Leerpad

Na maanden van geruchten en vlak na de lancering van de nieuwe GPT-5.5 en Claude Opus 4.7 heeft DeepSeek eindelijk DeepSeek V4 uitgebracht. De release komt in de vorm van twee previewmodellen, V4-Pro en V4-Flash, die de markt betreden met agressieve prijzen en prestaties dicht bij de top.

DeepSeek V4-Pro pronkt met in totaal 1,6 biljoen parameters en standaard een contextvenster van 1 miljoen tokens. Volgens DeepSeek loopt het slechts 3 tot 6 maanden achter op state-of-the-art gesloten modellen, terwijl het een fractie kost van concurrenten zoals OpenAI en Anthropic.

In dit artikel bespreek ik de release van DeepSeek V4, met de belangrijkste functies, benchmarkprestaties en hoe het zich verhoudt tot de concurrentie. Bekijk ook onze gidsen voor GPT-5.5 en Claude Opus 4.7. Voor een gedetailleerde vergelijking lees je onze artikelen over DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 en DeepSeek V4 Flash vs GPT-5.4 mini en nano.

DeepSeek V4 in een notendop

- V4 komt in twee varianten: Pro (1,6T parameters) en Flash (284B parameters).

- Beide modellen hebben standaard een contextvenster van 1 miljoen tokens.

- Pro kost $1,74 input / $3,48 output per miljoen tokens en is daarmee veel goedkoper dan GPT-5.5 en Opus 4.7.

- Beschikbaar via API, webinterface en open weights (MIT-licentie).

Wat is DeepSeek V4?

DeepSeek V4 is de langverwachte nieuwe reeks open-weight large language models van het Chinese AI-lab DeepSeek. Uitgebracht op 24 april 2026, komt de V4-serie in twee versies: DeepSeek-V4-Pro en DeepSeek-V4-Flash. Beide modellen maken gebruik van een Mixture of Experts (MoE)-architectuur en bieden standaard een enorm contextvenster van 1 miljoen tokens.

Wat DeepSeek V4 tot een grote release voor de sector maakt, is de combinatie van prestaties dicht bij de top en supercompetitieve prijzen. Het V4-Pro-model heeft in totaal 1,6 biljoen parameters (49 miljard actief) en is daarmee het grootste open-weights-model dat momenteel beschikbaar is.

Ondanks zijn omvang beweert DeepSeek dat het slechts 3 tot 6 maanden achterloopt op state-of-the-art gesloten modellen, terwijl het een fractie kost van concurrenten zoals OpenAI en Anthropic.

Belangrijkste functies van DeepSeek V4

Laten we enkele opvallende functies van de nieuwste release bekijken:

Structurele innovatie en 1M-contextefficiëntie

De opvallendste eigenschap van DeepSeek V4 is de zeer efficiënte omgang met lange context.

Volgens de technische aantekeningen gebruikt de V4-serie een Hybrid Attention-architectuur die Compressed Sparse Attention (CSA) en Heavily Compressed Attention (HCA) combineert.

Door deze structurele wijzigingen is een context van 1 miljoen tokens nu de standaard in alle DeepSeek-diensten.

DeepSeek claimt dat DeepSeek-V4-Pro in een scenario met 1M tokens slechts 27% van de single-token inference FLOPs en slechts 10% van de KV-cache nodig heeft in vergelijking met zijn voorganger, DeepSeek-V3.2.

Drie modi voor redeneerinspanning

Om je fijnmazige controle te geven over latency en prestaties, bevat DeepSeek V4 drie redeneermodi:

- Non-think: Snelle, intuïtieve antwoorden voor dagelijkse routinetaken en beslissingen met laag risico.

- Think High: Bewuste logische analyse die trager is maar zeer nauwkeurig voor complexe probleemoplossing.

- Think Max: Drijft de redeneercapaciteiten tot het uiterste om de grenzen van het model te verkennen.

Verbeterde agentische mogelijkheden

DeepSeek V4 is kennelijk geoptimaliseerd voor agentisch coderen. Volgens de releasenotes integreert het naadloos met toonaangevende AI-agenten zoals Claude Code, OpenClaw en OpenCode, en het stuurt al DeepSeeks interne agentische codeer-infrastructuur aan.

Geavanceerde trainingsoptimalisaties

Onder de motorkap introduceerde DeepSeek Manifold-Constrained Hyper-Connections (mHC) om residuele verbindingen te versterken en signaalpropagatie te stabiliseren. Ze stapten ook over op de Muon Optimizer voor snellere convergentie en grotere trainingsstabiliteit, waarbij de modellen zijn voorgetraind op meer dan 32 biljoen diverse tokens.

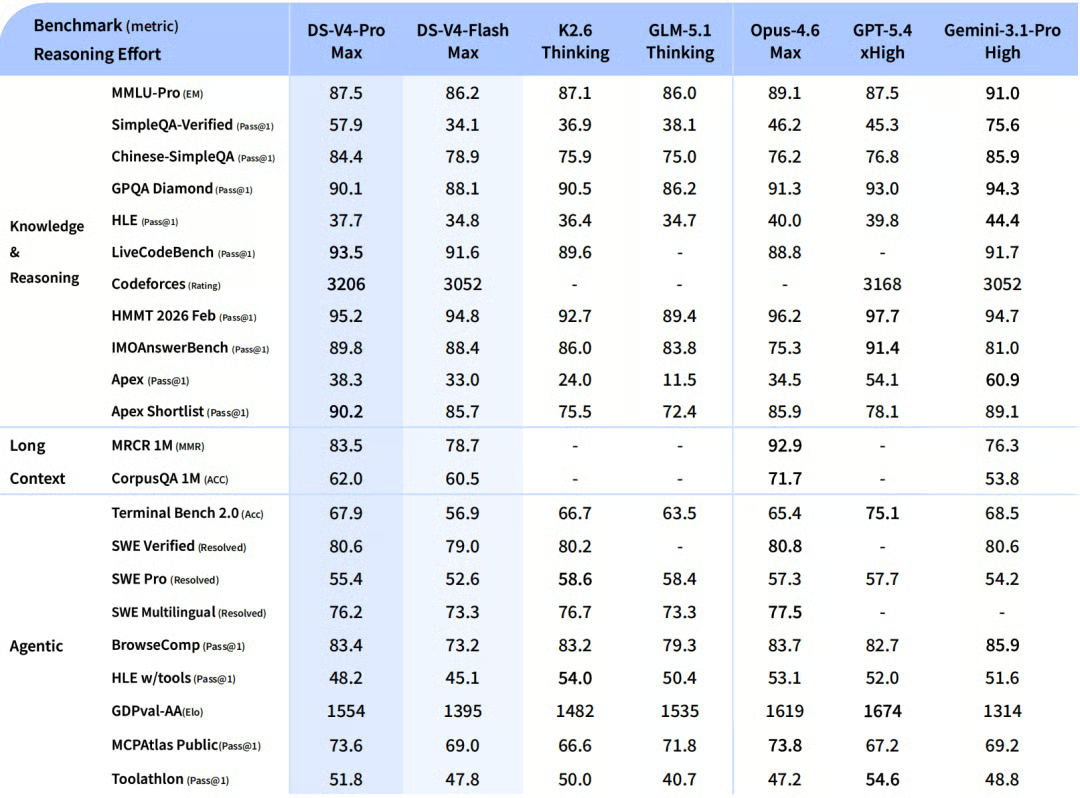

DeepSeek V4-benchmarks

Volgens de interne resultaten van DeepSeek laat DeepSeek V4 indrukwekkende prestaties zien, vooral wanneer het tot zijn maximale redeneergrenzen wordt gepusht (DeepSeek-V4-Pro-Max).

Volgens de officiële releasenotes verhoudt het model zich als volgt tot de bredere industrie:

Kennis en redeneren

Pro-Max presteert moeiteloos beter dan andere open-sourcemodellen en klopt oudere grensmodellen zoals GPT-5.2. Het scoort een zeer competitieve 87,5% op MMLU-Pro en 90,1% op GPQA Diamond, naast een enorme 92,6% op GSM8K voor wiskunde. Hoewel het nog steeds enkele maanden achterloopt op de absolute voorhoede (GPT-5.4 en Gemini-3.1-Pro), is de kennisachterstand aanzienlijk kleiner geworden.

Agentische taken

Pro-Max is vergelijkbaar met toonaangevende open modellen en behaalt 67,9% op Terminal Bench 2.0 en 55,4% op SWE-Bench Pro. Hoewel het net iets onder de nieuwste gesloten modellen scoort op publieke ranglijsten, tonen interne tests aan dat het Claude Sonnet 4.5 verslaat en in de buurt komt van Opus 4.5.

Lange context

Het contextvenster van 1 miljoen tokens is niet alleen voor de show. Pro-Max levert hier ongelooflijk sterke resultaten, met een score van 83,5% op MRCR 1M (MMR) needle-in-a-haystack-retrievaltests. Dit overtreft zelfs Gemini-3.1-Pro op academische long-context-benchmarks.

DeepSeek V4 Pro vs Flash

Vanwege zijn kleinere omvang scoort Flash-Max logischerwijs lager op pure kennis en heeft het moeite met de meest complexe agentworkflows. Maar als je het een groter "denkbudget" geeft, behaalt het redeneerscores die vergelijkbaar zijn met oudere grensmodellen, wat het een ongelooflijk kostenefficiënte optie maakt voor zware workloads.

Hoe krijg ik toegang tot DeepSeek V4?

Er zijn op dit moment verschillende manieren om toegang te krijgen tot DeepSeek V4:

- Webinterface: Je kunt beide modellen meteen uitproberen op chat.deepseek.com via Instant Mode of Expert Mode.

- API-toegang: De API is vandaag beschikbaar. Ontwikkelaars hoeven alleen hun modelparameter bij te werken naar

deepseek-v4-proofdeepseek-v4-flash. De API behoudt compatibiliteit met zowel OpenAI ChatCompletions- als Anthropic-API-formaten. (Let op: de verouderde modellendeepseek-chatendeepseek-reasonerworden uitgefaseerd op 24 juli 2026). - Open weights: Beide modellen zijn uitgebracht onder de MIT-licentie. Je kunt de weights rechtstreeks downloaden van Hugging Face of ModelScope. Pro is een download van 865 GB, terwijl Flash een veel beter behapbare 160 GB is.

DeepSeek V4 vs concurrenten

In de afgelopen week zagen we de release van OpenAI's GPT-5.5 en Anthropics Claude Opus 4.7. Hoewel die modellen topprestaties bieden, vooral in long-context-redeneren en agentisch coderen, concurreert DeepSeek V4 sterk op waarde en open toegankelijkheid.

Zo verhoudt DeepSeek-V4-Pro zich tot de nieuwe vlaggenschipmodellen van OpenAI en Anthropic:

|

Functie/Benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

API-prijzen (Input / Output per 1M) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Contextvenster |

1M tokens |

~1M tokens |

~1M tokens |

|

SWE-bench Pro (coderen) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (agentisch) |

67,9% |

82,7% |

69,4% |

|

Open weights |

Ja (MIT-licentie) |

Nee (gesloten) |

Nee (gesloten) |

Opmerking: Voor gebruikers met een krap budget kost DeepSeek V4 Flash slechts $0,14 per 1M inputtokens en $0,28 per 1M outputtokens, en is daarmee zelfs goedkoper dan kleine modellen zoals GPT-5.4 Nano.

Hoe goed is DeepSeek V4?

DeepSeek V4 is een enorm disruptieve release. Volgens de door DeepSeek gerapporteerde benchmarks loopt het Pro-model slechts 3 tot 6 maanden achter op state-of-the-art grensmodellen (zoals GPT-5.4 en Gemini-3.1-Pro) in ontwikkeltraject.

Kijk je echter naar de bredere context van de sector, dan is ruwe performance maar de helft van het verhaal. Het grote nieuws van DeepSeek V4 zit in de ultrahoge contextefficiëntie en messcherpe prijzen.

Met capaciteiten dicht bij de top, waaronder een contextvenster van 1M tokens, en dat voor een fractie van de kosten van GPT-5.5 of Opus 4.7, is DeepSeek V4 de meest overtuigende optie voor grootschalige enterprise-taken, open-sourceresearchers en prijsbewuste ontwikkelaars.

Toepassingen van DeepSeek V4

Met die sterke punten in het achterhoofd zijn dit een paar gebieden waar V4 uitblinkt:

- Geautomatiseerde software-engineering: Sterke agentische benchmarks en integratie met tools zoals OpenClaw maken V4-Pro een solide kandidaat voor autonome refactoring en debugging van codebases.

- Documentverwerking op grote schaal: De lagere kosten bij 1M-token-contextberekeningen betekenen dat financieel analisten en juridische teams stapels pdf's, 10-K's en contracten voor een prikkie kunnen verwerken.

- Lokale deployment en onderzoek: Omdat het een MIT-licentie gebruikt, kunnen onderzoekers quantization uitvoeren (vooral op het 160GB Flash-model) om lokaal te experimenteren met AI op grensniveau op high-end consumentenhardware.

Slotgedachten

DeepSeek V4 is een enorme stap vooruit voor de open-source AI-community. Hoewel GPT-5.5 en Claude Opus 4.7 het op de allerzwaarste codeer- en redeneerbenchmarks nipt kunnen winnen, democratiseert DeepSeek V4 de toegang tot contextvensters van 1 miljoen tokens en complexe agentische workflows.

Wil je vooroplopen en leren hoe je deze geavanceerde modellen in je eigen workflows implementeert? Bekijk dan zeker een aantal van onze resources. Met name onze cursus Understanding Prompt Engineering om te verfijnen hoe je met modellen zoals DeepSeek communiceert, of onze AI Agent Fundamentals-skilltrack als je schaalbare agentische systemen wilt gaan bouwen.

DeepSeek V4 FAQ's

Is DeepSeek V4 open-source?

Ja. Zowel DeepSeek-V4-Pro als DeepSeek-V4-Flash zijn open-weight-modellen die zijn uitgebracht onder de zeer permissieve MIT-licentie. Dit stelt ontwikkelaars en onderzoekers in staat de modellen commercieel te gebruiken, aan te passen en te deployen.

Wat is het contextvenster voor DeepSeek V4?

Zowel de Pro- als de Flash-modellen hebben standaard een contextvenster van 1 miljoen tokens. Dankzij de nieuwe Hybrid Attention-architectuur gaat DeepSeek V4 met een fractie van de reken- en geheugenkosten van oudere modellen met deze enorme context om.

Wat kost de DeepSeek V4 API?

De prijzen zijn zeer competitief. DeepSeek-V4-Flash kost slechts $0,14 per 1M inputtokens en $0,28 per 1M outputtokens. DeepSeek-V4-Pro kost $1,74 per 1M inputtokens en $3,48 per 1M outputtokens.

Hoe groot zijn de DeepSeek V4-modellen?

DeepSeek gebruikt een Mixture of Experts (MoE)-architectuur. Het Pro-model bevat in totaal 1,6 biljoen parameters (49 miljard actief) en vereist een download van 865 GB. Het Flash-model bevat 284 miljard parameters (13 miljard actief) en vereist een download van 160 GB.

Verslaat DeepSeek V4 GPT-5.5 en Claude Opus 4.7?

In pure capaciteit niet. Volgens de door DeepSeek zelf gerapporteerde data loopt het V4-Pro-model ongeveer 3 tot 6 maanden achter op state-of-the-art gesloten modellen bij de zwaarste codeer- en redeneerbenchmarks. Het levert echter prestaties dicht bij de top voor ongeveer een derde van de API-kosten, wat het zeer disruptief maakt.

Senior redacteur in AI en edtech. Toegewijd aan het verkennen van data- en AI-trends.