Tracks

数か月にわたる噂を経て、GPT-5.5 と Claude Opus 4.7 の発表直後に、DeepSeek はついに DeepSeek V4 を公開しました。V4-Pro と V4-Flash という 2 つのプレビューモデルとしてリリースされ、攻めた価格設定とフロンティアに迫る性能で市場に登場しています。

DeepSeek V4-Pro は合計 1.6 兆パラメータ、デフォルトで 100 万トークンのコンテキストウィンドウを備えています。DeepSeek は、OpenAI や Anthropic のような競合と比べてコストが大幅に低い一方で、最先端のクローズドモデルに 3〜6 か月遅れる程度だと主張しています。

本記事では、DeepSeek V4 のリリース概要として、主要な機能、ベンチマーク性能、競合との比較を取り上げます。あわせて GPT-5.5 と Claude Opus 4.7 のガイドもご覧ください。詳細な比較は、DeepSeek V4 と GPT-5.5 の比較、Claude Opus 4.7 と DeepSeek V4 の比較、および DeepSeek V4 Flash と GPT-5.4 mini / nano の比較をご確認ください。

DeepSeek V4 の概要

- V4 は 2 種類:Pro(1.6 兆パラメータ)と Flash(2840 億パラメータ)。

- 両モデルともデフォルトで 100 万トークンのコンテキストウィンドウを搭載。

- Pro は 100 万トークンあたり入力 $1.74/出力 $3.48。GPT-5.5 や Opus 4.7 を大きく下回る価格。

- API、ウェブインターフェース、オープンウェイト(MIT ライセンス)で提供。

DeepSeek V4 とは?

DeepSeek V4 は、中国の AI 研究所 DeepSeek による、オープンウェイトの大規模言語モデル新シリーズです。2026 年 4 月 24 日にリリースされ、DeepSeek-V4-Pro と DeepSeek-V4-Flash の 2 バージョンがあります。両モデルは Mixture of Experts(MoE)アーキテクチャを採用し、デフォルトで 100 万トークンの大規模コンテキストを提供します。

DeepSeek V4 が業界にとって大きな意味を持つのは、フロンティアに迫る性能と極めて競争力の高い価格設定を組み合わせている点です。V4-Pro は合計 1.6 兆パラメータ(アクティブ 490 億)を誇り、現時点で入手可能な最大規模のオープンウェイトモデルとなっています。

この規模にもかかわらず、DeepSeek は OpenAI や Anthropic といった競合の価格のごく一部で、最先端のクローズドモデルに 3〜6 か月遅れる程度だと主張しています。

DeepSeek V4 の主な機能

今回のリリースで際立つ特徴を見ていきましょう。

構造的な革新と 100 万トークン文脈での効率性

DeepSeek V4 の特長は、長大なコンテキストを非常に効率よく処理できる点です。

技術ノートによれば、V4 シリーズは Compressed Sparse Attention(CSA)と Heavily Compressed Attention(HCA)を組み合わせたハイブリッド・アテンション・アーキテクチャを採用しています。

これらの構造的変更により、DeepSeek のすべてのサービスで 100 万トークンのコンテキストが標準となりました。

DeepSeek によれば、100 万トークンのコンテキスト環境では、DeepSeek-V4-Pro は単一トークン推論の FLOPs を従来比 27%、KV キャッシュを 10% にまで削減でき、前世代の DeepSeek-V3.2 と比べて大幅な効率化を達成しています。

3 つの推論モード

レイテンシと性能をきめ細かく制御できるよう、DeepSeek V4 には 3 つの推論モードがあります。

- Non-think:日常的な作業やリスクの低い判断に向いた、迅速で直感的な応答。

- Think High:論理的分析を明示的に行うため、遅いが複雑な問題解決に高精度。

- Think Max:モデルの能力の限界に迫る思考を行い、可能性の境界を探るモード。

強化されたエージェント機能

DeepSeek V4 はエージェント型コーディング向けに最適化されているようです。リリースノートによれば、Claude Code、OpenClaw、OpenCode といった主要な AI エージェントとシームレスに統合されており、すでに DeepSeek 社内のエージェント型コーディング基盤を支えています。

高度な学習最適化

内部的には、DeepSeek は残差接続を強化し信号伝播を安定化するために Manifold-Constrained Hyper-Connections(mHC) を導入しました。また、収束の高速化と学習の安定性向上のため Muon Optimizer に切り替え、3.2 兆超の多様なトークンで事前学習を行っています。

DeepSeek V4 のベンチマーク

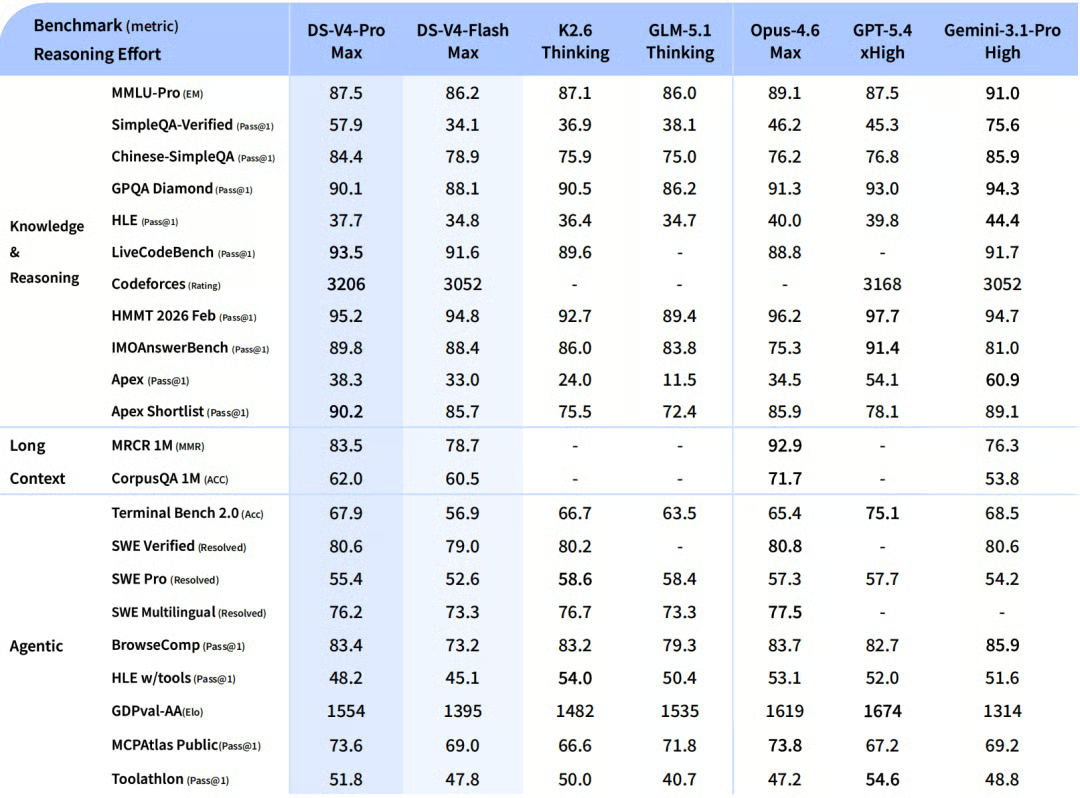

DeepSeek の社内結果によれば、DeepSeek V4 はとりわけ推論能力を最大限に引き出した設定(DeepSeek-V4-Pro-Max)で、非常に優れた性能を示しています。

公式リリースノートに基づくと、業界全体との比較は次のとおりです。

知識と推論

Pro-Max は他のオープンソースモデルを容易に上回り、GPT-5.2 のような一世代前のフロンティアモデルにも勝ります。MMLU-Pro で 87.5%、GPQA Diamond で 90.1%、さらに数学の GSM8K で 92.6% を記録するなど、非常に競争力があります。最先端(GPT-5.4 や Gemini-3.1-Pro)には数か月遅れるものの、知識面のギャップは大きく縮小しました。

エージェントタスク

Pro-Max は有力なオープンモデルと同等で、Terminal Bench 2.0 で 67.9%、SWE-Bench Pro で 55.4% を達成。公開リーダーボードでは最新のクローズドモデルにわずかに及ばないものの、社内テストでは Claude Sonnet 4.5 を上回り、Opus 4.5 に迫る水準を示しています。

長文脈

100 万トークンのウィンドウは見せかけではありません。Pro-Max はここでも非常に強力で、MRCR 1M(MMR)の「干し草の山から針を探す」型リトリーバルテストで 83.5% を記録。学術系の長文脈ベンチマークでは、実際に Gemini-3.1-Pro を上回っています。

DeepSeek V4 Pro と Flash の比較

Flash-Max は小型であるがゆえに、知識の純粋な指標では当然スコアが低く、最も複雑なエージェントワークフローでは苦戦します。しかし、より大きな「思考予算」を与えると、旧世代のフロンティアモデルに匹敵する推論スコアに到達し、大規模ワークロードに対して非常に費用対効果の高い選択肢となります。

DeepSeek V4 へのアクセス方法

現在、DeepSeek V4 にアクセスする方法はいくつかあります。

- ウェブインターフェース:chat.deepseek.com で Instant Mode または Expert Mode を使い、両モデルをすぐに試せます。

- API アクセス:API は本日利用可能です。開発者はモデル指定を

deepseek-v4-proまたはdeepseek-v4-flashに更新するだけです。API は OpenAI ChatCompletions と Anthropic の API 形式の両方と互換性を維持します。(注:レガシーのdeepseek-chatおよびdeepseek-reasonerモデルは 2026 年 7 月 24 日に廃止予定) - オープンウェイト:両モデルは MIT ライセンスで公開されています。Hugging Face または ModelScope から直接ウェイトをダウンロードできます。Pro は 865GB、Flash はより扱いやすい 160GB のダウンロードサイズです。

DeepSeek V4 と競合の比較

直近 1 週間で、OpenAI の GPT-5.5 と Anthropic の Claude Opus 4.7 がリリースされました。これらのモデルは、特に長文脈推論やエージェント型コーディングで最上位の性能を誇りますが、DeepSeek V4 は価値とオープンなアクセス性で強力に競合します。

OpenAI と Anthropic の新たなフラッグシップモデルに対して、DeepSeek-V4-Pro は次のように比較できます。

|

機能/ベンチマーク |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

API 価格(100 万あたり 入力/出力) |

$1.74 / $3.48 |

$5.00 / $30.00 |

$5.00 / $25.00 |

|

コンテキストウィンドウ |

100 万トークン |

約 100 万トークン |

約 100 万トークン |

|

SWE-bench Pro(コーディング) |

55.4% |

58.6% |

64.3% |

|

Terminal-Bench 2.0(エージェント) |

67.9% |

82.7% |

69.4% |

|

オープンウェイト |

はい(MIT ライセンス) |

いいえ(クローズド) |

いいえ(クローズド) |

注:コスト重視の場合、DeepSeek V4 Flash は 100 万入力トークンあたりわずか $0.14、100 万出力トークンあたり $0.28 と、GPT-5.4 Nano のような小型モデルさえ下回ります。

DeepSeek V4 はどれほど優れているか?

DeepSeek V4 は非常にディスラプティブなリリースです。DeepSeek の自己申告ベンチマークによれば、Pro モデルは開発トレンド上で最先端のフロンティアモデル(GPT-5.4 や Gemini-3.1-Pro など)に 3〜6 か月遅れる程度です。

ただし業界全体の文脈で見ると、生の性能はあくまで半分の話にすぎません。DeepSeek V4 の最大の目玉は、超高いコンテキスト効率と破壊的な低価格にあります。

100 万トークンのコンテキストウィンドウを含むフロンティア級の能力を、GPT-5.5 や Opus 4.7 のごく一部のコストで提供できるため、DeepSeek V4 は大量処理を行う企業、オープンソース研究者、コスト重視の開発者にとって最有力の選択肢となります。

DeepSeek V4 のユースケース

これらの強みを踏まえると、V4 が特に力を発揮する分野は次のとおりです。

- 自動化されたソフトウェアエンジニアリング:強力なエージェント系ベンチマークと OpenClaw などのツール統合により、V4-Pro は自律的なコードベースのリファクタリングやデバッグの有力候補です。

- 大量のドキュメント処理:100 万トークン文脈での計算コスト削減により、金融アナリストや法務チームは PDF、10-K、契約書といった大量ドキュメントを低コストで処理できます。

- ローカル展開と研究:MIT ライセンスのため、研究者は(特に 160GB の Flash モデルで)量子化を行い、ハイエンド民生ハードウェア上でフロンティア級の AI をローカルに実験できます。

まとめ

DeepSeek V4 はオープンソース AI コミュニティにとって大きな前進です。GPT-5.5 や Claude Opus 4.7 が、最難関のコーディングや推論ベンチマークで一歩先行する場面はあるものの、DeepSeek V4 は 100 万トークンのコンテキストウィンドウや高度なエージェント型ワークフローへのアクセスを民主化しました。

先端を走り続け、これらの最先端モデルを自身のワークフローに実装する方法を学びたい場合は、当社のリソースをぜひご覧ください。特に、DeepSeek などのモデルとの対話を洗練するための Understanding Prompt Engineering コースや、スケーラブルなエージェント型システムの構築を始めたい方向けの AI Agent Fundamentals スキルトラックがおすすめです。

DeepSeek V4 よくある質問

DeepSeek V4 はオープンソースですか?

はい。DeepSeek-V4-Pro と DeepSeek-V4-Flash はいずれも、非常に寛容な MIT ライセンスの下で公開されたオープンウェイトモデルです。これにより、開発者や研究者は商用利用を含め、モデルの使用・改変・デプロイが可能です。

DeepSeek V4 のコンテキストウィンドウは?

Pro と Flash の両モデルは、デフォルトで 100 万トークンのコンテキストウィンドウを備えています。新しいハイブリッド・アテンション・アーキテクチャにより、DeepSeek V4 は従来モデルの一部の計算・メモリコストで、この巨大なコンテキストを処理します。

DeepSeek V4 の API 料金はいくらですか?

価格は非常に競争力があります。DeepSeek-V4-Flash は 100 万入力トークンあたり $0.14、100 万出力トークンあたり $0.28。DeepSeek-V4-Pro は 100 万入力トークンあたり $1.74、100 万出力トークンあたり $3.48 です。

DeepSeek V4 モデルのサイズはどれくらいですか?

DeepSeek は Mixture of Experts(MoE)アーキテクチャを採用しています。Pro モデルは合計 1.6 兆パラメータ(アクティブ 490 億)で、ダウンロードサイズは 865GB。Flash モデルは 2840 億パラメータ(アクティブ 130 億)で、ダウンロードサイズは 160GB です。

DeepSeek V4 は GPT-5.5 や Claude Opus 4.7 を上回りますか?

純粋な能力では、いいえ。DeepSeek の自己申告データによれば、V4-Pro は最難関のコーディングや推論ベンチマークで、最先端のクローズドモデルに約 3〜6 か月遅れています。ただし、API コストは約 3 分の 1 でフロンティア級の性能を提供しており、非常に破壊的です。