Programa

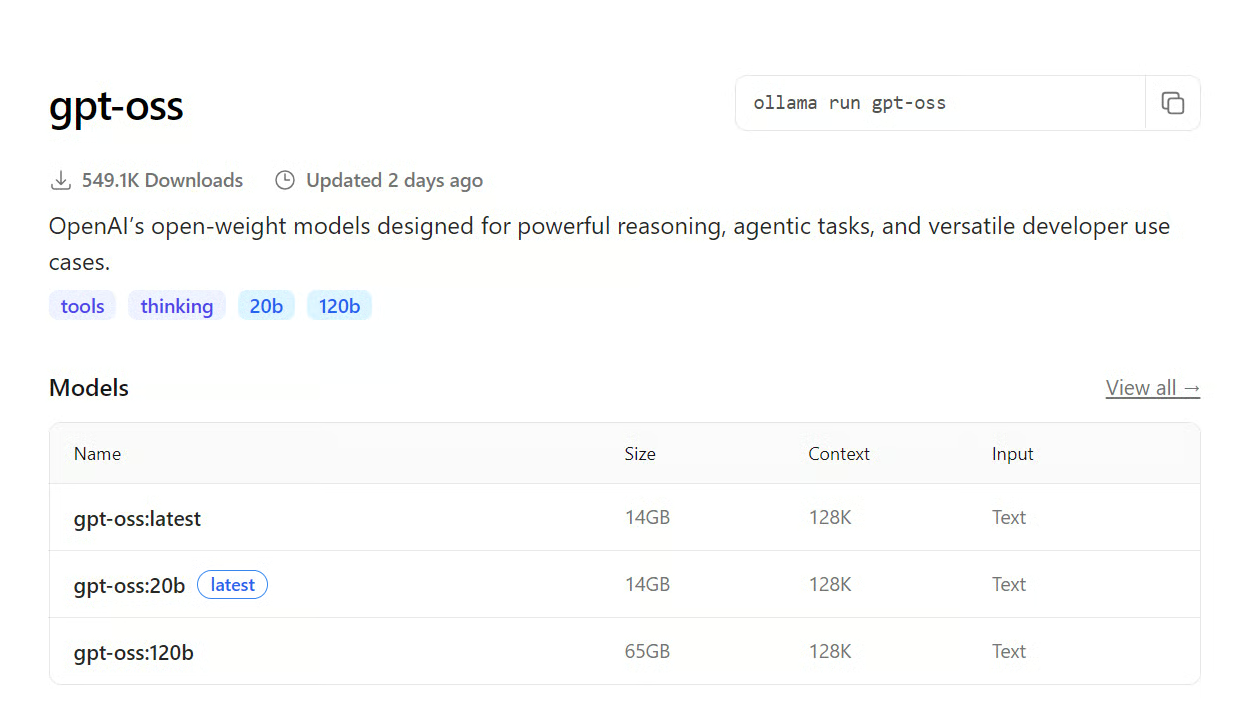

A OpenAI lançou recentemente modelos de peso aberto feitos pra raciocínio poderoso, tarefas de agência e casos de uso versáteis pra desenvolvedores. Esses modelos vêm em duas versões: gpt-oss-120b e gpt-oss-20b. O modelo menor pode ser rodado localmente em GPUs de consumo, enquanto rodarum gpt-oss-120b em precisa de 80 GB de VRAM e uma configuração de computação mais robusta, que muitos usuários podem não ter.

Pra ajudar, eu fiz uma lista de maneiras fáceis e de graça pra acessar o modelo maior. Você pode rodar o modelo localmente usando Ollama, Transformers ou a estrutura vLLM. Também tem aplicativos de chat grátis onde você pode testar o modelo, além de vários provedores de inferência de modelo de linguagem grande (LLM) rápidos e grátis que você pode experimentar. Além disso, você pode visitar o marketplace LLM para encontrar as melhores opções para o seu caso. Dá uma olhada no nosso guia separado sobre como configurar e executar o GPT-OSS localmente com o Ollama.

Código aberto

O OpenAI GPT-OSS é uma série de modelos de peso aberto que permite que os usuários baixem e executem em qualquer sistema. Você também pode usá-lo localmente para criar aplicativos e projetos. Esse modelo está disponível tanto para uso comercial quanto para uso em código aberto.

Nesta parte, vamos aprender a rodar o modelo grande GPT-OSS-120B em hardware de consumo.

1. Ollama

Com o Ollama, você não precisa necessariamente de uma GPU; você pode rodar o modelo inteiramente na sua CPU e RAM. Mas, a geração de tokens vai ser bem mais lenta sem a aceleração da GPU.

Se você tem várias GPUs, pode passar algumas camadas do modelo para a GPU, o que vai melhorar bastante a velocidade de geração. Isso precisa de um pouco de conhecimento técnico e configuração pra funcionar direitinho.

Fonte: gpt-oss

Pra começar, instala o Ollama no Linux.

curl -fsSL https://ollama.com/install.sh | sh Depois, dá um clique no seguinte comando pra baixar e rodar o gpt-oss-120b .

ollama run gpt-oss:120bÉ simples assim.

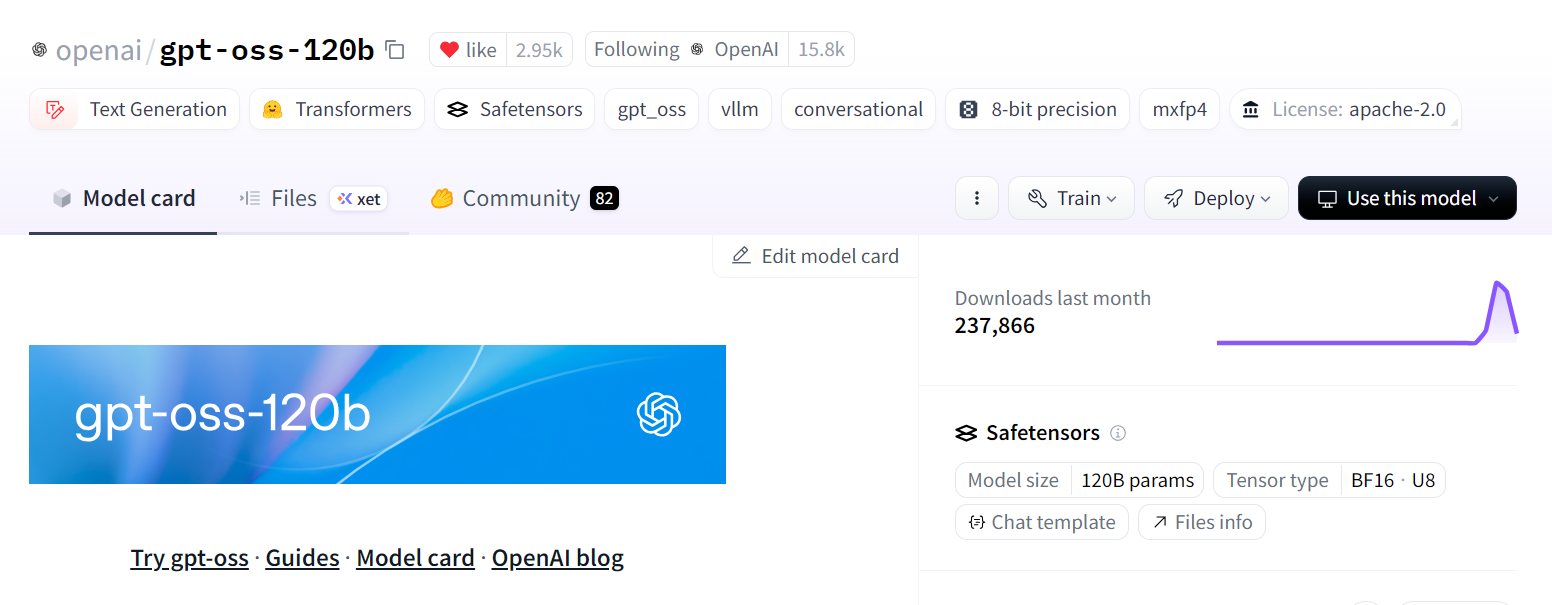

2. Transformadores

Com a biblioteca Transformers, você pode baixar e carregar o modelo, fazer inferências, ajustar o modelo e integrá-lo direto no seu aplicativo.

Para modelos com 120 bilhões de parâmetros, você vai precisar dividir o modelo em várias GPUs. Além disso, talvez você precise usar quantização de 8 bits ou 4 bits para ajustar o modelo à memória.

Se a sua VRAM ainda não for suficiente, você pode transferir algumas camadas para a CPU. Esse processo precisa de mais experiência e conhecimento técnico, mas se você já sabe o que fazer, dá pra fazer.

Fonte: openai/gpt-oss-120b

Instale os pacotes necessários:

pip install -U transformers kernels torchAqui vai um exemplo de como usar: Crie o pipeline de geração de texto, forneça um prompt e execute o pipeline para gerar uma resposta.

from transformers import pipeline

import torch

model_id = "openai/gpt-oss-120b"

pipe = pipeline(

"text-generation",

model=model_id,

torch_dtype="auto",

device_map="auto",

)

messages = [

{"role": "user", "content": "What is the best DataCamp course to learn AI?"},

]

outputs = pipe(

messages,

max_new_tokens=256,

)

print(outputs[0]["generated_text"][-1])3. vLLM

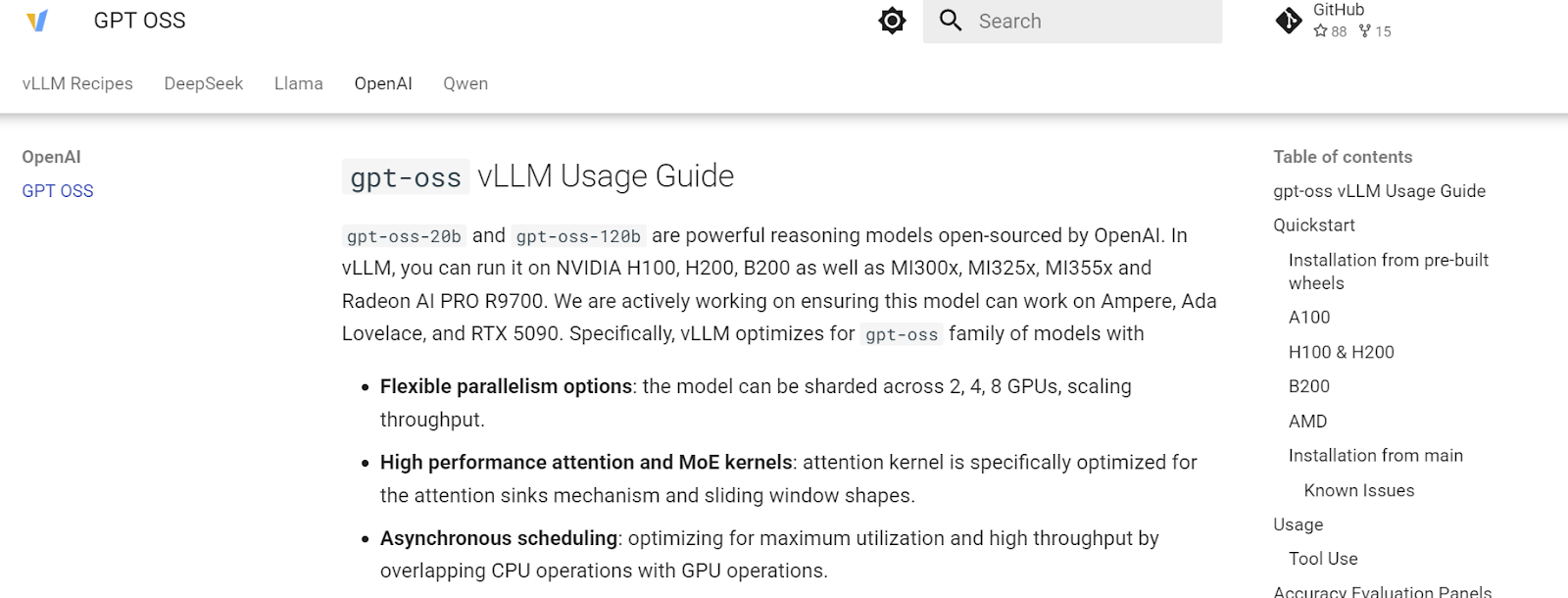

O vLLM é um mecanismo de inferência de alto desempenho feito especialmente para gerar textos rápido e com um monte de dados, o que o torna perfeito para usar em produção.

Ele pode ser usado de várias maneiras: no seu servidor local para desenvolvimento e testes, em uma nuvem privada para uso interno da empresa ou em pequenas empresas e startups que querem mais controle e privacidade dos dados sem depender de APIs externas.

Fonte: GPT OSS - Receitas vLLM

Use o uv pip pra instalar os pacotes Python mais rápido.

uv pip install --pre vllm==0.10.1+gptoss \

--extra-index-url https://wheels.vllm.ai/gpt-oss/ \

--extra-index-url https://download.pytorch.org/whl/nightly/cu128 \

--index-strategy unsafe-best-matchExecute o seguinte comando no seu terminal para baixar o modelo e iniciar o servidor vLLM:

vllm serve openai/gpt-oss-120bDepois de rodar, o vLLM vai começar um servidor API local (padrão: http://localhost:8000) que você pode consultar por meio de solicitações HTTP e integrar diretamente nas suas aplicações.

Aplicativos de bate-papo

Os aplicativos de chat com IA permitem que você experimente diferentes modelos sem precisar configurar nada. É só acessar o site e se cadastrar. Você pode aproveitar os recursos oferecidos por esses aplicativos.

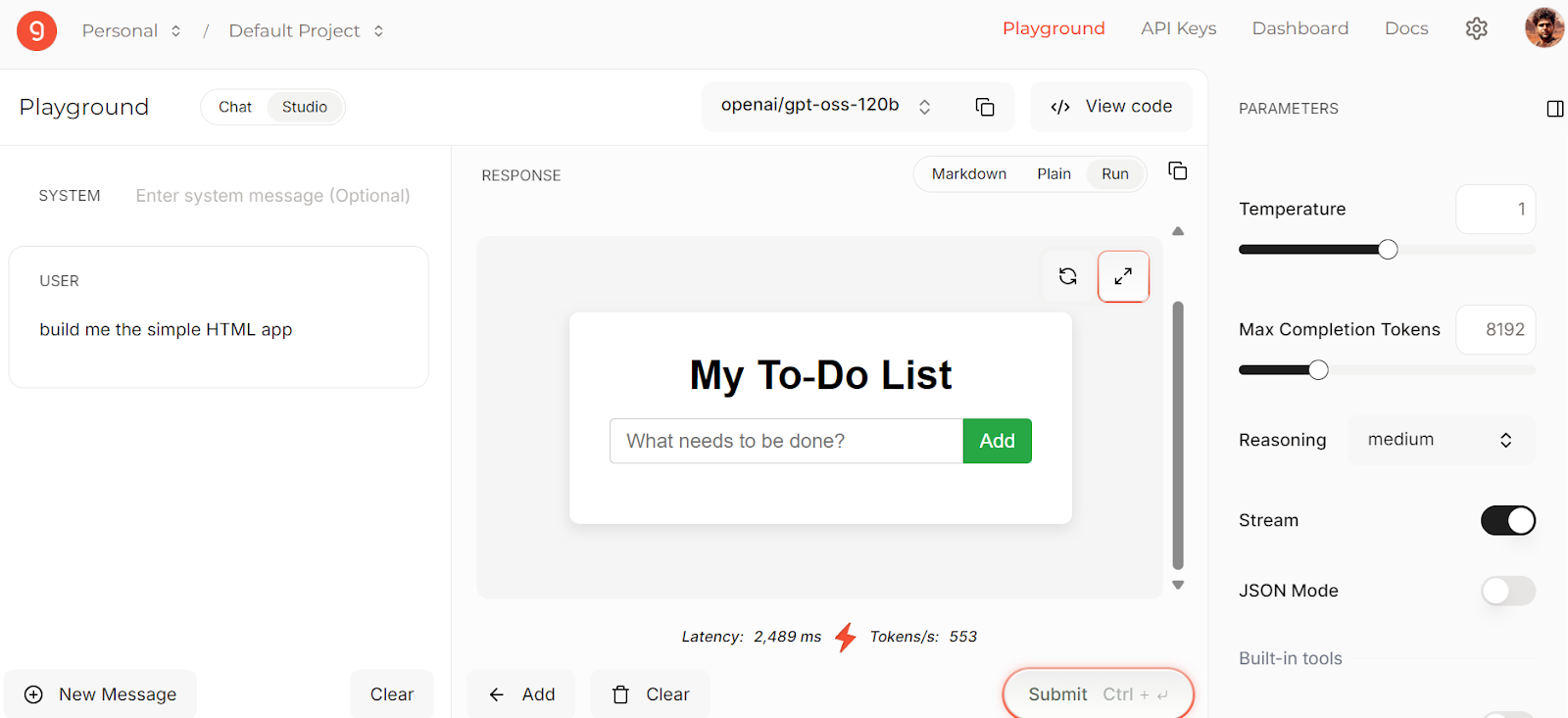

Nesta seção, vamos dar uma olhada no chat oficial e no aplicativo de chat T3, que oferecem acesso grátis aos novos modelos OpenAI GPT-OSS.

4. GPT-OSS.com

Gpt-oss é o site oficial onde você pode testar os dois modelos de código aberto da OpenAI. Ele foi criado em parceria com a Hugging Face, então você vai precisar entrar com sua conta da Hugging Face para desbloquear todos os recursos dos modelos.

Fonte: Gpt-oss

O app é totalmente grátis e você pode trocar quantas mensagens quiser. Você pode experimentar diferentes níveis de raciocínio, alternar entre modos e até mesmo pedir para ele criar um aplicativo web completo do zero. É super rápido e não precisa de configuração.

5. Bate-papo T3

Tenho curtido muito o T3 Chat desde que descobri. Ele dá acesso rapidinho a modelos de código aberto e proprietários. Pense nisso como um aplicativo no estilo ChatGPT, mas para todos os tipos de modelos de IA, incluindo geração de imagens, modelos de linguagem visual e grandes modelos de linguagem.

No momento, o T3 Chat dá acesso grátis ao GPT-OSS 20B e ao GPT-OSS 120B. Tudo que você precisa fazer é se cadastrar e começar a curtir acesso total a todos os recursos desses modelos.

Fonte: t3.chat

E o melhor de tudo? A interface é super simples e intuitiva, e os resultados aparecem de um jeito bem legal.

Provedores de inferência LLM

Os provedores de inferência hospedam grandes modelos de linguagem em seus próprios servidores e oferecem aos usuários acesso por API ou pela web, permitindo que eles integrem esses modelos diretamente em seus aplicativos sem precisar rodar um servidor de inferência em sua própria infraestrutura. Isso facilita para os desenvolvedores usarem modelos poderosos sem se preocupar com implantação, dimensionamento ou manutenção.

Nesta seção, vamos ver alguns provedores de inferência super rápidos e de graça que você pode usar agora mesmo para acessar a variante 120B do modelo GPT-OSS.

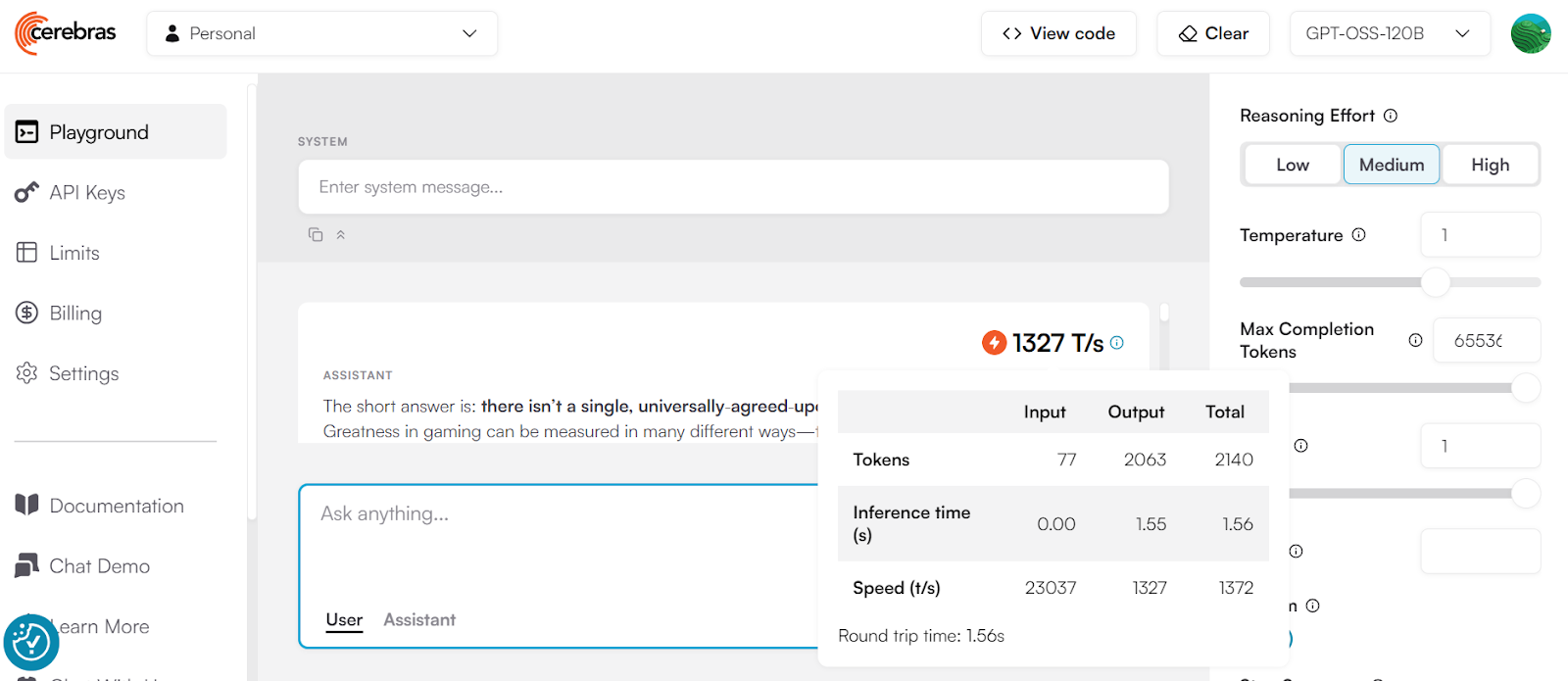

6. Cerebras

A Cerebras é um dos provedores de inferência LLM mais rápidos do mundo, capaz de entregar até 1.400 tokens por segundo com solicitações simultâneas. Isso faz dele uma escolha excelente pra construir sistemas de IA em tempo real, onde a velocidade é super importante.

Mas tem umas coisinhas pra pensar:

- Preços: Se você precisa de muitas solicitações, é melhor pegar um plano pago. O plano gratuito só dá acesso ao básico.

- Precisão: Embora o Cerebras seja super rápido, a qualidade do resultado pode variar. Alguns provedores de inferência otimizam a velocidade em detrimento da precisão.

Fonte: cerebras.ai

O Cerebras não é compatível com o SDK da OpenAI, então você vai precisar instalar o SDK deles:

pip install --upgrade cerebras_cloud_sdkDepois disso, crie o cliente usando a chave API, crie a função de conclusão do chat e, em seguida, gere a resposta como um fluxo.

import os

from cerebras.cloud.sdk import Cerebras

client = Cerebras(

# This is the default and can be omitted

api_key=os.environ.get("CEREBRAS_API_KEY")

)

stream = client.chat.completions.create(

messages=[

{

"role": "system",

"content": "Who was Leonardo Da Vinci?"

}

],

model="gpt-oss-120b",

stream=True,

max_completion_tokens=65536,

temperature=1,

top_p=1,

reasoning_effort="high"

)

for chunk in stream:

print(chunk.choices[0].delta.content or "", end="")7. Groq

Sou super fã do Groq porque eles oferecem pontos finais de inferência rápidos e acessíveis para modelos populares de código aberto. Agora, você pode usar a versão 120B do GPT-OSS da OpenAI de graça, mas com um limite de solicitações.

Você pode experimentar o modelo diretamente no Groq Studio antes de integrá-lo às suas aplicações, facilitando a experimentação e o ajuste fino das suas solicitações.

Fonte: Groq

O Groq é compatível com OpenAI, o que significa que você pode usar o SDK Python da OpenAI para acessar os modelos deles. Mas, a Groq também tem seu próprio SDK otimizado, que é mais adequado para a infraestrutura deles, e é isso que vamos usar aqui.

Instale o SDK do Groq:

pip install groqCrie o cliente Groq com a chave API e, em seguida, crie as conclusões do chat usando o nome do modelo e outros argumentos para transmitir a resposta.

from groq import Groq

client = Groq(

api_key=os.environ.get("GROQ_API_KEY"),

)

completion = client.chat.completions.create(

model="openai/gpt-oss-120b",

messages=[

{

"role": "user",

"content": "What is the meaning of life?"

}

],

temperature=1,

max_completion_tokens=8192,

top_p=1,

reasoning_effort="medium",

stream=True,

stop=None

)

for chunk in completion:

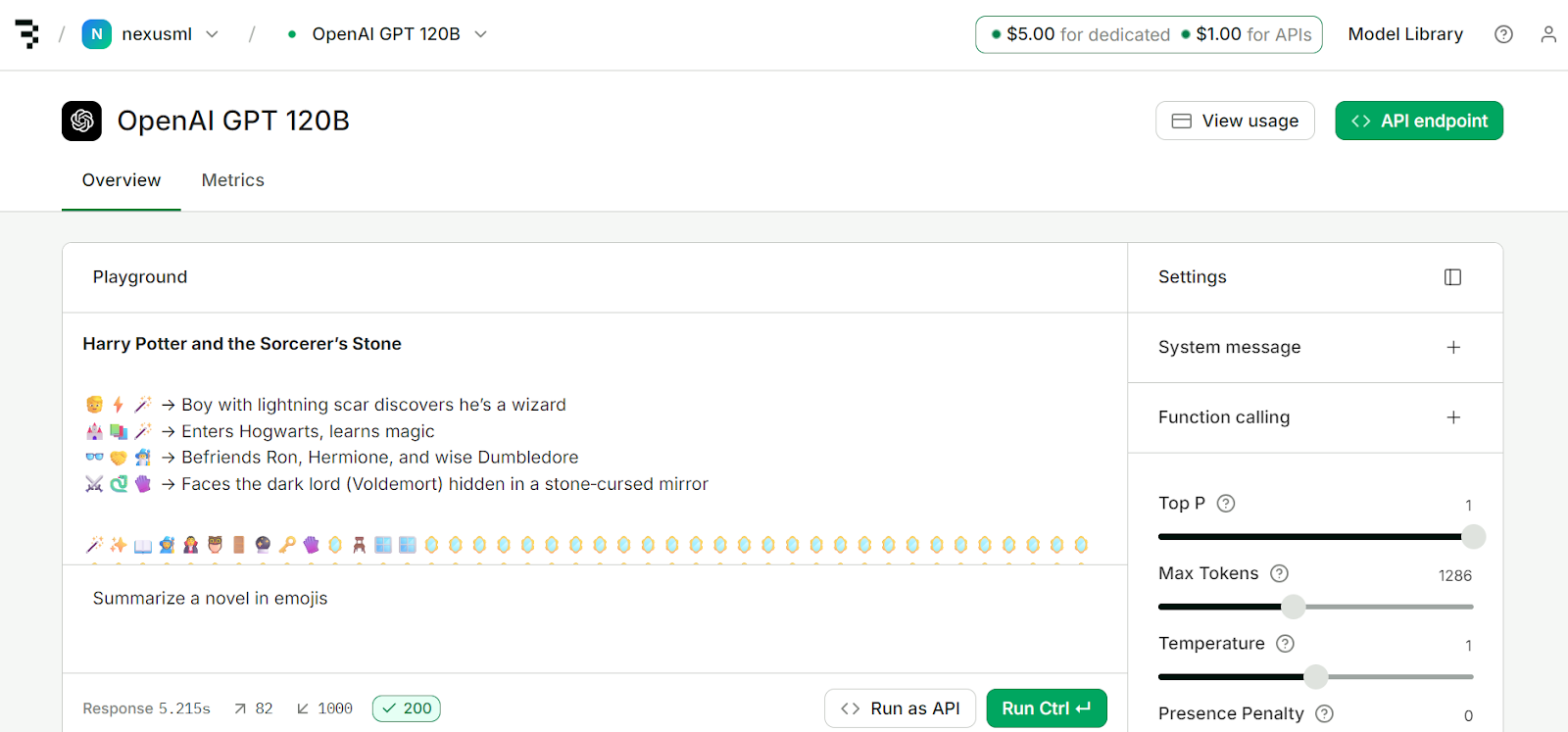

print(chunk.choices[0].delta.content or "", end="")8. Baseten

Baseten é uma plataforma poderosa de inferência e treinamento feita pra implantar, escalar e gerenciar modelos de IA com controle total. O melhor é que ele está no mesmo nível do Groq e do Cerebras em termos de velocidade de geração de tokens.

Quando você se inscreve, ganha US$ 5 de crédito de implantação e US$ 1 para acessar a API. Você pode usar esse dinheiro pra acessar os serviços da plataforma.

Fonte: API do modelo | Baseten

O Baseten é compatível com o OpenAI e não tem seu próprio SDK, então vamos usar o SDK Python do OpenAI para acessar o endpoint do modelo. Para fazer isso, você precisa instalar o pacote Python OpenAI:

pip install openaiDepois, crie o cliente usando sua chave API e URL base. Depois disso, você pode criar conclusões de bate-papo especificando o nome do modelo e outros parâmetros. Por fim, você pode gerar respostas em fluxo contínuo.

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("BASETEN_API_KEY"),

base_url="https://inference.baseten.co/v1"

)

response = client.chat.completions.create(

model="openai/gpt-oss-120b",

messages=[

{

"role": "user",

"content": "Implement Hello World in Python"

}

],

stop=[],

stream=True,

stream_options={

"include_usage": True,

"continuous_usage_stats": True

},

top_p=1,

max_tokens=1286,

temperature=1,

presence_penalty=0,

frequency_penalty=0

)

for chunk in response:

if chunk.choices and chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="", flush=True)

Mercado LLM

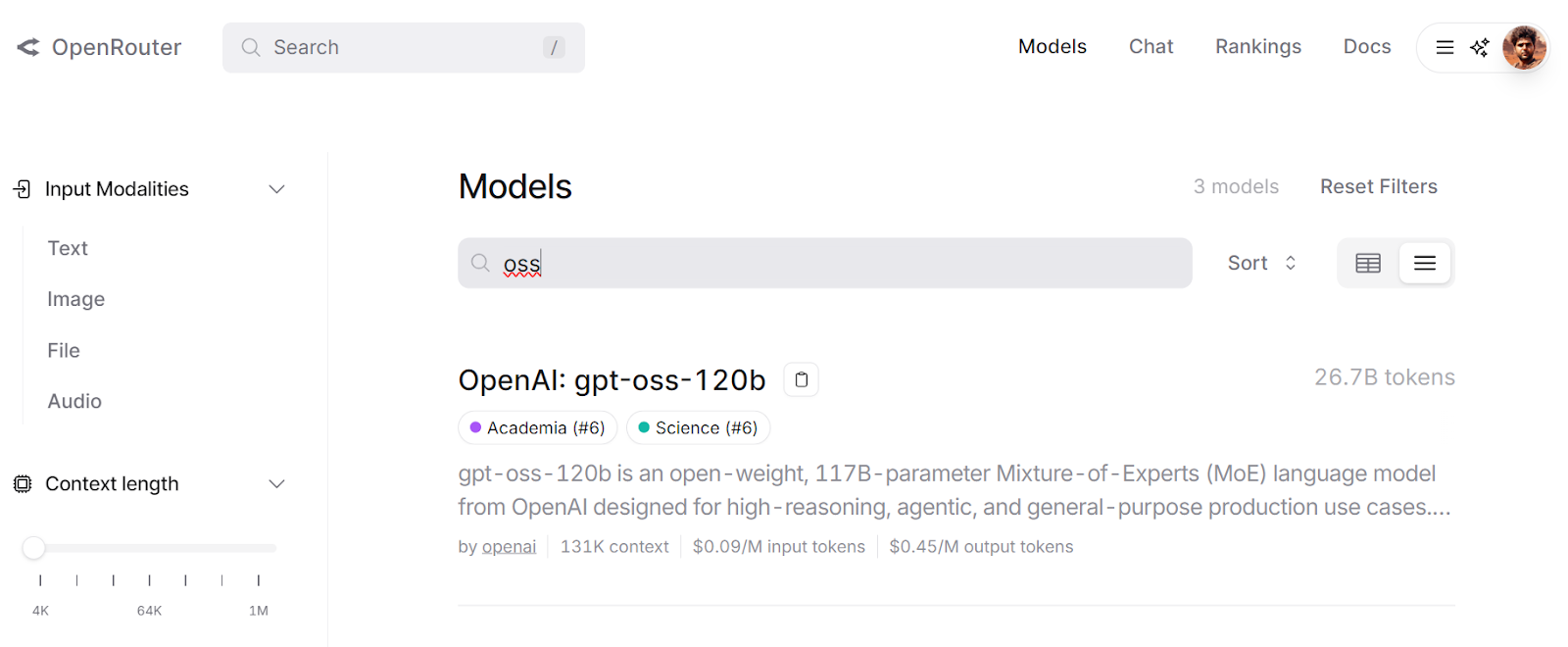

O mercado LLM permite que você acesse modelos de linguagem grandes, tanto de código aberto quanto fechado, em um só lugar. Todos os modelos de código aberto estão hospedados no OpenRouter, o que te permite usar uma API unificada sem se preocupar com custo, disponibilidade ou desempenho.

Nesta seção, vamos dar uma olhada em dois dos mercados LLM mais populares, o OpenRouter e o Requesty. As duas plataformas oferecem acesso grátis ao modelo GPT-OSS 12B.

9. OpenRouter

OpenRouter tem uma API unificada que te dá acesso a centenas de modelos de IA por meio de um único ponto de conexão. Ele cuida automaticamente dos fallbacks e escolhe as opções mais econômicas para suas solicitações.

Você pode experimentar diferentes modelos usando o LLM Playground, que permite testar e comparar resultados antes de integrá-los ao seu fluxo de trabalho.

Fonte: gpt-oss-120b

Integrar o OpenRouter é bem simples; basta acessar , mudar a URL base e colocar sua chave API. O resto da implementação continua igual à API OpenAI.

import os

from openai import OpenAI

client = OpenAI(

base_url="https://openrouter.ai/api/v1",

api_key=os.getenv("OPENROUTER_API_KEY"),

)

completion = client.chat.completions.create(

model="openai/gpt-oss-120b",

messages=[{"role": "user", "content": "What is the meaning of life?"}],

)

print(completion.choices[0].message.content)10. Pedido

O Requesty é parecido com o OpenRouter, mas ele encaminha suas solicitações de forma inteligente por mais de 170 modelos de IA, incluindo o GPT-OSS 120B. Isso ajuda você a:

- Reduza os custos da API

- Evite ficar preso a um SDK

- Acesse recursos avançados como cache automático, balanceamento de carga e políticas de fallback.

- Use uma interface simples que funciona com o OpenAI

Você pode ver os modelos no menu Chat, conferir o ranking, ver o painel de uso e adicionar integrações diretas.

Quando você se cadastra, ganha US$ 1 em créditos grátis, que dá pra experimentar até os modelos pagos.

Fonte: Pedido

Para integrar o Requesty, basta atualizar a URL base, a chave API e os cabeçalhos padrão no seu código OpenAI Python SDK.

Se você quiser usar um modelo grátis, certifique-se de escolher os que a Groq oferece.

import os

import openai

ROUTER_API_KEY = os.getenv("REQUESTY_API_KEY")

client = openai.OpenAI(

api_key=ROUTER_API_KEY,

base_url="https://router.requesty.ai/v1",

default_headers={"Authorization": f"Bearer {ROUTER_API_KEY}"},

)

# Example request

response = client.chat.completions.create(

model="groq/openai/gpt-oss-120b",

messages=[{"role": "user", "content": "Hello, who are you?"}],

)

# Print the result

print(response.choices[0].message.content)Conclusão

Depois de muita espera, a OpenAI finalmente lançou um LLM de código aberto. Isso quer dizer que agora você pode ajustar tudo direitinho, rodar localmente e ter controle total sobre o que vai sair. Você está no comando; pode até criar produtos com base nisso sem precisar compartilhar seus dados com a OpenAI ou pagar pelo acesso à API.

Isso é um grande passo pra frente pra IA e, com o tempo, a gente vai ver modelos novos e melhores feitos com base nos modelos e estruturas de código aberto da OpenAI. Se você quer começar a experimentar agora, você pode:

- Executar o GPT-OSS 120B localmente

- Acesse no seu navegador usando aplicativos de chat grátis.

- Experimente provedores de inferência LLM rápidos e grátis

- Dá uma olhada nos mercados de LLM pra achar o melhor e mais rápido acesso aos modelos.

Se você está começando sua jornada com IA, não deixe de conferir nosso programa de habilidades Fundamentos da IA , que aborda tópicos como LLMs, ChatGPT, IA generativa, ética em IA e engenharia de prompts.

Sou um cientista de dados certificado que gosta de criar aplicativos de aprendizado de máquina e escrever blogs sobre ciência de dados. No momento, estou me concentrando na criação e edição de conteúdo e no trabalho com modelos de linguagem de grande porte.