Program

Veri mühendisliği, dünya çapındaki şirketler için veri altyapısının bel kemiğini oluşturarak teknoloji sektöründeki en önemli rollerdən biri haline geldi. Şirketler giderek daha fazla verilere dayalı karar alma süreçlerine güvendikçe, yetenekli veri mühendislerine olan talep de artmaya devam ediyor.

Bir veri mühendisliği mülakatına hazırlanıyorsanız, deneyiminizi, problem çözme becerilerinizi ve teknik yetkinliklerinizi değerlendiren genel ve teknik sorulara hâkim olmanız gerekir.

Bu blog yazısında, ilk İK ön elemeden kapsamlı teknik değerlendirmelere kadar veri mühendisliği mülakatının farklı aşamalarına hazırlanmanıza yardımcı olacak kapsamlı bir rehber sunuyoruz.

İlk İK Veri Mühendisi Mülakat Soruları

İlk İK mülakat turunda, İK yöneticisi iş deneyiminiz ve şirkete katacağınız değer hakkında sorular soracaktır. Bu aşama, geçmişinizi, kişilerarası becerilerinizi ve şirket kültürüne genel uyumunuzu değerlendirmek için tasarlanmıştır.

1. Sizi bu pozisyon için en iyi aday yapan nedir?

İşe alım yöneticisi sizi telefon mülakatı için seçtiyse, profilinizde hoşuna giden bir şey görmüş demektir. Bu soruya özgüvenle yaklaşın ve deneyiminiz ile kariyer gelişiminizden bahsedin.

Mülakat öncesinde şirket profilini ve iş tanımını gözden geçirmek önemlidir. Bunu yapmak, işe alım yöneticisinin ne aradığını anlamanıza ve yanıtınızı buna göre uyarlamanıza yardımcı olur.

İş gereksinimleriyle uyumlu belirli beceri ve deneyimlere odaklanın; örneğin veri hatları tasarımı ve yönetimi, modelleme ve ETL süreçleri. Becerilerinizin, deneyiminizin ve bilginizin benzersiz kombinasyonunun sizi nasıl öne çıkardığını vurgulayın.

2. Bir veri mühendisinin günlük sorumlulukları nelerdir?

Kesin bir yanıt olmamakla birlikte, önceki iş deneyimlerinizden örnekler paylaşmak ve iş tanımına atıfta bulunmak kapsamlı bir cevap sağlayabilir. Genel olarak veri mühendislerinin günlük sorumlulukları şunları içerir:

- Veritabanlarını geliştirmek, test etmek ve bakımını yapmak.

- İş gereksinimlerine dayalı veri çözümleri oluşturmak.

- Veri edinimi ve entegrasyonu.

- ETL süreçleri, modelleme, dönüşüm ve sunum için veri hatları geliştirmek, doğrulamak ve sürdürmek.

- Bazı durumlarda makine öğrenimi modellerini dağıtmak ve yönetmek.

- Veri akışlarını temizleyerek, doğrulayarak ve izleyerek veri kalitesini korumak.

- Sistem güvenilirliğini, performansını ve kalitesini iyileştirmek.

- Uyumluluk ve veri bütünlüğünü sağlamak için veri yönetişimi ve güvenlik yönergelerini izlemek.

3. Veri mühendisi olmanın en zor yanı sizce nedir?

Bu soru bireysel deneyimlere göre değişse de yaygın zorluklar şunlardır:

- Hızlı teknolojik gelişmelere ayak uydurmak ve veri sistemlerinin performansını, güvenliğini, güvenilirliğini ve yatırım getirisini artırmak için yeni araçları entegre etmek.

- Karmaşık veri yönetişimi ve güvenlik protokollerini anlamak ve uygulamak.

- Felaket kurtarma planlarını yönetmek ve öngörülmeyen durumlarda veri erişilebilirliğini ve bütünlüğünü sağlamak.

- İş gereksinimlerini teknik kısıtlarla dengelemek ve gelecekteki veri taleplerini öngörmek.

- Büyük veri hacimlerini verimli şekilde işlemek ve veri kalitesi ile tutarlılığını sağlamak.

4. Hangi veri araçları veya çerçeveleriyle deneyiminiz var? Diğerlerine tercih ettikleriniz var mı?

Yanıtınız deneyimlerinize dayanacaktır. Modern araçlar ve üçüncü taraf entegrasyonlara aşina olmak bu soruya güvenle yanıt vermenize yardımcı olur. Şu konularla ilgili araçları tartışın:

- Veritabanı yönetimi (örn. MySQL, PostgreSQL, MongoDB)

- Veri ambarı (örn. Amazon Redshift, Google BigQuery, Snowflake)

- Veri orkestrasyonu (örn. Apache Airflow, Prefect)

- Veri hatları (örn. Apache Kafka, Apache NiFi)

- Bulut yönetimi (örn. AWS, Google Cloud Platform, Microsoft Azure)

- Veri temizleme, modelleme ve dönüşüm (örn. pandas, dbt, Spark)

- Yığın ve gerçek zamanlı işleme (örn. Apache Spark, Apache Flink)

Unutmayın, bu sorunun yanlış bir cevabı yok. Görüşmeci becerilerinizi ve deneyiminizi değerlendiriyor.

5. Veri mühendisliğindeki en son trend ve gelişmelerden nasıl haberdar oluyorsunuz?

Bu soru, sürekli öğrenmeye ve alanınızdaki güncelliğe olan bağlılığınızı değerlendirir.

Sektör bültenlerine abone olduğunuzu, etkili blogları takip ettiğinizi, çevrimiçi forum ve topluluklara katıldığınızı, web seminerleri ve konferanslara iştirak ettiğinizi ve çevrimiçi kurslar aldığınızı belirtebilirsiniz. Güncel kalmak için kullandığınız belirli kaynakları veya platformları vurgulayın.

6. Bir projeyi tamamlamak için fonksiyonlar arası bir ekiple iş birliği yapmanız gereken bir zamanı anlatabilir misiniz?

Veri mühendisliği sıklıkla veri bilimciler, analistler ve BT personeli dahil olmak üzere çeşitli ekiplerle çalışmayı gerektirir.

Başarıyla iş birliği yaptığınız belirli bir örneği paylaşın; iletişim becerilerinizi, farklı bakış açılarını anlama yeteneğinizi ve projeye nasıl katkıda bulunduğunuzu vurgulayın. Karşılaştığınız zorlukları ve arzu edilen sonuca ulaşmak için bunların nasıl üstesinden geldiğinizi açıklayın.

Teknik Veri Mühendisi Mülakat Soruları

Veri mühendisliği son derece tekniktir; bu yüzden mülakat sürecinizin büyük kısmının teknik sorular ve alıştırmalar içermesi şaşırtıcı değildir. Bu bölümde, başlangıç seviyesinden Python, SQL, proje tabanlı ve yönetim sorularına odaklanarak farklı teknik soru türlerini ve cevaplarını ele alacağız.

Junior veri mühendisi mülakat soruları

Junior mühendis mülakatları araçlar, Python ve SQL sorgularına odaklanır. Ayrıca veritabanı yönetimi ve ETL süreçleri hakkında sorular, kodlama sınavları ve ev ödevi testleri içerebilir.

Şirketler yeni mezunları işe alırken, verilerini ve sistemlerini etkili şekilde yönetebileceğinizden emin olmak ister.

7. Veri modelleme ile ilgili tasarım şemalarını açıklayabilir misiniz?

Üç temel veri modelleme tasarım şeması vardır: yıldız, kar tanesi ve galaksi.

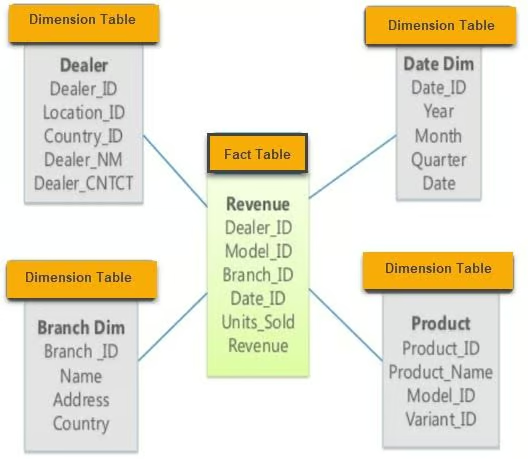

- Yıldız şeması: Bu şema, merkezi bir olgu tablosuna bağlı çeşitli boyut tabloları içerir. Basit ve anlaşılması kolaydır; düz sorgular için uygundur.

Yıldız şeması örneği. Görsel: guru99

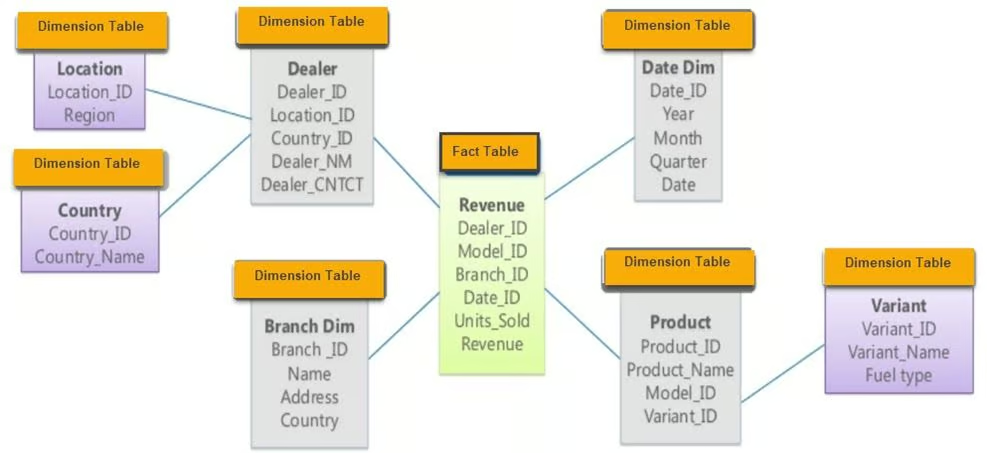

- Kar tanesi şeması: Yıldız şemasının bir uzantısıdır; olgu tablosu ve ek normalleştirme katmanlarına sahip çoklu boyut tablolarından oluşur ve kar tanesine benzer bir yapı oluşturur. Fazlalığı azaltır ve veri bütünlüğünü iyileştirir.

Kar tanesi şeması örneği. Görsel: guru99

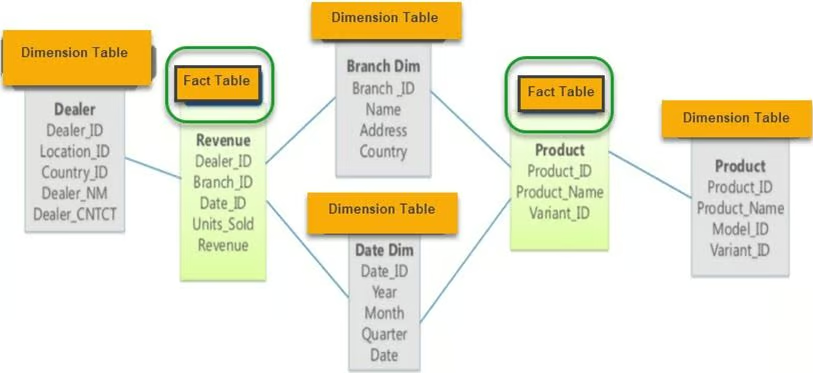

- Galaksi şeması: Olgu takımyıldızı şeması olarak da bilinir; boyut tablolarını paylaşan iki veya daha fazla olgu tablosu içerir. Birden fazla olgu tablosu gerektiren karmaşık veritabanı sistemleri için uygundur.

Galaksi şeması örneği. Görsel: guru99

8. Hangi ETL araçlarıyla çalıştınız? Favoriniz hangisi ve neden?

Bu soruyu yanıtlarken, hâkim olduğunuz ETL araçlarını belirtin ve belirli projeler için neden bu araçları seçtiğinizi açıklayın. Her aracın artılarını ve eksilerini ve iş akışınıza nasıl uyduğunu tartışın. Popüler açık kaynaklı araçlar şunlardır:

- dbt (data build tool): Ambarınızdaki verileri SQL ile dönüştürmek için idealdir.

- Apache Spark: Büyük ölçekli veri işleme ve yığın işleme için mükemmeldir.

- Apache Kafka: Gerçek zamanlı veri hatları ve akış için kullanılır.

- Airbyte: Veri çıkarma ve yüklemeye yardımcı olan açık kaynaklı bir veri entegrasyon aracıdır.

ETL bilginizi tazelemeniz gerekiyorsa, Introduction to Data Engineering kursunu düşünün.

9. Veri orkestrasyonu nedir ve bunu gerçekleştirmek için hangi araçları kullanabilirsiniz?

Veri orkestrasyonu; birden çok kaynaktan ham veriye erişme, veri temizleme, dönüşüm ve modelleme tekniklerini uygulama ve analitik görevler için sunma süreçlerini otomatikleştiren bir işlemdir. Verinin farklı sistemler ve işleme aşamaları arasında sorunsuz akmasını sağlar.

Veri orkestrasyonu için popüler araçlar şunlardır:

- Apache Airflow: İş akışlarını zamanlamak ve izlemek için yaygın olarak kullanılır.

- Prefect: Veri akışına odaklanan modern bir orkestrasyon aracıdır.

- Dagster: Veri yoğun iş yükleri için tasarlanmış bir orkestrasyon aracıdır.

- AWS Glue: Analitik için veri hazırlığını basitleştiren yönetilen bir ETL hizmeti.

10. Analitik mühendisliği için hangi araçları kullanıyorsunuz?

Analitik mühendisliği, işlenmiş verileri dönüştürmeyi, istatistiksel modeller uygulamayı ve raporlar ile panolar üzerinden görselleştirmeyi içerir.

Analitik mühendisliği için popüler araçlar şunlardır:

- dbt (data build tool): Ambarınızdaki verileri SQL kullanarak dönüştürmek için kullanılır.

- BigQuery: Büyük ölçekli veri analitiği için tamamen yönetilen, sunucusuz bir veri ambarı.

- Postgres: Güçlü, açık kaynaklı bir ilişkisel veritabanı sistemi.

- Metabase: Veriniz hakkında sorular sorup yanıtları anlaşılır formatlarda görüntülemenizi sağlayan açık kaynaklı bir araç.

- Google Data Studio: Panolar ve görsel raporlar oluşturmak için kullanılır.

- Tableau: Veri görselleştirme için lider bir platform.

Bu araçlar, anlamlı içgörüler çıkarmak ve karar alma süreçlerini desteklemek için veriye erişmeye, dönüştürmeye ve görselleştirmeye yardımcı olur.

11. OLAP ve OLTP sistemleri arasındaki fark nedir?

OLAP (Online Analytical Processing) geçmiş verileri analiz eder ve karmaşık sorguları destekler. Okuma ağırlıklı iş yükleri için optimize edilmiştir ve sıklıkla iş zekâsı görevleri için veri ambarlarında kullanılır. OLTP (Online Transaction Processing) gerçek zamanlı işlemsel veriyi yönetmek için tasarlanmıştır. Yazma ağırlıklı iş yükleri için optimize edilmiştir ve günlük operasyonlar için operasyonel veritabanlarında kullanılır.

Ana fark amaçlarındadır: OLAP karar almayı desteklerken, OLTP günlük operasyonları destekler.

Hâlâ tereddütünüz varsa, OLTP vs OLAP blog yazısını okumanızı öneririm.

Python veri mühendisi mülakat soruları

Python, çok yönlülüğü ve veri işleme, analiz ve otomasyona yönelik zengin kütüphane ekosistemi nedeniyle veri mühendisliğinde en popüler dildir. İşte veri mühendisliği mülakatında karşılaşabileceğiniz bazı Python odaklı sorular.

12. Veri işleme için en verimli Python kütüphaneleri hangileridir?

Python’daki en popüler veri işleme kütüphaneleri şunlardır:

- pandas: DataFrame gibi veri yapıları sağlayarak veri düzenleme ve analizi için idealdir.

- NumPy: Büyük çok boyutlu diziler ve matrisleri destekleyerek sayısal hesaplamalar için gereklidir.

- Dask: Paralel hesaplamayı kolaylaştırır ve pandas benzeri sözdizimiyle belleğe sığmayan hesaplamaları gerçekleştirebilir.

- PySpark: Apache Spark için Python API’sidir; büyük ölçekli veri işleme ve gerçek zamanlı analitik için kullanışlıdır.

Bu kütüphanelerin her birinin artıları ve eksileri vardır; seçim, belirli veri gereksinimlerine ve işleme ölçeğine bağlıdır.

13. Python’da web scraping’i nasıl gerçekleştirirsiniz?

Python’da web scraping genellikle şu adımları içerir:

1. requests kütüphanesini kullanarak web sayfasına erişin:

import requests

from bs4 import BeautifulSoup

url = 'http://example.com'

response = requests.get(url)

soup = BeautifulSoup(response.text, 'html.parser')2. BeautifulSoup kullanarak tabloları ve bilgileri çıkarın:

tables = soup.find_all('table')3. Bunu pandas kullanarak yapılandırılmış bir formata dönüştürün:

import pandas as pd

data = []

for table in tables:

rows = table.find_all('tr')

for row in rows:

cols = row.find_all('td')

cols = [ele.text.strip() for ele in cols]

data.append(cols)

df = pd.DataFrame(data)4. Verileri pandas ve NumPy ile temizleyin:

df.dropna(inplace=True) # Drop missing values5. Verileri CSV dosyası olarak kaydedin:

df.to_csv('scraped_data.csv', index=False)Bazı durumlarda pandas.read_html süreci basitleştirebilir:

df_list = pd.read_html('http://example.com')

df = df_list[0] # Assuming the table of interest is the first one14. Belleğe sığmayan büyük veri kümelerini Python’da nasıl yönetirsiniz?

Belleğe sığmayan büyük veri kümelerini yönetmek, bellek dışı hesaplama için tasarlanmış araç ve teknikleri kullanmayı gerektirir:

- Dask: Paralel hesaplamaya olanak tanır ve pandas benzeri sözdizimiyle belleğe sığmayan veri kümeleriyle çalışır.

import dask.dataframe as dd

df = dd.read_csv('large_dataset.csv')- PySpark: Büyük ölçekli verileri yönetmek için yararlı olan dağıtık veri işlemesini sağlar.

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName('data_processing').getOrCreate()

df = spark.read.csv('large_dataset.csv', header=True, inferSchema=True)- pandas ile parça parça okuma: Büyük veri kümelerini parçalar halinde okuyun.

import pandas as pd

chunk_size = 10000

for chunk in pd.read_csv('large_dataset.csv', chunksize=chunk_size):

process(chunk) # Replace with your processing function15. Python kodunuzun verimli ve performans için optimize edilmiş olmasını nasıl sağlarsınız?

Python kodunun verimli ve performans için optimize edilmiş olmasını sağlamak için şu uygulamaları dikkate alın:

- Profil çıkarma: Kodunuzdaki darboğazları belirlemek için

cProfile,line_profilerveyamemory_profilergibi araçları kullanın.

import cProfile

cProfile.run('your_function()')- Vektörleştirme: Döngüler yerine

numpyveyapandasile vektörleştirilmiş işlemler kullanın.

import numpy as np

data = np.array([1, 2, 3, 4, 5])

result = data * 2 # Vectorized operation- Verimli veri yapıları: Kullanım durumunuza göre uygun veri yapıları (örn. listeler, setler, sözlükler) seçin.

data_dict = {'key1': 'value1', 'key2': 'value2'} # Faster lookups compared to lists- Paralel işlem: Paralelleştirilebilen görevler için çok iş parçacığı veya çoklu işlemden yararlanın.

from multiprocessing import Pool

def process_data(data_chunk):

# Your processing logic here

return processed_chunk

with Pool(processes=4) as pool:

results = pool.map(process_data, data_chunks)- Yinelenen hesaplamalardan kaçınma: Pahalı işlemlerin sonuçlarını yeniden kullanılacaksa önbelleğe alın.

from functools import lru_cache

@lru_cache(maxsize=None)

def expensive_computation(x):

# Perform expensive computation

return result16. Veri hatlarınızda veri bütünlüğünü ve kalitesini nasıl sağlarsınız?

Güvenilir veri mühendisliği için veri bütünlüğü ve kalitesi önemlidir. En iyi uygulamalar şunları içerir:

- Veri doğrulama: Veri hattının çeşitli aşamalarında veri biçimlerini, aralıkları ve tutarlılığı doğrulamak için kontroller uygulayın.

def validate_data(df):

assert df['age'].min() >= 0, "Age cannot be negative"

assert df['salary'].dtype == 'float64', "Salary should be a float"

# Additional checks...- Veri temizleme: Eksik değerleri ele almak, yinelenenleri kaldırmak ve hataları düzeltmek için

pandasgibi kütüphaneleri kullanarak verileri temizleyin ve ön işleme tabi tutun.

df.dropna(inplace=True) # Drop missing values

df.drop_duplicates(inplace=True) # Remove duplicates- Otomatik test:

pytestgibi çerçevelerle veri işleme fonksiyonları için birim testleri geliştirin.

import pytest

def test_clean_data():

raw_data = pd.DataFrame({'age': [25, -3], 'salary': ['50k', '60k']})

clean_data = clean_data_function(raw_data)

assert clean_data['age'].min() >= 0

assert clean_data['salary'].dtype == 'float64'- İzleme ve uyarılar: Veri kalitesi sorunları ortaya çıktığında anormallikleri tespit etmek ve uyarılar göndermek için veri hatlarınız için izleme kurun.

from airflow import DAG

from airflow.operators.dummy_operator import DummyOperator

from airflow.operators.email_operator import EmailOperator

# Define your DAG and tasks...17. Veri kümelerinizde eksik verileri nasıl ele alırsınız?

Eksik verileri ele almak veri mühendisliğinde yaygın bir görevdir. Yaklaşımlar şunlardır:

- Kaldırma: Önemli değilse, eksik veriye sahip satırları veya sütunları basitçe kaldırın.

df.dropna(inplace=True)- Atama (imputation): Eksik değerleri istatistiksel ölçülerle (ortalama, medyan) doldurun veya KNN imputasyonu gibi daha gelişmiş yöntemler kullanın.

df['column'].fillna(df['column'].mean(), inplace=True)- Göstergesi değişkeni: Hangi değerlerin eksik olduğunu belirtmek için bir gösterge değişkeni ekleyin.

df['column_missing'] = df['column'].isnull().astype(int)- Model tabanlı atama: Eksik değerleri tahmin etmek için öngörücü modelleme kullanın.

from sklearn.impute import KNNImputer

imputer = KNNImputer(n_neighbors=5)

df = pd.DataFrame(imputer.fit_transform(df), columns=df.columns)18. Python’da veri çekerken API hız sınırlarını nasıl yönetirsiniz?

API hız sınırlarını yönetmek için şu stratejiler kullanılabilir:

- Geri çekilme ve yeniden deneme: Sınır aşıldığında üstel geri çekilme uygulamak.

- Sayfalandırma: API’nin sayfalandırma seçeneklerini kullanarak veriyi daha küçük parçalar halinde almak.

- Önbellekleme: Yinelenen API çağrılarını önlemek için yanıtları saklamak.

Python’un time kütüphanesi ve requests modülünü kullanarak örnek:

import time

import requests

def fetch_data_with_rate_limit(url):

for attempt in range(5): # Retry up to 5 times

response = requests.get(url)

if response.status_code == 429: # Too many requests

time.sleep(2 ** attempt) # Exponential backoff

else:

return response.json()

raise Exception("Rate limit exceeded")Python, veri mühendisliğinde tartışmasız en önemli dillerden biridir. Modern veri mühendisliği kavramları, programlama dilleri, araçlar ve çerçeveleri kapsayan kapsamlı bir müfredat sunan Data Engineer in Python yolumuz ile becerilerinizi geliştirebilirsiniz.

SQL veri mühendisi mülakat soruları

SQL kodlama aşaması, veri mühendisliği işe alım sürecinin önemli bir parçasıdır. Çeşitli basit ve karmaşık betikleri pratik etmek hazırlık açısından yardımcı olur. Görüşmeciler veri analitiği, ortak tablo ifadeleri, sıralama, ara toplam ekleme ve geçici fonksiyonlar için sorgular yazmanızı isteyebilir.

19. SQL’de Common Table Expression (CTE) nedir?

CTE’ler, karmaşık join’leri basitleştirmek ve alt sorguları çalıştırmak için kullanılır. SQL sorgularını daha okunabilir ve sürdürülebilir hale getirirler. İşte Fen (Science) bölümlü ve A notuna sahip tüm öğrencileri gösteren bir CTE örneği:

SELECT *

FROM class

WHERE id IN (

SELECT DISTINCT id

FROM students

WHERE grade = "A"

AND major = "Science"

);CTE kullanıldığında sorgu şu hale gelir:

WITH temp AS (

SELECT id

FROM students

WHERE grade = "A"

AND major = "Science"

)

SELECT *

FROM class

WHERE id IN (SELECT id FROM temp);CTE’ler daha karmaşık problemler için kullanılabilir ve birden fazla CTE birbirine zincirlenebilir.

20. Veriyi SQL’de nasıl sıralarsınız?

Veri mühendisleri genellikle satış ve kâr gibi parametrelere göre değerleri sıralar. Belirli bir sütuna göre sıralamak için RANK() fonksiyonu kullanılır:

SELECT

id,

sales,

RANK() OVER (ORDER BY sales DESC) AS rank

FROM bill;Alternatif olarak, aynı değerlere sahip sıralarda atlama yapmayan DENSE_RANK() kullanabilirsiniz.

21. Basit bir geçici fonksiyon oluşturup bir SQL sorgusunda kullanabilir misiniz?

Python’da olduğu gibi, SQL’de de sorgularınızı daha zarif kılmak ve tekrarlı case ifadelerinden kaçınmak için fonksiyonlar oluşturabilirsiniz. İşte get_gender adlı geçici bir fonksiyon örneği:

CREATE TEMPORARY FUNCTION get_gender(type VARCHAR) RETURNS VARCHAR AS (

CASE

WHEN type = "M" THEN "male"

WHEN type = "F" THEN "female"

ELSE "n/a"

END

);

SELECT

name,

get_gender(type) AS gender

FROM class;Bu yaklaşım SQL kodunuzu daha temiz ve sürdürülebilir hale getirir.

22. SQL’de ara toplamları nasıl eklersiniz?

GROUP BY ve ROLLUP() fonksiyonlarını kullanarak ara toplamlar eklenebilir. İşte bir örnek:

SELECT

department,

product,

SUM(sales) AS total_sales

FROM sales_data

GROUP BY ROLLUP(department, product);Bu sorgu, her departman için bir ara toplam ve sonunda genel toplam verecektir.

23. SQL’de eksik verileri nasıl ele alırsınız?

Veri bütünlüğünü korumak için eksik verileri ele almak esastır. Yaygın yaklaşımlar şunlardır:

COALESCE()kullanımı: Bu fonksiyon listedeki ilk null olmayan değeri döndürür.

SELECT id, COALESCE(salary, 0) AS salary FROM employees;CASEifadeleri kullanımı: Eksik değerleri koşullu olarak ele almak için.

SELECT id,

CASE

WHEN salary IS NULL THEN 0

ELSE salary

END AS salary

FROM employees;24. SQL’de veri toplulaştırmayı nasıl yaparsınız?

Veri toplulaştırma, SUM(), AVG(), COUNT(), MIN() ve MAX() gibi toplama fonksiyonlarını kullanmayı içerir. İşte bir örnek:

SELECT department,

SUM(salary) AS total_salary,

AVG(salary) AS average_salary,

COUNT(*) AS employee_count

FROM employees

GROUP BY department;25. SQL sorgularını daha iyi performans için nasıl optimize edersiniz?

Daha iyi performans için SQL sorgularını şu şekilde optimize edebilirsiniz:

- Sık sorgulanan sütunlarda indeksler kullanarak aramaları hızlandırın.

SELECT *yerine yalnızca gerekli sütunları belirtin.- Join’leri akıllıca kullanın ve gereksiz olanlardan kaçının.

- Uygun olduğunda alt sorguları CTE’lerle değiştirerek optimize edin.

- Sorgu yürütme planlarını analiz ederek darboğazları belirleyin. Örnek:

EXPLAIN ANALYZE

SELECT customer_id, COUNT(order_id)

FROM orders

GROUP BY customer_id;SQL kodlama alıştırmalarını çözmek, pratik yapmak ve unutulan kavramları gözden geçirmek için en iyi yoldur. DataCamp’in SQL ile Veri Analizi testini yaparak SQL becerilerinizi ölçebilirsiniz (bu değerlendirmeye erişmek için bir hesaba ihtiyacınız olacak).

Proje ile ilgili veri mühendisi mülakat soruları

Genel mülakat turlarından sonra genellikle kodlama zorlukları, problem çözme, beyaz tahtada veritabanı sistemi tasarımı, ev ödevi sınavı ve analitik sorulardan oluşan teknik bir aşamaya ilerlersiniz.

Bu aşama oldukça yoğun olabilir; bu nedenle yaygın veri mühendisliği mülakat soruları ve cevaplarını bilmek mülakatta başarılı olmanıza yardımcı olabilir.

26. Baştan sona üzerinde çalıştığınız bir projeyi anlatın.

Öğrenci ya da profesyonel olarak daha önce bir veri mühendisliği projesinde çalıştıysanız bu yanıt doğal gelecektir. Yine de önceden hazırlık yapmak her zaman faydalıdır. Yanıtınızı şu şekilde yapılandırın:

- Giriş ve iş problemi:

- Projenin bağlamını açıklayarak başlayın. Çözdüğünüz iş problemini ve projenin hedeflerini anlatın.

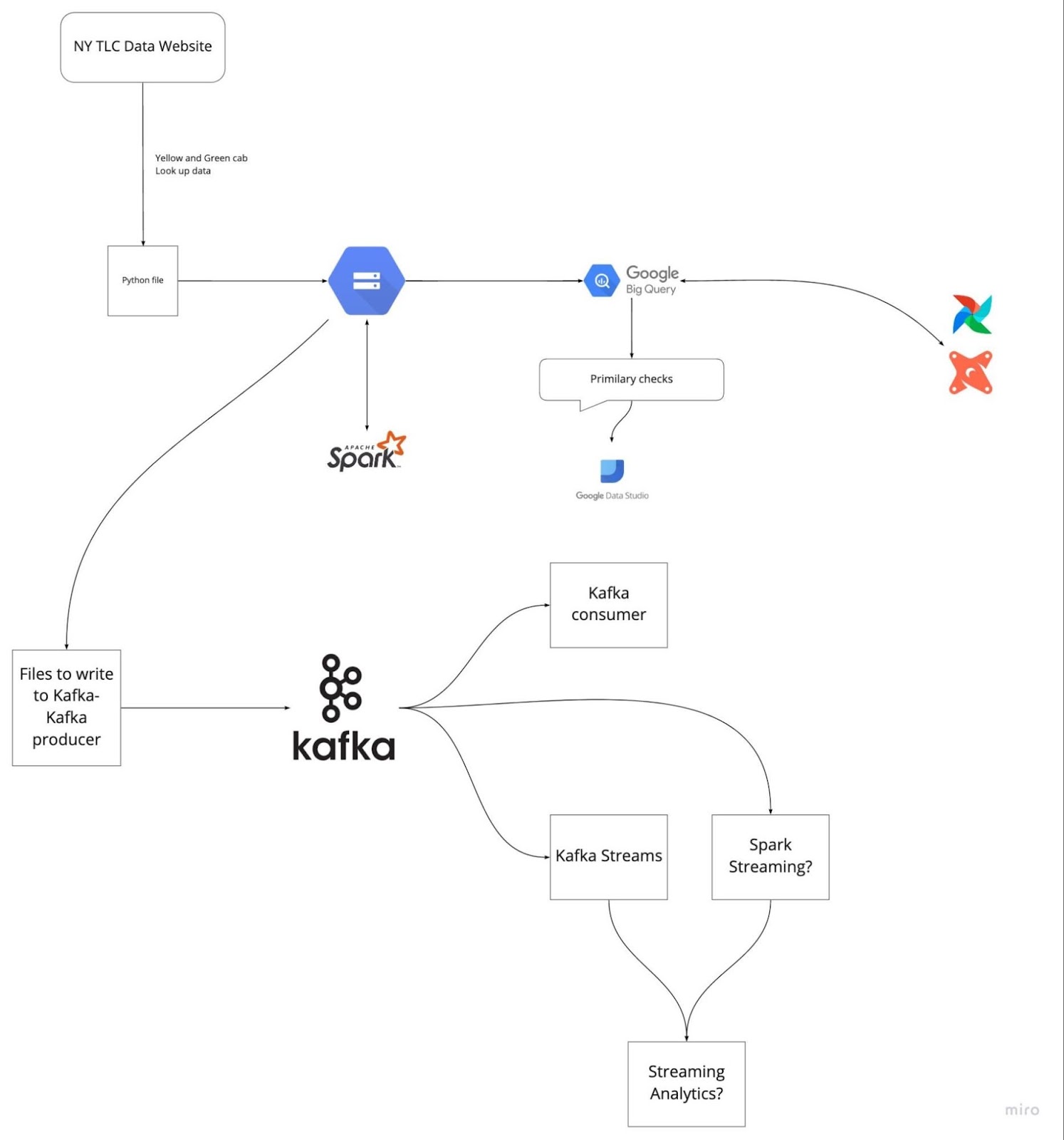

- Örnek: "Bu projede, analitik ekibi için sorgu performansını ve veri doğruluğunu artırmak üzere TLC Trip Record verilerini işleyen veri hattını optimize etmeyi hedefledik."

- Veri alımı:

- Ham veriye nasıl eriştiğinizi ve onu nasıl içeri aldığınızı açıklayın.

- Örnek: "Ham TLC Trip Record verilerini birden fazla kaynaktan güvenilir veri alımı sağlamak için GCP, Airflow ve PostgreSQL kullanarak içeri aldık."

- Veri işleme ve dönüşüm:

- Veriyi temizlemek, dönüştürmek ve yapılandırmak için atılan adımları açıklayın.

- Örnek: "Veri dönüşümü için yığın işlemde Apache Spark, gerçek zamanlı akışta Apache Kafka kullandık. Veriler temizlendi, doğrulandı ve analize uygun yapılandırılmış bir formata dönüştürüldü."

- Veri depolama ve ambarlama:

- Kullanılan veri depolama çözümlerini ve neden seçildiklerini tartışın.

- Örnek: "İşlenmiş veriler, ölçeklenebilir ve verimli bir veri ambarı çözümü sunan Google BigQuery’de saklandı. Veri iş akışları Airflow ile yönetildi."

- Analitik mühendisliği:

- Analitik amaçlarla kullanılan araç ve yöntemleri vurgulayın.

- Örnek: "Analitik mühendislik için dbt (data build tool), BigQuery, PostgreSQL, Google Data Studio ve Metabase kullandık. Bu araçlar sağlam veri modelleri oluşturup anlamlı rapor ve panolar üretmemizi sağladı."

- Dağıtım ve bulut ortamı:

- Kullanılan dağıtım stratejilerini ve bulut altyapısını belirtin.

- Örnek: "Tüm proje GCP, Terraform ve Docker kullanılarak dağıtıldı; böylece ölçeklenebilir ve güvenilir bir bulut ortamı sağlandı."

- Zorluklar ve çözümler:

- Karşılaştığınız zorlukları ve bunların nasıl üstesinden geldiğinizi tartışın.

- Örnek: "Ana zorluklardan biri gerçek zamanlı yüksek veri hacmini yönetmekti. Bunu Kafka akış işlerimizi optimize ederek ve verimli Spark dönüşümleri uygulayarak çözdük."

- Sonuçlar ve etki:

- Projenin sonuçlarını ve etkisini anlatarak bitirin.

- Örnek: "Proje, analitik ekibinin sorgu performansını ve veri doğruluğunu önemli ölçüde iyileştirdi; bu da daha hızlı karar alma ve daha iyi içgörüler sağladı."

Görsel: DataTalksClub/data-engineering-zoomcamp

Son beş projenizi gözden geçirerek önceden hazırlık yapmak, mülakatta kilitlenmenizi önlemeye yardımcı olabilir. Problem ifadesini ve uyguladığınız çözümleri netleştirin. Her adımı açık ve öz bir şekilde anlatmayı pratiğe dökün.

Veri mühendisi yönetici mülakat soruları

Mühendislik yönetici pozisyonlarında sorular genellikle karar alma, iş anlayışı, veri kümelerinin kürasyonu ve bakımı, uyumluluk ve güvenlik politikalarıyla ilgilidir.

27. Veri ambarı ile operasyonel veritabanı arasındaki fark nedir?

Bir veri ambarı, veri analitiği görevleri ve karar alma için geçmiş verileri sunar. Online Analytical Processing (OLAP) gibi yüksek hacimli analitik işlemleri destekler. Veri ambarları, birden fazla satıra erişen karmaşık sorguları işlemek üzere tasarlanmıştır ve okuma ağırlıklı işlemler için optimize edilmiştir. Az sayıda eşzamanlı kullanıcıyı destekler ve veriyi hızlı ve yüksek hacimde verimli şekilde getirmek üzere tasarlanmıştır.

Operasyonel Veritabanı Yönetim Sistemleri (OLTP) dinamik veri kümelerini gerçek zamanlı yönetir. Binlerce eşzamanlı istemci için yüksek hacimli işlem işlemesini destekleyerek günlük operasyonlar için uygundur. Veriler genellikle iş işlemleri ve operasyonlarla ilgili güncel, anlık bilgiden oluşur. OLTP sistemleri yazma ağırlıklı işlemler ve hızlı sorgu işleme için optimize edilmiştir.

28. Veri sistemleri kullanan her firmanın neden bir felaket kurtarma planına ihtiyaç duyduğunu düşünüyorsunuz?

Felaket yönetimi, bir veri mühendisliği yöneticisinin sorumluluğudur. Bir felaket kurtarma planı; siber saldırı, donanım arızası, doğal afet veya diğer yıkıcı olaylar durumunda veri sistemlerinin geri yüklenmesini ve çalışmaya devam etmesini sağlar. İlgili unsurlar şunlardır:

- Gerçek zamanlı yedekleme: Dosya ve veritabanlarının güvenli, harici konumlara düzenli olarak yedeklenmesi.

- Veri yedekliliği: Erişilebilirliği sağlamak için farklı coğrafi konumlarda veri çoğaltma uygulamak.

- Güvenlik protokolleri: Veri ihlallerini önlemek için gelen ve giden trafiği izleme, iz sürme ve kısıtlama protokolleri oluşturmak.

- Kurtarma prosedürleri: Kesintiyi en aza indirmek için veri ve sistemleri hızlı ve verimli biçimde geri yüklemeye yönelik ayrıntılı prosedürler.

- Testler ve tatbikatlar: Planın etkinliğini sağlamak ve gerekli ayarlamaları yapmak için felaket kurtarma planını düzenli olarak simülasyonlar ve tatbikatlarla test etmek.

29. Bir veri mühendisliği ekibini yönetirken karar alma süreçlerine nasıl yaklaşırsınız?

Bir veri mühendisliği yöneticisi olarak karar alma, teknik hususları iş hedefleriyle dengelemeyi içerir. Bazı yaklaşımlar şunlardır:

- Veri odaklı kararlar: Sezgiden ziyade nesnel içgörülere dayanması için kararları veri analitiğiyle desteklemek.

- Paydaş iş birliği: İş gereksinimlerini anlamak ve veri mühendisliği çalışmalarını şirket hedefleriyle uyumlamak için paydaşlarla yakın çalışmak.

- Risk değerlendirmesi: Olası riskleri ve projelere etkilerini değerlendirmek ve azaltma stratejileri geliştirmek.

- Çevik metodolojiler: Değişen gereksinimlere uyum sağlamak ve değeri artımlı olarak sunmak için çevik uygulamaları hayata geçirmek.

- Mentorluk ve gelişim: Ekip üyelerinin gelişimini mentorluk ve eğitim fırsatlarıyla desteklemek ve iş birliğine dayalı bir ortamı teşvik etmek.

30. Veri mühendisliği projelerinizde veri koruma düzenlemelerine uyumu nasıl sağlarsınız?

Veri koruma düzenlemelerine uyum, örneğin şu uygulamaları içerir:

- Düzenlemeleri anlama: GDPR, CCPA ve HIPAA gibi veri koruma düzenlemeleri hakkında güncel kalmak.

- Veri yönetişimi çerçevesi: Veri gizliliği, güvenliği ve erişim kontrolü politikalarını içeren sağlam bir veri yönetişimi çerçevesi uygulamak.

- Veri şifreleme: Yetkisiz erişimi önlemek için hassas verileri hem beklemede hem aktarımda şifrelemek.

- Erişim kontrolleri: Sadece yetkili personelin hassas verilere erişebilmesini sağlayan sıkı erişim kontrolleri uygulamak.

- Denetimler ve izleme: Herhangi bir uyumluluk sorununu hızla tespit ve ele almak için düzenli olarak denetimler yapmak ve veri erişimi ile kullanımını izlemek.

31. Yönettiğiniz zorlu bir veri mühendisliği projesini anlatabilir misiniz?

Zorlu bir projeyi tartışırken aşağıdaki unsurlara odaklanabilirsiniz:

- Proje kapsamı ve hedefleri: Projenin amaçlarını ve çözmeyi hedeflediği iş problemini net şekilde tanımlayın.

- Karşılaşılan zorluklar: Teknik sınırlamalar, kaynak kısıtları veya paydaş uyumu gibi belirli zorlukları açıklayın.

- Stratejiler ve çözümler: Bu zorlukların üstesinden gelmek için başvurduğunuz yöntemleri; teknik çözümler, ekip yönetimi uygulamaları ve paydaş katılımını içerecek şekilde açıklayın.

- Sonuçlar ve etki: İyileşen veri kalitesi, geliştirilen sistem performansı veya artan operasyonel verimlilik gibi başarılı sonuçları ve iş üzerindeki etkisini vurgulayın.

32. Yeni veri teknolojilerini nasıl değerlendirir ve uygularsınız?

Yeni veri teknolojilerini değerlendirmek ve uygulamak şunları içerir:

- Pazar araştırması: Veri mühendisliği teknolojilerindeki en son gelişme ve trendleri takip etmek.

- Kavram kanıtı (PoC): Yeni teknolojilerin kendi bağlamınızdaki uygulanabilirliğini ve faydalarını test etmek için PoC projeleri yürütmek.

- Maliyet-fayda analizi: Yeni teknolojileri benimsemenin maliyetlerini, faydalarını ve potansiyel YG’sini değerlendirmek.

- Paydaş onayı: Bulguları ve önerileri paydaşlara sunarak onay ve destek sağlamak.

- Uygulama planı: Zaman çizelgeleri, kaynak tahsisi ve risk yönetimi stratejilerini içeren ayrıntılı bir uygulama planı geliştirmek.

- Eğitim ve destek: Ekibin yeni teknolojilere sorunsuz geçişini sağlamak için eğitim ve destek sağlamak.

33. Hızlı tempolu bir ortamda görev ve projeleri nasıl önceliklendirirsiniz?

Görevleri önceliklendirmek için etkilerini iş hedeflerine ve aciliyetlerine göre değerlendirmek etkilidir. Görevleri dört bölüme ayırmak için Eisenhower Matrisi gibi çerçeveler kullanabilirsiniz: acil ve önemli, önemli ama acil değil, acil ama önemli değil ve ikisi de değil. Ayrıca, paydaşlarla iletişim kurarak öncelikleri hizalayın ve ekibin yüksek değerli faaliyetlere odaklanmasını sağlayın.

FAANG Veri Mühendisi Mülakat Soruları

Bu bölümde, Facebook, Amazon ve Google yöneticilerinin veri mühendisliği pozisyonları için en sık sorduğu veri mühendisliği mülakat sorularını inceliyoruz.

Facebook Veri Mühendisi Mülakat Soruları

34. Kafka’da neden kümeler kullanırız ve faydaları nelerdir?

Bir Kafka kümesi, veriyi birden fazla örneğe dağıtan birden çok broker’dan oluşur. Bu mimari, kesinti olmaksızın ölçeklenebilirlik ve hata toleransı sağlar. Birincil küme devre dışı kalırsa diğer Kafka kümeleri aynı hizmetleri sunabilir ve yüksek erişilebilirlik sağlanır.

Kafka küme mimarisi Topics, Brokers, ZooKeeper, Producers ve Consumers bileşenlerinden oluşur. Büyük veri uygulamaları için veri akışlarını verimli şekilde yönetir ve sağlam, veriye dayalı uygulamalar oluşturmaya olanak tanır.

35. Apache Airflow hangi sorunları çözer?

Apache Airflow, analitik iş akışları, veri ambarı yönetimi ile veri dönüşüm ve modelleme için hatları yönetmenizi ve zamanlamanızı sağlar. Şunları sunar:

- Boru hattı yönetimi: İş akışlarını tanımlamak, zamanlamak ve izlemek için bir platform.

- Merkezi günlükleme: Yürütme günlüklerini tek bir yerden izleme.

- Hata yönetimi: Slack ve Discord gibi iletişim platformlarına hata uyarıları göndermek için geri çağırmalar.

- Kullanıcı arayüzü: İş akışlarını yönetmek ve görselleştirmek için kullanıcı dostu bir arayüz.

- Entegrasyon: Çeşitli araç ve sistemlerle sağlam entegrasyonlar.

- Açık kaynak: Ücretsizdir ve geniş bir topluluk tarafından desteklenir.

Amazon Veri Mühendisi Mülakat Soruları

36. Girdi olarak bir IP adresi dize halinde veriliyor. Bunun geçerli bir IP adresi olup olmadığını nasıl anlarsınız?

Bir IP adresinin geçerliliğini belirlemek için diziyi “.” üzerinden bölüp her parçayı doğrulamak için çeşitli kontroller oluşturabilirsiniz. Bunu gerçekleştiren bir Python fonksiyonu şöyledir:

def is_valid(ip):

ip = ip.split(".")

for i in ip:

if len(i) > 3 or int(i) < 0 or int(i) > 255:

return False

if len(i) > 1 and int(i) == 0:

return False

if len(i) > 1 and int(i) != 0 and i[0] == '0':

return False

return True

A = "255.255.11.135"

B = "255.050.11.5345"

print(is_valid(A)) # True

print(is_valid(B)) # False37. Hadoop’taki çeşitli modlar nelerdir?

Hadoop temel olarak üç modda çalışır:

- Bağımsız mod: Hata ayıklama amaçları için kullanılır. HDFS kullanmaz; girdi ve çıktılar için yerel dosya sistemine dayanır.

- Sözde dağıtık mod: NameNode ve DataNode’un aynı makinede bulunduğu tek düğümlü bir kümedir. Öncelikle test ve geliştirme için kullanılır.

- Tam dağıtık mod: Verinin birden çok düğüme dağıtıldığı, yönetici (NameNode) ve işçi (DataNode) süreçleri için ayrı düğümlerin bulunduğu üretime hazır moddur.

Google Veri Mühendisi Mülakat Soruları

38. Bir SQL sorgusunda yinelenen veri noktalarını nasıl ele alırsınız?

SQL’de yinelenenleri ele almak için DISTINCT anahtar sözcüğünü kullanabilir veya ROWID ile MAX ya da MIN fonksiyonlarını kullanarak yinelenen satırları silebilirsiniz. İşte örnekler:

DISTINCT kullanımı:

SELECT DISTINCT Name, ADDRESS

FROM CUSTOMERS

ORDER BY Name;ROWID kullanarak yinelenenleri silme:

DELETE FROM Employee

WHERE ROWID NOT IN (

SELECT MAX(ROWID)

FROM Employee

GROUP BY Name, ADDRESS

);39. 1’den n’e kadar aralıkta olan n-1 tamsayıdan oluşan bir liste veriliyor. Listede yineleme yok. Tamsayılardan biri listede eksik. Eksik tamsayıyı bulmak için verimli bir kod yazabilir misiniz?

Bu yaygın kodlama sorunu matematiksel bir yaklaşımla çözülebilir:

def search_missing_number(list_num):

n = len(list_num)

# Check if the first or last number is missing

if list_num[0] != 1:

return 1

if list_num[-1] != n + 1:

return n + 1

# Calculate the sum of the first n+1 natural numbers

total = (n + 1) * (n + 2) // 2

# Calculate the sum of all elements in the list

sum_of_L = sum(list_num)

# Return the difference, which is the missing number

return total - sum_of_L

# Validation

num_list = [1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 13]

print("The missing number is", search_missing_number(num_list)) # The missing number is 12Veri Mühendisi Mülakatına Nasıl Hazırlanılır

Bir mülakata girmeden önce, veri mühendisliğinde kullanılan tüm kavramları ve standart terimleri gözden geçirmelisiniz. Odaklanmanız gereken en önemli alanlardan bazıları şunlardır:

- SQL’e hâkim olun: Veritabanları oluşturma, değiştirme ve yönetme pratikleri yapmalısınız. Ayrıca veri analitiği, modelleme ve dönüşümde ustalaşmalısınız.

- Kodlama alıştırmaları çözün: Python, Scala veya C++ kodlama alıştırmaları çözün. Çoğu şirket programlama becerilerini ev ödevi sınavları ve canlı kodlama zorlukları vererek ölçer.

- Bir ETL hattı tasarlayın: veri, ETL veya teslimat hatları oluşturmayı pratiğe dökün. Veri hatlarını test etmeyi, doğrulamayı, ölçeklendirmeyi ve bakımını nasıl yapacağınızı bilmelisiniz.

- Analitik mühendislik: veri yükleme, dönüşüm ve analitiği pratiği yapın. Veri kalitesi ve sistem performansı için bir pano oluşturmayı öğrenin.

- Olası soruları gözden geçirin: Örnek deneme soruları üzerinden mülakata hazırlanın. Basit bir Google aramasıyla yüzlerce soruya erişebilirsiniz.

- Modern veri mühendisliği araçlarını öğrenin: Modern araçlarla deneyiminiz olmasa bile nasıl çalıştıklarını ve diğer araçlarla nasıl entegre olduklarını bilmelisiniz. Şirketler, daha düşük maliyetle performansı artıracak daha iyi araçlar arar.

- Yığın işleme ve akışı öğrenin: Apache Spark yığın işlem için, Apache Kafka ise veri akışı için kullanılır. Bu araçlar yüksek talep görür ve üst düzey şirketlerde iş bulmanıza yardımcı olur.

- Ortam: Bazen görüşmeci bulut bilişim (GCP, AWS, Azure), Docker, betik yazma, Terraform ve Kubernetes hakkında sorar. Bu araçları, bulutta veya şirket içinde bilgi işlem ve depolama kaynakları kurmak için kullanabilirsiniz. Bu teknolojileri anlamak ve portföy projelerine entegre etmek iyi bir uygulamadır.

Bir veri mühendisliği mülakatına hazırlanmak zorlayıcı olabilir; ancak doğru kaynaklar ve pratikle başarılı olabilir ve hayalinizdeki işe ulaşabilirsiniz. Becerilerinizi ve bilginizi daha da geliştirmek için şu değerli kaynaklara göz atın:

- Understanding Data Engineering: Veri mühendisliği kavram ve ilkelerini kapsamlı şekilde anlayın.

- Data Engineer in Python: Temel araç ve çerçeveleri kapsayan bu kariyer yoluyla Python ile veri mühendisliğinde ustalaşın.

- Database Design: Verimli ve ölçeklenebilir veritabanları tasarlamanın temellerini öğrenin.

Bu kurslardan yararlanarak temelinizi sağlamlaştırın ve veri mühendisliği kariyerinizde öne geçin. Mülakatlarınızda bol şans!

SSS

Bir veri mühendisi mülakatında ne bekleyebilirim?

Bir İK telefon görüşmesi, teknik telefon görüşmesi, ev ödevi sınavı, kodlama zorluğu, yerinde mülakat, beyaz tahtada veritabanı ve sistem tasarımları, SQL mülakatı ve son olarak kültürel uyumu kontrol etmek için “yönetici” mülakatı bekleyebilirsiniz.

Bazı şirketlerde üç aşamalı, bazılarında ise dokuz aşamaya kadar çıkan mülakat süreçleri vardır. Kurumlar, adayları her seviyede sınamak için sıklıkla yüksek bir giriş barajı uygular.

Veri mühendislerine talep var mı?

Evet, veri üreten her şirketin, boru hatları oluşturmak, veriyi yönetmek ve çeşitli departmanlara teslim etmek için veri mühendislerine ihtiyacı vardır. 2025’e kadar günde 463 exabayt veri üreteceğiz ve veriyi çıkarmak, dönüştürmek ve veri hatları ile sistemlerini yönetmek için giderek daha fazla mühendise ihtiyaç duyulacak - weforum.org.

Veri mühendisleri kod yazar mı?

Evet, BT alanıyla ilgili herkes, yönetim seviyesinde bile kod yazmayı öğrenmelidir. Veri mühendisleri için Python, SQL, Docker, Yaml ve Bash gerekli kodlama dilleridir. Bunlar; kod olarak altyapı, boru hatları, veritabanı yönetimi, akış, web scraping, veri işleme, modelleme ve analitikte kullanılır.

Veri analisti ile veri mühendisi arasındaki fark nedir?

Veri mühendisi, veri analistlerinin değerli iş içgörüleri çıkarması için verileri toplar, dönüştürür ve hazırlar. Veri mühendisleri tüm veritabanı sistemlerini yönetir ve analitik raporlar, panolar, müşteri araştırmaları ve tahminleme gibi veri analizi görevleri için yüksek kaliteli veri sağladıklarından emin olur.

Bir veri mühendisi gerçekte ne yapar?

Birden fazla kaynaktan veri edinmek; veri hatları oluşturmak, doğrulamak ve bakımını yapmak; verileri algoritmalarla dönüştürmek; analitik mühendislik yapmak; veri yönetişimi ve güvenliğine uyumu sağlamak ve tüm veritabanı sistemlerinin bakımını yapmak. Şirketteki çeşitli departmanlara yüksek kaliteli veri akışları sağlamaktan sorumludurlar. Veri mühendisliği hakkında daha fazla bilgi edinmek için What is Data Engineering? blog yazısını okuyabilirsiniz.

Veri mühendisi olmak için hangi becerilere ihtiyaç var?

Kodlama, veri ambarı, ETL (Extract Transform Load), SQL sorguları, veri analitiği ve modelleme, eleştirel düşünme ve iletişim becerilerini bilmelisiniz. Veri mühendisliği; sahada deneyim kazanarak ve karmaşık zorlukların üstesinden gelerek öğrenilir. Data Engineering Certification programımız, becerilerinizi geliştirmek ve bir veri mühendisi rolü elde etmek için ideal bir adımdır.

Sertifikalı bir veri bilimcisi olarak, yenilikçi makine öğrenimi uygulamaları oluşturmak için en son teknolojileri kullanmaya büyük ilgi duyuyorum. Konuşma tanıma, veri analizi ve raporlama, MLOps, konuşma yapay zekası ve NLP alanlarında güçlü bir geçmişe sahip olarak, gerçek bir etki yaratabilecek akıllı sistemler geliştirme becerilerimi geliştirdim. Teknik uzmanlığımın yanı sıra, karmaşık kavramları açık ve özlü bir dille ifade etme yeteneğine sahip, becerikli bir iletişimciyim. Sonuç olarak, veri bilimi konusunda aranan bir blog yazarı oldum ve giderek büyüyen veri profesyonelleri topluluğuyla görüşlerimi ve deneyimlerimi paylaşıyorum. Şu anda, içerik oluşturma ve düzenlemeye odaklanıyorum. Büyük dil modelleriyle çalışarak, hem işletmelerin hem de bireylerin verilerinden en iyi şekilde yararlanmalarına yardımcı olabilecek güçlü ve ilgi çekici içerikler geliştiriyorum.