Programma

Il data engineering è diventato uno dei ruoli più importanti nel settore tech, alla base delle infrastrutture dati delle aziende di tutto il mondo. Poiché le aziende si affidano sempre più al decision making basato sui dati, la domanda di data engineer qualificati continua a crescere.

Se ti stai preparando per un colloquio di data engineering, dovresti avere dimestichezza con domande generali e tecniche che valutano la tua esperienza, le capacità di problem solving e le competenze tecniche.

In questo post del blog, forniamo una guida completa per aiutarti a prepararti per le diverse fasi di un colloquio di data engineering, dal primo screening HR a valutazioni tecniche approfondite.

Domande iniziali HR per colloqui da Data Engineer

Nel primo colloquio con HR, il responsabile risorse umane ti farà domande sulla tua esperienza lavorativa e sul valore che puoi portare all'azienda. Questa fase serve a valutare il tuo background, le tue soft skill e l'allineamento con la cultura aziendale.

1. Perché sei la persona migliore per questa posizione?

Se il responsabile delle assunzioni ti ha selezionato per un colloquio telefonico, è perché ha visto qualcosa di interessante nel tuo profilo. Affronta la domanda con sicurezza e parla della tua esperienza e della tua crescita professionale.

È importante rivedere il profilo dell'azienda e la job description prima del colloquio. Questo ti aiuterà a capire cosa cerca il selezionatore e ad adattare di conseguenza la tua risposta.

Concentrati su competenze ed esperienze specifiche in linea con i requisiti del ruolo, come la progettazione e la gestione di pipeline dati, il modeling e i processi di ETL. Metti in evidenza come la tua combinazione unica di abilità, esperienza e conoscenze ti faccia spiccare.

2. Quali sono le responsabilità quotidiane di un data engineer?

Non esiste una risposta assoluta: condividere le tue esperienze passate e fare riferimento alla job description può fornire una risposta completa. In generale, le responsabilità quotidiane dei data engineer includono:

- Sviluppare, testare e mantenere database.

- Creare soluzioni dati basate sui requisiti di business.

- Acquisizione e integrazione dei dati.

- Sviluppare, validare e mantenere pipeline di dati per processi ETL, modeling, trasformazione e serving.

- Distribuire e gestire modelli di machine learning in alcuni casi.

- Mantenere la qualità dei dati pulendo, validando e monitorando i flussi.

- Migliorare affidabilità, prestazioni e qualità dei sistemi.

- Seguire le linee guida di data governance e sicurezza per garantire conformità e integrità dei dati.

3. Qual è l'aspetto più difficile dell'essere un data engineer?

Questa domanda varia in base alle esperienze personali, ma le sfide comuni includono:

- Tenere il passo con il ritmo rapido dell'innovazione tecnologica e integrare nuovi strumenti per migliorare prestazioni, sicurezza, affidabilità e ROI dei sistemi dati.

- Comprendere e implementare complessi protocolli di data governance e sicurezza.

- Gestire piani di disaster recovery e garantire disponibilità e integrità dei dati in eventi imprevisti.

- Bilanciare requisiti di business e vincoli tecnici, prevedendo la domanda di dati futura.

- Gestire grandi volumi di dati in modo efficiente, garantendo qualità e coerenza.

4. Con quali strumenti o framework dati hai esperienza? Ne preferisci alcuni rispetto ad altri?

La tua risposta dipenderà dalle tue esperienze. Conoscere strumenti moderni e integrazioni di terze parti ti aiuterà a rispondere con sicurezza. Parla di strumenti relativi a:

- Gestione database (ad es., MySQL, PostgreSQL, MongoDB)

- Data warehousing (ad es., Amazon Redshift, Google BigQuery, Snowflake)

- Orchestrazione dei dati (ad es., Apache Airflow, Prefect)

- Pipeline dati (ad es., Apache Kafka, Apache NiFi)

- Gestione cloud (ad es., AWS, Google Cloud Platform, Microsoft Azure)

- Pulizia, modeling e trasformazione dei dati (ad es., pandas, dbt, Spark)

- Elaborazione batch e real-time (ad es., Apache Spark, Apache Flink)

Ricorda, non c'è una risposta sbagliata a questa domanda. L'intervistatore sta valutando le tue competenze ed esperienze.

5. Come resti aggiornato sulle ultime tendenze e innovazioni nel data engineering?

Questa domanda valuta il tuo impegno verso l'apprendimento continuo e l'aggiornamento nel tuo campo.

Puoi citare l'iscrizione a newsletter di settore, il follow di blog influenti, la partecipazione a forum e community online, la frequenza a webinar e conferenze, e i corsi online. Evidenzia fonti o piattaforme specifiche che utilizzi per informarti.

6. Puoi descrivere un'occasione in cui hai collaborato con un team cross-funzionale per completare un progetto?

Il data engineering comporta spesso la collaborazione con vari team, tra cui data scientist, analyst e personale IT.

Condividi un esempio concreto in cui hai collaborato con successo con altri, evidenziando le tue capacità comunicative, la capacità di comprendere prospettive diverse e come hai contribuito al successo del progetto. Spiega le sfide affrontate e come le hai superate per raggiungere il risultato desiderato.

Domande tecniche per colloqui da Data Engineer

Il data engineering è altamente tecnico, quindi non sorprende che gran parte del tuo processo di colloquio includa domande ed esercizi tecnici. In questa sezione trattiamo diversi tipi di domande e risposte tecniche, con focus su junior, Python, SQL, progetti e domande gestionali.

Domande per junior data engineer

I colloqui per profili junior si concentrano su strumenti, Python e query SQL. Possono includere anche domande sulla gestione dei database e sui processi ETL, compresi coding challenge e test a casa.

Quando le aziende assumono neolaureati, vogliono assicurarsi che tu possa gestire efficacemente i loro dati e sistemi.

7. Puoi spiegare gli schemi di design rilevanti per il data modeling?

Esistono tre principali schemi di data modeling: stella (star), fiocco di neve (snowflake) e galassia.

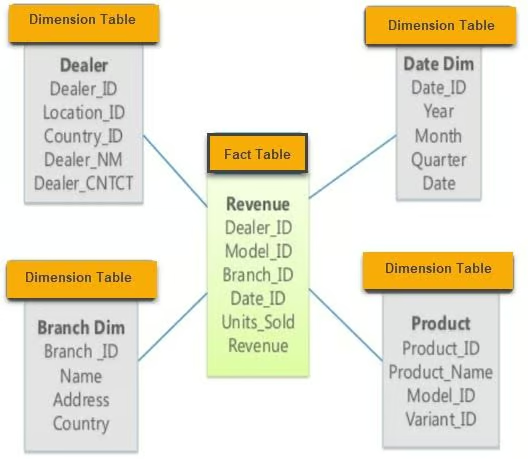

- Schema a stella: contiene varie tabelle di dimensione collegate a una tabella di fatto centrale. È semplice e facile da comprendere, adatto a query lineari.

Esempio di schema a stella. Immagine da guru99

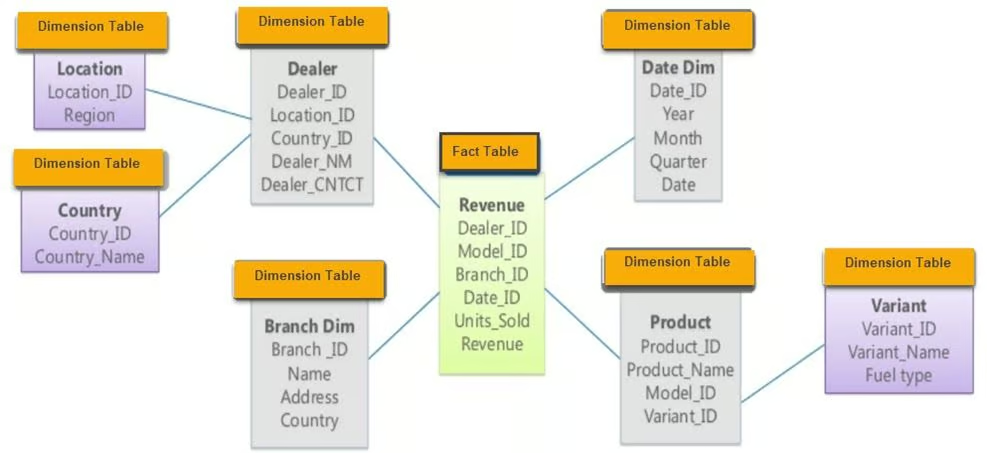

- Schema a fiocco di neve: estensione dello schema a stella, consiste in una tabella di fatto e più tabelle di dimensione con ulteriori livelli di normalizzazione, formando una struttura a fiocco di neve. Riduce la ridondanza e migliora l'integrità dei dati.

Esempio di schema a fiocco di neve. Immagine da guru99

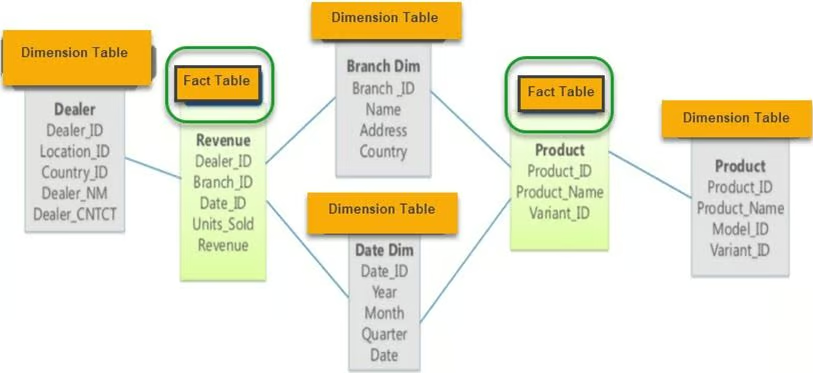

- Schema a galassia: noto anche come fact constellation, contiene due o più tabelle di fatto che condividono tabelle di dimensione. È adatto a sistemi database complessi che richiedono più tabelle di fatto.

Esempio di schema a galassia. Immagine da guru99

8. Con quali strumenti ETL hai lavorato? Qual è il tuo preferito e perché?

Quando rispondi, cita gli strumenti ETL che conosci al meglio e spiega perché hai scelto determinati strumenti per specifici progetti. Discuti pro e contro di ciascuno e come si inseriscono nel tuo flusso di lavoro. Strumenti open-source popolari includono:

- dbt (data build tool): Ottimo per trasformare i dati nel tuo warehouse usando SQL.

- Apache Spark: Eccellente per l'elaborazione di dati su larga scala e batch processing.

- Apache Kafka: Usato per pipeline in tempo reale e streaming.

- Airbyte: Strumento open-source di integrazione dati che aiuta in estrazione e caricamento.

Se vuoi rinfrescare le tue conoscenze ETL, considera il corso Introduction to Data Engineering.

9. Che cos'è l'orchestrazione dei dati e quali strumenti puoi usare?

L'orchestrazione dei dati è un processo automatico per accedere a dati grezzi da più fonti, eseguire pulizia, trasformazione e modeling, e servirli per attività analitiche. Garantisce che i dati fluiscano senza intoppi tra sistemi e fasi diverse di elaborazione.

Strumenti popolari per l'orchestrazione includono:

- Apache Airflow: Ampiamente usato per schedulare e monitorare workflow.

- Prefect: Uno strumento moderno di orchestrazione con focus sui flussi di dati.

- Dagster: Uno strumento pensato per carichi di lavoro data-intensive.

- AWS Glue: Servizio ETL gestito che semplifica la preparazione dei dati per l'analisi.

10. Quali strumenti usi per l'analytics engineering?

L'analytics engineering prevede la trasformazione dei dati processati, l'applicazione di modelli statistici e la loro visualizzazione tramite report e dashboard.

Strumenti popolari per l'analytics engineering includono:

- dbt (data build tool): usato per trasformare i dati nel warehouse tramite SQL.

- BigQuery: Data warehouse completamente gestito e serverless per analytics su larga scala.

- Postgres: Potente sistema di database relazionale open-source.

- Metabase: Strumento open-source che permette di interrogare i dati e visualizzare le risposte in formati comprensibili.

- Google Data Studio: Usato per creare dashboard e report visivi.

- Tableau: Piattaforma leader per la visualizzazione dei dati.

Questi strumenti aiutano ad accedere, trasformare e visualizzare i dati per ottenere insight utili e supportare i processi decisionali.

11. Qual è la differenza tra sistemi OLAP e OLTP?

OLAP (Online Analytical Processing) analizza dati storici e supporta query complesse. È ottimizzato per carichi di lavoro orientati alla lettura ed è spesso usato nei data warehouse per attività di business intelligence. OLTP (Online Transaction Processing) è progettato per gestire dati transazionali in tempo reale. È ottimizzato per carichi di lavoro orientati alla scrittura ed è usato nei database operativi per le attività quotidiane.

La differenza principale è nello scopo: l'OLAP supporta il decision making, l'OLTP le operazioni giornaliere.

Se hai ancora dubbi, ti consiglio di leggere il post OLTP vs OLAP.

Domande su Python per colloqui da data engineer

Python è il linguaggio più popolare nel data engineering grazie alla sua versatilità e al ricco ecosistema di librerie per elaborazione, analisi e automazione dei dati. Ecco alcune domande su Python che potresti incontrare in un colloquio.

12. Quali librerie Python sono più efficienti per l'elaborazione dei dati?

Le librerie più popolari per l'elaborazione dei dati in Python includono:

- pandas: ideale per manipolazione e analisi dei dati, con strutture come i DataFrame.

- NumPy: essenziale per il calcolo numerico, supporta array e matrici multi-dimensionali di grandi dimensioni.

- Dask: facilita il calcolo parallelo e gestisce elaborazioni oltre la memoria usando una sintassi simile a pandas.

- PySpark: API Python per Apache Spark, utile per elaborazioni su larga scala e analytics in tempo reale.

Ognuna ha pro e contro; la scelta dipende dai requisiti e dalla scala dei task.

13. Come esegui il web scraping in Python?

Il web scraping in Python tipicamente segue questi passaggi:

1. Accedi alla pagina web con la libreria requests:

import requests

from bs4 import BeautifulSoup

url = 'http://example.com'

response = requests.get(url)

soup = BeautifulSoup(response.text, 'html.parser')2. Estrai tabelle e informazioni con BeautifulSoup:

tables = soup.find_all('table')3. Converti in un formato strutturato usando pandas:

import pandas as pd

data = []

for table in tables:

rows = table.find_all('tr')

for row in rows:

cols = row.find_all('td')

cols = [ele.text.strip() for ele in cols]

data.append(cols)

df = pd.DataFrame(data)4. Pulisci i dati con pandas e NumPy:

df.dropna(inplace=True) # Drop missing values5. Salva i dati in un file CSV:

df.to_csv('scraped_data.csv', index=False)In alcuni casi, pandas.read_html può semplificare il processo:

df_list = pd.read_html('http://example.com')

df = df_list[0] # Assuming the table of interest is the first one14. Come gestisci in Python dataset così grandi da non entrare in memoria?

Gestire dataset che non entrano in memoria richiede strumenti e tecniche per l'elaborazione out-of-core:

- Dask: consente il calcolo parallelo e lavora con dataset oltre la memoria con sintassi tipo pandas.

import dask.dataframe as dd

df = dd.read_csv('large_dataset.csv')- PySpark: abilita l'elaborazione distribuita, utile su larga scala.

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName('data_processing').getOrCreate()

df = spark.read.csv('large_dataset.csv', header=True, inferSchema=True)- Chunking con pandas: leggi grandi dataset a blocchi.

import pandas as pd

chunk_size = 10000

for chunk in pd.read_csv('large_dataset.csv', chunksize=chunk_size):

process(chunk) # Replace with your processing function15. Come garantisci che il tuo codice Python sia efficiente e ottimizzato?

Per garantire efficienza e performance del codice Python, considera queste pratiche:

- Profilazione: usa strumenti come

cProfile,line_profileromemory_profilerper individuare colli di bottiglia.

import cProfile

cProfile.run('your_function()')- Vettorizzazione: usa

numpyopandasper operazioni vettoriali invece dei loop.

import numpy as np

data = np.array([1, 2, 3, 4, 5])

result = data * 2 # Vectorized operation- Strutture dati efficienti: scegli strutture adeguate (liste, set, dizionari) in base al caso d'uso.

data_dict = {'key1': 'value1', 'key2': 'value2'} # Faster lookups compared to lists- Parallelizzazione: usa multi-threading o multi-processing per task parallelizzabili.

from multiprocessing import Pool

def process_data(data_chunk):

# Your processing logic here

return processed_chunk

with Pool(processes=4) as pool:

results = pool.map(process_data, data_chunks)- Evitare calcoli ridondanti: metti in cache i risultati di operazioni costose se riutilizzati.

from functools import lru_cache

@lru_cache(maxsize=None)

def expensive_computation(x):

# Perform expensive computation

return result16. Come garantisci integrità e qualità dei dati nelle tue pipeline?

Integrità e qualità dei dati sono fondamentali per un data engineering affidabile. Best practice includono:

- Validazione dati: implementa controlli in varie fasi della pipeline per validare formati, range e coerenza.

def validate_data(df):

assert df['age'].min() >= 0, "Age cannot be negative"

assert df['salary'].dtype == 'float64', "Salary should be a float"

# Additional checks...- Pulizia dati: usa librerie come

pandasper pulire e preprocessare gestendo valori mancanti, rimuovendo duplicati e correggendo errori.

df.dropna(inplace=True) # Drop missing values

df.drop_duplicates(inplace=True) # Remove duplicates- Testing automatico: sviluppa unit test per le funzioni di elaborazione con framework come

pytest.

import pytest

def test_clean_data():

raw_data = pd.DataFrame({'age': [25, -3], 'salary': ['50k', '60k']})

clean_data = clean_data_function(raw_data)

assert clean_data['age'].min() >= 0

assert clean_data['salary'].dtype == 'float64'- Monitoraggio e alert: imposta il monitoraggio delle pipeline per rilevare anomalie e inviare avvisi quando emergono problemi di qualità.

from airflow import DAG

from airflow.operators.dummy_operator import DummyOperator

from airflow.operators.email_operator import EmailOperator

# Define your DAG and tasks...17. Come gestisci i dati mancanti nei dataset?

Gestire i dati mancanti è un compito comune. Approcci includono:

- Rimozione: elimina righe o colonne con dati mancanti se non significative.

df.dropna(inplace=True)- Imputazione: riempi i valori mancanti con misure statistiche (media, mediana) o metodi più sofisticati come l'imputazione KNN.

df['column'].fillna(df['column'].mean(), inplace=True)- Variabile indicatrice: aggiungi una variabile che segnali i valori mancanti.

df['column_missing'] = df['column'].isnull().astype(int)- Imputazione basata su modelli: usa modelli predittivi per stimare i valori mancanti.

from sklearn.impute import KNNImputer

imputer = KNNImputer(n_neighbors=5)

df = pd.DataFrame(imputer.fit_transform(df), columns=df.columns)18. Come gestisci i limiti di rate di un'API quando recuperi dati in Python?

Per gestire i limiti di rate di un'API, strategie utili includono:

- Backoff e retry: implementare un backoff esponenziale quando si raggiungono i limiti.

- Paginazione: recuperare i dati in blocchi più piccoli usando le opzioni di paginazione dell'API.

- Caching: memorizzare le risposte per evitare chiamate ridondanti.

Esempio con le librerie Python time e requests:

import time

import requests

def fetch_data_with_rate_limit(url):

for attempt in range(5): # Retry up to 5 times

response = requests.get(url)

if response.status_code == 429: # Too many requests

time.sleep(2 ** attempt) # Exponential backoff

else:

return response.json()

raise Exception("Rate limit exceeded")Python è senza dubbio uno dei linguaggi più importanti nel data engineering. Puoi affinare le tue competenze con il nostro percorso Data Engineer in Python, che copre un curriculum completo per dotarti di concetti, linguaggi, strumenti e framework moderni.

Domande su SQL per colloqui da data engineer

La fase di coding in SQL è una parte significativa del processo di selezione. Esercitarti con script semplici e complessi può aiutarti a prepararti. Potrebbero chiederti di scrivere query per analytics, common table expression, ranking, aggiunta di subtotali e funzioni temporanee.

19. Cosa sono le Common Table Expressions (CTE) in SQL?

Le CTE sono usate per semplificare join complessi ed eseguire sottoquery. Rendono le query più leggibili e manutenibili. Ecco un esempio di CTE che mostra tutti gli studenti con major in Science e voto A:

SELECT *

FROM class

WHERE id IN (

SELECT DISTINCT id

FROM students

WHERE grade = "A"

AND major = "Science"

);Usando una CTE, la query diventa:

WITH temp AS (

SELECT id

FROM students

WHERE grade = "A"

AND major = "Science"

)

SELECT *

FROM class

WHERE id IN (SELECT id FROM temp);Le CTE possono essere utilizzate per problemi più complessi e si possono concatenare più CTE.

20. Come esegui il ranking dei dati in SQL?

I data engineer classificano spesso valori in base a parametri come vendite e profitto. La funzione RANK() viene usata per classificare i dati in base a una colonna:

SELECT

id,

sales,

RANK() OVER (ORDER BY sales DESC) AS rank

FROM bill;In alternativa, puoi usare DENSE_RANK(), che non salta i ranghi successivi in caso di parità.

21. Puoi creare una semplice funzione temporanea e usarla in una query SQL?

Come in Python, puoi creare funzioni in SQL per rendere le query più eleganti ed evitare ripetitive case statement. Ecco un esempio di funzione temporanea get_gender:

CREATE TEMPORARY FUNCTION get_gender(type VARCHAR) RETURNS VARCHAR AS (

CASE

WHEN type = "M" THEN "male"

WHEN type = "F" THEN "female"

ELSE "n/a"

END

);

SELECT

name,

get_gender(type) AS gender

FROM class;Questo approccio rende il tuo SQL più pulito e manutenibile.

22. Come aggiungi subtotali in SQL?

L'aggiunta di subtotali si può ottenere con le funzioni GROUP BY e ROLLUP(). Ecco un esempio:

SELECT

department,

product,

SUM(sales) AS total_sales

FROM sales_data

GROUP BY ROLLUP(department, product);Questa query fornirà un subtotale per ogni reparto e un totale generale finale.

23. Come gestisci i dati mancanti in SQL?

Gestire i dati mancanti è essenziale per mantenere l'integrità. Approcci comuni includono:

- Uso di

COALESCE(): restituisce il primo valore non nullo nell'elenco.

SELECT id, COALESCE(salary, 0) AS salary FROM employees;- Uso di

CASE: per gestire condizionalmente i valori mancanti.

SELECT id,

CASE

WHEN salary IS NULL THEN 0

ELSE salary

END AS salary

FROM employees;24. Come esegui l'aggregazione dei dati in SQL?

L'aggregazione usa funzioni come SUM(), AVG(), COUNT(), MIN() e MAX(). Ecco un esempio:

SELECT department,

SUM(salary) AS total_salary,

AVG(salary) AS average_salary,

COUNT(*) AS employee_count

FROM employees

GROUP BY department;25. Come ottimizzi le query SQL per migliori prestazioni?

Per ottimizzare le query SQL, puoi:

- Usare indici sulle colonne più interrogate per velocizzare le ricerche.

- Evitare

SELECT *specificando solo le colonne necessarie. - Usare i join con criterio ed evitare quelli non necessari.

- Ottimizzare le sottoquery sostituendole con CTE quando appropriato.

- Analizzare i piani di esecuzione per identificare colli di bottiglia. Esempio:

EXPLAIN ANALYZE

SELECT customer_id, COUNT(order_id)

FROM orders

GROUP BY customer_id;Risolvere esercizi di SQL è il modo migliore per fare pratica e ripassare concetti dimenticati. Puoi valutare le tue skill SQL sostenendo il test Data Analysis in SQL di DataCamp (serve un account per accedere alla valutazione).

Domande su progetti per colloqui da data engineer

Dopo i colloqui generali, di solito si passa a una fase tecnica con challenge di coding, problem solving, progettazione di sistemi database alla lavagna, esame a casa e domande analitiche.

Questa fase può essere intensa, quindi conoscere alcune tipiche domande e risposte di data engineering può aiutarti a eccellere.

26. Guidami attraverso un progetto a cui hai lavorato dall'inizio alla fine.

Questa risposta dovrebbe venire naturale se hai già lavorato a un progetto di data engineering come studente o professionista. Detto questo, prepararsi in anticipo aiuta sempre. Ecco come strutturare la tua risposta:

- Introduzione e problema di business:

- Spiega il contesto del progetto. Descrivi il problema di business e gli obiettivi.

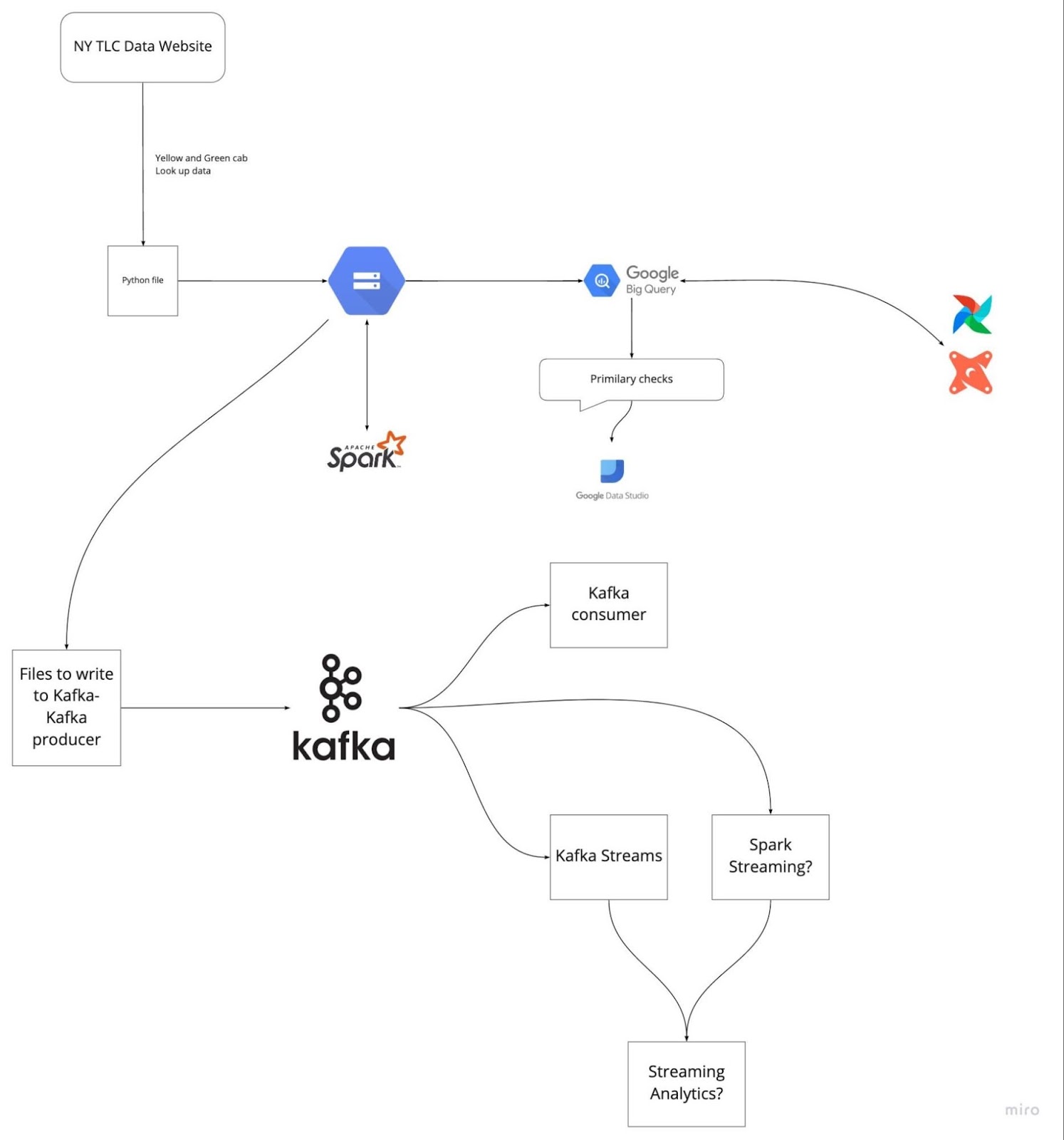

- Esempio: "In questo progetto, miravamo a ottimizzare la pipeline per processare i TLC Trip Record per migliorare le prestazioni delle query e l'accuratezza dei dati per il team analytics."

- Ingestione dati:

- Descrivi come hai accesso e ingerito i dati grezzi.

- Esempio: "Abbiamo ingerito i TLC Trip Record grezzi usando GCP, Airflow e PostgreSQL per garantire intake affidabile da più fonti."

- Elaborazione e trasformazione:

- Spiega i passaggi di pulizia, trasformazione e strutturazione dei dati.

- Esempio: "Abbiamo usato Apache Spark per il batch e Apache Kafka per lo streaming real-time nella trasformazione. I dati sono stati puliti, validati e convertiti in un formato strutturato per l'analisi."

- Storage e warehousing:

- Discuti le soluzioni di storage scelte e il perché.

- Esempio: "I dati processati sono stati archiviati in Google BigQuery, che offre un data warehousing scalabile ed efficiente. Airflow ha gestito i workflow."

- Analytics engineering:

- Evidenzia strumenti e metodi usati per scopi analitici.

- Esempio: "Abbiamo usato dbt (data build tool), BigQuery, PostgreSQL, Google Data Studio e Metabase per l'analytics engineering, creando modelli robusti e report e dashboard informativi."

- Deployment e ambiente cloud:

- Menziona strategie di deployment e infrastruttura cloud.

- Esempio: "L'intero progetto è stato deployato con GCP, Terraform e Docker, garantendo un ambiente cloud scalabile e affidabile."

- Sfide e soluzioni:

- Discuti le sfide affrontate e come le hai superate.

- Esempio: "Una delle principali sfide era gestire l'alto volume di dati in tempo reale. L'abbiamo affrontata ottimizzando i job di streaming Kafka e implementando trasformazioni Spark efficienti."

- Risultati e impatto:

- Concludi descrivendo risultati e impatto del progetto.

- Esempio: "Il progetto ha migliorato sensibilmente le prestazioni delle query e l'accuratezza dei dati per il team analytics, portando a decisioni più rapide e insight migliori."

Immagine da DataTalksClub/data-engineering-zoomcamp

Prepararti in anticipo rivedendo gli ultimi cinque progetti a cui hai lavorato può aiutarti a evitare blocchi durante il colloquio. Comprendi il problema e le soluzioni implementate. Esercitati a spiegare ogni passaggio in modo chiaro e conciso.

Domande per manager data engineer

Per i ruoli di engineering manager, le domande riguardano in genere decision making, comprensione del business, cura e mantenimento dei dataset, conformità e policy di sicurezza.

27. Qual è la differenza tra un data warehouse e un database operativo?

Un data warehouse serve dati storici per attività di data analytics e decision-making. Supporta elaborazioni analitiche ad alto volume, come l'Online Analytical Processing (OLAP). È progettato per gestire query complesse che accedono a molte righe ed è ottimizzato per operazioni di lettura. Supporta pochi utenti concorrenti ed è pensato per recuperare rapidamente grandi volumi di dati in modo efficiente.

I sistemi di database operativi (OLTP) gestiscono dataset dinamici in tempo reale. Supportano l'elaborazione di transazioni ad alto volume per migliaia di client concorrenti, risultando adatti alle operazioni quotidiane. I dati sono solitamente aggiornati e relativi a transazioni e operazioni. I sistemi OLTP sono ottimizzati per operazioni di scrittura e query veloci.

28. Perché pensi che ogni azienda che usa sistemi dati debba avere un piano di disaster recovery?

La gestione dei disastri è responsabilità di un data engineering manager. Un piano di disaster recovery garantisce che i sistemi dati possano essere ripristinati e continuare a operare in caso di attacchi informatici, guasti hardware, disastri naturali o altri eventi catastrofici. Aspetti rilevanti includono:

- Backup in tempo reale: eseguire regolarmente backup di file e database in location sicure e offsite.

- Ridondanza dei dati: implementare la replica dei dati in diverse aree geografiche per garantirne la disponibilità.

- Protocolli di sicurezza: stabilire protocolli per monitorare, tracciare e limitare il traffico in entrata e in uscita per prevenire violazioni.

- Procedure di ripristino: procedure dettagliate per ripristinare rapidamente ed efficientemente dati e sistemi, minimizzando i downtime.

- Test e simulazioni: testare regolarmente il piano tramite simulazioni ed esercitazioni per verificarne l'efficacia e apportare correzioni.

29. Come affronti il decision making quando guidi un team di data engineering?

Come data engineering manager, il decision making implica bilanciare considerazioni tecniche e obiettivi di business. Alcuni approcci includono:

- Decisioni data-driven: usare analytics per informare le decisioni, basandole su insight oggettivi e non sull'intuito.

- Collaborazione con gli stakeholder: lavorare a stretto contatto con gli stakeholder per capire i requisiti di business e allineare gli sforzi del team con gli obiettivi aziendali.

- Valutazione dei rischi: valutare rischi potenziali e impatti sui progetti, sviluppando strategie di mitigazione.

- Metodologie agili: adottare pratiche agili per adattarsi ai cambiamenti e rilasciare valore in modo incrementale.

- Mentorship e sviluppo: supportare la crescita del team con mentorship e formazione, favorendo un ambiente collaborativo.

30. Come gestisci la conformità alle normative sulla protezione dei dati nei tuoi progetti?

La conformità alle normative sulla protezione dei dati comporta diverse pratiche, ad esempio:

- Comprendere le normative: restare aggiornati su regolamenti come GDPR, CCPA e HIPAA.

- Framework di data governance: implementare un solido framework con policy su privacy, sicurezza e controllo degli accessi.

- Crittografia: cifrare i dati sensibili sia at rest che in transit per prevenire accessi non autorizzati.

- Controlli di accesso: implementare controlli rigorosi per garantire che solo personale autorizzato acceda ai dati sensibili.

- Audit e monitoraggio: condurre audit regolari e monitorare accessi e utilizzo dei dati per individuare e risolvere tempestivamente eventuali problemi di conformità.

31. Puoi descrivere un progetto di data engineering impegnativo che hai gestito?

Quando parli di un progetto impegnativo, puoi focalizzarti su:

- Ambito e obiettivi: definisci chiaramente gli obiettivi e il problema di business da risolvere.

- Sfide incontrate: descrivi sfide specifiche come limiti tecnici, vincoli di risorse o allineamento con gli stakeholder.

- Strategie e soluzioni: spiega come le hai superate, incluse soluzioni tecniche, pratiche di gestione del team e coinvolgimento degli stakeholder.

- Risultati e impatto: evidenzia gli esiti e l'impatto sul business, come migliore qualità dei dati, prestazioni di sistema potenziate o efficienza operativa aumentata.

32. Come valuti e implementi nuove tecnologie dati?

Valutare e implementare nuove tecnologie dati implica:

- Ricerca di mercato: restare aggiornati sulle ultime novità e tendenze nelle tecnologie di data engineering.

- Proof of concept (PoC): condurre PoC per testarne fattibilità e benefici nel tuo contesto.

- Analisi costi-benefici: valutare costi, benefici e potenziale ROI dell'adozione.

- Coinvolgimento degli stakeholder: presentare risultati e raccomandazioni per ottenere supporto.

- Piano di implementazione: sviluppare un piano dettagliato con timeline, allocazione risorse e gestione dei rischi.

- Formazione e supporto: fornire training e supporto al team per una transizione fluida.

33. Come dai priorità a task e progetti in un ambiente frenetico?

Un modo efficace è basarsi sull'impatto sugli obiettivi di business e sull'urgenza. Puoi usare framework come la Matrice di Eisenhower per categorizzare i task in quattro quadranti: urgente e importante, importante ma non urgente, urgente ma non importante, e nessuno dei due. Inoltre, comunica con gli stakeholder per allineare le priorità e assicurare che il team si concentri sulle attività a maggior valore.

Domande per colloqui da Data Engineer nelle FAANG

In questa sezione esploriamo le domande più frequenti poste da manager di Facebook, Amazon e Google per posizioni di data engineering.

Domande per colloqui da Data Engineer in Facebook

34. Perché usiamo cluster in Kafka e quali sono i benefici?

Un cluster Kafka è composto da più broker che distribuiscono i dati tra istanze multiple. Questa architettura offre scalabilità e tolleranza ai guasti senza downtime. Se il cluster primario cade, altri cluster Kafka possono fornire gli stessi servizi, garantendo alta disponibilità.

L'architettura del cluster Kafka comprende Topic, Broker, ZooKeeper, Producer e Consumer. Gestisce in modo efficiente stream di dati per applicazioni big data, abilitando la creazione di applicazioni data-driven robuste.

35. Quali problemi risolve Apache Airflow?

Apache Airflow consente di gestire e schedulare pipeline per workflow analitici, gestione di data warehouse e trasformazione e modeling dei dati. Fornisce:

- Gestione pipeline: una piattaforma per definire, schedulare e monitorare workflow.

- Log centralizzati: monitorare i log di esecuzione in un unico posto.

- Gestione errori: callback per inviare alert di failure a piattaforme come Slack e Discord.

- Interfaccia utente: una UI intuitiva per gestire e visualizzare i workflow.

- Integrazione: integrazioni robuste con vari strumenti e sistemi.

- Open source: è gratuito e ampiamente supportato dalla community.

Domande per colloqui da Data Engineer in Amazon

36. Ti viene fornito un indirizzo IP come stringa in input. Come verificheresti se è valido o no?

Per determinarne la validità, puoi dividere la stringa su “.” ed effettuare vari controlli per validare ciascun segmento. Ecco una funzione Python per farlo:

def is_valid(ip):

ip = ip.split(".")

for i in ip:

if len(i) > 3 or int(i) < 0 or int(i) > 255:

return False

if len(i) > 1 and int(i) == 0:

return False

if len(i) > 1 and int(i) != 0 and i[0] == '0':

return False

return True

A = "255.255.11.135"

B = "255.050.11.5345"

print(is_valid(A)) # True

print(is_valid(B)) # False37. Quali sono le diverse modalità in Hadoop?

Hadoop funziona principalmente in tre modalità:

- Standalone: usata per il debug. Non usa HDFS e si basa sul file system locale per input e output.

- Pseudo-distribuita: cluster a nodo singolo in cui NameNode e DataNode risiedono sulla stessa macchina. Usata soprattutto per test e sviluppo.

- Completamente distribuita: modalità production-ready in cui i dati sono distribuiti su più nodi, con nodi separati per i demoni master (NameNode) e slave (DataNode).

Domande per colloqui da Data Engineer in Google

38. Come gestiresti i punti dati duplicati in una query SQL?

Per gestire i duplicati in SQL, puoi usare la keyword DISTINCT oppure eliminare le righe duplicate usando ROWID con le funzioni MAX o MIN. Ecco alcuni esempi:

Uso di DISTINCT:

SELECT DISTINCT Name, ADDRESS

FROM CUSTOMERS

ORDER BY Name;Eliminazione dei duplicati usando ROWID:

DELETE FROM Employee

WHERE ROWID NOT IN (

SELECT MAX(ROWID)

FROM Employee

GROUP BY Name, ADDRESS

);39. Dato un elenco di interi di lunghezza n-1, questi interi sono nel range da 1 a n. Non ci sono duplicati nell'elenco. Manca un intero. Puoi scrivere un codice efficiente per trovare il numero mancante?

Questa challenge comune si può risolvere con un approccio matematico:

def search_missing_number(list_num):

n = len(list_num)

# Check if the first or last number is missing

if list_num[0] != 1:

return 1

if list_num[-1] != n + 1:

return n + 1

# Calculate the sum of the first n+1 natural numbers

total = (n + 1) * (n + 2) // 2

# Calculate the sum of all elements in the list

sum_of_L = sum(list_num)

# Return the difference, which is the missing number

return total - sum_of_L

# Validation

num_list = [1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 13]

print("The missing number is", search_missing_number(num_list)) # The missing number is 12Come prepararsi al colloquio da Data Engineer

Prima di presentarti a un colloquio, dovresti rivedere tutti i concetti e i termini standard usati nel data engineering. Ecco le aree più importanti su cui concentrarti:

- Domina SQL: esercitati a creare, modificare e gestire database. Inoltre, padroneggia analytics, modeling e trasformazione dei dati.

- Risolvi coding challenge: esercitati con sfide di Python, Scala o C++. Molte aziende valutano le capacità di programmazione con esami a casa e challenge live.

- Progetta una pipeline ETL: fai pratica nel creare pipeline di dati, ETL o di delivery. Devi capire come testare, validare, scalare e mantenere le pipeline.

- Analytics engineering: fai pratica con caricamento, trasformazione e analytics. Impara a creare una dashboard per la qualità dei dati e le prestazioni del sistema.

- Rivedi le possibili domande: preparati consultando domande di esempio. Una semplice ricerca su Google ti darà accesso a centinaia di domande.

- Conosci gli strumenti moderni di data engineering: anche se non hai esperienza pratica, dovresti sapere come funzionano e come si integrano con altri strumenti. Le aziende cercano sempre soluzioni migliori per migliorare le prestazioni a costi inferiori.

- Impara batch processing e streaming: Apache Spark per il batch, Apache Kafka per lo streaming. Questi strumenti sono molto richiesti e ti aiuteranno a entrare nelle aziende top.

- Ambiente: Talvolta l'intervistatore chiede di cloud computing (GCP, AWS, Azure), Docker, scripting, Terraform e Kubernetes. Puoi usare questi strumenti per configurare risorse di calcolo e storage in cloud o on-premise. Comprenderli e integrarli in progetti portfolio è una buona pratica.

Prepararsi a un colloquio di data engineering può essere impegnativo, ma con le giuste risorse e pratica puoi eccellere e ottenere il lavoro dei tuoi sogni. Per migliorare ulteriormente competenze e conoscenze, dai un'occhiata a queste risorse utili:

- Understanding Data Engineering: acquisisci una comprensione completa di concetti e principi del data engineering.

- Data Engineer in Python: padroneggia il data engineering con Python tramite questo career track, che copre strumenti e framework essenziali.

- Database Design: impara i fondamenti del design dei database per crearli efficienti e scalabili.

Sfrutta questi corsi per consolidare le basi e restare un passo avanti nella tua carriera nel data engineering. In bocca al lupo per i colloqui!

FAQs

Cosa posso aspettarmi da un colloquio da data engineer?

Puoi aspettarti un colloquio telefonico HR, un colloquio tecnico telefonico, un esame a casa, un coding challenge, un colloquio on-site, progettazione alla lavagna di database e sistemi, un colloquio SQL e infine un colloquio con l’“executive” per verificare l’aderenza culturale.

Alcune aziende hanno tre fasi di colloquio, altre fino a nove. Spesso le organizzazioni impostano una barriera d’ingresso elevata per testare i candidati su ogni livello.

I data engineer sono richiesti?

Sì, ogni azienda che genera dati ha bisogno di data engineer per creare pipeline, gestirle e fornire dati ai vari reparti. Entro il 2025, produrremo 463 exabyte di dati al giorno, e serviranno sempre più ingegneri per estrarre, trasformare e gestire pipeline e sistemi dati - weforum.org.

I data engineer scrivono codice?

Sì, chiunque lavori nell’IT dovrebbe saper scrivere codice, anche a livello manageriale. Per i data engineer, Python, SQL, Docker, Yaml e Bash sono linguaggi necessari. Sono usati in infrastructure as code, pipeline, gestione database, streaming, web scraping, elaborazione dati, modeling e analytics.

Qual è la differenza tra un data analyst e un data engineer?

Il data engineer raccoglie, trasforma e prepara i dati affinché i data analyst possano estrarre insight di business. I data engineer gestiscono interi sistemi di database e si assicurano che forniscano dati di alta qualità per compiti analitici come report, dashboard, ricerche sui clienti e forecasting.

Cosa fa concretamente un data engineer?

Acquisire dati da più fonti, creare, validare e mantenere pipeline, trasformare i dati con algoritmi, svolgere analytics engineering, garantire conformità a governance e sicurezza, e mantenere interi sistemi di database. Sono responsabili di fornire stream di dati di alta qualità ai vari reparti dell’azienda. Puoi saperne di più leggendo il blog What is Data Engineering?.

Quali competenze servono per essere un data engineer?

Devi conoscere coding, data warehousing, ETL (Extract Transform Load), query SQL, data analytics e modeling, pensiero critico e capacità comunicative. Il data engineering si apprende con l’esperienza e superando sfide complesse sul campo. La nostra Data Engineering Certification è l’opzione perfetta per sviluppare le tue competenze e ottenere un ruolo da data engineer.

In quanto data scientist certificato, sono appassionato di sfruttare tecnologie all’avanguardia per creare applicazioni di machine learning innovative. Con una solida esperienza in riconoscimento vocale, analisi e reportistica dei dati, MLOps, AI conversazionale e NLP, ho affinato le mie competenze nello sviluppo di sistemi intelligenti in grado di avere un impatto concreto. Oltre alla mia expertise tecnica, sono anche un comunicatore efficace, con il talento di rendere chiari e sintetici concetti complessi. Di conseguenza, sono diventato un blogger molto seguito in ambito data science, condividendo idee ed esperienze con una community in crescita di professionisti dei dati. Attualmente mi concentro sulla creazione e sull’editing di contenuti, lavorando con large language model per sviluppare contenuti potenti e coinvolgenti che possano aiutare aziende e singoli a valorizzare al meglio i propri dati.