Leerpad

Data engineering is uitgegroeid tot een van de belangrijkste rollen in de techsector en vormt de ruggengraat van de datainfrastructuur van bedrijven wereldwijd. Nu organisaties steeds meer vertrouwen op datagedreven besluitvorming, blijft de vraag naar bekwame data engineers stijgen.

Als je je voorbereidt op een sollicitatiegesprek voor data engineering, moet je goed thuis zijn in algemene en technische vragen die je ervaring, probleemoplossend vermogen en technische vaardigheden toetsen.

In dit blog geven we je een uitgebreide gids om je voor te bereiden op de verschillende fasen van een data-engineeringgesprek, van de eerste HR-screening tot diepgaande technische evaluaties.

Eerste HR-vragen voor een data-engineeringsgesprek

In de eerste HR-ronde vraagt de HR-manager naar je werkervaring en de waarde die je meebrengt voor het bedrijf. Deze fase is bedoeld om je achtergrond, sociale vaardigheden en algehele fit met de bedrijfscultuur te beoordelen.

1. Waarom ben jij de beste kandidaat voor deze functie?

Als de hiring manager je selecteert voor een telefoongesprek, heeft diegene iets in je profiel gezien dat beviel. Beantwoord deze vraag met zelfvertrouwen en vertel over je ervaring en je loopbaangroei.

Het is belangrijk om vooraf het bedrijfsprofiel en de functiebeschrijving te bekijken. Zo begrijp je beter waar de hiring manager naar op zoek is en kun je je antwoord daarop afstemmen.

Focus op specifieke vaardigheden en ervaringen die aansluiten op de functie-eisen, zoals het ontwerpen en beheren van datapijplijnen, modelleren en ETL-processen. Leg uit hoe jouw unieke combinatie van skills, ervaring en kennis je onderscheidt.

2. Wat zijn de dagelijkse verantwoordelijkheden van een data engineer?

Er is geen absoluut antwoord, maar door je ervaringen uit eerdere banen te delen en te verwijzen naar de functiebeschrijving kun je een volledig beeld geven. Over het algemeen omvatten de dagelijkse taken van data engineers:

- Ontwikkelen, testen en onderhouden van databases.

- Datatoepassingen bouwen op basis van zakelijke vereisten.

- Data-acquisitie en -integratie.

- Ontwikkelen, valideren en onderhouden van datapijplijnen voor ETL-processen, modellering, transformatie en ontsluiting.

- Uitrollen en beheren van machinelearning-modellen in sommige gevallen.

- Datakwaliteit borgen door data te schonen, te valideren en datastromen te monitoren.

- Betrouwbaarheid, performance en kwaliteit van systemen verbeteren.

- Datagovernance en beveiligingsrichtlijnen volgen om compliance en dataintegriteit te waarborgen.

3. Wat vind je het lastigst aan werken als data engineer?

Dit verschilt per persoon, maar veelvoorkomende uitdagingen zijn:

- Bijblijven met het hoge tempo van technologische ontwikkelingen en nieuwe tools integreren om prestaties, beveiliging, betrouwbaarheid en ROI van datasystemen te verbeteren.

- Inzicht krijgen in en implementeren van complexe datagovernance- en beveiligingsprotocollen.

- Rampenplannen beheren en zorgen voor beschikbaarheid en integriteit van data bij onvoorziene gebeurtenissen.

- Balanceren van bedrijfsvereisten met technische beperkingen en toekomstige databehoeften inschatten.

- Efficiënt omgaan met grote hoeveelheden data en datakwaliteit en -consistentie waarborgen.

4. Met welke datatools of -frameworks heb je ervaring? Heb je voorkeuren?

Je antwoord is gebaseerd op je eigen ervaring. Bekend zijn met moderne tools en externe integraties helpt je deze vraag met vertrouwen te beantwoorden. Bespreek tools voor:

- Databasemanagement (bijv. MySQL, PostgreSQL, MongoDB)

- Datawarehousing (bijv. Amazon Redshift, Google BigQuery, Snowflake)

- Data-orchestratie (bijv. Apache Airflow, Prefect)

- Datapijplijnen (bijv. Apache Kafka, Apache NiFi)

- Cloudbeheer (bijv. AWS, Google Cloud Platform, Microsoft Azure)

- Dataschoning, modellering en transformatie (bijv. pandas, dbt, Spark)

- Batch- en realtimeverwerking (bijv. Apache Spark, Apache Flink)

Onthoud dat er geen fout antwoord bestaat. De interviewer beoordeelt je vaardigheden en ervaring.

5. Hoe blijf je op de hoogte van de nieuwste trends en ontwikkelingen in data engineering?

Met deze vraag wordt je inzet voor continu leren en up-to-date blijven getoetst.

Je kunt noemen dat je vaknieuwsbrieven volgt, invloedrijke blogs leest, deelneemt aan online fora en communities, webinars en conferenties bezoekt en online cursussen volgt. Noem concrete bronnen of platforms die je gebruikt om geïnformeerd te blijven.

6. Kun je een moment beschrijven waarop je met een crossfunctioneel team samenwerkte om een project te voltooien?

Data engineering betekent vaak samenwerken met verschillende teams, waaronder data scientists, analisten en IT.

Deel een concreet voorbeeld waarin je succesvol samenwerkte, met de nadruk op je communicatievaardigheden, je vermogen om verschillende perspectieven te begrijpen en je bijdrage aan het succes van het project. Leg uit welke uitdagingen je tegenkwam en hoe je die hebt overwonnen om het gewenste resultaat te bereiken.

Technische interviewvragen voor data engineers

Data engineering is sterk technisch, dus het is geen verrassing dat het grootste deel van je sollicitatieproces uit technische vragen en oefeningen bestaat. In deze sectie behandelen we verschillende soorten technische vragen en antwoorden, met focus op junior, Python, SQL, projectgerichte en managementvragen.

Junior data-engineer interviewvragen

Junior-interviews richten zich op tools, Python en SQL-queries. Er kunnen ook vragen komen over databasemanagement en ETL-processen, inclusief codeeropdrachten en thuisopdrachten.

Wanneer bedrijven starters aannemen, willen ze zeker weten dat je effectief met hun data en systemen kunt werken.

7. Kun je de ontwerpschema’s uitleggen die relevant zijn voor datamodellering?

Er zijn drie primaire datamodelleringsschema’s: ster, sneeuwvlok en galaxie.

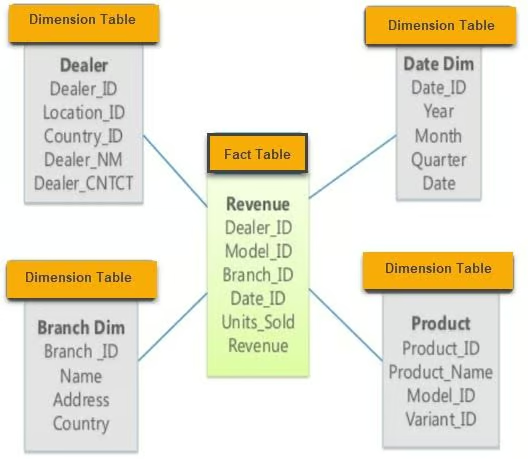

- Sterschema: Dit schema bevat verschillende dimensietabellen die zijn verbonden met een centrale feiten- of facttabel. Het is eenvoudig en makkelijk te begrijpen, en daardoor geschikt voor rechttoe-rechtaan queries.

Voorbeeld van een sterschema. Afbeelding van guru99

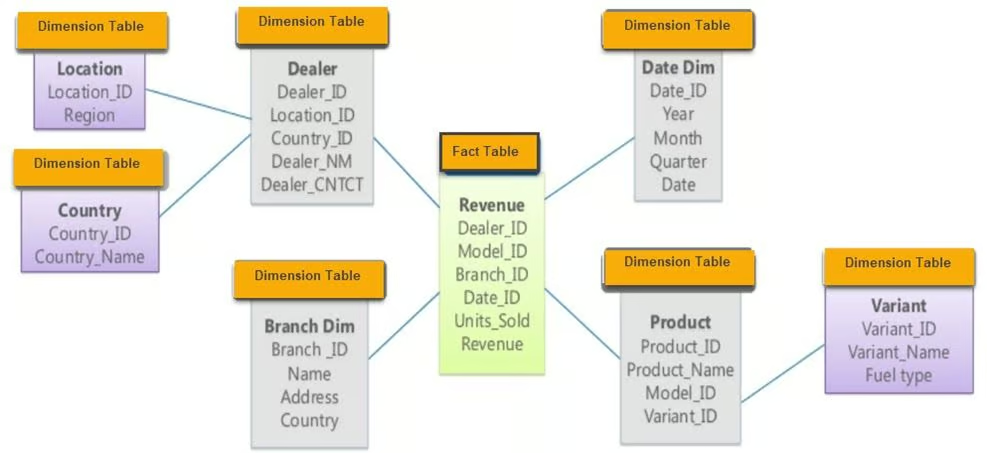

- Sneeuwvlokschema: Een uitbreiding op het sterschema. Het sneeuwvlokschema bestaat uit een facttabel en meerdere dimensietabellen met extra lagen normalisatie, waardoor een sneeuwvlokstructuur ontstaat. Dit reduceert redundantie en verbetert dataintegriteit.

Voorbeeld van een sneeuwvlokschema. Afbeelding van guru99

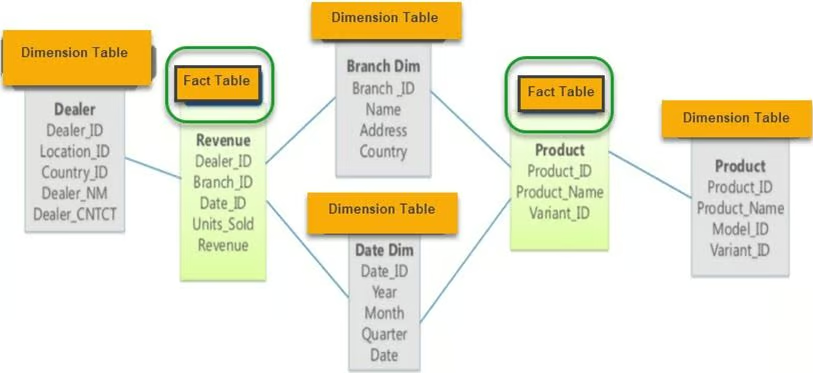

- Galaxieschema: Ook wel fact constellation genoemd. Het bevat twee of meer facttabellen die dimensietabellen delen. Dit schema is geschikt voor complexe databasesystemen die meerdere facttabellen nodig hebben.

Voorbeeld van een galaxieschema. Afbeelding van guru99

8. Met welke ETL-tools heb je gewerkt? Welke is je favoriet en waarom?

Noem de ETL-tools die je beheerst en leg uit waarom je voor bepaalde projecten specifieke tools hebt gekozen. Bespreek de voor- en nadelen van elke tool en hoe ze in je workflow passen. Populaire open-sourcetools zijn onder andere:

- dbt (data build tool): Uitstekend voor het transformeren van data in je warehouse met SQL.

- Apache Spark: Zeer geschikt voor grootschalige en batchverwerking.

- Apache Kafka: Gebruikt voor realtime datapijplijnen en streaming.

- Airbyte: Een open-source dataintegratietool voor extractie en laden.

Moet je je ETL-kennis opfrissen? Volg dan de cursus Introduction to Data Engineering.

9. Wat is data-orchestratie en welke tools kun je gebruiken?

Data-orchestratie is een geautomatiseerd proces waarbij ruwe data uit meerdere bronnen wordt opgehaald, opgeschoond, getransformeerd en gemodelleerd en vervolgens beschikbaar wordt gemaakt voor analytische taken. Het zorgt voor een soepele datastroom tussen systemen en verwerkingsstadia.

Populaire tools voor data-orchestratie zijn:

- Apache Airflow: Veelgebruikt voor het plannen en monitoren van workflows.

- Prefect: Een moderne orchestratie-tool met focus op dataflow.

- Dagster: Ontworpen voor data-intensieve workloads.

- AWS Glue: Een beheerde ETL-service die datavoorbereiding voor analytics vereenvoudigt.

10. Welke tools gebruik je voor analytics engineering?

Analytics engineering omvat het transformeren van verwerkte data, het toepassen van statistische modellen en het visualiseren via rapporten en dashboards.

Populaire tools voor analytics engineering zijn:

- dbt (data build tool): Voor het transformeren van data in je warehouse met SQL.

- BigQuery: Een volledig beheerd, serverloos datawarehouse voor grootschalige data-analyse.

- Postgres: Een krachtige, open-source relationele database.

- Metabase: Open source-tool om vragen over je data te stellen en antwoorden overzichtelijk weer te geven.

- Google Data Studio: Voor het maken van dashboards en visuele rapporten.

- Tableau: Een toonaangevend platform voor datavisualisatie.

Met deze tools kun je data ontsluiten, transformeren en visualiseren om inzichten te verkrijgen en besluitvorming te ondersteunen.

11. Wat is het verschil tussen OLAP- en OLTP-systemen?

OLAP (Online Analytical Processing) analyseert historische data en ondersteunt complexe queries. Het is geoptimaliseerd voor read-heavy workloads en wordt vaak gebruikt in datawarehouses voor business intelligence. OLTP (Online Transaction Processing) is ontworpen voor het beheren van realtime transactionele data. Het is geoptimaliseerd voor write-heavy workloads en wordt gebruikt in operationele databases voor dagelijkse bedrijfsvoering.

Het belangrijkste verschil zit in het doel: OLAP ondersteunt besluitvorming, OLTP ondersteunt dagelijkse operaties.

Heb je nog twijfels? Lees dan de blog OLTP vs OLAP.

Python-interviewvragen voor data engineers

Python is de populairste taal in data engineering vanwege de veelzijdigheid en de rijke ecosysteem aan libraries voor dataverwerking, analyse en automatisering. Hier zijn enkele Python-gerelateerde vragen die je kunt tegenkomen.

12. Welke Python-libraries zijn het meest efficiënt voor dataverwerking?

De populairste dataverwerkingslibraries in Python zijn:

- pandas: Ideaal voor datamanipulatie en -analyse, met datastructuren zoals DataFrames.

- NumPy: Essentieel voor numerieke berekeningen, met ondersteuning voor grote multidimensionale arrays en matrices.

- Dask: Maakt parallelle computing mogelijk en kan groter-dan-geheugen-bewerkingen aan met een pandas-achtige syntax.

- PySpark: Een Python-API voor Apache Spark, nuttig voor grootschalige verwerking en realtime analytics.

Elke library heeft voor- en nadelen; de keuze hangt af van de eisen en schaal van je taak.

13. Hoe doe je webscraping in Python?

Webscraping in Python omvat doorgaans de volgende stappen:

1. Toegang krijgen tot de webpagina met de requests-library:

import requests

from bs4 import BeautifulSoup

url = 'http://example.com'

response = requests.get(url)

soup = BeautifulSoup(response.text, 'html.parser')2. Tabellen en informatie extraheren met BeautifulSoup:

tables = soup.find_all('table')3. Omzetten naar een gestructureerd formaat met pandas:

import pandas as pd

data = []

for table in tables:

rows = table.find_all('tr')

for row in rows:

cols = row.find_all('td')

cols = [ele.text.strip() for ele in cols]

data.append(cols)

df = pd.DataFrame(data)4. Data opschonen met pandas en NumPy:

df.dropna(inplace=True) # Drop missing values5. Data opslaan als CSV-bestand:

df.to_csv('scraped_data.csv', index=False)In sommige gevallen kan pandas.read_html het proces vereenvoudigen:

df_list = pd.read_html('http://example.com')

df = df_list[0] # Assuming the table of interest is the first one14. Hoe ga je om met grote datasets in Python die niet in het geheugen passen?

Voor grote datasets die niet in het geheugen passen, gebruik je tools en technieken voor out-of-core computing:

- Dask: Voor parallelle computing en groter-dan-geheugen-datasets met een pandas-achtige syntax.

import dask.dataframe as dd

df = dd.read_csv('large_dataset.csv')- PySpark: Maakt gedistribueerde dataverwerking mogelijk voor grootschalige data.

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName('data_processing').getOrCreate()

df = spark.read.csv('large_dataset.csv', header=True, inferSchema=True)- Chunking met pandas: Lees grote datasets in stukken in.

import pandas as pd

chunk_size = 10000

for chunk in pd.read_csv('large_dataset.csv', chunksize=chunk_size):

process(chunk) # Replace with your processing function15. Hoe zorg je dat je Python-code efficiënt en geoptimaliseerd is?

Pas de volgende praktijken toe:

- Profiling: Gebruik tools als

cProfile,line_profilerofmemory_profilerom bottlenecks te vinden.

import cProfile

cProfile.run('your_function()')- Vectorisatie: Gebruik

numpyofpandasvoor gevectoriseerde bewerkingen in plaats van lussen.

import numpy as np

data = np.array([1, 2, 3, 4, 5])

result = data * 2 # Vectorized operation- Efficiënte datastructuren: Kies passende structuren (bijv. lijsten, sets, dictionaries) voor je use-case.

data_dict = {'key1': 'value1', 'key2': 'value2'} # Faster lookups compared to lists- Parallel processing: Gebruik multithreading of multiprocessing voor taken die te paralleliseren zijn.

from multiprocessing import Pool

def process_data(data_chunk):

# Your processing logic here

return processed_chunk

with Pool(processes=4) as pool:

results = pool.map(process_data, data_chunks)- Redundante berekeningen vermijden: Cache resultaten van dure operaties als je ze hergebruikt.

from functools import lru_cache

@lru_cache(maxsize=None)

def expensive_computation(x):

# Perform expensive computation

return result16. Hoe borg je dataintegriteit en -kwaliteit in je datapijplijnen?

Dataintegriteit en -kwaliteit zijn cruciaal. Best practices zijn onder andere:

- Datavalidatie: Voer checks uit in verschillende stadia om formats, bereiken en consistentie te valideren.

def validate_data(df):

assert df['age'].min() >= 0, "Age cannot be negative"

assert df['salary'].dtype == 'float64', "Salary should be a float"

# Additional checks...- Dataschoning: Gebruik

pandasom missende waarden te verwerken, duplicaten te verwijderen en fouten te corrigeren.

df.dropna(inplace=True) # Drop missing values

df.drop_duplicates(inplace=True) # Remove duplicates- Geautomatiseerd testen: Schrijf unit tests voor verwerkingsfuncties met frameworks zoals

pytest.

import pytest

def test_clean_data():

raw_data = pd.DataFrame({'age': [25, -3], 'salary': ['50k', '60k']})

clean_data = clean_data_function(raw_data)

assert clean_data['age'].min() >= 0

assert clean_data['salary'].dtype == 'float64'- Monitoring en alerts: Zet monitoring op om afwijkingen te detecteren en meldingen te sturen bij kwaliteitsproblemen.

from airflow import DAG

from airflow.operators.dummy_operator import DummyOperator

from airflow.operators.email_operator import EmailOperator

# Define your DAG and tasks...17. Hoe ga je om met missende data in je datasets?

Missende data verwerken is een veelvoorkomende taak. Aanpakken zijn onder andere:

- Verwijderen: Rijen of kolommen met missende waarden weghalen als ze niet significant zijn.

df.dropna(inplace=True)- Imputatie: Missende waarden vullen met statistieken (gemiddelde, mediaan) of geavanceerdere methoden zoals KNN-imputatie.

df['column'].fillna(df['column'].mean(), inplace=True)- Indicatorvariabele: Een indicator toevoegen die aangeeft welke waarden ontbraken.

df['column_missing'] = df['column'].isnull().astype(int)- Modelgebaseerde imputatie: Voorspellende modellen gebruiken om missende waarden te schatten.

from sklearn.impute import KNNImputer

imputer = KNNImputer(n_neighbors=5)

df = pd.DataFrame(imputer.fit_transform(df), columns=df.columns)18. Hoe ga je om met API-rate limits bij het ophalen van data in Python?

Strategieën zijn onder andere:

- Backoff en retry: Exponentiële backoff toepassen wanneer je de limiet bereikt.

- Paginering: Data in kleinere stukken ophalen via de pagineringsopties van de API.

- Caching: Responses opslaan om dubbele API-calls te vermijden.

Voorbeeld met de Python-time-library en de module requests:

import time

import requests

def fetch_data_with_rate_limit(url):

for attempt in range(5): # Retry up to 5 times

response = requests.get(url)

if response.status_code == 429: # Too many requests

time.sleep(2 ** attempt) # Exponential backoff

else:

return response.json()

raise Exception("Rate limit exceeded")Python is zonder twijfel een van de belangrijkste talen in data engineering. Je kunt je skills aanscherpen met onze Data Engineer in Python-track, met een complete leerlijn rond moderne concepten, programmeertalen, tools en frameworks.

SQL-interviewvragen voor data engineers

De SQL-codeerfase is een belangrijk onderdeel van het wervingsproces. Oefen met uiteenlopende eenvoudige en complexe scripts. Interviewers kunnen je vragen queries te schrijven voor data-analyse, common table expressions, ranking, subtotals en tijdelijke functies.

19. Wat zijn Common Table Expressions (CTE’s) in SQL?

CTE’s worden gebruikt om complexe joins te vereenvoudigen en subqueries uit te voeren. Ze maken SQL-queries leesbaarder en onderhoudsvriendelijker. Hier is een voorbeeld van een CTE die alle studenten met Science als major en cijfer A toont:

SELECT *

FROM class

WHERE id IN (

SELECT DISTINCT id

FROM students

WHERE grade = "A"

AND major = "Science"

);Met een CTE wordt de query:

WITH temp AS (

SELECT id

FROM students

WHERE grade = "A"

AND major = "Science"

)

SELECT *

FROM class

WHERE id IN (SELECT id FROM temp);CTE’s kun je ook voor complexere problemen gebruiken en je kunt meerdere CTE’s aaneenkoppelen.

20. Hoe rangschik je data in SQL?

Data engineers rangschikken vaak waarden op basis van parameters zoals omzet en winst. De functie RANK() wordt gebruikt om te rangschikken op een specifieke kolom:

SELECT

id,

sales,

RANK() OVER (ORDER BY sales DESC) AS rank

FROM bill;Alternatief kun je DENSE_RANK() gebruiken, dat geen rangen overslaat bij gelijke waarden.

21. Kun je een eenvoudige tijdelijke functie maken en die in een SQL-query gebruiken?

Net als in Python kun je in SQL functies maken om je queries eleganter te maken en repetitieve case-statements te vermijden. Hier is een voorbeeld van een tijdelijke functie get_gender:

CREATE TEMPORARY FUNCTION get_gender(type VARCHAR) RETURNS VARCHAR AS (

CASE

WHEN type = "M" THEN "male"

WHEN type = "F" THEN "female"

ELSE "n/a"

END

);

SELECT

name,

get_gender(type) AS gender

FROM class;Deze aanpak maakt je SQL-code overzichtelijker en beter onderhoudbaar.

22. Hoe voeg je subtotals toe in SQL?

Subtotals kun je maken met GROUP BY en ROLLUP(). Bijvoorbeeld:

SELECT

department,

product,

SUM(sales) AS total_sales

FROM sales_data

GROUP BY ROLLUP(department, product);Deze query geeft een subtotaal per afdeling en een totaaltelling aan het einde.

23. Hoe ga je om met missende data in SQL?

Het verwerken van missende data is essentieel voor dataintegriteit. Veelgebruikte methoden:

COALESCE()gebruiken: deze functie retourneert de eerste niet-null waarde in de lijst.

SELECT id, COALESCE(salary, 0) AS salary FROM employees;CASE-statements gebruiken: om missende waarden conditioneel af te handelen.

SELECT id,

CASE

WHEN salary IS NULL THEN 0

ELSE salary

END AS salary

FROM employees;24. Hoe voer je data-aggregatie uit in SQL?

Data-aggregatie omvat gebruik van aggregatiefuncties zoals SUM(), AVG(), COUNT(), MIN() en MAX(). Bijvoorbeeld:

SELECT department,

SUM(salary) AS total_salary,

AVG(salary) AS average_salary,

COUNT(*) AS employee_count

FROM employees

GROUP BY department;25. Hoe optimaliseer je SQL-queries voor betere prestaties?

Je kunt onder meer:

- Indexen gebruiken op vaak bevraagde kolommen om lookups te versnellen.

SELECT *vermijden en alleen benodigde kolommen selecteren.- Joins verstandig inzetten en onnodige joins vermijden.

- Subqueries optimaliseren en waar passend vervangen door CTE’s.

- Query execution plans analyseren om bottlenecks te vinden. Bijvoorbeeld:

EXPLAIN ANALYZE

SELECT customer_id, COUNT(order_id)

FROM orders

GROUP BY customer_id;Het oplossen van SQL-oefeningen is de beste manier om te oefenen en vergeten concepten op te frissen. Je kunt je SQL-skills toetsen met DataCamp’s Data Analysis in SQL-test (je hebt een account nodig om de toets te maken).

Projectgerelateerde interviewvragen voor data engineers

Na de algemene rondes volgt meestal een technische fase met codeeropdrachten, probleemoplossing, systeem- en databasontwerp op een whiteboard, een thuisexamen en analytische vragen.

Deze fase kan intens zijn, dus kennis van veelvoorkomende vragen en antwoorden helpt je excelleren.

26. Neem me mee door een project dat je van begin tot eind hebt gedaan.

Als je eerder aan een data-engineeringproject hebt gewerkt als student of professional, komt dit antwoord vanzelf. Toch is voorbereiding nuttig. Zo structureer je je antwoord:

- Introductie en businessprobleem:

- Leg de context van het project uit. Beschrijf het businessprobleem en de doelen.

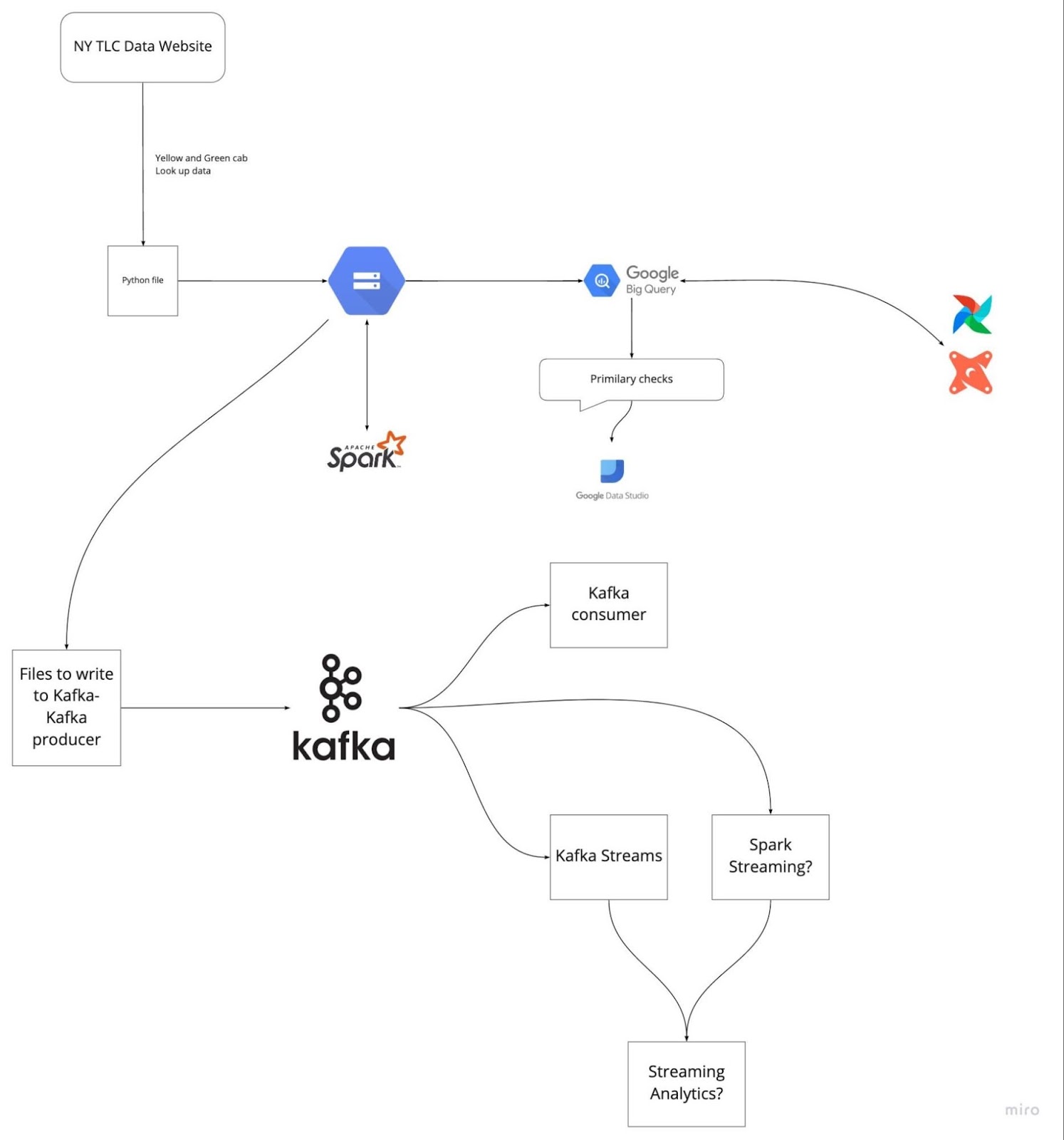

- Voorbeeld: "In dit project wilden we de datapijplijn voor het verwerken van TLC Trip Record-data optimaliseren om queryprestaties en datanauwkeurigheid voor het analyseteam te verbeteren."

- Data-ingestie:

- Beschrijf hoe je ruwe data hebt benaderd en ingeladen.

- Voorbeeld: "We hebben de ruwe TLC Trip Record-data ingeladen met GCP, Airflow en PostgreSQL om betrouwbare intake uit meerdere bronnen te waarborgen."

- Dataverwerking en transformatie:

- Leg uit welke stappen je hebt genomen om data te schonen, transformeren en structureren.

- Voorbeeld: "We gebruikten Apache Spark voor batchverwerking en Apache Kafka voor realtime streaming. De data werd opgeschoond, gevalideerd en omgezet naar een geschikt formaat voor analyse."

- Dataopslag en -warehousing:

- Bespreek de opslagoplossingen en je keuzes.

- Voorbeeld: "De verwerkte data is opgeslagen in Google BigQuery, een schaalbaar en efficiënt datawarehouse. Airflow beheerde de dataworkflows."

- Analytical engineering:

- Benadruk de tools en methoden voor analytische doeleinden.

- Voorbeeld: "We gebruikten dbt (data build tool), BigQuery, PostgreSQL, Google Data Studio en Metabase. Deze tools hielpen bij robuuste datamodellen en inzichtelijke rapporten en dashboards."

- Deployment en cloudomgeving:

- Noem de deploymentstrategieën en cloudinfrastructuur.

- Voorbeeld: "Het hele project is uitgerold met GCP, Terraform en Docker voor een schaalbare en betrouwbare cloudomgeving."

- Uitdagingen en oplossingen:

- Bespreek uitdagingen en hoe je die hebt aangepakt.

- Voorbeeld: "De hoge realtime datavolumes waren een uitdaging. We hebben Kafka-streamingjobs geoptimaliseerd en efficiënte Spark-transformaties geïmplementeerd."

- Resultaten en impact:

- Sluit af met resultaten en impact.

- Voorbeeld: "Het project verbeterde de queryprestaties en datanauwkeurigheid aanzienlijk, wat leidde tot snellere besluitvorming en betere inzichten."

Afbeelding van DataTalksClub/data-engineering-zoomcamp

Voorbereiden door je laatste vijf projecten te herzien helpt om vastlopers in het gesprek te voorkomen. Begrijp de probleemstelling en je oplossingen. Oefen om elke stap helder en beknopt uit te leggen.

Interviewvragen voor data-engineeringmanagers

Voor engineeringmanagers gaan vragen doorgaans over besluitvorming, businessinzicht, het samenstellen en onderhouden van datasets, compliance en beveiligingsbeleid.

27. Wat is het verschil tussen een datawarehouse en een operationele database?

Een datawarehouse bevat historische data voor analytische taken en besluitvorming. Het ondersteunt high-volume analytische verwerking, zoals Online Analytical Processing (OLAP). Datawarehouses zijn ontworpen voor complexe queries die veel rijen aanspreken en zijn geoptimaliseerd voor leesintensieve operaties. Ze ondersteunen relatief weinig gelijktijdige gebruikers en zijn gebouwd om grote hoeveelheden data snel op te halen.

Operationele Database Management Systemen (OLTP) beheren dynamische datasets in realtime. Ze ondersteunen transactieverwerking op grote schaal voor duizenden gelijktijdige clients en zijn geschikt voor dagelijkse operaties. De data bestaat doorgaans uit actuele informatie over transacties en operaties. OLTP-systemen zijn geoptimaliseerd voor schrijfintensieve operaties en snelle queryverwerking.

28. Waarom heeft elk bedrijf dat datasystemen gebruikt een disaster recovery-plan nodig?

Rampenbeheer is de verantwoordelijkheid van een data-engineeringmanager. Een disaster recovery-plan zorgt ervoor dat datasystemen kunnen worden hersteld en blijven draaien bij een cyberaanval, hardwarestoring, natuurramp of andere calamiteiten. Relevante aspecten zijn:

- Realtime back-up: Bestanden en databases regelmatig back-uppen naar veilige, externe locaties.

- Redundantie: Datareplicatie in verschillende regio’s om beschikbaarheid te garanderen.

- Beveiligingsprotocollen: Protocollen opstellen om inkomend en uitgaand verkeer te monitoren, te traceren en te beperken om datalekken te voorkomen.

- Herstelprocedures: Gedetailleerde procedures om data en systemen snel en efficiënt te herstellen en downtime te minimaliseren.

- Tests en oefeningen: Het plan regelmatig testen met simulaties en oefeningen om de effectiviteit te borgen en waar nodig bij te sturen.

29. Hoe pak je besluitvorming aan als leidinggevende van een data-engineeringteam?

Als manager balanceer je technische overwegingen met bedrijfsdoelen. Aanpakken zijn onder andere:

- Datagedreven beslissingen: Analytics gebruiken om besluiten te onderbouwen in plaats van intuïtie.

- Stakeholder-samenwerking: Dicht samenwerken met stakeholders om eisen te begrijpen en de inspanningen van het team te alignen met bedrijfsdoelen.

- Risico-assessment: Potentiële risico’s en impact evalueren en mitigerende strategieën ontwikkelen.

- Agile-methoden: Agile-praktijken toepassen om te kunnen inspelen op veranderende eisen en stapsgewijs waarde te leveren.

- Mentorship en ontwikkeling: Teamgroei ondersteunen met begeleiding en training en een collaboratieve cultuur bevorderen.

30. Hoe zorg je voor compliance met privacywetgeving in je data-engineeringprojecten?

Compliance met privacywetgeving omvat onder meer:

- Regelgeving begrijpen: Op de hoogte blijven van wetgeving zoals GDPR, CCPA en HIPAA.

- Datagovernanceframework: Een robuust framework implementeren met beleid voor privacy, security en toegangsbeheer.

- Data-encryptie: Gevoelige data versleutelen in rust en tijdens transport om ongeautoriseerde toegang te voorkomen.

- Toegangscontrole: Strenge toegangsrechten invoeren zodat alleen geautoriseerd personeel bij gevoelige data kan.

- Audits en monitoring: Regelmatig audits uitvoeren en toegang en gebruik monitoren om issues tijdig te detecteren en op te lossen.

31. Kun je een uitdagend data-engineeringproject beschrijven dat je hebt geleid?

Focus bij een uitdagend project op:

- Scope en doelen: Omschrijf de doelen en het businessprobleem.

- Uitdagingen: Noem specifieke issues zoals technische beperkingen, resources of alignment met stakeholders.

- Strategieën en oplossingen: Licht je aanpak toe, inclusief technische oplossingen, teammanagement en stakeholdermanagement.

- Resultaten en impact: Benadruk de uitkomsten, zoals betere datakwaliteit, hogere systeemprestaties of efficiëntere operaties.

32. Hoe evalueer en implementeer je nieuwe datatechnologieën?

Dit omvat:

- Marktonderzoek: Bijblijven met de nieuwste ontwikkelingen en trends.

- Proof of concept (PoC): PoC’s uitvoeren om haalbaarheid en baten in jouw context te testen.

- Kosten-batenanalyse: Kosten, baten en potentiële ROI beoordelen.

- Stakeholder buy-in: Bevindingen en aanbevelingen presenteren om steun te krijgen.

- Implementatieplan: Een gedetailleerd plan maken met tijdlijnen, resources en risicobeheer.

- Training en support: Training en ondersteuning bieden voor een soepele transitie.

33. Hoe prioriteer je taken en projecten in een dynamische omgeving?

Een effectieve manier is prioriteren op basis van impact op bedrijfsdoelen en urgentie. Je kunt frameworks als de Eisenhower-matrix gebruiken om taken in vier kwadranten te plaatsen: urgent en belangrijk, belangrijk maar niet urgent, urgent maar niet belangrijk, en geen van beide. Communiceer daarnaast met stakeholders om prioriteiten te alignen en focus te houden op activiteiten met hoge waarde.

FAANG-interviewvragen voor data engineers

In deze sectie bekijken we de meest gestelde data-engineeringvragen door managers van Facebook, Amazon en Google voor data-engineeringsfuncties.

Facebook-interviewvragen voor data engineers

34. Waarom gebruiken we clusters in Kafka en wat zijn de voordelen?

Een Kafka-cluster bestaat uit meerdere brokers die data over meerdere instanties verdelen. Deze architectuur biedt schaalbaarheid en fouttolerantie zonder downtime. Als het primaire cluster uitvalt, kunnen andere Kafka-clusters dezelfde services leveren, waardoor hoge beschikbaarheid is gegarandeerd.

De Kafka-clusterarchitectuur bestaat uit Topics, Brokers, ZooKeeper, Producers en Consumers. Het verwerkt datastromen voor bigdata-toepassingen efficiënt en maakt robuuste datagedreven applicaties mogelijk.

35. Welke problemen lost Apache Airflow op?

Apache Airflow laat je pijplijnen beheren en plannen voor analytische workflows, datawarehousebeheer en datatransformatie en -modellering. Het biedt:

- Pijplijnbeheer: Een platform om workflows te definiëren, plannen en monitoren.

- Gecentraliseerde logging: Uitvoeringslogs op één plek monitoren.

- Foutafhandeling: Callbacks om faalmeldingen naar Slack, Discord e.d. te sturen.

- Gebruikersinterface: Een gebruiksvriendelijke UI voor beheer en visualisatie van workflows.

- Integratie: Sterke integraties met diverse tools en systemen.

- Open source: Gratis te gebruiken en breed ondersteund door de community.

Amazon-interviewvragen voor data engineers

36. Je krijgt een IP-adres als string. Hoe bepaal je of het geldig is of niet?

Split de string op "." en voer meerdere checks uit om elk segment te valideren. Hier is een Python-functie:

def is_valid(ip):

ip = ip.split(".")

for i in ip:

if len(i) > 3 or int(i) < 0 or int(i) > 255:

return False

if len(i) > 1 and int(i) == 0:

return False

if len(i) > 1 and int(i) != 0 and i[0] == '0':

return False

return True

A = "255.255.11.135"

B = "255.050.11.5345"

print(is_valid(A)) # True

print(is_valid(B)) # False37. In welke modi werkt Hadoop?

Hadoop werkt hoofdzakelijk in drie modi:

- Standalone-modus: Gebruikt voor debuggen. Maakt geen gebruik van HDFS en gebruikt het lokale bestandssysteem voor input en output.

- Pseudo-distributed modus: Een single-node cluster waarbij de NameNode en DataNode op dezelfde machine draaien. Vooral voor testen en ontwikkeling.

- Volledig gedistribueerde modus: Productiemodus waarbij data over meerdere nodes is verdeeld, met aparte nodes voor de master- (NameNode) en slave-daemons (DataNode).

Google-interviewvragen voor data engineers

38. Hoe zou je dubbele datapunten in een SQL-query afhandelen?

Je kunt het sleutelwoord DISTINCT gebruiken of dubbele rijen verwijderen met ROWID in combinatie met MAX of MIN. Bijvoorbeeld:

Met DISTINCT:

SELECT DISTINCT Name, ADDRESS

FROM CUSTOMERS

ORDER BY Name;Duplicaten verwijderen met ROWID:

DELETE FROM Employee

WHERE ROWID NOT IN (

SELECT MAX(ROWID)

FROM Employee

GROUP BY Name, ADDRESS

);39. Gegeven een lijst van n-1 gehele getallen in het bereik 1 tot n, zonder duplicaten. Één getal ontbreekt. Kun je efficiënte code schrijven om het ontbrekende getal te vinden?

Deze veelvoorkomende codeeropgave kun je wiskundig oplossen:

def search_missing_number(list_num):

n = len(list_num)

# Check if the first or last number is missing

if list_num[0] != 1:

return 1

if list_num[-1] != n + 1:

return n + 1

# Calculate the sum of the first n+1 natural numbers

total = (n + 1) * (n + 2) // 2

# Calculate the sum of all elements in the list

sum_of_L = sum(list_num)

# Return the difference, which is the missing number

return total - sum_of_L

# Validation

num_list = [1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 13]

print("The missing number is", search_missing_number(num_list)) # The missing number is 12Hoe je je voorbereidt op het data-engineeringsgesprek

Voordat je op gesprek gaat, moet je de concepten en standaardtermen in data engineering herhalen. Focus op de volgende gebieden:

- Beheers SQL: Oefen met het maken, wijzigen en beheren van databases. Beheers bovendien data-analyse, modellering en transformatie.

- Los codeeropgaven op: Oefen met Python-, Scala- of C++-opgaven. Veel bedrijven toetsen programmeervaardigheden met thuisopgaven en live coding.

- Ontwerp een ETL-pijplijn: oefen met het maken van data-, ETL- of deliverypijplijnen. Je moet weten hoe je pijplijnen test, valideert, schaalt en onderhoudt.

- Analytics engineering: oefen met laden, transformeren en data-analyse. Leer een dashboard te maken voor datakwaliteit en systeemprestaties.

- Bekijk potentiële vragen: Bereid je voor met voorbeeldvragen. Een simpele Google-zoekopdracht levert honderden vragen op.

- Leer moderne tools kennen: ook als je er nog niet mee hebt gewerkt, moet je weten hoe ze werken en integreren met andere tools. Bedrijven zoeken steeds naar betere tools voor hogere performance tegen lagere kosten.

- Leer batchverwerking en streaming: Apache Spark wordt gebruikt voor batchverwerking en Apache Kafka voor datastreaming. Deze tools zijn zeer gewild en helpen je bij topbedrijven binnen te komen.

- Omgeving: Soms wordt gevraagd naar cloud (GCP, AWS, Azure), Docker, scripting, Terraform en Kubernetes. Met deze tools zet je cloud- of on-premises compute- en opslagresources op. Deze technologieën begrijpen en opnemen in je portfolio is een goed idee.

Voorbereiden op een data-engineeringsgesprek kan uitdagend zijn, maar met de juiste resources en oefening kun je uitblinken en je droombaan bemachtigen. Vergroot je skills en kennis met deze waardevolle bronnen:

- Understanding Data Engineering: Krijg een volledig beeld van data-engineeringconcepten en -principes.

- Data Engineer in Python: Beheers data engineering met Python in deze carrièretrack met essentiële tools en frameworks.

- Database Design: Leer de basis van databaseontwerp om efficiënte en schaalbare databases te maken.

Maak gebruik van deze cursussen om je basis te versterken en voorop te blijven in je data-engineeringscarrière. Succes met je sollicitaties!

FAQs

Wat kan ik verwachten van een sollicitatiegesprek voor data engineer?

Je kunt een HR-telefoonscreening verwachten, een technische telefoonscreening, een thuisopdracht, een codeeruitdaging, een on-site interview, whiteboardontwerpen voor databases en systemen, een SQL-interview en tot slot het “executive” interview om culturele fit te toetsen.

Sommige bedrijven hebben drie gespreksrondes, andere wel negen. Organisaties hanteren vaak een hoge drempel om kandidaten op elk niveau te testen.

Zijn data engineers in trek?

Ja, elk bedrijf dat data genereert, heeft data engineers nodig om pijplijnen te bouwen, data te beheren en te leveren aan verschillende afdelingen. Tegen 2025 produceren we 463 exabytes aan data per dag, en we hebben steeds meer engineers nodig om de datapijplijnen en systemen te extraheren, transformeren en te beheren - weforum.org.

Schrijven data engineers code?

Ja, iedereen in IT moet kunnen coderen, zelfs op managementniveau. Voor data engineers zijn Python, SQL, Docker, Yaml en Bash noodzakelijke talen. Ze worden gebruikt voor infrastructure as code, pijplijnen, databasemanagement, streaming, webscraping, dataverwerking, modellering en analytics.

Wat is het verschil tussen een data-analist en een data engineer?

Een data engineer verzamelt, transformeert en bereidt data voor zodat data-analisten waardevolle zakelijke inzichten kunnen halen. Data engineers beheren complete databasesystemen en zorgen voor hoogwaardige data voor analysetaken zoals rapporten, dashboards, klantonderzoek en forecasting.

Wat doet een data engineer eigenlijk?

Data verzamelen uit meerdere bronnen, datapijplijnen maken, valideren en onderhouden, data transformeren met algoritmen, analytical engineering uitvoeren, zorgen voor naleving van datagovernance en security, en complete databasesystemen onderhouden. Ze leveren hoogwaardige datastromen aan verschillende afdelingen. Je leest meer in de blog What is Data Engineering?.

Welke vaardigheden heb je nodig om data engineer te worden?

Je moet kunnen coderen, datawarehousing kennen, ETL (Extract Transform Load), SQL-queries, data-analyse en -modellering, kritisch denken en communicatieve vaardigheden. Data engineering leer je door ervaring en het overwinnen van complexe uitdagingen in het veld. Onze Data Engineering Certification is de perfecte stap om je skills uit te bouwen en een rol als data engineer te bemachtigen.

Als gecertificeerd data scientist haal ik met passie het maximale uit de nieuwste technologie om innovatieve machinelearning-toepassingen te bouwen. Met een sterke achtergrond in spraakherkenning, data-analyse en -rapportage, MLOps, conversationele AI en NLP heb ik mijn vaardigheden aangescherpt in het ontwikkelen van intelligente systemen die echt impact maken. Naast mijn technische expertise ben ik ook een sterke communicator met een talent om complexe concepten terug te brengen tot heldere, beknopte taal. Daardoor ben ik uitgegroeid tot een veelgelezen blogger over data science, waar ik mijn inzichten en ervaringen deel met een groeiende community van data-professionals. Op dit moment richt ik me op contentcreatie en redactie, waarbij ik met large language models werk aan krachtige en aansprekende content die zowel bedrijven als individuen helpt het beste uit hun data te halen.