Kurs

2019’da kurulan bir girişim olan Stability AI, çeşitli akademik araştırmacılar ve kâr amacı gütmeyen kuruluşlarla iş birliği içinde, ilk kez 2022’de yayımlanan Stable Diffusion modelini geliştirdi.

Stable Diffusion, metin açıklamalarından yüksek kaliteli, ayrıntılı görseller üretmek üzere tasarlanmış, açık kaynaklı bir derin öğrenme modelidir. Ayrıca mevcut görselleri değiştirebilir veya metin girdileri kullanarak düşük çözünürlüklü görselleri iyileştirebilir. Model gelişmeye devam etmekte ve en son yenilikler performansını ve yeteneklerini artırmaktadır.

Bu yazıda, Stable Diffusion’ın nasıl çalıştığını inceleyecek ve onu çalıştırmanın farklı yöntemlerini ele alacağız.

Stable Diffusion nedir?

Stable Diffusion, Stability AI tarafından geliştirilen gelişmiş, açık kaynaklı bir derin öğrenme modelidir. 2022’de piyasaya sürülen model, metinsel açıklamalardan yüksek kaliteli, ayrıntılı görseller üretme konusunda üstündür. Bu çok yönlü model, mevcut görselleri değiştirebilir veya metin girdileriyle düşük çözünürlüklü görselleri iyileştirebilir.

Başlangıçta 2,3 milyar görselden oluşan geniş bir veri kümesi üzerinde eğitilen Stable Diffusion, üretici modelleme ve difüzyon süreçlerinin ilkelerinden yararlanır. Bu sayede, eğitim verilerindeki örüntü ve yapıları öğrenerek yeni ve gerçekçi görseller oluşturabilir. Yetenekleri, diğer son teknoloji modellerle karşılaştırılabilir düzeydedir ve görsel üretimi ile düzenlemesinde geniş bir uygulama yelpazesi için güçlü bir araç haline gelir.

Şubat 2024’te Stability AI, Stable Diffusion 3’ü erken ön izlemede duyurdu ve özellikle çoklu konu içeren istemler, görsel kalitesi ve yazım konularında büyük ölçüde geliştirilmiş performans sergiledi. Stable Diffusion 3 ailesi, 800 milyon ile 8 milyar arasında parametreye sahip modellerden oluşur ve çeşitli yaratıcı ihtiyaçları karşılamak için ölçeklenebilirlik ve kaliteye odaklanır. Haziran 2024’e gelindiğinde, 2 milyar parametreli Stable Diffusion 3 Medium’un yayımlanması önemli bir ilerleme kaydetti; standart tüketici GPU’larında verimli şekilde çalışırken olağanüstü ayrıntı, renk ve fotogerçekçilik sundu.

Stable Diffusion 3, görüntü ve dil temsilleri için ayrı ağırlık kümeleri kullanan yeni bir Multimodal Diffusion Transformer (MMDiT) mimarisini içerir. Bu yenilik, modelin önceki sürümlere kıyasla metin anlama ve yazım becerilerini geliştirir. İnsan tercih değerlendirmelerine göre, Stable Diffusion 3 tipografi ve isteme uyum konularında DALL·E 3, Midjourney v6 ve Ideogram v1 gibi diğer önde gelen metinden-görüntü üretim sistemlerini geride bırakır.

Stability AI, Stable Diffusion 3’ün temel teknolojisini ayrıntılı biçimde ele alan kapsamlı bir araştırma makalesi yayımladı ve ilerlemelerini ile üstün performansını vurguladı. Bu iyileştirmeler, Stable Diffusion 3’ü metinsel açıklamalardan yüksek kaliteli görseller üretmek için güçlü bir araç haline getirir; özellikle karmaşık istemlerin ele alınması ve gerçekçi çıktılar üretiminde belirgin gelişmeler sunar.

Stable Diffusion Nasıl Çalışır?

Stable Diffusion, difüzyon modelleri olarak bilinen bir derin öğrenme modeli sınıfının sofistike bir örneğidir. Daha spesifik olarak, üretici (generative) modeller kategorisine girer. Bu modeller, eğitildikleri verilere benzer yeni veriler üretmek üzere tasarlanmıştır; böylece öğrenilen örüntü ve yapılara dayanarak yeni ve gerçekçi çıktılar oluşturabilirler.

Difüzyon modelleri, fizikte parçacıkların zamanla yüksek yoğunluklu bölgelerden düşük yoğunluklu bölgelere yayılmasını ifade eden difüzyon kavramından ilham alır. Derin öğrenme bağlamında difüzyon modelleri, bu süreci yüksek boyutlu bir veri uzayında simüle eder. Model, rastgele gürültüyle başlar ve bir dizi adımda bu gürültüyü yinelemeli olarak rafine ederek tutarlı ve yüksek kaliteli görseller üretir.

Bir tür gözetimsiz öğrenme olan üretici modelleme, modellerin girdi verilerindeki örüntüleri otomatik olarak keşfedip öğrenmesi için eğitilmesini içerir. Eğitildikten sonra bu modeller, orijinal veriye benzeyen yeni örnekler üretebilir. Bu yetenek, görsel sentezi, veri çoğaltma ve daha fazlası gibi görevler için üretici modelleri özellikle kullanışlı kılar.

Bu modeller hakkında daha fazla bilgi edinmek isterseniz, Python ile Derin Öğrenme eğitim yolumuzu inceleyin.

Difüzyon Süreci

Stable Diffusion’daki difüzyon süreci iki ana aşamadan oluşur: ileri difüzyon süreci ve ters gürültü giderme süreci.

1. İleri difüzyon süreci:

Bu aşamada, eğitim verilerine (görsellere) birkaç adım boyunca kademeli olarak gürültü eklenir ve görseller tamamen gürültüye dönüşene kadar devam eder. Bu süreç, matematiksel olarak tersine çevrilebilir olacak şekilde tasarlanmıştır.

2. Ters gürültü giderme süreci:

Bu aşamada model, gürültü ekleme sürecini tersine çevirmeyi öğrenir. Rastgele gürültüyle başlayarak, model çoklu adımlarda görselin gürültüsünü giderir ve kademeli olarak tutarlı ve yüksek kaliteli bir görseli yeniden oluşturur. Bu ters süreç, eğitim verilerinden öğrenilen örüntü ve yapılar tarafından yönlendirilir.

Multimodal Diffusion Transformer (MMDiT) Mimarisi

Stable Diffusion 3, Multimodal Diffusion Transformer (MMDiT) olarak bilinen yeni bir mimari sunar. Bu mimari, görsel ve dil temsilleri için ayrı ağırlık kümeleri kullanarak modelin metin tabanlı istemleri anlama ve üretme becerisini güçlendirir. Görselleri ve metinsel bilgileri işlemek için ayrı yollar kullanarak, MMDiT özellikle karmaşık istemler ve tipografi söz konusu olduğunda üretilen görsellerin tutarlılığını ve doğruluğunu artırır.

Stable Diffusion’ın Pratik Kullanımları

Stable Diffusion çeşitli pratik uygulamalarda kullanılabilir, örneğin:

- Görsel üretimi: Metinsel açıklamalardan yeni görseller oluşturma.

- Görsel düzenleme: Metin istemlerine göre mevcut görselleri değiştirme.

- Görsel iyileştirme: Düşük çözünürlüklü görsellerin kalitesini artırma.

Bu yetenekler, Stable Diffusion’ı sanatçılar, tasarımcılar, araştırmacılar ve üretici yapay zekânın potansiyelini keşfetmek isteyen herkes için güçlü bir araç haline getirir.

Stable Diffusion’ı Çevrimiçi Nasıl Çalıştırılır

Stable Diffusion modelini hemen kullanmaya başlamak isterseniz, aşağıdaki araçlarla çevrimiçi olarak çalıştırabilirsiniz.

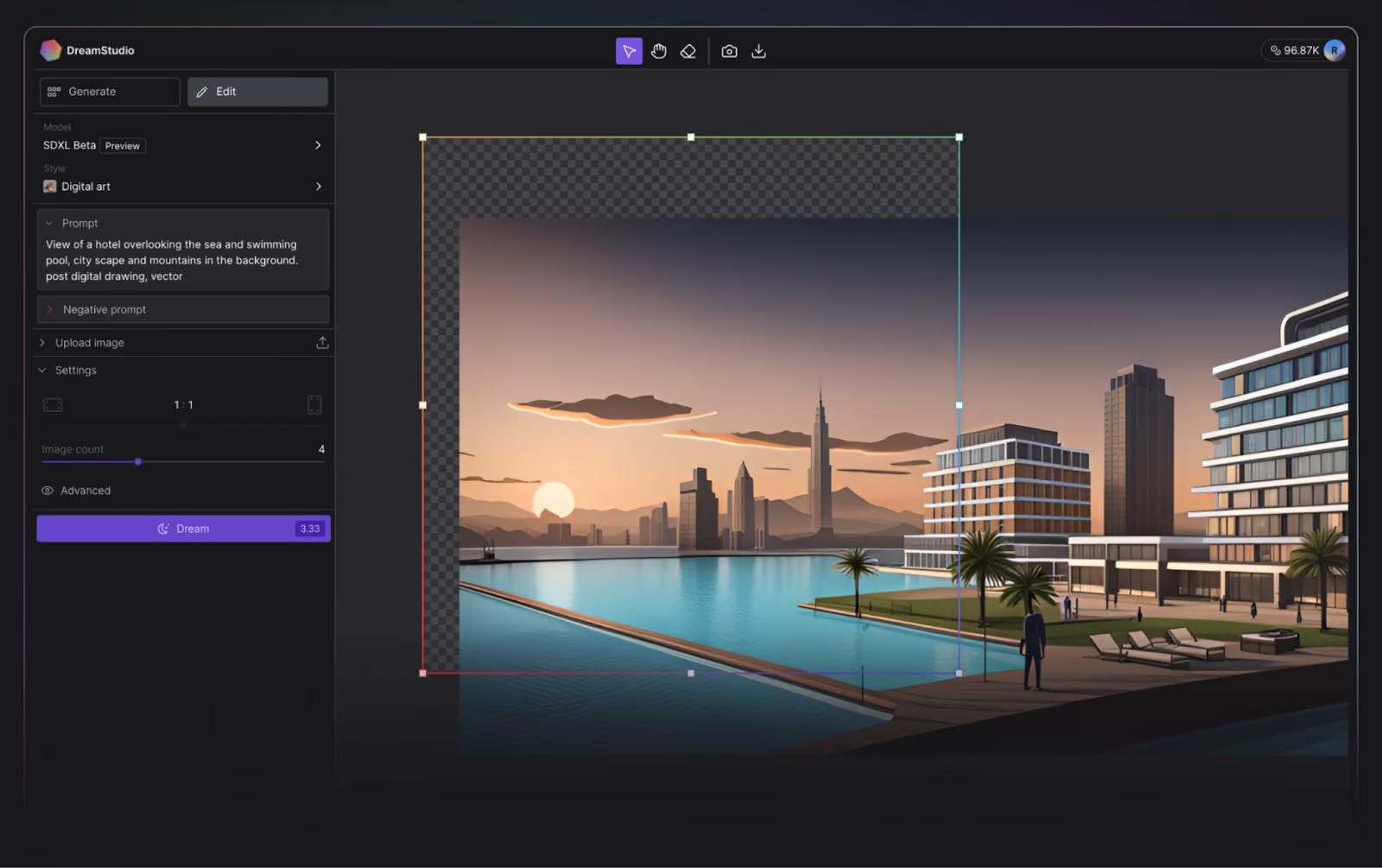

1. DreamStudio

Stable Diffusion’ın geliştiricisi Stability AI, meraklıların metinden-görüntü modelini çevrimiçi araçları DreamStudio ile test etmelerini son derece kolaylaştırdı.

DreamStudio, kullanıcılara Stable Diffusion modellerinin en son sürümüne erişim sağlar ve 15 saniyeye kadar kısa sürede görsel üretmelerine olanak tanır.

DreamStudio kullanıcı arayüzü. Görsel kaynağı: DreamStudio.

Bu eğitim hazırlanırken, yeni kullanıcılar DreamStudio’yu denemek için 100 ücretsiz kredi alıyor; varsayılan ayarlarla bu, 500 görsel için yeterli! Ek kredileri uygulama içinden uygun olduğunuzda satın alabilirsiniz; 1000 kredi yalnızca 10,00 $’dır.

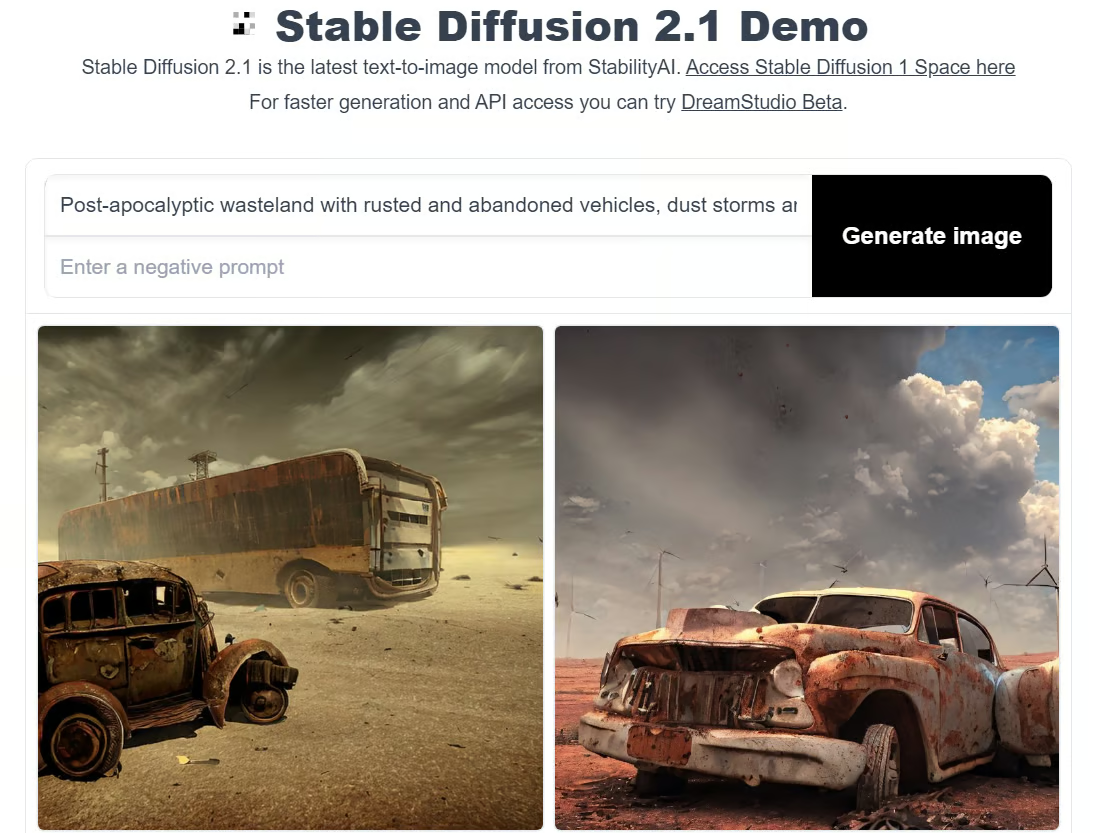

2. Hugging Face

Hugging Face, açık kaynak katkılarını teşvik eden bir yapay zekâ topluluğu ve platformudur. Transformer modelleri ile tanınsa da Hugging Face, en son Stable Diffusion modeline de erişim sağlar ve gerçek bir açık kaynak tutkununa yakışır şekilde ücretsizdir.

Hugging Face’te Stable Diffusion’ı çalıştırmak için demolardan birini deneyebilir, örneğin Stable Diffusion 2.1 demosunu kullanabilirsiniz.

Hugging Face’in dezavantajı, DreamStudio’da olduğu gibi özellikleri özelleştirememek ve bir görsel üretmenin belirgin şekilde daha uzun sürmesidir.

Hugging Face’te Stable Diffusion demosu. Görsel: yazar.

Stable Diffusion’ı Yerelde Nasıl Çalıştırılır

Peki Stable Diffusion’ı kendi bilgisayarınızda denemek isterseniz? Size yardımcı olacağız.

Stable Diffusion’ı yerelde çalıştırmak, çeşitli metin girdileriyle deney yaparak gereksinimlerinize daha uygun görseller üretmenizi sağlar. Ayrıca sağladığınız girdiler doğrultusunda sonuçları iyileştirmek için modeli kendi verileriniz üzerinde ince ayar yapabilirsiniz.

Feragat: Stable Diffusion’ı yerelde çalıştırmak için bir GPU’ya sahip olmanız gerekir.

Adım 1: Python ve Git’i kurun

Stable Diffusion’ı yerel bilgisayarınızdan çalıştırmak için Python 3.10.6 gerekir. Bunu resmi Python web sitesinden kurabilirsiniz. Takılırsanız Python Nasıl Kurulur eğitimimize göz atın.

Kurulumun doğru çalıştığını, komut istemini açıp python yazıp komutu çalıştırarak kontrol edin. Bu, kullandığınız Python sürümünü yazdırmalıdır.

Feragat: Stable Diffusion’ı çalıştırmak için önerilen sürüm Python 3.10.6’dır. Sorun yaşamamak için bu sürüm olmadan devam etmemenizi öneririz.

Sonraki adımda kod deposu yönetim sistemi olan Git’i kurmanız gerekir. Git Kurulum Eğitimi yardımcı olabilir; ayrıca Git’e Giriş kursumuz Git bilginizi derinleştirebilir.

Adım 2: GitHub ve Hugging Face hesabı oluşturun

GitHub, geliştiricilerin kodlarını barındırdığı, projelerde diğer geliştiricilerle takip ve iş birliği yapabildiği bir yazılım geliştirme barındırma servisidir. Henüz bir Github hesabınız yoksa, şimdi oluşturmak için iyi bir zaman—yardım için Yeni Başlayanlar için Github ve Git Eğitimine bakın.

Hugging Face ise açık kaynak katkılarını savunan bir yapay zekâ topluluğudur. Doğal dil işleme, bilgisayarla görme ve daha pek çok alandan birçok yapay zekâ modelinin merkezidir. Stable Diffusion’ın en son sürümünü indirmek için bir hesaba ihtiyacınız olacak. Bu adıma birazdan geleceğiz.

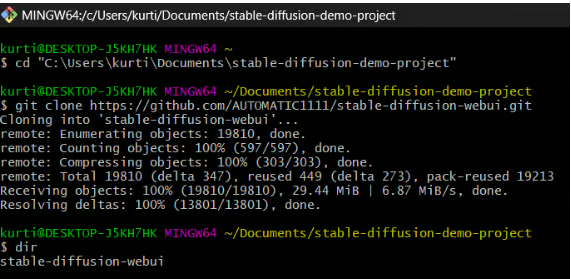

Adım 3: Stable Diffusion Web-UI’ı klonlayın

Bu adımda Stable Diffusion Web-UI’ı yerel bilgisayarınıza indireceksiniz. Bu amaçla (ör. stable-diffusion-demo-project) adanmış bir klasör oluşturmanız faydalı olsa da zorunlu değildir.

1. Git Bash’i açın:

- Bilgisayarınızda Git Bash’in kurulu olduğundan emin olun.

2. İstediğiniz klasöre gidin:

- Git Bash’i açın ve Stable Diffusion Web-UI’ı klonlamak istediğiniz klasöre gitmek için

cdkomutunu kullanın. Örneğin:

cd path/to/your/folder3. Depoyu klonlayın:

- Stable Diffusion Web-UI deposunu klonlamak için aşağıdaki komutu çalıştırın:

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git

4. Klonlamayı doğrulayın:

- Komut başarıyla çalışırsa, seçtiğiniz dizinde

stable-diffusion-webuiadlı yeni bir klasör görmelisiniz.

Not: Donanımınız ve işletim sisteminiz için daha spesifik talimatları Stable Diffusion web UI Github deposunda bulabilirsiniz.

Adım 4: En son Stable Diffusion modelini indirin

1. Hugging Face’e giriş yapın:

- Hugging Face hesabınıza erişin.

2. Stable Diffusion modelini indirin:

- Hugging Face’ten çalıştırmak istediğiniz Stable Diffusion modelini bulun ve indirin. Bu dosyalar büyüktür, bu nedenle indirme birkaç dakika sürebilir.

3. Model klasörünü bulun:

- Bilgisayarınızda şu klasöre gidin:

stable-diffusion-webui\models\Stable-diffusion

4. İndirilen modeli taşıyın:

Stable-diffusionklasöründePut Stable Diffusion Checkpoints hereadlı bir metin dosyası göreceksiniz.- İndirdiğiniz Stable Diffusion model dosyasını bu klasöre taşıyın.

Adım 5: Stable Diffusion web UI’ı kurun

Bu adımda Stable Diffusion’ı çalıştırmak için gerekli araçları kuracaksınız.

1. Komut İstemi veya Terminal’i açın.

2. Stable Diffusion web UI klasörüne gidin:

- Daha önce klonladığınız

stable-diffusion-webuiklasörüne gitmek içincdkomutunu kullanın. Örneğin:

cd path/to/stable-diffusion-webui3. Kurulum betiğini çalıştırın:

stable-diffusion-webuiklasöründeyken aşağıdaki komutu çalıştırın:

webui-user.batBu betik, bir sanal ortam oluşturacak ve Stable Diffusion’ı çalıştırmak için gerekli tüm bağımlılıkları kuracaktır. İşlem yaklaşık 10 dakika sürebilir; lütfen sabırlı olun.

Not: Donanımınız ve işletim sisteminiz için daha spesifik talimatları Stable Diffusion web UI Github deposunda bulabilirsiniz.

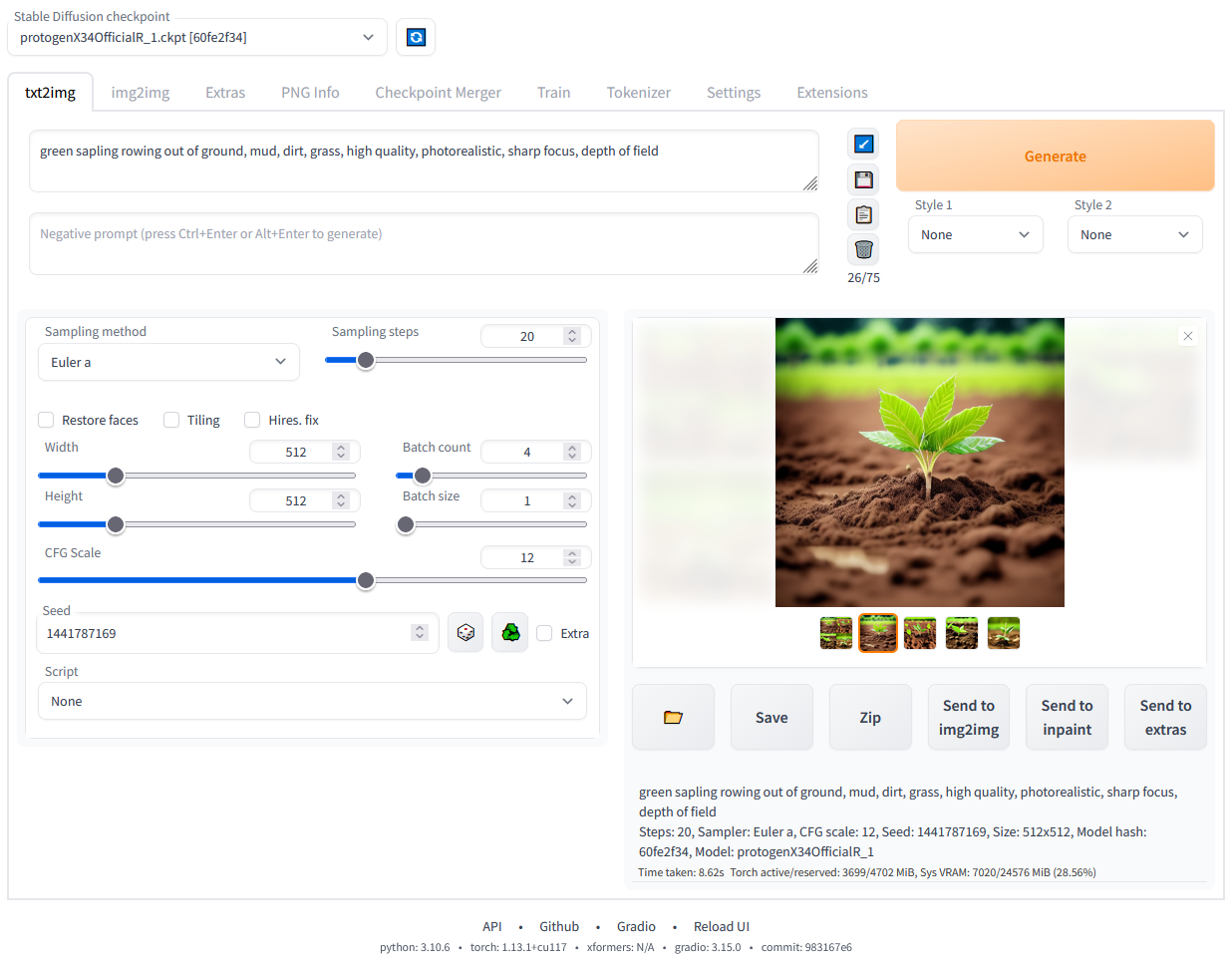

Adım 6: Stable Diffusion’ı yerelde çalıştırın

Bağımlılıklar kurulduktan sonra komut isteminizde şu URL görünecektir: http://127.0.0.1:7860.

- Stable Diffusion web UI’ı çalıştırmak için bunu kopyalayıp web tarayıcınıza yapıştırın.

- Artık istemler vermeye ve görseller üretmeye başlayabilirsiniz!

Stable Diffusion web UI yerelde çalışıyor. Görsel: yazar.

Sonuç

Stable Diffusion, üretici yapay zekâ alanında önemli bir ilerlemeyi temsil eder. Metinsel açıklamalardan yüksek kaliteli, ayrıntılı görseller üretme olanağı sunar. Mevcut görselleri değiştirmek, düşük çözünürlüklü görselleri iyileştirmek veya tamamen yeni görseller oluşturmak istiyorsanız, Stable Diffusion güçlü ve çok yönlü bir araç seti sağlar.

Stable Diffusion 3 ve Medium’daki son güncellemeler ve iyileştirmelerle modelin yetenekleri daha da artırılmış ve onu üretici yapay zekâ alanında liderlerden biri hâline getirmiştir.

Stable Diffusion’ı yerelde veya DreamStudio ve Hugging Face gibi çeşitli çevrimiçi platformlar üzerinden çalıştırmak, onun tüm potansiyelini keşfetmenize ve kullanmanıza olanak tanır. Bu rehberdeki adımları izleyerek, Stable Diffusion’ı kurabilir ve yaratıcı ile pratik ihtiyaçlarınızı karşılamak için kullanmaya başlayabilirsiniz!

Üretici Yapay Zekâ Hakkında Daha Fazla Öğrenin

Üretici yapay zekâ, eğitildiği verilere dayanarak yüksek kaliteli metinler, görseller ve diğer içerikleri üreten çığır açan bir derin öğrenme yaklaşımıdır. Stable Diffusion, ChatGPT ve DALL-E gibi araçlar, üretici yapay zekânın yeni yaratıcılık ve inovasyon biçimlerini mümkün kılarak çeşitli sektörleri nasıl dönüştürdüğüne dair mükemmel örneklerdir. Bu teknolojiler gelişmeye devam ettikçe, sanatçılar, geliştiriciler ve araştırmacılar için mümkün olanın sınırlarını zorlamak adına yeni fırsatlar sunarlar.

Üretici yapay zekâ dünyasına daha derinlemesine dalmak isteyenler için keşfedilecek bazı kaynaklar:

SSS

Özel bir GPU olmayan bir bilgisayarda Stable Diffusion’ı çalıştırabilir miyim?

Stable Diffusion’ı çalıştırmak genellikle özel bir GPU tarafından sağlanan önemli hesaplama gücü gerektirir. Teorik olarak CPU üzerinde çalıştırmak mümkün olsa da süreç son derece yavaş ve verimsiz olur. En iyi deneyim için en az 6 GB VRAM’e sahip güçlü bir GPU barındıran bir makine kullanmanız önerilir.

Kendi veri kümemle Stable Diffusion’a nasıl ince ayar yapabilirim?

Stable Diffusion’ın ince ayarı, modelin performansını kullanım senaryonuza göre iyileştirmek amacıyla onu kendi veri kümeniz üzerinde yeniden eğitmeyi içerir. Bu süreç, makine öğrenmesi konusunda iyi bir anlayış ve uygun bir hesaplama ortamına erişim gerektirir. Genellikle veri kümenizi hazırlamanız, eğitim betiklerini verinizi içerecek şekilde değiştirmeniz ve ardından güçlü bir GPU kullanarak eğitim sürecini çalıştırmanız gerekir. Modellerin ince ayarına ilişkin ayrıntılı yönergeler, sıklıkla PyTorch gibi makine öğrenmesi çerçevelerinin dokümantasyonunda bulunabilir.

Eğitimimize göz atın: DreamBooth ve LoRA ile Stable Diffusion XL’ın İnce Ayarı.

Stable Diffusion’ı yerelde çalıştırırken karşılaşabileceğim yaygın sorunlar nelerdir ve bunları nasıl çözerim?

Yaygın sorunlar şunlardır:

- Kurulum hataları: Tüm bağımlılıkların düzgün kurulduğundan ve sisteminizle uyumlu olduğundan emin olun.

- Yetersiz bellek hataları: GPU’nuzda yeterli VRAM yoksa görsel boyutunu veya yığın boyutunu (batch size) küçültün.

- Yavaş performans: GPU sürücülerinizin güncel olduğundan ve sisteminizde başka yoğun işlemler çalışmadığından emin olun.

Özel sorun giderme ipuçları ve çözümler için GitHub deposunun sorunlar (issues) sayfasına ve topluluk forumlarına başvurun.

Stable Diffusion’ın GPU’mdaki performansını nasıl optimize edebilirim?

Stable Diffusion’ın GPU’nuzdaki performansını optimize etmek için:

- Sürücüleri güncelleyin: GPU sürücülerinizin güncel olduğundan emin olun.

- Ayarları düzenleyin: GPU’nuzun VRAM sınırlarına sığması için görsel çözünürlüğünü veya yığın boyutunu küçültün.

- Optimize edilmiş kütüphaneler kullanın: NVIDIA GPU’lar için CUDA ve cuDNN gibi optimize edilmiş kütüphane ve çerçevelerden yararlanın.

- Arka plan süreçlerini kapatın: Gereksiz arka plan süreçlerini kapatarak sistem kaynaklarını boşaltın.

- Performansı izleyin: GPU kullanımını takip etmek için izleme araçları kullanın ve en iyi performans için ayarları buna göre uyarlayın.

Stable Diffusion’ı kullanarak animasyon veya video üretebilir miyim?

Stable Diffusion esas olarak durağan görseller üretmek için tasarlanmış olsa da, bir dizi görsel üreterek bunları birleştirmek suretiyle animasyonlar veya videolar oluşturmak mümkündür. Bu şu yollarla yapılabilir:

- Kare kare üretim: Her kare için girdi istemini veya tohumu (seed) biraz değiştirerek bireysel kareler oluşturun.

- Enterpolasyon: Stable Diffusion ile üretilen ana kareler arasında enterpolasyon teknikleri kullanın.

- Video düzenleme yazılımı: Kareleri video düzenleme yazılımıyla birleştirerek akıcı animasyonlar veya videolar üretin. Yüksek kaliteli animasyonlar oluşturmanın önemli ölçüde son işlem ve video düzenleme uzmanlığı gerektirebileceğini unutmayın.