Program

Büyük dil modellerini (LLM) yerel olarak çalıştırmak, özellikle özel verileri harici sunuculara göndermek istemediğinizde, giderek daha popüler hale geldi. Her şey makinenizde çalıştığında, istemleriniz ve verileriniz kendi ortamınızda kalır; bu da size daha fazla kontrol ve daha iyi gizlilik sağlar.

Aynı gücü siz de kullanmak istiyorsanız, LM Studio ile LLM’leri yerelde nasıl çalıştırıp onlarla nasıl sohbet edeceğinizi adım adım göstereceğim. Bu, önceliği GUI olan bir araçtır; bu nedenle terminal deneyimi veya derin teknik bilgi gerekmez. Kurulum basittir ve hızlıca başlayabilirsiniz. Hadi başlayalım!

Aracı araçları (agentic tools) yerelde çalıştırmakla ilgileniyorsanız, sırasıyla Ollama ile OpenClaw ve Claude Code kurulumuna ilişkin eğitimlerimize göz atmanızı öneririm.

LM Studio nedir?

LM Studio, verilerinizin harici sunuculara sızmamasını sağlamak için modelleri indirmenize ve makinenizde büyük dil modellerini yerel olarak çalıştırmanıza olanak tanıyan, çapraz platform bir uygulamadır.

Hugging Face’ten doğrudan arama yapabileceğiniz, göz atabileceğiniz ve model indirebileceğiniz yerleşik bir model tarayıcısıyla gelir. DeepSeek, Llama, Gemma, Phi veya Mistral gibi farklı sürümler dahil olmak üzere dilediğiniz hemen her modeli indirebilirsiniz. Ekstra bir kurulum da gerekmez.

LM Studio, özellikle komut satırında çalışmaktan hoşlanmayan yeni başlayanlar için de harika bir seçenektir. Kullanıcı dostu bir arayüz sunar; bir modeli seçebilir, yapılandırmayı ayarlayabilir ve hemen sohbet etmeye başlayabilirsiniz.

Ayrıca yerel dosyalarınızı yükleyip onlarla sohbet edebilirsiniz: LM Studio, sohbet oturumlarına .docx, .pdf ve .txt dosyaları ekleyebilir. Bir belge bağlama sığıyorsa tamamı eklenir; çok uzunsa LM Studio, sorularınızı yanıtlamak için bu dosyalardan ilgili bilgileri çekmek üzere geri getirme artırımlı üretim (RAG) kullanabilir.

LM Studio çapraz platform olduğundan Windows, Mac ve Linux’ta sorunsuz çalışır; yani kurulumunuz tarafından sınırlanmazsınız. Temelleri aştıktan sonra daha fazlasını da yapabilirsiniz. MCP sunucularını entegre ederek yerel LLM’lerinizi harici araçlara, veri kaynaklarına ve API’lere bağlayabilirsiniz; bu da onu daha gelişmiş iş akışları için yeterince esnek kılar.

LM Studio ve Ollama

LM Studio ve Ollama, büyük dil modellerini yerel olarak çalıştırmak ve onlarla sohbet etmek için tasarlanmıştır. Ancak birkaç temel fark vardır:

|

Özellik |

LM Studio |

Ollama |

|

Arayüz |

Önceliği GUI olan, kullanıcı dostu arayüz |

Önceliği CLI olan, terminal tabanlı arayüz |

|

Yerleşik RAG |

Evet, ek kurulum gerekmez |

Harici araçlar gerekir |

|

MCP desteği |

Yerleşik |

Sınırlı / yerel değil |

|

Model indirme |

Uygulama içinden Hugging Face’e erişim |

|

|

Kurulum kolaylığı |

Yeni başlayanlar için çok uygun |

CLI’ye yeniyseniz hafif bir öğrenme eğrisi |

LM Studio Sistem Gereksinimleri ve Model Seçimi

LM Studio’da model indirmeye başlamadan önce, sisteminizin gerçekte neyi kaldırabileceğini anlamak faydalıdır. Seçeceğiniz model doğrudan kullanılabilir RAM’inize bağlıdır; yanlış seçim, işleri yavaşlatabilir veya uygulamayı kullanılamaz hâle getirebilir.

Farklı RAM miktarları için uygun modellere dair hızlı bir başvuru tablosu:

|

RAM |

Rahatça çalıştırabilecekleriniz |

|

8GB |

Küçük modeller (1B–4B) |

|

16GB |

Orta boy modeller (7B-9B) |

|

32GB+ |

Daha büyük modeller (13B ve üzeri) |

GPU isteğe bağlıdır, ancak fark yaratır. Varsa, model yanıtları belirgin şekilde daha hızlı ve akıcı olur. CUDA destekli NVIDIA GPU’lar en iyi sonucu verir; Apple Silicon Metal’i etkili şekilde kullanır ve AMD, kuruluma bağlı olarak kısmi destek sunar.

Donanımınız için doğru modeli nasıl seçersiniz

Makinenizde gerçekten iyi çalışan, sistemi zorlamayan bir model seçimi için bazı pratik öneriler:

|

RAM/VRAM |

Önerilen modeller |

|

8GB |

Qwen 2.5 3B / 4B, Phi-3 Mini (3.8B), Gemma 2 2B |

|

16GB |

Llama 3 8B, Gemma 2 9B, Mistral 7B, Qwen 2.5 7B |

|

24GB |

Llama 3.1 8B (daha kaliteli quant), Mixtral 8x7B (quantize), Qwen 2.5 14B |

|

32GB+ |

Llama 3.1 70B (ağır quantize), Qwen 2.5 32B, Mixtral varyantları (daha iyi konfigürasyonlar) |

Aynı modelin Q4_K_M veya Q8_0 gibi etiketlerle farklı sürümlerini de göreceksiniz. Bu, quantization düzeylerini ifade eder; temelde modelin ne kadar sıkıştırıldığını gösterir. Q4 gibi daha düşük quantization, bellek kullanımını azaltır ve daha hızlı çalışır, ancak bir miktar kalite kaybı olur. Q8 gibi daha yüksek quantization, çıktı kalitesini daha iyi korur; fakat daha fazla RAM ister ve daha yavaş çalışır.

Emin değilseniz, özellikle benimki gibi 16GB bir kurulumda, Q4 veya Q5 genellikle güvenli bir başlangıçtır.

LM Studio’nun Kurulumu

LM Studio ile çalışmaya başlamak için resmî web sitesine gidin ve uygulamayı indirin. Web sitesi işletim sisteminizi otomatik olarak algılar ve ilgili sürümü indirmenizi teklif eder.

Sistem ayarlarınıza bağlı olarak izin vermeniz istenebilir. Benim durumumda, Mac’te, indirdiğim yükleyiciyi açtıktan hemen sonra uygulama olarak kullanılabiliyordu.

Sistem ayarlarınıza bağlı olarak izin vermeniz istenebilir. Benim durumumda, Mac’te, indirdiğim yükleyiciyi açtıktan hemen sonra uygulama olarak kullanılabiliyordu.

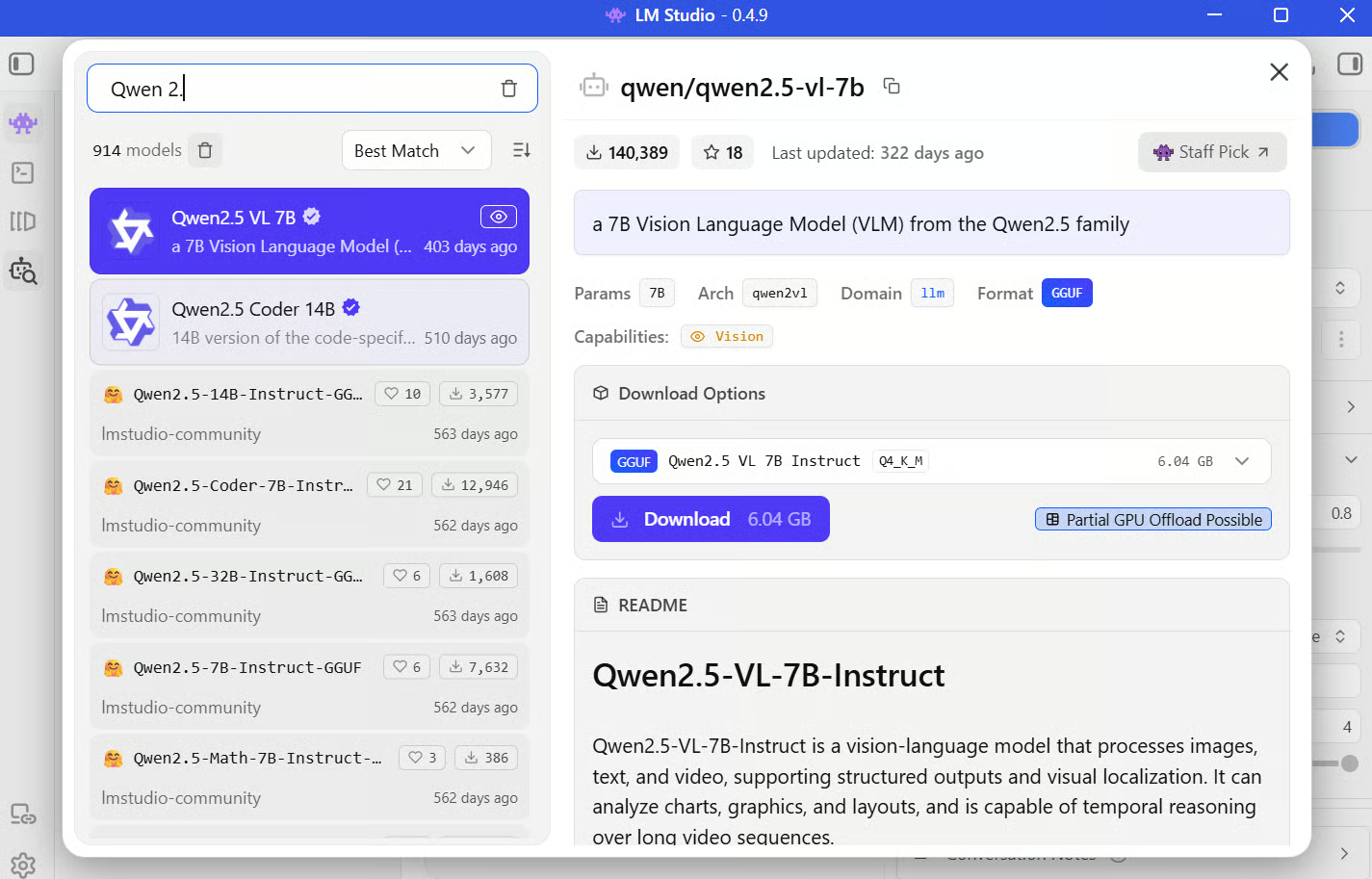

LM Studio’da İlk Modelinizi İndirme

LM Studio’yu ilk açtığınızda, model tarayıcısının olduğu sade bir arayüzle karşılaşırsınız. Hemen model arayabilir, mevcut seçenekleri keşfedebilir ve yerelde çalıştırmak üzere indirmeye başlayabilirsiniz.

Keşfet sekmesine göz atma

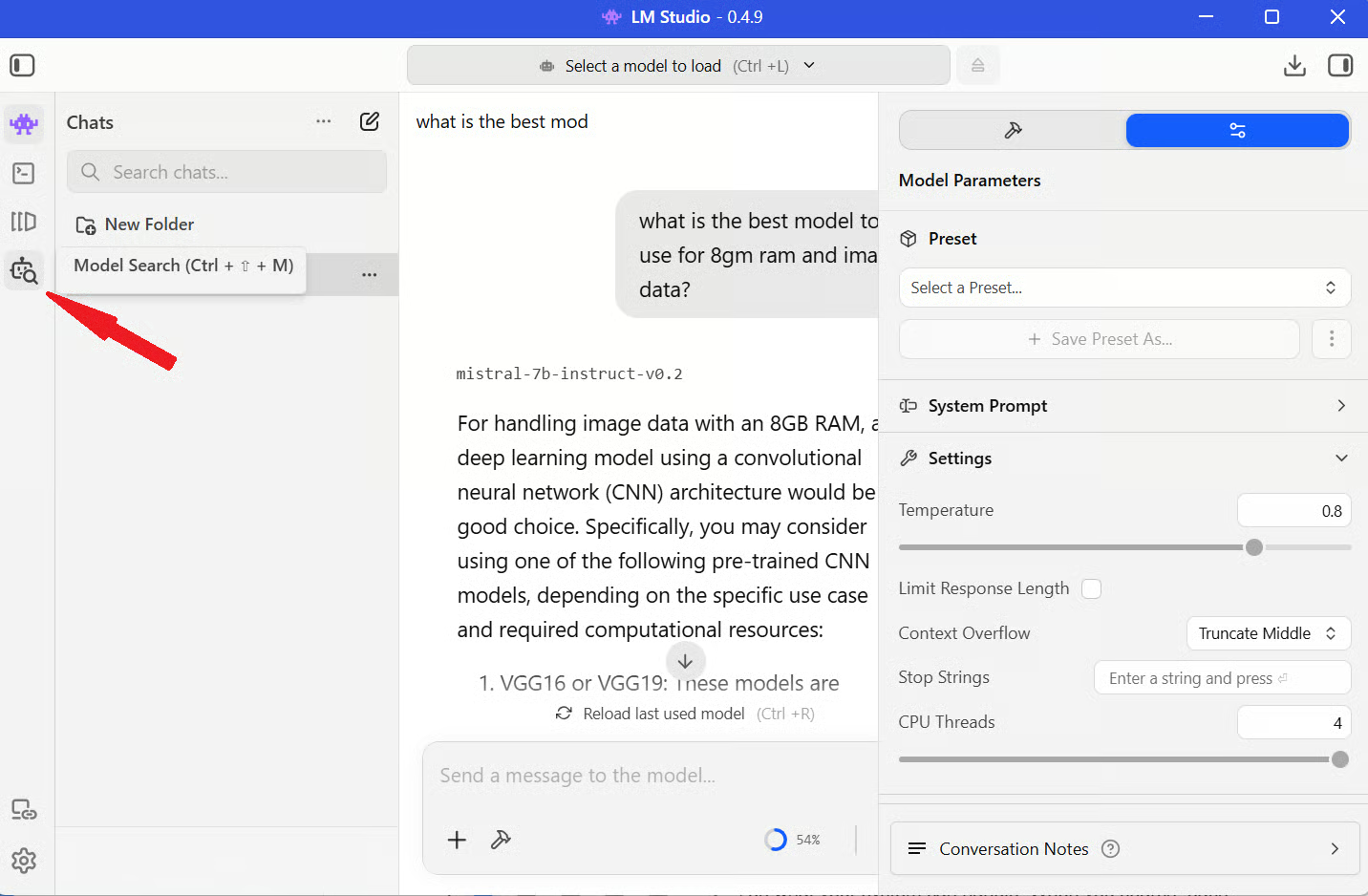

LM Studio’yu açın ve sol kenar çubuğundan arama simgesine tıklayın.

Burası, boyuta göre filtreleyebileceğiniz, farklı seçenekleri keşfedebileceğiniz ve belirli modelleri arayabileceğiniz bir model pazarı gibidir. Arama yaptığınızda her model, boyut, yetenekler ve bazen önerilen kullanım senaryoları gibi yararlı bağlamlar sunan bir model kartıyla gelir. Ne bekleyeceğinizi bilmek için indirmeden önce buna göz atmaya değer.

Eşlik ediyorsanız ve güvenilir bir başlangıç noktası istiyorsanız, 16GB bir sistem için Qwen 2.5 7B (Q4_K_M) gibi bir modelle başlayın (veya yukarıda yaptığım önerilerden birini alın). Performans ve kalite arasında iyi bir denge kurar ve makinenizi çok zorlamadan akıcı şekilde çalışır.

Model formatlarını anlama

Göz atarken modellerin çoğunun GGUF formatında olduğunu göreceksiniz. GGUF, GPT-Generated Unified Format ifadesinin kısaltmasıdır ve LLM’leri son kullanıcı donanımında verimli şekilde depolayıp çalıştırmak için kullanılan ikili bir formattır.

Bu format, modellerin yüksek hassasiyetli ağırlıklarını (ör. Float16) daha düşük bitli tamsayılara (ör. 4-bit, 5-bit) eşler ve model ağırlıklarını, metaveriyi ve yapılandırmayı tek bir optimize dosyada paketler. Bu, yüklemeyi hızlandırır ve LM Studio’nun arka planda kullandığı llama.cpp gibi çıkarım motorlarıyla uyumluluğu sağlar.

LM Studio’da Yerel Bir LLM ile Sohbet Etme

Şimdi heyecan verici kısma geçelim ve modeli kullanıma alalım.

Model yükleme ve parametreleri yapılandırma

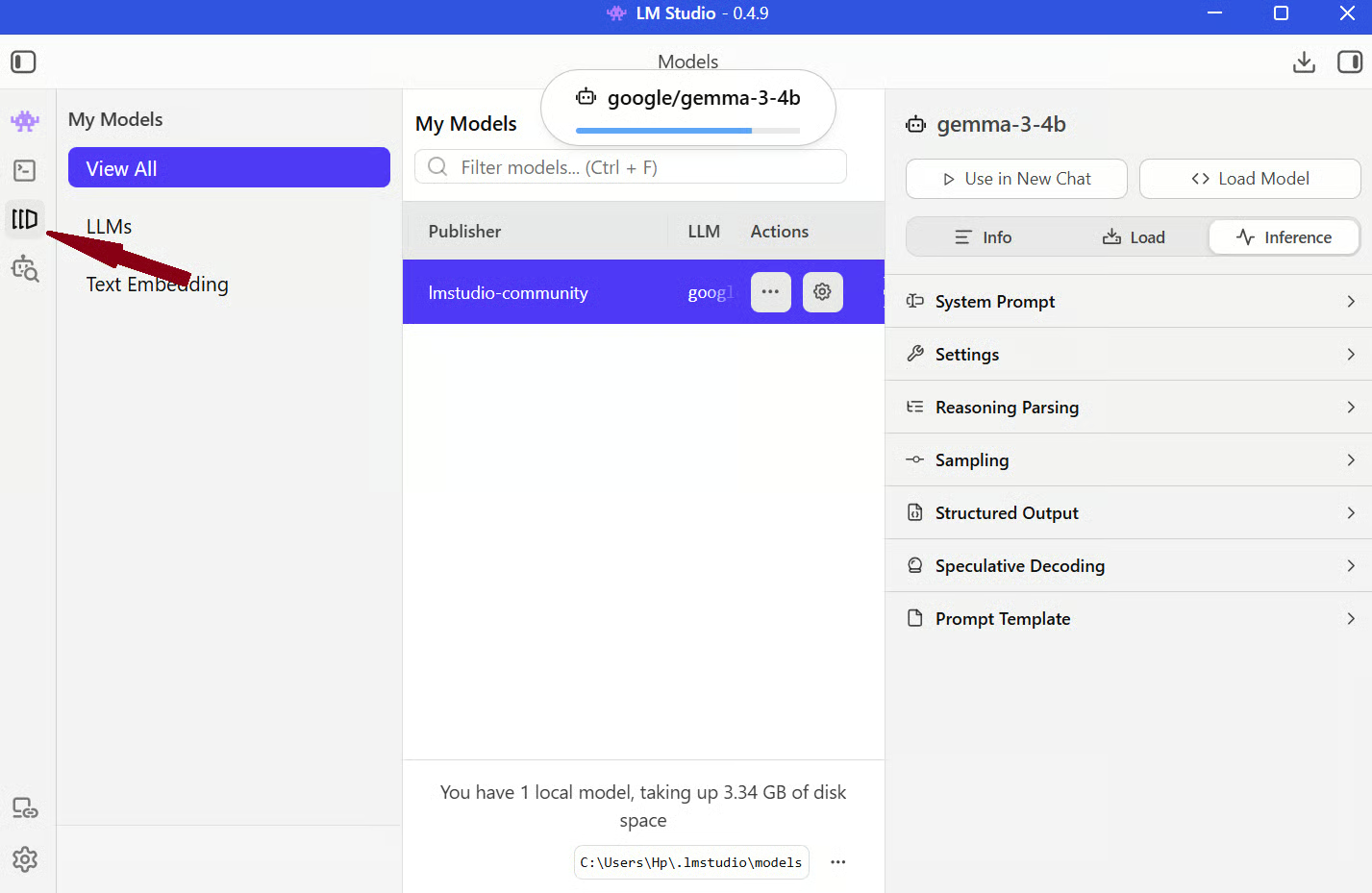

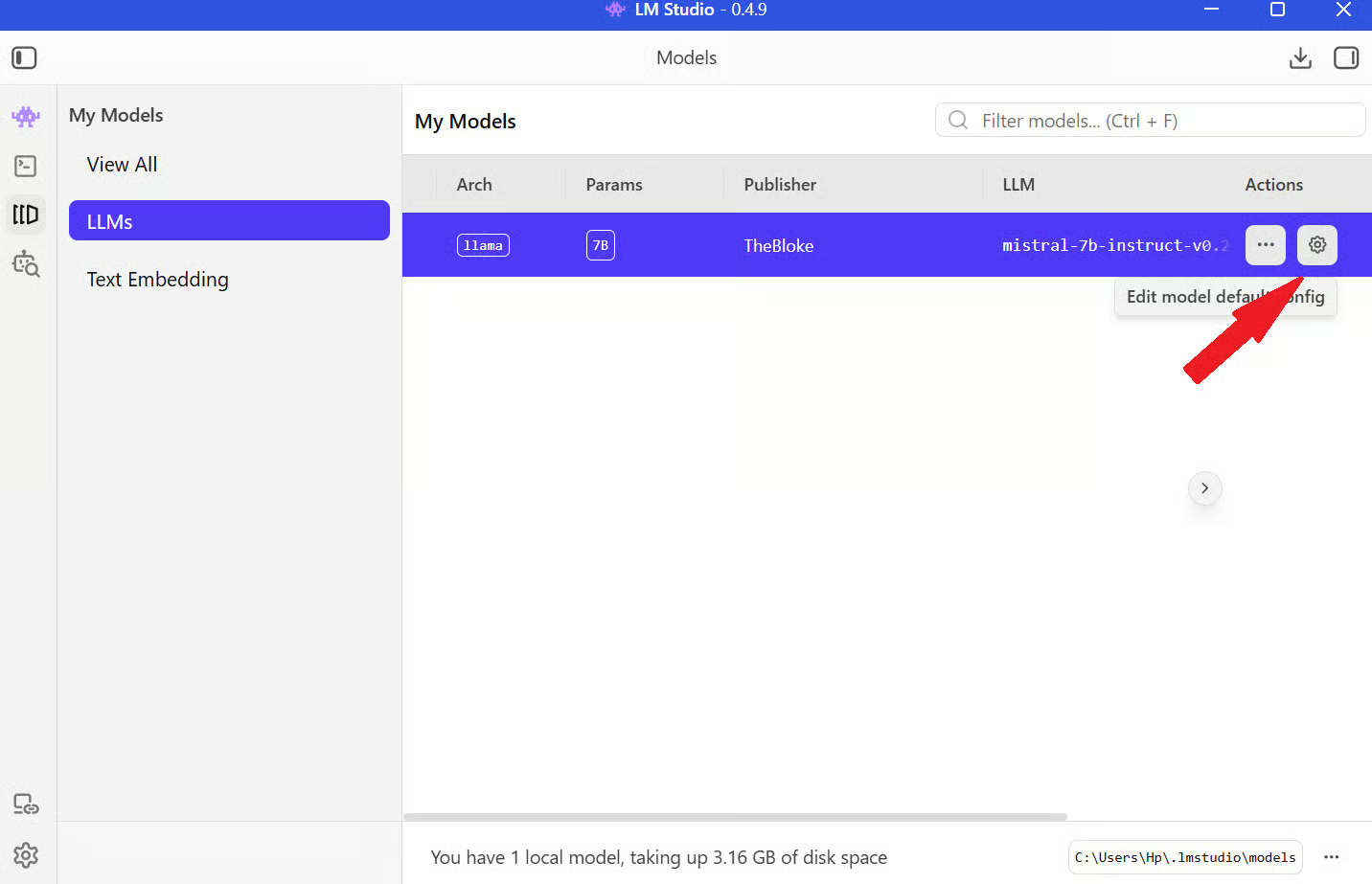

Adım 1: LM Studio’yu açın ve sol menü çubuğundan Modellerim bölümüne gidin.

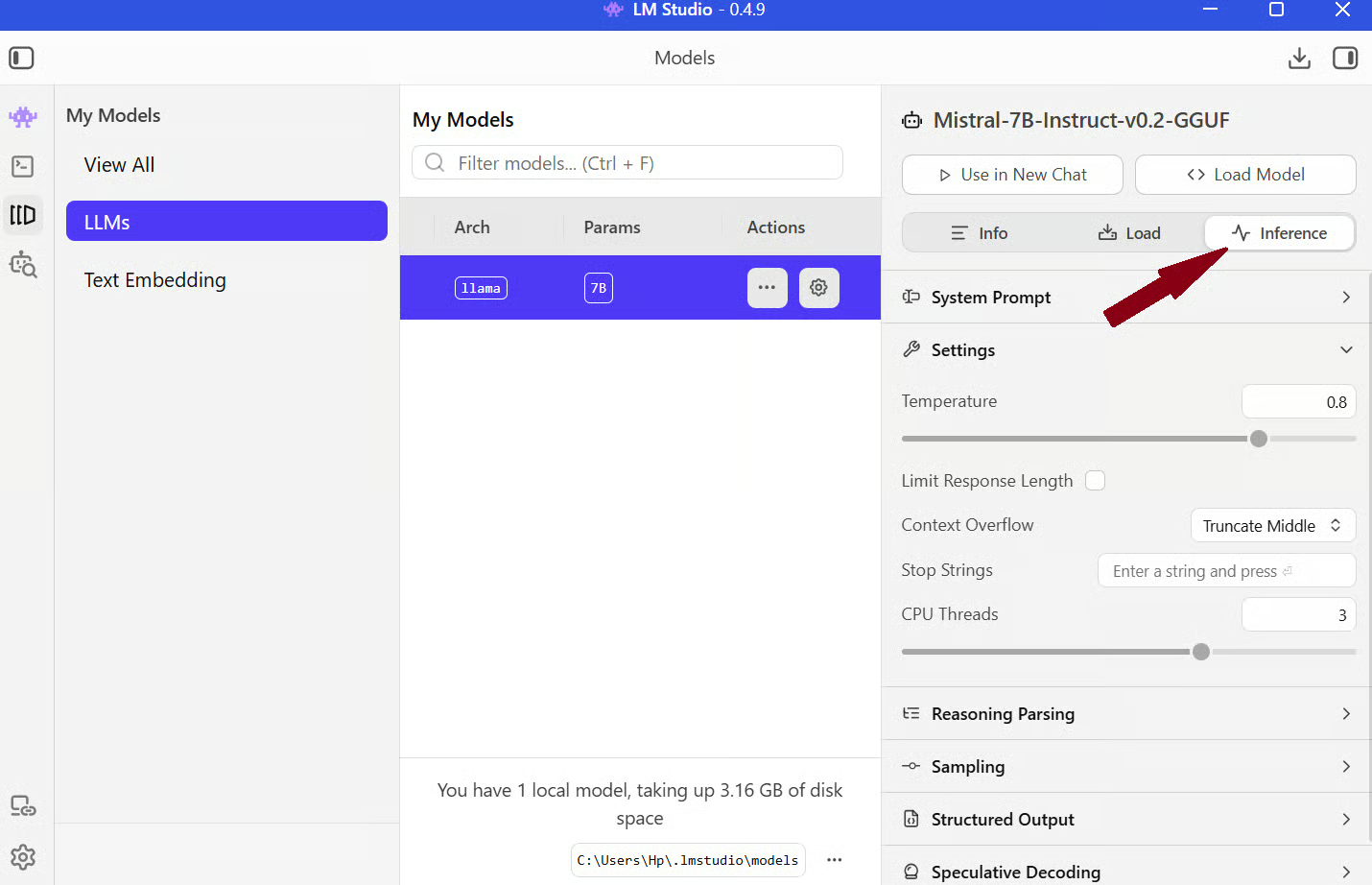

Adım 2: Modelin üzerindeki Ayarlar simgesine tıklayın ve Modeli Yükle seçeneğine tıklayın.

Yüklendikten sonra aynı ekrandaki Çıkarım sekmesine gidin; bağlam uzunluğu, sıcaklık ve daha fazlası için denetimler göreceksiniz.

- Bağlam uzunluğu, modelin bir sohbet sırasında ne kadar bilgiyi hatırlayabildiğini kontrol eder. Daha yüksek değerler daha uzun girdilerle çalışmanıza izin verir; ancak daha fazla bellek kullanır. RAM’iniz sınırlıysa bunu makul tutmak daha iyidir.

- Sıcaklık, modelin ne kadar yaratıcı veya öngörülebilir olduğunu kontrol eder. Düşük değerler yanıtları daha belirleyici yaparken, yüksek değerler daha çeşitli kılar.

- Sistem istemi, modelin davranışını belirler. Asistanın nasıl yanıt vermesi gerektiğini; ton, stil ve rol dahil olmak üzere burada tanımlarsınız.

İlk sohbetiniz

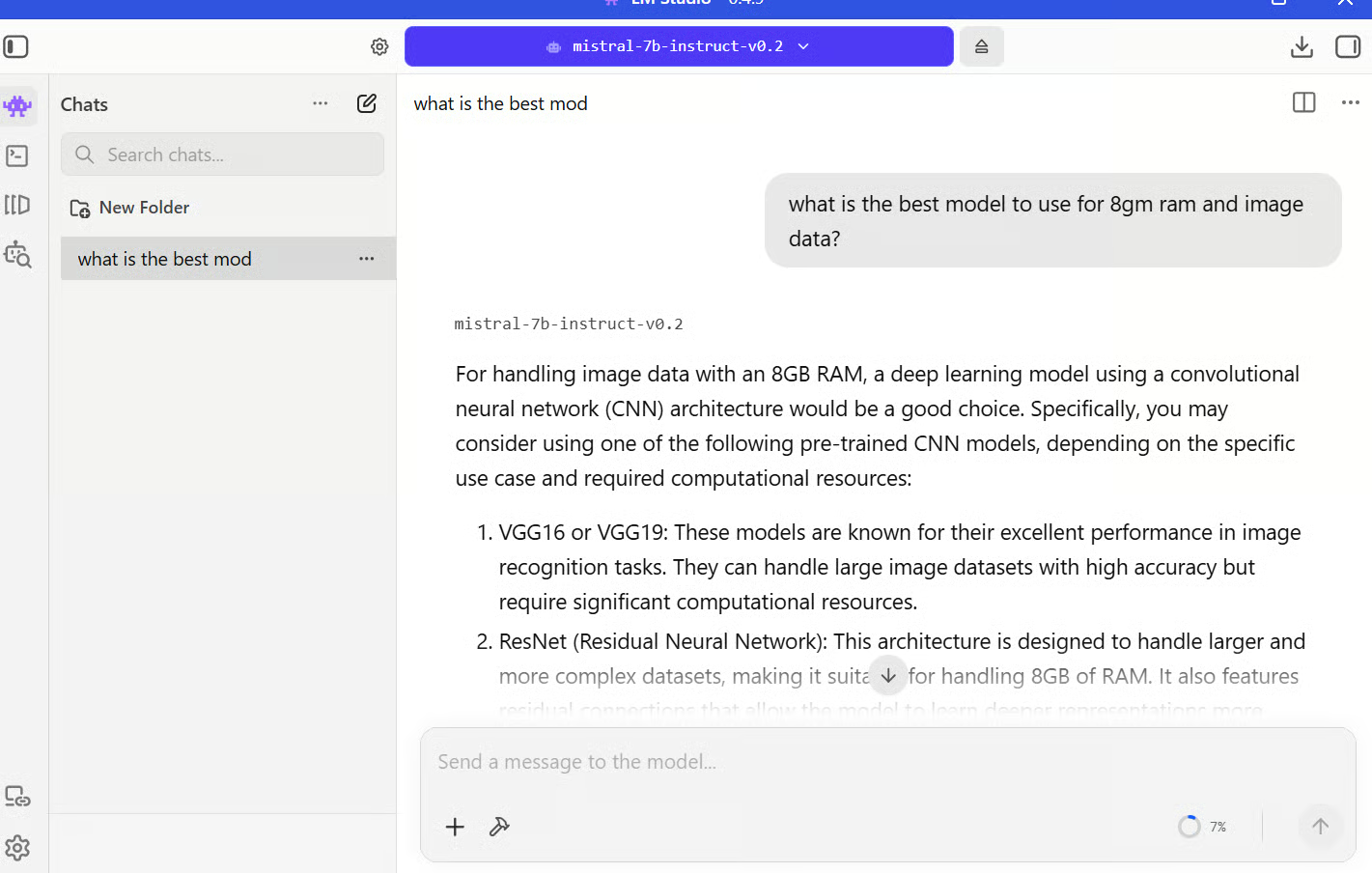

Her şey hazır olduğunda, modelle tıpkı herhangi bir yapay zekâ asistanıyla olduğu gibi sohbet etmeye başlayabilirsiniz. Basit bir örnek:

Şöyle sordum: “8GB RAM ve görsel veri için en iyi model hangisi?”

Model, evrişimli sinir ağı (CNN) mimarisine sahip bir model kullanmayı önerdi; görselde gösterildiği gibi.

Temel akış bu. Yanıtların kalitesi, yapılandırmalarınıza oldukça bağlıdır. Örneğin sistem istemine “Her şeyi basit terimlerle ve kısa yanıtlarla açıkla” derseniz, model çoklu yanıtlarda da bu stile tutarlı şekilde bağlı kalır.

LM Studio’da Belgelerinizle Sohbet Etme

LM Studio’daki en kullanışlı özelliklerden biri, yerleşik RAG desteğidir. Belgelerinizi doğrudan sohbete yükleyebilir ve soru sormaya başlayabilirsiniz.

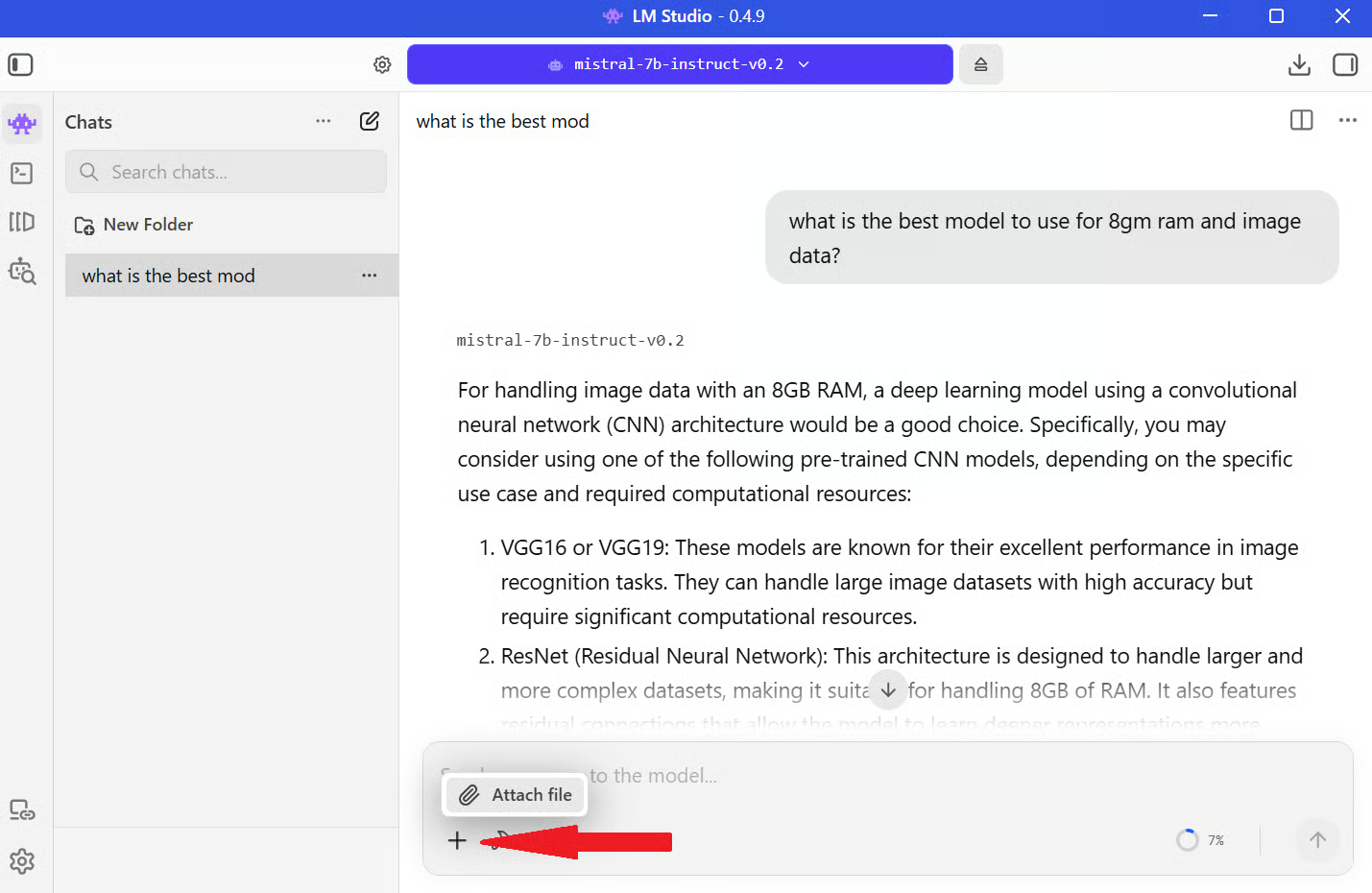

Belge Soru-Cevap kurulumu

Başlamak için, yüklü modelinizle bir sohbet oturumu açın. Dosya eklemek için bir + simgesi göreceksiniz. PDF veya metin dosyaları gibi belgeleri doğrudan sohbete yüklemek için buna tıklayın.

Dosya eklendikten sonra LM Studio, sorgulama için onu otomatik olarak hazırlar; bu nedenle el ile bir şey yapılandırmanız gerekmez. Arka planda belge, modelin verimli çalışabilmesi için daha küçük parçalara bölünür. Bu parçalar daha sonra gömlemelere (embedding) dönüştürülür; yani metnin sayısal temsillerine.

Bir soru sorduğunuzda, LM Studio en alakalı parçaları getirir ve bunları sorgunuzla birlikte modele iletir. Böylece model, belgelerinizden ek bilgi alır ve buna göre yanıt verir.

Bilgi tabanınızı sorgulama

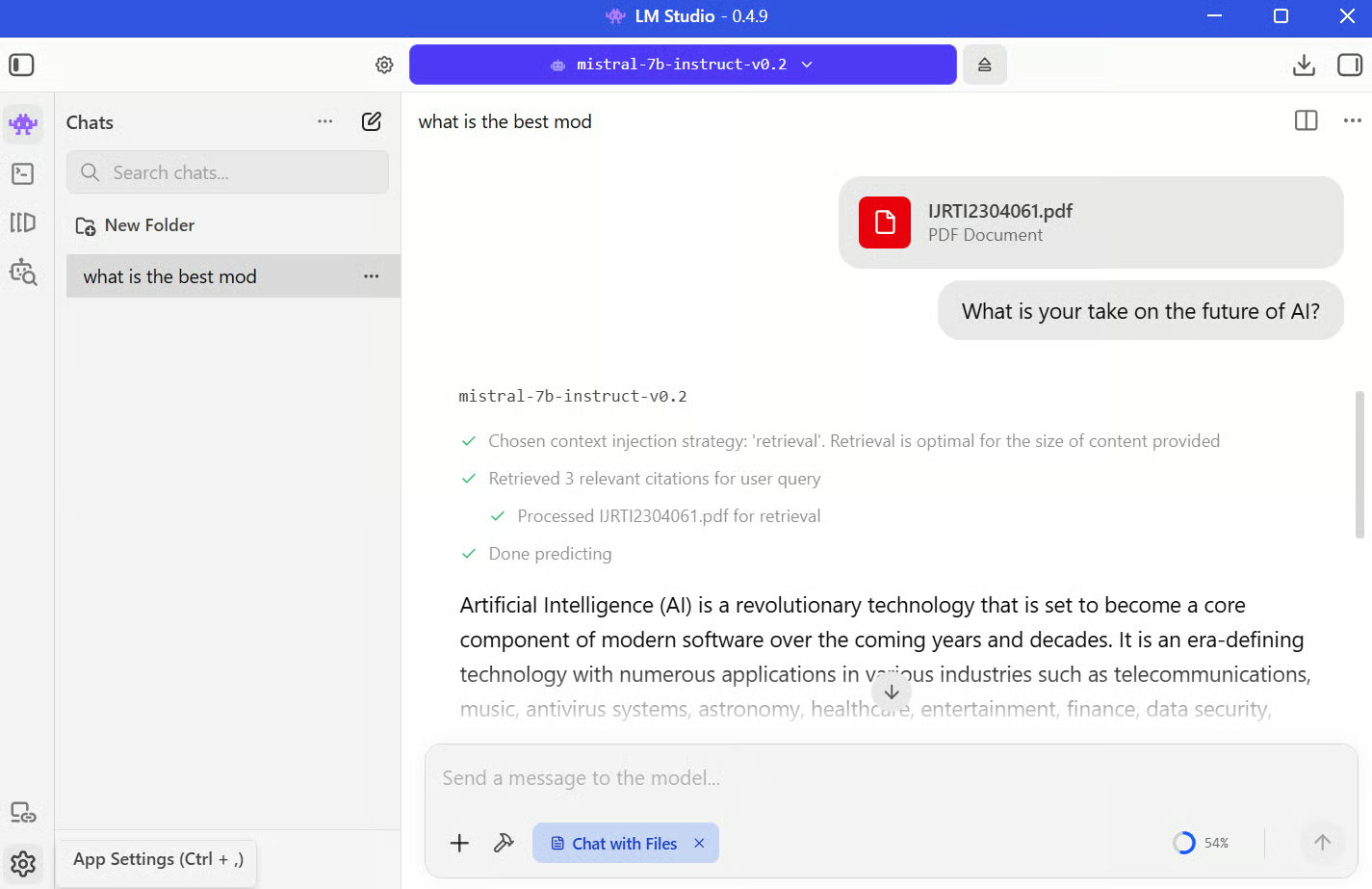

Örneğin, yapay zekâ üzerine bir araştırma makalesi yükledim ve “Yapay zekânın geleceği hakkında ne düşünüyorsunuz?” diye sordum.

LM Studio, belgeden en ilgili kısımları çeker ve bunları isteminizle birlikte modele gönderir. Model, sağlanan bağlamın yanı sıra mevcut bilgisine dayanarak bir yanıt üretir.

Aynısını aşağıdaki görselde görsel olarak da görebilirsiniz:

Aklınızda tutmanız gereken birkaç sınırlama var. Model hâlâ bağlam penceresine bağlıdır; bu nedenle çok büyük belgeler bir seferde tamamen dikkate alınamayabilir. Getirme kalitesi de belgenin ne kadar iyi parçalandığına bağlıdır; bu da ilgili bölümler doğru getirilemezse bazı yanıtların ayrıntıları kaçırabileceği anlamına gelir.

LM Studio’yu Yerel API Sunucusu Olarak Çalıştırma

LM Studio ile yapabileceğiniz en güçlü şeylerden biri, onu yerel bir API sunucusu olarak çalıştırmaktır. Bu sayede yerel LLM’inizi betiklerde, uygulamalarda veya diğer araçlarda kullanabilirsiniz.

Sunucuyu başlatma

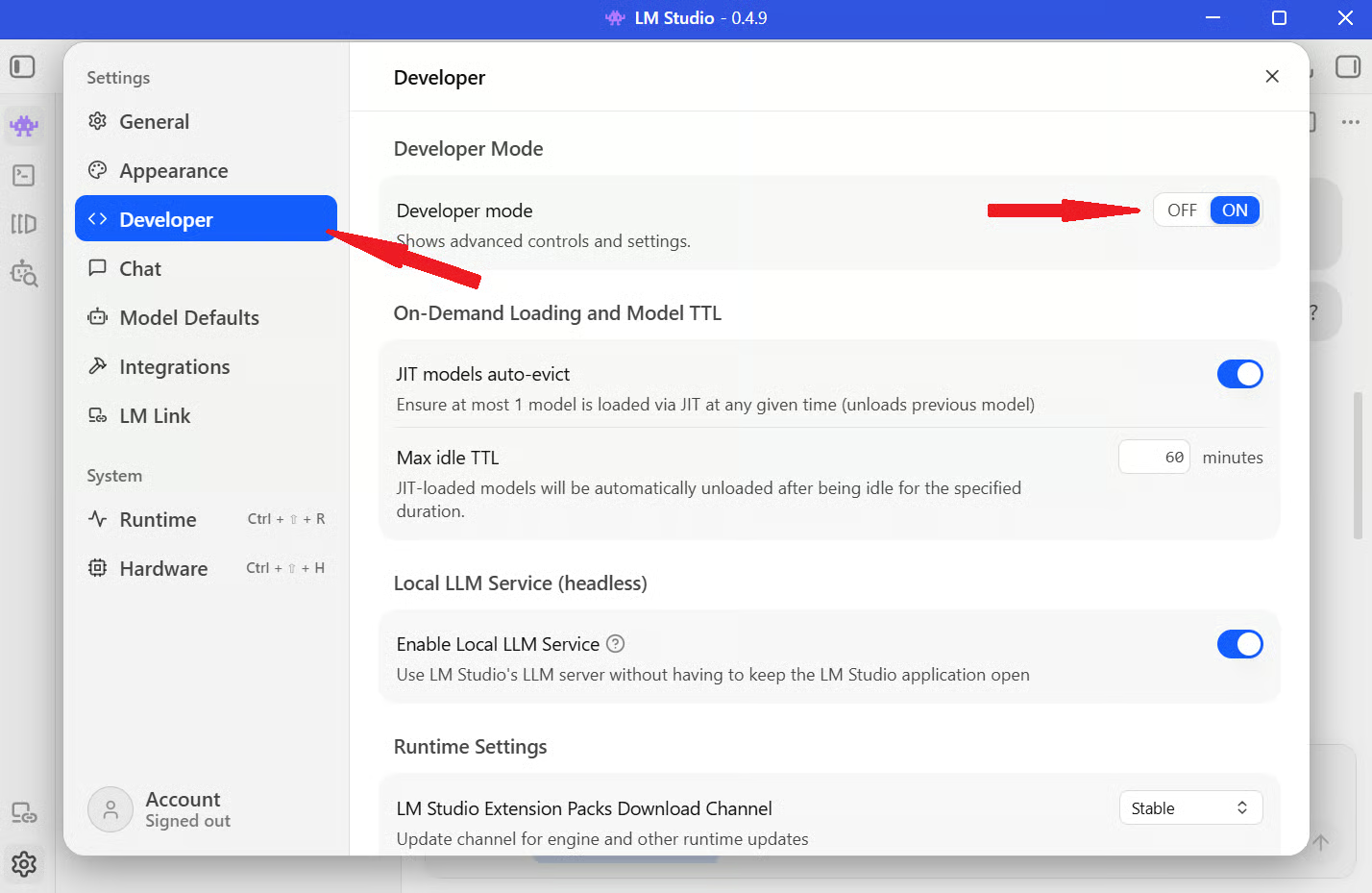

Adım 1: Bunu etkinleştirmek için LM Studio’yu açın ve ekranın sol alt köşesindeki Ayarlar simgesine tıklayın.

Adım 2: Sol kenar çubuğundan Geliştirici bölümüne gidin ve Geliştirici Modu anahtarını açın.

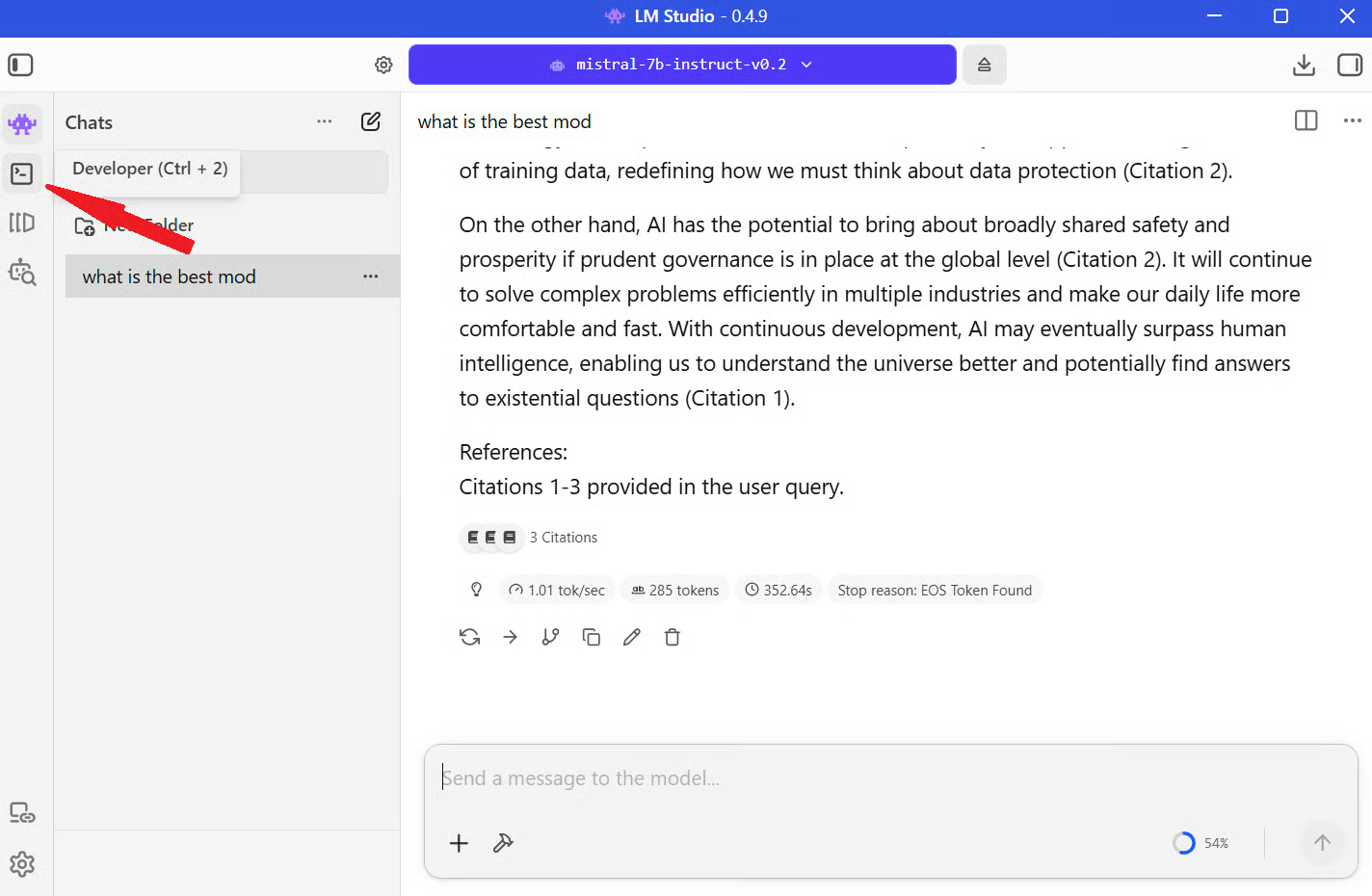

Adım 3: Sohbet arayüzüne geri dönün ve sol menü çubuğundan Geliştirici simgesine tıklayın.

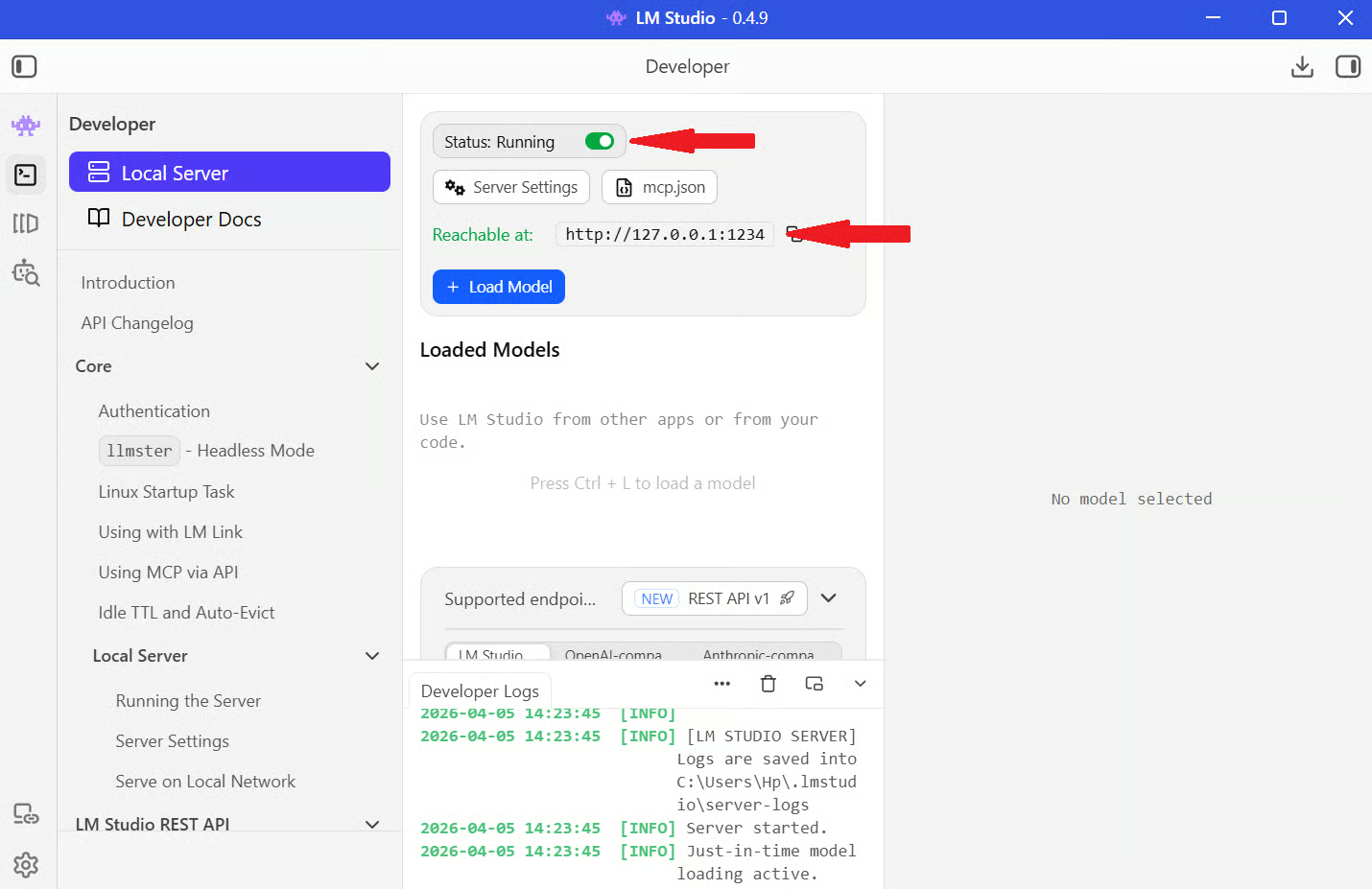

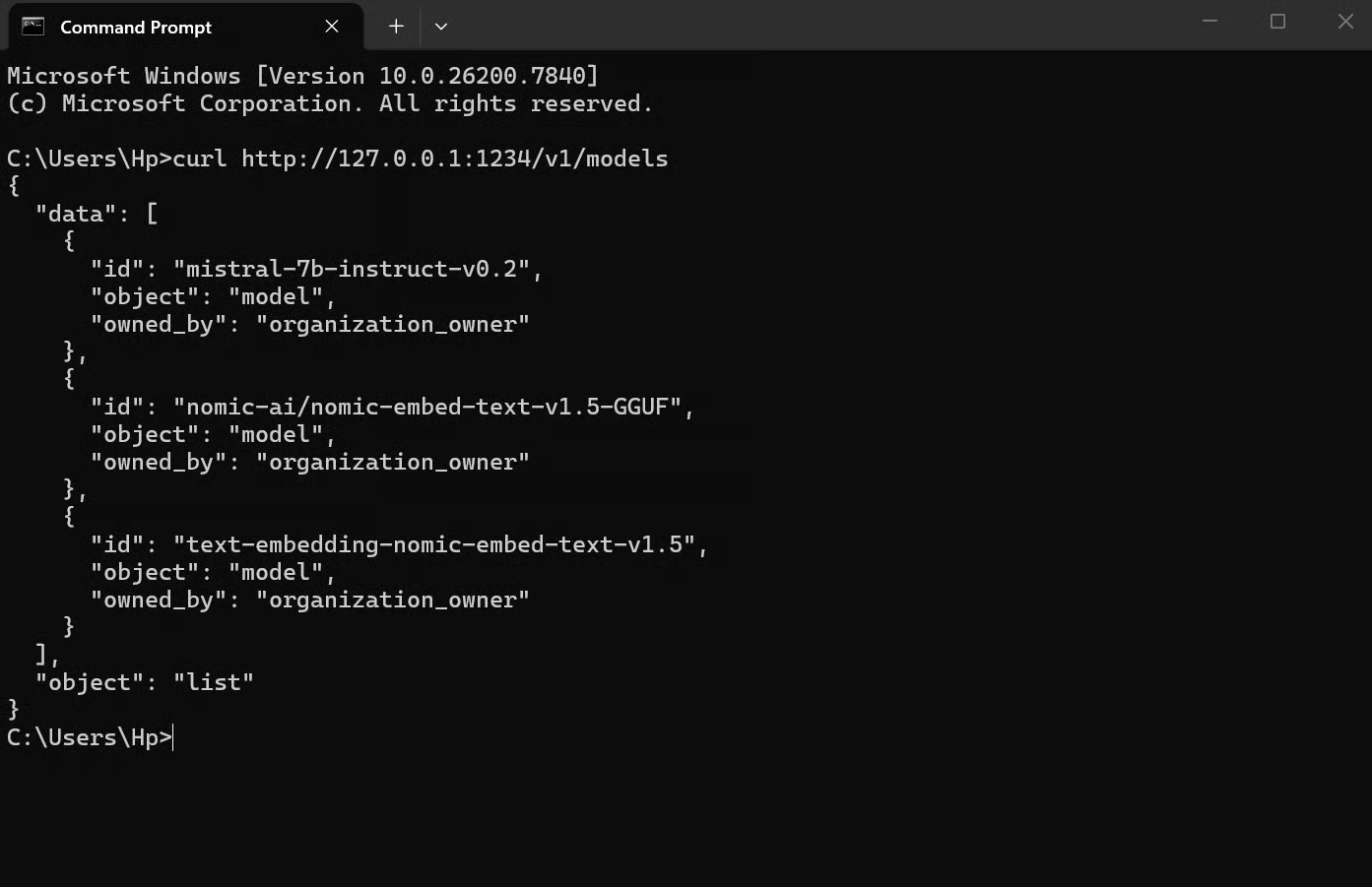

Adım 4: Aşağıdaki görselde olduğu gibi sunucuyu başlatmak için Durum yanındaki anahtarı açın. Çalışmaya başladığında sunucu adresini kopyalayabilir ve basit bir curl isteğiyle test edebilirsiniz:

curl http://127.0.0.1:1234/v1/models

Her şey doğru ayarlandıysa, kullanılabilir modeli listeleyen bir JSON yanıtı görürsünüz.

Python’dan bağlanma

Yerel sunucunuz çalıştığında onu diğer API’ler gibi kullanabilirsiniz. Tek fark, OpenAI’ın sunucularını çağırmak yerine kendi makinenizi çağırıyor olmanızdır.

Basit bir örnek:

from openai import OpenAI

client = OpenAI(base_url="http://localhost:1234/v1", api_key="lm-studio")

response = client.chat.completions.create(

model="local-model",

messages=[

{"role": "user", "content": "Explain how local LLMs work"}

],

)

print(response.choices[0].message.content)Burada olanlar:

-

base_url, kodun OpenAI yerine yerel LM Studio sunucunuzu kullanmasını söyler -

api_keyherhangi bir şey olabilir (LM Studio bunu zorunlu kılmaz) -

model, LM Studio’da yüklediğiniz modele karşılık gelir -

messages, isteminizdir

Bunu çalıştırdığınızda isteğiniz “localhost:1234” adresine gider, model bunu işler ve tıpkı herhangi bir API çağrısında olduğu gibi bir yanıt alırsınız. Bu, LM Studio’nun OpenAI API formatını izlemesi sayesinde çalışır.

Sonuç

LM Studio, LLM’lerle yerelde çalışmanız için sade ve pratik bir arayüz sunar; ortamı tamamen kontrol edebilirsiniz. Modelleri seçebilir, ayarları yapılandırabilir, onlarla sohbet edebilir ve hatta kurulumu yerel bir API sunucusu olarak çalıştıracak şekilde genişletebilirsiniz.

Öne çıkan nokta, büyük dil modellerini yerel olarak çalıştırmanın eskiden çok fazla kurulum ve araç gerektirmesiydi. LM Studio bunu, sıradan bir masaüstü uygulamasını kurup kullanmaya daha yakın bir deneyime indiriyor.

Daha fazlasını inşa etmek isterseniz, bir sonraki adım bu modelleri gerçek iş akışlarına nasıl entegre edeceğinizi öğrenmektir. OpenAI API ile Çalışma gibi kursları veya daha geniş Yapay Zekâ temelleri programlarını keşfederek istemleri nasıl yapılandıracağınızı, uygulamalar geliştireceğinizi ve modellerle etkili şekilde çalışacağınızı anlayabilirsiniz.

LM Studio SSS

LM Studio ücretsiz mi?

Evet, LM Studio’yu indirmek ve kullanmak ücretsizdir. Çekirdek uygulama için abonelik ücreti, kullanım sınırı veya ücretli özellik yoktur.

LM Studio tamamen çevrimdışı mı?

Evet, bir modeli indirdikten sonra her şey yerelde çalışır. Sadece Hugging Face’ten model indirmek için internet bağlantısına ihtiyacınız olur.

LM Studio’yu kendi uygulamalarımda kullanabilir miyim?

Evet, LM Studio OpenAI API formatını izleyen yerel bir API sunucusu olarak çalışabilir. Bu, onu makinenizde çalışan betiklere, uygulamalara veya diğer araçlara bağlayabileceğiniz anlamına gelir.

LM Studio görselleri işleyebilir mi?

Evet, ancak yalnızca görme yetenekli modellerle. LLaVA veya Qwen-VL gibi çok modlu bir modeli yüklerseniz görselleri yükleyebilir ve onlar hakkında sorular sorabilirsiniz. Standart yalnızca metin tabanlı modeller görsel girişi desteklemez.

LLM’leri yerelde çalıştırmak için ne kadar RAM’e ihtiyacım var?

Modele bağlıdır. 8GB daha küçük modelleri çalıştırabilir; 16GB birçok kullanım durumu için yeterlidir; 32GB veya daha fazlası ise çoğunlukla daha büyük modeller için gereklidir.

Srujana, Bilgisayar Bilimleri alanında dört yıllık dereceye sahip serbest çalışan bir teknoloji yazarıdır. Veri bilimi, bulut bilişim, geliştirme, programlama, güvenlik ve daha birçok konuyu yazmak onun için doğal bir süreçtir. Klasik edebiyata ve yeni yerler keşfetmeye tutkuyla bağlıdır.