Programa

Rodar modelos de linguagem de grande porte localmente ficou cada vez mais popular, principalmente quando você não quer enviar dados privados para servidores externos. Quando tudo roda na sua máquina, seus prompts e dados permanecem no seu ambiente, o que dá mais controle e privacidade.

Se você quer essa mesma autonomia, vou te mostrar como usar o LM Studio para rodar e conversar com LLMs localmente. É uma ferramenta com foco em interface gráfica, então você não precisa de experiência no terminal nem conhecimento técnico profundo. A configuração é simples e você começa rapidinho. Vamos lá!

Se você se interessa por rodar agentes e ferramentas localmente, recomendo conferir nossos tutoriais de configuração do OpenClaw e do Claude Code com Ollama.

O que é o LM Studio?

O LM Studio é um aplicativo multiplataforma que permite baixar e rodar modelos de linguagem de grande porte localmente na sua máquina, garantindo que seus dados não vazem para servidores externos.

Ele vem com um navegador de modelos integrado, em que você pode buscar, explorar e baixar modelos diretamente do Hugging Face. Dá para baixar praticamente qualquer modelo que quiser, incluindo diferentes versões de DeepSeek, Llama, Gemma, Phi ou Mistral. Você não precisa de nenhuma configuração extra.

O LM Studio também é uma ótima opção para iniciantes, especialmente se você não curte trabalhar no terminal. Ele oferece uma interface amigável para você escolher o modelo, ajustar configurações e começar a conversar na hora.

Você também pode enviar arquivos locais e conversar com eles: o LM Studio permite anexar arquivos .docx, .pdf e .txt às conversas. Se o documento couber no contexto, ele é incluído por completo; se for muito longo, o LM Studio pode usar retrieval-augmented generation (RAG) para buscar trechos relevantes e responder às suas perguntas.

Como o LM Studio é multiplataforma, ele funciona bem em Windows, Mac e Linux, sem limitar seu ambiente. E quando você passa do básico, dá para ir além. É possível conectar seus LLMs locais a ferramentas externas, fontes de dados e APIs integrando servidores MCP, deixando o fluxo flexível para usos mais avançados.

LM Studio vs Ollama

LM Studio e Ollama foram criados para rodar e conversar com LLMs localmente. Mas há algumas diferenças importantes:

|

Recurso |

LM Studio |

Ollama |

|

Interface |

GUI em primeiro lugar, interface amigável |

Foco em CLI, interface no terminal |

|

RAG integrado |

Sim, sem configuração extra |

Requer ferramentas externas |

|

Suporte a MCP |

Nativo |

Limitado / não nativo |

|

Download de modelos |

Acesso ao Hugging Face dentro do app |

Por comandos como |

|

Facilidade de configuração |

Muito amigável para iniciantes |

Curva de aprendizado se você é novo em CLI |

Requisitos do sistema do LM Studio e escolha do modelo

Antes de começar a baixar modelos no LM Studio, vale entender o que seu sistema realmente aguenta. A escolha do modelo depende diretamente da sua RAM disponível; escolher errado pode deixar tudo lento ou até travar o app.

Uma tabela rápida com modelos adequados para diferentes quantidades de RAM:

|

RAM |

O que roda com folga |

|

8GB |

Modelos pequenos (1B–4B) |

|

16GB |

Modelos médios (7B–9B) |

|

32GB+ |

Modelos maiores (13B ou mais) |

GPU é opcional, mas faz diferença. Se você tiver uma, as respostas do modelo ficam bem mais rápidas e fluidas. GPUs NVIDIA com suporte a CUDA funcionam melhor, Apple Silicon usa bem o Metal e a AMD tem suporte parcial, dependendo da configuração.

Como escolher o modelo certo para seu hardware

Aqui vão recomendações práticas para escolher um modelo que rode bem na sua máquina sem forçar demais.

|

RAM/VRAM |

Modelos recomendados |

|

8GB |

Qwen 2.5 3B / 4B, Phi-3 Mini (3.8B), Gemma 2 2B |

|

16GB |

Llama 3 8B, Gemma 2 9B, Mistral 7B, Qwen 2.5 7B |

|

24GB |

Llama 3.1 8B (quantização melhor), Mixtral 8x7B (quantizado), Qwen 2.5 14B |

|

32GB+ |

Llama 3.1 70B (fortemente quantizado), Qwen 2.5 32B, variantes Mixtral (configurações melhores) |

Você também vai notar diferentes versões do mesmo modelo com rótulos como Q4_K_M ou Q8_0. Isso se refere aos níveis de quantização, que basicamente indicam o quanto o modelo foi comprimido. Quantizações mais baixas, como Q4, reduzem o uso de memória e rodam mais rápido, mas com alguma perda de qualidade. Quantizações mais altas, como Q8, preservam melhor a qualidade de saída, porém exigem mais RAM e rodam mais devagar.

Se estiver na dúvida, Q4 ou Q5 costuma ser um bom ponto de partida, especialmente em máquinas com 16GB (como a minha).

Instalando o LM Studio

Para começar com o LM Studio, acesse o site oficial e faça o download do app. O site detecta automaticamente seu sistema operacional e oferece a versão correspondente.

Dependendo das configurações do sistema, você pode precisar conceder permissões. No meu caso, no Mac, o app ficou disponível logo após abrir o instalador.

Dependendo das configurações do sistema, você pode precisar conceder permissões. No meu caso, no Mac, o app ficou disponível logo após abrir o instalador.

Baixando seu primeiro modelo no LM Studio

Ao abrir o LM Studio pela primeira vez, você verá uma interface limpa com o navegador de modelos. Dá para buscar modelos, explorar opções e começar a baixar um para rodar localmente.

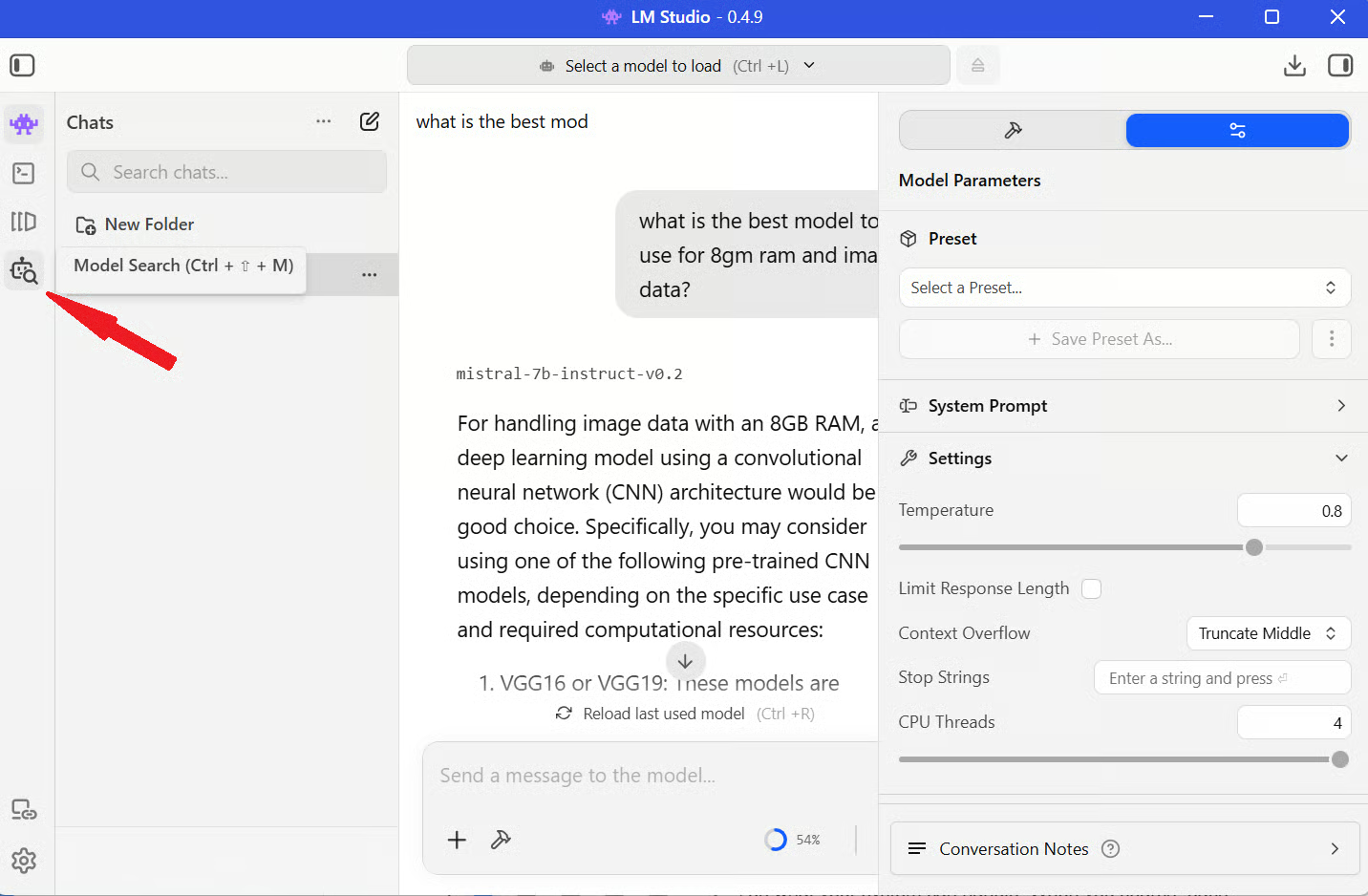

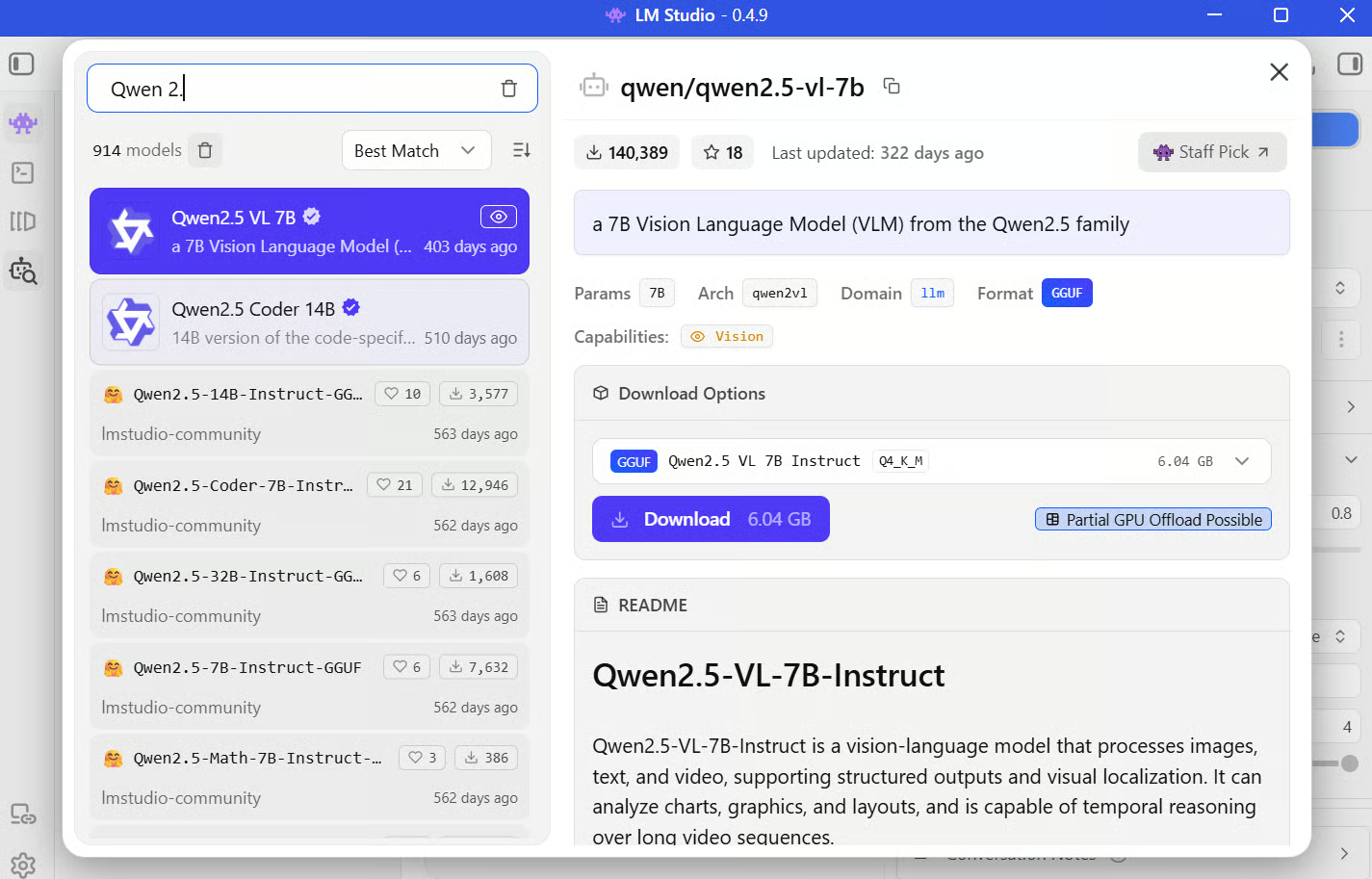

Explorando a aba Discover

Abra o LM Studio e clique no ícone de busca na barra lateral esquerda.

Pense nessa área como um marketplace de modelos: você busca por nomes específicos, filtra por tamanho e explora alternativas. Cada modelo vem com um card com contexto útil como tamanho, capacidades e, às vezes, casos de uso recomendados. Vale dar uma olhada antes de baixar para saber o que esperar.

Se quiser acompanhar e ter um ponto de partida confiável, escolha algo como Qwen 2.5 7B (Q4_K_M) para sistemas com 16GB (ou siga uma das sugestões acima). É um bom equilíbrio entre desempenho e qualidade, rodando liso sem forçar a máquina.

Entendendo os formatos de modelo

Ao explorar, você vai notar que a maioria dos modelos está no formato GGUF. GGUF, de GPT-Generated Unified Format, é um formato binário para armazenar e rodar LLMs com eficiência em hardwares de consumo.

Esse formato mapeia os pesares de alta precisão (por exemplo, Float16) para inteiros de menos bits (como 4 ou 5 bits) e empacota pesos, metadados e configurações em um único arquivo otimizado. Isso acelera o carregamento e garante compatibilidade com mecanismos de inferência como o llama.cpp, que o LM Studio usa nos bastidores.

Conversando com um LLM local no LM Studio

Hora de colocar o modelo para trabalhar.

Carregando um modelo e ajustando parâmetros

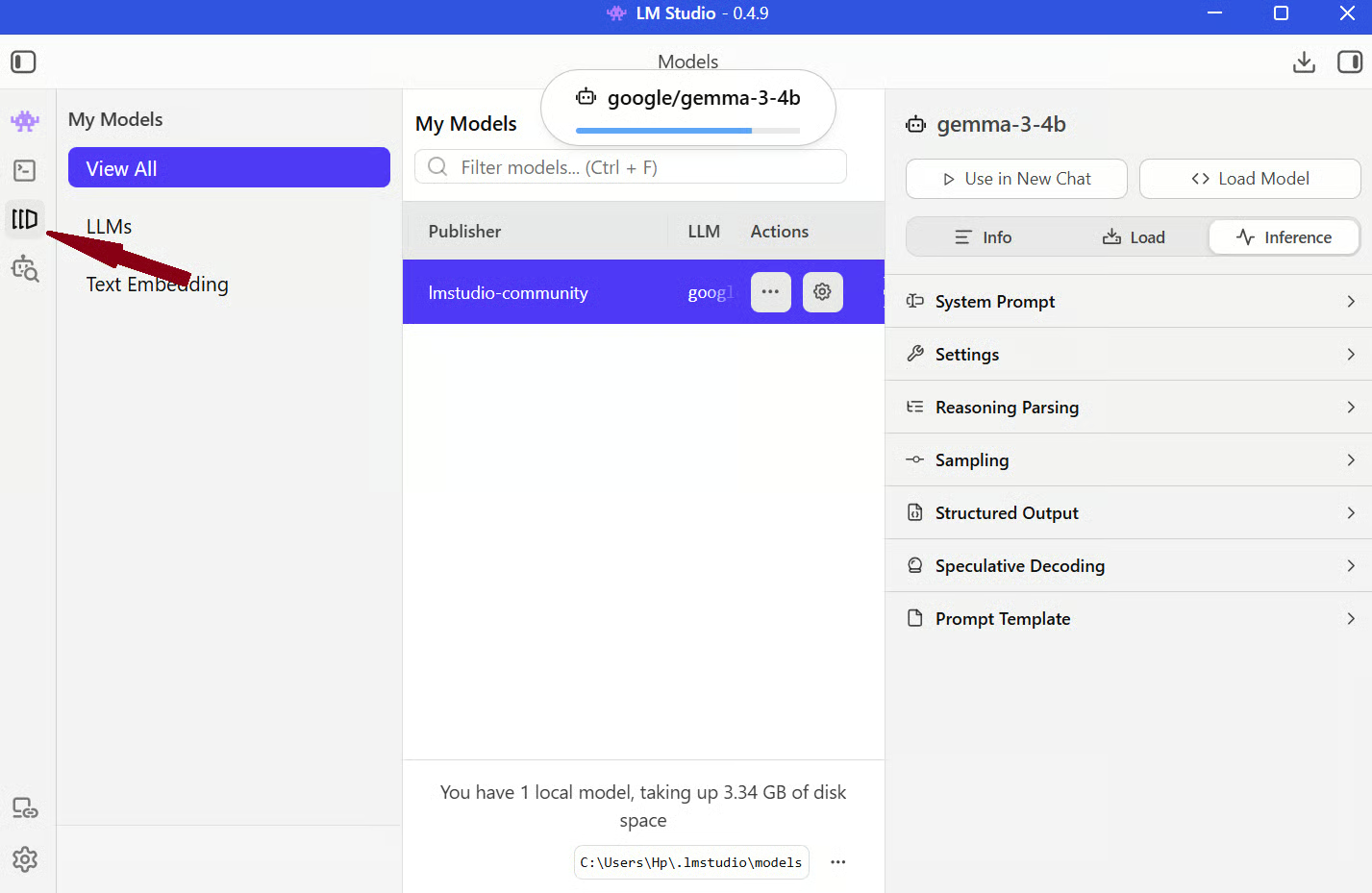

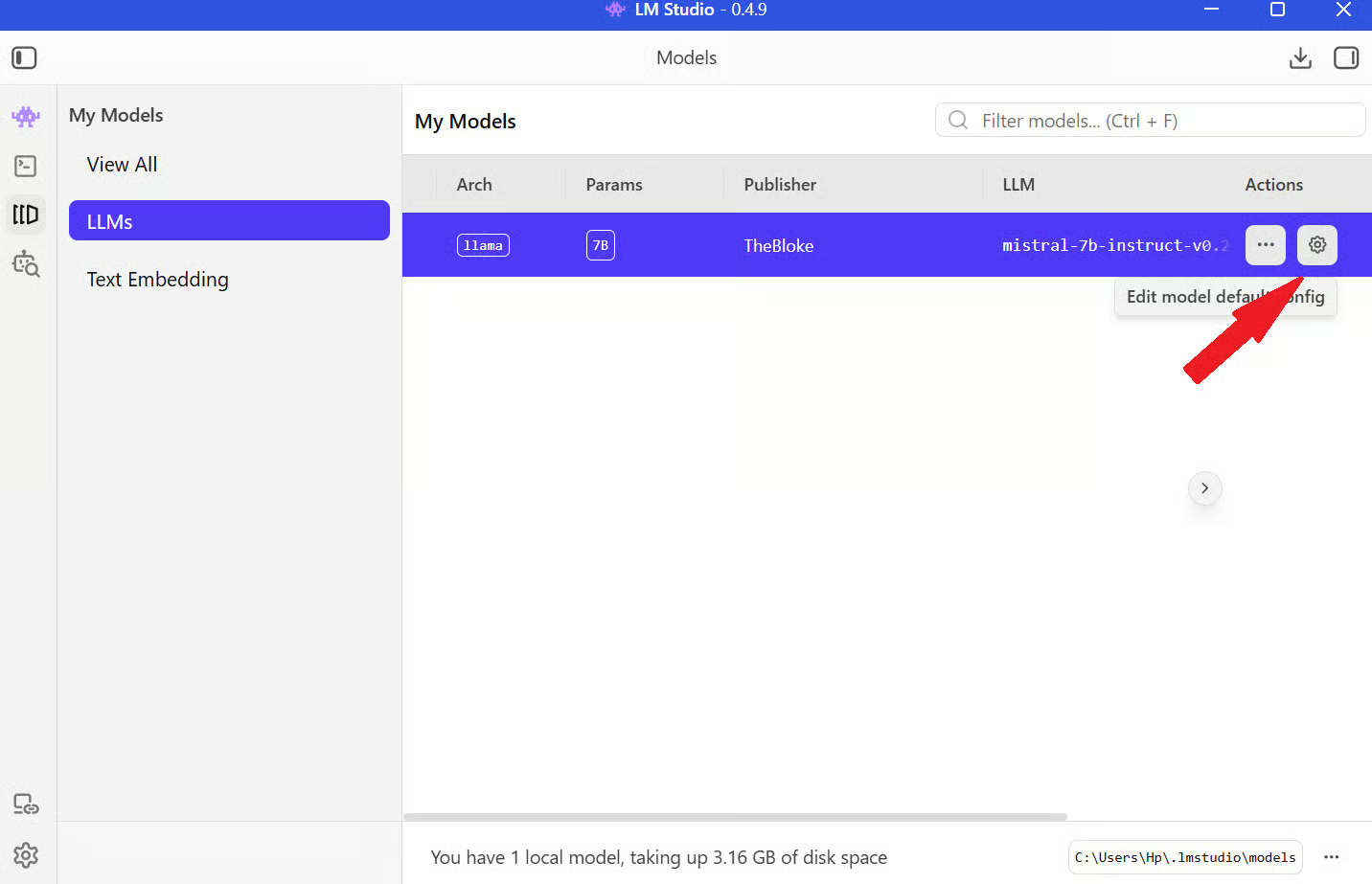

Passo 1: Abra o LM Studio e vá até a seção My Models no menu esquerdo.

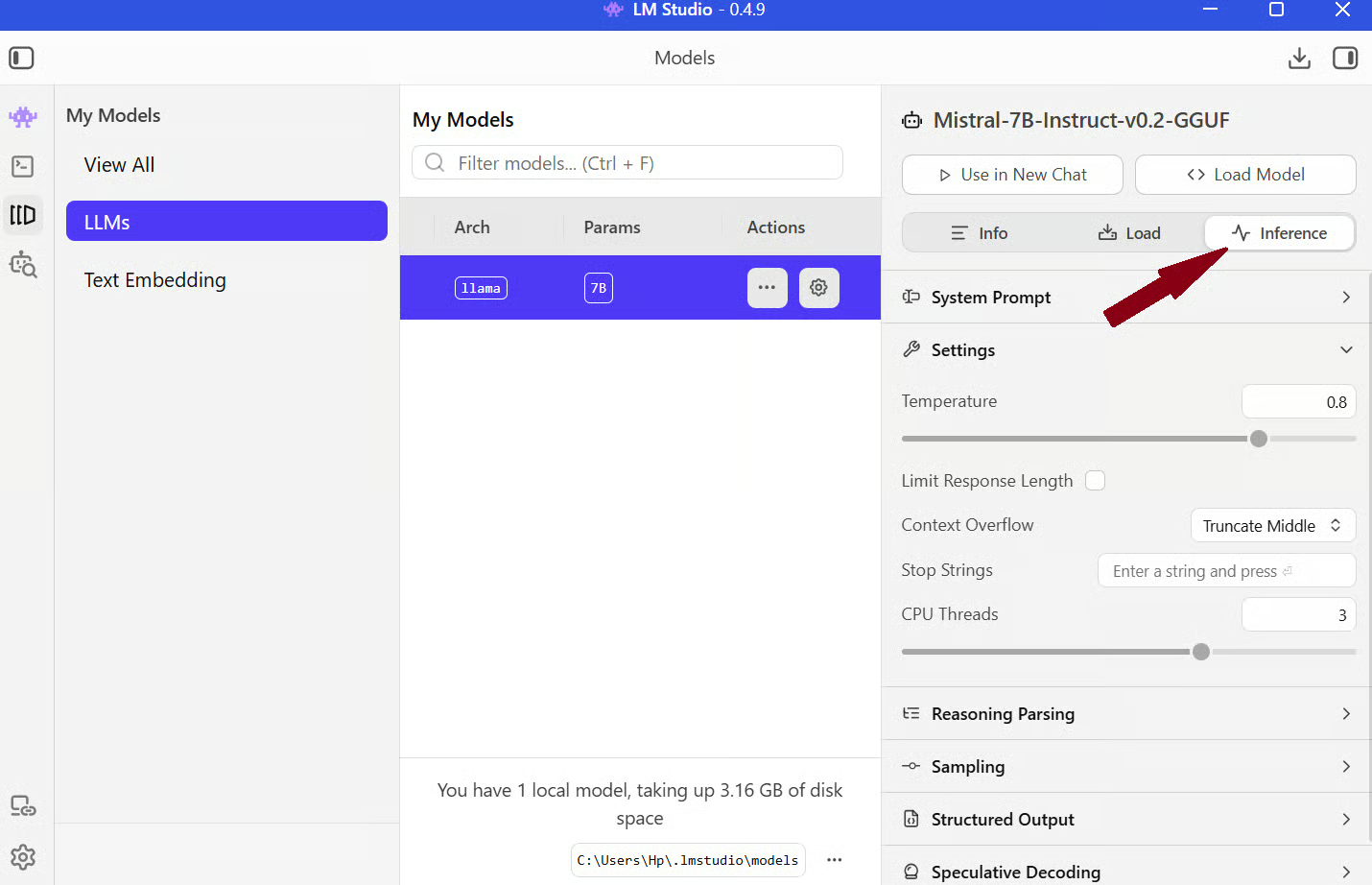

Passo 2: Clique no ícone de Settings do modelo e depois em Load Model.

Depois de carregar, vá até a aba Inference na mesma tela. Ali você encontra os controles de context length, temperature e outras opções.

- Context length controla quanto o modelo consegue "lembrar" durante a conversa. Valores mais altos permitem entradas mais longas, mas usam mais memória. Se a RAM for limitada, mantenha em um nível moderado.

- Temperature controla quão criativas ou previsíveis serão as respostas. Valores baixos tornam as respostas mais determinísticas; valores altos, mais variadas.

- System prompt define o comportamento do modelo. Aqui você determina como o assistente deve responder, incluindo tom, estilo e papel.

Sua primeira conversa

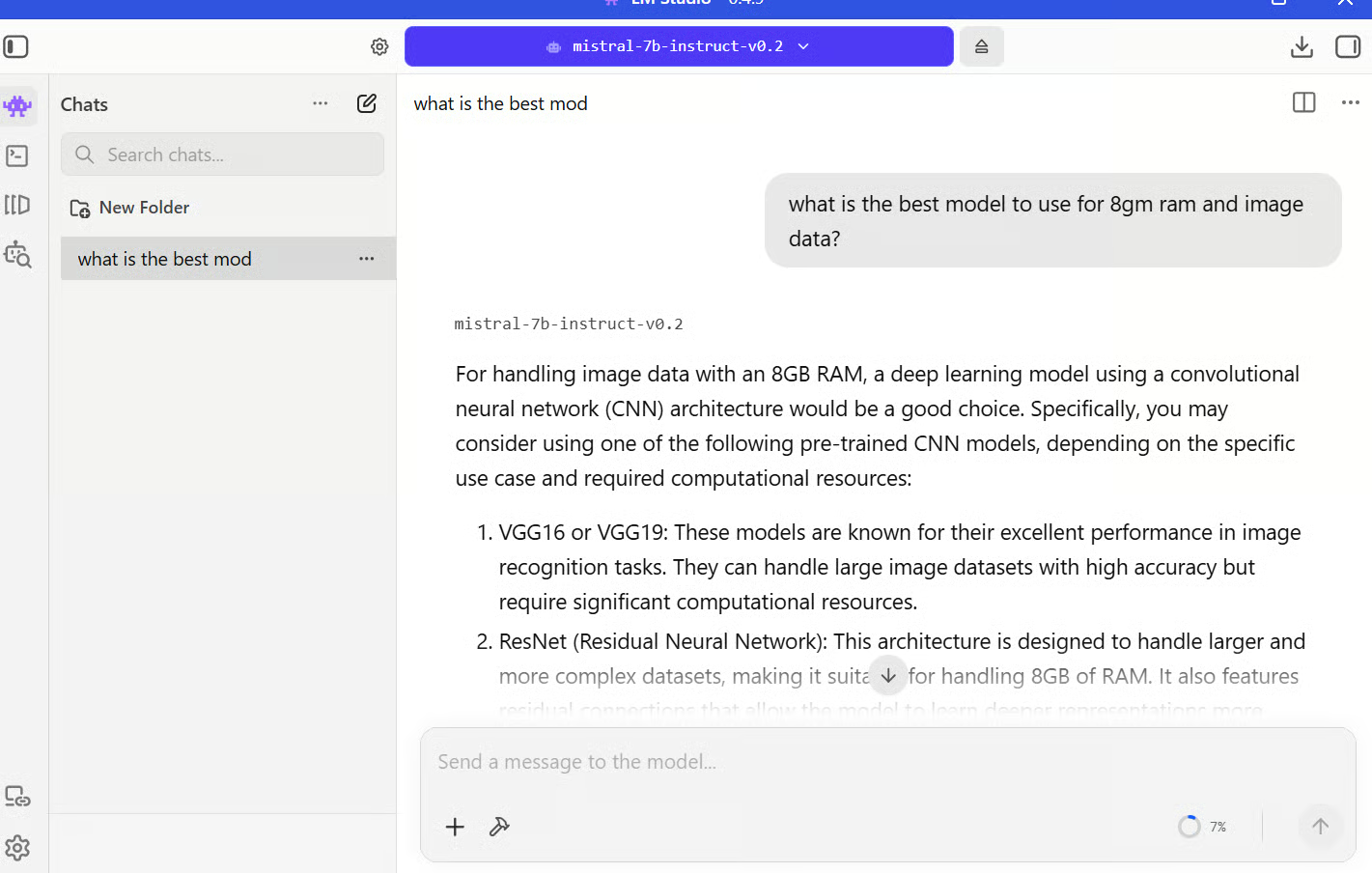

Com tudo pronto, é só conversar com o modelo como faria com qualquer assistente de IA. Um exemplo simples:

Eu perguntei: “Qual é o melhor modelo para 8GB de RAM e dados de imagem?”

O modelo sugeriu usar um modelo com arquitetura de convolutional neural network (CNN), como na imagem.

Esse é o fluxo básico. A qualidade das respostas depende bastante das configurações. Por exemplo, se você definir no system prompt “Explique tudo de forma simples e com respostas curtas”, o modelo tende a manter esse estilo ao longo das respostas.

Conversando com seus documentos no LM Studio

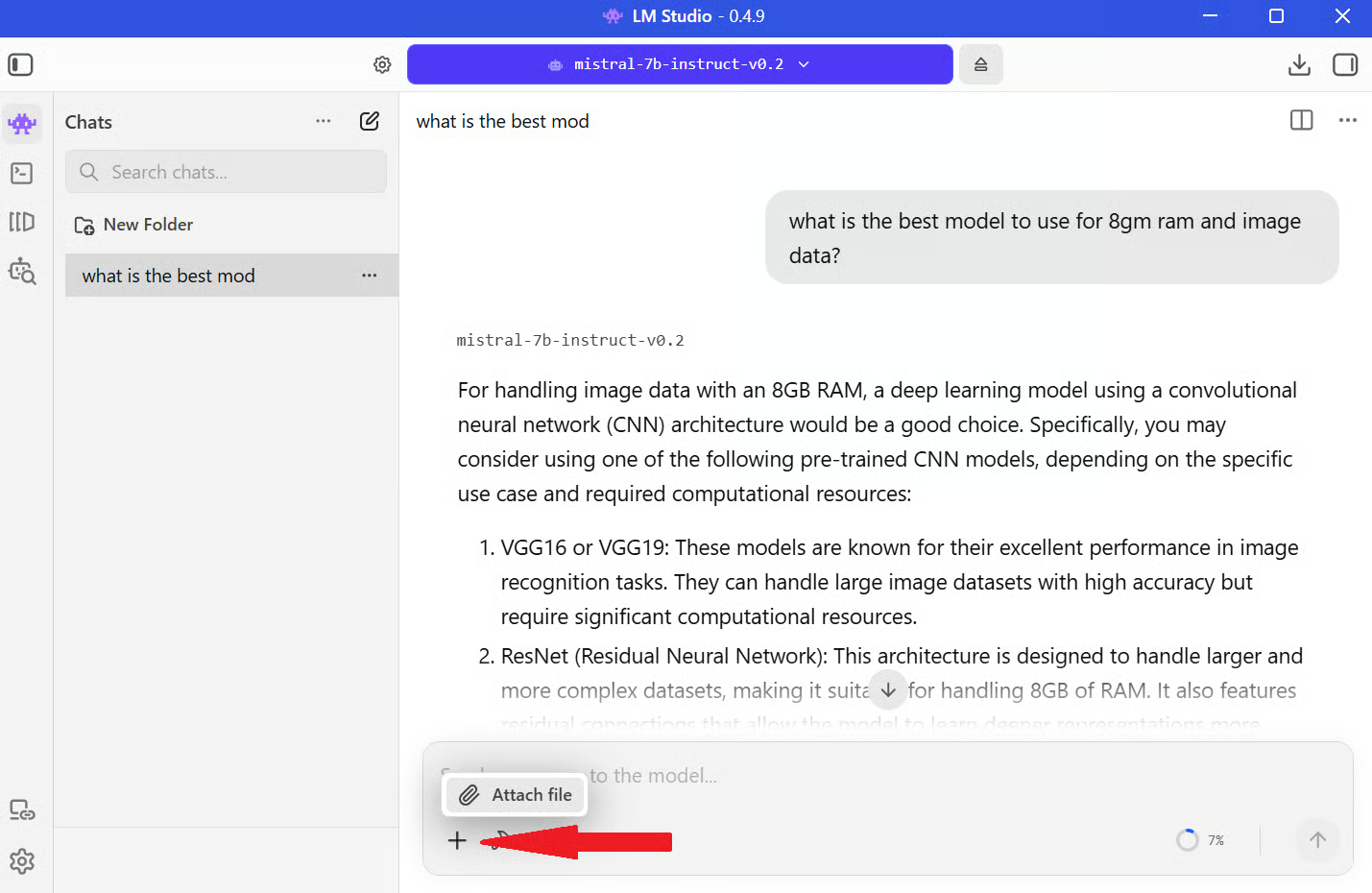

Um dos recursos mais úteis do LM Studio é o suporte nativo a RAG. Você pode enviar documentos diretamente no chat e começar a fazer perguntas.

Configurando perguntas e respostas com documentos

Para começar, abra uma conversa com o modelo carregado. Você verá um ícone de + para anexar arquivos. Clique para enviar PDFs ou arquivos de texto diretamente para o chat.

Assim que o arquivo é adicionado, o LM Studio o prepara automaticamente para consulta, sem necessidade de configurar nada manualmente. Por baixo dos panos, o documento é dividido em pedaços menores para processamento eficiente. Esses pedaços são convertidos em embeddings, que são representações numéricas do texto.

Quando você faz uma pergunta, o LM Studio recupera os trechos mais relevantes e os envia ao modelo junto com sua pergunta. Assim, o modelo recebe informações extras dos seus documentos e responde com base nisso.

Consultando sua base de conhecimento

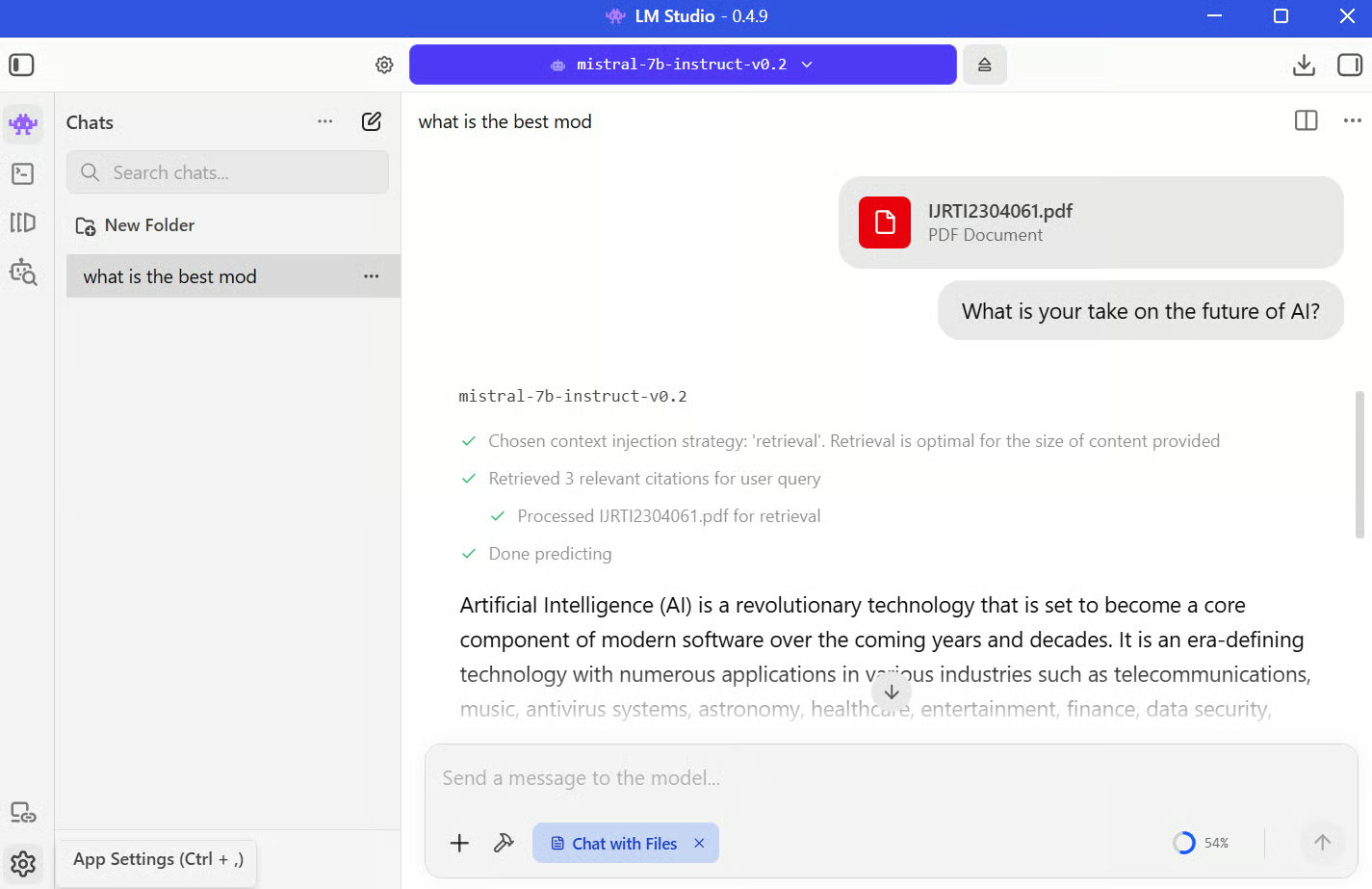

Por exemplo, enviei um artigo de pesquisa sobre inteligência artificial e perguntei: “Qual é sua visão sobre o futuro da IA?”

O LM Studio extrai as seções mais relevantes do documento e as envia ao modelo junto com o seu prompt. O modelo então gera uma resposta combinando o contexto fornecido e seu conhecimento prévio.

Na imagem abaixo, dá para ver esse processo visualmente:

Existem algumas limitações. O modelo ainda depende da janela de contexto, então documentos muito grandes podem não ser considerados por completo de uma só vez. A qualidade da recuperação também depende de como o documento é fragmentado; algumas respostas podem perder detalhes se os trechos certos não forem recuperados.

Rodando o LM Studio como um servidor de API local

Um dos recursos mais poderosos do LM Studio é rodá-lo como um servidor de API local. Assim, você pode usar seu LLM local em scripts, apps ou outras ferramentas.

Iniciando o servidor

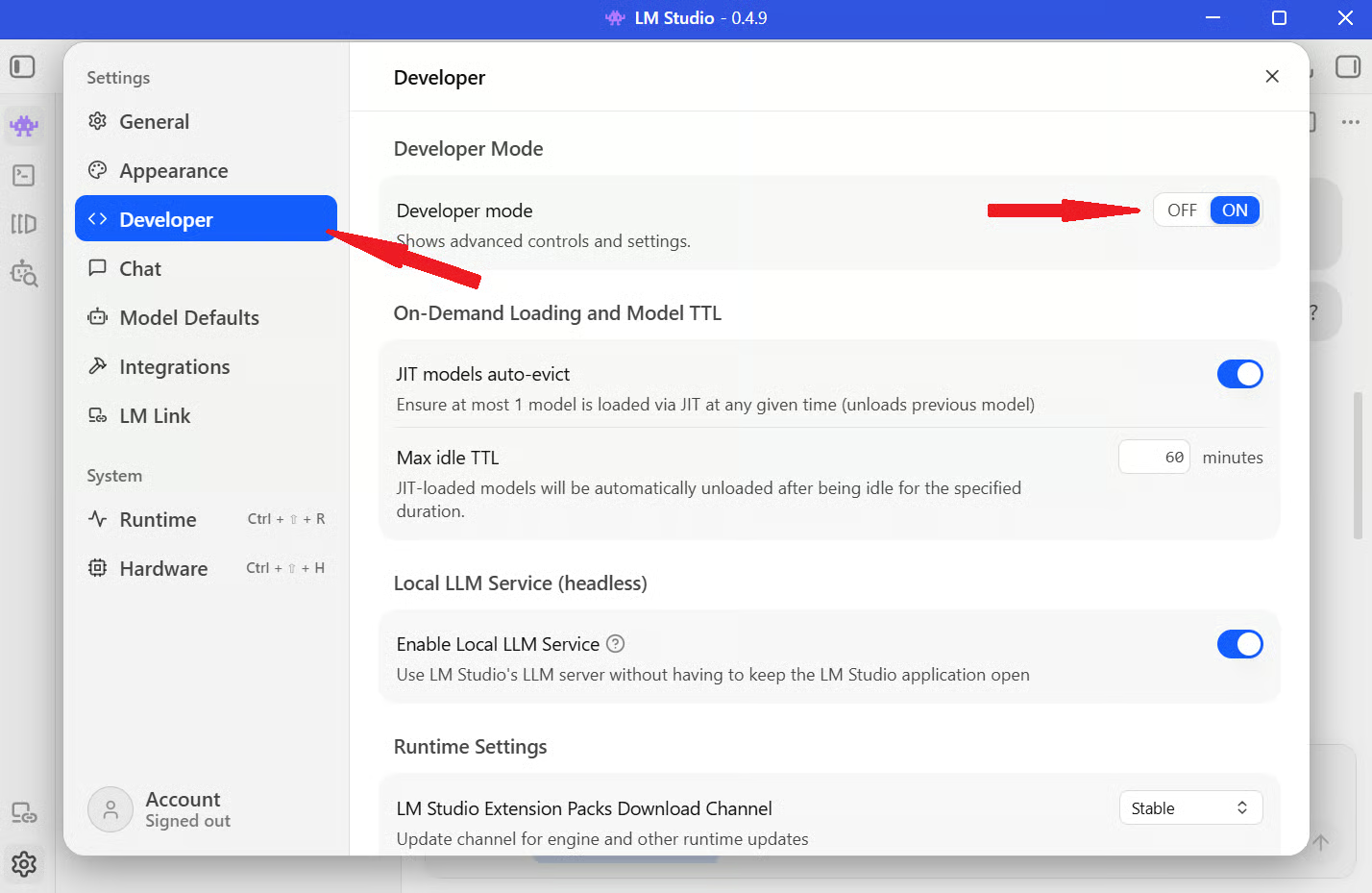

Passo 1: Para ativar isso, abra o LM Studio e clique no ícone de Settings no canto inferior esquerdo da tela.

Passo 2: Vá até a seção Developer na barra lateral esquerda e ative a opção Developer Mode.

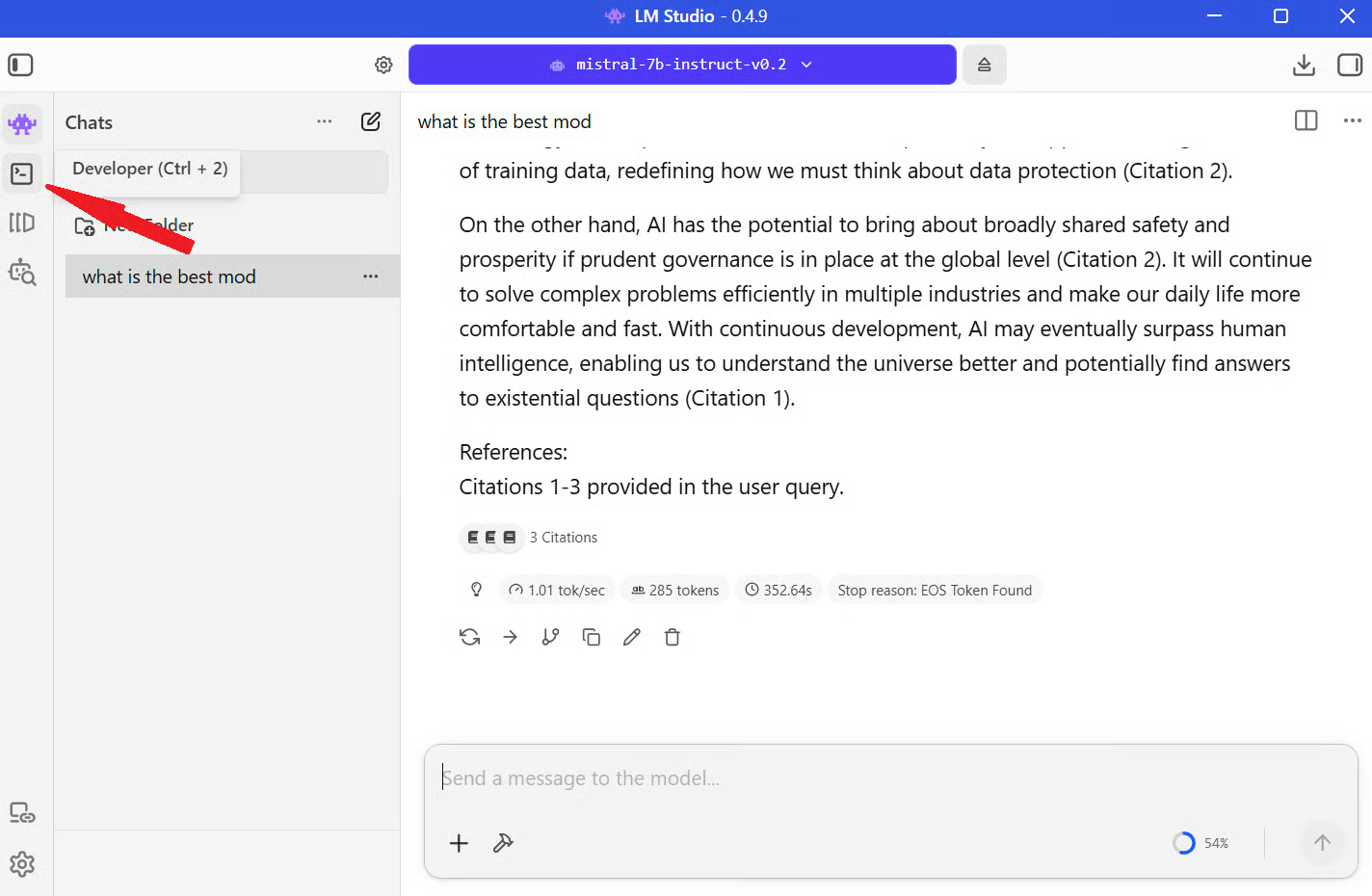

Passo 3: Volte para a interface de chat e clique no ícone Developer na barra lateral esquerda.

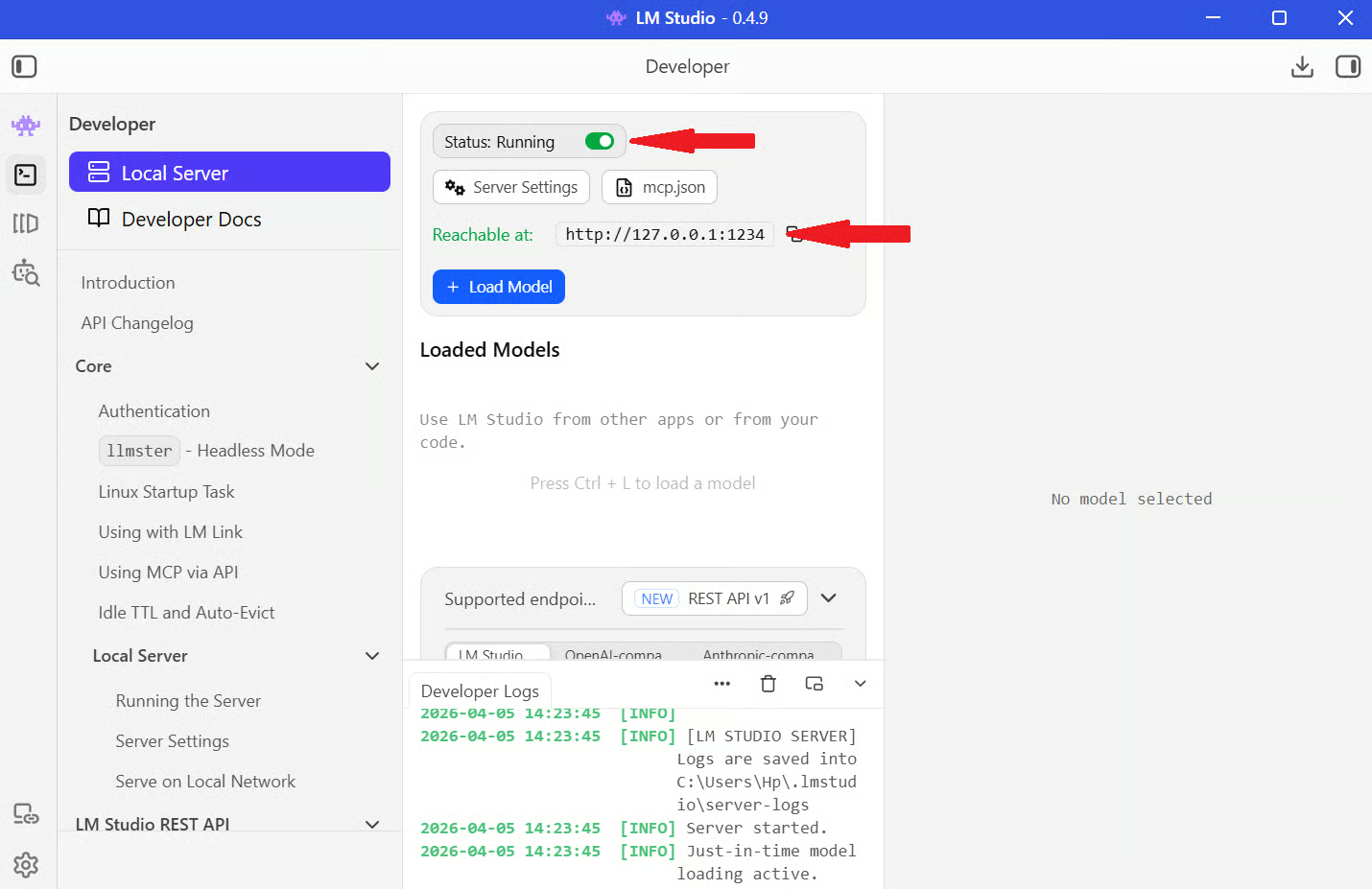

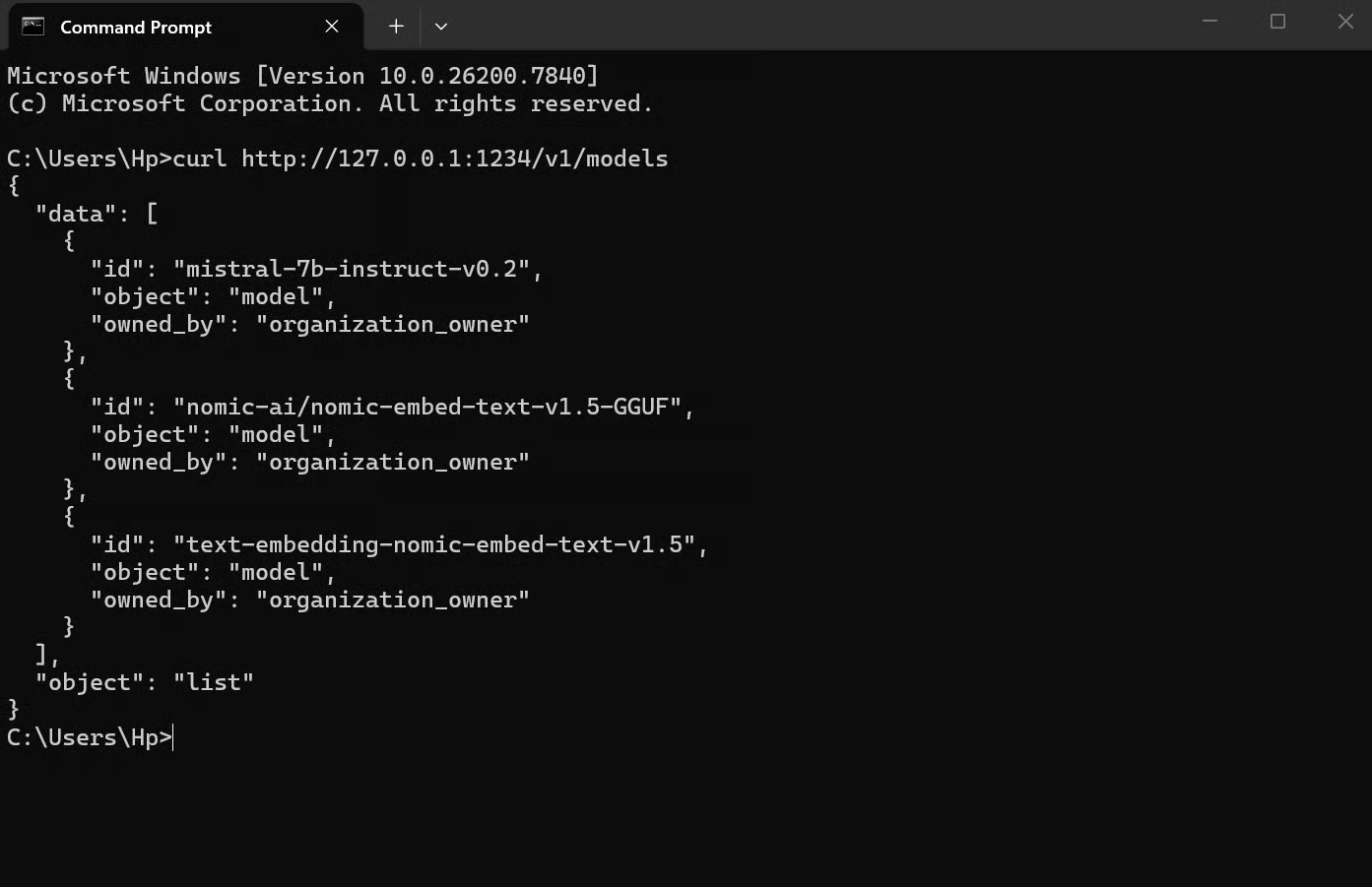

Passo 4: Ative a chave ao lado de Status para iniciar o servidor, como na imagem abaixo. Com ele rodando, copie o endereço do servidor e teste com um curl simples:

curl http://127.0.0.1:1234/v1/models

Se tudo estiver certo, você verá uma resposta em JSON listando o(s) modelo(s) disponível(is).

Conectando a partir do Python

Com o servidor local rodando, você o trata como qualquer outra API. A única diferença é que, em vez de chamar os servidores da OpenAI, você chama a sua própria máquina.

Um exemplo simples:

from openai import OpenAI

client = OpenAI(base_url="http://localhost:1234/v1", api_key="lm-studio")

response = client.chat.completions.create(

model="local-model",

messages=[

{"role": "user", "content": "Explain how local LLMs work"}

],

)

print(response.choices[0].message.content)O que está acontecendo aqui:

-

base_urlindica ao código para usar seu servidor local do LM Studio em vez da OpenAI -

api_keypode ser qualquer coisa (o LM Studio não exige) -

modelse refere ao modelo que você carregou no LM Studio -

messagesé o seu prompt

Ao executar, sua requisição vai para “localhost:1234”, o modelo processa e você recebe a resposta, como em qualquer chamada de API. Isso funciona porque o LM Studio segue o formato da API da OpenAI.

Conclusão

O LM Studio oferece uma interface limpa e prática para trabalhar com LLMs localmente, com controle total do ambiente. Você escolhe os modelos, ajusta as configurações, conversa com eles e ainda pode estender a configuração para rodar como um servidor de API local.

O destaque é que, antes, rodar LLMs localmente exigia muita configuração e ferramentas. O LM Studio reduz isso a algo mais próximo de instalar e usar um app de desktop comum.

Se quiser avançar, o próximo passo é integrar esses modelos a fluxos de trabalho reais. Explore cursos como Working with the OpenAI API ou trilhas mais amplas de fundamentos de IA para entender como estruturar prompts, criar aplicações e trabalhar com modelos com eficiência.

Perguntas frequentes sobre o LM Studio

O LM Studio é gratuito?

Sim, o LM Studio é gratuito para baixar e usar. Não há mensalidades, limites de uso nem recursos essenciais bloqueados.

O LM Studio funciona totalmente offline?

Sim, depois de baixar um modelo, tudo roda localmente. Você só precisa de internet para baixar modelos do Hugging Face.

Posso usar o LM Studio nas minhas aplicações?

Sim, o LM Studio pode rodar como um servidor de API local compatível com o formato da API da OpenAI. Isso permite conectá-lo a scripts, apps ou outras ferramentas na sua máquina.

O LM Studio lida com imagens?

Sim, mas apenas com modelos com visão. Se você carregar um modelo multimodal como LLaVA ou Qwen-VL, dá para enviar imagens e fazer perguntas sobre elas. Modelos apenas de texto não aceitam imagens.

Quanta RAM eu preciso para rodar LLMs localmente?

Depende do tamanho do modelo. 8GB rodam modelos menores, 16GB atendem muitos casos de uso, e 32GB ou mais geralmente são necessários para modelos grandes.

Srujana é redatora freelancer de tecnologia e tem um diploma de quatro anos em Ciência da Computação. Escrever sobre vários tópicos, incluindo ciência de dados, computação em nuvem, desenvolvimento, programação, segurança e muitos outros, é algo natural para ela. Ela gosta de literatura clássica e de explorar novos destinos.