programa

Ejecutar modelos de lenguaje grandes en local se ha vuelto cada vez más popular, sobre todo cuando no quieres enviar datos privados a servidores externos. Cuando todo funciona en tu equipo, tus prompts y tus datos se quedan en tu entorno, lo que te da más control y mejor privacidad.

Si quieres esa misma potencia, te explico cómo usar LM Studio para ejecutar y chatear con LLMs en local. Es una herramienta centrada en la interfaz gráfica, así que no necesitas experiencia con la terminal ni conocimientos técnicos profundos. La configuración es sencilla y puedes empezar en minutos. ¡Vamos a ello!

Si te interesa ejecutar herramientas de agentes en local, te recomiendo echar un vistazo a nuestros tutoriales para configurar OpenClaw y Claude Code con Ollama, respectivamente.

¿Qué es LM Studio?

LM Studio es una aplicación multiplataforma que te permite descargar y ejecutar modelos de lenguaje grandes en local en tu equipo para que tus datos no salgan a servidores externos.

Incluye un navegador de modelos integrado donde puedes buscar, explorar y descargar modelos directamente desde Hugging Face. Puedes descargar prácticamente cualquier modelo que quieras, incluidas distintas versiones de DeepSeek, Llama, Gemma, Phi o Mistral. No necesitas ninguna configuración extra.

LM Studio también es una gran opción para principiantes, especialmente si no te manejas cómodo con la línea de comandos. Te ofrece una interfaz muy intuitiva donde puedes elegir un modelo, ajustar la configuración y ponerte a chatear al instante.

También puedes subir archivos locales y chatear con ellos: LM Studio puede adjuntar archivos .docx, .pdf y .txt a las sesiones de chat. Si un documento cabe en el contexto, se añade completo; si es muy largo, LM Studio puede usar retrieval-augmented generation (RAG) para extraer información relevante de esos archivos y responder a tus preguntas.

Como LM Studio es multiplataforma, funciona sin problemas en Windows, Mac y Linux, así que no estás limitado por tu configuración. Y cuando superas lo básico, puedes hacer aún más. Puedes conectar tus LLMs locales a herramientas externas, fuentes de datos y APIs integrando servidores MCP, lo que le da suficiente flexibilidad para flujos de trabajo avanzados.

LM Studio vs Ollama

LM Studio y Ollama están pensados para ejecutar y chatear con modelos de lenguaje grandes en local. Sin embargo, hay algunas diferencias clave:

|

Función |

LM Studio |

Ollama |

|

Interfaz |

Primero GUI, interfaz fácil de usar |

Primero CLI, interfaz basada en terminal |

|

RAG integrado |

Sí, sin configuración adicional |

Requiere herramientas externas |

|

Compatibilidad MCP |

Integrada |

Limitada / no nativa |

|

Descarga de modelos |

Acceso a Hugging Face desde la app |

Mediante comandos como |

|

Facilidad de configuración |

Muy amigable para principiantes |

Cierta curva de aprendizaje si eres nuevo en CLI |

Requisitos de sistema de LM Studio y elección de modelo

Antes de empezar a descargar modelos en LM Studio, conviene entender qué puede soportar realmente tu sistema. El modelo que elijas depende directamente de tu RAM disponible, y elegir mal puede ralentizarlo todo o volver la app inutilizable.

Una tabla rápida con modelos adecuados según la RAM disponible:

|

RAM |

Qué puedes ejecutar con comodidad |

|

8GB |

Modelos pequeños (1B–4B) |

|

16GB |

Modelos medianos (7B–9B) |

|

32GB+ |

Modelos más grandes (13B en adelante) |

La GPU es opcional, pero marca una diferencia notable. Si tienes una, las respuestas del modelo serán mucho más rápidas y fluidas. Las GPUs de NVIDIA con soporte CUDA funcionan mejor, Apple Silicon usa Metal de forma eficaz y AMD tiene soporte parcial según la configuración.

Cómo elegir el modelo adecuado para tu hardware

Aquí tienes algunas recomendaciones prácticas para elegir un modelo que realmente funcione bien en tu equipo sin forzarlo.

|

RAM/VRAM |

Modelos recomendados |

|

8GB |

Qwen 2.5 3B / 4B, Phi-3 Mini (3.8B), Gemma 2 2B |

|

16GB |

Llama 3 8B, Gemma 2 9B, Mistral 7B, Qwen 2.5 7B |

|

24GB |

Llama 3.1 8B (quant de mayor calidad), Mixtral 8x7B (cuantizado), Qwen 2.5 14B |

|

32GB+ |

Llama 3.1 70B (fuertemente cuantizado), Qwen 2.5 32B, variantes de Mixtral (mejores configuraciones) |

También verás diferentes versiones del mismo modelo con etiquetas como Q4_K_M o Q8_0. Esto se refere a los niveles de cuantización, que básicamente indican cómo se comprime el modelo. Una cuantización más baja, como Q4, reduce el uso de memoria y va más rápido, pero pierdes algo de calidad. Una cuantización más alta, como Q8, mantiene mejor calidad de salida, pero requiere más RAM y va más lenta.

Si tienes dudas, Q4 o Q5 suele ser un buen punto de partida, especialmente con una configuración de 16GB como la mía.

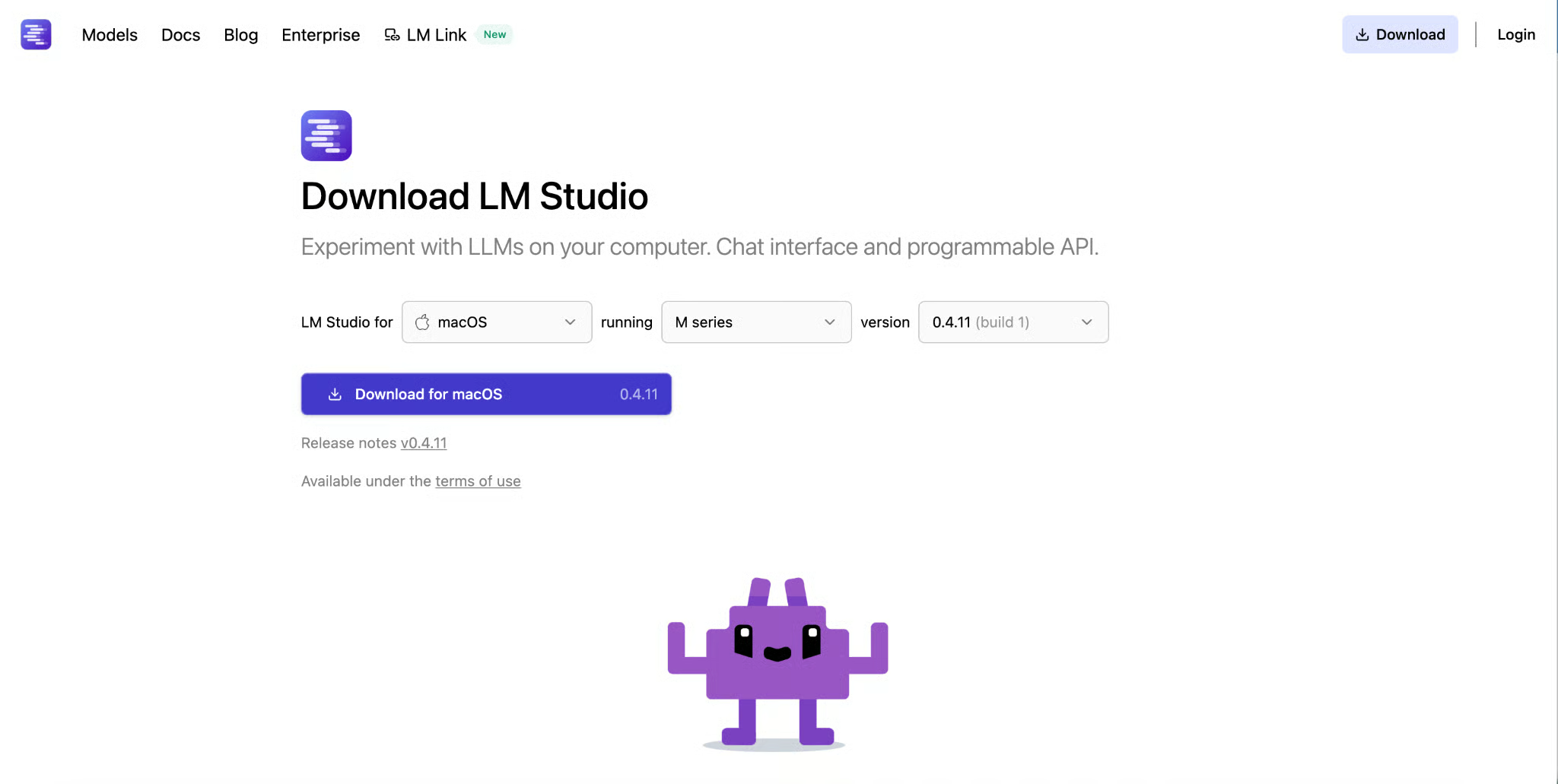

Instalar LM Studio

Para empezar con LM Studio, ve al sitio web oficial y descarga la app. La web detecta automáticamente tu sistema operativo y te ofrece la versión correspondiente.

Puede que te pida permisos según la configuración de tu sistema. En mi caso, en Mac, estuvo disponible como aplicación nada más abrir el instalador descargado.

Puede que te pida permisos según la configuración de tu sistema. En mi caso, en Mac, estuvo disponible como aplicación nada más abrir el instalador descargado.

Descargar tu primer modelo en LM Studio

Cuando abras LM Studio por primera vez, verás una interfaz limpia con el explorador de modelos. Puedes buscar modelos al momento, explorar opciones disponibles y empezar a descargar uno para ejecutarlo en local.

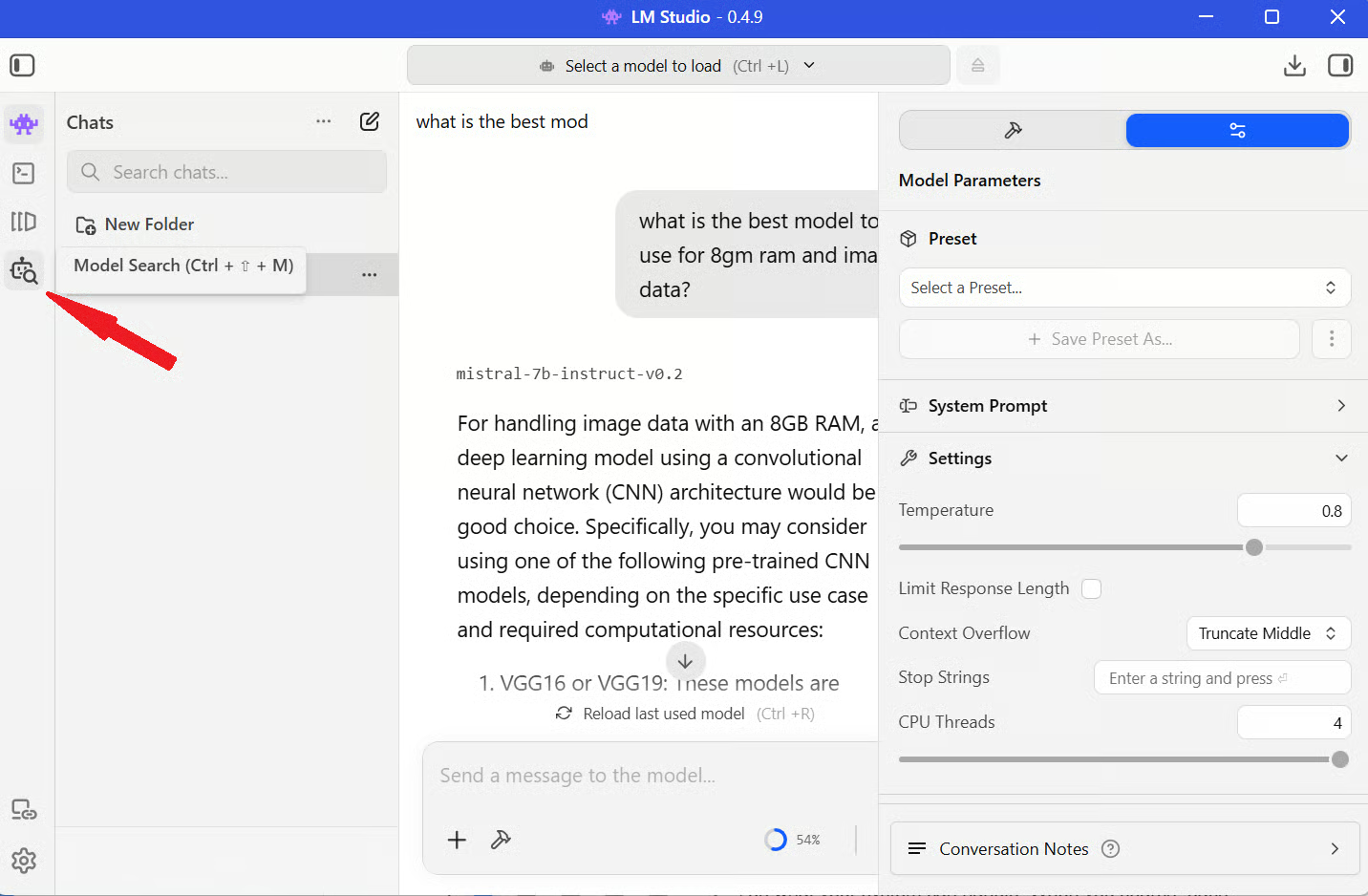

Explorar la pestaña Discover

Abre LM Studio y haz clic en el icono de búsqueda de la barra lateral izquierda.

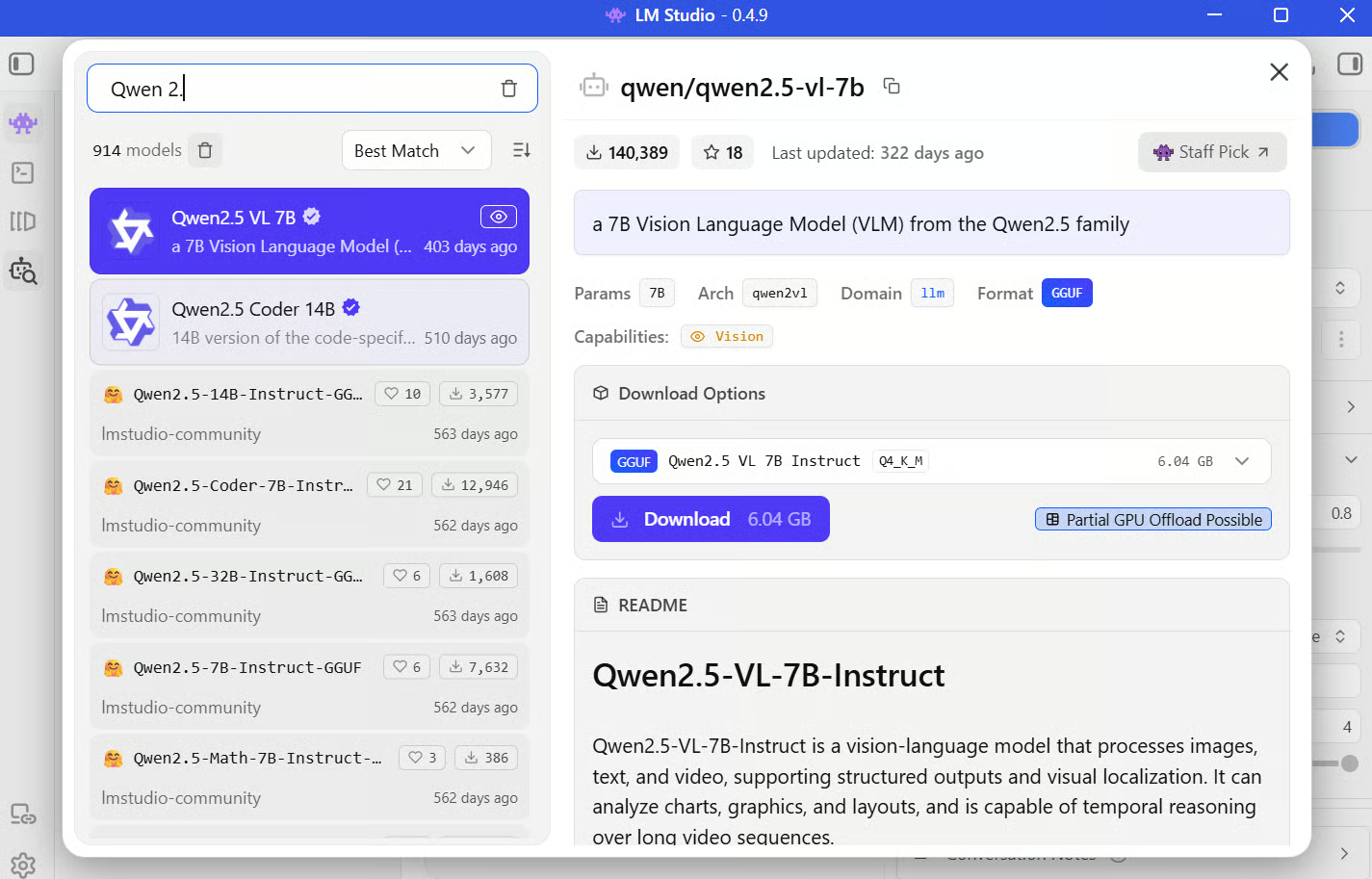

Básicamente es tu mercado de modelos, donde puedes buscar modelos concretos, filtrar por tamaño y explorar distintas opciones. Al buscar, cada modelo viene con una tarjeta informativa que te da contexto útil como tamaño, capacidades y, a veces, casos de uso recomendados. Merece la pena echarle un vistazo antes de descargar para saber qué esperar.

Si sigues el tutorial y quieres un punto de partida fiable, elige alguno como Qwen 2.5 7B (Q4_K_M) para un sistema de 16GB (o toma una de las sugerencias que hice arriba). Ofrece un buen equilibrio entre rendimiento y calidad, y funciona fluido sin forzar tu equipo.

Entender los formatos de modelo

Mientras navegas, verás que la mayoría de modelos están disponibles en formato GGUF. GGUF, de GPT-Generated Unified Format, es un formato binario para almacenar y ejecutar LLMs de forma eficiente en hardware de consumo.

Este formato mapea los pesaos de alta precisión (p. ej., Float16) de los modelos a enteros de menos bits (p. ej., 4-bit, 5-bit) y empaqueta los pesos, metadatos y configuración en un único archivo optimizado. Facilita la carga y garantiza compatibilidad con motores de inferencia como llama.cpp, en el que se apoya LM Studio por debajo.

Chatear con un LLM local en LM Studio

Vamos a la parte interesante: poner el modelo en marcha.

Cargar un modelo y configurar parámetros

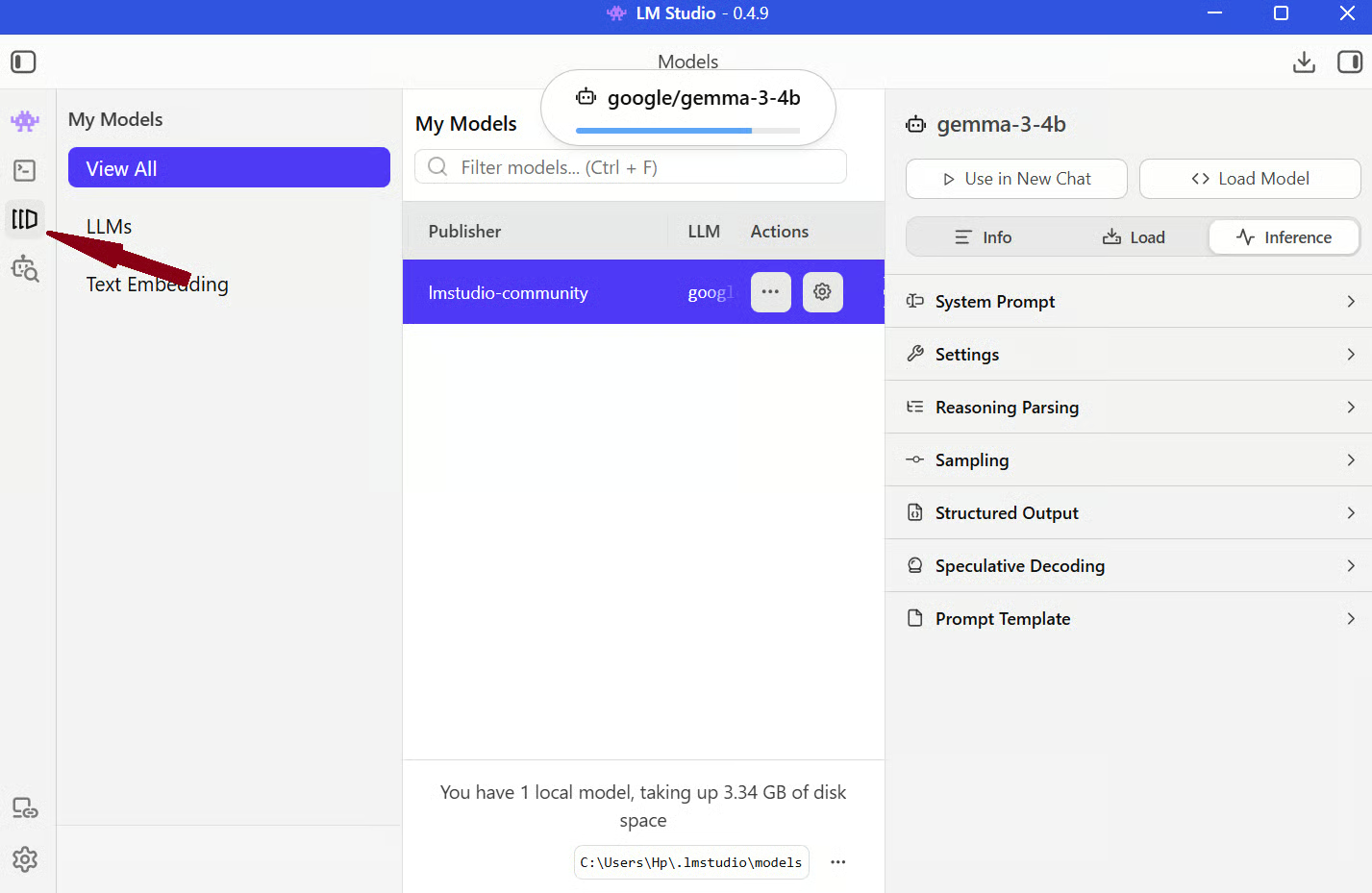

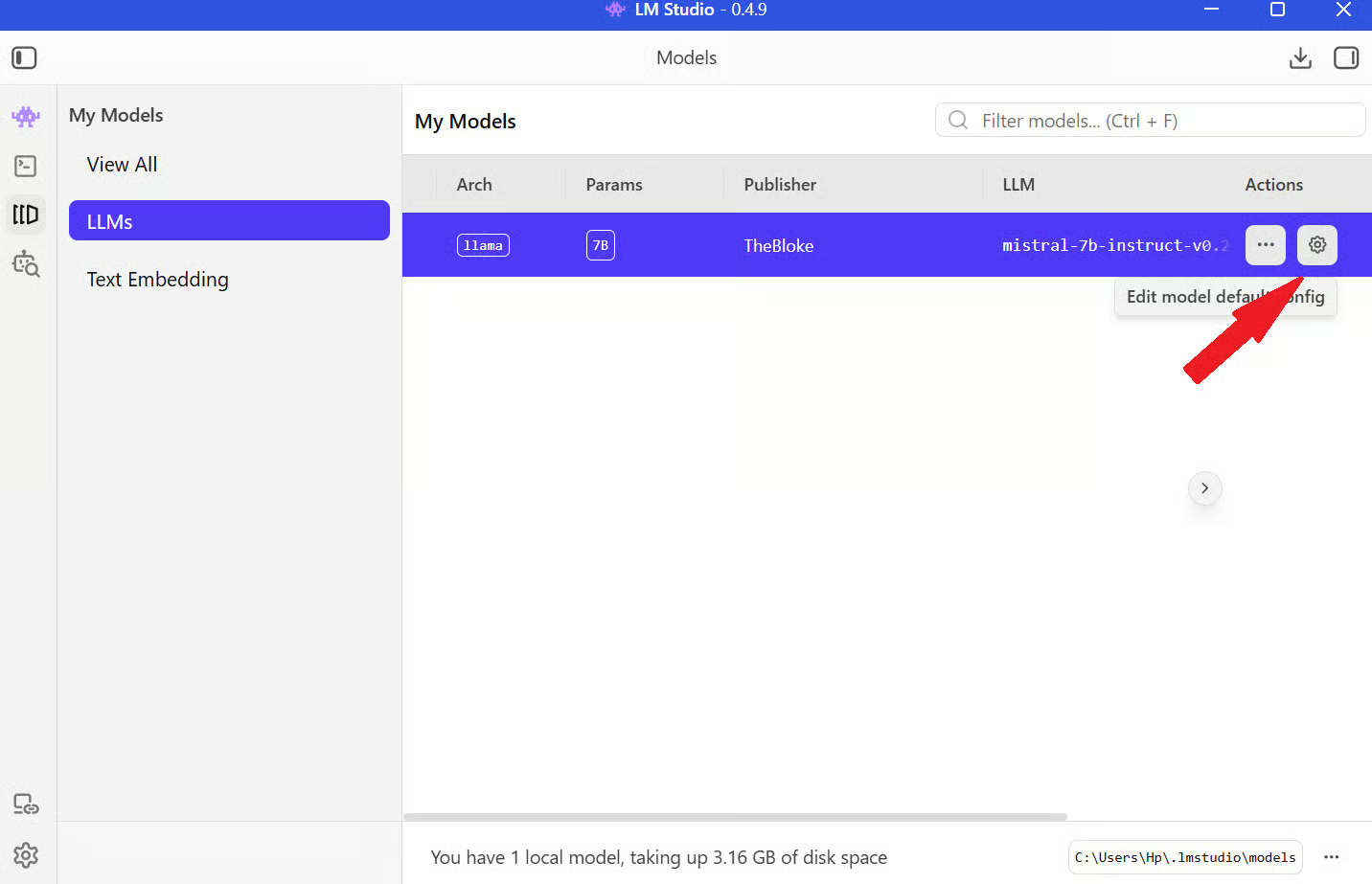

Paso 1: abre LM Studio y ve a la sección My Models desde el menú de la izquierda.

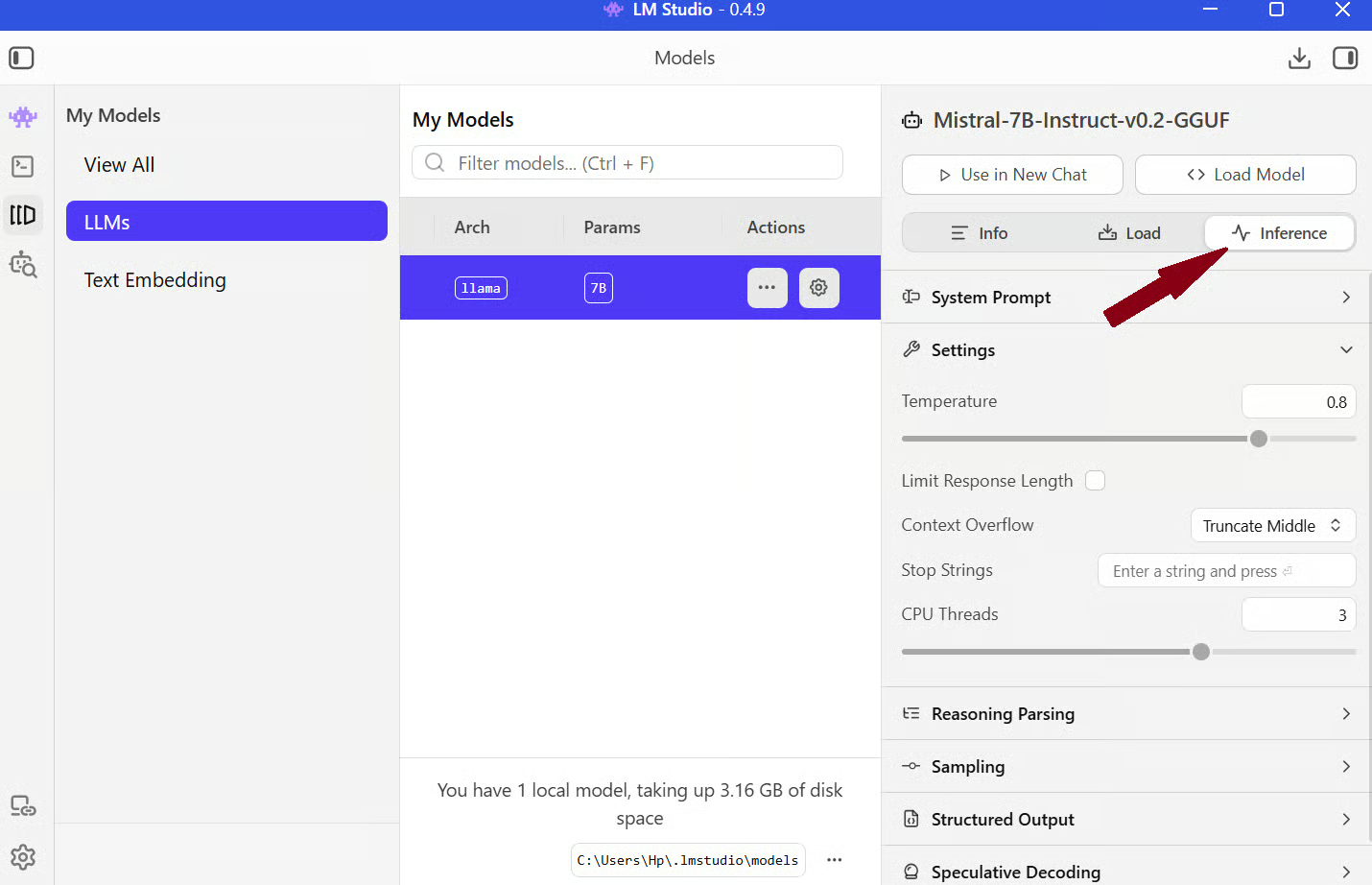

Paso 2: haz clic en el icono de Settings del modelo y luego en Load Model.

Una vez cargado, ve a la pestaña Inference en la misma pantalla; verás controles para la longitud de contexto, la temperatura y más.

- Context length controla cuánta información puede recordar el modelo durante una conversación. Un valor alto te permite trabajar con entradas más largas, pero también usa más memoria. Si vas justo de RAM, mejor mantenlo moderado.

- Temperature controla lo creativo o predecible que es el modelo. Valores bajos hacen respuestas más deterministas; valores altos, más variadas.

- System prompt define el comportamiento del modelo. Aquí marcas cómo debe responder el asistente, incluido tono, estilo y rol.

Tu primera conversación

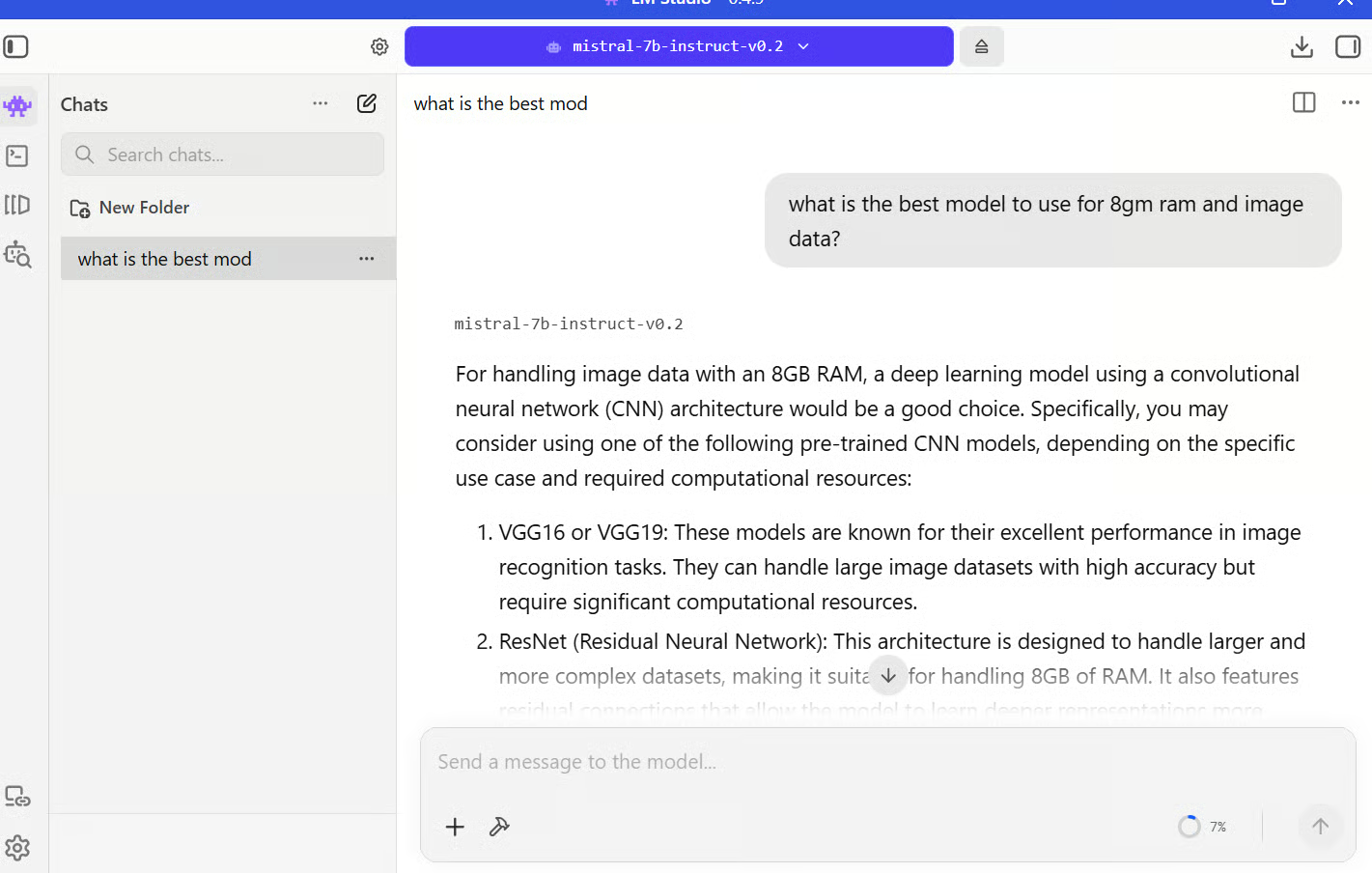

Cuando todo esté listo, puedes empezar a chatear con el modelo como con cualquier asistente de IA. Aquí va un ejemplo sencillo:

Le pedí: «¿Cuál es el mejor modelo para usar con 8GB de RAM y datos de imagen?»

El modelo sugirió usar un modelo con arquitectura de red neuronal convolucional (CNN), como se muestra en la imagen.

Ese es el flujo básico. La calidad de las respuestas depende mucho de tu configuración. Por ejemplo, si en el system prompt indicas «Explica todo en términos sencillos y con respuestas cortas», el modelo se mantiene coherente con ese estilo en varias respuestas.

Chatear con tus documentos en LM Studio

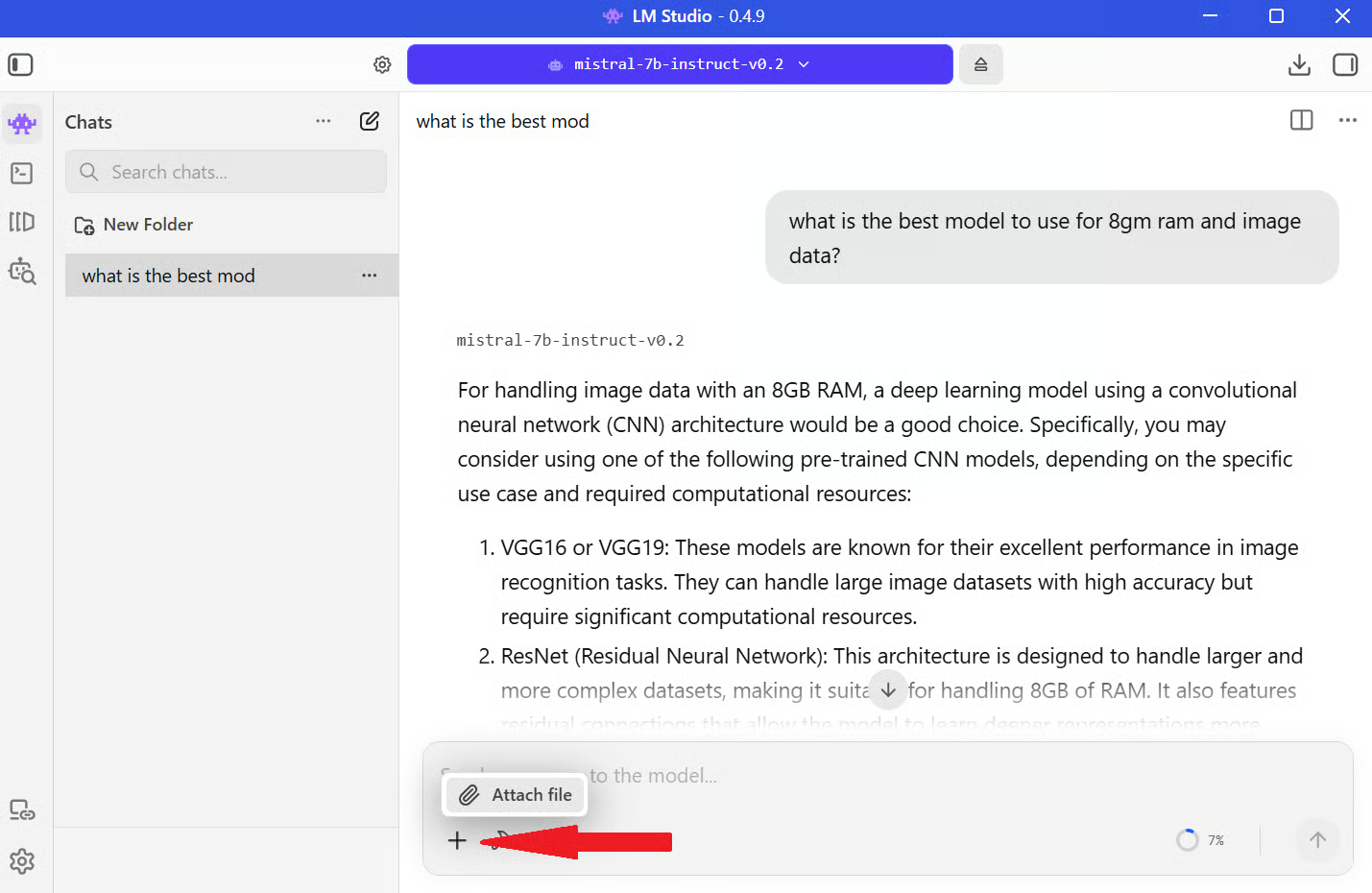

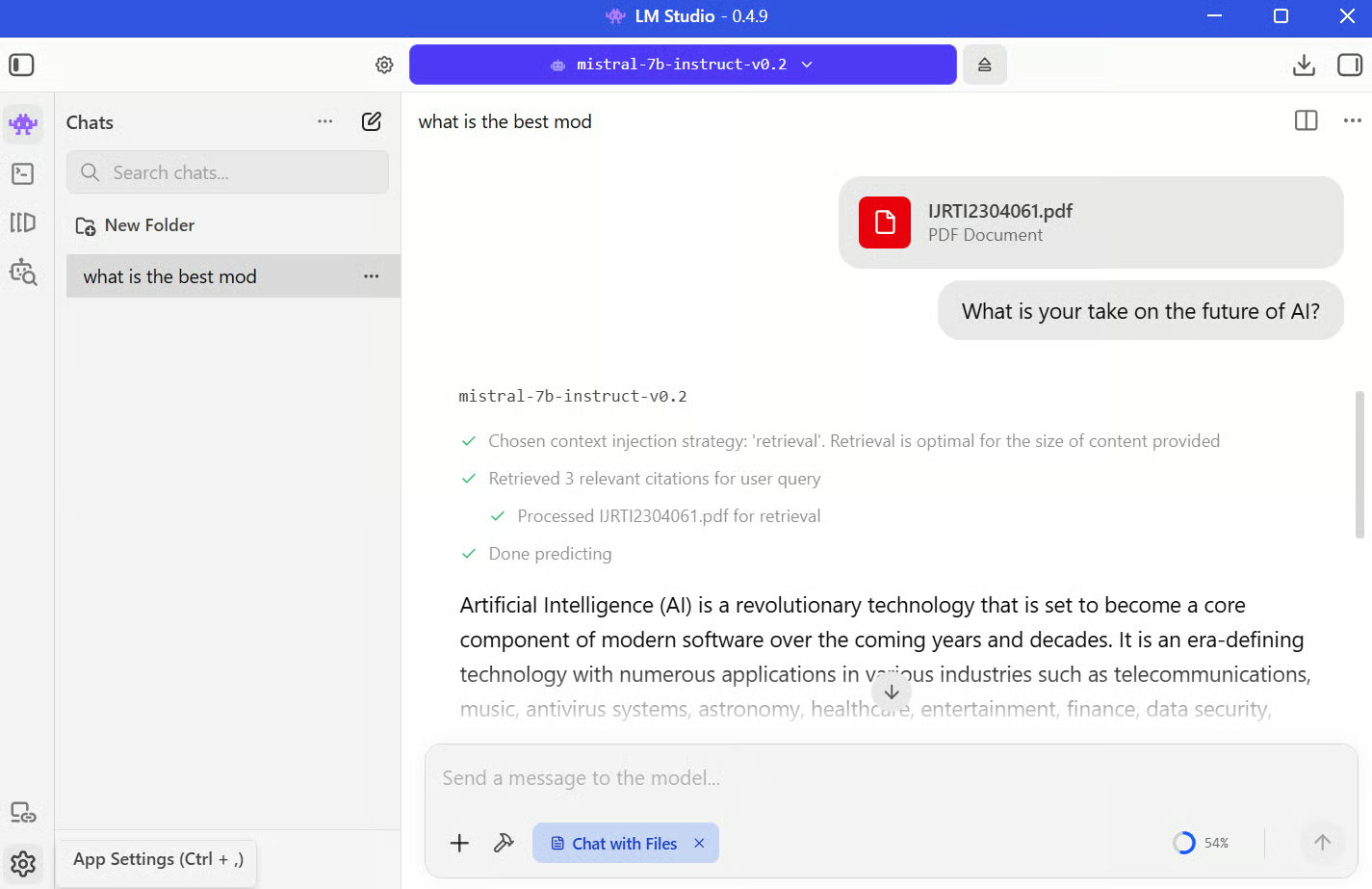

Una de las funciones más útiles de LM Studio es su soporte de RAG integrado. Puedes subir documentos directamente al chat y empezar a hacer preguntas.

Configurar preguntas y respuestas con documentos

Para empezar, abre una sesión de chat con el modelo cargado. Verás un icono de + para adjuntar archivos. Haz clic para subir PDFs o archivos de texto directamente en el chat.

Una vez añadido el archivo, LM Studio lo prepara automáticamente para las consultas, así que no tienes que configurar nada a mano. Por debajo, el documento se divide en fragmentos más pequeños para que el modelo trabaje con ellos de forma eficiente. Estos fragmentos se convierten en embeddings, que son representaciones numéricas del texto.

Cuando haces una pregunta, LM Studio recupera los fragmentos más relevantes y se los pasa al modelo junto con tu consulta. Así, el modelo recibe información extra de tus documentos y responde en consecuencia.

Consultar tu base de conocimiento

Por ejemplo, subí un artículo de investigación sobre inteligencia artificial y pregunté: «¿Cuál es tu opinión sobre el futuro de la IA?»

LM Studio extrae las secciones más relevantes del documento y se las envía al modelo junto con tu prompt. El modelo genera una respuesta basada tanto en ese contexto como en su conocimiento previo.

Esto mismo lo puedes ver de forma visual en la imagen siguiente:

Hay algunas limitaciones a tener en cuenta. El modelo sigue dependiendo de su ventana de contexto, por lo que los documentos muy grandes pueden no considerarse al completo de una vez. La calidad de la recuperación también depende de cómo se fragmente el documento, así que algunas respuestas pueden pasar por alto detalles si no se recuperan bien las secciones relevantes.

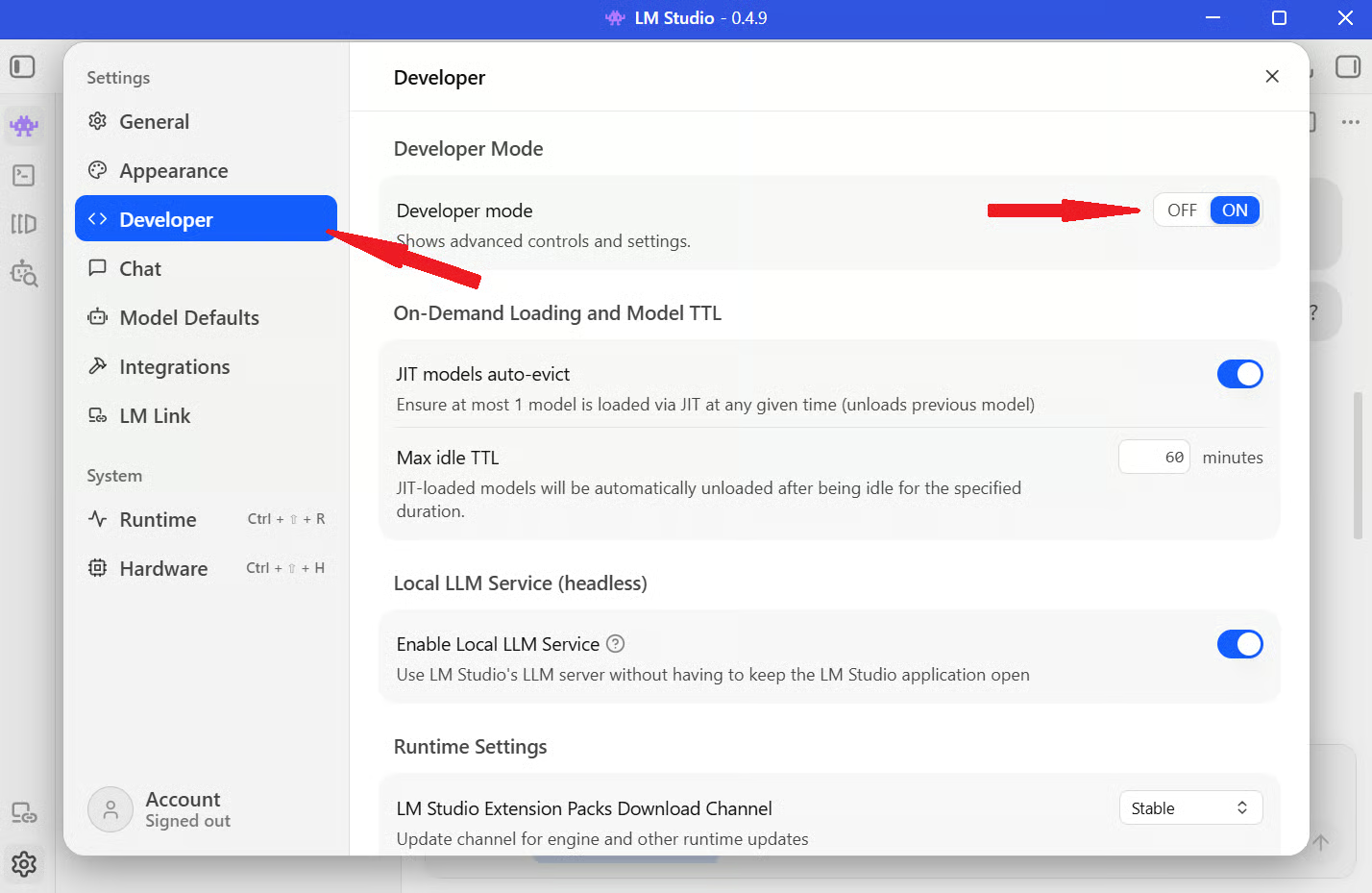

Ejecutar LM Studio como servidor de API local

Una de las funciones más potentes de LM Studio es ejecutarlo como servidor de API local. Esto te permite usar tu LLM local en scripts, apps u otras herramientas.

Iniciar el servidor

Paso 1: para activarlo, abre LM Studio y haz clic en el icono de Settings en la esquina inferior izquierda.

Paso 2: ve a la sección Developer en la barra lateral izquierda y activa el conmutador de Developer Mode.

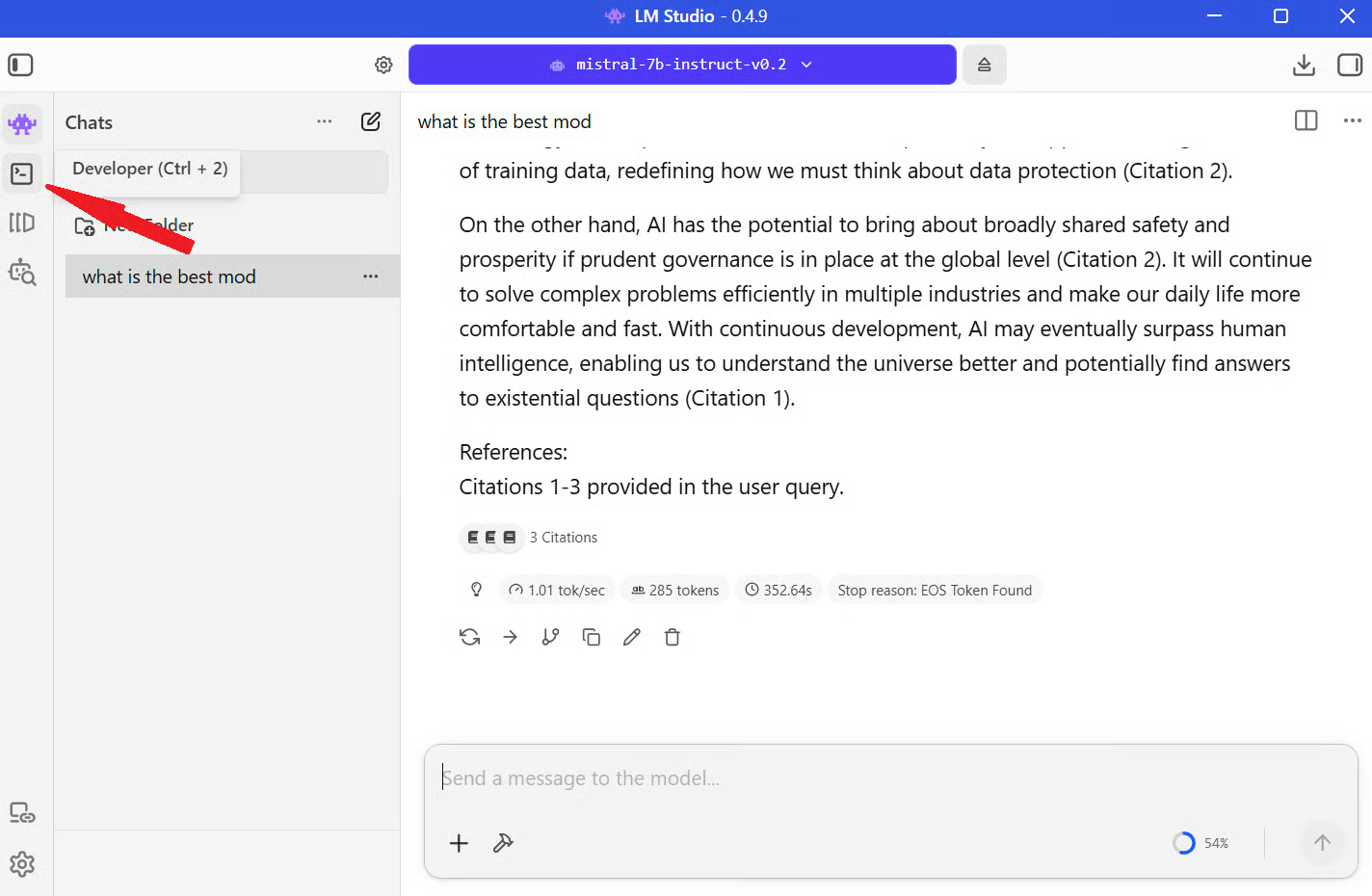

Paso 3: vuelve a la interfaz de chat y haz clic en el icono de Developer de la barra lateral izquierda.

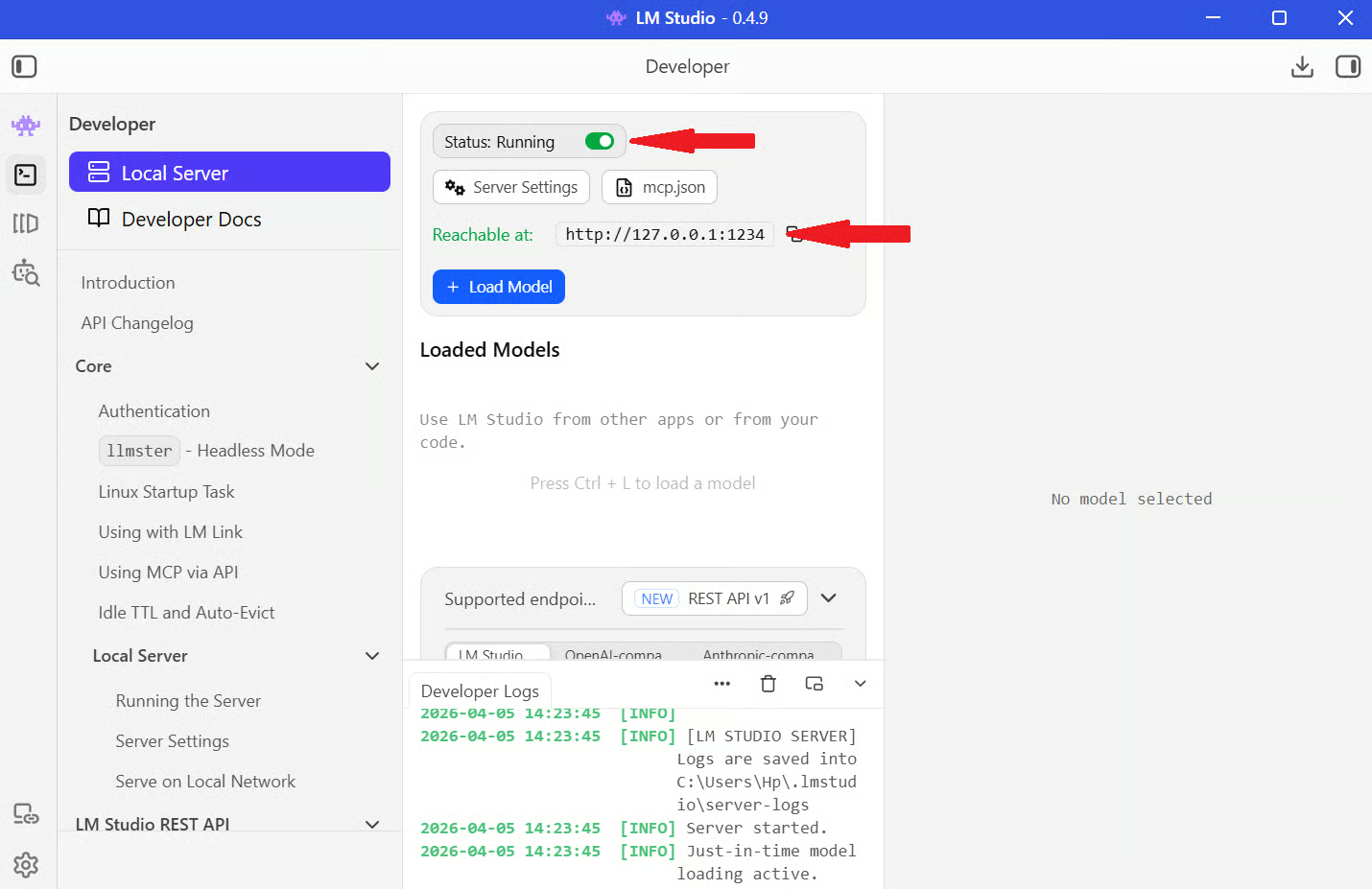

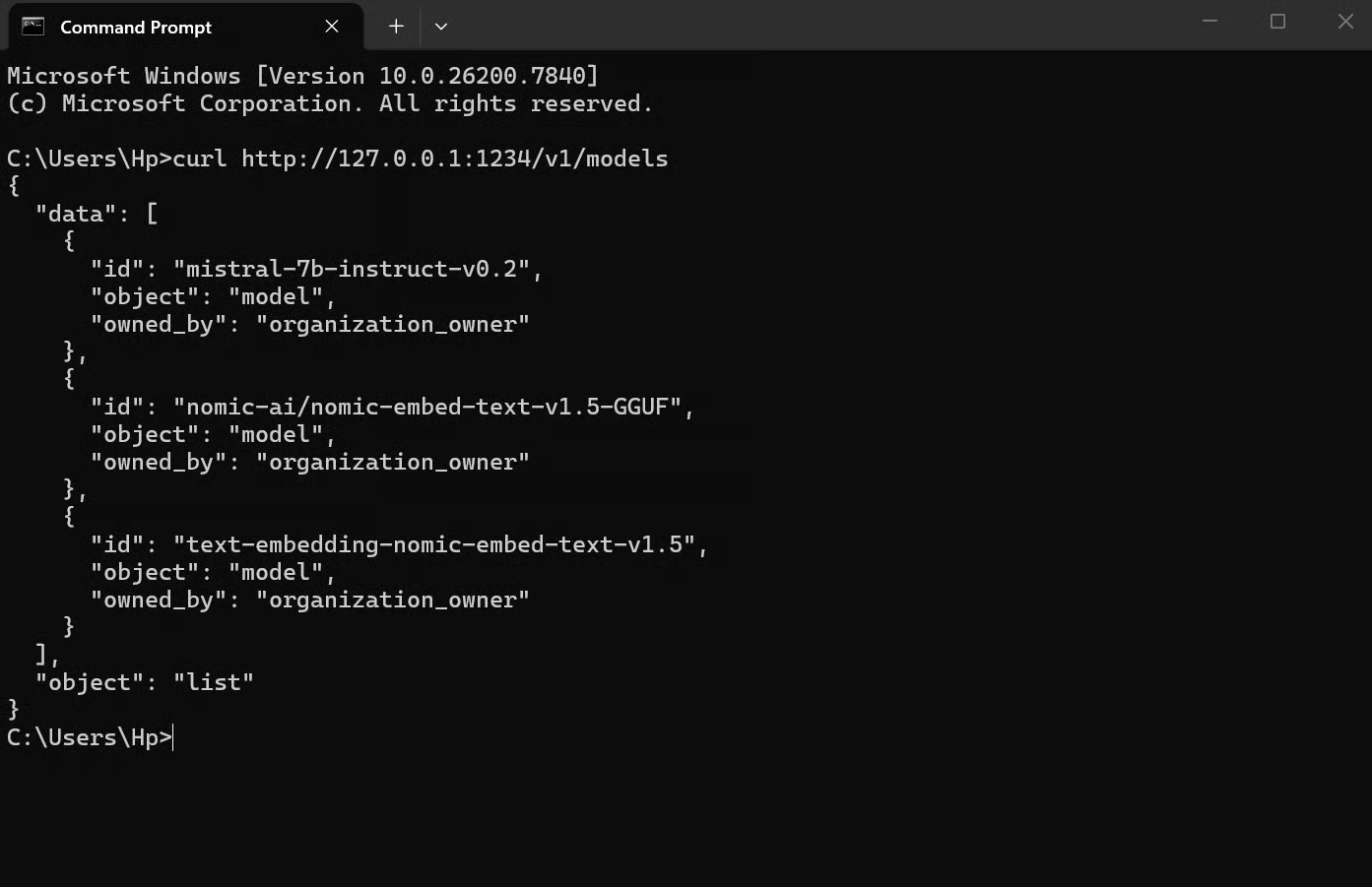

Paso 4: activa el conmutador junto a Status para iniciar el servidor, como en la imagen. Una vez en marcha, puedes copiar la dirección del servidor y probarla con una simple solicitud curl:

curl http://127.0.0.1:1234/v1/models

Si todo está bien configurado, verás una respuesta JSON con el listado del modelo disponible.

Conectar desde Python

Una vez que tu servidor local esté funcionando, puedes tratarlo como cualquier otra API. La única diferencia es que, en lugar de llamar a los servidores de OpenAI, llamas a tu propia máquina.

Aquí tienes un ejemplo sencillo:

from openai import OpenAI

client = OpenAI(base_url="http://localhost:1234/v1", api_key="lm-studio")

response = client.chat.completions.create(

model="local-model",

messages=[

{"role": "user", "content": "Explain how local LLMs work"}

],

)

print(response.choices[0].message.content)Qué está pasando aquí:

-

base_urlle dice al código que use tu servidor local de LM Studio en lugar de OpenAI -

api_keypuede ser cualquier cosa (LM Studio no la exige) -

modelse refiere al modelo que cargaste en LM Studio -

messageses tu prompt

Al ejecutar esto, tu solicitud va a «localhost:1234», el modelo la procesa y recibes una respuesta, como en cualquier llamada a una API. Esto funciona porque LM Studio sigue el formato de la API de OpenAI.

Conclusión

LM Studio te ofrece una interfaz limpia y práctica para trabajar con LLMs en local, con control total del entorno. Puedes seleccionar los modelos, ajustar la configuración, chatear con ellos e incluso ampliar el montaje para ejecutarlo como servidor de API local.

Lo más destacable es que antes ejecutar modelos de lenguaje grandes en local implicaba mucho montaje y herramientas. LM Studio reduce todo eso a algo más parecido a instalar y usar una app de escritorio normal.

Si quieres ir un paso más allá, el siguiente nivel es aprender a integrar estos modelos en flujos de trabajo reales. Puedes explorar cursos como Working with the OpenAI API o itinerarios más amplios de fundamentos de IA para entender cómo estructurar prompts, crear aplicaciones y trabajar con modelos de forma efectiva.

Preguntas frecuentes sobre LM Studio

¿LM Studio es gratuito?

Sí, LM Studio se puede descargar y usar gratis. No hay cuotas de suscripción, límites de uso ni funciones básicas detrás de un muro de pago.

¿LM Studio funciona completamente sin conexión?

Sí, una vez que descargas un modelo, todo funciona en local. Solo necesitas conexión a internet para descargar modelos desde Hugging Face.

¿Puedo usar LM Studio en mis propias aplicaciones?

Sí, LM Studio puede ejecutarse como servidor de API local que sigue el formato de la API de OpenAI. Esto significa que puedes conectarlo a scripts, aplicaciones u otras herramientas que se ejecuten en tu equipo.

¿LM Studio puede manejar imágenes?

Sí, pero solo con modelos con visión. Si cargas un modelo multimodal como LLaVA o Qwen-VL, puedes subir imágenes y hacer preguntas sobre ellas. Los modelos estándar solo de texto no admiten entradas de imagen.

¿Cuánta RAM necesito para ejecutar LLMs en local?

Depende del tamaño del modelo. Con 8GB puedes manejar modelos pequeños; 16GB es suficiente para muchos casos de uso, pero 32GB o más suelen ser necesarios para modelos grandes.

Srujana es una redactora técnica autónoma con una licenciatura de cuatro años en Informática. Escribir sobre diversos temas, como la ciencia de datos, la computación en la nube, el desarrollo, la programación, la seguridad y muchos otros, le resulta natural. Le encanta la literatura clásica y explorar nuevos destinos.