Lernpfad

Große Sprachmodelle lokal auszuführen wird immer beliebter – vor allem, wenn du keine privaten Daten an externe Server senden willst. Läuft alles auf deinem Rechner, bleiben Prompts und Daten in deiner Umgebung. Das gibt dir mehr Kontrolle und bessere Privatsphäre.

Wenn du genau das willst, zeige ich dir, wie du mit LM Studio LLMs lokal startest und mit ihnen chattest. Das Tool ist GUI-first, du brauchst also weder Terminal-Erfahrung noch tiefes Technikwissen. Die Einrichtung ist unkompliziert und du legst schnell los. Los geht’s!

Wenn du agentische Tools lokal betreiben möchtest, schau dir auch unsere Tutorials zur Einrichtung von OpenClaw und Claude Code mit Ollama an.

Was ist LM Studio?

LM Studio ist eine plattformübergreifende Anwendung, mit der du große Sprachmodelle lokal auf deinem Rechner herunterladen und ausführen kannst, sodass keine Daten an externe Server abfließen.

Mit dem integrierten Model-Browser kannst du Modelle direkt von Hugging Face suchen, durchsuchen und herunterladen. Du kannst praktisch jedes gewünschte Modell beziehen – etwa verschiedene Versionen von DeepSeek, Llama, Gemma, Phi oder Mistral. Du brauchst dafür keine zusätzliche Einrichtung.

LM Studio ist auch ideal für Einsteigerinnen und Einsteiger, besonders wenn du dich mit der Kommandozeile nicht wohlfühlst. Über die benutzerfreundliche Oberfläche wählst du ein Modell, passt die Konfiguration an und kannst direkt loschatten.

Du kannst auch lokale Dateien hochladen und mit ihnen chatten: LM Studio kann .docx-, .pdf- und .txt-Dateien an Chats anhängen. Wenn ein Dokument in den Kontext passt, wird es komplett eingebunden. Ist es sehr lang, kann LM Studio per Retrieval-Augmented Generation (RAG) relevante Informationen daraus ziehen, um deine Fragen zu beantworten.

Da LM Studio plattformübergreifend ist, läuft es reibungslos auf Windows, Mac und Linux – unabhängig von deiner Umgebung. Und über die Basics hinaus geht noch mehr: Du kannst deine lokalen LLMs über die Integration von MCP-Servern mit externen Tools, Datenquellen und APIs verbinden – flexibel genug für fortgeschrittene Workflows.

LM Studio vs. Ollama

LM Studio und Ollama sind beide dafür gedacht, große Sprachmodelle lokal auszuführen und mit ihnen zu chatten. Es gibt jedoch ein paar wesentliche Unterschiede:

|

Funktion |

LM Studio |

Ollama |

|

Interface |

GUI-first, benutzerfreundliche Oberfläche |

CLI-first, terminalbasiertes Interface |

|

Integriertes RAG |

Ja, keine Extra-Einrichtung nötig |

Erfordert externe Tools |

|

MCP-Support |

Integriert |

Begrenzt / nicht nativ |

|

Modelldownloads |

Zugriff auf Hugging Face aus der App |

Über Befehle wie |

|

Einrichtung |

Sehr einsteigerfreundlich |

Leichte Lernkurve, wenn du neu bei CLI bist |

LM Studio: Systemanforderungen und Modellauswahl

Bevor du in LM Studio Modelle herunterlädst, solltest du wissen, was dein System wirklich stemmen kann. Die Modellauswahl hängt direkt von deinem verfügbaren RAM ab. Die falsche Wahl kann alles ausbremsen oder die App unbenutzbar machen.

Eine schnelle Orientierungstabelle mit passenden Modellen für unterschiedliche RAM-Größen:

|

RAM |

Was du flüssig ausführen kannst |

|

8GB |

Kleine Modelle (1B–4B) |

|

16GB |

Mittlere Modelle (7B–9B) |

|

32GB+ |

Größere Modelle (13B und mehr) |

Eine GPU ist optional, aber sie macht einen spürbaren Unterschied. Mit GPU werden Modellantworten deutlich schneller und gleichmäßiger. NVIDIA-GPUs mit CUDA funktionieren am besten, Apple Silicon nutzt Metal effektiv, und AMD wird – je nach Setup – teilweise unterstützt.

So wählst du das passende Modell für deine Hardware

Hier sind ein paar praxisnahe Tipps, um ein Modell zu wählen, das auf deinem Rechner gut läuft, ohne ihn zu überfordern.

|

RAM/VRAM |

Empfohlene Modelle |

|

8GB |

Qwen 2.5 3B / 4B, Phi-3 Mini (3.8B), Gemma 2 2B |

|

16GB |

Llama 3 8B, Gemma 2 9B, Mistral 7B, Qwen 2.5 7B |

|

24GB |

Llama 3.1 8B (höhere Quant-Qualität), Mixtral 8x7B (quantisiert), Qwen 2.5 14B |

|

32GB+ |

Llama 3.1 70B (stark quantisiert), Qwen 2.5 32B, Mixtral-Varianten (bessere Konfigurationen) |

Du wirst außerdem unterschiedliche Versionen desselben Modells mit Labels wie Q4_K_M oder Q8_0 sehen. Das bezieht sich auf Quantisierungsstufen, die angeben, wie stark ein Modell komprimiert ist. Niedrigere Quantisierung wie Q4 reduziert Speicherbedarf und beschleunigt die Ausführung, kostet aber Qualität. Höhere Quantisierung wie Q8 erhält die Qualität besser, benötigt jedoch mehr RAM und läuft langsamer.

Wenn du unsicher bist, sind Q4 oder Q5 meist ein guter Start – besonders auf einem 16GB-System wie meinem.

LM Studio installieren

Um loszulegen, geh auf die offizielle Website und lade die App herunter. Die Website erkennt dein Betriebssystem automatisch und bietet dir die passende Version an.

Je nach Systemeinstellungen musst du eventuell Berechtigungen erteilen. Auf meinem Mac war die App direkt nach dem Öffnen des Installers verfügbar.

Je nach Systemeinstellungen musst du eventuell Berechtigungen erteilen. Auf meinem Mac war die App direkt nach dem Öffnen des Installers verfügbar.

Dein erstes Modell in LM Studio herunterladen

Wenn du LM Studio zum ersten Mal öffnest, landest du in einer aufgeräumten Oberfläche mit dem Model-Browser. Du kannst sofort nach Modellen suchen, Optionen erkunden und ein Modell zum lokalen Ausführen herunterladen.

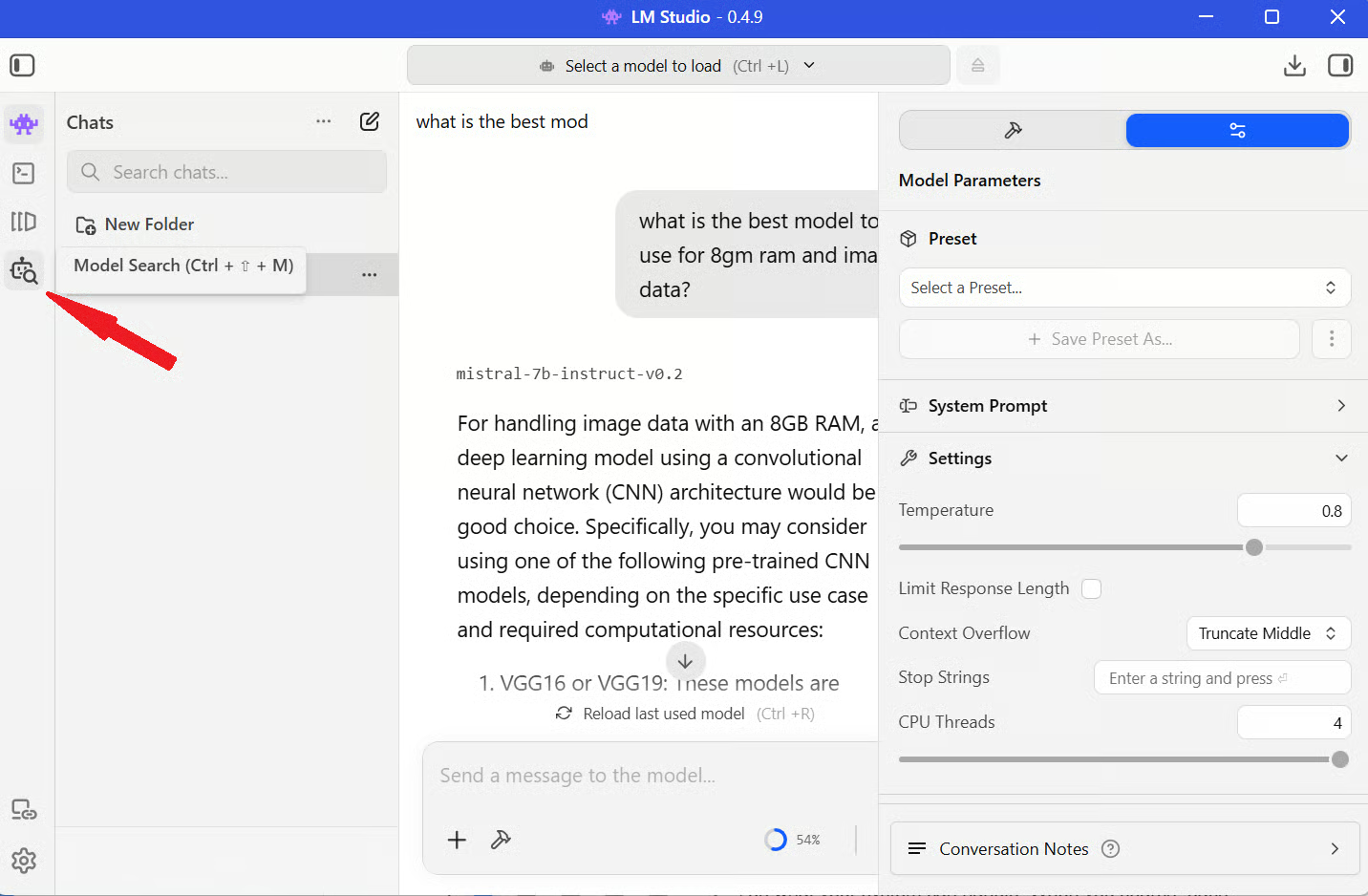

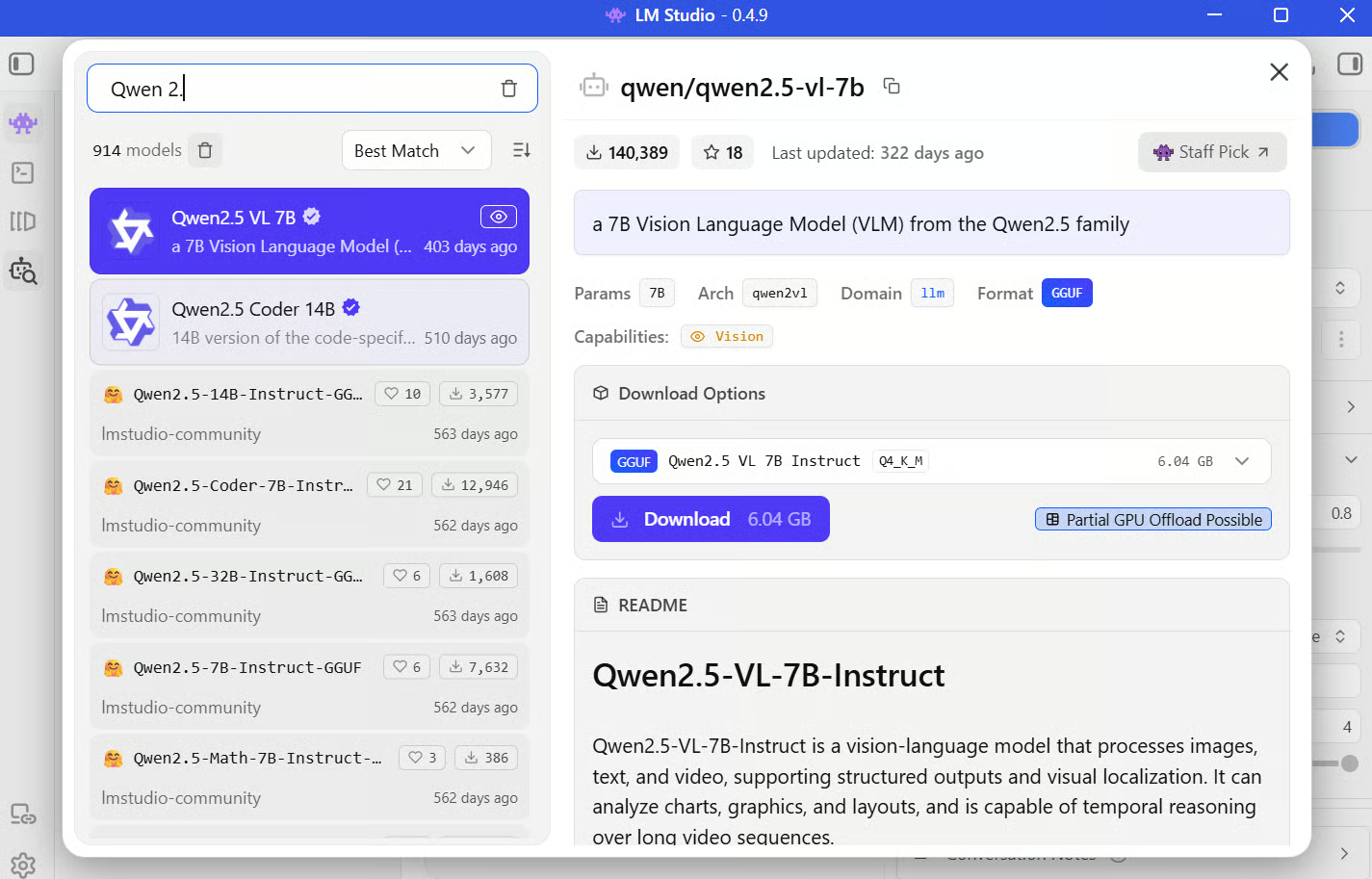

Den Discover-Tab durchsuchen

Öffne LM Studio und klicke in der linken Seitenleiste auf das Suchsymbol.

Das ist im Grunde dein Modell-Marktplatz: Du kannst gezielt suchen, nach Größe filtern und verschiedene Optionen vergleichen. Zu jedem Treffer gibt es eine Model Card mit nützlichem Kontext wie Größe, Fähigkeiten und manchmal empfohlenen Anwendungsfällen. Ein kurzer Blick lohnt sich vor dem Download, damit du weißt, was dich erwartet.

Wenn du mitmachen willst und einen soliden Startpunkt suchst, nimm etwas wie Qwen 2.5 7B (Q4_K_M) für ein 16GB-System (oder eine der obigen Empfehlungen). Das ist ein guter Kompromiss aus Performance und Qualität und läuft stabil, ohne deinen Rechner zu stressen.

Die Modellformate verstehen

Beim Stöbern siehst du, dass die meisten Modelle im GGUF-Format angeboten werden. GGUF steht für GPT-Generated Unified Format und ist ein Binärformat, um LLMs effizient auf Consumer-Hardware zu speichern und auszuführen.

Dieses Format mappt hochpräzise Gewichte (z. B. Float16) auf niedrigbitige Integer (z. B. 4-Bit, 5-Bit) und bündelt Model-Gewichte, Metadaten und Konfiguration in einer einzigen optimierten Datei. Das beschleunigt das Laden und sorgt für Kompatibilität mit Inferenz-Engines wie llama.cpp, auf die sich LM Studio unter der Haube stützt.

Mit einem lokalen LLM in LM Studio chatten

Kommen wir zum spannenden Teil und setzen das Modell ein.

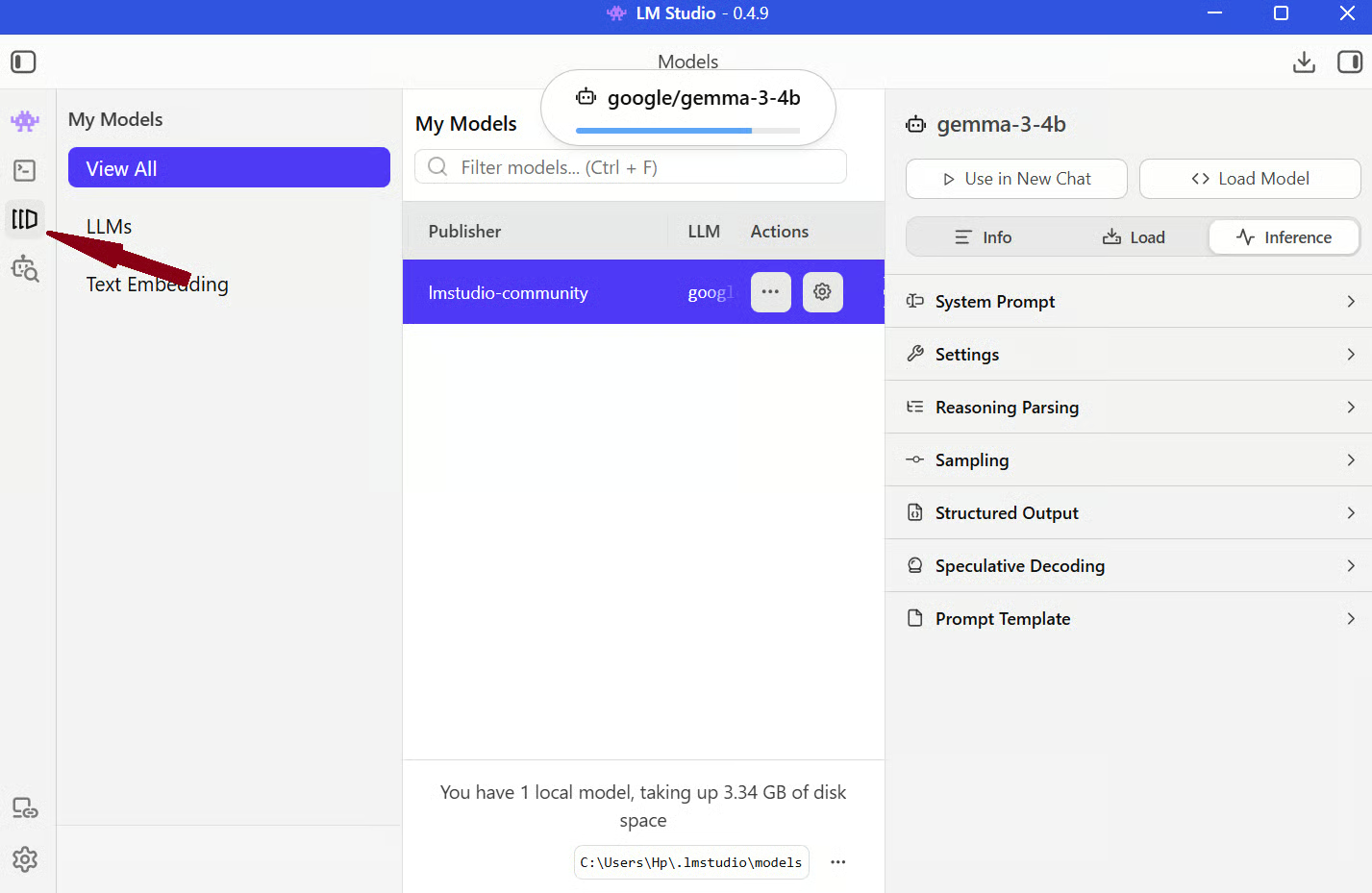

Ein Modell laden und Parameter konfigurieren

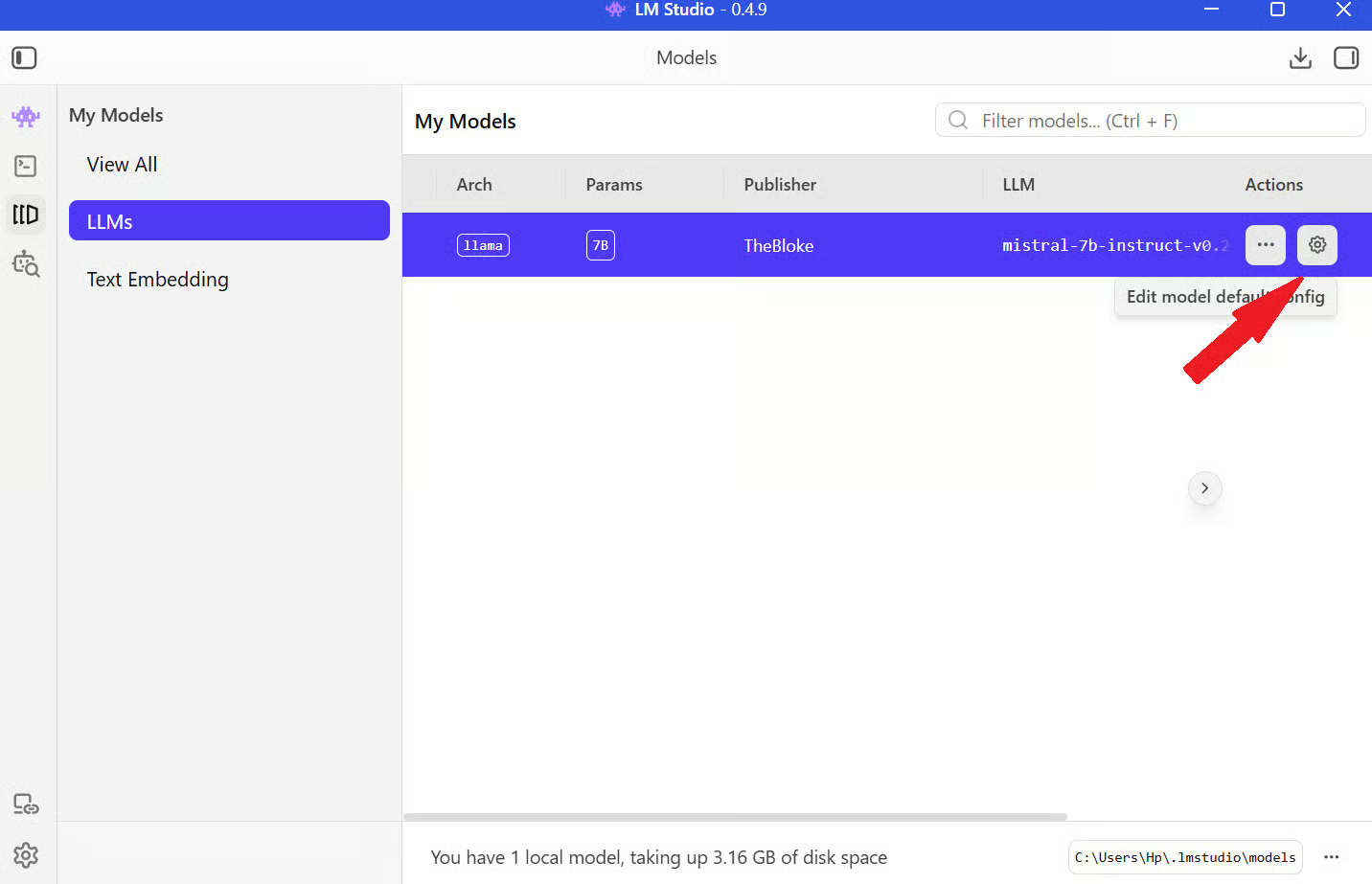

Schritt 1: Öffne LM Studio und wechsle im linken Menü zu My Models.

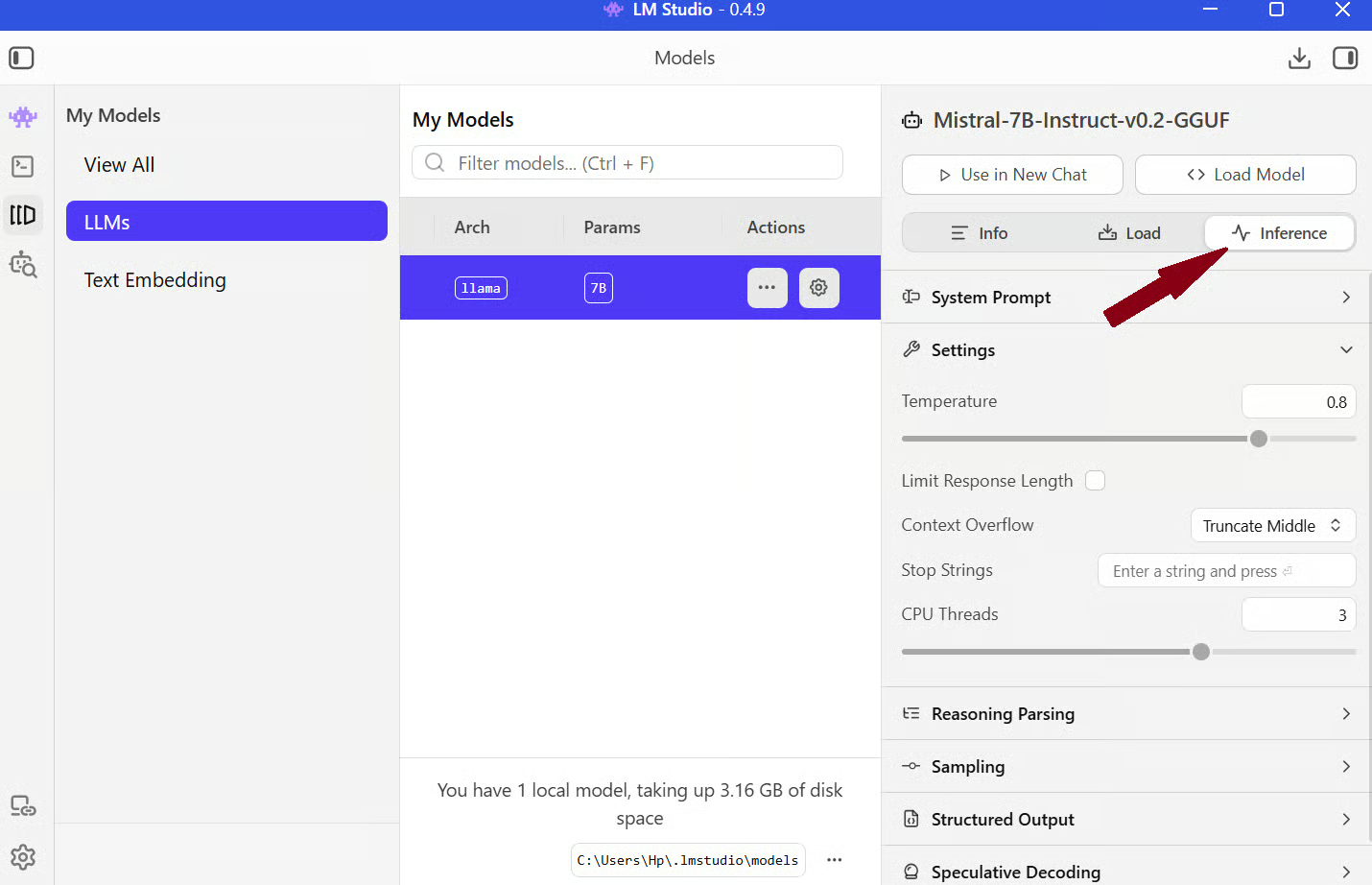

Schritt 2: Klicke beim Modell auf das Settings-Symbol und dann auf Load Model.

Sobald es geladen ist, wechsle auf derselben Seite zum Tab Inference. Dort findest du Regler für Kontextlänge, Temperatur und mehr.

- Kontextlänge steuert, wie viel das Modell während einer Unterhaltung „im Kopf behält“. Ein höherer Wert erlaubt längere Eingaben, benötigt aber mehr Speicher. Bei wenig RAM lieber moderat halten.

- Temperatur steuert, wie kreativ oder vorhersehbar das Modell antwortet. Niedrige Werte erzeugen deterministischere Antworten, höhere sorgen für mehr Varianz.

- System-Prompt legt das Verhalten des Modells fest. Hier definierst du Tonalität, Stil und Rolle der Assistenz.

Dein erstes Gespräch

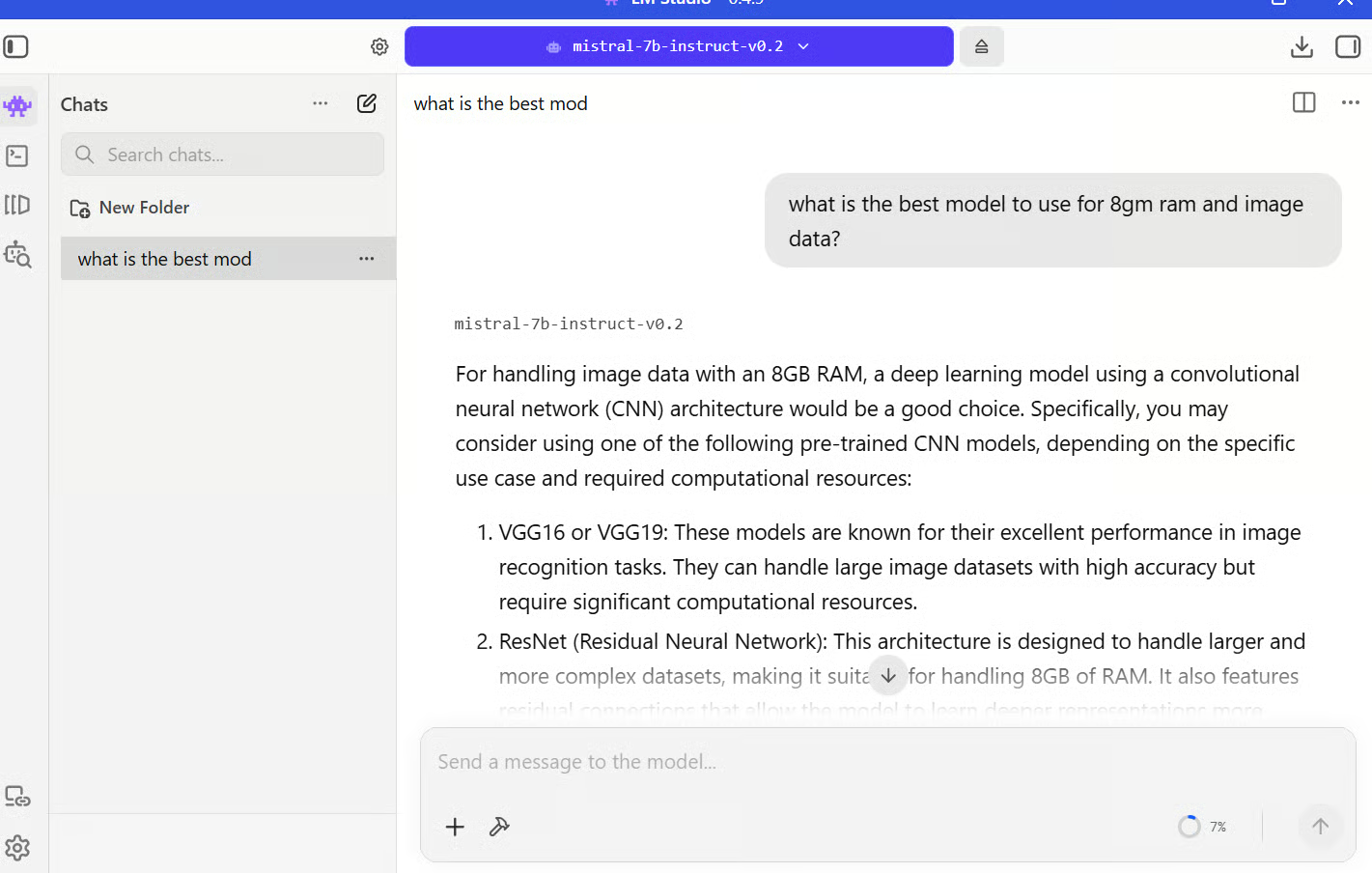

Sobald alles konfiguriert ist, kannst du mit dem Modell chatten wie mit jedem KI-Assistenten. Ein einfaches Beispiel:

Ich habe gefragt: „Welches ist das beste Modell für 8GB RAM und Bilddaten?“

Das Modell hat eine Architektur mit Convolutional Neural Network (CNN) empfohlen, wie im Bild zu sehen.

So sieht der Grundfluss aus. Die Antwortqualität hängt stark von deinen Einstellungen ab. Wenn du zum Beispiel im System-Prompt vorgibst: „Erkläre alles in einfachen Worten und mit kurzen Antworten“, bleibt das Modell über mehrere Antworten hinweg konsistent bei diesem Stil.

Mit deinen Dokumenten in LM Studio chatten

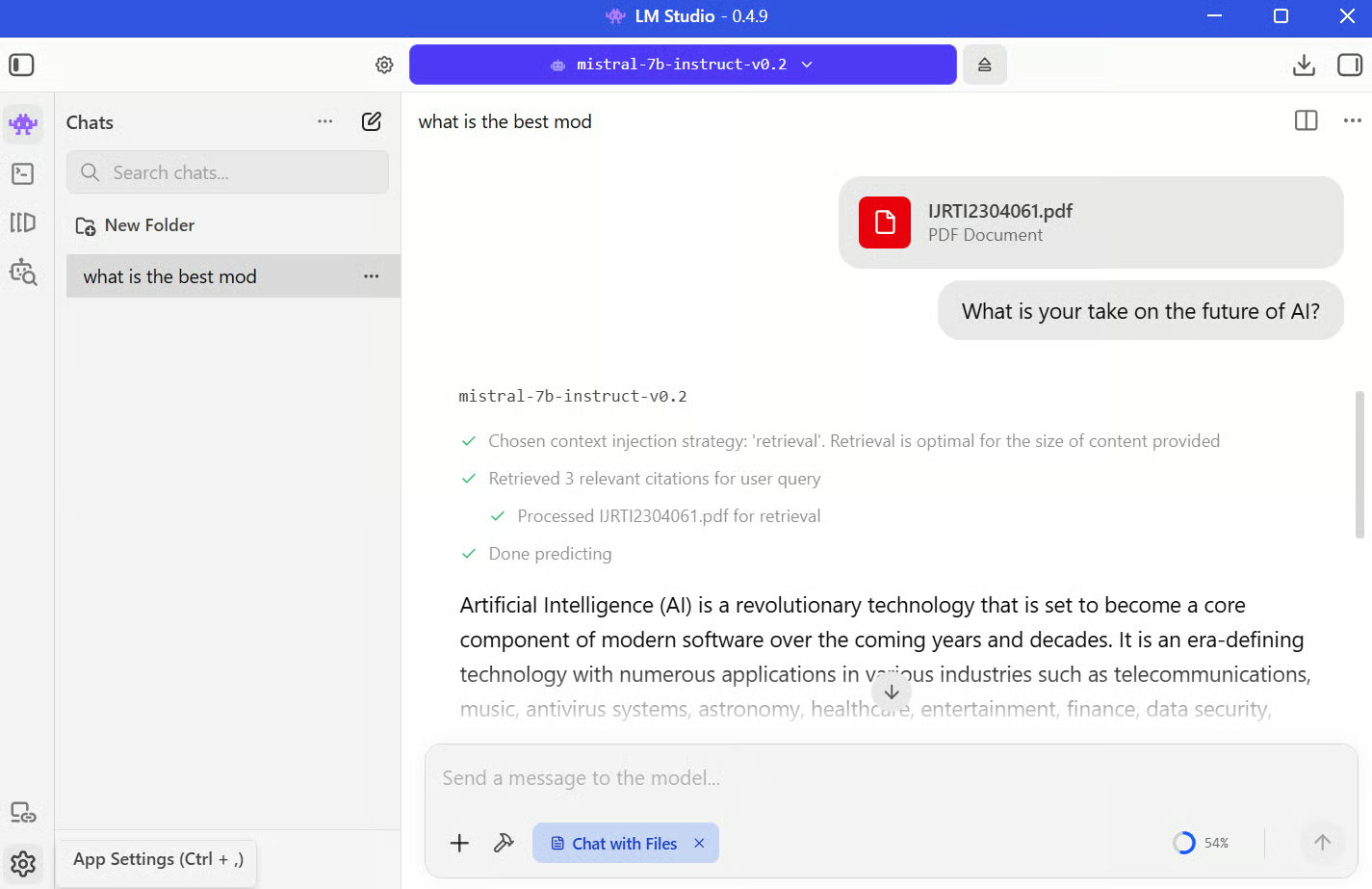

Eine der nützlichsten Funktionen in LM Studio ist die integrierte RAG-Unterstützung. Du kannst Dokumente direkt in den Chat hochladen und Fragen dazu stellen.

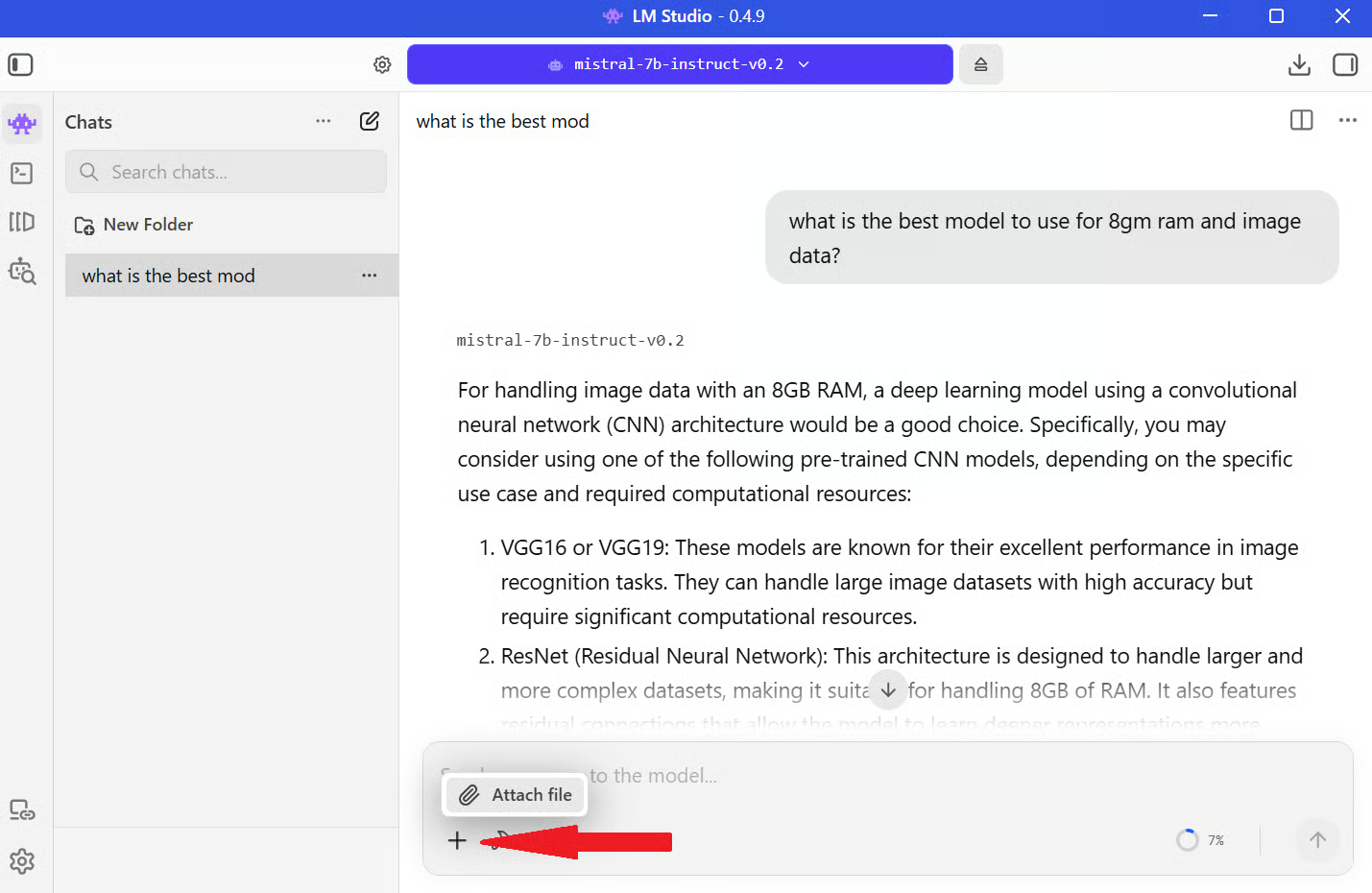

Dokumenten-Q&A einrichten

Öffne dafür eine Chatsitzung mit deinem geladenen Modell. Du siehst ein +-Symbol zum Anhängen von Dateien. Klicke darauf, um etwa PDFs oder Textdateien direkt in den Chat zu laden.

Sobald die Datei hinzugefügt ist, bereitet LM Studio sie automatisch für Abfragen vor – du musst nichts manuell konfigurieren. Im Hintergrund wird das Dokument in kleinere Abschnitte zerlegt, damit das Modell effizient damit arbeiten kann. Diese Abschnitte werden dann in Embeddings umgewandelt – numerische Repräsentationen des Textes.

Wenn du eine Frage stellst, ruft LM Studio die relevantesten Abschnitte ab und übergibt sie zusammen mit deiner Anfrage an das Modell. So erhält das Modell zusätzlichen Kontext aus deinen Dokumenten und antwortet entsprechend.

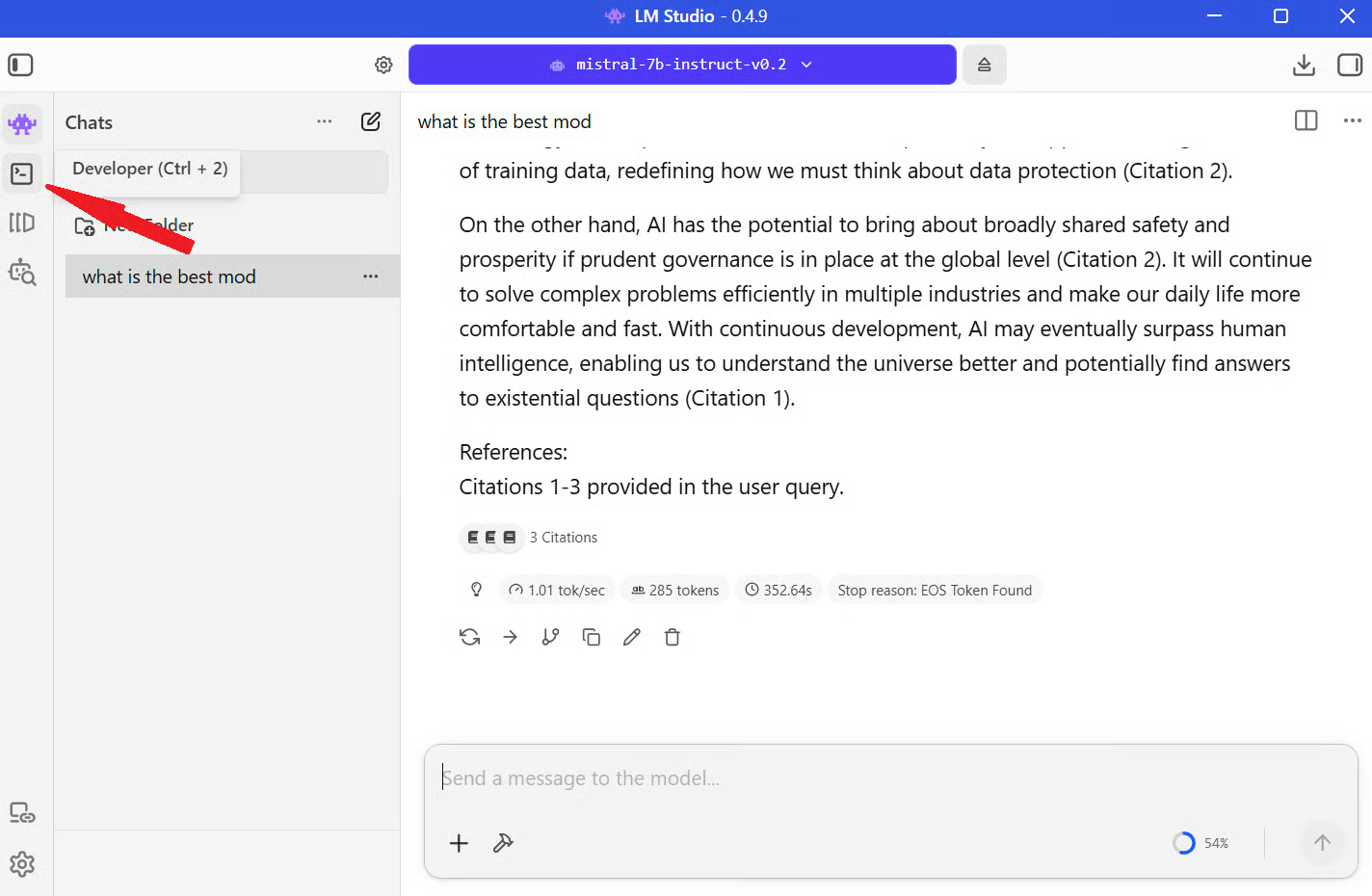

Deine Wissensbasis abfragen

Ich habe zum Beispiel ein Forschungspapier zur Künstlichen Intelligenz hochgeladen und gefragt: „Was ist deine Einschätzung zur Zukunft der KI?“

LM Studio zieht die relevantesten Abschnitte aus dem Dokument und gibt sie zusammen mit deinem Prompt an das Modell weiter. Die Antwort basiert dann sowohl auf diesem Kontext als auch auf dem vorhandenen Wissen des Modells.

Im folgenden Bild siehst du das auch visuell:

Ein paar Einschränkungen solltest du im Blick behalten: Das Modell ist weiterhin durch das Kontextfenster limitiert, sehr große Dokumente können nicht vollständig auf einmal berücksichtigt werden. Die Retrieval-Qualität hängt auch von der Chunking-Strategie ab – wenn relevante Stellen nicht korrekt gefunden werden, können Details fehlen.

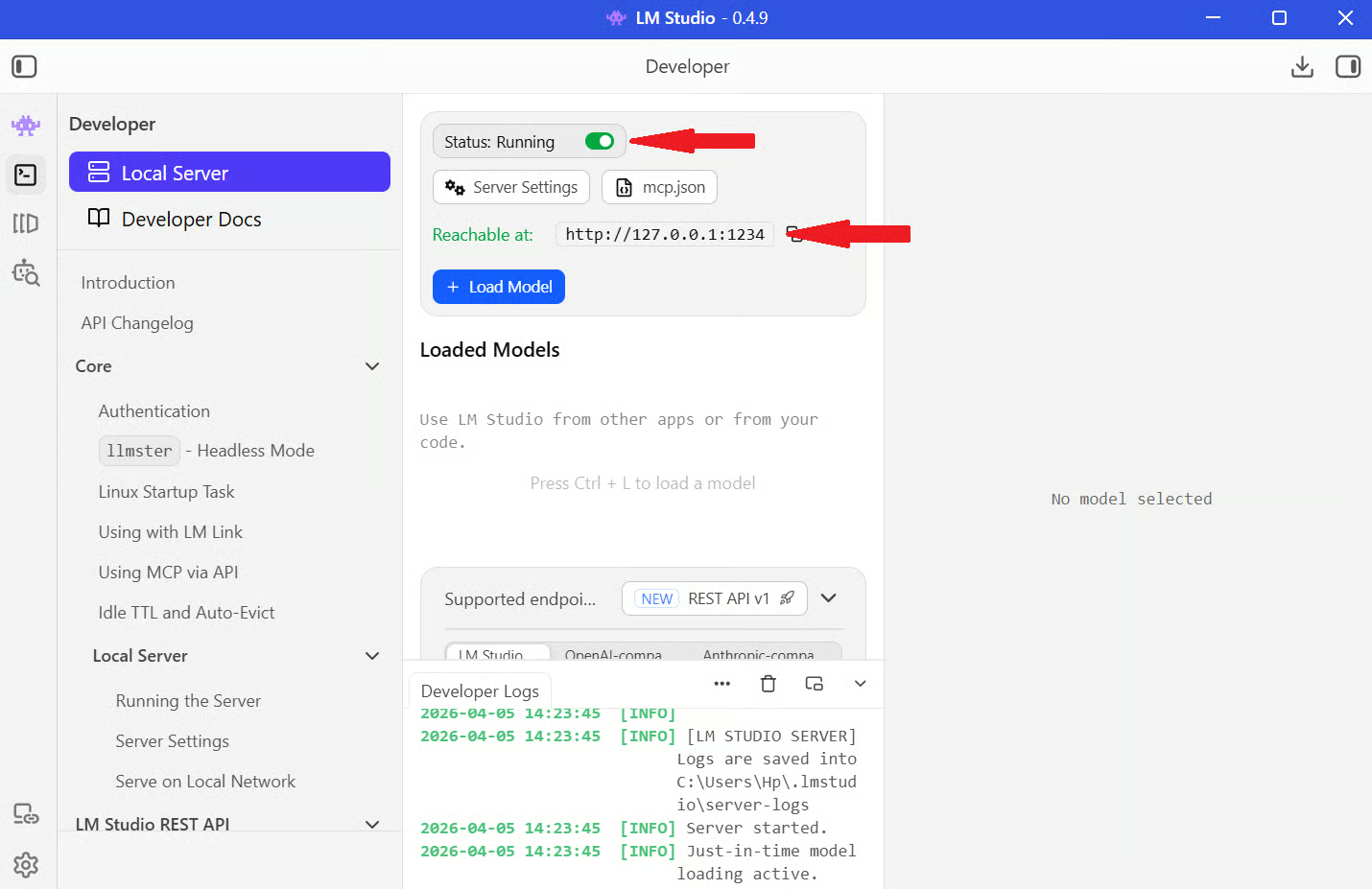

LM Studio als lokalen API-Server betreiben

Eine der stärksten Funktionen ist, LM Studio als lokalen API-Server zu starten. So kannst du dein lokales LLM in Skripten, Apps oder anderen Tools verwenden.

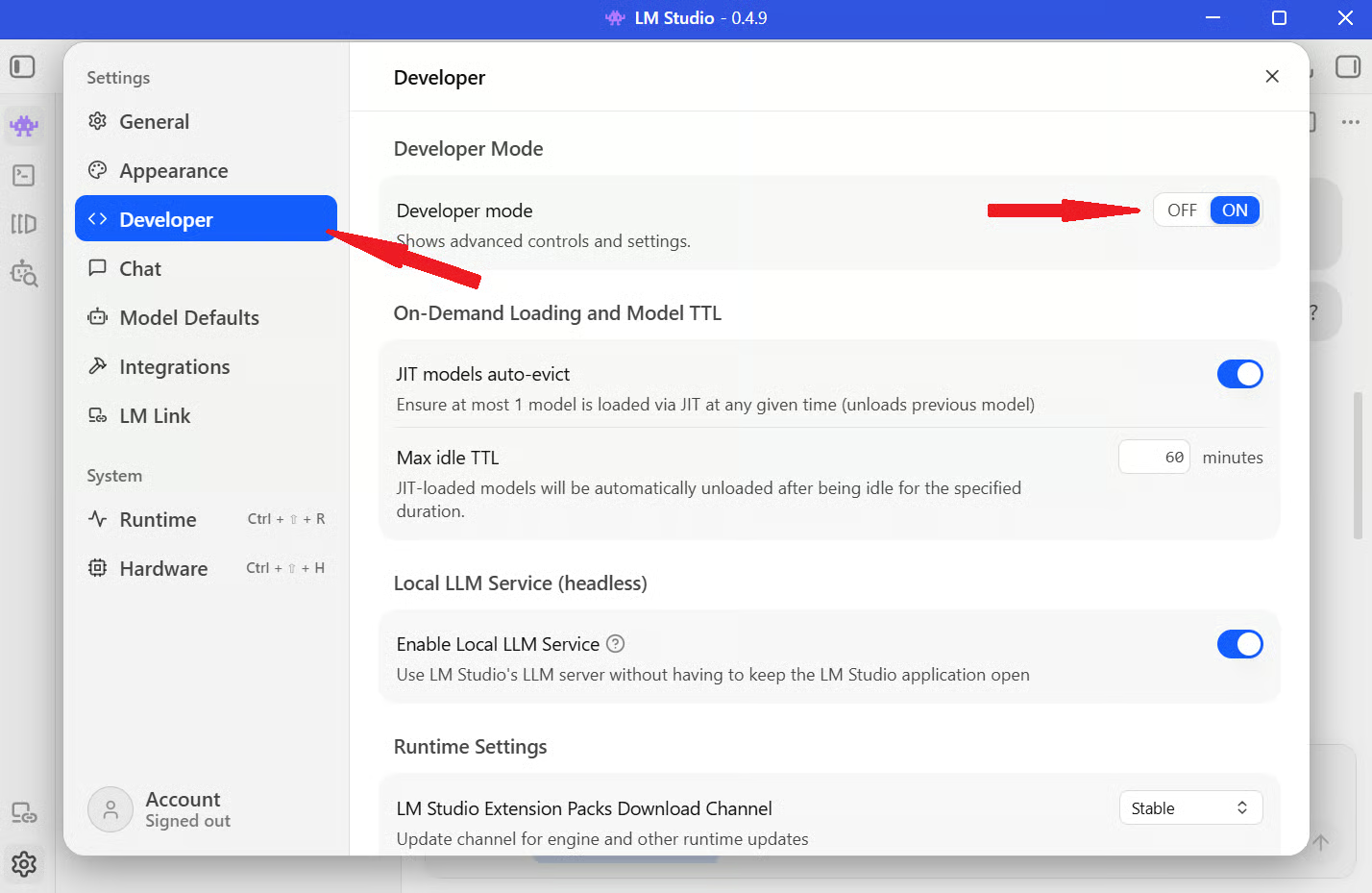

Server starten

Schritt 1: Öffne LM Studio und klicke unten links auf das Settings-Symbol.

Schritt 2: Gehe in der linken Seitenleiste zum Bereich Developer und aktiviere den Developer-Mode-Schalter.

Schritt 3: Gehe zurück zur Chat-Oberfläche und klicke in der linken Menüleiste auf das Developer-Symbol.

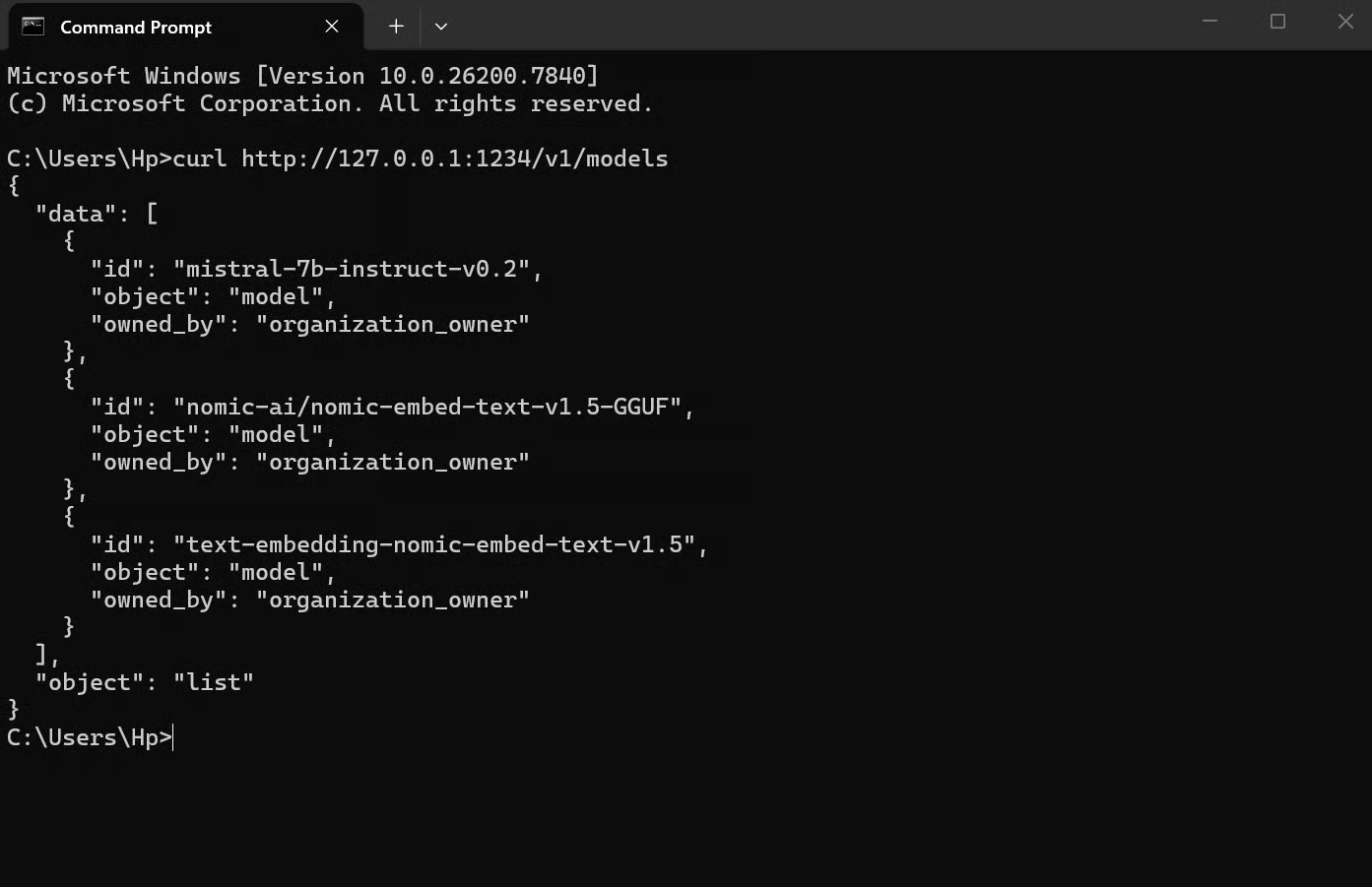

Schritt 4: Aktiviere den Schalter neben Status, um den Server zu starten, wie im Bild unten. Sobald er läuft, kannst du die Serveradresse kopieren und sie mit einer einfachen curl-Anfrage testen:

curl http://127.0.0.1:1234/v1/models

Wenn alles korrekt eingerichtet ist, siehst du eine JSON-Antwort mit den verfügbaren Modellen.

Verbindung aus Python

Sobald dein lokaler Server läuft, kannst du ihn wie jede andere API behandeln. Der einzige Unterschied: Statt die Server von OpenAI aufzurufen, sprichst du deinen eigenen Rechner an.

Ein einfaches Beispiel:

from openai import OpenAI

client = OpenAI(base_url="http://localhost:1234/v1", api_key="lm-studio")

response = client.chat.completions.create(

model="local-model",

messages=[

{"role": "user", "content": "Explain how local LLMs work"}

],

)

print(response.choices[0].message.content)Was hier passiert:

-

base_urlweist den Code an, deinen lokalen LM-Studio-Server statt OpenAI zu verwenden -

api_keykann beliebig sein (LM Studio erzwingt ihn nicht) -

modelverweist auf das in LM Studio geladene Modell -

messagesist dein Prompt

Wenn du das ausführst, geht deine Anfrage an „localhost:1234“, das Modell verarbeitet sie und du erhältst eine Antwort zurück – genau wie bei jedem API-Call. Das funktioniert, weil LM Studio dem OpenAI-API-Format folgt.

Fazit

LM Studio bietet dir eine aufgeräumte, praxisnahe Oberfläche, um lokal mit LLMs zu arbeiten – mit voller Kontrolle über deine Umgebung. Du wählst die Modelle, passt die Einstellungen an, chattest damit und kannst das Setup sogar als lokalen API-Server erweitern.

Bemerkenswert ist: Lokale LLMs zu betreiben war früher mit viel Setup und Tooling verbunden. LM Studio reduziert das auf etwas, das sich eher wie die Installation und Nutzung einer normalen Desktop-App anfühlt.

Wenn du darauf aufbauen willst, lernst du als Nächstes, wie du diese Modelle in echte Workflows integrierst. Starte mit Kursen wie Working with the OpenAI API oder mit breiteren AI fundamentals-Lernpfaden, um zu verstehen, wie du Prompts strukturierst, Anwendungen baust und effektiv mit Modellen arbeitest.

LM Studio: FAQs

Ist LM Studio kostenlos?

Ja, LM Studio ist kostenlos zum Herunterladen und Nutzen. Es gibt keine Abo-Gebühren, Nutzungslimits oder hinter einer Paywall versteckte Kernfunktionen.

Ist LM Studio komplett offline nutzbar?

Ja, sobald du ein Modell heruntergeladen hast, läuft alles lokal. Nur für den Download von Modellen über Hugging Face brauchst du eine Internetverbindung.

Kann ich LM Studio in meinen eigenen Anwendungen nutzen?

Ja, LM Studio kann als lokaler API-Server laufen und folgt dem OpenAI-API-Format. So kannst du es mit Skripten, Apps oder anderen Tools auf deinem Rechner verbinden.

Kann LM Studio mit Bildern umgehen?

Ja, aber nur mit visionsfähigen Modellen. Wenn du ein multimodales Modell wie LLaVA oder Qwen-VL lädst, kannst du Bilder hochladen und Fragen dazu stellen. Standard-Textmodelle unterstützen keine Bild-Inputs.

Wie viel RAM brauche ich, um LLMs lokal auszuführen?

Das hängt von der Modellgröße ab. 8GB genügen für kleinere Modelle, 16GB reichen für viele Anwendungsfälle, und 32GB oder mehr brauchst du meist für größere Modelle.

Srujana ist freiberufliche Tech-Autorin und hat einen vierjährigen Abschluss in Informatik. Das Schreiben über verschiedene Themen wie Data Science, Cloud Computing, Entwicklung, Programmierung, Sicherheit und viele andere ist für sie selbstverständlich. Sie liebt klassische Literatur und erkundet gerne neue Reiseziele.