Cursus

Exécuter des modèles de langage de grande taille en local gagne en popularité, surtout lorsque vous ne souhaitez pas envoyer de données sensibles vers des serveurs externes. Quand tout tourne sur votre machine, vos invites et vos données restent dans votre environnement, ce qui vous offre plus de contrôle et une meilleure confidentialité.

Si vous voulez bénéficier des mêmes avantages, je vous montre pas à pas comment utiliser LM Studio pour faire tourner et discuter avec des LLM en local. C’est un outil orienté interface graphique, vous n’avez donc pas besoin d’expérience du terminal ni de connaissances techniques poussées. La configuration est simple et vous pouvez démarrer rapidement. Allons-y !

Si vous souhaitez aussi exécuter des outils agents en local, consultez nos tutoriels pour configurer OpenClaw et Claude Code avec Ollama.

Qu’est-ce que LM Studio ?

LM Studio est une application multiplateforme qui vous permet de télécharger et d’exécuter des modèles de langage de grande taille en local sur votre machine, afin que vos données ne fuitent jamais vers des serveurs externes.

Elle intègre un navigateur de modèles pour rechercher, parcourir et télécharger directement des modèles depuis Hugging Face. Vous pouvez récupérer quasiment n’importe quel modèle, y compris différentes versions de DeepSeek, Llama, Gemma, Phi ou Mistral. Vous n’avez pas besoin d’une configuration supplémentaire.

LM Studio est aussi une excellente option pour débuter, surtout si vous n’êtes pas à l’aise avec la ligne de commande. Vous disposez d’une interface conviviale pour choisir un modèle, ajuster la configuration et commencer à discuter immédiatement.

Vous pouvez également téléverser vos fichiers locaux et discuter avec eux : LM Studio peut joindre des fichiers .docx, .pdf et .txt aux sessions de chat. Si un document tient dans le contexte, il est ajouté en entier ; s’il est très long, LM Studio peut utiliser la génération augmentée par récupération (RAG) pour extraire les informations pertinentes et répondre à vos questions.

Comme LM Studio est multiplateforme, il fonctionne sans accroc sous Windows, Mac et Linux : vous n’êtes donc pas limité par votre environnement. Et une fois les bases acquises, vous pouvez aller plus loin. Il est possible de connecter vos LLM locaux à des outils, des sources de données et des API externes via l’intégration de serveurs MCP, ce qui le rend assez flexible pour des workflows avancés.

LM Studio vs Ollama

LM Studio et Ollama visent tous deux à exécuter et à interagir avec des modèles de langage de grande taille en local. Quelques différences clés toutefois :

|

Fonctionnalité |

LM Studio |

Ollama |

|

Interface |

Interface conviviale, orientée GUI |

Interface orientée CLI, basée sur le terminal |

|

RAG intégré |

Oui, aucune configuration supplémentaire |

Nécessite des outils externes |

|

Prise en charge MCP |

Intégrée |

Limitée / non native |

|

Téléchargement de modèles |

Accès à Hugging Face depuis l’application |

Via des commandes comme |

|

Facilité de mise en route |

Très adapté aux débutants |

Courbe d’apprentissage si vous découvrez la CLI |

Configuration requise pour LM Studio et choix du modèle

Avant de télécharger des modèles dans LM Studio, il est utile de comprendre ce que votre système peut réellement supporter. Le modèle à choisir dépend directement de votre RAM disponible ; un mauvais choix peut tout ralentir, voire rendre l’application inutilisable.

Un tableau récapitulatif rapide des modèles adaptés selon la RAM disponible :

|

RAM |

Ce que vous pouvez faire tourner confortablement |

|

8 Go |

Petits modèles (1B–4B) |

|

16 Go |

Modèles intermédiaires (7B–9B) |

|

32 Go et + |

Modèles plus grands (13B et au‑delà) |

Le GPU est facultatif, mais il fait une vraie différence. Si vous en avez un, les réponses du modèle sont nettement plus rapides et fluides. Les GPU NVIDIA avec CUDA offrent le meilleur support, Apple Silicon exploite efficacement Metal, et AMD propose un support partiel selon la configuration.

Comment choisir le bon modèle pour votre matériel

Voici quelques recommandations pratiques pour sélectionner un modèle qui tourne bien sur votre machine sans la surcharger.

|

RAM/VRAM |

Modèles recommandés |

|

8 Go |

Qwen 2.5 3B / 4B, Phi-3 Mini (3.8B), Gemma 2 2B |

|

16 Go |

Llama 3 8B, Gemma 2 9B, Mistral 7B, Qwen 2.5 7B |

|

24 Go |

Llama 3.1 8B (quantification de meilleure qualité), Mixtral 8x7B (quantifié), Qwen 2.5 14B |

|

32 Go et + |

Llama 3.1 70B (fortement quantifié), Qwen 2.5 32B, variantes Mixtral (meilleures configurations) |

Vous verrez aussi différentes versions d’un même modèle avec des libellés comme Q4_K_M ou Q8_0. Cela renvoie aux niveaux de quantification, qui indiquent en substance comment le modèle est compressé. Une quantification plus faible, comme Q4, réduit l’usage mémoire et accélère l’exécution, mais vous perdez un peu en qualité. Une quantification plus élevée, comme Q8, préserve mieux la qualité de sortie, au prix de plus de RAM et de performances moindres.

En cas de doute, Q4 ou Q5 constitue en général un bon point de départ, notamment sur une configuration 16 Go comme la mienne.

Installer LM Studio

Pour commencer avec LM Studio, rendez-vous sur le site officiel et téléchargez l’application. Le site détecte automatiquement votre système d’exploitation et propose la version adaptée.

Selon vos réglages système, des autorisations peuvent être requises. Dans mon cas, sur Mac, l’application était disponible dès l’ouverture de l’installeur téléchargé.

Selon vos réglages système, des autorisations peuvent être requises. Dans mon cas, sur Mac, l’application était disponible dès l’ouverture de l’installeur téléchargé.

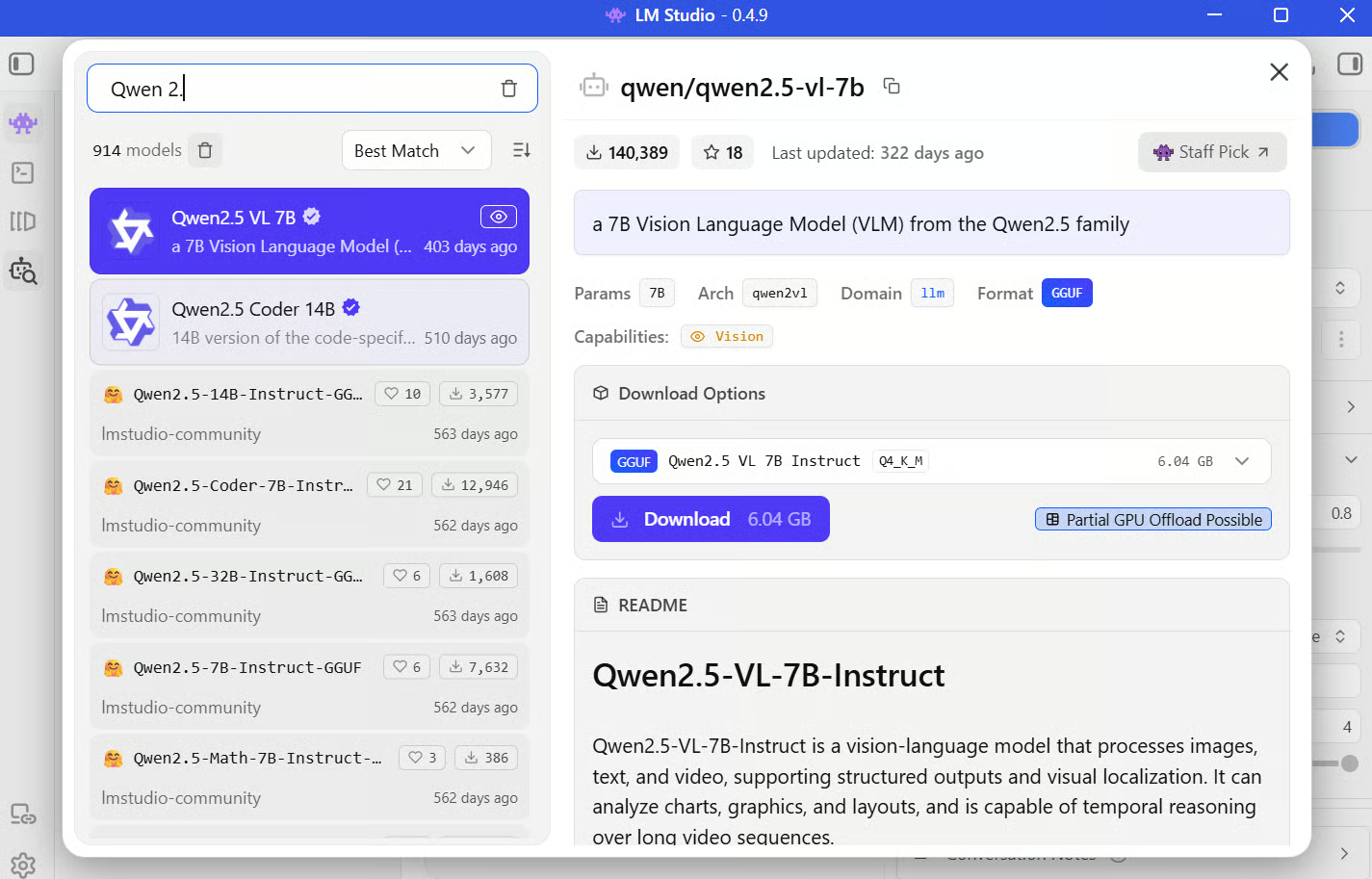

Télécharger votre premier modèle dans LM Studio

À la première ouverture de LM Studio, vous arrivez sur une interface épurée avec le navigateur de modèles. Vous pouvez aussitôt rechercher des modèles, explorer les options disponibles et commencer à en télécharger un pour l’exécuter en local.

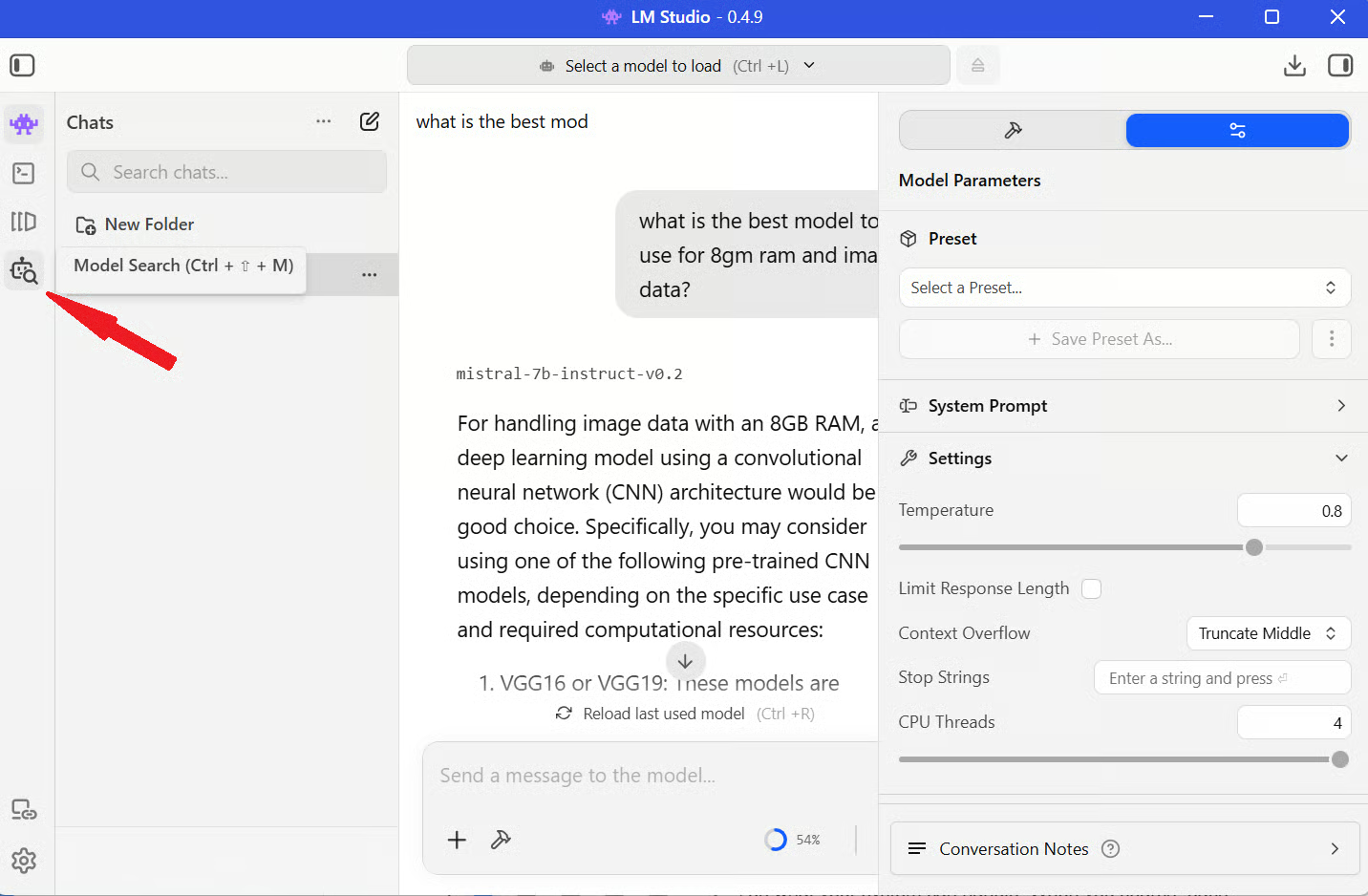

Parcourir l’onglet Discover

Ouvrez LM Studio et cliquez sur l’icône de recherche dans la barre latérale gauche.

C’est en quelque sorte votre marketplace de modèles : vous pouvez chercher un modèle précis, filtrer par taille et explorer différentes options. Chaque résultat dispose d’une fiche modèle qui fournit des informations utiles comme la taille, les capacités et parfois les cas d’usage recommandés. Prenez le temps de la parcourir avant de télécharger, pour savoir à quoi vous attendre.

Si vous suivez le tutoriel et souhaitez un point de départ fiable, optez pour quelque chose comme Qwen 2.5 7B (Q4_K_M) sur un système 16 Go (ou choisissez l’une de mes suggestions ci‑dessus). Il offre un bon équilibre entre performances et qualité, sans trop solliciter votre machine.

Comprendre les formats de modèles

En parcourant le catalogue, vous remarquerez que la plupart des modèles sont proposés au format GGUF. GGUF, pour GPT‑Generated Unified Format, est un format binaire conçu pour stocker et exécuter efficacement des LLM sur du matériel grand public.

Ce format fait correspondre les poids en haute précision (p. ex. Float16) à des entiers sur moins de bits (p. ex. 4 ou 5 bits) et regroupe les poids, les métadonnées et la configuration du modèle dans un seul fichier optimisé. Le chargement est plus rapide et la compatibilité est assurée avec des moteurs d’inférence comme llama.cpp, sur lequel LM Studio s’appuie en coulisses.

Discuter avec un LLM local dans LM Studio

Passons à la partie la plus intéressante et mettons le modèle en action.

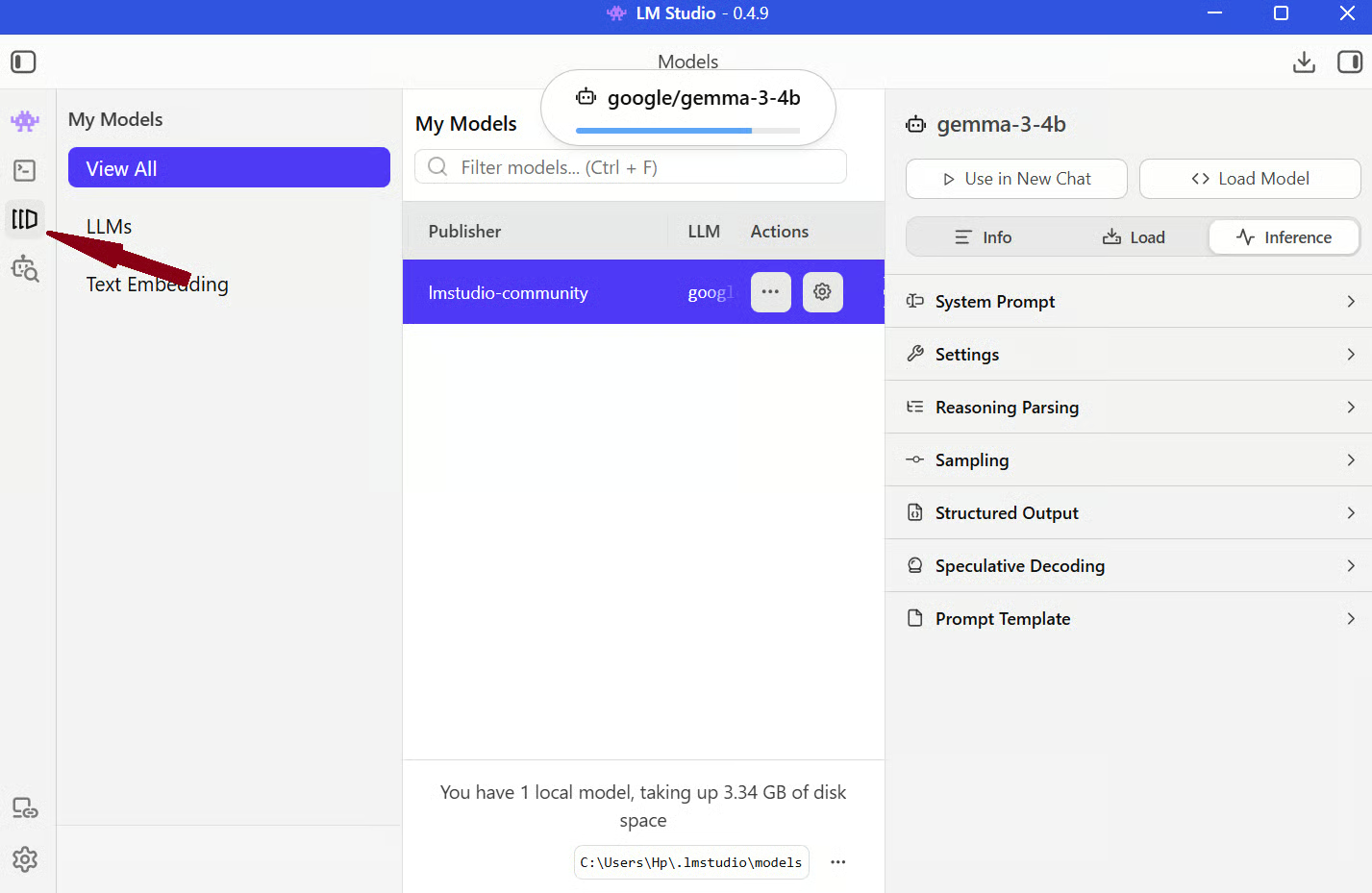

Charger un modèle et configurer les paramètres

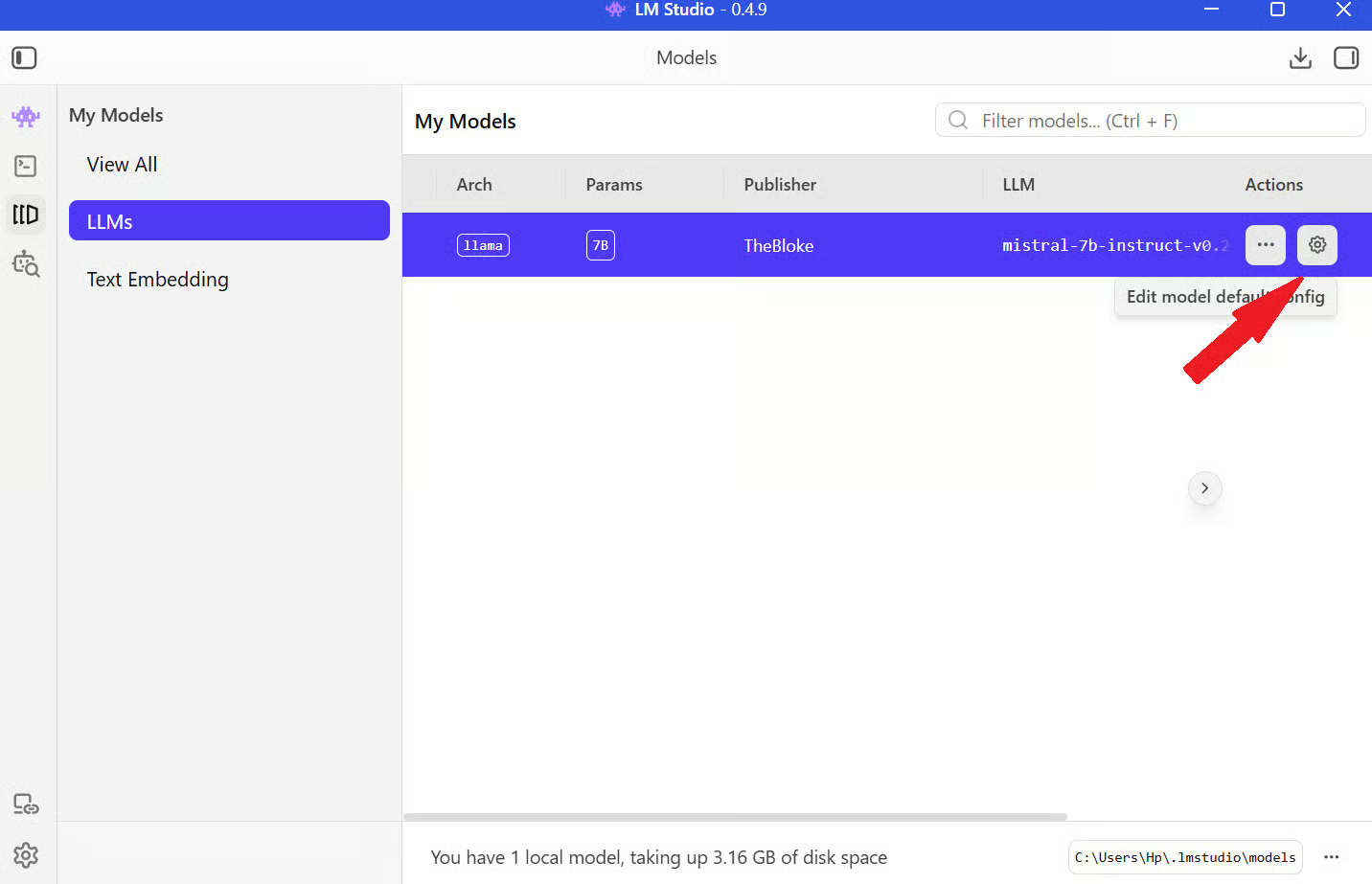

Étape 1 : ouvrez LM Studio et rendez‑vous dans la section My Models depuis le menu de gauche.

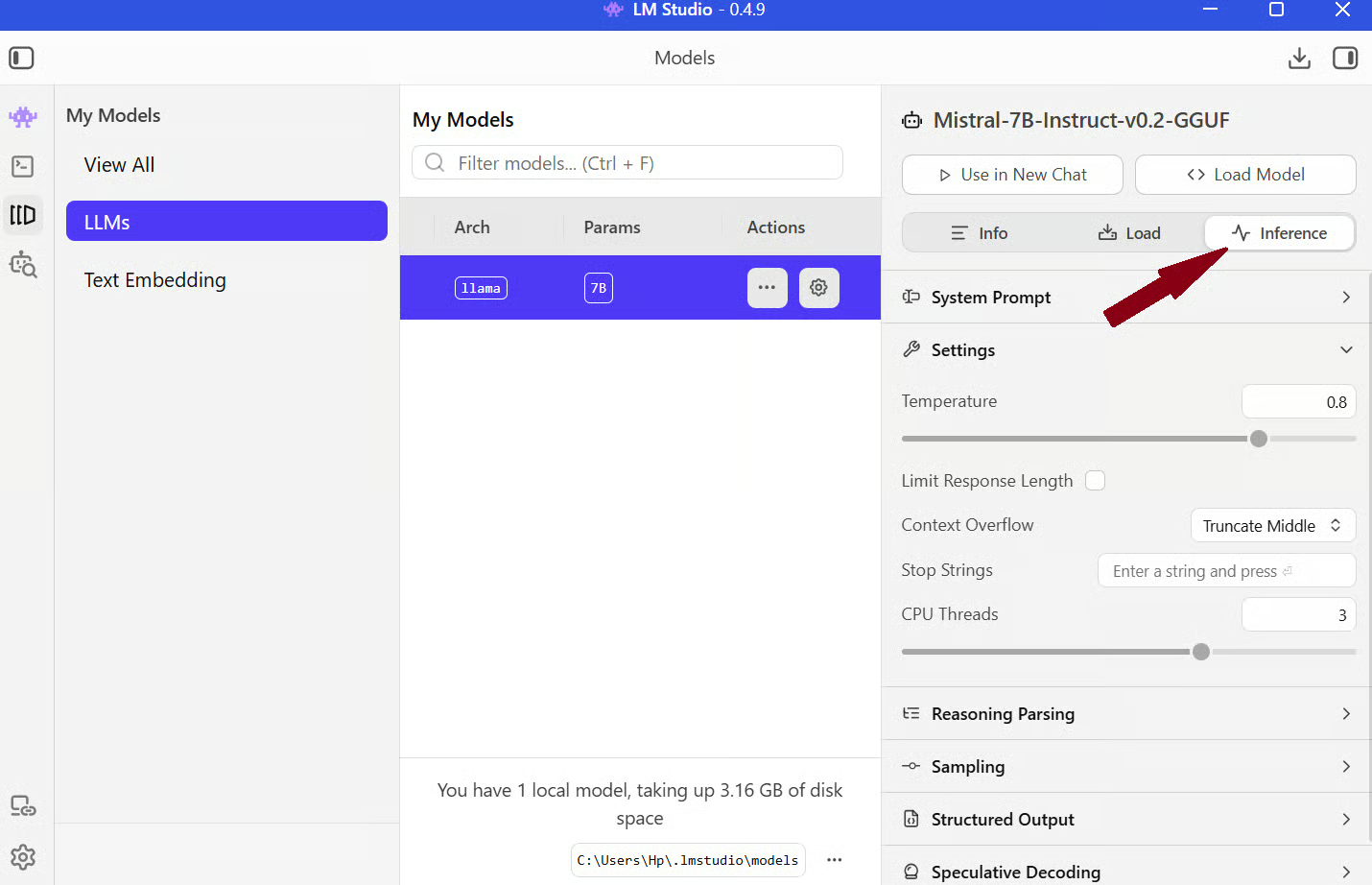

Étape 2 : cliquez sur l’icône Settings du modèle puis sur Load Model.

Une fois chargé, rendez‑vous dans l’onglet Inference sur le même écran : vous y trouverez les réglages pour la longueur de contexte, la température, etc.

- Longueur de contexte : détermine la quantité d’informations que le modèle peut garder en mémoire pendant une conversation. Plus elle est élevée, plus vous pouvez travailler avec des entrées longues, mais la consommation mémoire augmente. Si votre RAM est limitée, restez modéré.

- Température : règle le degré de créativité/prédictibilité du modèle. Des valeurs basses donnent des réponses plus déterministes, des valeurs hautes plus variées.

- Invite système (system prompt) : définit le comportement du modèle. C’est ici que vous précisez le ton, le style et le rôle de l’assistant.

Votre première conversation

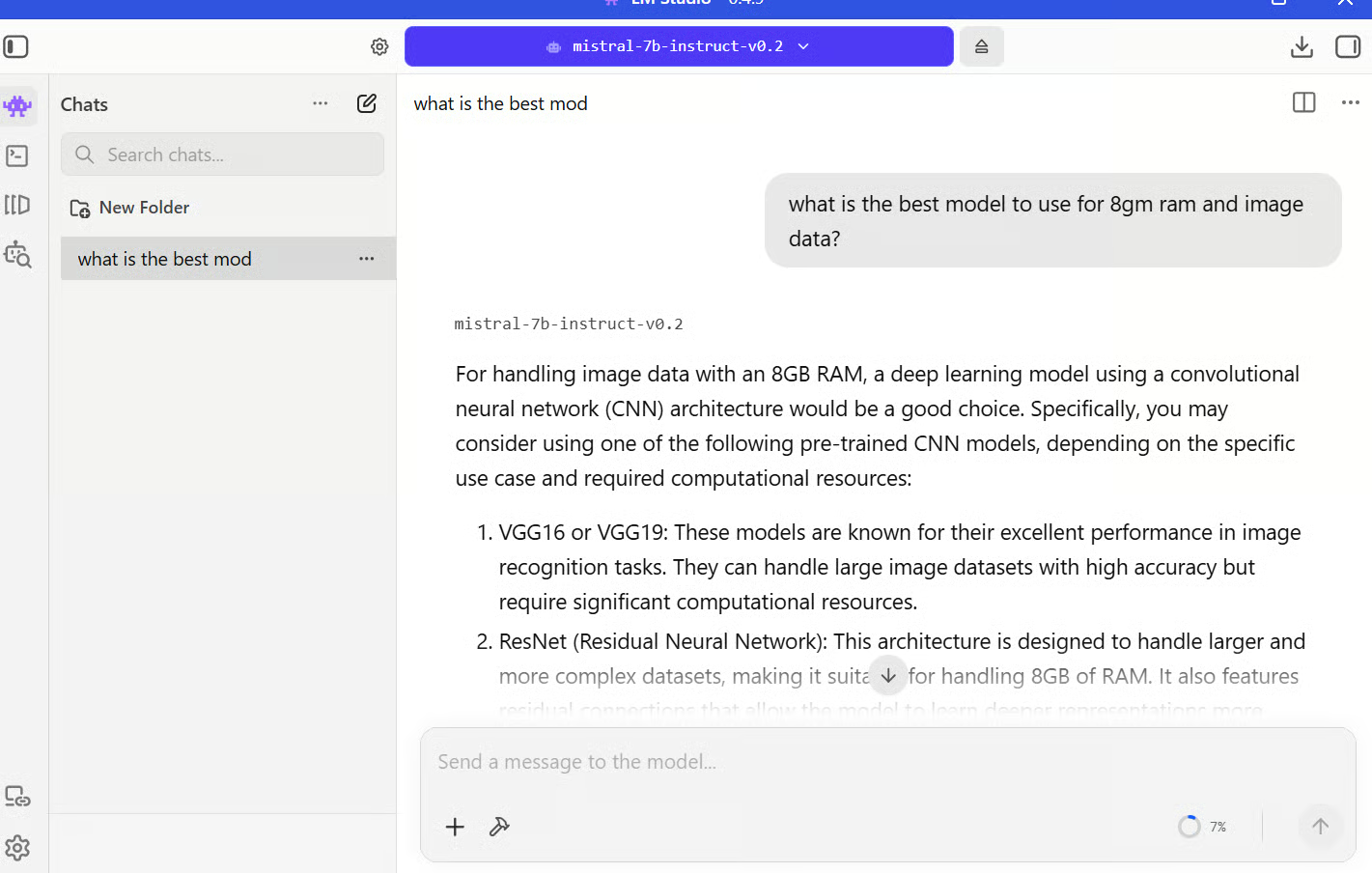

Une fois tout en place, vous pouvez discuter avec le modèle comme avec n’importe quel assistant IA. Voici un exemple simple :

J’ai demandé : « Quel est le meilleur modèle à utiliser avec 8 Go de RAM et des données images ? »

Le modèle a recommandé d’utiliser une architecture de réseau de neurones convolutionnel (CNN), comme illustré sur l’image.

Voilà pour le flux de base. La qualité des réponses dépend beaucoup de vos réglages. Par exemple, si vous définissez dans l’invite système « Expliquez tout en termes simples avec des réponses courtes », le modèle conservera ce style sur plusieurs échanges.

Discuter avec vos documents dans LM Studio

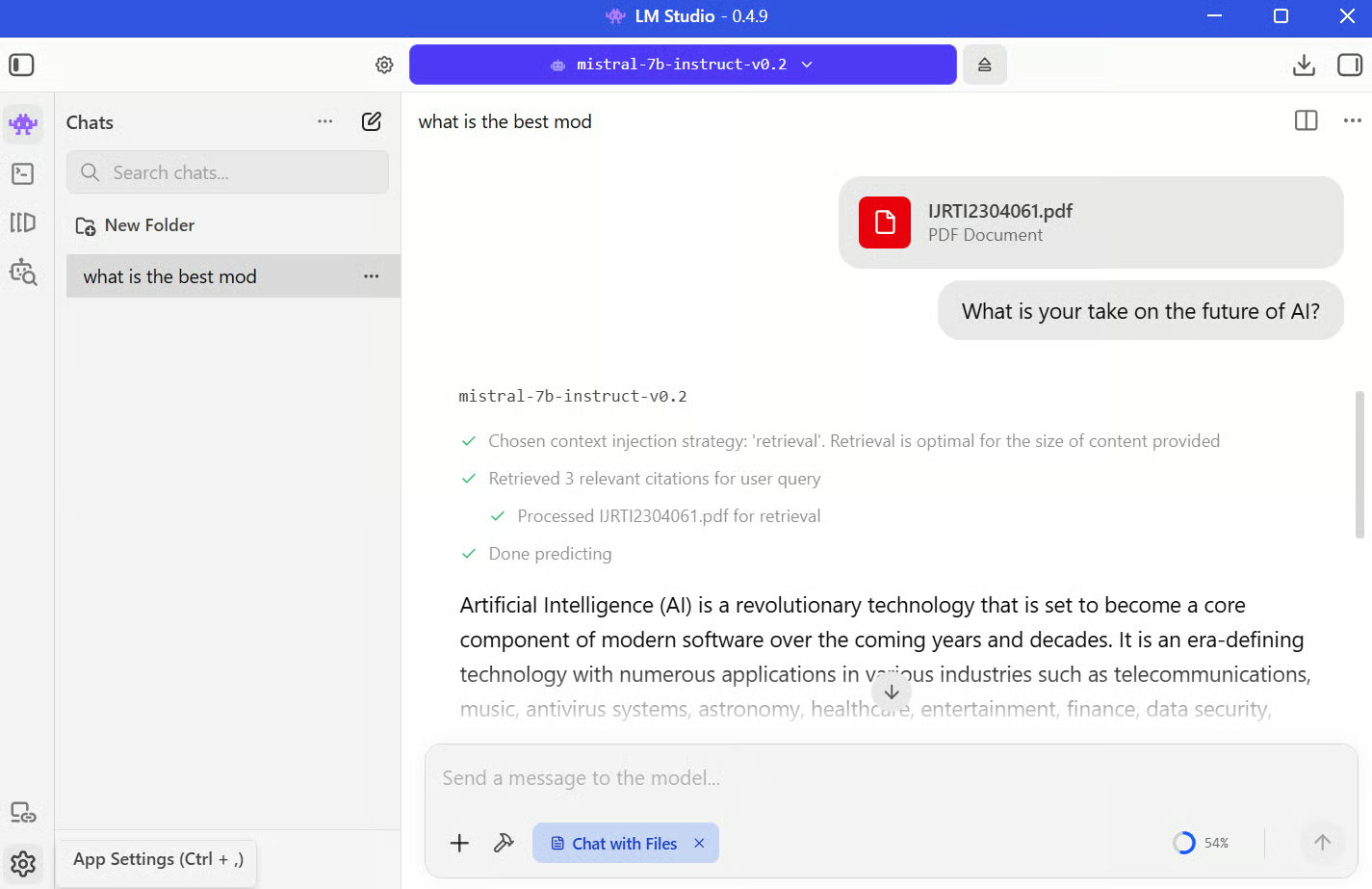

L’une des fonctionnalités les plus utiles de LM Studio est la prise en charge intégrée du RAG. Vous pouvez téléverser directement vos documents dans le chat et commencer à poser des questions.

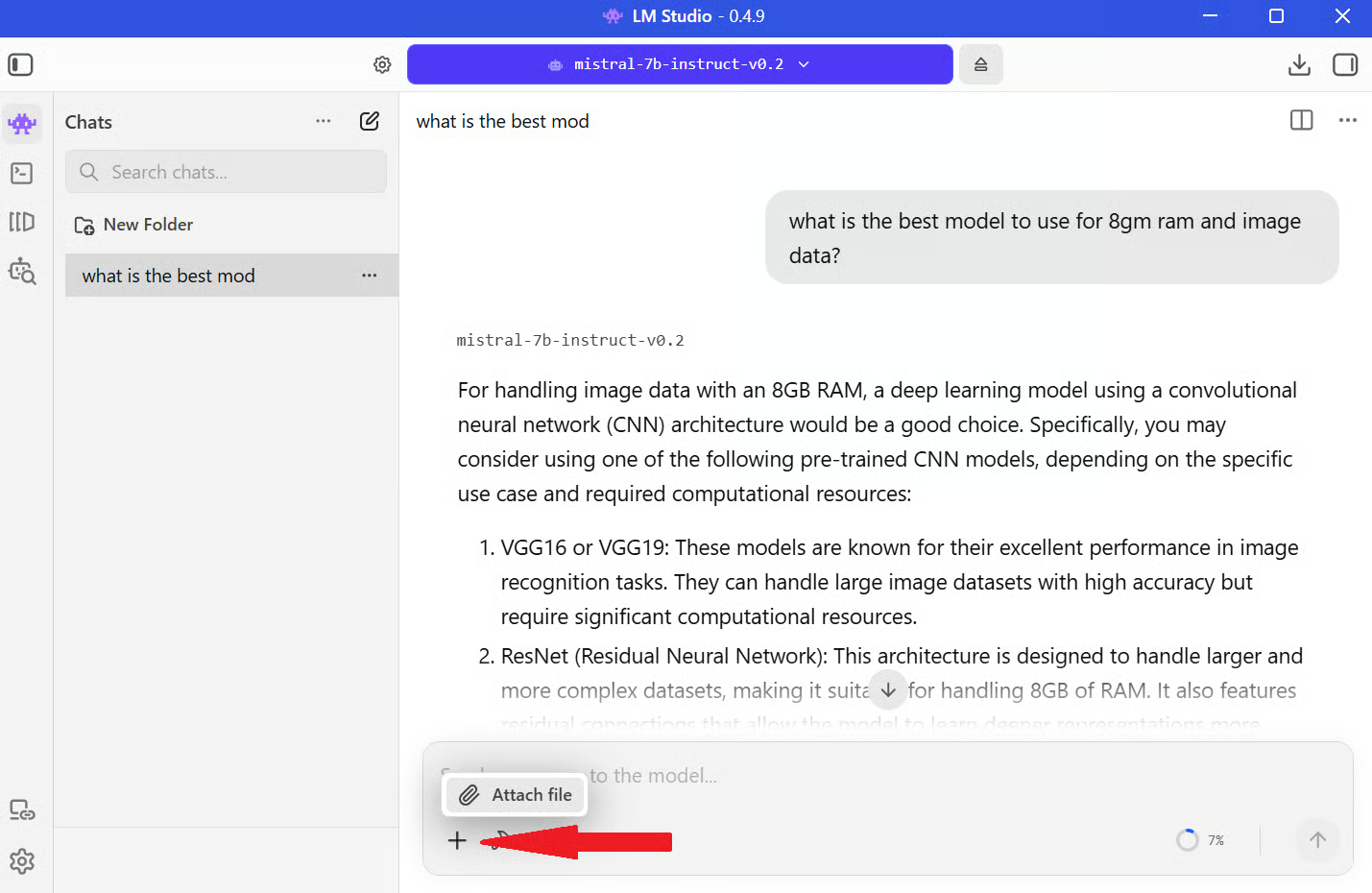

Configurer le questions‑réponses sur documents

Pour démarrer, ouvrez une session de chat avec votre modèle chargé. Vous verrez une icône + pour joindre des fichiers. Cliquez dessus pour téléverser des documents, comme des PDF ou des fichiers texte, directement dans le chat.

Une fois le fichier ajouté, LM Studio le prépare automatiquement pour l’interrogation ; aucune configuration manuelle n’est nécessaire. En coulisse, le document est découpé en petits segments pour que le modèle puisse travailler efficacement. Ces segments sont ensuite convertis en embeddings, des représentations numériques du texte.

Quand vous posez une question, LM Studio récupère les segments les plus pertinents et les transmet au modèle avec votre requête. Le modèle s’appuie ainsi sur vos documents en plus de ses connaissances pour vous répondre.

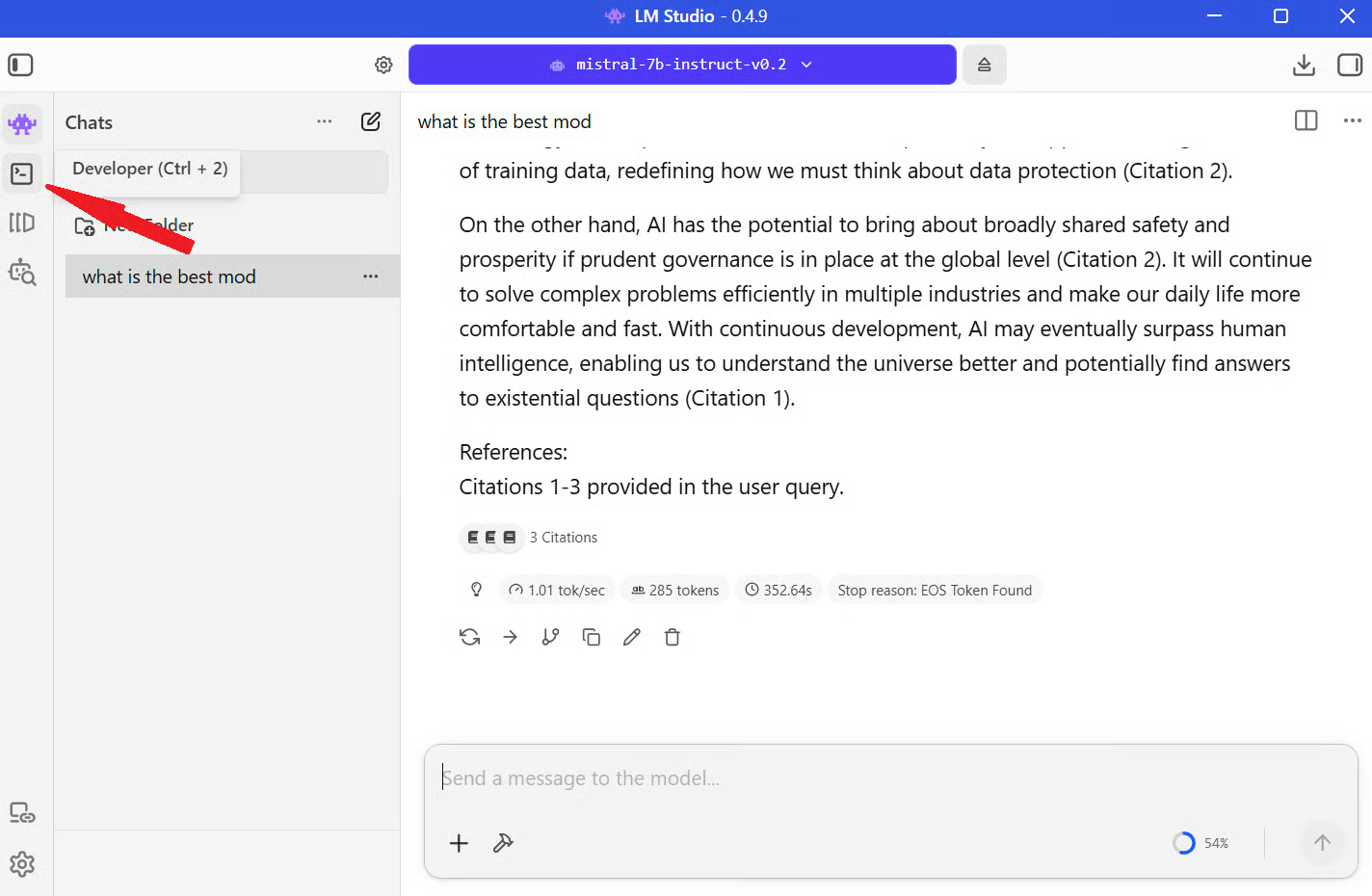

Interroger votre base de connaissances

Par exemple, j’ai téléversé un article de recherche sur l’intelligence artificielle et demandé : « Quel est, selon vous, l’avenir de l’IA ? »

LM Studio extrait les sections les plus pertinentes du document et les envoie au modèle avec votre invite. Le modèle génère ensuite une réponse en combinant ce contexte et ses connaissances existantes.

Vous pouvez voir le même processus représenté visuellement ci‑dessous :

Gardez quelques limites à l’esprit : le modèle reste contraint par sa fenêtre de contexte, donc des documents très volumineux ne seront pas pris en compte en totalité d’un coup. La qualité de la récupération dépend aussi du découpage du document ; certaines réponses peuvent manquer de précision si les passages pertinents ne sont pas correctement récupérés.

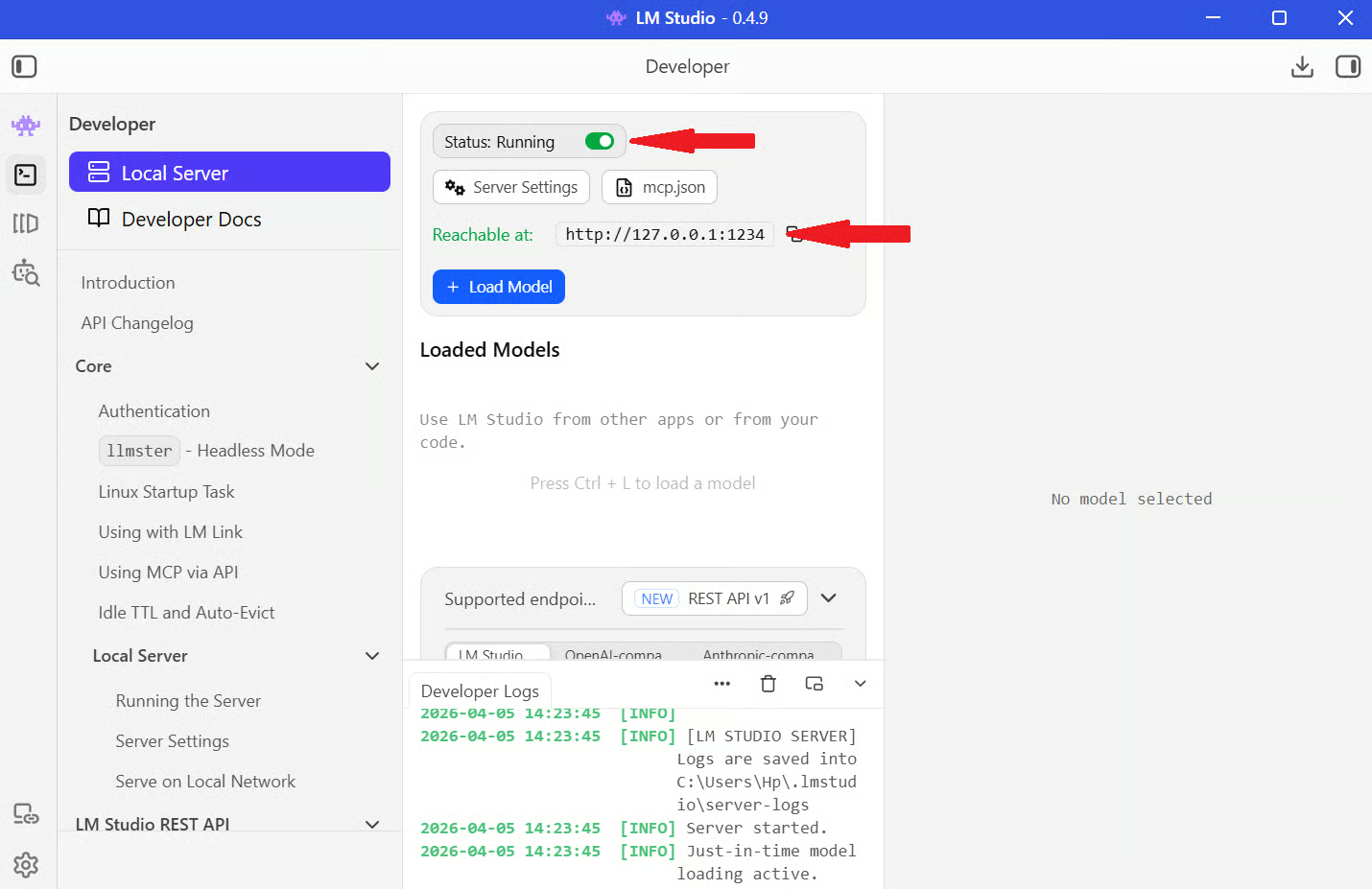

Exécuter LM Studio en tant que serveur API local

LM Studio peut également faire office de serveur API local, ce qui est très puissant. Vous pouvez ainsi utiliser votre LLM local dans des scripts, des applications ou d’autres outils.

Démarrer le serveur

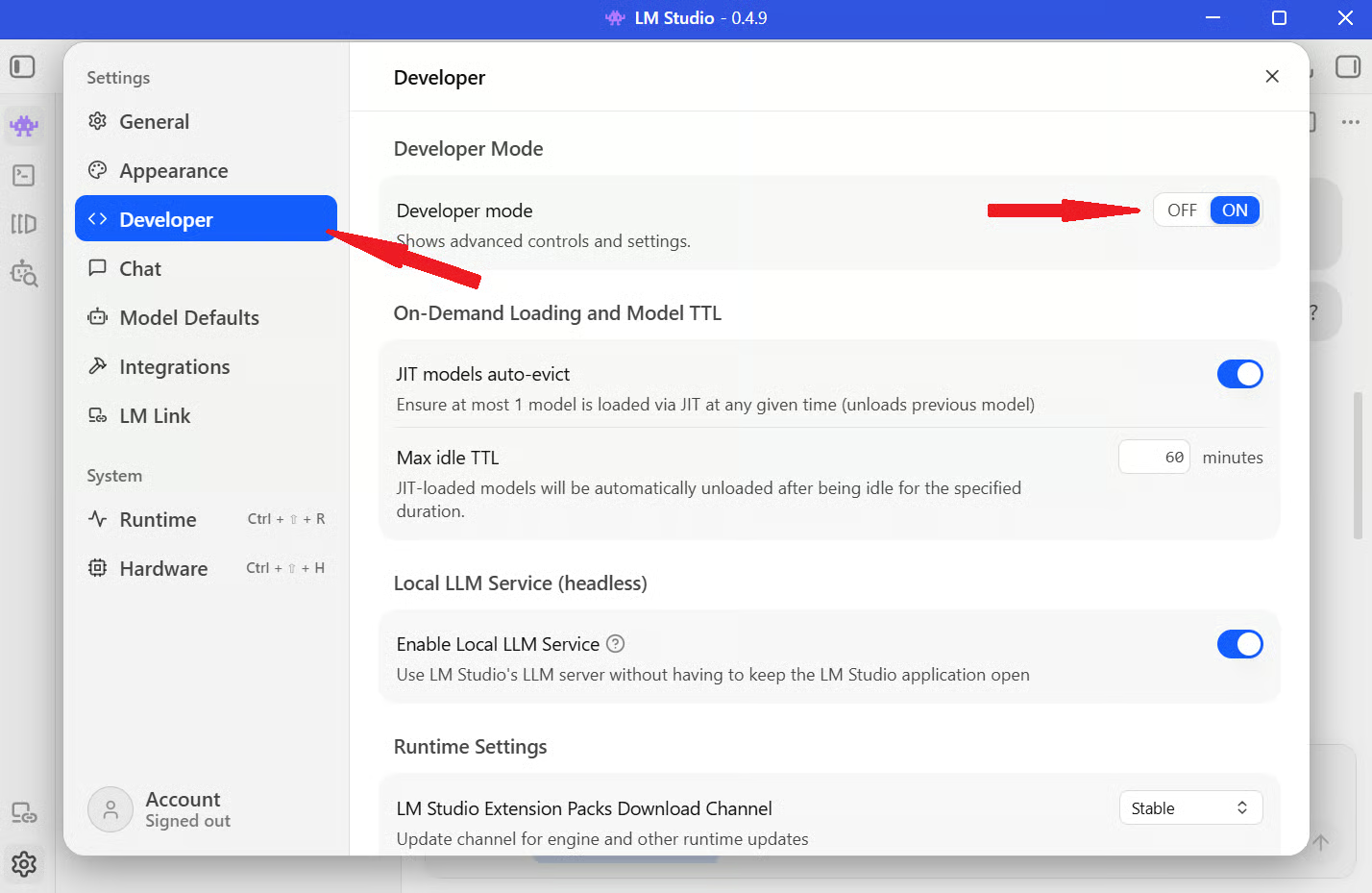

Étape 1 : pour activer cette option, ouvrez LM Studio et cliquez sur l’icône Settings en bas à gauche de l’écran.

Étape 2 : allez dans la section Developer dans la barre latérale gauche et activez le bouton Developer Mode.

Étape 3 : retournez à l’interface de chat et cliquez sur l’icône Developer dans le menu de gauche.

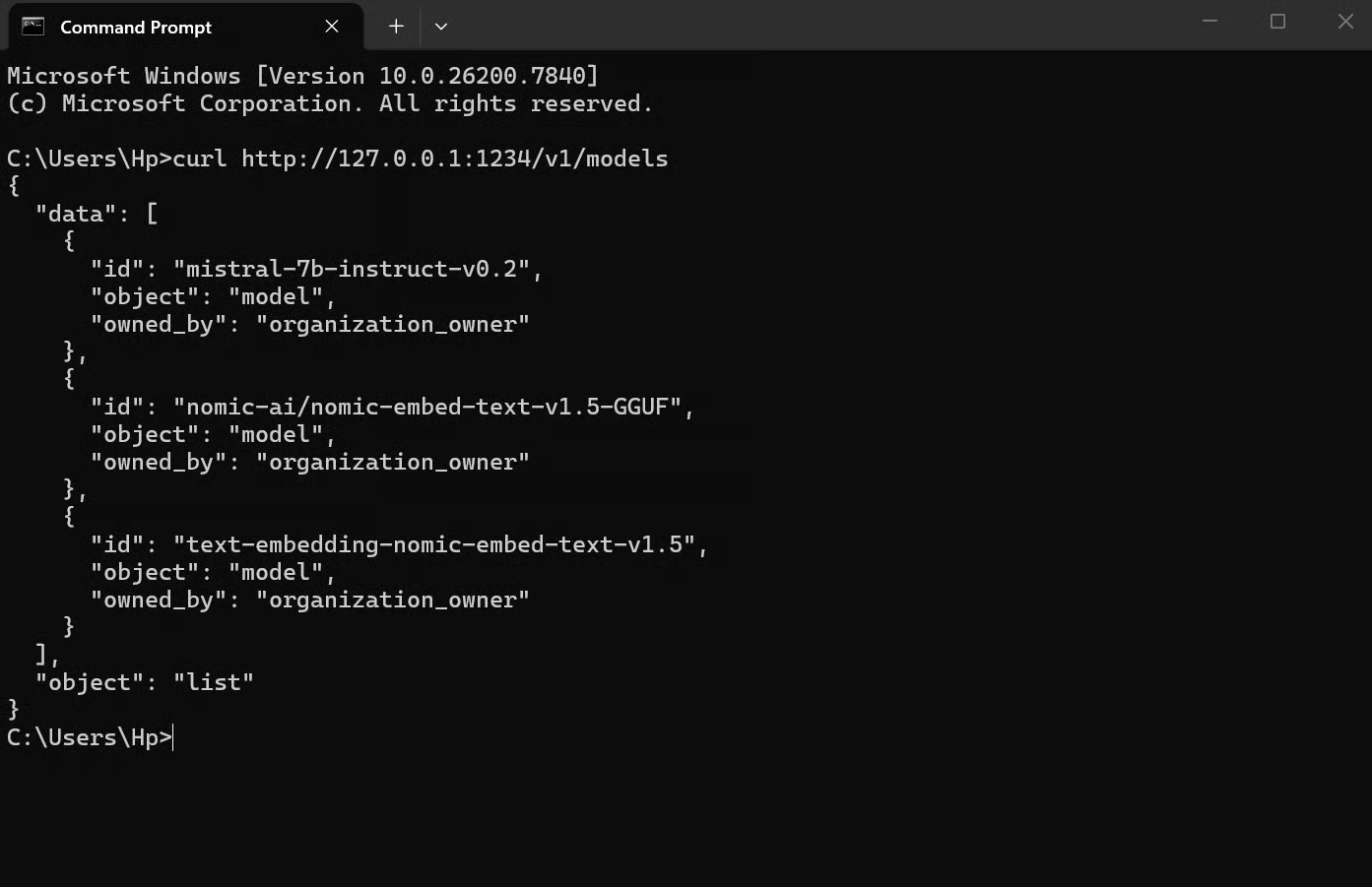

Étape 4 : activez le bouton à côté de Status pour démarrer le serveur, comme sur l’image ci‑dessous. Une fois lancé, copiez l’adresse du serveur et testez‑la avec une simple requête curl :

curl http://127.0.0.1:1234/v1/models

Si tout est correctement configuré, vous verrez une réponse JSON listant le modèle disponible.

Se connecter depuis Python

Une fois votre serveur local lancé, vous pouvez le traiter comme n’importe quelle API. La seule différence, c’est qu’au lieu d’appeler les serveurs d’OpenAI, vous interrogez votre propre machine.

Voici un exemple simple :

from openai import OpenAI

client = OpenAI(base_url="http://localhost:1234/v1", api_key="lm-studio")

response = client.chat.completions.create(

model="local-model",

messages=[

{"role": "user", "content": "Explain how local LLMs work"}

],

)

print(response.choices[0].message.content)Ce qui se passe ici :

-

base_urlindique au code d’utiliser votre serveur LM Studio local au lieu d’OpenAI -

api_keypeut être quelconque (LM Studio ne l’impose pas) -

modelfait référence au modèle que vous avez chargé dans LM Studio -

messagescorrespond à votre invite

À l’exécution, votre requête part vers « localhost:1234 », le modèle la traite et vous obtenez une réponse, comme pour n’importe quel appel d’API. Cela fonctionne parce que LM Studio suit le format de l’API OpenAI.

Conclusion

LM Studio offre une interface claire et pratique pour travailler avec des LLM en local, tout en gardant la maîtrise totale de l’environnement. Vous choisissez les modèles, réglez les paramètres, discutez avec eux et pouvez même aller jusqu’à l’exposer en serveur API local.

Ce qui ressort, c’est que faire tourner des modèles de langage en local nécessitait auparavant beaucoup de configuration et d’outillage. LM Studio simplifie tout cela au point de ressembler à l’installation et l’utilisation d’une application de bureau classique.

Si vous souhaitez aller plus loin, la prochaine étape consiste à intégrer ces modèles dans de vrais workflows. Vous pouvez explorer des cours comme Working with the OpenAI API ou des parcours sur les fondamentaux de l’IA pour apprendre comment structurer des invites, créer des applications et travailler efficacement avec les modèles.

FAQ sur LM Studio

LM Studio est-il gratuit ?

Oui, LM Studio est gratuit à télécharger et à utiliser. Aucuns frais d’abonnement, aucune limite d’usage ni fonctionnalité essentielle derrière un paywall.

LM Studio fonctionne‑t‑il entièrement hors ligne ?

Oui, une fois un modèle téléchargé, tout fonctionne en local. Vous n’avez besoin d’Internet que pour télécharger des modèles depuis Hugging Face.

Puis‑je utiliser LM Studio dans mes propres applications ?

Oui, LM Studio peut tourner comme serveur API local compatible avec le format de l’API OpenAI. Vous pouvez ainsi le connecter à des scripts, des applications ou d’autres outils sur votre machine.

LM Studio peut‑il traiter des images ?

Oui, mais uniquement avec des modèles compatibles vision. Si vous chargez un modèle multimodal comme LLaVA ou Qwen‑VL, vous pouvez téléverser des images et poser des questions à leur sujet. Les modèles texte‑seul ne prennent pas en charge les entrées image.

De combien de RAM ai‑je besoin pour exécuter des LLM en local ?

Cela dépend de la taille du modèle. 8 Go conviennent aux petits modèles, 16 Go suffisent dans de nombreux cas, mais 32 Go ou plus sont généralement requis pour les modèles plus grands.

Srujana est rédactrice technique indépendante et titulaire d'un diplôme de quatre ans en informatique. Écrire sur divers sujets, notamment la science des données, l'informatique en nuage, le développement, la programmation, la sécurité et bien d'autres encore, est pour elle une évidence. Elle aime la littérature classique et la découverte de nouvelles destinations.