Kurs

Moderne LLMs sind tiefer, breiter und rechenintensiver geworden, doch das Stapeln weiterer Transformer-Schichten bringt nicht immer proportionalen Mehrwert. Ein Grund: Standard-Residualverbindungen aggregieren Schichtausgaben mit festen Einheitsgewichten, sodass jede Schicht eine gleichförmige Summe von allem Vorherigen übernimmt. Das kann frühere Repräsentationen verwässern, die Größe der Hidden States aufblähen und es dem Netzwerk erschweren, die nützlichsten Zwischenmerkmale gezielt wiederzuverwenden.

Statt Tiefe als feste additive Rekurrenz zu behandeln, lässt das Paper des Kimi-Teams zu Attention Residuals jede Schicht mit gelernten Softmax-Gewichten über frühere Schichtausgaben „attendieren“. In diesem Artikel schauen wir uns an, warum die Standard-Residualaggregation zum Flaschenhals wird, wie Attention Residuals funktioniert, warum die Block-Variante wichtig ist und was die Ergebnisse in puncto Skalierung tiefer Sprachmodelle tatsächlich nahelegen.

Wenn du mehr über die Ideen hinter modernen Transformer-Architekturen lernen willst, empfehle ich dir den DataCamp-Kurs Transformer Models Tutorial in PyTorch.

Das Problem: Das ertrinkende Signal

Residualverbindungen sind seit Jahren ein Fundament des Deep Learnings. In Transformern lautet das Standard-Residual-Update:

hl=hl−1+fl−1(hl−1)

Das hilft, Gradienten durch sehr tiefe Netze zu leiten. Aber Residuals sind nicht nur ein Gradiententrick. Sie bestimmen auch, wie Informationen über die Tiefe aggregiert werden. Rollen wir die Rekurrenz auf, ergibt sich:

hl=h1+∑i=1l−1fi(hi)

Das bedeutet: Der Hidden State in Schicht l ist die Einbettung plus eine gleichmäßig gewichtete Summe aller früheren Schichtausgaben. Jede Komponente erhält effektiv dasselbe Gewicht.

Im großen Maßstab wird das problematisch. Das Paper zeigt, dass in PreNorm-Architekturen ungewichtete Residualakkumulation dazu führt, dass die Größen der Hidden States mit der Tiefe ungefähr wie O(L) wachsen.

Mit wachsendem Residualstrom werden frühe Schichtausgaben in einer immer größeren laufenden Summe verwässert. Ist ein Frühschichtsignal einmal hineingemischt, können tiefere Schichten es nicht mehr selektiv rekonstruieren. Sie operieren nur noch auf dem aggregierten Zustand.

Das führt zu dem, was das Paper den „drowning signal“-Effekt nennt. Ein starkes empirisches Indiz für diese Ineffizienz liefern Layer-Pruning-Studien: Ein beträchtlicher Teil der Schichten trainierter Modelle kann oft ohne großen Performanceverlust entfernt werden. Das legt nahe, dass Modelle trotz wachsender Tiefe keinen wirksamen Mechanismus haben, sie voll auszuschöpfen. Statt einer hierarchischen Argumentationskette verhält sich das Netz eher wie eine redundante Staffel, in der frühe Signale zunehmend verwässern.

Auch im Vorwärtsdurchlauf gibt es einen Trade-off. Wenn der Residualstrom wächst, müssen spätere Schichten Ausgaben mit höherer Amplitude erzeugen, um den akkumulierten Zustand spürbar zu beeinflussen. Das Paper verbindet dies mit PreNorm-Verhalten, bei dem Hidden-State-Größen unter Standard-Residualaggregation monoton mit der Tiefe zunehmen.

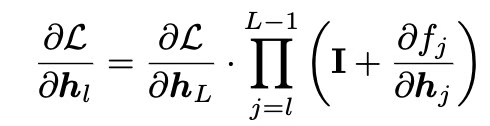

Residualverbindungen erleichtern den Gradientenfluss, und der Gradient bezüglich eines Zwischen-Hidden-States lässt sich schreiben als:

Der Identitätsterm erhält hier einen direkten Gradientenpfad. Doch die Residuals zwingen den Vorwärtspfad der Aggregation weiterhin dazu, jede frühere Schicht mit dem festen Gewicht 1,0 zu behandeln. Genau diese strukturelle Einschränkung versucht AttnRes zu beheben.

Von additiven Residuals zu auf Tiefe gerichteter Attention

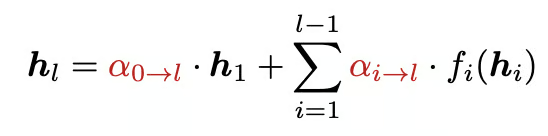

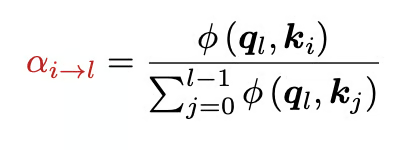

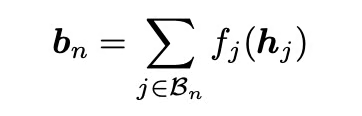

Der spannendste konzeptionelle Schritt des Papers ist die Zeit–Tiefe-Dualität. Residualverbindungen komprimieren Information über die Tiefe, so wie rekurrente Netze Information über die Zeit komprimieren. In der Sequenzmodellierung hat Attention die Rekurrenz ersetzt, indem jede Position frühere Positionen selektiv adressieren kann. AttnRes überträgt diesen Wechsel auf die Netzwerktiefe. Anstatt den nächsten Hidden State als feste Summe früherer Schichten zu definieren, lässt AttnRes jede Schicht über frühere Schichtausgaben „attendieren“:

wobei die Gewichte αi→l Softmax-Attention-Gewichte über die Tiefe sind und sich zu 1 summieren. Diese Gewichte werden berechnet als:

wobei das Paper verwendet:

![]()

Jede Schicht erhält einen gelernten Pseudo-Query-Vektor wl, und dieser Query attendiert über Keys und Values, die aus früheren Schichtausgaben aufgebaut sind. RMSNorm wird auf die Keys angewandt, damit Schichten mit größeren Ausgangsamplituden nicht allein aufgrund ihrer Skala die Softmax dominieren.

Der zentrale Wechsel im Paper: Standard-Residuals werden als eine Art linearer Attention über die Tiefe interpretiert, während AttnRes das zu einer Softmax-Attention über die Tiefe aufwertet. Statt gleichförmiger Akkumulation erhalten wir selektives Abrufen entlang der Tiefe.

Ein kleines, aber wichtiges Implementierungsdetail ist die Initialisierung. Die Autorinnen und Autoren schlagen vor, alle Pseudo-Query-Vektoren auf Null zu initialisieren. So sind die anfänglichen Attention-Gewichte gleichmäßig, und das Modell startet das Training als Gleichgewichts-Mittel statt mit einer zufällig verzerrten Attention-Mechanik.

Abbildung 1: Überblick über Attention Residuals (Attention Residuals Paper)

Full Attention Residuals

Bei Full Attention Residuals attendiert jede Schicht über alle vorherigen Schichtausgaben und kann Informationen selektiv über die Tiefe aggregieren. Das gibt dem Modell maximale Flexibilität: Eine tiefere Schicht kann ihren unmittelbaren Vorgänger, die ursprüngliche Einbettung oder jede frühere Schicht betonen – je nachdem, wo das nützlichste Signal liegt.

Im Standardtraining ist der Speicher-Overhead von Full AttnRes kleiner als zunächst vermutet, da viele Schichtausgaben für Backpropagation ohnehin vorgehalten werden. Im großskaligen Training ändert sich das Bild jedoch. Mit Aktivations-Neuberechnung und Pipeline-Parallelismus müssen diese früheren Ausgaben explizit erhalten und übermittelt werden, damit spätere Schichten auf sie attendieren können – das wird teuer.

Full AttnRes ist also ideal, um die Kernidee zu verstehen, aber nicht die Variante, die die meisten Teams im großen Maßstab einsetzen würden.

Block Attention Residuals

Das Paper führt Block Attention Residuals ein, um Speicher- und Kommunikationsaufwand zu reduzieren. Die Schichten des Modells werden in Blöcke unterteilt: Innerhalb eines Blocks werden Ausgaben per Standard-Residuals additiv kombiniert, zwischen Blöcken führt das Modell Attention über Block-Zusammenfassungen statt über jede einzelne frühere Schicht aus.

Wenn Bn die Menge der Schichten im Block n ist, lautet die Block-Repräsentation:

Das Modell attendiert dann über die Einbettung b0=h1 sowie frühere Block-Zusammenfassungen und die aktuelle Block-Teilsumme, während die Berechnung fortschreitet. Dadurch sinken Speicher- und Kommunikationsbedarf von O(Ld) auf O(Nd), wobei N die Anzahl der Blöcke ist.

Das Paper berichtet, dass mit rund acht Blöcken der Großteil des Nutzens der Vollversion erreicht wird und die Lücke zwischen Full AttnRes und Block AttnRes mit wachsendem Maßstab kleiner wird. Blockgrößen wie S=2,4,8 bleiben nahe an der Vollversion, während deutlich gröbere Gruppierungen wieder in Richtung Basisverhalten tendieren.

Die wichtigste Erkenntnis: Du brauchst keine vollumfängliche Attention über jede einzelne Schicht, um den Großteil des Gewinns mitzunehmen. Block AttnRes macht Attention über die Tiefe rechnerisch praktikabel, doch ein effizienter Einsatz im großen Maßstab erfordert weiterhin sorgfältiges Systemdesign. Das Paper stellt zudem mehrere Optimierungen vor, die AttnRes für Training und Inferenz in der Praxis tauglich machen.

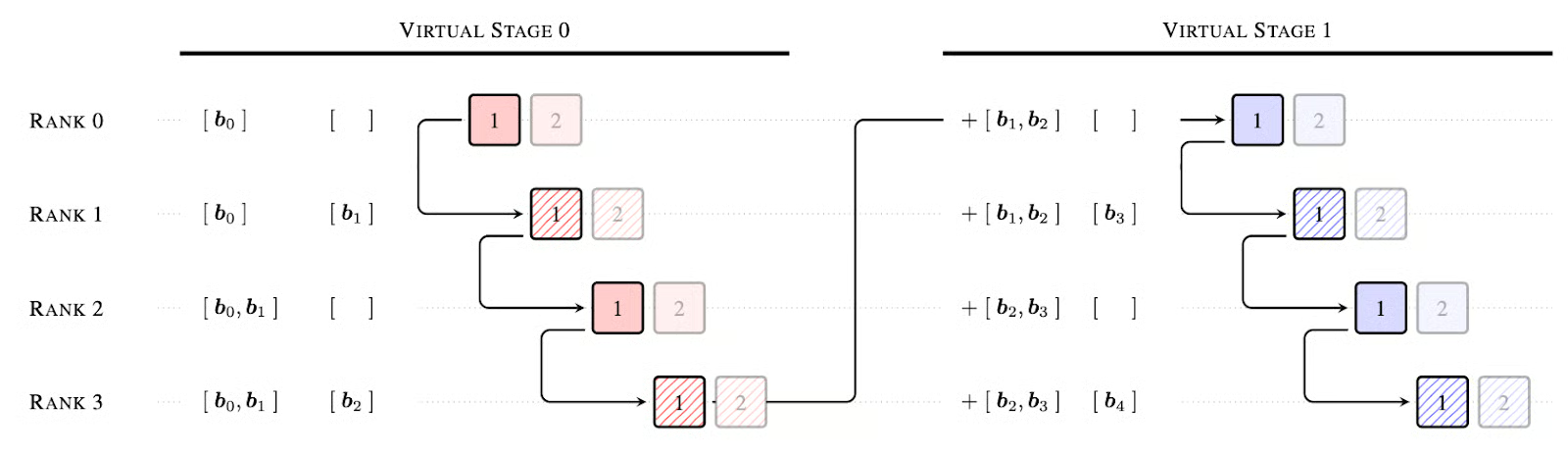

Abbildung 2: Beispiel für Cache-basierte Pipeline-Kommunikation mit 4 physischen Ranks und 2 virtuellen Stufen pro Rank; schraffierte Kästen markieren das Blockende von AttnRes (Attention Residuals Paper)

Hier sind drei zentrale Systemoptimierungen, die AttnRes zu einem Drop-in-Ersatz für Standard-Residuals machen:

- Zweistufige Berechnung: Durch Entkopplung des Pseudo-Querys vom Hidden State können wir Queries aller Schichten innerhalb eines Blocks bündeln. Phase 1 berechnet die Inter-Block-Attention parallel, Phase 2 verarbeitet die sequentären Intra-Block-Abhängigkeiten mithilfe eines Online-Softmax-Merge. Das reduziert das I/O pro Schicht deutlich gegenüber früheren Multi-Stream-Methoden wie mHC.

- Cross-Stage-Caching: In Pipeline-Parallelismus vermeiden wir redundante Datenübertragungen, indem zuvor empfangene Blöcke lokal gecacht werden. Das bringt eine V×-Verbesserung (V ist die Anzahl virtueller Stufen, siehe Abbildung 2) bei den Spitzenkosten je Übergang und erlaubt, Kommunikation vollständig mit Berechnung zu überlappen.

- Speichereffizientes Prefilling: Durch Sharding der Block-Repräsentationen über tensorparalle Geräte sinkt der Speicherbedarf für Long-Context-Sequenzen (128K+) um Größenordnungen (z. B. von 15 GB auf 0,3 GB pro Gerät).

Ergebnisse und Performance-Analyse

Das Paper validiert AttnRes auf mehreren Ebenen: Skalierungsgesetze, Ablationen, Trainingsdynamik und Downstream-Benchmarks.

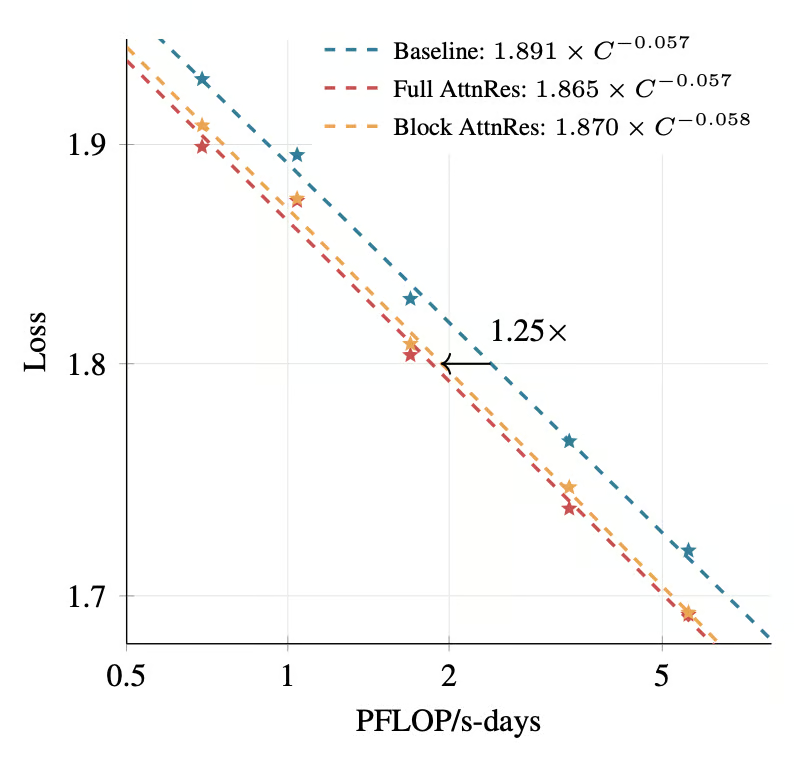

Abbildung 3: Skalierungskurven für Attention Residuals. (Attention Residuals Paper)

Das wichtigste Ergebnis stammt jedoch aus den Skalierungsgesetzen. Über fünf Modellgrößen hinweg erzielen sowohl Full AttnRes als auch Block AttnRes durchgehend eine niedrigere Validierungsverlustzahl als die Basis. Laut den angepassten Kurven erreicht Block AttnRes denselben Verlust wie ein Basismodell, das mit etwa 1,25× mehr Rechenaufwand trainiert wurde. Das deutet darauf hin, dass AttnRes nicht nur theoretisch besser ist, sondern auch compute-effizienter.

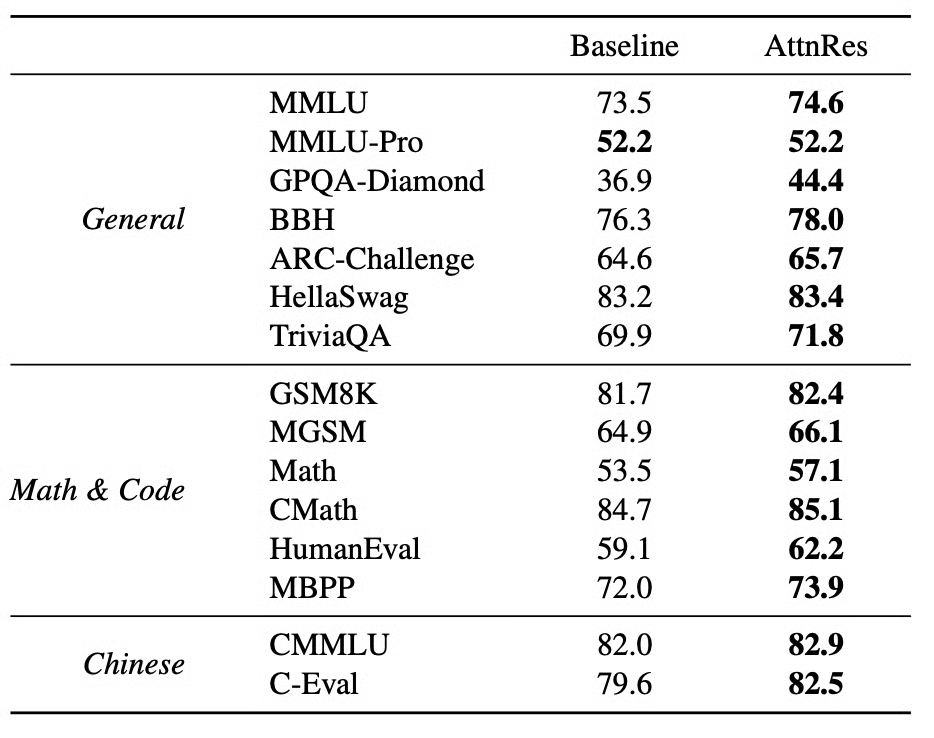

In Downstream-Aufgaben verbessert AttnRes die Ergebnisse gegenüber der Basis in allen bewerteten Benchmarks. Die größten Zuwächse zeigen sich bei aufwändigerem Reasoning, wie Tabelle 1 verdeutlicht:

Tabelle 1: Performancevergleich von AttnRes mit der Basis, beide nach demselben Pretraining-Rezept (Attention Residuals Paper)

Die Zugewinne sind besonders stark bei mehrschrittigem Reasoning, Mathematik und Code – passend zur Kernhypothese des Papers: Wenn spätere Schichten frühere Repräsentationen selektiv abrufen können, statt eine verschwommene Summe zu erben, verbessert sich die kompositionale Argumentation.

Im Vergleich zur Basis zeigt AttnRes während des gesamten Trainings niedrigere Validierungsverluste, begrenztere Ausgangsamplituden über die Tiefe und gleichmäßigere Gradientenstärken über die Schichten. Die Basis leidet unter dem üblichen PreNorm-Verdünnungsmuster, bei dem die Hidden-State-Größen monoton mit der Tiefe wachsen, während Block AttnRes dank selektiver Aggregation an Blockgrenzen ein kontrollierteres, begrenztes Muster erzeugt.

Außerdem zeigt sich auf Architekturebene: In einem Sweep mit festem Compute- und Parameterbudget verschiebt sich die optimale AttnRes-Konfiguration hin zu einem tieferen, schmaleren Modell im Vergleich zur Basis. Das legt nahe, dass AttnRes zusätzliche Tiefe nützlicher macht, als es mit Standard-Residualaggregation der Fall ist.

Fazit

Residuals werden oft als notwendiger Trainingstrick gesehen – ein Identitätskürzel, das Gradienten am Leben hält. AttnRes zeigt, dass dieser Blick zu eng ist. Residualpfade sind auch der Mechanismus, über den Information über die Tiefe geleitet wird, und feste additive Akkumulation ist für sehr tiefe Modelle womöglich zu grob.

Attention Residuals ist weniger ein Patch für ein bekanntes Problem, sondern eher ein Upgrade einer vernachlässigten Designentscheidung. Die Sequenzmodellierung ist von Rekurrenz zu Attention übergegangen, weil feste Rekurrenz zu restriktiv war. AttnRes argumentiert, dass die Tiefe nun für denselben Wandel bereit ist.

Das Modell zeigt weiterhin starke Lokalität – Schichten attendieren häufig am stärksten auf nahe Vorgänger –, lernt aber auch nichttriviale Übersprungmuster, erhält ein persistentes Gewicht auf der Einbettung und bewahrt unterschiedliches Verhalten zwischen Pre-Attention- und Pre-MLP-Schichten.

Die praktische Quintessenz ist nicht, dass alle Modelle Residuals durch volle Attention über die Tiefe ersetzen sollten. Vielmehr wird die Residualaggregation als zentrales architektonisches Designfeld neu gerahmt.

Attention Residuals FAQs

How is AttnRes different from standard residual connections?

Standard-Residuals summieren frühere Schichtausgaben mit festen Einheitsgewichten. AttnRes ersetzt das durch gelernte Softmax-Gewichte über frühere Schichten, sodass eine Schicht die relevantesten früheren Repräsentationen selektiv abrufen kann.

What problem is AttnRes trying to solve?

AttnRes adressiert die Grenzen gleichförmiger Residualakkumulation in der Tiefe – insbesondere das Wachstum der Hidden States, den Verlust selektiven Zugriffs auf frühere Schichten und den allgemeinen PreNorm-Verdünnungseffekt.

What is the difference between Full AttnRes and Block AttnRes?

Full AttnRes attendiert auf alle früheren Schichtausgaben. Block AttnRes gruppiert Schichten in Blöcke und attendiert über Block-Zusammenfassungen und Teilsummen, wodurch Speicher und Kommunikation von O(Ld) auf O(Nd) sinken.

Does AttnRes increase inference latency?

Ja, aber laut Paper hält die optimierte zweistufige Implementierung den End-to-End-Inferenzlatenz-Overhead bei typischen Workloads unter 2%.

What are the biggest reported gains?

Im großen Kimi-Linear-Experiment verbessert AttnRes die Ergebnisse in allen bewerteten Aufgaben gegenüber der Basis, mit deutlichen Zuwächsen bei GPQA-Diamond, Math und HumanEval.

Ich bin Google Developers Expertin für ML (Gen AI), dreifache Kaggle-Expertin und Women-Techmakers-Botschafterin mit über drei Jahren Erfahrung in der Tech-Branche. 2020 habe ich ein Health-Tech-Startup mitgegründet und absolviere derzeit einen Master in Informatik an der Georgia Tech mit Schwerpunkt Machine Learning.