programa

Dos de los lanzamientos de modelos más comentados de principios de 2026 llegan con enfoques muy distintos. Muse Spark de Meta es el primer modelo de Meta Superintelligence Labs y rompe de forma deliberada con la línea Llama. Claude Opus 4.6 de Anthropic llegó a principios de año como una mejora del nivel insignia de la compañía, con una ventana de contexto de 1 millón de tokens y la mejor puntuación en Terminal-Bench 2.0.

No es fácil elegir entre ambos. Muse Spark es multimodal de forma nativa, con tres modos de razonamiento diferenciados y un fuerte foco en la eficiencia de cómputo. Claude Opus 4.6 está pensado para programación con agentes, flujos de trabajo de larga duración y razonamiento profundo, con Agent Teams y pensamiento adaptativo integrados. Ambos son propietarios y solo en la nube, lo que ya reduce el abanico frente a alternativas de pesos abiertos.

En este artículo, compararé Muse Spark y Claude Opus 4.6 en seis dimensiones clave: arquitectura y filosofía de diseño, razonamiento y benchmarks, capacidades multimodales, funciones orientadas a agentes, acceso y disponibilidad, y privacidad y licencias.

Si te interesa aprender más sobre los modelos de lenguaje grande (LLMs) de Anthropic, te recomiendo nuestro curso Introduction to Claude Models. Además, no te pierdas nuestra otra comparativa sobre GPT-5.4 vs Claude Opus 4.6.

Actualización: Poco después de publicar este artículo, salió una nueva versión de Opus. Asegúrate de leer nuestra guía de Claude Opus 4.7.

¿Qué es Muse Spark?

Muse Spark es el primer modelo lanzado bajo la familia Muse, cuyo nombre en clave durante el desarrollo fue "Avocado". Lo construyó Meta Superintelligence Labs, una división que Meta creó en junio de 2025 tras una inversión de 14.300 millones de dólares que incluyó fichar a Alexandr Wang de Scale AI. El modelo se lanzó el 8 de abril de 2026.

La decisión de diseño clave detrás de Muse Spark fue reconstruir la canalización de entrenamiento desde cero. En lugar de extender la arquitectura de Llama, el equipo de Meta empezó de nuevo con multimodalidad nativa en texto, imágenes, audio y uso de herramientas. El resultado, según Meta, es un modelo que iguala el rendimiento de Llama 4 Maverick usando un orden de magnitud menos cómputo.

Muse Spark ofrece tres modos de razonamiento:

- Instant para respuestas rápidas

- Thinking para cadenas de razonamiento en problemas complejos

- Contemplating para razonamiento multiagente en paralelo (aún en despliegue gradual)

El modelo es solo en la nube, accesible vía meta.ai o la app de Meta AI, con una API en vista previa privada para socios empresariales seleccionados.

¿Qué es Claude Opus 4.6?

Claude Opus 4.6 es el último modelo insignia de Anthropic, lanzado a principios de 2026 como actualización de Opus 4.5. Anthropic lo describe como su nivel más inteligente, con foco en programación con agentes, razonamiento profundo y autocorrección. Lidera el benchmark de programación Terminal-Bench 2.0 y está a la altura de los mejores en otros como BrowseComp para investigación de información.

La cifra titular es la ventana de contexto de 1 millón de tokens, actualmente en beta. Esto sitúa a Opus 4.6 al nivel de Gemini 3 en longitud de contexto y lo hace viable para grandes bases de código y tareas agenticas de larga duración. Junto al modelo, Anthropic lanzó Agent Teams en Claude Code, permitiendo que varias instancias independientes de Claude trabajen en paralelo en una misma tarea.

Claude Opus 4.6 está disponible a través de la API de Claude (ID de modelo: claude-opus-4-6), Claude Code y Claude in PowerPoint. Es propietario y solo en la nube, sin versión de pesos abiertos.

Comparativa cara a cara: Muse Spark vs Claude Opus 4.6

Sin rodeos, comparemos ambos modelos en algunas categorías relevantes.

Guía rápida para decidir

Si quieres una respuesta rápida antes de entrar en detalles, esta tabla mapea escenarios comunes con el modelo más adecuado.

| Caso de uso | Recomendado | Por qué |

|---|---|---|

| Programación con agentes en paralelo | Claude Opus 4.6 | Agent Teams en Claude Code, 80,8 en SWE-Bench Verified |

| Análisis de documentos con contexto largo | Claude Opus 4.6 | Ventana de contexto de 1M de tokens (beta) |

| Razonamiento multimodal (texto + imágenes + audio) | Muse Spark | Multimodalidad nativa desde el diseño, cadena de razonamiento visual |

| Inferencia eficiente en cómputo | Muse Spark | Iguala a Llama 4 Maverick con 10 veces menos cómputo |

| Matemáticas y razonamiento complejos | Claude Opus 4.6 | Mejores puntuaciones en benchmarks de razonamiento |

| Acceso a API para empresa | Claude Opus 4.6 | API pública disponible; la API de Muse Spark es solo vista previa privada |

| Razonamiento extremo en múltiples pasos | Muse Spark (Contemplating) | Modo de razonamiento multiagente en paralelo; compite con Gemini Deep Think y GPT Pro |

| Integración con PowerPoint y Excel | Claude Opus 4.6 | Claude in PowerPoint y Claude in Excel son integraciones ya disponibles |

| Casos de uso relacionados con salud | Muse Spark | Punto fuerte de Muse Spark: 42,8 vs 14,8 en HealthBench Hard |

Arquitectura y filosofía de diseño

Cómo se construye un modelo condiciona en qué destaca. Muse Spark y Claude Opus 4.6 reflejan apuestas realmente distintas sobre hacia dónde debe ir la IA de frontera.

Meta reconstruyó desde cero su pipeline de entrenamiento para Muse Spark. El modelo es multimodal de forma nativa, es decir, texto, imágenes, audio y uso de herramientas se entrenaron juntos y no como un añadido posterior. Es un contraste directo con la serie Llama, que la propia Meta describió como basada en reconocimiento de patrones.

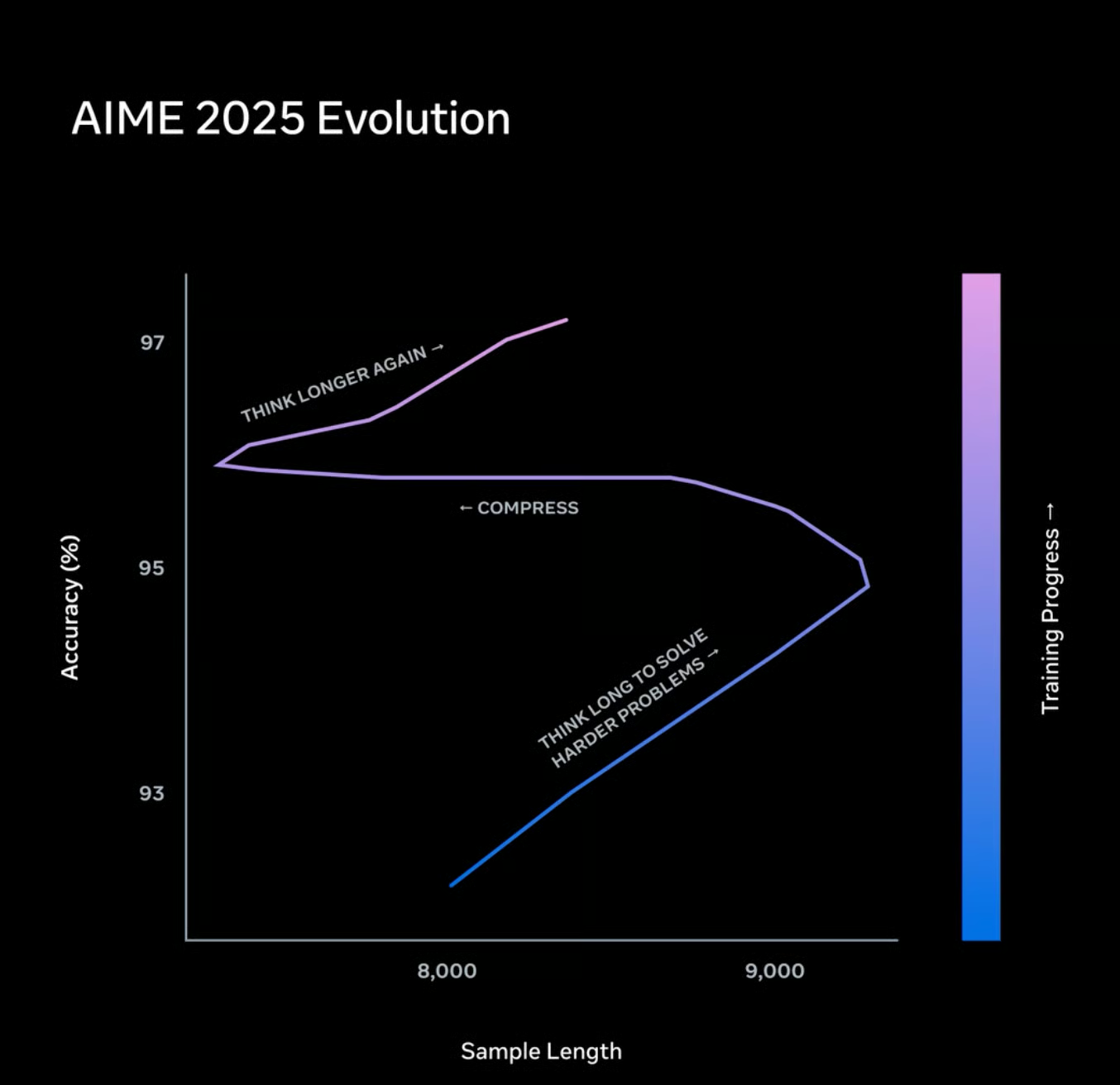

Una de las decisiones técnicas más interesantes es Thought Compression, una técnica de aprendizaje por refuerzo que penaliza el exceso de tokens durante el razonamiento. El objetivo es la eficiencia: empujar al modelo a razonar bien sin generar pasos intermedios innecesarios. Esto explica en parte por qué Muse Spark puede igualar a Llama 4 Maverick con una fracción del coste computacional.

El enfoque de diseño de Anthropic para Opus 4.6 prioriza la acción sostenida frente al rendimiento en un solo turno. El modelo está hecho para planificar con cuidado, mantener la coherencia durante largos periodos e identificar errores en su propio razonamiento. El pensamiento adaptativo permite al modelo decidir si un prompt justifica una cadena de razonamiento extendida, y el parámetro de esfuerzo da a los desarrolladores control manual sobre ese equilibrio.

Los niveles de esfuerzo merecen la pena si usas la API:

- Max effort: Siempre usa razonamiento extendido, sin límites de profundidad

- High effort: Por defecto; siempre razona y ofrece profundidad

- Medium effort: Razonamiento moderado, puede omitirlo en consultas simples

- Low effort: Omite el razonamiento en tareas simples y prioriza la velocidad

La pila reconstruida de Muse Spark es una apuesta arquitectónica más radical, y su historia de eficiencia de cómputo es realmente llamativa. El pensamiento adaptativo y los controles de esfuerzo de Claude Opus 4.6 son más útiles de inmediato para desarrolladores que necesitan un control fino del coste frente a la exhaustividad.

Razonamiento

Las cifras de benchmarks no son perfectas, pero son la señal más clara que tenemos para comparar modelos que la mayoría aún no ha probado en paralelo.

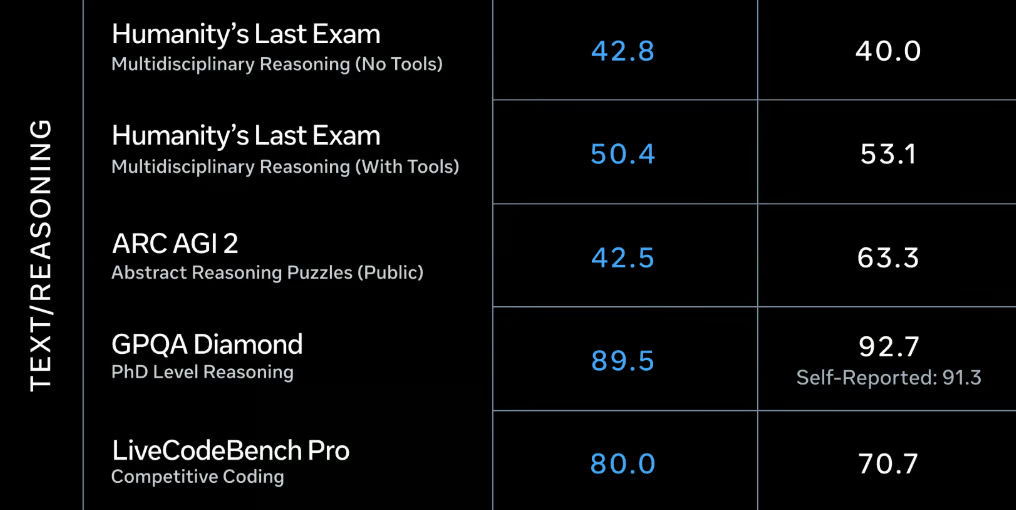

Benchmarks de texto/razonamiento. Puntuaciones de Muse Spark (Thinking) a la izquierda, Claude Opus 4.6 (Max) a la derecha. Fuente: Meta

Al comparar ambos modelos en el ámbito de texto/razonamiento, se observan estos patrones:

- En razonamiento relacionado con programación, Claude Opus 4.6 toma la delantera, como cabría esperar (80,0 vs 70,7 en LiveCodeBench Pro)

- Lo mismo ocurre con rompecabezas de razonamiento abstracto, medidos en ARC AGI 2, donde la diferencia es aún mayor (63,3 vs 42,5 para Muse Spark)

- En GPQA Diamond y Humanity's Last Exam, van muy igualados. Un dato interesante en este último es que Muse Spark aventaja ligeramente sin uso de herramientas, mientras que Opus 4.6 logra mejor puntuación con herramientas. Según Meta, el modo Contemplating lleva a Muse Spark a 50,2 sin y 58,4 con herramientas, situándolo en lo alto del ranking

En conjunto, Claude Opus 4.6 parece la mejor opción cuando se requiere razonamiento muy abstracto, mientras que Muse Spark está a la par en sentido común y razonamiento por dominio.

Capacidades multimodales

Ambos modelos manejan más que texto, pero la profundidad de ese soporte difiere bastante.

La multimodalidad es central en la identidad de Muse Spark, no un añadido. El modelo se entrenó de forma nativa con texto, imágenes, audio y datos estructurados juntos. La cadena de razonamiento visual es una función específica: el modelo puede resolver problemas basados en imágenes paso a paso, no solo describir lo que ve. El uso de herramientas también es nativo, lo que importa para flujos agenticos que invocan APIs externas o procesan datos estructurados junto a entradas no estructuradas.

Claude Opus 4.6 admite entradas multimodales, pero sus notas de investigación no lo describen como multimodal nativo en el mismo sentido arquitectónico que Muse Spark. Su integración multimodal más destacada está en la salida: Claude in PowerPoint genera objetos de diapositiva editables en lugar de imágenes, y Claude in Excel rastrea dependencias de fórmulas entre hojas.

Benchmarks multimodales. Puntuaciones de Muse Spark (Thinking) a la izquierda, Claude Opus 4.6 (Max) a la derecha. Fuente: Meta

En el terreno multimodal, Muse Spark muestra músculo: supera a Claude Opus 4.6 en todos los benchmarks citados. Destacan especialmente estos resultados:

- Muse Spark lidera el benchmark CharXiv Reasoning para comprensión de figuras con 86,4 (Claude Opus 4.6: 65,3)

- En comprensión multimodal (80,4 en MMMU Pro), Muse Spark está a la altura del líder actual, GPT-5.4

- Tanto en razonamiento encarnado (64,7 vs 51,6 en ERQA) como en factualidad visual (71,3 vs 62,2 en SimpleVQA), Muse Spark logra puntuaciones significativamente mejores que Opus 4.6

Para tareas que mezclan texto, imágenes y audio a nivel de modelo, Muse Spark tiene una base más sólida. Para flujos empresariales con documentos y hojas de cálculo, las integraciones de Claude Opus 4.6 son más prácticas de inmediato.

Funciones orientadas a agentes

Ambos modelos se posicionan para casos de uso con agentes, pero abordan el problema de forma distinta.

El modo Contemplating de Muse Spark es su apuesta agentica. En lugar de que un único modelo razone de forma secuencial, Contemplating lanza varios agentes en paralelo, cada uno trabajando en una parte del problema, con verificación cruzada de resultados. Es similar en espíritu a Agent Teams de Claude, pero integrado en el propio modo de razonamiento en lugar de exponerse como una función separada de API.

Agent Teams en Claude Code es la función agentica destacada en Opus 4.6. Puedes lanzar varias instancias independientes de Claude, con una como coordinadora y otras ejecutando tareas, cada una con su propia ventana de contexto. Esto evita que los flujos en paralelo compitan por el mismo presupuesto de tokens, aunque los costes pueden multiplicarse rápido. Anthropic recomienda Agent Teams para escenarios de alta complejidad en los que la ejecución paralela justifique el gasto.

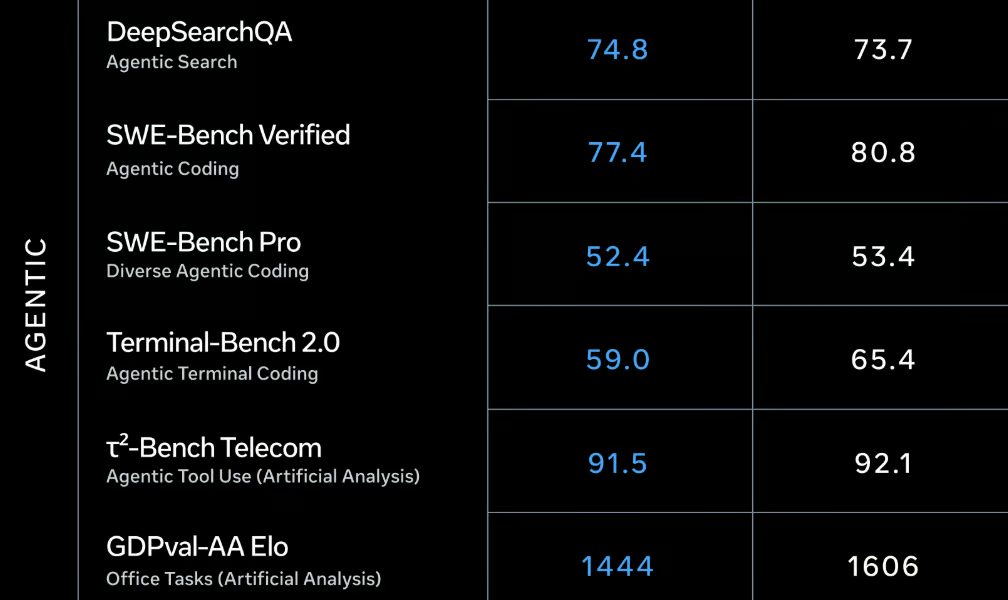

Benchmarks agenticos. Puntuaciones de Muse Spark (Thinking) a la izquierda, Claude Opus 4.6 (Max) a la derecha. Fuente: Meta

En general, la mayoría de puntuaciones en benchmarks de agentes son bastante similares entre ambos modelos, pero Opus 4.6 tiene una ligera ventaja sobre Muse Spark. Observaciones más notables:

- En los tres benchmarks de programación con agentes (SWE-Bench Verified y Pro, Terminal-Bench 2.0), Opus 4.6 va en cabeza. Aun así, las puntuaciones de Muse Spark son muy buenas, especialmente considerando que Opus 4.6 lidera Terminal-Bench 2.0 (65,4 vs 59,0 aquí)

- En GDPval-AA, que mide tareas de oficina cotidianas, se da la mayor brecha entre ambos. Claude Opus 4.6 (1606) ocupa el segundo lugar tras su hermano pequeño, Claude Sonnet 4.6 (1633), y Muse Spark queda claramente por detrás (1444)

- Muse Spark supera a Claude Opus 4.6 en búsqueda con agentes (74,8 vs 73,7 en DeepSearchQA), algo llamativo

Las capacidades agenticas de Claude Opus 4.6 son más maduras y mejores para la mayoría de tareas. El modo Contemplating de Muse Spark es prometedor, pero aún está desplegándose, lo que limita lo que hoy puedes construir con él.

Casos de uso en salud

Aunque no es una categoría clásica para comparar LLMs, el rendimiento en escenarios relacionados con la salud merece mención, ya que uno de los objetivos clave de Muse Spark es ayudar a las personas a aprender sobre su salud y mejorarla. Meta colaboró con más de 1.000 médicos para seleccionar datos de formación médica sobre consultas cotidianas como el contenido nutricional de los alimentos o los músculos que se activan durante el ejercicio.

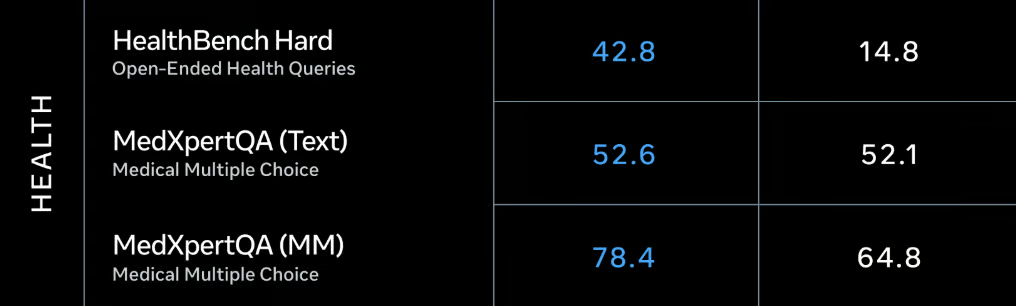

Benchmarks de salud. Puntuaciones de Muse Spark (Thinking) a la izquierda, Claude Opus 4.6 (Max) a la derecha. Fuente: Meta

El foco en salud se refleja en las puntuaciones. Como pauta general, cuanto menos estandarizadas son las consultas de salud, más se amplía la diferencia entre los dos modelos.

- Claude Opus 4.6 compite en evaluaciones médicas tipo test (52,1 vs 52,6 en la versión de texto de MedXpertQA)

- En evaluaciones multimodales tipo test, la brecha se amplía: Muse Spark aventaja a Opus 4.6 por más de diez puntos en la versión multimedia de MedXpertQA

- Por último, en consultas abiertas de salud, Muse Spark casi triplica la puntuación de Opus 4.6 (42,8 vs 14,8 en HealthBench Hard)

En combinación con las habilidades multimodales de Muse Spark, esto abre un abanico de aplicaciones muy interesantes para el día a día. Piensa en sacar una foto de tu nevera y recibir un plan de comidas personalizado para la semana según tus objetivos nutricionales. Habrá que ver cómo rinden estas herramientas en la práctica, pero suena prometedor.

Acceso

Ambos modelos son propietarios y solo en la nube, pero su disponibilidad difiere bastante.

Muse Spark está disponible vía meta.ai y la app Meta AI, ambas requieren una cuenta de Meta. Existe una API en vista previa privada para determinados socios empresariales, pero no hay API pública ni fecha confirmada para un acceso más amplio. Meta ha afirmado que espera abrir el código de futuras versiones de Muse, pero Muse Spark en sí es de código cerrado, sin opción de descarga ni de ajuste fino.

Sobre privacidad: la política de Meta permite usar datos de conversación para mejorar el modelo. Si trabajas con datos sensibles, conviene tenerlo en cuenta antes de enrutar nada por Muse Spark.

Claude Opus 4.6 está disponible mediante la API pública de Claude usando el ID de modelo claude-opus-4-6. También se puede acceder desde la interfaz web de Claude, Claude Code, Claude Cowork y las apps móviles de Claude para iOS/Android. En la web, el acceso está limitado a suscriptores de pago. Agent Teams es experimental en Claude Code.

Si necesitas acceso por API hoy, Claude Opus 4.6 es la única opción. La API en vista previa privada de Muse Spark implica que la mayoría de desarrolladores aún no pueden construir con ella, por muy bueno que sea el modelo.

Muse Spark vs Claude Opus 4.6: ¿cuál deberías elegir?

Dado que los puntos fuertes y débiles de ambos modelos son bastante distintos, podemos recomendar con claridad los casos de uso para cada uno.

Cuándo elegir Muse Spark

Muse Spark encaja mejor en un conjunto concreto de escenarios, la mayoría centrados en entradas multimodales y eficiencia de cómputo.

- Tu flujo de trabajo mezcla texto, imágenes y audio a nivel de modelo, no solo como adjuntos

- Tu caso de uso está relacionado con preguntas médicas

- Necesitas cadenas de razonamiento visual en problemas basados en imágenes

- El coste de cómputo es un límite y buscas rendimiento de frontera con menor coste de inferencia

- Trabajas en problemas que se benefician de verificación multiagente en paralelo (cuando el modo Contemplating esté plenamente disponible)

- Ya estás en el ecosistema de Meta y tienes acceso a la API de vista previa para empresas

Un aviso honesto: el acceso público a Muse Spark es limitado por ahora. Si no puedes entrar en la vista previa para empresas, lo usarás a través de meta.ai, que sirve para explorar, pero no para montar flujos en producción.

Cuándo elegir Claude Opus 4.6

Claude Opus 4.6 es hoy la opción más sólida para la mayoría de desarrolladores y data scientists, sobre todo porque es accesible de verdad.

-

Necesitas una API pública con un ID de modelo documentado (

claude-opus-4-6) -

Tu principal caso de uso es la programación con agentes, especialmente con Claude Code y Agent Teams

-

Trabajas con grandes bases de código que se benefician de una ventana de contexto de 1 millón de tokens

-

Quieres rendimiento de primer nivel en benchmarks de programación

-

Buscas control fino sobre la profundidad del razonamiento mediante el parámetro de esfuerzo

-

Tu equipo usa PowerPoint o Excel y quiere IA integrada directamente en esas herramientas

Agent Teams aún es experimental, y los costes de tokens se multiplican rápido al ejecutar agentes en paralelo. Pero para tareas complejas de desarrollo de software, el modelo de ejecución paralela es realmente útil, y la compactación de conversaciones mantiene a los agentes de larga duración en el camino.

Reflexiones finales

La realidad es que estos dos modelos ahora mismo no compiten por los mismos usuarios. Claude Opus 4.6 es un modelo maduro, accesible, líder en benchmarks, con API pública, funciones documentadas e integraciones reales. Muse Spark es un primer lanzamiento técnicamente interesante de un nuevo laboratorio, con acceso público limitado y menos métricas publicadas. Esa brecha puede cerrarse rápido, pero es la situación en abril de 2026.

Si eres desarrollador o data scientist y necesitas construir algo hoy, Claude Opus 4.6 es la opción práctica. Las puntuaciones en benchmarks de programación, la ventana de 1M de tokens y Agent Teams en Claude Code son cosas que puedes usar ya. La multimodalidad nativa y la Thought Compression de Muse Spark son realmente interesantes, pero es más difícil evaluarlas sin un acceso a API más amplio.

Donde vigilaría de cerca a Muse Spark es en tareas de razonamiento multimodal cuando el modo Contemplating esté totalmente desplegado. El enfoque multiagente en paralelo para problemas difíciles es una apuesta distinta a simplemente escalar los tokens de inferencia, y si las promesas de eficiencia de Meta se confirman en pruebas independientes, su historia de costes computacionales será muy convincente para cargas en producción.

Si te interesa desarrollar aplicaciones de IA, te recomiendo encarecidamente apuntarte a nuestro AI Engineering with LangChain skill track. El contenido didáctico es AI-native, lo que significa que tendrás un tutor personal que te enseña exactamente lo que necesitas desde tu nivel para convertirte en un verdadero profesional diseñando flujos de trabajo de IA.

Editor de ciencia de datos en DataCamp | Me encanta hacer previsiones y crear con API.