Cursus

Deux des sorties de modèles les plus commentées du début 2026 viennent d’horizons très différents. Muse Spark de Meta est le premier modèle issu de Meta Superintelligence Labs et marque une rupture assumée avec la lignée Llama. Claude Opus 4.6 d’Anthropic est arrivé plus tôt dans l’année comme une mise à niveau de son échelon phare, avec une fenêtre de contexte d’un million de tokens et le meilleur score sur Terminal-Bench 2.0.

Le choix entre les deux n’a rien d’évident. Muse Spark est nativement multimodal, propose trois modes de raisonnement distincts et met l’accent sur l’efficacité de calcul. Claude Opus 4.6 est conçu pour le code agentique, les workflows de longue durée et le raisonnement approfondi, avec Agent Teams et une pensée adaptative intégrées. Tous deux sont propriétaires et accessibles uniquement dans le cloud, ce qui réduit d’emblée le champ face aux alternatives à poids ouverts.

Dans cet article, je compare Muse Spark et Claude Opus 4.6 selon six axes : architecture et philosophie de conception, raisonnement et benchmarks, capacités multimodales, fonctionnalités agentiques, accès et disponibilité, ainsi que confidentialité et licences.

Si vous souhaitez en savoir plus sur les grands modèles de langage (LLM) d’Anthropic, je vous recommande notre cours Introduction to Claude Models. Consultez également notre autre comparatif GPT-5.4 vs Claude Opus 4.6.

Mise à jour : Peu après la publication de cet article, une nouvelle version d’Opus est sortie. Lisez notre guide Claude Opus 4.7.

Qu’est-ce que Muse Spark ?

Muse Spark est le premier modèle publié sous la marque Muse, au départ nom de code « Avocado » pendant son développement. Il a été conçu par Meta Superintelligence Labs, une division créée par Meta en juin 2025 après un investissement annoncé de 14,3 milliards de dollars, incluant le recrutement d’Alexandr Wang depuis Scale AI. Le modèle a été lancé le 8 avril 2026.

La décision clef derrière Muse Spark est une chaîne d’entraînement entièrement repensée. Plutôt que d’étendre l’architecture Llama, l’équipe de Meta est repartie de zéro avec une multimodalité native couvrant texte, images, audio et usage d’outils. Résultat : selon Meta, le modèle égale les performances de Llama 4 Maverick avec un ordre de grandeur de calcul en moins.

Muse Spark propose trois modes de raisonnement :

- Instant pour des réponses rapides

- Thinking pour des chaînes de pensée sur des problèmes complexes

- Contemplating pour un raisonnement multi-agents en parallèle (déploiement progressif en cours)

Le modèle est accessible uniquement dans le cloud, via meta.ai ou l’application Meta AI, avec une API en aperçu privé pour certains partenaires entreprise.

Qu’est-ce que Claude Opus 4.6 ?

Claude Opus 4.6 est le dernier modèle phare d’Anthropic, publié début 2026 en mise à niveau d’Opus 4.5. Anthropic le présente comme son échelon le plus performant, axé sur le code agentique, le raisonnement profond et l’auto-correction. Il domine le benchmark de codage Terminal-Bench 2.0 et se place au niveau des meilleurs sur plusieurs autres benchmarks, comme BrowseComp pour la recherche d’information.

Le chiffre marquant est la fenêtre de contexte d’un million de tokens, actuellement en bêta. Cela aligne Opus 4.6 sur Gemini 3 en longueur de contexte et le rend pertinent pour de grands codebases et des tâches agentiques de longue durée. En parallèle, Anthropic a lancé Agent Teams dans Claude Code, permettant à plusieurs instances indépendantes de Claude de travailler en parallèle sur une même tâche.

Claude Opus 4.6 est disponible via l’API Claude (ID du modèle : claude-opus-4-6), Claude Code, et Claude in PowerPoint. Il est propriétaire et cloud-only, sans version à poids ouverts.

Muse Spark vs Claude Opus 4.6 : comparaison directe

Entrons sans tarder dans la comparaison sur quelques catégories pertinentes.

Guide de décision rapide

Si vous voulez une réponse rapide avant les détails, ce tableau fait correspondre des scénarios courants au modèle le plus adapté.

| Cas d’usage | Recommandé | Pourquoi |

|---|---|---|

| Code agentique avec agents parallèles | Claude Opus 4.6 | Agent Teams dans Claude Code, 80,8 sur SWE-Bench Verified |

| Analyse de documents à long contexte | Claude Opus 4.6 | Fenêtre de contexte 1 M de tokens (bêta) |

| Raisonnement multimodal (texte + images + audio) | Muse Spark | Multimodalité native, chaîne de pensée visuelle |

| Inférence économe en calcul | Muse Spark | Égale Llama 4 Maverick avec 10× moins de calcul |

| Maths et raisonnement complexes | Claude Opus 4.6 | Meilleurs scores sur les benchmarks de raisonnement |

| Accès API entreprise | Claude Opus 4.6 | API publique disponible ; API Muse Spark en aperçu privé uniquement |

| Raisonnement multi-étapes extrême | Muse Spark (Contemplating) | Mode de raisonnement multi-agents en parallèle ; rivalise avec Gemini Deep Think et GPT Pro |

| Intégration PowerPoint et Excel | Claude Opus 4.6 | Claude in PowerPoint et Claude in Excel sont déjà opérationnels |

| Cas d’usage santé | Muse Spark | Point fort de Muse Spark : 42,8 vs 14,8 sur HealthBench Hard |

Architecture et philosophie de conception

La manière dont un modèle est bâti conditionne ses points forts. Muse Spark et Claude Opus 4.6 incarnent de vrais paris différents sur la trajectoire de l’IA de pointe.

Meta a reconstruit sa chaîne d’entraînement à partir de zéro pour Muse Spark. Le modèle est nativement multimodal : texte, images, audio et usage d’outils ont été entraînés ensemble, et non ajoutés après coup. C’est l’inverse de la série Llama, que Meta elle-même décrivait comme fondée sur la reconnaissance de motifs.

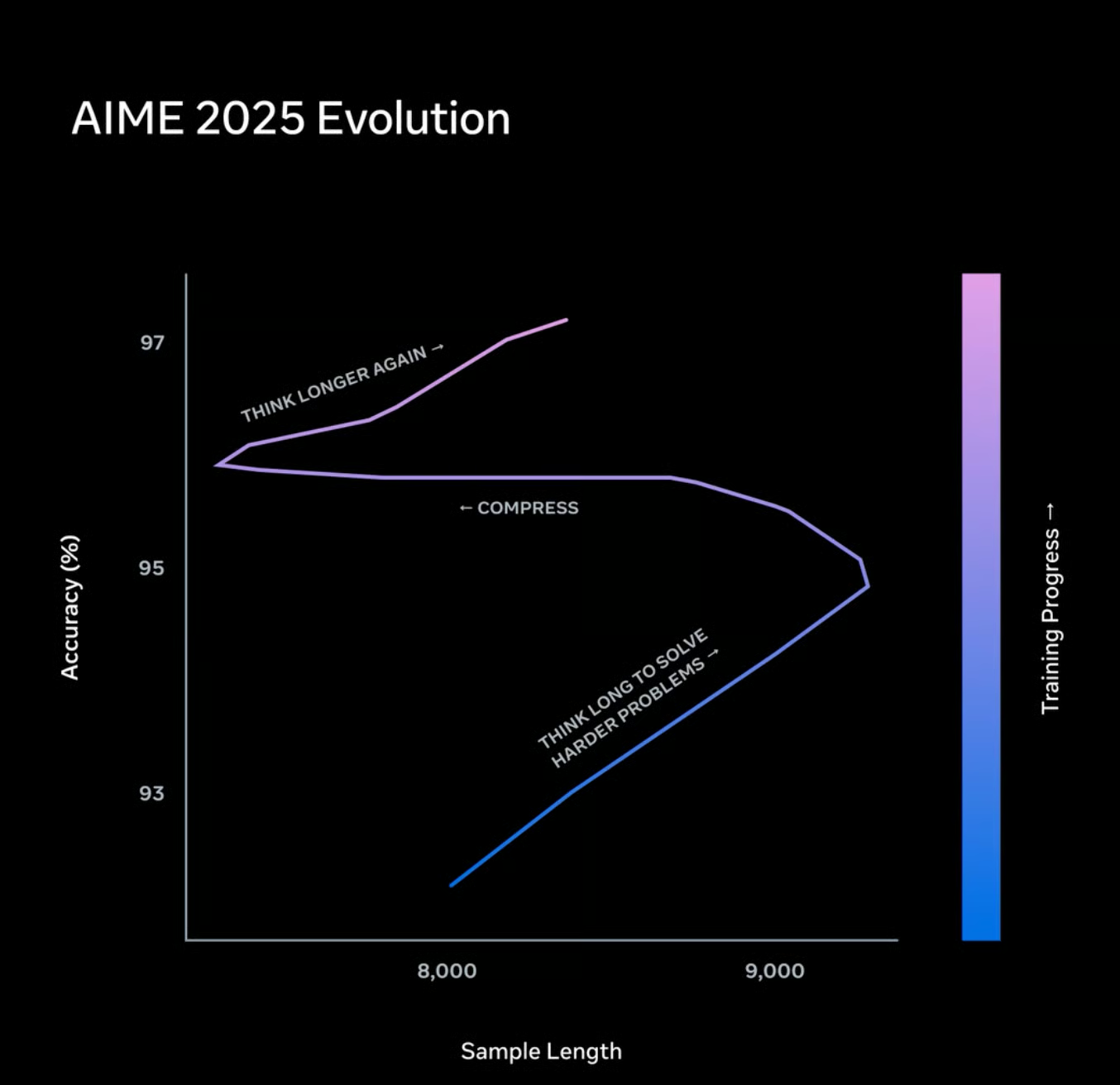

Un choix technique notable est la « compression de pensée » (Thought Compression), une technique d’apprentissage par renforcement qui pénalise les tokens superflus durant le raisonnement. L’objectif : l’efficacité ; pousser le modèle à bien raisonner sans générer d’étapes intermédiaires inutiles. C’est l’une des raisons pour lesquelles Muse Spark peut égaler Llama 4 Maverick avec une fraction du coût de calcul.

La priorité de conception d’Anthropic pour Opus 4.6 est l’action soutenue plutôt que la performance en un seul tour. Le modèle est conçu pour planifier avec soin, maintenir la cohérence dans la durée et identifier ses propres erreurs de raisonnement. La pensée adaptative lui permet de décider si une invite justifie une chaîne de pensée étendue, et le paramètre d’effort donne aux développeurs un contrôle manuel sur ce compromis.

Les niveaux d’effort sont à connaître si vous utilisez l’API :

- Max effort : pensée étendue systématique, sans limite de profondeur

- High effort : par défaut ; raisonnement approfondi systématique

- Medium effort : pensée modérée, peut l’omettre pour des requêtes simples

- Low effort : saute la pensée pour les tâches simples, priorité à la vitesse

La pile reconstruite de Muse Spark représente une rupture architecturale plus radicale, et son efficacité de calcul est vraiment impressionnante. La pensée adaptative et les contrôles d’effort de Claude Opus 4.6 sont plus immédiatement utiles aux développeurs qui veulent affiner coût et approfondissement.

Raisonnement

Les chiffres de benchmarks sont des indicateurs imparfaits, mais restent le meilleur signal pour comparer des modèles que peu de gens ont encore testé côte à côte.

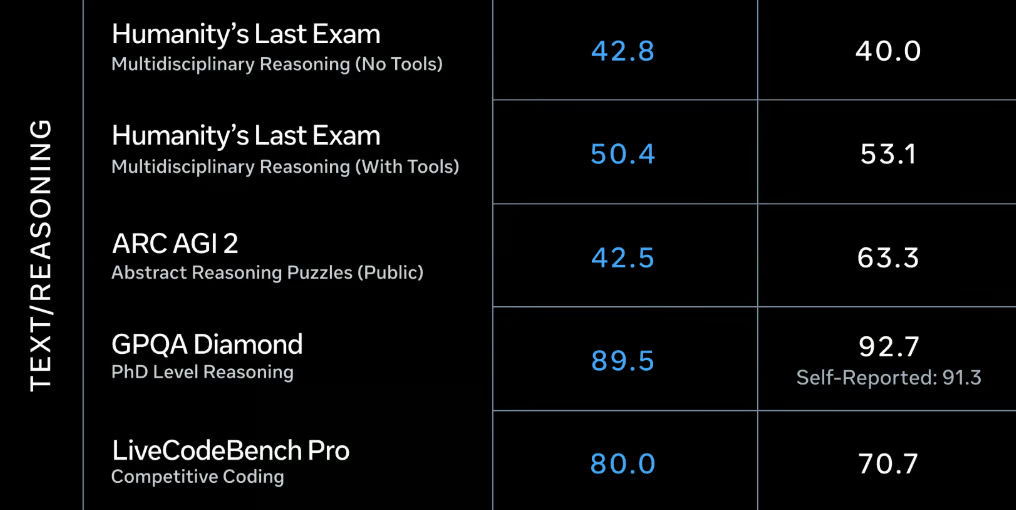

Benchmarks texte/raisonnement. Scores de Muse Spark (Thinking) à gauche, Claude Opus 4.6 (Max) à droite. Source : Meta

En comparant les deux modèles sur le volet texte/raisonnement, on observe les tendances suivantes :

- Pour le raisonnement lié au codage, Claude Opus 4.6 prend l’avantage, comme attendu (80,0 vs 70,7 sur LiveCodeBench Pro)

- Même constat pour les casse-têtes d’abstraction, mesurés sur ARC AGI 2, où l’écart est encore plus marqué (63,3 vs 42,5 pour Muse Spark)

- Sur GPQA Diamond et Humanity's Last Exam, les deux sont au coude-à-coude. Point intéressant pour ce dernier benchmark : Muse Spark devance légèrement en raisonnement sans outils, tandis qu’Opus 4.6 obtient un meilleur score avec outils. Selon Meta, le mode Contemplating amène Muse Spark à 50,2 sans outils et 58,4 avec, le plaçant en tête du classement

Globalement, Claude Opus 4.6 semble le meilleur choix lorsque l’on exige un raisonnement très abstrait, tandis que Muse Spark tient la cadence en bon sens et en raisonnement orienté domaine.

Capacités multimodales

Les deux modèles vont au-delà du texte, mais la profondeur de prise en charge diffère nettement.

La multimodalité est au cœur de l’ADN de Muse Spark, pas un module ajouté. Le modèle a été entraîné nativement et conjointement sur texte, images, audio et données structurées. La chaîne de pensée visuelle est une fonctionnalité dédiée : le modèle peut raisonner étape par étape sur des problèmes basés image, et pas seulement décrire ce qu’il voit. L’usage d’outils est également natif, ce qui compte pour des workflows agentiques impliquant des appels à des API externes ou le traitement de données structurées aux côtés d’entrées non structurées.

Claude Opus 4.6 prend en charge des entrées multimodales, mais ses notes de recherche ne le décrivent pas comme nativement multimodal au même sens architectural que Muse Spark. Son intégration multimodale phare se situe côté sortie : Claude in PowerPoint génère des objets de diapos modifiables plutôt que des images, et Claude in Excel suit les dépendances de formules entre feuilles.

Benchmarks multimodaux. Scores de Muse Spark (Thinking) à gauche, Claude Opus 4.6 (Max) à droite. Source : Meta

Sur le volet multimodal, Muse Spark montre sa force : il devance Claude Opus 4.6 dans tous les benchmarks cités. Les résultats suivants sont notamment impressionnants :

- Muse Spark arrive en tête sur CharXiv Reasoning pour la compréhension de figures, avec 86,4 (Claude Opus 4.6 : 65,3)

- En compréhension multimodale (80,4 sur MMMU Pro), Muse Spark est au niveau du leader actuel, GPT-5.4

- En raisonnement incarné (64,7 vs 51,6 sur ERQA) comme en factualité visuelle (71,3 vs 62,2 sur SimpleVQA), Muse Spark surpasse nettement Opus 4.6

Pour des tâches mêlant texte, images et audio au niveau du modèle, Muse Spark dispose d’une base plus solide. Pour les workflows d’entreprise centrés documents et feuilles de calcul, les intégrations de Claude Opus 4.6 sont plus immédiatement pratiques.

Fonctionnalités agentiques

Les deux modèles ciblent des cas d’usage agentiques, mais avec des approches différentes.

Le mode Contemplating de Muse Spark est sa réponse agentique. Plutôt qu’un seul modèle raisonnant séquentiellement, Contemplating lance plusieurs agents en parallèle, chacun sur une partie du problème, avec vérification croisiée des résultats. L’idée rappelle Agent Teams de Claude, mais intégrée au mode de raisonnement plutôt qu’exposée comme une fonctionnalité API distincte.

Agent Teams dans Claude Code est la fonctionnalité agentique marquante d’Opus 4.6. Vous pouvez lancer plusieurs instances indépendantes de Claude, l’une jouant le coordinateur, les autres l’exécution, chacune avec sa propre fenêtre de contexte. Ainsi, les flux de travail parallèles ne se disputent pas le même budget de tokens, mais les coûts peuvent grimper vite. Anthropic recommande Agent Teams pour des scénarios très complexes où l’exécution parallèle justifie la dépense.

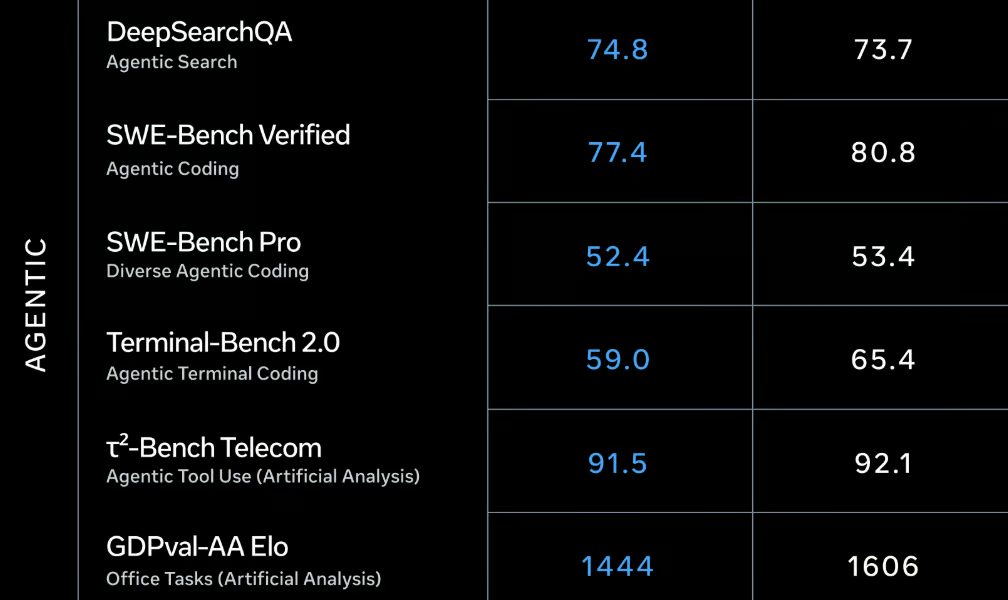

Benchmarks agentiques. Scores de Muse Spark (Thinking) à gauche, Claude Opus 4.6 (Max) à droite. Source : Meta

Globalement, la plupart des scores agentiques sont assez proches, mais Opus 4.6 conserve un léger avantage. Points à retenir :

- Sur les trois benchmarks de code agentique (SWE-Bench Verified et Pro, Terminal-Bench 2.0), Opus 4.6 mène. Cela dit, les scores de Muse Spark restent très solides, d’autant qu’Opus 4.6 est premier sur Terminal-Bench 2.0 (65,4 vs 59,0 ici)

- Sur GDPval-AA, qui mesure les tâches de bureau du quotidien, l’écart est le plus marqué. Claude Opus 4.6 (1606) est second derrière son petit frère, Claude Sonnet 4.6 (1633), et Muse Spark est nettement derrière (1444)

- Muse Spark dépasse Claude Opus 4.6 en recherche agentique (74,8 vs 73,7 sur DeepSearchQA), ce qui surprend

Les capacités agentiques de Claude Opus 4.6 sont plus mûres et mieux adaptées à la plupart des tâches. Le mode Contemplating de Muse Spark est prometteur mais encore en déploiement progressif, ce qui limite aujourd’hui ce que vous pouvez construire avec.

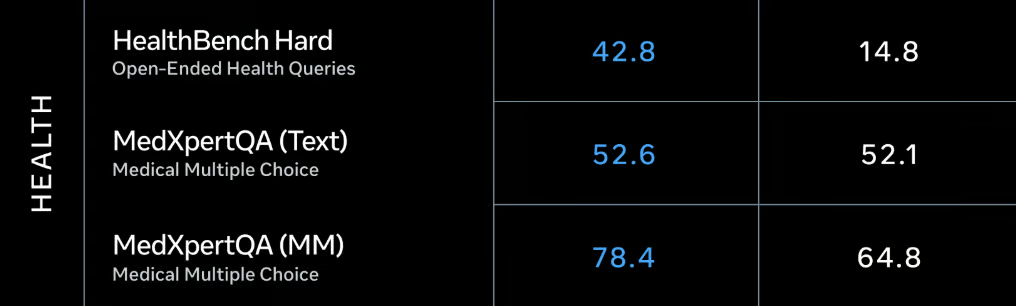

Cas d’usage santé

Ce n’est pas une catégorie classique pour comparer des LLM, mais la performance sur des scénarios liés à la santé mérite d’être soulignée, car l’un des objectifs clefs de Muse Spark est d’aider les gens à mieux comprendre et améliorer leur santé. Meta a collaboré avec plus de 1 000 médecins pour constituer des données d’entraînement médicales sur des questions de santé du quotidien comme la teneur nutritionnelle des aliments ou les muscles sollicités pendant l’exercice.

Benchmarks santé. Scores de Muse Spark (Thinking) à gauche, Claude Opus 4.6 (Max) à droite. Source : Meta

L’orientation santé se reflète dans les scores. De manière générale, plus les questions de santé sont peu standardisées, plus l’écart entre les deux modèles se creuse.

- Claude Opus 4.6 rivalise sur les QCM médicaux (52,1 vs 52,6 sur la version texte de MedXpertQA)

- Pour les QCM multimodaux, l’écart se creuse, Muse Spark devance Opus 4.6 de plus de dix points sur la version multimédia de MedXpertQA

- Enfin, pour les questions de santé ouvertes, Muse Spark triple presque le score d’Opus 4.6 (42,8 vs 14,8 sur HealthBench Hard)

Associée aux compétences multimodales de Muse Spark, cette orientation ouvre une belle palette d’applications pour le quotidien. Par exemple, photographier le contenu de votre réfrigérateur et recevoir un plan de repas personnalisé aligné sur vos objectifs nutritionnels de la semaine. Il reste à voir la qualité en pratique, mais le potentiel est réel.

Accès

Les deux modèles sont propriétaires et cloud-only, mais l’accès diffère sensiblement.

Muse Spark est disponible via meta.ai et l’application Meta AI, toutes deux nécessitant un compte Meta. Une API en aperçu privé existe pour certains partenaires entreprise, mais aucune API publique ni date annoncée d’ouverture plus large. Meta a indiqué vouloir open-sourcer de futures versions de Muse, mais Muse Spark lui-même est fermé, sans téléchargement ni option de fine-tuning.

Côté confidentialité : la politique de Meta autorise l’utilisation des conversations pour améliorer les modèles. Si vous manipulez des données sensibles, à prendre en compte avant de passer par Muse Spark.

Claude Opus 4.6 est accessible via l’API publique Claude avec l’ID claude-opus-4-6. On y accède aussi via l’interface web Claude, Claude Code, Claude Cowork, et les applications mobiles iOS/Android. Sur le web, l’accès est réservé aux abonnés payants. Agent Teams est expérimental dans Claude Code.

Pour toute personne ayant besoin d’une API aujourd’hui, Claude Opus 4.6 est la seule option. L’API en aperçu privé de Muse Spark empêche la plupart des développeurs de construire avec, quelle que soit la qualité du modèle.

Muse Spark vs Claude Opus 4.6 : lequel choisir ?

Les forces et faiblesses étant assez distinctes, on peut recommander clairement des cas d’usage pour chacun.

Quand choisir Muse Spark

Muse Spark s’impose dans un ensemble de scénarios précis, majoritairement centrés sur les entrées multimodales et l’efficacité de calcul.

- Votre flux de travail mêle texte, images et audio au niveau du modèle, pas seulement en pièces jointes

- Votre cas d’usage touche à des questions médicales

- Vous avez besoin d’une chaîne de pensée visuelle sur des problèmes à base d’images

- Le coût de calcul est contraint et vous cherchez des performances de pointe avec un coût d’inférence plus faible

- Vous travaillez sur des problèmes bénéficiant d’une vérification multi-agents parallèle (une fois le mode Contemplating pleinement disponible)

- Vous êtes déjà dans l’écosystème Meta et avez accès à l’API entreprise en avant-première

Un bémol honnête : l’accès public à Muse Spark est limité pour l’instant. Sans accès à l’aperçu entreprise, vous passez par meta.ai, très bien pour explorer, moins pour des workflows de production.

Quand choisir Claude Opus 4.6

Claude Opus 4.6 est aujourd’hui le choix le plus solide pour la plupart des développeurs et data scientists, avant tout parce qu’il est réellement accessible.

-

Vous avez besoin d’une API publique avec un ID de modèle documenté (

claude-opus-4-6) -

Votre cas d’usage principal est le code agentique, notamment avec Claude Code et Agent Teams

-

Vous travaillez sur de grands codebases bénéficiant d’une fenêtre de contexte d’un million de tokens

-

Vous visez les meilleures performances sur les benchmarks de codage

-

Vous voulez un contrôle fin de la profondeur de raisonnement via le paramètre d’effort

-

Votre équipe utilise PowerPoint ou Excel et souhaite une intégration IA directe

Agent Teams reste expérimental, et les coûts en tokens grimpent vite dès que vous faites tourner des agents en parallèle. Mais pour des tâches logicielles complexes, l’exécution parallèle est vraiment utile, et la compaction de conversation garde les agents de longue durée sur de bons rails.

Derniers mots

Honnêtement, ces deux modèles ne se disputent pas vraiment les mêmes utilisateurs aujourd’hui. Claude Opus 4.6 est un modèle arrivé à maturité, accessible, en tête des benchmarks, avec une API publique, des fonctionnalités documentées et de vraies intégrations. Muse Spark est une première sortie techniquement intéressante d’un nouveau labo, avec un accès public limité et moins de chiffres publiés. L’écart pourrait vite se résorber, mais c’est la réalité en avril 2026.

Si vous êtes développeur ou data scientist et devez construire dès maintenant, Claude Opus 4.6 est le choix pratique. Les scores en benchmarks de codage, la fenêtre de contexte à 1 M de tokens et Agent Teams dans Claude Code sont autant d’éléments exploitables immédiatement. La multimodalité native et la Thought Compression de Muse Spark sont réellement intéressantes, mais plus difficiles à évaluer sans un accès API plus large.

Là où je suivrais Muse Spark de près : les tâches de raisonnement multimodal une fois le mode Contemplating pleinement déployé. L’approche multi-agents parallèle pour les problèmes difficiles est un pari différent de la simple augmentation des tokens d’inférence, et si les promesses d’efficacité de Meta se vérifient indépendamment, l’argument coût de calcul devient très convaincant en production.

Si vous souhaitez développer des applications d’IA, je vous recommande vivement de vous inscrire à notre parcours de compétences AI Engineering with LangChain. Le contenu pédagogique est natif IA : vous êtes accompagné par un tuteur personnel qui vous enseigne exactement les compétences dont vous avez besoin, depuis votre niveau de départ, pour devenir un véritable pro de l’ingénierie de workflows IA.

Rédacteur en chef Data Science chez DataCamp | Je suis passionné par la prévision et le développement à l'aide d'API.