Track

Dostawcy interfejsów API Large Language Model (LLM) zapewniają deweloperom dostęp do zaawansowanych modeli AI bez konieczności zarządzania procesorami GPU, wdrażaniem modeli, skalowaniem ani infrastrukturą inferencyjną. Zamiast samodzielnie hostować model, deweloperzy mogą połączyć się z API, wybrać model, wysłać żądanie i otrzymać odpowiedź.

W tym artykule przyjrzymy się 10 najlepszym dostawcom interfejsów API LLM pod kątem jakości modeli, doświadczenia deweloperskiego, cen, skalowalności, wsparcia ekosystemu oraz gotowości do wdrożeń produkcyjnych. Dla każdego dostawcy omówimy, do czego nadaje się najlepiej, jego kluczowe zalety oraz główne wady, które deweloperzy powinni wziąć pod uwagę.

Ten przewodnik dzieli najlepszych dostawców interfejsów API LLM na cztery kategorie:

- Natywni dostawcy LLM

- Dostawcy interfejsów API LLM typu open-source

- Dostawcy routingu LLM

- Dostawcy chmurowi LLM

Natywni dostawcy LLM

Natywni dostawcy LLM tworzą, trenują i udostępniają własne rodziny modeli poprzez API. Często są najlepszą opcją dla deweloperów, którym zależy na wysokiej jakości modeli, rzetelnej dokumentacji, zaawansowanym rozumowaniu, obsłudze multimodalnej i narzędziach gotowych do produkcji.

1. OpenAI

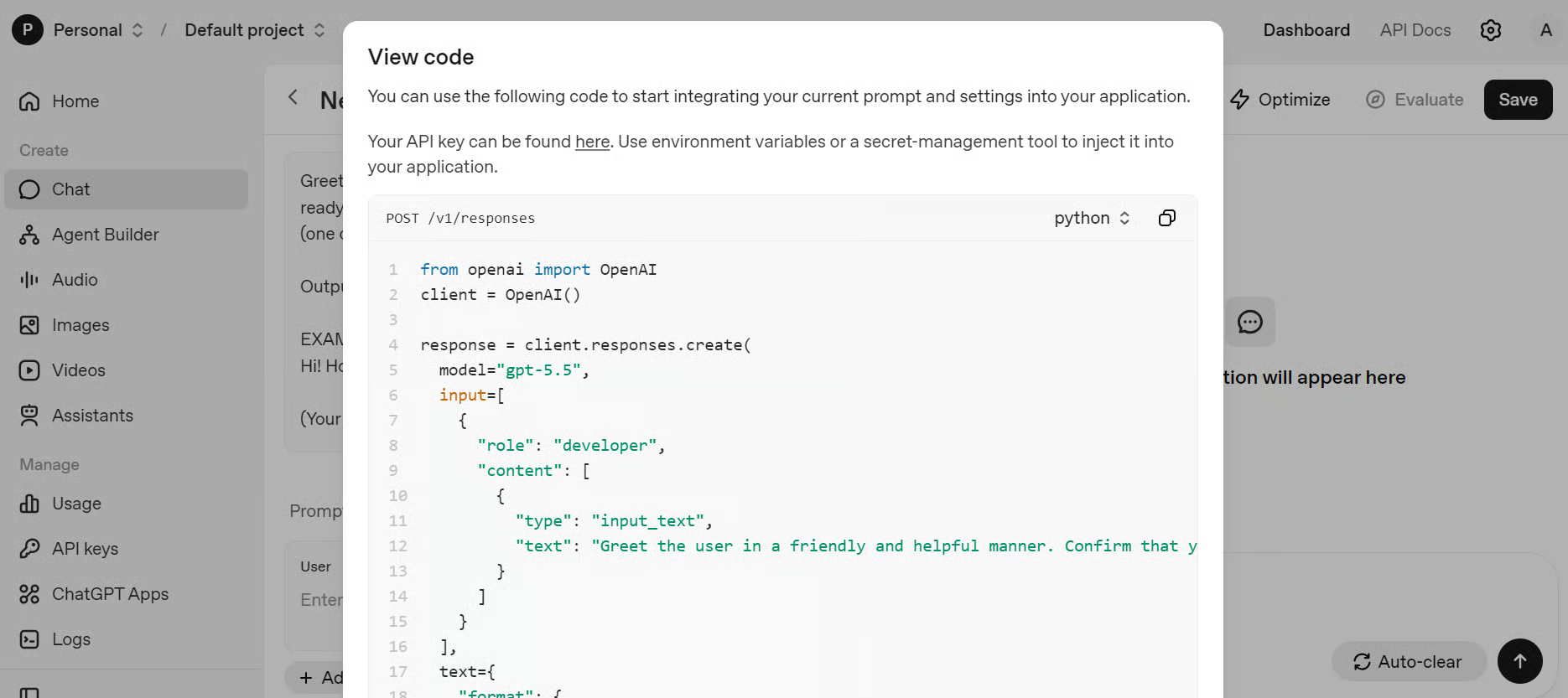

OpenAI to jeden z najszerzej używanych dostawców interfejsów API LLM. Jego API Platform zapewnia dostęp do:

- Modeli frontier do rozumowania, takich jak GPT-5.5

- Generowania i tłumaczenia głosu w czasie rzeczywistym za pośrednictwem GPT-Realtime-2

- Generowania obrazów przez model GPT-Images-2.0

- Tworzenia agentów dzięki OpenAI Agents SDK

Jego API obsługuje streaming, interfejsy czasu rzeczywistego i ustrukturyzowane wyniki.

OpenAI to dobry wybór dla zespołów budujących asystentów AI, narzędzia do kodowania, agentów wsparcia klienta, wewnętrzne copiloty, aplikacje multimodalne i systemy oparte na agentach.

Źródło: OpenAI

Jedną z wad jest to, że OpenAI może być kosztowny w dużej skali, zwłaszcza w przypadku aplikacji o dużej liczbie wywołań lub intensywnym rozumowaniu. To także zamknięty dostawca API, co oznacza mniejszą kontrolę nad wnętrzem modeli, hostingiem i dostosowaniem w porównaniu z modelami open-source lub samodzielnie hostowanymi.

Najlepszy do: uniwersalnych aplikacji AI, rozumowania, kodowania, przepływów multimodalnych i produktów AI gotowych do produkcji.

2. Anthropic

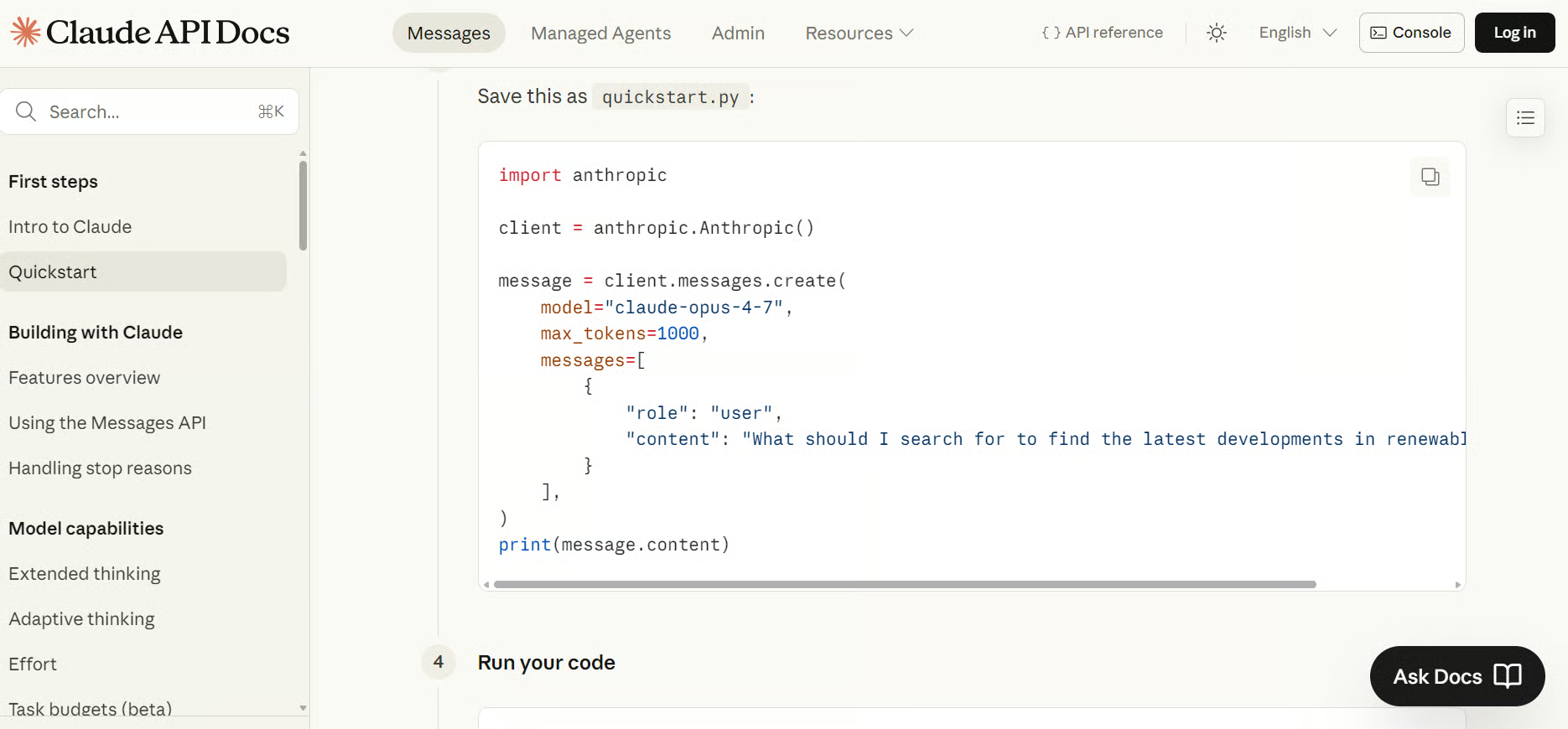

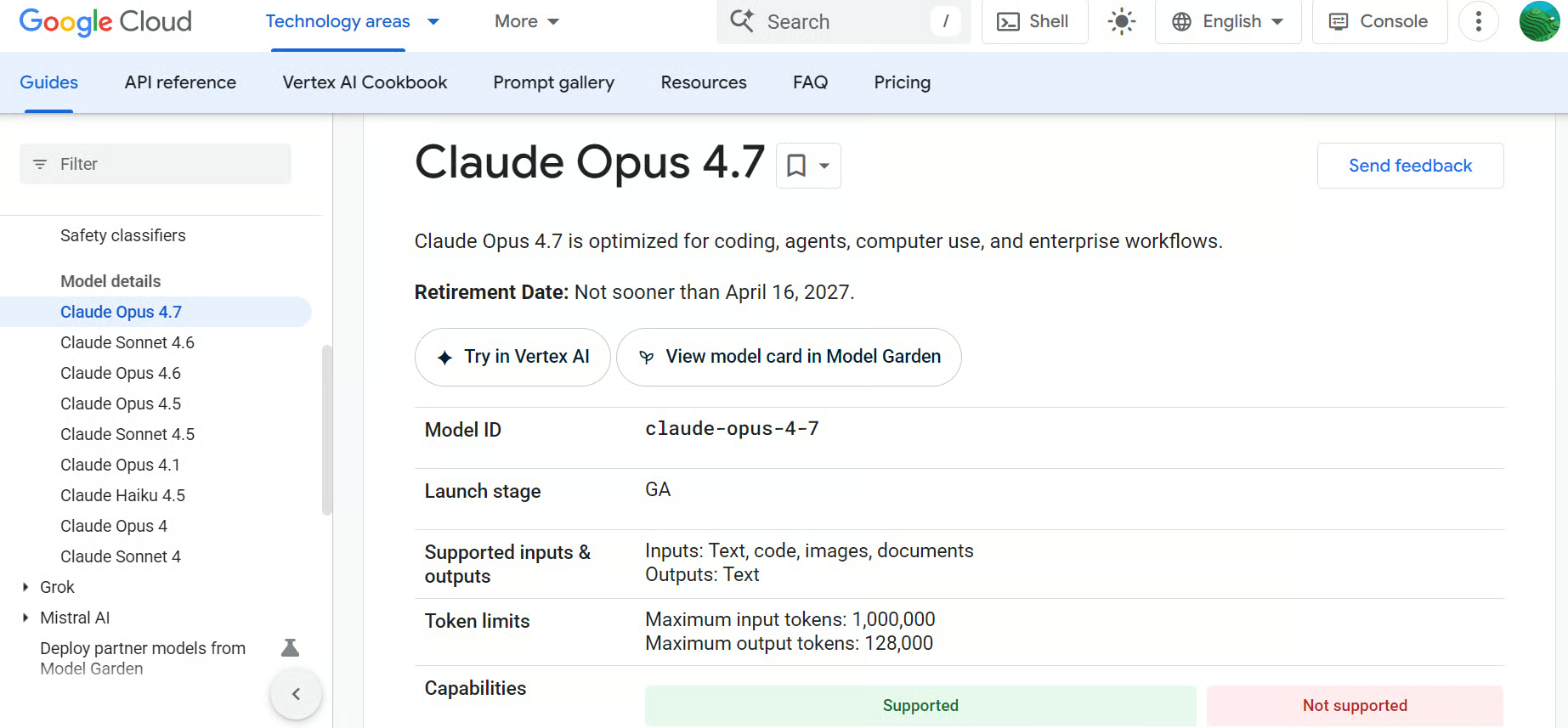

Anthropic udostępnia rodzinę modeli Claude poprzez swoje API, np. najnowszy flagowy model Claude Opus 4.7. Claude został zaprojektowany do zadań językowych, rozumowania, analizy, kodowania, pracy z długim kontekstem i przepływów agentowych. Platforma deweloperska Anthropic daje zespołom bezpośredni dostęp do modeli poprzez API, SDK i dokumentację dla deweloperów.

Claude jest szczególnie przydatny w aplikacjach wymagających skrupulatnego podążania za instrukcjami, wysokiej jakości pisania, analizy dokumentów i niezawodnej obsługi złożonych promptów.

Źródło: Pierwsze kroki z Claude

Kluczową wadą są koszty, zwłaszcza przy użyciu Claude do dużych dokumentów, promptów z długim kontekstem lub aplikacji o wysokiej przepustowości. Ponieważ dostęp do Claude odbywa się przez hostowane API, zespoły mają również ograniczoną kontrolę nad miejscem i sposobem działania modelu.

W przypadku zastosowań wrażliwych na prywatność deweloperzy powinni uważnie przeanalizować zasady przetwarzania danych, retencji i zgodności, zanim prześlą poufne dane firmowe lub klientów przez API.

Najlepszy do: asystentów kodowania, AI dla przedsiębiorstw, analizy z długim kontekstem, obiegu dokumentów i agentów AI.

Szczegółowe porównanie dwóch gigantów AI znajdzie Pan/Pani w naszym przewodniku Anthropic vs OpenAI.

3. Google Gemini

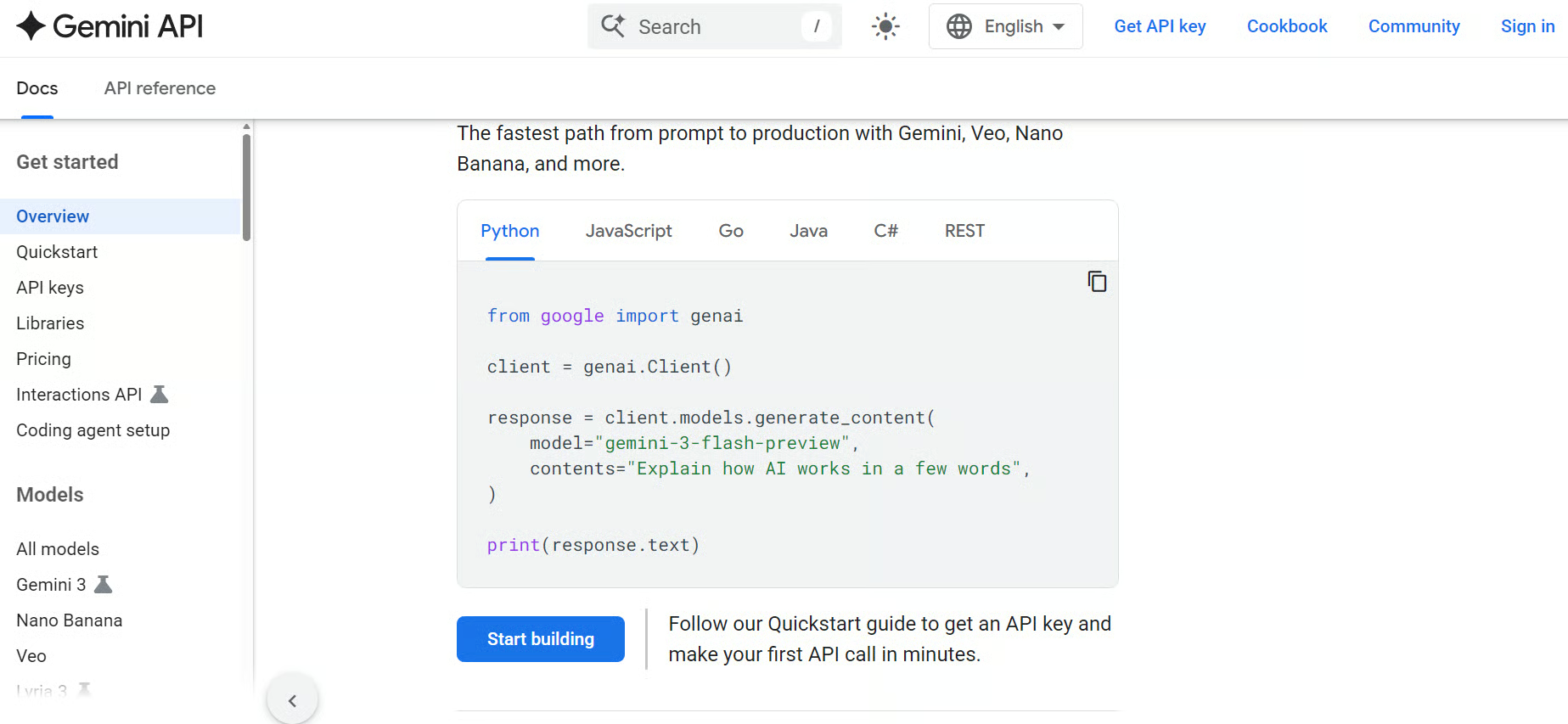

Google Gemini to natywna rodzina LLM Google, w tym Gemini 3.1 Pro, dostępna dla deweloperów przez Gemini API. Gemini API obsługuje standardowe, strumieniowe i czasu rzeczywistego interfejsy API, z dokumentacją dotyczącą szczegółów modeli, SDK, cen, konfiguracji i odniesień do API.

Dzięki Nano Banana 2 do generowania obrazów oraz Veo 3.1 Gemini jest mocną opcją dla deweloperów budujących aplikacje multimodalne. To także dobry wybór dla asystentów AI (zwłaszcza opartych na wyszukiwaniu), narzędzi do kodowania oraz produktów zintegrowanych z szerszym ekosystemem AI Google.

Źródło: Gemini API

Jednak Gemini bywa silniej powiązany z ekosystemem Google, co może nie odpowiadać zespołom, które chcą neutralnej konfiguracji względem dostawców. Ceny, dostępność modeli i wsparcie funkcji mogą się też różnić w zależności od narzędzi i regionów.

W zastosowaniach wrażliwych na prywatność zespoły powinny przeanalizować zasady przetwarzania danych, retencji i zgodności przed wysłaniem poufnych danych biznesowych lub klientów przez API.

Najlepszy do: aplikacji AI multimodalnych, integracji z ekosystemem Google, przepływów z długim kontekstem, kodowania i uniwersalnych zastosowań AI.

Dostawcy interfejsów API LLM typu open-source

Dostawcy interfejsów API LLM typu open-source zapewniają deweloperom hostowany dostęp do modeli otwartoźródłowych i o otwartych wagach. Zamiast pobierać modele i uruchamiać je na własnych GPU, platformy te hostują modele i udostępniają je poprzez proste API.

Tacy dostawcy są przydatni dla zespołów, którym zależy na niższych kosztach, większej elastyczności modeli, szybszych eksperymentach i dostępie do popularnych otwartych modeli, takich jak Llama, DeepSeek, Qwen, Mistral, Gemma i inne.

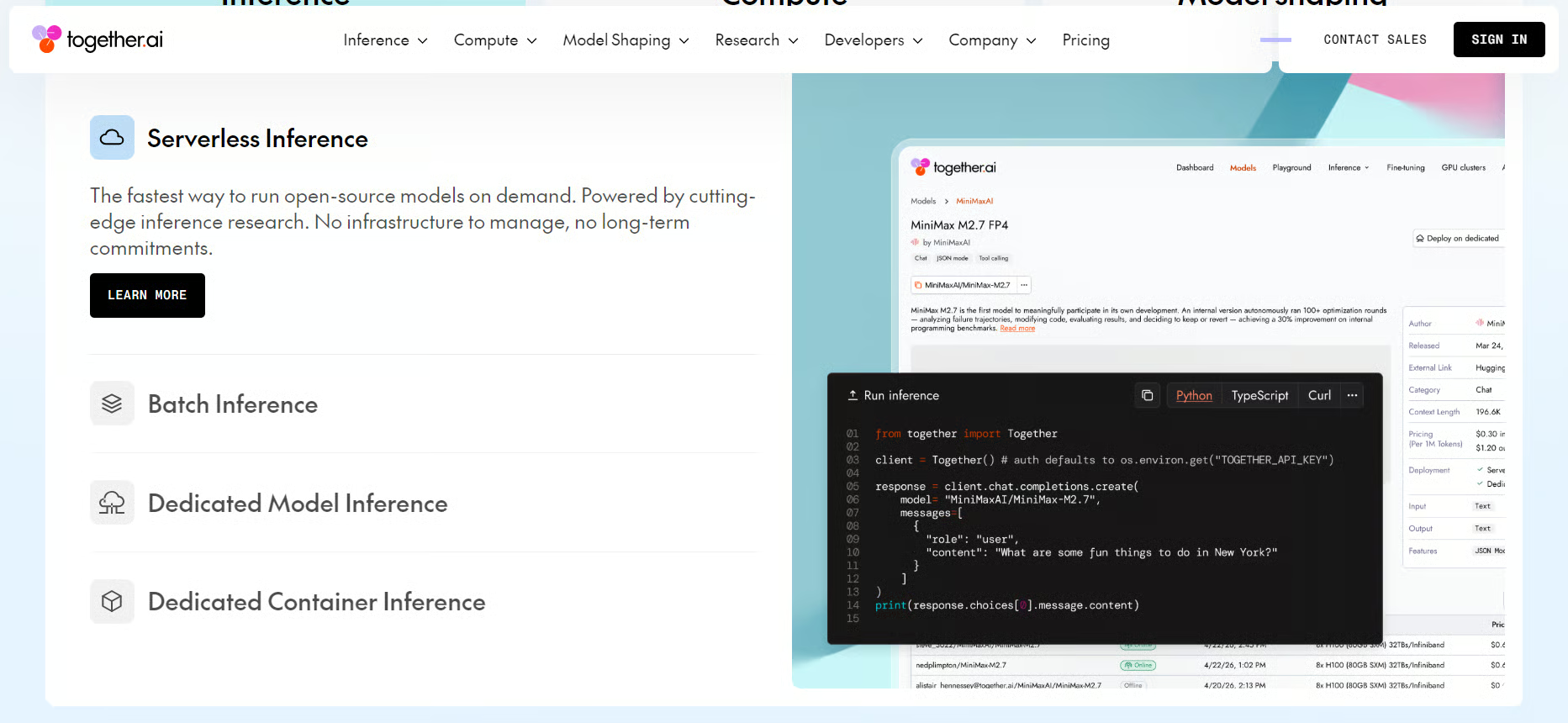

4. Together AI

Together AI zapewnia hostowany dostęp do modeli otwartoźródłowych i wyspecjalizowanych poprzez ujednolicone API. Jego katalog obejmuje ponad 200 modeli tekstowych, obrazowych, wideo, kodu i dźwięku, z obsługą bezserwerowej inferencji, inferencji wsadowej, dedykowanych punktów końcowych, dostrajania, ewaluacji i klastrów GPU.

Together AI to mocna opcja dla deweloperów, którzy chcą budować na otwartych modelach bez zarządzania własną infrastrukturą. Jest szczególnie przydatna dla zespołów testujących wiele modeli, dostrajających modele niestandardowe lub skalujących obciążenia inferencyjne.

Źródło: Together AI

Należy jednak pamiętać, że jakość, szybkość i niezawodność mogą się różnić w zależności od wybranego modelu. Zespoły mogą potrzebować więcej testów, benchmarków i ewaluacji przed wdrożeniem w produkcji.

W przypadku obciążeń wrażliwych zespoły powinny sprawdzić, czy potrzebują dostępu bezserwerowego, dedykowanych punktów końcowych lub opcji prywatnego wdrożenia, aby spełnić wymagania bezpieczeństwa i zgodności.

Najlepszy do: inferencji modeli open-source, dostrajania, skalowalnych obciążeń AI i eksperymentów na wielu modelach.

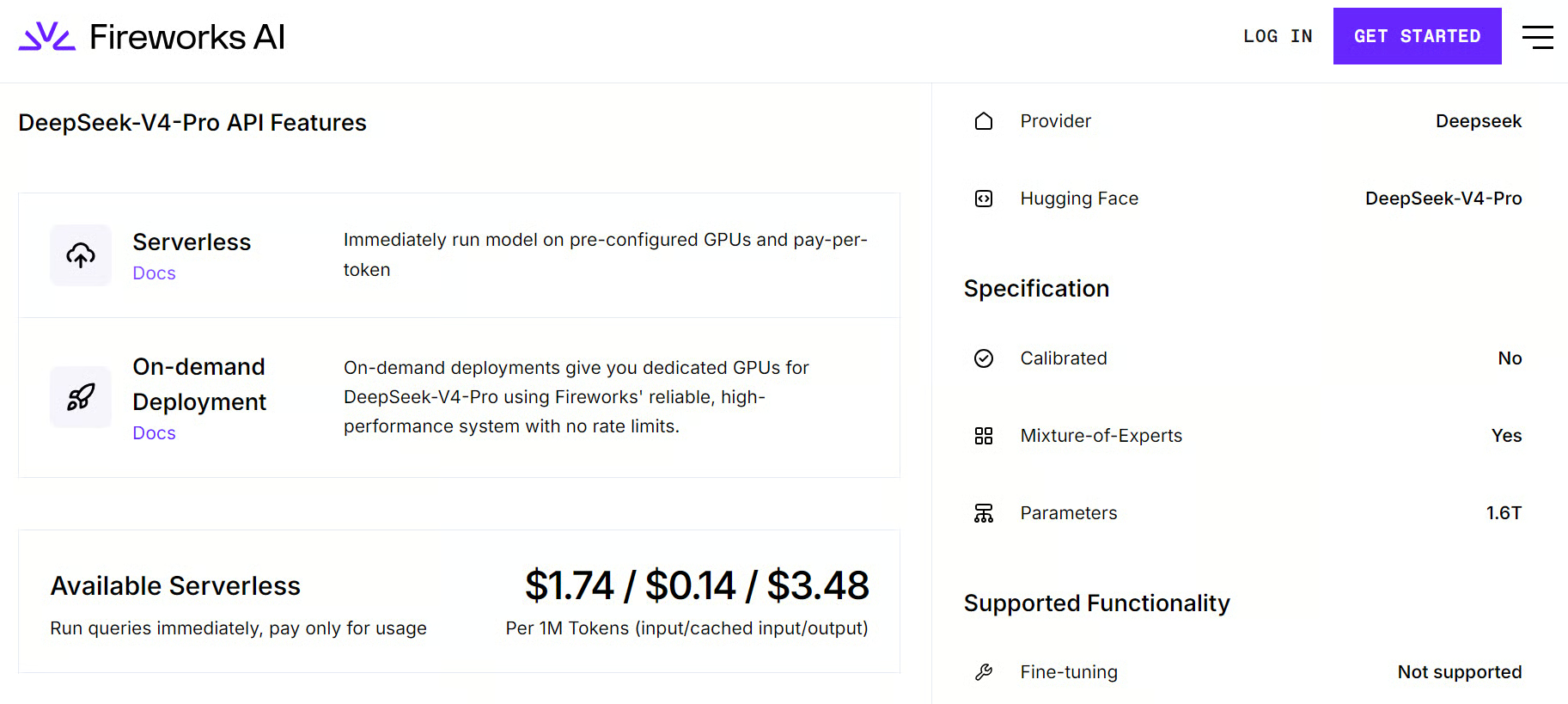

5. Fireworks AI

Fireworks AI koncentruje się na szybkiej inferencji dla otwartoźródłowych LLM i modeli generatywnych. Jego platforma obsługuje bezserwerową inferencję, wdrożenia na żądanie, dostrajanie i produkcyjne API dla popularnych modeli open-source.

Fireworks AI to dobra opcja dla zespołów, które chcą elastyczności otwartych modeli z szybszą inferencją i niższymi opóźnieniami. Jest szczególnie przydatny w konwersacyjnej AI, asystentach kodowania, wyszukiwaniu, aplikacjach multimodalnych i korporacyjnych systemach RAG.

Źródło: Fireworks AI

Kluczową wadą jest to, że Fireworks AI jest bardziej skoncentrowany na inferencji i wdrażaniu niż na byciu szeroką, kompleksową platformą do rozwoju AI. Zespoły mogą nadal potrzebować osobnych narzędzi do orkiestracji, ewaluacji, monitoringu czy złożonych przepływów agentowych.

Zespoły powinny też rozważyć, czy bezserwerowa inferencja wystarczy dla wrażliwych obciążeń, czy potrzebne są wdrożenia dedykowane, aby mieć większą kontrolę nad wydajnością i zgodnością.

Najlepszy do: szybkiej inferencji modeli open-source, dostrajania, produkcyjnych aplikacji AI i wdrożeń otwartych modeli o niskich opóźnieniach.

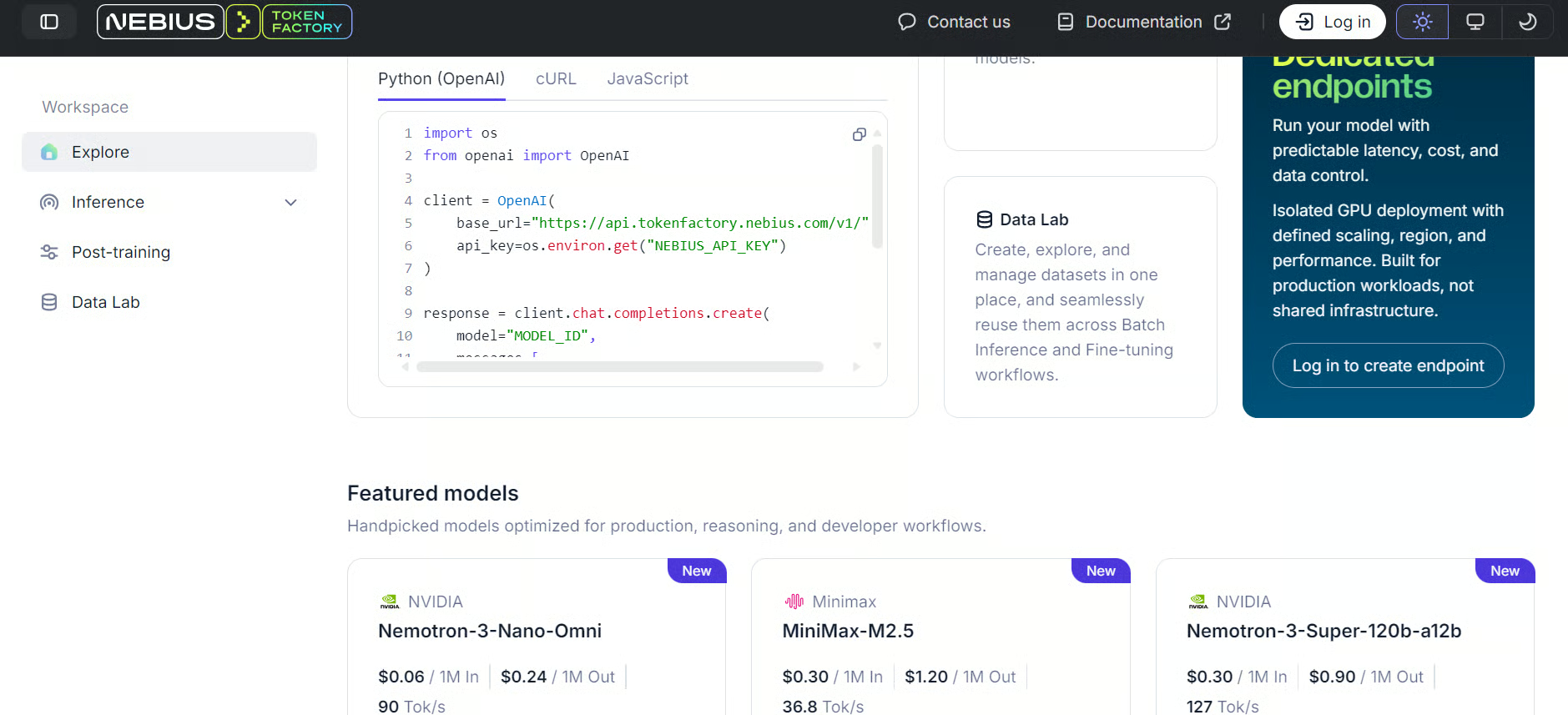

6. Nebius AI

Nebius AI to dostawca chmury AI zbudowany pod kątem obciążeń AI wspieranych przez GPU, hostowanej inferencji, serwowania modeli i skalowalnej infrastruktury AI. Jego usługa inferencyjna Token Factory obsługuje otwarte modele przez API kompatybilne z OpenAI, z opcjami bezserwerowej inferencji, dostrajania i dedykowanej infrastruktury chmury AI.

Nebius AI to dobry wybór dla zespołów, które chcą większej kontroli nad infrastrukturą niż w przypadku podstawowego dostawcy API, a jednocześnie chcą uniknąć złożoności pełnego zarządzania własnym środowiskiem GPU. Jest szczególnie przydatny dla zespołów budujących z użyciem modeli otwartych i niestandardowych, które potrzebują skalowalnej mocy obliczeniowej, szybkiej inferencji i opcji wdrożeń gotowych do produkcji.

Źródło: Nebius Token Factory

Nebius Token Factory oferuje dwa warianty szybkości inferencji: Fast i Base. Fast jest przeznaczony do interaktywnych obciążeń o niskim opóźnieniu, a Base do bardziej ekonomicznej kosztowo, wysokowolumenowej inferencji lub przetwarzania w tle.

Nebius jest z pewnością bardziej zorientowany na infrastrukturę niż proste, „podłącz i używaj” platformy API LLM. Oznacza to, że zespoły mogą potrzebować większej wiedzy z zakresu chmury, wdrożeń i zarządzania obciążeniami, aby w pełni wykorzystać jego możliwości.

W przypadku wrażliwych obciążeń zespoły powinny rozważyć, czy zarządzana inferencja wystarczy, czy też potrzebna jest dedykowana infrastruktura, aby mieć większą kontrolę nad bezpieczeństwem, zgodnością i ładem danych.

Najlepszy do: infrastruktury chmury AI, hostowanej inferencji, obciążeń wspieranych przez GPU, szybkiej inferencji i zespołów oczekujących większej kontroli nad wdrożeniami.

Dostawcy routingu LLM

Dostawcy routingu LLM dają deweloperom dostęp do wielu modeli i dostawców przez jedno API. Zamiast integrować się osobno z OpenAI, Anthropic, Google, Mistral, DeepSeek i innymi, deweloperzy mogą użyć jednej warstwy routingu do zarządzania dostępem do modeli z jednego miejsca.

Platformy te są przydatne do porównywania modeli, routingu awaryjnego, optymalizacji kosztów, redundancji dostawców, obserwowalności oraz przełączania się między modelami bez przepisywania aplikacji.

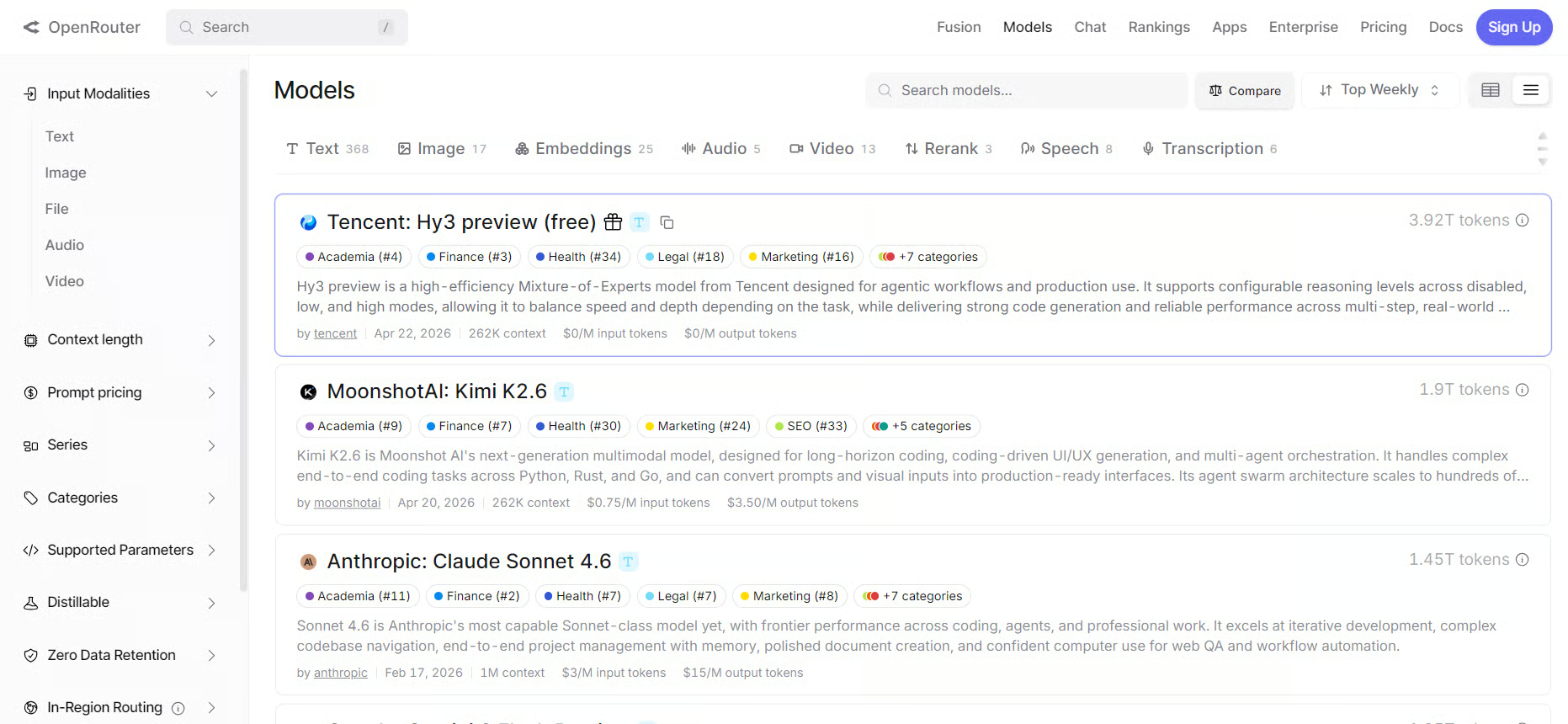

7. OpenRouter

OpenRouter to jeden z najpopularniejszych dostawców routingu LLM. Zapewnia deweloperom dostęp do wielu modeli przez jedno API kompatybilne z OpenAI, co ułatwia pracę z różnymi dostawcami przy użyciu jednej integracji.

Jak omawialiśmy w kilku poradnikach, OpenRouter to dobra opcja dla deweloperów, którzy chcą porównywać modele, szybko testować nowe wydania, kierować żądania do różnych dostawców lub uniknąć uzależnienia od jednego sprzedawcy modeli.

Źródło: OpenRouter

Wadą jest to, że OpenRouter dodaje kolejną warstwę między aplikacją a dostawcą modeli. Może to wprowadzać dodatkową zależność, zmienne opóźnienia i specyficzne dla dostawców zachowania, które nadal wymagają testów.

W przypadku obciążeń produkcyjnych zespoły powinny przejrzeć ustawienia routingu, zachowanie w trybie awaryjnym, preferencje dostawców i kontrolę prywatności, zanim prześlą wrażliwy lub krytyczny biznesowo ruch przez platformę.

Najlepszy do: aplikacji wielomodelowych, porównywania modeli, routingu awaryjnego, elastyczności dostawców i szybkich eksperymentów.

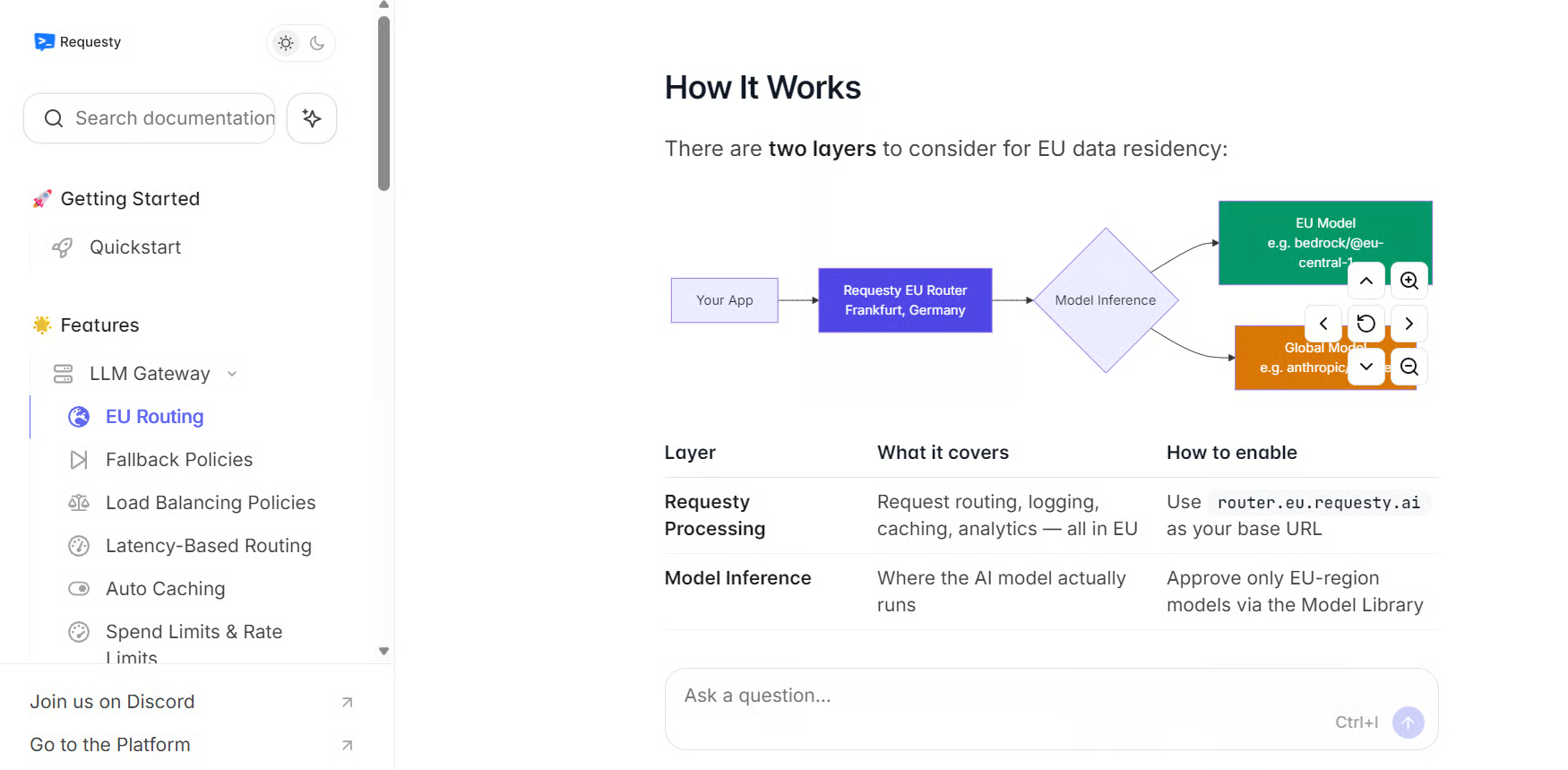

8. Requesty.ai

Requesty.ai to platforma routingu i bramy dla LLM, która pomaga zespołom łączyć się z wieloma dostawcami LLM przez jedno API kompatybilne z OpenAI. Obsługuje ponad 400 modeli, oferując funkcje routingu, awaryjnego przełączania, buforowania, zarządzania kosztami, obserwowalności i ładu.

Requesty.ai to dobra opcja dla zespołów budujących produkcyjne aplikacje AI, które opierają się na więcej niż jednym dostawcy modeli. Jest szczególnie przydatny do zarządzania politykami routingu, śledzenia wykorzystania, kontroli wydatków i poprawy niezawodności, gdy dostawcy zawodzą, przekraczają limit czasu lub limity zapytań.

Źródło: Requesty AI Documentation

Podobnie jak w przypadku OpenRouter, kluczową wadą jest to, że Requesty.ai dodaje kolejną warstwę bramy do stosu aplikacji. Zespoły muszą starannie skonfigurować routing, awaryjne przełączanie, logowanie i ład, aby uniknąć nieoczekiwanych kosztów, opóźnień lub zachowań dostawców.

W przypadku wrażliwych obciążeń Requesty.ai oferuje takie mechanizmy, jak wykrywanie i usuwanie PII, zabezpieczenia treści, dzienniki audytowe i funkcje ładu, ale zespoły powinny mimo to zdecydować, jakie dane mogą przechodzić przez bramę i jak należy zarządzać logami.

Najlepszy do: routingu LLM, kontroli kosztów, obserwowalności, awaryjnego przełączania dostawców, ładu i produkcyjnych przepływów pracy bramy AI.

Dostawcy chmurowi LLM

Dostawcy chmurowi LLM to duże platformy chmurowe, które zapewniają deweloperom i przedsiębiorstwom zarządzany dostęp do modeli bazowych. Często obsługują własne modele oraz modele dostawców zewnętrznych.

Są one szczególnie przydatne dla przedsiębiorstw, które już korzystają z infrastruktury chmurowej i potrzebują w jednym miejscu bezpieczeństwa, ładu, zgodności, integracji danych, kontroli wdrożeń i zarządzania modelami.

9. Google Vertex AI

Google Vertex AI to platforma uczenia maszynowego i generatywnej AI w Google Cloud. Zapewnia deweloperom i przedsiębiorstwom dostęp do modeli Gemini, Model Garden, narzędzi agentowych i zarządzanej infrastruktury do budowy, wdrażania i zarządzania aplikacjami AI.

Vertex AI obsługuje również czołowych partnerów i modele otwarte przez Model Garden, w tym Anthropic Claude, xAI Grok, modele Mistral AI oraz otwarte modele takie jak GLM 5 i Gemma 4, obok własnych modeli Gemini Google.

Źródło: Generative AI on Vertex AI

Google Vertex AI to dobry wybór dla zespołów, które już korzystają z Google Cloud i chcą natywnego chmurowo wdrażania modeli, ładu, kontroli bezpieczeństwa oraz integracji ze szerszym ekosystemem danych i AI Google.

Z drugiej strony Vertex AI może być bardziej złożony niż proste API modelu. Zespoły mogą potrzebować doświadczenia z Google Cloud, aby właściwie zarządzać projektami, uprawnieniami, rozliczeniami, ustawieniami wdrożeń i integracjami.

W przypadku wrażliwych obciążeń Vertex AI jest użyteczny dla zespołów, które potrzebują kontroli na poziomie chmury, ładu i zarządzanej infrastruktury, jednak decyzje dotyczące logowania, dostępu do danych i regionów wdrożeń wymagają starannego przeglądu.

Najlepszy do: użytkowników Google Cloud, dostępu do Gemini, korporacyjnych aplikacji AI, przepływów multimodalnych i chmurowo natywnego wdrażania modeli.

10. Amazon Bedrock

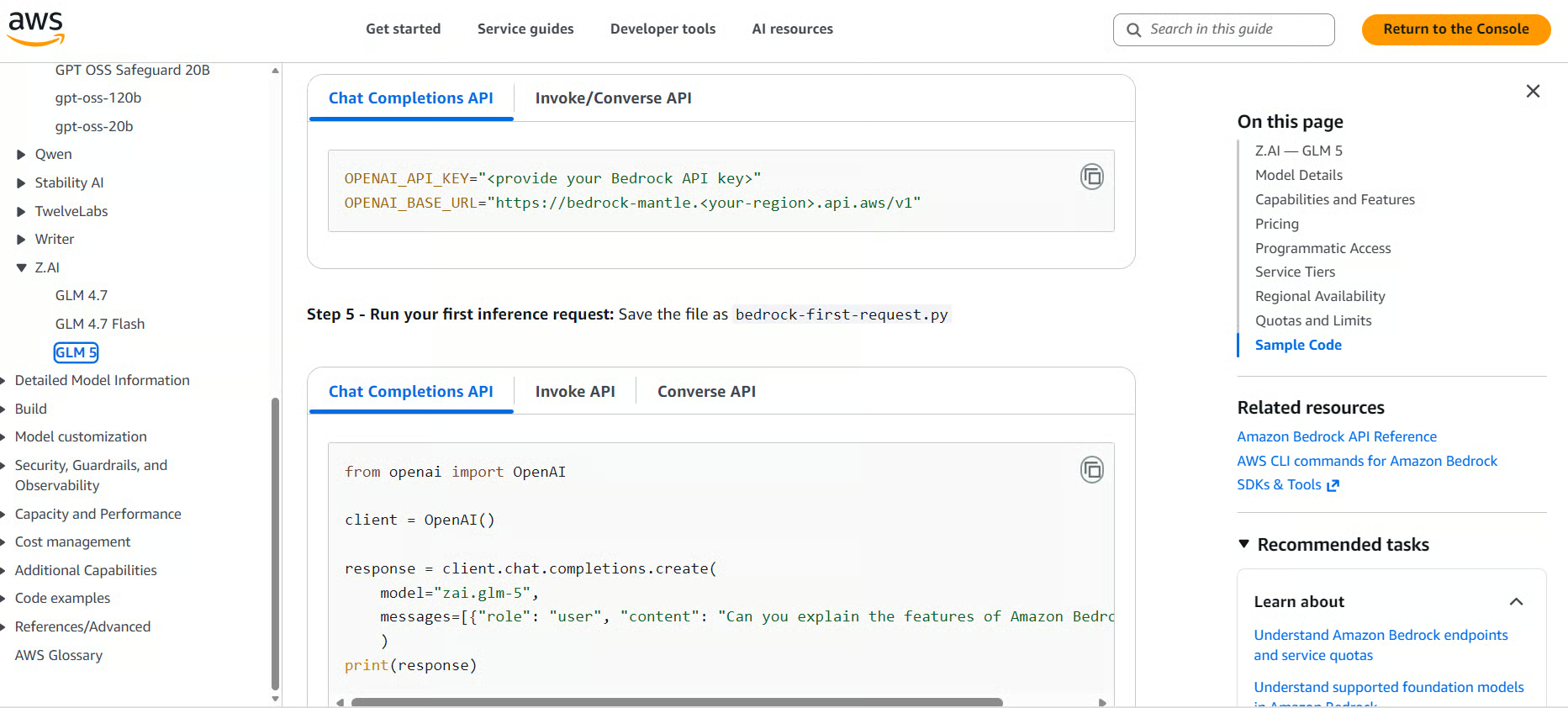

Amazon Bedrock to zarządzana platforma generatywnej AI w AWS. Zapewnia deweloperom dostęp do modeli bazowych od Amazonu i zewnętrznych dostawców w ramach jednej zarządzanej usługi AWS.

Bedrock obsługuje modele dostawców takich jak Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek i inni, co jest przydatne dla zespołów, które chcą wyboru modeli w ekosystemie AWS.

Amazon Bedrock to dobry wybór dla firm, które już budują w AWS, ponieważ łączy dostęp do modeli, infrastrukturę chmurową, kontrolę bezpieczeństwa i integrację korporacyjną w jednej platformie.

Źródło: Amazon Bedrock

Kluczową wadą jest to, że Bedrock może być bardziej złożony niż proste API LLM. Zespoły mogą potrzebować doświadczenia z AWS, aby właściwie zarządzać uprawnieniami, regionami, dostępem do modeli, cenami, siecią i ustawieniami wdrożeń.

W przypadku wrażliwych obciążeń Bedrock jest przydatny, ponieważ prompty i wyniki nie są wykorzystywane do trenowania modeli bazowych ani udostępniane dostawcom modeli, a zespoły mogą korzystać z mechanizmów AWS, takich jak szyfrowanie, IAM i PrivateLink.

Najlepszy do: użytkowników AWS, korporacyjnej AI, zarządzanego dostępu do modeli bazowych, wdrożeń z naciskiem na bezpieczeństwo i chmurowo natywnych aplikacji generatywnej AI.

Tabela porównawcza dostawców interfejsów API LLM

Poniższa tabela porównuje najlepszych dostawców interfejsów API LLM na podstawie ich kluczowych zalet i głównych wad.

|

Dostawca |

Kluczowe zalety |

Główne wady |

|

OpenAI |

Wysoka jakość modeli, dojrzałe API, narzędzia multimodalne, ustrukturyzowane wyniki, osadzania, mowa, generowanie obrazów i przepływy agentowe |

Może stać się kosztowny w dużej skali i oferuje mniejszą kontrolę niż modele open-source lub samodzielnie hostowane |

|

Anthropic |

Wysoka jakość pisania, skrupulatne podążanie za instrukcjami, rozumowanie, kodowanie i wsparcie długiego kontekstu |

Koszty mogą rosnąć przy dużych dokumentach lub wysokim wolumenie, a zespoły mają ograniczoną kontrolę nad hostingiem i wnętrzem modelu |

|

Google Gemini |

Silne możliwości multimodalne, API czasu rzeczywistego, wsparcie długiego kontekstu i ścisła integracja z ekosystemem AI Google |

Może być silnie związany z ekosystemem Google, a ceny, dostępność i funkcje mogą się różnić w zależności od narzędzia lub regionu |

|

Together AI |

Hostowany dostęp do wielu otwartych i wyspecjalizowanych modeli, z bezserwerową inferencją, dedykowanymi punktami końcowymi, dostrajaniem, ewaluacjami i infrastrukturą GPU |

Jakość, szybkość i niezawodność modelu mogą się różnić w zależności od wybranego modelu |

|

Fireworks AI |

Szybka inferencja, niskie opóźnienia, dostęp bezserwerowy, wdrożenia na żądanie i produkcyjne API dla otwartych modeli |

Bardziej skoncentrowany na inferencji i wdrażaniu niż na pełnej, kompleksowej platformie rozwoju AI |

|

Nebius AI |

Infrastruktura wspierana przez GPU, hostowana inferencja, API kompatybilne z OpenAI oraz poziomy szybkości, takie jak Fast i Base |

Bardziej zorientowany na infrastrukturę, więc zespoły mogą potrzebować mocniejszej wiedzy chmurowej i wdrożeniowej |

|

OpenRouter |

Dostęp do wielu modeli przez jedno API kompatybilne z OpenAI, z łatwiejszym przełączaniem dostawców i opcjami awaryjnymi |

Dodaje kolejną warstwę między aplikacją a dostawcą, co może wpływać na opóźnienia, niezawodność lub debugowanie |

|

Requesty.ai |

Jedno API dla wielu dostawców, z routingiem, awaryjnym przełączaniem, buforowaniem, śledzeniem kosztów, obserwowalnością i funkcjami ładu |

Wymaga starannej konfiguracji routingu, logowania, awaryjnego przełączania i kontroli kosztów, aby uniknąć nieoczekiwanych zachowań |

|

Google Vertex AI |

Zarządzany dostęp do Gemini, Anthropic Claude, xAI Grok, Mistral AI i modeli otwartych przez Model Garden, a także narzędzia bezpieczeństwa i ładu Google Cloud |

Bardziej złożony niż proste API i może wymagać doświadczenia z Google Cloud |

|

Amazon Bedrock |

Zarządzany dostęp do modeli Amazonu i dostawców zewnętrznych, takich jak Anthropic, Meta, Mistral AI, Cohere i inni w ramach AWS |

Bardziej złożony niż podstawowe API LLM, zwłaszcza w obszarach uprawnień, regionów, cen i dostępu do modeli |

Wybór najlepszego dostawcy interfejsu API LLM do Państwa zastosowania

Wybór odpowiedniego dostawcy interfejsu API LLM zależy od trzech czynników:

- Co jest budowane

- Jak dużej kontroli Pan/Pani potrzebuje

- Ile jest Pan/Pani gotów/gotowa wydać

Dla startupów i małych zespołów dostawcy interfejsów API LLM typu open-source często są najlepszym miejscem na start. Platformy takie jak Together AI, Fireworks AI i Nebius AI zapewniają dostęp do potężnych otwartych modeli bez zarządzania własnymi GPU ani infrastrukturą. Mogą być szybsze, tańsze i bardziej elastyczne do eksperymentów oraz wczesnego rozwoju produktów.

Jeśli chce Pan/Pani szybko testować różne modele, dobrym wyborem są dostawcy routingu LLM. Narzędzia takie jak OpenRouter i Requesty.ai pozwalają porównywać modele zamknięte i otwarte przez jedno API, zarządzać trybem awaryjnym i zmieniać dostawców bez przepisywania aplikacji.

W procesach, w których liczy się przede wszystkim jakość modelu, natywni dostawcy tacy jak OpenAI i Anthropic nadal należą do najsilniejszych opcji. Są szczególnie przydatni do produkcyjnych asystentów AI, narzędzi do kodowania, przepływów intensywnie opartych na rozumowaniu, aplikacji multimodalnych i systemów agentowych, gdzie najbardziej liczą się niezawodność i wydajność modelu.

Wreszcie, jeśli Państwa firma już działa w AWS lub Google Cloud, często ma sens pozostanie w tym ekosystemie chmurowym. Amazon Bedrock i Google Vertex AI zapewniają zarządzany dostęp do modeli, kontrolę bezpieczeństwa, ład i integrację z narzędziami, z których zespół już korzysta.

Na zakończenie

W pracach technicznych, asystentach kodowania i „vibe coding” nie przesadzałbym z eksperymentami na początku. Z mojego doświadczenia OpenAI i Anthropic to zazwyczaj najbezpieczniejsze wybory ze względu na silne możliwości w kodowaniu, rozumowaniu i narzędziach deweloperskich.

Dostawcy interfejsów API LLM typu open-source oraz dostawcy routingu LLM to mocne alternatywy do bardziej zaawansowanych eksperymentów.

Duzi dostawcy chmurowi LLM zwykle mają sens tylko w środowisku korporacyjnym. Wtedy warto wybrać ten ekosystem, z którego już się korzysta.

FAQ dotyczące dostawców interfejsów API LLM

Czym jest dostawca interfejsu API LLM?

Firma lub platforma, która hostuje duże modele językowe i udostępnia je przez API, dzięki czemu deweloperzy mogą wysyłać żądania i otrzymywać odpowiedzi generowane przez AI bez samodzielnego zarządzania infrastrukturą GPU lub inferencyjną.

Jaka jest różnica między natywnym dostawcą LLM a chmurowym dostawcą LLM?

Dostawcy natywni (tacy jak OpenAI i Anthropic) tworzą i serwują własne modele bezpośrednio. Dostawcy chmurowi (tacy jak AWS Bedrock i Google Vertex AI) oferują zarządzany dostęp do wielu modeli stron trzecich, wbudowany w istniejący ekosystem chmurowy z korporacyjnymi narzędziami bezpieczeństwa i ładu.

Kiedy powinienem/powinnam użyć dostawcy routingu LLM, takiego jak OpenRouter lub Requesty.ai?

Gdy trzeba pracować z więcej niż jednym modelem lub dostawcą, chce się automatycznego przełączania awaryjnego w razie niedostępności dostawcy lub trzeba porównywać modele i kontrolować koszty — wszystko w ramach jednej integracji API.

Czy dostawcy interfejsów API LLM typu open-source są mniej wydajni niż natywni dostawcy tacy jak OpenAI?

Niekoniecznie; to zależy od zadania. Platformy takie jak Together AI i Fireworks AI hostują najnowocześniejsze otwarte modele, takie jak Llama, DeepSeek i Mistral, które mogą konkurować z modelami zamkniętymi, często przy znacznie niższym koszcie.

Który dostawca interfejsu API LLM jest najlepszy dla przedsiębiorstw z rygorystycznymi wymaganiami zgodności?

Zazwyczaj najsilniejszymi wyborami są Amazon Bedrock i Google Vertex AI, ponieważ oferują natywne dla chmury mechanizmy bezpieczeństwa, IAM, szyfrowanie, logowanie audytowe i funkcje ładu, które integrują się z istniejącą infrastrukturą korporacyjną.