Lernpfad

Anbieter von Large Language Model (LLM) APIs geben Entwicklern Zugriff auf leistungsstarke KI-Modelle, ohne dass sie GPUs, Modellauslieferung, Skalierung oder Inference-Infrastruktur selbst betreiben müssen. Statt ein Modell selbst zu hosten, verbindest du dich mit einer API, wählst ein Modell, sendest eine Anfrage und erhältst die Antwort.

In diesem Artikel stellen wir die 10 führenden LLM-API-Anbieter vor – bewertet nach Modellqualität, Developer Experience, Preisgestaltung, Skalierbarkeit, Ökosystem-Unterstützung und Produktionsreife. Für jeden Anbieter zeigen wir, wofür er sich am besten eignet, die wichtigsten Vorteile und die zentralen Nachteile, die Entwickler beachten sollten.

Dieser Guide unterteilt die führenden LLM-API-Anbieter in vier Kategorien:

- Native LLM-Anbieter

- Open-Source-LLM-API-Anbieter

- LLM-Routing-Anbieter

- Cloud-LLM-Anbieter

Associate AI Engineer für Datenwissenschaftler

Native LLM-Anbieter

Native LLM-Anbieter entwickeln, trainieren und betreiben eigene Modellfamilien über APIs. Sie sind oft die beste Wahl für Entwickler, die hohe Modellqualität, verlässliche Dokumentation, fortgeschrittenes Reasoning, Multimodalität und produktionsreife Tools benötigen.

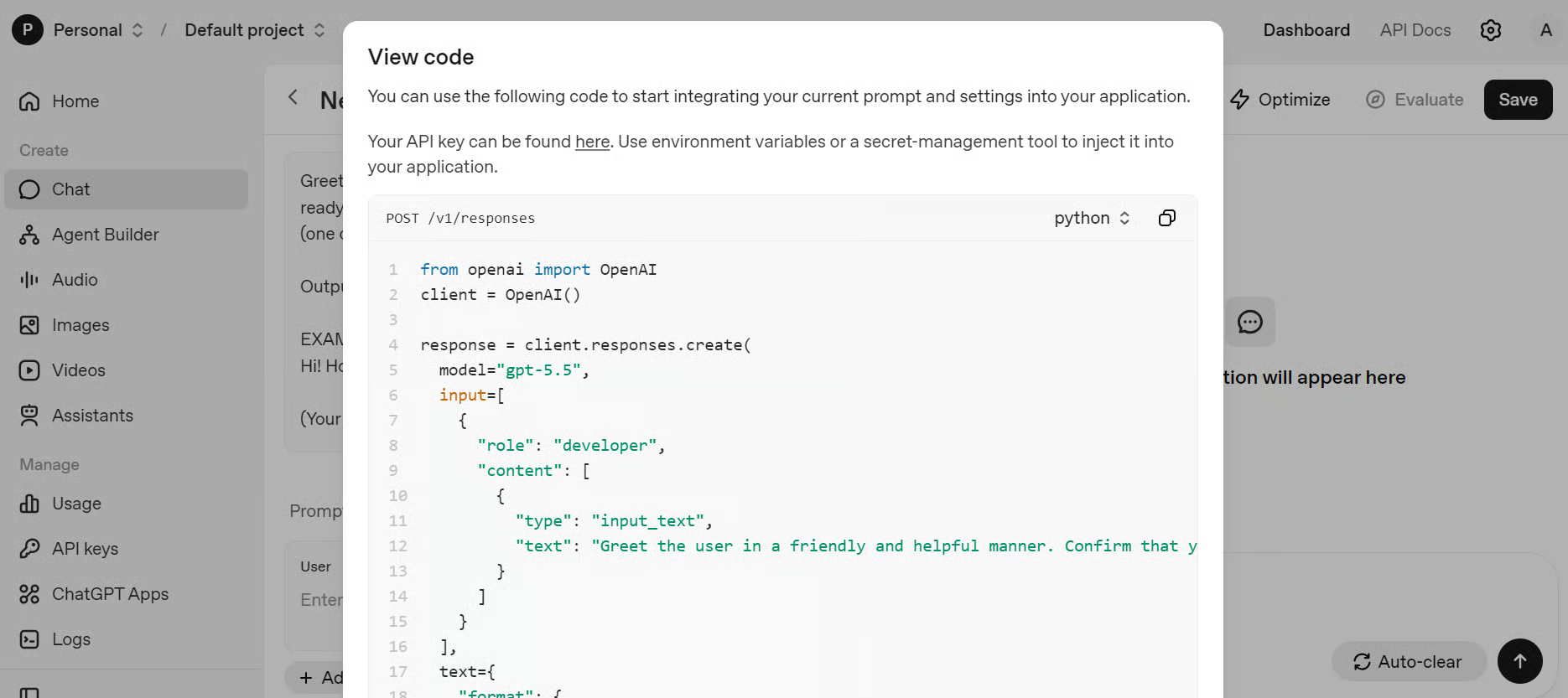

1. OpenAI

OpenAI ist einer der am weitesten verbreiteten LLM-API-Anbieter. Die API Platform bietet Zugriff auf:

- Spitzen-Reasoning-Modelle wie GPT-5.5

- Echtzeit-Sprachgenerierung und -Übersetzung über GPT-Realtime-2

- Bildgenerierung über das GPT-Images-2.0-Modell

- Agentenbasierte Entwicklung mit dem OpenAI Agents SDK

Die API unterstützt Streaming, Echtzeit-Schnittstellen und strukturierte Ausgaben.

OpenAI ist eine starke Wahl für Teams, die KI-Assistenten, Coding-Tools, Kundensupport-Agenten, interne Copilots, multimodale Apps und agentenbasierte Systeme entwickeln.

Quelle: OpenAI

Ein Nachteil ist, dass OpenAI bei großem Umfang teuer werden kann, insbesondere für Anwendungen mit hohem Anfragevolumen oder intensivem Reasoning. Zudem ist es ein geschlossenes API-Angebot, was im Vergleich zu Open-Source- oder selbst gehosteten Modellen weniger Kontrolle über Modellinterna, Hosting und Anpassung bedeutet.

Am besten geeignet für: Allzweck-KI-Apps, Reasoning, Coding, multimodale Workflows und produktionsreife KI-Produkte.

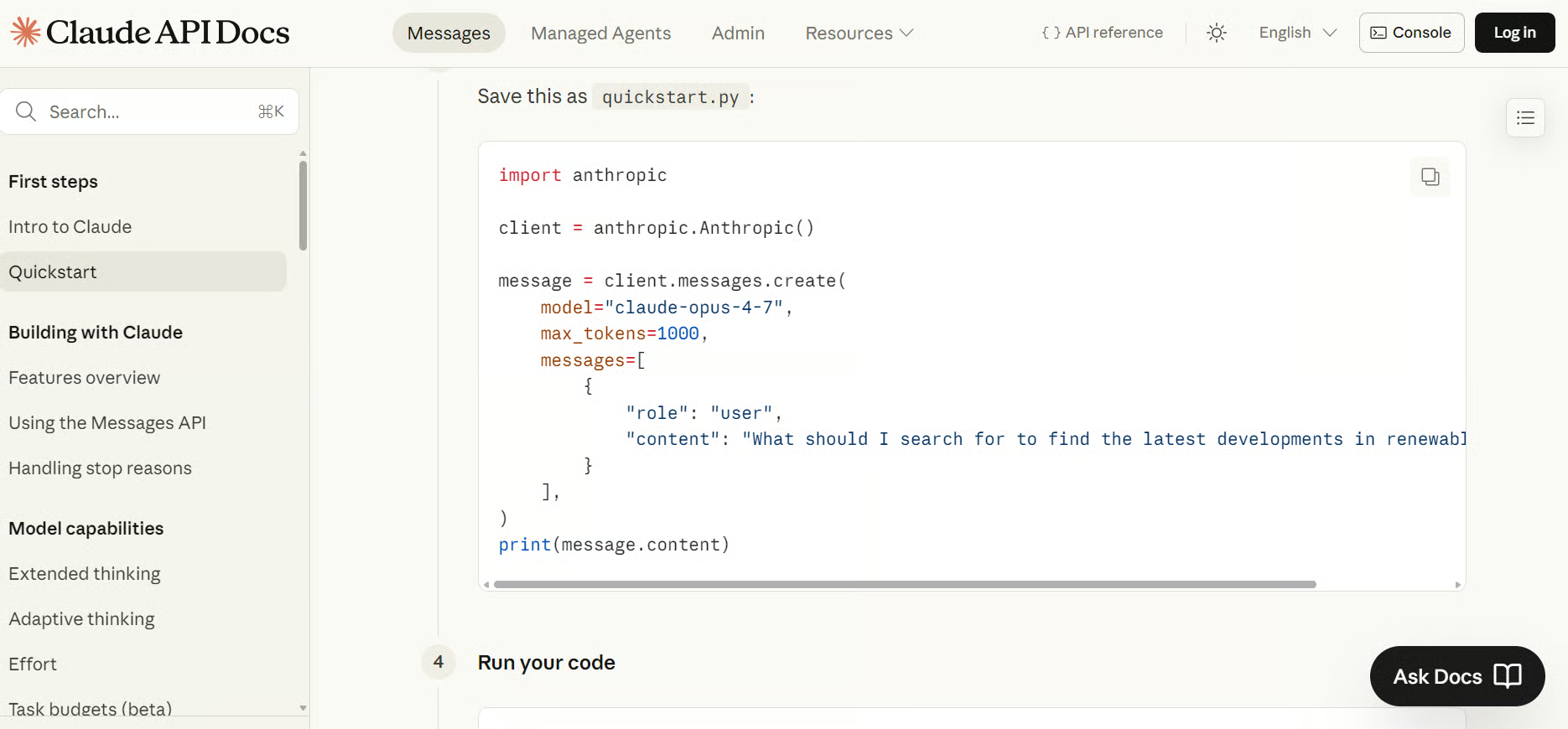

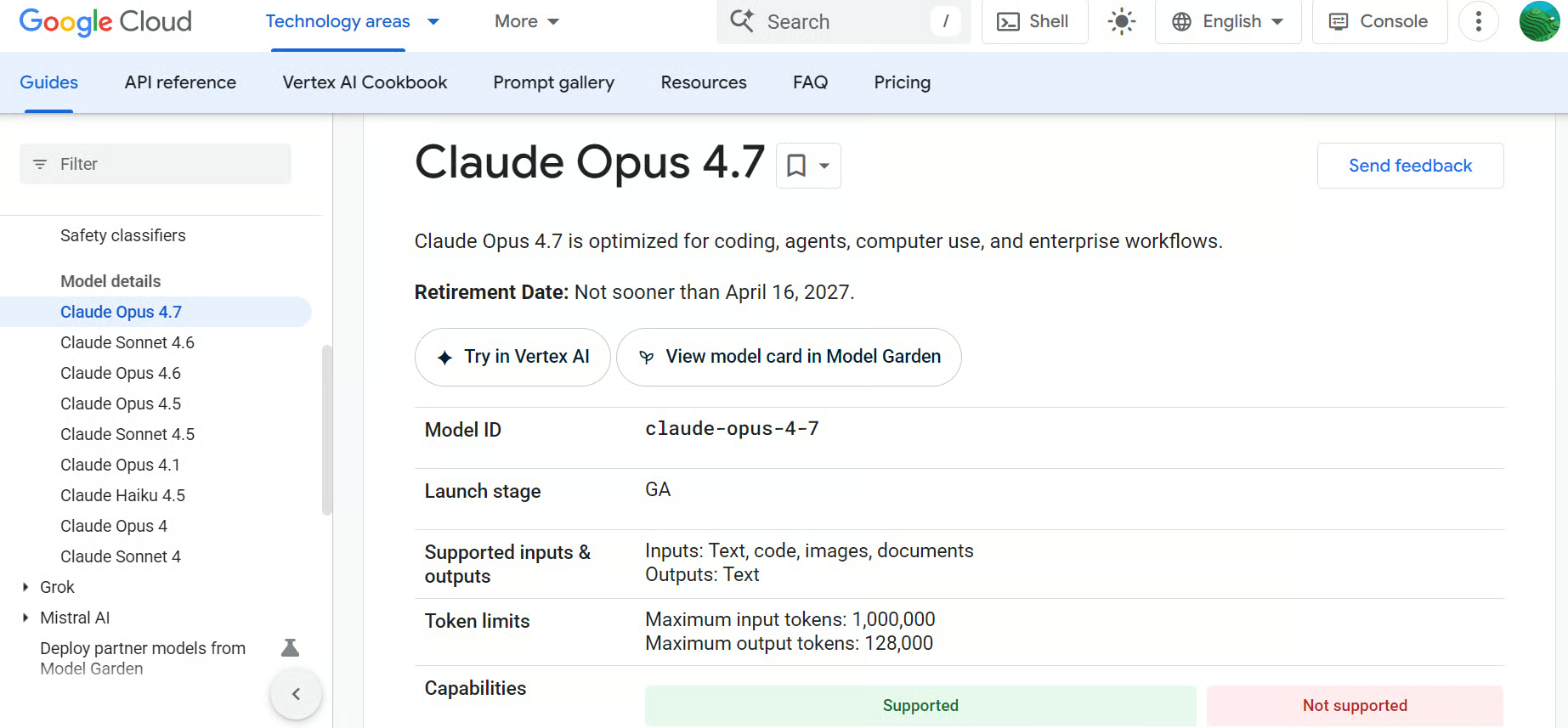

2. Anthropic

Anthropic stellt die Claude-Modellfamilie über seine API bereit, z. B. das aktuelle Flaggschiff Claude Opus 4.7. Claude ist für Sprache, Reasoning, Analyse, Coding, Long-Context-Aufgaben und agentische Workflows ausgelegt. Die Entwicklerplattform von Anthropic bietet direkten Modellzugang über APIs, SDKs und Developer-Dokumentation.

Claude ist besonders nützlich für Anwendungen, die präzises Befolgen von Anweisungen, hohe Schreibqualität, Dokumentanalyse und zuverlässigen Umgang mit komplexen Prompts erfordern.

Quelle: Get started with Claude

Ein wesentlicher Nachteil sind die Kosten, insbesondere bei großen Dokumenten, sehr langen Kontexten oder hohem Durchsatz. Da Claude über eine gehostete API bereitgestellt wird, ist die Kontrolle darüber, wo und wie das Modell läuft, ebenfalls begrenzt.

Für datenschutzsensible Anwendungsfälle sollten Entwickler die Anforderungen an Datenverarbeitung, -speicherung und Compliance sorgfältig prüfen, bevor vertrauliche Unternehmens- oder Kundendaten über die API gesendet werden.

Am besten geeignet für: Coding-Assistenten, Enterprise-KI, Long-Context-Analysen, Dokumenten-Workflows und KI-Agenten.

Für einen detaillierten Vergleich der beiden KI-Giganten wirf einen Blick in unseren Guide zu Anthropic vs OpenAI.

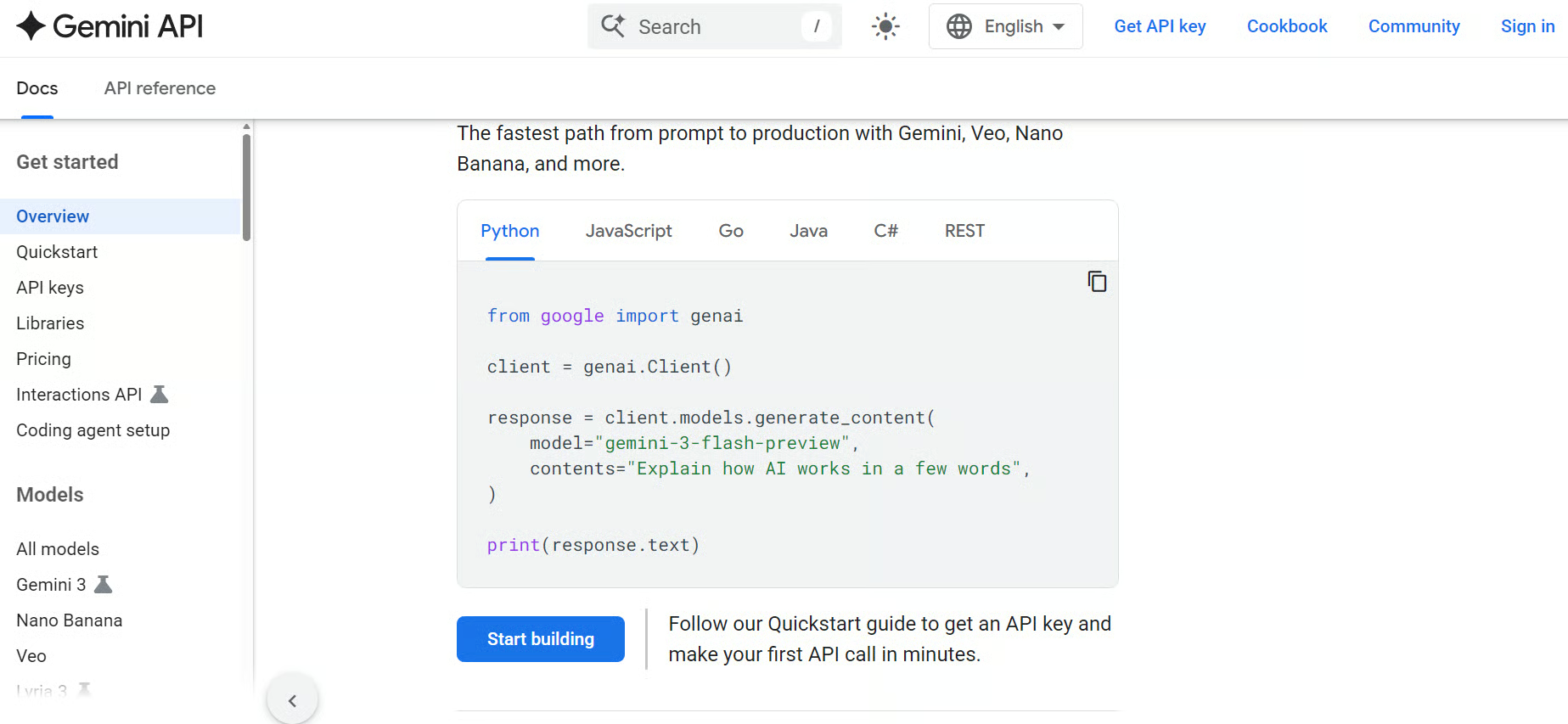

3. Google Gemini

Google Gemini ist Googles eigene LLM-Familie, darunter Gemini 3.1 Pro, verfügbar über die Gemini API für Entwickler. Die Gemini API unterstützt Standard-, Streaming- und Echtzeit-APIs mit Dokumentation zu Modelldetails, SDKs, Preisen, Setup und API-Referenzen.

Mit Nano Banana 2 für Bildgenerierung und Veo 3.1 integriert ist Gemini eine starke Option für Entwickler, die multimodale Anwendungen bauen. Ebenfalls geeignet ist es für KI-Assistenten (insbesondere mit Suchbezug), Coding-Tools und Produkte, die sich eng mit Googles KI-Ökosystem verzahnen.

Quelle: Gemini API

Allerdings ist Gemini stärker an Googles Ökosystem gebunden, was für Teams mit providerneutralem Setup weniger geeignet sein kann. Preise, Modellverfügbarkeit und Funktionsumfang können je nach Tool und Region variieren.

Für datenschutzsensible Anwendungen sollten Teams die Anforderungen an Datenverarbeitung, -speicherung und Compliance prüfen, bevor vertrauliche Unternehmens- oder Kundendaten über die API gesendet werden.

Am besten geeignet für: multimodale KI-Apps, Integration ins Google-Ökosystem, Long-Context-Workflows, Coding und Allzweck-KI-Anwendungen.

Open-Source-LLM-API-Anbieter

Open-Source-LLM-API-Anbieter geben Entwicklern gehosteten API-Zugang zu Open-Source- und Open-Weight-Modellen. Anstatt Modelle herunterzuladen und auf eigenen GPUs zu betreiben, hosten diese Plattformen die Modelle und stellen sie über einfache APIs bereit.

Diese Anbieter sind sinnvoll für Teams, die geringere Kosten, mehr Modellflexibilität, schnelle Experimente und Zugriff auf populäre Open-Modelle wie Llama, DeepSeek, Qwen, Mistral, Gemma und weitere benötigen.

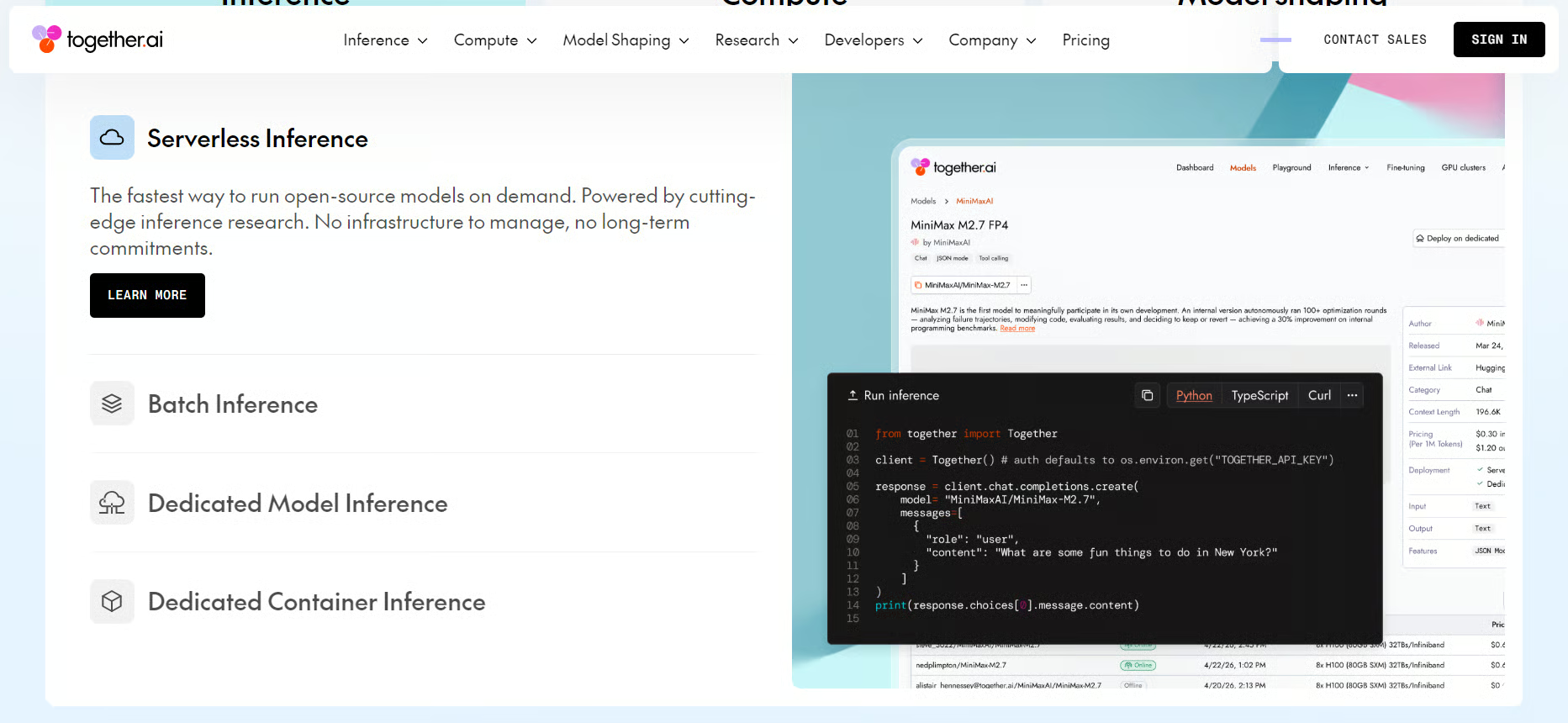

4. Together AI

Together AI bietet gehosteten Zugriff auf Open-Source- und spezialisierte Modelle über eine einheitliche API. Der Modellkatalog umfasst 200+ Modelle für Text, Bild, Video, Code und Audio – mit Unterstützung für serverlose Inference, Batch-Inference, dedizierte Endpunkte, Fine-Tuning, Evaluierungen und GPU-Cluster.

Together AI ist eine starke Option für Entwickler, die mit Open-Modellen bauen wollen, ohne eigene Infrastruktur zu managen. Besonders hilfreich ist es für Teams, die mehrere Modelle testen, kundenspezifische Modelle fine-tunen oder Inference-Workloads skalieren möchten.

Quelle: Together AI

Allerdings können Modellqualität, Geschwindigkeit und Zuverlässigkeit je nach gewähltem Modell variieren. Vor dem Produktionseinsatz sind oft zusätzliche Tests, Benchmarks und Evaluierungen nötig.

Für sensible Workloads sollten Teams prüfen, ob serverloser Zugriff ausreicht oder ob dedizierte Endpunkte bzw. private Deployments für mehr Sicherheit und Compliance erforderlich sind.

Am besten geeignet für: Open-Source-Modell-Inference, Fine-Tuning, skalierbare KI-Workloads und Experimente über viele Modelle hinweg.

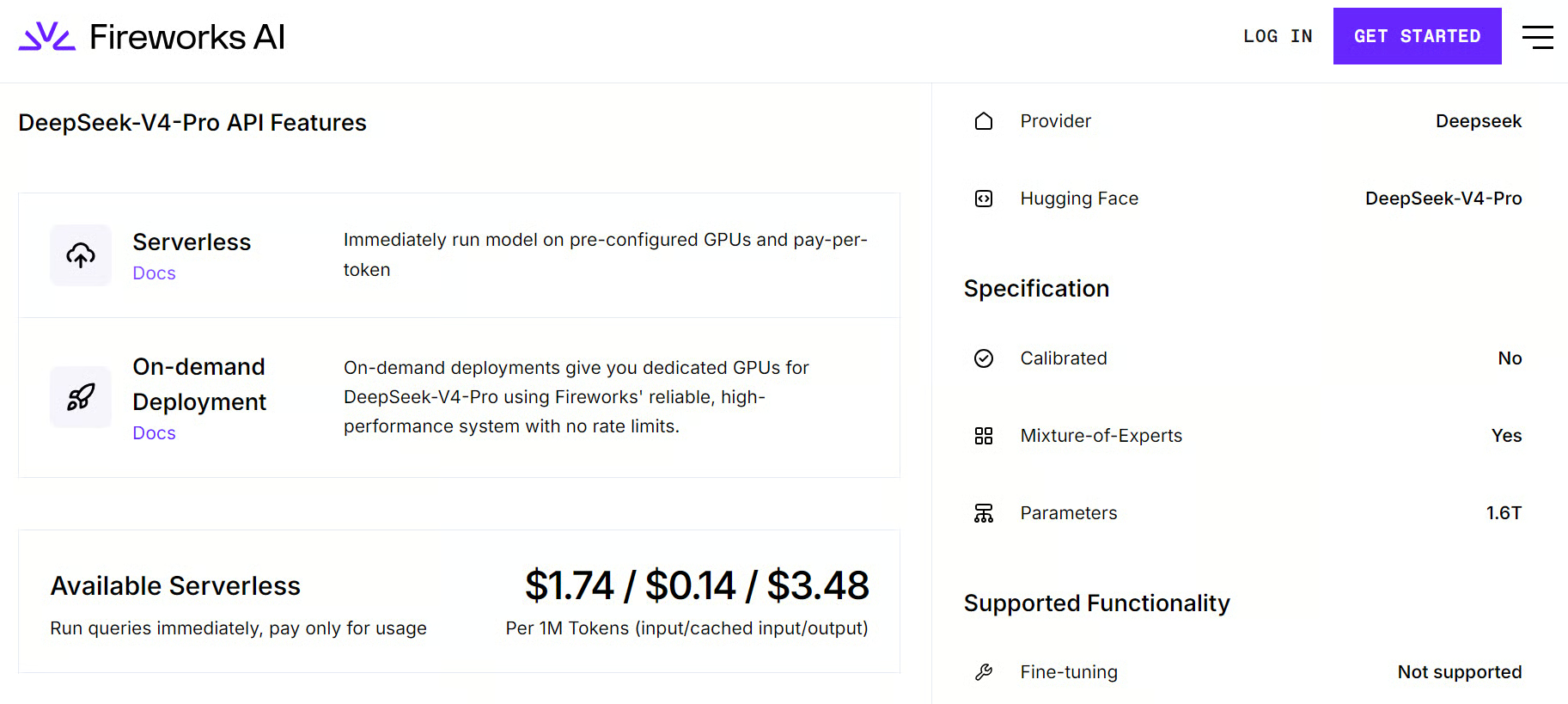

5. Fireworks AI

Fireworks AI fokussiert schnelle Inference für Open-Source-LLMs und generative KI-Modelle. Die Plattform unterstützt serverlose Inference, On-Demand-Deployments, Fine-Tuning und produktionsreife APIs für populäre Open-Modelle.

Fireworks AI ist ideal für Teams, die Flexibilität offener Modelle mit schneller Inference und niedriger Latenz kombinieren wollen. Besonders geeignet für Conversational AI, Coding-Assistenten, Suche, multimodale Apps und Enterprise-RAG-Systeme.

Quelle: Fireworks AI

Ein Nachteil ist, dass Fireworks AI stärker auf Inference und Deployment ausgerichtet ist als auf eine umfassende All-in-One-KI-Plattform. Für Orchestrierung, Evaluierungen, Monitoring oder komplexe Agenten-Workflows können zusätzliche Tools nötig sein.

Außerdem sollten Teams abwägen, ob serverlose Inference für sensible Workloads ausreicht oder ob dedizierte Deployments für mehr Kontrolle über Leistung und Compliance benötigt werden.

Am besten geeignet für: schnelle Open-Source-Modell-Inference, Fine-Tuning, produktionsreife KI-Apps und Low-Latency-Deployments mit offenen Modellen.

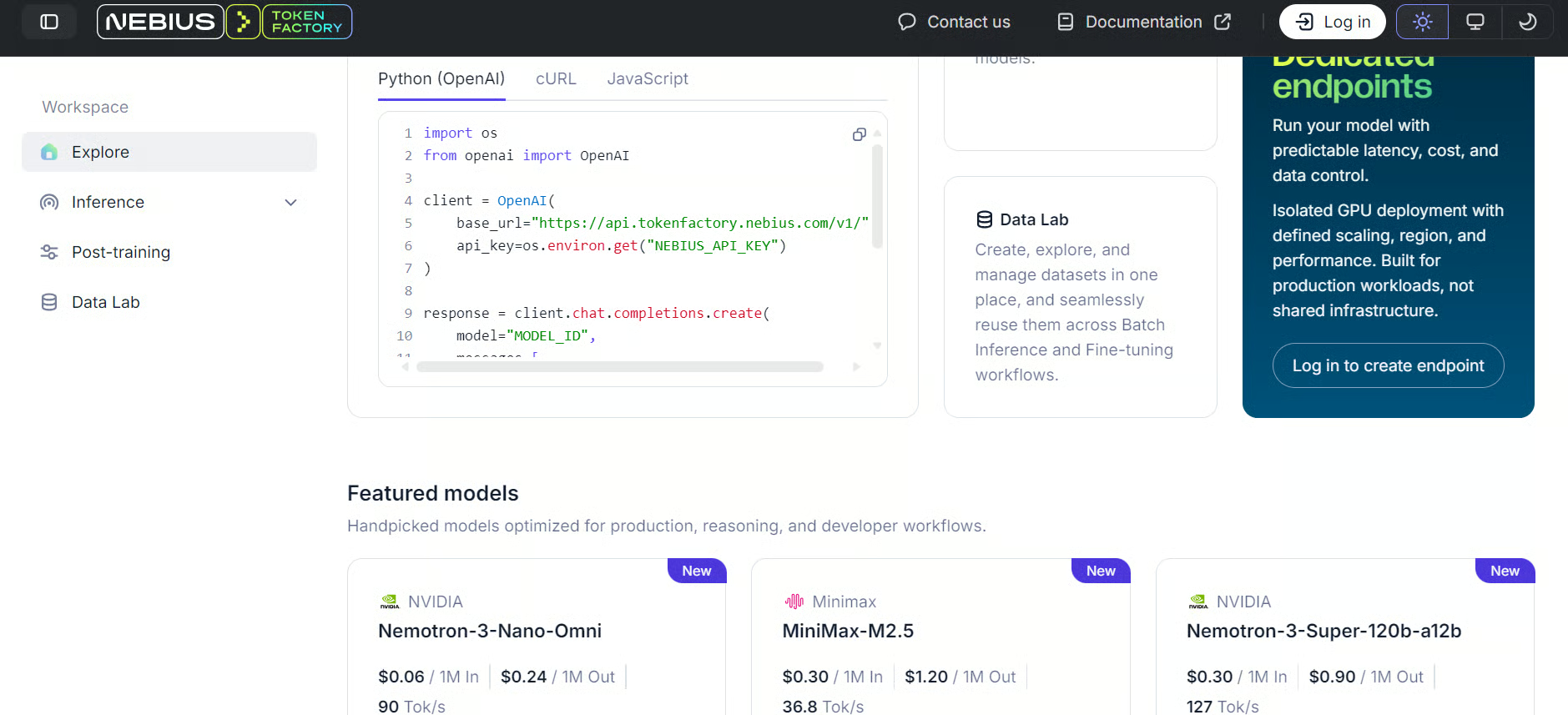

6. Nebius AI

Nebius AI ist ein KI-Cloud-Anbieter für GPU-gestützte KI-Workloads, gehostete Inference, Model Serving und skalierbare KI-Infrastruktur. Der Token Factory-Inference-Service unterstützt offene Modelle über eine OpenAI-kompatible API – mit Optionen für serverlose Inference, Fine-Tuning und dedizierte KI-Cloud-Infrastruktur.

Nebius AI ist ideal für Teams, die mehr Infrastrukturkontrolle als bei einem einfachen API-Anbieter wollen, ohne die Komplexität eines komplett eigenen GPU-Betriebs. Besonders nützlich für Teams, die mit offenen und kundenspezifischen Modellen arbeiten und skalierbare Rechenleistung, schnelle Inference und produktionsreife Deployment-Optionen benötigen.

Quelle: Nebius Token Factory

Nebius Token Factory bietet zwei Geschwindigkeitsstufen für Inference: Fast und Base. Fast ist für latenzkritische, interaktive Workloads konzipiert, Base für kosteneffiziente, hochvolumige Inference oder Hintergrundverarbeitung.

Nebius ist klarer infrastrukturorientiert als einfache Plug-and-Play-LLM-API-Plattformen. Teams brauchen daher eher Know-how in Cloud, Deployment und Workload-Management, um den vollen Nutzen zu ziehen.

Für sensible Workloads sollten Teams prüfen, ob Managed Inference ausreicht oder ob dedizierte Infrastruktur für mehr Kontrolle über Sicherheit, Compliance und Data Governance nötig ist.

Am besten geeignet für: KI-Cloud-Infrastruktur, gehostete Inference, GPU-Workloads, schnelle Inference und Teams mit höherem Bedarf an Deployment-Kontrolle.

LLM-Routing-Anbieter

LLM-Routing-Anbieter ermöglichen den Zugriff auf mehrere Modelle und Anbieter über eine einzige API. Anstatt OpenAI, Anthropic, Google, Mistral, DeepSeek und weitere separat zu integrieren, nutzt du eine Routing-Schicht, um den Modellzugang zentral zu verwalten.

Diese Plattformen sind hilfreich für Modellvergleiche, Fallback-Routing, Kostenoptimierung, Anbieter-Redundanz, Observability und den Modellwechsel ohne Neuschreiben deiner Anwendung.

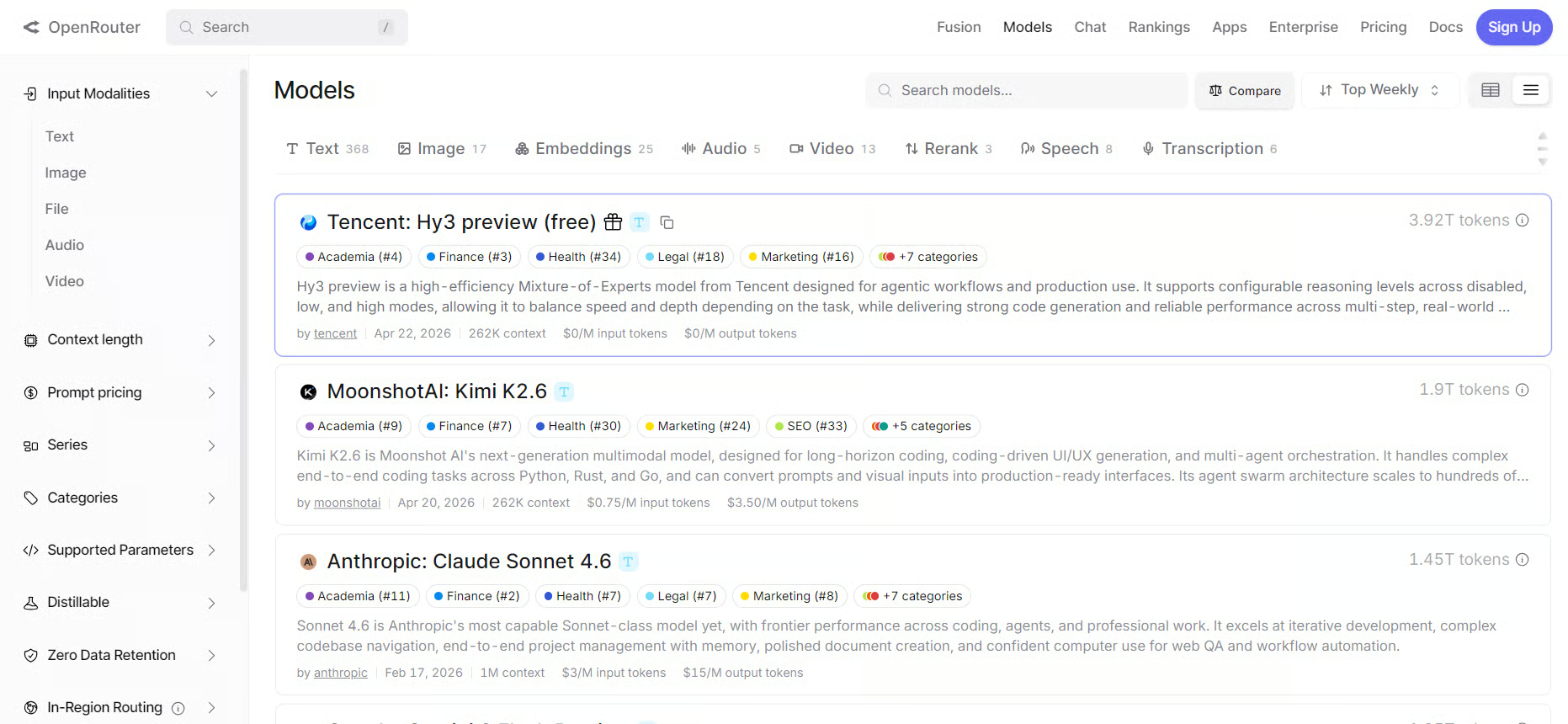

7. OpenRouter

OpenRouter ist einer der populärsten LLM-Routing-Anbieter. Er bietet Zugriff auf viele Modelle über eine einzige OpenAI-kompatible API und erleichtert so die Arbeit mit unterschiedlichen Anbietern über eine Integration.

Wie wir in mehreren Tutorials gezeigt haben, ist OpenRouter eine starke Option für Entwickler, die Modelle vergleichen, neue Releases schnell testen, Anfragen über Anbieter hinweg routen oder Vendor-Lock-in vermeiden möchten.

Quelle: OpenRouter

Ein Nachteil ist, dass OpenRouter eine weitere Schicht zwischen Anwendung und Modellanbieter einführt. Das kann zusätzliche Abhängigkeiten, variable Latenz und anbieterspezifisches Verhalten mit sich bringen, die weiterhin getestet werden müssen.

Für Produktionsworkloads sollten Teams Routing-Einstellungen, Fallback-Verhalten, Anbieterpräferenzen und Datenschutzkontrollen prüfen, bevor sensible oder geschäftskritische Datenverkehr über die Plattform läuft.

Am besten geeignet für: Multi-Modell-Apps, Modellvergleich, Fallback-Routing, Anbieterflexibilität und schnelle Experimente.

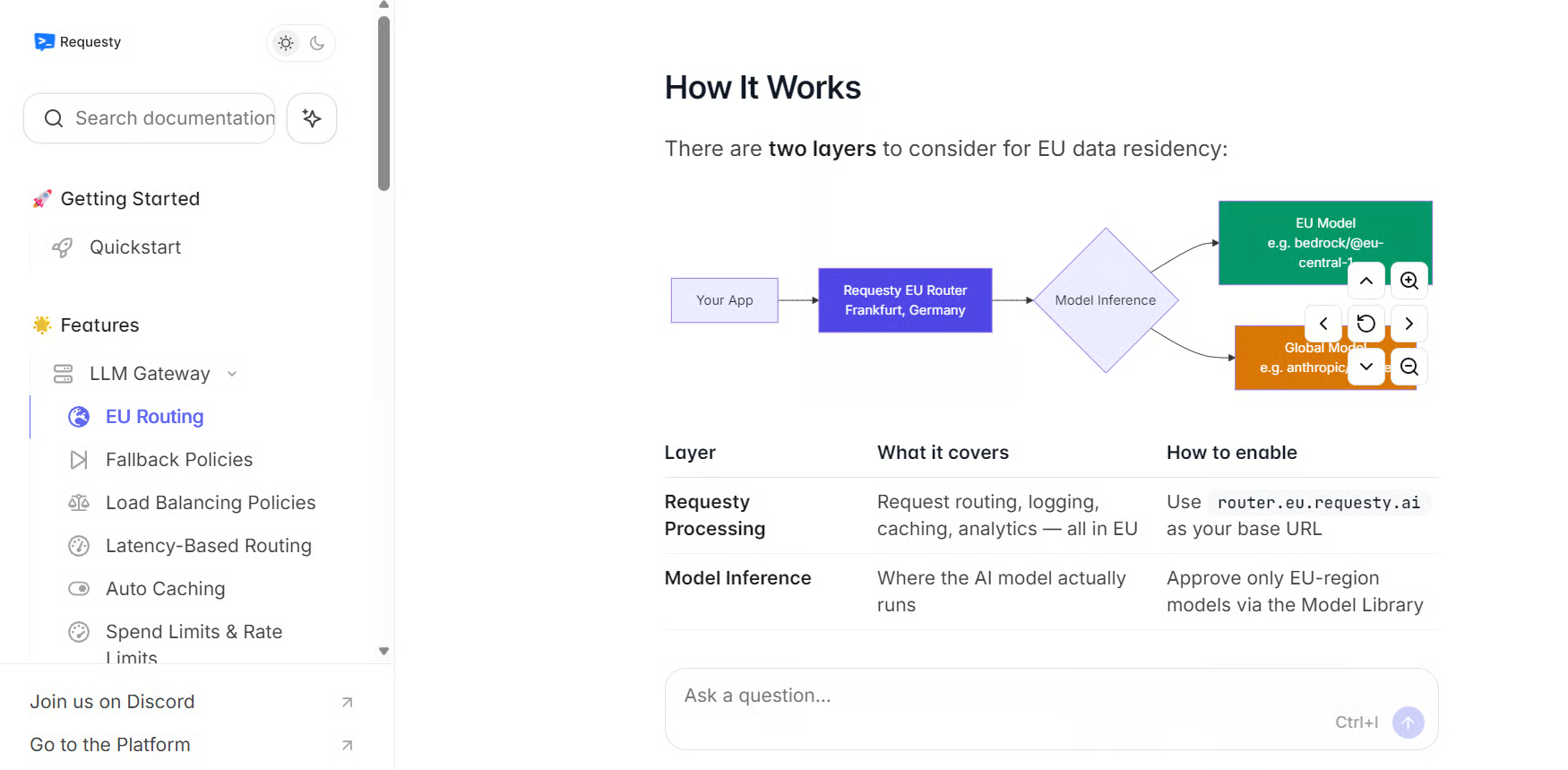

8. Requesty.ai

Requesty.ai ist eine LLM-Routing- und Gateway-Plattform, die Teams den Anschluss an mehrere LLM-Anbieter über eine OpenAI-kompatible API ermöglicht. Unterstützt werden 400+ Modelle sowie Funktionen für Routing, Fallback, Caching, Kostensteuerung, Observability und Governance.

Requesty.ai ist eine starke Option für Teams, die produktionsreife KI-Anwendungen mit mehr als einem Modellanbieter bauen. Besonders nützlich für die Verwaltung von Routing-Richtlinien, Nutzungs-Tracking, Kostenkontrolle und höhere Zuverlässigkeit, wenn Anbieter ausfallen, Timeouts auftreten oder Ratenlimits greifen.

Quelle: Requesty AI Documentation

Wie bei OpenRouter gilt: Requesty.ai fügt der Anwendungsarchitektur eine Gateway-Schicht hinzu. Teams müssen Routing, Fallback, Protokollierung und Governance sorgfältig konfigurieren, um unerwartete Kosten, Latenz oder Anbieter-Verhalten zu vermeiden.

Für sensible Workloads bietet Requesty.ai Funktionen wie PII-Erkennung, Redaction, Content-Guardrails, Audit-Logs und Governance. Dennoch sollten Teams festlegen, welche Daten das Gateway passieren dürfen und wie Logs verwaltet werden.

Am besten geeignet für: LLM-Routing, Kostenkontrolle, Observability, Anbieter-Fallback, Governance und produktionsreife KI-Gateway-Workflows.

Cloud-LLM-Anbieter

Cloud-LLM-Anbieter sind große Cloud-Plattformen, die Entwickler:innen und Unternehmen gemanagten Zugang zu Foundation Models bieten. Diese Plattformen unterstützen oft eigene Modelle sowie Modelle von Drittanbietern.

Sie sind besonders nützlich für Unternehmen, die bereits Cloud-Infrastruktur einsetzen und Sicherheit, Governance, Compliance, Datenintegration, Deployment-Kontrollen und Modellmanagement an einem Ort benötigen.

9. Google Vertex AI

Google Vertex AI ist die Machine-Learning- und Generative-KI-Plattform von Google Cloud. Sie bietet Zugriff auf Gemini-Modelle, Model Garden, Agenten-Tools und gemanagte Infrastruktur für das Bauen, Deployen und Verwalten von KI-Anwendungen.

Vertex AI unterstützt über den Model Garden auch führende Partner und Open-Modelle, darunter Anthropic Claude, xAI Grok, Mistral AI-Modelle sowie Open-Source-Modelle wie GLM 5 und Gemma 4 – zusätzlich zu Googles eigenen Gemini-Modellen.

Quelle: Generative AI on Vertex AI

Google Vertex AI ist eine starke Option für Teams, die bereits Google Cloud nutzen und Cloud-native Modellbereitstellung, Governance, Sicherheitskontrollen sowie Integration ins breitere Daten- und KI-Ökosystem von Google wünschen.

Auf der anderen Seite ist Vertex AI komplexer als eine einfache Modell-API. Teams benötigen oft Google-Cloud-Erfahrung, um Projekte, Berechtigungen, Abrechnung, Deployment-Einstellungen und Integrationen korrekt zu verwalten.

Für sensible Workloads ist Vertex AI nützlich, wenn Cloud-Level-Zugriffskontrollen, Governance und gemanagte Infrastruktur benötigt werden – Entscheidungen zu Logging, Datenzugriff und Regionen erfordern dennoch eine sorgfältige Prüfung.

Am besten geeignet für: Google-Cloud-Nutzer, Gemini-Zugang, Enterprise-KI-Apps, multimodale Workflows und Cloud-native Modellbereitstellung.

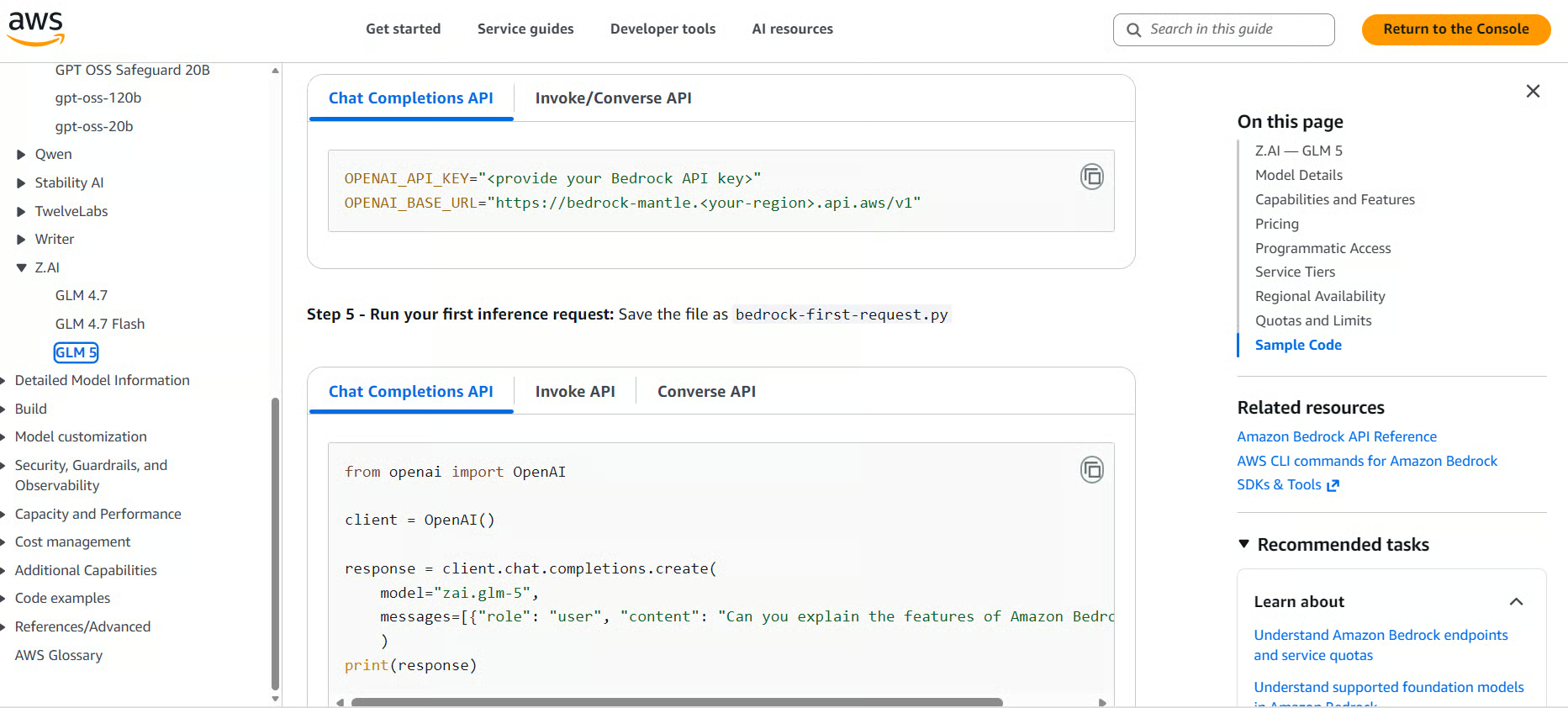

10. Amazon Bedrock

Amazon Bedrock ist die gemanagte Generative-KI-Plattform von AWS. Sie bietet Entwicklern Zugriff auf Foundation Models von Amazon und Drittanbietern über einen gemanagten AWS-Service.

Bedrock unterstützt Modelle von Anbietern wie Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek und weiteren – ideal für Teams, die Modellauswahl innerhalb des AWS-Ökosystems wünschen.

Amazon Bedrock ist eine starke Wahl für Unternehmen, die bereits auf AWS bauen, da Modellzugang, Cloud-Infrastruktur, Sicherheitskontrollen und Enterprise-Integration in einer Plattform zusammenkommen.

Quelle: Amazon Bedrock

Ein Nachteil ist, dass Bedrock komplexer ist als eine einfache LLM-API. Teams benötigen in der Regel AWS-Erfahrung, um Berechtigungen, Regionen, Modellzugriff, Preise, Netzwerk und Deployment-Einstellungen korrekt zu verwalten.

Für sensible Workloads ist Bedrock vorteilhaft, da Prompts und Outputs nicht zum Training von Basismodellen verwendet oder mit Modellanbietern geteilt werden. Außerdem können AWS-Kontrollen wie Verschlüsselung, IAM und PrivateLink genutzt werden.

Am besten geeignet für: AWS-Nutzer, Enterprise-KI, gemanagten Zugang zu Foundation Models, sicherheitsfokussierte Deployments und Cloud-native Generative-AI-Anwendungen.

Vergleichstabelle der LLM-API-Anbieter

Die folgende Tabelle vergleicht die führenden LLM-API-Anbieter auf Basis ihrer wichtigsten Vorteile und zentralen Nachteile.

|

Anbieter |

Wichtigste Vorteile |

Zentrale Nachteile |

|

OpenAI |

Hohe Modellqualität, ausgereifte APIs, multimodale Tools, strukturierte Ausgaben, Embeddings, Speech, Bildgenerierung und agentische Workflows |

Kann im großen Maßstab teuer werden und bietet weniger Kontrolle als Open-Source- oder selbst gehostete Modelle |

|

Anthropic |

Starke Schreibqualität, präzises Befolgen von Anweisungen, Reasoning, Coding und Unterstützung langer Kontexte |

Kosten steigen bei großen Dokumenten oder hohem Volumen; außerdem begrenzte Kontrolle über Hosting und Modellinterna |

|

Google Gemini |

Starke multimodale Fähigkeiten, Echtzeit-APIs, Unterstützung langer Kontexte und enge Integration mit Googles KI-Ökosystem |

Stärker an Googles Ökosystem gebunden; Preise, Verfügbarkeit und Features variieren je nach Tool oder Region |

|

Together AI |

Gehosteter Zugang zu vielen offenen und spezialisierten Modellen, mit serverloser Inference, dedizierten Endpunkten, Fine-Tuning, Evaluierungen und GPU-Infrastruktur |

Modellqualität, Geschwindigkeit und Zuverlässigkeit variieren je nach gewähltem Modell |

|

Fireworks AI |

Schnelle Inference, niedrige Latenz, serverloser Zugriff, On-Demand-Deployments und produktionsreife APIs für Open-Modelle |

Stärker auf Inference und Deployment fokussiert als auf eine vollständige All-in-One-KI-Plattform |

|

Nebius AI |

GPU-gestützte Infrastruktur, gehostete Inference, OpenAI-kompatible API und Geschwindigkeitsstufen wie Fast und Base |

Stärker infrastrukturorientiert; Teams benötigen mehr Cloud- und Deployment-Know-how |

|

OpenRouter |

Zugriff auf viele Modelle über eine OpenAI-kompatible API, erleichtert Anbieterwechsel und Fallback |

Fügt eine weitere Schicht zwischen App und Anbieter hinzu, was Latenz, Zuverlässigkeit oder Debugging beeinflussen kann |

|

Requesty.ai |

Eine API für mehrere Anbieter, mit Routing, Fallback, Caching, Kosten-Tracking, Observability und Governance |

Erfordert sorgfältiges Setup von Routing, Logging, Fallback und Kostenkontrollen, um unerwartetes Verhalten zu vermeiden |

|

Google Vertex AI |

Gemanagter Zugang zu Gemini, Anthropic Claude, xAI Grok, Mistral AI und Open-Modellen über Model Garden plus Google-Cloud-Sicherheits- und Governance-Tools |

Komplexer als eine einfache API und erfordert möglicherweise Google-Cloud-Erfahrung |

|

Amazon Bedrock |

Gemanagter Zugang zu Modellen von Amazon und Drittanbietern wie Anthropic, Meta, Mistral AI, Cohere u. a. innerhalb von AWS |

Komplexer als eine grundlegende LLM-API, insbesondere bei Berechtigungen, Regionen, Preisen und Modellzugriff |

Den besten LLM-API-Anbieter für deinen Use Case wählen

Die Wahl des richtigen LLM-API-Anbieters hängt von drei Faktoren ab:

- Was du baust

- Wie viel Kontrolle du brauchst

- Wie viel du ausgeben willst

Für Startups und kleine Teams sind Open-Source-LLM-API-Anbieter oft der beste Einstieg. Plattformen wie Together AI, Fireworks AI und Nebius AI geben dir Zugriff auf leistungsstarke Open-Modelle, ohne selbst GPUs oder Infrastruktur zu betreiben. Für Experimente und frühe Produktphasen sind sie oft schneller, günstiger und flexibler.

Wenn du schnell verschiedene Modelle testen möchtest, sind LLM-Routing-Anbieter eine starke Option. Tools wie OpenRouter und Requesty.ai erlauben dir, Closed-Source- und Open-Source-Modelle über eine API zu vergleichen, Fallbacks zu managen und Anbieter zu wechseln, ohne deine Anwendung neu zu schreiben.

Für Workflows, in denen Modellqualität wichtiger ist als Kosten, bleiben native Anbieter wie OpenAI und Anthropic erste Wahl. Sie sind besonders geeignet für produktionsreife KI-Assistenten, Coding-Tools, Reasoning-lastige Workflows, multimodale Apps und agentische Systeme, bei denen Zuverlässigkeit und Performance zählen.

Wenn euer Unternehmen bereits auf AWS oder Google Cloud läuft, ergibt es häufig Sinn, im jeweiligen Ökosystem zu bleiben. Amazon Bedrock und Google Vertex AI bieten gemanagten Modellzugang, Sicherheitskontrollen, Governance und Integrationen mit euren bestehenden Tools.

Fazit

Für technische Arbeit, Coding-Assistenten und „Vibe Coding“-Tools würde ich zum Start nicht übermäßig experimentieren. Nach meiner Erfahrung sind OpenAI und Anthropic in der Regel die sichersten Optionen – dank starkem Coding, Reasoning und gutem Developer-Tooling.

Open-Source-LLM-API-Anbieter und LLM-Routing-Anbieter sind starke Alternativen für fortgeschrittenere Experimente.

Große Cloud-LLM-Anbieter lohnen sich meist im Unternehmenskontext. In diesem Fall bleib bei dem Ökosystem, das ihr ohnehin nutzt.

LLM-API-Anbieter: Häufige Fragen

Was ist ein LLM-API-Anbieter?

Ein Unternehmen oder eine Plattform, die große Sprachmodelle hostet und sie über eine API zugänglich macht. So können Entwickler Anfragen senden und KI-generierte Antworten erhalten, ohne selbst GPUs oder Inference-Infrastruktur zu betreiben.

Worin besteht der Unterschied zwischen einem nativen LLM-Anbieter und einem Cloud-LLM-Anbieter?

Native Anbieter (wie OpenAI und Anthropic) entwickeln und betreiben ihre eigenen Modelle direkt. Cloud-Anbieter (wie AWS Bedrock und Google Vertex AI) bieten gemanagten Zugriff auf mehrere Drittanbieter-Modelle – eingebettet in ein bestehendes Cloud-Ökosystem mit Enterprise-Sicherheits- und Governance-Tools.

Wann sollte ich einen LLM-Routing-Anbieter wie OpenRouter oder Requesty.ai nutzen?

Wenn du mit mehr als einem Modell oder Anbieter arbeiten willst, automatisches Fallback bei Ausfällen benötigst oder Modelle vergleichen und Kosten steuern möchtest – alles über eine einzige API-Integration.

Sind Open-Source-LLM-API-Anbieter weniger leistungsfähig als native Anbieter wie OpenAI?

Nicht unbedingt; es hängt von der Aufgabe ab. Plattformen wie Together AI und Fireworks AI hosten State-of-the-Art-Open-Modelle wie Llama, DeepSeek und Mistral, die mit Closed-Source-Modellen konkurrieren können – oft zu deutlich geringeren Kosten.

Welcher LLM-API-Anbieter ist am besten für Unternehmen mit strengen Compliance-Anforderungen geeignet?

Amazon Bedrock und Google Vertex AI sind in der Regel die stärksten Optionen. Sie bieten Cloud-native Sicherheitskontrollen, IAM, Verschlüsselung, Audit-Logging und Governance-Funktionen, die sich in bestehende Enterprise-Infrastruktur integrieren.

Als zertifizierter Data Scientist ist es meine Leidenschaft, modernste Technologien zu nutzen, um innovative Machine Learning-Anwendungen zu entwickeln. Mit meinem fundierten Hintergrund in den Bereichen Spracherkennung, Datenanalyse und Reporting, MLOps, KI und NLP habe ich meine Fähigkeiten bei der Entwicklung intelligenter Systeme verfeinert, die wirklich etwas bewirken können. Neben meinem technischen Fachwissen bin ich auch ein geschickter Kommunikator mit dem Talent, komplexe Konzepte in eine klare und prägnante Sprache zu fassen. Das hat dazu geführt, dass ich ein gefragter Blogger zum Thema Datenwissenschaft geworden bin und meine Erkenntnisse und Erfahrungen mit einer wachsenden Gemeinschaft von Datenexperten teile. Zurzeit konzentriere ich mich auf die Erstellung und Bearbeitung von Inhalten und arbeite mit großen Sprachmodellen, um aussagekräftige und ansprechende Inhalte zu entwickeln, die sowohl Unternehmen als auch Privatpersonen helfen, das Beste aus ihren Daten zu machen.