track

Furnizorii de API pentru Large Language Models (LLM) oferă dezvoltatorilor acces la modele AI puternice fără a fi nevoie să gestioneze GPU-uri, implementarea modelelor, scalarea sau infrastructura de inferență. În loc să găzduiți propriul model, dezvoltatorii se pot conecta la un API, pot alege un model, pot trimite o solicitare și pot primi un răspuns.

În acest articol, vom analiza top 10 furnizori de API pentru LLM pe baza calității modelelor, experienței dezvoltatorilor, prețurilor, scalabilității, suportului din ecosistem și gradului de pregătire pentru producție. Pentru fiecare furnizor, vom acoperi pentru ce este cel mai potrivit, principalele avantaje și principalele dezavantaje pe care trebuie să le ia în calcul dezvoltatorii.

Acest ghid împarte cei mai buni furnizori de API pentru LLM în patru categorii:

- Furnizori LLM nativi

- Furnizori de API LLM open-source

- Furnizori de rutare LLM

- Furnizori LLM în cloud

Furnizori LLM nativi

Furnizorii LLM nativi își construiesc, antrenează și servesc propriile familii de modele prin API-uri. Sunt adesea cea mai puternică opțiune pentru dezvoltatorii care își doresc calitate ridicată a modelelor, documentație fiabilă, raționare avansată, suport multimodal și instrumente gata de producție.

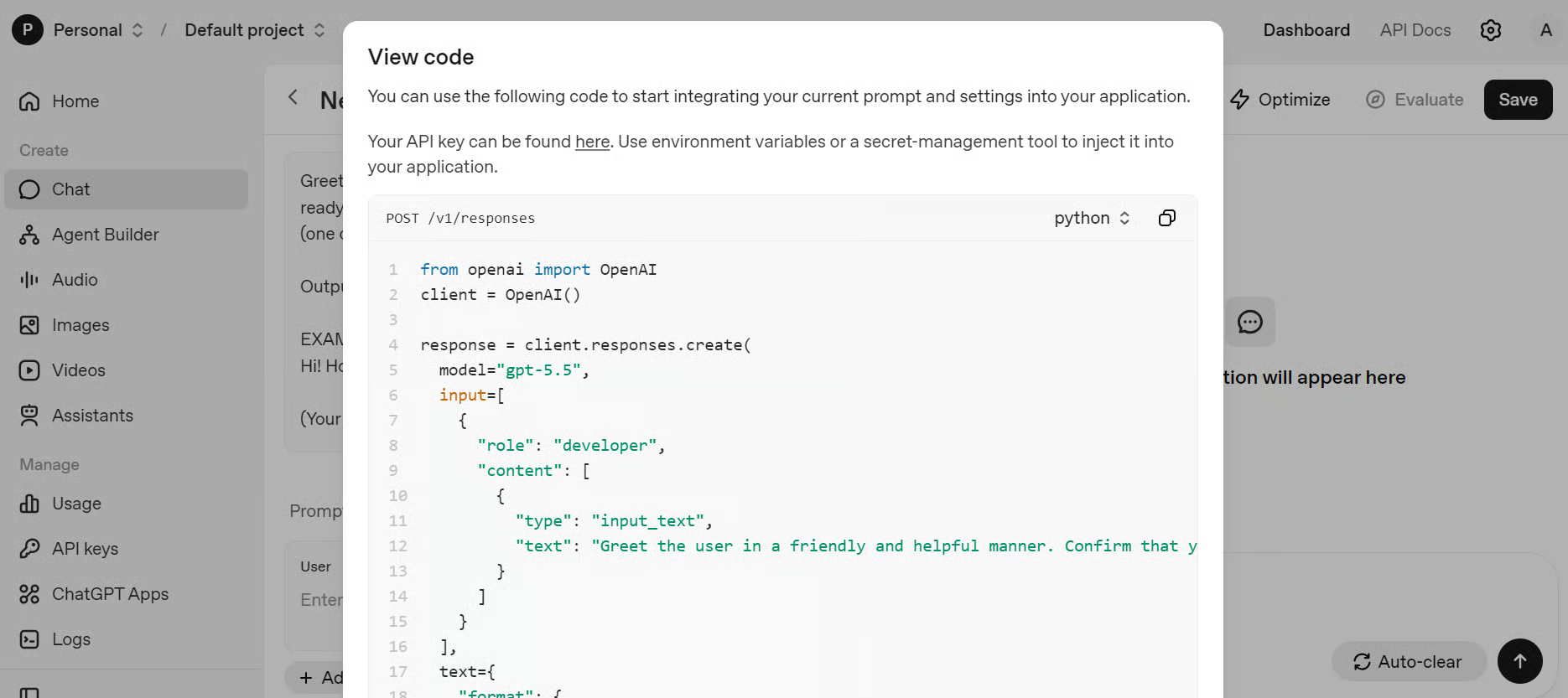

1. OpenAI

OpenAI este unul dintre cei mai răspândiți furnizori de API pentru LLM. Platforma sa API oferă acces la:

- Modele de raționare de frontieră precum GPT-5.5

- Generare și traducere vocală în timp real prin GPT-Realtime-2

- Generare de imagini prin modelul de generare GPT-Images-2.0

- Dezvoltare bazată pe agenți prin OpenAI Agents SDK

API-ul său suportă streaming, interfețe în timp real și rezultate structurate.

OpenAI este o alegere solidă pentru echipele care construiesc asistenți AI, instrumente de programare, agenți de suport clienți, co-piloți interni, aplicații multimodale și sisteme bazate pe agenți.

Sursă: OpenAI

Un dezavantaj este că OpenAI poate deveni costisitor la scară, în special pentru aplicații cu volum mare sau cu sarcini intense de raționare. Este, de asemenea, un furnizor cu API închis, ceea ce înseamnă că dezvoltatorii au mai puțin control asupra internelor modelelor, găzduirii și personalizării față de modelele open-source sau auto-găzduite.

Cel mai potrivit pentru: aplicații AI de uz general, raționare, programare, fluxuri de lucru multimodale și produse AI gata de producție.

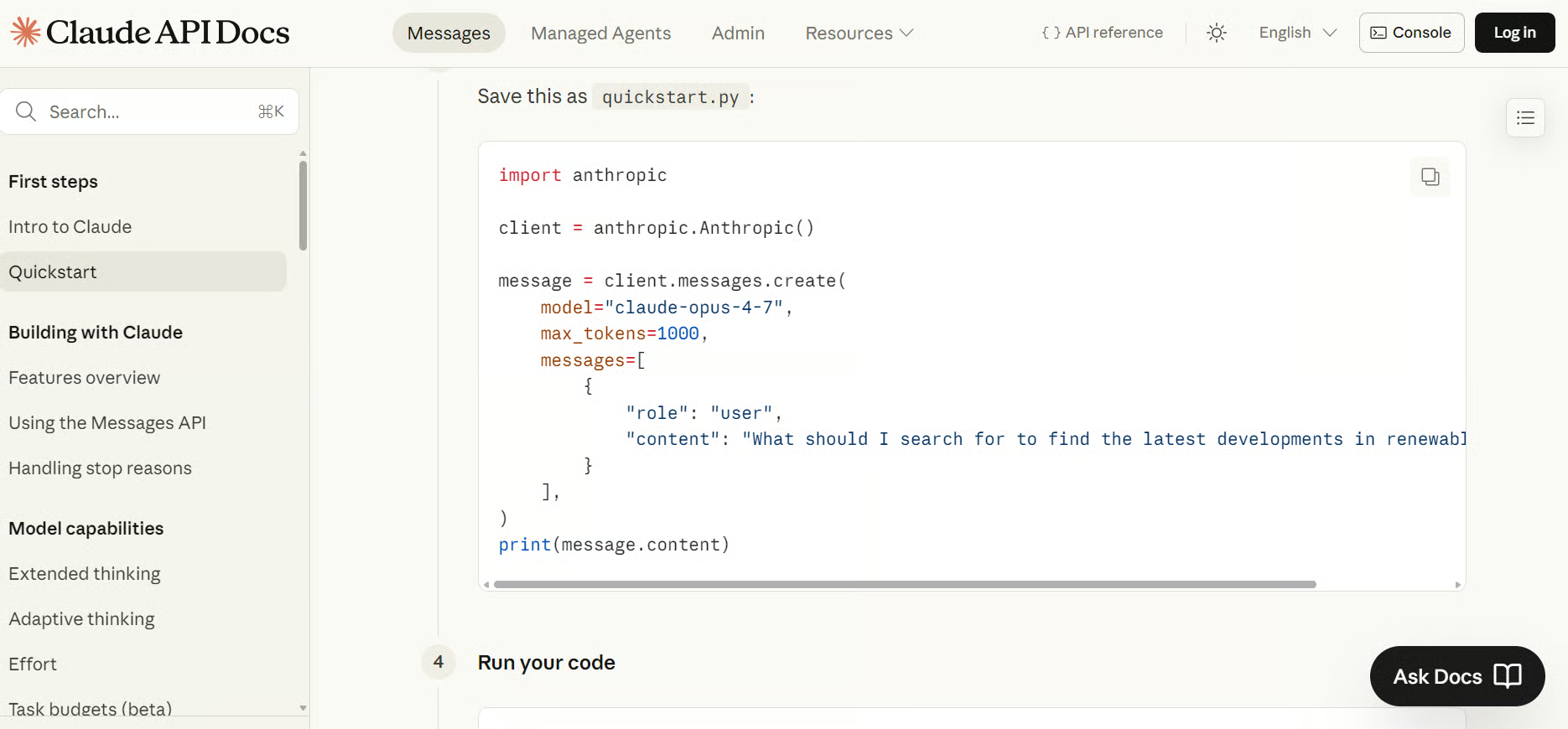

2. Anthropic

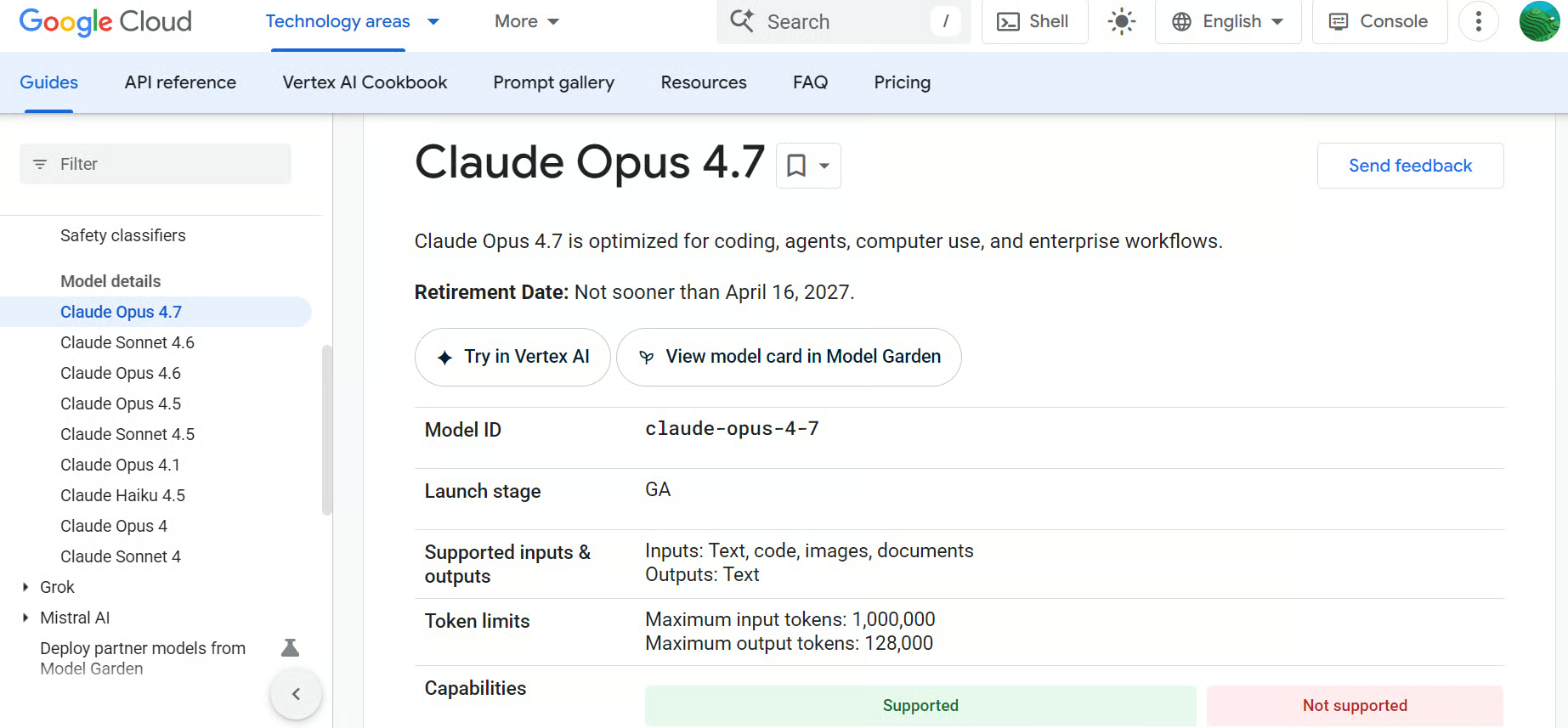

Anthropic oferă familia de modele Claude prin API-ul său, de exemplu cel mai recent model de vârf, Claude Opus 4.7. Claude este conceput pentru limbaj, raționare, analiză, programare, lucru cu context lung și fluxuri de lucru agentice. Platforma pentru dezvoltatori a Anthropic oferă echipelor acces direct la modele prin API-uri, SDK-uri și documentație pentru dezvoltatori.

Claude este deosebit de util pentru aplicații care au nevoie de respectare atentă a instrucțiunilor, calitate ridicată a redactării, analiză de documente și gestionare fiabilă a prompturilor complexe.

Sursă: Începeți cu Claude

Un dezavantaj important este costul, mai ales când folosiți Claude pentru documente mari, prompturi cu context lung sau aplicații cu volum ridicat. Deoarece Claude este accesat printr-un API găzduit, echipele au și un control limitat asupra locului și modului în care rulează modelul.

Pentru cazuri sensibile la confidențialitate, dezvoltatorii ar trebui să analizeze cu atenție cerințele privind gestionarea datelor, păstrarea și conformitatea înainte de a trimite date confidențiale de afaceri sau ale clienților prin API.

Cel mai potrivit pentru: asistenți pentru programare, AI de nivel enterprise, analiză cu context lung, fluxuri de lucru pe documente și agenți AI.

Pentru o comparație detaliată a celor doi giganți AI, consultați ghidul nostru Anthropic vs OpenAI.

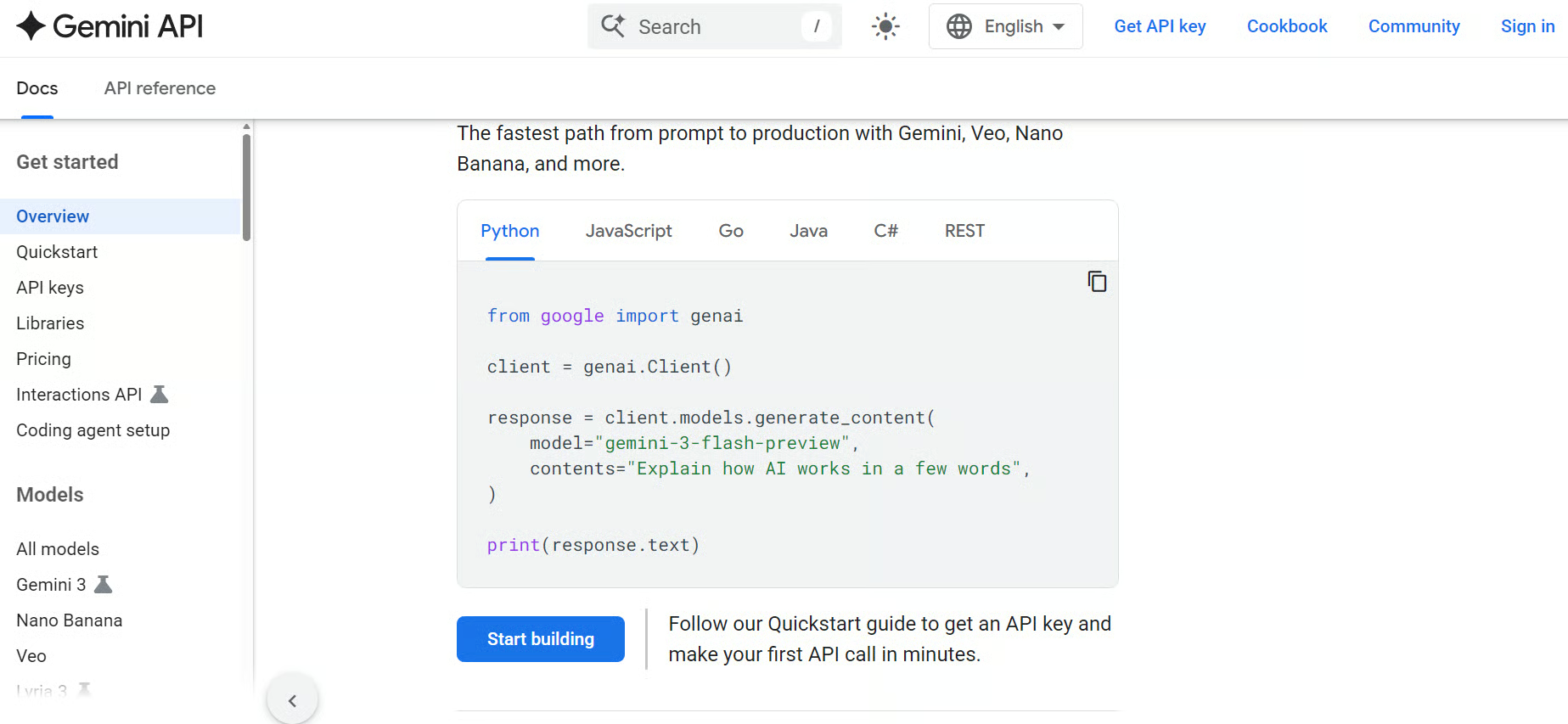

3. Google Gemini

Google Gemini este familia LLM nativă a Google, inclusiv Gemini 3.1 Pro, disponibilă prin Gemini API pentru dezvoltatori. Gemini API suportă API-uri standard, de streaming și în timp real, cu documentație pentru detalii despre modele, SDK-uri, prețuri, configurare și referințe API.

Cu Nano Banana 2 pentru generare de imagini și Veo 3.1 integrate, Gemini este o opțiune solidă pentru dezvoltatorii care creează aplicații multimodale. De asemenea, este o alegere bună pentru asistenți AI (mai ales cei care se bazează pe experiențe de căutare), instrumente de programare și produse conectate la ecosistemul AI mai larg al Google.

Sursă: Gemini API

Totuși, Gemini poate părea mai legat de ecosistemul Google, ceea ce poate să nu se potrivească echipelor care doresc o configurare neutră față de furnizor. Prețurile, disponibilitatea modelelor și suportul pentru funcționalități pot varia, de asemenea, între instrumente și regiuni.

Pentru aplicațiile sensibile la confidențialitate, echipele ar trebui să revizuiască cerințele privind gestionarea datelor, păstrarea și conformitatea înainte de a trimite date confidențiale de afaceri sau ale clienților prin API.

Cel mai potrivit pentru: aplicații AI multimodale, integrare în ecosistemul Google, fluxuri de lucru cu context lung, programare și aplicații AI de uz general.

Furnizori de API LLM open-source

Furnizorii de API LLM open-source oferă dezvoltatorilor acces găzduit, prin API, la modele open-source și cu greutăți deschise. În loc să descărcați modele și să le rulați pe propriile GPU-uri, aceste platforme găzduiesc modelele și le pun la dispoziție prin API-uri simple.

Acești furnizori sunt utili pentru echipele care vor costuri mai mici, mai multă flexibilitate a modelelor, experimentare mai rapidă și acces la modele deschise populare precum Llama, DeepSeek, Qwen, Mistral, Gemma și altele.

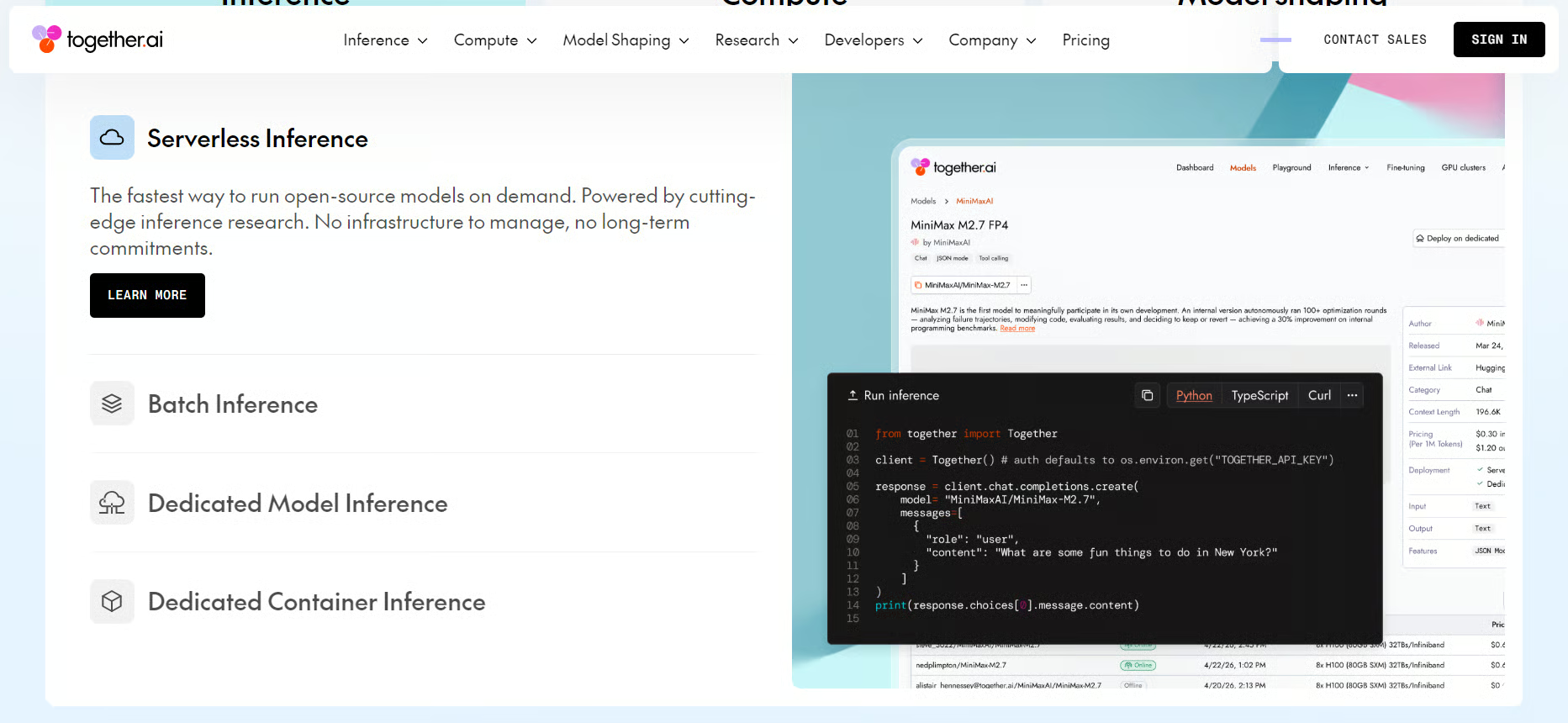

4. Together AI

Together AI oferă acces găzduit la modele open-source și specializate printr-un API unificat. Catalogul său include peste 200 de modele pentru text, imagine, video, cod și audio, cu suport pentru inferență serverless, inferență în lot, endpointuri dedicate, ajustare fină, evaluări și clustere GPU.

Together AI este o opțiune solidă pentru dezvoltatorii care vor să construiască folosind modele deschise fără a-și gestiona propria infrastructură. Este deosebit de util pentru echipele care testează mai multe modele, ajustează fin modele personalizate sau scalează sarcini de inferență.

Sursă: Together AI

Totuși, calitatea, viteza și fiabilitatea pot varia în funcție de modelul selectat. Echipele pot avea nevoie de mai multe teste, benchmark-uri și evaluări înainte de utilizarea în producție.

Pentru sarcini sensibile, echipele ar trebui să verifice dacă au nevoie de acces serverless, endpointuri dedicate sau opțiuni de implementare privată pentru a-și îndeplini cerințele de securitate și conformitate.

Cel mai potrivit pentru: inferință pe modele open-source, ajustare fină, sarcini AI scalabile și experimentare pe numeroase modele.

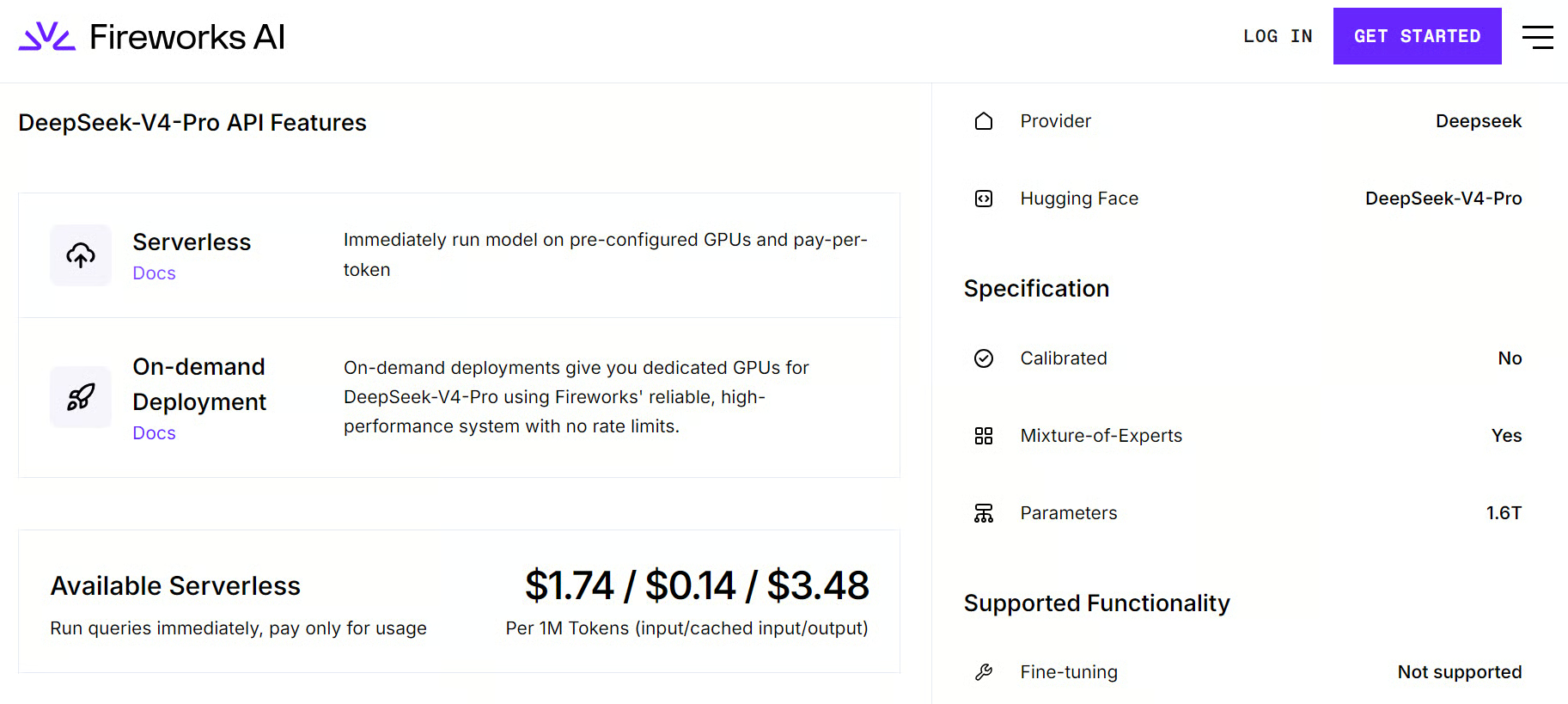

5. Fireworks AI

Fireworks AI se concentrează pe inferență rapidă pentru LLM-uri și modele generative open-source. Platforma sa suportă inferență serverless, implementări la cerere, ajustare fină și API-uri gata de producție pentru modele deschise populare.

Fireworks AI este o opțiune solidă pentru echipele care își doresc flexibilitatea modelelor deschise cu inferență mai rapidă și latență mai redusă. Este deosebit de util pentru AI conversațional, asistenți de programare, căutare, aplicații multimodale și sisteme RAG enterprise.

Sursă: Fireworks AI

Un dezavantaj cheie este că Fireworks AI este mai axat pe inferență și implementare decât pe a fi o platformă amplă, all-in-one, pentru dezvoltare AI. Echipele pot avea în continuare nevoie de instrumente separate pentru orchetrare, evaluări, monitorizare sau fluxuri de lucru complexe bazate pe agenți.

Echipele ar trebui, de asemenea, să ia în considerare dacă inferența serverless este suficientă pentru sarcinile sensibile sau dacă sunt necesare implementări dedicate pentru un control mai bun asupra performanței și conformității.

Cel mai potrivit pentru: inferință rapidă pe modele open-source, ajustare fină, aplicații AI de producție și implementări cu latență redusă pe modele deschise.

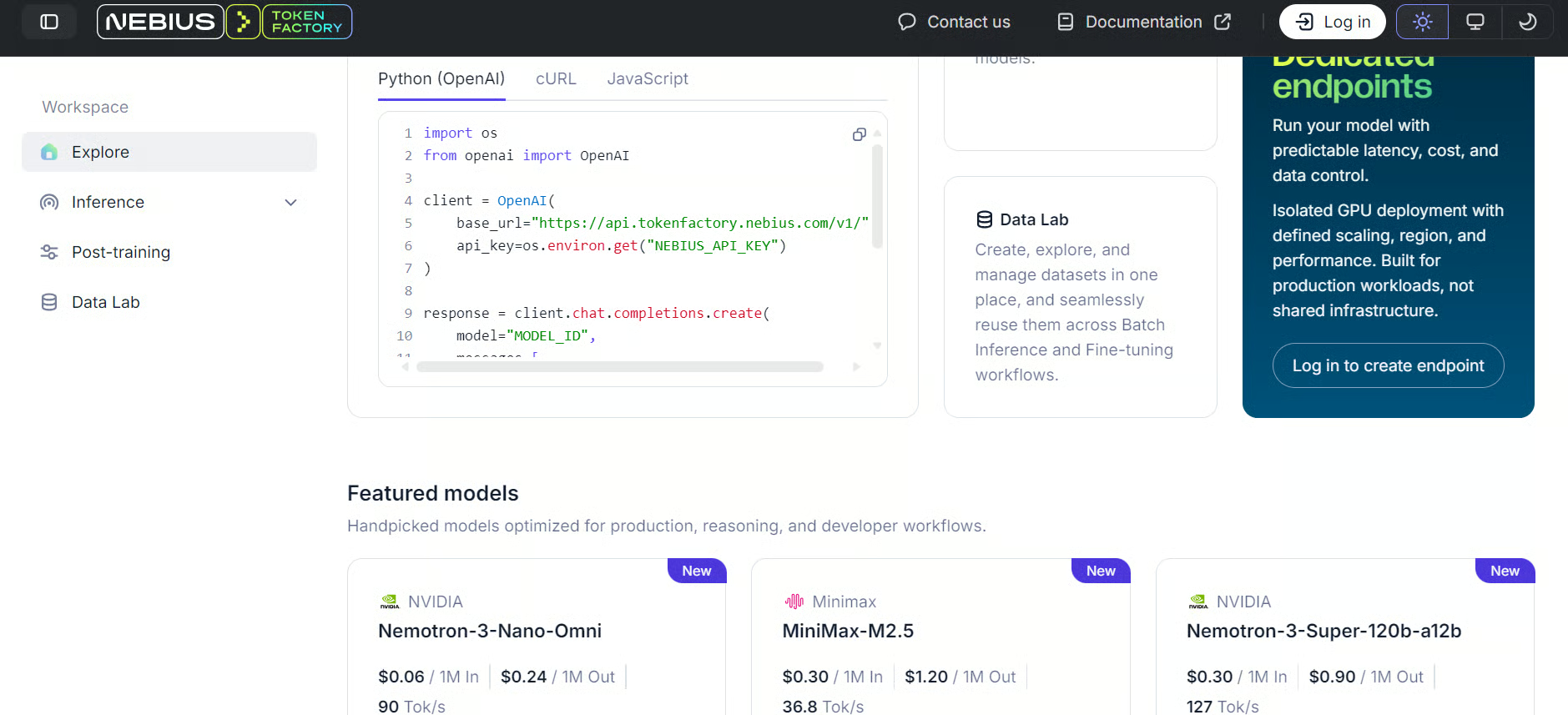

6. Nebius AI

Nebius AI este un furnizor de cloud AI creat pentru sarcini AI susținute de GPU, inferență găzduită, servire de modele și infrastructură AI scalabilă. Serviciul său de inferență Token Factory suportă modele deschise printr-un API compatibil cu OpenAI, cu opțiuni pentru inferență serverless, ajustare fină și infrastructură de cloud AI dedicată.

Nebius AI este o opțiune solidă pentru echipele care vor mai mult control asupra infrastructurii decât oferă un furnizor API de bază, evitând totodată complexitatea gestionării complete a propriilor medii GPU. Este deosebit de util pentru echipele care construiesc cu modele deschise și personalizate și care au nevoie de compute scalabil, inferență rapidă și opțiuni de implementare gata de producție.

Sursă: Nebius Token Factory

Nebius Token Factory oferă două niveluri de viteză a inferenței: Fast și Base. Fast este conceput pentru sarcini interactive cu latență scăzută, în timp ce Base este conceput pentru inferență mai eficientă ca cost, cu volum mare, sau pentru procesare în fundal.

Nebius este cu siguranță mai orientat spre infrastructură decât platformele LLM plug-and-play simple. Asta înseamnă că echipele pot avea nevoie de mai multe cunoștințe de cloud, implementare și management al sarcinilor pentru a obține valoarea maximă.

Pentru sarcini sensibile, echipele ar trebui să ia în considerare dacă inferența gestionată este suficientă sau dacă este necesară infrastructură dedicată pentru un control mai strict asupra securității, conformității și guvernanței datelor.

Cel mai potrivit pentru: infrastructură cloud AI, inferență găzduită, sarcini susținute de GPU, inferență rapidă și echipe care doresc mai mult control asupra implementării.

Furnizori de rutare LLM

Furnizorii de rutare LLM oferă dezvoltatorilor acces la mai multe modele și furnizori printr-un singur API. În loc să integrați separat cu OpenAI, Anthropic, Google, Mistral, DeepSeek și alți furnizori, dezvoltatorii pot folosi un singur strat de rutare pentru a gestiona accesul la modele dintr-un singur loc.

Aceste platforme sunt utile pentru compararea modelelor, rutare de tip fallback, optimizarea costurilor, redundanță la nivel de furnizor, observabilitate și comutarea între modele fără a rescrie aplicația.

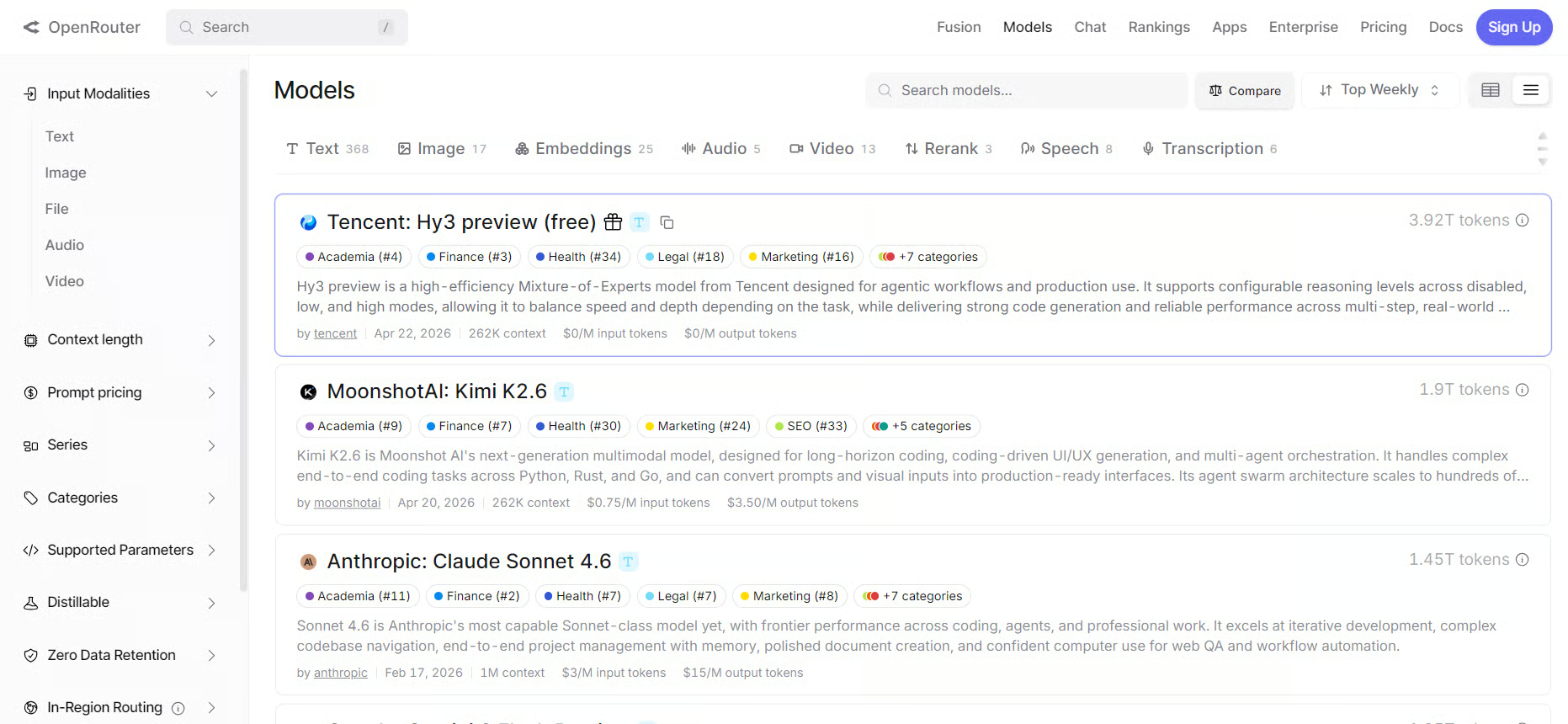

7. OpenRouter

OpenRouter este unul dintre cei mai populari furnizori de rutare LLM. Oferă dezvoltatorilor acces la multe modele printr-un singur API compatibil cu OpenAI, facilitând lucrul cu furnizori diferiți folosind o singură integrare.

Așa cum am acoperit în mai multe tutoriale, OpenRouter este o opțiune solidă pentru dezvoltatorii care vor să compare modele, să testeze rapid noi versiuni, să ruteze cereri între furnizori sau să evite blocarea la un singur vânzător de modele.

Sursă: OpenRouter

Un dezavantaj este că OpenRouter adaugă un alt strat între aplicația dumneavoastră și furnizorul de modele. Acest lucru poate introduce o dependență suplimentară, latență variabilă și comportamente specifice furnizorului care necesită totuși testare.

Pentru sarcini de producție, echipele ar trebui să revizuiască setările de rutare, comportamentul de fallback, preferințele de furnizor și controalele de confidențialitate înainte de a trimite trafic sensibil sau critic pentru afacere prin platformă.

Cel mai potrivit pentru: aplicații multi-model, compararea modelelor, rutare fallback, flexibilitate a furnizorilor și experimentare rapidă.

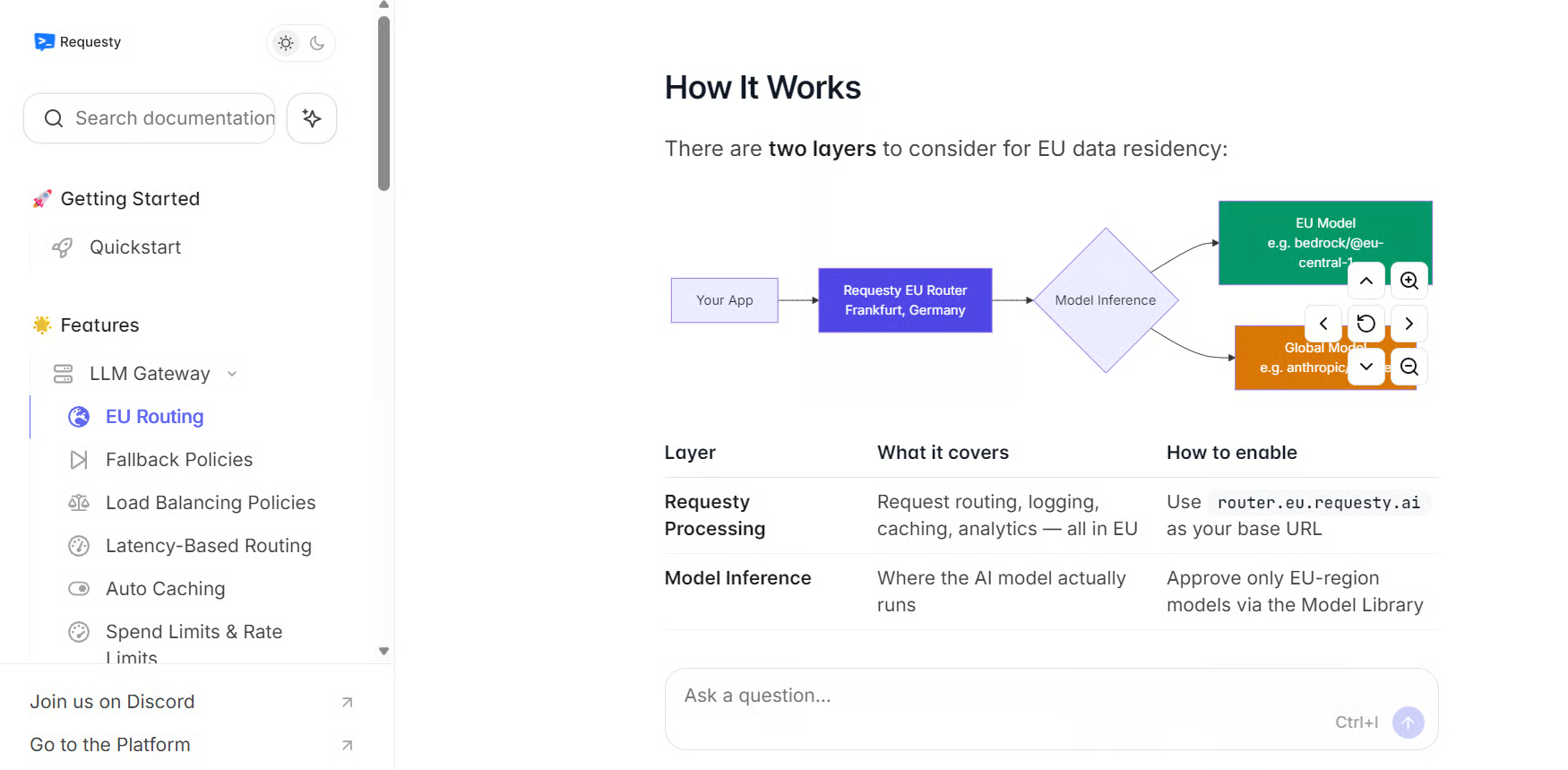

8. Requesty.ai

Requesty.ai este o platformă de rutare și gateway pentru LLM care ajută echipele să se conecteze la mai mulți furnizori LLM printr-un singur API compatibil cu OpenAI. Suportă peste 400 de modele, cu funcționalități pentru rutare, fallback, caching, managementul costurilor, observabilitate și guvernanță.

Requesty.ai este o opțiune solidă pentru echipele care construiesc aplicații AI de producție ce se bazează pe mai mult de un furnizor de modele. Este deosebit de util pentru gestionarea politicilor de rutare, urmărirea utilizării, controlul cheltuielilor și îmbunătățirea fiabilității atunci când furnizorii eșuează, expiră sau ating limite de rată.

Sursă: Documentația Requesty AI

Ca și în cazul OpenRouter, principalul dezavantaj este că Requesty.ai adaugă un alt strat de gateway în stiva aplicației. Echipele trebuie să configureze cu atenție rutarea, mechanismul de fallback, înregistrările și guvernanța pentru a evita costuri, latențe sau comportamente ale furnizorilor neașteptate.

Pentru sarcini sensibile, Requesty.ai include controale precum detectarea PII, curățarea datelor, limite de conținut, jurnale de audit și funcții de guvernanță, dar echipele ar trebui totuși să decidă ce date pot trece prin gateway și cum ar trebui gestionate jurnalele.

Cel mai potrivit pentru: rutare LLM, controlul costurilor, observabilitate, fallback de furnizor, guvernanță și fluxuri de lucru de gateway AI pentru producție.

Furnizori LLM în cloud

Furnizorii LLM în cloud sunt platforme cloud mari care oferă dezvoltatorilor și companiilor acces gestionat la modele de bază. Aceste platforme suportă adesea propriile modele, precum și modele de la furnizori terți.

Sunt deosebit de utile pentru companiile care folosesc deja infrastructură cloud și au nevoie de securitate, guvernanță, conformitate, integrare a datelor, controale de implementare și management al modelelor într-un singur loc.

9. Google Vertex AI

Google Vertex AI este platforma de machine learning și AI generativă a Google Cloud. Oferă dezvoltatorilor și companiilor acces la modelele Gemini, Model Garden, instrumente pentru agenți și infrastructură gestionată pentru construirea, implementarea și gestionarea aplicațiilor AI.

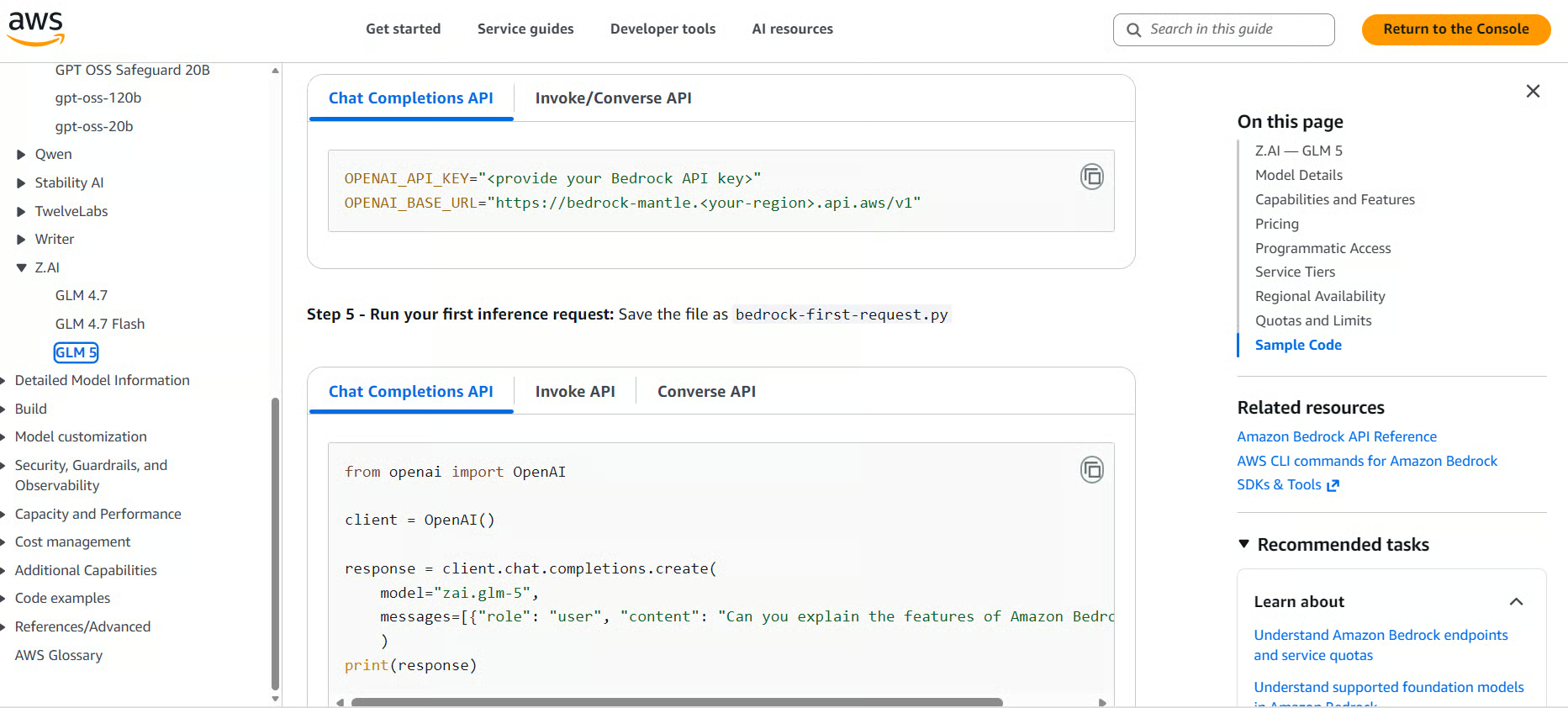

Vertex AI suportă, de asemenea, parteneri importanți și modele deschise prin Model Garden, inclusiv Anthropic Claude, xAI Grok, modelele Mistral AI și modele open-source precum GLM 5 și Gemma 4, alături de modelele Gemini ale Google.

Sursă: Generative AI on Vertex AI

Google Vertex AI este o opțiune solidă pentru echipele care folosesc deja Google Cloud și doresc implementare cloud-native a modelelor, guvernanță, controale de securitate și integrare cu ecosistemul mai larg de date și AI al Google.

Pe de altă parte, Vertex AI poate fi mai complex decât utilizarea unui simplu API de model. Echipele pot avea nevoie de experiență cu Google Cloud pentru a gestiona corect proiectele, permisiunile, facturarea, setările de implementare și integrările.

Pentru sarcini sensibile, Vertex AI este util pentru echipele care au nevoie de controale de acces la nivel de cloud, guvernanță și infrastructură gestionată, dar deciziile de configurare privind jurnalizarea, accesul la date și regiunile de implementare necesită în continuare o analiză atentă.

Cel mai potrivit pentru: utilizatorii Google Cloud, acces la Gemini, aplicații AI enterprise, fluxuri multimodale și implementare cloud-native a modelelor.

10. Amazon Bedrock

Amazon Bedrock este platforma gestionată de AI generativă a AWS. Oferă dezvoltatorilor acces la modele de bază de la Amazon și furnizori terți printr-un singur serviciu AWS gestionat.

Bedrock suportă modele de la furnizori precum Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek și alții, fiind util pentru echipele care doresc opțiuni de modele în cadrul ecosistemului AWS.

Amazon Bedrock este o alegere puternică pentru companiile care construiesc deja pe AWS deoarece reunește accesul la modele, infrastructura cloud, controalele de securitate și integrarea enterprise într-o singură platformă.

Sursă: Amazon Bedrock

Un dezavantaj important este că Bedrock poate fi mai complex decât un simplu API pentru LLM. Echipele pot avea nevoie de experiență în AWS pentru a gestiona corect permisiunile, regiunile, accesul la modele, prețurile, rețeaua și setările de implementare.

Pentru sarcini sensibile, Bedrock este util deoarece prompturile și rezultatele nu sunt folosite pentru antrenarea modelelor de bază și nu sunt partajate cu furnizorii de modele, iar echipele pot utiliza controalele AWS precum criptarea, IAM și PrivateLink.

Cel mai potrivit pentru: utilizatorii AWS, AI enterprise, acces gestionat la modele de bază, implementări axate pe securitate și aplicații cloud-native de AI generativă.

Tabel comparativ al furnizorilor de API pentru LLM

Tabelul de mai jos compară principalii furnizori de API pentru LLM pe baza avantajelor cheie și a principalelor dezavantaje.

|

Furnizor |

Avantaje cheie |

Dezavantaje principale |

|

OpenAI |

Calitate ridicată a modelelor, API-uri mature, instrumente multimodale, rezultate structurate, embeddings, vorbire, generare de imagini și fluxuri de lucru agentice |

Poate deveni costisitor la scară și oferă mai puțin control decât modelele open-source sau auto-găzduite |

|

Anthropic |

Calitate ridicată a redactării, respectare atentă a instrucțiunilor, raționare, programare și suport pentru context lung |

Costurile pot crește cu documente mari sau utilizare cu volum ridicat, iar echipele au control limitat asupra găzduirii și internelor modelelor |

|

Google Gemini |

Capabilități multimodale puternice, API-uri în timp real, suport pentru context lung și integrare strânsă cu ecosistemul AI al Google |

Poate părea legat de ecosistemul Google, iar prețurile, disponibilitatea și funcțiile pot varia în funcție de instrument sau regiune |

|

Together AI |

Acces găzduit la numeroase modele deschise și specializate, cu inferență serverless, endpointuri dedicate, ajustare fină, evaluări și infrastructură GPU |

Calitatea, viteza și fiabilitatea pot varia în funcție de modelul selectat |

|

Fireworks AI |

Inferență rapidă, latență redusă, acces serverless, implementări la cerere și API-uri gata de producție pentru modele deschise |

Mai concentrat pe inferență și implementare decât pe a fi o platformă completă, all-in-one, pentru dezvoltare AI |

|

Nebius AI |

Infrastructură susținută de GPU, inferență găzduită, API compatibil cu OpenAI și niveluri de viteză precum Fast și Base |

Mai orientat spre infrastructură, așadar echipele pot avea nevoie de cunoștințe solide de cloud și implementare |

|

OpenRouter |

Acces la multe modele printr-un singur API compatibil cu OpenAI, cu comutare mai ușoară a furnizorilor și opțiuni de fallback |

Adaugă un strat suplimentar între aplicație și furnizor, ceea ce poate afecta latența, fiabilitatea sau depanarea |

|

Requesty.ai |

Un API pentru mai mulți furnizori, cu rutare, fallback, caching, urmărirea costurilor, observabilitate și funcții de guvernanță |

Necesită configurare atentă a rutării, jurnalizării, fallback-ului și controalelor de cost pentru a evita comportamente neașteptate |

|

Google Vertex AI |

Acces gestionat la Gemini, Anthropic Claude, xAI Grok, Mistral AI și modele deschise prin Model Garden, plus instrumente Google Cloud pentru securitate și guvernanță |

Mai complex decât un simplu API și poate necesita experiență cu Google Cloud |

|

Amazon Bedrock |

Acces gestionat la modele de la Amazon și furnizori terți precum Anthropic, Meta, Mistral AI, Cohere și alții în cadrul AWS |

Mai complex decât un API LLM de bază, în special în ceea ce privește permisiunile, regiunile, prețurile și accesul la modele |

Alegerea celui mai bun furnizor de API pentru LLM pentru cazul dumneavoastră de utilizare

Alegerea furnizorului potrivit de API pentru LLM depinde de trei factori:

- Ce construiți

- Cât control aveți nevoie

- Cât sunteți dispus(ă) să cheltuiți

Pentru startup-uri și echipe mici, furnizorii de API LLM open-source sunt adesea cel mai bun punct de pornire. Platforme precum Together AI, Fireworks AI și Nebius AI vă oferă acces la modele deschise puternice fără să gestionați GPU-uri sau infrastructură. Pot fi mai rapide, mai ieftine și mai flexibile pentru experimentare și dezvoltarea timpurie a produselor.

Dacă doriți să testați rapid diferite modele, furnizorii de rutare LLM sunt o opțiune solidă. Instrumente precum OpenRouter și Requesty.ai vă permit să comparați modele închise și deschise printr-un singur API, să gestionați fallback-urile și să comutați furnizorii fără a rescrie aplicația.

Pentru fluxuri de lucru unde calitatea modelului contează mai mult decât costul, furnizorii nativi precum OpenAI și Anthropic rămân printre cele mai puternice alegeri. Sunt deosebit de utili pentru asistenți AI de producție, instrumente de programare, fluxuri de lucru cu raționare intensă, aplicații multimodale și sisteme agentice în care fiabilitatea și performanța modelelor sunt esențiale.

În cele din urmă, dacă compania dumneavoastră rulează deja pe AWS sau Google Cloud, de multe ori are sens să rămâneți în acel ecosistem cloud. Amazon Bedrock și Google Vertex AI vă oferă acces gestionat la modele, controale de securitate, guvernanță și integrare cu instrumentele pe care echipa le folosește deja.

Gânduri finale

Pentru munca tehnică, asistenți de programare și instrumente de tip vibe coding, nu aș exagera cu experimentarea la început. Din experiența mea, OpenAI și Anthropic sunt, de obicei, cele mai sigure alegeri datorită capabilităților puternice de programare, raționare și a instrumentelor pentru dezvoltatori.

Furnizorii de API LLM open-source și furnizorii de rutare LLM sunt alternative solide pentru experimentare mai avansată.

Furnizorii mari de LLM în cloud au, de obicei, sens doar într-un mediu corporativ. În acest caz, alegeți-l pe cel al cărui ecosistem îl utilizați deja.

Întrebări frecvente despre furnizorii de API pentru LLM

Ce este un furnizor de API pentru LLM?

O companie sau o platformă care găzduiește modele lingvistice mari și le expune printr-un API, astfel încât dezvoltatorii să poată trimite solicitări și primi răspunsuri generate de AI fără a gestiona ei înșiși vreo infrastructură de GPU sau inferență.

Care este diferența între un furnizor LLM nativ și un furnizor LLM în cloud?

Furnizorii nativi (precum OpenAI și Anthropic) își construiesc și servesc propriile modele direct. Furnizorii cloud (precum AWS Bedrock și Google Vertex AI) oferă acces gestionat la mai multe modele terțe, integrate într-un ecosistem cloud existent, cu instrumente enterprise pentru securitate și guvernanță.

Când ar trebui să folosesc un furnizor de rutare LLM precum OpenRouter sau Requesty.ai?

Când trebuie să lucrați cu mai mult de un model sau furnizor, doriți fallback automat dacă un furnizor are probleme sau aveți nevoie să comparați modele și să controlați costurile, totul printr-o singură integrare API.

Furnizorii de API LLM open-source sunt mai puțin capabili decât furnizorii nativi precum OpenAI?

Nu neapărat; depinde de sarcină. Platforme precum Together AI și Fireworks AI găzduiesc modele deschise de ultimă generație, precum Llama, DeepSeek și Mistral, care pot rivaliza cu modelele închise, adesea la costuri semnificativ mai mici.

Care furnizor de API pentru LLM este cel mai bun pentru companiile cu cerințe stricte de conformitate?

Amazon Bedrock și Google Vertex AI sunt, de obicei, cele mai bune alegeri, deoarece oferă controale de securitate cloud-native, IAM, criptare, jurnalizare pentru audit și funcții de guvernanță care se integrează cu infrastructura enterprise existentă.