Tracks

LLM(大規模言語モデル)APIプロバイダーは、GPUやモデルのデプロイ、スケーリング、推論基盤を自前で管理せずに強力なAIモデルへアクセスできるようにします。モデルを自前ホスティングする代わりに、APIへ接続してモデルを選び、リクエストを送ってレスポンスを受け取るだけで済みます。

本記事では、モデル品質、開発者体験、価格、スケーラビリティ、エコシステムの充実度、プロダクション対応の観点から、トップ10のLLM APIプロバイダーを取り上げます。各プロバイダーについて、適した用途、主な利点、開発者が考慮すべき欠点を解説します。

本ガイドでは、主要LLM APIプロバイダーを次の4カテゴリに整理しています。

- ネイティブLLMプロバイダー

- オープンソースLLM APIプロバイダー

- LLMルーティングプロバイダー

- クラウドLLMプロバイダー

ネイティブLLMプロバイダー

ネイティブLLMプロバイダーは、自社のモデル群を構築・学習し、APIを通じて提供します。高いモデル品質、信頼できるドキュメント、高度な推論、マルチモーダル対応、プロダクション対応のツール群を求める開発者にとって、最有力の選択肢になることが多いです。

1. OpenAI

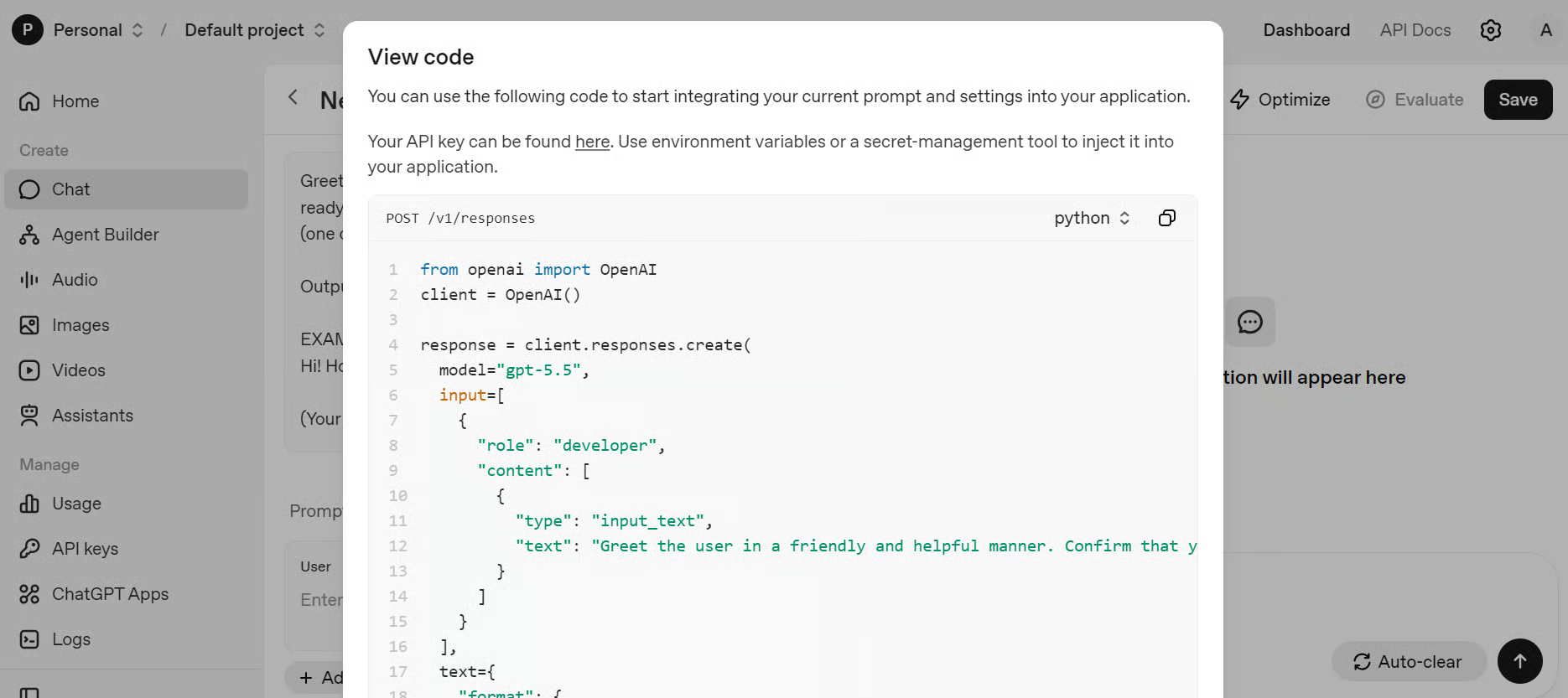

OpenAIは最も広く使われているLLM APIプロバイダーの一つです。そのAPI Platformでは次の機能にアクセスできます。

- GPT-5.5のような先端の推論モデル

- GPT-Realtime-2によるリアルタイム音声生成と翻訳

- GPT-Images-2.0による画像生成

- OpenAI Agents SDKを用いたエージェント型開発

APIはストリーミング、リアルタイムインターフェース、構造化出力をサポートしています。

OpenAIは、AIアシスタント、コーディングツール、カスタマーサポートエージェント、社内コパイロット、マルチモーダルアプリ、エージェント型システムの構築に適した強力な選択肢です。

出典: OpenAI

一方で、特に大量利用や推論負荷の高いアプリケーションではスケールに伴いコストが高くなる可能性があります。またクローズドなAPIプロバイダーであるため、オープンソースや自前ホスティングのモデルと比べて、モデル内部やホスティング、カスタマイズに関するコントロールの自由度は低くなります。

適している用途: 汎用AIアプリ、推論、コーディング、マルチモーダルワークフロー、プロダクション対応のAIプロダクト。

2. Anthropic

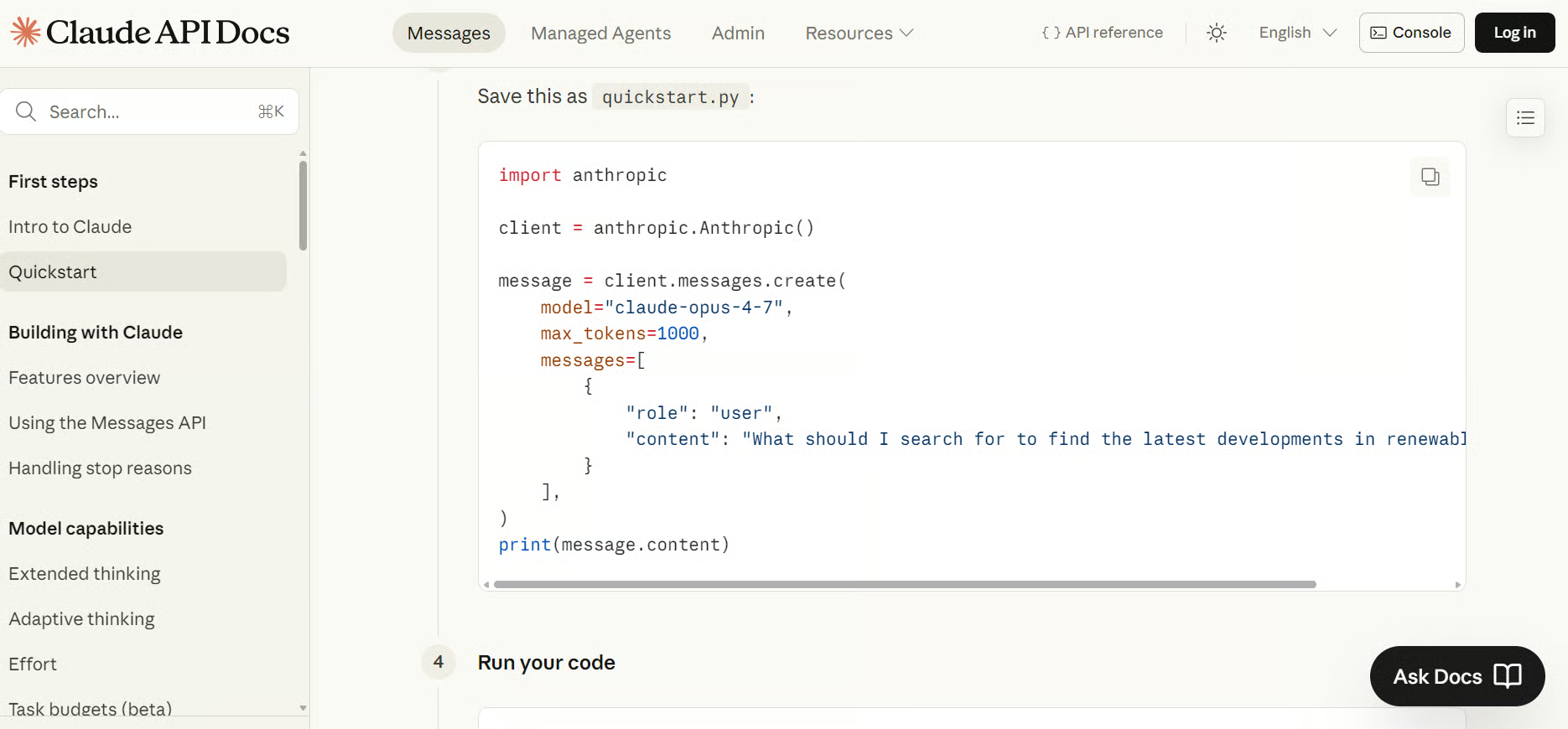

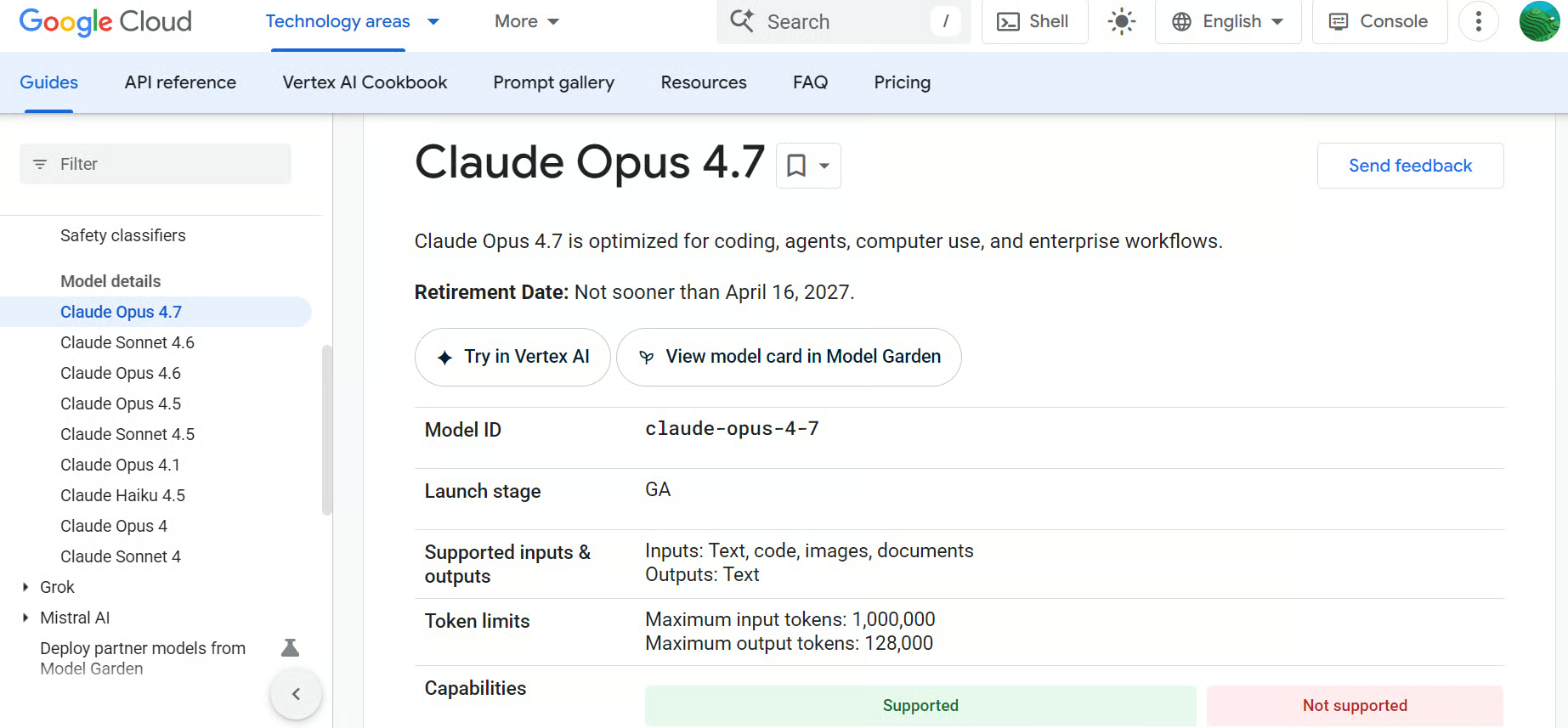

AnthropicはAPIを通じてClaudeモデル群(最新のフラッグシップであるClaude Opus 4.7など)を提供しています。Claudeは言語、推論、分析、コーディング、長文コンテキスト、エージェント的なワークフロー向けに設計されています。Anthropicの開発者向けプラットフォームでは、APIやSDK、ドキュメントを通してモデルへ直接アクセスできます。

Claudeは、丁寧な指示追従、高品質な文章生成、ドキュメント分析、複雑なプロンプトの安定した処理を要するアプリケーションで特に有用です。

主な欠点はコストで、特に大規模ドキュメント、長文コンテキストのプロンプト、高ボリューム用途では費用がかさみます。Claudeはホスト型のAPI経由で利用するため、モデルの実行場所や方法に対する制御も限定的です。

プライバシー重視のユースケースでは、機密性の高い業務データや顧客データをAPI経由で送信する前に、データの取り扱い、保存、コンプライアンス要件を慎重に確認してください。

適している用途: コーディングアシスタント、エンタープライズAI、長文コンテキスト分析、ドキュメント業務、AIエージェント。

2大プロバイダーの詳細比較は、Anthropic vs OpenAIのガイドをご覧ください。

3. Google Gemini

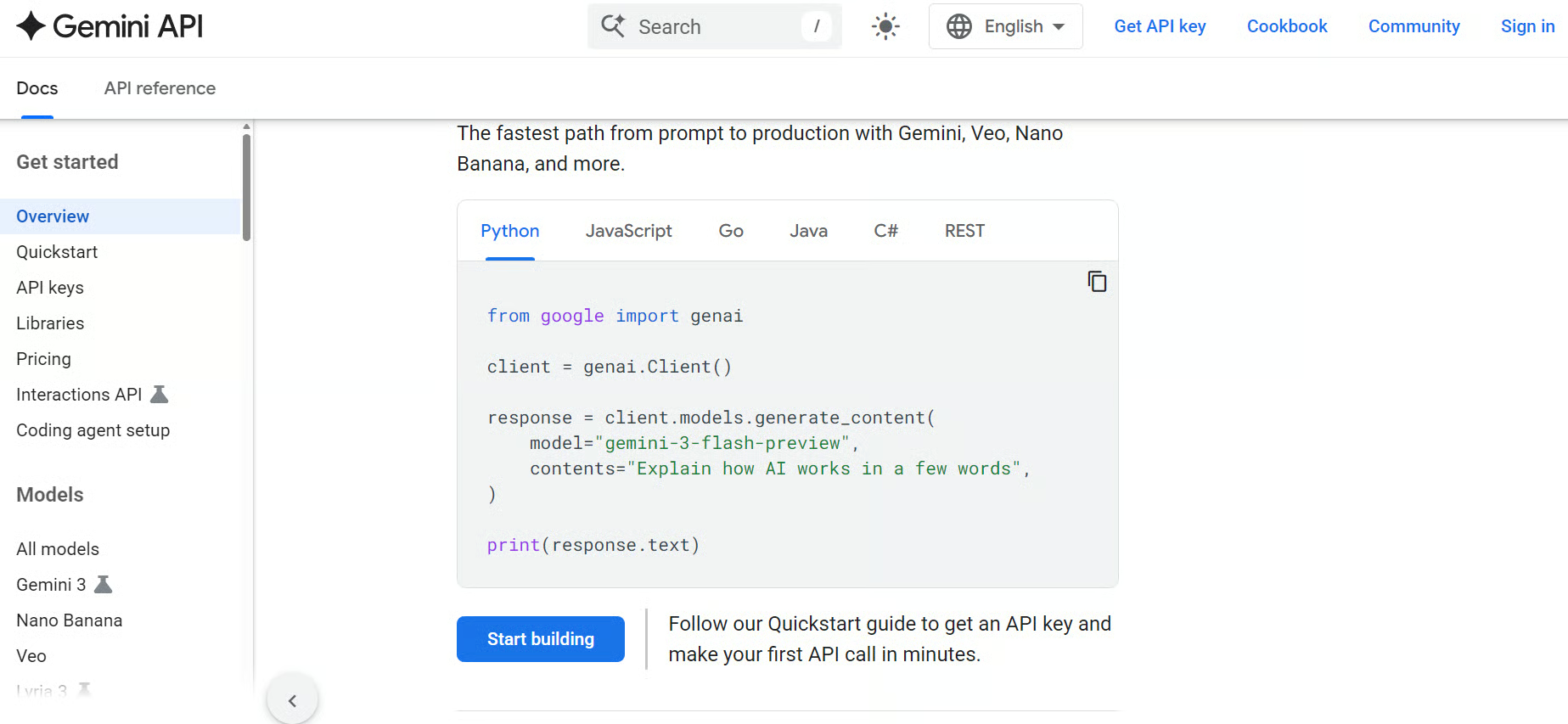

Google GeminiはGoogleのネイティブLLMファミリーで、Gemini 3.1 Proなどが開発者向けのGemini APIから利用可能です。Gemini APIは標準、ストリーミング、リアルタイムAPIをサポートし、モデル詳細、SDK、料金、セットアップ、APIリファレンスのドキュメントが提供されています。

Nano Banana 2による画像生成やVeo 3.1の統合により、Geminiはマルチモーダルアプリを構築する開発者にとって強力な選択肢です。検索体験に依存するアシスタント、コーディングツール、Googleの広範なAIエコシステムと連携するプロダクトにも適しています。

出典: Gemini API

一方で、GeminiはGoogleのエコシステムとの結び付きが強く、プロバイダーに中立な構成を求めるチームには合わない場合があります。料金、モデルの提供状況、機能のサポートはツールや地域によって異なることもあります。

プライバシー重視の用途では、機密性の高い業務データや顧客データをAPI経由で送る前に、データの取り扱い、保存、コンプライアンス要件を確認してください。

適している用途: マルチモーダルAIアプリ、Googleエコシステムとの統合、長文コンテキストのワークフロー、コーディング、汎用AIアプリケーション。

オープンソースLLM APIプロバイダー

オープンソースLLM APIプロバイダーは、オープンソース/オープンウェイトのモデルにホスト型APIでアクセスできるようにします。モデルをダウンロードして自前GPUで動かす代わりに、これらのプラットフォームがモデルをホスティングし、シンプルなAPIで利用できるようにします。

コストを抑えたい、モデル選択の柔軟性を高めたい、実験を素早く回したい、Llama、DeepSeek、Qwen、Mistral、Gemmaなどの人気オープンモデルにアクセスしたいチームに有用です。

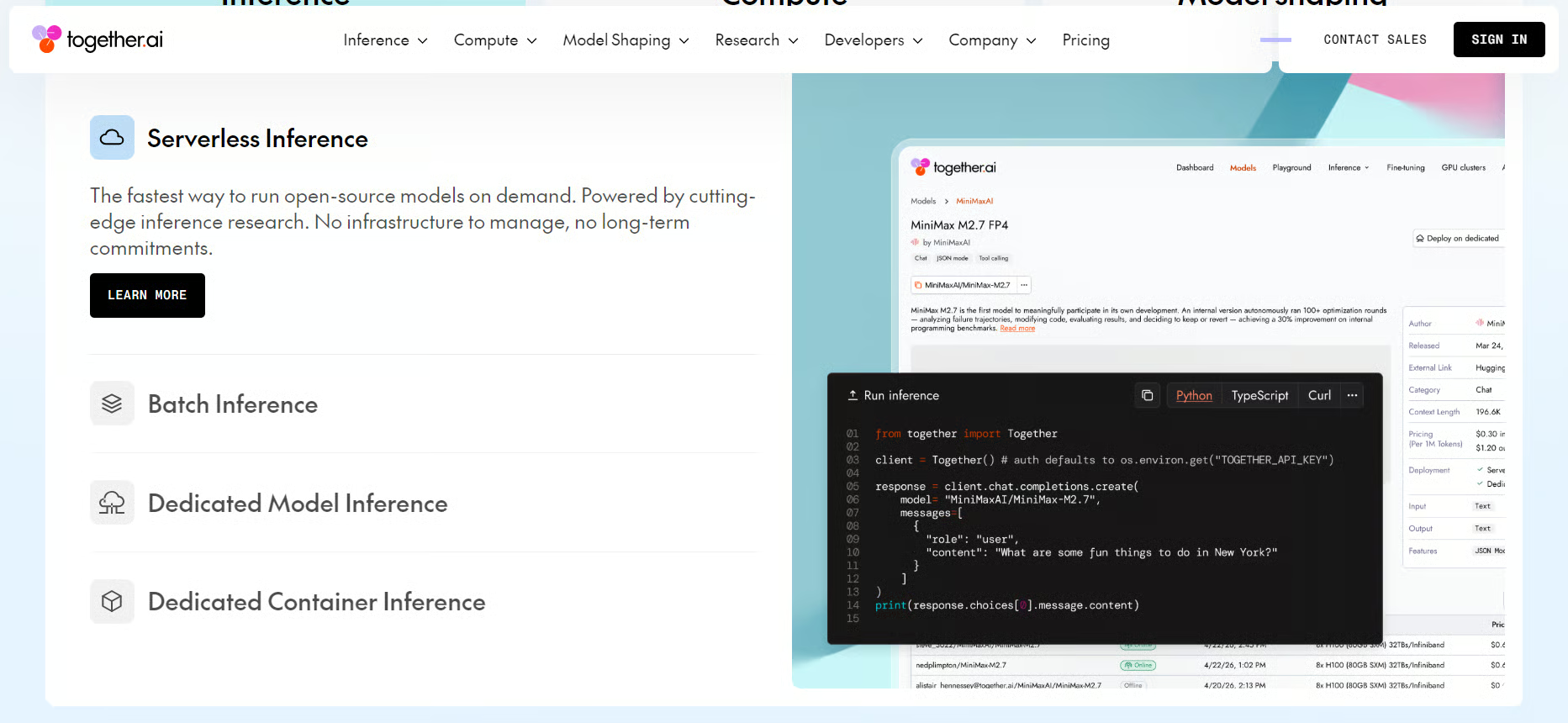

4. Together AI

Together AIは、統一APIを通じてオープンソースおよび特化型モデルへのホスト型アクセスを提供します。テキスト、画像、動画、コード、音声にわたる200以上のモデルを揃え、サーバーレス推論、バッチ推論、専用エンドポイント、ファインチューニング、評価、GPUクラスターをサポートします。

Together AIは、インフラ管理なしでオープンモデルを活用したい開発者に有力です。複数モデルの検証、カスタムモデルのファインチューニング、推論ワークロードのスケールに特に向いています。

出典: Together AI

ただし、モデルの選択によっては品質、速度、信頼性が変動する可能性があります。プロダクション投入前に、追加のテスト、ベンチマーク、評価が必要になる場合があります。

機密度の高いワークロードでは、サーバーレスアクセス、専用エンドポイント、プライベートデプロイのいずれが自社のセキュリティ/コンプライアンス要件に適合するかを確認してください。

適している用途: オープンソースモデルの推論、ファインチューニング、スケーラブルなAIワークロード、多数モデルでの実験。

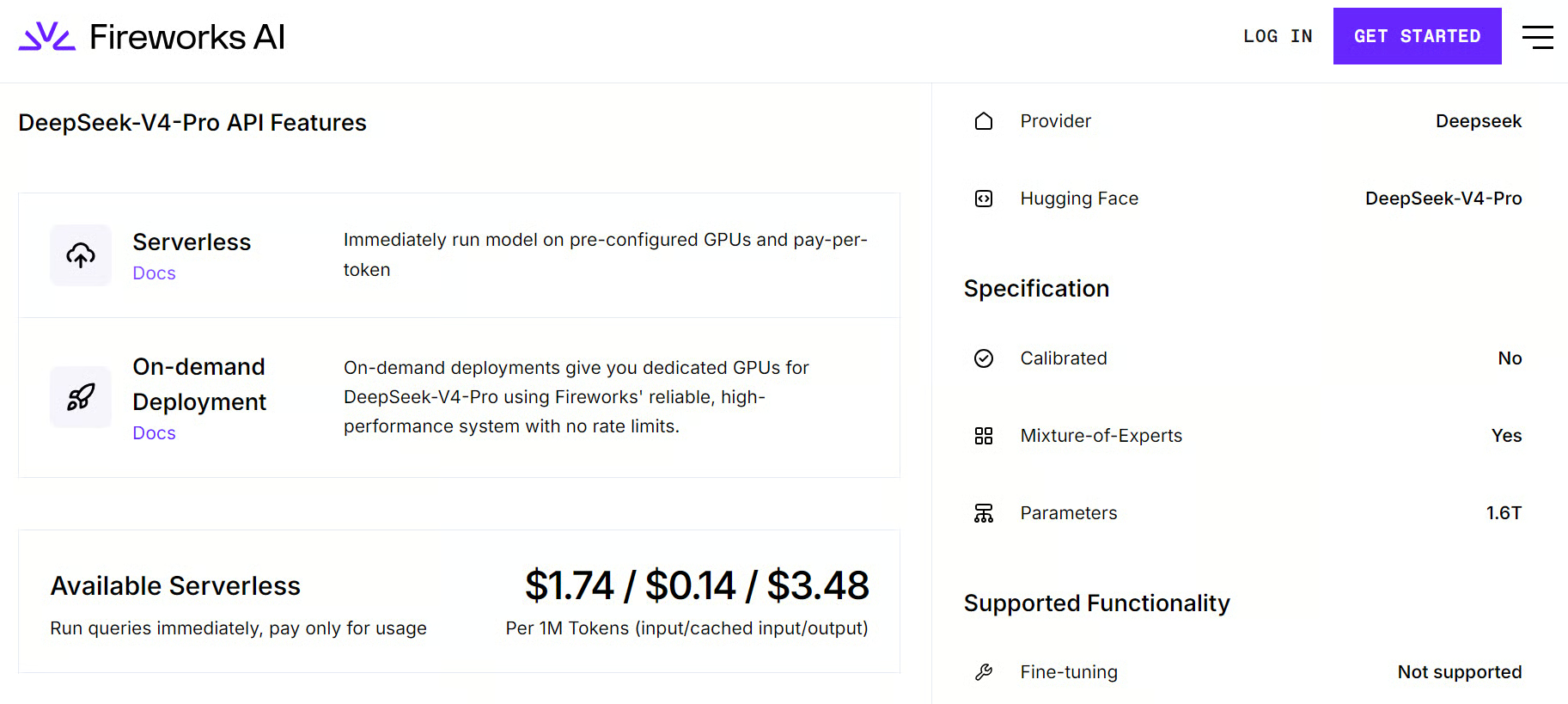

5. Fireworks AI

Fireworks AIは、オープンソースLLMや生成AIモデルの高速推論に特化しています。プラットフォームはサーバーレス推論、オンデマンドデプロイ、ファインチューニング、人気のオープンモデル向けのプロダクション対応APIを提供します。

Fireworks AIは、オープンモデルの柔軟性を維持しつつ、より高速な推論と低レイテンシを求めるチームに最適です。会話型AI、コーディングアシスタント、検索、マルチモーダルアプリ、エンタープライズRAGシステムで特に有用です。

出典: Fireworks AI

欠点として、Fireworks AIは包括的なオールインワンAIプラットフォームというより、推論とデプロイに焦点を当てています。オーケストレーション、評価、モニタリング、複雑なエージェントワークフローには別ツールが必要になる場合があります。

また、機密ワークロードにおいてサーバーレス推論で十分か、より厳格なパフォーマンス/コンプライアンス管理のために専用デプロイが必要かも検討してください。

適している用途: 高速なオープンソースモデル推論、ファインチューニング、プロダクションAIアプリ、低レイテンシのオープンモデルデプロイ。

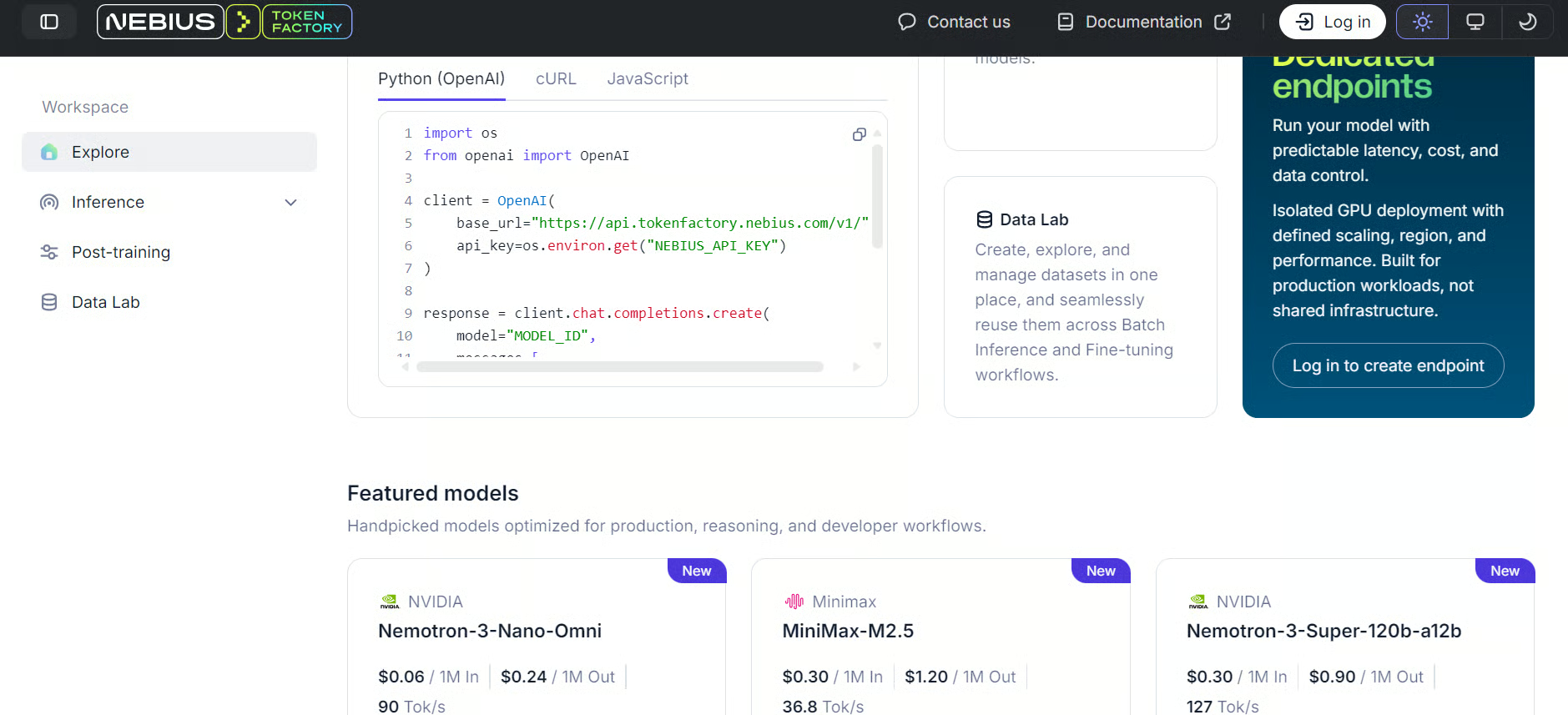

6. Nebius AI

Nebius AIは、GPUを活用したAIワークロード、ホスト型推論、モデル提供、スケーラブルなAIインフラ向けのAIクラウドプロバイダーです。Token Factory推論サービスはOpenAI互換APIでオープンモデルをサポートし、サーバーレス推論、ファインチューニング、専用のAIクラウドインフラなどの選択肢を提供します。

Nebius AIは、シンプルなAPIプロバイダーよりもインフラ制御を強めつつ、完全なGPU環境の自主管理による複雑さは避けたいチームに有力です。スケール可能なコンピュート、迅速な推論、プロダクション対応のデプロイオプションを必要とするオープン/カスタムモデル活用チームに特に向いています。

Nebius Token FactoryはFastとBaseの2つの推論速度レベルを提供します。Fastは低レイテンシの対話型ワークロード向け、Baseはコスト効率を重視した大規模推論やバックグラウンド処理向けです。

Nebiusは、プラグアンドプレイ型のシンプルなLLM APIプラットフォームに比べて、よりインフラ重視の性格が強いといえます。そのため、価値を最大化するにはクラウド、デプロイ、ワークロード管理に関する知見がより求められます。

機密ワークロードにおいて、マネージド推論で十分か、セキュリティ、コンプライアンス、データガバナンスの制御を強化するために専用インフラが必要かも検討してください。

適している用途: AIクラウドインフラ、ホスト型推論、GPU活用ワークロード、高速推論、デプロイ制御を重視するチーム。

LLMルーティングプロバイダー

LLMルーティングプロバイダーは、1つのAPIで複数のモデルやプロバイダーへアクセスできるようにします。OpenAI、Anthropic、Google、Mistral、DeepSeekなど各社と個別に統合する代わりに、1つのルーティングレイヤーでモデルアクセスを一元管理できます。

これらのプラットフォームは、モデル比較、フォールバックルーティング、コスト最適化、プロバイダー冗長化、可観測性、アプリの書き直しなしにモデルを切り替える用途に有用です。

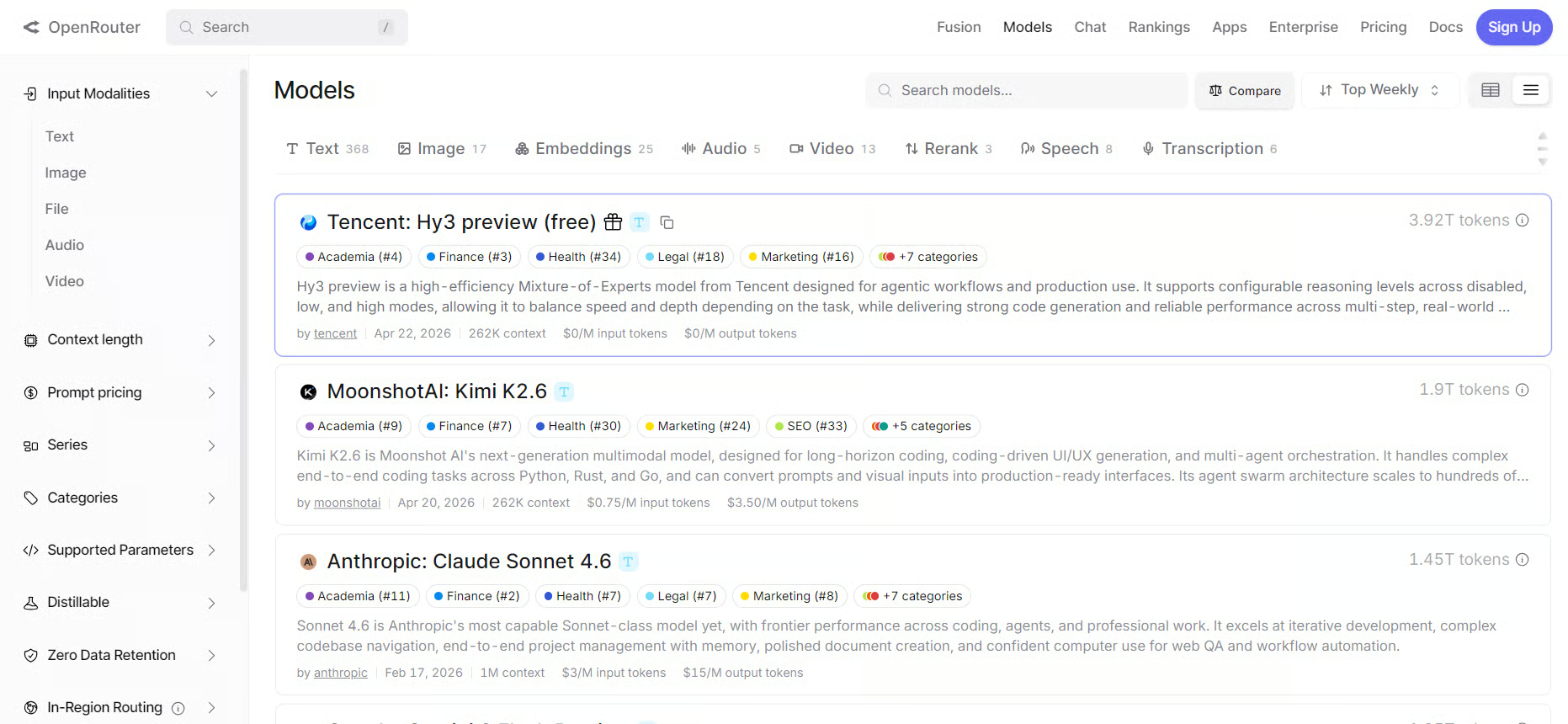

7. OpenRouter

OpenRouterは、人気の高いLLMルーティングプロバイダーの一つです。単一のOpenAI互換APIを通して多くのモデルにアクセスでき、1度の統合で複数プロバイダーを扱いやすくします。

複数のチュートリアルで取り上げているように、OpenRouterは、モデルの比較、新リリースの迅速なテスト、プロバイダー横断のリクエストルーティング、特定ベンダーへのロックイン回避を望む開発者に有力です。

出典: OpenRouter

欠点として、OpenRouterはアプリとモデルプロバイダーの間にもう一層を挟むため、依存関係の追加、レイテンシの変動、プロバイダー特有の挙動など、引き続きテストが必要な要素が増えます。

プロダクション用途では、機密データや重要トラフィックを流す前に、ルーティング設定、フォールバック動作、プロバイダー選好、プライバシー制御を確認してください。

適している用途: マルチモデルアプリ、モデル比較、フォールバックルーティング、プロバイダー柔軟性、迅速な実験。

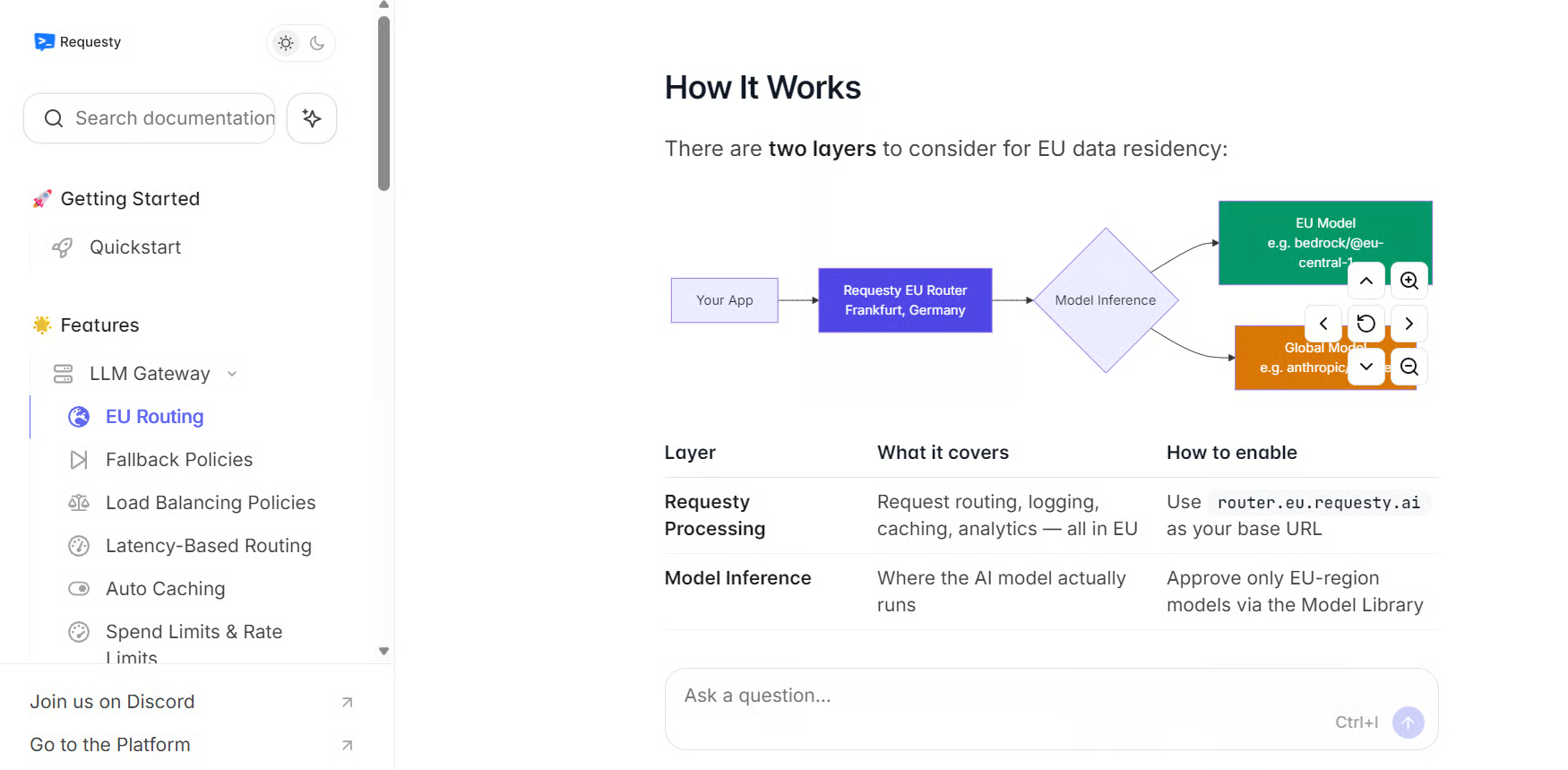

8. Requesty.ai

Requesty.aiは、OpenAI互換APIで複数のLLMプロバイダーに接続できるようにするLLMルーティング/ゲートウェイプラットフォームです。400以上のモデルをサポートし、ルーティング、フォールバック、キャッシュ、コスト管理、可観測性、ガバナンスの機能を備えています。

Requesty.aiは、複数のモデルプロバイダーに依存するプロダクションAIアプリを構築するチームに有力です。ルーティングポリシーの管理、使用状況の追跡、支出のコントロール、プロバイダーの障害・タイムアウト・レート制限時の信頼性向上に特に有用です。

OpenRouterの場合と同様に、Requesty.aiもアプリスタックにゲートウェイ層を追加する点が欠点です。ルーティング、フォールバック、ロギング、ガバナンスを適切に構成しないと、想定外のコストやレイテンシ、プロバイダー挙動につながる恐れがあります。

機密ワークロード向けには、PII検出、スクラビング、コンテンツガードレール、監査ログ、ガバナンス機能などの制御も用意されていますが、どのデータをゲートウェイに通すか、ログをどう管理するかはチーム側で判断が必要です。

適している用途: LLMルーティング、コスト管理、可観測性、プロバイダーフォールバック、ガバナンス、プロダクションのAIゲートウェイ運用。

クラウドLLMプロバイダー

クラウドLLMプロバイダーは、大規模クラウドプラットフォームが、基盤モデルへのマネージドアクセスを開発者や企業に提供するものです。自社モデルに加え、サードパーティモデルをサポートすることも多くあります。

クラウドインフラをすでに利用しており、セキュリティ、ガバナンス、コンプライアンス、データ統合、デプロイ制御、モデル管理を一元的に求める企業に特に有用です。

9. Google Vertex AI

Google Vertex AIは、Google Cloudの機械学習/生成AIプラットフォームです。Geminiモデル、Model Garden、エージェントツール、マネージドインフラにアクセスでき、AIアプリの構築・デプロイ・管理を支援します。

Vertex AIは、Model Gardenを通じて主要パートナーやオープンモデルもサポートしており、Anthropic Claude、xAI Grok、Mistral AIモデル、GLM 5やGemma 4などのオープンソースモデルに加え、GoogleのGeminiモデルも利用できます。

出典: Generative AI on Vertex AI

Google Cloudをすでに利用しており、クラウドネイティブなモデルデプロイ、ガバナンス、セキュリティ制御、Googleのデータ/AIエコシステムとの連携を求めるチームには有力な選択肢です。

一方で、単純なモデルAPIよりも複雑になりがちです。プロジェクト、権限、課金、デプロイ設定、各種統合を適切に扱うにはGoogle Cloudの経験が必要になる場合があります。

機密度の高いワークロードでは、クラウドレベルのアクセス制御、ガバナンス、マネージドインフラが有用ですが、ログ、データアクセス、デプロイ地域に関する設定は慎重に見直す必要があります。

適している用途: Google Cloudユーザー、Geminiへのアクセス、エンタープライズAIアプリ、マルチモーダルワークフロー、クラウドネイティブなモデルデプロイ。

10. Amazon Bedrock

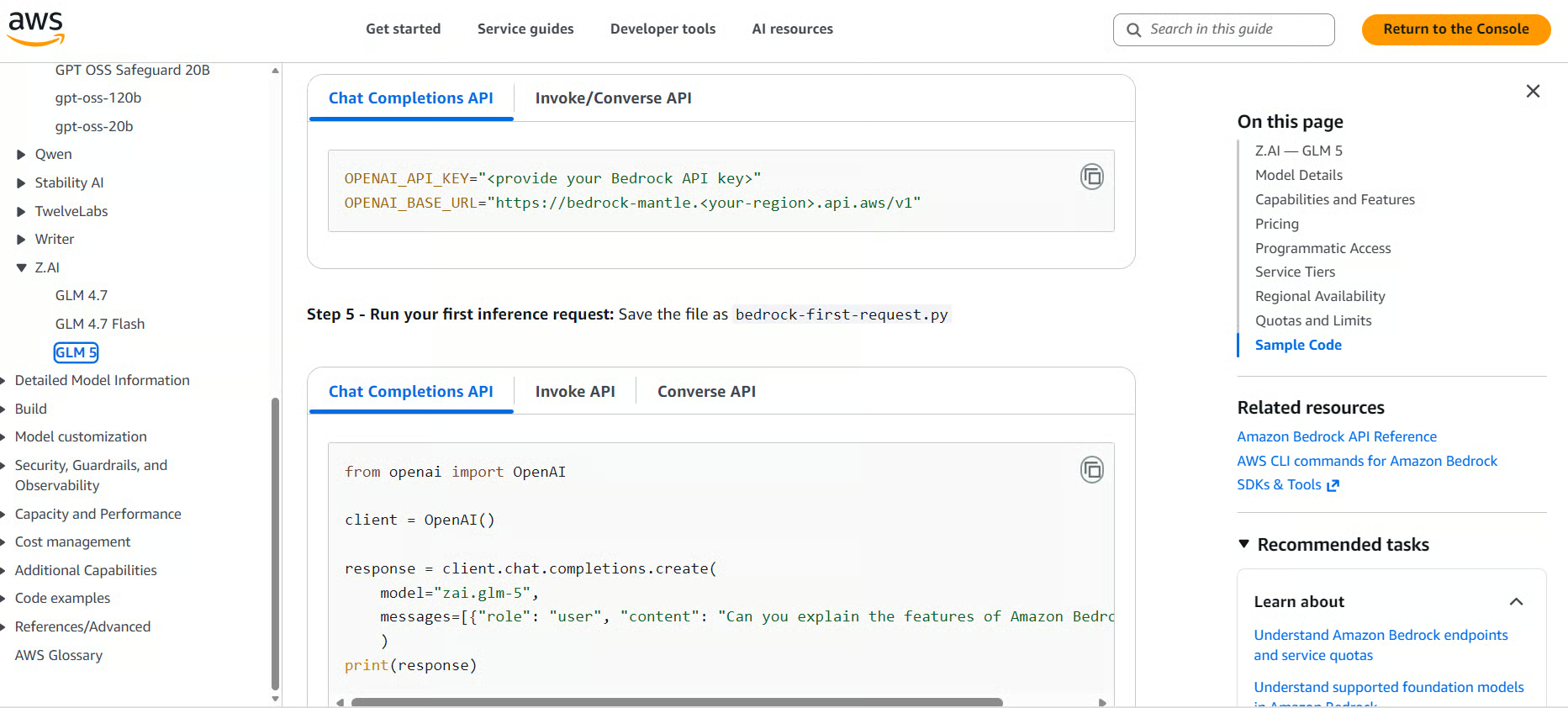

Amazon Bedrockは、AWSのマネージド生成AIプラットフォームです。Amazonおよびサードパーティの基盤モデルに、単一のマネージドAWSサービスを通じてアクセスできます。

Bedrockは、Amazon、Anthropic、Meta、Mistral AI、Cohere、DeepSeekなどのプロバイダーのモデルをサポートしており、AWSエコシステム内でモデルの選択肢を確保したいチームに有用です。

Amazon Bedrockは、すでにAWS上で開発している企業にとって強力な選択肢です。モデルアクセス、クラウドインフラ、セキュリティ制御、エンタープライズ統合を1つのプラットフォームで提供します。

出典: Amazon Bedrock

欠点として、Bedrockは基本的なLLM APIより複雑になりがちです。権限、リージョン、モデルアクセス、料金、ネットワーキング、デプロイ設定を適切に管理するにはAWSの経験が必要になる場合があります。

機密度の高いワークロードでは、プロンプトや出力がベースモデルの学習やモデルプロバイダーとの共有に使われない点が有用で、暗号化、IAM、PrivateLinkなどのAWS制御も活用できます。

適している用途: AWSユーザー、エンタープライズAI、マネージド基盤モデルアクセス、セキュリティ重視のデプロイ、クラウドネイティブな生成AIアプリ。

LLM APIプロバイダー比較表

以下の表では、主要LLM APIプロバイダーの主な利点と欠点を比較します。

|

プロバイダー |

主な利点 |

主な欠点 |

|

OpenAI |

高品質なモデル、成熟したAPI、マルチモーダルツール、構造化出力、埋め込み、音声、画像生成、エージェント型ワークフロー |

スケールすると高コストになり得る。オープンソースや自前ホスティングモデルに比べ制御性が低い |

|

Anthropic |

高品質な文章生成、丁寧な指示追従、推論、コーディング、長文コンテキスト対応 |

大規模文書や高ボリューム利用でコスト増。ホスティングやモデル内部の制御は限定的 |

|

Google Gemini |

強力なマルチモーダル機能、リアルタイムAPI、長文コンテキスト対応、GoogleのAIエコシステムとの緊密な統合 |

Googleエコシステムへの依存感。料金や提供状況、機能がツールや地域で変動 |

|

Together AI |

多数のオープン/特化型モデルへのホスト型アクセス。サーバーレス推論、専用エンドポイント、ファインチューニング、評価、GPUインフラ |

選ぶモデルにより品質・速度・信頼性が変動 |

|

Fireworks AI |

高速推論、低レイテンシ、サーバーレスアクセス、オンデマンドデプロイ、オープンモデル向けプロダクションAPI |

オールインワンのAI開発基盤というより、推論とデプロイに特化 |

|

Nebius AI |

GPU基盤インフラ、ホスト型推論、OpenAI互換API、Fast/Baseなどの速度ティア |

インフラ寄りのため、クラウドやデプロイの知見がより必要 |

|

OpenRouter |

1つのOpenAI互換APIで多数モデルにアクセス可能。プロバイダーの切替やフォールバックが容易 |

アプリとプロバイダーの間に層が増え、レイテンシや信頼性、デバッグに影響する可能性 |

|

Requesty.ai |

複数プロバイダーを1つのAPIで。ルーティング、フォールバック、キャッシュ、コスト追跡、可観測性、ガバナンス |

ルーティング、ロギング、フォールバック、コスト制御の適切な設定が不可欠 |

|

Google Vertex AI |

Gemini、Anthropic Claude、xAI Grok、Mistral AI、オープンモデルへのマネージドアクセス(Model Garden)。Google Cloudのセキュリティ/ガバナンスツール |

シンプルなAPIより複雑で、Google Cloudの知識が必要な場合あり |

|

Amazon Bedrock |

AWS内で、AmazonやAnthropic、Meta、Mistral AI、Cohereなどのサードパーティモデルへマネージドアクセス |

基本的なLLM APIより複雑(権限、リージョン、料金、モデルアクセスなど) |

ユースケース別に最適なLLM APIプロバイダーを選ぶには

最適なLLM APIプロバイダーは、次の3要素で決まります。

- 何を構築するか

- どの程度のコントロールが必要か

- どれだけのコストを許容できるか

スタートアップや小規模チームには、オープンソースLLM APIプロバイダーが出発点として有望です。Together AI、Fireworks AI、Nebius AIといったプラットフォームは、GPUやインフラを自前管理せずに強力なオープンモデルへアクセスできます。実験や初期プロダクト開発において、より高速・低コスト・柔軟になることが多いでしょう。

異なるモデルを素早く試したい場合は、LLMルーティングプロバイダーが有力です。OpenRouterやRequesty.aiのようなツールを使えば、単一APIでクローズドソースとオープンソース双方のモデルを比較し、フォールバックを管理し、アプリを書き換えずにプロバイダーを切り替えられます。

コストよりモデル品質を重視するワークフローでは、OpenAIやAnthropicといったネイティブプロバイダーが依然として有力です。プロダクションのAIアシスタント、コーディングツール、推論負荷の高いワークフロー、マルチモーダルアプリ、エージェント型システムなど、信頼性とモデル性能が最重要の場面で特に有用です。

最後に、すでにAWSやGoogle Cloudを利用している企業であれば、そのクラウドエコシステム内にとどまるのが理にかなうことが多いです。Amazon BedrockやGoogle Vertex AIは、マネージドなモデルアクセス、セキュリティ制御、ガバナンス、既存ツールとの統合を提供します。

まとめ

テクニカル作業、コーディングアシスタント、いわゆる「バイブ」系のコーディングツールについては、最初から過度に実験的になる必要はありません。筆者の経験では、OpenAIとAnthropicは、強力なコーディング能力、推論力、開発者向けツール群により、安全策として選ばれることが多いです。

より高度な実験には、オープンソースLLM APIプロバイダーやLLMルーティングプロバイダーが有力な代替手段になります。

大手クラウドのLLMプロバイダーは、基本的に企業環境でこそ真価を発揮します。この場合は、既に利用しているエコシステムに合わせるのが無難です。

LLM APIプロバイダーに関するFAQ

LLM APIプロバイダーとは何ですか?

LLMをホストしAPI経由で公開する企業またはプラットフォームのこと。開発者はGPUや推論基盤を自前で管理せず、リクエストを送ってAI生成の応答を受け取れます。

ネイティブLLMプロバイダーとクラウドLLMプロバイダーの違いは?

ネイティブプロバイダー(OpenAIやAnthropicなど)は自社モデルを直接構築・提供します。クラウドプロバイダー(AWS BedrockやGoogle Vertex AIなど)は、既存のクラウドエコシステム内で、エンタープライズ向けのセキュリティ/ガバナンスツールとともに、複数のサードパーティモデルへのマネージドアクセスを提供します。

OpenRouterやRequesty.aiのようなLLMルーティングプロバイダーはいつ使うべき?

複数のモデル/プロバイダーを使いたい場合、プロバイダー障害時の自動フォールバックが必要な場合、モデル比較やコスト管理を単一API統合で行いたい場合に適しています。

オープンソースLLM APIプロバイダーは、OpenAIのようなネイティブプロバイダーより能力が低いですか?

必ずしも劣るとは限りません。Together AIやFireworks AIのようなプラットフォームは、Llama、DeepSeek、Mistralといった最先端のオープンモデルをホストしており、タスクによってはクローズドモデルと競合し、しばしば大幅に低コストです。

厳格なコンプライアンス要件がある企業には、どのLLM APIプロバイダーが最適?

Amazon BedrockとGoogle Vertex AIが有力です。クラウドネイティブのセキュリティ制御、IAM、暗号化、監査ログ、ガバナンス機能を備え、既存のエンタープライズインフラと統合できます。