programa

Los proveedores de API de Large Language Models (LLM) dan a los desarrolladores acceso a potentes modelos de IA sin tener que gestionar GPUs, despliegues de modelos, escalado ni infraestructura de inferencia. En lugar de alojar el modelo por tu cuenta, te conectas a una API, eliges un modelo, envías una solicitud y recibes una respuesta.

En este artículo analizamos los 10 principales proveedores de API de LLM en función de la calidad del modelo, la experiencia para desarrolladores, los precios, la escalabilidad, el soporte del ecosistema y la preparación para producción. Para cada proveedor, verás para qué es más adecuado, sus ventajas clave y las principales desventajas a tener en cuenta.

Esta guía clasifica a los principales proveedores de API de LLM en cuatro categorías:

- Proveedores nativos de LLM

- Proveedores de API de LLM de código abierto

- Proveedores de enrutamiento de LLM

- Proveedores de LLM en la nube

Ingeniero Asociado de IA para Científicos de Datos

Proveedores nativos de LLM

Los proveedores nativos de LLM crean, entrenan y ofrecen sus propias familias de modelos a través de APIs. Suelen ser la opción más sólida si buscas alta calidad de modelo, documentación fiable, razonamiento avanzado, soporte multimodal y herramientas listas para producción.

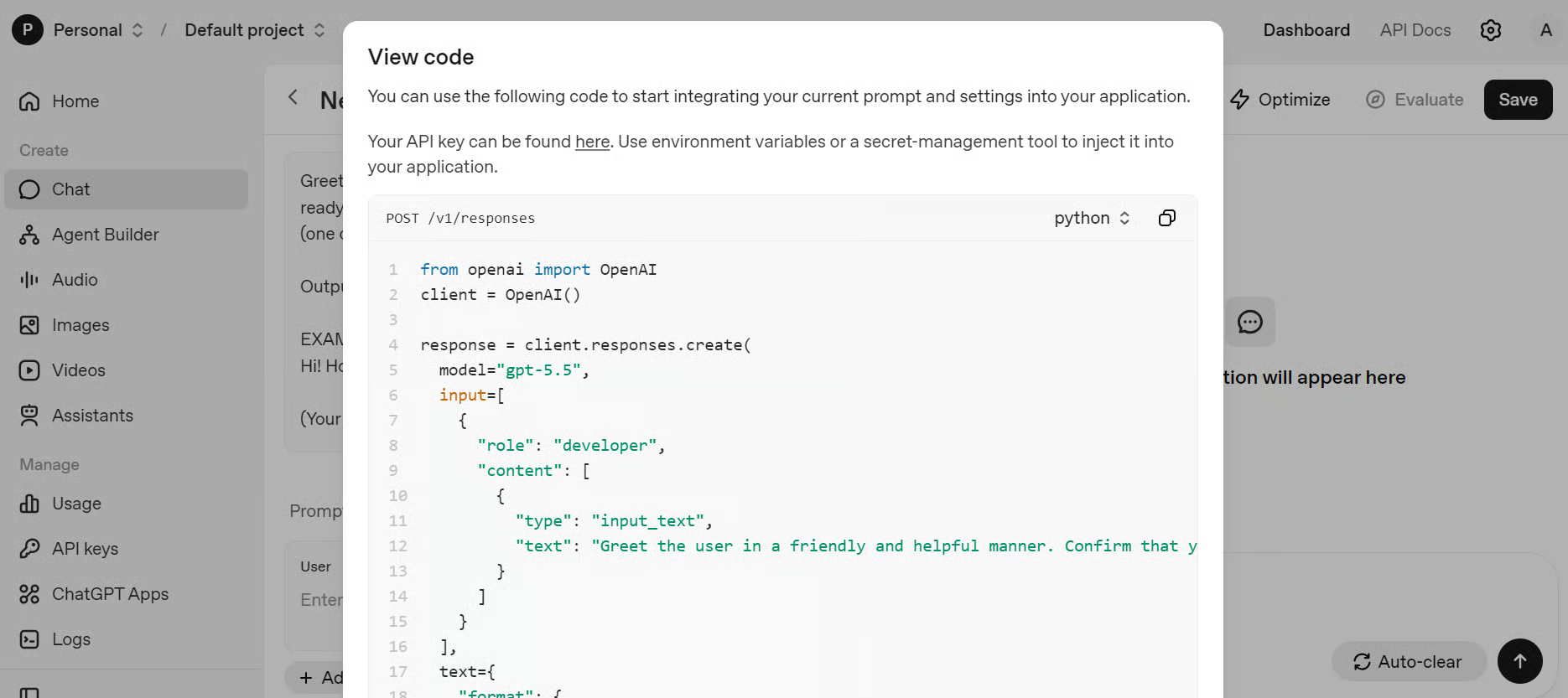

1. OpenAI

OpenAI es uno de los proveedores de API de LLM más utilizados. Su API Platform da acceso a:

- Modelos de razonamiento de vanguardia como GPT-5.5

- Generación y traducción de voz en tiempo real con GPT-Realtime-2

- Generación de imágenes con el modelo GPT-Images-2.0

- Desarrollo basado en agentes mediante el OpenAI Agents SDK

Su API admite streaming, interfaces en tiempo real y salidas estructuradas.

OpenAI es una gran elección para equipos que construyen asistentes de IA, herramientas de programación, agentes de atención al cliente, copilotos internos, apps multimodales y sistemas basados en agentes.

Fonte: OpenAI

Una desventaja es que OpenAI puede resultar caro a gran escala, especialmente en aplicaciones de alto volumen o con mucho razonamiento. Además, es un proveedor de API cerrada, lo que implica menos control sobre los internos del modelo, el alojamiento y la personalización frente a modelos open source o autoalojados.

Ideal para: apps de IA de propósito general, razonamiento, programación, flujos multimodales y productos de IA listos para producción.

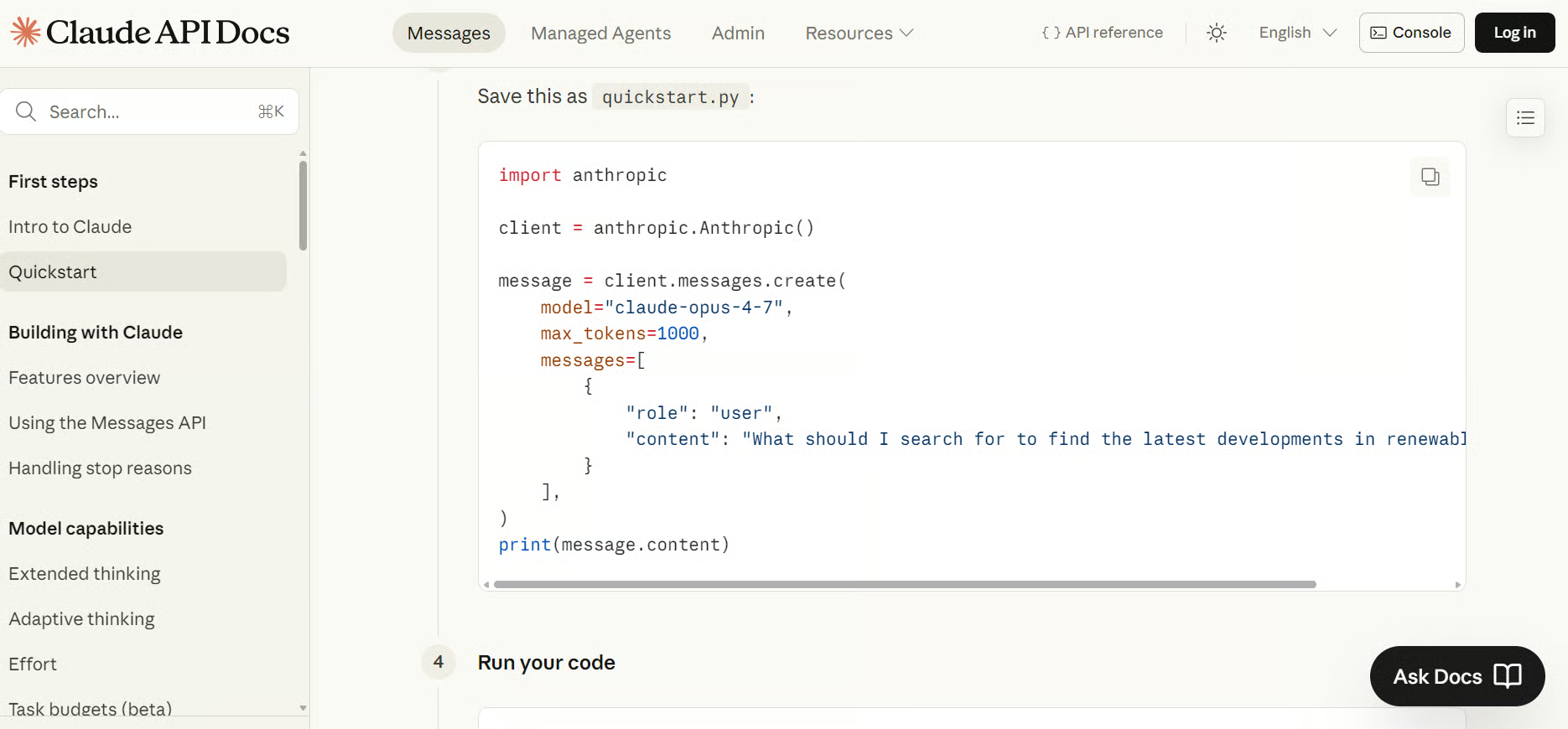

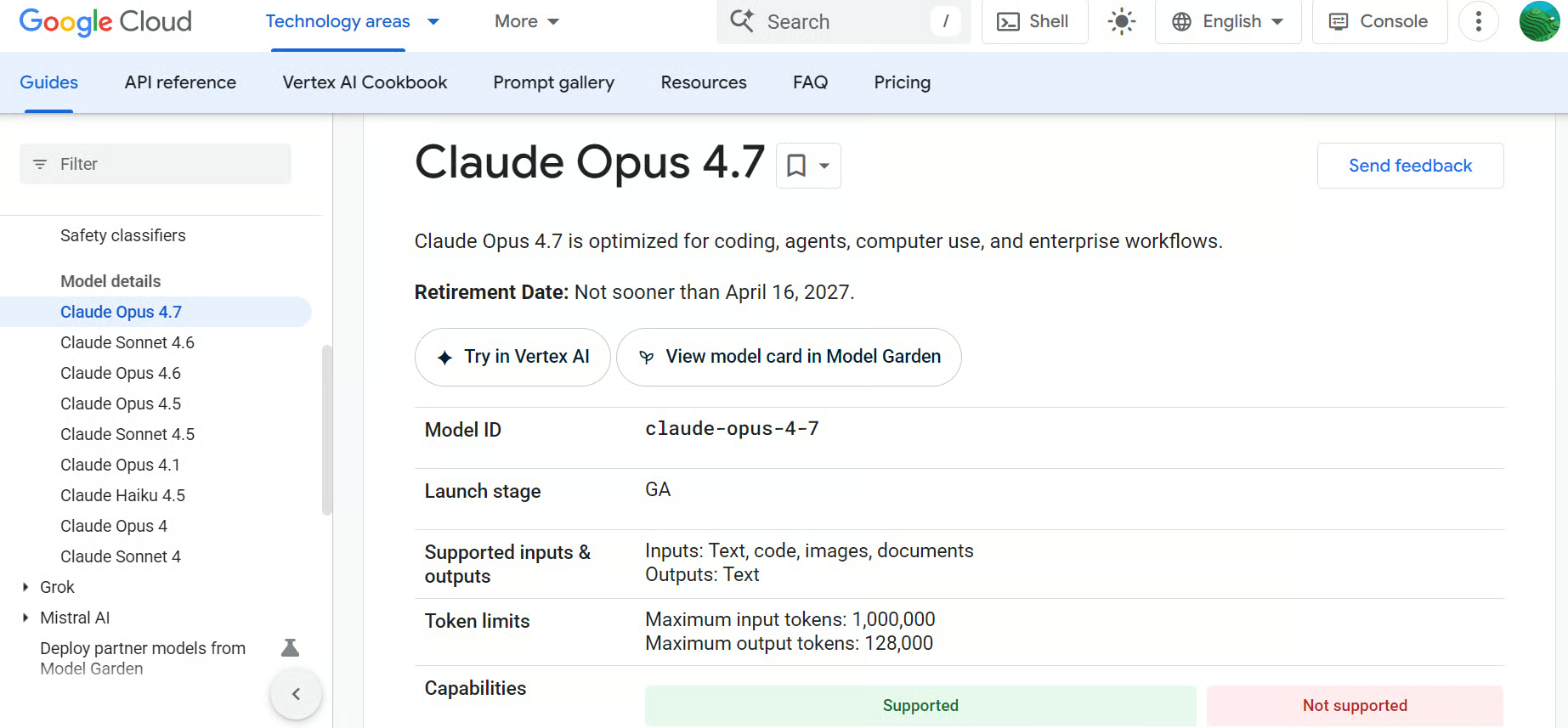

2. Anthropic

Anthropic ofrece la familia de modelos Claude a través de su API, por ejemplo su último modelo insignia, Claude Opus 4.7. Claude está diseñado para lenguaje, razonamiento, análisis, programación, contextos largos y flujos de trabajo con agentes. La plataforma para desarrolladores de Anthropic ofrece acceso directo a los modelos mediante APIs, SDKs y documentación técnica.

Claude es especialmente útil para aplicaciones que requieren seguir instrucciones con precisión, alta calidad de redacción, análisis de documentos y un manejo fiable de prompts complejos.

Fuente: Get started with Claude

Una desventaja clave es el coste, sobre todo al usar Claude con documentos grandes, prompts de largo contexto o aplicaciones de alto volumen. Al acceder a Claude mediante una API alojada, los equipos también tienen un control limitado sobre dónde y cómo se ejecuta el modelo.

Para casos de uso sensibles a la privacidad, conviene revisar con detalle el tratamiento de datos, la retención y los requisitos de cumplimiento antes de enviar datos confidenciales de negocio o de clientes a través de la API.

Ideal para: asistentes de programación, IA empresarial, análisis de contexto largo, flujos de documentos y agentes de IA.

Para una comparación detallada de estos dos gigantes de la IA, consulta nuestra guía Anthropic vs OpenAI.

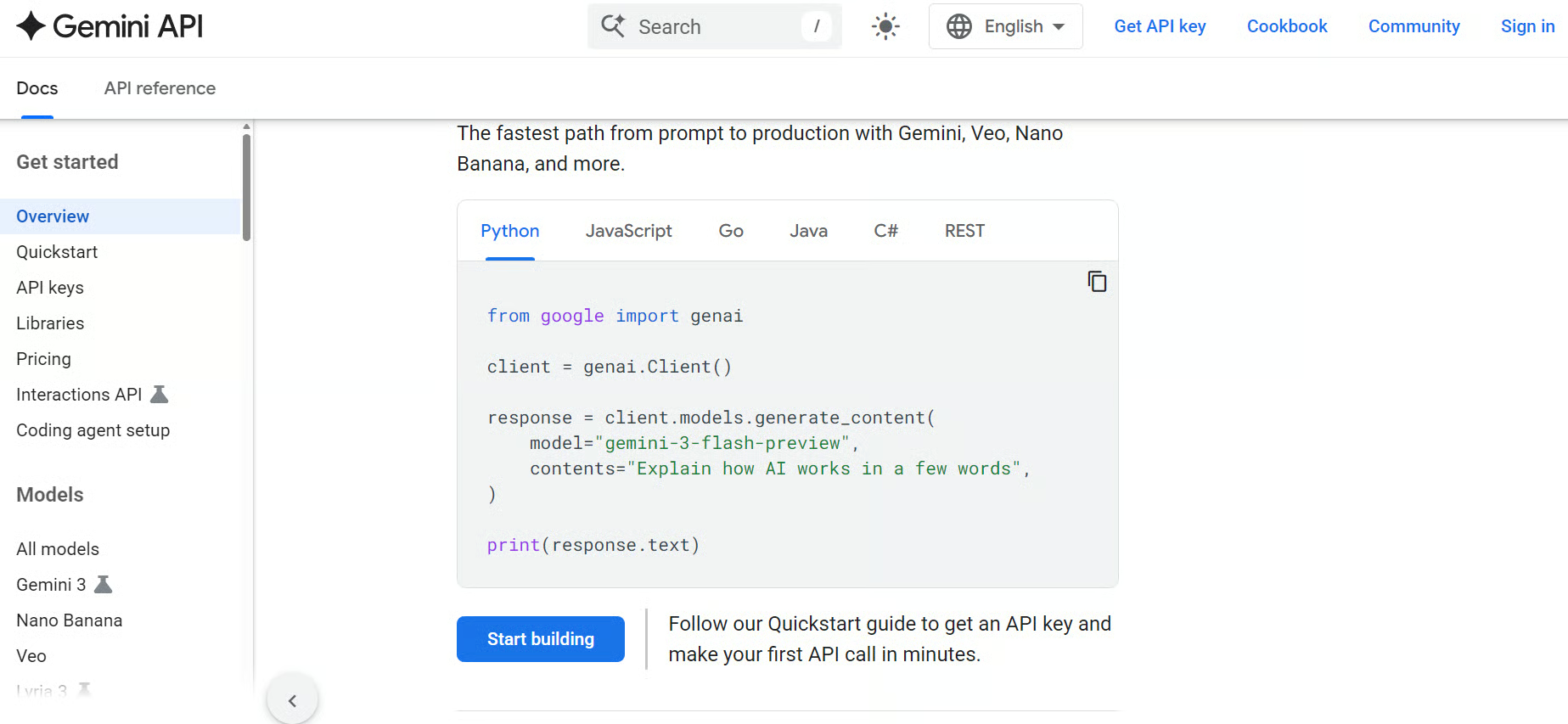

3. Google Gemini

Google Gemini es la familia nativa de LLM de Google, que incluye Gemini 3.1 Pro, disponible para desarrolladores a través de la Gemini API. La API de Gemini ofrece APIs estándar, en streaming y en tiempo real, con documentación sobre detalles de modelos, SDKs, precios, configuración y referencias de API.

Con Nano Banana 2 para generación de imágenes y Veo 3.1 integrado, Gemini es una gran opción para desarrollar apps multimodales. También es una buena elección para asistentes de IA (especialmente los que dependen de experiencias de búsqueda), herramientas de programación y productos que se conectan con el ecosistema de IA de Google.

Fuente: Gemini API

No obstante, Gemini puede sentirse más ligado al ecosistema de Google, lo que quizá no encaje con equipos que quieran una configuración neutral respecto al proveedor. Los precios, la disponibilidad de modelos y las funciones también pueden variar según las herramientas y las regiones.

Para aplicaciones sensibles a la privacidad, conviene revisar el tratamiento de datos, la retención y los requisitos de cumplimiento antes de enviar datos confidenciales a través de la API.

Ideal para: apps de IA multimodal, integración con el ecosistema de Google, contextos largos, programación y aplicaciones de IA de propósito general.

Proveedores de API de LLM de código abierto

Los proveedores de API de LLM de código abierto ofrecen acceso alojado a modelos open source y de pesos abiertos. En lugar de descargar los modelos y ejecutarlos en tus propias GPUs, estas plataformas los alojan y los exponen mediante APIs sencillas.

Son útiles para equipos que buscan menores costes, más flexibilidad de modelos, experimentación más rápida y acceso a modelos abiertos populares como Llama, DeepSeek, Qwen, Mistral, Gemma y otros.

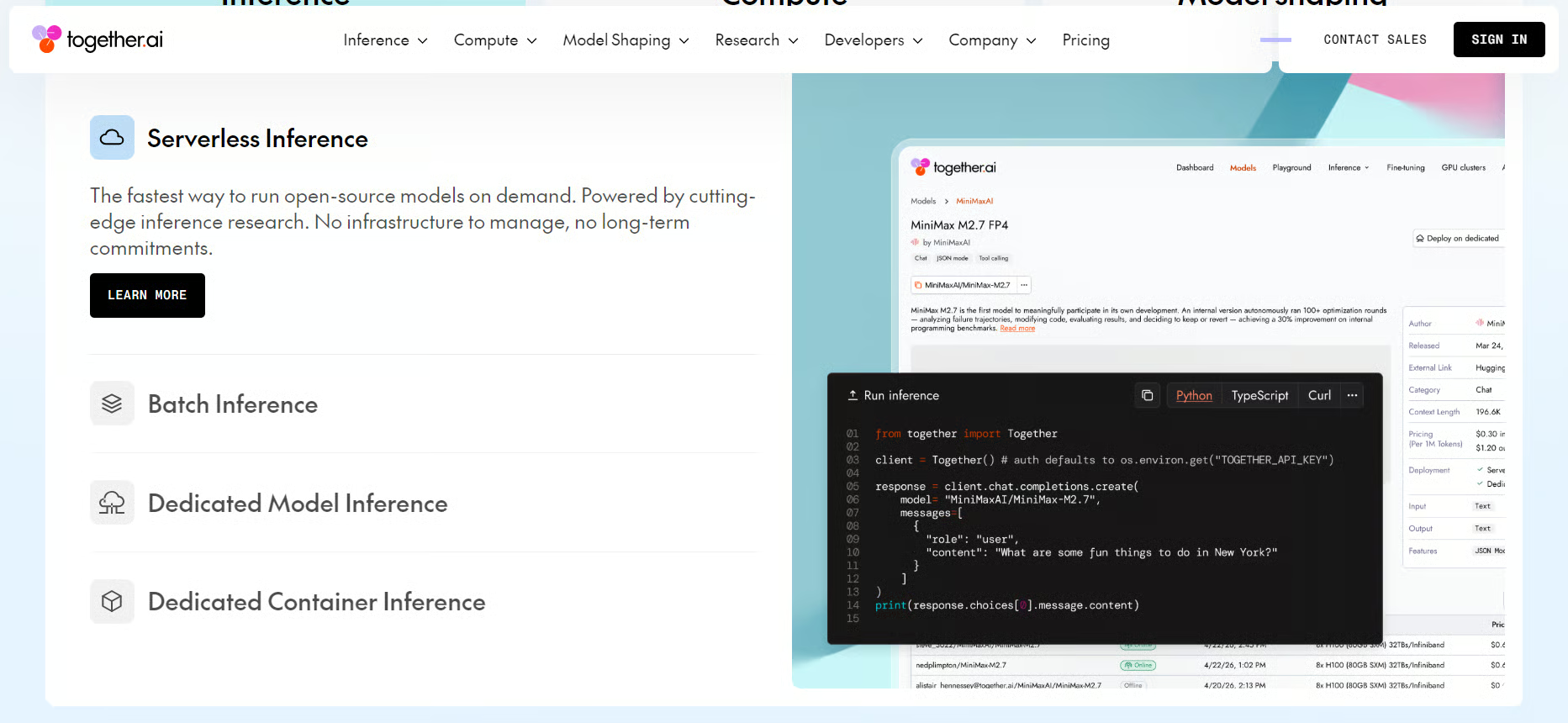

4. Together AI

Together AI ofrece acceso alojado a modelos de código abierto y especializados a través de una API unificada. Su catálogo incluye más de 200 modelos para texto, imagen, vídeo, código y audio, con soporte para inferencia serverless, inferencia por lotes, endpoints dedicados, fine-tuning, evaluaciones y clústeres de GPU.

Together AI es una gran opción si quieres trabajar con modelos abiertos sin gestionar tu propia infraestructura. Resulta especialmente útil para probar varios modelos, afinar modelos a medida o escalar cargas de inferencia.

Fuente: Together AI

Dicho esto, la calidad, la velocidad y la fiabilidad pueden variar según el modelo elegido. Puede que el equipo necesite más pruebas, benchmarking y evaluación antes del uso en producción.

Para cargas sensibles, conviene valorar si basta con acceso serverless, si se requieren endpoints dedicados o despliegues privados para cumplir requisitos de seguridad y cumplimiento.

Ideal para: inferencia de modelos open source, fine-tuning, cargas de IA a escala y experimentación con muchos modelos.

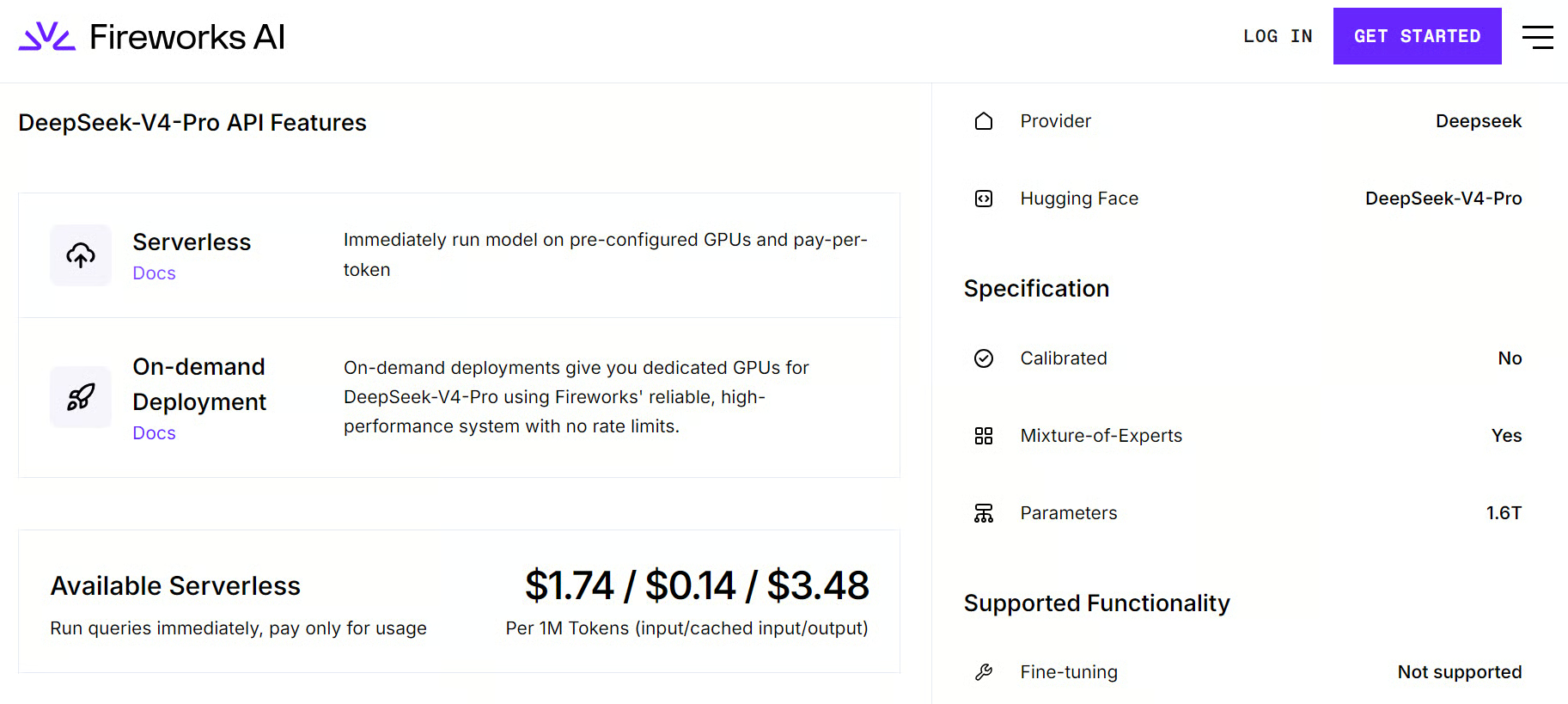

5. Fireworks AI

Fireworks AI se centra en inferencia rápida para LLMs y modelos generativos de código abierto. Su plataforma admite inferencia serverless, despliegues bajo demanda, fine-tuning y APIs listas para producción para modelos abiertos populares.

Fireworks AI es una gran opción si buscas la flexibilidad de los modelos abiertos con inferencia más veloz y menor latencia. Es especialmente útil para IA conversacional, asistentes de programación, búsqueda, apps multimodales y sistemas RAG empresariales.

Fuente: Fireworks AI

Como contrapartida, Fireworks AI está más enfocada en inferencia y despliegue que en ser una plataforma integral de desarrollo de IA. Puede que necesites herramientas aparte para orquestación, evaluaciones, monitorización o flujos complejos de agentes.

También conviene valorar si la inferencia serverless es suficiente para cargas sensibles, o si necesitas despliegues dedicados para mayor control de rendimiento y cumplimiento.

Ideal para: inferencia rápida con modelos abiertos, fine-tuning, apps de IA en producción y despliegues de baja latencia.

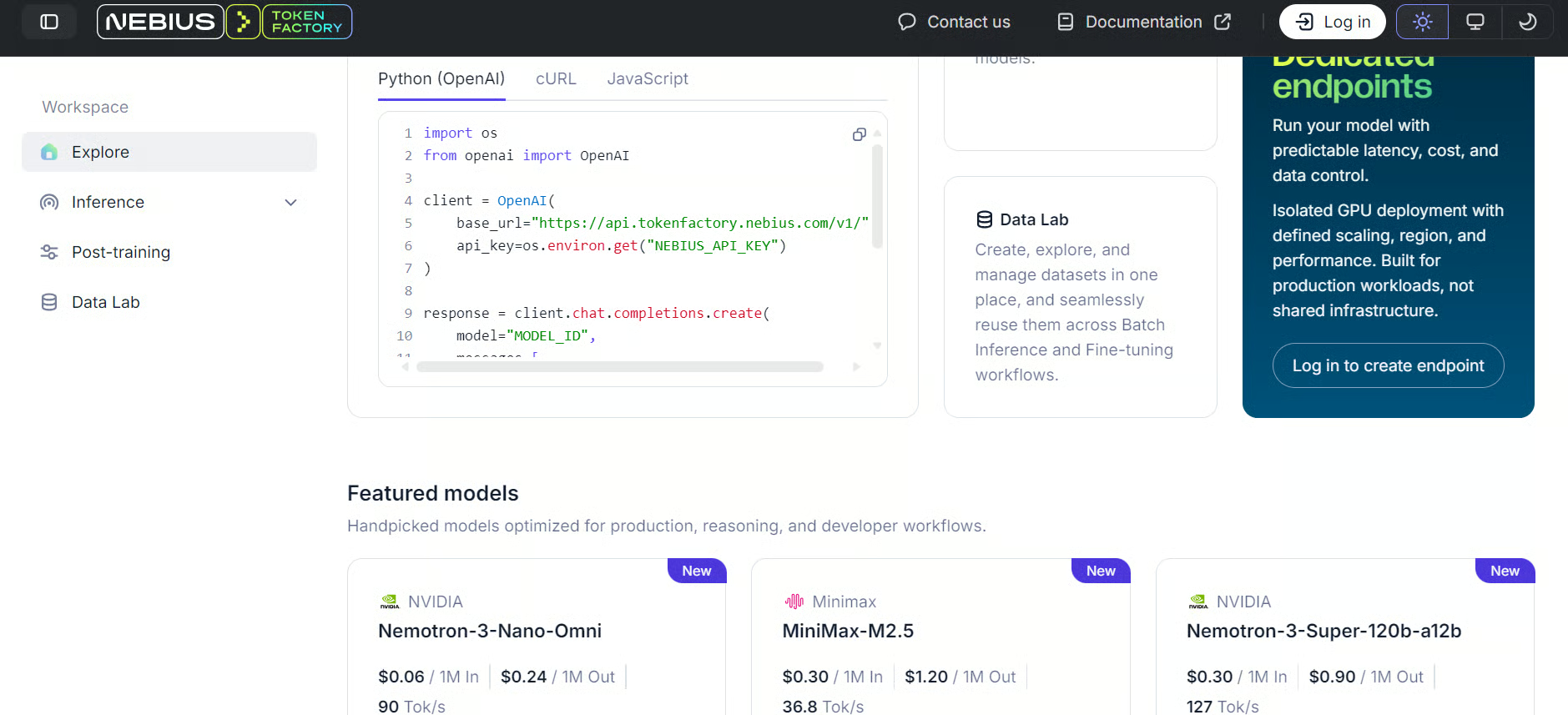

6. Nebius AI

Nebius AI es un proveedor de nube de IA creado para cargas de trabajo de IA con GPUs, inferencia alojada, serving de modelos e infraestructura de IA escalable. Su servicio de inferencia Token Factory admite modelos abiertos mediante una API compatible con OpenAI, con opciones de inferencia serverless, fine-tuning e infraestructura de nube de IA dedicada.

Nebius AI es ideal para equipos que quieren más control de la infraestructura que con un proveedor de API básico, pero sin la complejidad de gestionar por completo sus entornos de GPU. Es especialmente útil para trabajar con modelos abiertos y a medida que requieren cómputo escalable, inferencia rápida y opciones de despliegue listas para producción.

Fuente: Nebius Token Factory

Nebius Token Factory ofrece dos niveles de velocidad de inferencia: Fast y Base. Fast está pensado para cargas interactivas de baja latencia, mientras que Base prioriza la eficiencia de costes en inferencia de alto volumen o procesado en segundo plano.

Nebius está claramente más orientado a infraestructura que las plataformas de API de LLM enchufar y listo. Esto implica que quizá necesites más conocimiento de nube, despliegue y gestión de cargas para sacarle todo el partido.

Para cargas sensibles, valora si la inferencia gestionada es suficiente o si necesitas infraestructura dedicada para mayor control de seguridad, cumplimiento y gobernanza de datos.

Ideal para: infraestructura de nube de IA, inferencia alojada, cargas con GPU, inferencia rápida y equipos que quieren más control del despliegue.

Proveedores de enrutamiento de LLM

Los proveedores de enrutamiento de LLM dan acceso a múltiples modelos y proveedores mediante una única API. En lugar de integrarte por separado con OpenAI, Anthropic, Google, Mistral, DeepSeek y otros, usas una capa de enrutamiento para gestionar el acceso a los modelos desde un único lugar.

Estas plataformas resultan útiles para comparar modelos, configurar rutas de respaldo, optimizar costes, tener redundancia de proveedores, observabilidad y cambiar entre modelos sin reescribir tu aplicación.

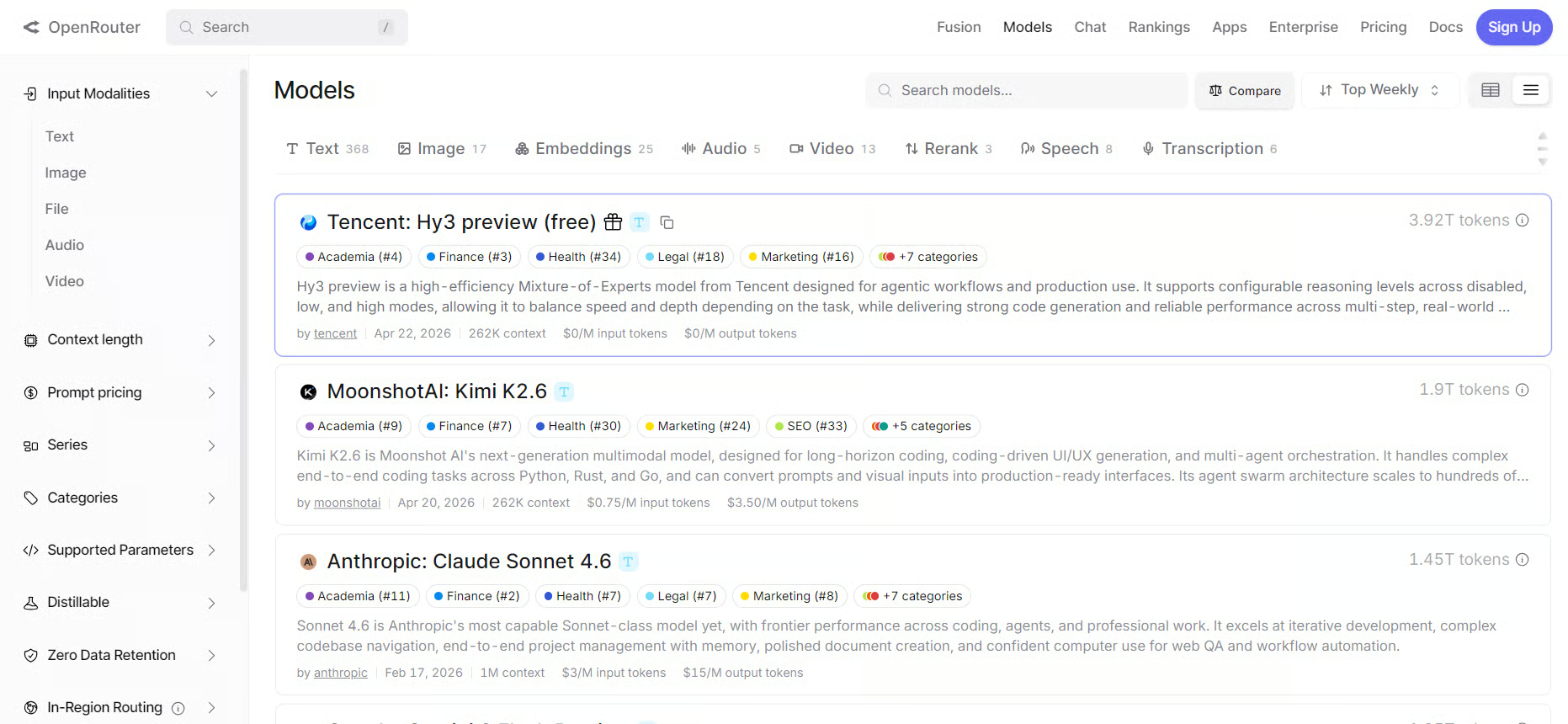

7. OpenRouter

OpenRouter es uno de los proveedores de enrutamiento de LLM más populares. Ofrece acceso a numerosos modelos mediante una única API compatible con OpenAI, lo que facilita trabajar con distintos proveedores con una sola integración.

Como hemos cubierto en varios tutoriales, OpenRouter es una gran opción si quieres comparar modelos, probar lanzamientos nuevos rápidamente, enrutar peticiones entre proveedores o evitar el bloqueo con un único proveedor.

Fuente: OpenRouter

Como desventaja, OpenRouter añade otra capa entre tu aplicación y el proveedor del modelo. Esto puede introducir dependencia adicional, latencia variable y comportamientos específicos de proveedor que igualmente requieren pruebas.

Para cargas en producción, revisa ajustes de enrutamiento, comportamiento de fallback, preferencias de proveedor y controles de privacidad antes de enviar tráfico sensible o crítico por la plataforma.

Ideal para: apps multmodelo, comparación de modelos, rutas de respaldo, flexibilidad de proveedor y experimentación rápida.

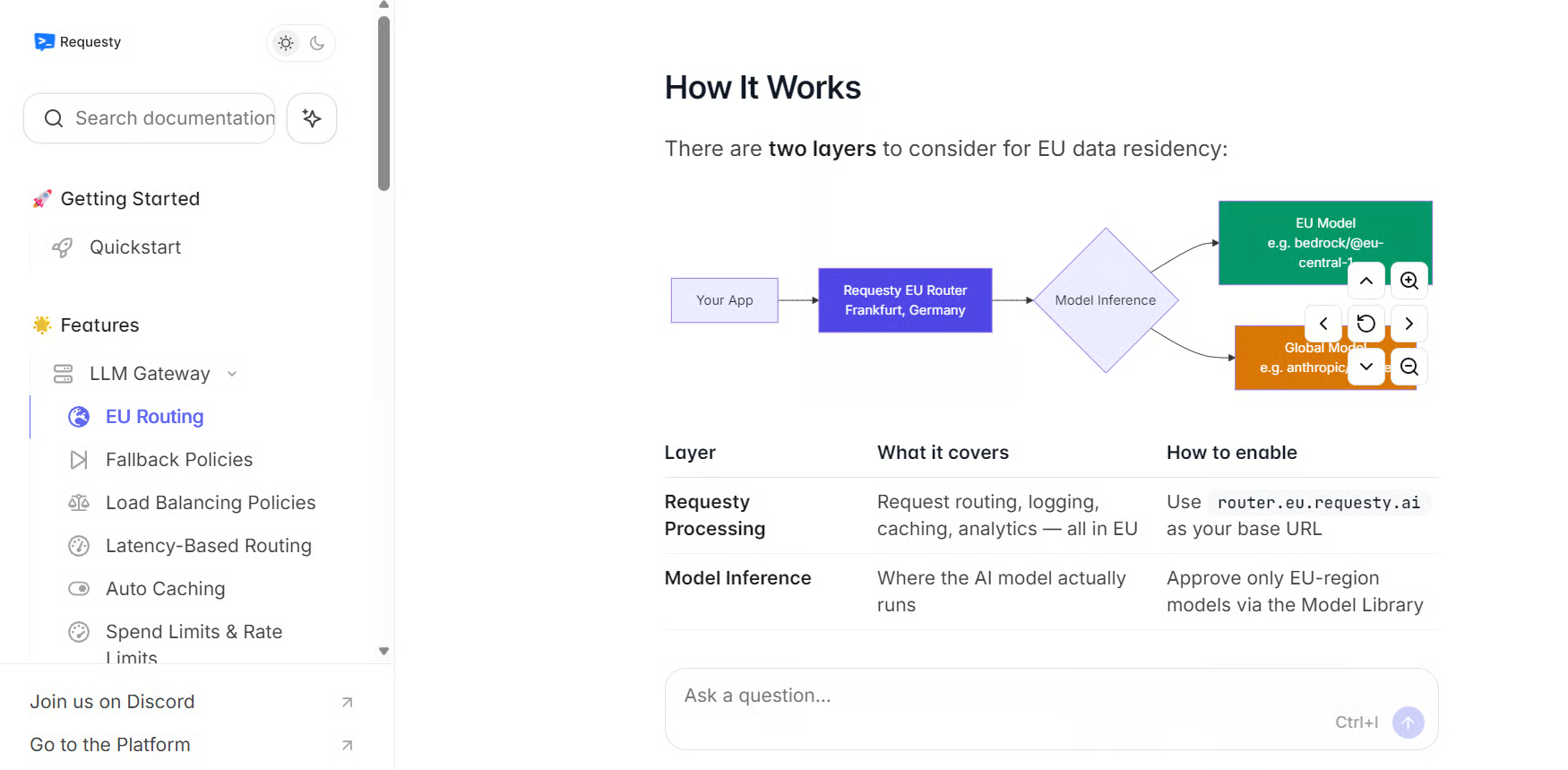

8. Requesty.ai

Requesty.ai es una plataforma de enrutamiento y gateway para LLM que ayuda a conectar con múltiples proveedores mediante una única API compatible con OpenAI. Admite más de 400 modelos, con funciones de enrutamiento, fallback, caché, control de costes, observabilidad y gobernanza.

Requesty.ai es una gran opción para equipos que construyen aplicaciones de IA en producción y dependen de más de un proveedor de modelos. Es especialmente útil para gestionar políticas de enrutamiento, controlar el gasto, mejorar la fiabilidad cuando los proveedores fallan, expiran o alcanzan límites de tasa.

Fuente: Requesty AI Documentation

Al igual que con OpenRouter, la principal desventaja es que Requesty.ai añade otra capa de gateway al stack de la aplicación. Es necesario configurar con cuidado el enrutamiento, el registro y la gobernanza para evitar costes, latencias o comportamientos inesperados.

Para cargas sensibles, Requesty.ai incluye controles como detección de PII, enmascaramiento, barreras de contenido, registros de auditoría y funciones de gobernanza; aun así, debéis decidir qué datos pueden pasar por el gateway y cómo se gestionan los logs.

Ideal para: enrutamiento de LLM, control de costes, observabilidad, fallback de proveedores, gobernanza y flujos de gateway de IA en producción.

Proveedores de LLM en la nube

Los proveedores de LLM en la nube son grandes plataformas cloud que ofrecen acceso gestionado a modelos fundacionales para desarrolladores y empresas. Suelen soportar sus propios modelos y también modelos de terceros.

Son especialmente útiles para empresas que ya usan infraestructura cloud y necesitan seguridad, gobernanza, cumplimiento, integración de datos, controles de despliegue y gestión de modelos en un mismo lugar.

9. Google Vertex AI

Google Vertex AI es la plataforma de machine learning e IA generativa de Google Cloud. Ofrece acceso a los modelos Gemini, Model Garden, herramientas de agentes e infraestructura gestionada para crear, desplegar y gestionar aplicaciones de IA.

Vertex AI también admite socios líderes y modelos abiertos a través de Model Garden, incluidos Anthropic Claude, xAI Grok, modelos de Mistral AI y modelos open source como GLM 5 y Gemma 4, junto con los modelos Gemini de Google.

Fuente: Generative AI on Vertex AI

Google Vertex AI es una gran opción para equipos que ya usan Google Cloud y quieren despliegue cloud-nativo de modelos, gobernanza, controles de seguridad e integración con el ecosistema de datos e IA de Google.

Por otro lado, Vertex AI puede ser más complejo que usar una API de modelo sencilla. El equipo puede necesitar experiencia en Google Cloud para gestionar proyectos, permisos, facturación, despliegues e integraciones correctamente.

Para cargas sensibles, Vertex AI es útil si necesitas controles de acceso a nivel cloud, gobernanza e infraestructura gestionada, aunque las decisiones de configuración sobre logging, acceso a datos y regiones de despliegue requieren una revisión cuidadosa.

Ideal para: usuarios de Google Cloud, acceso a Gemini, apps de IA empresariales, flujos multimodales y despliegue cloud-nativo de modelos.

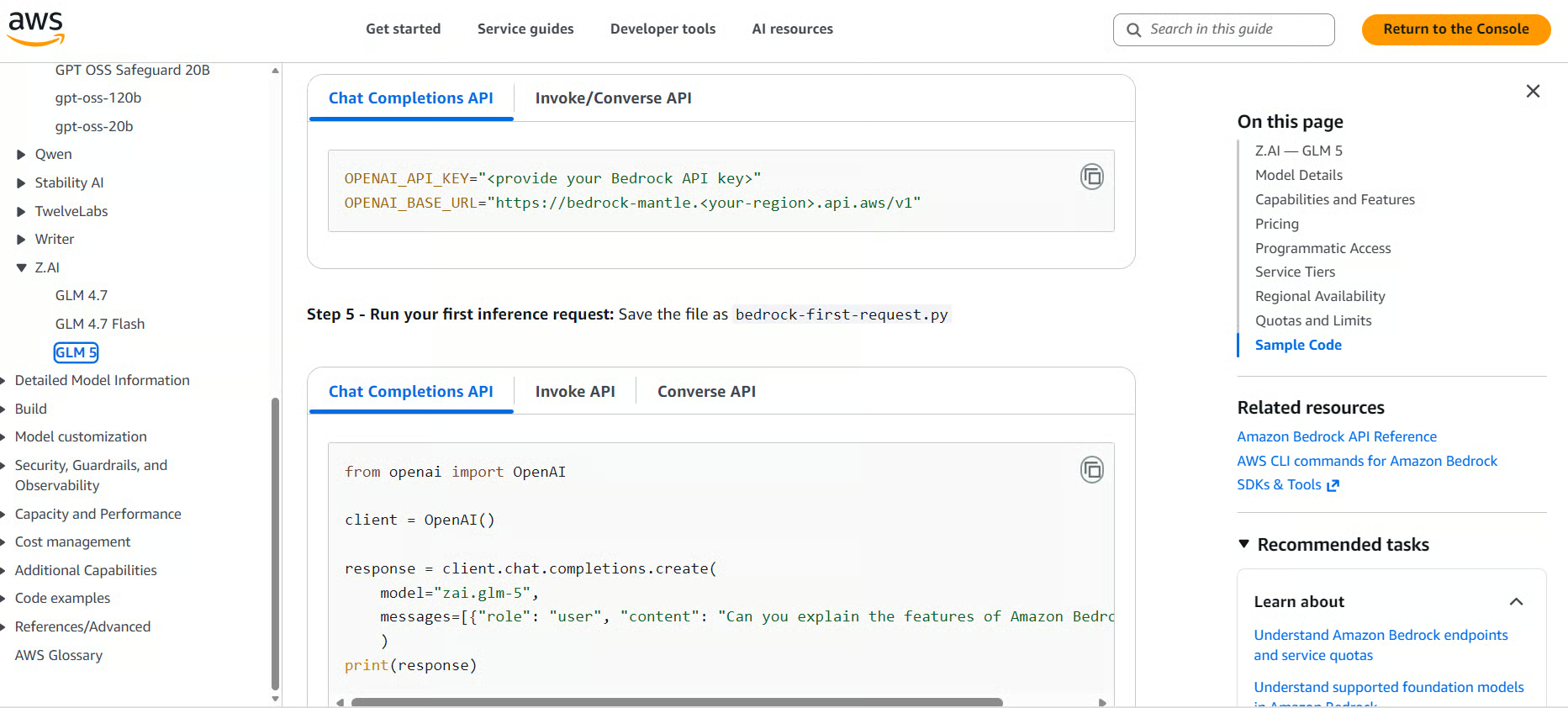

10. Amazon Bedrock

Amazon Bedrock es la plataforma gestionada de IA generativa de AWS. Ofrece acceso, en un servicio gestionado de AWS, a modelos fundacionales de Amazon y de terceros.

Bedrock admite modelos de proveedores como Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek y otros, lo que lo hace útil para equipos que quieren variedad de modelos dentro del ecosistema AWS.

Amazon Bedrock es una gran elección para empresas que ya trabajan en AWS, ya que reúne acceso a modelos, infraestructura cloud, controles de seguridad e integración empresarial en una única plataforma.

Fuente: Amazon Bedrock

Una desventaja clave es que Bedrock puede ser más complejo que una API básica de LLM. El equipo puede necesitar experiencia en AWS para gestionar permisos, regiones, acceso a modelos, precios, red y despliegues correctamente.

Para cargas sensibles, Bedrock es útil porque los prompts y salidas no se usan para entrenar modelos base ni se comparten con los proveedores de modelos, y puedes usar controles de AWS como cifrado, IAM y PrivateLink.

Ideal para: usuarios de AWS, IA empresarial, acceso gestionado a modelos fundacionales, despliegues con foco en seguridad y aplicaciones de IA generativa cloud-nativas.

Tabla comparativa de proveedores de API de LLM

La siguiente tabla compara los principales proveedores de API de LLM en función de sus ventajas clave y sus principales inconvenientes.

|

Proveedor |

Ventajas clave |

Principales desventajas |

|

OpenAI |

Alta calidad de modelos, APIs maduras, herramientas multimodales, salidas estructuradas, embeddings, voz e imagen, y flujos con agentes |

Puede resultar caro a escala y ofrece menos control que los modelos open source o autoalojados |

|

Anthropic |

Gran calidad de redacción, seguimiento cuidadoso de instrucciones, razonamiento, programación y soporte de contexto largo |

Los costes pueden subir con documentos grandes o alto volumen, y hay control limitado sobre el hosting y los internos del modelo |

|

Google Gemini |

Potentes capacidades multimodales, APIs en tiempo real, soporte de contextos largos e integración estrecha con el ecosistema de IA de Google |

Puede sentirse ligado al ecosistema de Google; precios, disponibilidad y funciones pueden variar por herramienta o región |

|

Together AI |

Acceso alojado a muchos modelos abiertos y especializados, con inferencia serverless, endpoints dedicados, fine-tuning, evaluaciones e infraestructura de GPU |

La calidad, velocidad y fiabilidad dependen del modelo seleccionado |

|

Fireworks AI |

Inferencia rápida, baja latencia, acceso serverless, despliegues bajo demanda y APIs listas para producción para modelos abiertos |

Más centrado en inferencia y despliegue que en ser una plataforma integral de desarrollo de IA |

|

Nebius AI |

Infraestructura con GPU, inferencia alojada, API compatible con OpenAI y niveles de velocidad como Fast y Base |

Enfoque más de infraestructura, por lo que puede requerir más conocimiento de nube y despliegue |

|

OpenRouter |

Acceso a muchos modelos mediante una API compatible con OpenAI, con cambio de proveedor y fallbacks más sencillos |

Añade otra capa entre la app y el proveedor, lo que puede afectar a latencia, fiabilidad o depuración |

|

Requesty.ai |

Una API para múltiples proveedores, con enrutamiento, fallback, caché, control de costes, observabilidad y funciones de gobernanza |

Requiere configurar con cuidado enrutamiento, logging, fallback y controles de coste para evitar comportamientos inesperados |

|

Google Vertex AI |

Acceso gestionado a Gemini, Anthropic Claude, xAI Grok, Mistral AI y modelos abiertos vía Model Garden, además de las herramientas de seguridad y gobernanza de Google Cloud |

Más complejo que una API sencilla y puede requerir experiencia en Google Cloud |

|

Amazon Bedrock |

Acceso gestionado a modelos de Amazon y de terceros como Anthropic, Meta, Mistral AI, Cohere y otros dentro de AWS |

Más complejo que una API básica de LLM, especialmente en permisos, regiones, precios y acceso a modelos |

Cómo elegir el mejor proveedor de API de LLM para tu caso

La elección del proveedor adecuado depende de tres factores:

- Qué estás construyendo

- Cuánto control necesitas

- Cuánto estás dispuesto a invertir

Para startups y equipos pequeños, los proveedores de API de LLM de código abierto suelen ser el mejor punto de partida. Plataformas como Together AI, Fireworks AI y Nebius AI te dan acceso a potentes modelos abiertos sin gestionar GPUs ni infraestructura propia. Suelen ser más rápidas, baratas y flexibles para experimentar y para el desarrollo inicial de producto.

Si quieres probar distintos modelos rápidamente, los proveedores de enrutamiento de LLM son una gran opción. Herramientas como OpenRouter y Requesty.ai te permiten comparar modelos cerrados y abiertos desde una única API, gestionar fallbacks y cambiar de proveedor sin reescribir tu aplicación.

Si en tus flujos de trabajo prima más la calidad del modelo que el coste, los proveedores nativos como OpenAI y Anthropic siguen siendo de las mejores opciones. Son especialmente útiles para asistentes de IA en producción, herramientas de programación, flujos con mucho razonamiento, apps multimodales y sistemas con agentes en los que importan la fiabilidad y el rendimiento del modelo.

Por último, si tu empresa ya opera en AWS o Google Cloud, suele tener sentido mantenerse en ese ecosistema. Amazon Bedrock y Google Vertex AI te ofrecen acceso gestionado a modelos, controles de seguridad, gobernanza e integración con las herramientas que tu equipo ya utiliza.

Reflexiones finales

Para trabajo técnico, asistentes de programación y herramientas de "vibe coding", no me excedería experimentando al principio. Por experiencia, OpenAI y Anthropic suelen ser las opciones más seguras por su fortaleza en programación, razonamiento y herramientas para desarrolladores.

Los proveedores de API de LLM open source y los de enrutamiento son grandes alternativas para una experimentación más avanzada.

Los grandes proveedores de LLM en la nube suelen tener sentido solo en entornos corporativos. En ese caso, elige el del ecosistema que ya estés utilizando.

Preguntas frecuentes sobre proveedores de API de LLM

¿Qué es un proveedor de API de LLM?

Una empresa o plataforma que aloja large language models y los expone mediante una API, para que los desarrolladores envíen solicitudes y reciban respuestas generadas por IA sin gestionar por sí mismos GPUs ni infraestructura de inferencia.

¿Cuál es la diferencia entre un proveedor nativo de LLM y uno en la nube?

Los proveedores nativos (como OpenAI y Anthropic) crean y sirven sus propios modelos directamente. Los proveedores en la nube (como AWS Bedrock y Google Vertex AI) ofrecen acceso gestionado a múltiples modelos de terceros dentro de un ecosistema cloud existente, con herramientas empresariales de seguridad y gobernanza.

¿Cuándo debería usar un proveedor de enrutamiento de LLM como OpenRouter o Requesty.ai?

Cuando necesites trabajar con más de un modelo o proveedor, quieras un fallback automático si un proveedor cae, o necesites comparar modelos y controlar costes, todo ello con una única integración de API.

¿Los proveedores de API de LLM de código abierto son menos capaces que los nativos como OpenAI?

No necesariamente; depende de la tarea. Plataformas como Together AI y Fireworks AI alojan modelos abiertos de última generación como Llama, DeepSeek y Mistral, que pueden competir con modelos cerrados, a menudo a un coste significativamente menor.

¿Qué proveedor de API de LLM es mejor para empresas con requisitos estrictos de cumplimiento?

Amazon Bedrock y Google Vertex AI suelen ser las opciones más sólidas, ya que ofrecen controles de seguridad cloud-nativos, IAM, cifrado, registros de auditoría y funciones de gobernanza que se integran con la infraestructura empresarial existente.

Soy un científico de datos certificado que disfruta creando aplicaciones de aprendizaje automático y escribiendo blogs sobre ciencia de datos. Actualmente me centro en la creación de contenidos, la edición y el trabajo con grandes modelos lingüísticos.