Program

Penyedia API Large Language Model (LLM) memberi pengembang akses ke model AI yang kuat tanpa perlu mengelola GPU, deployment model, penskalaan, atau infrastruktur inferensi. Alih-alih melakukan self-hosting model, pengembang dapat terhubung ke API, memilih model, mengirim permintaan, dan menerima respons.

Dalam artikel ini, kami akan melihat 10 penyedia API LLM teratas berdasarkan kualitas model, pengalaman pengembang, harga, skalabilitas, dukungan ekosistem, dan kesiapan produksi. Untuk setiap penyedia, kami akan membahas kegunaan terbaiknya, keunggulan utama, dan kekurangan utama yang perlu dipertimbangkan pengembang.

Panduan ini membagi penyedia API LLM teratas ke dalam empat kategori:

- Penyedia LLM native

- Penyedia API LLM open-source

- Penyedia routing LLM

- Penyedia LLM cloud

Penyedia LLM Native

Penyedia LLM native membangun, melatih, dan menyajikan keluarga model mereka sendiri melalui API. Mereka sering kali menjadi opsi terkuat bagi pengembang yang menginginkan kualitas model tinggi, dokumentasi andal, penalaran tingkat lanjut, dukungan multimodal, dan perangkat siap produksi.

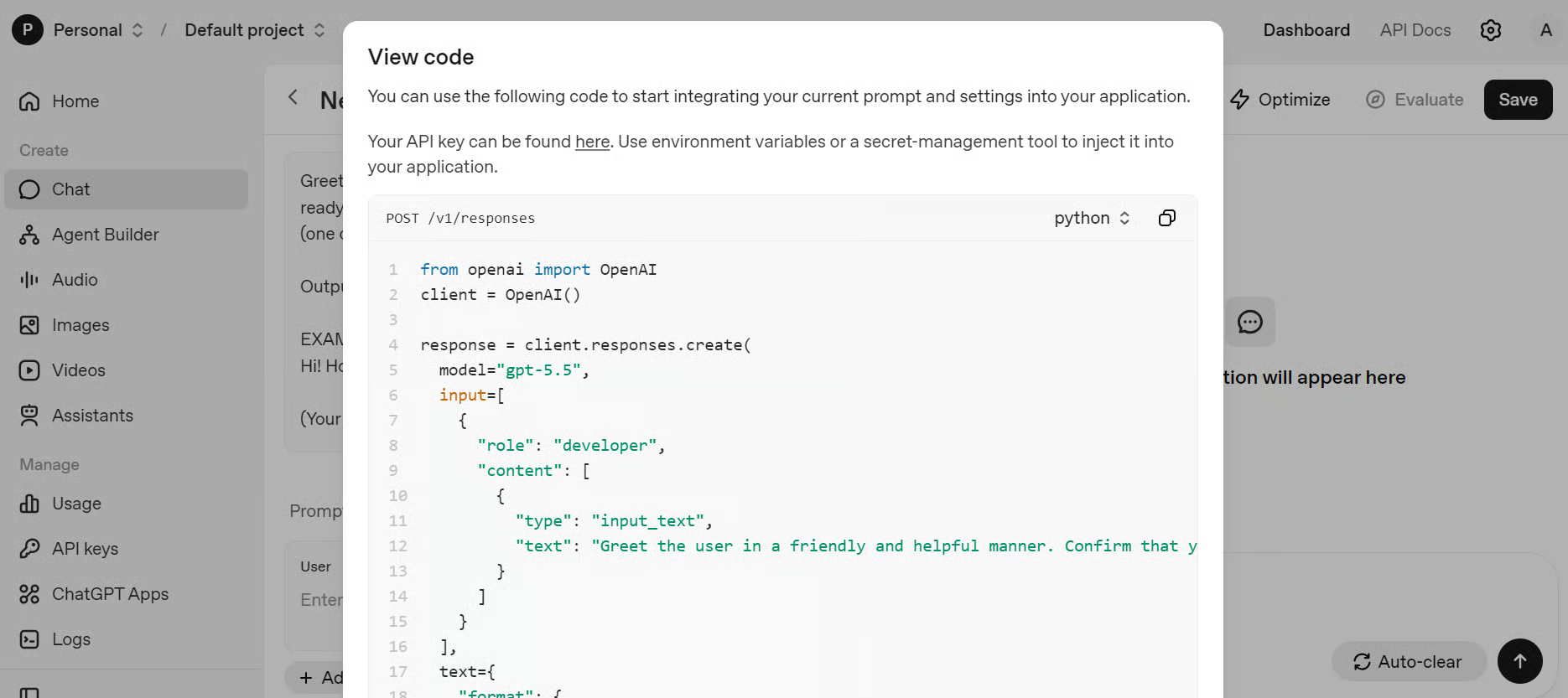

1. OpenAI

OpenAI adalah salah satu penyedia API LLM yang paling banyak digunakan. API Platform mereka menyediakan akses ke:

- Model penalaran frontier seperti GPT-5.5

- Generasi suara real-time dan penerjemahan melalui GPT-Realtime-2

- Pembuatan gambar melalui model GPT-Images-2.0

- Pengembangan berbasis agen melalui OpenAI Agents SDK

API-nya mendukung streaming, antarmuka real-time, dan output terstruktur.

OpenAI adalah pilihan kuat untuk tim yang membangun asisten AI, alat coding, agen dukungan pelanggan, copilot internal, aplikasi multimodal, dan sistem berbasis agen.

Sumber: OpenAI

Salah satu kekurangannya adalah OpenAI dapat menjadi mahal pada skala besar, terutama untuk aplikasi dengan volume tinggi atau yang menuntut penalaran berat. Ini juga merupakan penyedia API tertutup, yang berarti pengembang memiliki kontrol lebih sedikit atas internal model, hosting, dan kustomisasi dibandingkan dengan model open-source atau self-hosted.

Terbaik untuk: aplikasi AI serbaguna, penalaran, coding, alur kerja multimodal, dan produk AI siap produksi.

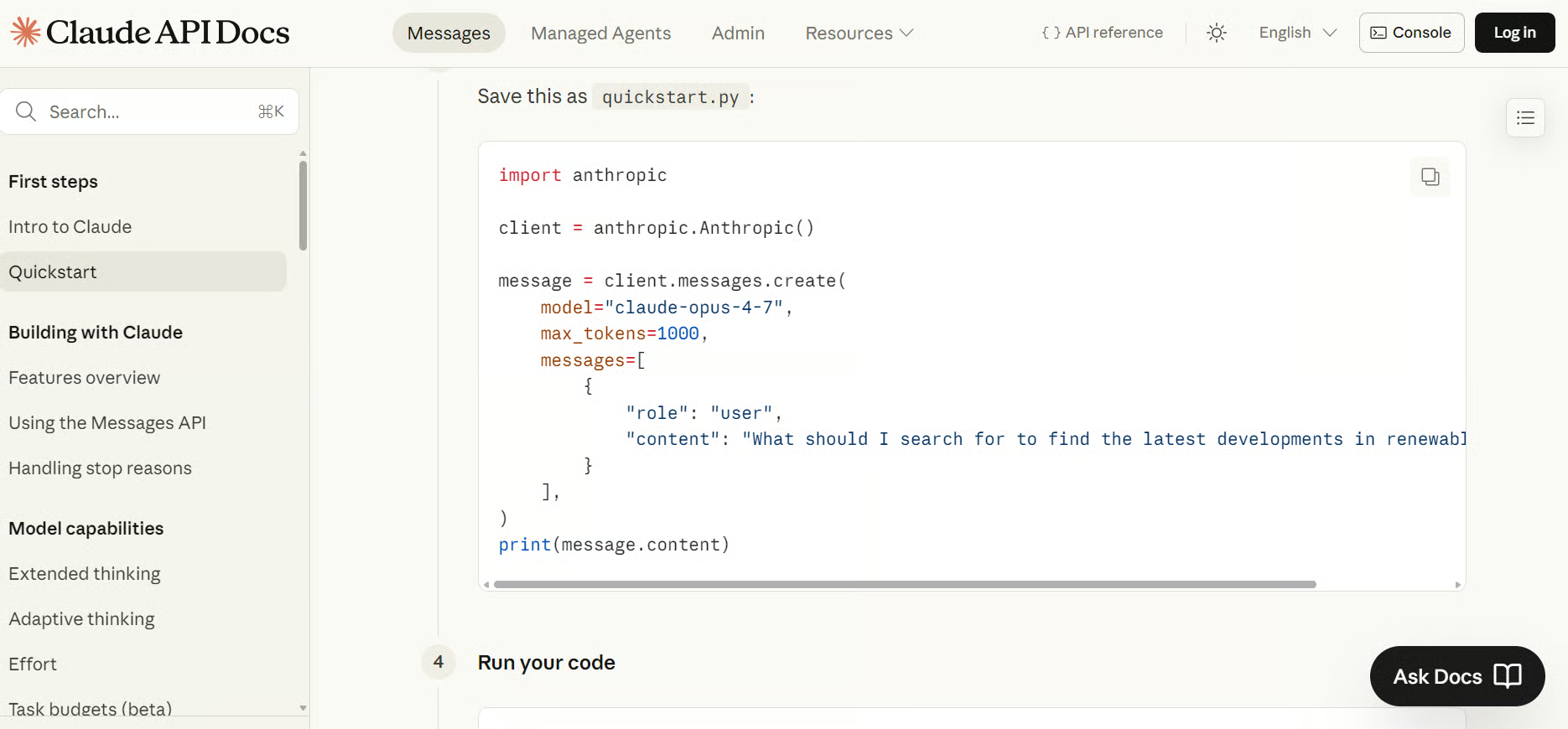

2. Anthropic

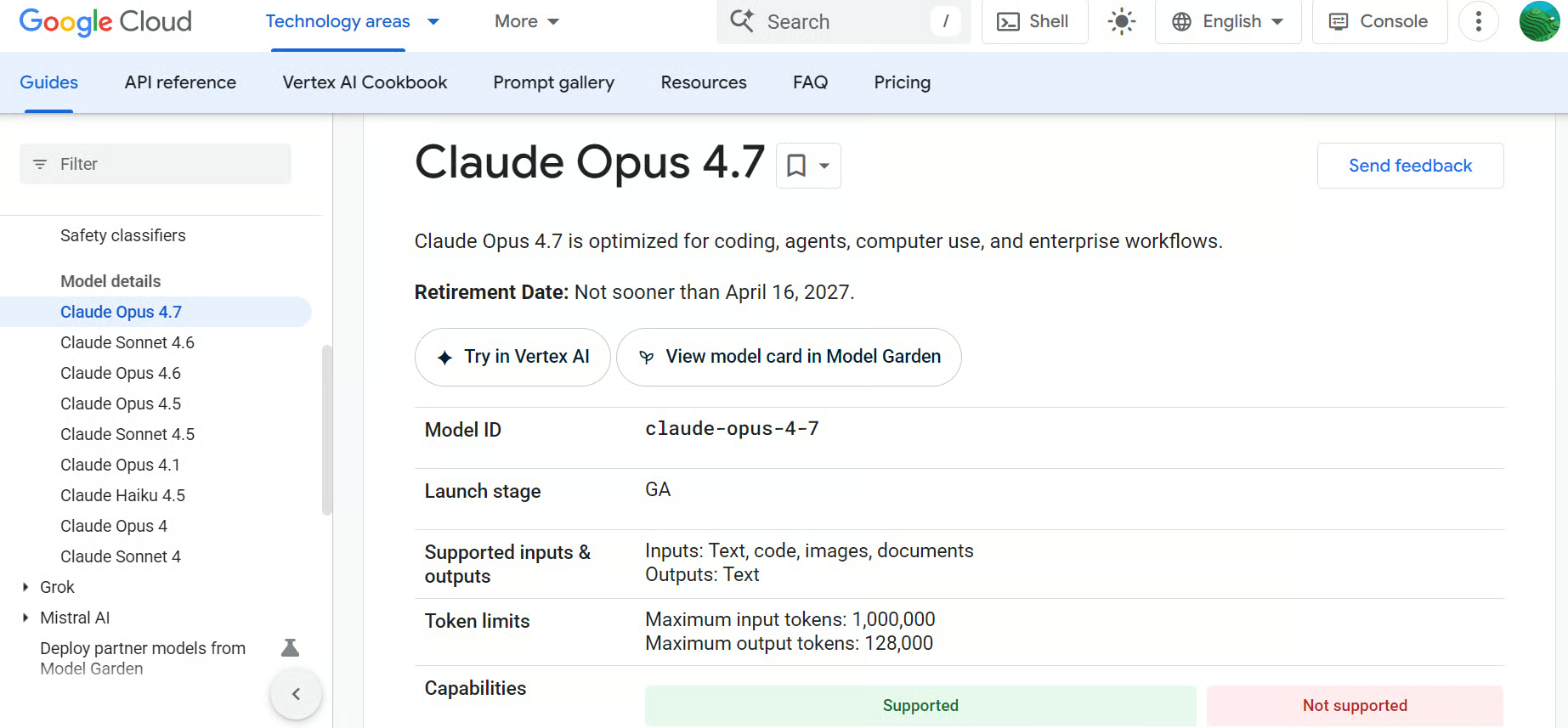

Anthropic menyediakan keluarga model Claude melalui API-nya, misalnya model flagship terbarunya, Claude Opus 4.7. Claude dirancang untuk bahasa, penalaran, analisis, coding, pekerjaan konteks panjang, dan alur kerja agen. Platform pengembang Anthropic memberi tim akses langsung ke model melalui API, SDK, dan dokumentasi pengembang.

Claude sangat berguna untuk aplikasi yang membutuhkan kepatuhan instruksi yang cermat, kualitas penulisan yang kuat, analisis dokumen, dan penanganan yang andal terhadap prompt kompleks.

Sumber: Mulai dengan Claude

Kekurangan utamanya adalah biaya, terutama saat menggunakan Claude untuk dokumen besar, prompt konteks panjang, atau aplikasi dengan volume tinggi. Karena Claude diakses melalui API yang di-host, tim juga memiliki kontrol terbatas atas lokasi dan cara model dijalankan.

Untuk kasus penggunaan yang sensitif terhadap privasi, pengembang harus meninjau dengan saksama penanganan data, retensi, dan persyaratan kepatuhan sebelum mengirim data bisnis atau pelanggan yang bersifat rahasia melalui API.

Terbaik untuk: asisten coding, AI enterprise, analisis konteks panjang, alur kerja dokumen, dan agen AI.

Untuk perbandingan mendetail antara dua raksasa AI ini, lihat panduan kami tentang Anthropic vs OpenAI.

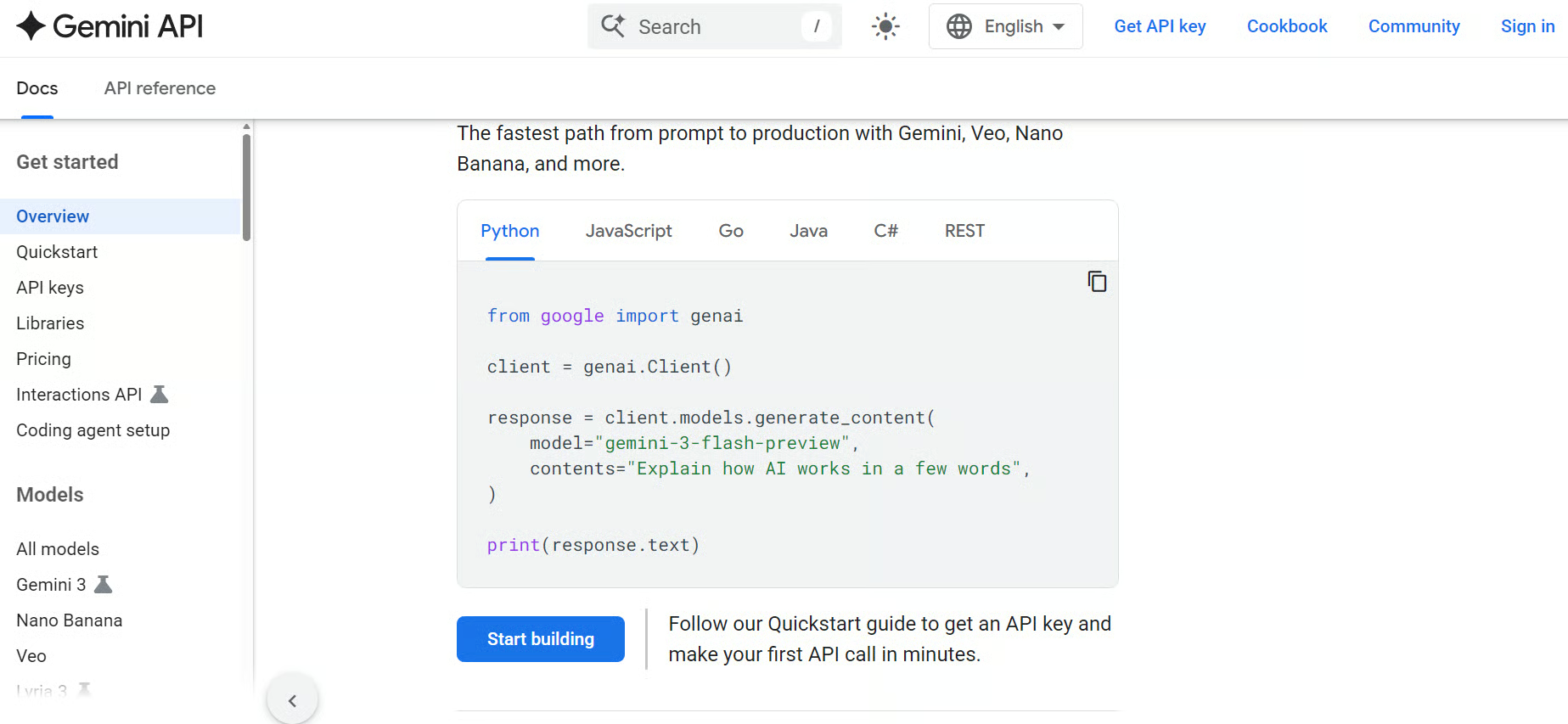

3. Google Gemini

Google Gemini adalah keluarga LLM native Google, termasuk Gemini 3.1 Pro, yang tersedia melalui Gemini API untuk pengembang. Gemini API mendukung API standar, streaming, dan real-time, dengan dokumentasi untuk detail model, SDK, harga, penyiapan, dan referensi API.

Dengan Nano Banana 2 untuk pembuatan gambar dan Veo 3.1 yang terintegrasi, Gemini adalah opsi kuat bagi pengembang yang membangun aplikasi multimodal. Ini juga pilihan yang baik untuk asisten AI (terutama yang mengandalkan pengalaman penelusuran), alat coding, dan produk yang terhubung dengan ekosistem AI Google yang lebih luas.

Sumber: Gemini API

Namun, Gemini bisa terasa lebih terikat pada ekosistem Google, yang mungkin tidak cocok untuk tim yang menginginkan pengaturan netral penyedia. Harga, ketersediaan model, dan dukungan fitur juga dapat bervariasi di berbagai alat dan wilayah.

Untuk aplikasi yang sensitif terhadap privasi, tim harus meninjau penanganan data, retensi, dan persyaratan kepatuhan sebelum mengirim data bisnis atau pelanggan yang bersifat rahasia melalui API.

Terbaik untuk: aplikasi AI multimodal, integrasi ekosistem Google, alur kerja konteks panjang, coding, dan aplikasi AI serbaguna.

Penyedia API LLM Open-Source

Penyedia API LLM open-source memberi pengembang akses API terkelola ke model open-source dan open-weight. Alih-alih mengunduh model dan menjalankannya di GPU Anda sendiri, platform ini meng-host model dan menyediakannya melalui API sederhana.

Penyedia ini berguna bagi tim yang menginginkan biaya lebih rendah, fleksibilitas model yang lebih besar, eksperimen lebih cepat, dan akses ke model open-source populer seperti Llama, DeepSeek, Qwen, Mistral, Gemma, dan lainnya.

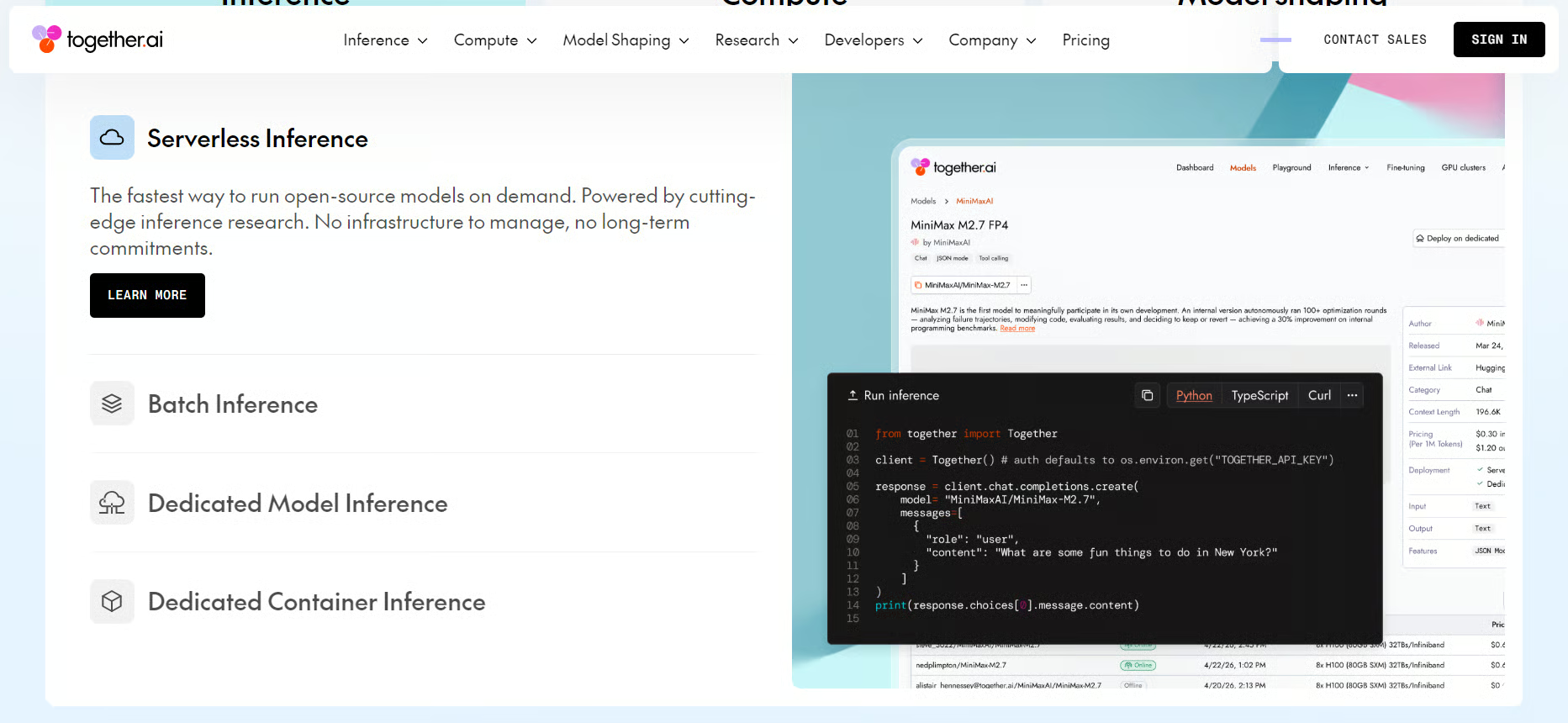

4. Together AI

Together AI menyediakan akses terkelola ke model open-source dan model spesialis melalui satu API terpadu. Katalog modelnya mencakup 200+ model untuk teks, gambar, video, kode, dan audio, dengan dukungan untuk inferensi serverless, inferensi batch, endpoint khusus, fine-tuning, evaluasi, dan klaster GPU.

Together AI adalah opsi kuat bagi pengembang yang ingin membangun dengan model open-source tanpa mengelola infrastruktur sendiri. Ini sangat berguna bagi tim yang menguji banyak model, melakukan fine-tuning model kustom, atau menskalakan beban kerja inferensi.

Sumber: Together AI

Meski demikian, kualitas, kecepatan, dan keandalan model dapat bervariasi tergantung model yang dipilih. Tim mungkin memerlukan lebih banyak pengujian, benchmarking, dan evaluasi sebelum digunakan di produksi.

Untuk beban kerja sensitif, tim harus memeriksa apakah mereka memerlukan akses serverless, endpoint khusus, atau opsi deployment privat untuk memenuhi persyaratan keamanan dan kepatuhan mereka.

Terbaik untuk: inferensi model open-source, fine-tuning, beban kerja AI berskala, dan eksperimen lintas banyak model.

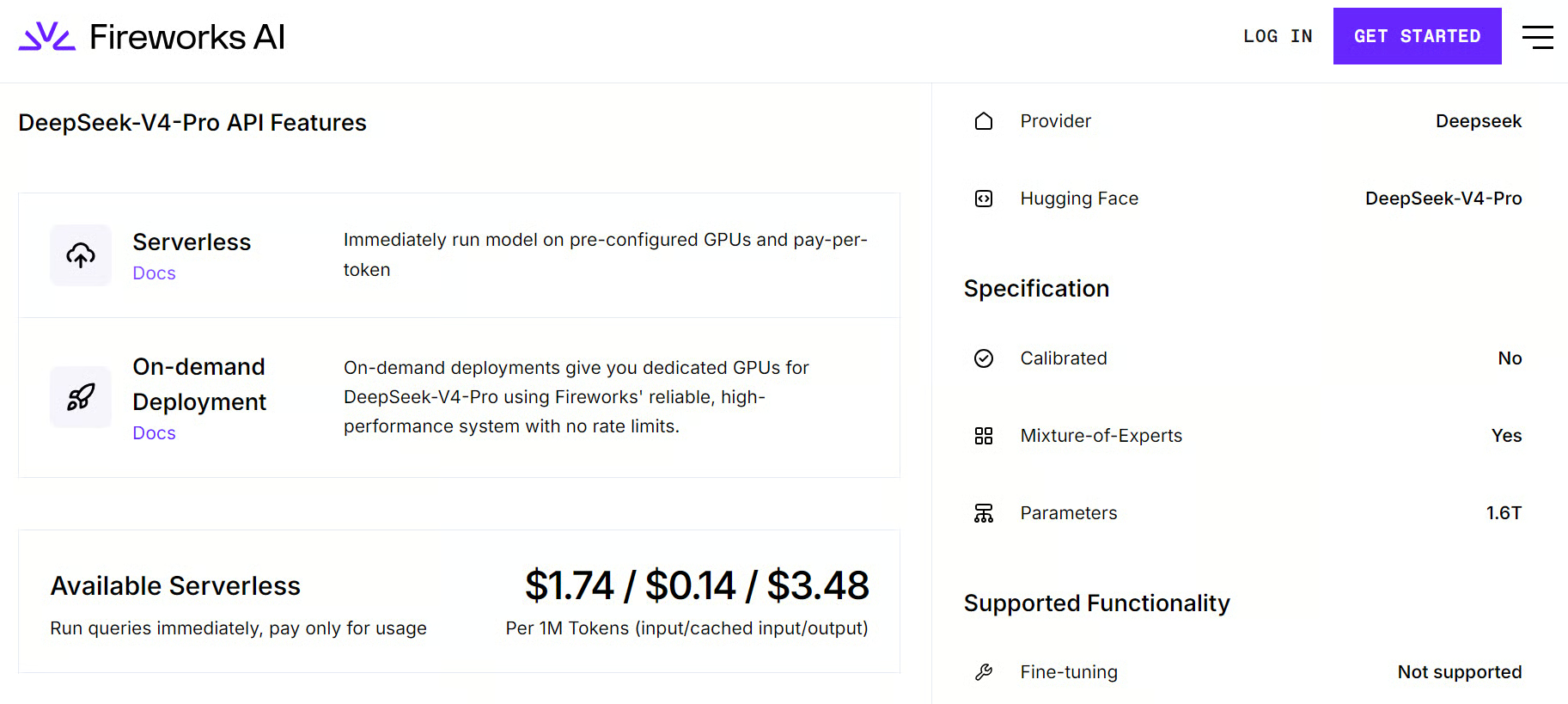

5. Fireworks AI

Fireworks AI berfokus pada inferensi cepat untuk LLM open-source dan model AI generatif. Platformnya mendukung inferensi serverless, deployment on-demand, fine-tuning, dan API siap produksi untuk model open-source populer.

Fireworks AI adalah opsi kuat bagi tim yang menginginkan fleksibilitas model open-source dengan inferensi lebih cepat dan latensi lebih rendah. Ini sangat berguna untuk AI percakapan, asisten coding, pencarian, aplikasi multimodal, dan sistem RAG enterprise.

Sumber: Fireworks AI

Kekurangan utamanya adalah Fireworks AI lebih berfokus pada inferensi dan deployment daripada menjadi platform AI serba ada yang luas. Tim mungkin tetap memerlukan alat terpisah untuk orkestrasi, evaluasi, pemantauan, atau alur kerja agen yang kompleks.

Tim juga harus mempertimbangkan apakah inferensi serverless cukup untuk beban kerja sensitif, atau apakah diperlukan deployment khusus untuk kontrol yang lebih kuat atas performa dan kepatuhan.

Terbaik untuk: inferensi cepat model open-source, fine-tuning, aplikasi AI produksi, dan deployment model open-source berlatensi rendah.

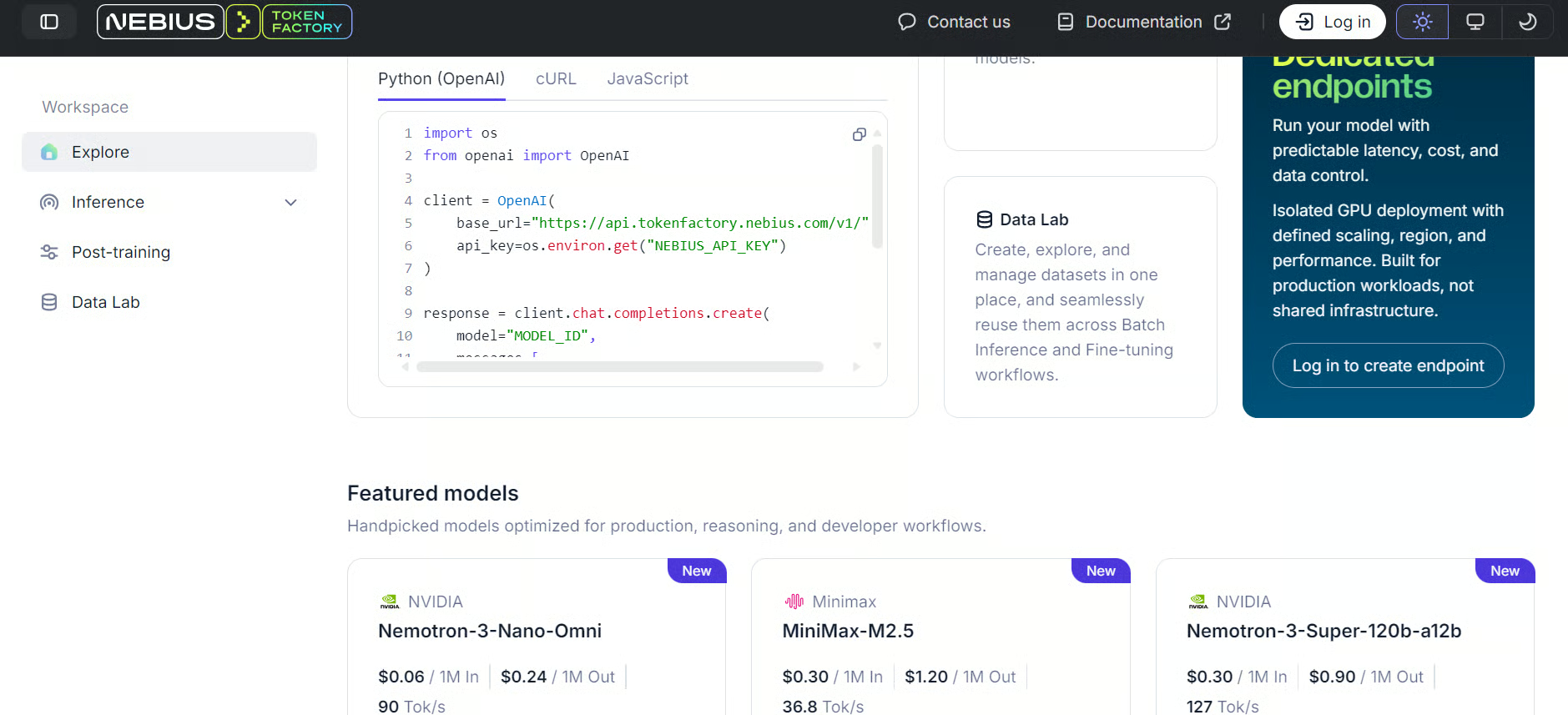

6. Nebius AI

Nebius AI adalah penyedia cloud AI yang dibangun untuk beban kerja AI berbasis GPU, inferensi terkelola, penyajian model, dan infrastruktur AI yang dapat diskalakan. Layanan inferensi Token Factory mendukung model open-source melalui API yang kompatibel dengan OpenAI, dengan opsi for inferensi serverless, fine-tuning, dan infrastruktur cloud AI khusus.

Nebius AI adalah opsi kuat untuk tim yang menginginkan kontrol infrastruktur lebih besar daripada penyedia API dasar, sekaligus menghindari kompleksitas mengelola lingkungan GPU sendiri sepenuhnya. Ini sangat berguna bagi tim yang membangun dengan model open-source dan kustom yang membutuhkan komputasi berskala, inferensi cepat, dan opsi deployment siap produksi.

Sumber: Nebius Token Factory

Nebius Token Factory menawarkan dua pilihan kecepatan inferensi: Fast dan Base. Fast dirancang untuk beban kerja interaktif berlatensi rendah, sementara Base dirancang untuk inferensi volume tinggi yang lebih hemat biaya atau pemrosesan latar belakang.

Nebius jelas lebih berfokus pada infrastruktur dibandingkan platform API LLM plug-and-play sederhana. Ini berarti tim mungkin memerlukan lebih banyak pengetahuan cloud, deployment, dan manajemen beban kerja untuk mendapatkan nilai maksimal.

Untuk beban kerja sensitif, tim harus mempertimbangkan apakah inferensi terkelola sudah cukup atau apakah diperlukan infrastruktur khusus untuk kontrol yang lebih kuat atas keamanan, kepatuhan, dan tata kelola data.

Terbaik untuk: infrastruktur cloud AI, inferensi terkelola, beban kerja berbasis GPU, inferensi cepat, dan tim yang menginginkan kontrol deployment lebih besar.

Penyedia Routing LLM

Penyedia routing LLM memberi pengembang akses ke banyak model dan penyedia melalui satu API. Alih-alih melakukan integrasi terpisah dengan OpenAI, Anthropic, Google, Mistral, DeepSeek, dan penyedia lain, pengembang dapat menggunakan satu lapisan routing untuk mengelola akses model dari satu tempat.

Platform ini berguna untuk perbandingan model, routing fallback, optimasi biaya, redundansi penyedia, observabilitas, dan beralih antar model tanpa menulis ulang aplikasi Anda.

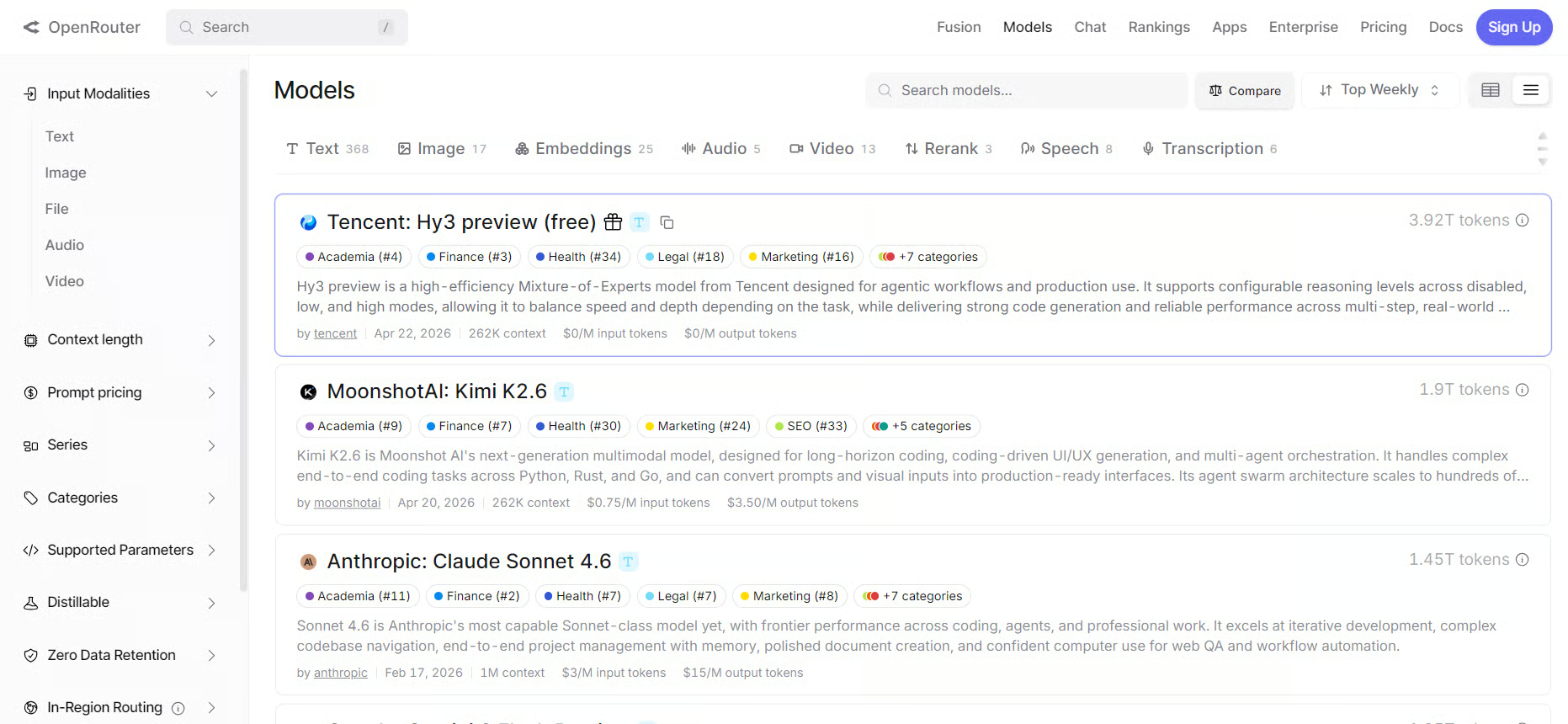

7. OpenRouter

OpenRouter adalah salah satu penyedia routing LLM paling populer. Ini memberi pengembang akses ke banyak model melalui satu API yang kompatibel dengan OpenAI, sehingga lebih mudah bekerja dengan berbagai penyedia menggunakan satu integrasi.

Seperti yang telah kami bahas dalam beberapa tutorial, OpenRouter adalah opsi kuat bagi pengembang yang ingin membandingkan model, menguji rilis baru dengan cepat, melakukan routing permintaan lintas penyedia, atau menghindari terkunci pada satu vendor model.

Sumber: OpenRouter

Salah satu kekurangannya adalah OpenRouter menambahkan lapisan lain antara aplikasi Anda dan penyedia model. Ini dapat menimbulkan ketergantungan tambahan, latensi yang bervariasi, dan perilaku spesifik penyedia yang tetap perlu diuji.

Untuk beban kerja produksi, tim harus meninjau pengaturan routing, perilaku fallback, preferensi penyedia, dan kontrol privasi sebelum mengirim lalu lintas yang sensitif atau krusial bagi bisnis melalui platform.

Terbaik untuk: aplikasi multi-model, perbandingan model, routing fallback, fleksibilitas penyedia, dan eksperimen cepat.

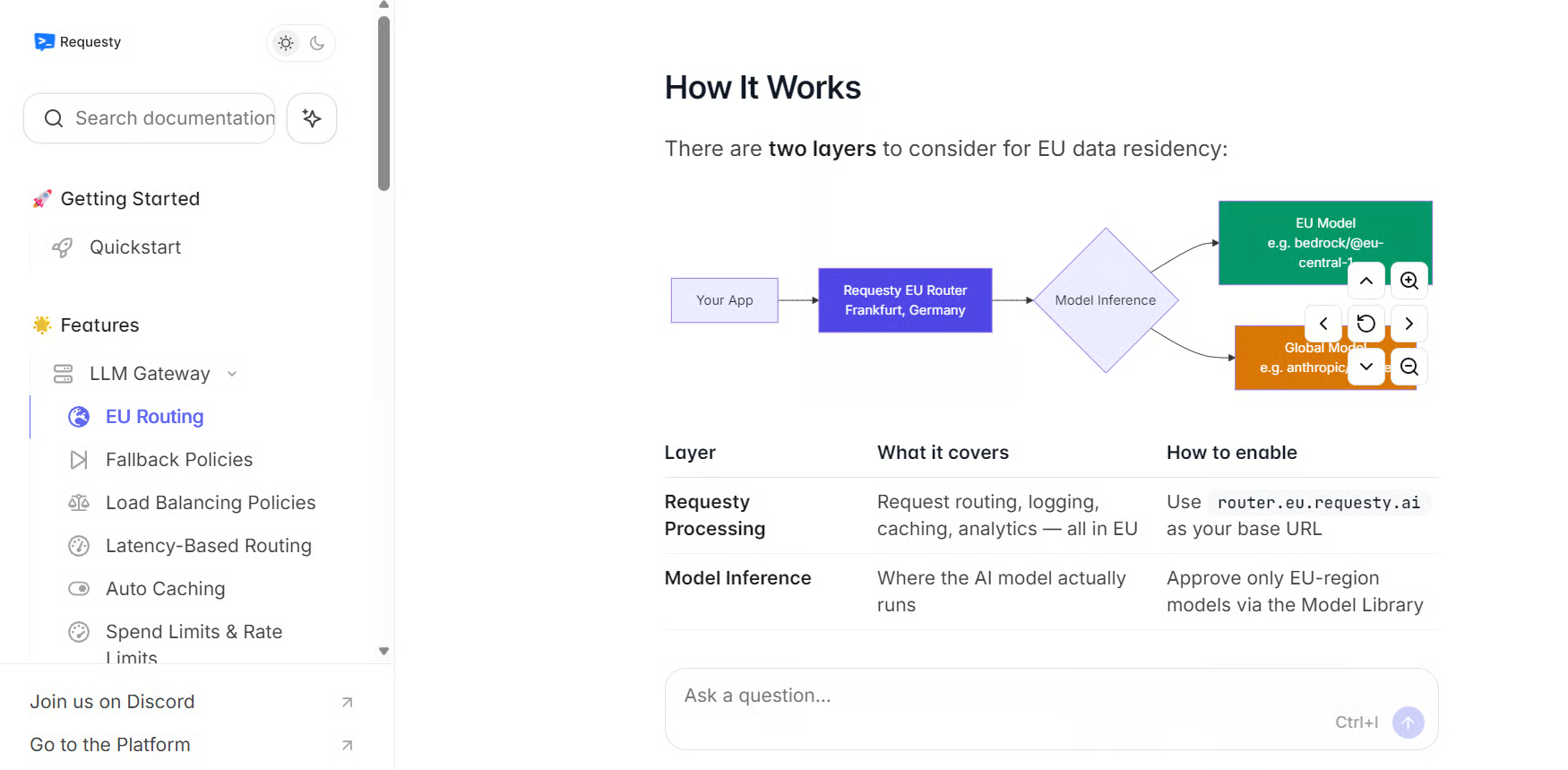

8. Requesty.ai

Requesty.ai adalah platform routing dan gateway LLM yang membantu tim terhubung ke banyak penyedia LLM melalui satu API yang kompatibel dengan OpenAI. Ini mendukung 400+ model, dengan fitur untuk routing, fallback, caching, manajemen biaya, observabilitas, dan tata kelola.

Requesty.ai adalah opsi kuat bagi tim yang membangun aplikasi AI produksi yang bergantung pada lebih dari satu penyedia model. Ini sangat berguna untuk mengelola kebijakan routing, melacak penggunaan, mengontrol pengeluaran, dan meningkatkan keandalan saat penyedia gagal, timeout, atau terkena batas laju.

Sumber: Dokumentasi Requesty AI

Seperti OpenRouter, kekurangan utamanya adalah Requesty.ai menambahkan lapisan gateway lain ke tumpukan aplikasi. Tim perlu mengonfigurasi routing, fallback, logging, dan tata kelola dengan hati-hati untuk menghindari biaya, latensi, atau perilaku penyedia yang tidak terduga.

Untuk beban kerja sensitif, Requesty.ai menyertakan kontrol seperti deteksi PII, pembersihan data, pagar pembatas konten, log audit, dan fitur tata kelola, namun tim tetap harus memutuskan data apa yang boleh melewati gateway dan bagaimana log harus dikelola.

Terbaik untuk: routing LLM, kontrol biaya, observabilitas, fallback penyedia, tata kelola, dan alur kerja gateway AI produksi.

Penyedia LLM Cloud

Penyedia LLM cloud adalah platform cloud besar yang memberi pengembang dan perusahaan akses terkelola ke foundation model. Platform ini sering mendukung model mereka sendiri serta model dari penyedia pihak ketiga.

Mereka sangat berguna bagi perusahaan yang sudah menggunakan infrastruktur cloud dan membutuhkan keamanan, tata kelola, kepatuhan, integrasi data, kontrol deployment, dan manajemen model dalam satu tempat.

9. Google Vertex AI

Google Vertex AI adalah platform machine learning dan AI generatif dari Google Cloud. Ini memberi pengembang dan perusahaan akses ke model Gemini, Model Garden, alat agen, dan infrastruktur terkelola untuk membangun, melakukan deployment, dan mengelola aplikasi AI.

Vertex AI juga mendukung mitra terkemuka dan model open-source melalui Model Garden, termasuk Anthropic Claude, xAI Grok, model Mistral AI, dan model open-source seperti GLM 5 dan Gemma 4, bersamaan dengan model Gemini milik Google.

Sumber: Generative AI di Vertex AI

Google Vertex AI adalah opsi kuat untuk tim yang sudah menggunakan Google Cloud dan menginginkan deployment model cloud-native, tata kelola, kontrol keamanan, serta integrasi dengan ekosistem data dan AI Google yang lebih luas.

Di sisi lain, Vertex AI bisa lebih kompleks dibandingkan menggunakan API model sederhana. Tim mungkin memerlukan pengalaman Google Cloud untuk mengelola proyek, izin, penagihan, pengaturan deployment, dan integrasi dengan benar.

Untuk beban kerja sensitif, Vertex AI berguna bagi tim yang memerlukan kontrol akses tingkat cloud, tata kelola, dan infrastruktur terkelola, namun keputusan penyiapan terkait logging, akses data, dan wilayah deployment tetap perlu ditinjau dengan cermat.

Terbaik untuk: pengguna Google Cloud, akses Gemini, aplikasi AI enterprise, alur kerja multimodal, dan deployment model cloud-native.

10. Amazon Bedrock

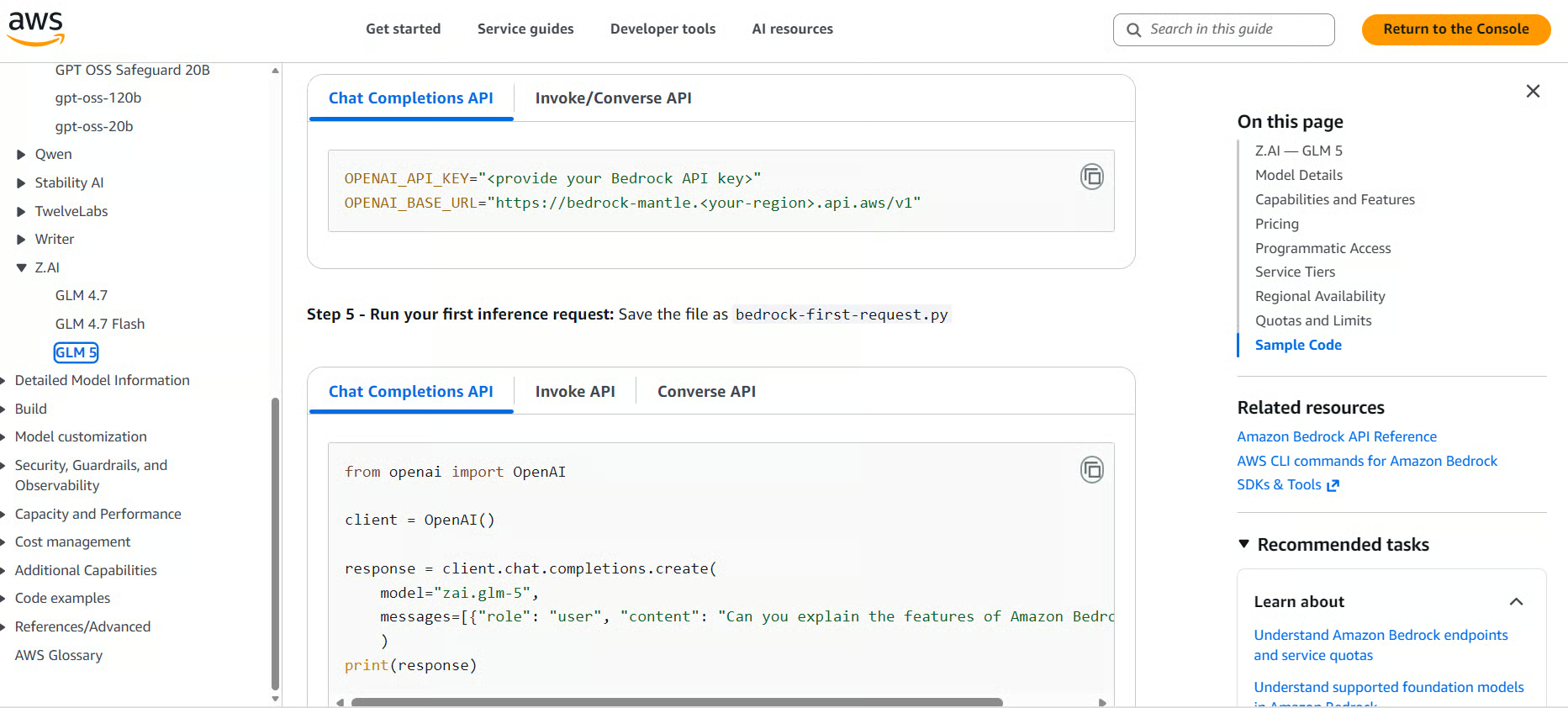

Amazon Bedrock adalah platform AI generatif terkelola dari AWS. Ini memberi pengembang akses ke foundation model dari Amazon dan penyedia pihak ketiga melalui satu layanan AWS terkelola.

Bedrock mendukung model dari penyedia seperti Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek, dan lainnya, sehingga berguna bagi tim yang menginginkan pilihan model dalam ekosistem AWS.

Amazon Bedrock adalah pilihan kuat bagi perusahaan yang sudah membangun di AWS karena menggabungkan akses model, infrastruktur cloud, kontrol keamanan, dan integrasi enterprise dalam satu platform.

Sumber: Amazon Bedrock

Kekurangan utamanya adalah Bedrock bisa lebih kompleks dibandingkan API LLM sederhana. Tim mungkin memerlukan pengalaman AWS untuk mengelola izin, wilayah, akses model, harga, jaringan, dan pengaturan deployment dengan benar.

Untuk beban kerja sensitif, Bedrock bermanfaat karena prompt dan output tidak digunakan untuk melatih model dasar atau dibagikan ke penyedia model, dan tim dapat menggunakan kontrol AWS seperti enkripsi, IAM, dan PrivateLink.

Terbaik untuk: pengguna AWS, AI enterprise, akses foundation model terkelola, deployment berfokus keamanan, dan aplikasi AI generatif cloud-native.

Tabel Perbandingan Penyedia API LLM

Tabel di bawah ini membandingkan penyedia API LLM teratas berdasarkan keunggulan utama dan kekurangan utamanya.

|

Penyedia |

Keunggulan utama |

Kekurangan utama |

|

OpenAI |

Kualitas model kuat, API matang, alat multimodal, output terstruktur, embeddings, suara, pembuatan gambar, dan alur kerja berbasis agen |

Dapat menjadi mahal pada skala besar dan menawarkan kontrol lebih sedikit dibanding model open-source atau self-hosted |

|

Anthropic |

Kualitas penulisan kuat, kepatuhan instruksi yang cermat, penalaran, coding, dan dukungan konteks panjang |

Biaya dapat meningkat dengan dokumen besar atau penggunaan volume tinggi, dan tim memiliki kontrol terbatas atas hosting serta internal model |

|

Google Gemini |

Kemampuan multimodal kuat, API real-time, dukungan konteks panjang, dan integrasi erat dengan ekosistem AI Google |

Terasa terikat pada ekosistem Google, serta harga, ketersediaan, dan fitur dapat bervariasi menurut alat atau wilayah |

|

Together AI |

Akses terkelola ke banyak model open-source dan spesialis, dengan inferensi serverless, endpoint khusus, fine-tuning, evaluasi, dan infrastruktur GPU |

Kualitas, kecepatan, dan keandalan model dapat bervariasi tergantung model yang dipilih |

|

Fireworks AI |

Inferensi cepat, latensi rendah, akses serverless, deployment on-demand, dan API siap produksi untuk model open-source |

Lebih berfokus pada inferensi dan deployment daripada menjadi platform pengembangan AI serba ada |

|

Nebius AI |

Infrastruktur berbasis GPU, inferensi terkelola, API kompatibel OpenAI, dan tingkatan kecepatan seperti Fast dan Base |

Lebih berfokus pada infrastruktur, sehingga tim mungkin memerlukan pengetahuan cloud dan deployment yang lebih kuat |

|

OpenRouter |

Akses ke banyak model melalui satu API yang kompatibel OpenAI, dengan pergantian penyedia dan opsi fallback yang lebih mudah |

Menambahkan lapisan lain antara aplikasi dan penyedia, yang dapat memengaruhi latensi, keandalan, atau debugging |

|

Requesty.ai |

Satu API untuk banyak penyedia, dengan routing, fallback, caching, pelacakan biaya, observabilitas, dan fitur tata kelola |

Memerlukan penyiapan teliti untuk routing, logging, fallback, dan kontrol biaya guna menghindari perilaku yang tidak terduga |

|

Google Vertex AI |

Akses terkelola ke Gemini, Anthropic Claude, xAI Grok, Mistral AI, dan model open-source melalui Model Garden, plus alat keamanan dan tata kelola Google Cloud |

Lebih kompleks dibanding API sederhana dan mungkin memerlukan pengalaman Google Cloud |

|

Amazon Bedrock |

Akses terkelola ke model dari Amazon dan penyedia pihak ketiga seperti Anthropic, Meta, Mistral AI, Cohere, dan lainnya di dalam AWS |

Lebih kompleks daripada API LLM dasar, terutama terkait izin, wilayah, harga, dan akses model |

Memilih Penyedia API LLM Terbaik untuk Kasus Penggunaan Anda

Memilih penyedia API LLM yang tepat bergantung pada tiga faktor:

- Apa yang Anda bangun

- Seberapa banyak kontrol yang Anda butuhkan

- Seberapa besar anggaran Anda

Untuk startup dan tim kecil, penyedia API LLM open-source sering kali menjadi tempat terbaik untuk memulai. Platform seperti Together AI, Fireworks AI, dan Nebius AI memberi Anda akses ke model open-source yang kuat tanpa mengelola GPU atau infrastruktur sendiri. Mereka bisa lebih cepat, lebih murah, dan lebih fleksibel untuk eksperimen dan pengembangan produk tahap awal.

Jika Anda ingin menguji berbagai model dengan cepat, penyedia routing LLM adalah opsi kuat. Alat seperti OpenRouter dan Requesty.ai memungkinkan Anda membandingkan model closed-source dan open-source melalui satu API, mengelola fallback, dan beralih penyedia tanpa menulis ulang aplikasi Anda.

Untuk alur kerja yang menempatkan kualitas model di atas biaya, penyedia native seperti OpenAI dan Anthropic masih menjadi pilihan paling kuat. Mereka sangat berguna untuk asisten AI produksi, alat coding, alur kerja dengan penalaran berat, aplikasi multimodal, dan sistem berbasis agen di mana keandalan dan performa model paling penting.

Terakhir, jika perusahaan Anda sudah berjalan di AWS atau Google Cloud, sering kali masuk akal untuk tetap berada dalam ekosistem cloud tersebut. Amazon Bedrock dan Google Vertex AI memberi Anda akses model terkelola, kontrol keamanan, tata kelola, dan integrasi dengan alat yang sudah digunakan tim Anda.

Penutup

Untuk pekerjaan teknis, asisten coding, dan alat vibe coding, saya tidak akan terlalu banyak bereksperimen di awal. Berdasarkan pengalaman saya, OpenAI dan Anthropic biasanya menjadi pilihan paling aman karena kemampuan coding, penalaran, dan tooling pengembang yang kuat.

Penyedia API LLM open-source dan penyedia routing LLM adalah alternatif kuat untuk eksperimen yang lebih lanjut.

Penyedia LLM Cloud besar biasanya hanya masuk akal dalam lingkungan korporat. Dalam kasus ini, pilih yang ekosistemnya sudah Anda gunakan.

FAQ Penyedia API LLM

Apa itu penyedia API LLM?

Perusahaan atau platform yang meng-host large language model dan mengeksposnya melalui API, sehingga pengembang dapat mengirim permintaan dan menerima respons yang dihasilkan AI tanpa mengelola GPU atau infrastruktur inferensi sendiri.

Apa perbedaan antara penyedia LLM native dan penyedia LLM cloud?

Penyedia native (seperti OpenAI dan Anthropic) membangun dan menyajikan model mereka sendiri secara langsung. Penyedia cloud (seperti AWS Bedrock dan Google Vertex AI) menawarkan akses terkelola ke banyak model pihak ketiga yang dibundel dalam ekosistem cloud yang ada dengan alat keamanan dan tata kelola tingkat enterprise.

Kapan saya harus menggunakan penyedia routing LLM seperti OpenRouter atau Requesty.ai?

Saat Anda perlu bekerja dengan lebih dari satu model atau penyedia, menginginkan fallback otomatis jika penyedia down, atau perlu membandingkan model dan mengontrol biaya, semuanya melalui satu integrasi API.

Apakah penyedia API LLM open-source kurang mampu dibanding penyedia native seperti OpenAI?

Tidak selalu; itu bergantung pada tugasnya. Platform seperti Together AI dan Fireworks AI meng-host model open-source mutakhir seperti Llama, DeepSeek, dan Mistral, yang dapat bersaing dengan model tertutup, sering kali dengan biaya yang jauh lebih rendah.

Penyedia API LLM mana yang terbaik untuk perusahaan dengan persyaratan kepatuhan ketat?

Amazon Bedrock dan Google Vertex AI biasanya menjadi pilihan terkuat, karena mereka menawarkan kontrol keamanan cloud-native, IAM, enkripsi, pencatatan audit, dan fitur tata kelola yang terintegrasi dengan infrastruktur enterprise yang ada.

Sebagai data scientist tersertifikasi, saya bersemangat memanfaatkan teknologi mutakhir untuk menciptakan aplikasi machine learning yang inovatif. Dengan latar belakang kuat di pengenalan ucapan, analisis dan pelaporan data, MLOps, conversational AI, dan NLP, saya mengasah keterampilan dalam mengembangkan sistem cerdas yang berdampak nyata. Selain keahlian teknis, saya juga komunikator andal yang mampu menyederhanakan konsep kompleks menjadi bahasa yang jelas dan ringkas. Karena itu, saya menjadi blogger yang dicari di bidang data science, membagikan wawasan dan pengalaman kepada komunitas profesional data yang terus berkembang. Saat ini, saya berfokus pada pembuatan dan penyuntingan konten, bekerja dengan large language model untuk mengembangkan konten yang kuat dan menarik agar membantu bisnis dan individu memaksimalkan data mereka.