Tracks

大型语言模型(LLM)API 提供商让开发者无需管理 GPU、模型部署、扩缩容或推理基础设施,就能使用强大的 AI 模型。相比自托管模型,开发者只需连接到 API、选择模型、发送请求并接收响应。

本文将基于模型质量、开发者体验、定价、可扩展性、生态系统支持与生产就绪度,盘点十大 LLM API 提供商。我们将逐一说明其最佳适用场景、核心优势,以及开发者应关注的主要不足。

本指南将十大 LLM API 提供商划分为四类:

- 原生 LLM 提供商

- 开源 LLM API 提供商

- LLM 路由提供商

- 云端 LLM 提供商

原生 LLM 提供商

原生 LLM 提供商通过 API 自行构建、训练并提供其模型家族。对于追求高模型质量、可靠文档、先进推理、多模态支持和生产级工具链的开发者而言,这类提供商往往是最优选。

1. OpenAI

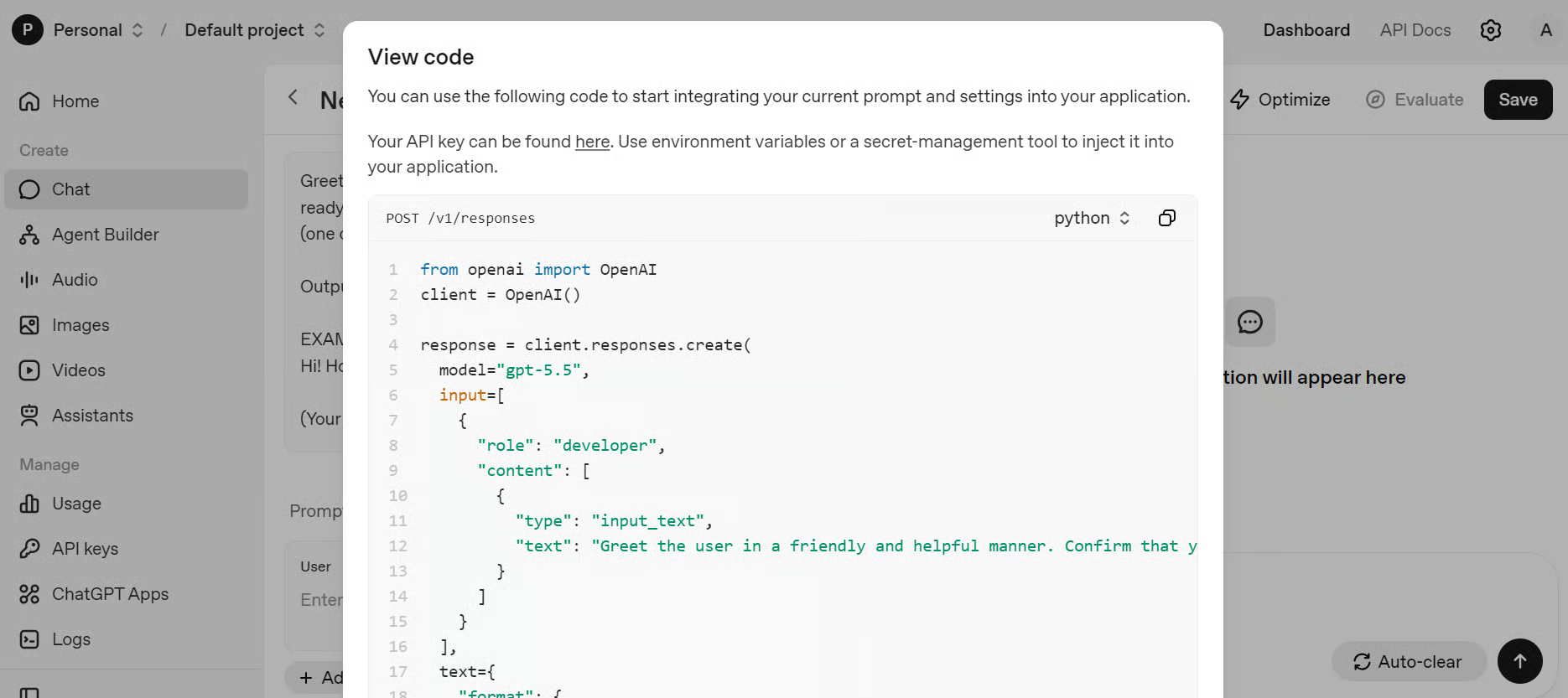

OpenAI 是最广泛使用的 LLM API 提供商之一。其 API Platform 提供对以下能力的访问:

- 前沿推理模型,如 GPT-5.5

- 通过 GPT-Realtime-2 实现实时语音生成与翻译

- 通过 GPT-Images-2.0 进行图像生成

- 借助 OpenAI Agents SDK 进行基于 Agent 的开发

其 API 支持流式输出、实时接口以及结构化输出。

OpenAI 尤其适合构建 AI 助手、编程工具、客服代理、内部副驾、多模态应用和基于 Agent 的系统。

来源:OpenAI

其一大不足是:在大规模场景下成本可能较高,尤其是高并发或重推理应用。此外,它是封闭 API 提供商,相比开源或自托管模型,开发者对模型内部、托管方式与定制化的掌控力较弱。

最佳适用:通用 AI 应用、推理、编程、多模态工作流,以及生产级 AI 产品。

2. Anthropic

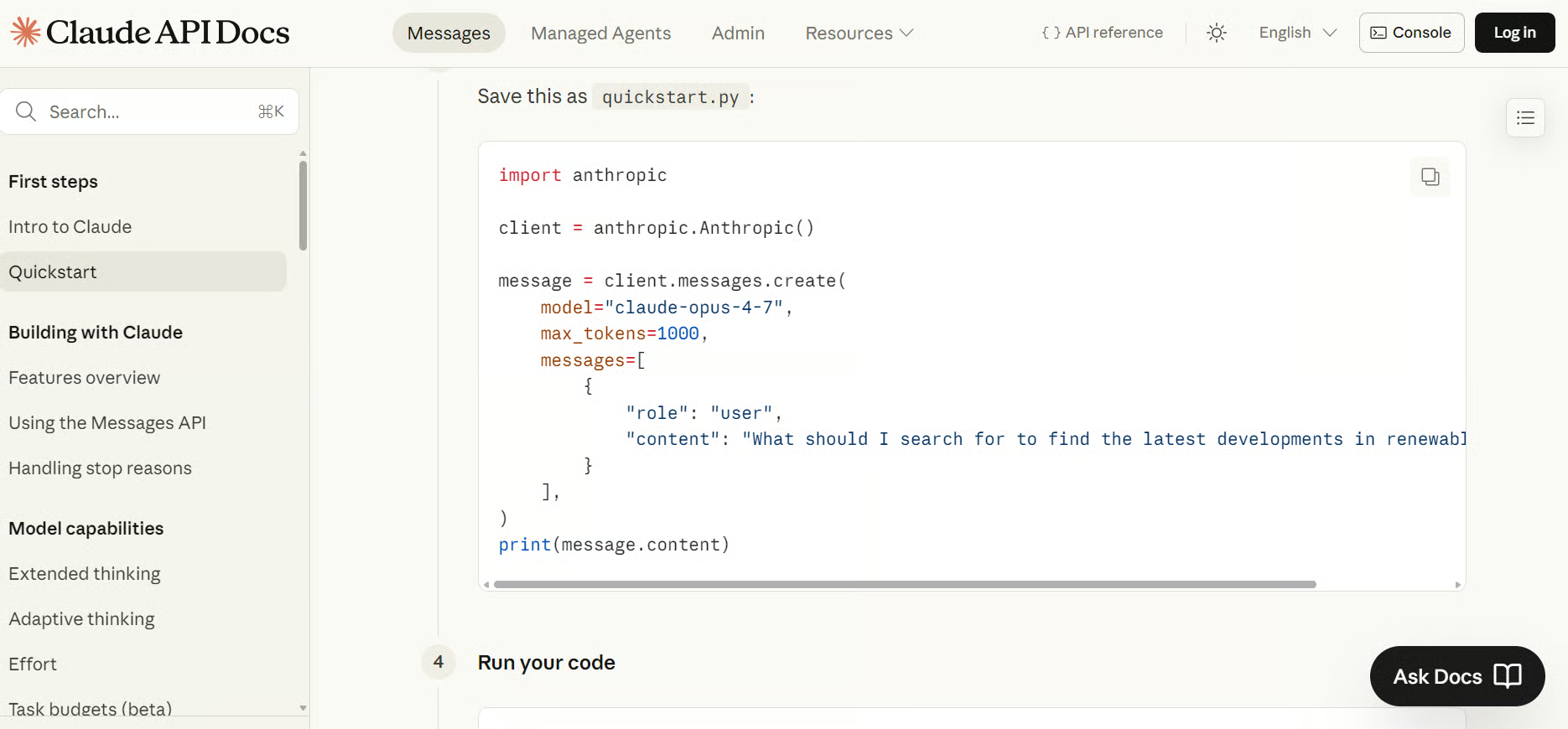

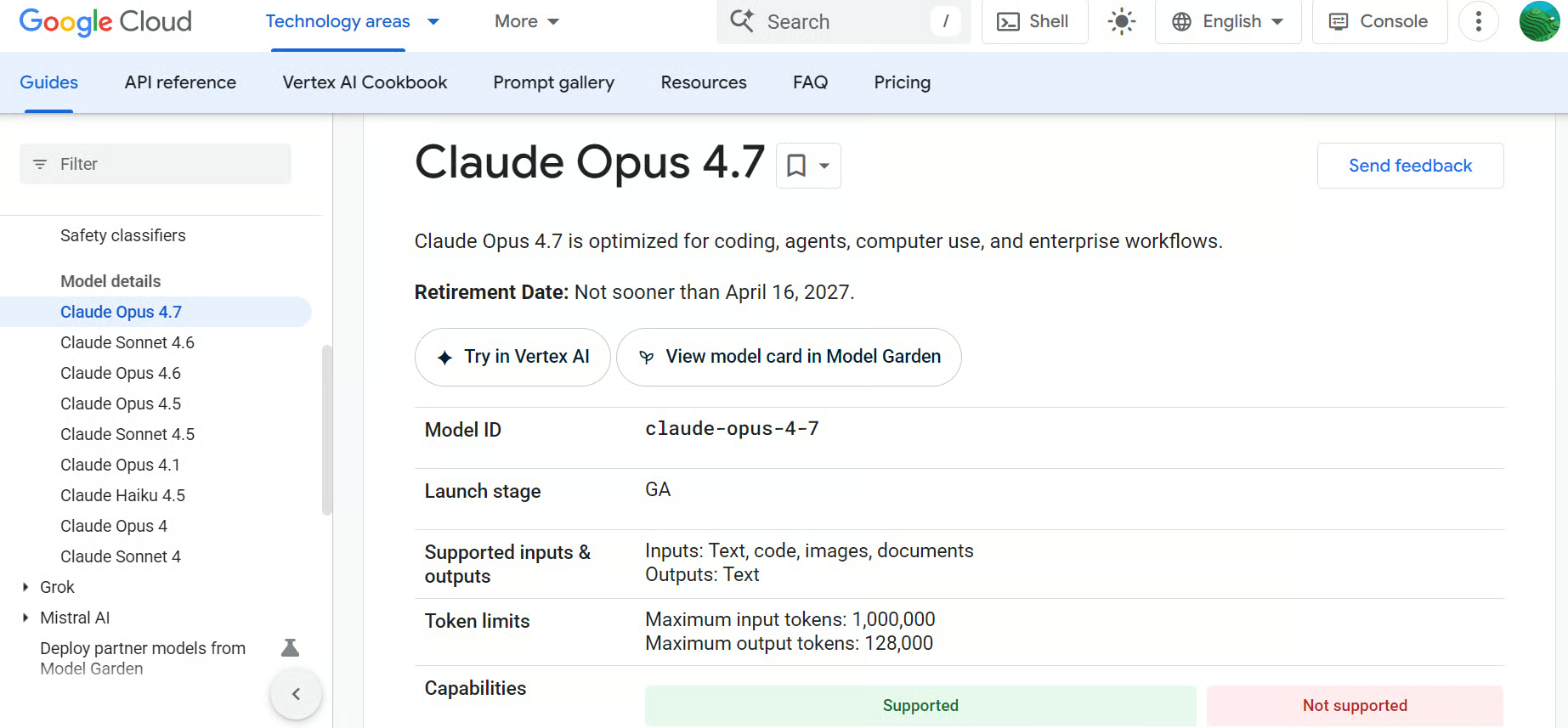

Anthropic 通过其 API 提供 Claude 模型家族,例如其最新旗舰模型 Claude Opus 4.7。Claude 专为语言、推理、分析、编程、长上下文与 Agent 工作流而设计。Anthropic 的开发者平台通过 API、SDK 与文档为团队提供直接的模型访问。

Claude 尤其适用于需要严格遵循指令、出色写作质量、文档分析,以及可靠处理复杂提示的应用。

其主要不足在于成本,特别是在处理大文档、长上下文提示或高并发应用时。由于 Claude 通过托管 API 访问,团队对模型运行的位置与方式也缺乏足够控制。

对于注重隐私的场景,在通过 API 发送机密的业务或客户数据前,开发者应仔细审阅数据处理、保留与合规要求。

最佳适用:编程助手、企业级 AI、长上下文分析、文档工作流与 AI Agent。

若需两家巨头的详细对比,请参阅我们的指南:Anthropic vs OpenAI。

3. Google Gemini

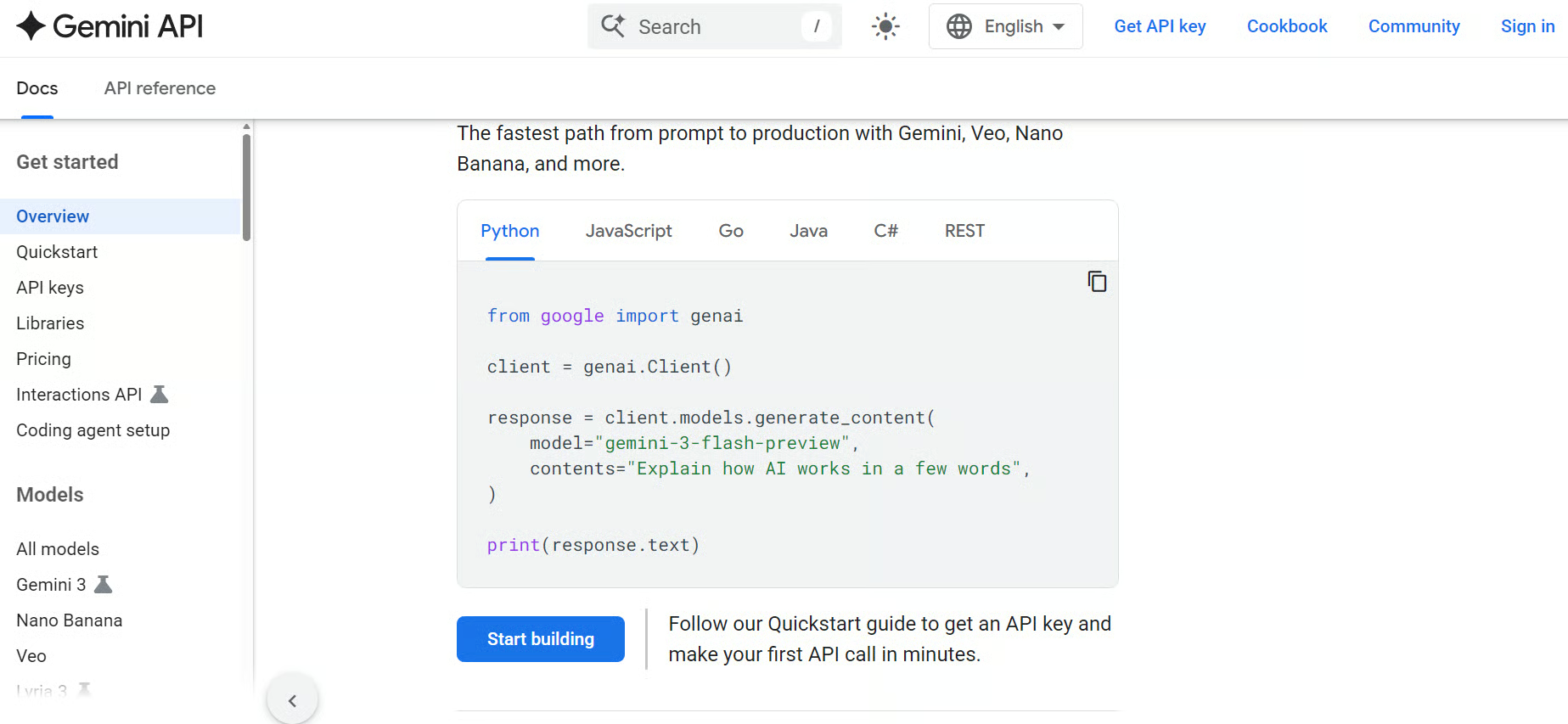

Google Gemini 是 Google 的原生 LLM 家族,包括 Gemini 3.1 Pro,可通过 Gemini API 供开发者使用。Gemini API 支持标准、流式与实时 API,并提供模型详情、SDK、定价、设置与 API 参考文档。

随着用于图像生成的 Nano Banana 2 与 Veo 3.1 的集成,Gemini 是构建多模态应用的强势之选。它也非常适合 AI 助手(尤其依赖搜索体验的)、编程工具,以及需连接 Google 更广泛 AI 生态的产品。

来源:Gemini API

不过,Gemini 可能更紧密地绑定于 Google 生态,这未必适合希望保持供应商中立架构的团队。不同工具和地区的定价、模型可用性与功能支持也可能存在差异。

对于隐私敏感型应用,在通过 API 发送机密业务或客户数据前,团队应审查数据处理、保留与合规要求。

最佳适用:多模态 AI 应用、Google 生态集成、长上下文工作流、编程与通用 AI 应用。

开源 LLM API 提供商

开源 LLM API 提供商通过托管 API 提供对开源与开放权重模型的访问。开发者无需自行下载并在自有 GPU 上运行模型,这些平台会托管模型并通过简单 API 提供使用。

这类提供商适合希望降低成本、获得更高模型灵活性、更快试验迭代,并使用热门开源模型(如 Llama、DeepSeek、Qwen、Mistral、Gemma 等)的团队。

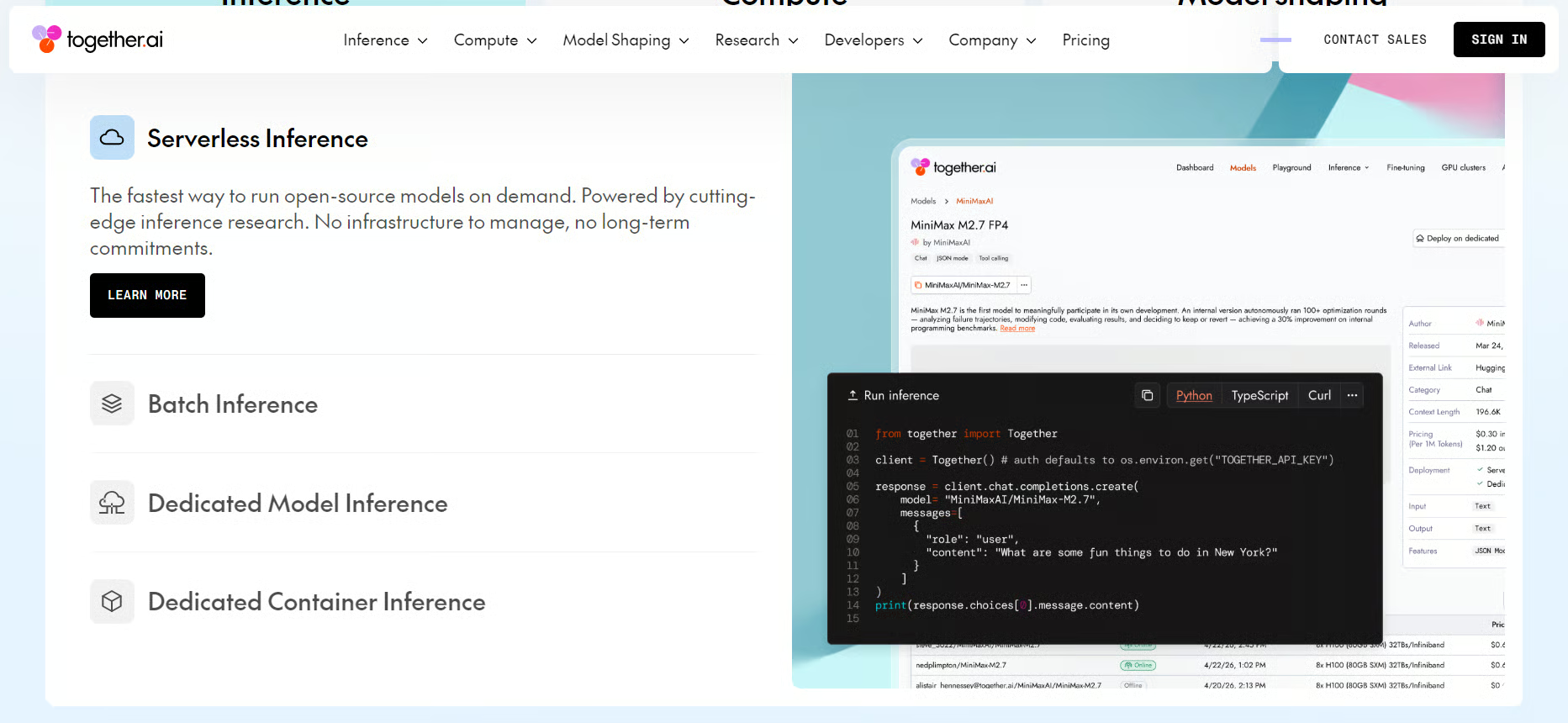

4. Together AI

Together AI 通过统一 API 提供对开源与专用模型的托管访问。其模型目录涵盖文本、图像、视频、代码、音频在内的 200+ 模型,并支持无服务器推理、批量推理、专用端点、微调、评测与 GPU 集群。

Together AI 非常适合希望在无需自建基础设施的前提下使用开源模型的开发者。它对测试多模型、微调自定义模型或扩展推理工作负载的团队尤为有用。

来源:Together AI

需要注意的是,模型质量、速度与可靠性会随所选模型而异。团队在投产前可能需要更多测试、基准与评估。

对于敏感工作负载,团队应评估是否需要无服务器访问、专用端点或私有部署方案,以满足安全与合规要求。

最佳适用:开源模型推理、微调、可扩展 AI 工作负载,以及跨多模型的试验。

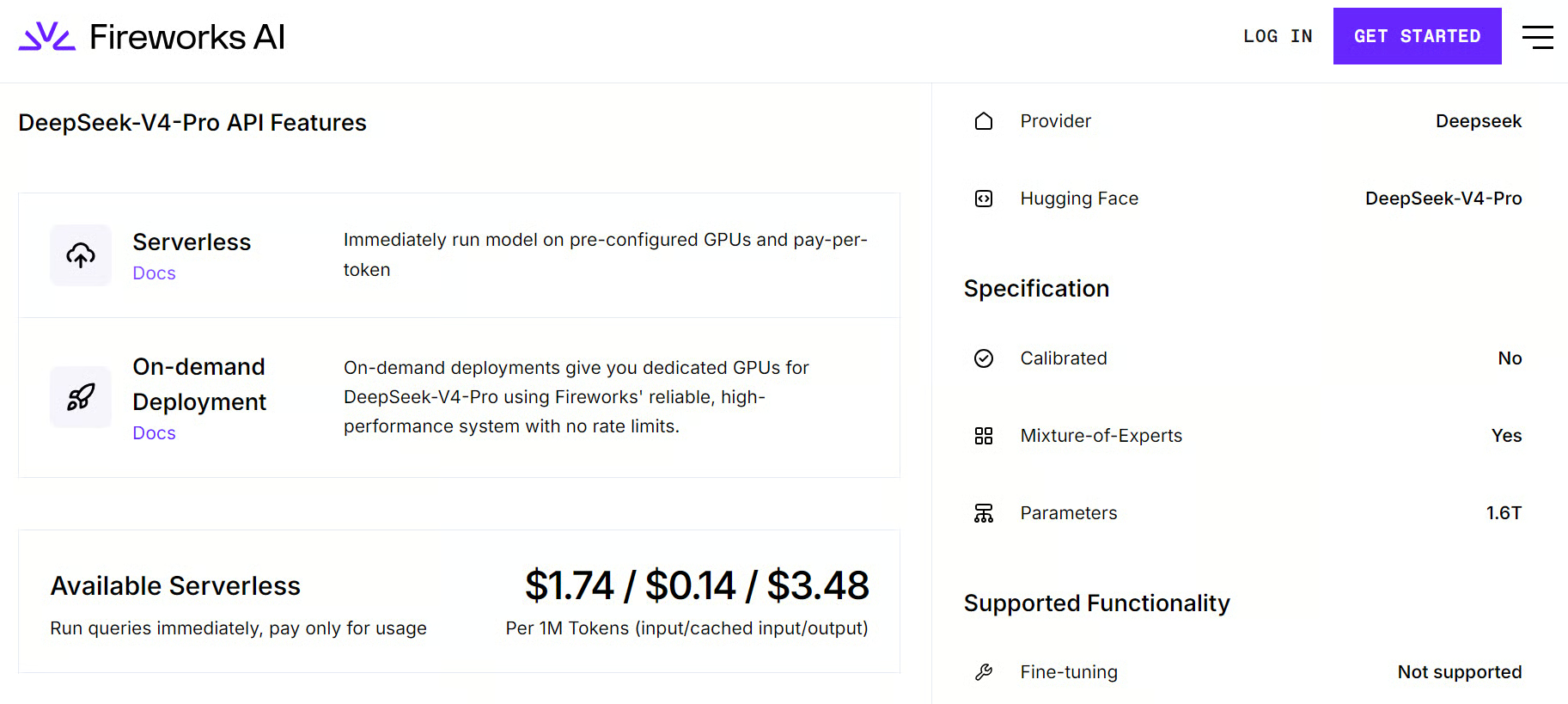

5. Fireworks AI

Fireworks AI 专注于为开源 LLM 与生成式 AI 模型提供高速推理。其平台支持无服务器推理、按需部署、微调与面向热门开源模型的生产级 API。

对于希望兼具开源模型灵活性与更快推理、低延迟的团队而言,Fireworks AI 是强有力的选择。它尤其适合对话式 AI、编程助手、搜索、多模态应用与企业级 RAG 系统。

来源:Fireworks AI

其主要不足是更聚焦于推理与部署,而非提供面面俱到的一体化 AI 平台。团队可能仍需额外工具来处理编排、评测、监控或复杂的 Agent 工作流。

团队还应考虑:无服务器推理是否足以覆盖敏感负载,或是否需要专用部署以更好地控制性能与合规。

最佳适用:快速的开源模型推理、微调、生产级 AI 应用与低延迟的开源模型部署。

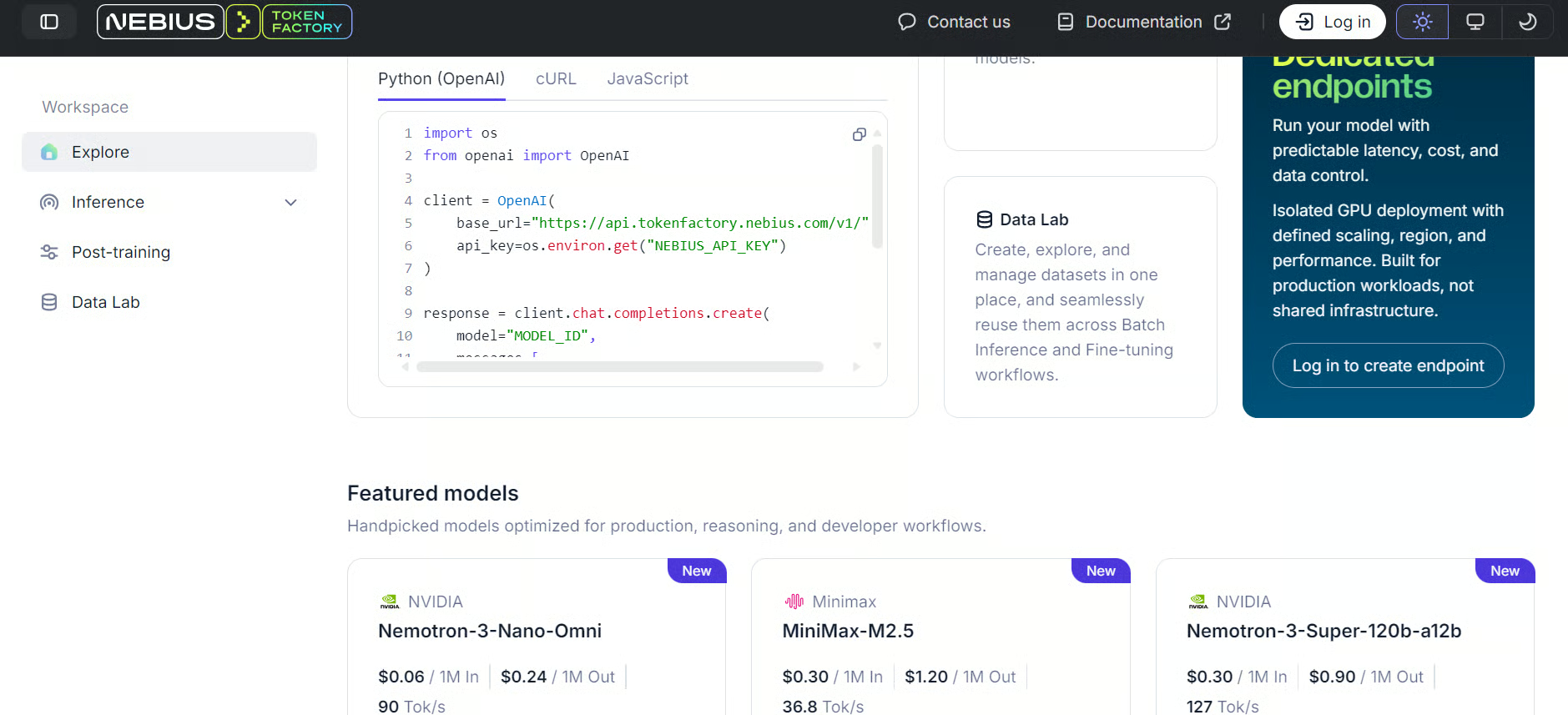

6. Nebius AI

Nebius AI 是面向 GPU 支撑型 AI 工作负载、托管推理、模型服务与可扩展 AI 基础设施的云提供商。其 Token Factory 推理服务通过 OpenAI 兼容 API 支持开源模型,并提供无服务器推理、微调与专用 AI 云基础设施选项。

Nebius AI 适合希望比基础 API 提供商拥有更多基础设施掌控、但又不想全权管理自有 GPU 环境复杂性的团队。对于基于开源与自定义模型、需要可扩展算力、快速推理与生产就绪部署选项的团队尤为有用。

Nebius Token Factory 提供两种推理速度档位:Fast 与 Base。Fast 面向低延迟、交互式负载;Base 面向更具性价比的高并发推理或后台处理。

与简单即插即用的 LLM API 平台相比,Nebius 更偏基础设施导向。这意味着团队需要具备更多云、部署与工作负载管理方面的知识,才能发挥其最大价值。

对于敏感负载,团队需评估:托管推理是否足够,或是否需要专用基础设施以更好地控制安全、合规与数据治理。

最佳适用:AI 云基础设施、托管推理、GPU 支撑负载、快速推理,以及希望拥有更强部署控制的团队。

LLM 路由提供商

LLM 路由提供商通过一个 API 为开发者接入多个模型与提供商。开发者无需分别集成 OpenAI、Anthropic、Google、Mistral、DeepSeek 等各家服务,只需使用一个路由层即可在单一入口管理模型访问。

这类平台有助于模型对比、回退路由、成本优化、供应商冗余、可观测性,并可在无需重写应用的情况下切换模型。

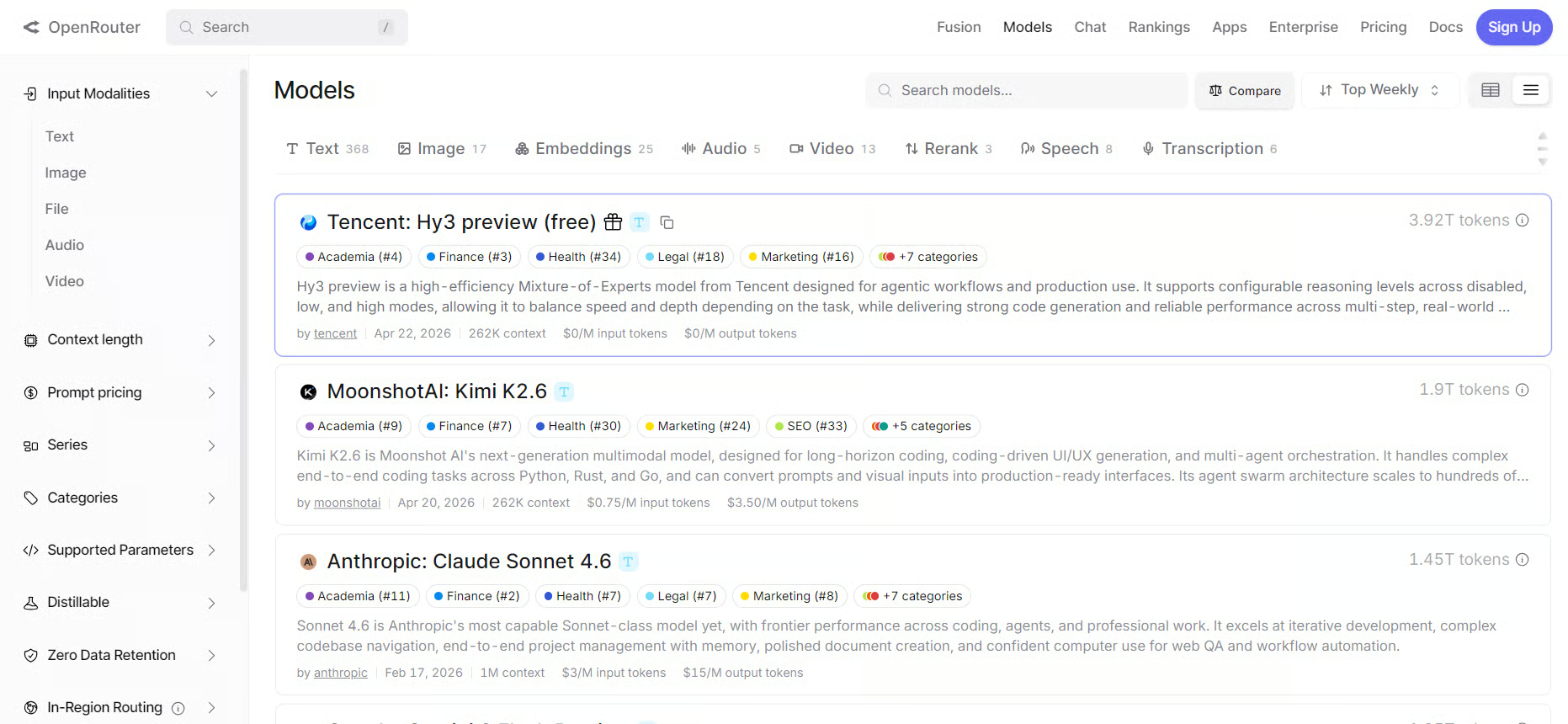

7. OpenRouter

OpenRouter 是最受欢迎的 LLM 路由提供商之一。它通过一个 OpenAI 兼容 API 向开发者开放多种模型,便于在一次集成下与不同提供商协作。

正如我们在多篇教程中所述,OpenRouter 非常适合希望对比模型、快速测试新版本、跨提供商路由请求或避免被单一模型厂商锁定的开发者。

来源:OpenRouter

其一项不足在于:OpenRouter 在您的应用与模型提供商之间增加了一个中间层。这可能带来额外依赖、可变延迟,以及仍需测试的提供商特定行为。

在生产工作负载中,团队应在将敏感或关键业务流量接入平台前,审查路由设置、回退行为、提供商偏好与隐私控制。

最佳适用:多模型应用、模型对比、回退路由、提供商灵活性与快速试验。

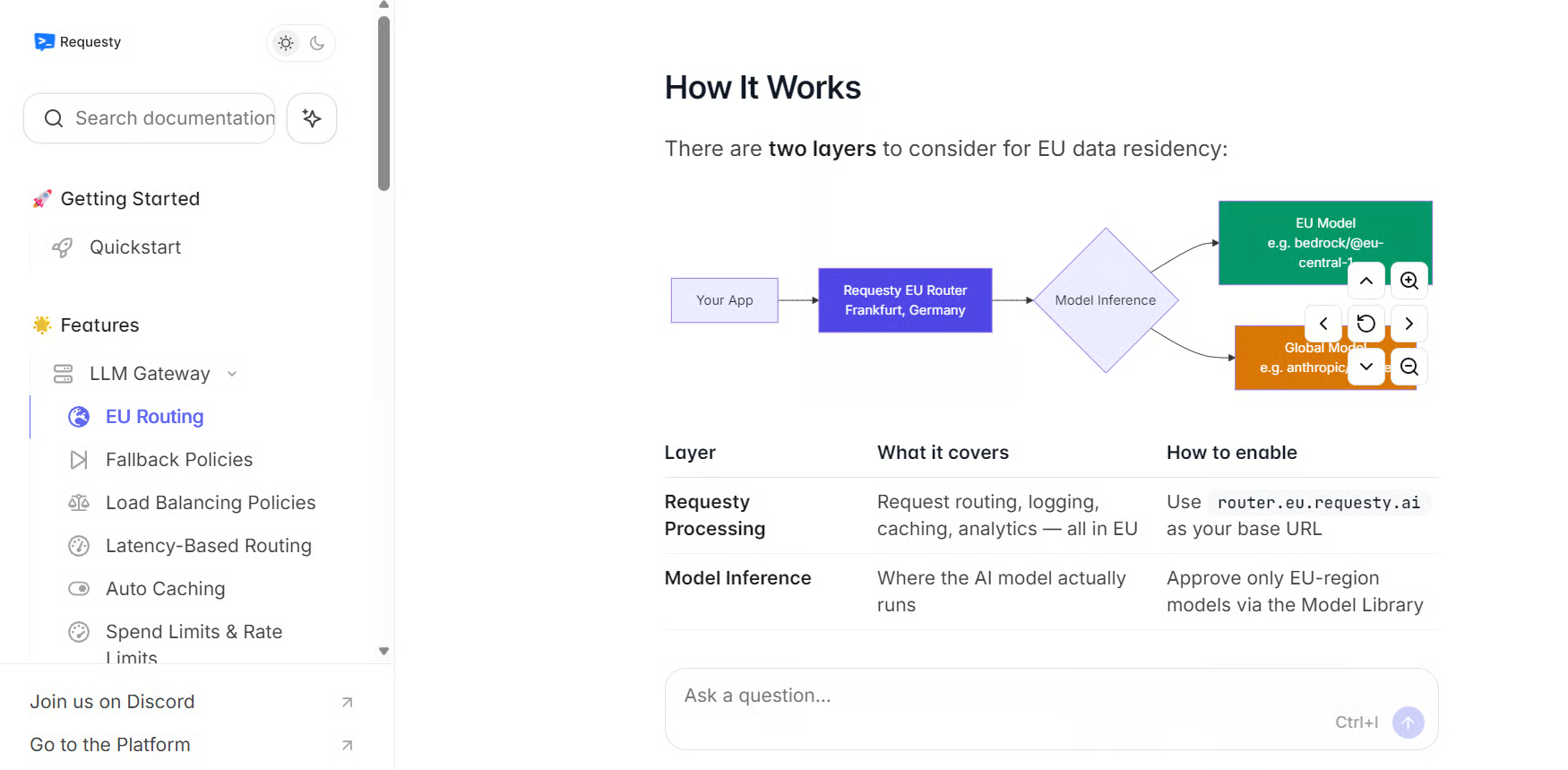

8. Requesty.ai

Requesty.ai 是一款 LLM 路由与网关平台,帮助团队通过一个 OpenAI 兼容 API 连接多家 LLM 提供商。它支持 400+ 模型,并提供路由、回退、缓存、成本管理、可观测性与治理等功能。

对于依赖多家模型提供商构建生产级 AI 应用的团队而言,Requesty.ai 是强力选择。它尤为适合管理路由策略、跟踪用量、控制支出,并在提供商故障、超时或触发限流时提升可靠性。

与 OpenRouter 类似,其关键不足在于 Requesty.ai 会为应用栈新增一个网关层。团队需要谨慎配置路由、回退、日志与治理,避免意外的成本、延迟或提供商行为。

对于敏感负载,Requesty.ai 提供 PII 检测、清洗、内容护栏、审计日志与治理等控制,但团队仍需明确哪些数据可通过网关,以及日志应如何管理。

最佳适用:LLM 路由、成本控制、可观测性、提供商回退、治理与生产级 AI 网关工作流。

云端 LLM 提供商

云端 LLM 提供商是大型云平台,为开发者与企业提供托管的基础模型访问。这些平台通常既支持自家模型,也支持第三方提供商的模型。

它们尤其适用于已使用云基础设施,并需要集安全、治理、合规、数据集成、部署控制与模型管理于一体的企业。

9. Google Vertex AI

Google Vertex AI 是 Google Cloud 的机器学习与生成式 AI 平台。它为开发者与企业提供对 Gemini 模型、Model Garden、Agent 工具与托管基础设施的访问,用于构建、部署与管理 AI 应用。

Vertex AI 还通过 Model Garden 支持领先合作伙伴与开源模型,包括 Anthropic Claude、xAI Grok、Mistral AI 模型,以及 GLM 5 与 Gemma 4 等开源模型,同时也支持 Google 自家的 Gemini 系列。

对于已使用 Google Cloud 的团队,Google Vertex AI 是强势选择,它提供云原生的模型部署、治理、安全控制,并与 Google 更广泛的数据与 AI 生态深度集成。

另一方面,Vertex AI 可能比简单的模型 API 更复杂。团队可能需要具备 Google Cloud 经验,才能妥善管理项目、权限、计费、部署设置与集成。

对于敏感负载,Vertex AI 有助于提供云级访问控制、治理与托管基础设施,但仍需慎重评估日志、数据访问与部署区域等配置。

最佳适用:Google Cloud 用户、Gemini 访问、企业级 AI 应用、多模态工作流与云原生模型部署。

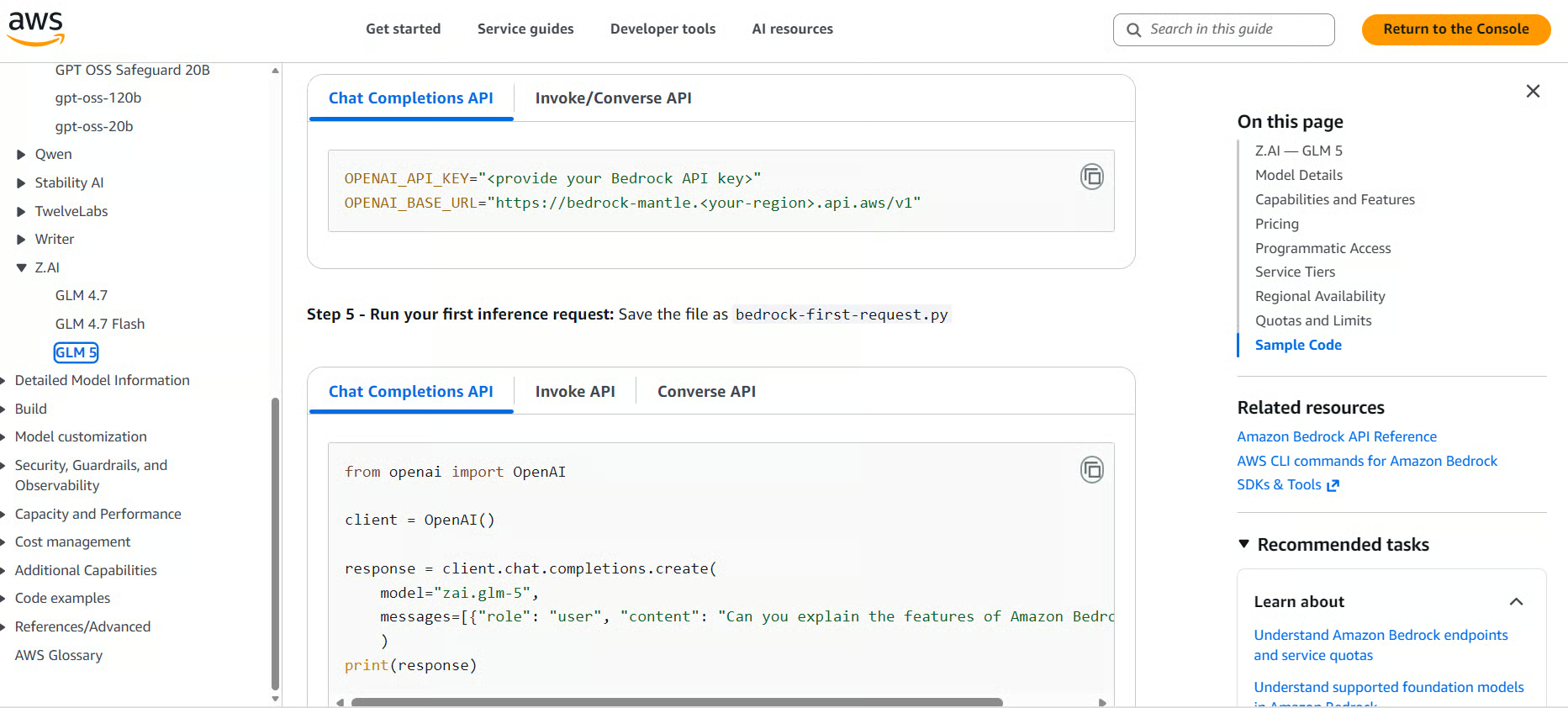

10. Amazon Bedrock

Amazon Bedrock 是 AWS 的托管生成式 AI 平台。它通过一个托管的 AWS 服务,为开发者提供来自 Amazon 与第三方提供商的基础模型访问。

Bedrock 支持来自 Amazon、Anthropic、Meta、Mistral AI、Cohere、DeepSeek 等提供商的模型,适合希望在 AWS 生态中拥有多模型选择的团队。

对于已在 AWS 上构建的公司,Amazon Bedrock 是强有力的选项,因为它将模型访问、云基础设施、安全控制与企业集成整合到同一平台。

其关键不足在于 Bedrock 可能比基础 LLM API 更复杂。团队可能需要 AWS 经验,以妥善管理权限、区域、模型访问、定价、网络与部署设置。

对于敏感负载,Bedrock 的优势在于提示与输出不会用于训练基础模型或与模型提供商共享,且团队可使用 AWS 的加密、IAM 与 PrivateLink 等控制项。

最佳适用:AWS 用户、企业级 AI、托管基础模型访问、以安全为重点的部署与云原生生成式 AI 应用。

LLM API 提供商对比表

下表基于各家的关键优势与主要不足对顶级 LLM API 提供商进行对比。

|

提供商 |

关键优势 |

主要不足 |

|

OpenAI |

模型质量强、API 成熟、多模态工具、结构化输出、向量嵌入、语音、图像生成与基于 Agent 的工作流 |

大规模时成本可能上升,相比开源或自托管模型可控性较弱 |

|

Anthropic |

写作质量强、严格遵循指令、出色推理与编程能力、支持长上下文 |

处理大文档或高并发时成本上升,且团队对托管与模型内部的控制有限 |

|

Google Gemini |

多模态能力强、实时 API、支持长上下文,并与 Google AI 生态深度集成 |

与 Google 生态绑定感较强;定价、可用性与功能可能因工具或地区而异 |

|

Together AI |

托管访问大量开源与专用模型,支持无服务器推理、专用端点、微调、评测与 GPU 基础设施 |

模型质量、速度与可靠性取决于所选模型,存在差异 |

|

Fireworks AI |

推理快速、低延迟、无服务器访问、按需部署,并为开源模型提供生产级 API |

更专注于推理与部署,而非一体化的 AI 开发平台 |

|

Nebius AI |

GPU 支撑的基础设施、托管推理、OpenAI 兼容 API,以及 Fast 与 Base 等速度档位 |

更偏基础设施导向,团队可能需要更强的云与部署知识 |

|

OpenRouter |

通过一个 OpenAI 兼容 API 访问众多模型,便于切换提供商并实现回退 |

在应用与提供商之间新增一层,可能影响延迟、可靠性或调试 |

|

Requesty.ai |

一个 API 接入多家提供商,具备路由、回退、缓存、成本追踪、可观测性与治理功能 |

需要谨慎配置路由、日志、回退与成本控制,以避免意外行为 |

|

Google Vertex AI |

通过 Model Garden 托管访问 Gemini、Anthropic Claude、xAI Grok、Mistral AI 与开源模型,并提供 Google Cloud 的安全与治理工具 |

比简单 API 更复杂,可能需要具备 Google Cloud 经验 |

|

Amazon Bedrock |

在 AWS 内托管访问 Amazon 及 Anthropic、Meta、Mistral AI、Cohere 等第三方模型 |

比基础 LLM API 更复杂,尤其在权限、区域、定价与模型访问方面 |

为您的场景选择最合适的 LLM API 提供商

选择合适的 LLM API 提供商主要取决于三点:

- 您要构建什么

- 您需要多大程度的控制

- 您愿意投入多少成本

对于初创与小团队,开源 LLM API 提供商往往是良好起点。Together AI、Fireworks AI 与 Nebius AI 等平台让您无需自管 GPU 或基础设施,即可使用强大的开源模型。它们在试验与早期产品开发中通常更快、更省、更灵活。

若您希望快速测试不同模型,LLM 路由提供商是不俗选择。OpenRouter 与 Requesty.ai 等工具可通过一个 API 对比闭源与开源模型、管理回退,并在无需重写应用的情况下切换提供商。

对于更看重模型质量而非成本的工作流,OpenAI 与 Anthropic 等原生提供商仍是强势之选。它们尤其适合投产级 AI 助手、编程工具、重推理工作流、多模态应用与基于 Agent 的系统,这些场景更依赖可靠性与模型表现。

最后,若您的公司已运行在 AWS 或 Google Cloud 上,留在既有云生态通常更合理。Amazon Bedrock 与 Google Vertex AI 提供托管模型访问、安全控制、治理,以及与团队既用工具的集成。

结语

对于技术类工作、编程助手与「vibe coding」工具,我建议起步阶段不要过度试验。以我的经验,OpenAI 与 Anthropic 通常是更稳妥的选择,因为它们在编程、推理与开发者工具方面表现强劲。

开源 LLM API 提供商与 LLM 路由提供商是进行更高级试验的有力替代方案。

大型云端 LLM 提供商通常更适用于企业环境。此时,选择您已使用生态中的那一家即可。

LLM API 提供商常见问答

什么是 LLM API 提供商?

一家托管大型语言模型并通过 API 暴露模型能力的公司或平台,开发者无需自行管理 GPU 或推理基础设施即可发送请求并接收 AI 生成的响应。

原生 LLM 提供商与云端 LLM 提供商有何区别?

原生提供商(如 OpenAI 与 Anthropic)自行构建并直接提供其模型。云提供商(如 AWS Bedrock 与 Google Vertex AI)在现有云生态中,以托管方式提供对多家第三方模型的访问,并配套企业级安全与治理工具。

何时应使用 OpenRouter 或 Requesty.ai 这样的 LLM 路由提供商?

当您需要同时使用多个模型或提供商、希望在某个提供商故障时自动回退,或需要对比模型并控制成本——且希望通过一次 API 集成实现以上目标时。

开源 LLM API 提供商是否一定不如 OpenAI 等原生提供商?

不一定;要视任务而定。Together AI 与 Fireworks AI 等平台托管了 Llama、DeepSeek、Mistral 等最前沿的开源模型,在许多场景下可与闭源模型竞争,而且成本常显著更低。

哪家 LLM API 提供商更适合合规要求严格的企业?

Amazon Bedrock 与 Google Vertex AI 通常是最强选择,因为它们提供云原生的安全控制、IAM、加密、审计日志与治理功能,并可与既有企业基础设施集成。