track

Leverantörer av Large Language Model (LLM) API:er ger utvecklare tillgång till kraftfulla AI-modeller utan att behöva hantera GPU:er, modellutrullning, skalning eller inferensinfrastruktur. I stället för att drifta en modell själv kan utvecklare ansluta till ett API, välja en modell, skicka en begäran och ta emot ett svar.

I den här artikeln går vi igenom de 10 bästa LLM-API-leverantörerna baserat på modellkvalitet, utvecklarupplevelse, prissättning, skalbarhet, ekosystemstöd och produktionsmognad. För varje leverantör tar vi upp vad den passar bäst för, dess viktigaste fördelar och de huvudsakliga nackdelarna som utvecklare bör beakta.

Den här guiden delar in de främsta LLM-API-leverantörerna i fyra kategorier:

- Inbyggda LLM-leverantörer

- Open source-LLM-API-leverantörer

- LLM-routingleverantörer

- Molnbaserade LLM-leverantörer

Inbyggda LLM-leverantörer

Inbyggda LLM-leverantörer bygger, tränar och tillhandahåller sina egna modelfamiljer via API:er. De är ofta det starkaste alternativet för utvecklare som vill ha hög modellkvalitet, tillförlitlig dokumentation, avancerat resonemang, multimodalt stöd och produktionsredo verktyg.

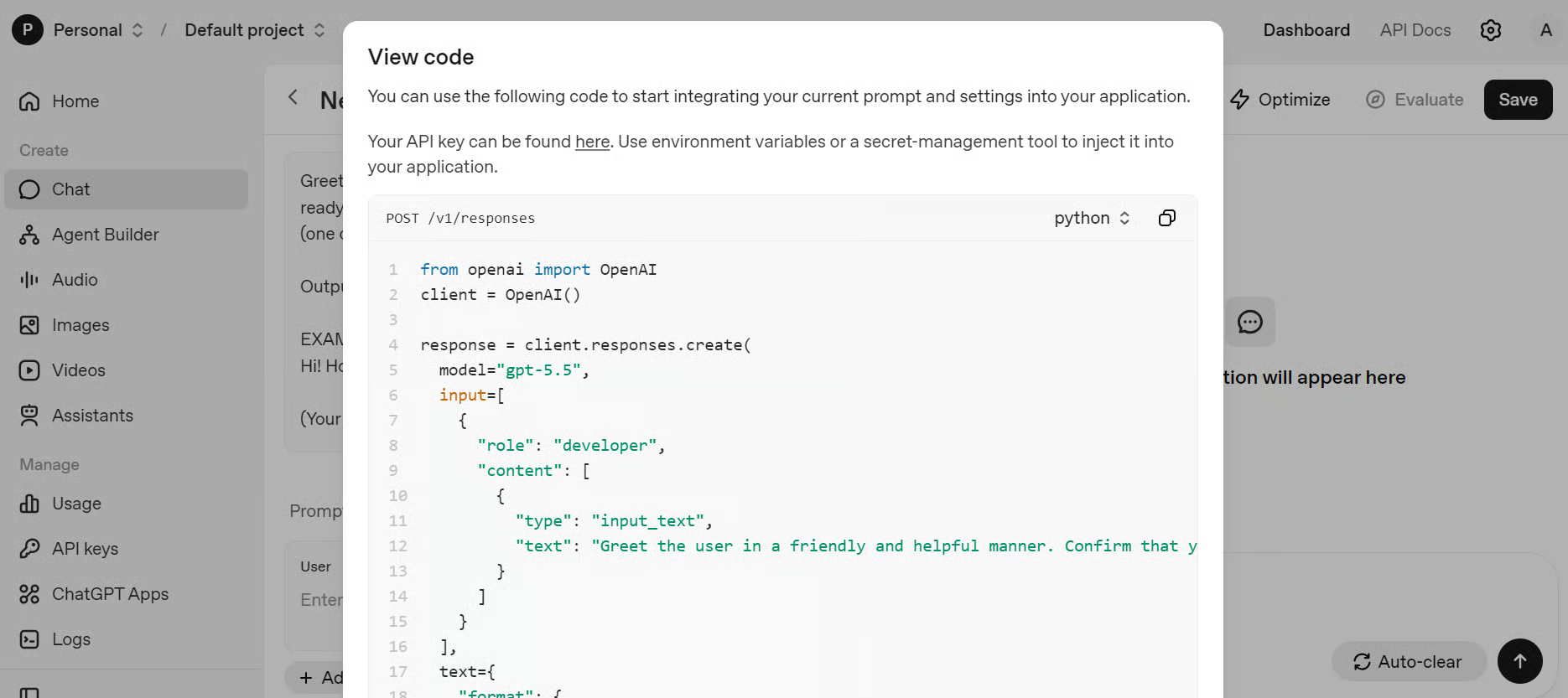

1. OpenAI

OpenAI är en av de mest använda LLM-API-leverantörerna. Deras API-plattform ger tillgång till:

- Gränsmodeller för resonemang som GPT-5.5

- Realtidsgenerering av röst och översättning via GPT-Realtime-2

- Bildgenerering via GPT-Images-2.0, en modell för bildgenerering

- Agentbaserad utveckling genom OpenAI Agents SDK

Deras API stöder streaming, realtidsgränssnitt och strukturerade utdata.

OpenAI är ett starkt val för team som bygger AI-assistenter, kodningsverktyg, kundtjänstagenter, interna copilots, multimodala appar och agentbaserade system.

Källa: OpenAI

En nackdel är att OpenAI kan bli dyrt i större skala, särskilt för applikationer med hög volym eller tungt resonemang. Det är också en sluten API-leverantör, vilket innebär att utvecklare har mindre kontroll över modellernas interna delar, hosting och anpassning jämfört med open source- eller egenhostade modeller.

Bäst för: allmänna AI-appar, resonemang, kodning, multimodala arbetsflöden och produktionsredo AI-produkter.

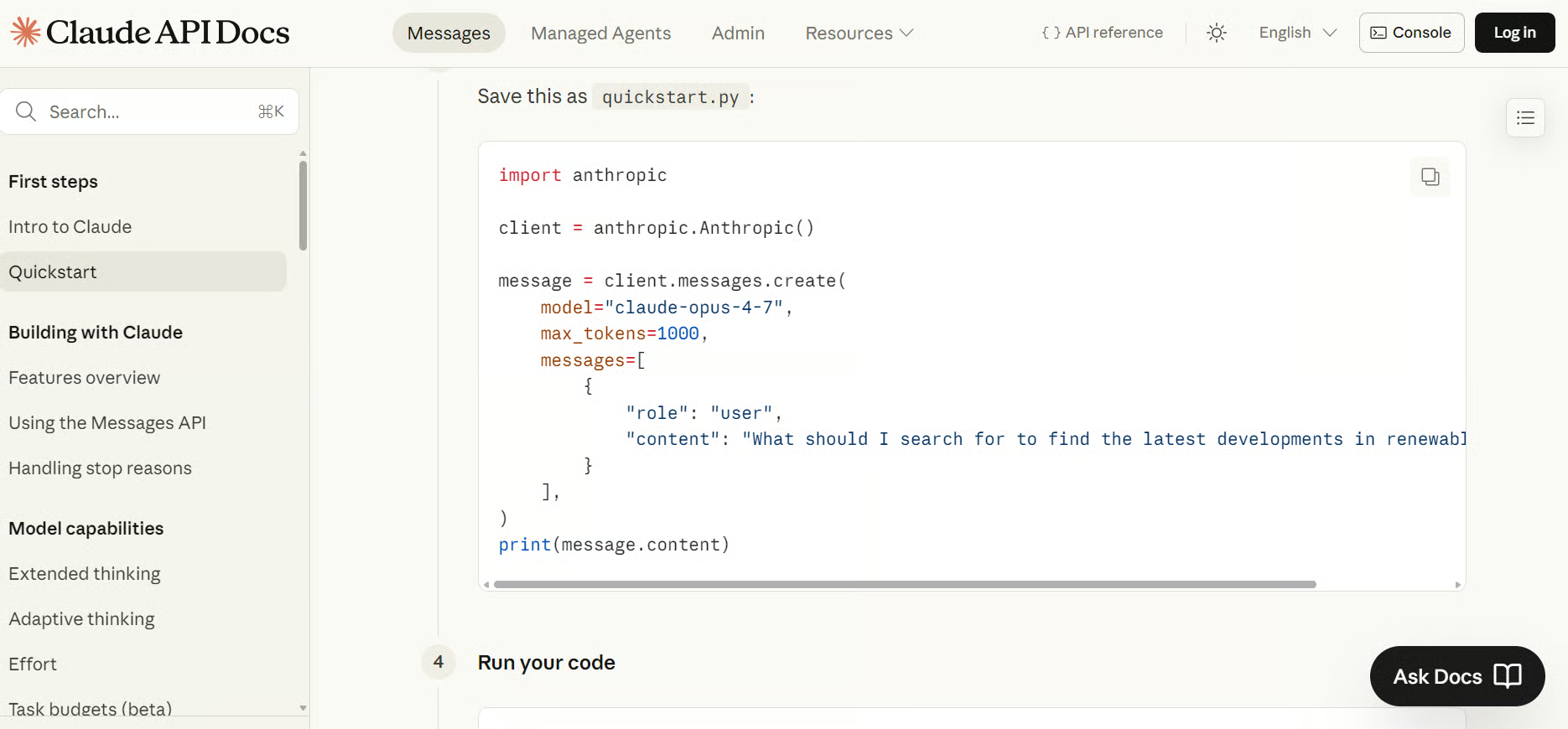

2. Anthropic

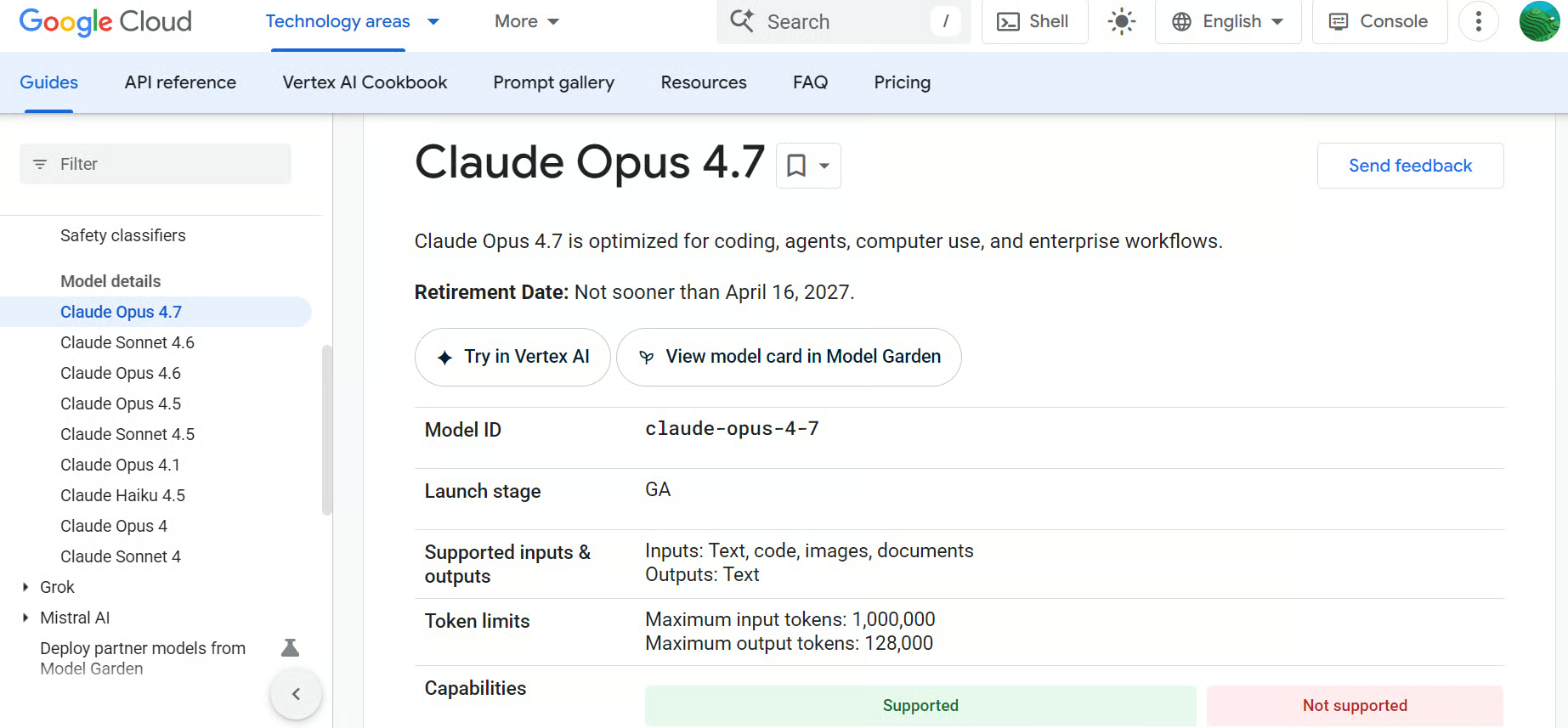

Anthropic tillhandahåller Claude-modellfamiljen via sitt API, t.ex. deras senaste flaggskeppsmodell, Claude Opus 4.7. Claude är utformad för språk, resonemang, analys, kodning, arbete med långa kontexter och agentiska arbetsflöden. Anthropics utvecklarplattform ger team direkt modellåtkomst via API:er, SDK:er och utvecklardokumentation.

Claude är särskilt användbar för applikationer som kräver noggrann instruktionsföljning, hög skrivkvalitet, dokumentanalys och pålitlig hantering av komplexa uppmaningar.

Källa: Kom igång med Claude

En viktig nackdel är kostnaden, särskilt när Claude används för stora dokument, långa kontextpromptar eller applikationer med hög volym. Eftersom Claude nås via ett hostat API har team också begränsad kontroll över var och hur modellen körs.

För integritetskänsliga användningsfall bör utvecklare noggrant granska datahantering, lagring och efterlevnadskrav innan konfidentiella företags- eller kunduppgifter skickas via API:et.

Bäst för: kodningsassistenter, företags-AI, långtidskontextanalys, dokumentflöden och AI-agenter.

För en detaljerad jämförelse av de två AI-jättarna, läs vår guide om Anthropic vs OpenAI.

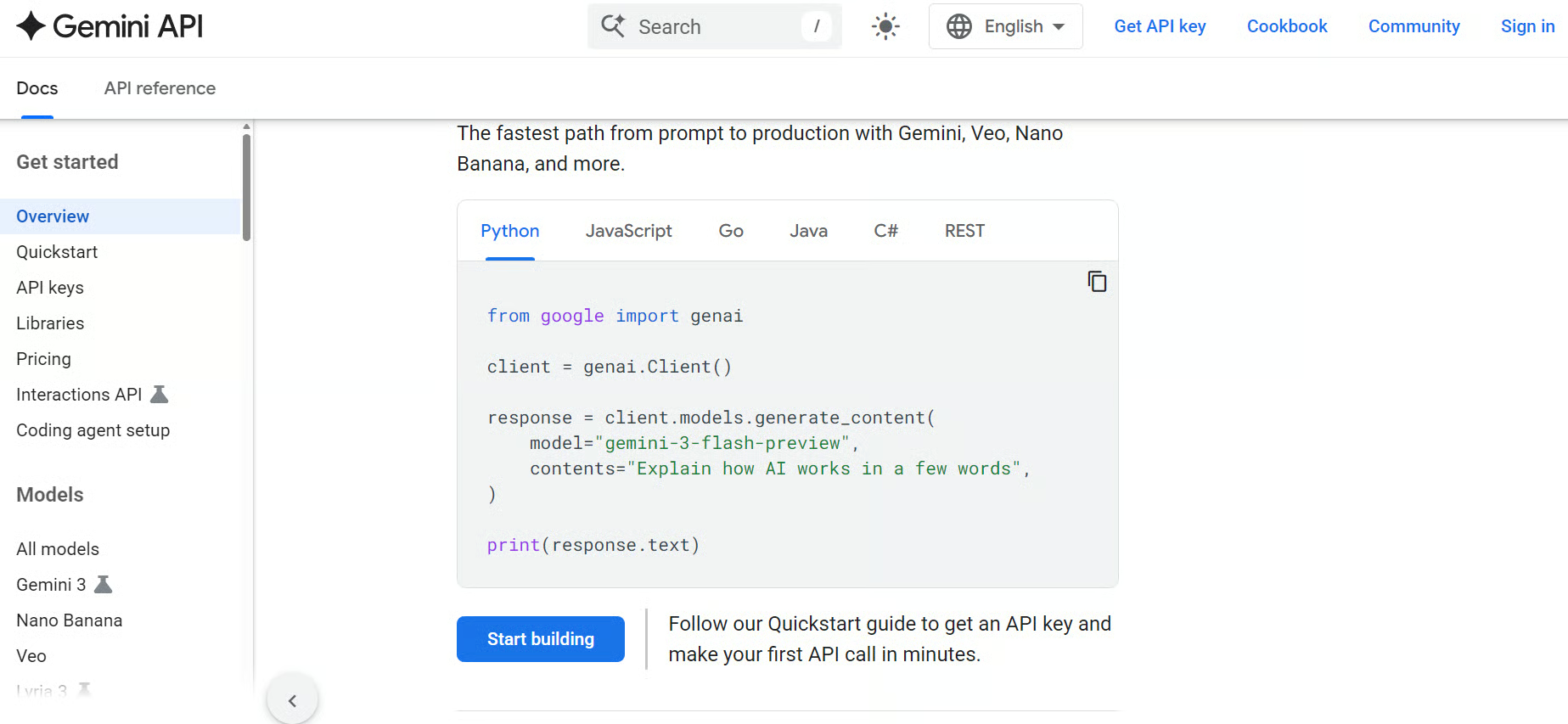

3. Google Gemini

Google Gemini är Googles inbyggda LLM-familj, inklusive Gemini 3.1 Pro, tillgänglig via Gemini API för utvecklare. Gemini API stöder standard-, streaming- och realtids-API:er, med dokumentation för modellinformation, SDK:er, prissättning, installation och API-referenser.

Med Nano Banana 2 för bildgenerering och Veo 3.1 integrerat är Gemini ett starkt alternativ för utvecklare som bygger multimodala applikationer. Det är också ett bra val för AI-assistenter (särskilt de som förlitar sig på sökupplevelser), kodningsverktyg och produkter som ansluter till Googles bredare AI-ekosystem.

Källa: Gemini API

Gemini kan dock upplevas som mer bundet till Googles ekosystem, vilket kanske inte passar team som vill ha en leverantörsneutral uppsättning. Prissättning, modelltillgänglighet och funktionsstöd kan också variera mellan verktyg och regioner.

För integritetskänsliga applikationer bör team granska datahantering, lagring och efterlevnadskrav innan konfidentiella företags- eller kunduppgifter skickas via API:et.

Bäst för: multimodala AI-appar, integration med Googles ekosystem, långtidskontext, kodning och allmänna AI-applikationer.

Open source-LLM-API-leverantörer

Open source-LLM-API-leverantörer ger utvecklare hostad API-åtkomst till open source- och open weight-modeller. I stället för att ladda ner modeller och köra dem på dina egna GPU:er hostar dessa plattformar modellerna och gör dem tillgängliga via enkla API:er.

Dessa leverantörer är användbara för team som vill ha lägre kostnader, större modelflexibilitet, snabbare experimenterande och tillgång till populära öppna modeller som Llama, DeepSeek, Qwen, Mistral, Gemma och andra.

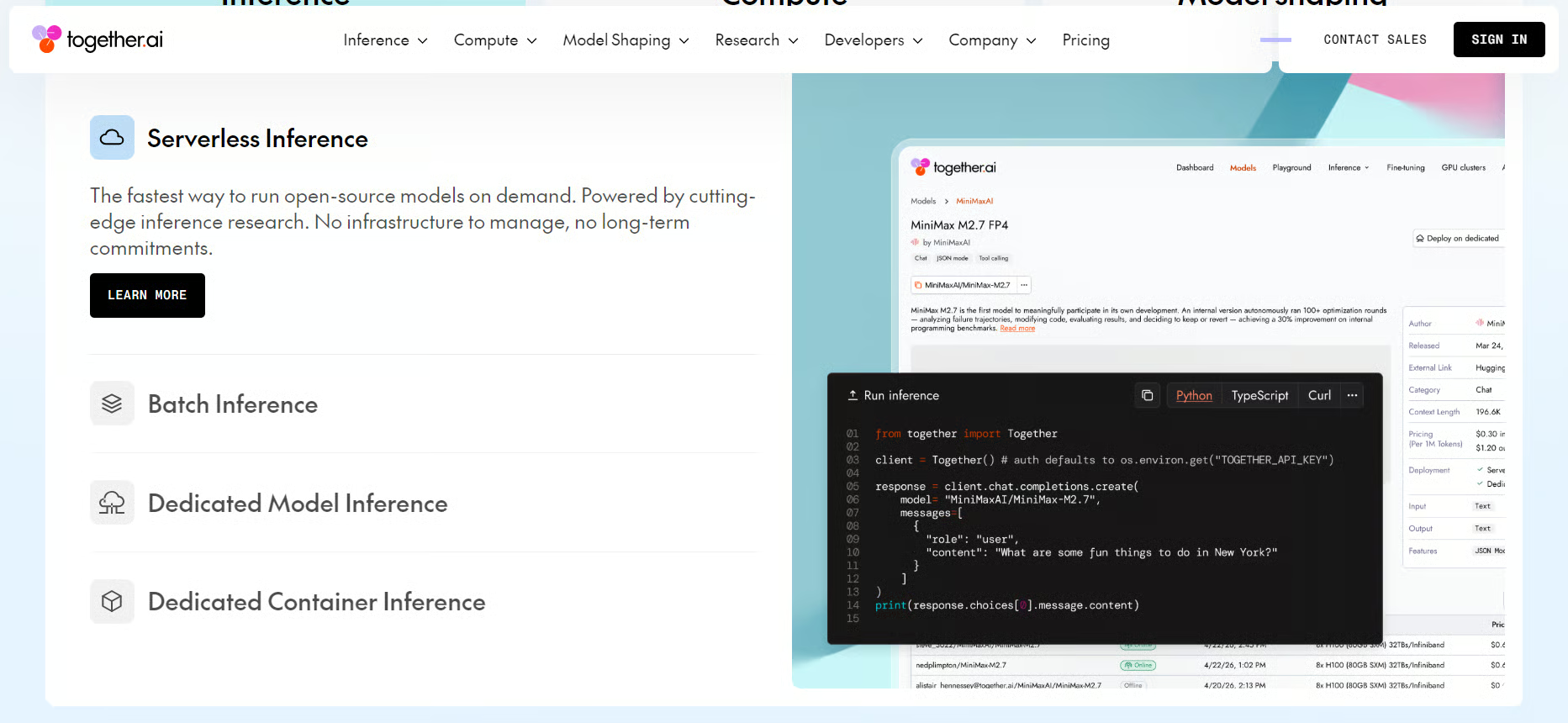

4. Together AI

Together AI tillhandahåller hostad åtkomst till öppen källkod och specialiserade modeller via ett enhetligt API. Deras modellkatalog innehåller 200+ modeller för text, bild, video, kod och ljud, med stöd för serverlös inferens, batchinferens, dedikerade slutpunkter, finjustering, utvärderingar och GPU-kluster.

Together AI är ett starkt alternativ för utvecklare som vill bygga med öppna modeller utan att hantera egen infrastruktur. Det är särskilt användbart för team som testar flera modeller, finjusterar anpassade modeller eller skalar inferensarbetslaster.

Källa: Together AI

Med det sagt kan modellkvalitet, hastighet och tillförlitlighet variera beroende på vald modell. Team kan behöva mer testning, benchmarking och utvärdering innan användning i produktion.

För känsliga arbetslaster bör team kontrollera om de behöver serverlös åtkomst, dedikerade slutpunkter eller privata driftsättningar för att uppfylla säkerhets- och efterlevnadskrav.

Bäst för: inferens av open source-modeller, finjustering, skalbara AI-arbetslaster och experimenterande över många modeller.

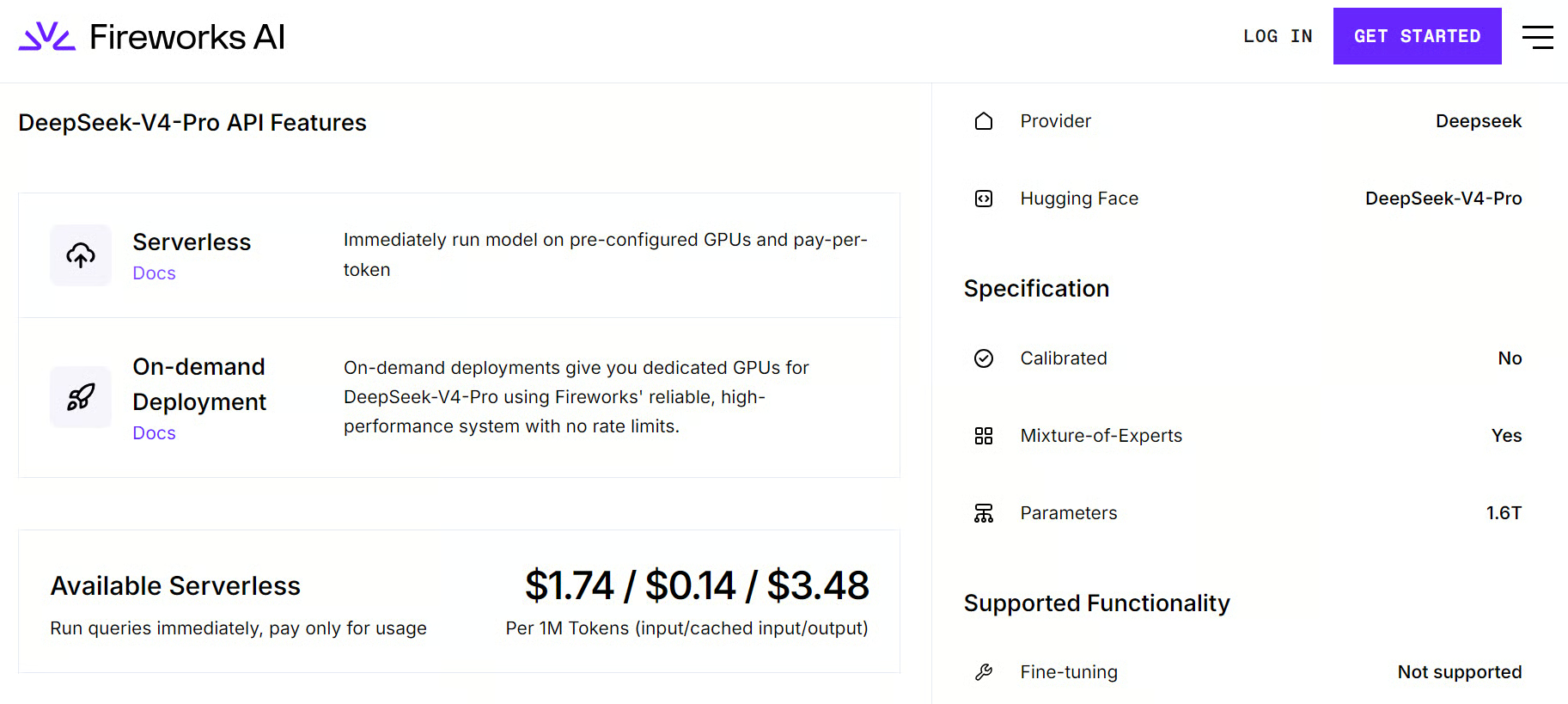

5. Fireworks AI

Fireworks AI fokuserar på snabb inferens för open source-LLM:er och generativa AI-modeller. Plattformen stöder serverlös inferens, on-demand-driftsättningar, finjustering och produktionsredo API:er för populära öppna modeller.

Fireworks AI är ett starkt alternativ för team som vill ha flexibiliteten hos öppna modeller med snabbare inferens och lägre latens. Det är särskilt användbart för konverserande AI, kodningsassistenter, sök, multimodala appar och företags-RAG-system.

Källa: Fireworks AI

En viktig nackdel är att Fireworks AI är mer fokuserat på inferens och driftsättning än att vara en bred, allt-i-ett-plattform för AI-utveckling. Team kan fortfarande behöva separata verktyg för orkestrering, utvärderingar, övervakning eller komplexa agentarbetsflöden.

Team bör också överväga om serverlös inferens räcker för känsliga arbetslaster, eller om dedikerade driftsättningar behövs för starkare kontroll över prestanda och efterlevnad.

Bäst för: snabb inferens av open source-modeller, finjustering, produktionsappar för AI och låg-latensdriftsättningar av öppna modeller.

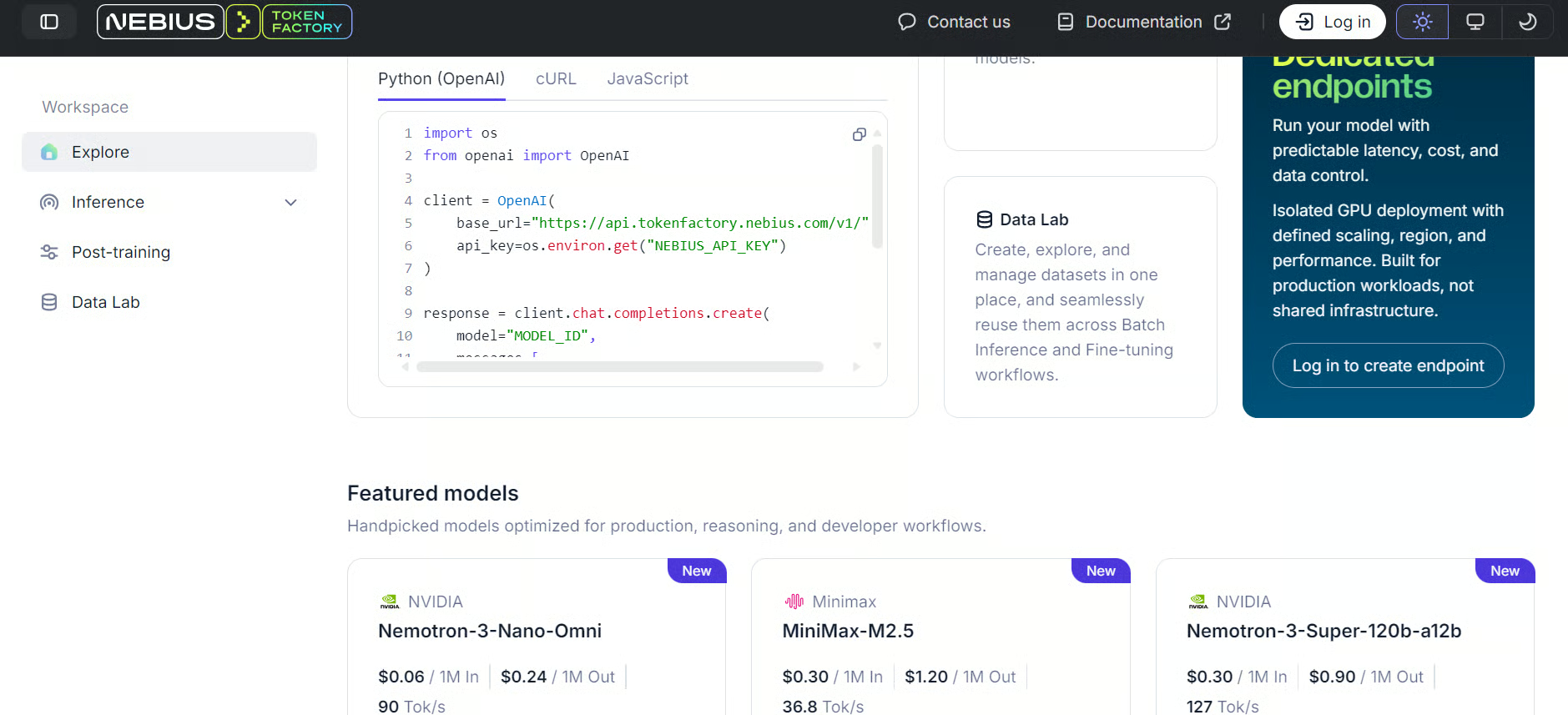

6. Nebius AI

Nebius AI är en AI-molnleverantör byggd för GPU-stödda AI-arbetslaster, hostad inferens, modellservering och skalbar AI-infrastruktur. Deras Token Factory-inferenstjänst stöder öppna modeller via ett OpenAI-kompatibelt API, med alternativ för serverlös inferens, finjustering och dedikerad AI-molninfrastruktur.

Nebius AI är ett starkt alternativ för team som vill ha mer infrastrukturkontroll än en enkel API-leverantör erbjuder, samtidigt som de undviker komplexiteten i att helt hantera egna GPU-miljöer. Det är särskilt användbart för team som bygger med öppna och anpassade modeller som behöver skalbar beräkningskraft, snabb inferens och produktionsredo driftsättningsalternativ.

Källa: Nebius Token Factory

Nebius Token Factory erbjuder två inferenshastigheter: Fast och Base. Fast är utformad för interaktiva arbetslaster med lägre latens, medan Base är utformad för mer kostnadseffektiv inferens med hög volym eller bakgrundsprocesser.

Nebius är utan tvekan mer infrastrukturfokuserat än enkla plug-and-play-LLM-API-plattformar. Det innebär att team kan behöva mer kunskap om moln, driftsättning och arbetslastshantering för att få ut mest värde.

För känsliga arbetslaster bör team överväga om hanterad inferens räcker, eller om dedikerad infrastruktur behövs för starkare kontroll över säkerhet, efterlevnad och datastyrning.

Bäst för: AI-molninfrastruktur, hostad inferens, GPU-stödda arbetslaster, snabb inferens och team som vill ha mer kontroll över driftsättning.

LLM-routingleverantörer

LLM-routingleverantörer ger utvecklare åtkomst till flera modeller och leverantörer via ett API. I stället för att integrera separat med OpenAI, Anthropic, Google, Mistral, DeepSeek och andra leverantörer kan utvecklare använda ett routinglager för att hantera modellåtkomst från ett och samma ställe.

Dessa plattformar är användbara för modelljämförelser, fallback-routing, kostnadsoptimering, leverantörsredundans, observabilitet och för att växla mellan modeller utan att skriva om applikationen.

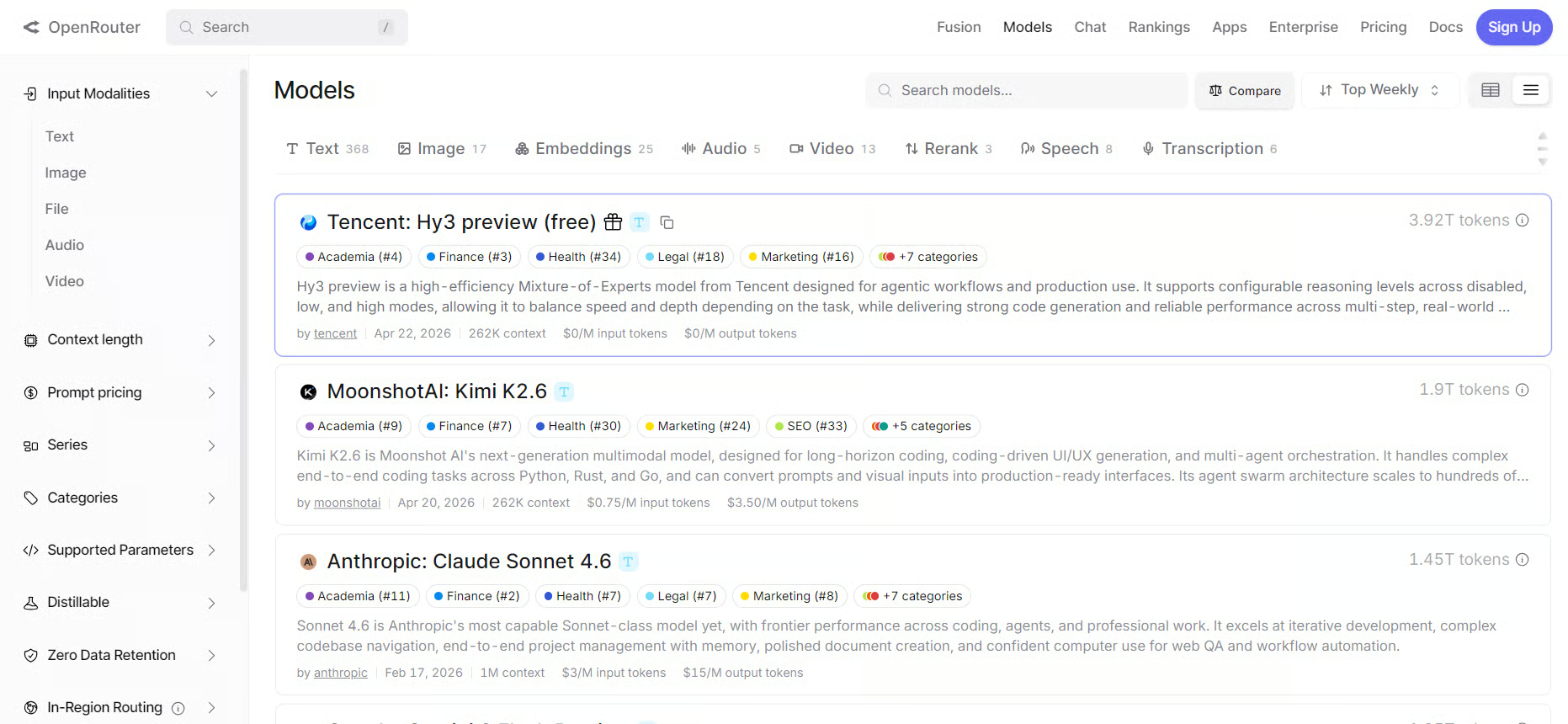

7. OpenRouter

OpenRouter är en av de mest populära LLM-routingleverantörerna. Den ger utvecklare åtkomst till många modeller via ett enda OpenAI-kompatibelt API, vilket gör det enklare att arbeta med olika leverantörer via en integration.

Som vi har behandlat i flera handledningar är OpenRouter ett starkt alternativ för utvecklare som vill jämföra modeller, testa nya versioner snabbt, dirigera förfrågningar över leverantörer eller undvika inlåsning till en modellleverantör.

Källa: OpenRouter

En nackdel är att OpenRouter lägger till ytterligare ett lager mellan din applikation och modellleverantören. Detta kan introducera extra beroende, varierande latens och leverantörsspecifikt beteende som ändå behöver testas.

För produktionsarbetslaster bör team granska routinginställningar, fallback-beteende, leverantörspreferenser och integritetskontroller innan känslig eller affärskritisk trafik skickas via plattformen.

Bäst för: multi-modellappar, modelljämförelser, fallback-routing, leverantörsflexibilitet och snabb experimentering.

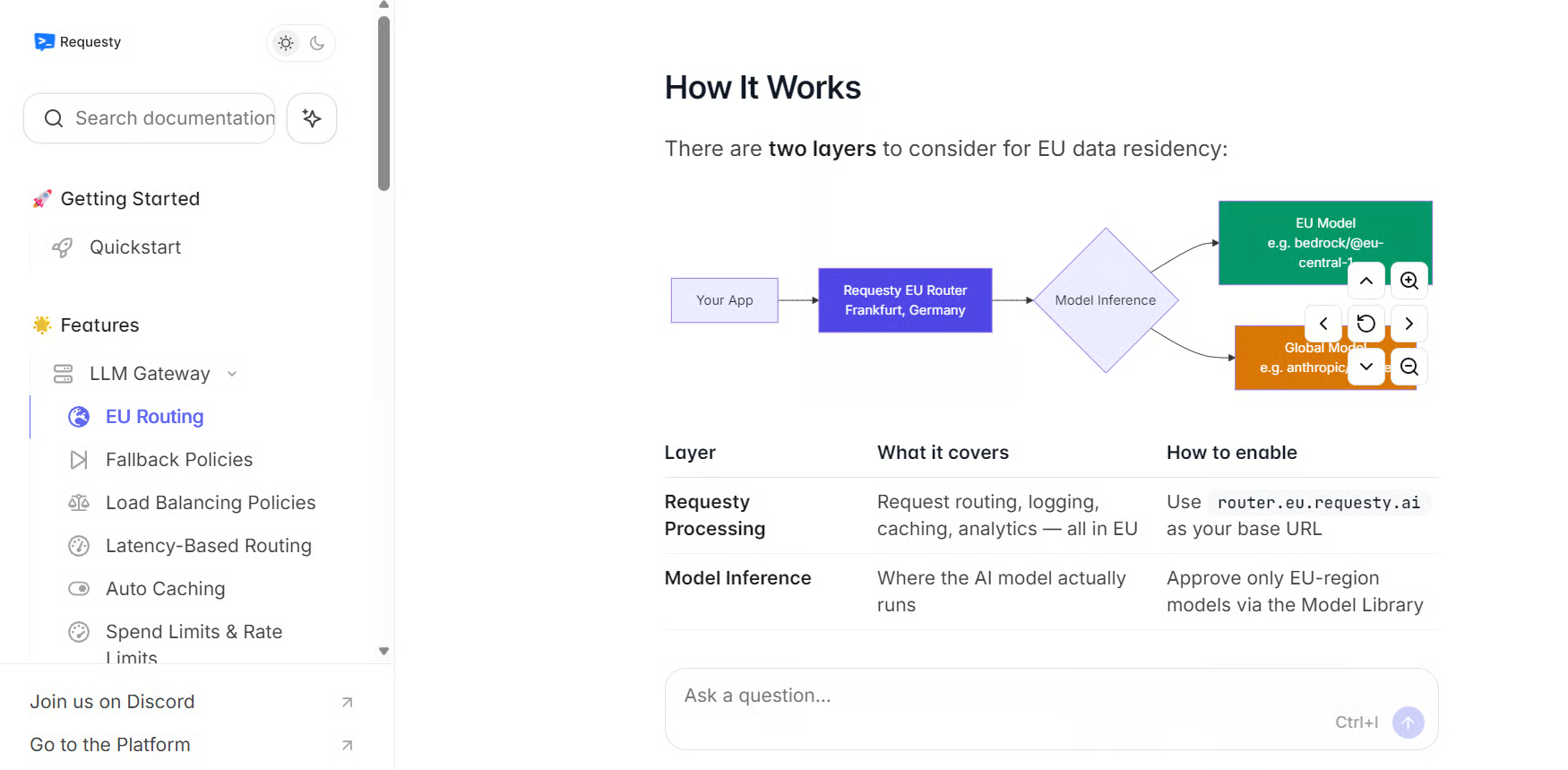

8. Requesty.ai

Requesty.ai är en LLM-routing- och gatewayplattform som hjälper team att ansluta till flera LLM-leverantörer via ett OpenAI-kompatibelt API. Den stöder 400+ modeller, med funktioner för routing, fallback, cachning, kostnadshantering, observabilitet och styrning.

Requesty.ai är ett starkt alternativ för team som bygger produktionsklara AI-applikationer som förlitar sig på mer än en modellleverantör. Det är särskilt användbart för att hantera routingpolicys, spåra användning, kontrollera kostnader och förbättra tillförlitlighet när leverantörer fallerar, får timeout eller når ransoneringsgränser.

Källa: Requesty AI-dokumentation

Liksom för OpenRouter är den största nackdelen att Requesty.ai lägger till ett ytterligare gatewaylager i applikationsstacken. Team behöver konfigurera routing, fallback, loggning och styrning noggrant för att undvika oväntade kostnader, latens eller leverantörsbeteenden.

För känsliga arbetslaster inkluderar Requesty.ai kontroller som PII-detektering, sanering, innehållsräcken, granskningsloggar och styrningsfunktioner, men team bör ändå avgöra vilken data som får passera genom gatewayen och hur loggar ska hanteras.

Bäst för: LLM-routing, kostnadskontroll, observabilitet, leverantörs-fallback, styrning och produktionsklara AI-gatewayarbetsflöden.

Molnbaserade LLM-leverantörer

Molnbaserade LLM-leverantörer är stora molnplattformar som ger utvecklare och företag hanterad åtkomst till grundmodeller. Dessa plattformar stöder ofta sina egna modeller såväl som modeller från tredjepartsleverantörer.

De är särskilt användbara för företag som redan använder molninfrastruktur och behöver säkerhet, styrning, efterlevnad, dataintegration, driftsättningskontroller och modellhantering på ett och samma ställe.

9. Google Vertex AI

Google Vertex AI är Google Clouds plattform för maskininlärning och generativ AI. Den ger utvecklare och företag åtkomst till Gemini-modeller, Model Garden, agentverktyg och hanterad infrastruktur för att bygga, driftsätta och hantera AI-applikationer.

Vertex AI stöder också ledande partners och öppna modeller via Model Garden, inklusive Anthropic Claude, xAI Grok, Mistral AI-modeller och open source-modeller som GLM 5 och Gemma 4, utöver Googles egna Gemini-modeller.

Källa: Generativ AI på Vertex AI

Google Vertex AI är ett starkt alternativ för team som redan använder Google Cloud och vill ha molnnativ driftsättning av modeller, styrning, säkerhetskontroller och integration med Googles bredare data- och AI-ekosystem.

Å andra sidan kan Vertex AI vara mer komplext än att använda ett enkelt modell-API. Team kan behöva erfarenhet av Google Cloud för att hantera projekt, behörigheter, fakturering, driftsättningsinställningar och integrationer på rätt sätt.

För känsliga arbetslaster är Vertex AI användbart för team som behöver åtkomstkontroller på molnnivå, styrning och hanterad infrastruktur, men beslut kring loggning, dataåtkomst och driftsättningsregioner kräver fortfarande noggrann granskning.

Bäst för: Google Cloud-användare, åtkomst till Gemini, företags-AI, multimodala arbetsflöden och molnnativ driftsättning av modeller.

10. Amazon Bedrock

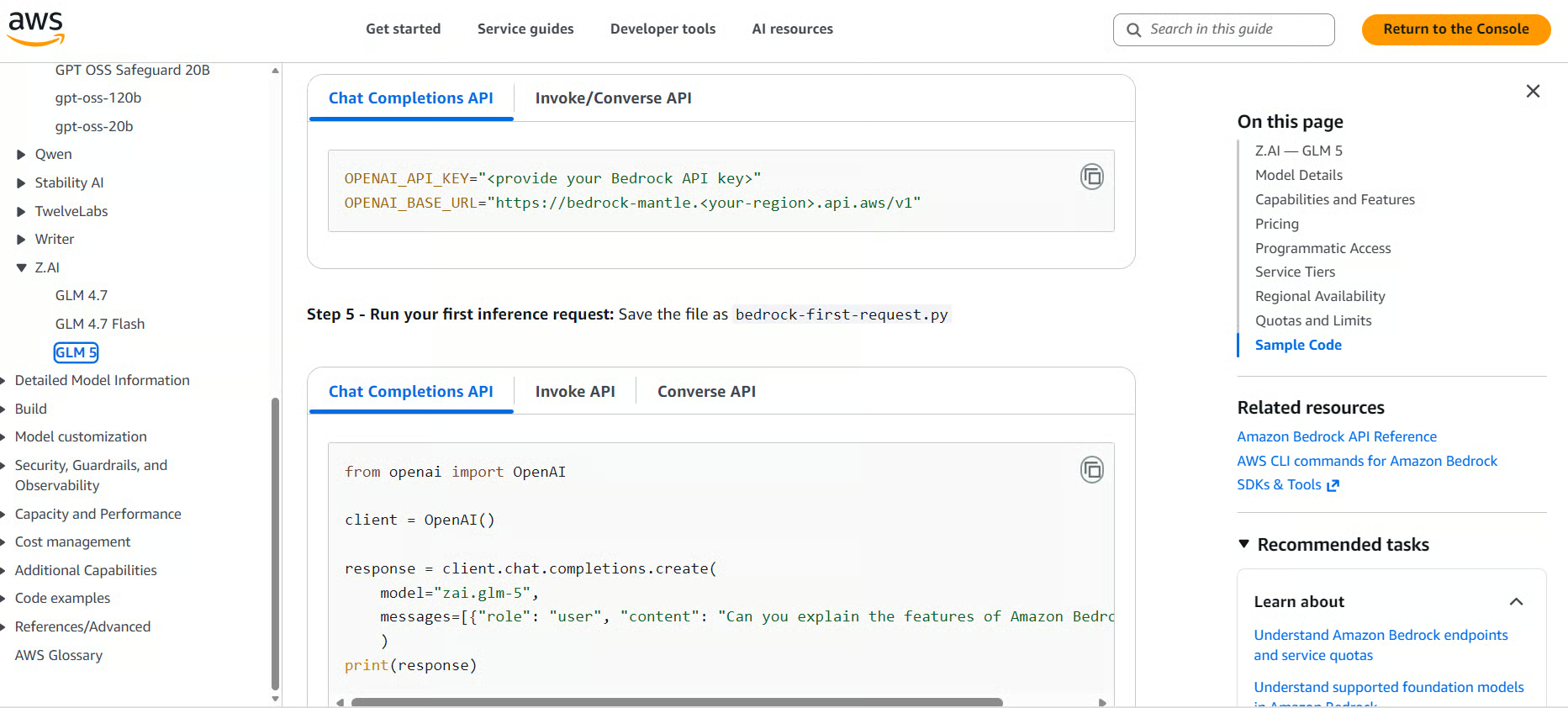

Amazon Bedrock är AWS hanterade plattform för generativ AI. Den ger utvecklare åtkomst till grundmodeller från Amazon och tredjepartsleverantörer via en hanterad AWS-tjänst.

Bedrock stöder modeller från leverantörer som Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek och andra, vilket gör den användbar för team som vill ha modellval inom AWS-ekosystemet.

Amazon Bedrock är ett starkt val för företag som redan bygger på AWS eftersom den samlar modellåtkomst, molninfrastruktur, säkerhetskontroller och företagsintegration i en plattform.

Källa: Amazon Bedrock

En viktig nackdel är att Bedrock kan vara mer komplext än ett enkelt LLM-API. Team kan behöva AWS-erfarenhet för att hantera behörigheter, regioner, modellåtkomst, prissättning, nätverk och driftsättningsinställningar på rätt sätt.

För känsliga arbetslaster är Bedrock användbart eftersom promptar och utdata inte används för att träna basmodeller eller delas med modellleverantörer, och team kan använda AWS-kontroller som kryptering, IAM och PrivateLink.

Bäst för: AWS-användare, företags-AI, hanterad åtkomst till grundmodeller, säkerhetsfokuserade driftsättningar och molnnativa generativa AI-applikationer.

Jämförelsetabell för LLM-API-leverantörer

Tabellen nedan jämför de främsta LLM-API-leverantörerna baserat på deras viktigaste fördelar och huvudsakliga nackdelar.

|

Leverantör |

Viktigaste fördelar |

Huvudsakliga nackdelar |

|

OpenAI |

Stark modellkvalitet, mogna API:er, multimodala verktyg, strukturerade utdata, embeddingar, tal, bildgenerering och agentiska arbetsflöden |

Kan bli dyrt i stor skala och erbjuder mindre kontroll än open source- eller egenhostade modeller |

|

Anthropic |

Hög skrivkvalitet, noggrann instruktionsföljning, resonemang, kodning och stöd för långa kontexter |

Kostnaderna kan öka med stora dokument eller hög användningsvolym, och team har begränsad kontroll över hosting och modellernas interna delar |

|

Google Gemini |

Starka multimodala funktioner, realtids-API:er, stöd för långa kontexter och nära integration med Googles AI-ekosystem |

Kan upplevas som bundet till Googles ekosystem, och pris, tillgänglighet och funktioner kan variera efter verktyg eller region |

|

Together AI |

Hostad åtkomst till många öppna och specialiserade modeller, med serverlös inferens, dedikerade slutpunkter, finjustering, utvärderingar och GPU-infrastruktur |

Modellkvalitet, hastighet och tillförlitlighet kan variera beroende på vald modell |

|

Fireworks AI |

Snabb inferens, låg latens, serverlös åtkomst, on-demand-driftsättningar och produktionsredo API:er för öppna modeller |

Mer fokuserad på inferens och driftsättning än att vara en fullständig allt-i-ett-plattform för AI-utveckling |

|

Nebius AI |

GPU-stödd infrastruktur, hostad inferens, OpenAI-kompatibelt API och hastighetsnivåer som Fast och Base |

Mer infrastrukturfokuserad, så team kan behöva starkare kunskap om moln och driftsättning |

|

OpenRouter |

Åtkomst till många modeller via ett OpenAI-kompatibelt API, med enklare leverantörsbyte och fallback-alternativ |

Lägger till ytterligare ett lager mellan appen och leverantören, vilket kan påverka latens, tillförlitlighet eller felsökning |

|

Requesty.ai |

Ett API för flera leverantörer, med routing, fallback, cachning, kostnadsspårning, observabilitet och styrningsfunktioner |

Kräver noggrann konfiguration av routing, loggning, fallback och kostnadskontroller för att undvika oväntat beteende |

|

Google Vertex AI |

Hanterad åtkomst till Gemini, Anthropic Claude, xAI Grok, Mistral AI och öppna modeller via Model Garden, plus säkerhets- och styrningsverktyg i Google Cloud |

Mer komplext än ett enkelt API och kan kräva erfarenhet av Google Cloud |

|

Amazon Bedrock |

Hanterad åtkomst till modeller från Amazon och tredjepartsleverantörer som Anthropic, Meta, Mistral AI, Cohere och andra inom AWS |

Mer komplext än ett grundläggande LLM-API, särskilt kring behörigheter, regioner, prissättning och modellåtkomst |

Att välja den bästa LLM-API-leverantören för ditt användningsfall

Att välja rätt LLM-API-leverantör beror på tre faktorer:

- Vad du bygger

- Hur mycket kontroll du behöver

- Hur mycket du är villig att spendera

För nystartade bolag och små team är open source-LLM-API-leverantörer ofta den bästa startpunkten. Plattformar som Together AI, Fireworks AI och Nebius AI ger dig tillgång till kraftfulla öppna modeller utan att du själv behöver hantera GPU:er eller infrastruktur. De kan vara snabbare, billigare och mer flexibla för experimenterande och tidig produktutveckling.

Om du vill testa olika modeller snabbt är LLM-routingleverantörer ett starkt alternativ. Verktyg som OpenRouter och Requesty.ai låter dig jämföra slutna och öppna modeller via ett API, hantera fallback och byta leverantör utan att skriva om din applikation.

För arbetsflöden där modellkvalitet är viktigare än kostnad är inbyggda leverantörer som OpenAI och Anthropic fortfarande bland de starkaste valen. De är särskilt användbara för produktionsklara AI-assistenter, kodningsverktyg, arbetsflöden med tungt resonemang, multimodala appar och agentiska system där tillförlitlighet och modellprestanda är avgörande.

Slutligen, om ditt företag redan körs på AWS eller Google Cloud är det ofta rimligt att stanna inom det molnekosystemet. Amazon Bedrock och Google Vertex AI ger dig hanterad modellåtkomst, säkerhetskontroller, styrning och integration med de verktyg som ditt team redan använder.

Avslutande tankar

För tekniskt arbete, kodningsassistenter och vibe-kodningsverktyg skulle jag inte överexperimentera i början. Enligt min erfarenhet är OpenAI och Anthropic oftast de tryggaste valen tack vare stark kodning, resonemang och utvecklarverktyg.

Open source-LLM-API-leverantörer och LLM-routingleverantörer är starka alternativ för mer avancerad experimentering.

Stora moln-LLM-leverantörer är vanligtvis mest vettiga i en företagsmiljö. Välj i så fall den vars ekosystem du redan använder.

LLM-API-leverantörer: Vanliga frågor

Vad är en LLM-API-leverantör?

Ett företag eller en plattform som hostar stora språkmodeller och exponerar dem via ett API, så att utvecklare kan skicka förfrågningar och ta emot AI-genererade svar utan att själva hantera någon GPU- eller inferensinfrastruktur.

Vad är skillnaden mellan en inbyggd LLM-leverantör och en molnbaserad LLM-leverantör?

Inbyggda leverantörer (som OpenAI och Anthropic) bygger och tillhandahåller sina egna modeller direkt. Molnleverantörer (som AWS Bedrock och Google Vertex AI) erbjuder hanterad åtkomst till flera tredjepartsmodeller, paketerat i ett befintligt molnekosystem med säkerhets- och styrningsverktyg för företag.

När ska jag använda en LLM-routingleverantör som OpenRouter eller Requesty.ai?

När du behöver arbeta med mer än en modell eller leverantör, vill ha automatisk fallback om en leverantör går ner, eller behöver jämföra modeller och kontrollera kostnader, allt via en enda API-integration.

Är open source-LLM-API-leverantörer mindre kapabla än inbyggda leverantörer som OpenAI?

Inte nödvändigtvis; det beror på uppgiften. Plattformar som Together AI och Fireworks AI hostar toppmoderna öppna modeller som Llama, DeepSeek och Mistral, vilka kan konkurrera med slutna modeller, ofta till avsevärt lägre kostnad.

Vilken LLM-API-leverantör är bäst för företag med strikta efterlevnadskrav?

Amazon Bedrock och Google Vertex AI är vanligtvis de starkaste valen, eftersom de erbjuder molnnativa säkerhetskontroller, IAM, kryptering, granskningsloggning och styrningsfunktioner som integreras med befintlig företagsinfrastruktur.