Cursus

Les fournisseurs d’API de grands modèles de langage (LLM) donnent aux développeurs accès à des modèles d’IA puissants sans avoir à gérer de GPU, de déploiement, de mise à l’échelle ni d’infrastructure d’inférence. Plutôt que d’héberger un modèle en interne, ils se connectent à une API, choisissent un modèle, envoient une requête et reçoivent une réponse.

Dans cet article, nous passons en revue les 10 meilleurs fournisseurs d’API LLM selon la qualité des modèles, l’expérience développeur, les tarifs, la scalabilité, le support de l’écosystème et la préparation à la production. Pour chaque fournisseur, nous indiquons ses meilleurs cas d’usage, ses principaux atouts et les limites à prendre en compte.

Ce guide classe les meilleurs fournisseurs d’API LLM en quatre catégories :

- Fournisseurs LLM natifs

- Fournisseurs d’API LLM open source

- Fournisseurs d’acheminement LLM

- Fournisseurs LLM cloud

Ingénieur IA associé pour les scientifiques de données

Fournisseurs LLM natifs

Les fournisseurs LLM natifs conçoivent, entraînent et servent leurs propres familles de modèles via des APIs. Ils constituent souvent la meilleure option pour les développeurs qui recherchent une haute qualité de modèle, une documentation fiable, des capacités de raisonnement avancées, le multimodal et des outils prêts pour la production.

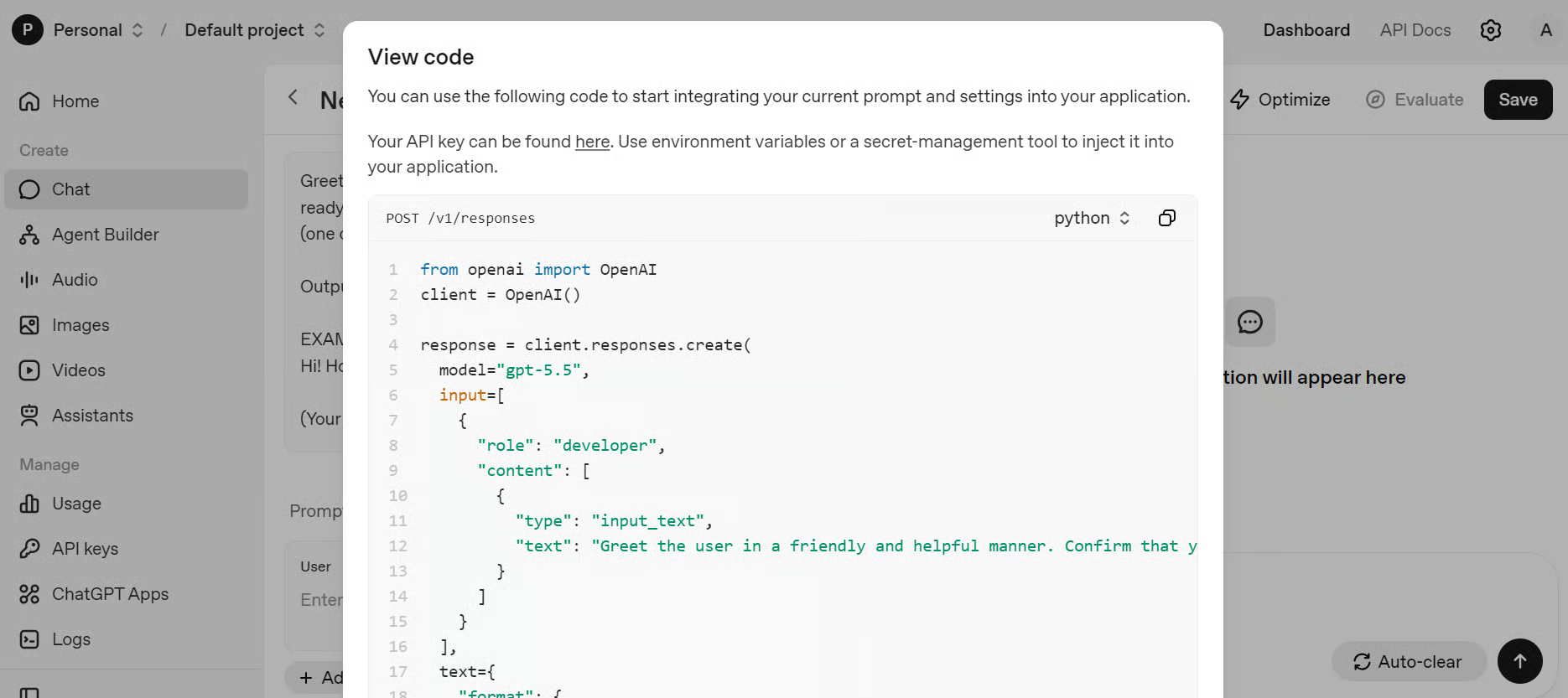

1. OpenAI

OpenAI est l’un des fournisseurs d’API LLM les plus répandus. Sa API Platform donne accès à :

- Des modèles de raisonnement de pointe comme GPT-5.5

- La génération et la traduction vocales en temps réel via GPT-Realtime-2

- La génération d’images via le modèle GPT-Images-2.0

- Le développement d’agents avec le OpenAI Agents SDK

Son API prend en charge le streaming, les interfaces temps réel et des sorties structurées.

OpenAI est un excellent choix pour créer des assistants IA, des outils de développement, des agents de support client, des copilotes internes, des apps multimodales et des systèmes à base d’agents.

Source : OpenAI

Un inconvénient : OpenAI peut devenir coûteux à grande échelle, surtout pour des applications volumineuses ou très axées sur le raisonnement. C’est aussi un fournisseur fermé, ce qui laisse moins de contrôle sur les internes du modèle, l’hébergement et la personnalisation, comparé aux modèles open source ou auto-hébergés.

Idéal pour : applications IA généralistes, raisonnement, code, workflows multimodaux et produits IA prêts pour la production.

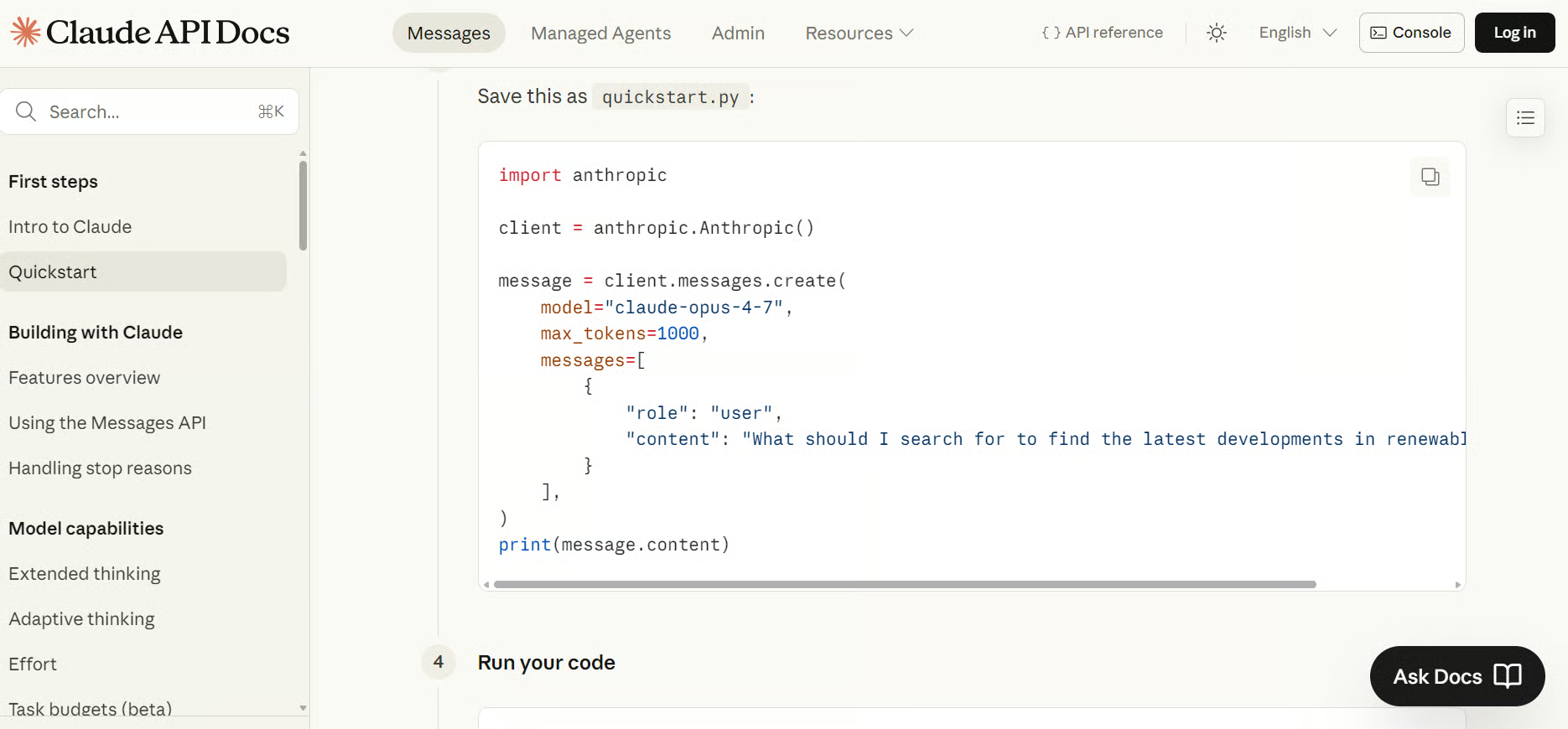

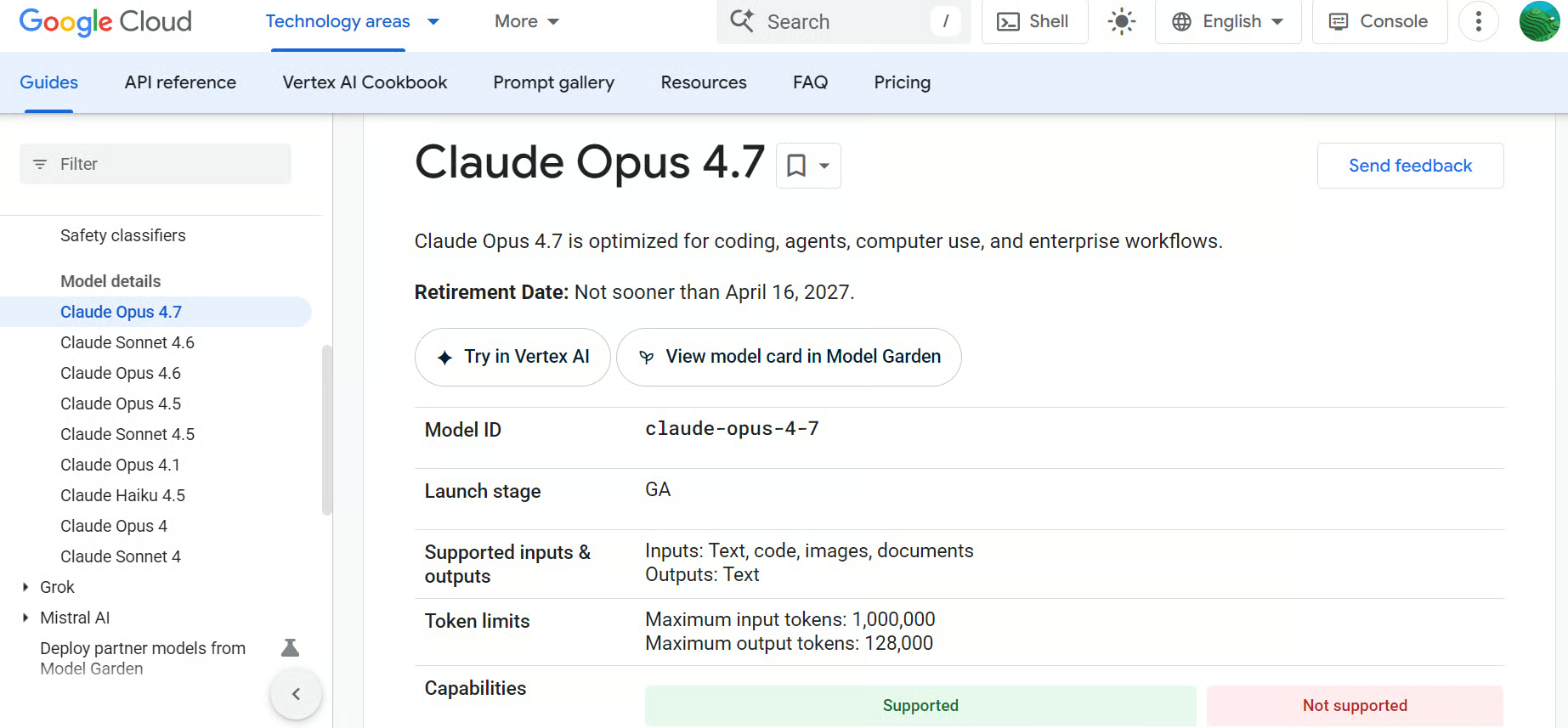

2. Anthropic

Anthropic propose la famille de modèles Claude via son API, par exemple son dernier modèle phare, Claude Opus 4.7. Claude est conçu pour la langue, le raisonnement, l’analyse, le code, le long contexte et les workflows agentiques. La plateforme développeur d’Anthropic offre un accès direct via APIs, SDKs et documentation.

Claude est particulièrement utile pour les applications nécessitant un suivi d’instructions rigoureux, une excellente qualité rédactionnelle, l’analyse documentaire et une gestion fiable de prompts complexes.

Source : Get started with Claude

Un inconvénient majeur reste le coût, notamment avec de gros documents, des prompts en long contexte ou des usages intensifs. Comme l’accès à Claude se fait via une API hébergée, les équipes ont aussi un contrôle limité sur le lieu et la manière d’exécution du modèle.

Pour les cas sensibles, il faut examiner de près la gestion des données, la rétention et les exigences de conformité avant d’envoyer des données confidentielles via l’API.

Idéal pour : assistants de code, IA d’entreprise, analyse en long contexte, workflows documentaires et agents IA.

Pour une comparaison détaillée des deux géants, consultez notre guide Anthropic vs OpenAI.

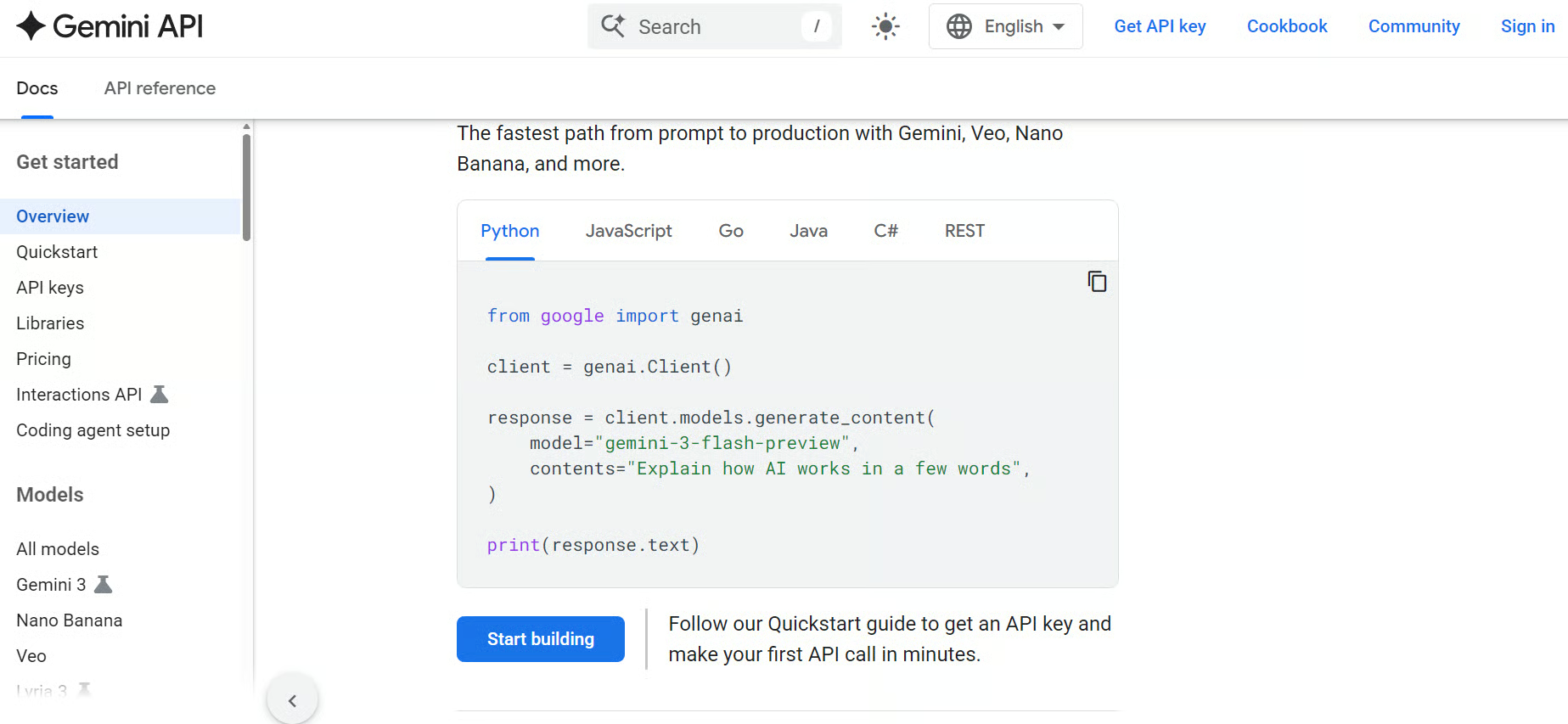

3. Google Gemini

Google Gemini est la famille LLM native de Google, dont Gemini 3.1 Pro, disponible via l’API Gemini pour les développeurs. L’API prend en charge des interfaces standard, en streaming et temps réel, avec documentation sur les modèles, SDKs, tarifs, configuration et références d’API.

Avec Nano Banana 2 pour la génération d’images et Veo 3.1 intégrés, Gemini est une option solide pour créer des applications multimodales. C’est aussi un bon choix pour des assistants IA (notamment adossés à la recherche), des outils de code et des produits connectés au large écosystème IA de Google.

Source : Gemini API

En revanche, Gemini peut sembler plus lié à l’écosystème Google, ce qui ne convient pas aux équipes souhaitant rester agnostiques. Les tarifs, la disponibilité et les fonctionnalités peuvent aussi varier selon les outils et les régions.

Pour les applications sensibles, examinez la gestion des données, la rétention et les exigences de conformité avant d’envoyer des informations confidentielles via l’API.

Idéal pour : apps IA multimodales, intégration à l’écosystème Google, longs contextes, code et applications IA généralistes.

Fournisseurs d’API LLM open source

Ces fournisseurs offrent un accès API hébergé à des modèles open source et open weight. Au lieu de télécharger et d’exécuter les modèles sur vos propres GPU, ces plateformes les hébergent et les exposent via des APIs simples.

Ils sont utiles si vous cherchez des coûts moindres, plus de flexibilité, une expérimentation rapide et l’accès à des modèles populaires comme Llama, DeepSeek, Qwen, Mistral, Gemma et d’autres.

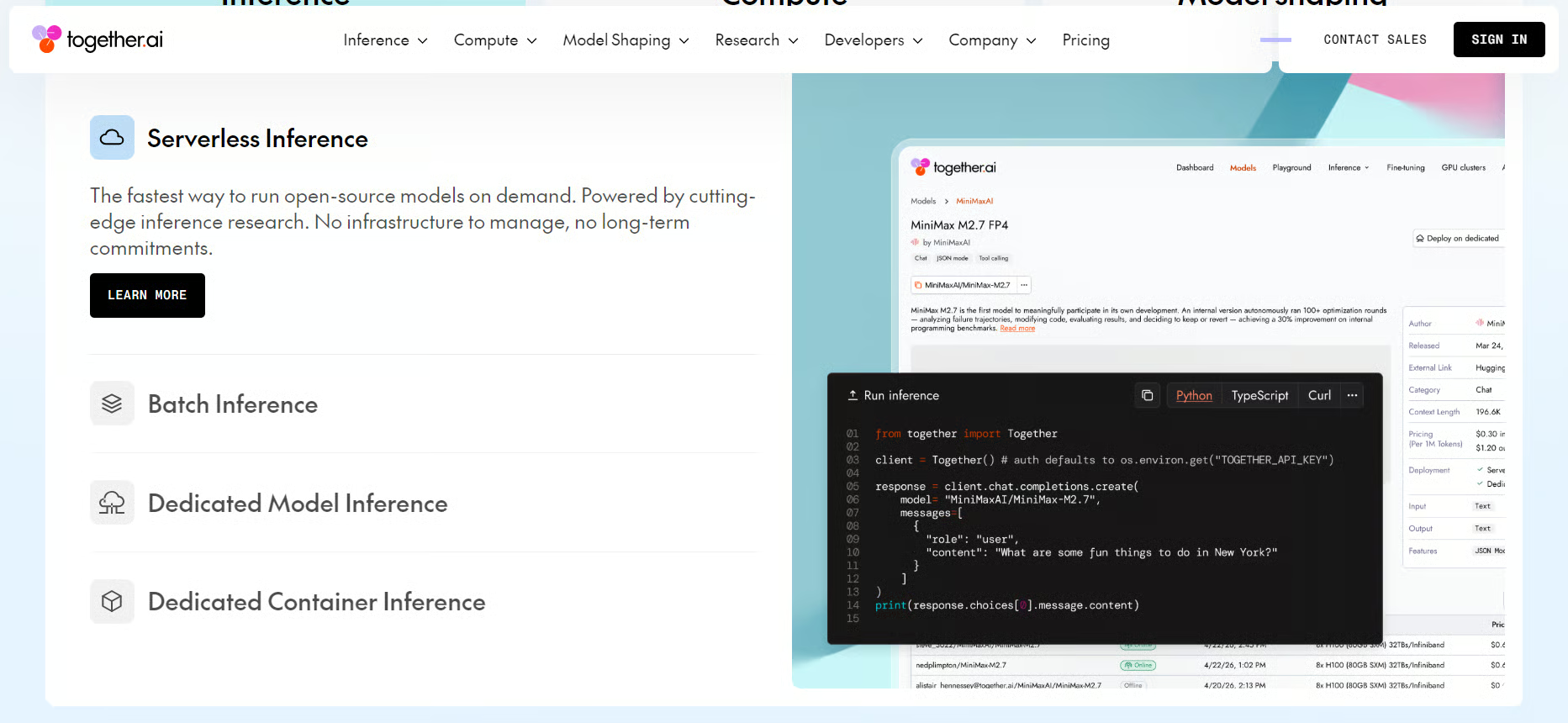

4. Together AI

Together AI propose un accès hébergé à des modèles open source et spécialisés via une API unifiée. Son catalogue compte plus de 200 modèles pour le texte, l’image, la vidéo, le code et l’audio, avec prise en charge de l’inférence serverless, par lots, d’endpoints dédiés, du fine-tuning, des évaluations et de clusters GPU.

Together AI est une bonne option si vous souhaitez utiliser des modèles ouverts sans gérer votre propre infrastructure. Particulièrement adapté pour tester plusieurs modèles, affiner des modèles personnalisés ou mettre à l’échelle les charges d’inférence.

Source : Together AI

Cela dit, la qualité, la vitesse et la fiabilité peuvent varier selon le modèle choisi. Il faudra souvent plus de tests, de benchmarks et d’évaluations avant un usage en production.

Pour des charges sensibles, vérifiez si l’inférence serverless suffit ou s’il faut des endpoints dédiés, voire des déploiements privés, pour répondre à vos exigences de sécurité et de conformité.

Idéal pour : inférence de modèles open source, fine-tuning, charges IA à grande échelle et expérimentation multi-modèles.

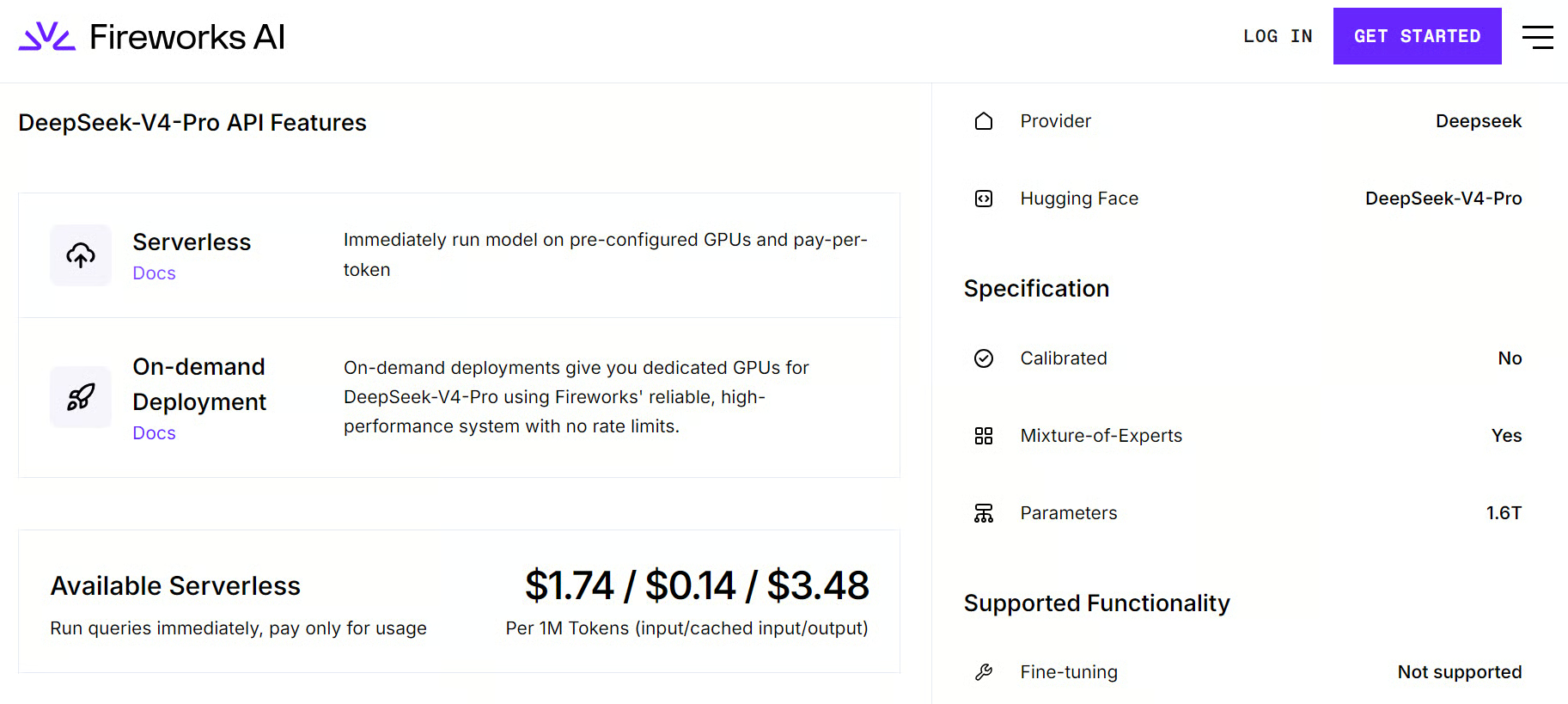

5. Fireworks AI

Fireworks AI met l’accent sur une inférence rapide pour les LLM et modèles génératifs open source. Sa plateforme prend en charge l’inférence serverless, les déploiements à la demande, le fine-tuning et des APIs prêtes pour la production pour les modèles ouverts populaires.

Fireworks AI convient aux équipes qui veulent la flexibilité des modèles ouverts avec une inférence plus rapide et une latence réduite. Particulièrement pertinent pour les IA conversationnelles, assistants de code, recherche, apps multimodales et systèmes RAG d’entreprise.

Source : Fireworks AI

L’inconvénient principal est que Fireworks AI se concentre davantage sur l’inférence et le déploiement que sur une plateforme IA tout-en-un. Il peut donc falloir des outils séparés pour l’orchestration, les évaluations, le monitoring ou des workflows d’agents complexes.

Demandez-vous également si l’inférence serverless suffit pour des charges sensibles, ou si des déploiements dédiés sont nécessaires pour mieux contrôler performances et conformité.

Idéal pour : inférence rapide de modèles open source, fine-tuning, apps IA en production et déploiements à faible latence.

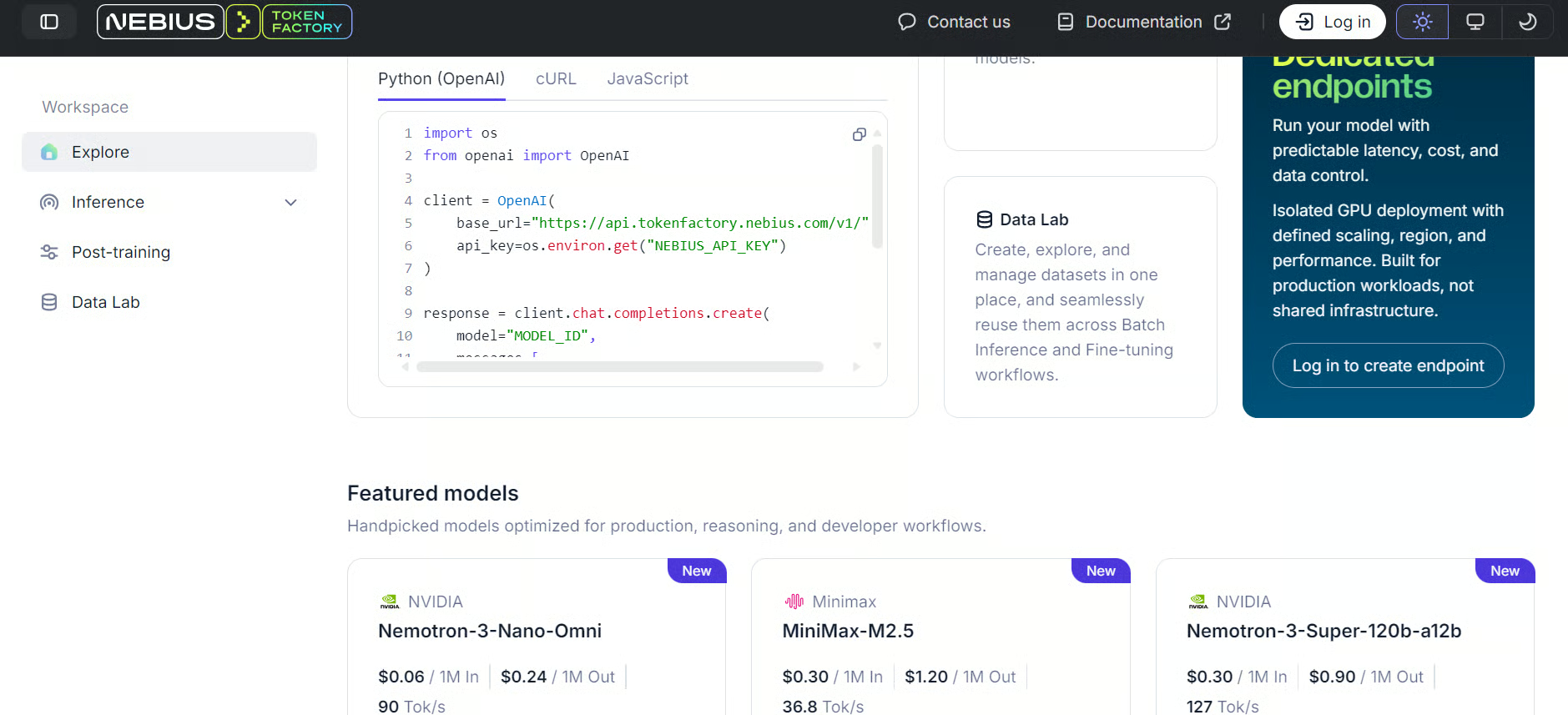

6. Nebius AI

Nebius AI est un fournisseur cloud IA conçu pour des charges IA sur GPU, l’inférence hébergée, le service de modèles et une infrastructure IA à l’échelle. Son service Token Factory prend en charge des modèles ouverts via une API compatible OpenAI, avec des options d’inférence serverless, de fine-tuning et d’infrastructure cloud IA dédiée.

Nebius AI est une bonne option pour les équipes qui veulent plus de contrôle d’infrastructure qu’un simple fournisseur d’API, tout en évitant la complexité d’une gestion complète des environnements GPU. Particulièrement utile pour bâtir avec des modèles ouverts et personnalisés nécessitant du calcul à l’échelle, une inférence rapide et des options de déploiement prêtes pour la production.

Source : Nebius Token Factory

Nebius Token Factory propose deux niveaux de vitesse d’inférence : Fast et Base. Fast vise les charges interactives à faible latence, tandis que Base privilégie l’économie pour des inférences volumineuses ou des traitements en arrière-plan.

Nebius est clairement plus centré sur l’infrastructure que les plateformes LLM plug-and-play. Les équipes auront donc besoin de compétences cloud, déploiement et gestion de charges pour en tirer le meilleur parti.

Pour des charges sensibles, évaluez si l’inférence managée suffit ou si une infrastructure dédiée est nécessaire pour renforcer sécurité, conformité et gouvernance des données.

Idéal pour : infrastructure cloud IA, inférence hébergée, charges sur GPU, inférence rapide et équipes souhaitant plus de contrôle sur les déploiements.

Fournisseurs d’acheminement LLM

Les fournisseurs d’acheminement LLM donnent accès à plusieurs modèles et fournisseurs via une seule API. Au lieu d’intégrer séparément OpenAI, Anthropic, Google, Mistral, DeepSeek, etc., vous utilisez une couche d’acheminement pour gérer l’accès aux modèles depuis un point unique.

Ces plateformes sont utiles pour comparer des modèles, mettre en place des bascules de secours, optimiser les coûts, assurer une redondance entre fournisseurs, améliorer l’observabilité et changer de modèle sans réécrire votre application.

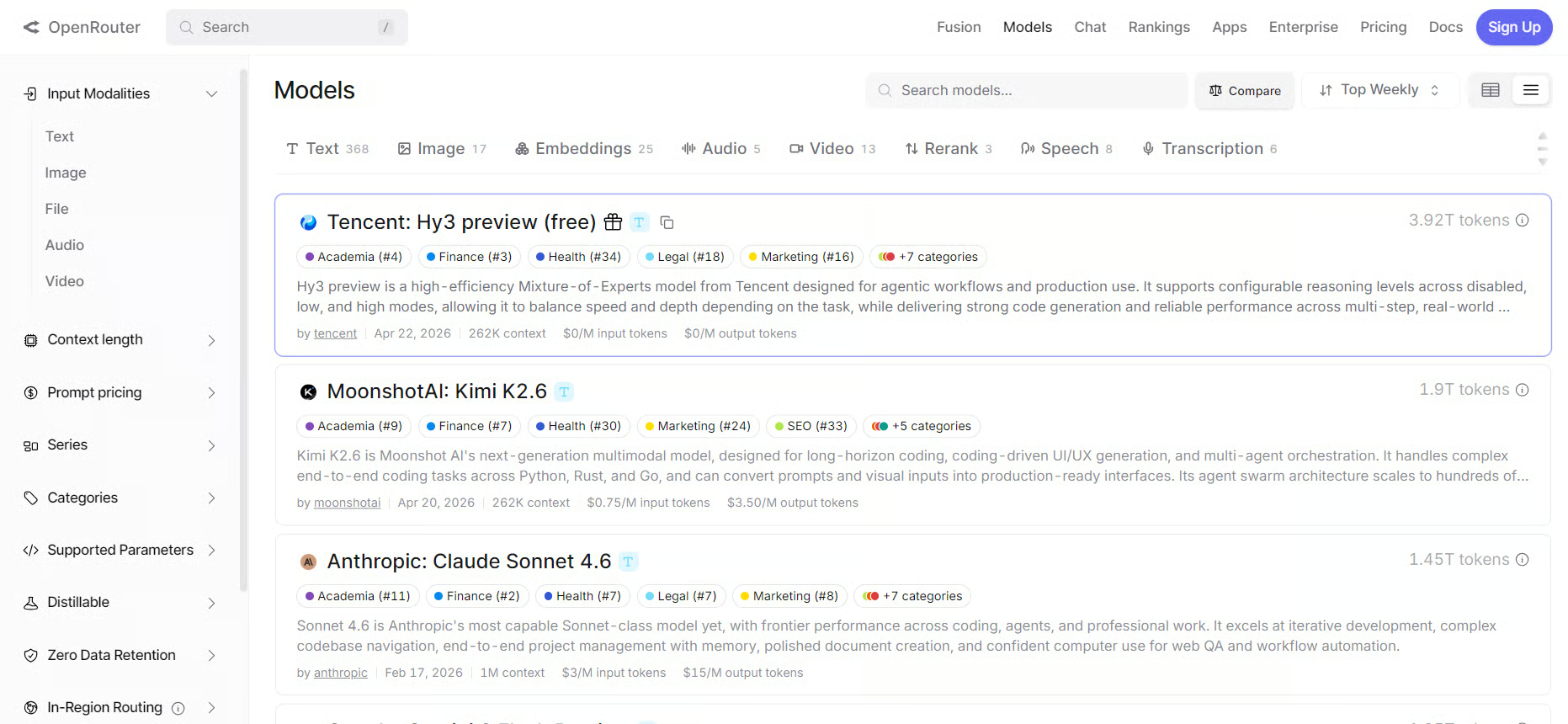

7. OpenRouter

OpenRouter est l’un des fournisseurs d’acheminement LLM les plus populaires. Il donne accès à de nombreux modèles via une API compatible OpenAI, ce qui facilite l’usage de plusieurs fournisseurs avec une seule intégration.

Comme nous l’avons montré dans plusieurs tutoriels, OpenRouter est une excellente option pour comparer des modèles, tester rapidement de nouvelles versions, router des requêtes entre fournisseurs ou éviter l’enfermement chez un seul éditeur.

Source : OpenRouter

Un inconvénient : OpenRouter ajoute une couche entre votre application et le fournisseur de modèle. Cela peut introduire une dépendance supplémentaire, une latence variable et des comportements spécifiques au fournisseur qui nécessitent encore des tests.

Pour la production, examinez les paramètres d’acheminement, les mécanismes de secours, les préférences de fournisseur et les contrôles de confidentialité avant d’envoyer du trafic sensible ou critique.

Idéal pour : apps multi-modèles, comparaison, acheminement de secours, flexibilité fournisseurs et expérimentation rapide.

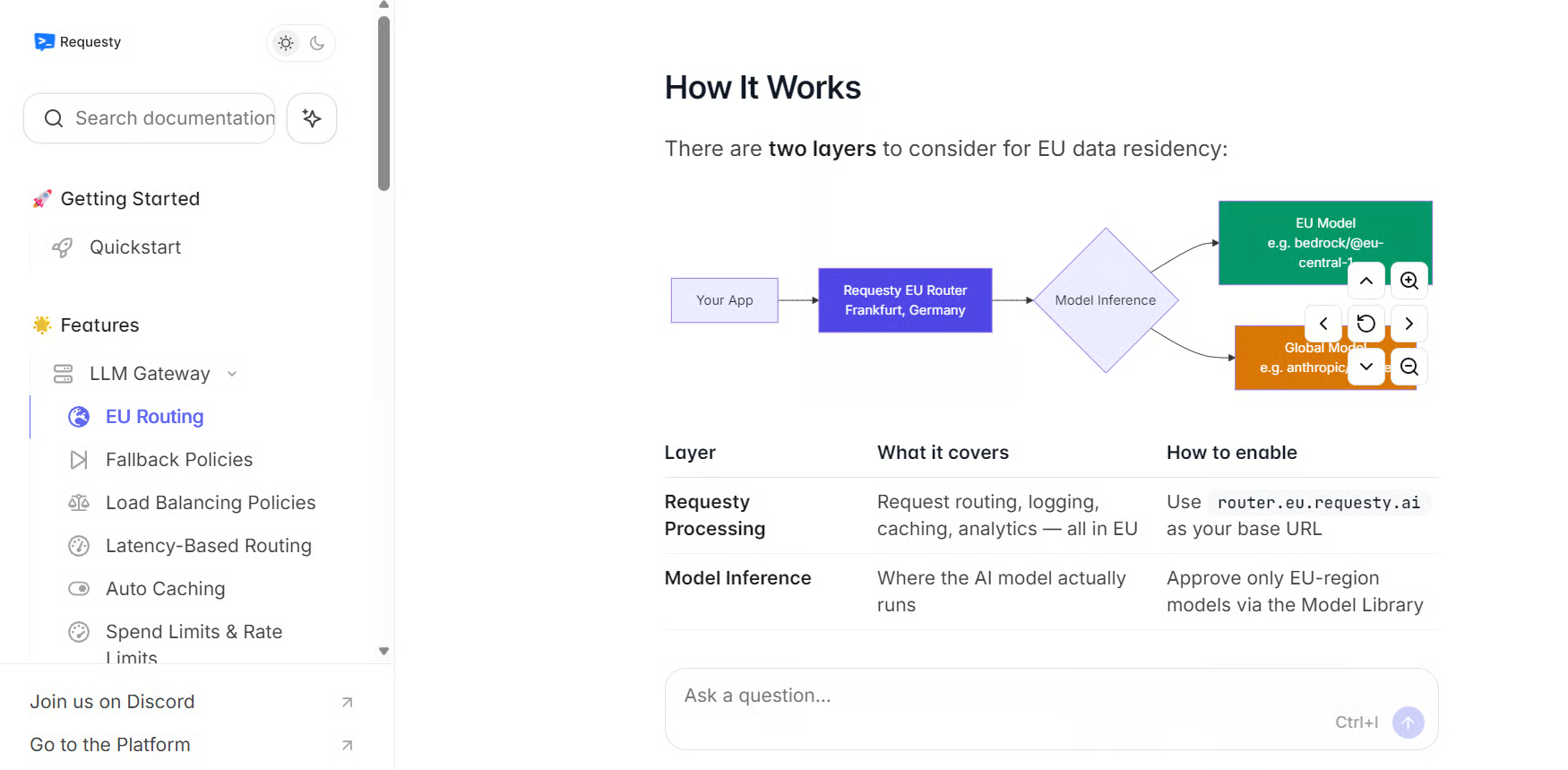

8. Requesty.ai

Requesty.ai est une plateforme d’acheminement et de passerelle LLM qui aide les équipes à se connecter à plusieurs fournisseurs via une API compatible OpenAI. Elle prend en charge plus de 400 modèles, avec des fonctionnalités d’acheminement, secours, mise en cache, gestion des coûts, observabilité et gouvernance.

Requesty.ai est une bonne option pour les équipes qui construisent des applications IA en production et s’appuient sur plusieurs fournisseurs. Particulièrement utile pour gérer des politiques d’acheminement, suivre l’usage, maîtriser les dépenses et améliorer la fiabilité quand des fournisseurs tombent en panne, expirent ou atteignent leurs limites de débit.

Source : Requesty AI Documentation

Comme pour OpenRouter, l’inconvénient majeur est que Requesty.ai ajoute une couche passerelle supplémentaire. Il faut configurer avec soin l’acheminement, le secours, la journalisation et la gouvernance pour éviter des surprises en matière de coûts, de latence ou de comportement.

Pour les charges sensibles, Requesty.ai inclut des contrôles comme la détection et l’anonymisation des PII, des garde-fous de contenu, des journaux d’audit et des fonctions de gouvernance, mais il vous revient de décider quelles données peuvent transiter par la passerelle et comment gérer les logs.

Idéal pour : acheminement LLM, maîtrise des coûts, observabilité, secours fournisseur, gouvernance et passerelles IA en production.

Fournisseurs LLM cloud

Les fournisseurs LLM cloud sont de grandes plateformes cloud qui offrent aux développeurs et aux entreprises un accès managé à des modèles de fondation. Ils prennent souvent en charge leurs propres modèles ainsi que ceux de tiers.

Ils sont particulièrement utiles aux entreprises déjà sur le cloud et qui ont besoin de sécurité, gouvernance, conformité, intégration des données, contrôles de déploiement et gestion des modèles en un seul endroit.

9. Google Vertex AI

Google Vertex AI est la plateforme de machine learning et d’IA générative de Google Cloud. Elle donne accès aux modèles Gemini, au Model Garden, aux outils d’agents et à une infrastructure managée pour créer, déployer et gérer des applications IA.

Vertex AI prend aussi en charge des partenaires majeurs et des modèles ouverts via Model Garden, notamment Anthropic Claude, xAI Grok, les modèles de Mistral AI et des modèles open source comme GLM 5 et Gemma 4, aux côtés des modèles Gemini de Google.

Source : Generative AI on Vertex AI

Google Vertex AI est une option solide pour les équipes déjà sur Google Cloud qui recherchent un déploiement cloud-native, de la gouvernance, des contrôles de sécurité et l’intégration avec l’écosystème data et IA de Google.

En contrepartie, Vertex AI peut être plus complexe qu’une simple API de modèle. Il faut souvent une expérience Google Cloud pour gérer projets, permissions, facturation, paramètres de déploiement et intégrations.

Pour les charges sensibles, Vertex AI est utile grâce à ses contrôles d’accès, sa gouvernance et son infrastructure managée, mais les choix de configuration autour des logs, de l’accès aux données et des régions de déploiement nécessitent une revue attentive.

Idéal pour : utilisateurs de Google Cloud, accès à Gemini, apps IA d’entreprise, workflows multimodaux et déploiements cloud-native.

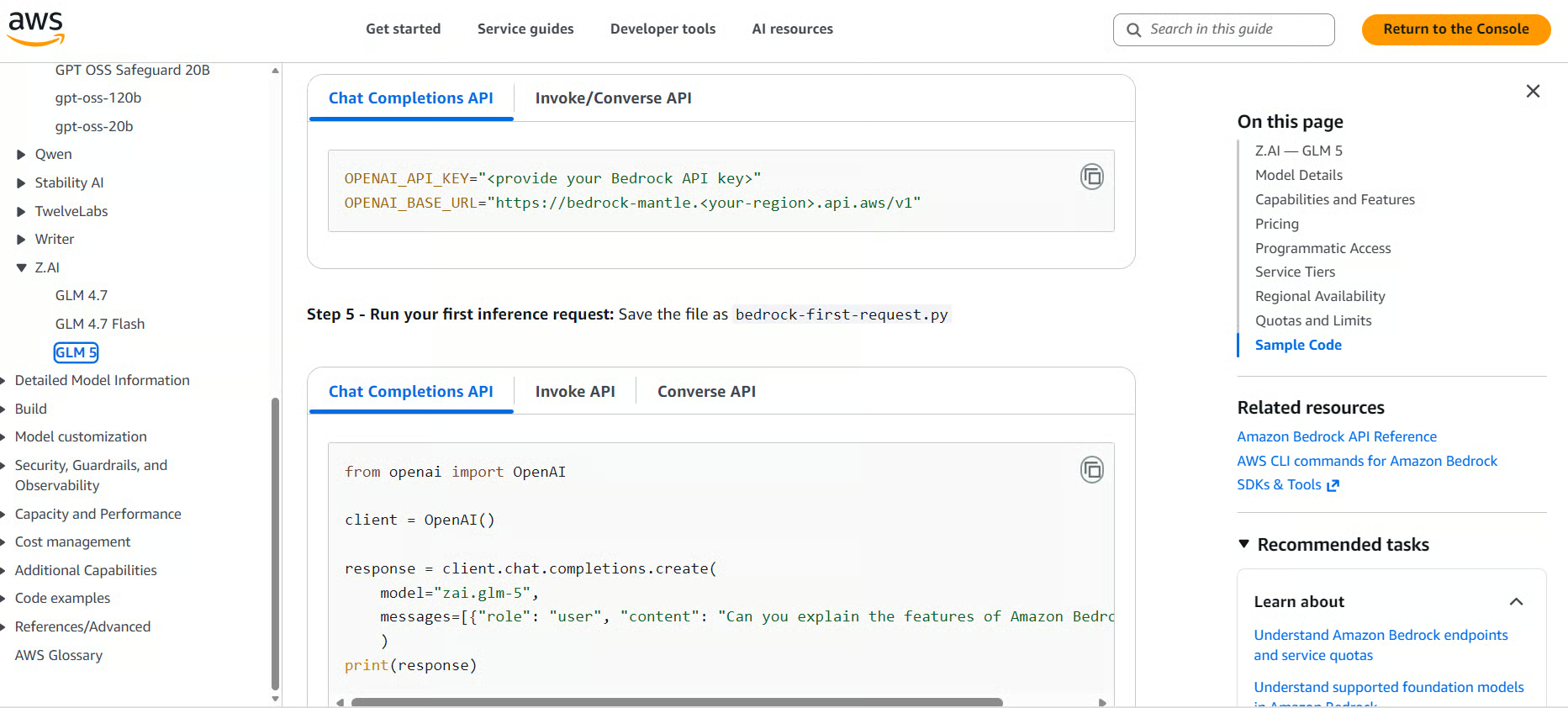

10. Amazon Bedrock

Amazon Bedrock est la plateforme managée d’IA générative d’AWS. Elle donne accès à des modèles de fondation d’Amazon et de tiers via un service AWS managé unique.

Bedrock prend en charge des modèles de fournisseurs comme Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek et d’autres, ce qui est utile pour les équipes qui veulent du choix au sein de l’écosystème AWS.

Amazon Bedrock est un excellent choix pour les entreprises déjà sur AWS, car il réunit accès aux modèles, infrastructure cloud, contrôles de sécurité et intégrations d’entreprise sur une seule plateforme.

Source : Amazon Bedrock

Un inconvénient clé est que Bedrock peut être plus complexe qu’une simple API LLM. Des compétences AWS sont souvent nécessaires pour gérer correctement permissions, régions, accès aux modèles, tarification, réseau et paramètres de déploiement.

Pour les charges sensibles, Bedrock est intéressant car les prompts et sorties ne servent pas à entraîner les modèles de base ni ne sont partagés avec les fournisseurs, et l’on peut utiliser les contrôles AWS tels que le chiffrement, IAM et PrivateLink.

Idéal pour : utilisateurs AWS, IA d’entreprise, accès managé aux modèles de fondation, déploiements centrés sécurité et applications IA génératives cloud-native.

Tableau comparatif des fournisseurs d’API LLM

Le tableau ci-dessous compare les principaux fournisseurs d’API LLM selon leurs atouts clés et leurs limites principales.

|

Fournisseur |

Atouts clés |

Principales limites |

|

OpenAI |

Haute qualité de modèles, APIs matures, outils multimodaux, sorties structurées, embeddings, voix, génération d’images et workflows agentiques |

Peut devenir coûteux à l’échelle et offre moins de contrôle que les modèles open source ou auto-hébergés |

|

Anthropic |

Excellente qualité rédactionnelle, suivi d’instructions rigoureux, raisonnement, code et support du long contexte |

Les coûts augmentent avec de gros documents ou un usage intensif, et le contrôle sur l’hébergement et les internes du modèle est limité |

|

Google Gemini |

Fortes capacités multimodales, APIs temps réel, long contexte et intégration étroite avec l’écosystème IA de Google |

Peut sembler lié à l’écosystème Google ; tarifs, disponibilité et fonctionnalités varient selon l’outil ou la région |

|

Together AI |

Accès hébergé à de nombreux modèles ouverts et spécialisés, avec inférence serverless, endpoints dédiés, fine-tuning, évaluations et infrastructure GPU |

Qualité, vitesse et fiabilité variables selon le modèle sélectionné |

|

Fireworks AI |

Inférence rapide, faible latence, accès serverless, déploiements à la demande et APIs prêtes pour la production pour les modèles ouverts |

Plus focalisé sur l’inférence et le déploiement que sur une plateforme de développement IA tout-en-un |

|

Nebius AI |

Infrastructure sur GPU, inférence hébergée, API compatible OpenAI et paliers de vitesse comme Fast et Base |

Plus orienté infrastructure, nécessitant des compétences cloud et déploiement plus poussées |

|

OpenRouter |

Accès à de nombreux modèles via une API compatible OpenAI, avec bascule facilitée entre fournisseurs et options de secours |

Ajoute une couche entre l’app et le fournisseur, ce qui peut affecter latence, fiabilité ou débogage |

|

Requesty.ai |

Une API pour plusieurs fournisseurs, avec routage, secours, cache, suivi des coûts, observabilité et fonctions de gouvernance |

Nécessite une configuration soignée du routage, de la journalisation, du secours et des contrôles de coûts pour éviter les comportements inattendus |

|

Google Vertex AI |

Accès managé à Gemini, Anthropic Claude, xAI Grok, Mistral AI et modèles ouverts via Model Garden, plus les outils de sécurité et de gouvernance de Google Cloud |

Plus complexe qu’une API simple et peut nécessiter une expérience Google Cloud |

|

Amazon Bedrock |

Accès managé aux modèles d’Amazon et de tiers (Anthropic, Meta, Mistral AI, Cohere, etc.) au sein d’AWS |

Plus complexe qu’une API LLM basique, notamment pour les permissions, régions, tarification et accès aux modèles |

Choisir le meilleur fournisseur d’API LLM pour votre cas d’usage

Le bon choix dépend de trois facteurs :

- Ce que vous construisez

- Le niveau de contrôle souhaité

- Votre budget

Pour les startups et petites équipes, les fournisseurs d’API LLM open source sont souvent le meilleur point de départ. Des plateformes comme Together AI, Fireworks AI et Nebius AI donnent accès à des modèles ouverts puissants sans gérer vous-même GPU ou infrastructure. C’est souvent plus rapide, économique et flexible pour l’expérimentation et les premiers développements produit.

Si vous souhaitez tester rapidement différents modèles, les fournisseurs d’acheminement LLM sont une excellente option. Des outils comme OpenRouter et Requesty.ai permettent de comparer des modèles ouverts et fermés via une seule API, de gérer les secours et de changer de fournisseur sans réécrire votre application.

Pour des workflows où la qualité du modèle prime sur le coût, les fournisseurs natifs comme OpenAI et Anthropic restent parmi les meilleurs choix. Ils sont particulièrement adaptés aux assistants IA en production, aux outils de code, aux workflows exigeants en raisonnement, aux apps multimodales et aux systèmes à base d’agents où fiabilité et performances sont essentielles.

Enfin, si votre entreprise fonctionne déjà sur AWS ou Google Cloud, rester dans cet écosystème a souvent du sens. Amazon Bedrock et Google Vertex AI offrent un accès managé aux modèles, des contrôles de sécurité, de la gouvernance et une intégration avec les outils que vous utilisez déjà.

Dernières réflexions

Pour le travail technique, les assistants de code et les outils de "vibe coding", évitez de trop expérimenter au départ. D’expérience, OpenAI et Anthropic sont généralement des valeurs sûres grâce à leurs capacités en code, en raisonnement et à leurs outils développeurs.

Les fournisseurs d’API LLM open source et d’acheminement LLM sont d’excellentes alternatives pour une expérimentation plus avancée.

Les grands fournisseurs LLM cloud ont surtout du sens en contexte entreprise. Dans ce cas, optez pour celui dont vous utilisez déjà l’écosystème.

FAQ sur les fournisseurs d’API LLM

Qu’est-ce qu’un fournisseur d’API LLM ?

Une entreprise ou une plateforme qui héberge des grands modèles de langage et les expose via une API, afin que les développeurs puissent envoyer des requêtes et recevoir des réponses générées par l’IA sans gérer eux-mêmes de GPU ni d’infrastructure d’inférence.

Quelle est la différence entre un fournisseur LLM natif et un fournisseur LLM cloud ?

Les fournisseurs natifs (comme OpenAI et Anthropic) conçoivent et servent directement leurs propres modèles. Les fournisseurs cloud (comme AWS Bedrock et Google Vertex AI) offrent un accès managé à plusieurs modèles tiers intégrés à un écosystème cloud existant, avec des outils de sécurité et de gouvernance d’entreprise.

Quand utiliser un fournisseur d’acheminement LLM comme OpenRouter ou Requesty.ai ?

Quand vous devez travailler avec plusieurs modèles ou fournisseurs, souhaitez une bascule automatique en cas d’indisponibilité, ou avez besoin de comparer des modèles et de maîtriser les coûts, le tout via une seule intégration API.

Les fournisseurs d’API LLM open source sont-ils moins performants que les fournisseurs natifs comme OpenAI ?

Pas nécessairement ; cela dépend de la tâche. Des plateformes comme Together AI et Fireworks AI hébergent des modèles open source de pointe tels que Llama, DeepSeek et Mistral, souvent compétitifs avec les modèles propriétaires et à un coût nettement inférieur.

Quel fournisseur d’API LLM convient le mieux aux entreprises avec de fortes contraintes de conformité ?

Amazon Bedrock et Google Vertex AI sont généralement les meilleurs choix, car ils proposent des contrôles de sécurité cloud-native, IAM, chiffrement, journalisation d’audit et des fonctions de gouvernance intégrées à l’infrastructure d’entreprise existante.

En tant que data scientist certifié, je suis passionné par l'utilisation des technologies de pointe pour créer des applications innovantes d'apprentissage automatique. Avec une solide expérience en reconnaissance vocale, en analyse de données et en reporting, en MLOps, en IA conversationnelle et en NLP, j'ai affiné mes compétences dans le développement de systèmes intelligents qui peuvent avoir un impact réel. En plus de mon expertise technique, je suis également un communicateur compétent, doué pour distiller des concepts complexes dans un langage clair et concis. En conséquence, je suis devenu un blogueur recherché dans le domaine de la science des données, partageant mes idées et mes expériences avec une communauté grandissante de professionnels des données. Actuellement, je me concentre sur la création et l'édition de contenu, en travaillant avec de grands modèles linguistiques pour développer un contenu puissant et attrayant qui peut aider les entreprises et les particuliers à tirer le meilleur parti de leurs données.