Tracks

ผู้ให้บริการ Large Language Model (LLM) API เปิดทางให้นักพัฒนาเข้าถึงโมเดล AI ที่ทรงพลังได้ โดยไม่ต้องดูแล GPU การดีพลอยโมเดล การสเกล หรือโครงสร้างพื้นฐานการทำอินเฟอเรนซ์เอง แทนที่จะโฮสต์โมเดลด้วยตนเอง นักพัฒนาสามารถเชื่อมต่อ API เลือกโมเดล ส่งคำขอ และรับคำตอบได้ทันที

ในบทความนี้ เราจะสำรวจผู้ให้บริการ LLM API 10 อันดับแรก โดยพิจารณาจากคุณภาพโมเดล ประสบการณ์นักพัฒนา ราคา การสเกล การสนับสนุนระบบนิเวศ และความพร้อมใช้งานในงานโปรดักชัน สำหรับแต่ละผู้ให้บริการ เราจะครอบคลุมสิ่งที่ถนัด จุดเด่นสำคัญ และข้อควรพิจารณาหลักสำหรับนักพัฒนา

คู่มือนี้แบ่งผู้ให้บริการ LLM API ชั้นนำออกเป็น 4 ประเภท:

- ผู้ให้บริการ LLM แบบ Native

- ผู้ให้บริการ LLM API แบบโอเพนซอร์ส

- ผู้ให้บริการ LLM แบบ Routing

- ผู้ให้บริการ LLM บนคลาวด์

ผู้ให้บริการ LLM แบบ Native

ผู้ให้บริการ LLM แบบ Native จะสร้าง เทรน และให้บริการตระกูลโมเดลของตนเองผ่าน API มักเป็นตัวเลือกที่แข็งแกร่งสำหรับนักพัฒนาที่ต้องการคุณภาพโมเดลสูง เอกสารเชิงเทคนิคที่เชื่อถือได้ ความสามารถด้านเหตุผลขั้นสูง รองรับมัลติโหมด และเครื่องมือพร้อมใช้งานระดับโปรดักชัน

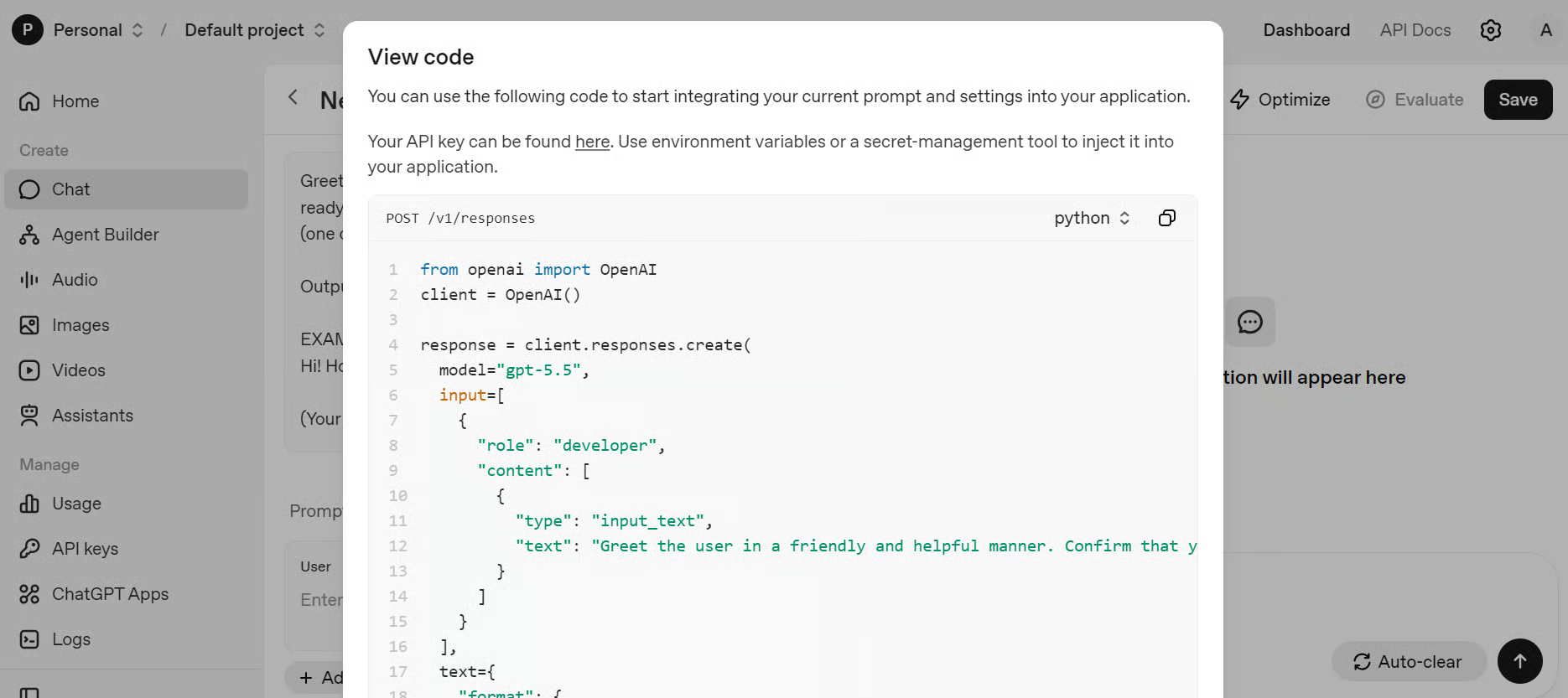

1. OpenAI

OpenAI เป็นหนึ่งในผู้ให้บริการ LLM API ที่มีการใช้งานอย่างกว้างขวาง แพลตฟอร์ม API เปิดให้เข้าถึง:

- โมเดลให้เหตุผลระดับแนวหน้าอย่าง GPT-5.5

- การสร้างเสียงแบบเรียลไทม์และการแปลผ่าน GPT-Realtime-2

- การสร้างภาพผ่านโมเดลสร้างภาพ GPT-Images-2.0

- การพัฒนาเชิงเอเจนต์ผ่าน OpenAI Agents SDK

API รองรับสตรีมมิง อินเทอร์เฟซเรียลไทม์ และเอาต์พุตแบบมีโครงสร้าง

OpenAI เป็นตัวเลือกที่แข็งแกร่งสำหรับทีมที่สร้างผู้ช่วย AI เครื่องมือเขียนโค้ด เอเจนต์ดูแลลูกค้า โคไพล็อตภายใน แอปมัลติโหมด และระบบเชิงเอเจนต์

แหล่งที่มา: OpenAI

ข้อเสียอย่างหนึ่งคือ OpenAI อาจมีค่าใช้จ่ายสูงเมื่อสเกล โดยเฉพาะแอปที่มีปริมาณสูงหรือเน้นเหตุผลมาก นอกจากนี้ยังเป็นผู้ให้บริการ API แบบปิด ทำให้นักพัฒนาควบคุมรายละเอียดภายในโมเดล โฮสติ้ง และการปรับแต่งได้น้อยกว่าเมื่อเทียบกับโมเดลโอเพนซอร์สหรือแบบโฮสต์เอง

เหมาะสำหรับ: แอป AI ทั่วไป งานให้เหตุผล การเขียนโค้ด เวิร์กโฟลว์มัลติโหมด และผลิตภัณฑ์ AI พร้อมใช้งานจริง

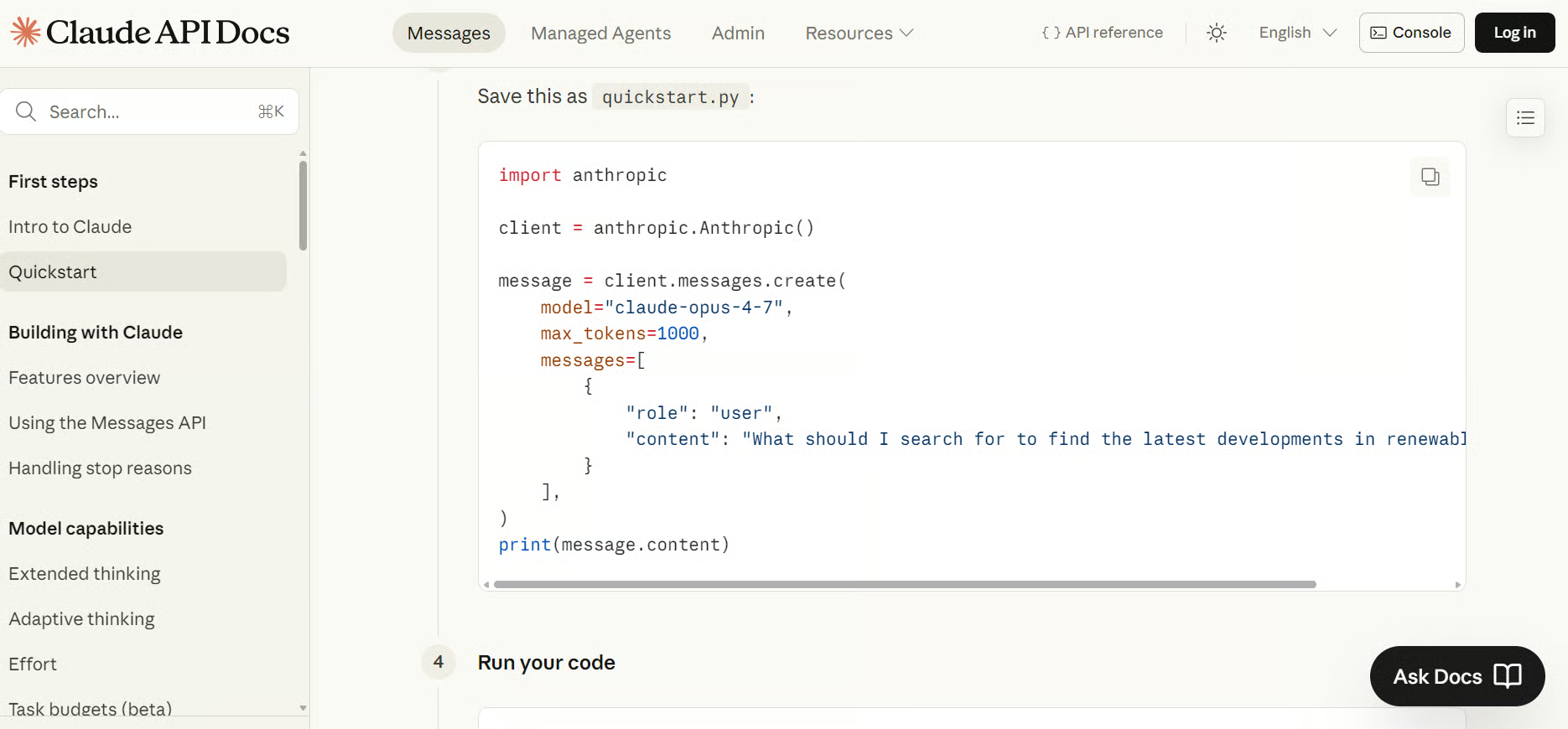

2. Anthropic

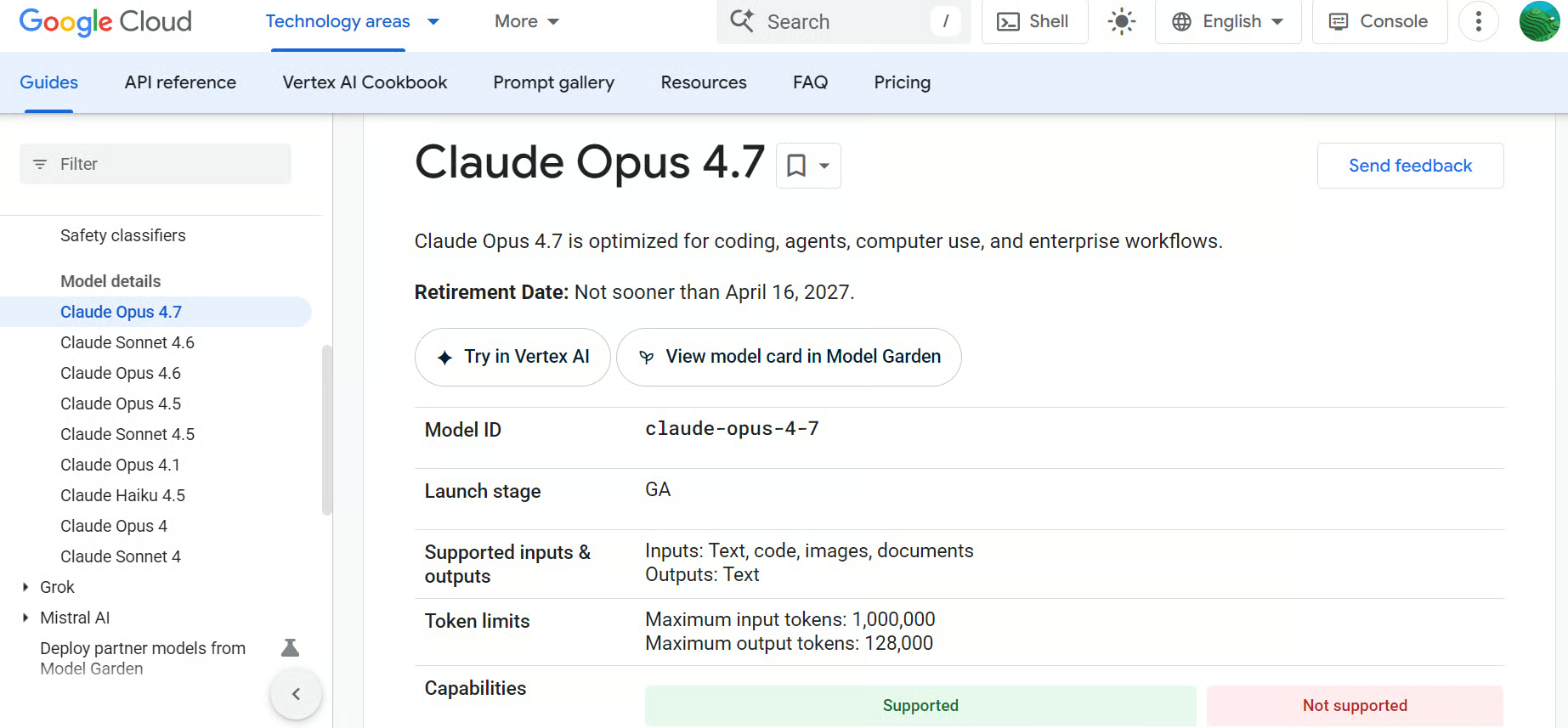

Anthropic ให้บริการตระกูลโมเดล Claude ผ่าน API ของตน เช่น รุ่นเรือธงล่าสุด Claude Opus 4.7 Claude ถูกออกแบบมาสำหรับงานภาษา เหตุผล การวิเคราะห์ การเขียนโค้ด บริบทยาว และเวิร์กโฟลว์เชิงเอเจนต์ แพลตฟอร์มนักพัฒนาของ Anthropic เปิดให้ทีมเข้าถึงโมเดลโดยตรงผ่าน API, SDK และเอกสารสำหรับนักพัฒนา

Claude มีประโยชน์เป็นพิเศษสำหรับแอปที่ต้องการการทำตามคำสั่งอย่างรอบคอบ คุณภาพงานเขียนที่แข็งแกร่ง การวิเคราะห์เอกสาร และการจัดการพรอมต์ที่ซับซ้อนได้อย่างเชื่อถือ

ที่มา: เริ่มต้นใช้งาน Claude

ข้อเสียสำคัญคือค่าใช้จ่าย โดยเฉพาะเมื่อใช้ Claude กับเอกสารขนาดใหญ่ พรอมต์บริบทยาว หรือแอปปริมาณสูง เนื่องจาก Claude เข้าถึงผ่าน API แบบโฮสต์ ทีมจึงมีข้อจำกัดในการควบคุมว่าโมเดลรันที่ไหนและอย่างไร

สำหรับกรณีที่อ่อนไหวด้านความเป็นส่วนตัว นักพัฒนาควรทบทวนการจัดการข้อมูล การเก็บรักษา และข้อกำหนดด้านการปฏิบัติตามมาตรฐานอย่างรอบคอบก่อนส่งข้อมูลธุรกิจหรือข้อมูลลูกค้าที่เป็นความลับผ่าน API

เหมาะสำหรับ: ผู้ช่วยเขียนโค้ด AI สำหรับองค์กร การวิเคราะห์บริบทยาว เวิร์กโฟลว์เอกสาร และเอเจนต์ AI

สำหรับการเปรียบเทียบเชิงลึกของสองยักษ์ใหญ่ AI โปรดดูคู่มือ Anthropic vs OpenAI

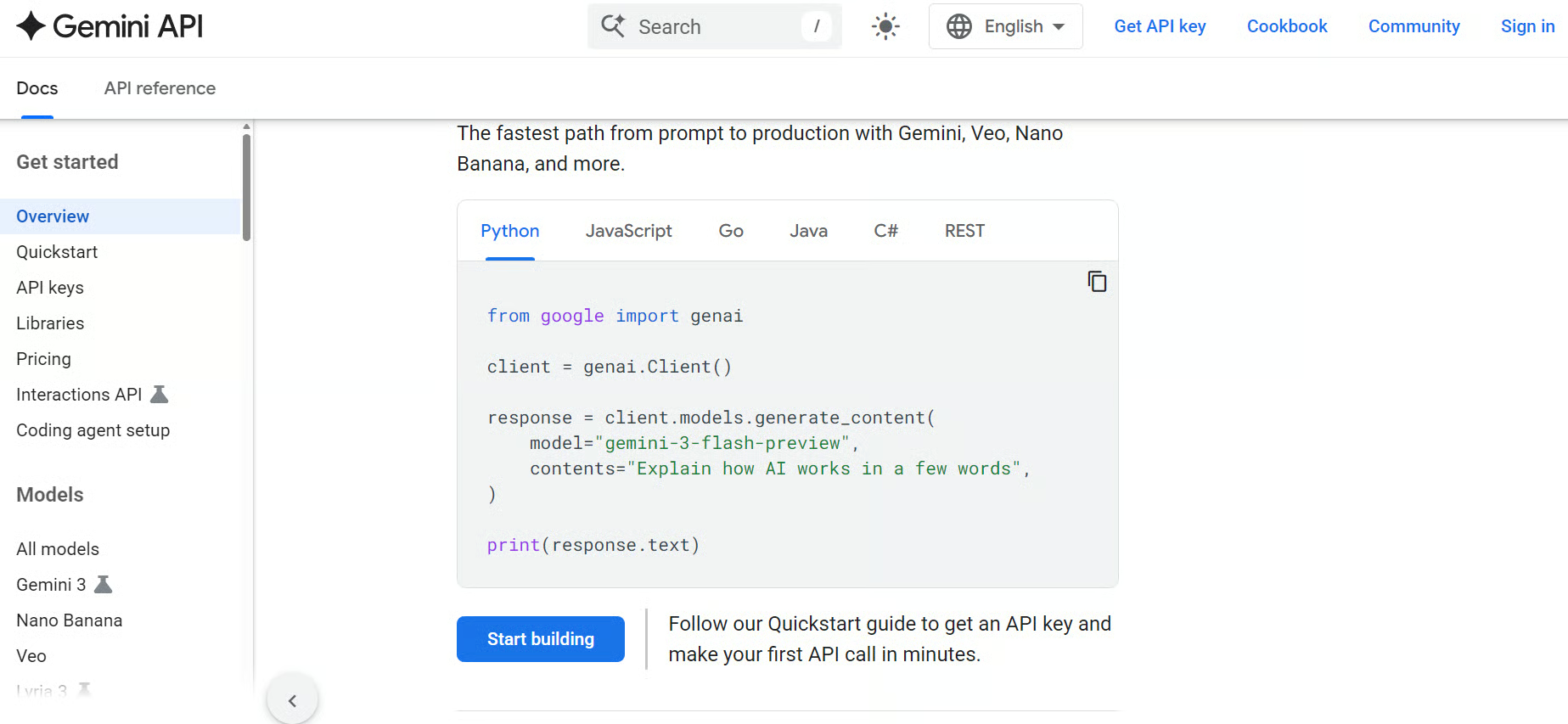

3. Google Gemini

Google Gemini เป็นตระกูล LLM แบบ Native ของ Google รวมถึง Gemini 3.1 Pro ที่มีให้ใช้ผ่าน Gemini API สำหรับนักพัฒนา Gemini API รองรับ API แบบมาตรฐาน แบบสตรีมมิง และแบบเรียลไทม์ พร้อมเอกสารรายละเอียดโมเดล SDK ราคา การตั้งค่า และเอกสารอ้างอิง API

ด้วย Nano Banana 2 สำหรับการสร้างภาพ และการผสาน Veo 3.1 ทำให้ Gemini เป็นตัวเลือกที่แข็งแกร่งสำหรับนักพัฒนาที่สร้างแอปมัลติโหมด นอกจากนี้ยังเหมาะกับผู้ช่วย AI (โดยเฉพาะที่พึ่งประสบการณ์ค้นหา) เครื่องมือเขียนโค้ด และผลิตภัณฑ์ที่เชื่อมต่อกับระบบนิเวศ AI ของ Google

ที่มา: Gemini API

อย่างไรก็ตาม Gemini อาจผูกกับระบบนิเวศของ Google มาก ซึ่งอาจไม่เหมาะสำหรับทีมที่ต้องการโครงแบบไม่ผูกผู้ให้บริการ ราคา การมีให้บริการของโมเดล และการรองรับฟีเจอร์อาจแตกต่างกันไปตามเครื่องมือและภูมิภาค

สำหรับแอปที่อ่อนไหวต่อความเป็นส่วนตัว ทีมควรทบทวนการจัดการข้อมูล การเก็บรักษา และข้อกำหนดการปฏิบัติตามมาตรฐานก่อนส่งข้อมูลธุรกิจหรือลูกค้าที่เป็นความลับผ่าน API

เหมาะสำหรับ: แอป AI มัลติโหมด การเชื่อมต่อระบบนิเวศของ Google เวิร์กโฟลว์บริบทยาว การเขียนโค้ด และแอป AI ทั่วไป

ผู้ให้บริการ LLM API แบบโอเพนซอร์ส

ผู้ให้บริการ LLM API แบบโอเพนซอร์สเปิดให้นักพัฒนาเข้าถึงโมเดลโอเพนซอร์สและโมเดลเปิดน้ำหนักผ่าน API แบบโฮสต์ แทนที่จะดาวน์โหลดโมเดลและรันบน GPU ของตนเอง แพลตฟอร์มเหล่านี้จะโฮสต์โมเดลและเปิดให้ใช้งานผ่าน API ที่ใช้งานง่าย

ผู้ให้บริการเหล่านี้มีประโยชน์สำหรับทีมที่ต้องการต้นทุนต่ำลง ความยืดหยุ่นของโมเดลมากขึ้น การทดลองที่เร็วขึ้น และการเข้าถึงโมเดลยอดนิยมอย่าง Llama, DeepSeek, Qwen, Mistral, Gemma และอื่น ๆ

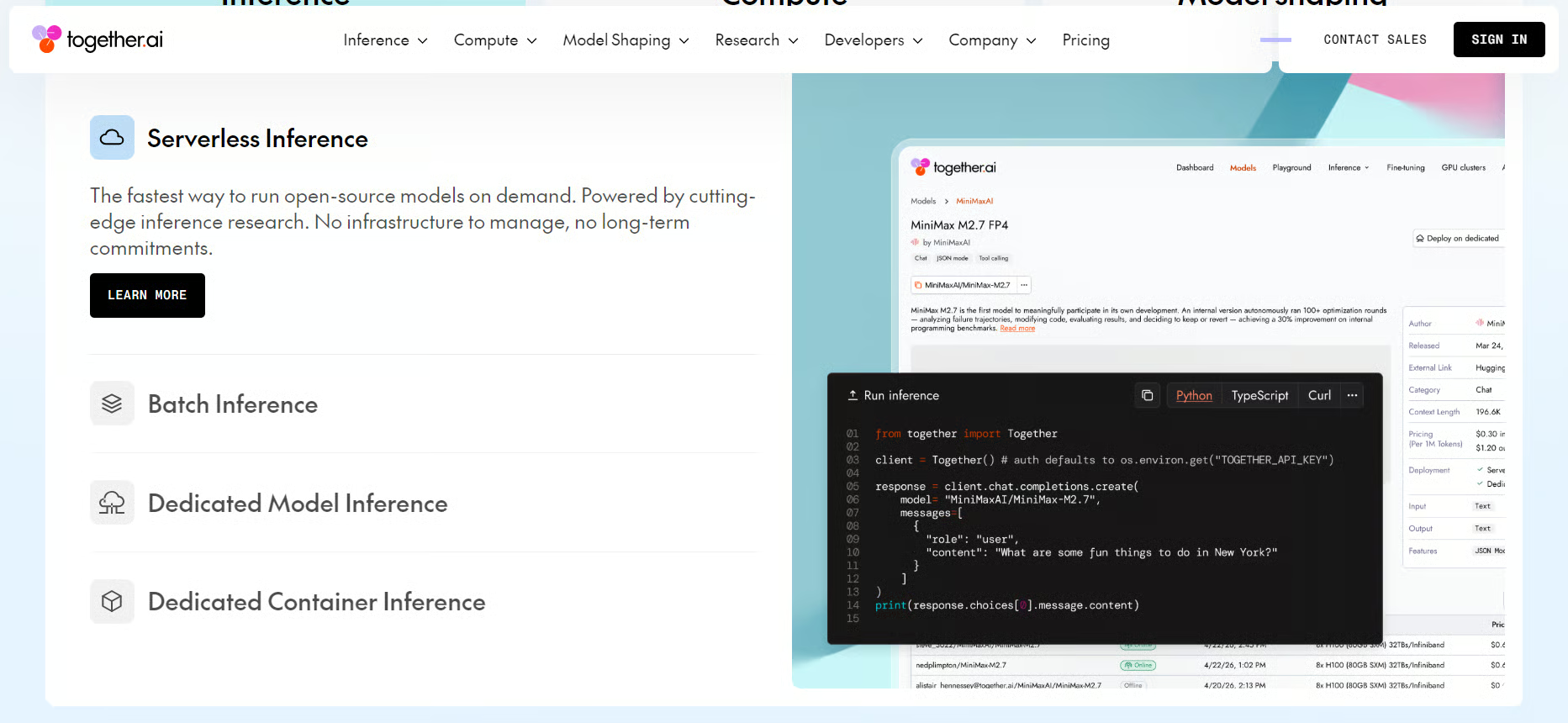

4. Together AI

Together AI เปิดให้เข้าถึงโมเดลโอเพนซอร์สและโมเดลเฉพาะทางผ่าน API แบบรวม แคตตาล็อกโมเดลมีมากกว่า 200 โมเดล ครอบคลุมข้อความ รูปภาพ วิดีโอ โค้ด และเสียง พร้อมรองรับอินเฟอเรนซ์แบบเซิร์ฟเวอร์เลส อินเฟอเรนซ์แบบแบตช์ เอ็นด์พอยต์เฉพาะ ปรับจูน การประเมินผล และคลัสเตอร์ GPU

Together AI เป็นตัวเลือกที่แข็งแกร่งสำหรับนักพัฒนาที่ต้องการสร้างด้วยโมเดลเปิด โดยไม่ต้องจัดการโครงสร้างพื้นฐานเอง เหมาะอย่างยิ่งสำหรับทีมที่ทดสอบหลายโมเดล ปรับจูนโมเดลแบบกำหนดเอง หรือสเกลงานอินเฟอเรนซ์

ที่มา: Together AI

อย่างไรก็ดี คุณภาพ ความเร็ว และความเชื่อถือได้ของโมเดลอาจแตกต่างกันตามโมเดลที่เลือก ทีมอาจต้องทดสอบ ตรวจวัด และประเมินเพิ่มเติมก่อนใช้งานในโปรดักชัน

สำหรับงานที่อ่อนไหว ทีมควรตรวจสอบว่าต้องการการเข้าถึงแบบเซิร์ฟเวอร์เลส เอ็นด์พอยต์เฉพาะ หรือทางเลือกการดีพลอยแบบส่วนตัวเพื่อให้ตรงตามข้อกำหนดด้านความปลอดภัยและการปฏิบัติตามมาตรฐาน

เหมาะสำหรับ: อินเฟอเรนซ์โมเดลโอเพนซอร์ส การปรับจูน เวิร์กโหลด AI ที่สเกลได้ และการทดลองข้ามหลายโมเดล

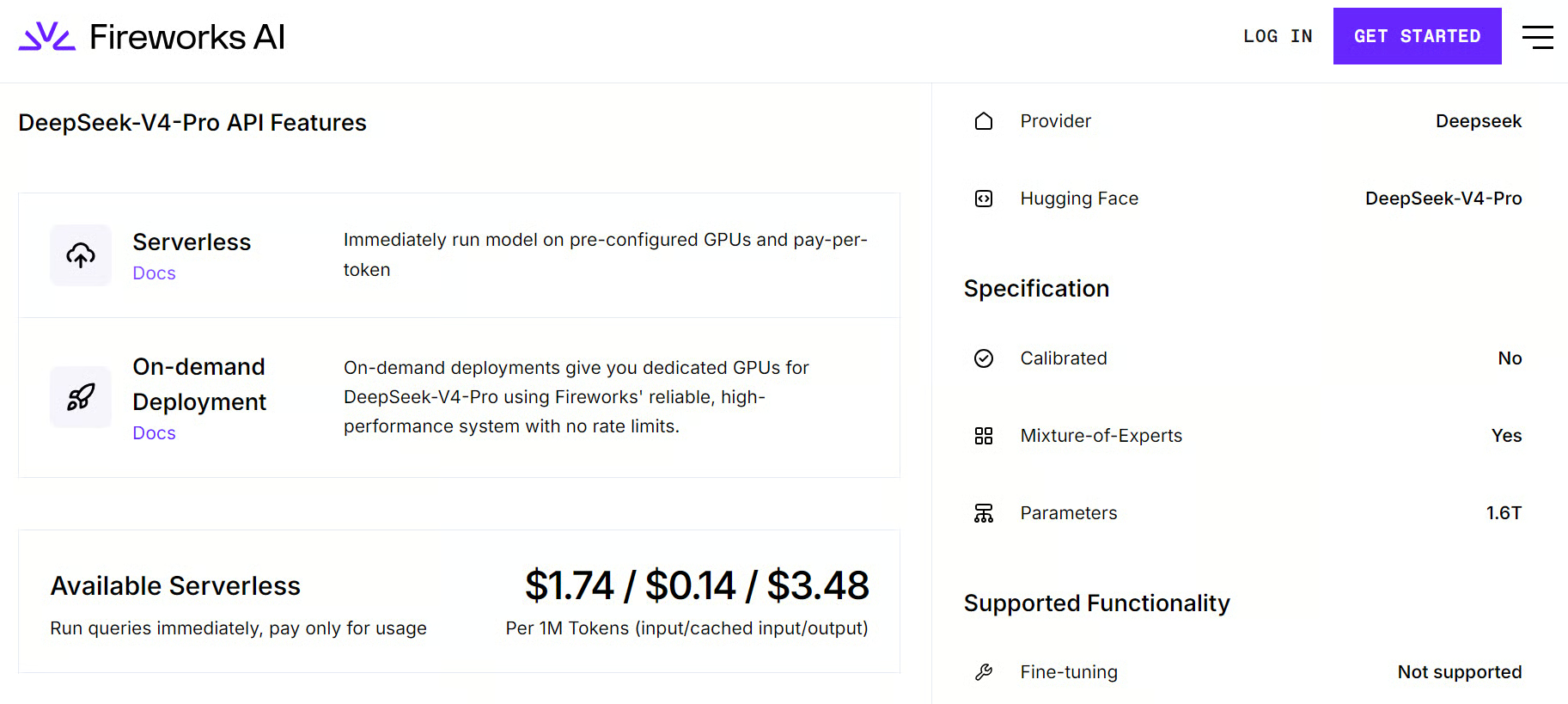

5. Fireworks AI

Fireworks AI เน้นอินเฟอเรนซ์ที่รวดเร็วสำหรับ LLM และโมเดลสร้างสรรค์แบบโอเพนซอร์ส แพลตฟอร์มรองรับอินเฟอเรนซ์แบบเซิร์ฟเวอร์เลส ดีพลอยเมนต์ตามต้องการ ปรับจูน และ API พร้อมโปรดักชันสำหรับโมเดลเปิดที่ได้รับความนิยม

Fireworks AI เป็นตัวเลือกที่แข็งแกร่งสำหรับทีมที่ต้องการความยืดหยุ่นของโมเดลเปิดพร้อมอินเฟอเรนซ์ที่เร็วและดีเลย์ต่ำ เหมาะอย่างยิ่งสำหรับ AI สนทนา ผู้ช่วยเขียนโค้ด การค้นหา แอปมัลติโหมด และระบบ RAG สำหรับองค์กร

ที่มา: Fireworks AI

ข้อเสียสำคัญคือ Fireworks AI มุ่งที่อินเฟอเรนซ์และการดีพลอยมากกว่าเป็นแพลตฟอร์มพัฒนา AI แบบครบวงจร ทีมอาจยังต้องใช้เครื่องมือแยกต่างหากสำหรับการออร์เคสเตรชัน การประเมิน การมอนิเตอร์ หรือเวิร์กโฟลว์เอเจนต์ที่ซับซ้อน

ทีมยังควรพิจารณาว่าอินเฟอเรนซ์แบบเซิร์ฟเวอร์เลสเพียงพอสำหรับงานที่อ่อนไหวหรือไม่ หรือจำเป็นต้องมีการดีพลอยแบบเฉพาะเพื่อควบคุมประสิทธิภาพและการปฏิบัติตามมาตรฐานให้เข้มงวดยิ่งขึ้น

เหมาะสำหรับ: อินเฟอเรนซ์โมเดลโอเพนซอร์สที่รวดเร็ว การปรับจูน แอป AI ระดับโปรดักชัน และการดีพลอยโมเดลเปิดแบบดีเลย์ต่ำ

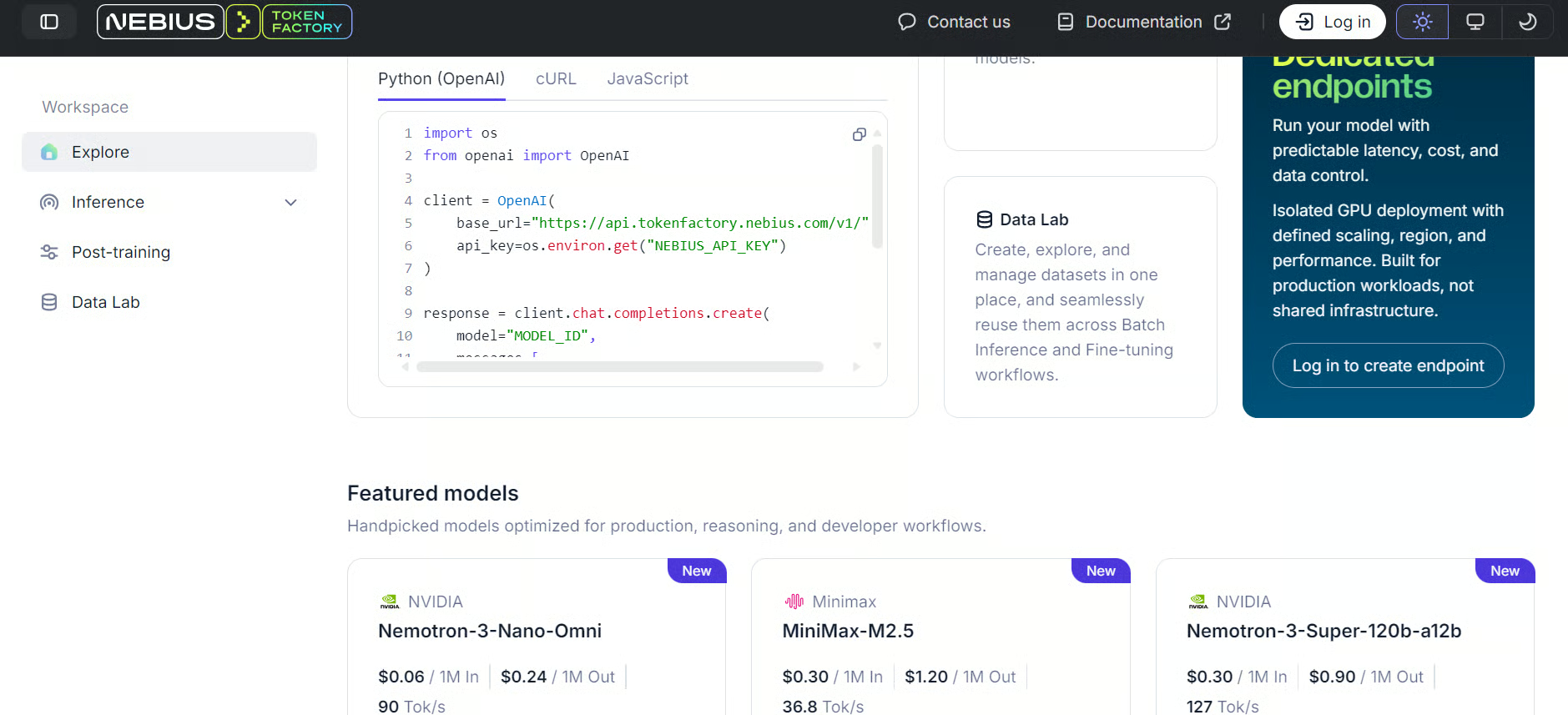

6. Nebius AI

Nebius AI เป็นผู้ให้บริการคลาวด์ด้าน AI ที่สร้างมาเพื่อเวิร์กโหลด AI ที่ใช้ GPU อินเฟอเรนซ์แบบโฮสต์ การให้บริการโมเดล และโครงสร้างพื้นฐาน AI ที่สเกลได้ บริการอินเฟอเรนซ์ Token Factory รองรับโมเดลเปิดผ่าน API ที่เข้ากันได้กับ OpenAI โดยมีตัวเลือกสำหรับอินเฟอเรนซ์แบบเซิร์ฟเวอร์เลส การปรับจูน และโครงสร้างพื้นฐาน AI บนคลาวด์แบบเฉพาะ

Nebius AI เป็นตัวเลือกที่แข็งแกร่งสำหรับทีมที่ต้องการควบคุมโครงสร้างพื้นฐานมากกว่าผู้ให้บริการ API พื้นฐาน ขณะเดียวกันก็หลีกเลี่ยงความซับซ้อนของการดูแลสภาพแวดล้อม GPU ด้วยตนเอง เหมาะอย่างยิ่งสำหรับทีมที่สร้างด้วยโมเดลเปิดและโมเดลแบบกำหนดเองที่ต้องการคอมพิวต์สเกลได้ อินเฟอเรนซ์ที่เร็ว และตัวเลือกการดีพลอยพร้อมโปรดักชัน

ที่มา: Nebius Token Factory

Nebius Token Factory มีระดับความเร็วอินเฟอเรนซ์สองแบบ: Fast และ Base โดย Fast ออกแบบมาสำหรับเวิร์กโหลดแบบโต้ตอบที่ต้องการดีเลย์ต่ำ ส่วน Base เหมาะกับอินเฟอเรนซ์ปริมาณมากที่คุ้มค่าใช้จ่ายหรือประมวลผลเบื้องหลัง

Nebius มุ่งเน้นโครงสร้างพื้นฐานมากกว่าพลักแอนด์เพลย์ LLM API แบบง่าย ๆ ซึ่งหมายความว่าทีมอาจต้องมีความรู้ด้านคลาวด์ การดีพลอย และการจัดการเวิร์กโหลดมากขึ้นเพื่อให้ได้คุณค่าสูงสุด

สำหรับงานที่อ่อนไหว ทีมควรพิจารณาว่าอินเฟอเรนซ์แบบจัดการเพียงพอหรือไม่ หรือจำเป็นต้องมีโครงสร้างพื้นฐานเฉพาะเพื่อควบคุมความปลอดภัย การปฏิบัติตามมาตรฐาน และธรรมาภิบาลข้อมูลอย่างเข้มงวด

เหมาะสำหรับ: โครงสร้างพื้นฐานคลาวด์สำหรับ AI อินเฟอเรนซ์แบบโฮสต์ เวิร์กโหลดที่ใช้ GPU อินเฟอเรนซ์ที่รวดเร็ว และทีมที่ต้องการควบคุมการดีพลอยมากขึ้น

ผู้ให้บริการ LLM แบบ Routing

ผู้ให้บริการ LLM แบบ Routing เปิดทางให้นักพัฒนาเข้าถึงหลายโมเดลและหลายผู้ให้บริการผ่าน API เดียว แทนที่จะต้องผสานการทำงานกับ OpenAI, Anthropic, Google, Mistral, DeepSeek และผู้ให้บริการอื่น ๆ แยกกัน นักพัฒนาสามารถใช้เลเยอร์ Routing ชั้นเดียวเพื่อจัดการการเข้าถึงโมเดลจากที่เดียว

แพลตฟอร์มเหล่านี้มีประโยชน์สำหรับการเปรียบเทียบโมเดล การกำหนดเส้นทางสำรอง การเพิ่มประสิทธิภาพต้นทุน ความซ้ำซ้อนของผู้ให้บริการ การสังเกตการณ์ และการสลับโมเดลโดยไม่ต้องเขียนแอปใหม่

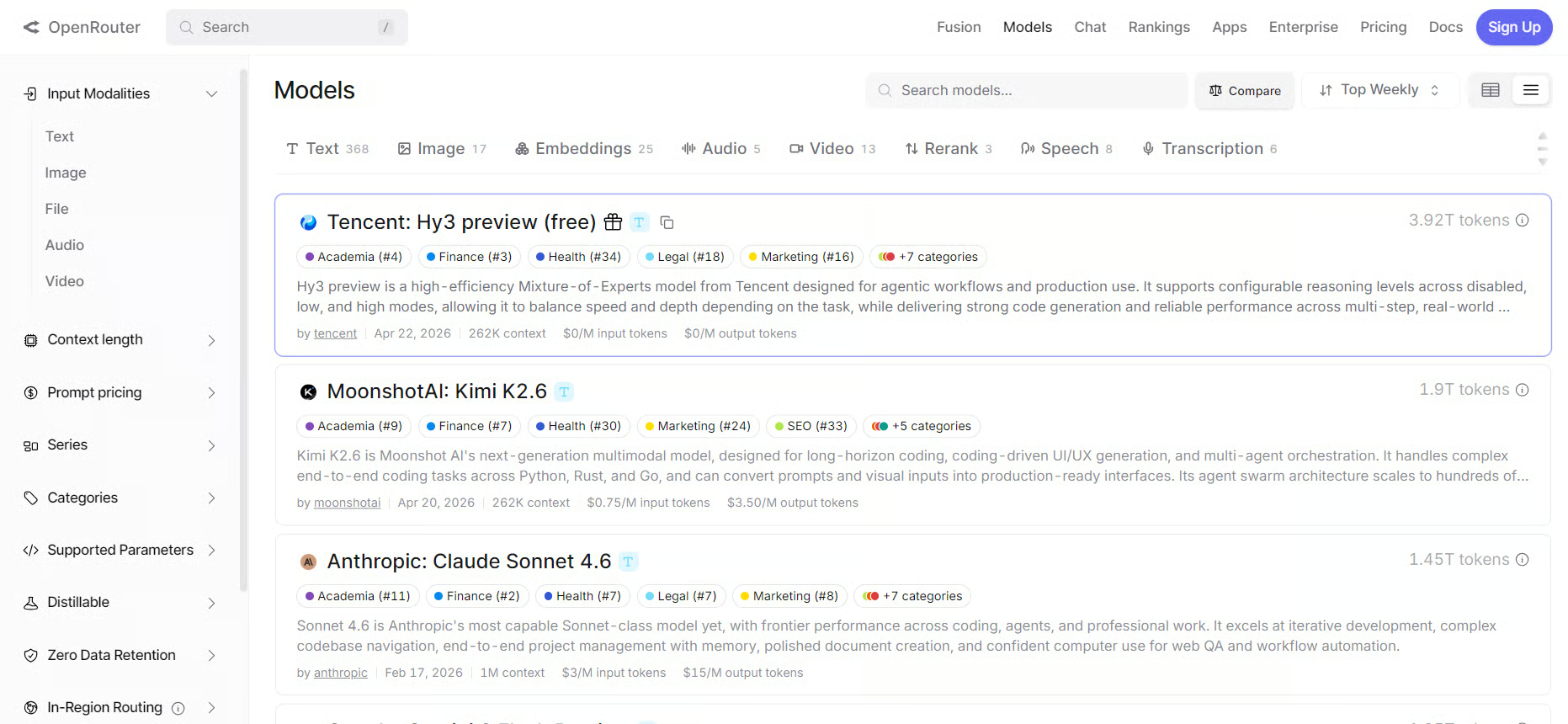

7. OpenRouter

OpenRouter เป็นหนึ่งในผู้ให้บริการ LLM Routing ที่ได้รับความนิยมมากที่สุด เปิดให้นักพัฒนาเข้าถึงหลายโมเดลผ่าน API เดียวที่เข้ากันได้กับ OpenAI ทำให้ง่ายต่อการใช้งานกับผู้ให้บริการที่แตกต่างกันผ่านการผสานครั้งเดียว

ตามที่เราได้ครอบคลุมไว้ในบทเรียนหลายฉบับ OpenRouter เป็นตัวเลือกที่แข็งแกร่งสำหรับนักพัฒนาที่ต้องการเปรียบเทียบโมเดล ทดสอบรุ่นใหม่อย่างรวดเร็ว กำหนดเส้นทางคำขอข้ามผู้ให้บริการ หรือหลีกเลี่ยงการถูกผูกกับผู้ขายโมเดลรายเดียว

ที่มา: OpenRouter

ข้อเสียคือ OpenRouter เพิ่มอีกชั้นหนึ่งระหว่างแอปของคุณกับผู้ให้บริการโมเดล ซึ่งอาจสร้างการพึ่งพาเพิ่มเติม ความแปรผันของดีเลย์ และพฤติกรรมเฉพาะผู้ให้บริการที่ยังต้องทดสอบ

สำหรับเวิร์กโหลดโปรดักชัน ทีมควรทบทวนการตั้งค่า Routing พฤติกรรมสำรอง การให้คะแนนผู้ให้บริการ และการควบคุมความเป็นส่วนตัว ก่อนส่งทราฟฟิกที่อ่อนไหวหรือสำคัญต่อธุรกิจผ่านแพลตฟอร์ม

เหมาะสำหรับ: แอปหลายโมเดล การเปรียบเทียบโมเดล การกำหนดเส้นทางสำรอง ความยืดหยุ่นของผู้ให้บริการ และการทดลองที่รวดเร็ว

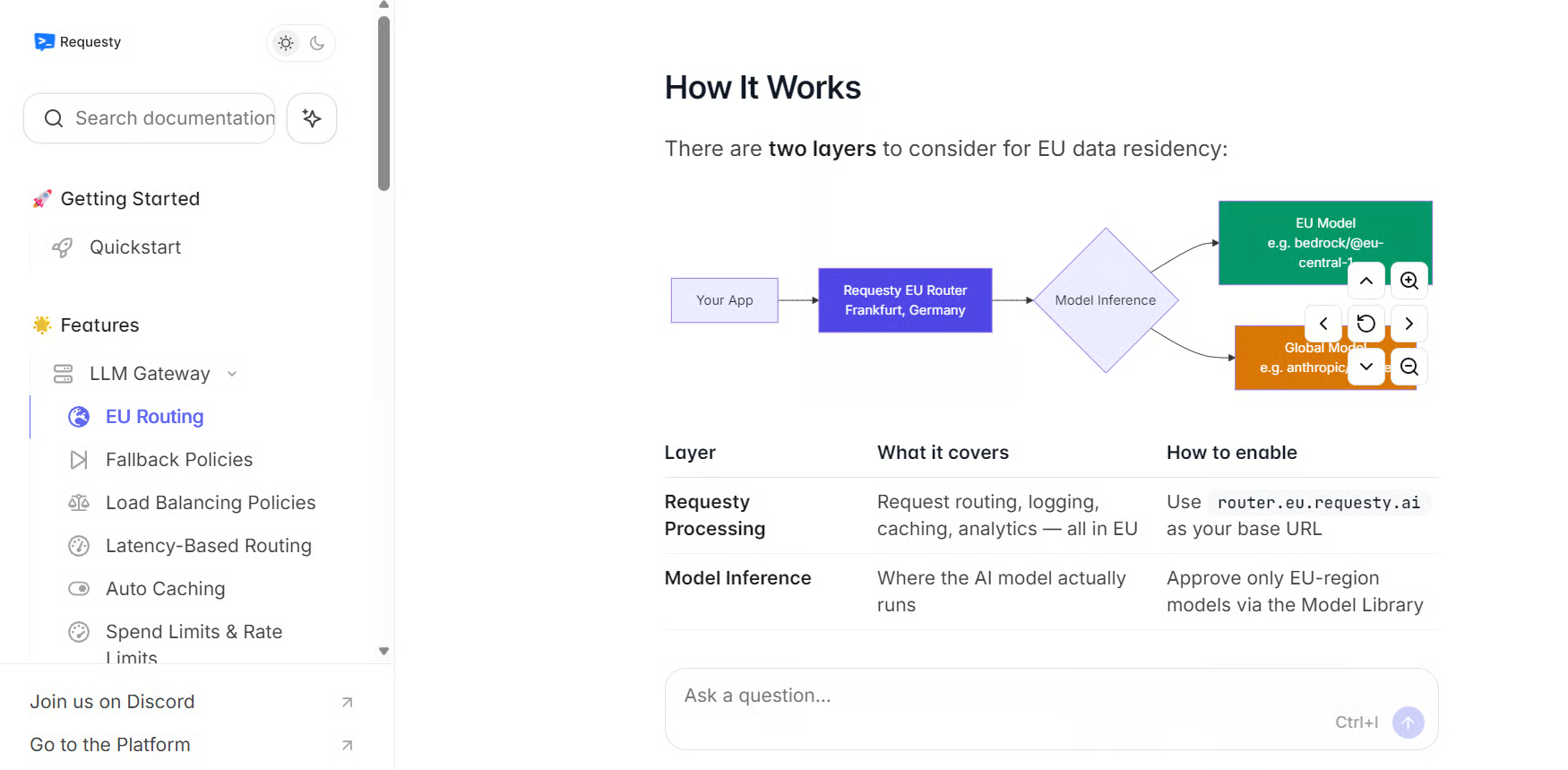

8. Requesty.ai

Requesty.ai เป็นแพลตฟอร์ม LLM Routing และเกตเวย์ที่ช่วยทีมเชื่อมต่อกับผู้ให้บริการ LLM หลายเจ้า ผ่าน API เดียวที่เข้ากันได้กับ OpenAI รองรับมากกว่า 400 โมเดล พร้อมฟีเจอร์สำหรับ Routing สำรอง แคช การจัดการค่าใช้จ่าย การสังเกตการณ์ และธรรมาภิบาล

Requesty.ai เป็นตัวเลือกที่แข็งแกร่งสำหรับทีมที่สร้างแอป AI ระดับโปรดักชันซึ่งพึ่งพาผู้ให้บริการมากกว่าหนึ่งราย เหมาะอย่างยิ่งสำหรับการจัดการนโยบาย Routing ติดตามการใช้งาน ควบคุมการใช้จ่าย และปรับปรุงความเชื่อถือได้เมื่อผู้ให้บริการล่ม หมดเวลา หรือชนลิมิตเรต

ที่มา: เอกสาร Requesty AI

เช่นเดียวกับ OpenRouter ข้อเสียสำคัญคือ Requesty.ai เพิ่มชั้นเกตเวย์อีกชั้นในสแตกของแอป ทีมต้องตั้งค่า Routing เส้นทางสำรอง โลก และธรรมาภิบาลอย่างรอบคอบเพื่อหลีกเลี่ยงต้นทุน ดีเลย์ หรือพฤติกรรมไม่คาดคิดของผู้ให้บริการ

สำหรับงานที่อ่อนไหว Requesty.ai มีคอนโทรลอย่างการตรวจจับข้อมูล PII การลบข้อมูล การ์ดเรลด้านคอนเทนต์ บันทึกการตรวจสอบ และฟีเจอร์ธรรมาภิบาล แต่ทีมยังคงต้องตัดสินใจว่าอนุญาตให้ข้อมูลใดผ่านเกตเวย์ได้บ้าง และจะจัดการล็อกอย่างไร

เหมาะสำหรับ: LLM Routing การควบคุมต้นทุน การสังเกตการณ์ เส้นทางสำรองผู้ให้บริการ ธรรมาภิบาล และเวิร์กโฟลว์เกตเวย์ AI ระดับโปรดักชัน

ผู้ให้บริการ LLM บนคลาวด์

ผู้ให้บริการ LLM บนคลาวด์คือแพลตฟอร์มคลาวด์ขนาดใหญ่ที่เปิดให้นักพัฒนาและองค์กรเข้าถึงโมเดลฐานแบบจัดการได้ แพลตฟอร์มเหล่านี้มักรองรับทั้งโมเดลของตนเองและโมเดลจากผู้ให้บริการภายนอก

มีประโยชน์อย่างยิ่งสำหรับองค์กรที่ใช้งานโครงสร้างพื้นฐานคลาวด์อยู่แล้ว และต้องการความปลอดภัย ธรรมาภิบาล การปฏิบัติตามมาตรฐาน การผสานข้อมูล การควบคุมการดีพลอย และการจัดการโมเดลในที่เดียว

9. Google Vertex AI

Google Vertex AI คือแพลตฟอร์มแมชชีนเลิร์นนิงและเจนเนอเรทีฟ AI ของ Google Cloud เปิดให้นักพัฒนาและองค์กรเข้าถึงโมเดล Gemini, Model Garden เครื่องมือเอเจนต์ และโครงสร้างพื้นฐานแบบจัดการสำหรับการสร้าง ดีพลอย และจัดการแอป AI

Vertex AI ยังรองรับพันธมิตรชั้นนำและโมเดลเปิดผ่าน Model Garden รวมถึง Anthropic Claude, xAI Grok, โมเดลของ Mistral AI และโมเดลโอเพนซอร์สอย่าง GLM 5 และ Gemma 4 ควบคู่ไปกับโมเดล Gemini ของ Google

ที่มา: Generative AI บน Vertex AI

Google Vertex AI เป็นตัวเลือกที่แข็งแกร่งสำหรับทีมที่ใช้ Google Cloud อยู่แล้ว และต้องการการดีพลอยโมเดลแบบคลาวด์เนทีฟ ธรรมาภิบาล คอนโทรลด้านความปลอดภัย และการผสานกับระบบข้อมูลและ AI ของ Google

ในอีกมุมหนึ่ง Vertex AI อาจซับซ้อนกว่าการใช้ API โมเดลแบบง่าย ทีมอาจต้องมีประสบการณ์ Google Cloud เพื่อจัดการโปรเจกต์ สิทธิ์เรียกใช้งาน บิลลิง การตั้งค่าดีพลอย และการผสานระบบอย่างถูกต้อง

สำหรับงานที่อ่อนไหว Vertex AI มีประโยชน์สำหรับทีมที่ต้องการคอนโทรลการเข้าถึงระดับคลาวด์ ธรรมาภิบาล และโครงสร้างพื้นฐานแบบจัดการ แต่การตัดสินใจตั้งค่าเกี่ยวกับการบันทึก การเข้าถึงข้อมูล และภูมิภาคการดีพลอยยังต้องพิจารณาอย่างรอบคอบ

เหมาะสำหรับ: ผู้ใช้ Google Cloud การเข้าถึง Gemini แอป AI สำหรับองค์กร เวิร์กโฟลว์มัลติโหมด และการดีพลอยโมเดลแบบคลาวด์เนทีฟ

10. Amazon Bedrock

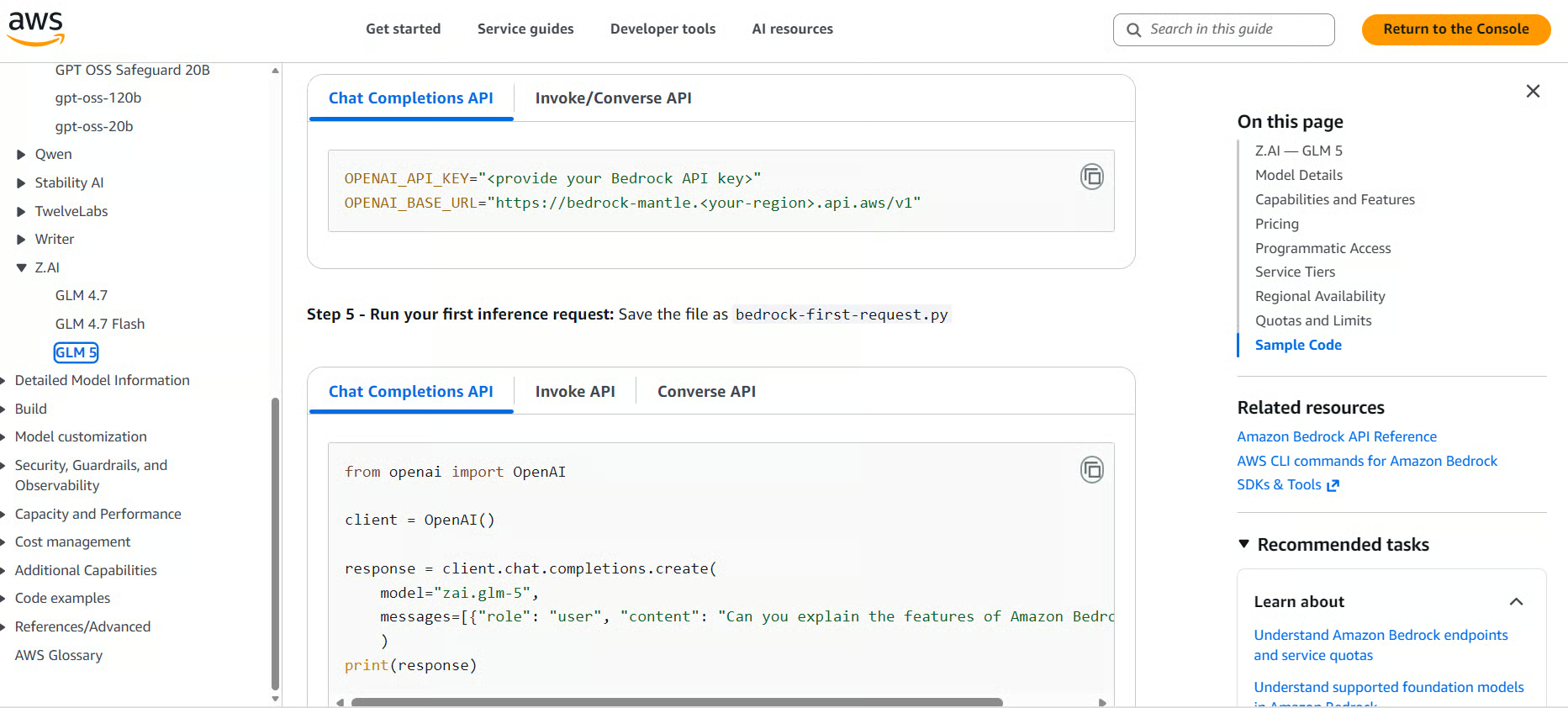

Amazon Bedrock คือแพลตฟอร์มเจนเนอเรทีฟ AI แบบจัดการของ AWS เปิดให้นักพัฒนาเข้าถึงโมเดลฐานจาก Amazon และผู้ให้บริการภายนอกผ่านบริการ AWS แบบจัดการเดียว

Bedrock รองรับโมเดลจากผู้ให้บริการอย่าง Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek และอื่น ๆ ทำให้มีประโยชน์สำหรับทีมที่ต้องการตัวเลือกโมเดลภายในระบบนิเวศ AWS

Amazon Bedrock เป็นตัวเลือกที่แข็งแกร่งสำหรับบริษัทที่สร้างบน AWS อยู่แล้ว เพราะรวมการเข้าถึงโมเดล โครงสร้างพื้นฐานคลาวด์ คอนโทรลความปลอดภัย และการผสานระบบสำหรับองค์กรไว้ในแพลตฟอร์มเดียว

ที่มา: Amazon Bedrock

ข้อเสียสำคัญคือ Bedrock อาจซับซ้อนกว่าการใช้ LLM API พื้นฐาน ทีมอาจต้องมีประสบการณ์ AWS เพื่อจัดการสิทธิ์ ภูมิภาค การเข้าถึงโมเดล ราคา เน็ตเวิร์ก และการตั้งค่าดีพลอยอย่างถูกต้อง

สำหรับงานที่อ่อนไหว Bedrock มีประโยชน์เพราะพรอมต์และเอาต์พุตจะไม่ถูกใช้เทรนโมเดลฐานหรือแชร์กับผู้ให้บริการโมเดล และทีมสามารถใช้คอนโทรลของ AWS เช่น การเข้ารหัส IAM และ PrivateLink

เหมาะสำหรับ: ผู้ใช้ AWS แอป AI สำหรับองค์กร การเข้าถึงโมเดลฐานแบบจัดการ การดีพลอยที่เน้นความปลอดภัย และแอปเจนเนอเรทีฟ AI แบบคลาวด์เนทีฟ

ตารางเปรียบเทียบผู้ให้บริการ LLM API

ตารางด้านล่างเปรียบเทียบผู้ให้บริการ LLM API ชั้นนําโดยอิงจากจุดเด่นและข้อเสียหลักของแต่ละราย

|

ผู้ให้บริการ |

จุดเด่นสำคัญ |

ข้อเสียหลัก |

|

OpenAI |

คุณภาพโมเดลแข็งแกร่ง API ที่ครบถ้วน เครื่องมือมัลติโหมด เอาต์พุตแบบมีโครงสร้าง Embeddings เสียง สร้างภาพ และเวิร์กโฟลว์เชิงเอเจนต์ |

มีค่าใช้จ่ายสูงเมื่อสเกล และให้การควบคุมน้อยกว่าโมเดลโอเพนซอร์สหรือแบบโฮสต์เอง |

|

Anthropic |

คุณภาพงานเขียนดีเยี่ยม ทำตามคำสั่งอย่างรอบคอบ ให้เหตุผล เขียนโค้ด และรองรับบริบทยาว |

ต้นทุนอาจสูงเมื่อใช้เอกสารใหญ่หรือปริมาณมาก และทีมควบคุมโฮสติ้งกับภายในโมเดลได้จำกัด |

|

Google Gemini |

ความสามารถมัลติโหมดแข็งแกร่ง API เรียลไทม์ รองรับบริบทยาว และผสานแน่นกับระบบนิเวศ AI ของ Google |

อาจรู้สึกว่าผูกกับระบบนิเวศของ Google และราคา การมีให้บริการ และฟีเจอร์อาจต่างกันตามเครื่องมือหรือภูมิภาค |

|

Together AI |

เข้าถึงโมเดลเปิดและเฉพาะทางจำนวนมาก พร้อมอินเฟอเรนซ์แบบเซิร์ฟเวอร์เลส เอ็นด์พอยต์เฉพาะ ปรับจูน การประเมินผล และโครงสร้างพื้นฐาน GPU |

คุณภาพ ความเร็ว และความเชื่อถือได้ขึ้นกับโมเดลที่เลือก |

|

Fireworks AI |

อินเฟอเรนซ์เร็ว ดีเลย์ต่ำ เข้าถึงแบบเซิร์ฟเวอร์เลส ดีพลอยตามต้องการ และ API พร้อมโปรดักชันสำหรับโมเดลเปิด |

โฟกัสที่อินเฟอเรนซ์และการดีพลอยมากกว่าจะเป็นแพลตฟอร์มพัฒนา AI แบบครบวงจร |

|

Nebius AI |

โครงสร้างพื้นฐานรองรับ GPU อินเฟอเรนซ์แบบโฮสต์ API เข้ากันได้กับ OpenAI และระดับความเร็วอย่าง Fast และ Base |

มุ่งเน้นโครงสร้างพื้นฐาน ทำให้ทีมต้องมีความรู้คลาวด์และการดีพลอยที่แข็งแรง |

|

OpenRouter |

เข้าถึงหลายโมเดลผ่าน API เดียวที่เข้ากันได้กับ OpenAI สลับผู้ให้บริการและตั้งค่าสำรองได้ง่าย |

เพิ่มอีกชั้นระหว่างแอปกับผู้ให้บริการ ซึ่งอาจกระทบดีเลย์ ความเชื่อถือได้ หรือการดีบัก |

|

Requesty.ai |

API เดียวสำหรับหลายผู้ให้บริการ พร้อม Routing สำรอง แคช ติดตามต้นทุน การสังเกตการณ์ และฟีเจอร์ธรรมาภิบาล |

ต้องตั้งค่า Routing การล็อก เส้นทางสำรอง และการควบคุมต้นทุนอย่างรอบคอบเพื่อหลีกเลี่ยงพฤติกรรมไม่คาดคิด |

|

Google Vertex AI |

เข้าถึงแบบจัดการสำหรับ Gemini, Anthropic Claude, xAI Grok, Mistral AI และโมเดลเปิดผ่าน Model Garden พร้อมเครื่องมือความปลอดภัยและธรรมาภิบาลของ Google Cloud |

ซับซ้อนกว่า API แบบง่าย และอาจต้องมีประสบการณ์ Google Cloud |

|

Amazon Bedrock |

เข้าถึงแบบจัดการสำหรับโมเดลจาก Amazon และผู้ให้บริการภายนอกอย่าง Anthropic, Meta, Mistral AI, Cohere และอื่น ๆ ภายใน AWS |

ซับซ้อนกว่า LLM API พื้นฐาน โดยเฉพาะเรื่องสิทธิ์ ภูมิภาค ราคา และการเข้าถึงโมเดล |

การเลือกผู้ให้บริการ LLM API ที่เหมาะกับเคสการใช้งาน

การเลือกผู้ให้บริการ LLM API ที่เหมาะสมขึ้นอยู่กับ 3 ปัจจัย:

- กำลังสร้างอะไร

- ต้องการการควบคุมมากแค่ไหน

- พร้อมใช้จ่ายเท่าไร

สำหรับสตาร์ทอัปและทีมขนาดเล็ก ผู้ให้บริการ LLM API แบบโอเพนซอร์สมักเป็นจุดเริ่มต้นที่ดี แพลตฟอร์มอย่าง Together AI, Fireworks AI และ Nebius AI เปิดให้เข้าถึงโมเดลเปิดที่ทรงพลัง โดยไม่ต้องจัดการ GPU หรือโครงสร้างพื้นฐานเอง ซึ่งอาจเร็วกว่า ถูกกว่า และยืดหยุ่นกว่าสำหรับการทดลองและพัฒนาผลิตภัณฑ์ระยะเริ่มต้น

หากต้องการทดสอบโมเดลที่ต่างกันอย่างรวดเร็ว ผู้ให้บริการ LLM แบบ Routing เป็นตัวเลือกที่แข็งแกร่ง เครื่องมืออย่าง OpenRouter และ Requesty.ai ช่วยให้เปรียบเทียบโมเดลแบบปิดและโอเพนซอร์สผ่าน API เดียว จัดการเส้นทางสำรอง และสลับผู้ให้บริการโดยไม่ต้องเขียนแอปใหม่

สำหรับเวิร์กโฟลว์ที่คุณภาพโมเดลสำคัญกว่าต้นทุน ผู้ให้บริการแบบ Native อย่าง OpenAI และ Anthropic ยังเป็นตัวเลือกที่แข็งแกร่ง เหมาะอย่างยิ่งสำหรับผู้ช่วย AI ระดับโปรดักชัน เครื่องมือเขียนโค้ด เวิร์กโฟลว์ที่เน้นเหตุผล แอปมัลติโหมด และระบบเชิงเอเจนต์ที่ความเชื่อถือได้และประสิทธิภาพโมเดลมีความสำคัญสูงสุด

สุดท้าย หากบริษัทใช้งานบน AWS หรือ Google Cloud อยู่แล้ว มักสมเหตุสมผลที่จะอยู่ในระบบนิเวศนั้น Amazon Bedrock และ Google Vertex AI มอบการเข้าถึงโมเดลแบบจัดการ คอนโทรลความปลอดภัย ธรรมาภิบาล และการผสานกับเครื่องมือที่ทีมใช้อยู่เดิม

ข้อคิดส่งท้าย

สำหรับงานเทคนิค ผู้ช่วยเขียนโค้ด และเครื่องมือโค้ดเชิงครีเอต ผมจะไม่ทดลองมากเกินไปในช่วงเริ่มต้น จากประสบการณ์ OpenAI และ Anthropic มักเป็นตัวเลือกที่ปลอดภัยกว่า เพราะแข็งแกร่งด้านการเขียนโค้ด การให้เหตุผล และเครื่องมือนักพัฒนา

ผู้ให้บริการ LLM API แบบโอเพนซอร์สและผู้ให้บริการ LLM แบบ Routing เป็นทางเลือกที่แข็งแกร่งสำหรับการทดลองขั้นสูง

ผู้ให้บริการ LLM บนคลาวด์ขนาดใหญ่โดยมากเหมาะกับสภาพแวดล้อมองค์กรเท่านั้น กรณีนี้ควรเลือกใช้ระบบนิเวศที่ใช้อยู่แล้ว

คำถามที่พบบ่อยเกี่ยวกับผู้ให้บริการ LLM API

What is an LLM API provider?

บริษัทหรือแพลตฟอร์มที่โฮสต์โมเดลภาษาขนาดใหญ่และเปิดให้ใช้งานผ่าน API เพื่อให้นักพัฒนาส่งคำขอและรับคำตอบที่สร้างโดย AI ได้ โดยไม่ต้องจัดการ GPU หรือโครงสร้างพื้นฐานอินเฟอเรนซ์ด้วยตนเอง

What's the difference between a native LLM provider and a cloud LLM provider?

ผู้ให้บริการแบบ Native (เช่น OpenAI และ Anthropic) จะสร้างและให้บริการโมเดลของตนเองโดยตรง ผู้ให้บริการบนคลาวด์ (เช่น AWS Bedrock และ Google Vertex AI) จะเปิดให้เข้าถึงโมเดลจากผู้ให้บริการภายนอกหลายรายแบบจัดการ ภายในระบบนิเวศคลาวด์ที่มีเครื่องมือความปลอดภัยและธรรมาภิบาลสำหรับองค์กร

When should I use an LLM routing provider like OpenRouter or Requesty.ai?

เมื่อจำเป็นต้องทำงานกับมากกว่าหนึ่งโมเดลหรือผู้ให้บริการ ต้องการเส้นทางสำรองอัตโนมัติหากผู้ให้บริการล่ม หรืออยากเปรียบเทียบโมเดลและควบคุมต้นทุน ทั้งหมดนี้ผ่านการผสาน API ครั้งเดียว

Are open-source LLM API providers less capable than native providers like OpenAI?

ไม่จำเป็นเสมอไป ขึ้นอยู่กับงาน แพลตฟอร์มอย่าง Together AI และ Fireworks AI โฮสต์โมเดลเปิดล้ำสมัยอย่าง Llama, DeepSeek และ Mistral ซึ่งแข่งขันกับโมเดลปิดได้ บ่อยครั้งในต้นทุนที่ต่ำกว่ามาก

Which LLM API provider is best for enterprises with strict compliance requirements?

Amazon Bedrock และ Google Vertex AI มักเป็นตัวเลือกที่แข็งแกร่งที่สุด เพราะมีคอนโทรลความปลอดภัยแบบคลาวด์เนทีฟ IAM การเข้ารหัส บันทึกตรวจสอบ และฟีเจอร์ธรรมาภิบาลที่ผสานกับโครงสร้างพื้นฐานขององค์กรที่มีอยู่