Tracks

Các nhà cung cấp API Large Language Model (LLM) cho phép nhà phát triển truy cập các mô hình AI mạnh mẽ mà không cần quản lý GPU, triển khai mô hình, mở rộng hay hạ tầng suy luận. Thay vì tự lưu trữ mô hình, nhà phát triển có thể kết nối tới một API, chọn mô hình, gửi yêu cầu và nhận phản hồi.

Trong bài viết này, chúng ta sẽ xem xét 10 nhà cung cấp API LLM hàng đầu dựa trên chất lượng mô hình, trải nghiệm dành cho nhà phát triển, mức giá, khả năng mở rộng, hỗ trợ hệ sinh thái và mức độ sẵn sàng cho sản xuất. Với mỗi nhà cung cấp, chúng tôi sẽ nêu rõ phù hợp nhất cho nhu cầu nào, các lợi thế chính và những hạn chế mà nhà phát triển cần cân nhắc.

Hướng dẫn này phân loại các nhà cung cấp API LLM hàng đầu thành bốn nhóm:

- Nhà cung cấp LLM native

- Nhà cung cấp API LLM mã nguồn mở

- Nhà cung cấp định tuyến LLM

- Nhà cung cấp LLM trên đám mây

Nhà cung cấp LLM Native

Các nhà cung cấp LLM native tự xây dựng, huấn luyện và phục vụ các họ mô hình của riêng họ thông qua API. Đây thường là lựa chọn mạnh mẽ nhất cho nhà phát triển muốn chất lượng mô hình cao, tài liệu đáng tin cậy, khả năng suy luận nâng cao, hỗ trợ đa phương thức và công cụ sẵn sàng cho sản xuất.

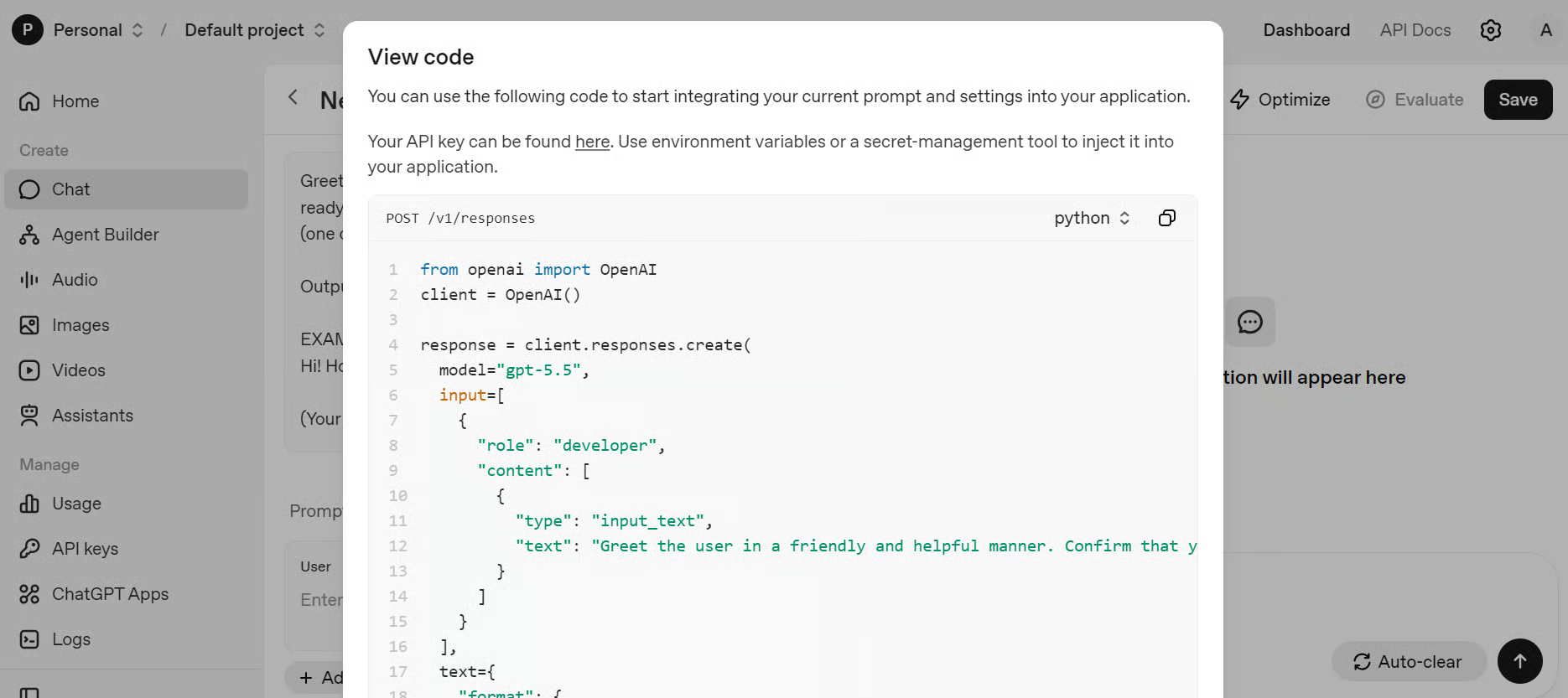

1. OpenAI

OpenAI là một trong các nhà cung cấp API LLM được sử dụng rộng rãi nhất. Nền tảng API của họ cung cấp quyền truy cập vào:

- Các mô hình suy luận tiên phong như GPT-5.5

- Tạo giọng nói thời gian thực và dịch qua GPT-Realtime-2

- Tạo ảnh thông qua mô hình tạo ảnh GPT-Images-2.0

- Phát triển dựa trên agent thông qua OpenAI Agents SDK

API của họ hỗ trợ streaming, giao diện thời gian thực và đầu ra có cấu trúc.

OpenAI là lựa chọn mạnh cho các đội nhóm xây dựng trợ lý AI, công cụ lập trình, agent hỗ trợ khách hàng, copilots nội bộ, ứng dụng đa phương thức và hệ thống dựa trên agent.

Nguồn: OpenAI

Một hạn chế là OpenAI có thể trở nên tốn kém khi mở rộng quy mô, đặc biệt với các ứng dụng lưu lượng lớn hoặc đòi hỏi suy luận nặng. Đây cũng là nhà cung cấp API đóng, nghĩa là nhà phát triển ít kiểm soát hơn đối với nội bộ mô hình, lưu trữ và tùy biến so với mô hình mã nguồn mở hoặc tự lưu trữ.

Phù hợp nhất cho: ứng dụng AI mục đích chung, suy luận, lập trình, quy trình đa phương thức và sản phẩm AI sẵn sàng cho sản xuất.

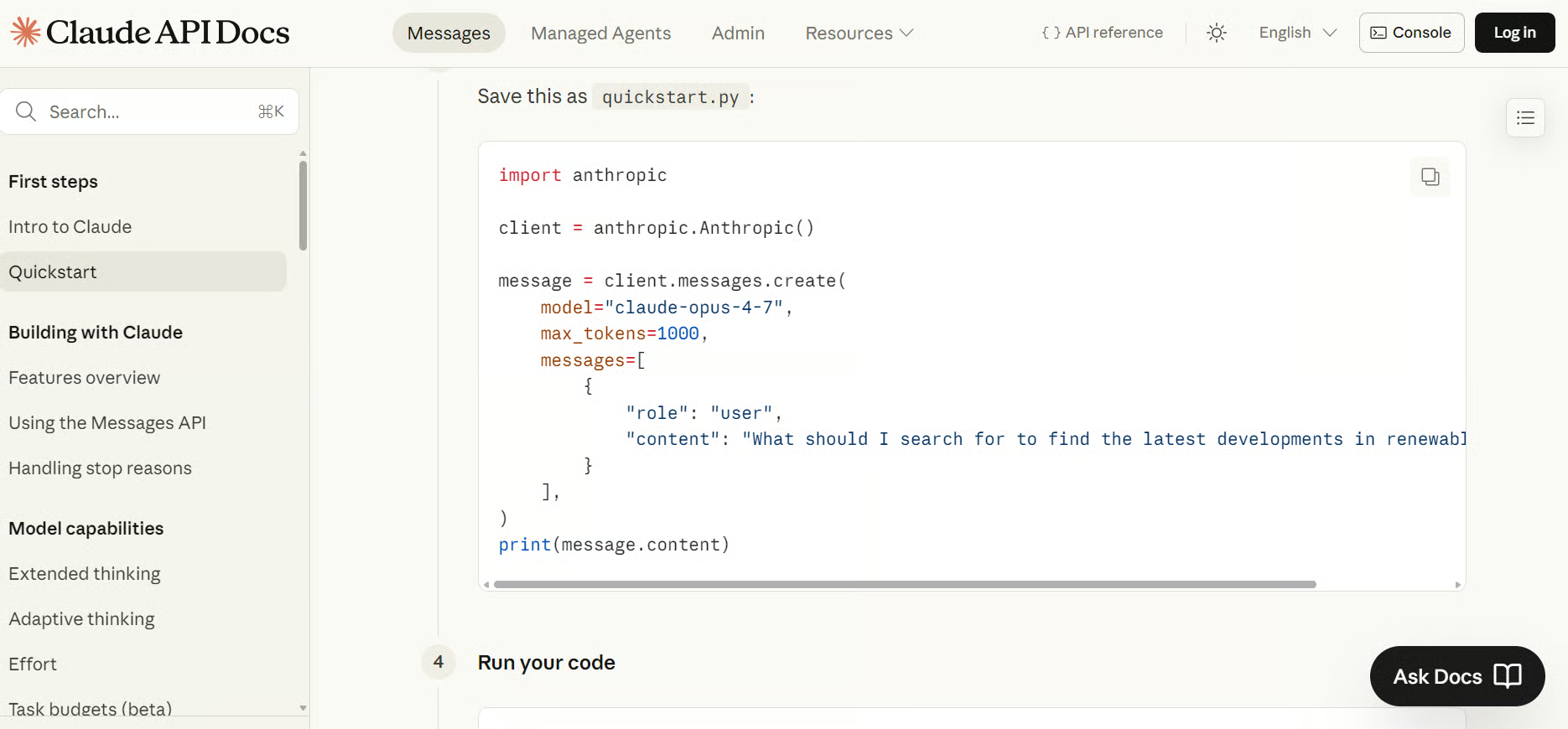

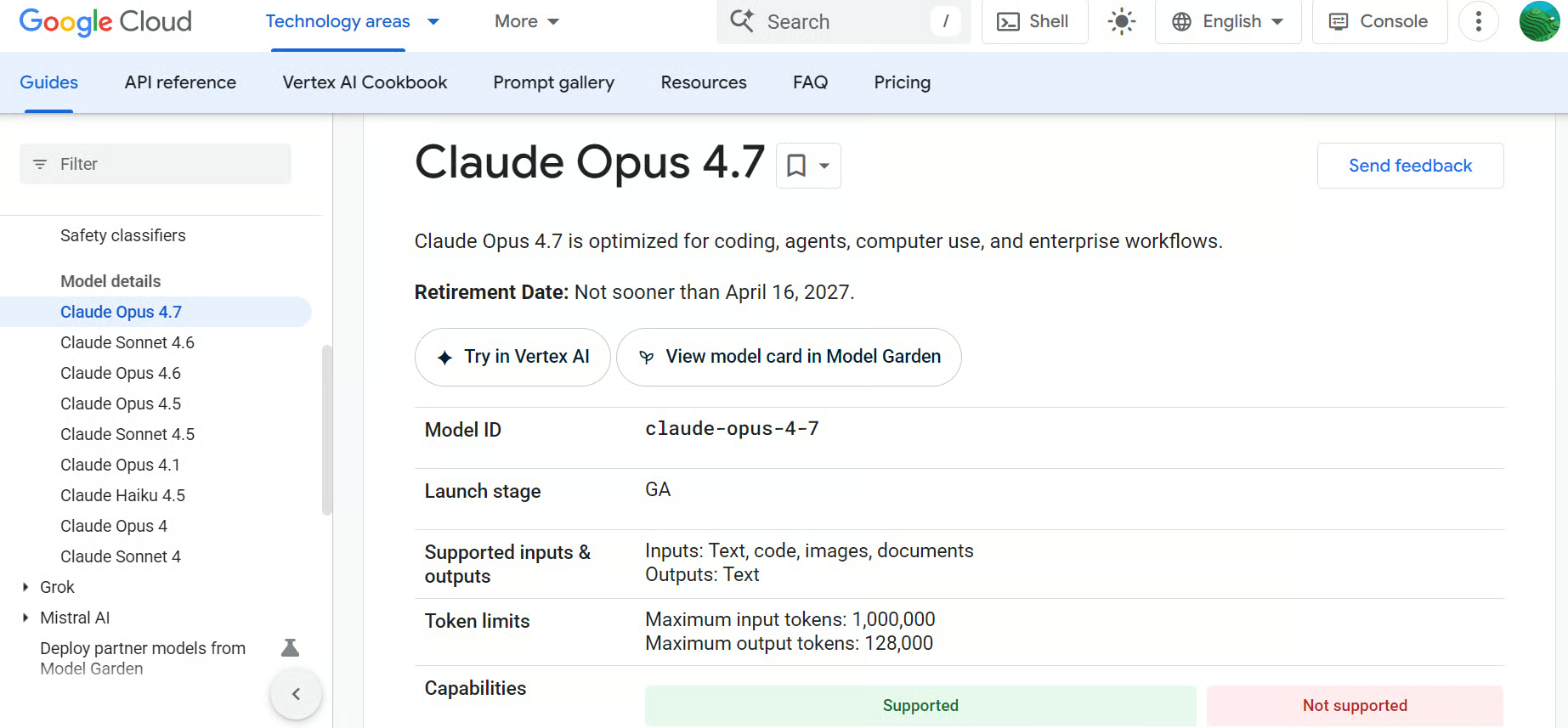

2. Anthropic

Anthropic cung cấp họ mô hình Claude thông qua API, ví dụ mẫu flagship mới nhất Claude Opus 4.7. Claude được thiết kế cho ngôn ngữ, suy luận, phân tích, lập trình, ngữ cảnh dài và quy trình dựa trên agent. Nền tảng dành cho nhà phát triển của Anthropic cung cấp quyền truy cập mô hình trực tiếp qua API, SDK và tài liệu.

Claude đặc biệt hữu ích cho các ứng dụng cần tuân thủ hướng dẫn cẩn trọng, chất lượng viết tốt, phân tích tài liệu và xử lý đáng tin cậy các prompt phức tạp.

Nguồn: Bắt đầu với Claude

Một hạn chế chính là chi phí, nhất là khi dùng Claude cho tài liệu lớn, prompt ngữ cảnh dài hoặc ứng dụng lưu lượng cao. Vì Claude được truy cập qua API được lưu trữ, các đội nhóm cũng bị hạn chế về nơi và cách mô hình chạy.

Với các trường hợp nhạy cảm về quyền riêng tư, nhà phát triển cần xem xét kỹ yêu cầu về xử lý dữ liệu, lưu giữ và tuân thủ trước khi gửi dữ liệu kinh doanh hoặc khách hàng mật qua API.

Phù hợp nhất cho: trợ lý lập trình, AI doanh nghiệp, phân tích ngữ cảnh dài, quy trình tài liệu và AI agents.

Để so sánh chi tiết giữa hai ông lớn AI, hãy xem hướng dẫn của chúng tôi về Anthropic vs OpenAI.

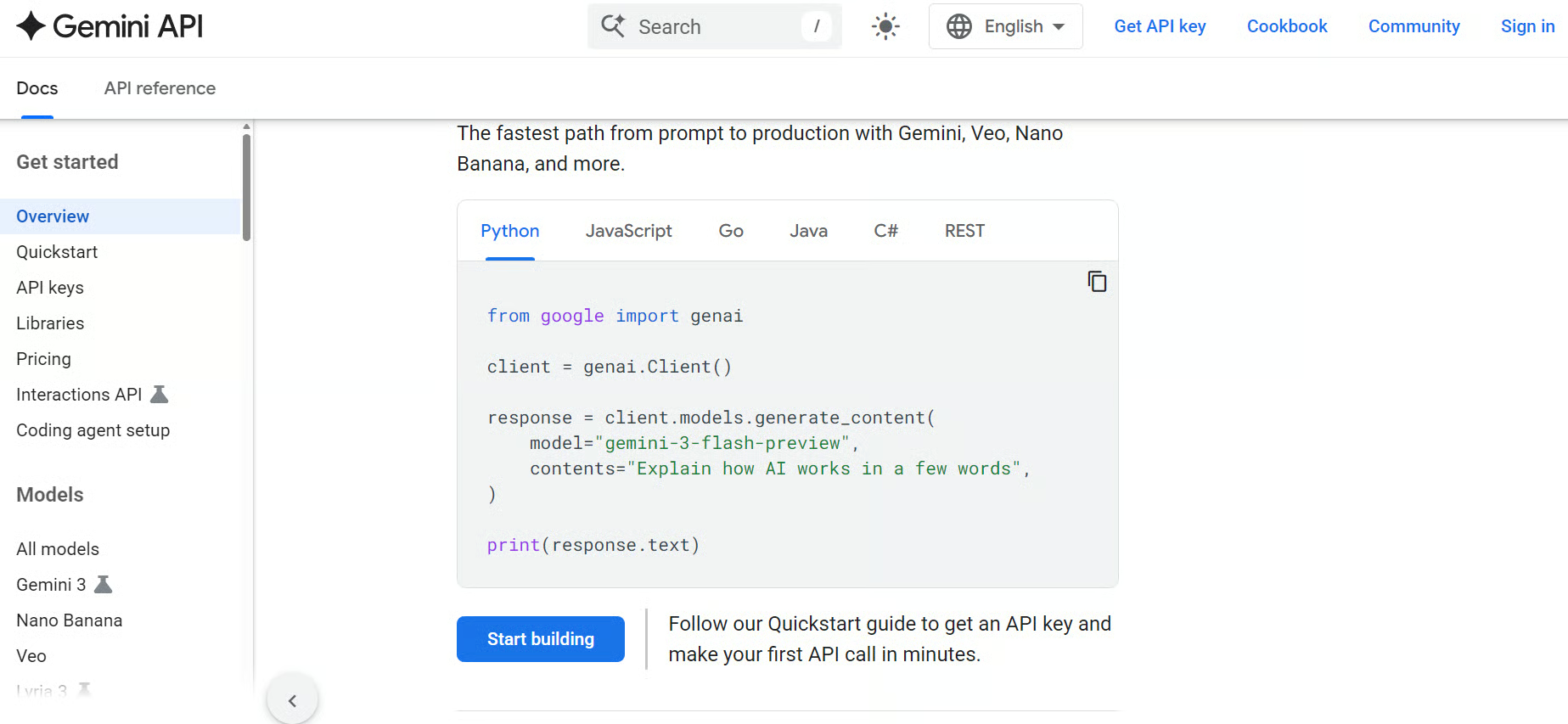

3. Google Gemini

Google Gemini là họ LLM native của Google, bao gồm Gemini 3.1 Pro, khả dụng qua Gemini API cho nhà phát triển. Gemini API hỗ trợ API tiêu chuẩn, streaming và thời gian thực, cùng tài liệu về chi tiết mô hình, SDK, giá, thiết lập và tham chiếu API.

Với Nano Banana 2 cho tạo ảnh và Veo 3.1 được tích hợp, Gemini là lựa chọn mạnh cho nhà phát triển xây dựng ứng dụng đa phương thức. Đây cũng là lựa chọn tốt cho trợ lý AI (đặc biệt những ứng dụng dựa vào trải nghiệm tìm kiếm), công cụ lập trình và các sản phẩm kết nối với hệ sinh thái AI rộng hơn của Google.

Nguồn: Gemini API

Tuy nhiên, Gemini có thể gắn chặt hơn với hệ sinh thái Google, điều này có thể không phù hợp với các đội muốn thiết lập trung lập với nhà cung cấp. Giá cả, tính sẵn sàng của mô hình và hỗ trợ tính năng cũng có thể khác nhau giữa các công cụ và khu vực.

Với các ứng dụng nhạy cảm về quyền riêng tư, các đội cần xem xét yêu cầu xử lý dữ liệu, lưu giữ và tuân thủ trước khi gửi dữ liệu kinh doanh hoặc khách hàng mật qua API.

Phù hợp nhất cho: ứng dụng AI đa phương thức, tích hợp hệ sinh thái Google, quy trình ngữ cảnh dài, lập trình và ứng dụng AI mục đích chung.

Nhà cung cấp API LLM mã nguồn mở

Các nhà cung cấp API LLM mã nguồn mở cung cấp cho nhà phát triển quyền truy cập API được lưu trữ đối với các mô hình mã nguồn mở và mở trọng số. Thay vì tải mô hình về và chạy trên GPU của bạn, các nền tảng này lưu trữ mô hình và cung cấp qua các API đơn giản.

Những nhà cung cấp này hữu ích cho đội nhóm muốn chi phí thấp hơn, linh hoạt mô hình cao hơn, thử nghiệm nhanh hơn và truy cập các mô hình mở phổ biến như Llama, DeepSeek, Qwen, Mistral, Gemma và các mô hình khác.

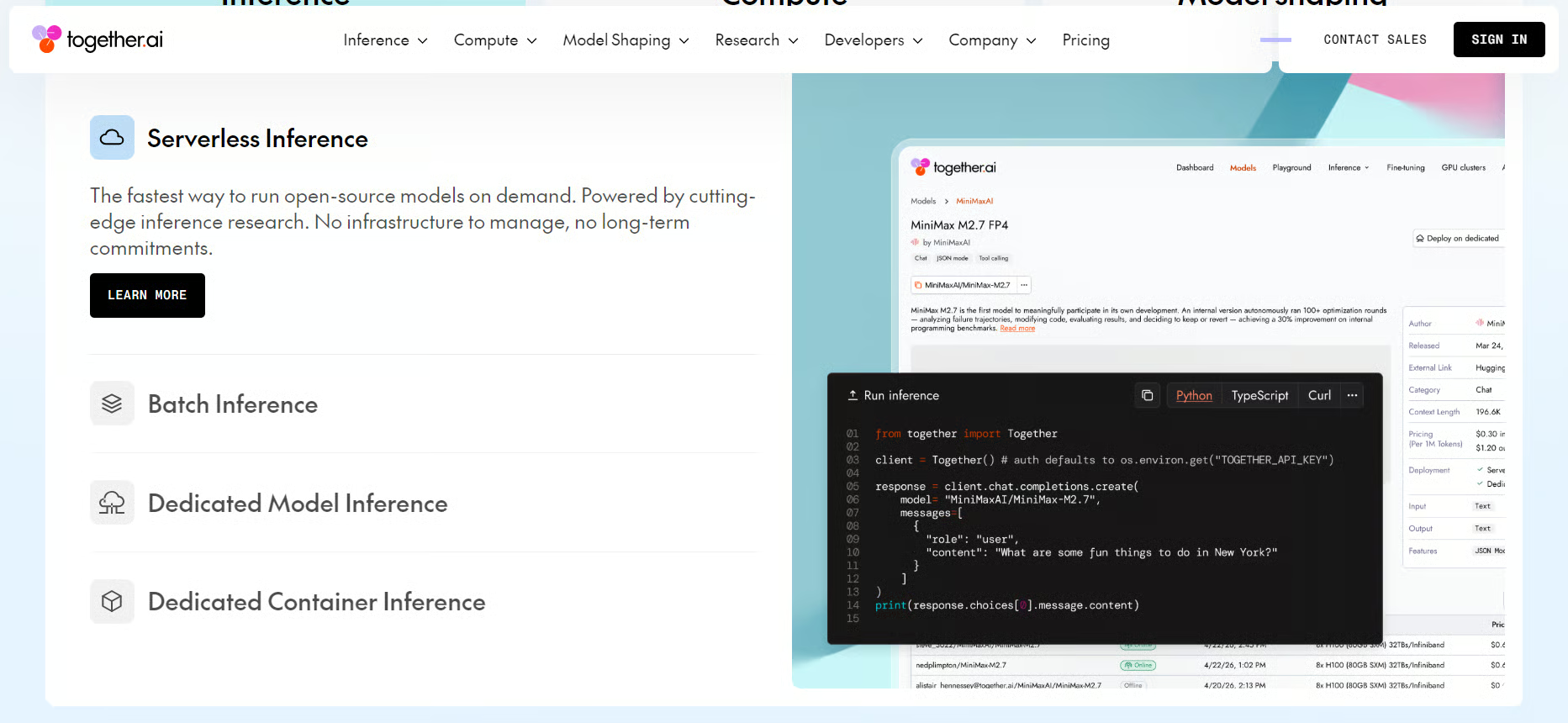

4. Together AI

Together AI cung cấp quyền truy cập được lưu trữ vào các mô hình mã nguồn mở và chuyên biệt thông qua một API hợp nhất. Danh mục mô hình của họ bao gồm hơn 200 mô hình về văn bản, ảnh, video, mã và âm thanh, với hỗ trợ suy luận serverless, suy luận theo lô, endpoint chuyên dụng, tinh chỉnh, đánh giá và cụm GPU.

Together AI là lựa chọn mạnh cho nhà phát triển muốn xây dựng với mô hình mở mà không cần tự quản lý hạ tầng. Đặc biệt hữu ích cho đội nhóm thử nghiệm nhiều mô hình, tinh chỉnh mô hình tùy chỉnh hoặc mở rộng tải suy luận.

Nguồn: Together AI

Tuy vậy, chất lượng, tốc độ và độ tin cậy của mô hình có thể thay đổi tùy mô hình được chọn. Các đội có thể cần nhiều thử nghiệm, đo chuẩn và đánh giá hơn trước khi dùng trong sản xuất.

Với khối lượng công việc nhạy cảm, các đội nên kiểm tra liệu cần truy cập serverless, endpoint chuyên dụng hay tùy chọn triển khai riêng để đáp ứng yêu cầu bảo mật và tuân thủ.

Phù hợp nhất cho: suy luận mô hình mã nguồn mở, tinh chỉnh, tải AI có thể mở rộng và thử nghiệm trên nhiều mô hình.

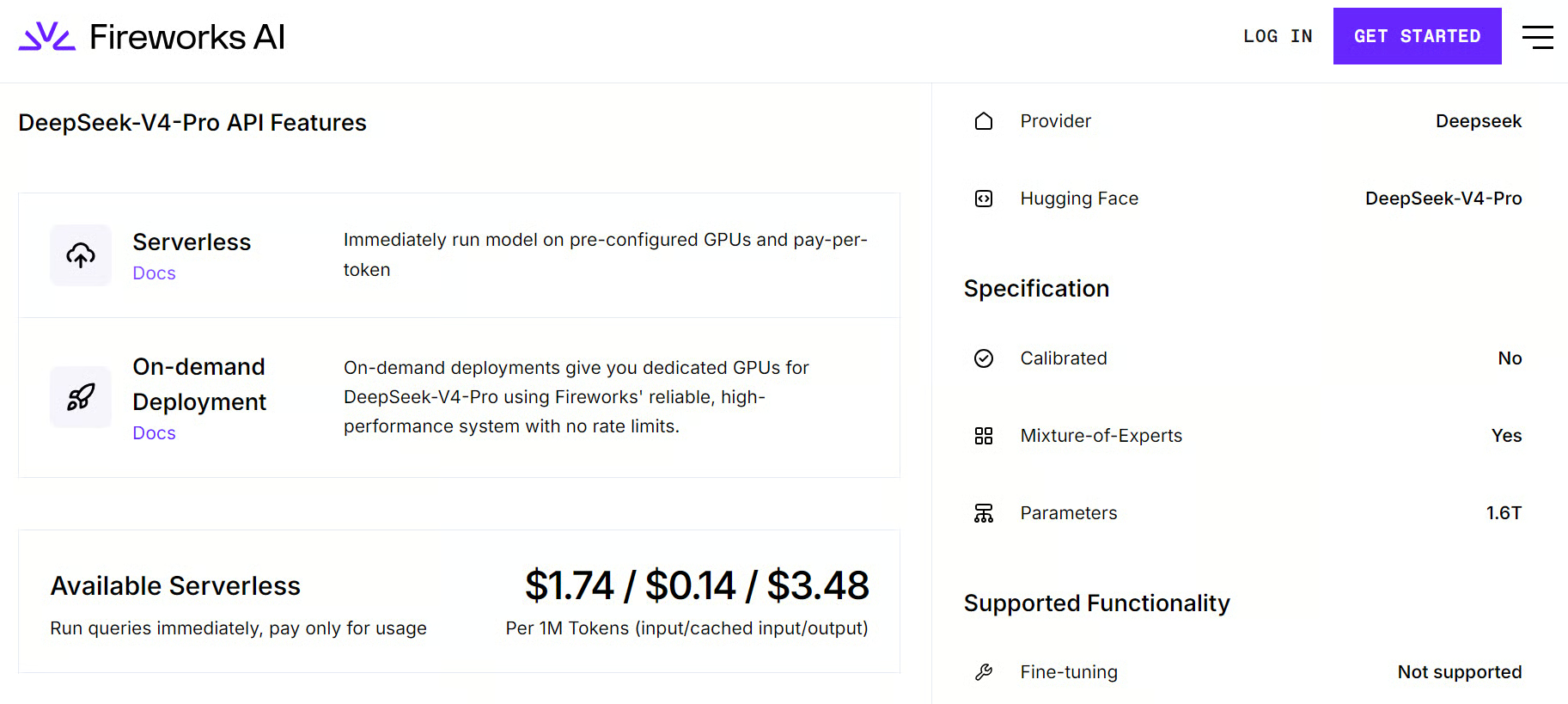

5. Fireworks AI

Fireworks AI tập trung vào suy luận nhanh cho các LLM mã nguồn mở và mô hình tạo sinh. Nền tảng hỗ trợ suy luận serverless, triển khai theo nhu cầu, tinh chỉnh và API sẵn sàng cho sản xuất đối với các mô hình mở phổ biến.

Fireworks AI là lựa chọn mạnh cho đội nhóm muốn sự linh hoạt của mô hình mở với suy luận nhanh hơn và độ trễ thấp hơn. Đặc biệt hữu ích cho hội thoại AI, trợ lý lập trình, tìm kiếm, ứng dụng đa phương thức và hệ thống RAG doanh nghiệp.

Nguồn: Fireworks AI

Một hạn chế chính là Fireworks AI tập trung nhiều vào suy luận và triển khai hơn là trở thành một nền tảng phát triển AI tất cả trong một toàn diện. Các đội có thể vẫn cần công cụ riêng cho điều phối, đánh giá, giám sát hoặc quy trình agent phức tạp.

Các đội cũng nên cân nhắc liệu suy luận serverless đủ cho khối lượng công việc nhạy cảm hay cần triển khai chuyên dụng để kiểm soát tốt hơn về hiệu năng và tuân thủ.

Phù hợp nhất cho: suy luận nhanh với mô hình mở, tinh chỉnh, ứng dụng AI sản xuất và triển khai mô hình mở độ trễ thấp.

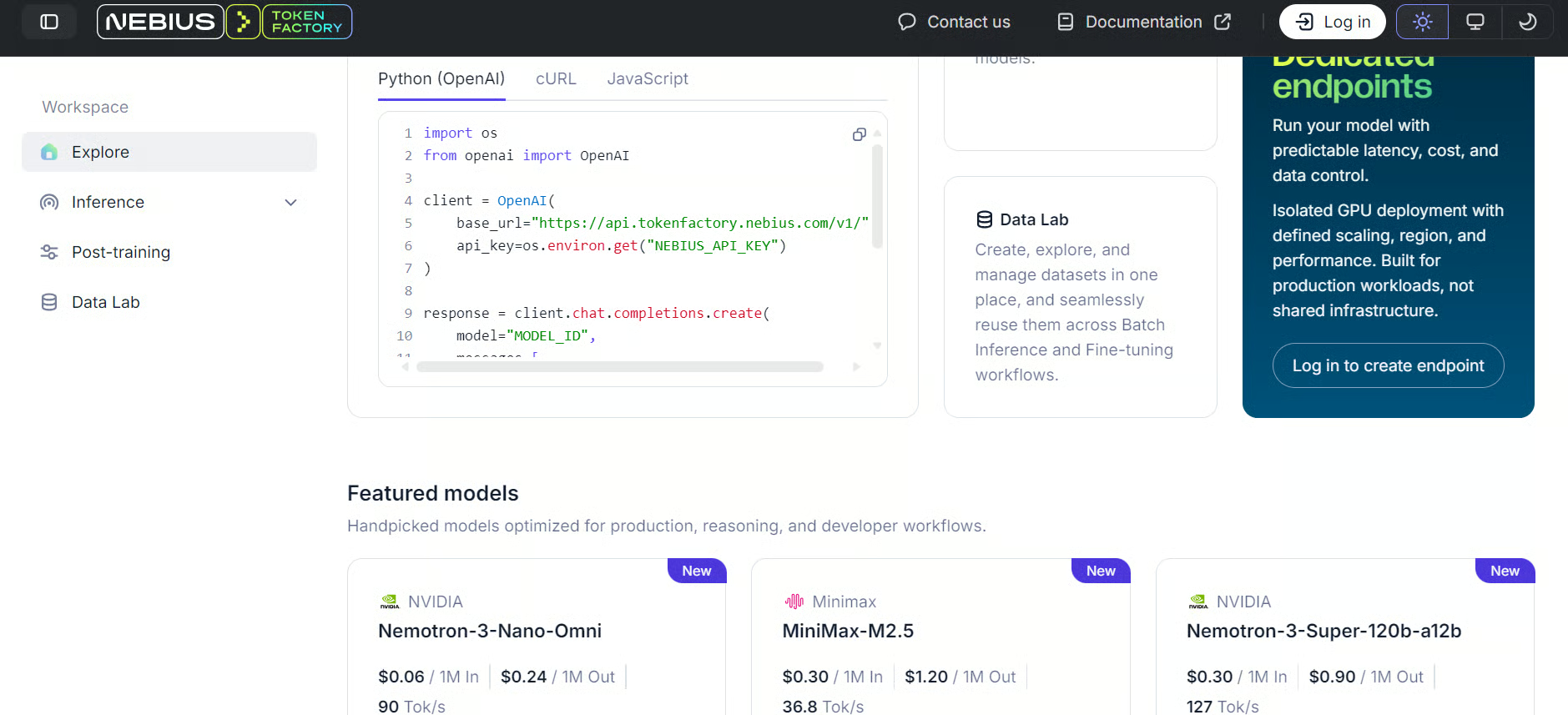

6. Nebius AI

Nebius AI là nhà cung cấp AI cloud được xây dựng cho tải công việc AI dựa trên GPU, suy luận được lưu trữ, phục vụ mô hình và hạ tầng AI có thể mở rộng. Dịch vụ suy luận Token Factory hỗ trợ mô hình mở qua API tương thích OpenAI, với các tùy chọn suy luận serverless, tinh chỉnh và hạ tầng AI đám mây chuyên dụng.

Nebius AI là lựa chọn mạnh cho đội nhóm muốn kiểm soát hạ tầng nhiều hơn so với nhà cung cấp API cơ bản, trong khi vẫn tránh được độ phức tạp của việc tự quản lý môi trường GPU. Đặc biệt hữu ích cho đội nhóm xây dựng với mô hình mở và tùy chỉnh cần tính toán có thể mở rộng, suy luận nhanh và tùy chọn triển khai sẵn sàng cho sản xuất.

Nguồn: Nebius Token Factory

Nebius Token Factory cung cấp hai cấp tốc độ suy luận: Fast và Base. Fast dành cho tải công việc tương tác, độ trễ thấp, trong khi Base hướng tới suy luận khối lượng lớn hiệu quả chi phí hơn hoặc xử lý nền.

Nebius chắc chắn tập trung hơn vào hạ tầng so với các nền tảng API LLM cắm là chạy đơn giản. Điều này có nghĩa là các đội có thể cần nhiều kiến thức về đám mây, triển khai và quản lý tải công việc để khai thác tối đa giá trị.

Với khối lượng công việc nhạy cảm, các đội nên cân nhắc liệu suy luận được quản lý là đủ hay cần hạ tầng chuyên dụng để kiểm soát tốt hơn về bảo mật, tuân thủ và quản trị dữ liệu.

Phù hợp nhất cho: hạ tầng AI trên đám mây, suy luận được lưu trữ, tải công việc dựa trên GPU, suy luận nhanh và các đội muốn kiểm soát triển khai nhiều hơn.

Nhà cung cấp định tuyến LLM

Các nhà cung cấp định tuyến LLM cho phép nhà phát triển truy cập nhiều mô hình và nhà cung cấp qua một API. Thay vì tích hợp riêng lẻ với OpenAI, Anthropic, Google, Mistral, DeepSeek và các nhà cung cấp khác, nhà phát triển có thể dùng một lớp định tuyến để quản lý quyền truy cập mô hình từ một nơi.

Các nền tảng này hữu ích cho so sánh mô hình, định tuyến dự phòng, tối ưu chi phí, dự phòng nhà cung cấp, khả năng quan sát và chuyển đổi giữa các mô hình mà không cần viết lại ứng dụng.

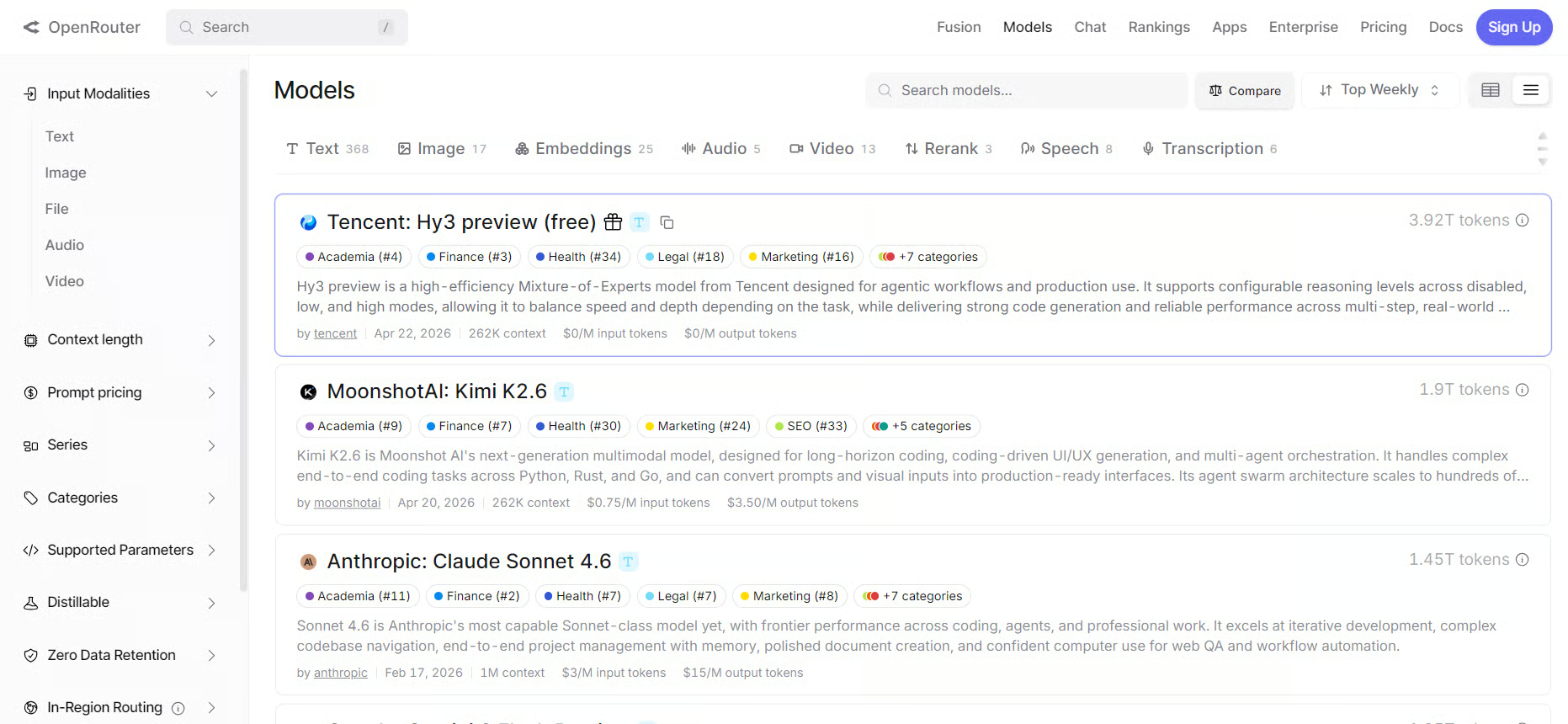

7. OpenRouter

OpenRouter là một trong những nhà cung cấp định tuyến LLM phổ biến nhất. Nó cho phép nhà phát triển truy cập nhiều mô hình qua một API tương thích OpenAI, giúp làm việc với các nhà cung cấp khác nhau dễ dàng hơn chỉ bằng một tích hợp.

Như chúng tôi đã đề cập trong một số hướng dẫn, OpenRouter là lựa chọn mạnh cho nhà phát triển muốn so sánh mô hình, thử nhanh các bản phát hành mới, định tuyến yêu cầu qua nhiều nhà cung cấp hoặc tránh bị khóa vào một nhà cung cấp mô hình duy nhất.

Nguồn: OpenRouter

Một hạn chế là OpenRouter thêm một lớp nữa giữa ứng dụng của bạn và nhà cung cấp mô hình. Điều này có thể tạo thêm phụ thuộc, độ trễ biến động và hành vi đặc thù từng nhà cung cấp vẫn cần được kiểm thử.

Với tải sản xuất, các đội nên xem xét cài đặt định tuyến, hành vi dự phòng, ưu tiên nhà cung cấp và kiểm soát quyền riêng tư trước khi gửi lưu lượng nhạy cảm hoặc quan trọng qua nền tảng.

Phù hợp nhất cho: ứng dụng đa mô hình, so sánh mô hình, định tuyến dự phòng, linh hoạt nhà cung cấp và thử nghiệm nhanh.

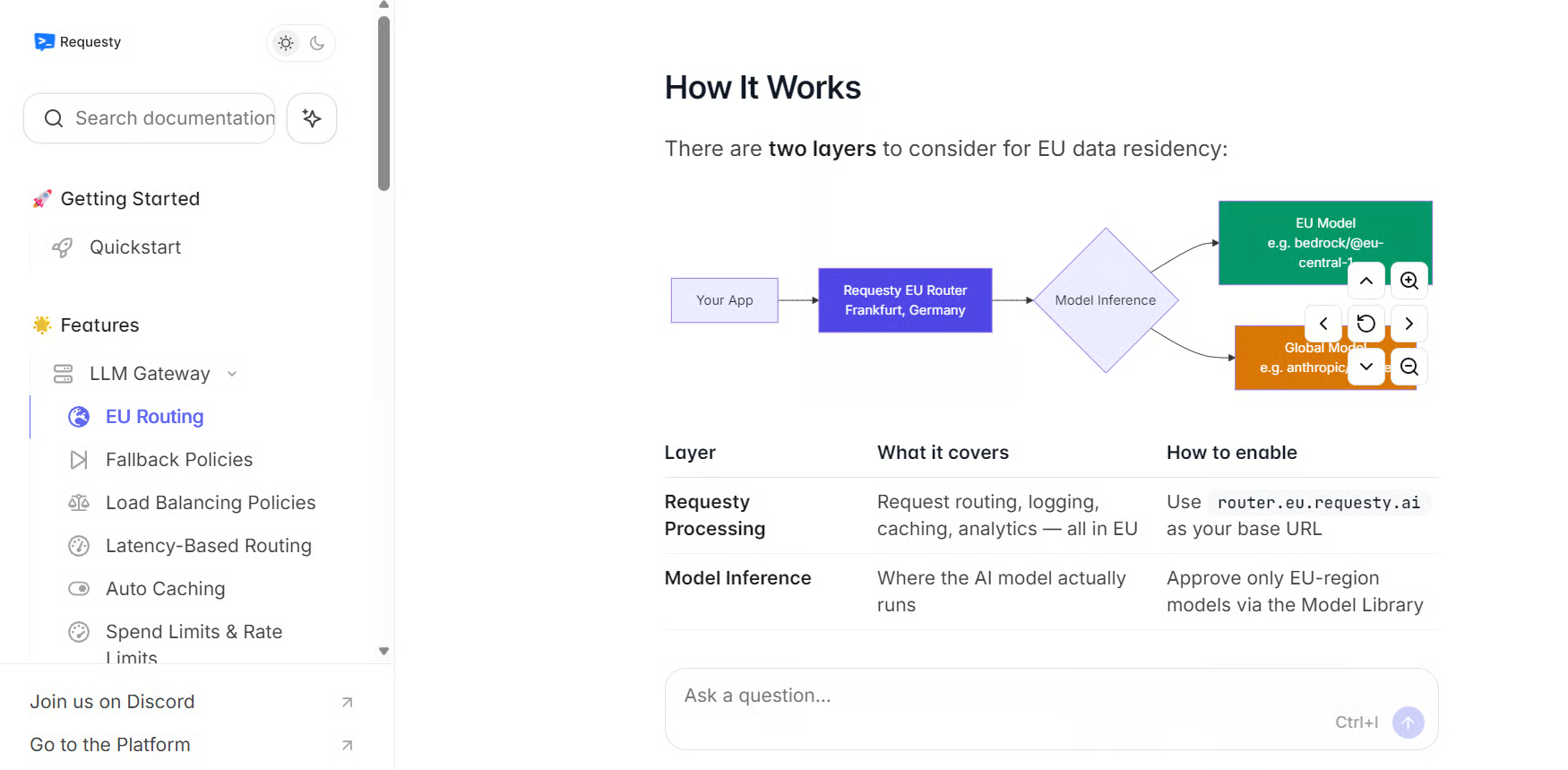

8. Requesty.ai

Requesty.ai là nền tảng định tuyến và gateway LLM giúp các đội kết nối với nhiều nhà cung cấp LLM qua một API tương thích OpenAI. Nó hỗ trợ hơn 400 mô hình, với các tính năng định tuyến, dự phòng, bộ nhớ đệm, quản lý chi phí, khả năng quan sát và quản trị.

Requesty.ai là lựa chọn mạnh cho các đội xây dựng ứng dụng AI sản xuất dựa vào hơn một nhà cung cấp mô hình. Đặc biệt hữu ích để quản lý chính sách định tuyến, theo dõi sử dụng, kiểm soát chi tiêu và cải thiện độ tin cậy khi nhà cung cấp gặp sự cố, hết thời gian chờ hoặc chạm giới hạn tần suất.

Nguồn: Tài liệu Requesty AI

Tương tự OpenRouter, hạn chế chính là Requesty.ai thêm một lớp gateway nữa vào ngăn xếp ứng dụng. Các đội cần cấu hình cẩn thận định tuyến, dự phòng, ghi log và quản trị để tránh chi phí, độ trễ hoặc hành vi nhà cung cấp ngoài mong muốn.

Với tải công việc nhạy cảm, Requesty.ai có các kiểm soát như phát hiện PII, làm sạch, hàng rào nội dung, log kiểm toán và tính năng quản trị, nhưng các đội vẫn cần quyết định dữ liệu nào có thể đi qua gateway và cách quản lý log.

Phù hợp nhất cho: định tuyến LLM, kiểm soát chi phí, khả năng quan sát, dự phòng nhà cung cấp, quản trị và quy trình gateway AI sản xuất.

Nhà cung cấp LLM trên đám mây

Các nhà cung cấp LLM trên đám mây là những nền tảng đám mây lớn cung cấp cho nhà phát triển và doanh nghiệp quyền truy cập được quản lý vào các mô hình nền tảng. Các nền tảng này thường hỗ trợ cả mô hình của riêng họ lẫn mô hình từ bên thứ ba.

Chúng đặc biệt hữu ích cho doanh nghiệp đã dùng hạ tầng đám mây và cần bảo mật, quản trị, tuân thủ, tích hợp dữ liệu, kiểm soát triển khai và quản lý mô hình tại một nơi.

9. Google Vertex AI

Google Vertex AI là nền tảng học máy và AI tạo sinh của Google Cloud. Nó cung cấp cho nhà phát triển và doanh nghiệp quyền truy cập vào các mô hình Gemini, Model Garden, công cụ agent và hạ tầng được quản lý để xây dựng, triển khai và quản lý ứng dụng AI.

Vertex AI cũng hỗ trợ các đối tác hàng đầu và mô hình mở thông qua Model Garden, bao gồm Anthropic Claude, xAI Grok, các mô hình Mistral AI, và mô hình mã nguồn mở như GLM 5 và Gemma 4, bên cạnh các mô hình Gemini của Google.

Nguồn: Generative AI trên Vertex AI

Google Vertex AI là lựa chọn mạnh cho các đội đã dùng Google Cloud và muốn triển khai mô hình theo cách cloud-native, có quản trị, kiểm soát bảo mật và tích hợp với hệ sinh thái dữ liệu và AI rộng hơn của Google.

Mặt khác, Vertex AI có thể phức tạp hơn so với dùng một API mô hình đơn giản. Các đội có thể cần kinh nghiệm Google Cloud để quản lý dự án, quyền hạn, thanh toán, thiết lập triển khai và tích hợp một cách phù hợp.

Với khối lượng công việc nhạy cảm, Vertex AI hữu ích cho các đội cần kiểm soát truy cập cấp đám mây, quản trị và hạ tầng được quản lý, nhưng các quyết định thiết lập quanh ghi log, truy cập dữ liệu và vùng triển khai vẫn cần được xem xét kỹ.

Phù hợp nhất cho: người dùng Google Cloud, truy cập Gemini, ứng dụng AI doanh nghiệp, quy trình đa phương thức và triển khai mô hình cloud-native.

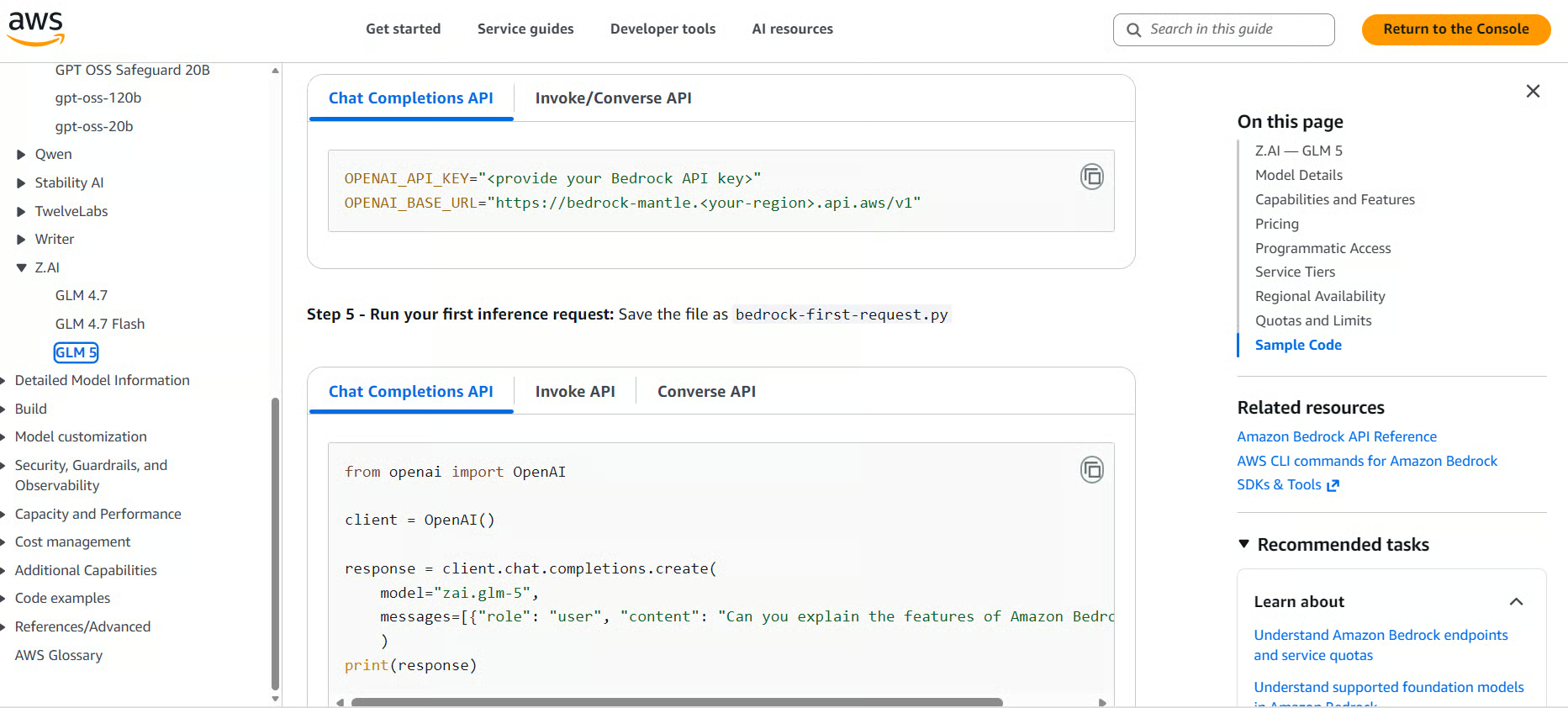

10. Amazon Bedrock

Amazon Bedrock là nền tảng AI tạo sinh được quản lý của AWS. Nó cung cấp cho nhà phát triển quyền truy cập vào các mô hình nền tảng từ Amazon và nhà cung cấp bên thứ ba thông qua một dịch vụ AWS được quản lý.

Bedrock hỗ trợ các mô hình từ những nhà cung cấp như Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek và các bên khác, hữu ích cho các đội muốn đa dạng mô hình trong hệ sinh thái AWS.

Amazon Bedrock là lựa chọn mạnh cho công ty đã xây dựng trên AWS vì nó kết hợp quyền truy cập mô hình, hạ tầng đám mây, kiểm soát bảo mật và tích hợp doanh nghiệp vào một nền tảng.

Nguồn: Amazon Bedrock

Hạn chế chính là Bedrock có thể phức tạp hơn một API LLM đơn giản. Các đội có thể cần kinh nghiệm AWS để quản lý quyền hạn, khu vực, quyền truy cập mô hình, giá, mạng và thiết lập triển khai một cách phù hợp.

Với tải công việc nhạy cảm, Bedrock hữu ích vì prompt và đầu ra không được dùng để huấn luyện mô hình gốc hoặc chia sẻ với nhà cung cấp mô hình, và các đội có thể dùng kiểm soát của AWS như mã hóa, IAM và PrivateLink.

Phù hợp nhất cho: người dùng AWS, AI doanh nghiệp, quyền truy cập mô hình nền tảng được quản lý, triển khai chú trọng bảo mật và ứng dụng AI tạo sinh cloud-native.

Bảng so sánh nhà cung cấp API LLM

Bảng dưới đây so sánh các nhà cung cấp API LLM hàng đầu dựa trên các lợi thế chính và hạn chế chủ yếu của họ.

|

Nhà cung cấp |

Lợi thế chính |

Hạn chế chủ yếu |

|

OpenAI |

Chất lượng mô hình mạnh, API trưởng thành, công cụ đa phương thức, đầu ra có cấu trúc, embeddings, giọng nói, tạo ảnh và quy trình dựa trên agent |

Có thể trở nên đắt khi mở rộng và ít kiểm soát hơn so với mô hình mã nguồn mở hoặc tự lưu trữ |

|

Anthropic |

Chất lượng viết mạnh, tuân thủ hướng dẫn cẩn trọng, suy luận, lập trình và hỗ trợ ngữ cảnh dài |

Chi phí có thể tăng với tài liệu lớn hoặc sử dụng lưu lượng cao, và đội nhóm bị hạn chế kiểm soát lưu trữ và nội bộ mô hình |

|

Google Gemini |

Khả năng đa phương thức mạnh, API thời gian thực, hỗ trợ ngữ cảnh dài và tích hợp chặt chẽ với hệ sinh thái AI của Google |

Có thể cảm giác bị ràng buộc vào hệ sinh thái Google, và giá, tính sẵn sàng, tính năng có thể khác nhau theo công cụ hoặc khu vực |

|

Together AI |

Quyền truy cập được lưu trữ vào nhiều mô hình mở và chuyên biệt, với suy luận serverless, endpoint chuyên dụng, tinh chỉnh, đánh giá và hạ tầng GPU |

Chất lượng, tốc độ và độ tin cậy mô hình có thể thay đổi tùy mô hình được chọn |

|

Fireworks AI |

Suy luận nhanh, độ trễ thấp, truy cập serverless, triển khai theo nhu cầu và API sẵn sàng cho sản xuất cho mô hình mở |

Tập trung nhiều hơn vào suy luận và triển khai hơn là một nền tảng phát triển AI tất cả trong một |

|

Nebius AI |

Hạ tầng dựa trên GPU, suy luận được lưu trữ, API tương thích OpenAI và các cấp tốc độ như Fast và Base |

Tập trung vào hạ tầng nhiều hơn, vì vậy các đội có thể cần kiến thức đám mây và triển khai vững |

|

OpenRouter |

Truy cập nhiều mô hình qua một API tương thích OpenAI, với chuyển đổi nhà cung cấp và tùy chọn dự phòng dễ dàng hơn |

Thêm một lớp giữa ứng dụng và nhà cung cấp, có thể ảnh hưởng độ trễ, độ tin cậy hoặc gỡ lỗi |

|

Requesty.ai |

Một API cho nhiều nhà cung cấp, với định tuyến, dự phòng, bộ nhớ đệm, theo dõi chi phí, khả năng quan sát và tính năng quản trị |

Cần thiết lập cẩn thận định tuyến, ghi log, dự phòng và kiểm soát chi phí để tránh hành vi ngoài mong đợi |

|

Google Vertex AI |

Quyền truy cập được quản lý vào Gemini, Anthropic Claude, xAI Grok, Mistral AI và mô hình mở qua Model Garden, cộng với công cụ bảo mật và quản trị của Google Cloud |

Phức tạp hơn một API đơn giản và có thể cần kinh nghiệm Google Cloud |

|

Amazon Bedrock |

Quyền truy cập được quản lý vào các mô hình từ Amazon và nhà cung cấp thứ ba như Anthropic, Meta, Mistral AI, Cohere và các bên khác trong AWS |

Phức tạp hơn một API LLM cơ bản, đặc biệt quanh quyền hạn, khu vực, giá và quyền truy cập mô hình |

Chọn nhà cung cấp API LLM tốt nhất cho trường hợp sử dụng của bạn

Việc chọn nhà cung cấp API LLM phù hợp phụ thuộc vào ba yếu tố:

- Bạn đang xây dựng gì

- Bạn cần mức độ kiểm soát ra sao

- Bạn sẵn sàng chi bao nhiêu

Với startup và đội nhỏ, các nhà cung cấp API LLM mã nguồn mở thường là điểm khởi đầu tốt nhất. Các nền tảng như Together AI, Fireworks AI và Nebius AI cho bạn quyền truy cập vào các mô hình mở mạnh mẽ mà không cần tự quản lý GPU hay hạ tầng. Chúng có thể nhanh hơn, rẻ hơn và linh hoạt hơn cho thử nghiệm và phát triển sản phẩm giai đoạn đầu.

Nếu bạn muốn thử nghiệm nhanh các mô hình khác nhau, các nhà cung cấp định tuyến LLM là lựa chọn mạnh. Công cụ như OpenRouter và Requesty.ai cho phép bạn so sánh mô hình đóng và mở qua một API, quản lý dự phòng và chuyển nhà cung cấp mà không cần viết lại ứng dụng.

Với các quy trình mà chất lượng mô hình quan trọng hơn chi phí, các nhà cung cấp native như OpenAI và Anthropic vẫn là những lựa chọn mạnh nhất. Chúng đặc biệt hữu ích cho trợ lý AI sản xuất, công cụ lập trình, quy trình đòi hỏi suy luận cao, ứng dụng đa phương thức và hệ thống agent nơi độ tin cậy và hiệu năng mô hình là quan trọng nhất.

Cuối cùng, nếu công ty bạn đã chạy trên AWS hoặc Google Cloud, thường hợp lý khi ở lại trong hệ sinh thái đám mây đó. Amazon Bedrock và Google Vertex AI cung cấp cho bạn quyền truy cập mô hình được quản lý, kiểm soát bảo mật, quản trị và tích hợp với các công cụ mà đội của bạn đang dùng.

Kết luận

Với công việc kỹ thuật, trợ lý lập trình và các công cụ lập trình theo phong cách “vibe coding”, tôi sẽ không thử nghiệm quá đà ngay từ đầu. Theo kinh nghiệm của tôi, OpenAI và Anthropic thường là lựa chọn an toàn vì khả năng lập trình, suy luận và bộ công cụ dành cho nhà phát triển mạnh.

Các nhà cung cấp API LLM mã nguồn mở và nhà cung cấp định tuyến LLM là lựa chọn thay thế mạnh cho thử nghiệm nâng cao.

Các nhà cung cấp LLM Đám mây lớn thường chỉ hợp lý trong môi trường doanh nghiệp. Trong trường hợp này, hãy chọn hệ sinh thái mà bạn đã sử dụng.

Câu hỏi thường gặp về nhà cung cấp API LLM

Nhà cung cấp API LLM là gì?

Một công ty hoặc nền tảng lưu trữ các mô hình ngôn ngữ lớn và cung cấp chúng qua API, để nhà phát triển có thể gửi yêu cầu và nhận phản hồi do AI tạo ra mà không phải tự quản lý GPU hay hạ tầng suy luận.

Sự khác nhau giữa nhà cung cấp LLM native và nhà cung cấp LLM đám mây là gì?

Nhà cung cấp native (như OpenAI và Anthropic) tự xây dựng và phục vụ mô hình của họ. Nhà cung cấp đám mây (như AWS Bedrock và Google Vertex AI) cung cấp quyền truy cập được quản lý vào nhiều mô hình bên thứ ba, gói trong hệ sinh thái đám mây sẵn có với công cụ bảo mật và quản trị cấp doanh nghiệp.

Khi nào tôi nên dùng nhà cung cấp định tuyến LLM như OpenRouter hoặc Requesty.ai?

Khi bạn cần làm việc với hơn một mô hình hoặc nhà cung cấp, muốn có dự phòng tự động nếu nhà cung cấp gặp sự cố, hoặc cần so sánh mô hình và kiểm soát chi phí, tất cả thông qua một tích hợp API duy nhất.

Các nhà cung cấp API LLM mã nguồn mở có kém hơn so với nhà cung cấp native như OpenAI không?

Không nhất thiết; điều đó phụ thuộc vào tác vụ. Các nền tảng như Together AI và Fireworks AI lưu trữ các mô hình mở tối tân như Llama, DeepSeek và Mistral, có thể cạnh tranh với mô hình đóng, thường với chi phí thấp hơn đáng kể.

Nhà cung cấp API LLM nào tốt nhất cho doanh nghiệp có yêu cầu tuân thủ nghiêm ngặt?

Amazon Bedrock và Google Vertex AI thường là lựa chọn mạnh nhất, vì chúng cung cấp kiểm soát bảo mật cloud-native, IAM, mã hóa, ghi log kiểm toán và tính năng quản trị tích hợp với hạ tầng doanh nghiệp hiện có.

Là một nhà khoa học dữ liệu được chứng nhận, tôi đam mê tận dụng công nghệ tiên tiến để tạo ra các ứng dụng học máy đổi mới. Với nền tảng vững chắc về nhận dạng giọng nói, phân tích và báo cáo dữ liệu, MLOps, AI hội thoại và NLP, tôi đã rèn giũa kỹ năng phát triển các hệ thống thông minh có thể tạo ra tác động thực sự. Bên cạnh chuyên môn kỹ thuật, tôi cũng là một người truyền đạt tốt, có khả năng chắt lọc các khái niệm phức tạp thành ngôn ngữ rõ ràng, súc tích. Nhờ đó, tôi trở thành một blogger được nhiều người quan tâm trong lĩnh vực khoa học dữ liệu, chia sẻ góc nhìn và kinh nghiệm với cộng đồng các chuyên gia dữ liệu ngày càng lớn. Hiện tại, tôi tập trung vào sáng tạo và biên tập nội dung, làm việc với các mô hình ngôn ngữ lớn để phát triển nội dung mạnh mẽ và hấp dẫn, giúp doanh nghiệp và cá nhân tận dụng tối đa dữ liệu của mình.