Programma

I provider di API per Large Language Model (LLM) offrono agli sviluppatori l’accesso a potenti modelli di IA senza dover gestire GPU, deployment dei modelli, scalabilità o infrastruttura di inferenza. Invece di eseguire un modello in proprio, gli sviluppatori possono collegarsi a un’API, scegliere un modello, inviare una richiesta e ricevere una risposta.

In questo articolo, vedremo i 10 migliori provider di API LLM in base a qualità del modello, esperienza dello sviluppatore, prezzi, scalabilità, supporto dell’ecosistema e prontezza per la produzione. Per ciascun provider, indicheremo per cosa è più adatto, i principali vantaggi e gli svantaggi da considerare.

Questa guida suddivide i principali provider di API LLM in quattro categorie:

- Provider LLM nativi

- Provider di API LLM open-source

- Provider di routing LLM

- Provider LLM cloud

Provider LLM nativi

I provider LLM nativi sviluppano, addestrano ed erogano le proprie famiglie di modelli tramite API. Spesso sono l’opzione migliore per chi vuole alta qualità dei modelli, documentazione affidabile, ragionamento avanzato, supporto multimodale e strumenti pronti per la produzione.

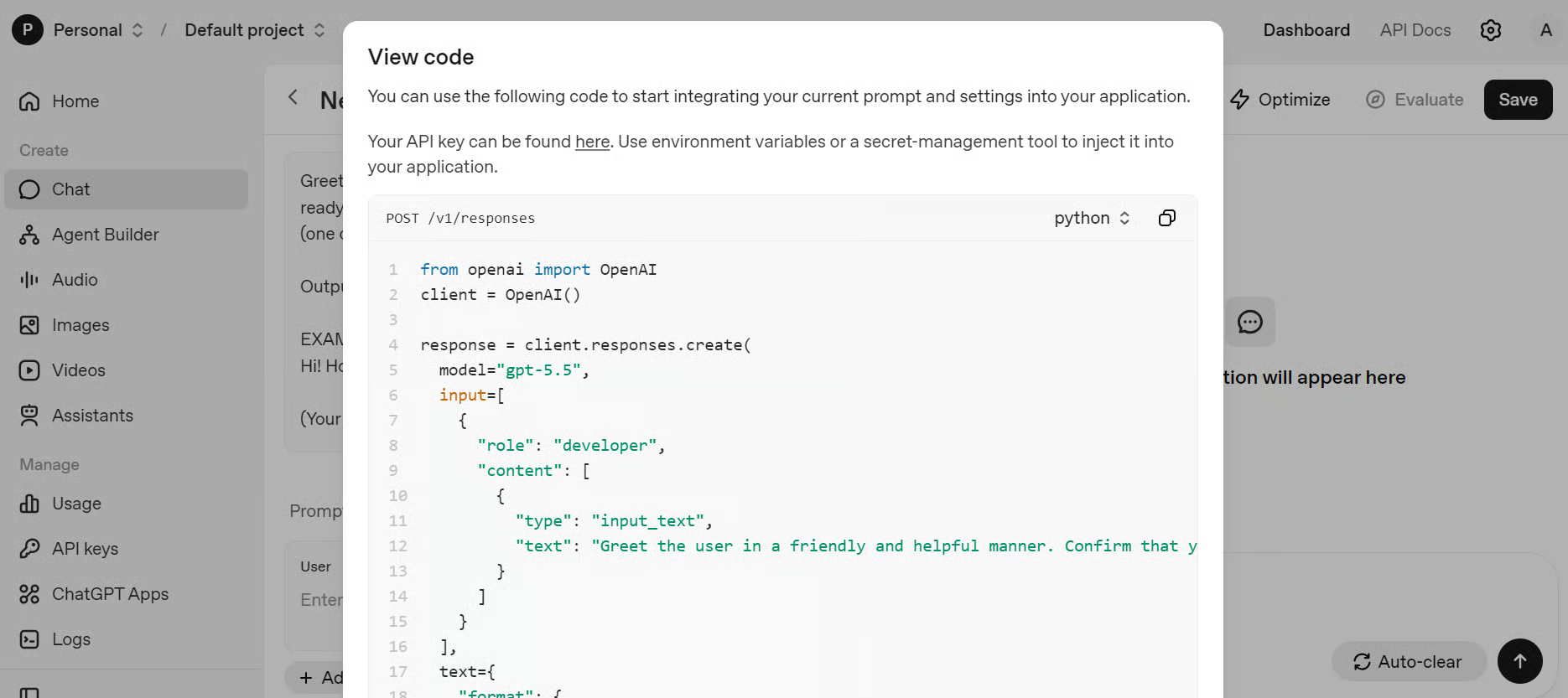

1. OpenAI

OpenAI è uno dei provider di API LLM più diffusi. La sua API Platform offre accesso a:

- Modelli di frontiera per il ragionamento come GPT-5.5

- Generazione e traduzione vocale in tempo reale tramite GPT-Realtime-2

- Generazione di immagini tramite il modello di generazione GPT-Images-2.0

- Sviluppo basato su agenti con l’OpenAI Agents SDK

La sua API supporta streaming, interfacce in tempo reale e output strutturati.

OpenAI è una scelta solida per team che costruiscono assistenti IA, strumenti per il coding, agenti di supporto clienti, copiloti interni, app multimodali e sistemi basati su agenti.

Fonte: OpenAI

Uno svantaggio è che OpenAI può diventare costoso su larga scala, soprattutto per applicazioni ad alto volume o con ragionamento intensivo. È anche un provider con API chiuse, il che offre meno controllo sugli internals del modello, sull’hosting e sulla personalizzazione rispetto a modelli open-source o self-hosted.

Ideale per: app IA generiche, ragionamento, coding, workflow multimodali e prodotti di IA pronti per la produzione.

2. Anthropic

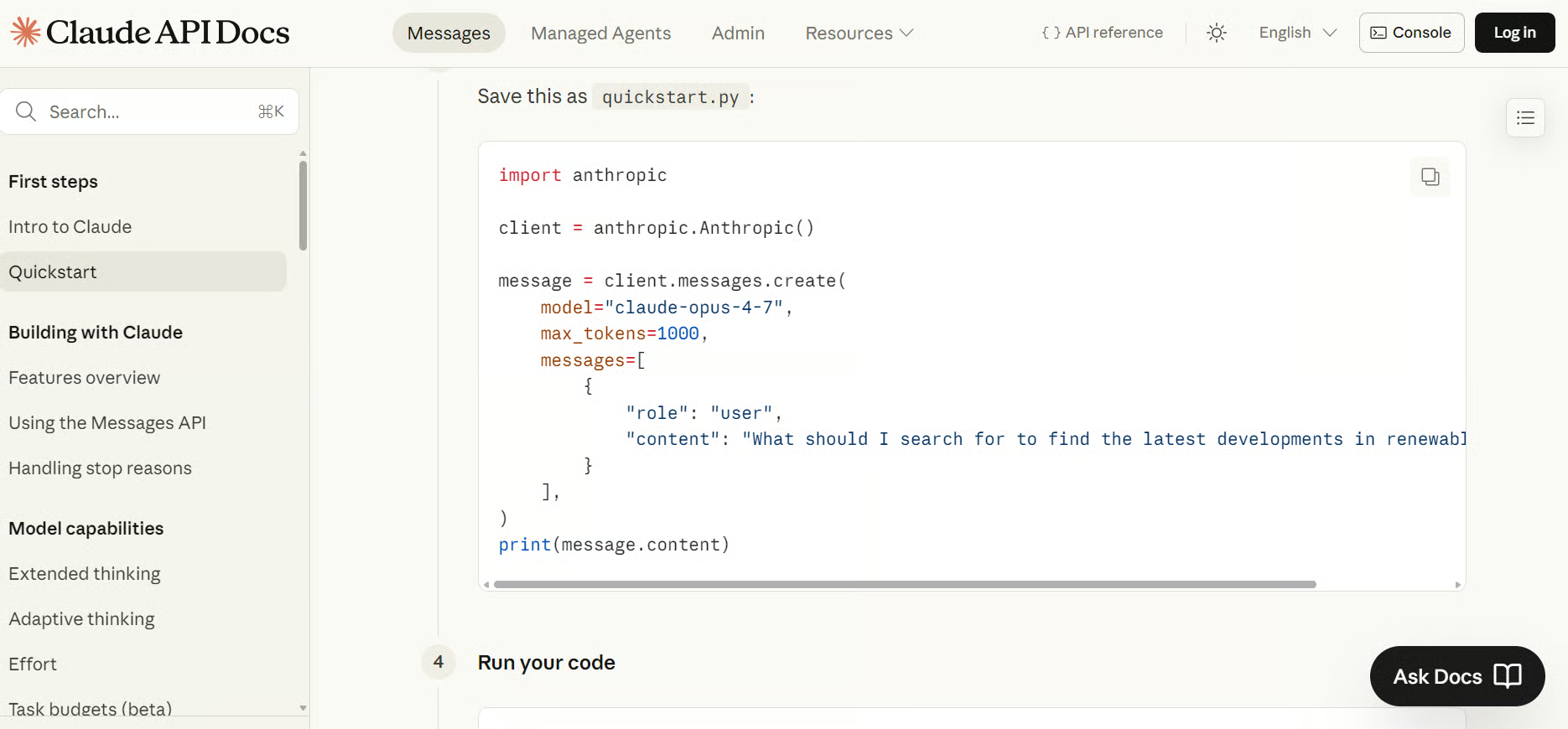

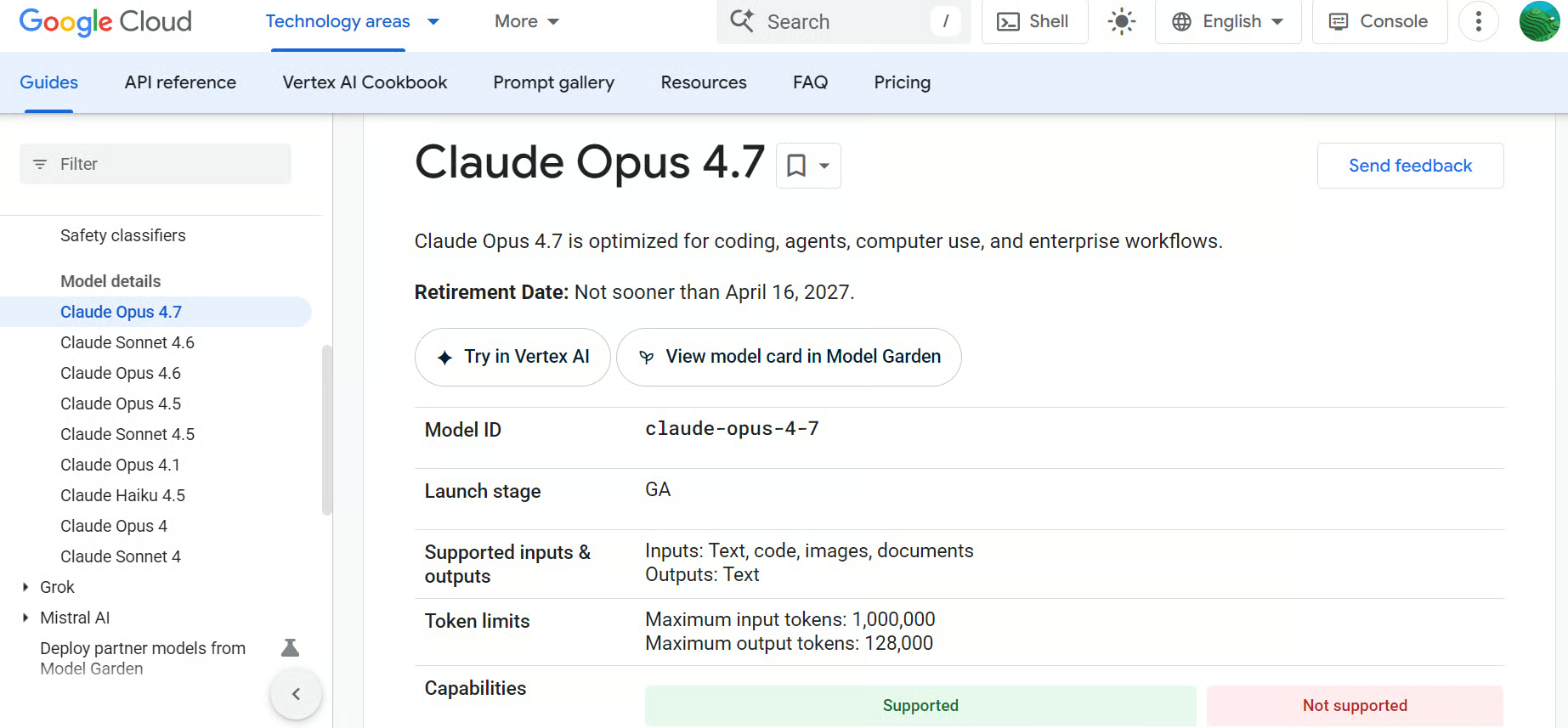

Anthropic fornisce la famiglia di modelli Claude tramite la sua API, ad esempio il suo ultimo modello di punta, Claude Opus 4.7. Claude è progettato per linguaggio, ragionamento, analisi, coding, contesti lunghi e workflow agentici. La piattaforma per sviluppatori di Anthropic offre accesso diretto ai modelli tramite API, SDK e documentazione.

Claude è particolarmente utile per applicazioni che richiedono un attento rispetto delle istruzioni, alta qualità di scrittura, analisi di documenti e gestione affidabile di prompt complessi.

Fonte: Get started with Claude

Un limite importante è il costo, soprattutto usando Claude per documenti di grandi dimensioni, prompt a contesto lungo o applicazioni ad alto volume. Poiché Claude è accessibile tramite un’API ospitata, i team hanno anche un controllo limitato su dove e come gira il modello.

Per i casi d’uso sensibili alla privacy, gli sviluppatori dovrebbero esaminare con attenzione gestione dei dati, conservazione e requisiti di conformità prima di inviare dati riservati dell’azienda o dei clienti tramite l’API.

Ideale per: assistenti di coding, IA enterprise, analisi a contesto lungo, workflow documentali e agenti di IA.

Per un confronto dettagliato tra i due giganti dell’IA, dai un’occhiata alla nostra guida su Anthropic vs OpenAI.

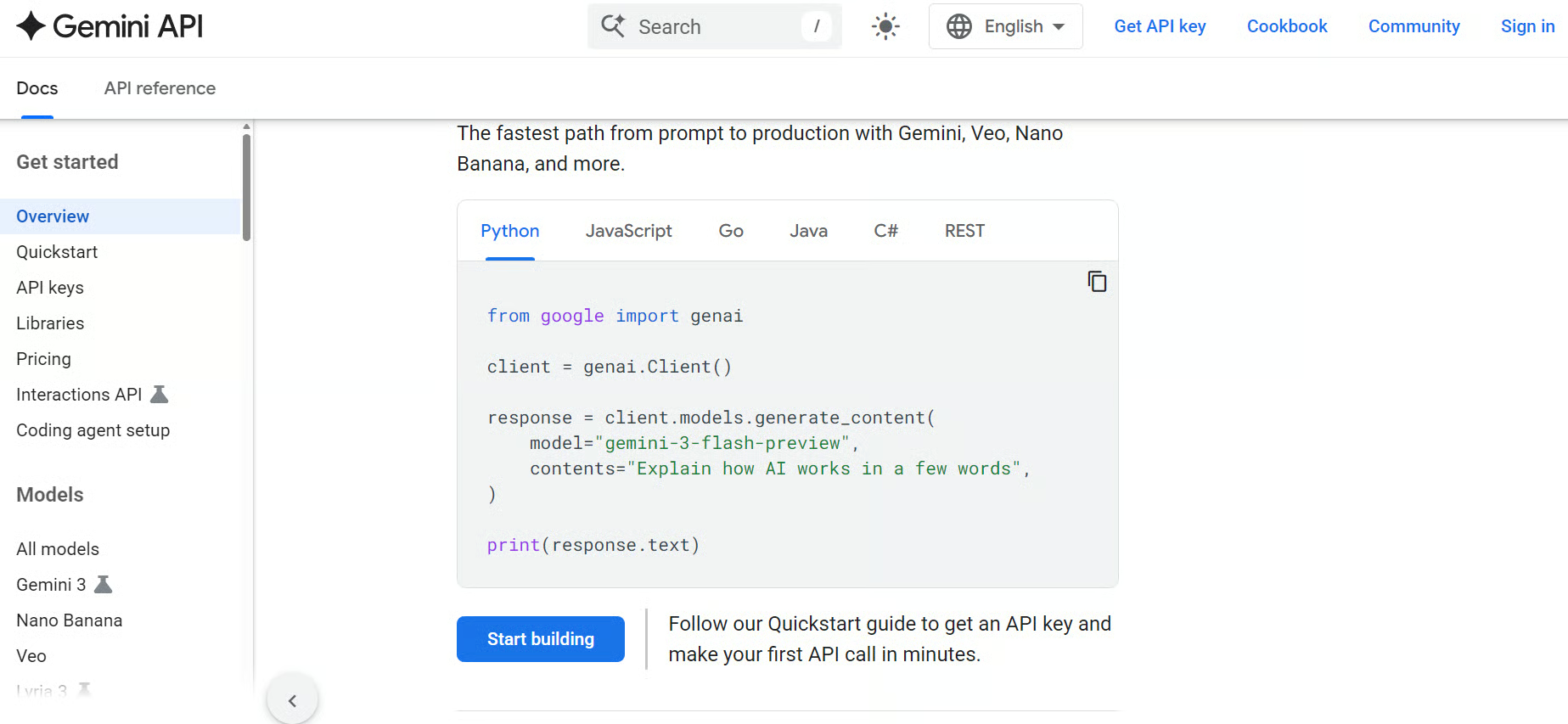

3. Google Gemini

Google Gemini è la famiglia LLM nativa di Google, tra cui Gemini 3.1 Pro, disponibile tramite la Gemini API per sviluppatori. La Gemini API supporta API standard, in streaming e in tempo reale, con documentazione su dettagli dei modelli, SDK, prezzi, configurazione e riferimenti API.

Con Nano Banana 2 per la generazione di immagini e Veo 3.1 integrato, Gemini è un’ottima opzione per sviluppatori che costruiscono applicazioni multimodali. È anche una buona scelta per assistenti IA (soprattutto quelli che si basano su esperienze di ricerca), strumenti di coding e prodotti che si collegano al più ampio ecosistema IA di Google.

Fonte: Gemini API

Tuttavia, Gemini può risultare più legato all’ecosistema Google, cosa che potrebbe non essere ideale per team che desiderano un setup neutrale rispetto ai provider. Anche i prezzi, la disponibilità dei modelli e il supporto delle funzionalità possono variare tra strumenti e regioni.

Per applicazioni sensibili alla privacy, i team dovrebbero rivedere gestione dei dati, conservazione e requisiti di conformità prima di inviare dati riservati dell’azienda o dei clienti tramite l’API.

Ideale per: app IA multimodali, integrazione con l’ecosistema Google, workflow a contesto lungo, coding e applicazioni IA generiche.

Provider di API LLM open-source

I provider di API LLM open-source offrono agli sviluppatori accesso ospitato a modelli open-source e open-weight. Invece di scaricare i modelli ed eseguirli sulle tue GPU, queste piattaforme li ospitano e li rendono disponibili tramite API semplici.

Questi provider sono utili per team che cercano costi più bassi, maggiore flessibilità dei modelli, sperimentazione più rapida e accesso a modelli open popolari come Llama, DeepSeek, Qwen, Mistral, Gemma e altri.

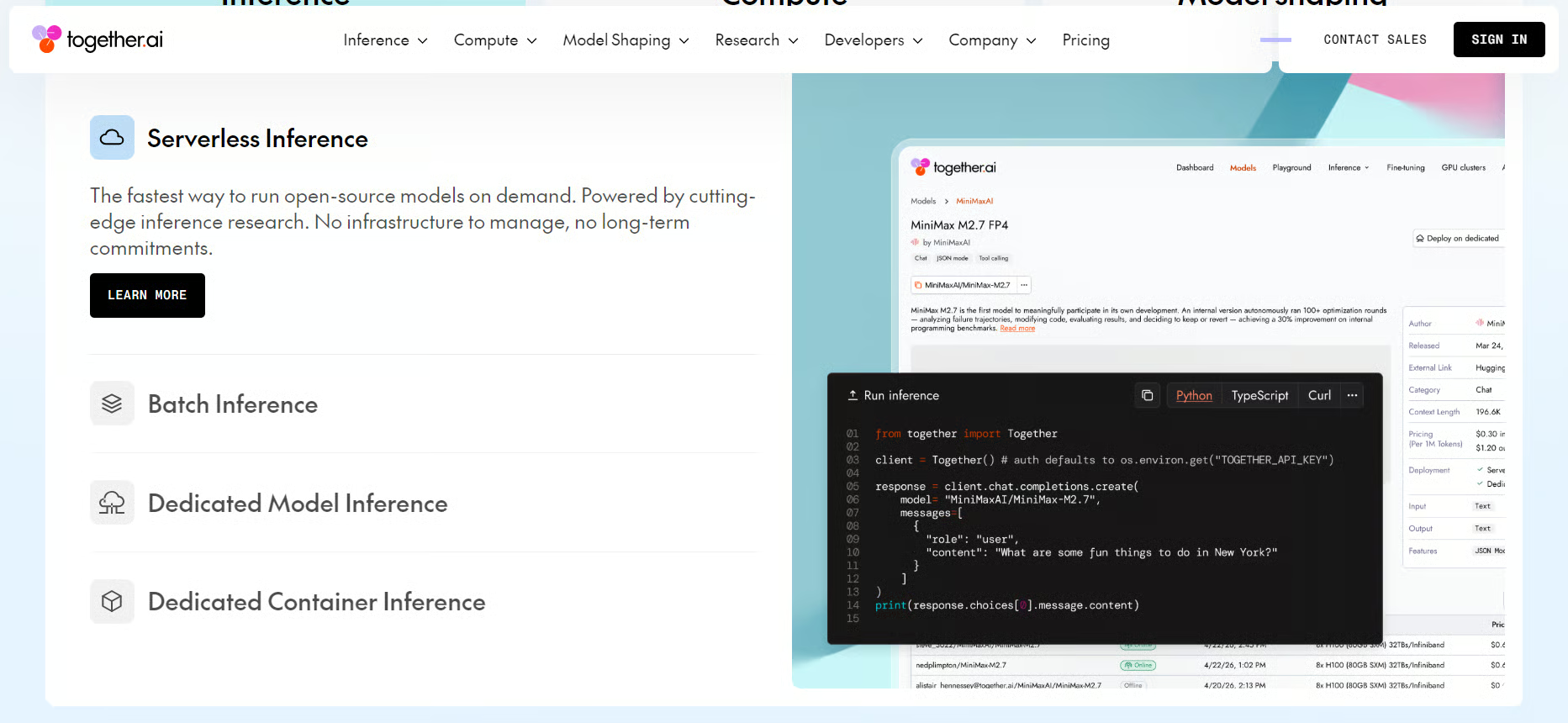

4. Together AI

Together AI fornisce accesso ospitato a modelli open-source e specializzati tramite un’API unificata. Il suo catalogo include oltre 200 modelli per testo, immagine, video, codice e audio, con supporto per inferenza serverless, inferenza batch, endpoint dedicati, fine-tuning, valutazioni e cluster GPU.

Together AI è un’ottima opzione per sviluppatori che vogliono usare modelli open senza gestire l’infrastruttura. È particolarmente utile per team che testano più modelli, effettuano fine-tuning di modelli personalizzati o scalano carichi di lavoro di inferenza.

Fonte: Together AI

Detto ciò, qualità, velocità e affidabilità possono variare a seconda del modello scelto. I team potrebbero aver bisogno di più test, benchmarking e valutazioni prima dell’uso in produzione.

Per carichi sensibili, i team dovrebbero verificare se serve accesso serverless, endpoint dedicati o opzioni di deployment privato per soddisfare requisiti di sicurezza e conformità.

Ideale per: inferenza di modelli open-source, fine-tuning, carichi di lavoro IA scalabili e sperimentazione su molti modelli.

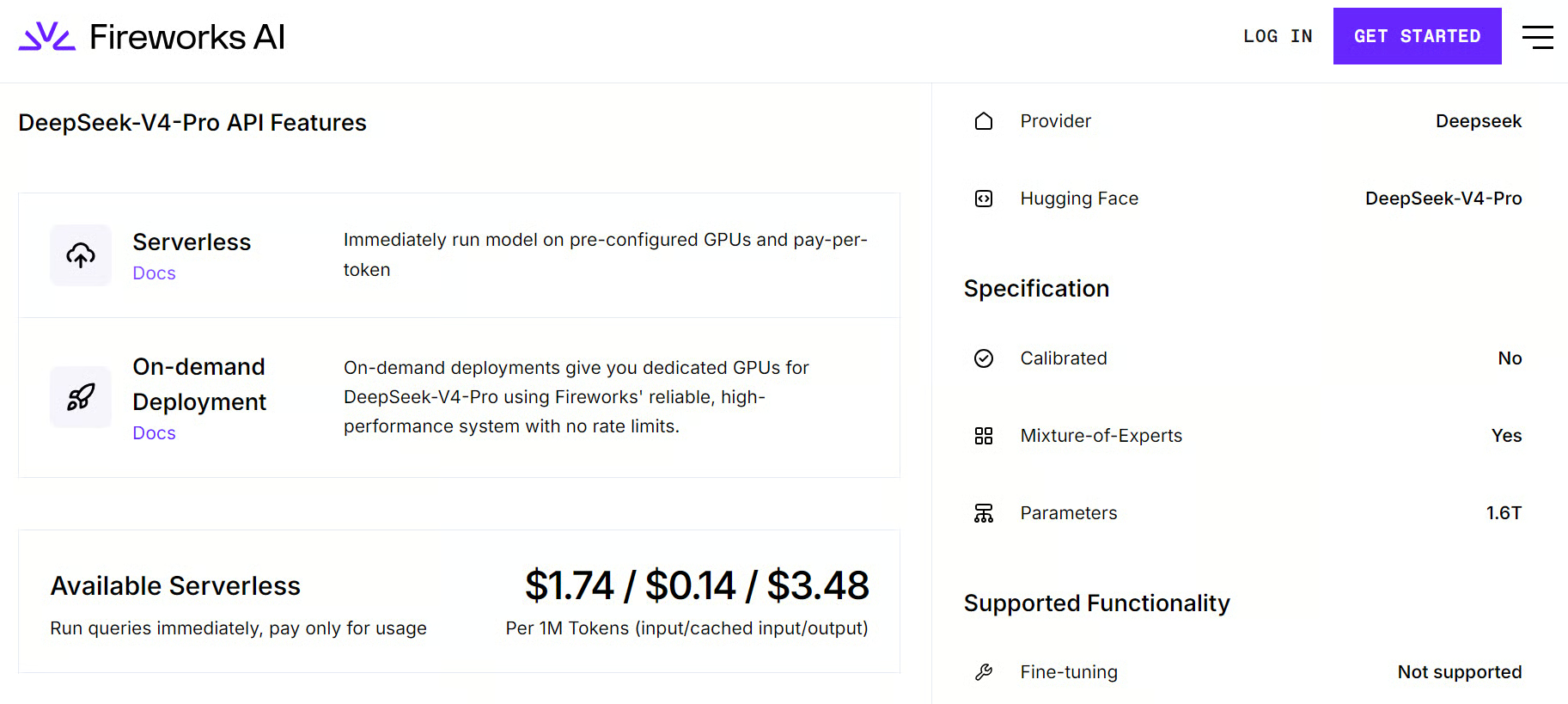

5. Fireworks AI

Fireworks AI si concentra su inferenza veloce per LLM open-source e modelli di IA generativa. La sua piattaforma supporta inferenza serverless, deployment on-demand, fine-tuning e API pronte per la produzione per modelli open popolari.

Fireworks AI è un’ottima opzione per team che vogliono la flessibilità dei modelli open con inferenza più rapida e minore latenza. È particolarmente utile per IA conversazionale, assistenti di coding, ricerca, app multimodali e sistemi RAG enterprise.

Fonte: Fireworks AI

Uno svantaggio è che Fireworks AI è più focalizzato su inferenza e deployment che su una piattaforma di sviluppo IA onnicomprensiva. I team potrebbero comunque aver bisogno di strumenti separati per orchestrazione, valutazioni, monitoraggio o workflow agentici complessi.

I team dovrebbero anche valutare se l’inferenza serverless sia sufficiente per carichi sensibili o se servano deployment dedicati per un controllo più forte su prestazioni e conformità.

Ideale per: inferenza veloce di modelli open-source, fine-tuning, app IA di produzione e deployment a bassa latenza di modelli open.

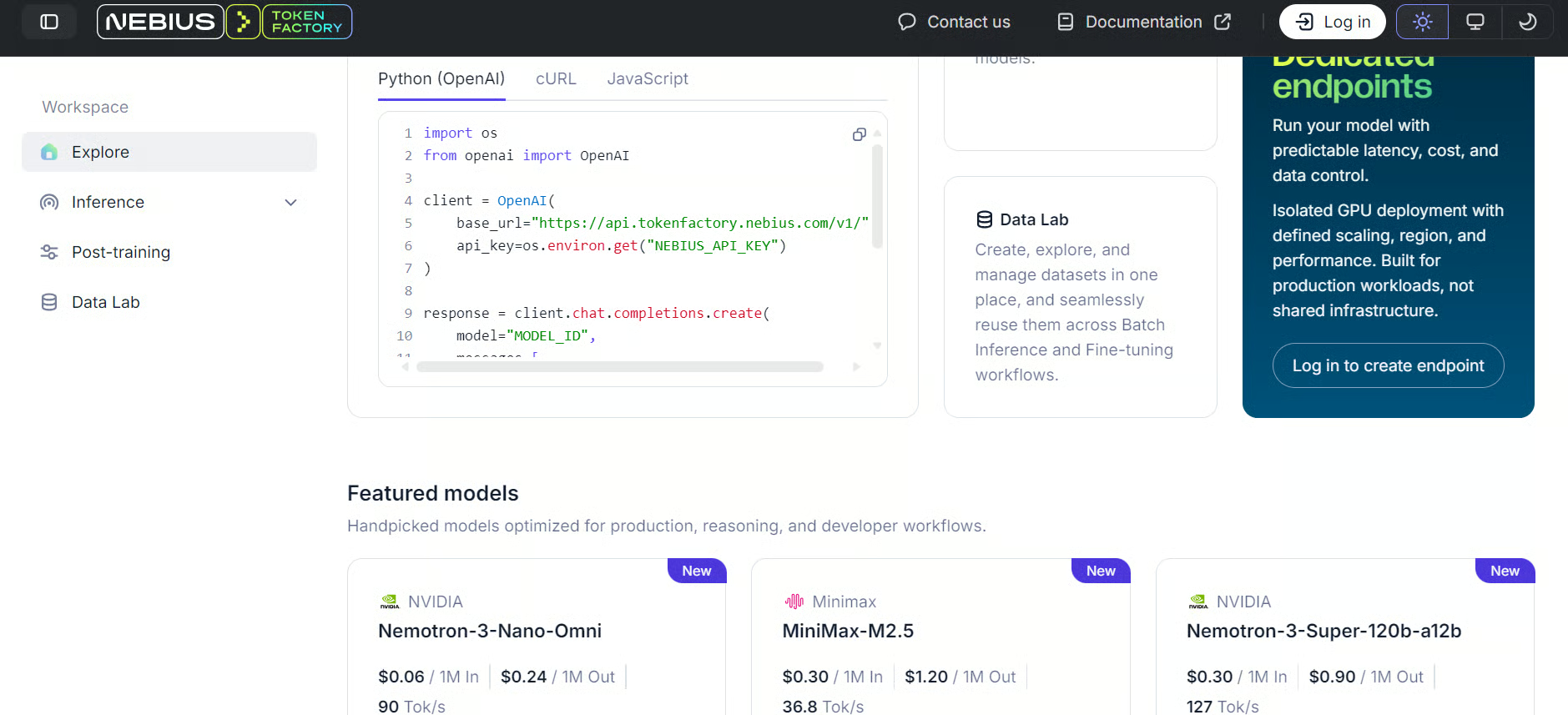

6. Nebius AI

Nebius AI è un provider cloud per l’IA costruito per carichi di lavoro su GPU, inferenza ospitata, model serving e infrastruttura IA scalabile. Il suo servizio di inferenza Token Factory supporta modelli open tramite un’API compatibile con OpenAI, con opzioni per inferenza serverless, fine-tuning e infrastruttura cloud di IA dedicata.

Nebius AI è un’ottima scelta per team che desiderano più controllo sull’infrastruttura rispetto a un semplice provider di API, evitando comunque la complessità di gestire completamente ambienti GPU. È particolarmente utile per team che lavorano con modelli open e personalizzati e che necessitano di compute scalabile, inferenza rapida e opzioni di deployment pronte per la produzione.

Fonte: Nebius Token Factory

Nebius Token Factory offre due profili di velocità di inferenza: Fast e Base. Fast è progettato per carichi interattivi a bassa latenza, mentre Base è pensato per inferenza ad alto volume più conveniente o elaborazioni in background.

Nebius è certamente più incentrato sull’infrastruttura rispetto a semplici piattaforme di API LLM plug-and-play. Ciò significa che i team potrebbero aver bisogno di maggiori competenze su cloud, deployment e gestione dei carichi per trarne il massimo valore.

Per carichi sensibili, i team dovrebbero valutare se l’inferenza gestita sia sufficiente o se serva un’infrastruttura dedicata per un controllo più forte su sicurezza, conformità e governance dei dati.

Ideale per: infrastruttura cloud per IA, inferenza ospitata, carichi su GPU, inferenza rapida e team che vogliono più controllo sul deployment.

Provider di routing LLM

I provider di routing LLM offrono agli sviluppatori accesso a più modelli e provider tramite un’unica API. Invece di integrare separatamente OpenAI, Anthropic, Google, Mistral, DeepSeek e altri, gli sviluppatori possono usare un unico livello di routing per gestire l’accesso ai modelli da un solo posto.

Queste piattaforme sono utili per confronto tra modelli, routing di fallback, ottimizzazione dei costi, ridondanza tra provider, osservabilità e passaggio tra modelli senza riscrivere l’applicazione.

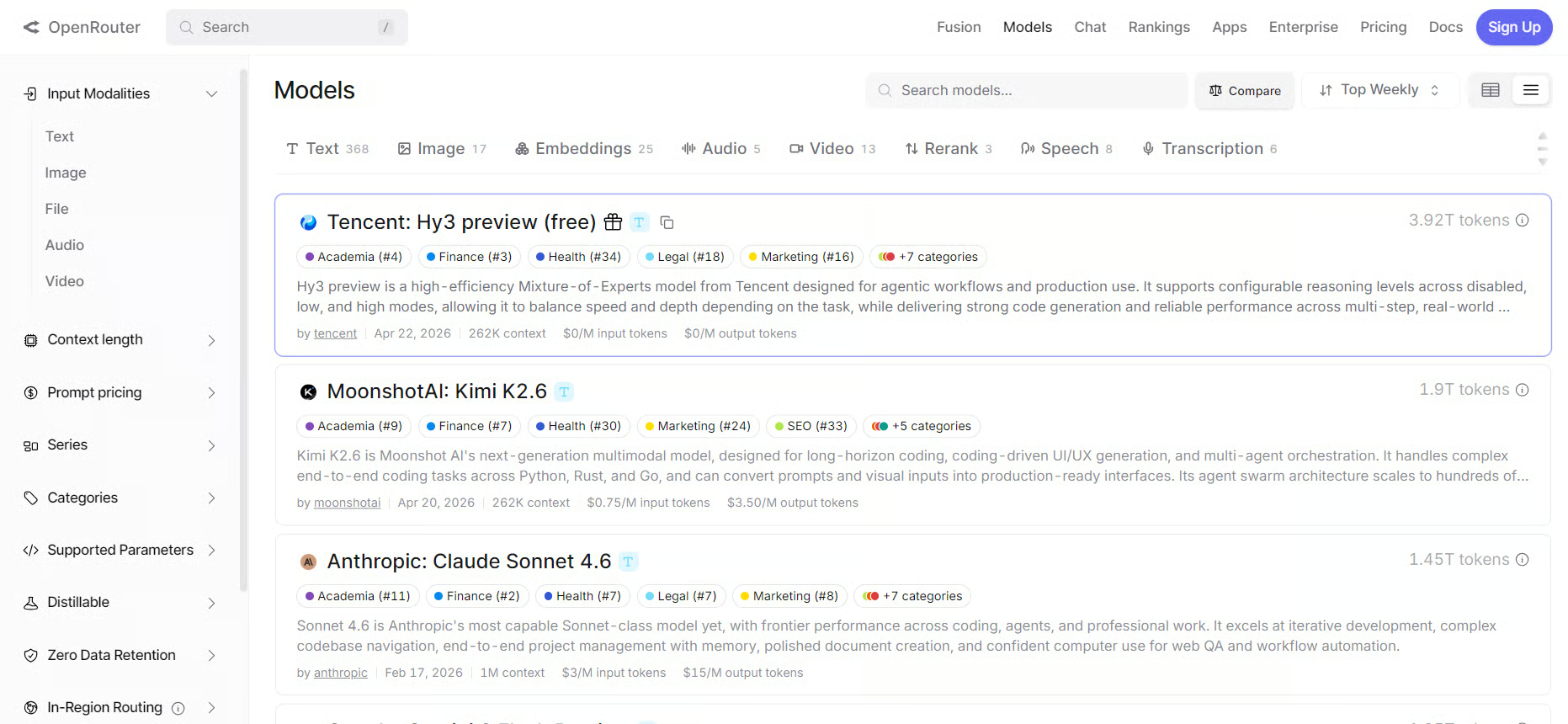

7. OpenRouter

OpenRouter è uno dei provider di routing LLM più popolari. Offre agli sviluppatori accesso a molti modelli tramite una singola API compatibile con OpenAI, facilitando il lavoro con diversi provider usando un’unica integrazione.

Come abbiamo trattato in diversi tutorial, OpenRouter è un’ottima opzione per sviluppatori che vogliono confrontare modelli, testare rapidamente nuove release, instradare richieste tra provider o evitare il lock-in su un unico fornitore.

Fonte: OpenRouter

Uno svantaggio è che OpenRouter aggiunge un ulteriore livello tra la tua applicazione e il provider del modello. Ciò può introdurre dipendenze extra, latenza variabile e comportamenti specifici del provider che richiedono comunque test.

Per carichi in produzione, i team dovrebbero rivedere impostazioni di routing, comportamento di fallback, preferenze di provider e controlli sulla privacy prima di inviare traffico sensibile o critico per il business attraverso la piattaforma.

Ideale per: app multi-modello, confronto tra modelli, routing di fallback, flessibilità sui provider e sperimentazione rapida.

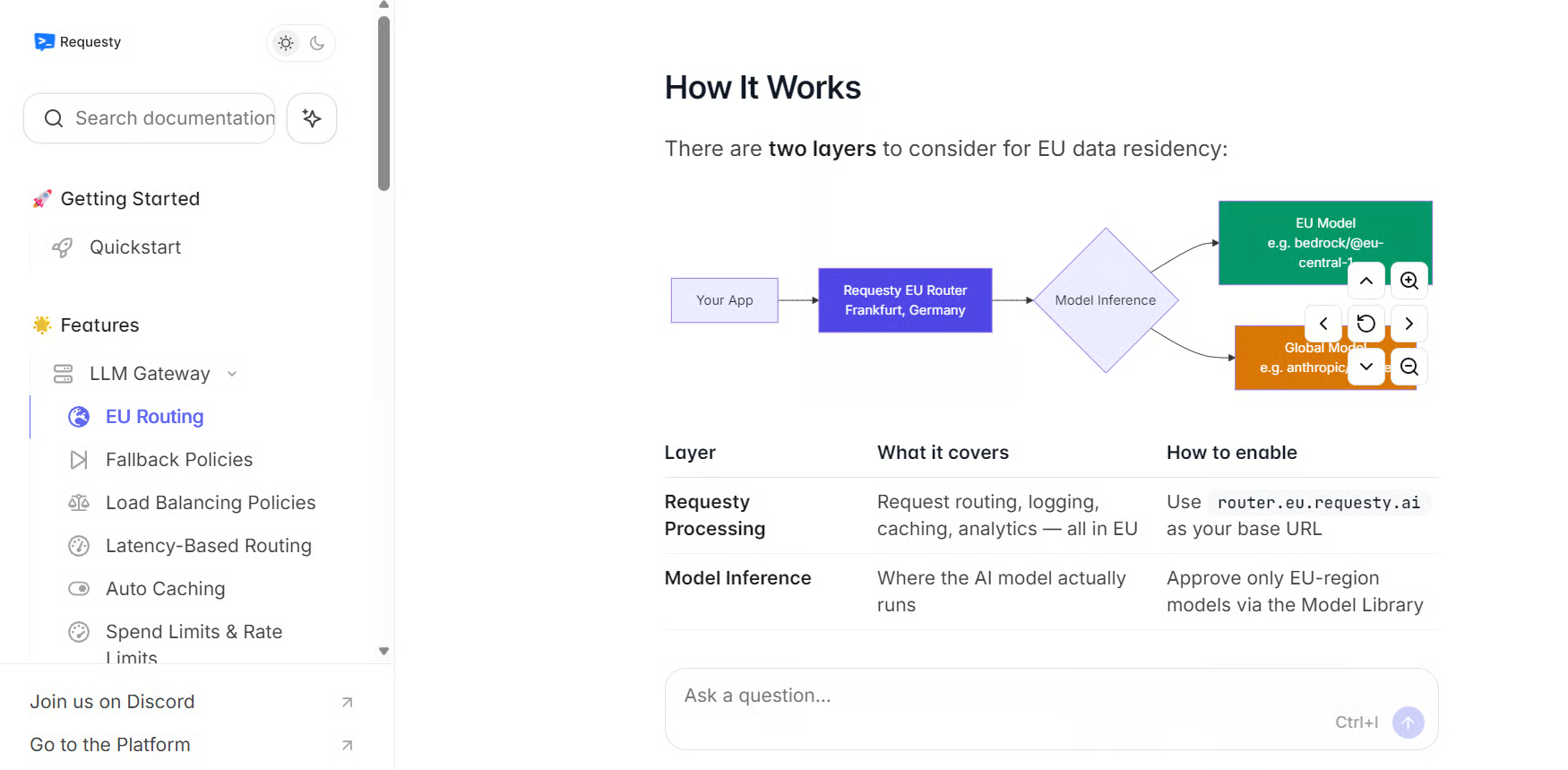

8. Requesty.ai

Requesty.ai è una piattaforma di routing e gateway per LLM che aiuta i team a connettersi a più provider LLM tramite un’unica API compatibile con OpenAI. Supporta oltre 400 modelli, con funzionalità per routing, fallback, caching, gestione dei costi, osservabilità e governance.

Requesty.ai è un’ottima opzione per team che costruiscono applicazioni IA di produzione basate su più di un provider di modelli. È particolarmente utile per gestire policy di routing, tracciare l’uso, controllare la spesa e migliorare l’affidabilità quando i provider hanno problemi, vanno in timeout o raggiungono i rate limit.

Fonte: Requesty AI Documentation

Come per OpenRouter, il principale svantaggio è che Requesty.ai aggiunge un altro livello di gateway allo stack applicativo. I team devono configurare con cura routing, fallback, logging e governance per evitare costi, latenze o comportamenti inattesi.

Per carichi sensibili, Requesty.ai include controlli come rilevamento PII, pulizia, guardrail sui contenuti, audit log e funzionalità di governance, ma i team dovrebbero comunque decidere quali dati possono passare dal gateway e come gestire i log.

Ideale per: routing LLM, controllo dei costi, osservabilità, fallback tra provider, governance e workflow di gateway IA in produzione.

Provider LLM cloud

I provider LLM cloud sono grandi piattaforme cloud che offrono a sviluppatori e aziende accesso gestito a modelli foundation. Spesso supportano sia i propri modelli che modelli di provider terzi.

Sono particolarmente utili per le aziende che già usano infrastruttura cloud e necessitano di sicurezza, governance, conformità, integrazione dei dati, controlli di deployment e gestione dei modelli in un unico posto.

9. Google Vertex AI

Google Vertex AI è la piattaforma di machine learning e IA generativa di Google Cloud. Offre a sviluppatori e aziende accesso ai modelli Gemini, al Model Garden, a strumenti per agenti e a infrastruttura gestita per creare, distribuire e gestire applicazioni IA.

Vertex AI supporta anche partner leader e modelli open tramite Model Garden, inclusi Anthropic Claude, xAI Grok, i modelli di Mistral AI e modelli open-source come GLM 5 e Gemma 4, insieme ai modelli Gemini di Google.

Fonte: Generative AI on Vertex AI

Google Vertex AI è un’ottima opzione per team che già usano Google Cloud e vogliono deployment cloud-native dei modelli, governance, controlli di sicurezza e integrazione con il più ampio ecosistema dati e IA di Google.

D’altra parte, Vertex AI può risultare più complesso rispetto all’uso di una semplice API di modello. I team potrebbero aver bisogno di esperienza con Google Cloud per gestire correttamente progetti, permessi, billing, impostazioni di deployment e integrazioni.

Per carichi sensibili, Vertex AI è utile per team che necessitano di controlli a livello cloud, governance e infrastruttura gestita, ma le decisioni di setup su logging, accesso ai dati e regioni di deployment richiedono comunque un attento esame.

Ideale per: utenti Google Cloud, accesso a Gemini, app IA enterprise, workflow multimodali e deployment cloud-native dei modelli.

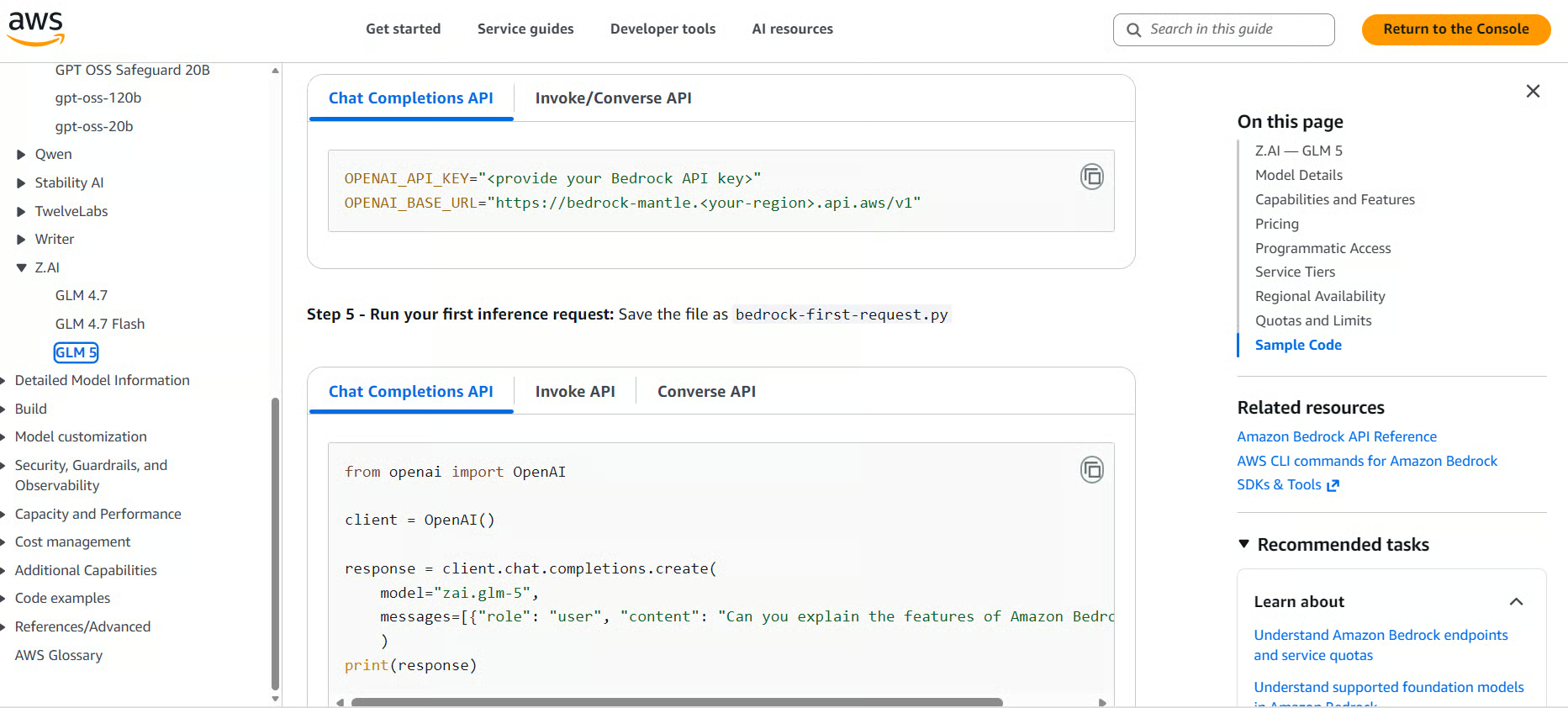

10. Amazon Bedrock

Amazon Bedrock è la piattaforma gestita di IA generativa di AWS. Offre agli sviluppatori accesso a modelli foundation di Amazon e provider terzi tramite un unico servizio AWS gestito.

Bedrock supporta modelli di provider come Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek e altri, risultando utile per team che vogliono scelta di modelli all’interno dell’ecosistema AWS.

Amazon Bedrock è un’ottima scelta per aziende che già costruiscono su AWS perché riunisce accesso ai modelli, infrastruttura cloud, controlli di sicurezza e integrazione enterprise in un’unica piattaforma.

Fonte: Amazon Bedrock

Uno svantaggio importante è che Bedrock può essere più complesso di una semplice API LLM. I team potrebbero aver bisogno di esperienza AWS per gestire correttamente permessi, regioni, accesso ai modelli, prezzi, networking e impostazioni di deployment.

Per carichi sensibili, Bedrock è utile perché prompt e output non vengono usati per addestrare i modelli base o condivisi con i provider, e i team possono usare controlli AWS come crittografia, IAM e PrivateLink.

Ideale per: utenti AWS, IA enterprise, accesso gestito ai modelli foundation, deployment incentrati sulla sicurezza e applicazioni di IA generativa cloud-native.

Tabella di confronto dei provider di API LLM

La tabella seguente confronta i principali provider di API LLM in base ai loro vantaggi chiave e ai principali svantaggi.

|

Provider |

Vantaggi chiave |

Principali svantaggi |

|

OpenAI |

Alta qualità dei modelli, API mature, strumenti multimodali, output strutturati, embeddings, speech, generazione di immagini e workflow agentici |

Può diventare costoso su larga scala e offre meno controllo rispetto a modelli open-source o self-hosted |

|

Anthropic |

Alta qualità di scrittura, attento rispetto delle istruzioni, ragionamento, coding e supporto a contesti lunghi |

I costi possono aumentare con documenti grandi o uso ad alto volume e i team hanno controllo limitato su hosting e internals del modello |

|

Google Gemini |

Forti capacità multimodali, API in tempo reale, supporto a contesti lunghi e stretta integrazione con l’ecosistema IA di Google |

Può risultare legato all’ecosistema Google; prezzi, disponibilità e funzionalità possono variare per strumento o regione |

|

Together AI |

Accesso ospitato a molti modelli open e specializzati, con inferenza serverless, endpoint dedicati, fine-tuning, valutazioni e infrastruttura GPU |

Qualità, velocità e affidabilità possono variare in base al modello selezionato |

|

Fireworks AI |

Inferenza veloce, bassa latenza, accesso serverless, deployment on-demand e API pronte per la produzione per modelli open |

Più focalizzato su inferenza e deployment che su una piattaforma di sviluppo IA all-in-one |

|

Nebius AI |

Infrastruttura con GPU, inferenza ospitata, API compatibile con OpenAI e livelli di velocità come Fast e Base |

Più incentrato sull’infrastruttura, quindi i team potrebbero necessitare di maggiori competenze su cloud e deployment |

|

OpenRouter |

Accesso a molti modelli tramite un’unica API compatibile con OpenAI, con passaggio ai provider e opzioni di fallback più semplici |

Aggiunge un ulteriore livello tra app e provider, che può influire su latenza, affidabilità o debugging |

|

Requesty.ai |

Un’unica API per più provider, con routing, fallback, caching, tracciamento dei costi, osservabilità e funzionalità di governance |

Richiede una configurazione attenta di routing, logging, fallback e controlli sui costi per evitare comportamenti inattesi |

|

Google Vertex AI |

Accesso gestito a Gemini, Anthropic Claude, xAI Grok, Mistral AI e modelli open tramite Model Garden, oltre a strumenti di sicurezza e governance di Google Cloud |

Più complesso di una semplice API e potrebbe richiedere esperienza con Google Cloud |

|

Amazon Bedrock |

Accesso gestito a modelli di Amazon e provider terzi come Anthropic, Meta, Mistral AI, Cohere e altri all’interno di AWS |

Più complesso di una semplice API LLM, soprattutto per permessi, regioni, prezzi e accesso ai modelli |

Scegliere il miglior provider di API LLM per il tuo caso d’uso

La scelta del giusto provider di API LLM dipende da tre fattori:

- Cosa stai costruendo

- Quanto controllo ti serve

- Quanto sei disposto a spendere

Per startup e piccoli team, i provider di API LLM open-source sono spesso il punto di partenza migliore. Piattaforme come Together AI, Fireworks AI e Nebius AI ti danno accesso a potenti modelli open senza gestire GPU o infrastruttura in proprio. Possono essere più veloci, economici e flessibili per la sperimentazione e lo sviluppo di prodotti nelle fasi iniziali.

Se vuoi testare rapidamente modelli diversi, i provider di routing LLM sono un’ottima opzione. Strumenti come OpenRouter e Requesty.ai ti permettono di confrontare modelli closed-source e open-source tramite un’unica API, gestire i fallback e cambiare provider senza riscrivere l’applicazione.

Per workflow in cui la qualità del modello conta più del costo, i provider nativi come OpenAI e Anthropic restano tra le scelte più forti. Sono particolarmente utili per assistenti IA in produzione, strumenti di coding, workflow con molto ragionamento, app multimodali e sistemi agentici in cui affidabilità e prestazioni del modello sono fondamentali.

Infine, se la tua azienda già usa AWS o Google Cloud, spesso ha senso restare in quell’ecosistema. Amazon Bedrock e Google Vertex AI offrono accesso gestito ai modelli, controlli di sicurezza, governance e integrazione con gli strumenti che il tuo team già utilizza.

Considerazioni finali

Per lavoro tecnico, assistenti di coding e strumenti di vibe coding, eviterei troppa sperimentazione all’inizio. Per esperienza, OpenAI e Anthropic sono di solito le scelte più sicure grazie al loro forte supporto a coding, ragionamento e strumenti per sviluppatori.

I provider di API LLM open-source e i provider di routing LLM sono valide alternative per sperimentazioni più avanzate.

I grandi provider LLM nel cloud di solito hanno senso solo in contesti aziendali. In tal caso, scegli quello del cui ecosistema già ti servi.

FAQ sui provider di API LLM

Che cos’è un provider di API LLM?

Un’azienda o piattaforma che ospita large language model ed espone tali modelli tramite un’API, così che gli sviluppatori possano inviare richieste e ricevere risposte generate dall’IA senza dover gestire direttamente GPU o infrastruttura di inferenza.

Qual è la differenza tra un provider LLM nativo e uno cloud?

I provider nativi (come OpenAI e Anthropic) costruiscono ed erogano direttamente i propri modelli. I provider cloud (come AWS Bedrock e Google Vertex AI) offrono accesso gestito a più modelli di terze parti, integrato in un ecosistema cloud esistente con strumenti enterprise di sicurezza e governance.

Quando dovrei usare un provider di routing LLM come OpenRouter o Requesty.ai?

Quando devi lavorare con più di un modello o provider, vuoi un fallback automatico se un provider ha un disservizio, oppure devi confrontare modelli e controllare i costi, il tutto tramite una singola integrazione API.

I provider di API LLM open-source sono meno capaci dei provider nativi come OpenAI?

Non necessariamente; dipende dal compito. Piattaforme come Together AI e Fireworks AI ospitano modelli open all’avanguardia come Llama, DeepSeek e Mistral, che possono competere con i modelli closed, spesso a costi significativamente inferiori.

Quale provider di API LLM è migliore per aziende con requisiti di conformità stringenti?

Amazon Bedrock e Google Vertex AI sono in genere le scelte più solide, poiché offrono controlli di sicurezza cloud-native, IAM, crittografia, audit logging e funzionalità di governance che si integrano con l’infrastruttura enterprise esistente.

In quanto data scientist certificato, sono appassionato di sfruttare tecnologie all’avanguardia per creare applicazioni di machine learning innovative. Con una solida esperienza in riconoscimento vocale, analisi e reportistica dei dati, MLOps, AI conversazionale e NLP, ho affinato le mie competenze nello sviluppo di sistemi intelligenti in grado di avere un impatto concreto. Oltre alla mia expertise tecnica, sono anche un comunicatore efficace, con il talento di rendere chiari e sintetici concetti complessi. Di conseguenza, sono diventato un blogger molto seguito in ambito data science, condividendo idee ed esperienze con una community in crescita di professionisti dei dati. Attualmente mi concentro sulla creazione e sull’editing di contenuti, lavorando con large language model per sviluppare contenuti potenti e coinvolgenti che possano aiutare aziende e singoli a valorizzare al meglio i propri dati.