Leerpad

API-providers voor Large Language Models (LLM's) geven ontwikkelaars toegang tot krachtige AI-modellen zonder zelf GPU's, modeluitrol, schaalvergroting of inferentie-infrastructuur te hoeven beheren. In plaats van een model zelf te hosten, kunnen ontwikkelaars verbinden met een API, een model kiezen, een verzoek sturen en een antwoord ontvangen.

In dit artikel bekijken we de top 10 LLM API-providers op basis van modelkwaliteit, ontwikkelaarservaring, prijs, schaalbaarheid, ecosysteemondersteuning en productierijpheid. Per provider bespreken we waar deze het best voor is, de belangrijkste voordelen en de voornaamste nadelen waar ontwikkelaars rekening mee moeten houden.

Deze gids verdeelt de beste LLM API-providers in vier categorieën:

- Native LLM-providers

- Open-source LLM API-providers

- LLM-routingproviders

- Cloud LLM-providers

Native LLM-providers

Native LLM-providers bouwen, trainen en leveren hun eigen modelfamilies via API's. Ze zijn vaak de sterkste optie voor ontwikkelaars die hoge modelkwaliteit, betrouwbare documentatie, geavanceerd redeneren, multimodale ondersteuning en productierijpe tooling willen.

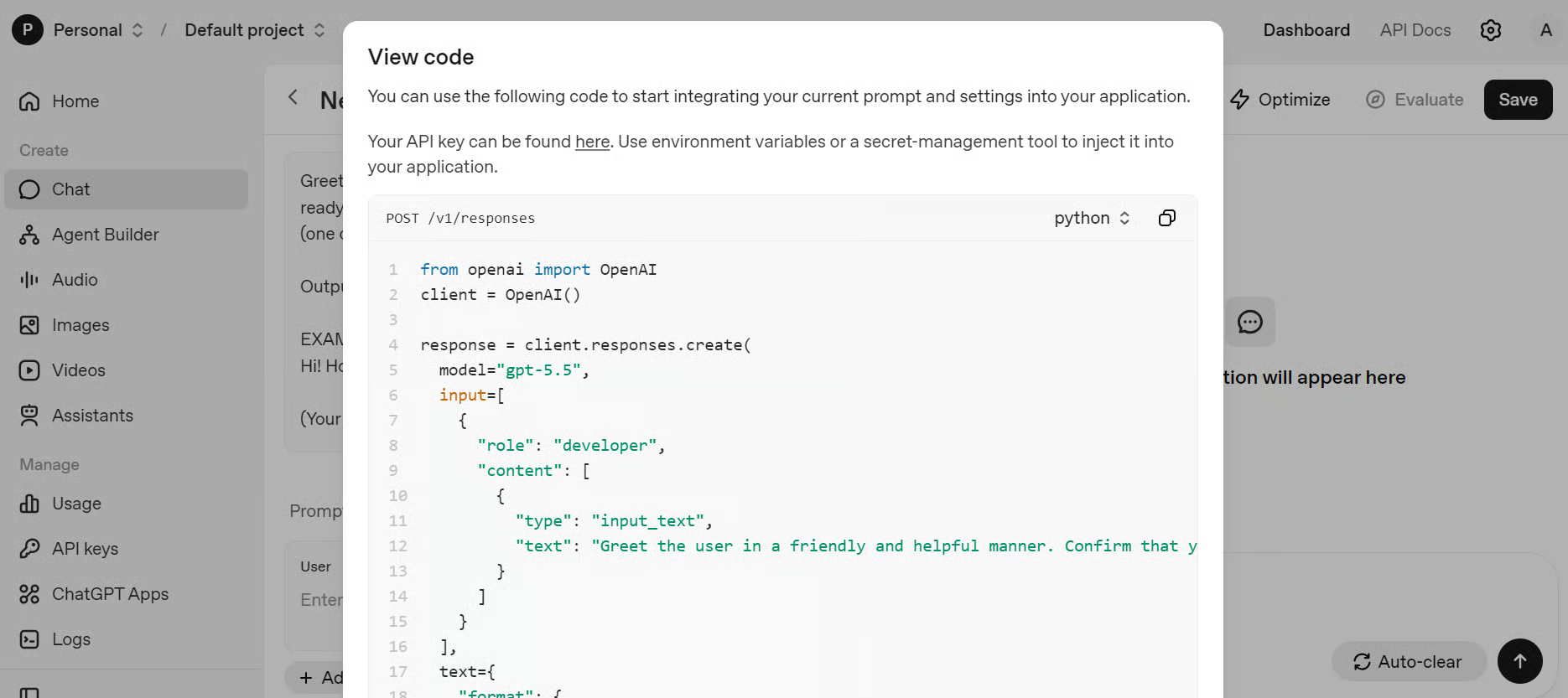

1. OpenAI

OpenAI is een van de meest wijdverspreide LLM API-providers. Het API-platform biedt toegang tot:

- Frontier-reasoningmodellen zoals GPT-5.5

- Realtime spraaksynthese en vertaling via GPT-Realtime-2

- Beeldgeneratie via het GPT-Images-2.0-beeldgeneratiemodel

- Agentgebaseerde ontwikkeling met de OpenAI Agents SDK

De API ondersteunt streaming, realtime-interfaces en gestructureerde outputs.

OpenAI is een sterke keuze voor teams die AI-assistants, codingtools, klantenservice-agents, interne copilots, multimodale apps en agentgebaseerde systemen bouwen.

Bron: OpenAI

Een nadeel is dat OpenAI op schaal duur kan worden, vooral voor toepassingen met veel volume of intensief redeneren. Het is ook een gesloten API-provider, wat betekent dat ontwikkelaars minder controle hebben over modelinterne zaken, hosting en maatwerk in vergelijking met open-source of zelfgehoste modellen.

Het best voor: algemene AI-apps, redeneren, coding, multimodale workflows en productierijpe AI-producten.

2. Anthropic

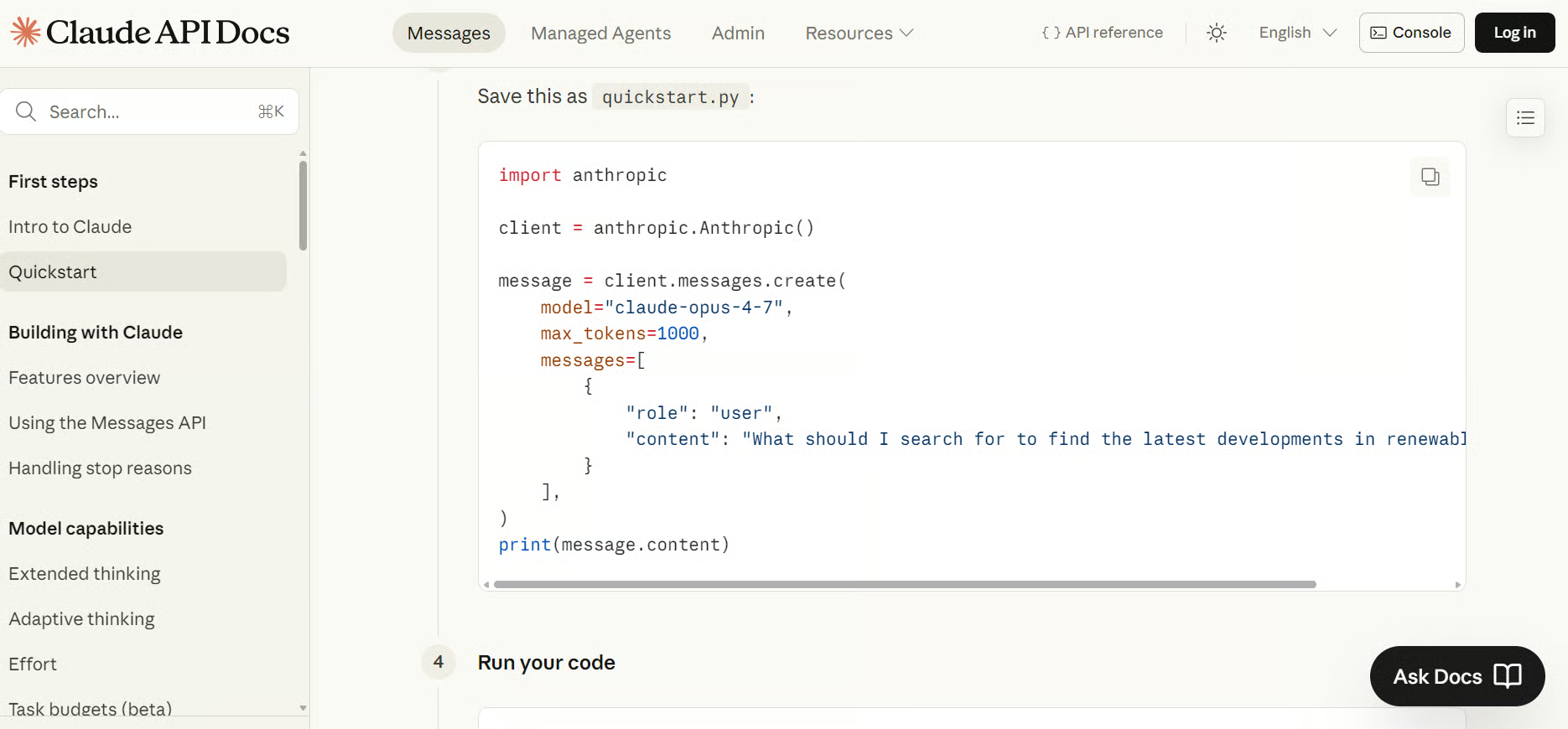

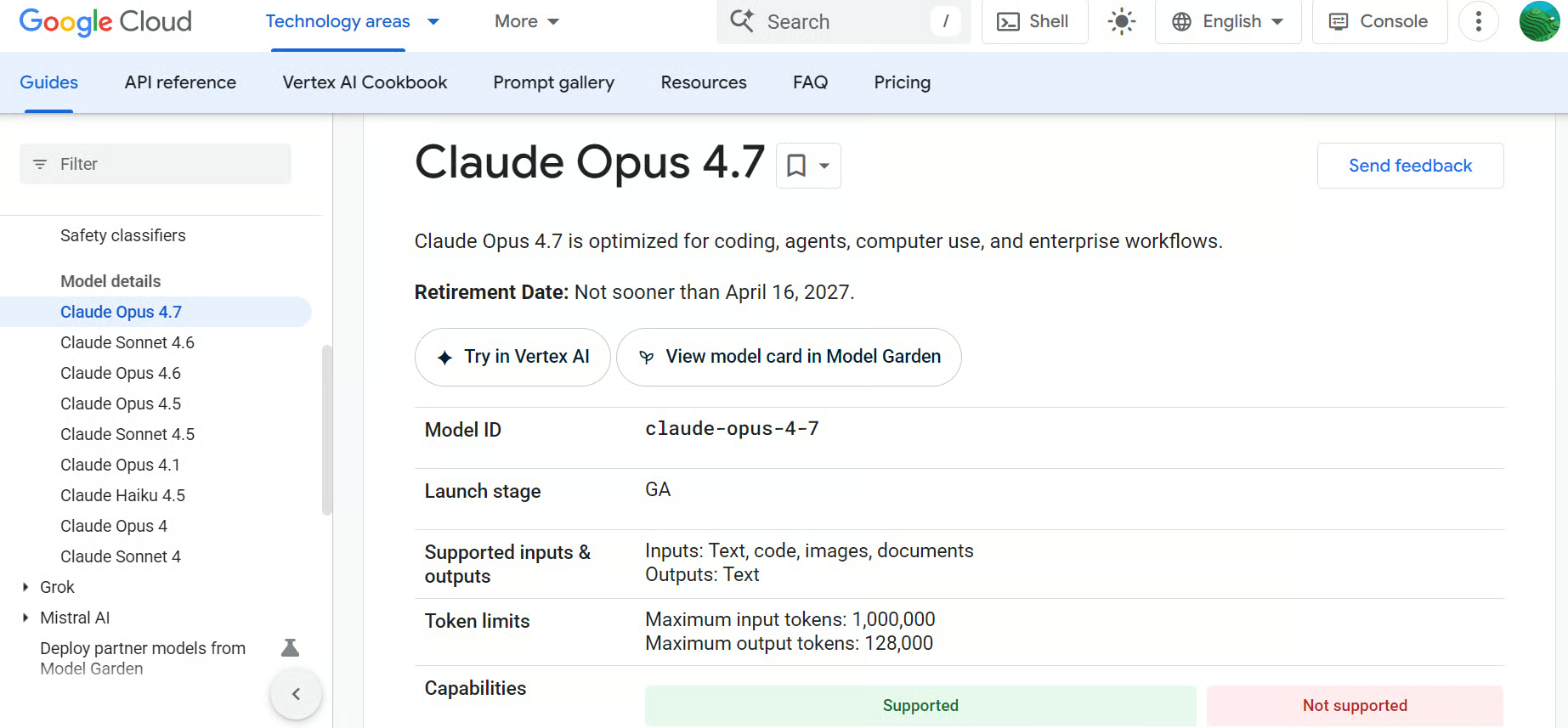

Anthropic biedt de Claude-modelfamilie via de API, bijvoorbeeld het nieuwste vlaggenschipmodel, Claude Opus 4.7. Claude is ontworpen voor taal, redeneren, analyse, coding, long-contextwerk en agentische workflows. Het ontwikkelaarsplatform van Anthropic geeft teams directe modeltoegang via API's, SDK's en ontwikkelaarsdocumentatie.

Claude is vooral nuttig voor toepassingen die zorgvuldige instructieopvolging, sterke schrijfkwaliteit, documentanalyse en betrouwbare omgang met complexe prompts nodig hebben.

Bron: Aan de slag met Claude

Een belangrijk nadeel is de kostprijs, vooral bij gebruik van Claude voor grote documenten, long-contextprompts of toepassingen met veel volume. Omdat Claude via een gehoste API wordt benaderd, hebben teams ook beperkte controle over waar en hoe het model draait.

Voor privacygevoelige use-cases moeten ontwikkelaars gegevensafhandeling, retentie en compliance-eisen zorgvuldig beoordelen voordat ze vertrouwelijke bedrijfs- of klantdata via de API versturen.

Het best voor: coding-assistants, enterprise-AI, long-contextanalyse, documentworkflows en AI-agents.

Voor een gedetailleerde vergelijking van de twee AI-giganten, bekijk onze gids over Anthropic vs OpenAI.

3. Google Gemini

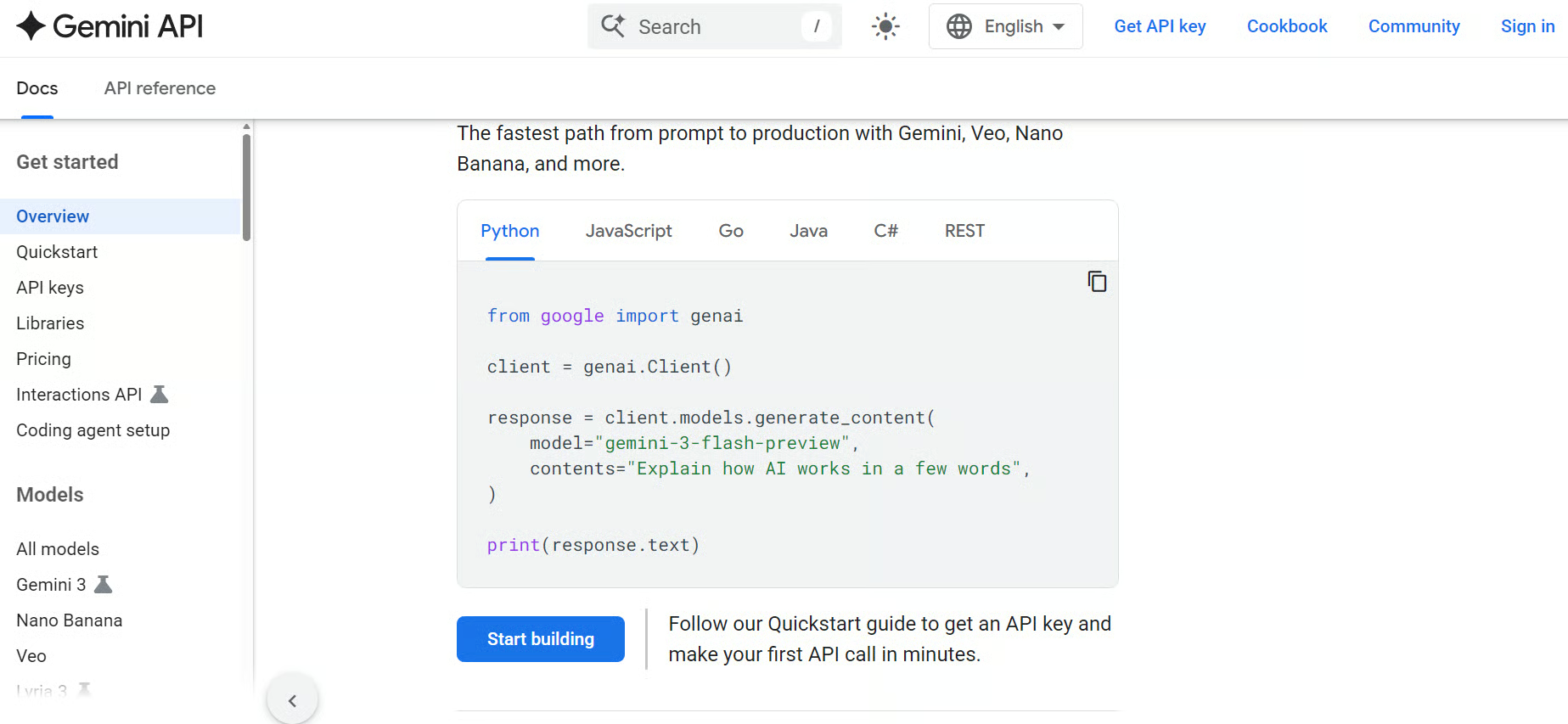

Google Gemini is Google's eigen LLM-familie, waaronder Gemini 3.1 Pro, beschikbaar voor ontwikkelaars via de Gemini API. De Gemini API ondersteunt standaard-, streaming- en realtime-API's, met documentatie voor modeldetails, SDK's, prijzen, setup en API-referenties.

Met Nano Banana 2 voor beeldgeneratie en Veo 3.1 geïntegreerd, is Gemini een sterke optie voor ontwikkelaars die multimodale toepassingen bouwen. Het is ook een goede keuze voor AI-assistants (vooral die afhankelijk zijn van zoekervaringen), codingtools en producten die aansluiten op Google's bredere AI-ecosysteem.

Bron: Gemini API

Toch kan Gemini meer verweven aanvoelen met Google's ecosysteem, wat misschien niet past bij teams die een provider-neutrale setup willen. Prijzen, modelbeschikbaarheid en ondersteuning van functies kunnen ook per tool en regio verschillen.

Voor privacygevoelige toepassingen moeten teams de gegevensafhandeling, retentie en compliance-eisen beoordelen voordat ze vertrouwelijke bedrijfs- of klantdata via de API sturen.

Het best voor: multimodale AI-apps, integratie met het Google-ecosysteem, long-contextworkflows, coding en algemene AI-toepassingen.

Open-source LLM API-providers

Open-source LLM API-providers geven ontwikkelaars gehoste API-toegang tot open-source- en open-weight-modellen. In plaats van modellen te downloaden en op je eigen GPU's te draaien, hosten deze platforms de modellen en stellen ze ze beschikbaar via simpele API's.

Deze providers zijn nuttig voor teams die lagere kosten, meer modelflexibiliteit, snellere experimentatie en toegang tot populaire open modellen willen, zoals Llama, DeepSeek, Qwen, Mistral, Gemma en andere.

4. Together AI

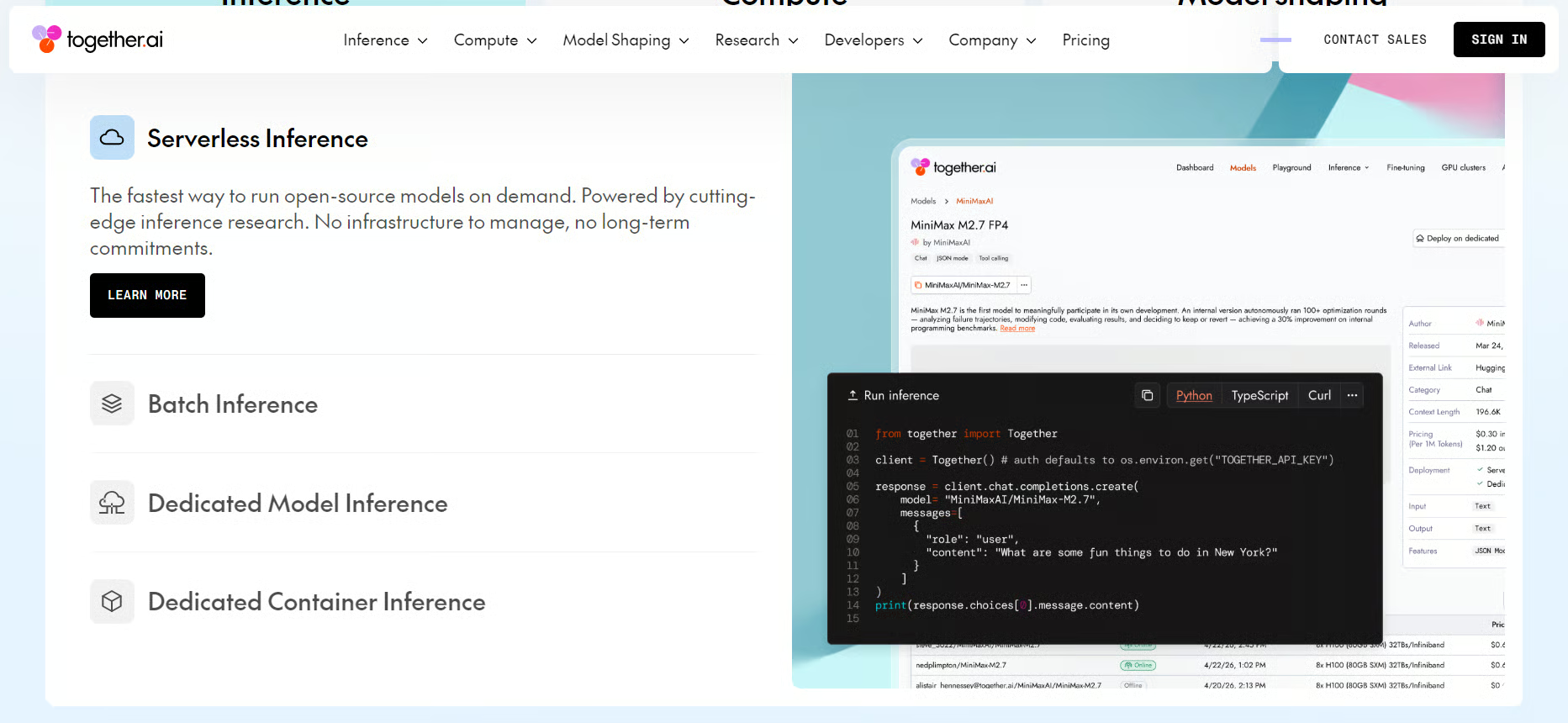

Together AI biedt gehoste toegang tot open-source- en gespecialiseerde modellen via één uniforme API. De modelcatalogus omvat 200+ modellen voor tekst, beeld, video, code en audio, met ondersteuning voor serverloze inferentie, batch-inferentie, dedicated endpoints, fine-tuning, evaluaties en GPU-clusters.

Together AI is een sterke optie voor ontwikkelaars die met open modellen willen bouwen zonder hun eigen infrastructuur te beheren. Het is vooral nuttig voor teams die meerdere modellen testen, aangepaste modellen fine-tunen of inferentieworkloads opschalen.

Bron: Together AI

Dat gezegd hebbende, de modelkwaliteit, snelheid en betrouwbaarheid kunnen variëren afhankelijk van het gekozen model. Teams hebben mogelijk meer tests, benchmarking en evaluatie nodig voordat ze het in productie gebruiken.

Voor gevoelige workloads moeten teams nagaan of ze serverloze toegang, dedicated endpoints of private deployment-opties nodig hebben om aan hun beveiligings- en compliance-eisen te voldoen.

Het best voor: open-source modelinferentie, fine-tuning, schaalbare AI-workloads en experimentatie met veel modellen.

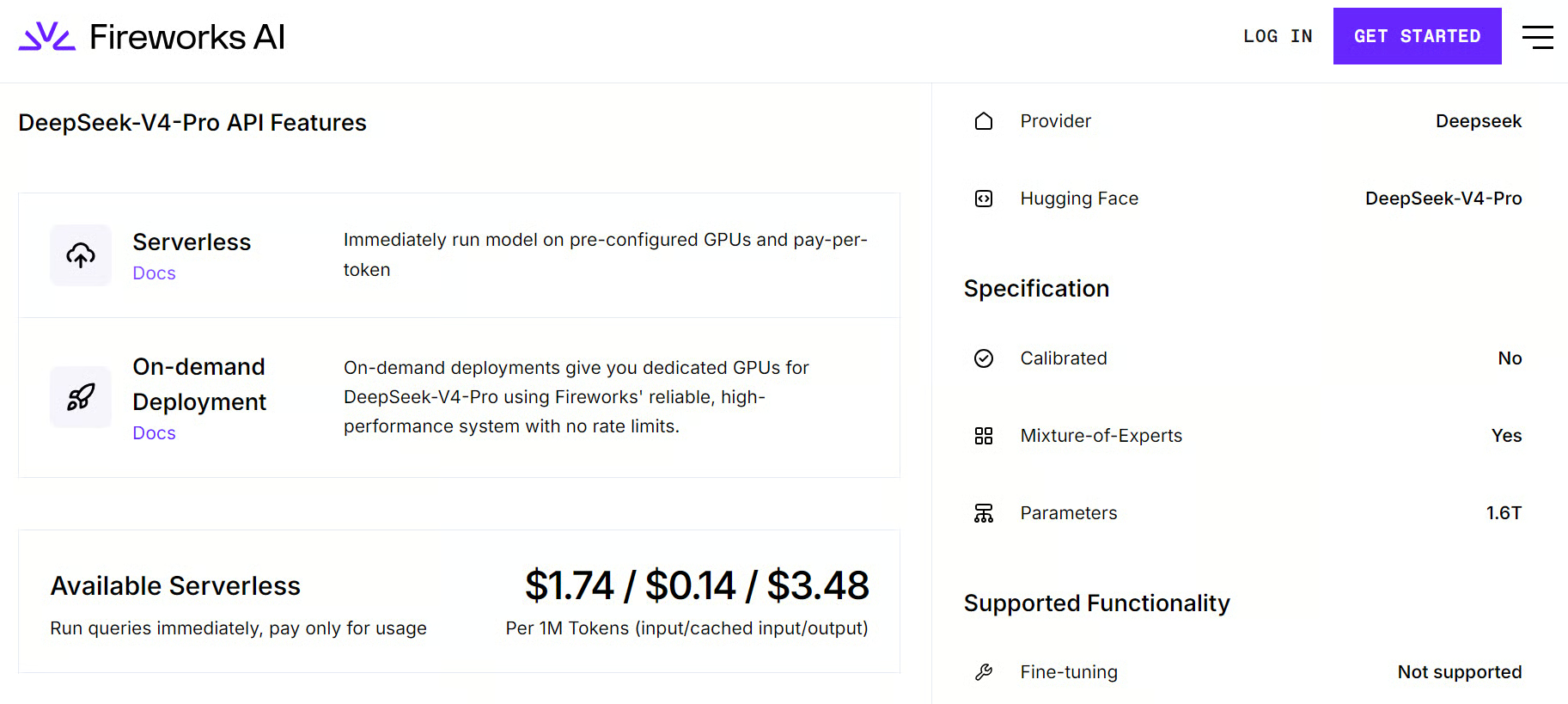

5. Fireworks AI

Fireworks AI richt zich op snelle inferentie voor open-source LLM's en generatieve AI-modellen. Het platform ondersteunt serverloze inferentie, on-demand deployments, fine-tuning en productierijpe API's voor populaire open modellen.

Fireworks AI is een sterke optie voor teams die open-modelflexibiliteit willen met snellere inferentie en lagere latency. Het is vooral nuttig voor conversational AI, coding-assistants, search, multimodale apps en enterprise RAG-systemen.

Bron: Fireworks AI

Een belangrijk nadeel is dat Fireworks AI meer gericht is op inferentie en deployment dan op een brede, alles-in-één AI-ontwikkelplatformbenadering. Teams hebben mogelijk nog aparte tools nodig voor orkestratie, evaluaties, monitoring of complexe agentworkflows.

Teams moeten ook overwegen of serverloze inferentie voldoende is voor gevoelige workloads, of dat dedicated deployments nodig zijn voor meer controle over prestaties en compliance.

Het best voor: snelle open-source modelinferentie, fine-tuning, productieklare AI-apps en low-latency open-modeldeployments.

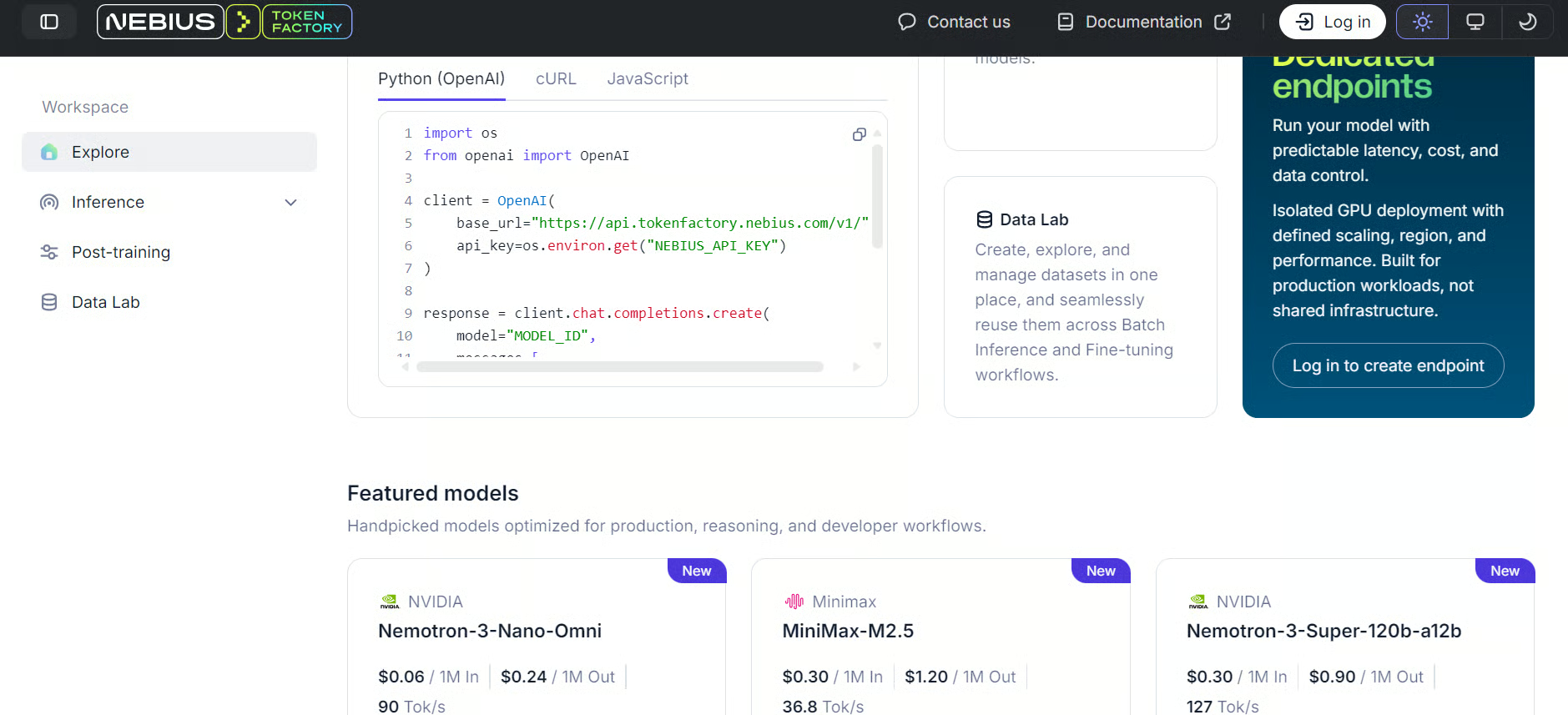

6. Nebius AI

Nebius AI is een AI-cloudprovider gebouwd voor GPU-ondersteunde AI-workloads, gehoste inferentie, modelserving en schaalbare AI-infrastructuur. De Token Factory-inferentieservice ondersteunt open modellen via een OpenAI-compatibele API, met opties voor serverloze inferentie, fine-tuning en dedicated AI-cloudinfrastructuur.

Nebius AI is een sterke optie voor teams die meer infrastructuurcontrole willen dan bij een basale API-provider, maar toch de complexiteit van volledig eigen GPU-omgevingen willen vermijden. Het is vooral nuttig voor teams die met open en custom modellen bouwen en schaalbare compute, snelle inferentie en productierijpe deploy-opties nodig hebben.

Bron: Nebius Token Factory

Nebius Token Factory biedt twee snelheidsniveaus voor inferentie: Fast en Base. Fast is ontworpen voor interactieve workloads met lagere latency, terwijl Base is bedoeld voor kostenefficiënte, grootschalige inferentie of achtergrondverwerking.

Nebius is zeker meer infrastructuurgericht dan eenvoudige plug-and-play LLM API-platforms. Dit betekent dat teams meer kennis van cloud, deployment en workloadbeheer nodig kunnen hebben om er het meeste uit te halen.

Voor gevoelige workloads moeten teams overwegen of managed inferentie voldoende is of dat dedicated infrastructuur nodig is voor meer controle over beveiliging, compliance en data governance.

Het best voor: AI-cloudinfrastructuur, gehoste inferentie, GPU-ondersteunde workloads, snelle inferentie en teams die meer deploycontrole willen.

LLM-routingproviders

LLM-routingproviders geven ontwikkelaars toegang tot meerdere modellen en providers via één API. In plaats van afzonderlijk te integreren met OpenAI, Anthropic, Google, Mistral, DeepSeek en andere providers, kunnen ontwikkelaars één routinglaag gebruiken om de modeltoegang centraal te beheren.

Deze platforms zijn nuttig voor modelvergelijking, fallback-routing, kostenoptimalisatie, providerredundantie, observeerbaarheid en wisselen tussen modellen zonder je applicatie te herschrijven.

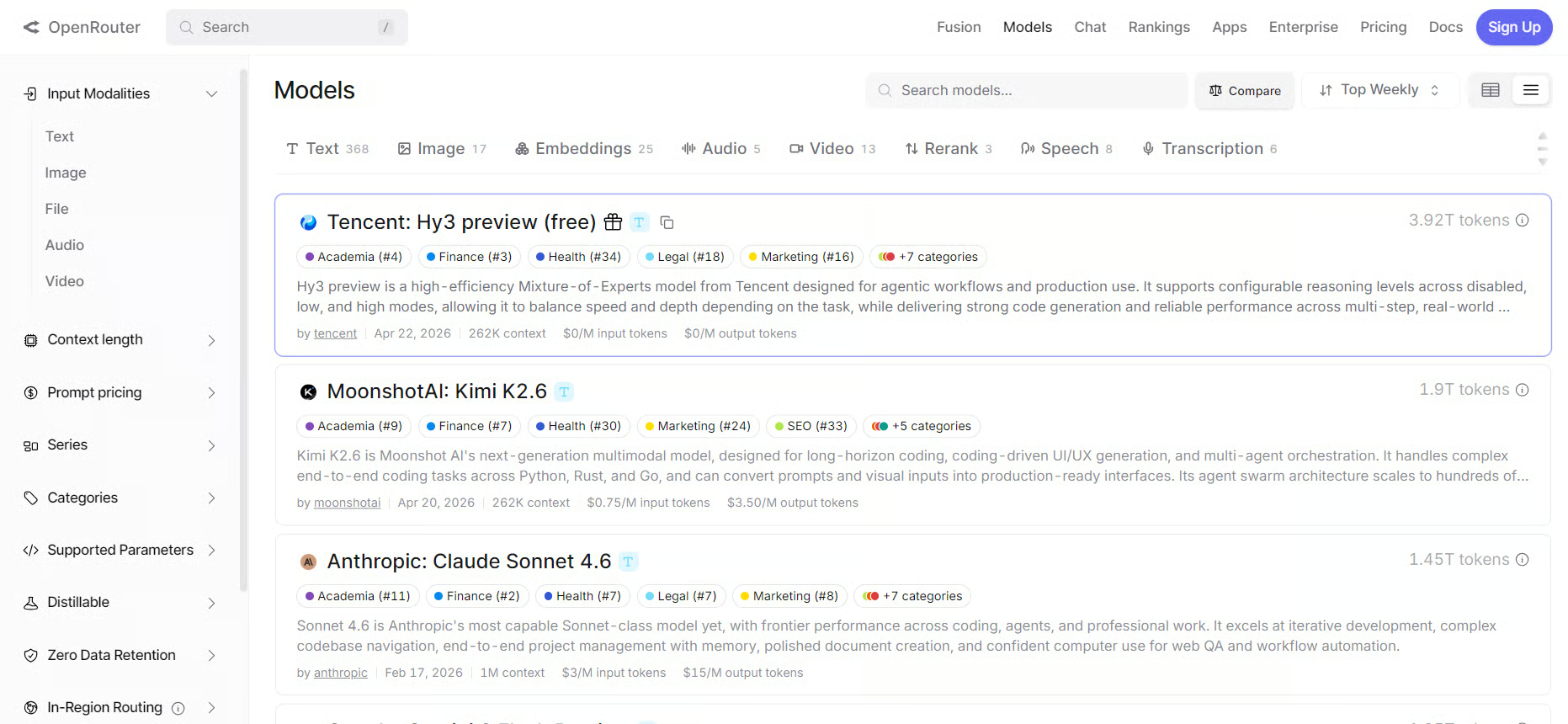

7. OpenRouter

OpenRouter is een van de populairste LLM-routingproviders. Het geeft ontwikkelaars toegang tot veel modellen via één OpenAI-compatibele API, waardoor het eenvoudiger wordt om met verschillende providers te werken met één integratie.

Zoals we in meerdere tutorials hebben besproken, is OpenRouter een sterke optie voor ontwikkelaars die modellen willen vergelijken, snel nieuwe releases willen testen, verzoeken over providers willen routeren of willen voorkomen dat ze vastzitten aan één modelleverancier.

Bron: OpenRouter

Een nadeel is dat OpenRouter een extra laag toevoegt tussen je applicatie en de modelprovider. Dit kan extra afhankelijkheid, variabele latency en providerspecifiek gedrag introduceren dat alsnog getest moet worden.

Voor productieworkloads moeten teams de routeringsinstellingen, fallback-gedrag, provider-voorkeuren en privacycontroles doornemen voordat ze gevoelige of bedrijfskritieke traffic via het platform sturen.

Het best voor: multi-modelapps, modelvergelijking, fallback-routing, providerflexibiliteit en snel experimenteren.

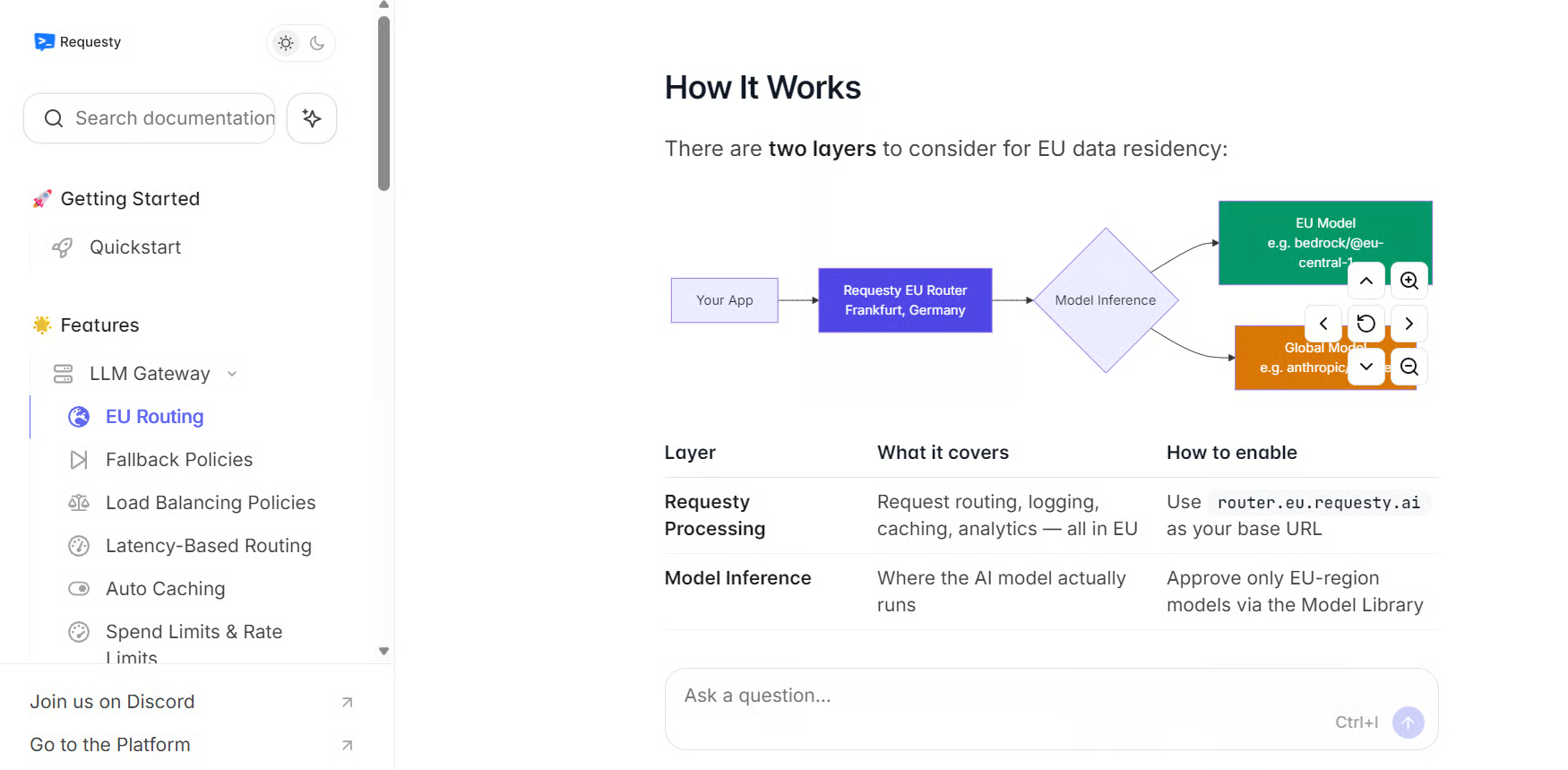

8. Requesty.ai

Requesty.ai is een LLM-routing- en gatewayplatform dat teams helpt verbinding te maken met meerdere LLM-providers via één OpenAI-compatibele API. Het ondersteunt 400+ modellen, met functies voor routing, fallback, caching, kostenbeheer, observeerbaarheid en governance.

Requesty.ai is een sterke optie voor teams die productie-AI-toepassingen bouwen die op meer dan één modelprovider steunen. Het is vooral nuttig voor het beheren van routeringsbeleid, het volgen van gebruik, het beheersen van kosten en het verbeteren van betrouwbaarheid wanneer providers uitvallen, time-outs geven of rate limits bereiken.

Bron: Requesty AI Documentatie

Net als bij OpenRouter is het belangrijkste nadeel dat Requesty.ai een extra gatewaylaag toevoegt aan de applicatiestack. Teams moeten routing, fallback, logging en governance zorgvuldig configureren om onverwachte kosten, latency of providergedrag te voorkomen.

Voor gevoelige workloads bevat Requesty.ai controles zoals PII-detectie, scrubbing, content-guardrails, auditlogs en governancefuncties, maar teams moeten nog steeds bepalen welke data door de gateway mag en hoe logs beheerd moeten worden.

Het best voor: LLM-routing, kostenbeheersing, observeerbaarheid, provider-fallback, governance en productie-AI-gatewayworkflows.

Cloud LLM-providers

Cloud LLM-providers zijn grote cloudplatforms die ontwikkelaars en enterprises beheerde toegang geven tot foundation-modellen. Deze platforms ondersteunen vaak hun eigen modellen én modellen van externe providers.

Ze zijn vooral nuttig voor enterprises die al cloudinfrastructuur gebruiken en beveiliging, governance, compliance, dataintegratie, deploycontrole en modelbeheer op één plek nodig hebben.

9. Google Vertex AI

Google Vertex AI is het machine learning- en generatieve AI-platform van Google Cloud. Het geeft ontwikkelaars en enterprises toegang tot Gemini-modellen, Model Garden, agenttools en beheerde infrastructuur voor het bouwen, uitrollen en beheren van AI-toepassingen.

Vertex AI ondersteunt ook leidende partners en open modellen via Model Garden, waaronder Anthropic Claude, xAI Grok, Mistral AI-modellen en open-source modellen zoals GLM 5 en Gemma 4, naast Google's eigen Gemini-modellen.

Bron: Generatieve AI op Vertex AI

Google Vertex AI is een sterke optie voor teams die al Google Cloud gebruiken en cloud-native modeldeployment, governance, beveiligingscontroles en integratie met Google's bredere data- en AI-ecosysteem willen.

Aan de andere kant kan Vertex AI complexer zijn dan het gebruik van een simpele model-API. Teams hebben mogelijk Google Cloud-ervaring nodig om projecten, permissies, facturatie, deploymentinstellingen en integraties goed te beheren.

Voor gevoelige workloads is Vertex AI nuttig voor teams die cloudniveau-toegangscontroles, governance en beheerde infrastructuur nodig hebben, maar beslissingen rond logging, data-toegang en deployregio's vergen nog steeds zorgvuldige afweging.

Het best voor: Google Cloud-gebruikers, Gemini-toegang, enterprise-AI-apps, multimodale workflows en cloud-native modeldeployment.

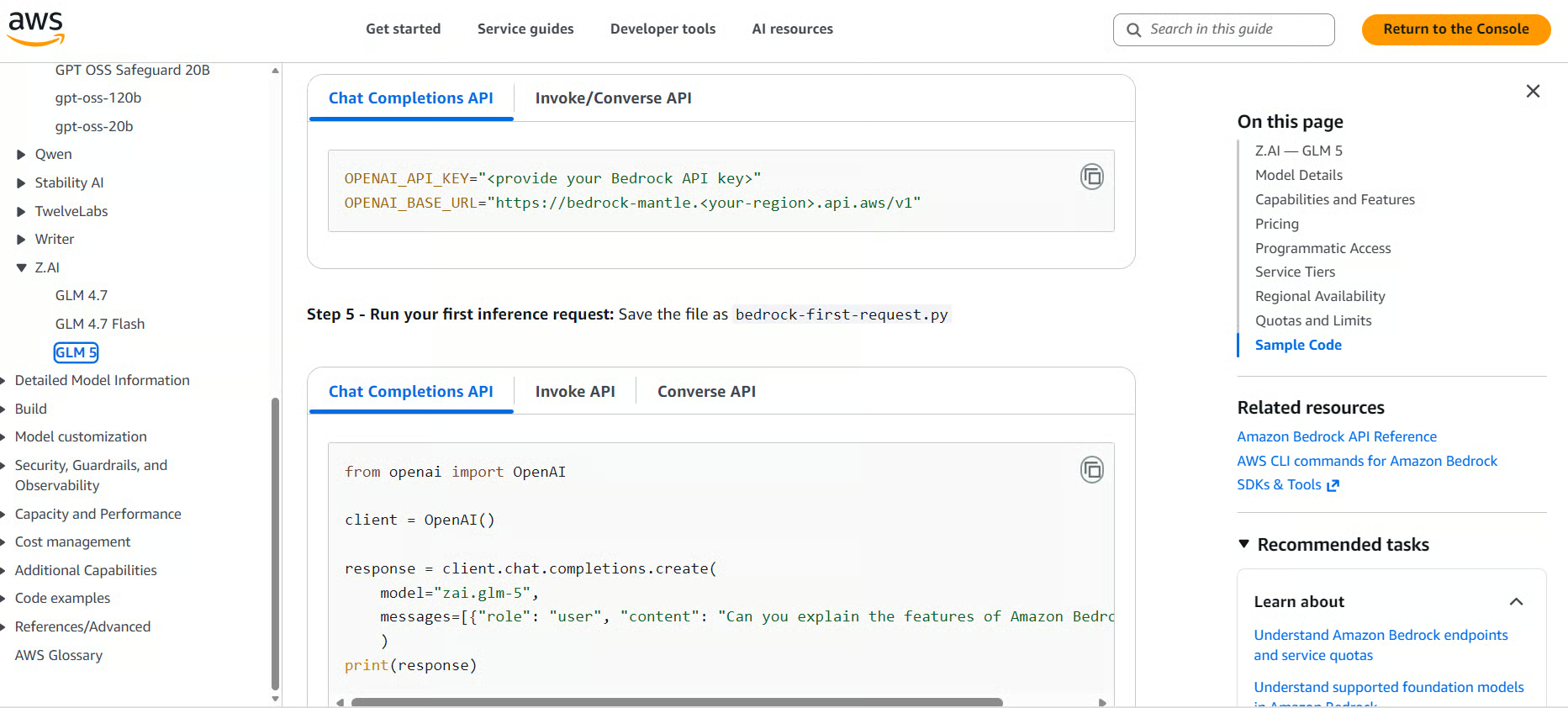

10. Amazon Bedrock

Amazon Bedrock is het beheerde generatieve AI-platform van AWS. Het geeft ontwikkelaars toegang tot foundation-modellen van Amazon en derden via één beheerde AWS-service.

Bedrock ondersteunt modellen van providers zoals Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek en anderen, wat het nuttig maakt voor teams die modelkeuze binnen het AWS-ecosysteem willen.

Amazon Bedrock is een sterke keuze voor bedrijven die al op AWS bouwen, omdat het modeltoegang, cloudinfrastructuur, beveiligingscontroles en enterprise-integratie in één platform samenbrengt.

Bron: Amazon Bedrock

Een belangrijk nadeel is dat Bedrock complexer kan zijn dan een eenvoudige LLM-API. Teams hebben mogelijk AWS-ervaring nodig om permissies, regio's, modeltoegang, prijzen, netwerk en deploymentinstellingen goed te beheren.

Voor gevoelige workloads is Bedrock nuttig omdat prompts en outputs niet worden gebruikt om basismodellen te trainen of gedeeld worden met modelproviders, en teams AWS-controles zoals encryptie, IAM en PrivateLink kunnen gebruiken.

Het best voor: AWS-gebruikers, enterprise-AI, beheerde foundation-modeltoegang, beveiligingsgerichte deployments en cloud-native generatieve AI-toepassingen.

Vergelijkingstabel LLM API-providers

De onderstaande tabel vergelijkt de beste LLM API-providers op basis van hun belangrijkste voordelen en voornaamste nadelen.

|

Provider |

Belangrijkste voordelen |

Voornaamste nadelen |

|

OpenAI |

Sterke modelkwaliteit, volwassen API's, multimodale tools, gestructureerde outputs, embeddings, spraak, beeldgeneratie en agentische workflows |

Kan op schaal duur worden en biedt minder controle dan open-source of zelfgehoste modellen |

|

Anthropic |

Sterke schrijfkwaliteit, zorgvuldige instructieopvolging, redeneren, coding en ondersteuning voor long context |

Kosten kunnen oplopen bij grote documenten of intensief gebruik, en teams hebben beperkte controle over hosting en modelinterne zaken |

|

Google Gemini |

Sterke multimodale mogelijkheden, realtime-API's, long-contextondersteuning en nauwe integratie met Google's AI-ecosysteem |

Kan gebonden aanvoelen aan Google's ecosysteem, en prijzen, beschikbaarheid en functies kunnen per tool of regio verschillen |

|

Together AI |

Gehoste toegang tot veel open en gespecialiseerde modellen, met serverloze inferentie, dedicated endpoints, fine-tuning, evaluaties en GPU-infrastructuur |

Modelkwaliteit, snelheid en betrouwbaarheid kunnen variëren afhankelijk van het gekozen model |

|

Fireworks AI |

Snelle inferentie, lage latency, serverloze toegang, on-demand deployments en productierijpe API's voor open modellen |

Meer gericht op inferentie en deployment dan een volledig alles-in-één AI-ontwikkelplatform te zijn |

|

Nebius AI |

GPU-ondersteunde infrastructuur, gehoste inferentie, OpenAI-compatibele API en snelheidsniveaus zoals Fast en Base |

Meer infrastructuurgericht, dus teams hebben mogelijk sterkere cloud- en deploymentkennis nodig |

|

OpenRouter |

Toegang tot veel modellen via één OpenAI-compatibele API, met eenvoudiger provideroverdracht en fallback-opties |

Voegt een extra laag toe tussen de app en de provider, wat latency, betrouwbaarheid of debugging kan beïnvloeden |

|

Requesty.ai |

Eén API voor meerdere providers, met routing, fallback, caching, kostentracking, observeerbaarheid en governancefuncties |

Vereist zorgvuldige setup van routing, logging, fallback en kostencontroles om onverwacht gedrag te voorkomen |

|

Google Vertex AI |

Beheerde toegang tot Gemini, Anthropic Claude, xAI Grok, Mistral AI en open modellen via Model Garden, plus Google Cloud-beveiliging en governance-tools |

Complexer dan een eenvoudige API en kan Google Cloud-ervaring vereisen |

|

Amazon Bedrock |

Beheerde toegang tot modellen van Amazon en derden zoals Anthropic, Meta, Mistral AI, Cohere en anderen binnen AWS |

Complexer dan een basale LLM-API, vooral rond permissies, regio's, prijzen en modeltoegang |

De beste LLM API-provider kiezen voor jouw use-case

De juiste LLM API-provider kiezen hangt af van drie factoren:

- Wat je bouwt

- Hoeveel controle je nodig hebt

- Hoeveel je bereid bent te besteden

Voor startups en kleine teams zijn open-source LLM API-providers vaak het beste startpunt. Platforms zoals Together AI, Fireworks AI en Nebius AI geven je toegang tot krachtige open modellen zonder zelf GPU's of infrastructuur te beheren. Ze kunnen sneller, goedkoper en flexibeler zijn voor experimenten en vroege productontwikkeling.

Als je snel verschillende modellen wilt testen, zijn LLM-routingproviders een sterke optie. Tools zoals OpenRouter en Requesty.ai laten je gesloten en open modellen via één API vergelijken, fallbacks beheren en van provider wisselen zonder je applicatie te herschrijven.

Voor workflows waar modelkwaliteit belangrijker is dan kosten, blijven native providers zoals OpenAI en Anthropic tot de sterkste keuzes behoren. Ze zijn vooral nuttig voor productie-AI-assistants, codingtools, workflows met veel redeneren, multimodale apps en agentische systemen waar betrouwbaarheid en modelprestaties het meest tellen.

Als je bedrijf al op AWS of Google Cloud draait, is het vaak logisch om binnen dat cloudecosysteem te blijven. Amazon Bedrock en Google Vertex AI geven je beheerde modeltoegang, beveiligingscontroles, governance en integratie met de tools die je team al gebruikt.

Tot slot

Voor technisch werk, coding-assistants en vibe coding-tools zou ik in het begin niet te veel experimenteren. Naar mijn ervaring zijn OpenAI en Anthropic meestal de veiligste keuzes vanwege hun sterke coding, redeneren en ontwikkelaarstooling.

Open-source LLM API-providers en LLM-routingproviders zijn sterke alternatieven voor meer geavanceerde experimenten.

Grote Cloud LLM-providers hebben meestal alleen zin in een bedrijfsomgeving. Kies in dat geval degene waarvan je het ecosysteem al gebruikt.

LLM API-provider FAQ's

Wat is een LLM API-provider?

Een bedrijf of platform dat large language models host en deze via een API beschikbaar maakt, zodat ontwikkelaars verzoeken kunnen sturen en AI-gegenereerde antwoorden kunnen ontvangen zonder zelf GPU- of inferentie-infrastructuur te beheren.

Wat is het verschil tussen een native LLM-provider en een cloud LLM-provider?

Native providers (zoals OpenAI en Anthropic) bouwen en leveren hun eigen modellen rechtstreeks. Cloudproviders (zoals AWS Bedrock en Google Vertex AI) bieden beheerde toegang tot meerdere modellen van derden, geïntegreerd in een bestaand cloudecosysteem met enterprise-beveiliging en governance-tools.

Wanneer moet ik een LLM-routingprovider zoals OpenRouter of Requesty.ai gebruiken?

Wanneer je met meer dan één model of provider moet werken, automatische fallback wilt als een provider uitvalt, of modellen wilt vergelijken en kosten wilt beheersen, allemaal via één enkele API-integratie.

Zijn open-source LLM API-providers minder capabel dan native providers zoals OpenAI?

Niet per se; het hangt af van de taak. Platforms zoals Together AI en Fireworks AI hosten state-of-the-art open modellen zoals Llama, DeepSeek en Mistral, die kunnen concurreren met gesloten modellen, vaak tegen aanzienlijk lagere kosten.

Welke LLM API-provider is het beste voor enterprises met strikte compliance-eisen?

Amazon Bedrock en Google Vertex AI zijn doorgaans de sterkste keuzes, omdat ze cloud-native beveiligingscontroles, IAM, encryptie, auditlogging en governancefuncties bieden die integreren met bestaande enterprise-infrastructuur.

Als gecertificeerd data scientist haal ik met passie het maximale uit de nieuwste technologie om innovatieve machinelearning-toepassingen te bouwen. Met een sterke achtergrond in spraakherkenning, data-analyse en -rapportage, MLOps, conversationele AI en NLP heb ik mijn vaardigheden aangescherpt in het ontwikkelen van intelligente systemen die echt impact maken. Naast mijn technische expertise ben ik ook een sterke communicator met een talent om complexe concepten terug te brengen tot heldere, beknopte taal. Daardoor ben ik uitgegroeid tot een veelgelezen blogger over data science, waar ik mijn inzichten en ervaringen deel met een groeiende community van data-professionals. Op dit moment richt ik me op contentcreatie en redactie, waarbij ik met large language models werk aan krachtige en aansprekende content die zowel bedrijven als individuen helpt het beste uit hun data te halen.