Track

Поставщики API больших языковых моделей (LLM) дают разработчикам доступ к мощным ИИ-моделям без необходимости управлять GPU, развёртыванием моделей, масштабированием или инфраструктурой инференса. Вместо самостоятельного хостинга модели разработчики могут подключиться к API, выбрать модель, отправить запрос и получить ответ.

В этой статье мы рассмотрим топ-10 поставщиков LLM API по качеству моделей, опыту разработчика, цене, масштабируемости, поддержке экосистемы и готовности к продакшену. Для каждого провайдера мы опишем, для чего он лучше всего подходит, его ключевые преимущества и основные недостатки, которые стоит учитывать разработчикам.

Это руководство делит ведущих поставщиков LLM API на четыре категории:

- Нативные поставщики LLM

- Поставщики LLM API с открытым исходным кодом

- Поставщики маршрутизации LLM

- Облачные поставщики LLM

Нативные поставщики LLM

Нативные поставщики LLM создают, обучают и обслуживают собственные семейства моделей через API. Часто это лучший вариант для разработчиков, которым нужны высокое качество моделей, надёжная документация, развитые возможности рассуждения, мультимодальность и готовые к продакшену инструменты.

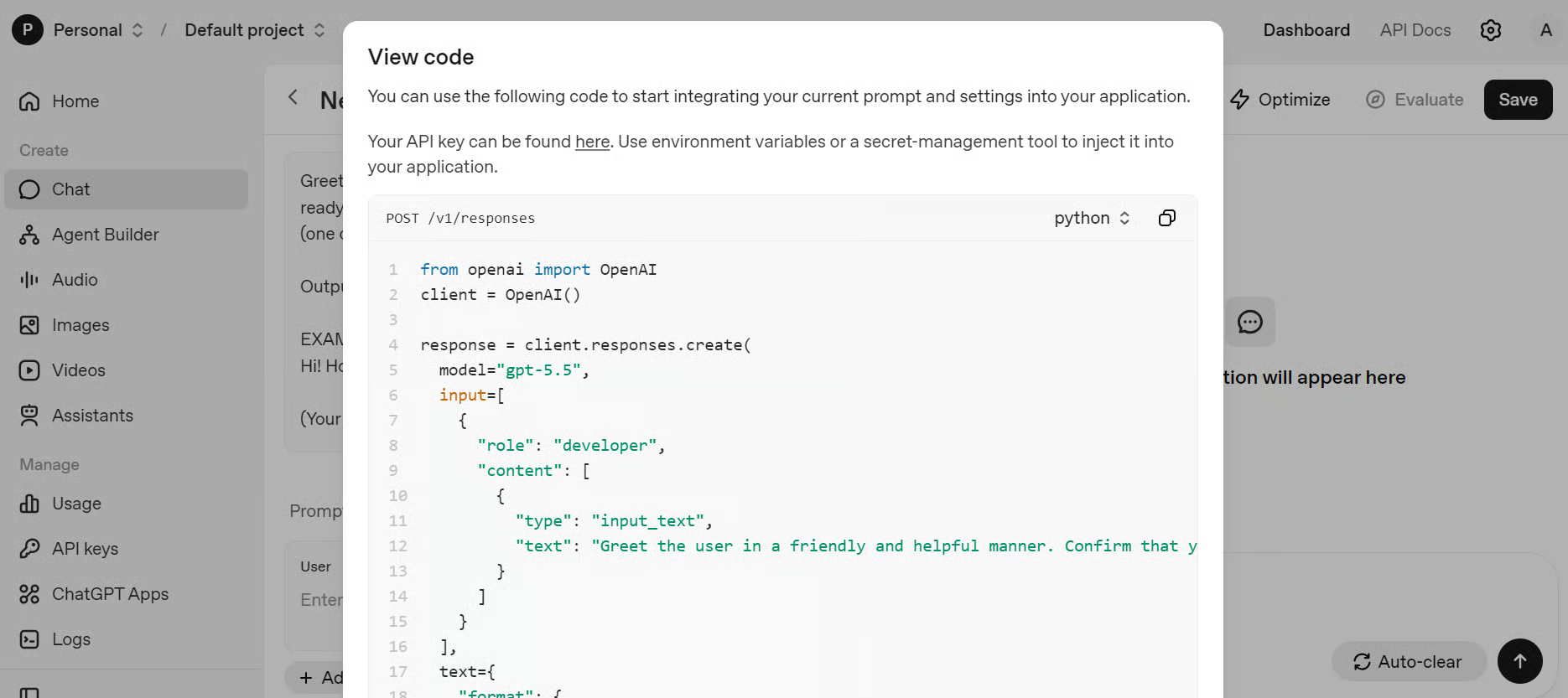

1. OpenAI

OpenAI — один из наиболее широко используемых поставщиков LLM API. Его API Platform предоставляет доступ к:

- Фронтирным моделям рассуждения, таким как GPT-5.5

- Генерации и переводу речи в реальном времени через GPT-Realtime-2

- Генерации изображений с помощью модели GPT-Images-2.0

- Агентной разработке через OpenAI Agents SDK

Его API поддерживает стриминг, интерфейсы реального времени и структурированные ответы.

OpenAI — сильный выбор для команд, создающих ИИ-ассистентов, инструменты для кодинга, агентov поддержки клиентов, внутренних копилотов, мультимодальные приложения и агентные системы.

Источник: OpenAI

Недостаток в том, что при масштабировании OpenAI может стать дорогим, особенно для приложений с большим объёмом или интенсивными рассуждениями. Это также закрытый провайдер API, что даёт разработчикам меньше контроля над внутренним устройством модели, хостингом и кастомизацией по сравнению с открытыми или самохостируемыми моделями.

Лучше всего для: универсальных ИИ-приложений, рассуждений, кодинга, мультимодальных процессов и готовых к продакшену ИИ-продуктов.

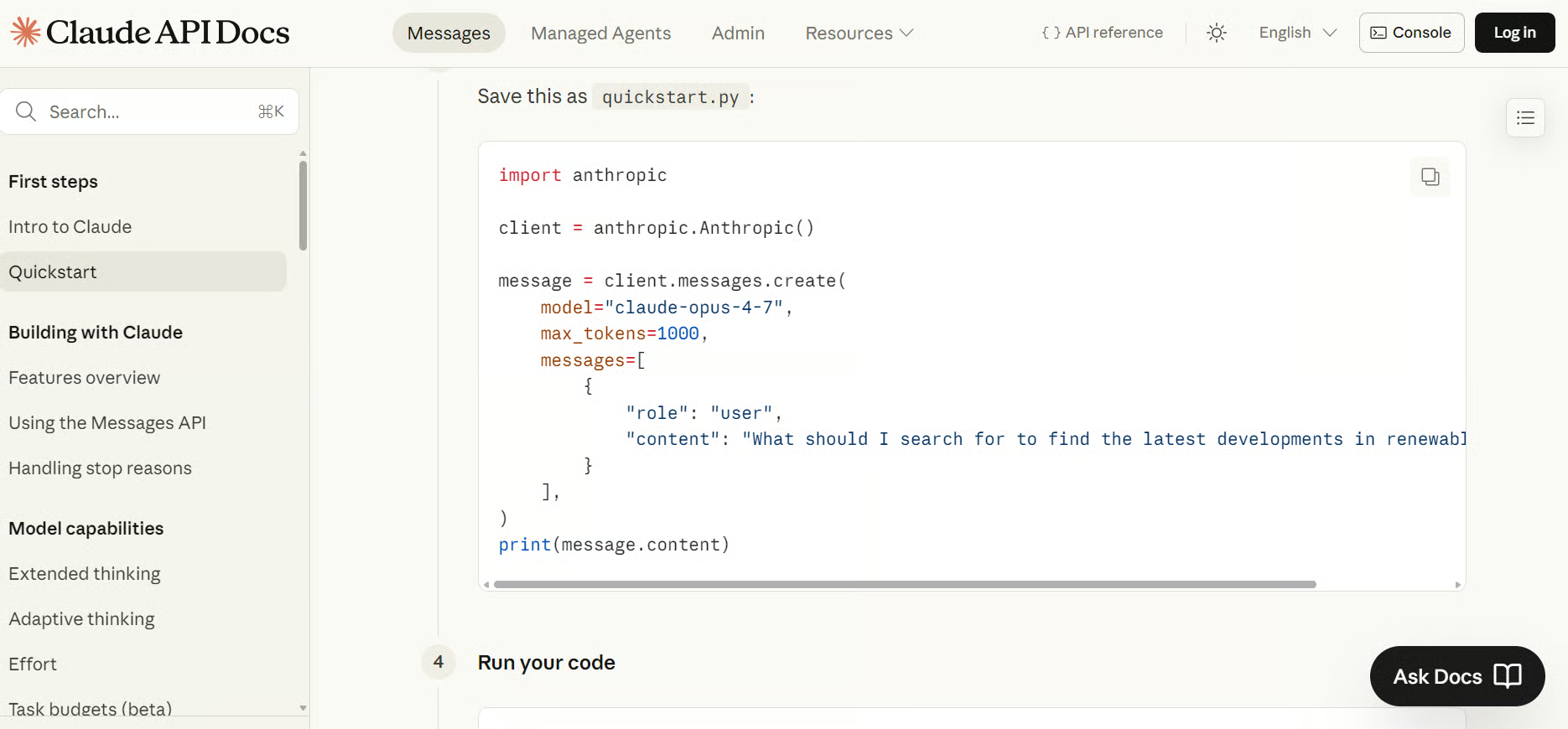

2. Anthropic

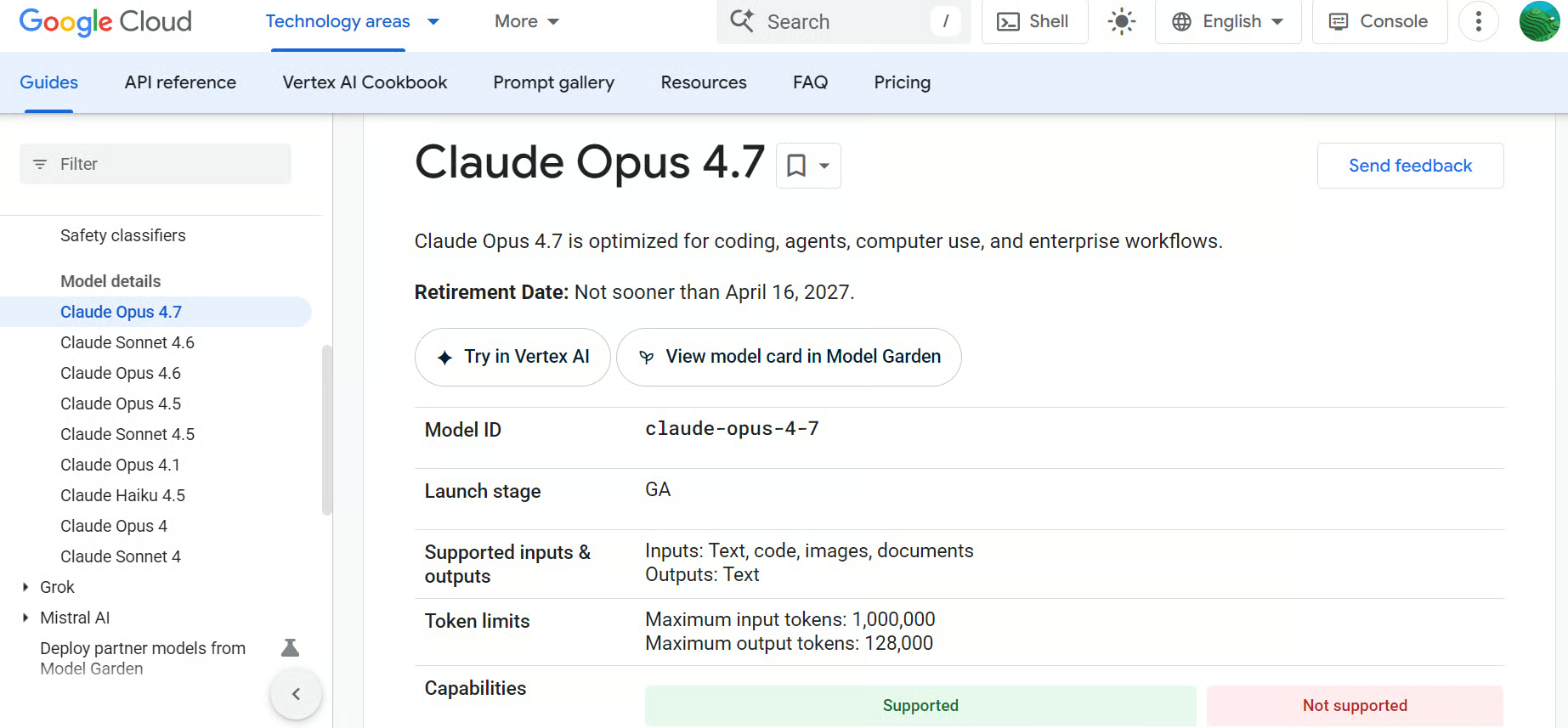

Anthropic предоставляет семейство моделей Claude через свой API, например свой последний флагман Claude Opus 4.7. Claude разработан для задач языка, рассуждений, анализа, кодинга, работы с длинным контекстом и агентных процессов. Платформа для разработчиков Anthropic даёт командам прямой доступ к моделям через API, SDK и документацию.

Claude особенно полезен для приложений, которым требуется аккуратное следование инструкциям, высокое качество текста, анализ документов и надёжная обработка сложных запросов.

Источник: Начало работы с Claude

Ключевой недостаток — стоимость, особенно при использовании Claude для больших документов, длинных контекстов или высоких объёмов. Поскольку доступ к Claude осуществляется через хостируемый API, у команд ограниченный контроль над тем, где и как запускается модель.

Для кейсов, требующих приватности, разработчикам следует внимательно изучить требования к обработке данных, их хранению и соответствию нормам, прежде чем отправлять конфиденциальные бизнес- или клиентские данные через API.

Лучше всего для: ассистентов для кодинга, корпоративного ИИ, анализа с длинным контекстом, документоориентированных процессов и ИИ-агентов.

Для подробного сравнения двух гигантов ИИ ознакомьтесь с нашим гайдом Anthropic vs OpenAI.

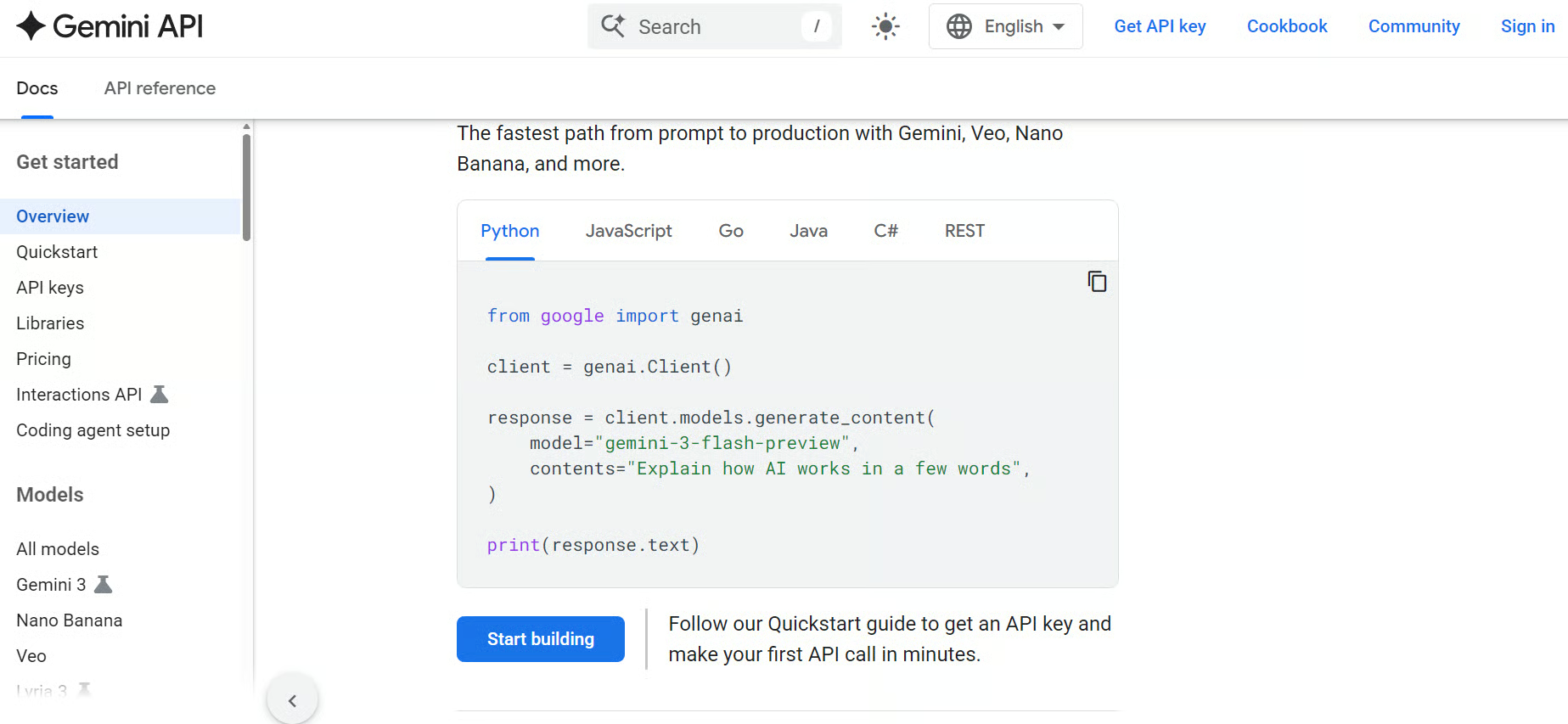

3. Google Gemini

Google Gemini — нативное семейство LLM от Google, включая Gemini 3.1 Pro, доступное через Gemini API для разработчиков. Gemini API поддерживает стандартные, стриминговые и реалтайм-API, с документацией по моделям, SDK, ценам, настройке и API-референсам.

С Nano Banana 2 для генерации изображений и интегрированным Veo 3.1 Gemini — сильный вариант для разработчиков мультимодальных приложений. Это также хороший выбор для ИИ-ассистентов (особенно опирающихся на поиск), инструментов для кодинга и продуктов, связанных с широкой ИИ-экосистемой Google.

Источник: Gemini API

Однако Gemini может быть более привязан к экосистеме Google, что не всегда подходит командам, стремящимся к провайдер-нейтральной архитектуре. Цены, доступность и поддержка функций также могут различаться по инструментам и регионам.

Для приватных приложений командам следует изучить требования к обработке данных, их хранению и соответствию нормам, прежде чем отправлять конфиденциальные данные бизнеса или клиентов через API.

Лучше всего для: мультимодальных ИИ-приложений, интеграции с экосистемой Google, процессов с длинным контекстом, кодинга и универсальных ИИ-задач.

Поставщики LLM API с открытым исходным кодом

Поставщики LLM API с открытым исходным кодом предоставляют разработчикам хостируемый доступ к open-source и open-weight моделям. Вместо загрузки моделей и их запуска на собственных GPU эти платформы хостят модели и предоставляют к ним доступ через простые API.

Эти провайдеры полезны командам, которым нужны более низкие затраты, большая гибкость моделей, быстрое экспериментирование и доступ к популярным открытым моделям, таким как Llama, DeepSeek, Qwen, Mistral, Gemma и др.

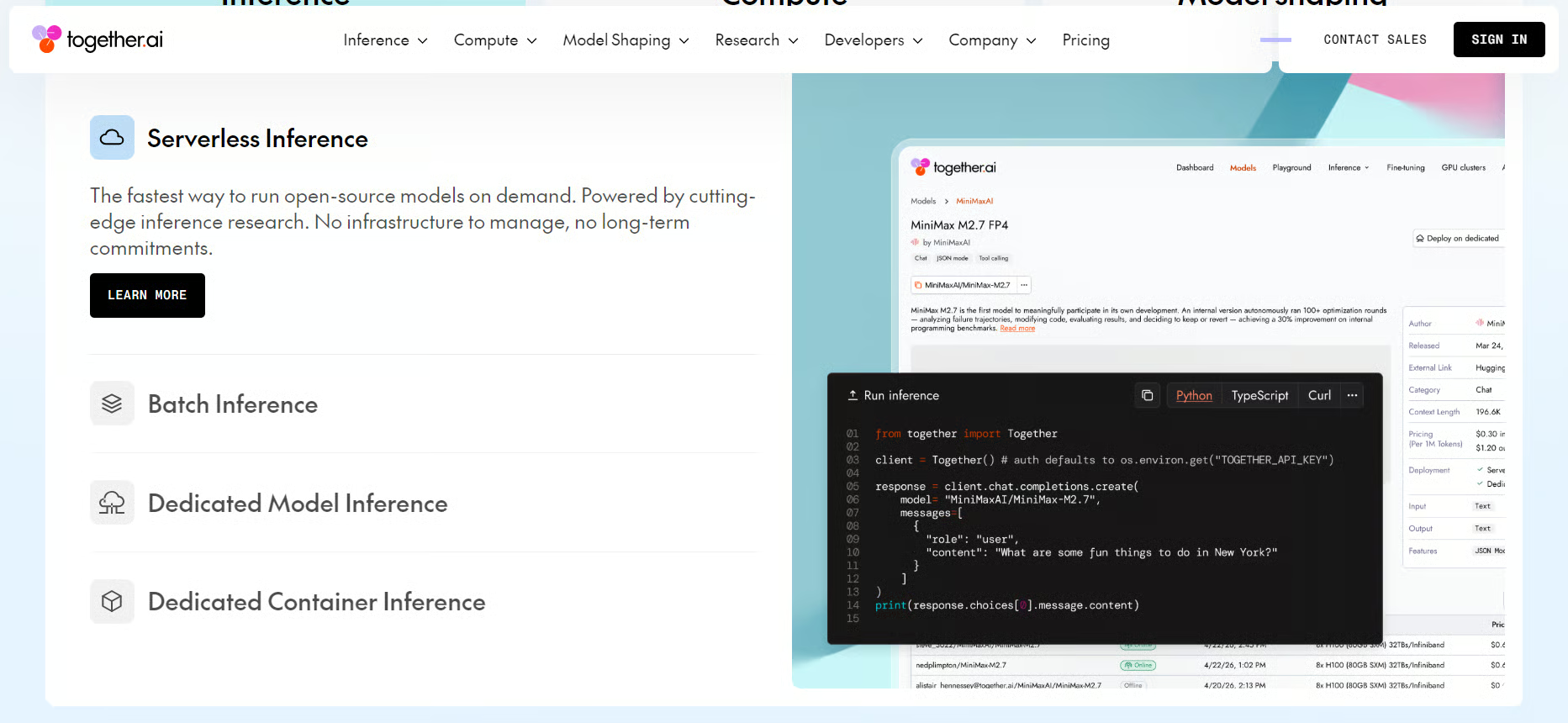

4. Together AI

Together AI предоставляет хостируемый доступ к открытым и специализированным моделям через унифицированный API. Его каталог включает 200+ моделей для текста, изображений, видео, кода и аудио с поддержкой бессерверного инференса, пакетного инференса, выделенных эндпоинтов, дообучения, оценок и GPU-кластеров.

Together AI — сильный вариант для разработчиков, желающих работать с открытыми моделями без управления собственной инфраструктурой. Особенно полезен командам, тестирующим несколько моделей, дообучающим кастомные модели или масштабирующим нагрузки инференса.

Источник: Together AI

При этом качество, скорость и надёжность могут варьироваться в зависимости от выбранной модели. Командам может потребоваться больше тестирования, бенчмаркинга и оценивания перед использованием в продакшене.

Для чувствительных нагрузок командам следует понять, достаточно ли бессерверного доступа или нужны выделенные эндпоинты либо приватные развёртывания для соответствия требованиям безопасности и комплаенса.

Лучше всего для: инференса открытых моделей, дообучения, масштабируемых ИИ-нагрузок и экспериментов на множестве моделей.

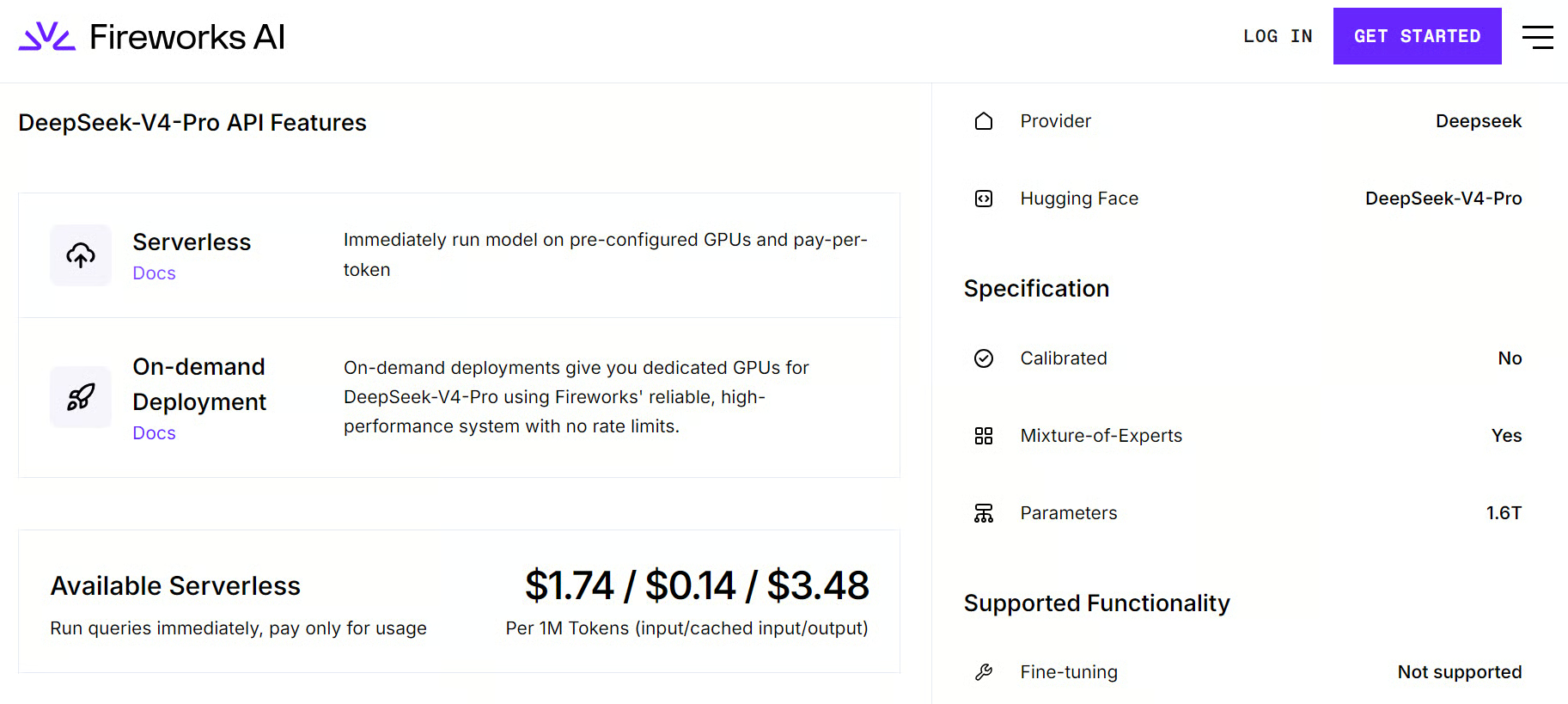

5. Fireworks AI

Fireworks AI фокусируется на быстром инференсе для open-source LLM и генеративных моделей ИИ. Платформа поддерживает бессерверный инференс, развёртывания по требованию, дообучение и продакшен-API для популярных открытых моделей.

Fireworks AI — сильный вариант для команд, которым нужна гибкость открытых моделей при более быстром инференсе и низкой латентности. Особенно полезен для разговорного ИИ, ассистентов для кодинга, поиска, мультимодальных приложений и корпоративных RAG-систем.

Источник: Fireworks AI

Ключевой недостаток — Fireworks AI больше ориентирован на инференс и развёртывание, чем на роль широкой, «всё-в-одном» платформы ИИ. Командам всё равно могут потребоваться отдельные инструменты для оркестрации, оценок, мониторинга или сложных агентных процессов.

Командам также стоит оценить, достаточно ли бессерверного инференса для чувствительных нагрузок или же нужны выделенные развёртывания для более жёсткого контроля производительности и комплаенса.

Лучше всего для: быстрого инференса открытых моделей, дообучения, продакшен-ИИ-приложений и низколатентных развёртываний открытых моделей.

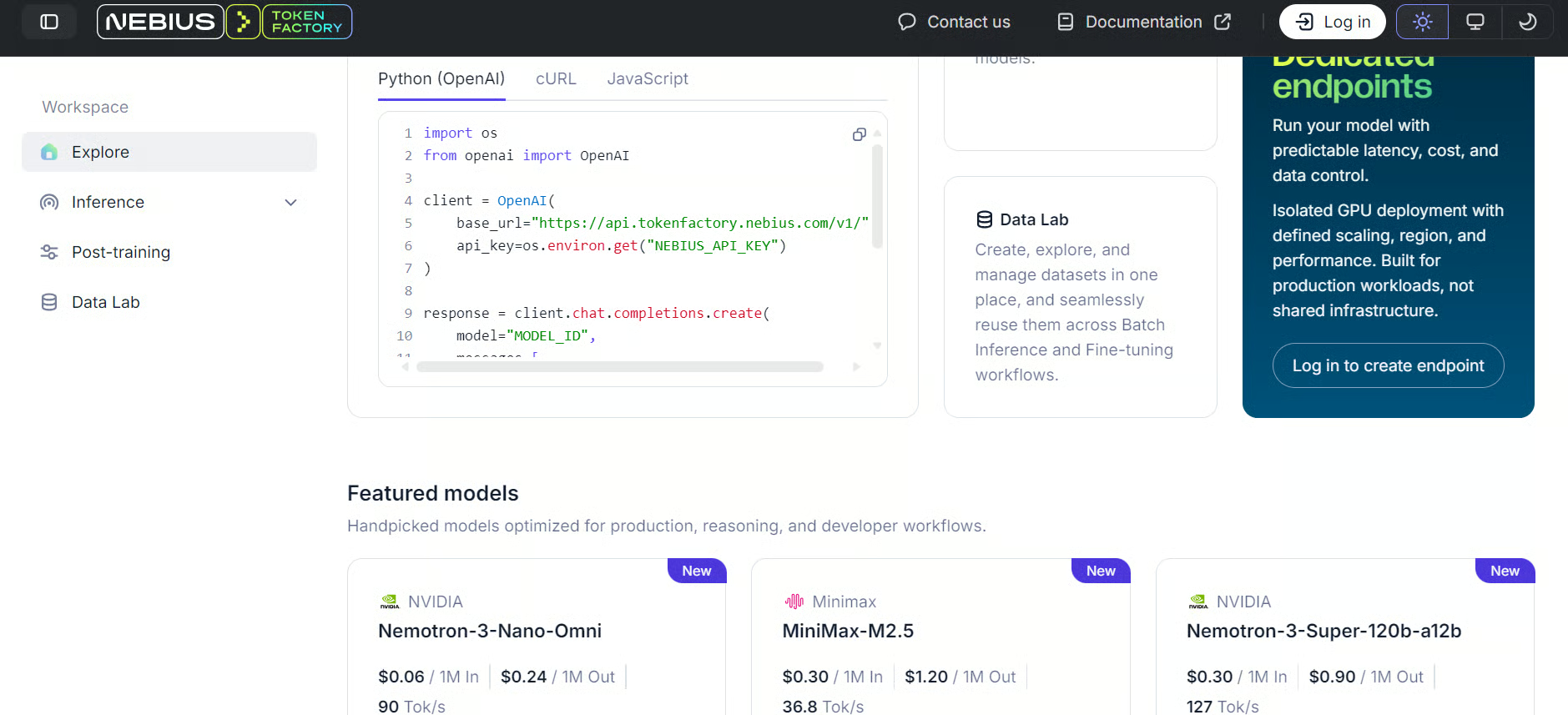

6. Nebius AI

Nebius AI — облачный провайдер ИИ, созданный для ИИ-нагрузок на GPU, хостируемого инференса, сервинга моделей и масштабируемой ИИ-инфраструктуры. Его сервис инференса Token Factory поддерживает открытые модели через совместимый с OpenAI API с опциями для бессерверного инференса, дообучения и выделенной ИИ-облачной инфраструктуры.

Nebius AI — сильный вариант для команд, которым нужен больший контроль над инфраструктурой, чем у базовых API-провайдеров, при этом без сложности полного управления собственными GPU-средами. Особенно полезен командам, работающим с открытыми и кастомными моделями, которым нужны масштабируемые ресурсы, быстрый инференс и готовые к продакшену опции развёртывания.

Источник: Nebius Token Factory

Nebius Token Factory предлагает два режима скорости инференса: Fast и Base. Fast рассчитан на низколатентные, интерактивные нагрузки, а Base — на более экономичный по стоимости, высокообъёмный инференс или фоновую обработку.

Nebius в большей степени ориентирован на инфраструктуру, чем простые LLM API «подключи и работай». Это значит, что командам может понадобиться больше экспертизы в облаках, развёртывании и управлении нагрузками, чтобы получить максимальную отдачу.

Для чувствительных нагрузок командам стоит оценить, достаточно ли управляемого инференса или необходима выделенная инфраструктура для более строгого контроля безопасности, соответствия требованиям и управления данными.

Лучше всего для: облачной ИИ-инфраструктуры, хостируемого инференса, задач на GPU, быстрого инференса и команд, которым нужен больший контроль над развёртыванием.

Поставщики маршрутизации LLM

Поставщики маршрутизации LLM дают разработчикам доступ к нескольким моделям и провайдерам через один API. Вместо отдельной интеграции с OpenAI, Anthropic, Google, Mistral, DeepSeek и другими провайдерами разработчики могут использовать один слой маршрутизации, чтобы централизованно управлять доступом к моделям.

Эти платформы полезны для сравнения моделей, резервной маршрутизации, оптимизации затрат, отказоустойчивости по провайдерам, наблюдаемости и переключения между моделями без переписывания приложения.

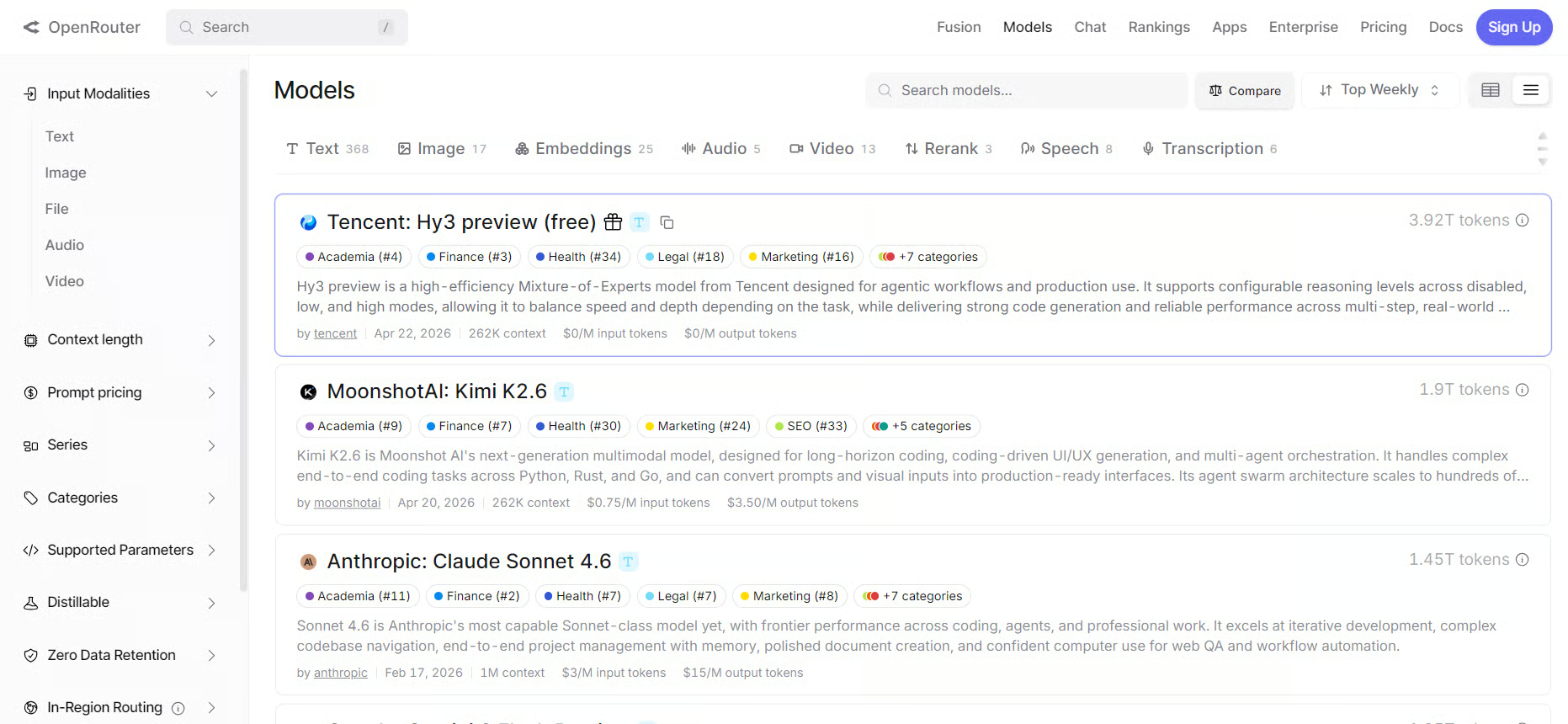

7. OpenRouter

OpenRouter — один из самых популярных провайдеров маршрутизации LLM. Он предоставляет разработчикам доступ ко множеству моделей через единый API, совместимый с OpenAI, что упрощает работу с разными провайдерами в рамках одной интеграции.

Как мы показывали в нескольких туториалах, OpenRouter — сильный вариант для разработчиков, желающих сравнивать модели, быстро тестировать новые релизы, маршрутизировать запросы между провайдерами или избегать зависимости от одного вендора.

Источник: OpenRouter

Недостаток в том, что OpenRouter добавляет ещё один слой между приложением и провайдером модели. Это может ввести дополнительную зависимость, переменную латентность и поведение, зависящее от провайдера, которое всё равно нужно тестировать.

Для продакшен-нагрузок командам следует проверить настройки маршрутизации, поведение при отказах, приоритеты провайдеров и параметры приватности перед отправкой конфиденциального или критичного трафика через платформу.

Лучше всего для: мультимодельных приложений, сравнения моделей, резервной маршрутизации, гибкости по провайдерам и быстрого эксперимента.

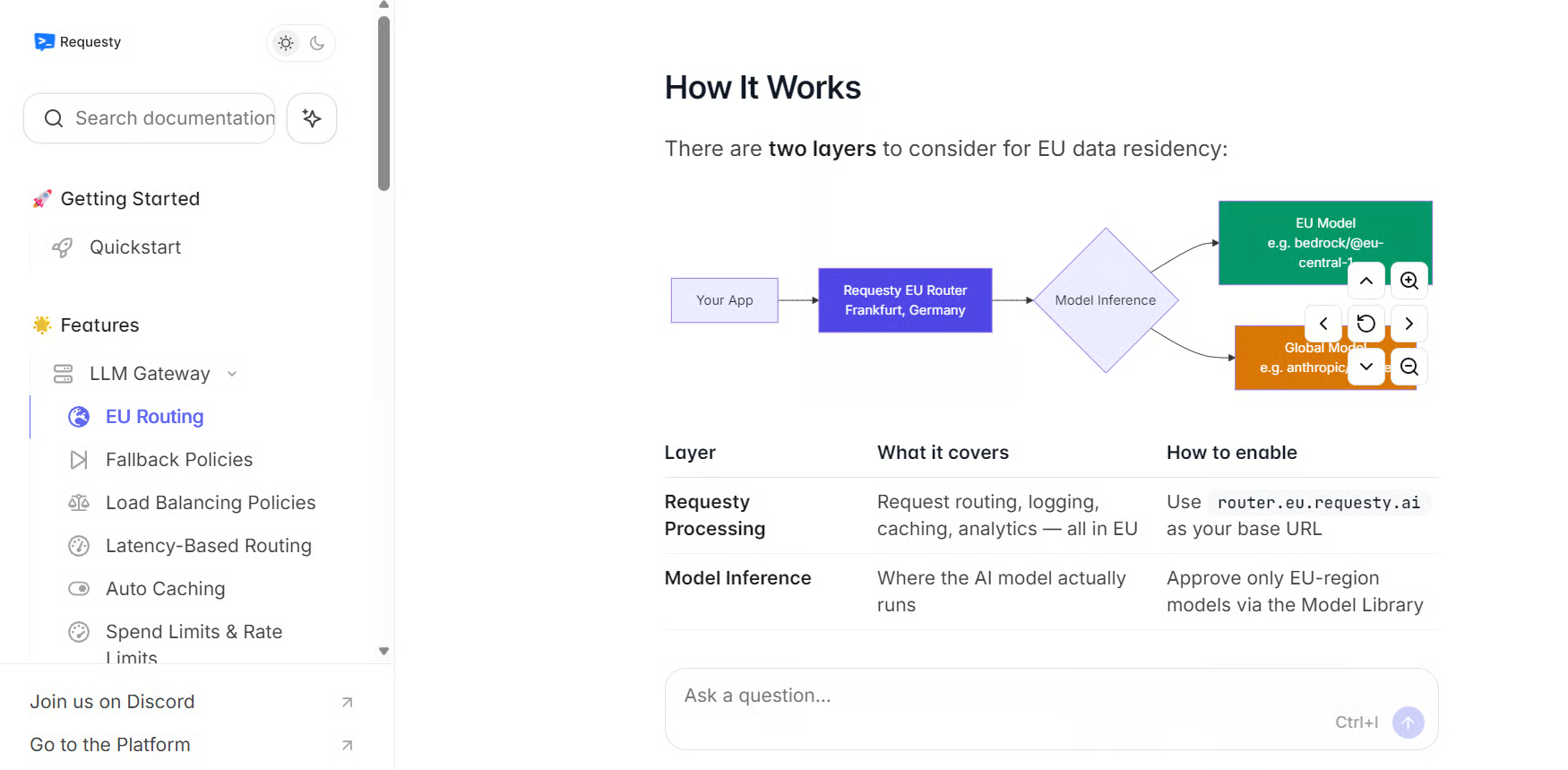

8. Requesty.ai

Requesty.ai — платформа маршрутизации и шлюза для LLM, которая помогает командам подключаться к нескольким LLM-провайдерам через один API, совместимый с OpenAI. Поддерживает 400+ моделей и функции маршрутизации, резервирования, кэширования, управления затратами, наблюдаемости и управления доступом.

Requesty.ai — сильный вариант для команд, строящих продакшен-ИИ-приложения, зависящие от более чем одного провайдера. Особенно полезен для управления политиками маршрутизации, отслеживания использования, контроля расходов и повышения надёжности, когда провайдеры дают сбой, истекает таймаут или достигнуты лимиты.

Источник: Документация Requesty AI

Как и в случае с OpenRouter, ключевой недостаток в том, что Requesty.ai добавляет ещё один шлюзовой слой в стек приложения. Командам необходимо внимательно настраивать маршрутизацию, резервирование, логирование и управление, чтобы избежать неожиданных затрат, латентности или поведения провайдера.

Для чувствительных нагрузок Requesty.ai предлагает такие средства, как обнаружение и очистка ПДн, контент-гардрейлы, журналы аудита и функции управления, но командам всё равно следует определить, какие данные могут проходить через шлюз и как вести логи.

Лучше всего для: маршрутизации LLM, контроля затрат, наблюдаемости, резервирования провайдеров, управления и рабочих процессов продакшен-шлюза ИИ.

Облачные поставщики LLM

Облачные поставщики LLM — это крупные облачные платформы, которые предоставляют разработчикам и предприятиям управляемый доступ к базовым моделям. Эти платформы часто поддерживают как собственные модели, так и модели сторонних провайдеров.

Они особенно полезны для предприятий, уже использующих облачную инфраструктуру, и нуждающихся в безопасности, управлении, комплаенсе, интеграции данных, контроле развёртывания и управлении моделями в одном месте.

9. Google Vertex AI

Google Vertex AI — платформа машинного обучения и генеративного ИИ в Google Cloud. Она предоставляет разработчикам и предприятиям доступ к моделям Gemini, Model Garden, инструментам для агентов и управляемой инфраструктуре для создания, развёртывания и управления ИИ-приложениями.

Vertex AI также поддерживает ведущих партнёров и открытые модели через Model Garden, включая Anthropic Claude, xAI Grok, модели Mistral AI и open-source модели, такие как GLM 5 и Gemma 4, наряду с собственными моделями Gemini от Google.

Источник: Generative AI on Vertex AI

Google Vertex AI — сильный вариант для команд, уже использующих Google Cloud и желающих облачно-нативного развёртывания моделей, управления, средств безопасности и интеграции с широкой экосистемой данных и ИИ Google.

С другой стороны, Vertex AI может быть сложнее, чем использование простого API модели. Командам может потребоваться опыт работы с Google Cloud для корректного управления проектами, правами, биллингом, настройками развёртывания и интеграциями.

Для чувствительных нагрузок Vertex AI полезен командам, которым нужны облачные средства контроля доступа, управление и управляемая инфраструктура, но решения по логированию, доступу к данным и регионам развёртывания всё равно требуют тщательного анализа.

Лучше всего для: пользователей Google Cloud, доступа к Gemini, корпоративных ИИ-приложений, мультимодальных процессов и облачно-нативного развёртывания моделей.

10. Amazon Bedrock

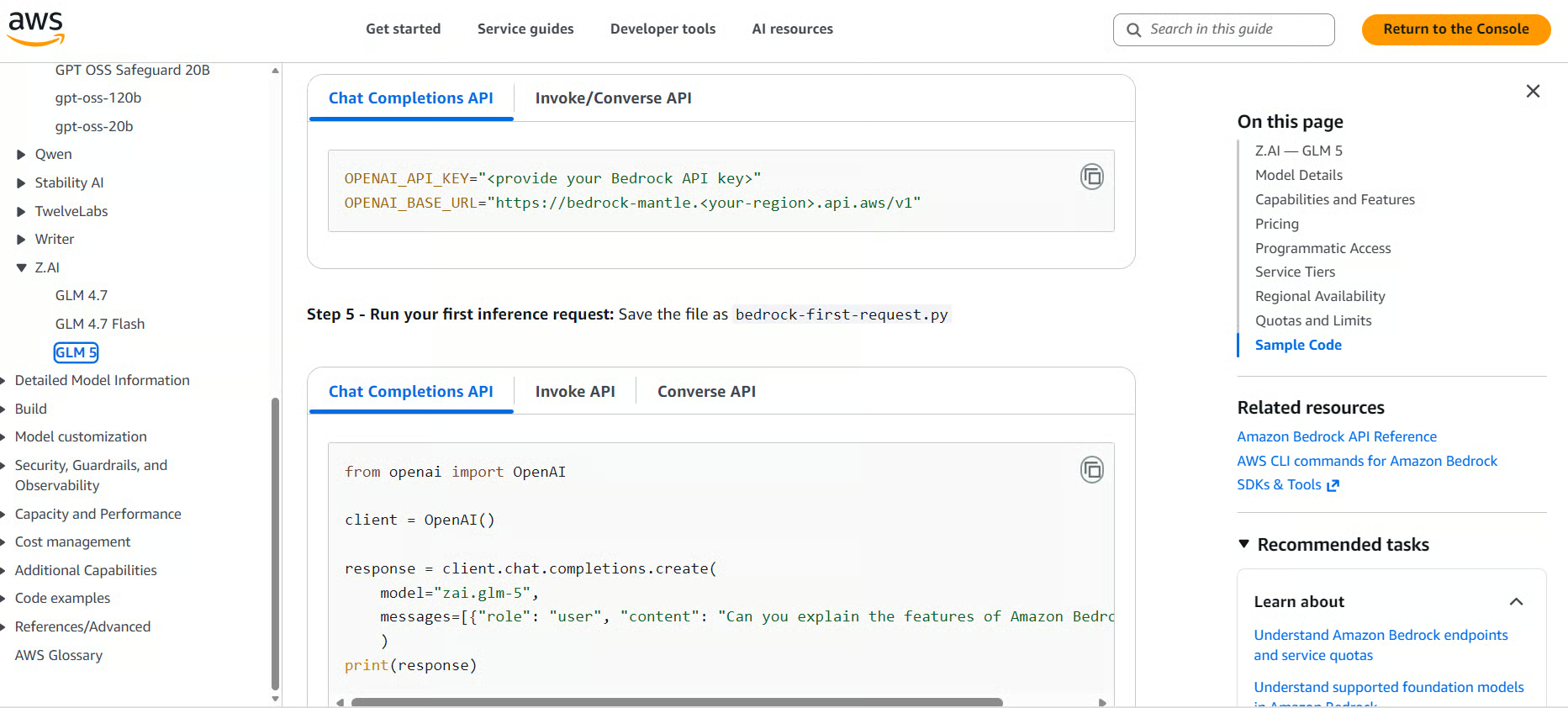

Amazon Bedrock — управляемая платформа генеративного ИИ от AWS. Она предоставляет разработчикам доступ к базовым моделям от Amazon и сторонних провайдеров в рамках одной управляемой службы AWS.

Bedrock поддерживает модели от таких провайдеров, как Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek и другие, что полезно командам, которым важен выбор моделей в экосистеме AWS.

Amazon Bedrock — сильный выбор для компаний, уже работающих на AWS, поскольку объединяет доступ к моделям, облачную инфраструктуру, средства безопасности и интеграцию корпоративного уровня в одной платформе.

Источник: Amazon Bedrock

Ключевой недостаток — Bedrock сложнее, чем простой LLM API. Командам может понадобиться опыт AWS для корректного управления правами, регионами, доступом к моделям, ценообразованием, сетевыми настройками и параметрами развёртывания.

Для чувствительных нагрузок Bedrock полезен тем, что подсказки и ответы не используются для обучения базовых моделей и не передаются провайдерам моделей, а команды могут использовать средства AWS, такие как шифрование, IAM и PrivateLink.

Лучше всего для: пользователей AWS, корпоративного ИИ, управляемого доступа к базовым моделям, безопасных развёртываний и облачно-нативных генеративных ИИ-приложений.

Сравнительная таблица поставщиков LLM API

В таблице ниже сравниваются ведущие поставщики LLM API на основе их ключевых преимуществ и основных недостатков.

|

Провайдер |

Ключевые преимущества |

Основные недостатки |

|

OpenAI |

Высокое качество моделей, зрелые API, мультимодальные инструменты, структурированные ответы, эмбеддинги, речь, генерация изображений и агентные сценарии |

Может стать дорогим при масштабировании и даёт меньше контроля, чем открытые или самохостируемые модели |

|

Anthropic |

Высокое качество текстов, аккуратное следование инструкциям, рассуждения, кодинг и поддержка длинного контекста |

Затраты растут при больших документах или высоком объёме, а у команд ограничен контроль над хостингом и внутренним устройством моделей |

|

Google Gemini |

Сильные мультимодальные возможности, реалтайм-API, поддержка длинного контекста и тесная интеграция с ИИ-экосистемой Google |

Может казаться привязанным к экосистеме Google; цены, доступность и функции могут различаться по инструментам или регионам |

|

Together AI |

Хостируемый доступ ко множеству открытых и специализированных моделей, бессерверный инференс, выделенные эндпоинты, дообучение, оценки и GPU-инфраструктура |

Качество, скорость и надёжность зависят от выбранной модели |

|

Fireworks AI |

Быстрый инференс, низкая латентность, бессерверный доступ, развёртывания по требованию и продакшен-API для открытых моделей |

Больше фокус на инференсе и развёртывании, чем на всеобъемлющей платформе разработки ИИ |

|

Nebius AI |

Инфраструктура на GPU, хостируемый инференс, API, совместимый с OpenAI, и уровни скорости, такие как Fast и Base |

Более инфраструктурный фокус, поэтому командам может потребоваться более глубокое знание облаков и развёртывания |

|

OpenRouter |

Доступ ко множеству моделей через один API, совместимый с OpenAI, с упрощённым переключением провайдеров и резервированием |

Добавляет ещё один слой между приложением и провайдером, что может влиять на латентность, надёжность или отладку |

|

Requesty.ai |

Один API для нескольких провайдеров с маршрутизацией, резервированием, кэшированием, учётом затрат, наблюдаемостью и управлением |

Требуется внимательная настройка маршрутизации, логирования, резервирования и контроля затрат, чтобы избежать неожиданного поведения |

|

Google Vertex AI |

Управляемый доступ к Gemini, Anthropic Claude, xAI Grok, Mistral AI и открытым моделям через Model Garden плюс средства безопасности и управления Google Cloud |

Сложнее, чем простой API, и может требовать опыта Google Cloud |

|

Amazon Bedrock |

Управляемый доступ к моделям от Amazon и сторонних провайдеров, таких как Anthropic, Meta, Mistral AI, Cohere и др., внутри AWS |

Сложнее, чем базовый LLM API, особенно в части прав доступа, регионов, ценообразования и доступа к моделям |

Как выбрать лучшего поставщика LLM API под вашу задачу

Выбор подходящего поставщика LLM API зависит от трёх факторов:

- Что вы строите

- Насколько вам нужен контроль

- Сколько вы готовы тратить

Для стартапов и небольших команд провайдеры LLM API с открытым исходным кодом часто — лучшее место для старта. Платформы вроде Together AI, Fireworks AI и Nebius AI дают доступ к мощным открытым моделям без управления GPU или инфраструктурой. Они могут быть быстрее, дешевле и гибче для экспериментов и ранней стадии разработки продукта.

Если вы хотите быстро тестировать разные модели, провайдеры маршрутизации LLM — сильный вариант. Инструменты вроде OpenRouter и Requesty.ai позволяют сравнивать закрытые и открытые модели через один API, настраивать резервирование и менять провайдеров без переписывания приложения.

Для рабочих процессов, где качество модели важнее стоимости, нативные провайдеры, такие как OpenAI и Anthropic, по-прежнему одни из самых сильных. Они особенно полезны для продакшен-ИИ-ассистентов, инструментов кодинга, процессов с упором на рассуждение, мультимодальных приложений и агентных систем, где критичны надёжность и производительность модели.

Наконец, если ваша компания уже работает на AWS или Google Cloud, часто логично оставаться в этой экосистеме. Amazon Bedrock и Google Vertex AI предоставляют управляемый доступ к моделям, средства безопасности, управление и интеграцию с инструментами, которые ваша команда уже использует.

Итоги

Для технических задач, ассистентов для кодинга и «vibe coding» инструментов я бы не стал слишком экспериментировать на старте. По моему опыту, OpenAI и Anthropic обычно самые безопасные варианты благодаря сильным возможностям кодинга, рассуждений и инструментарию для разработчиков.

Провайдеры LLM API с открытым исходным кодом и провайдеры маршрутизации LLM — сильные альтернативы для более продвинутых экспериментов.

Крупные облачные поставщики LLM обычно имеют смысл в корпоративной среде. В этом случае выбирайте тот, чьей экосистемой вы уже пользуетесь.

Частые вопросы о поставщиках LLM API

Что такое поставщик LLM API?

Компания или платформа, которая хостит большие языковые модели и предоставляет к ним доступ через API, чтобы разработчики могли отправлять запросы и получать ответы, сгенерированные ИИ, без самостоятельного управления GPU или инфраструктурой инференса.

В чём разница между нативным поставщиком LLM и облачным поставщиком LLM?

Нативные провайдеры (например, OpenAI и Anthropic) создают и обслуживают собственные модели напрямую. Облачные провайдеры (например, AWS Bedrock и Google Vertex AI) предлагают управляемый доступ к нескольким сторонним моделям в составе существующей облачной экосистемы с корпоративными средствами безопасности и управления.

Когда стоит использовать провайдера маршрутизации LLM, такого как OpenRouter или Requesty.ai?

Когда нужно работать с более чем одной моделью или провайдером, хотите автоматический фолбэк при недоступности провайдера, либо необходимо сравнивать модели и контролировать затраты — всё через одну интеграцию API.

Уступают ли поставщики LLM API с открытым исходным кодом нативным провайдерам вроде OpenAI?

Не обязательно; всё зависит от задачи. Платформы вроде Together AI и Fireworks AI хостят передовые открытые модели, такие как Llama, DeepSeek и Mistral, которые могут конкурировать с закрытыми моделями и часто заметно дешевле.

Какой поставщик LLM API лучше для предприятий с жёсткими требованиями к комплаенсу?

Обычно наилучший выбор — Amazon Bedrock и Google Vertex AI, поскольку они предлагают облачно-нативные средства безопасности, IAM, шифрование, журналы аудита и функции управления, интегрированные с существующей корпоративной инфраструктурой.