Program

Büyük Dil Modeli (LLM) API sağlayıcıları, geliştiricilere GPU, model dağıtımı, ölçekleme veya çıkarım altyapısını yönetmeye gerek kalmadan güçlü yapay zekâ modellerine erişim sağlar. Bir modeli kendiniz barındırmak yerine, bir API\'ye bağlanabilir, bir model seçebilir, bir istek gönderebilir ve yanıt alabilirsiniz.

Bu yazıda, model kalitesi, geliştirici deneyimi, fiyatlandırma, ölçeklenebilirlik, ekosistem desteği ve üretime hazır olma kriterlerine göre en iyi 10 LLM API sağlayıcısına bakacağız. Her sağlayıcı için en iyi olduğu alanları, başlıca avantajlarını ve geliştiricilerin göz önünde bulundurması gereken temel dezavantajlarını ele alacağız.

Bu rehber, en iyi LLM API sağlayıcılarını dört kategoriye ayırır:

- Yerel LLM sağlayıcıları

- Açık kaynak LLM API sağlayıcıları

- LLM yönlendirme sağlayıcıları

- Bulut LLM sağlayıcıları

Yerel LLM Sağlayıcıları

Yerel LLM sağlayıcıları, kendi model ailelerini API\'ler üzerinden geliştirir, eğitir ve sunar. Yüksek model kalitesi, güvenilir dokümantasyon, ileri düzey akıl yürütme, çok modlu destek ve üretime hazır araçlar isteyen geliştiriciler için sıklıkla en güçlü seçenektir.

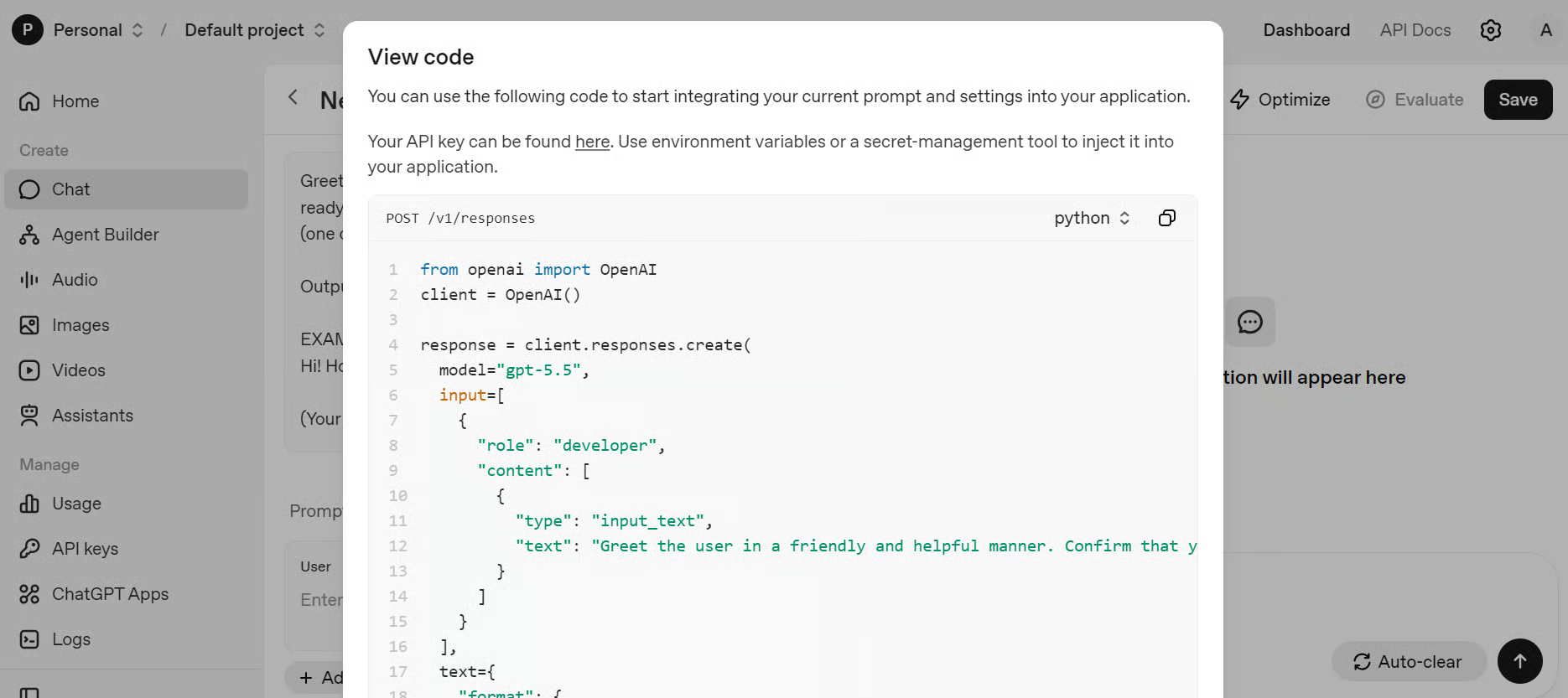

1. OpenAI

OpenAI, en yaygın kullanılan LLM API sağlayıcılarından biridir. API Platformu şunlara erişim sunar:

- GPT-5.5 gibi sınırları zorlayan akıl yürütme modelleri

- GPT-Realtime-2 ile gerçek zamanlı ses üretimi ve çeviri

- GPT-Images-2.0 görüntü üretim modeli ile görüntü üretimi

- OpenAI Agents SDK üzerinden aracı tabanlı geliştirme

API\'si akış, gerçek zamanlı arayüzler ve yapılandırılmış çıktıları destekler.

OpenAI, yapay zekâ asistanları, kodlama araçları, müşteri destek ajanları, dahili yardımcılar, çok modlu uygulamalar ve aracı tabanlı sistemler geliştiren ekipler için güçlü bir tercihtir.

Kaynak: OpenAI

Bir dezavantaj, özellikle yüksek hacimli veya yoğun akıl yürütme gerektiren uygulamalarda ölçek büyüdükçe maliyetin artabilmesidir. Ayrıca kapalı bir API sağlayıcısı olduğundan, geliştiriciler açık kaynak veya kendi barındırdıkları modellere kıyasla modelin iç işleyişi, barındırma ve özelleştirme üzerinde daha az kontrole sahiptir.

En uygun olduğu alanlar: genel amaçlı yapay zekâ uygulamaları, akıl yürütme, kodlama, çok modlu iş akışları ve üretime hazır yapay zekâ ürünleri.

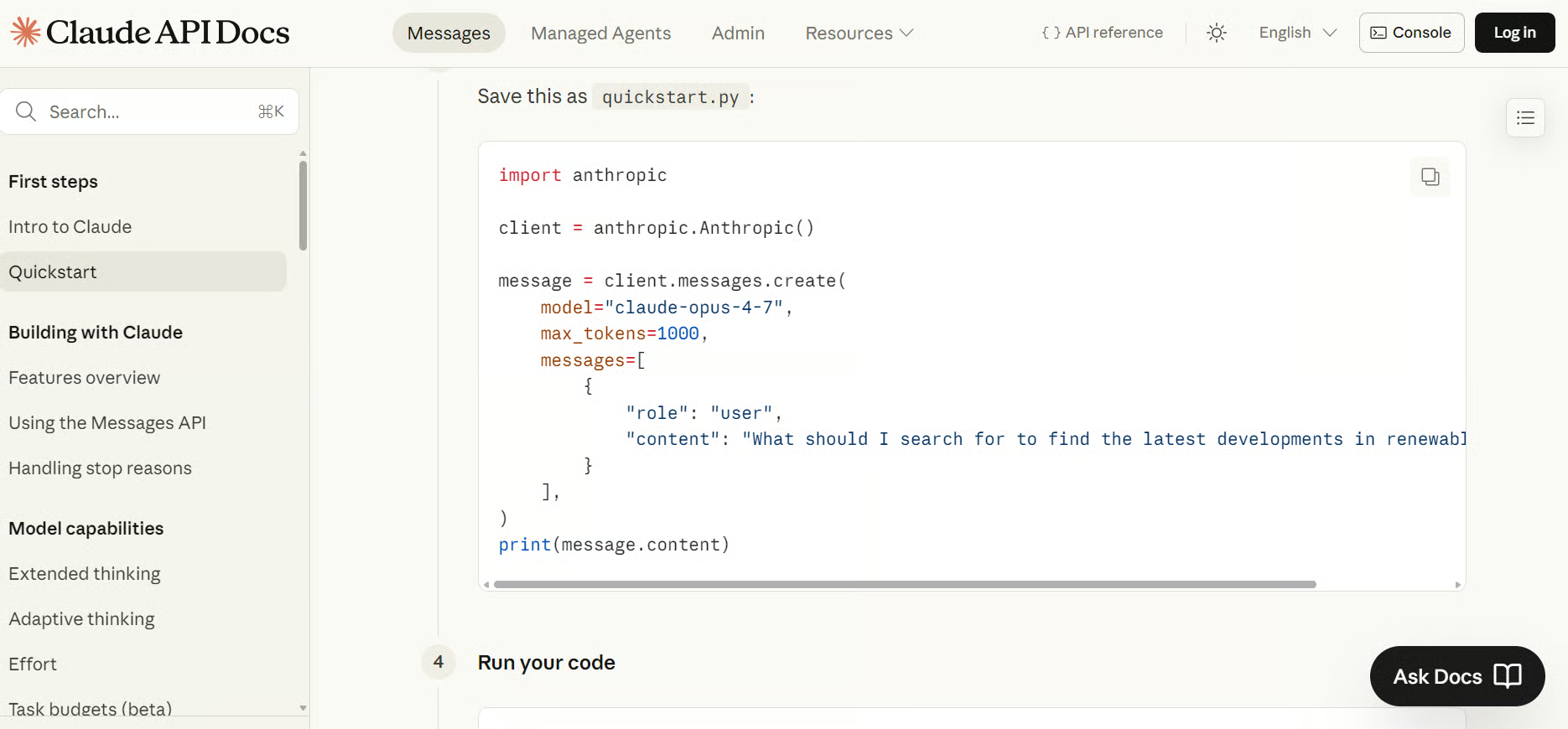

2. Anthropic

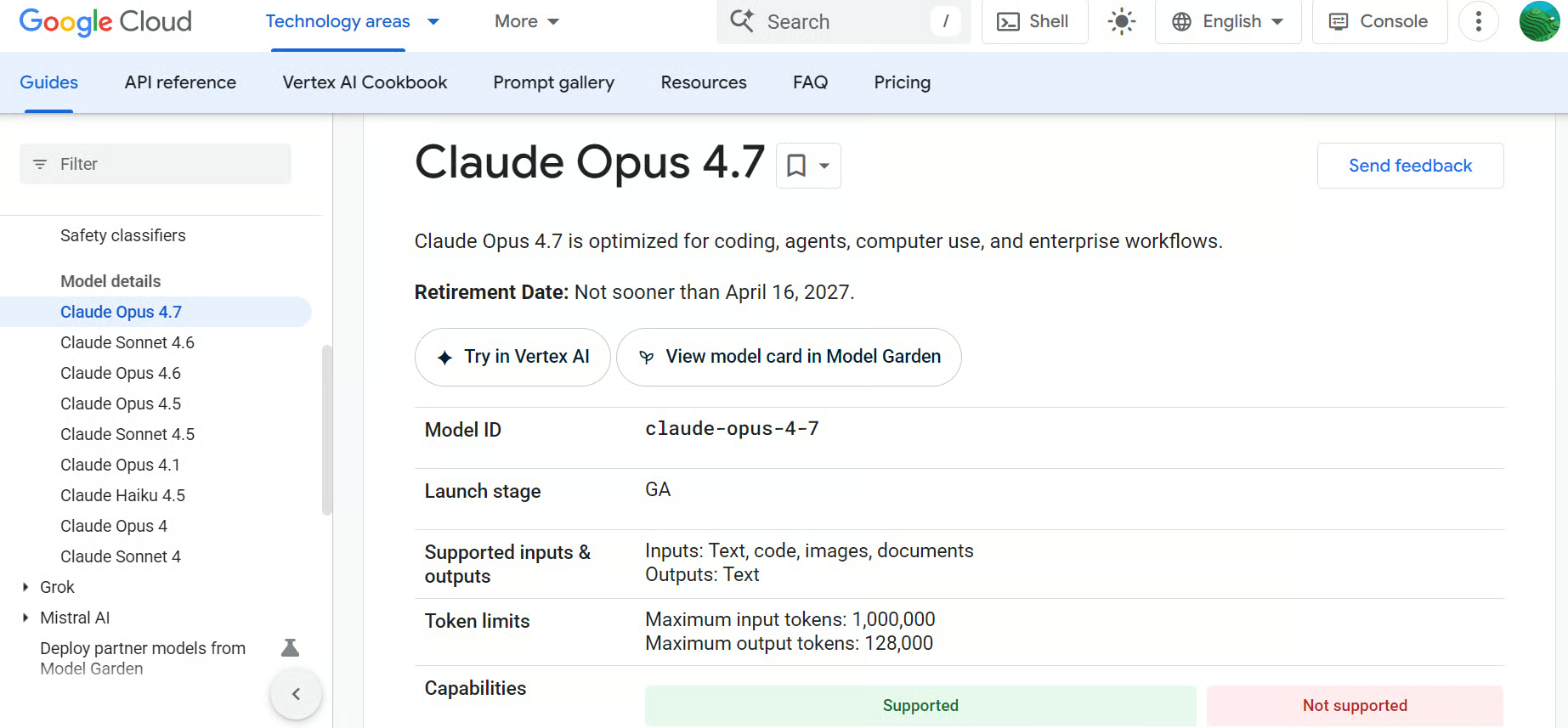

Anthropic, API\'si üzerinden Claude model ailesini sunar; örneğin en yeni amiral gemisi modeli Claude Opus 4.7. Claude; dil, akıl yürütme, analiz, kodlama, uzun bağlamlı çalışmalar ve aracı iş akışları için tasarlanmıştır. Anthropic\'in geliştirici platformu, ekiplere API\'ler, SDK\'lar ve geliştirici dokümantasyonu üzerinden doğrudan model erişimi sağlar.

Claude, özellikle dikkatli talimat takibi, güçlü yazı kalitesi, belge analizi ve karmaşık istemlerin güvenilir şekilde ele alınmasını gerektiren uygulamalar için faydalıdır.

Kaynak: Claude ile başlayın

Temel bir dezavantaj maliyettir; özellikle Claude\'u büyük belgeler, uzun bağlamlı istemler veya yüksek hacimli uygulamalar için kullanırken. Claude barındırılan bir API aracılığıyla erişildiğinden, ekiplerin modelin nerede ve nasıl çalıştığı üzerinde de sınırlı kontrolü vardır.

Gizliliğe duyarlı kullanım durumlarında, geliştiricilerin gizli iş veya müşteri verilerini API üzerinden göndermeden önce veri işleme, saklama ve uyumluluk gereksinimlerini dikkatle incelemesi gerekir.

En uygun olduğu alanlar: kodlama asistanları, kurumsal yapay zekâ, uzun bağlam analizi, belge iş akışları ve yapay zekâ ajanları.

İki devin ayrıntılı karşılaştırması için Anthropic vs OpenAI rehberimize göz atın.

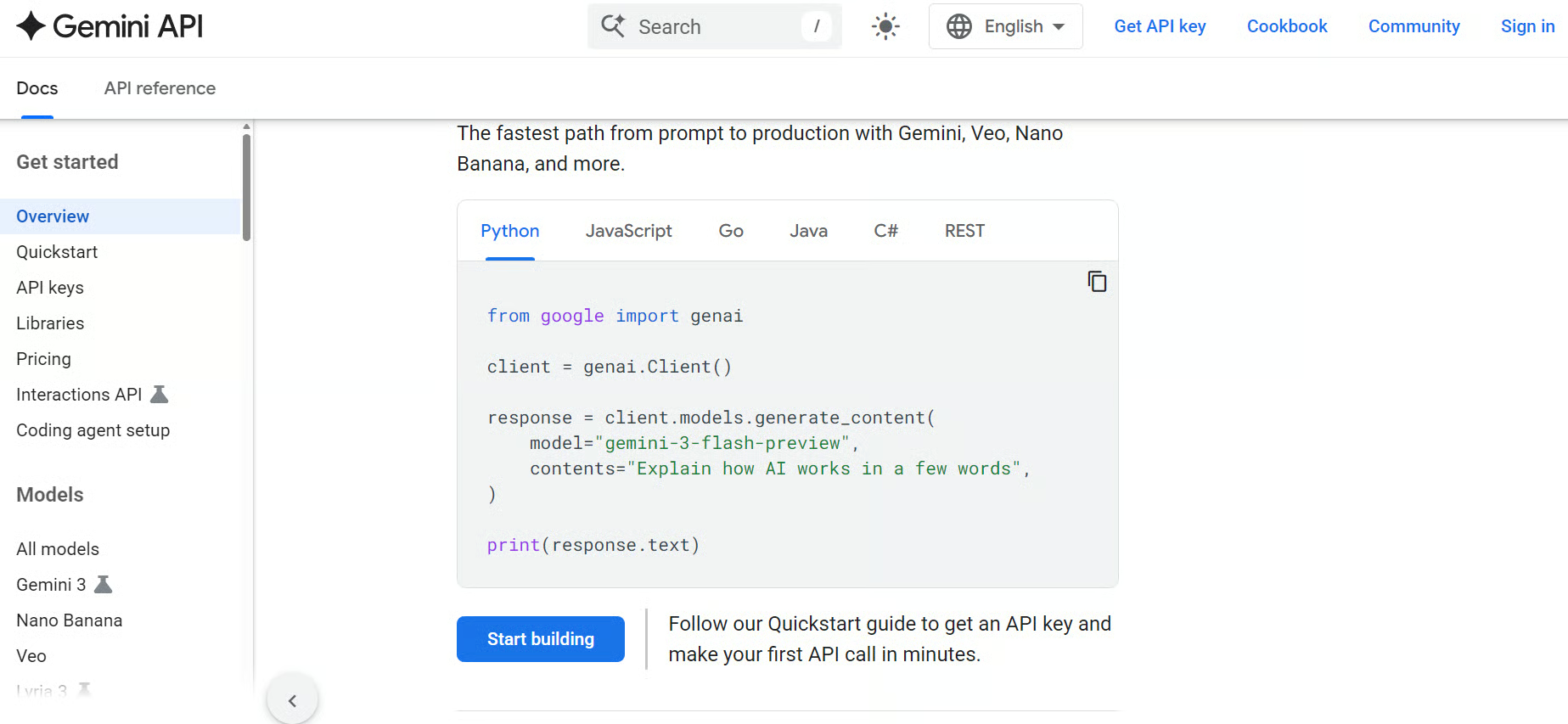

3. Google Gemini

Google Gemini, geliştiriciler için Gemini API üzerinden sunulan, Gemini 3.1 Pro dâhil Google\'ın yerel LLM ailesidir. Gemini API; standart, akış ve gerçek zamanlı API\'leri destekler; model detayları, SDK\'lar, fiyatlandırma, kurulum ve API referansları için dokümantasyon sunar.

Nano Banana 2 ile görüntü üretimi ve Veo 3.1 entegrasyonu sayesinde Gemini, çok modlu uygulamalar geliştirenler için güçlü bir seçenektir. Ayrıca, arama deneyimlerine dayanan asistanlar, kodlama araçları ve Google\'ın geniş yapay zekâ ekosistemiyle bütünleşen ürünler için de iyi bir tercihtir.

Kaynak: Gemini API

Bununla birlikte, Gemini Google ekosistemine daha sıkı bağlı hissi verebilir; bu da sağlayıcıdan bağımsız bir kurulum isteyen ekipler için uygun olmayabilir. Fiyatlandırma, model bulunabilirliği ve özellik desteği de araçlara ve bölgelere göre değişiklik gösterebilir.

Gizliliğe duyarlı uygulamalarda, ekipler gizli iş veya müşteri verilerini API üzerinden göndermeden önce veri işleme, saklama ve uyumluluk gereksinimlerini gözden geçirmelidir.

En uygun olduğu alanlar: çok modlu yapay zekâ uygulamaları, Google ekosistemi entegrasyonu, uzun bağlamlı iş akışları, kodlama ve genel amaçlı yapay zekâ uygulamaları.

Açık Kaynak LLM API Sağlayıcıları

Açık kaynak LLM API sağlayıcıları, geliştiricilere açık kaynak ve açık ağırlıklı modellere barındırılan API erişimi sunar. Modelleri indirip kendi GPU\'larınızda çalıştırmak yerine, bu platformlar modelleri barındırır ve basit API\'lerle erişilebilir hâle getirir.

Bu sağlayıcılar; daha düşük maliyet, daha fazla model esnekliği, daha hızlı deney yapma ve Llama, DeepSeek, Qwen, Mistral, Gemma ve diğer popüler açık modellere erişim isteyen ekipler için faydalıdır.

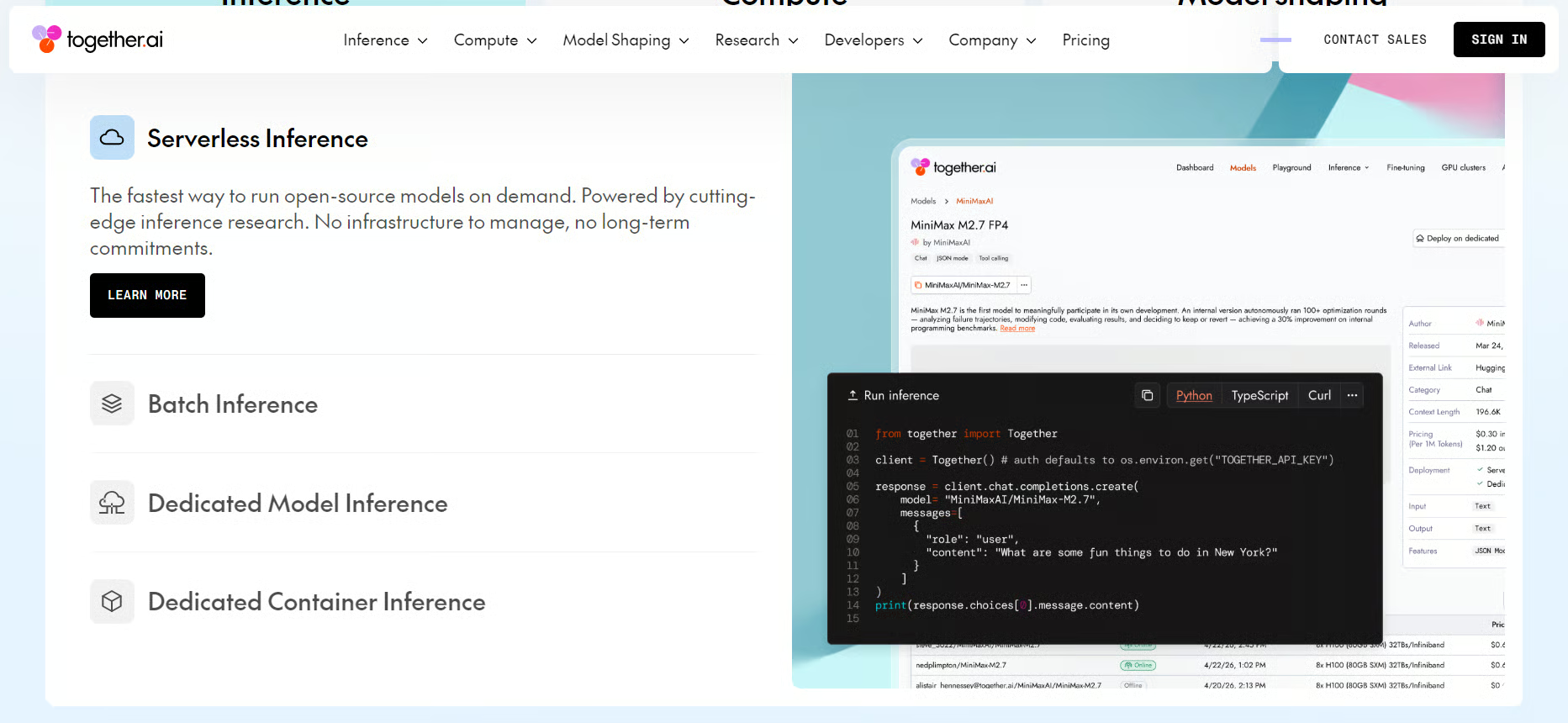

4. Together AI

Together AI, tek birleştirilmiş API üzerinden açık kaynaklı ve uzmanlaşmış modellere barındırılan erişim sağlar. Model kataloğu; metin, görsel, video, kod ve ses genelinde 200+ modeli içerir ve sunucusuz çıkarım, toplu çıkarım, adanmış uç noktalar, ince ayar, değerlendirmeler ve GPU kümeleri desteği sunar.

Together AI, kendi altyapısını yönetmeden açık modellerle geliştirme yapmak isteyenler için güçlü bir seçenektir. Birden fazla modeli test eden, özel modelleri ince ayar ile uyarlayan veya çıkarım iş yüklerini ölçekleyen ekipler için özellikle kullanışlıdır.

Kaynak: Together AI

Bununla birlikte, model kalitesi, hız ve güvenilirlik seçilen modele bağlı olarak değişebilir. Üretimde kullanmadan önce daha fazla test, kıyaslama ve değerlendirme gerekebilir.

Hassas iş yükleri için, ekipler güvenlik ve uyumluluk gereksinimlerini karşılamak amacıyla sunucusuz erişime, adanmış uç noktalara veya özel dağıtım seçeneklerine ihtiyaç duyup duymadıklarını kontrol etmelidir.

En uygun olduğu alanlar: açık kaynak model çıkarımı, ince ayar, ölçeklenebilir yapay zekâ iş yükleri ve çok sayıda model arasında deney yapma.

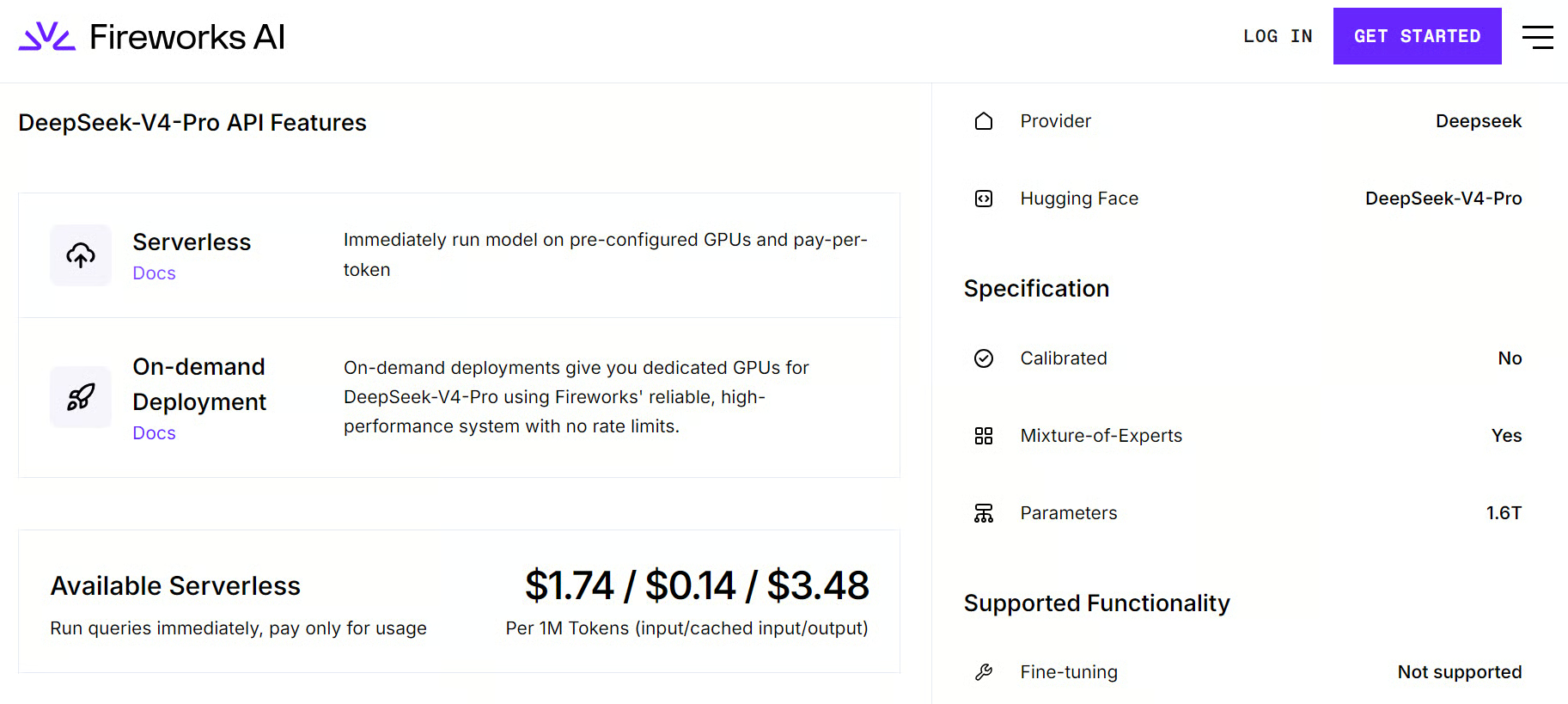

5. Fireworks AI

Fireworks AI, açık kaynak LLM\'ler ve üretken yapay zekâ modelleri için hızlı çıkarıma odaklanır. Platformu, sunucusuz çıkarım, ihtiya göre dağıtımlar, ince ayar ve popüler açık modeller için üretime hazır API\'leri destekler.

Fireworks AI, daha hızlı çıkarım ve daha düşük gecikme süresiyle açık model esnekliği isteyen ekipler için güçlü bir seçenektir. Özellikle sohbet tabanlı yapay zekâ, kodlama asistanları, arama, çok modlu uygulamalar ve kurumsal RAG sistemleri için yararlıdır.

Kaynak: Fireworks AI

Önemli bir dezavantaj, Fireworks AI\'ın her şey dâhil bir yapay zekâ platformu olmaktan ziyade çıkarım ve dağıtıma daha fazla odaklanmasıdır. Yönlendirme, değerlendirme, izleme veya karmaşık aracı iş akışları için ayrı araçlara hâlen ihtiyaç duyulabilir.

Ekipler ayrıca, hassas iş yükleri için sunucusuz çıkarımın yeterli olup olmadığını veya performans ve uyumluluk üzerinde daha güçlü kontrol için adanmış dağıtımların gerekip gerekmediğini değerlendirmelidir.

En uygun olduğu alanlar: hızlı açık kaynak model çıkarımı, ince ayar, üretim yapay zekâ uygulamaları ve düşük gecikmeli açık model dağıtımları.

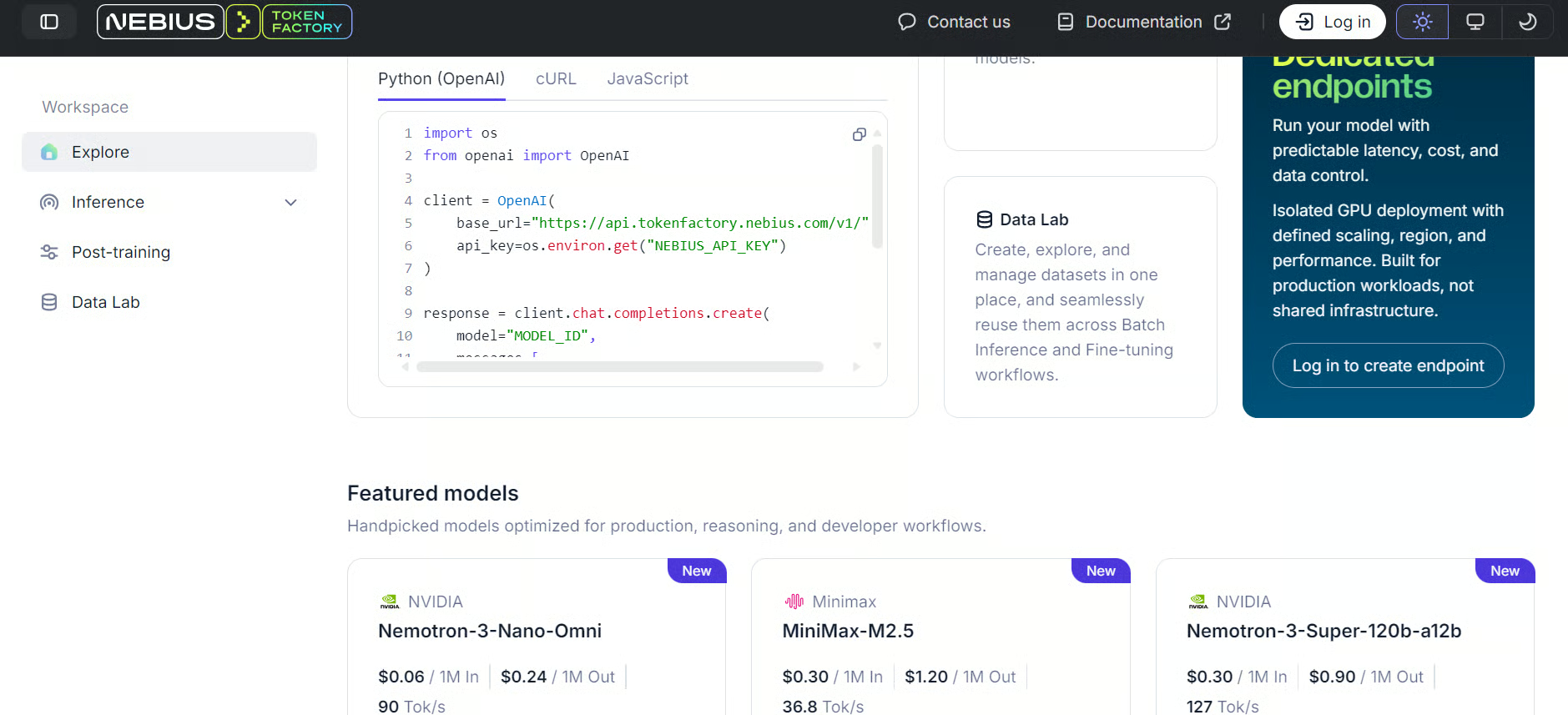

6. Nebius AI

Nebius AI, GPU destekli yapay zekâ iş yükleri, barındırılan çıkarım, model sunumu ve ölçeklenebilir yapay zekâ altyapısı için oluşturulmuş bir yapay zekâ bulut sağlayıcısıdır. Token Factory çıkarım hizmeti, OpenAI uyumlu bir API aracılığıyla açık modelleri destekler; sunucusuz çıkarım, ince ayar ve adanmış yapay zekâ bulut altyapısı seçenekleri sunar.

Nebius AI, temel bir API sağlayıcısından daha fazla altyapı kontrolü isteyen ancak tamamen kendi GPU ortamlarını yönetmenin karmaşıklığından kaçınmak isteyen ekipler için güçlü bir seçenektir. Özellikle açık ve özel modellerle çalışan, ölçeklenebilir hesaplama, hızlı çıkarım ve üretime hazır dağıtım seçeneklerine ihtiyaç duyan ekipler için faydalıdır.

Kaynak: Nebius Token Factory

Nebius Token Factory iki çıkarım hız seviyesi sunar: Fast ve Base. Fast, düşük gecikmeli, etkileşimli iş yükleri için; Base ise daha uygun maliyetli, yüksek hacimli çıkarım veya arka plan işlemleri için tasarlanmıştır.

Nebius, basit tak-çalıştır LLM API platformlarına kıyasla kesinlikle daha fazla altyapı odaklıdır. Bu da ekiplerin bundan en iyi şekilde yararlanmak için daha fazla bulut, dağıtım ve iş yükü yönetimi bilgisine ihtiyaç duyabileceği anlamına gelir.

Hassas iş yükleri için, ekipler güvenlik, uyumluluk ve veri yönetişimi üzerinde daha güçlü kontrol için yönetilen çıkarımın yeterli olup olmadığını veya adanmış altyapıya ihtiyaç duyup duymadıklarını değerlendirmelidir.

En uygun olduğu alanlar: yapay zekâ bulut altyapısı, barındırılan çıkarım, GPU destekli iş yükleri, hızlı çıkarım ve daha fazla dağıtım kontrolü isteyen ekipler.

LLM Yönlendirme Sağlayıcıları

LLM yönlendirme sağlayıcıları, geliştiricilere tek bir API üzerinden birden çok model ve sağlayıcıya erişim sunar. OpenAI, Anthropic, Google, Mistral, DeepSeek ve diğer sağlayıcılarla ayrı ayrı entegre olmak yerine, geliştiriciler tek bir yönlendirme katmanını kullanarak model erişimini tek yerden yönetebilir.

Bu platformlar; model karşılaştırma, geri dönüş (fallback) yönlendirme, maliyet optimizasyonu, sağlayıcı yedekliliği, gözlemlenebilirlik ve uygulamanızı yeniden yazmadan modeller arasında geçiş için faydalıdır.

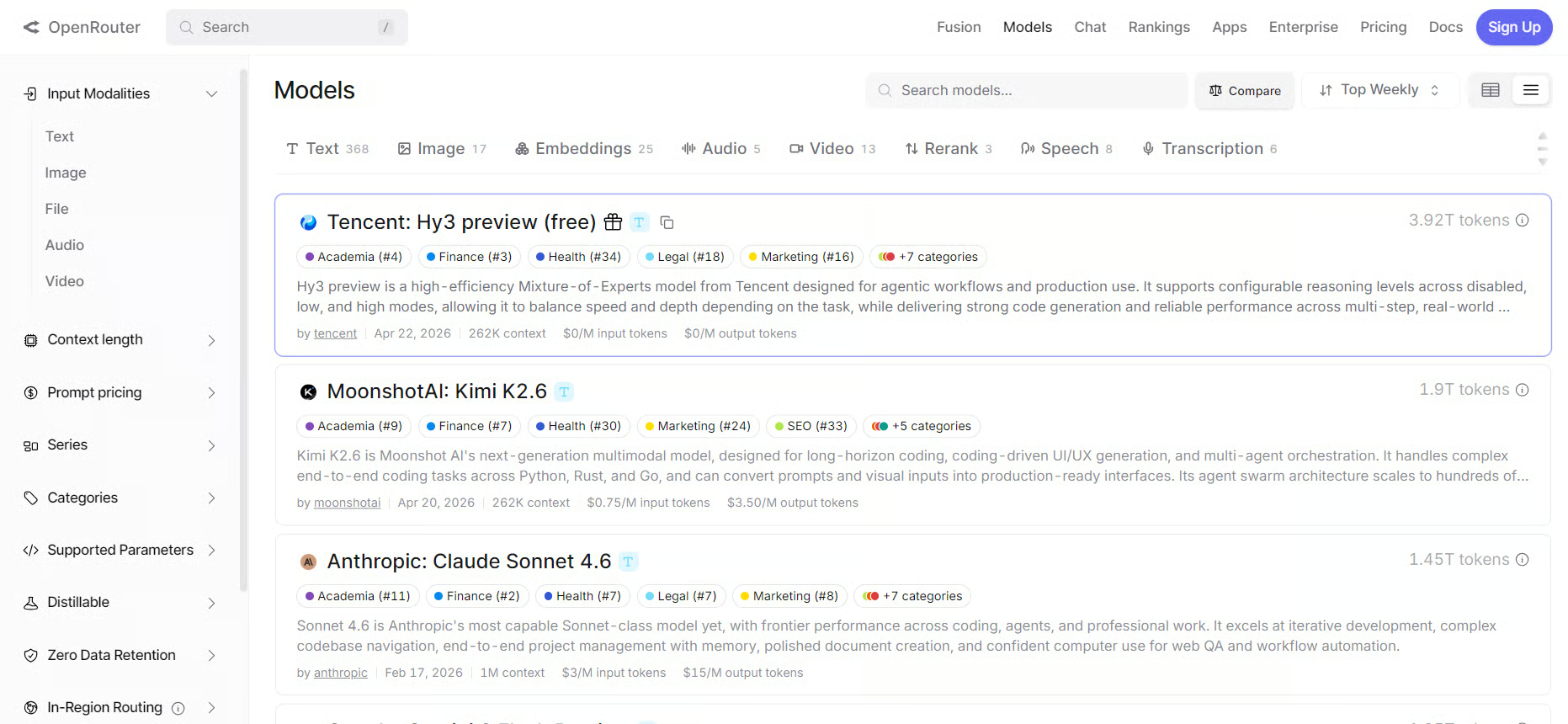

7. OpenRouter

OpenRouter, en popüler LLM yönlendirme sağlayıcılarından biridir. Geliştiricilere tek bir OpenAI uyumlu API üzerinden birçok modele erişim sağlar; böylece tek bir entegrasyonla farklı sağlayıcılarla çalışmayı kolaylaştırır.

Çeşitli eğitimlerimizde ele aldığımız üzere, OpenRouter, modelleri karşılaştırmak, yeni sürümleri hızlıca test etmek, istekleri sağlayıcılar arasında yönlendirmek veya tek bir model satıcısına bağımlı kalmaktan kaçınmak isteyen geliştiriciler için güçlü bir seçenektir.

Kaynak: OpenRouter

Bir dezavantaj, OpenRouter\'ın uygulamanız ile model sağlayıcısı arasında ek bir katman eklemesidir. Bu durum, fazladan bağımlılık, değişken gecikme ve yine test edilmesi gereken sağlayıcıya özgü davranışlar getirebilir.

Üretim iş yükleri için, ekipler platform üzerinden hassas veya iş açısından kritik trafiği göndermeden önce yönlendirme ayarlarını, geri dönüş davranışını, sağlayıcı tercihlerini ve gizlilik kontrollerini gözden geçirmelidir.

En uygun olduğu alanlar: çok modelli uygulamalar, model karşılaştırma, geri dönüş yönlendirme, sağlayıcı esnekliği ve hızlı deney yapma.

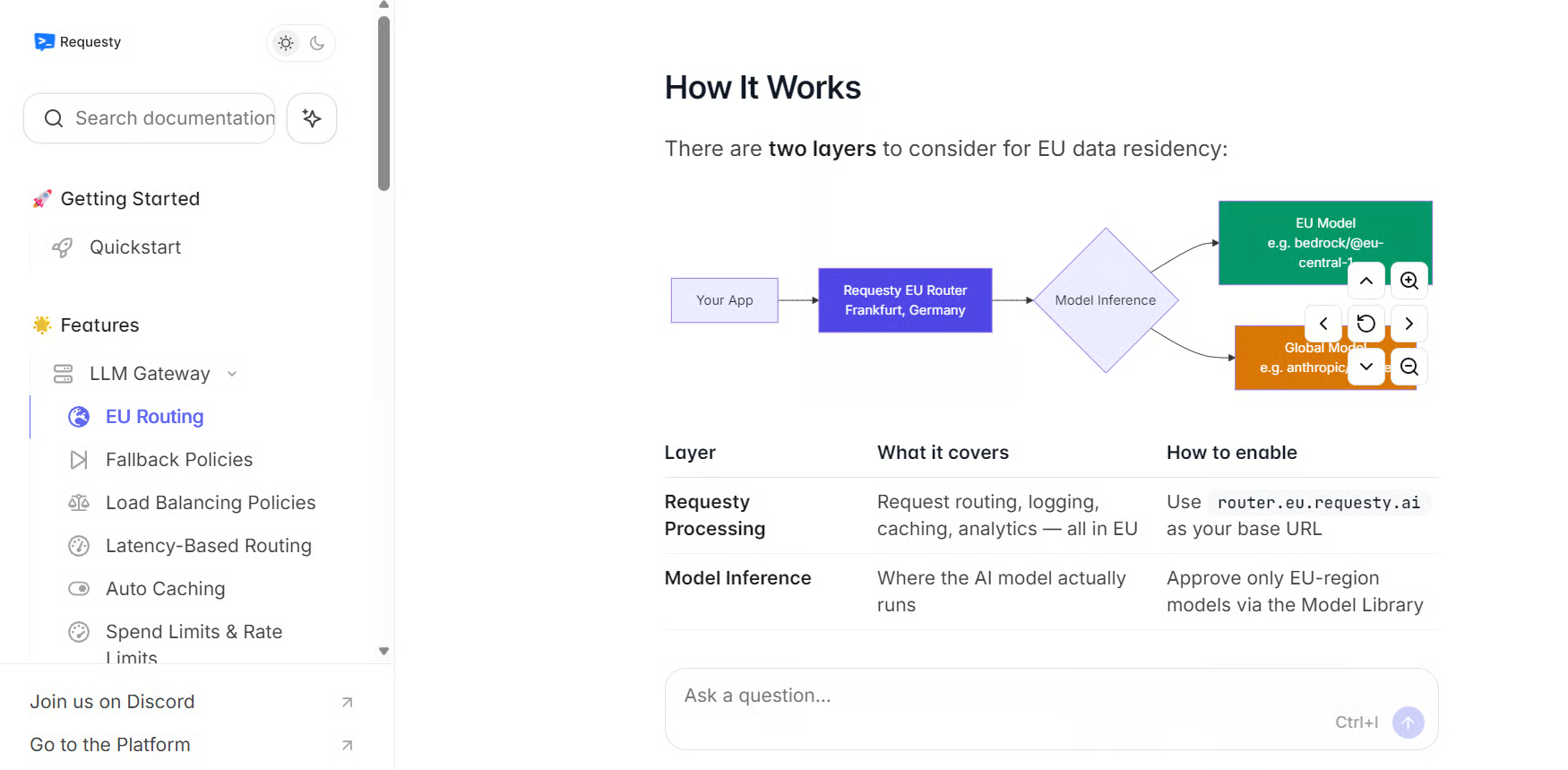

8. Requesty.ai

Requesty.ai, ekiplerin tek bir OpenAI uyumlu API üzerinden birden çok LLM sağlayıcısına bağlanmasına yardımcı olan bir LLM yönlendirme ve ağ geçidi platformudur. 400+ modeli destekler; yönlendirme, geri dönüş, önbellekleme, maliyet yönetimi, gözlemlenebilirlik ve yönetişim için özellikler sunar.

Requesty.ai, birden fazla model sağlayıcısına dayanan üretim yapay zekâ uygulamaları geliştiren ekipler için güçlü bir seçenektir. Özellikle yönlendirme ilkelerini yönetme, kullanımı izleme, harcamayı kontrol etme ve sağlayıcılar başarısız olduğunda, zaman aşımına uğradığında veya oran sınırına takıldığında güvenilirliği artırma açısından faydalıdır.

Kaynak: Requesty AI Dokümantasyonu

OpenRouter\'da olduğu gibi, temel dezavantaj Requesty.ai\'ın uygulama yığınına ek bir ağ geçidi katmanı eklemesidir. Ekiplerin, beklenmedik maliyet, gecikme veya sağlayıcı davranışlarını önlemek için yönlendirmeyi, geri dönüşü, günlükleme ve yönetişimi dikkatle yapılandırması gerekir.

Hassas iş yükleri için, Requesty.ai; KVK tespiti, temizleme, içerik güvenlik şeritleri, denetim günlükleri ve yönetişim özellikleri gibi kontroller içerir; ancak ekipler yine de ağ geçidinden hangi verilerin geçebileceğine ve günlüklerin nasıl yönetileceğine karar vermelidir.

En uygun olduğu alanlar: LLM yönlendirme, maliyet kontrolü, gözlemlenebilirlik, sağlayıcı geri dönüşleri, yönetişim ve üretim yapay zekâ ağ geçidi iş akışları.

Bulut LLM Sağlayıcıları

Bulut LLM sağlayıcıları, geliştiricilere ve işletmelere temel modellere yönetilen erişim sağlayan büyük bulut platformlarıdır. Bu platformlar genellikle kendi modellerinin yanı sıra üçüncü taraf sağlayıcıların modellerini de destekler.

Özellikle bulut altyapısını hâlihazırda kullanan ve güvenlik, yönetişim, uyumluluk, veri entegrasyonu, dağıtım kontrolleri ve model yönetimine tek bir yerde ihtiyaç duyan işletmeler için yararlıdır.

9. Google Vertex AI

Google Vertex AI, Google Cloud\'un makine öğrenimi ve üretken yapay zekâ platformudur. Geliştiricilere ve işletmelere Gemini modellerine, Model Garden\'a, aracı araçlarına ve yapay zekâ uygulamaları oluşturma, dağıtma ve yönetme için yönetilen altyapıya erişim sağlar.

Vertex AI, Model Garden aracılığıyla önde gelen iş ortaklarını ve açık modelleri de destekler; Anthropic Claude, xAI Grok, Mistral AI modelleri ve GLM 5 ile Gemma 4 gibi açık kaynak modeller, Google\'ın kendi Gemini modelleri yanında yer alır.

Kaynak: Vertex AI üzerinde Üretken Yapay Zekâ

Google Vertex AI, Google Cloud\'u zaten kullanan ve bulut yerel model dağıtımı, yönetişim, güvenlik kontrolleri ve Google\'ın daha geniş veri ve yapay zekâ ekosistemiyle entegrasyon isteyen ekipler için güçlü bir seçenektir.

Diğer yandan, Vertex AI basit bir model API\'si kullanmaktan daha karmaşık olabilir. Ekiplerin projeleri, izinleri, faturalandırmayı, dağıtım ayarlarını ve entegrasyonları doğru şekilde yönetmek için Google Cloud deneyimine ihtiyacı olabilir.

Hassas iş yükleri için Vertex AI, bulut düzeyinde erişim kontrolleri, yönetişim ve yönetilen altyapıya ihtiyaç duyan ekipler açısından faydalıdır; ancak günlükleme, veri erişimi ve dağıtım bölgelerine ilişkin kurulum kararları yine dikkatle gözden geçirilmelidir.

En uygun olduğu alanlar: Google Cloud kullanıcıları, Gemini erişimi, kurumsal yapay zekâ uygulamaları, çok modlu iş akışları ve bulut yerel model dağıtımı.

10. Amazon Bedrock

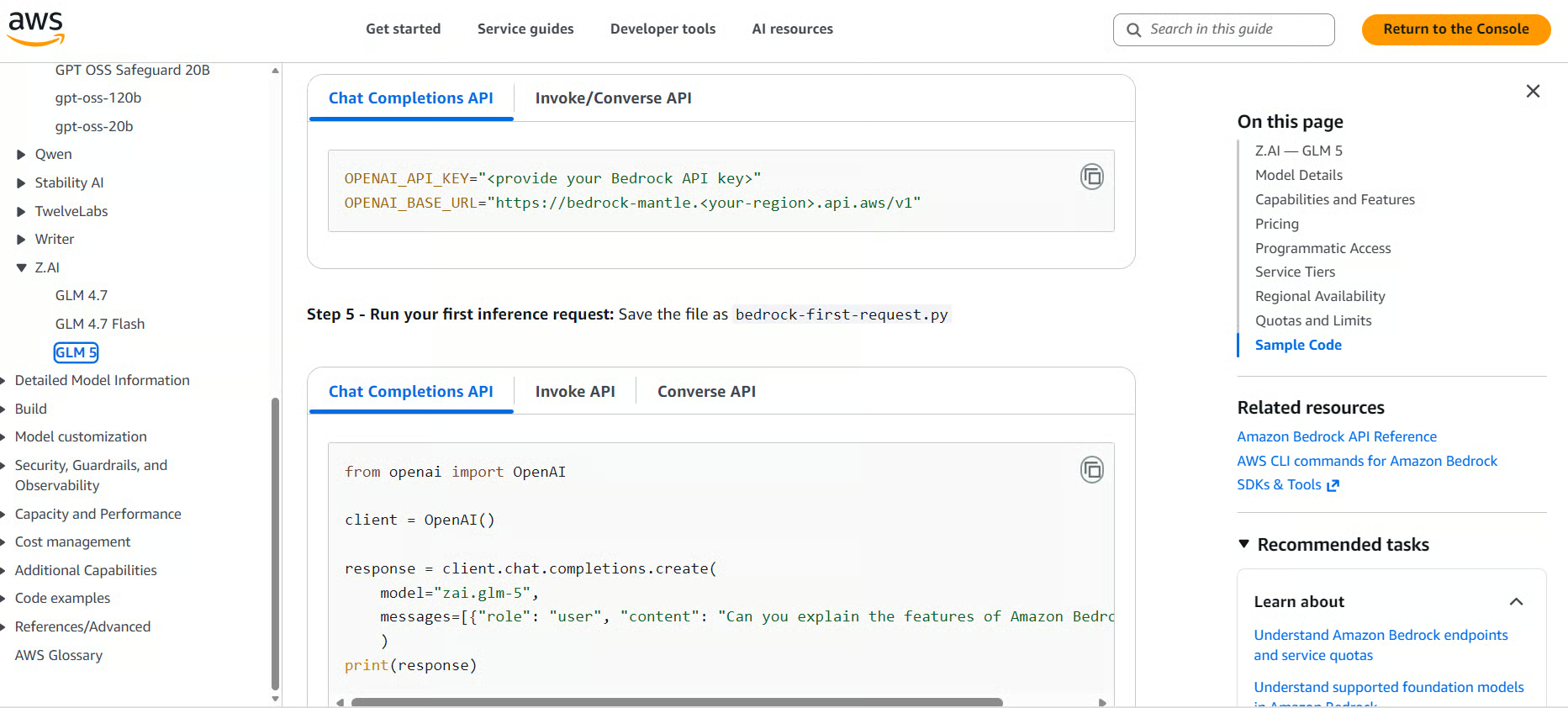

Amazon Bedrock, AWS\'in yönetilen üretken yapay zekâ platformudur. Geliştiricilere, Amazon ve üçüncü taraf sağlayıcıların temel modellerine tek bir yönetilen AWS hizmeti üzerinden erişim sunar.

Bedrock; Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek ve diğer sağlayıcıların modellerini destekler; bu da AWS ekosistemi içinde model seçimi isteyen ekipler için faydalıdır.

Amazon Bedrock, model erişimi, bulut altyapısı, güvenlik kontrolleri ve kurumsal entegrasyonu tek bir platformda sunduğu için hâlihazırda AWS üzerinde geliştirme yapan şirketler için güçlü bir tercihtir.

Kaynak: Amazon Bedrock

Temel bir dezavantaj, Bedrock\'ın basit bir LLM API\'sinden daha karmaşık olabilmesidir. Ekiplerin izinleri, bölgeleri, model erişimini, fiyatlandırmayı, ağ yapılandırmasını ve dağıtım ayarlarını doğru şekilde yönetmek için AWS deneyimine ihtiyacı olabilir.

Hassas iş yükleri için Bedrock faydalıdır; çünkü istemler ve çıktılar temel modelleri eğitmek için kullanılmaz veya model sağlayıcılarla paylaşılmaz ve ekipler şifreleme, IAM ve PrivateLink gibi AWS kontrollerini kullanabilir.

En uygun olduğu alanlar: AWS kullanıcıları, kurumsal yapay zekâ, yönetilen temel model erişimi, güvenlik odaklı dağıtımlar ve bulut yerel üretken yapay zekâ uygulamaları.

LLM API Sağlayıcıları Karşılaştırma Tablosu

Aşağıdaki tablo, başlıca avantajları ve temel dezavantajlarına göre en iyi LLM API sağlayıcılarını karşılaştırır.

|

Sağlayıcı |

Başlıca avantajlar |

Temel dezavantajlar |

|

OpenAI |

Güçlü model kalitesi, olgun API\'ler, çok modlu araçlar, yapılandırılmış çıktılar, gömme vektörleri, konuşma, görüntü üretimi ve aracı tabanlı iş akışları |

Ölçekte pahalı hâle gelebilir ve açık kaynak veya kendi barındırılan modellere kıyasla daha az kontrol sunar |

|

Anthropic |

Güçlü yazı kalitesi, dikkatli talimat takibi, akıl yürütme, kodlama ve uzun bağlam desteği |

Büyük belgeler veya yüksek hacimli kullanımda maliyet artabilir ve ekiplerin barındırma ile model iç işleyişi üzerinde sınırlı kontrolü vardır |

|

Google Gemini |

Güçlü çok modlu yetenekler, gerçek zamanlı API\'ler, uzun bağlam desteği ve Google\'ın yapay zekâ ekosistemiyle yakın entegrasyon |

Google ekosistemine bağlı hissi verebilir ve fiyatlandırma, bulunabilirlik ile özellikler araca veya bölgeye göre değişebilir |

|

Together AI |

Birçok açık ve uzmanlaşmış modele barındırılan erişim; sunucusuz çıkarım, adanmış uç noktalar, ince ayar, değerlendirmeler ve GPU altyapısı |

Model kalitesi, hız ve güvenilirlik seçilen modele bağlı olarak değişebilir |

|

Fireworks AI |

Hızlı çıkarım, düşük gecikme, sunucusuz erişim, ihtiyaca göre dağıtımlar ve açık modeller için üretime hazır API\'ler |

Tümü bir arada bir yapay zekâ geliştirme platformu olmaktan ziyade çıkarım ve dağıtıma daha çok odaklanır |

|

Nebius AI |

GPU destekli altyapı, barındırılan çıkarım, OpenAI uyumlu API ve Fast ile Base gibi hız katmanları |

Daha fazla altyapı odaklıdır; bu nedenle ekiplerin daha güçlü bulut ve dağıtım bilgisine ihtiyacı olabilir |

|

OpenRouter |

Tek bir OpenAI uyumlu API üzerinden birçok modele erişim; daha kolay sağlayıcı değiştirme ve geri dönüş seçenekleri |

Uygulama ile sağlayıcı arasına ek bir katman ekler; bu da gecikme, güvenilirlik veya hata ayıklamayı etkileyebilir |

|

Requesty.ai |

Birden çok sağlayıcı için tek API; yönlendirme, geri dönüş, önbellekleme, maliyet takibi, gözlemlenebilirlik ve yönetişim özellikleri |

Beklenmedik davranışları önlemek için yönlendirme, günlükleme, geri dönüş ve maliyet kontrollerinin dikkatli kurulumu gerekir |

|

Google Vertex AI |

Model Garden üzerinden Gemini, Anthropic Claude, xAI Grok, Mistral AI ve açık modellere yönetilen erişim; ayrıca Google Cloud güvenlik ve yönetişim araçları |

Basit bir API\'den daha karmaşıktır ve Google Cloud deneyimi gerektirebilir |

|

Amazon Bedrock |

AWS içinde Amazon ve Anthropic, Meta, Mistral AI, Cohere ve diğer üçüncü taraf sağlayıcıların modellerine yönetilen erişim |

Temel bir LLM API\'sinden daha karmaşıktır; özellikle izinler, bölgeler, fiyatlandırma ve model erişimi konularında |

Kullanım Durumunuza En Uygun LLM API Sağlayıcısını Seçmek

Doğru LLM API sağlayıcısını seçmek üç faktöre bağlıdır:

- Ne inşa ettiğiniz

- Ne kadar kontrole ihtiyaç duyduğunuz

- Ne kadar harcamaya istekli olduğunuz

Girişimler ve küçük ekipler için, açık kaynak LLM API sağlayıcıları çoğu zaman başlamak için en iyi yerdir. Together AI, Fireworks AI ve Nebius AI gibi platformlar, GPU veya altyapıyı kendiniz yönetmeden güçlü açık modellere erişim sağlar. Deney ve erken aşama ürün geliştirme için daha hızlı, daha ucuz ve daha esnek olabilirler.

Farklı modelleri hızlıca test etmek istiyorsanız, LLM yönlendirme sağlayıcıları güçlü bir seçenektir. OpenRouter ve Requesty.ai gibi araçlar, kapalı kaynak ve açık kaynak modelleri tek bir API üzerinden karşılaştırmanıza, geri dönüşleri yönetmenize ve uygulamanızı yeniden yazmadan sağlayıcı değiştirmenize olanak tanır.

Model kalitesinin maliyetten daha önemli olduğu iş akışları için, OpenAI ve Anthropic gibi yerel sağlayıcılar hâlâ en güçlü tercihler arasındadır. Güvenilirlik ve model performansının en çok önem taşıdığı üretim yapay zekâ asistanları, kodlama araçları, yoğun akıl yürütme gerektiren iş akışları, çok modlu uygulamalar ve aracı sistemler için özellikle faydalıdırlar.

Son olarak, şirketiniz zaten AWS veya Google Cloud üzerinde çalışıyorsa, genellikle o bulut ekosistemi içinde kalmak mantıklıdır. Amazon Bedrock ve Google Vertex AI; yönetilen model erişimi, güvenlik kontrolleri, yönetişim ve ekibinizin zaten kullandığı araçlarla entegrasyon sunar.

Son Düşünceler

Teknik işler, kodlama asistanları ve vibe coding araçları için başlangıçta aşırı deney yapmazdım. Deneyimlerime göre, güçlü kodlama, akıl yürütme ve geliştirici araçları nedeniyle OpenAI ve Anthropic genellikle en güvenli tercihlerdir.

Açık kaynak LLM API sağlayıcıları ve LLM yönlendirme sağlayıcıları, daha ileri düzey deneyler için güçlü alternatiflerdir.

Büyük Bulut LLM sağlayıcıları genellikle yalnızca kurumsal ortamlarda mantıklıdır. Bu durumda, hâlihazırda ekosistemini kullandığınız sağlayıcıyla devam edin.

LLM API Sağlayıcıları Hakkında SSS

Bir LLM API sağlayıcısı nedir?

Geliştiricilerin kendi GPU veya çıkarım altyapılarını yönetmesine gerek kalmadan, büyük dil modellerini barındıran ve bunları bir API aracılığıyla sunan şirket veya platform. Böylece geliştiriciler istek gönderip yapay zekâ tarafından üretilen yanıtları alabilir.

Yerel bir LLM sağlayıcısı ile bulut LLM sağlayıcısı arasındaki fark nedir?

Yerel sağlayıcılar (OpenAI ve Anthropic gibi) kendi modellerini doğrudan geliştirir ve sunar. Bulut sağlayıcıları (AWS Bedrock ve Google Vertex AI gibi) ise mevcut bir bulut ekosistemi içine paketlenmiş, kurumsal güvenlik ve yönetişim araçlarıyla birlikte, birden çok üçüncü taraf modeline yönetilen erişim sağlar.

OpenRouter veya Requesty.ai gibi bir LLM yönlendirme sağlayıcısını ne zaman kullanmalıyım?

Birden fazla model veya sağlayıcıyla çalışmanız gerektiğinde, bir sağlayıcı devre dışı kaldığında otomatik geri dönüş istendiğinde ya da tek bir API entegrasyonu üzerinden modelleri karşılaştırıp maliyetleri kontrol etmek gerektiğinde.

Açık kaynak LLM API sağlayıcıları, OpenAI gibi yerel sağlayıcılardan daha mı yetersiz?

Gerekmeyebilir; göreve bağlıdır. Together AI ve Fireworks AI gibi platformlar, Llama, DeepSeek ve Mistral gibi son teknoloji açık modelleri barındırır; bu modeller kapalı modellere kıyasla rekabetçi olabilir ve sıklıkla kayda değer ölçüde daha düşük maliyetlidir.

Sıkı uyumluluk gereksinimleri olan işletmeler için en iyi LLM API sağlayıcısı hangisidir?

Amazon Bedrock ve Google Vertex AI genellikle en güçlü seçeneklerdir; çünkü mevcut kurumsal altyapıyla entegre olan bulut yerel güvenlik kontrolleri, IAM, şifreleme, denetim günlüğü ve yönetişim özellikleri sunarlar.

Sertifikalı bir veri bilimcisi olarak, yenilikçi makine öğrenimi uygulamaları oluşturmak için en son teknolojileri kullanmaya büyük ilgi duyuyorum. Konuşma tanıma, veri analizi ve raporlama, MLOps, konuşma yapay zekası ve NLP alanlarında güçlü bir geçmişe sahip olarak, gerçek bir etki yaratabilecek akıllı sistemler geliştirme becerilerimi geliştirdim. Teknik uzmanlığımın yanı sıra, karmaşık kavramları açık ve özlü bir dille ifade etme yeteneğine sahip, becerikli bir iletişimciyim. Sonuç olarak, veri bilimi konusunda aranan bir blog yazarı oldum ve giderek büyüyen veri profesyonelleri topluluğuyla görüşlerimi ve deneyimlerimi paylaşıyorum. Şu anda, içerik oluşturma ve düzenlemeye odaklanıyorum. Büyük dil modelleriyle çalışarak, hem işletmelerin hem de bireylerin verilerinden en iyi şekilde yararlanmalarına yardımcı olabilecek güçlü ve ilgi çekici içerikler geliştiriyorum.