Track

लार्ज लैंग्वेज मॉडल (LLM) API प्रदाता डेवलपर्स को शक्तिशाली AI मॉडलों तक पहुँच देते हैं, बिना GPU, मॉडल डिप्लॉयमेंट, स्केलिंग या इन्फ़रेंस इंफ्रास्ट्रक्चर को संभाले। मॉडल को स्वयं होस्ट करने के बजाय, डेवलपर्स एक API से कनेक्ट कर सकते हैं, मॉडल चुन सकते हैं, अनुरोध भेज सकते हैं और प्रतिक्रिया प्राप्त कर सकते हैं।

इस लेख में, हम मॉडल क्वालिटी, डेवलपर अनुभव, प्राइसिंग, स्केलेबिलिटी, इकोसिस्टम सपोर्ट और प्रोडक्शन तत्परता के आधार पर शीर्ष 10 LLM API प्रदाताओं पर नज़र डालेंगे। हर प्रदाता के लिए, हम देखेंगे कि वह किसके लिए सबसे बेहतर है, उसकी मुख्य खूबियाँ क्या हैं, और वे प्रमुख कमियाँ जिन्हें डेवलपर्स को ध्यान में रखना चाहिए।

यह गाइड शीर्ष LLM API प्रदाताओं को चार श्रेणियों में बाँटता है:

- नेटिव LLM प्रदाता

- ओपन-सोर्स LLM API प्रदाता

- LLM रूटिंग प्रदाता

- क्लाउड LLM प्रदाता

नेटिव LLM प्रदाता

नेटिव LLM प्रदाता अपने स्वयं के मॉडल परिवार बनाते, ट्रेन करते और APIs के माध्यम से सर्व करते हैं। वे अक्सर उन डेवलपर्स के लिए सबसे सशक्त विकल्प होते हैं जो उच्च मॉडल क्वालिटी, भरोसेमंद डॉक्यूमेंटेशन, उन्नत रीजनिंग, मल्टीमॉडल सपोर्ट और प्रोडक्शन-रेडी टूलिंग चाहते हैं।

1. OpenAI

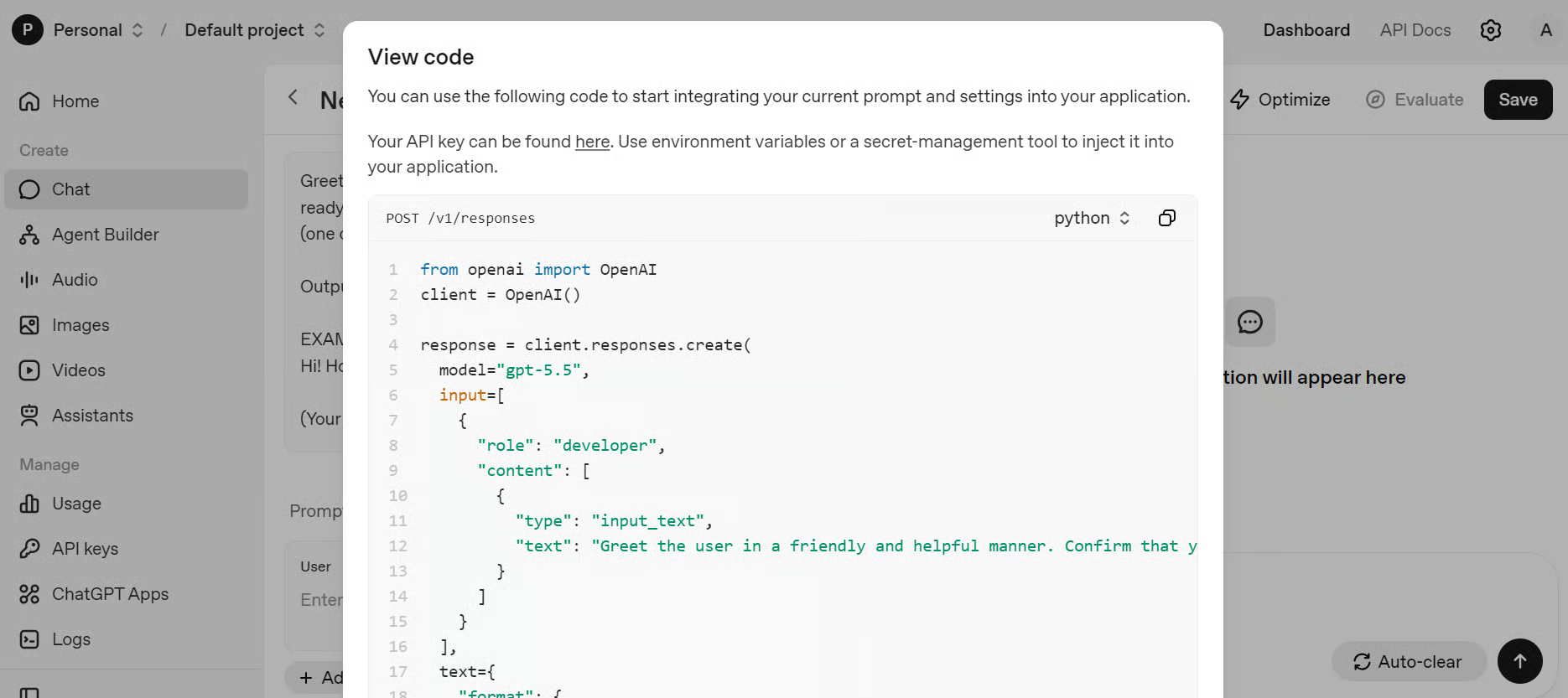

OpenAI सबसे अधिक उपयोग किए जाने वाले LLM API प्रदाताओं में से एक है। इसका API Platform इन तक पहुँच देता है:

- GPT-5.5 जैसे फ्रंटियर रीजनिंग मॉडल

- GPT-Realtime-2 के माध्यम से रियल-टाइम वॉइस जनरेशन और अनुवाद

- GPT-Images-2.0 इमेज जनरेशन मॉडल के जरिए इमेज जनरेशन

- OpenAI Agents SDK के जरिए एजेंट-आधारित डेवलपमेंट

इसका API स्ट्रीमिंग, रियल-टाइम इंटरफेस और स्ट्रक्चर्ड आउटपुट्स को सपोर्ट करता है।

OpenAI AI असिस्टेंट, कोडिंग टूल्स, कस्टमर सपोर्ट एजेंट्स, आंतरिक कोपायलट्स, मल्टीमॉडल ऐप्स और एजेंट-आधारित सिस्टम बनाने वाली टीमों के लिए मजबूत विकल्प है।

स्रोत: OpenAI

एक कमी यह है कि बड़े पैमाने पर OpenAI महंगा हो सकता है, खासकर उच्च वॉल्यूम या रीजनिंग-हेवी एप्लिकेशनों के लिए। यह एक क्लोज़्ड API प्रदाता भी है, जिसका अर्थ है कि डेवलपर्स को ओपन-सोर्स या स्वयं-होस्टेड मॉडलों की तुलना में मॉडल के आंतरिक हिस्सों, होस्टिंग और कस्टमाइज़ेशन पर कम नियंत्रण मिलता है।

सबसे उपयुक्त: जनरल-पर्पस AI ऐप्स, रीजनिंग, कोडिंग, मल्टीमॉडल वर्कफ़्लोज़ और प्रोडक्शन-रेडी AI प्रोडक्ट्स।

2. Anthropic

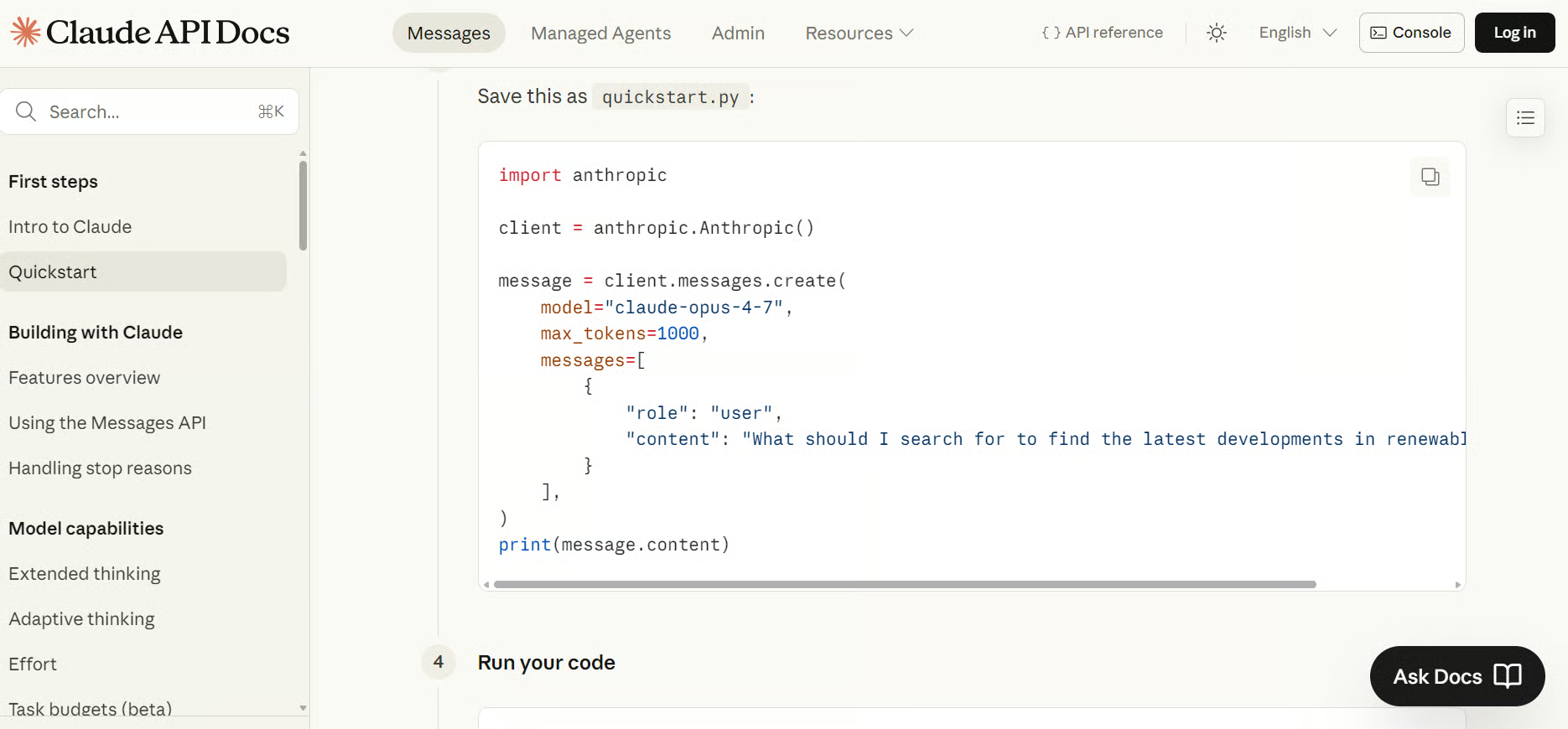

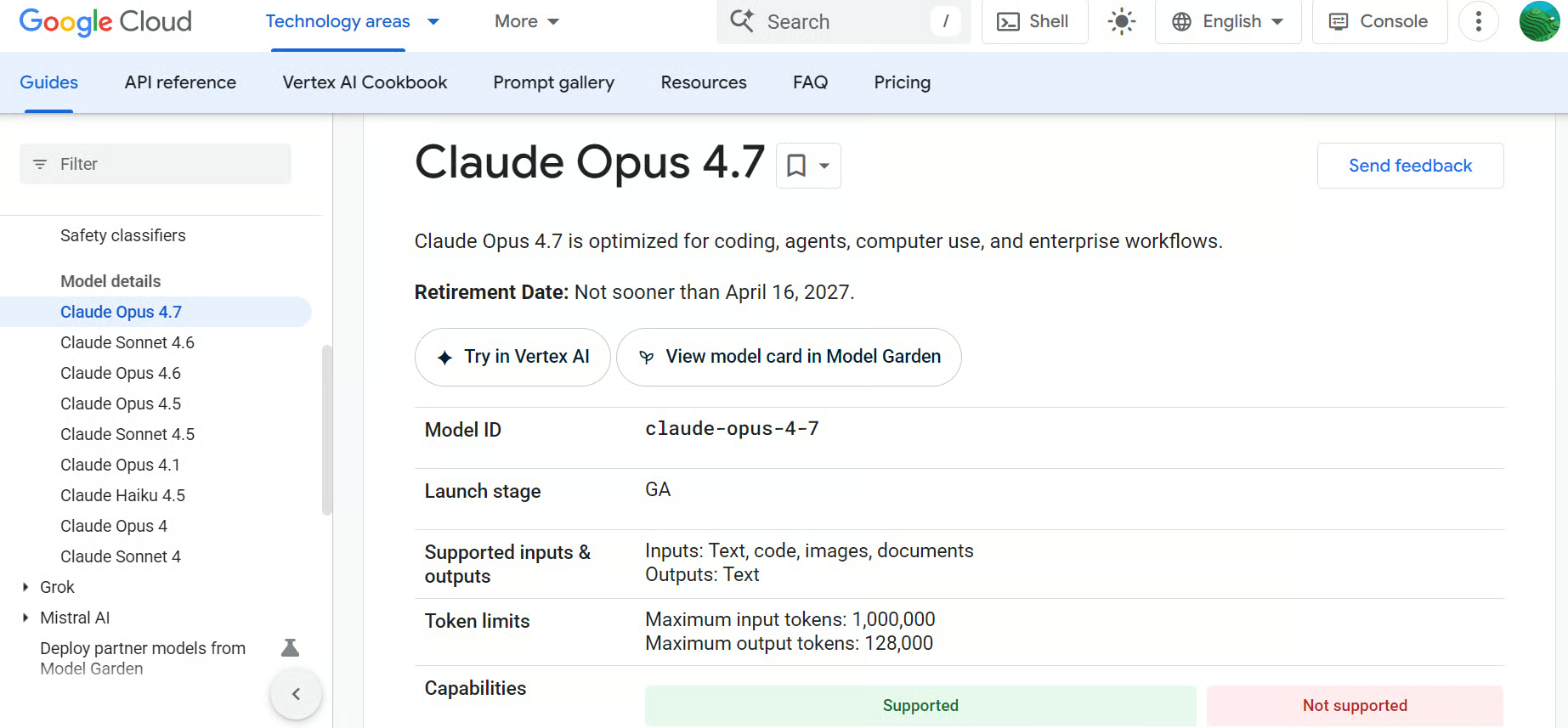

Anthropic अपने API के माध्यम से Claude मॉडल परिवार प्रदान करता है, जैसे इसका नवीनतम फ्लैगशिप मॉडल Claude Opus 4.7। Claude को भाषा, रीजनिंग, विश्लेषण, कोडिंग, लॉन्ग-कॉन्टेक्स्ट कार्य और एजेंटिक वर्कफ़्लोज़ के लिए डिज़ाइन किया गया है। Anthropic का डेवलपर प्लेटफ़ॉर्म टीमों को APIs, SDKs और डेवलपर डॉक्यूमेंटेशन के जरिए सीधे मॉडल एक्सेस देता है।

Claude खासकर उन अनुप्रयोगों के लिए उपयोगी है जहाँ सटीक निर्देश-पालन, मजबूत लेखन गुणवत्ता, दस्तावेज़ विश्लेषण और जटिल प्रॉम्प्ट्स की विश्वसनीय हैंडलिंग की आवश्यकता होती है।

स्रोत: Claude के साथ शुरुआत करें

एक प्रमुख कमी लागत है, खासकर जब Claude का उपयोग बड़े दस्तावेज़ों, लंबे संदर्भ वाले प्रॉम्प्ट्स या उच्च-वॉल्यूम एप्लिकेशनों के लिए किया जाता है। चूँकि Claude तक पहुँच एक होस्टेड API के माध्यम से होती है, टीमों के पास यह नियंत्रित करने की सीमित क्षमता होती है कि मॉडल कहाँ और कैसे चलता है।

गोपनीयता-संवेदनशील उपयोग मामलों के लिए, डेवलपर्स को API के माध्यम से गोपनीय व्यावसायिक या ग्राहक डेटा भेजने से पहले डेटा हैंडलिंग, रिटेंशन और अनुपालन आवश्यकताओं की सावधानीपूर्वक समीक्षा करनी चाहिए।

सबसे उपयुक्त: कोडिंग असिस्टेंट्स, एंटरप्राइज AI, लॉन्ग-कॉन्टेक्स्ट विश्लेषण, दस्तावेज़ वर्कफ़्लोज़ और AI एजेंट्स।

दो AI दिग्गजों की विस्तृत तुलना के लिए, हमारा गाइड देखें: Anthropic बनाम OpenAI।

3. Google Gemini

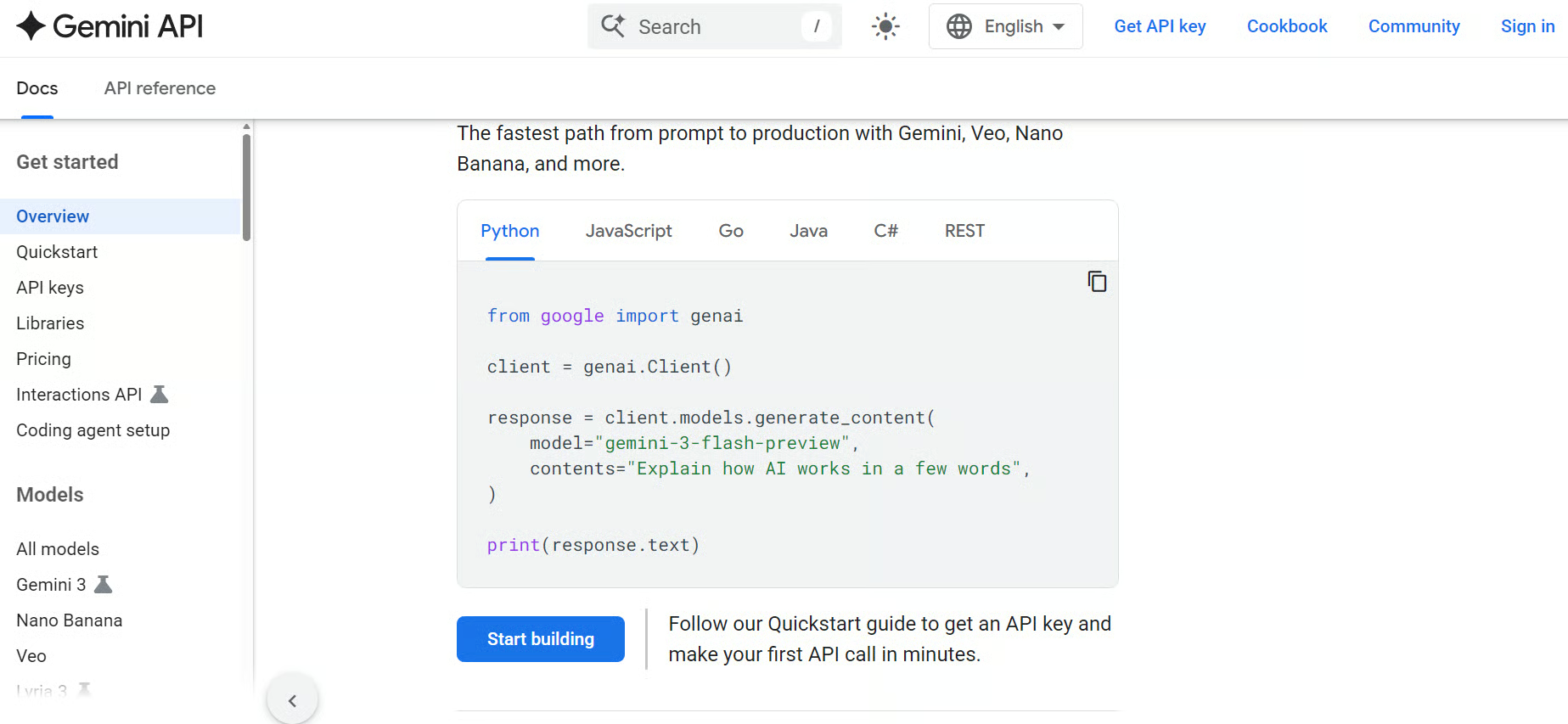

Google Gemini, Google का नेटिव LLM परिवार है, जिसमें Gemini 3.1 Pro शामिल है, जो डेवलपर्स के लिए Gemini API के माध्यम से उपलब्ध है। Gemini API स्टैंडर्ड, स्ट्रीमिंग और रियल-टाइम APIs को सपोर्ट करता है, साथ ही मॉडल विवरण, SDKs, प्राइसिंग, सेटअप और API रेफरेंस की डॉक्यूमेंटेशन भी देता है।

Nano Banana 2 (इमेज जनरेशन) और Veo 3.1 के इंटीग्रेशन के साथ, Gemini मल्टीमॉडल एप्लिकेशन बनाने वाले डेवलपर्स के लिए एक मजबूत विकल्प है। यह AI असिस्टेंट्स (खासकर सर्च अनुभव पर निर्भर), कोडिंग टूल्स, और Google के व्यापक AI इकोसिस्टम से जुड़े प्रोडक्ट्स के लिए भी अच्छा विकल्प है।

स्रोत: Gemini API

हालाँकि, Gemini Google के इकोसिस्टम से अधिक बंधा हुआ महसूस हो सकता है, जो उन टीमों के लिए उपयुक्त नहीं हो सकता जो प्रदाता-निरपेक्ष सेटअप चाहती हैं। टूल्स और क्षेत्रों के अनुसार प्राइसिंग, मॉडल उपलब्धता और फीचर सपोर्ट भी भिन्न हो सकते हैं।

गोपनीयता-संवेदनशील एप्लिकेशनों के लिए, टीमों को API के माध्यम से गोपनीय व्यावसायिक या ग्राहक डेटा भेजने से पहले डेटा हैंडलिंग, रिटेंशन और अनुपालन आवश्यकताओं की समीक्षा करनी चाहिए।

सबसे उपयुक्त: मल्टीमॉडल AI ऐप्स, Google इकोसिस्टम इंटीग्रेशन, लॉन्ग-कॉन्टेक्स्ट वर्कफ़्लोज़, कोडिंग और जनरल-पर्पस AI एप्लिकेशंस।

ओपन-सोर्स LLM API प्रदाता

ओपन-सोर्स LLM API प्रदाता डेवलपर्स को ओपन-सोर्स और ओपन-वेट मॉडलों तक होस्टेड API एक्सेस देते हैं। अपनी GPU पर मॉडल डाउनलोड और रन करने के बजाय, ये प्लेटफ़ॉर्म मॉडलों को होस्ट करते हैं और सरल APIs के माध्यम से उपलब्ध कराते हैं।

ये प्रदाता उन टीमों के लिए उपयोगी हैं जो कम लागत, अधिक मॉडल लचीलापन, तेज़ प्रयोग और लोकप्रिय ओपन मॉडलों—जैसे Llama, DeepSeek, Qwen, Mistral, Gemma और अन्य—तक पहुँच चाहते हैं।

4. Together AI

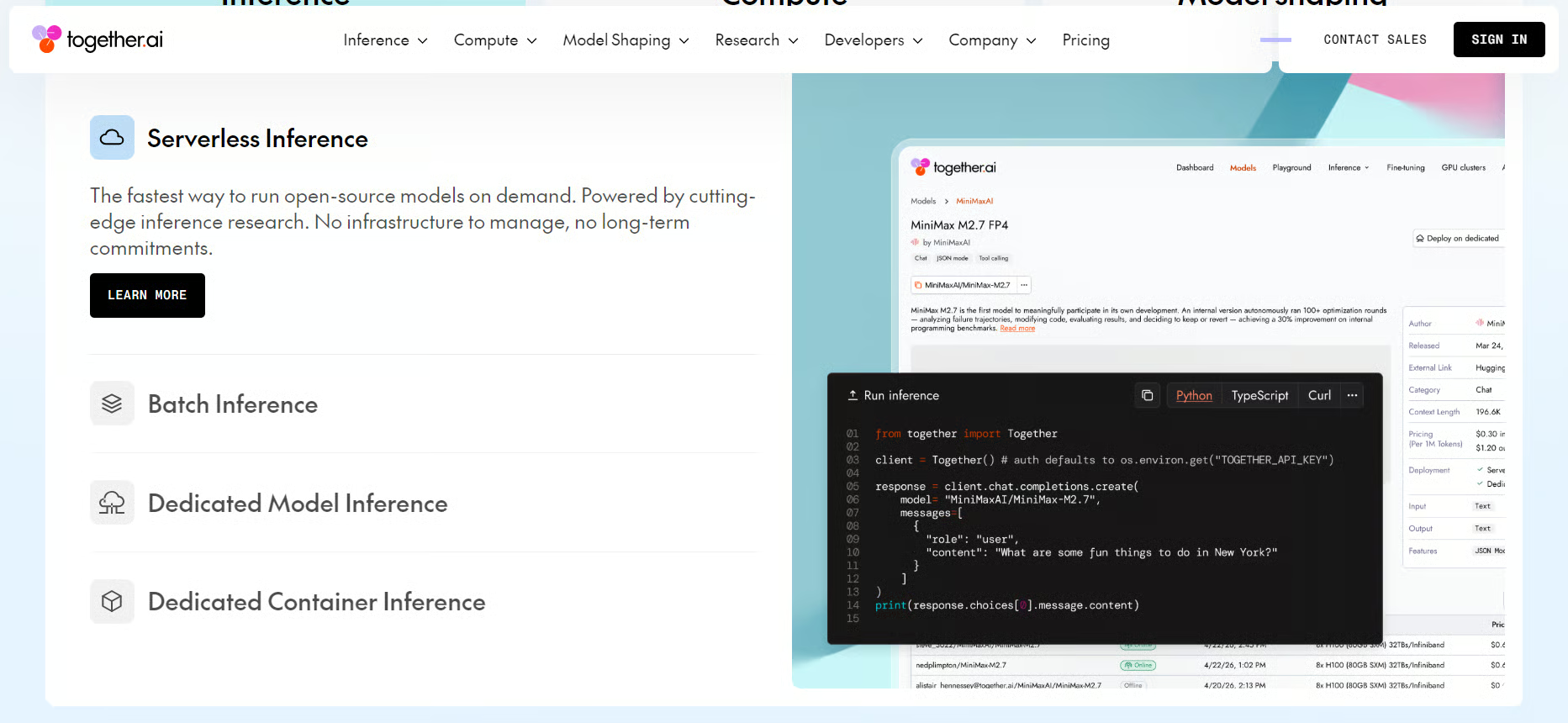

Together AI एकीकृत API के माध्यम से ओपन-सोर्स और विशिष्ट मॉडलों का होस्टेड एक्सेस प्रदान करता है। इसकी मॉडल कैटलॉग में टेक्स्ट, इमेज, वीडियो, कोड और ऑडियो में 200+ मॉडल शामिल हैं, और यह सर्वरलेस इन्फ़रेंस, बैच इन्फ़रेंस, डेडिकेटेड एंडपॉइंट्स, फाइन-ट्यूनिंग, इवैल्यूएशंस और GPU क्लस्टर्स को सपोर्ट करता है।

Together AI उन डेवलपर्स के लिए मजबूत विकल्प है जो बिना अपनी इंफ्रास्ट्रक्चर मैनेज किए ओपन मॉडलों के साथ बनाना चाहते हैं। यह विशेष रूप से उन टीमों के लिए उपयोगी है जो कई मॉडलों का परीक्षण कर रही हैं, कस्टम मॉडलों को फाइन-ट्यून कर रही हैं, या इन्फ़रेंस वर्कलोड्स को स्केल कर रही हैं।

स्रोत: Together AI

फिर भी, चुने गए मॉडल के आधार पर मॉडल क्वालिटी, गति और विश्वसनीयता बदल सकती है। प्रोडक्शन में उपयोग से पहले टीमों को अधिक परीक्षण, बेंचमार्किंग और मूल्यांकन की आवश्यकता हो सकती है।

संवेदनशील वर्कलोड्स के लिए, टीमों को यह जाँचना चाहिए कि उन्हें सर्वरलेस एक्सेस, डेडिकेटेड एंडपॉइंट्स या निजी डिप्लॉयमेंट विकल्पों की आवश्यकता है या नहीं, ताकि सुरक्षा और अनुपालन आवश्यकताओं को पूरा किया जा सके।

सबसे उपयुक्त: ओपन-सोर्स मॉडल इन्फ़रेंस, फाइन-ट्यूनिंग, स्केलेबल AI वर्कलोड्स और अनेक मॉडलों पर प्रयोग।

5. Fireworks AI

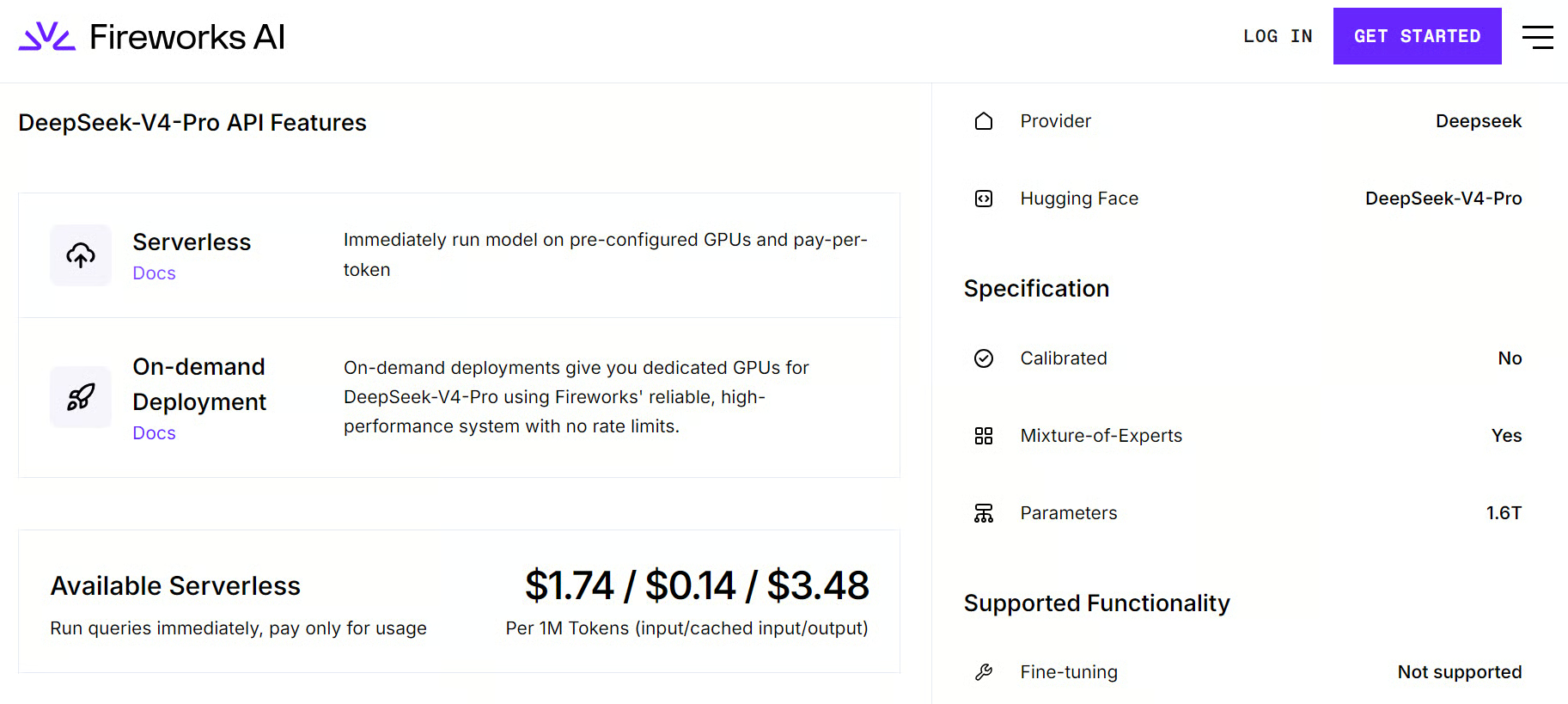

Fireworks AI ओपन-सोर्स LLMs और जेनरेटिव AI मॉडलों के लिए तेज़ इन्फ़रेंस पर केंद्रित है। इसका प्लेटफ़ॉर्म सर्वरलेस इन्फ़रेंस, ऑन-डिमांड डिप्लॉयमेंट्स, फाइन-ट्यूनिंग, और लोकप्रिय ओपन मॉडलों के लिए प्रोडक्शन-रेडी APIs को सपोर्ट करता है।

Fireworks AI उन टीमों के लिए मजबूत विकल्प है जो तेज़ इन्फ़रेंस और कम लेटेंसी के साथ ओपन-मॉडल लचीलापन चाहती हैं। यह वार्तालापात्मक AI, कोडिंग असिस्टेंट्स, सर्च, मल्टीमॉडल ऐप्स और एंटरप्राइज RAG सिस्टम्स के लिए विशेष रूप से उपयोगी है।

स्रोत: Fireworks AI

एक प्रमुख कमी यह है कि Fireworks AI इन्फ़रेंस और डिप्लॉयमेंट पर अधिक केंद्रित है, बजाए एक व्यापक, ऑल-इन-वन AI प्लेटफ़ॉर्म होने के। टीमों को अब भी ऑर्केस्ट्रेशन, इवैल्यूएशन, मॉनिटरिंग या जटिल एजेंट वर्कफ़्लोज़ के लिए अलग टूल्स की आवश्यकता हो सकती है।

टीमें यह भी विचार करें कि क्या सर्वरलेस इन्फ़रेंस संवेदनशील वर्कलोड्स के लिए पर्याप्त है, या बेहतर प्रदर्शन और अनुपालन नियंत्रण के लिए डेडिकेटेड डिप्लॉयमेंट्स चाहिए।

सबसे उपयुक्त: तेज़ ओपन-सोर्स मॉडल इन्फ़रेंस, फाइन-ट्यूनिंग, प्रोडक्शन AI ऐप्स और लो-लेटेंसी ओपन-मॉडल डिप्लॉयमेंट्स।

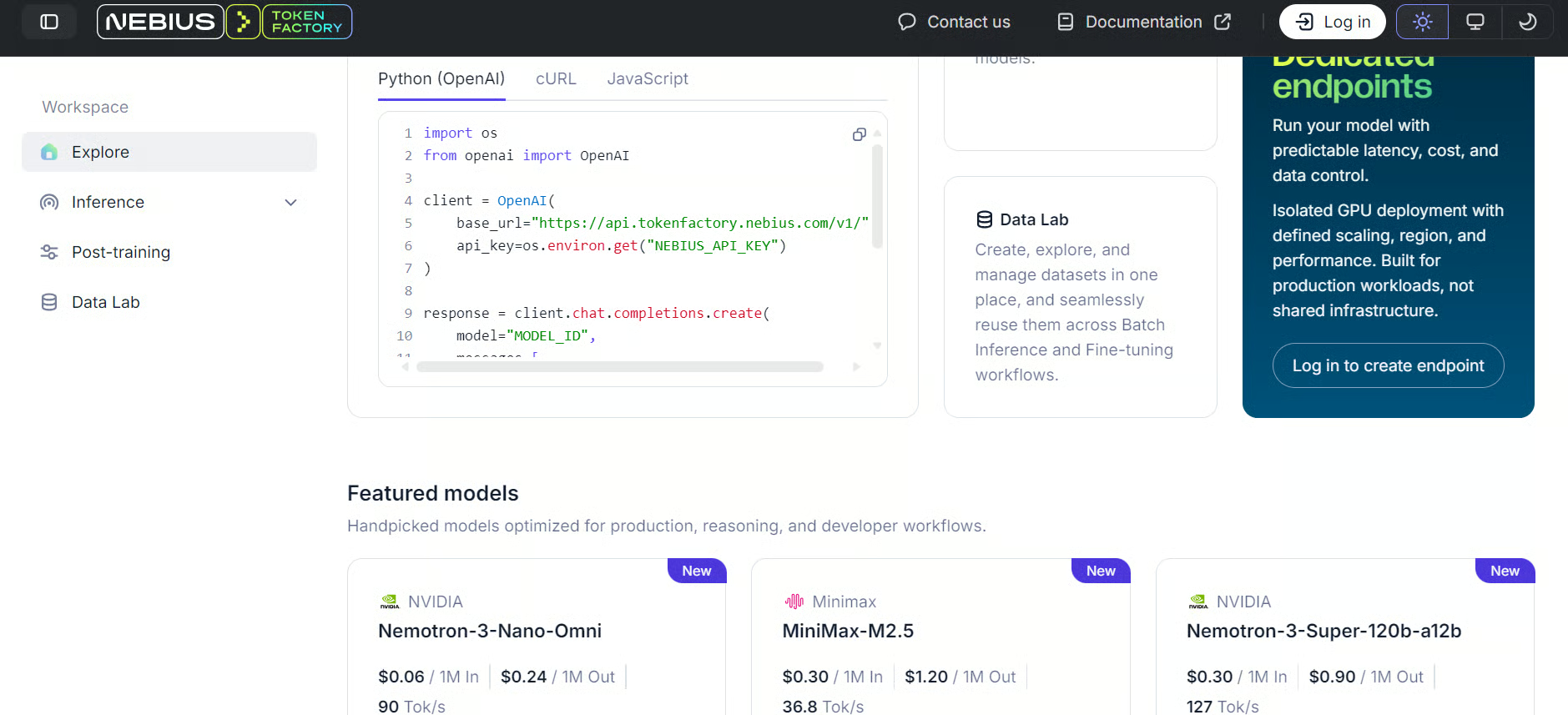

6. Nebius AI

Nebius AI GPU-समर्थित AI वर्कलोड्स, होस्टेड इन्फ़रेंस, मॉडल सर्विंग और स्केलेबल AI इंफ्रास्ट्रक्चर के लिए बनाया गया AI क्लाउड प्रदाता है। इसकी Token Factory इन्फ़रेंस सेवा OpenAI-कम्पैटिबल API के माध्यम से ओपन मॉडलों को सपोर्ट करती है, और सर्वरलेस इन्फ़रेंस, फाइन-ट्यूनिंग तथा डेडिकेटेड AI क्लाउड इंफ्रास्ट्रक्चर के विकल्प मुहैया कराती है।

Nebius AI उन टीमों के लिए मजबूत विकल्प है जो एक बेसिक API प्रदाता की तुलना में अधिक इंफ्रास्ट्रक्चर नियंत्रण चाहती हैं, जबकि अपनी पूरी GPU एनवायरनमेंट्स को मैनेज करने की जटिलता से बचना चाहती हैं। यह विशेष रूप से उन टीमों के लिए उपयोगी है जो ओपन और कस्टम मॉडलों के साथ बना रही हैं और जिन्हें स्केलेबल कंप्यूट, तेज़ इन्फ़रेंस और प्रोडक्शन-रेडी डिप्लॉयमेंट विकल्प चाहिए।

स्रोत: Nebius Token Factory

Nebius Token Factory दो इन्फ़रेंस गति विकल्प देता है: Fast और Base। Fast लो-लेटेंसी, इंटरैक्टिव वर्कलोड्स के लिए, जबकि Base अधिक किफायती, उच्च-वॉल्यूम इन्फ़रेंस या बैकग्राउंड प्रोसेसिंग के लिए डिज़ाइन किया गया है।

Nebius, प्लग-एंड-प्ले LLM API प्लेटफ़ॉर्म्स की तुलना में निश्चित रूप से अधिक इंफ्रास्ट्रक्चर-केंद्रित है। इसका मतलब है कि अधिकतम लाभ के लिए टीमों को क्लाउड, डिप्लॉयमेंट और वर्कलोड मैनेजमेंट का अधिक ज्ञान चाहिए हो सकता है।

संवेदनशील वर्कलोड्स के लिए, टीमों को यह विचार करना चाहिए कि मैनेज्ड इन्फ़रेंस पर्याप्त है या सुरक्षा, अनुपालन और डेटा गवर्नेंस पर अधिक नियंत्रण के लिए डेडिकेटेड इंफ्रास्ट्रक्चर चाहिए।

सबसे उपयुक्त: AI क्लाउड इंफ्रास्ट्रक्चर, होस्टेड इन्फ़रेंस, GPU-समर्थित वर्कलोड्स, तेज़ इन्फ़रेंस और वे टीमें जो डिप्लॉयमेंट पर अधिक नियंत्रण चाहती हैं।

LLM रूटिंग प्रदाता

LLM रूटिंग प्रदाता एक API के माध्यम से कई मॉडलों और प्रदाताओं तक पहुँच देते हैं। OpenAI, Anthropic, Google, Mistral, DeepSeek और अन्य प्रदाताओं से अलग-अलग इंटीग्रेशन करने के बजाय, डेवलपर्स एक रूटिंग लेयर का उपयोग कर एक ही जगह से मॉडल एक्सेस प्रबंधित कर सकते हैं।

ये प्लेटफ़ॉर्म मॉडल तुलना, फॉलबैक रूटिंग, लागत अनुकूलन, प्रदाता रेडंडेंसी, ऑब्ज़र्वेबिलिटी और बिना एप्लिकेशन को फिर से लिखे मॉडलों के बीच स्विच करने के लिए उपयोगी हैं।

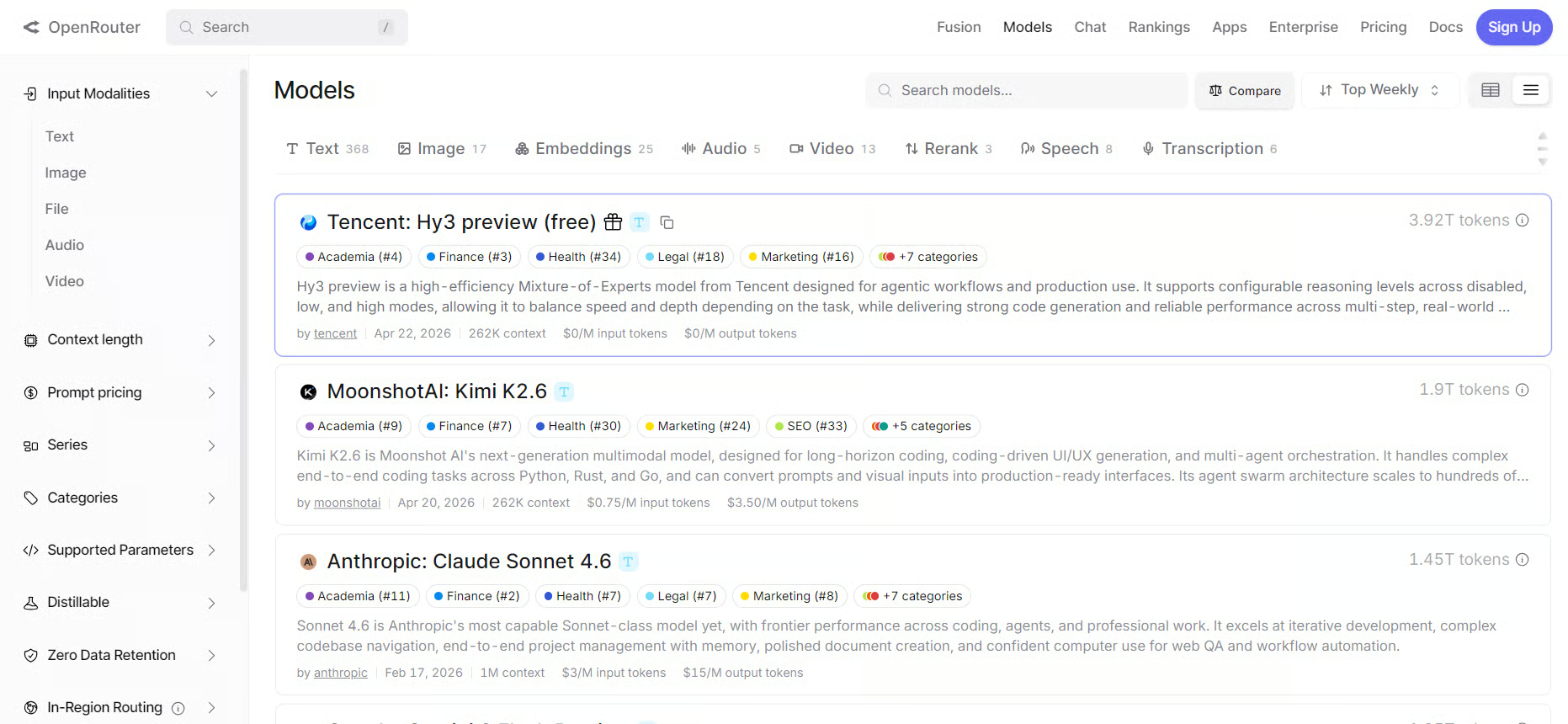

7. OpenRouter

OpenRouter सबसे लोकप्रिय LLM रूटिंग प्रदाताओं में से एक है। यह डेवलपर्स को एक ही OpenAI-कम्पैटिबल API के माध्यम से कई मॉडलों तक पहुँच देता है, जिससे एक ही इंटीग्रेशन का उपयोग करते हुए अलग-अलग प्रदाताओं के साथ काम करना आसान हो जाता है।

जैसा कि हमने कई ट्यूटोरियल्स में कवर किया है, OpenRouter उन डेवलपर्स के लिए एक मजबूत विकल्प है जो मॉडलों की तुलना करना चाहते हैं, नए रिलीज़ को जल्दी टेस्ट करना चाहते हैं, अनुरोधों को प्रदाताओं में रूट करना चाहते हैं, या एक ही मॉडल वेंडर पर निर्भरता से बचना चाहते हैं।

स्रोत: OpenRouter

एक कमी यह है कि OpenRouter आपके एप्लिकेशन और मॉडल प्रदाता के बीच एक और लेयर जोड़ता है। इससे अतिरिक्त निर्भरता, परिवर्तनीय लेटेंसी और प्रदाता-विशिष्ट व्यवहार आ सकता है, जिसका फिर भी परीक्षण आवश्यक है।

प्रोडक्शन वर्कलोड्स के लिए, प्लेटफ़ॉर्म के माध्यम से संवेदनशील या व्यावसायिक रूप से महत्वपूर्ण ट्रैफ़िक भेजने से पहले टीमों को रूटिंग सेटिंग्स, फॉलबैक व्यवहार, प्रदाता वरीयताएँ और गोपनीयता नियंत्रणों की समीक्षा करनी चाहिए।

सबसे उपयुक्त: मल्टी-मॉडल ऐप्स, मॉडल तुलना, फॉलबैक रूटिंग, प्रदाता लचीलापन और तेज़ प्रयोग।

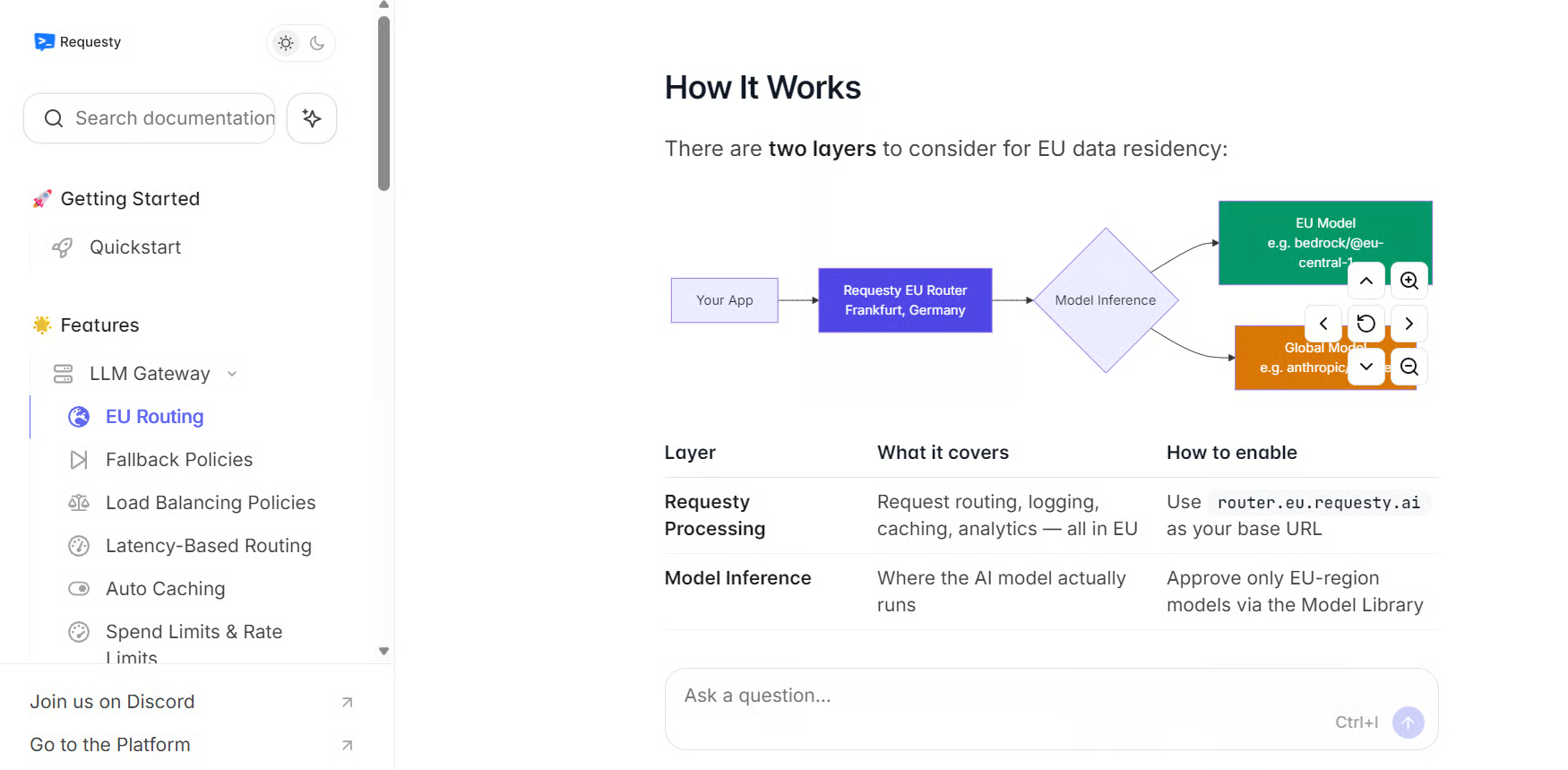

8. Requesty.ai

Requesty.ai एक LLM रूटिंग और गेटवे प्लेटफ़ॉर्म है जो टीमों को एक OpenAI-कम्पैटिबल API के माध्यम से कई LLM प्रदाताओं से कनेक्ट करने में मदद करता है। यह 400+ मॉडलों को सपोर्ट करता है और रूटिंग, फॉलबैक, कैशिंग, लागत प्रबंधन, ऑब्ज़र्वेबिलिटी और गवर्नेंस जैसी सुविधाएँ देता है।

Requesty.ai उन टीमों के लिए मजबूत विकल्प है जो एक से अधिक मॉडल प्रदाताओं पर निर्भर प्रोडक्शन AI एप्लिकेशंस बना रही हैं। यह विशेष रूप से रूटिंग नीतियों का प्रबंधन, उपयोग पर नज़र रखना, खर्च नियंत्रित करना और विश्वसनीयता बढ़ाने (जब प्रदाता विफल हों, टाइम-आउट हों या रेट लिमिट लगे) में उपयोगी है।

स्रोत: Requesty AI Documentation

OpenRouter की तरह, मुख्य कमी यह है कि Requesty.ai एप्लिकेशन स्टैक में एक और गेटवे लेयर जोड़ता है। टीमों को रूटिंग, फॉलबैक, लॉगिंग और गवर्नेंस को सावधानी से कॉन्फ़िगर करना चाहिए ताकि अप्रत्याशित लागत, लेटेंसी या प्रदाता व्यवहार से बचा जा सके।

संवेदनशील वर्कलोड्स के लिए, Requesty.ai में PII डिटेक्शन, स्क्रबिंग, कंटेंट गार्डरेल्स, ऑडिट लॉग्स और गवर्नेंस जैसी कंट्रोल्स शामिल हैं, लेकिन फिर भी टीमों को तय करना चाहिए कि गेटवे से कौन-सा डेटा गुजरे और लॉग्स कैसे मैनेज हों।

सबसे उपयुक्त: LLM रूटिंग, लागत नियंत्रण, ऑब्ज़र्वेबिलिटी, प्रदाता फॉलबैक, गवर्नेंस और प्रोडक्शन AI गेटवे वर्कफ़्लोज़।

क्लाउड LLM प्रदाता

क्लाउड LLM प्रदाता बड़े क्लाउड प्लेटफ़ॉर्म होते हैं जो डेवलपर्स और एंटरप्राइजेज को फ़ाउंडेशन मॉडलों तक मैनेज्ड एक्सेस देते हैं। ये प्लेटफ़ॉर्म अक्सर अपने खुद के मॉडलों के साथ-साथ थर्ड-पार्टी प्रदाताओं के मॉडलों को भी सपोर्ट करते हैं।

ये खासकर उन एंटरप्राइजेज के लिए उपयोगी हैं जो पहले से क्लाउड इंफ्रास्ट्रक्चर का उपयोग करते हैं और जिन्हें सुरक्षा, गवर्नेंस, अनुपालन, डेटा इंटीग्रेशन, डिप्लॉयमेंट कंट्रोल्स और मॉडल मैनेजमेंट एक ही जगह पर चाहिए।

9. Google Vertex AI

Google Vertex AI Google Cloud का मशीन लर्निंग और जेनरेटिव AI प्लेटफ़ॉर्म है। यह डेवलपर्स और एंटरप्राइजेज को Gemini मॉडलों, Model Garden, एजेंट टूल्स और AI एप्लिकेशंस बनाने, डिप्लॉय और मैनेज करने के लिए मैनेज्ड इंफ्रास्ट्रक्चर तक पहुँच देता है।

Vertex AI, Model Garden के माध्यम से प्रमुख पार्टनर्स और ओपन मॉडलों को भी सपोर्ट करता है, जिनमें Anthropic Claude, xAI Grok, Mistral AI मॉडल्स, और GLM 5 तथा Gemma 4 जैसे ओपन-सोर्स मॉडल शामिल हैं, साथ ही Google के अपने Gemini मॉडल भी।

स्रोत: Generative AI on Vertex AI

Google Vertex AI उन टीमों के लिए मजबूत विकल्प है जो पहले से Google Cloud का उपयोग करती हैं और क्लाउड-नेटिव मॉडल डिप्लॉयमेंट, गवर्नेंस, सुरक्षा नियंत्रण और Google के व्यापक डेटा व AI इकोसिस्टम के साथ इंटीग्रेशन चाहती हैं।

दूसरी ओर, Vertex AI का उपयोग एक साधारण मॉडल API की तुलना में अधिक जटिल हो सकता है। प्रोजेक्ट्स, परमिशन्स, बिलिंग, डिप्लॉयमेंट सेटिंग्स और इंटीग्रेशन्स को ठीक से मैनेज करने के लिए टीमों को Google Cloud का अनुभव चाहिए हो सकता है।

संवेदनशील वर्कलोड्स के लिए, Vertex AI उन टीमों के लिए उपयोगी है जिन्हें क्लाउड-स्तरीय एक्सेस कंट्रोल्स, गवर्नेंस और मैनेज्ड इंफ्रास्ट्रक्चर चाहिए, लेकिन लॉगिंग, डेटा एक्सेस और डिप्लॉयमेंट रीजन से संबंधित सेटअप निर्णयों की फिर भी सावधानीपूर्वक समीक्षा जरूरी है।

सबसे उपयुक्त: Google Cloud उपयोगकर्ता, Gemini एक्सेस, एंटरप्राइज AI ऐप्स, मल्टीमॉडल वर्कफ़्लोज़ और क्लाउड-नेटिव मॉडल डिप्लॉयमेंट।

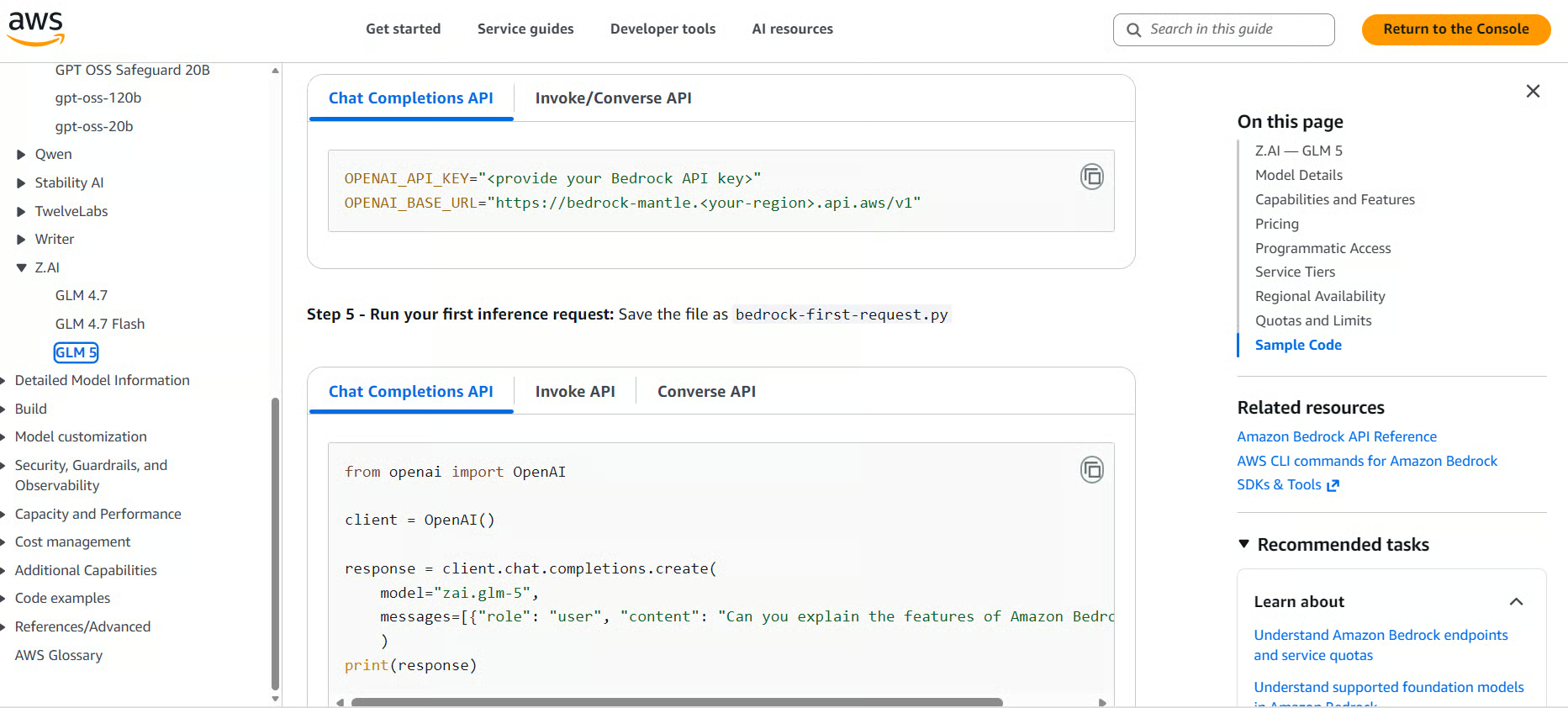

10. Amazon Bedrock

Amazon Bedrock AWS का मैनेज्ड जेनरेटिव AI प्लेटफ़ॉर्म है। यह डेवलपर्स को Amazon और थर्ड-पार्टी प्रदाताओं के फ़ाउंडेशन मॉडलों तक एक मैनेज्ड AWS सेवा के माध्यम से पहुँच देता है।

Bedrock, Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek और अन्य प्रदाताओं के मॉडलों को सपोर्ट करता है, जिससे यह AWS इकोसिस्टम के अंदर मॉडल विकल्प चाहने वाली टीमों के लिए उपयोगी बनता है।

Amazon Bedrock, AWS पर पहले से निर्माण कर रही कंपनियों के लिए मजबूत विकल्प है क्योंकि यह मॉडल एक्सेस, क्लाउड इंफ्रास्ट्रक्चर, सुरक्षा नियंत्रण और एंटरप्राइज इंटीग्रेशन को एक ही प्लेटफ़ॉर्म में लाता है।

स्रोत: Amazon Bedrock

एक प्रमुख कमी यह है कि Bedrock एक साधारण LLM API की तुलना में अधिक जटिल हो सकता है। परमिशन्स, रीजन, मॉडल एक्सेस, प्राइसिंग, नेटवर्किंग और डिप्लॉयमेंट सेटिंग्स को ठीक से मैनेज करने के लिए टीमों को AWS अनुभव चाहिए हो सकता है।

संवेदनशील वर्कलोड्स के लिए Bedrock उपयोगी है क्योंकि प्रॉम्प्ट्स और आउटपुट्स का उपयोग बेस मॉडलों को ट्रेन करने के लिए नहीं किया जाता या मॉडल प्रदाताओं के साथ साझा नहीं किया जाता, और टीमें एन्क्रिप्शन, IAM और PrivateLink जैसे AWS नियंत्रणों का उपयोग कर सकती हैं।

सबसे उपयुक्त: AWS उपयोगकर्ता, एंटरप्राइज AI, मैनेज्ड फ़ाउंडेशन मॉडल एक्सेस, सुरक्षा-केंद्रित डिप्लॉयमेंट्स और क्लाउड-नेटिव जेनरेटिव AI एप्लिकेशंस।

LLM API प्रदाताओं की तुलना तालिका

नीचे दी गई तालिका में उनके प्रमुख लाभों और मुख्य कमियों के आधार पर शीर्ष LLM API प्रदाताओं की तुलना की गई है।

|

प्रदाता |

मुख्य लाभ |

मुख्य कमियाँ |

|

OpenAI |

मजबूत मॉडल क्वालिटी, परिपक्व APIs, मल्टीमॉडल टूल्स, स्ट्रक्चर्ड आउटपुट्स, एम्बेडिंग्स, स्पीच, इमेज जनरेशन और एजेंटिक वर्कफ़्लोज़ |

बड़े पैमाने पर महंगा हो सकता है और ओपन-सोर्स या स्वयं-होस्टेड मॉडलों की तुलना में कम नियंत्रण देता है |

|

Anthropic |

मजबूत लेखन गुणवत्ता, सावधानीपूर्वक निर्देश-पालन, रीजनिंग, कोडिंग और लॉन्ग-कॉन्टेक्स्ट सपोर्ट |

बड़े दस्तावेज़ों या उच्च-वॉल्यूम उपयोग के साथ लागत बढ़ सकती है, और टीमों के पास होस्टिंग और मॉडल के आंतरिक हिस्सों पर सीमित नियंत्रण होता है |

|

Google Gemini |

मजबूत मल्टीमॉडल क्षमताएँ, रियल-टाइम APIs, लॉन्ग-कॉन्टेक्स्ट सपोर्ट और Google के AI इकोसिस्टम के साथ करीबी इंटीग्रेशन |

Google के इकोसिस्टम से बँधा हुआ महसूस हो सकता है, और प्राइसिंग, उपलब्धता व फीचर्स टूल या रीजन के अनुसार बदल सकते हैं |

|

Together AI |

कई ओपन और विशिष्ट मॉडलों तक होस्टेड एक्सेस, सर्वरलेस इन्फ़रेंस, डेडिकेटेड एंडपॉइंट्स, फाइन-ट्यूनिंग, इवैल्यूएशंस और GPU इंफ्रास्ट्रक्चर |

चुने गए मॉडल के अनुसार मॉडल क्वालिटी, गति और विश्वसनीयता बदल सकती है |

|

Fireworks AI |

तेज़ इन्फ़रेंस, कम लेटेंसी, सर्वरलेस एक्सेस, ऑन-डिमांड डिप्लॉयमेंट्स और ओपन मॉडलों के लिए प्रोडक्शन-रेडी APIs |

एक पूर्ण ऑल-इन-वन AI डेवलपमेंट प्लेटफ़ॉर्म होने की बजाय इन्फ़रेंस और डिप्लॉयमेंट पर अधिक केंद्रित |

|

Nebius AI |

GPU-समर्थित इंफ्रास्ट्रक्चर, होस्टेड इन्फ़रेंस, OpenAI-कम्पैटिबल API, और Fast व Base जैसी स्पीड टियर्स |

अधिक इंफ्रास्ट्रक्चर-केंद्रित, इसलिए टीमों को मज़बूत क्लाउड और डिप्लॉयमेंट ज्ञान की आवश्यकता हो सकती है |

|

OpenRouter |

एक OpenAI-कम्पैटिबल API के माध्यम से कई मॉडलों तक पहुँच, आसान प्रदाता-स्विचिंग और फॉलबैक विकल्प |

ऐप और प्रदाता के बीच एक और लेयर जोड़ता है, जो लेटेंसी, विश्वसनीयता या डीबगिंग को प्रभावित कर सकता है |

|

Requesty.ai |

कई प्रदाताओं के लिए एक API, रूटिंग, फॉलबैक, कैशिंग, लागत ट्रैकिंग, ऑब्ज़र्वेबिलिटी और गवर्नेंस फीचर्स के साथ |

अप्रत्याशित व्यवहार से बचने के लिए रूटिंग, लॉगिंग, फॉलबैक और लागत नियंत्रणों की सावधानीपूर्वक सेटअप की आवश्यकता |

|

Google Vertex AI |

Model Garden के माध्यम से Gemini, Anthropic Claude, xAI Grok, Mistral AI और ओपन मॉडलों तक मैनेज्ड एक्सेस, साथ ही Google Cloud की सुरक्षा और गवर्नेंस टूल्स |

एक साधारण API से अधिक जटिल और Google Cloud अनुभव की आवश्यकता हो सकती है |

|

Amazon Bedrock |

AWS के भीतर Amazon और Anthropic, Meta, Mistral AI, Cohere आदि जैसे थर्ड-पार्टी प्रदाताओं के मॉडलों तक मैनेज्ड एक्सेस |

बेसिक LLM API से अधिक जटिल, खासकर परमिशन्स, रीजन, प्राइसिंग और मॉडल एक्सेस के आसपास |

अपने उपयोग मामले के लिए सर्वश्रेष्ठ LLM API प्रदाता चुनना

सही LLM API प्रदाता तीन कारकों पर निर्भर करता है:

- आप क्या बना रहे हैं

- आपको कितने नियंत्रण की आवश्यकता है

- आप कितना खर्च करने को तैयार हैं

स्टार्टअप्स और छोटी टीमों के लिए, ओपन-सोर्स LLM API प्रदाता अक्सर शुरुआत करने के लिए सबसे अच्छा स्थान होते हैं। Together AI, Fireworks AI और Nebius AI जैसे प्लेटफ़ॉर्म आपको शक्तिशाली ओपन मॉडलों तक पहुँच देते हैं, बिना GPUs या इंफ्रास्ट्रक्चर को स्वयं मैनेज किए। वे प्रयोग और प्रारंभिक चरण के प्रोडक्ट डेवलपमेंट के लिए तेज़, सस्ते और अधिक लचीले हो सकते हैं।

यदि आप अलग-अलग मॉडलों को जल्दी टेस्ट करना चाहते हैं, तो LLM रूटिंग प्रदाता मजबूत विकल्प हैं। OpenRouter और Requesty.ai जैसे टूल्स आपको एक API के माध्यम से क्लोज़्ड-सोर्स और ओपन-सोर्स मॉडलों की तुलना करने, फॉलबैक मैनेज करने और अपने एप्लिकेशन को फिर से लिखे बिना प्रदाताओं को स्विच करने देते हैं।

जहाँ वर्कफ़्लोज़ में मॉडल क्वालिटी लागत से अधिक महत्वपूर्ण हो, वहाँ OpenAI और Anthropic जैसे नेटिव प्रदाता अब भी सबसे मजबूत विकल्पों में हैं। वे विशेष रूप से प्रोडक्शन AI असिस्टेंट्स, कोडिंग टूल्स, रीजनिंग-हेवी वर्कफ़्लोज़, मल्टीमॉडल ऐप्स और एजेंटिक सिस्टम्स के लिए उपयोगी हैं, जहाँ विश्वसनीयता और मॉडल प्रदर्शन सबसे अधिक मायने रखते हैं।

अंत में, यदि आपकी कंपनी पहले से AWS या Google Cloud पर चलती है, तो अक्सर उसी क्लाउड इकोसिस्टम में रहना समझदारी है। Amazon Bedrock और Google Vertex AI आपको मैनेज्ड मॉडल एक्सेस, सुरक्षा नियंत्रण, गवर्नेंस और उन टूल्स के साथ इंटीग्रेशन देते हैं जिनका आपकी टीम पहले से उपयोग करती है।

अंतिम विचार

तकनीकी कार्यों, कोडिंग असिस्टेंट्स और वाइब कोडिंग टूल्स के लिए, मैं शुरुआत में ज़्यादा प्रयोग करने की सलाह नहीं दूँगा। मेरे अनुभव में, OpenAI और Anthropic आमतौर पर सबसे सुरक्षित विकल्प होते हैं, उनकी मजबूत कोडिंग, रीजनिंग और डेवलपर टूलिंग के कारण।

ओपन-सोर्स LLM API प्रदाता और LLM रूटिंग प्रदाता अधिक उन्नत प्रयोग के लिए मजबूत विकल्प हैं।

बड़े क्लाउड LLM प्रदाता आमतौर पर केवल कॉरपोरेट वातावरण में ही समझ में आते हैं। ऐसे में, उसी को चुनें जिसका इकोसिस्टम आप पहले से उपयोग कर रहे हैं।

LLM API प्रदाता FAQs

LLM API प्रदाता क्या है?

एक ऐसी कंपनी या प्लेटफ़ॉर्म जो बड़े भाषा मॉडलों की होस्टिंग करता है और उन्हें API के माध्यम से उपलब्ध कराता है, ताकि डेवलपर्स बिना किसी GPU या इन्फ़रेंस इंफ्रास्ट्रक्चर को स्वयं मैनेज किए, अनुरोध भेज सकें और AI-जनित प्रतिक्रियाएँ प्राप्त कर सकें।

नेटिव LLM प्रदाता और क्लाउड LLM प्रदाता में क्या अंतर है?

नेटिव प्रदाता (जैसे OpenAI और Anthropic) अपने मॉडलों का निर्माण और सर्व सीधे करते हैं। क्लाउड प्रदाता (जैसे AWS Bedrock और Google Vertex AI) मौजूदा क्लाउड इकोसिस्टम में एंटरप्राइज सुरक्षा और गवर्नेंस टूल्स के साथ, कई थर्ड-पार्टी मॉडलों तक मैनेज्ड एक्सेस प्रदान करते हैं।

मुझे OpenRouter या Requesty.ai जैसे LLM रूटिंग प्रदाता का उपयोग कब करना चाहिए?

जब आपको एक से अधिक मॉडल या प्रदाता के साथ काम करना हो, प्रदाता डाउन होने पर स्वत: फॉलबैक चाहिए, या एक ही API इंटीग्रेशन के माध्यम से मॉडलों की तुलना करके लागत नियंत्रित करनी हो।

क्या ओपन-सोर्स LLM API प्रदाता, OpenAI जैसे नेटिव प्रदाताओं से कम सक्षम होते हैं?

ज़रूरी नहीं; यह कार्य पर निर्भर करता है। Together AI और Fireworks AI जैसे प्लेटफ़ॉर्म Llama, DeepSeek और Mistral जैसे अत्याधुनिक ओपन मॉडलों की होस्टिंग करते हैं, जो अक्सर काफी कम लागत पर क्लोज़्ड मॉडलों के बराबर प्रतिस्पर्धी हो सकते हैं।

कड़े अनुपालन आवश्यकताओं वाले एंटरप्राइजेज के लिए कौन-सा LLM API प्रदाता सबसे अच्छा है?

Amazon Bedrock और Google Vertex AI आमतौर पर सबसे मजबूत विकल्प होते हैं, क्योंकि वे क्लाउड-नेटिव सुरक्षा नियंत्रण, IAM, एन्क्रिप्शन, ऑडिट लॉगिंग और मौजूदा एंटरप्राइज इंफ्रास्ट्रक्चर के साथ इंटीग्रेटेड गवर्नेंस फीचर्स प्रदान करते हैं।