Programa

Provedores de API de Large Language Model (LLM) dão aos desenvolvedores acesso a modelos poderosos de IA sem precisar gerenciar GPUs, deployment de modelos, escalabilidade ou infraestrutura de inferência. Em vez de hospedar um modelo por conta própria, o desenvolvedor se conecta a uma API, escolhe um modelo, envia uma requisição e recebe a resposta.

Neste artigo, vamos analisar os 10 principais provedores de API de LLM com base em qualidade do modelo, experiência do desenvolvedor, preço, escalabilidade, suporte do ecossistema e preparo para produção. Para cada provedor, veremos para que ele é mais indicado, seus principais diferenciais e os pontos de atenção que os desenvolvedores devem considerar.

Este guia divide os principais provedores de API de LLM em quatro categorias:

- Provedores nativos de LLM

- Provedores de API de LLM open source

- Provedores de roteamento de LLM

- Provedores de LLM na nuvem

Engenheiro associado de IA para cientistas de dados

Provedores nativos de LLM

Provedores nativos de LLM constroem, treinam e disponibilizam suas próprias famílias de modelos via API. Geralmente são a melhor opção para desenvolvedores que buscam alta qualidade de modelo, documentação consistente, raciocínio avançado, suporte multimodal e ferramentas prontas para produção.

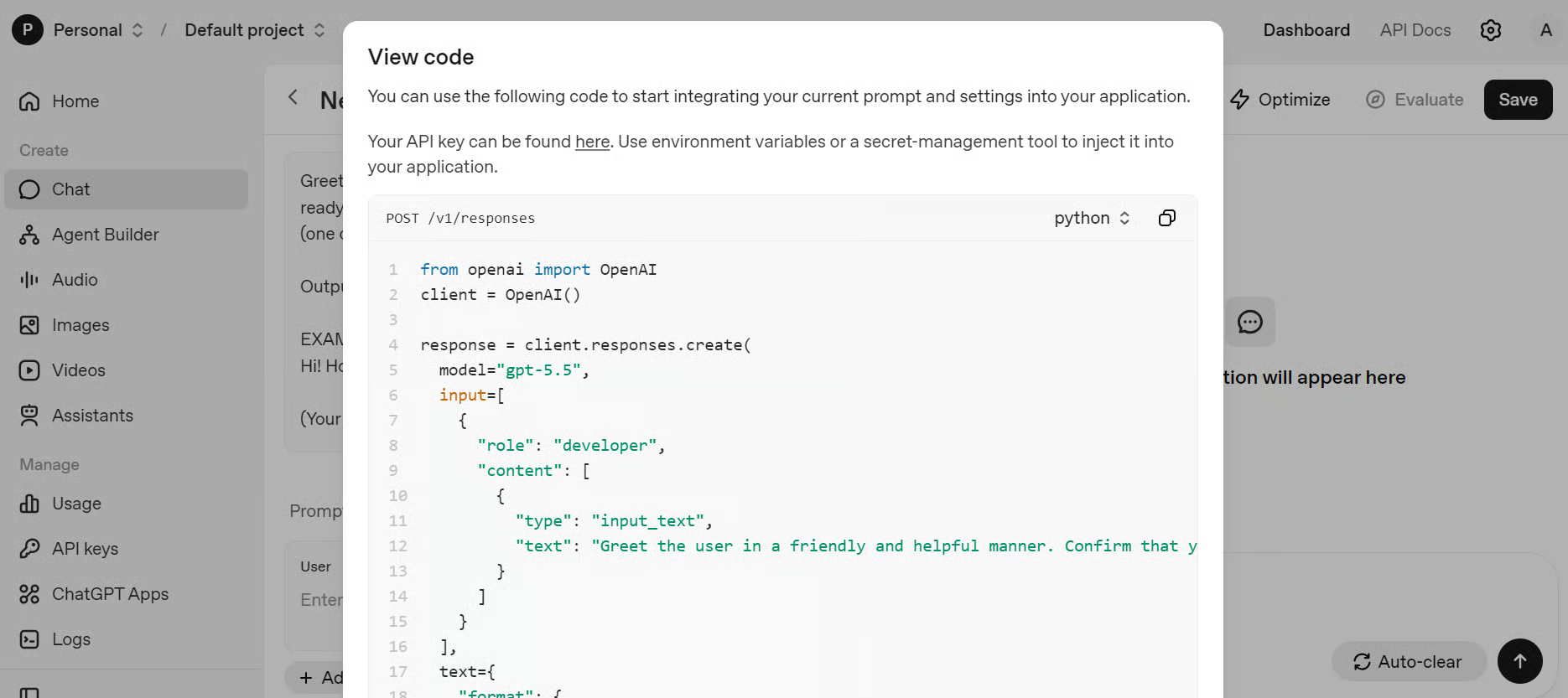

1. OpenAI

OpenAI é um dos provedores de API de LLM mais amplamente usados. Sua API Platform oferece acesso a:

- Modelos de raciocínio de ponta como o GPT-5.5

- Geração e tradução de voz em tempo real via GPT-Realtime-2

- Geração de imagens por meio do modelo GPT-Images-2.0

- Desenvolvimento baseado em agentes com o OpenAI Agents SDK

Sua API suporta streaming, interfaces em tempo real e saídas estruturadas.

A OpenAI é uma ótima escolha para times que constroem assistentes de IA, ferramentas de código, agentes de suporte ao cliente, copilotos internos, apps multimodais e sistemas baseados em agentes.

Fonte: OpenAI

Um ponto de atenção é que a OpenAI pode ficar cara em grande escala, especialmente para aplicações de alto volume ou com raciocínio intenso. Também é um provedor de API fechado, o que significa menos controle sobre internos do modelo, hospedagem e customização em comparação com modelos open source ou autogerenciados.

Melhor para: apps de IA de uso geral, raciocínio, coding, fluxos multimodais e produtos de IA prontos para produção.

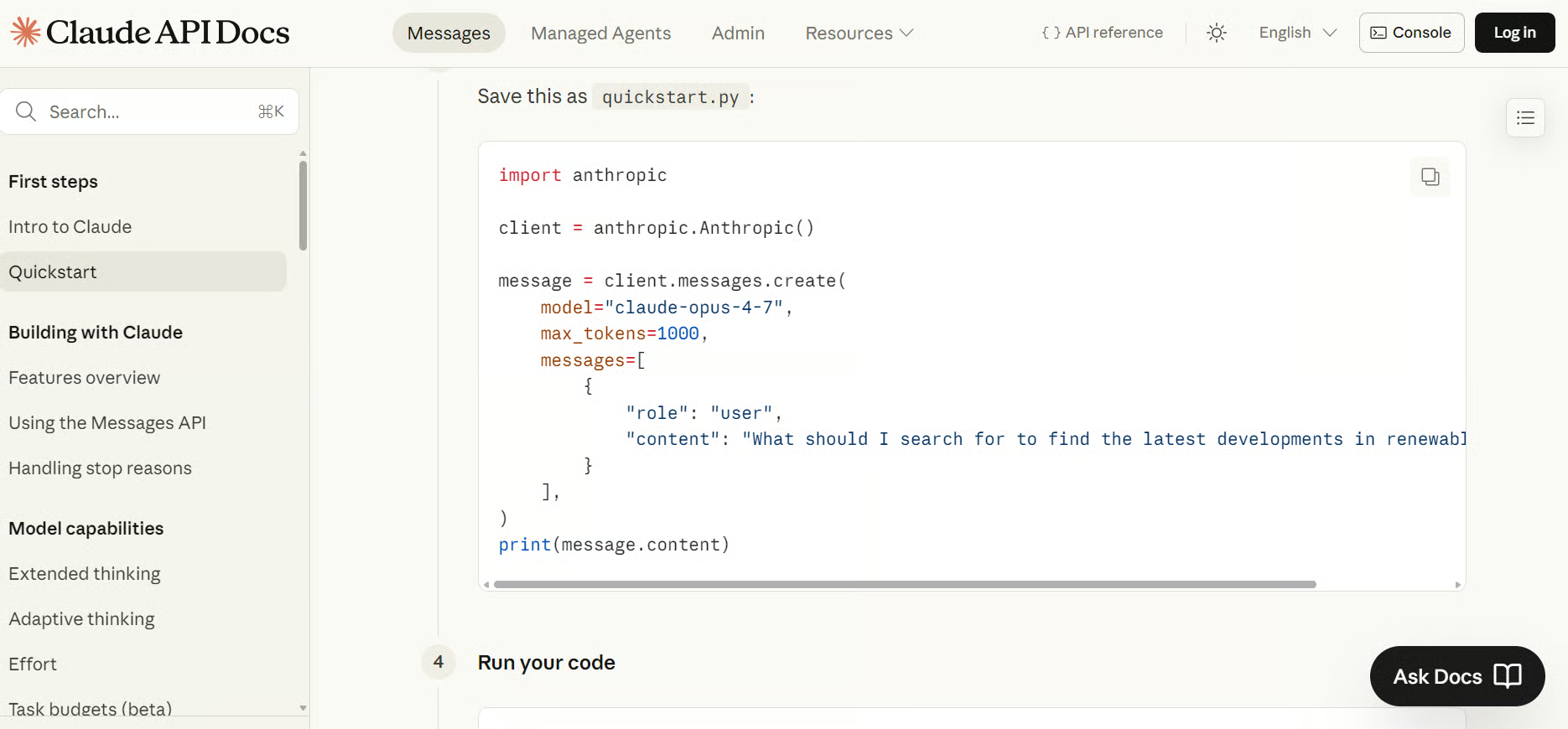

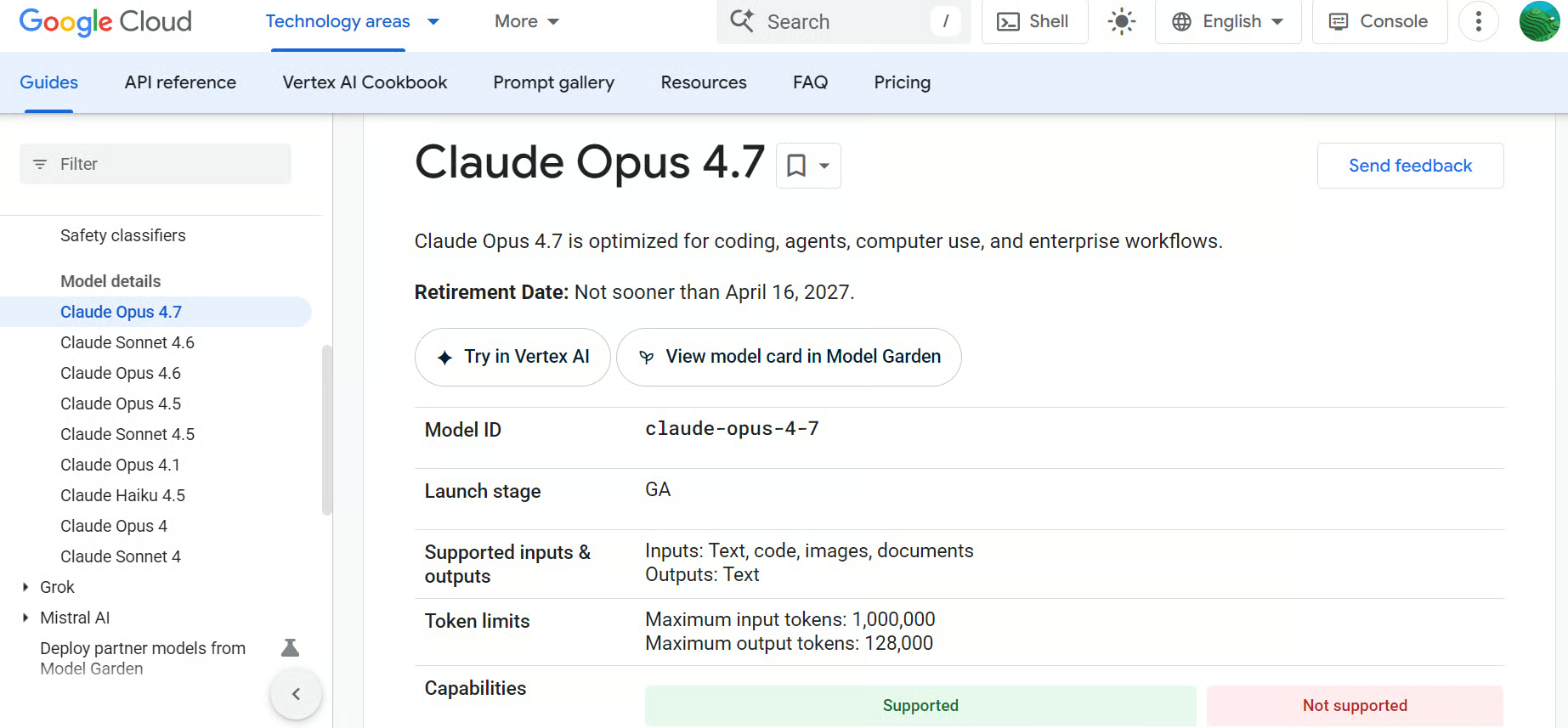

2. Anthropic

A Anthropic disponibiliza a família de modelos Claude por meio de sua API, como o seu modelo carro-chefe mais recente, o Claude Opus 4.7. O Claude foi projetado para linguagem, raciocínio, análise, coding, contextos longos e fluxos de trabalho com agentes. A plataforma para desenvolvedores da Anthropic dá acesso direto aos modelos via APIs, SDKs e documentação técnica.

O Claude é especialmente útil para apps que precisam seguir instruções com precisão, alta qualidade de escrita, análise de documentos e tratamento confiável de prompts complexos.

Fonte: Get started with Claude

Um ponto negativo importante é o custo, especialmente ao usar o Claude para documentos grandes, prompts de contexto longo ou aplicações de alto volume. Como o Claude é acessado por uma API hospedada, as equipes também têm controle limitado sobre onde e como o modelo roda.

Para casos sensíveis à privacidade, os desenvolvedores devem revisar com cuidado o tratamento de dados, retenção e requisitos de conformidade antes de enviar dados confidenciais de negócios ou de clientes pela API.

Melhor para: assistentes de código, IA para empresas, análise de longo contexto, fluxos com documentos e agentes de IA.

Para uma comparação detalhada entre os dois gigantes da IA, confira nosso guia Anthropic vs OpenAI.

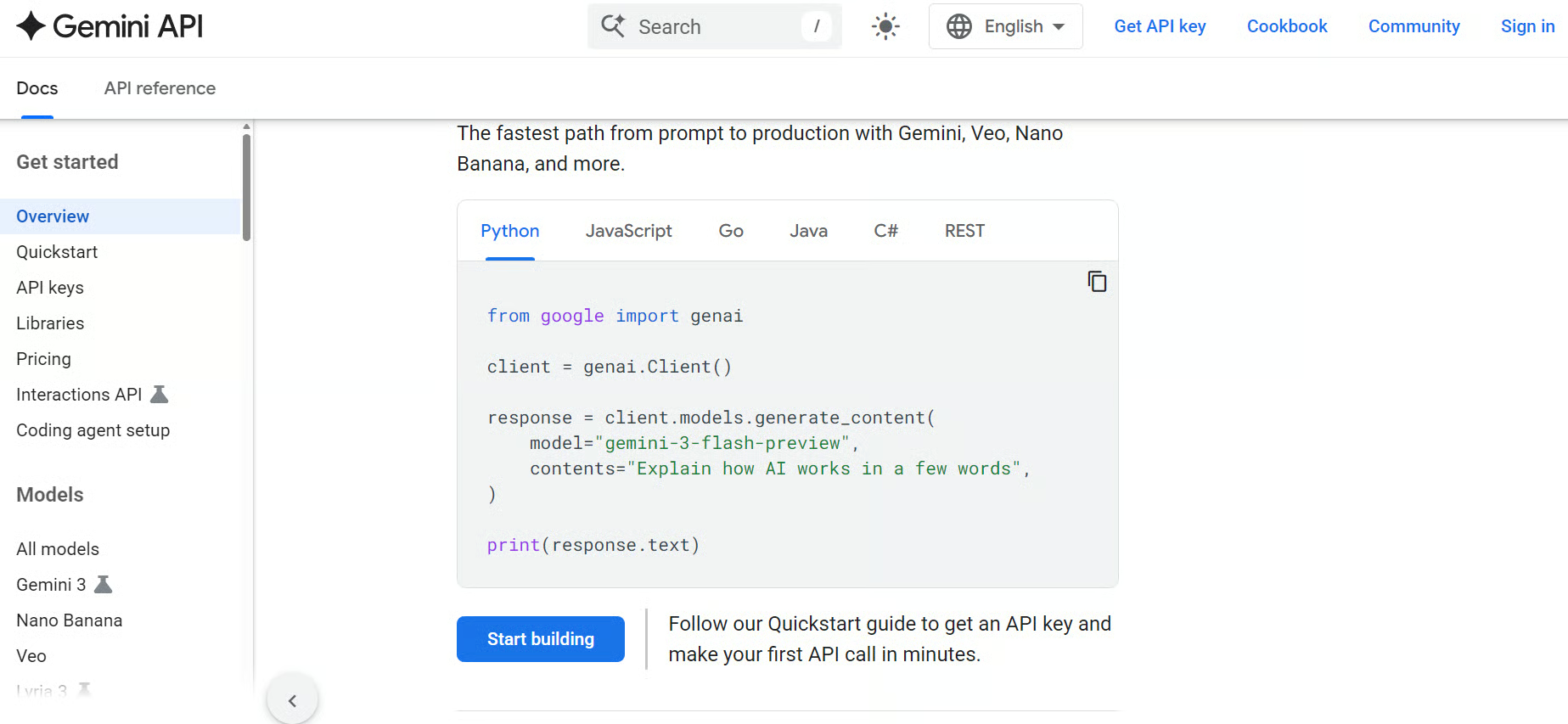

3. Google Gemini

O Google Gemini é a família nativa de LLMs do Google, incluindo o Gemini 3.1 Pro, disponível para desenvolvedores por meio da Gemini API. A Gemini API oferece APIs padrão, com streaming e em tempo real, com documentação sobre detalhes dos modelos, SDKs, preços, configuração e referências de API.

Com o Nano Banana 2 para geração de imagens e o Veo 3.1 integrado, o Gemini é uma opção forte para desenvolvedores que constroem aplicações multimodais. Também é uma boa escolha para assistentes de IA (principalmente os que dependem de experiências de busca), ferramentas de código e produtos que se conectam ao ecossistema mais amplo de IA do Google.

Fonte: Gemini API

Por outro lado, o Gemini pode parecer mais atrelado ao ecossistema Google, o que pode não atender times que buscam uma configuração neutra de fornecedores. Preços, disponibilidade de modelos e recursos também podem variar entre ferramentas e regiões.

Para aplicações sensíveis à privacidade, as equipes devem revisar o tratamento de dados, retenção e requisitos de conformidade antes de enviar dados confidenciais de negócios ou de clientes pela API.

Melhor para: apps de IA multimodais, integração com o ecossistema Google, fluxos de longo contexto, coding e aplicações de IA de uso geral.

Provedores de API de LLM open source

Provedores de API de LLM open source dão aos desenvolvedores acesso hospedado a modelos de código aberto e pesos abertos. Em vez de baixar modelos e rodá-los nas suas próprias GPUs, essas plataformas hospedam os modelos e os disponibilizam por APIs simples.

Esses provedores são úteis para times que querem reduzir custos, ter mais flexibilidade de modelos, experimentar mais rápido e acessar modelos abertos populares como Llama, DeepSeek, Qwen, Mistral, Gemma e outros.

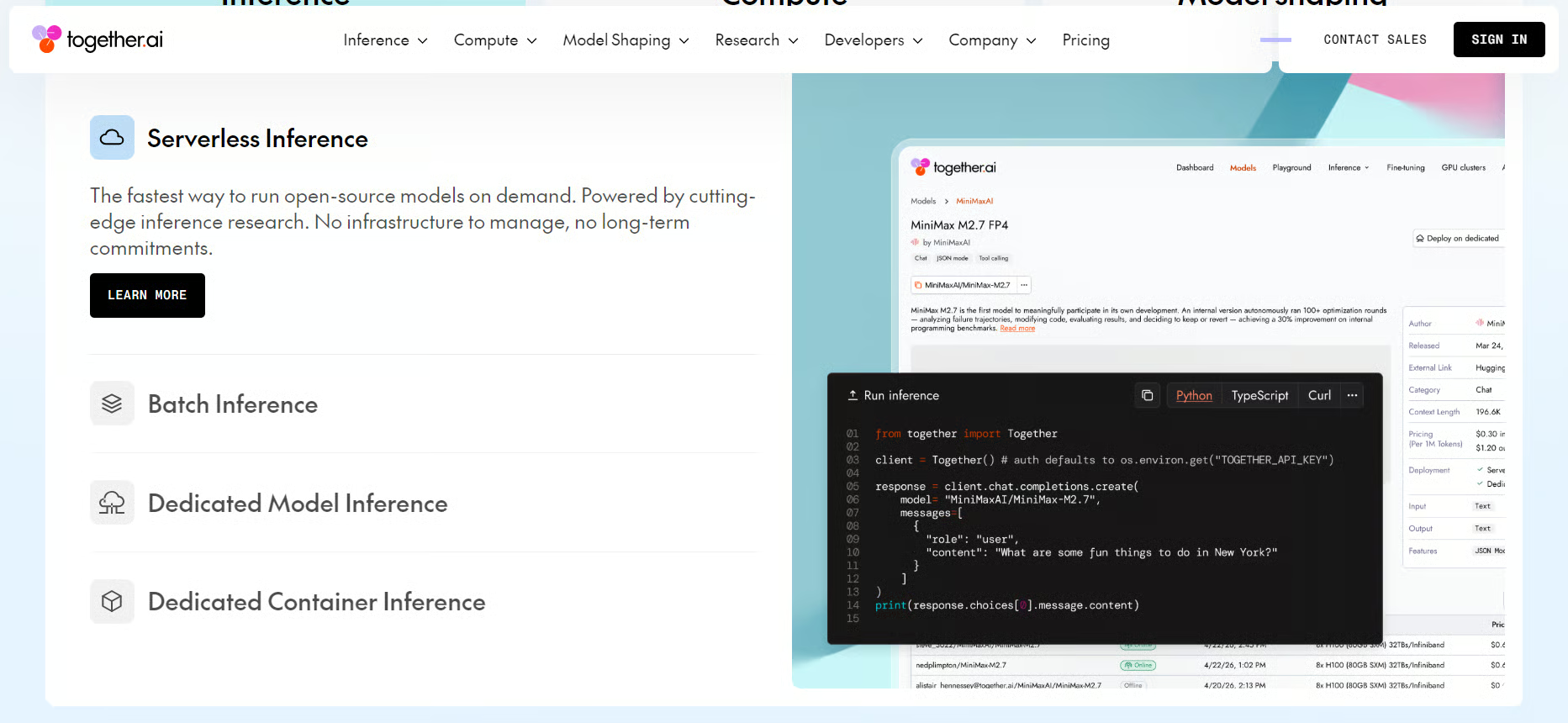

4. Together AI

Together AI oferece acesso hospedado a modelos open source e especializados por meio de uma API unificada. Seu catálogo inclui 200+ modelos de texto, imagem, vídeo, código e áudio, com suporte a inferência serverless, inferência em lote, endpoints dedicados, fine-tuning, avaliações e clusters de GPU.

A Together AI é uma ótima opção para desenvolvedores que querem construir com modelos abertos sem gerenciar sua própria infraestrutura. É especialmente útil para times que testam múltiplos modelos, fazem fine-tuning de modelos customizados ou escalam workloads de inferência.

Fonte: Together AI

Dito isso, a qualidade, a velocidade e a confiabilidade podem variar conforme o modelo selecionado. As equipes podem precisar de mais testes, benchmarking e avaliação antes do uso em produção.

Para workloads sensíveis, as equipes devem verificar se precisam de acesso serverless, endpoints dedicados ou opções de deployment privado para atender aos requisitos de segurança e conformidade.

Melhor para: inferência de modelos open source, fine-tuning, workloads de IA escaláveis e experimentação com muitos modelos.

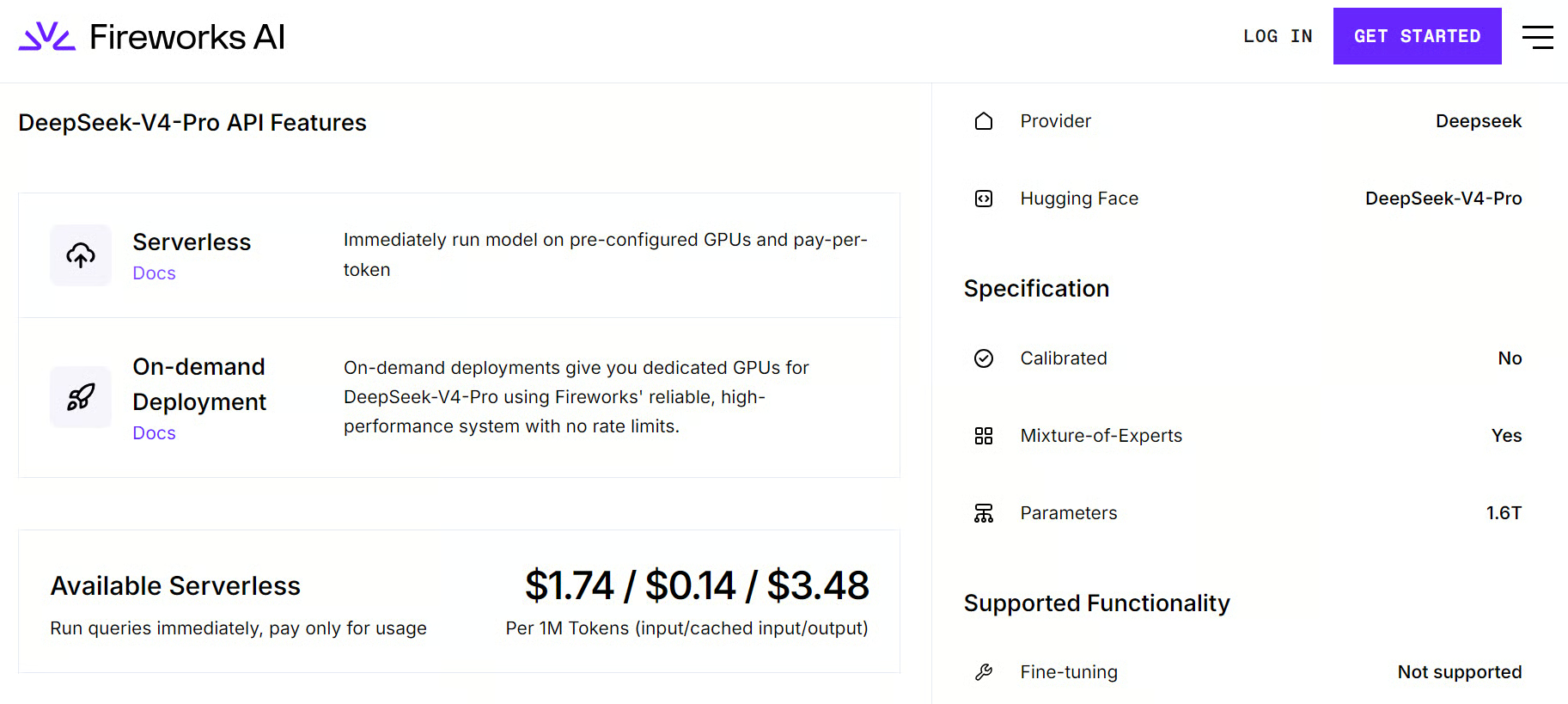

5. Fireworks AI

Fireworks AI é focada em inferência rápida para LLMs e modelos generativos open source. Sua plataforma suporta inferência serverless, deployments sob demanda, fine-tuning e APIs prontas para produção para modelos abertos populares.

A Fireworks AI é uma excelente alternativa para times que querem a flexibilidade de modelos abertos com inferência mais rápida e menor latência. É especialmente útil para IA conversacional, assistentes de código, busca, apps multimodais e sistemas corporativos de RAG.

Fonte: Fireworks AI

Um ponto de atenção é que a Fireworks AI é mais focada em inferência e deployment do que em ser uma plataforma ampla e tudo em um. As equipes ainda podem precisar de ferramentas separadas para orquestração, avaliação, monitoramento ou fluxos complexos com agentes.

As equipes também devem avaliar se a inferência serverless é suficiente para workloads sensíveis ou se são necessários deployments dedicados para mais controle de desempenho e conformidade.

Melhor para: inferência rápida de modelos open source, fine-tuning, apps de IA em produção e deployments de modelos abertos com baixa latência.

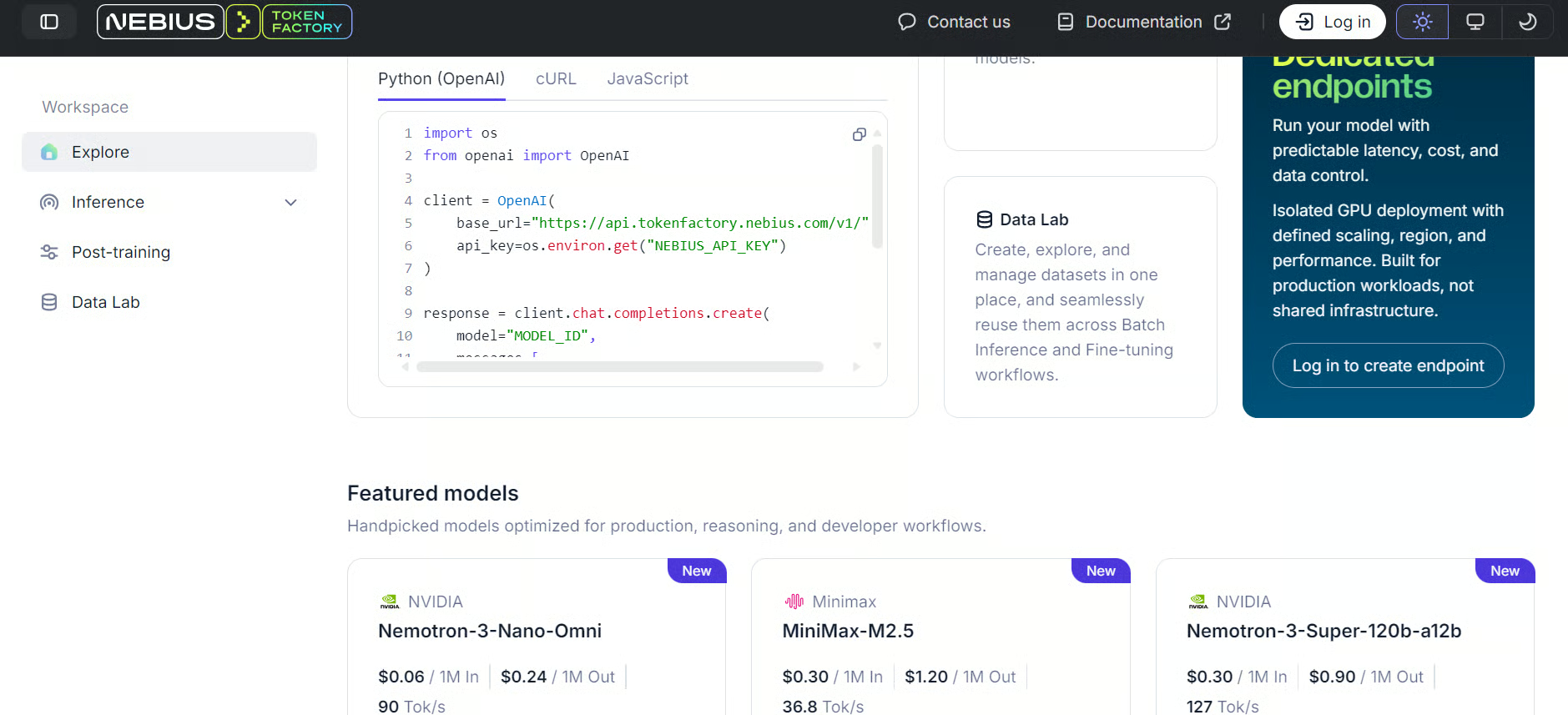

6. Nebius AI

Nebius AI é um provedor de nuvem de IA criado para workloads de IA com GPUs, inferência hospedada, serving de modelos e infraestrutura de IA escalável. Seu serviço de inferência Token Factory suporta modelos abertos via uma API compatível com OpenAI, com opções de inferência serverless, fine-tuning e infraestrutura dedicada de nuvem de IA.

A Nebius AI é uma boa pedida para times que querem mais controle de infraestrutura do que um provedor básico de API, mas sem a complexidade de gerenciar totalmente seus próprios ambientes de GPU. É especialmente útil para equipes que constroem com modelos abertos e customizados e precisam de computação escalável, inferência rápida e opções de deployment prontas para produção.

Fonte: Nebius Token Factory

O Nebius Token Factory oferece dois níveis de velocidade de inferência: Fast e Base. Fast foi pensado para workloads interativos e de baixa latência, enquanto Base é voltado a inferência de alto volume e mais econômica ou para processamento em background.

A Nebius é certamente mais focada em infraestrutura do que plataformas simples de API de LLM plug-and-play. Isso significa que as equipes podem precisar de mais conhecimento de nuvem, deployment e gestão de workloads para extrair o máximo valor.

Para workloads sensíveis, as equipes devem avaliar se a inferência gerenciada é suficiente ou se é necessária infraestrutura dedicada para maior controle de segurança, conformidade e governança de dados.

Melhor para: infraestrutura de IA na nuvem, inferência hospedada, workloads com GPU, inferência rápida e times que querem mais controle de deployment.

Provedores de roteamento de LLM

Provedores de roteamento de LLM dão aos desenvolvedores acesso a vários modelos e provedores por uma única API. Em vez de integrar separadamente com OpenAI, Anthropic, Google, Mistral, DeepSeek e outros, os desenvolvedores podem usar uma camada de roteamento para gerenciar o acesso aos modelos em um só lugar.

Essas plataformas são úteis para comparação de modelos, roteamento de fallback, otimização de custos, redundância de provedores, observabilidade e alternância entre modelos sem reescrever sua aplicação.

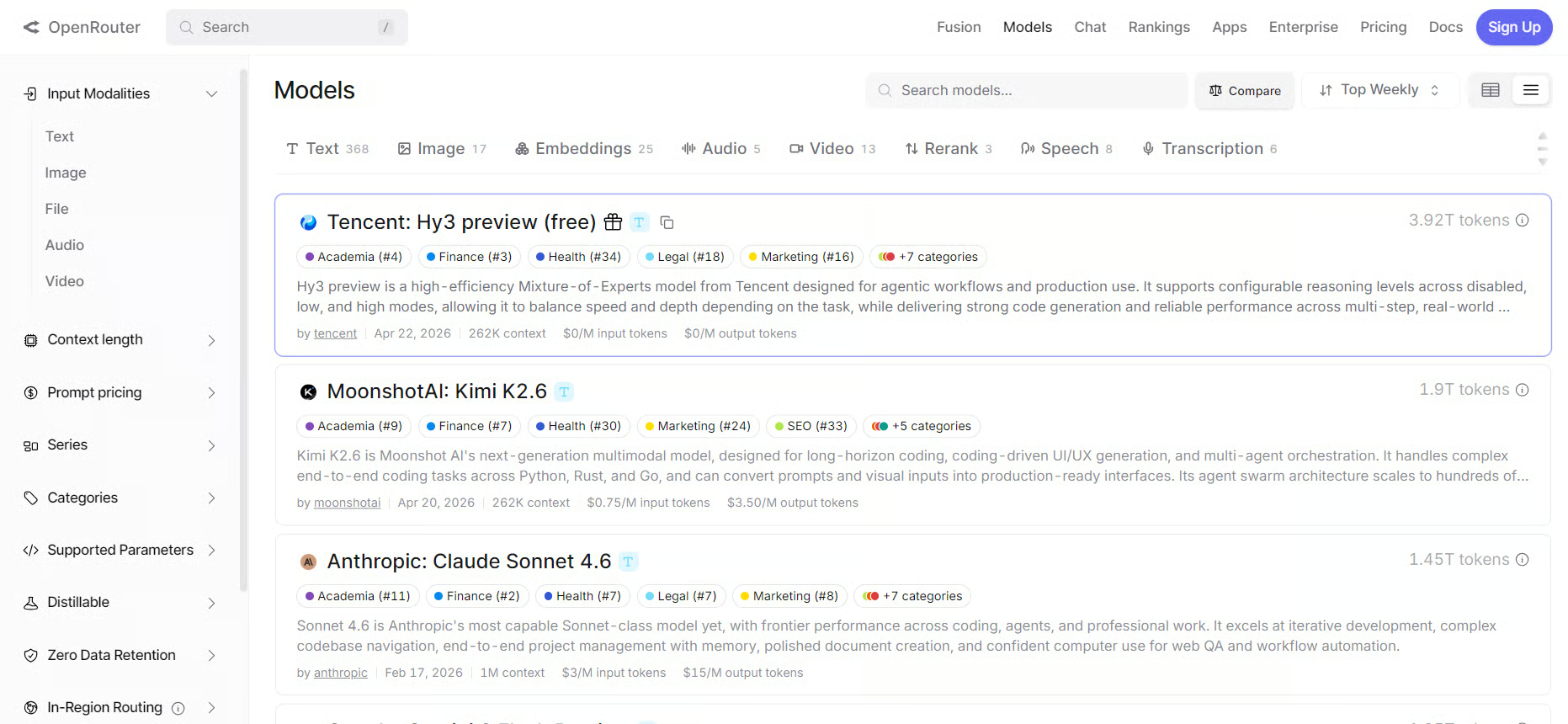

7. OpenRouter

OpenRouter é um dos provedores de roteamento de LLM mais populares. Ele dá aos desenvolvedores acesso a muitos modelos por uma única API compatível com OpenAI, facilitando trabalhar com diferentes provedores por meio de uma integração única.

Como já cobrimos em vários tutoriais, o OpenRouter é uma ótima opção para desenvolvedores que querem comparar modelos, testar novos lançamentos rapidamente, rotear requisições entre provedores ou evitar ficar preso a um único fornecedor de modelos.

Fonte: OpenRouter

Um ponto de atenção é que o OpenRouter adiciona mais uma camada entre sua aplicação e o provedor do modelo. Isso pode introduzir dependência extra, latência variável e comportamentos específicos de provedores que ainda precisam ser testados.

Para workloads em produção, as equipes devem revisar as configurações de roteamento, comportamento de fallback, preferências de provedores e controles de privacidade antes de enviar tráfego sensível ou crítico para a plataforma.

Melhor para: apps multi-modelo, comparação de modelos, roteamento de fallback, flexibilidade de provedores e experimentação rápida.

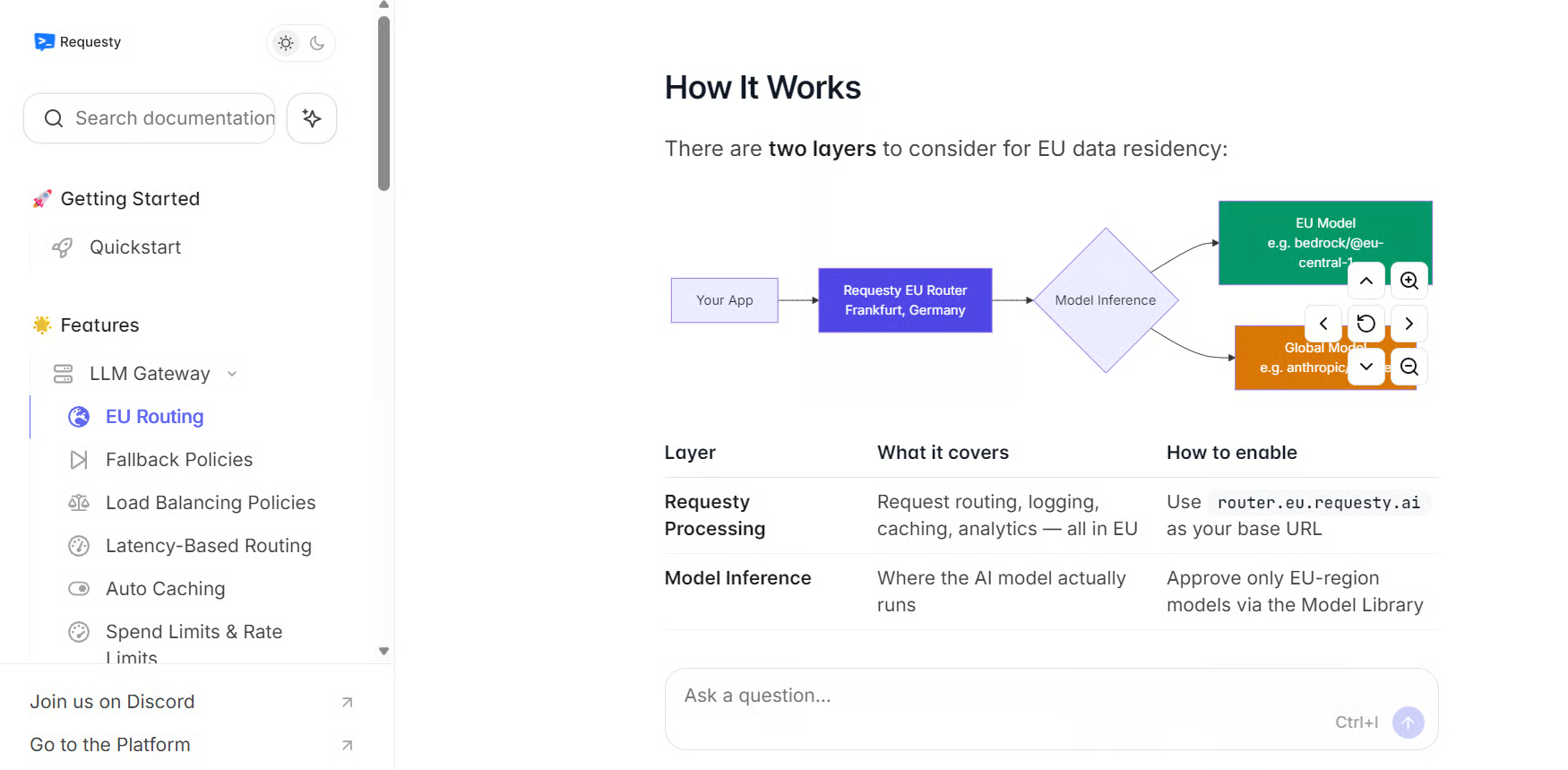

8. Requesty.ai

Requesty.ai é uma plataforma de roteamento e gateway de LLM que ajuda times a se conectarem a vários provedores de LLM por uma única API compatível com OpenAI. Ela suporta 400+ modelos e traz recursos de roteamento, fallback, cache, gestão de custos, observabilidade e governança.

A Requesty.ai é uma ótima opção para equipes que constroem aplicações de IA em produção e dependem de mais de um provedor de modelos. É especialmente útil para gerenciar políticas de roteamento, acompanhar uso, controlar gastos e melhorar a confiabilidade quando provedores falham, estouram timeout ou sofrem rate limits.

Fonte: Requesty AI Documentation

Assim como no OpenRouter, o principal ponto de atenção é que a Requesty.ai adiciona outra camada de gateway ao stack da aplicação. As equipes precisam configurar cuidadosamente roteamento, fallback, logging e governança para evitar custos inesperados, latência ou comportamentos de provedores.

Para workloads sensíveis, a Requesty.ai inclui controles como detecção e remoção de PII, guardrails de conteúdo, trilhas de auditoria e recursos de governança, mas as equipes ainda devem decidir quais dados podem passar pelo gateway e como os logs serão gerenciados.

Melhor para: roteamento de LLM, controle de custos, observabilidade, fallback de provedores, governança e fluxos de gateway de IA em produção.

Provedores de LLM na nuvem

Provedores de LLM na nuvem são grandes plataformas de cloud que dão a desenvolvedores e empresas acesso gerenciado a foundation models. Muitas vezes, essas plataformas suportam seus próprios modelos e também modelos de terceiros.

Eles são especialmente úteis para empresas que já usam infraestrutura em nuvem e precisam de segurança, governança, conformidade, integração de dados, controles de deployment e gestão de modelos em um só lugar.

9. Google Vertex AI

Google Vertex AI é a plataforma de machine learning e IA generativa do Google Cloud. Ela dá a desenvolvedores e empresas acesso aos modelos Gemini, ao Model Garden, a ferramentas de agentes e a infraestrutura gerenciada para criar, implantar e gerenciar aplicações de IA.

O Vertex AI também suporta parceiros líderes e modelos abertos via Model Garden, incluindo Anthropic Claude, xAI Grok, modelos da Mistral AI e modelos open source como GLM 5 e Gemma 4, além dos próprios modelos Gemini do Google.

Fonte: Generative AI on Vertex AI

O Google Vertex AI é uma ótima opção para times que já usam Google Cloud e querem deployment cloud-native de modelos, governança, controles de segurança e integração com o ecossistema de dados e IA do Google.

Por outro lado, o Vertex AI pode ser mais complexo do que usar uma API de modelo simples. As equipes podem precisar de experiência com Google Cloud para gerenciar projetos, permissões, billing, configurações de deployment e integrações adequadamente.

Para workloads sensíveis, o Vertex AI é útil para times que precisam de controles de acesso em nível de nuvem, governança e infraestrutura gerenciada, mas decisões de configuração sobre logging, acesso a dados e regiões de deployment ainda exigem revisão cuidadosa.

Melhor para: usuários do Google Cloud, acesso ao Gemini, apps corporativos de IA, fluxos multimodais e deployment cloud-native de modelos.

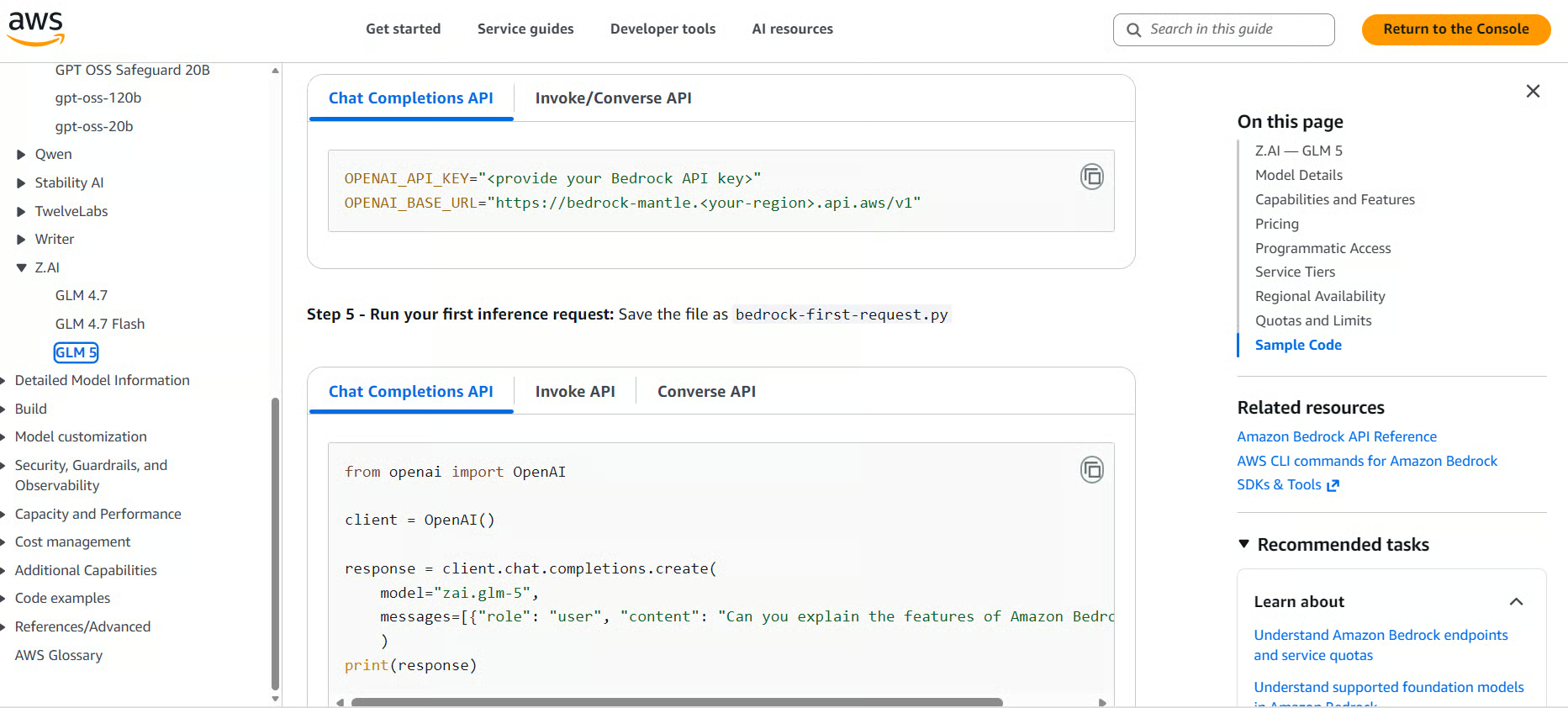

10. Amazon Bedrock

Amazon Bedrock é a plataforma gerenciada de IA generativa da AWS. Ela dá aos desenvolvedores acesso a foundation models da Amazon e de terceiros por meio de um serviço gerenciado da AWS.

O Bedrock suporta modelos de provedores como Amazon, Anthropic, Meta, Mistral AI, Cohere, DeepSeek e outros, sendo útil para times que querem opções de modelos dentro do ecossistema AWS.

O Amazon Bedrock é uma escolha forte para empresas que já constroem na AWS, pois reúne acesso a modelos, infraestrutura de nuvem, controles de segurança e integração corporativa em uma única plataforma.

Fonte: Amazon Bedrock

Um ponto de atenção é que o Bedrock pode ser mais complexo do que uma API básica de LLM. As equipes podem precisar de experiência com AWS para gerenciar permissões, regiões, acesso a modelos, preços, rede e configurações de deployment corretamente.

Para workloads sensíveis, o Bedrock é interessante porque prompts e saídas não são usados para treinar modelos base nem compartilhados com provedores de modelos, e as equipes podem usar controles AWS como criptografia, IAM e PrivateLink.

Melhor para: usuários da AWS, IA corporativa, acesso gerenciado a foundation models, deployments com foco em segurança e aplicações de IA generativa cloud-native.

Tabela comparativa de provedores de API de LLM

A tabela abaixo compara os principais provedores de API de LLM baseando-se em seus diferenciais e principais limitações.

|

Provedor |

Diferenciais |

Principais limitações |

|

OpenAI |

Alta qualidade de modelos, APIs maduras, ferramentas multimodais, saídas estruturadas, embeddings, fala, geração de imagens e fluxos com agentes |

Pode ficar cara em escala e oferece menos controle que modelos open source ou autohospedados |

|

Anthropic |

Ótima qualidade de escrita, obediência cuidadosa a instruções, raciocínio, coding e suporte a contexto longo |

Custos podem subir com documentos grandes ou alto volume, e há controle limitado sobre hospedagem e internos do modelo |

|

Google Gemini |

Forte capacidade multimodal, APIs em tempo real, suporte a contexto longo e integração próxima ao ecossistema de IA do Google |

Pode parecer preso ao ecossistema Google; preço, disponibilidade e recursos podem variar por ferramenta ou região |

|

Together AI |

Acesso hospedado a muitos modelos abertos e especializados, com inferência serverless, endpoints dedicados, fine-tuning, avaliações e infraestrutura de GPU |

Qualidade, velocidade e confiabilidade variam conforme o modelo escolhido |

|

Fireworks AI |

Inferência rápida, baixa latência, acesso serverless, deployments sob demanda e APIs prontas para produção para modelos abertos |

Mais focada em inferência e deployment do que em ser uma plataforma completa e tudo em um |

|

Nebius AI |

Infraestrutura com GPU, inferência hospedada, API compatível com OpenAI e faixas de velocidade como Fast e Base |

Mais focada em infraestrutura; equipes podem precisar de mais conhecimento de nuvem e deployment |

|

OpenRouter |

Acesso a muitos modelos por uma API compatível com OpenAI, com troca de provedores mais fácil e opções de fallback |

Adiciona uma camada entre app e provedor, o que pode afetar latência, confiabilidade ou debug |

|

Requesty.ai |

Uma API para múltiplos provedores, com roteamento, fallback, cache, rastreamento de custo, observabilidade e governança |

Exige configuração cuidadosa de roteamento, logging, fallback e controles de custo para evitar surpresas |

|

Google Vertex AI |

Acesso gerenciado ao Gemini, Anthropic Claude, xAI Grok, Mistral AI e modelos abertos via Model Garden, além de segurança e governança do Google Cloud |

Mais complexo do que uma API simples; pode exigir experiência com Google Cloud |

|

Amazon Bedrock |

Acesso gerenciado a modelos da Amazon e de terceiros como Anthropic, Meta, Mistral AI, Cohere e outros dentro da AWS |

Mais complexo que uma API básica de LLM, especialmente em permissões, regiões, preços e acesso a modelos |

Como escolher o melhor provedor de API de LLM para o seu caso

A escolha do provedor certo de API de LLM depende de três fatores:

- O que você está construindo

- Quanto controle você precisa

- Quanto está disposto a investir

Para startups e times pequenos, provedores de API de LLM open source costumam ser o melhor ponto de partida. Plataformas como Together AI, Fireworks AI e Nebius AI dão acesso a modelos abertos poderosos sem que você gerencie GPUs ou infraestrutura. Podem ser mais rápidas, baratas e flexíveis para experimentação e desenvolvimento inicial de produto.

Se você quer testar diferentes modelos rapidamente, provedores de roteamento de LLM são uma ótima opção. Ferramentas como OpenRouter e Requesty.ai permitem comparar modelos fechados e abertos por uma única API, gerenciar fallbacks e trocar de provedores sem reescrever sua aplicação.

Para fluxos em que a qualidade do modelo importa mais do que o custo, provedores nativos como OpenAI e Anthropic continuam entre as melhores escolhas. Eles são especialmente úteis para assistentes de IA em produção, ferramentas de código, fluxos com raciocínio intenso, apps multimodais e sistemas com agentes, onde confiabilidade e desempenho do modelo são fundamentais.

Por fim, se sua empresa já roda em AWS ou Google Cloud, muitas vezes faz sentido permanecer nesse ecossistema. Amazon Bedrock e Google Vertex AI oferecem acesso gerenciado a modelos, controles de segurança, governança e integração com as ferramentas que seu time já usa.

Considerações finais

Para trabalho técnico, assistentes de código e ferramentas de vibe coding, eu não exageraria na experimentação no começo. Pela minha experiência, OpenAI e Anthropic costumam ser as escolhas mais seguras por causa do forte suporte a coding, raciocínio e ferramentas para desenvolvedores.

Provedores de API de LLM open source e provedores de roteamento são alternativas sólidas para experimentação mais avançada.

Grandes provedores de LLM em nuvem geralmente só fazem sentido em ambiente corporativo. Nesse caso, siga o ecossistema que você já utiliza.

Perguntas frequentes sobre provedores de API de LLM

O que é um provedor de API de LLM?

Uma empresa ou plataforma que hospeda large language models e os expõe via API, para que desenvolvedores enviem requisições e recebam respostas geradas por IA sem precisar gerenciar GPUs ou infraestrutura de inferência.

Qual a diferença entre um provedor nativo de LLM e um provedor de LLM na nuvem?

Provedores nativos (como OpenAI e Anthropic) constroem e servem seus próprios modelos diretamente. Provedores de nuvem (como AWS Bedrock e Google Vertex AI) oferecem acesso gerenciado a múltiplos modelos de terceiros, integrados ao ecossistema de nuvem existente com ferramentas corporativas de segurança e governança.

Quando devo usar um provedor de roteamento de LLM como o OpenRouter ou o Requesty.ai?

Quando você precisa trabalhar com mais de um modelo ou provedor, quer fallback automático se um provedor cair, ou precisa comparar modelos e controlar custos — tudo por meio de uma única integração de API.

Provedores de API de LLM open source são menos capazes que provedores nativos como a OpenAI?

Não necessariamente; depende da tarefa. Plataformas como Together AI e Fireworks AI hospedam modelos abertos de ponta como Llama, DeepSeek e Mistral, que podem competir com modelos fechados — muitas vezes a um custo bem menor.

Qual provedor de API de LLM é melhor para empresas com requisitos rígidos de conformidade?

Amazon Bedrock e Google Vertex AI costumam ser as escolhas mais fortes, pois oferecem controles de segurança cloud-native, IAM, criptografia, auditoria e recursos de governança que se integram à infraestrutura corporativa existente.

Sou um cientista de dados certificado que gosta de criar aplicativos de aprendizado de máquina e escrever blogs sobre ciência de dados. No momento, estou me concentrando na criação e edição de conteúdo e no trabalho com modelos de linguagem de grande porte.