Track

Zaledwie w zeszłym tygodniu GPT-Realtime-2 od OpenAI podniósł poprzeczkę dla głosowych systemów AI, debiutując z rozumowaniem na poziomie GPT-5 i oknem kontekstu 128K. Teraz Thinking Machines Lab Miry Murati wysuwa inną tezę: że responsywność i inteligencję należy wytrenować w tym samym modelu od podstaw, a nie dokładać później za pomocą detekcji aktywności głosowej i komponentów do zarządzania dialogiem.

Laboratorium nazywa ten typ nowego modelu „modelem interakcji”.

Ich wersja badawcza, TML-Interaction-Small, to pierwszy rezultat tego podejścia. To model Mixture-of-Experts z 276 mld parametrów i 12 mld aktywnych parametrów. Przetwarza dźwięk, wideo i tekst w ciągłych mikro-turach trwających 200 ms, co oznacza, że postrzega i odpowiada jednocześnie, zamiast czekać, aż mówca skończy.

W tym artykule wyjaśnię, czym jest TML-Interaction-Small, omówię jego kluczowe cechy architektoniczne, porównam go bezpośrednio z GPT-Realtime-2, a następnie przyjrzę się szczegółowo wynikom benchmarków.

Czym są modele interakcji?

Thinking Machines Lab opisuje model interakcji jako system, w którym interaktywność jest częścią samego modelu, a nie implementowaną w zewnętrznej otoczce. Zasadą jest, że responsywność i inteligencję należy trenować razem od podstaw, na ciągłych strumieniach audio i wideo, zamiast dokładać je po fakcie do modelu opartego na tekście.

Większość istniejących systemów głosowych w czasie rzeczywistym łączy komponenty detekcji aktywności głosowej, osobne enkodery i warstwy zarządzania dialogiem, aby symulować responsywność. Thinking Machines Lab argumentuje, że to podejście zawsze będzie ustępować modelom, które natywnie obsługują interakcję, ze względu na sztuczne granice tur ograniczające możliwości modelu nieinteraktywnego.

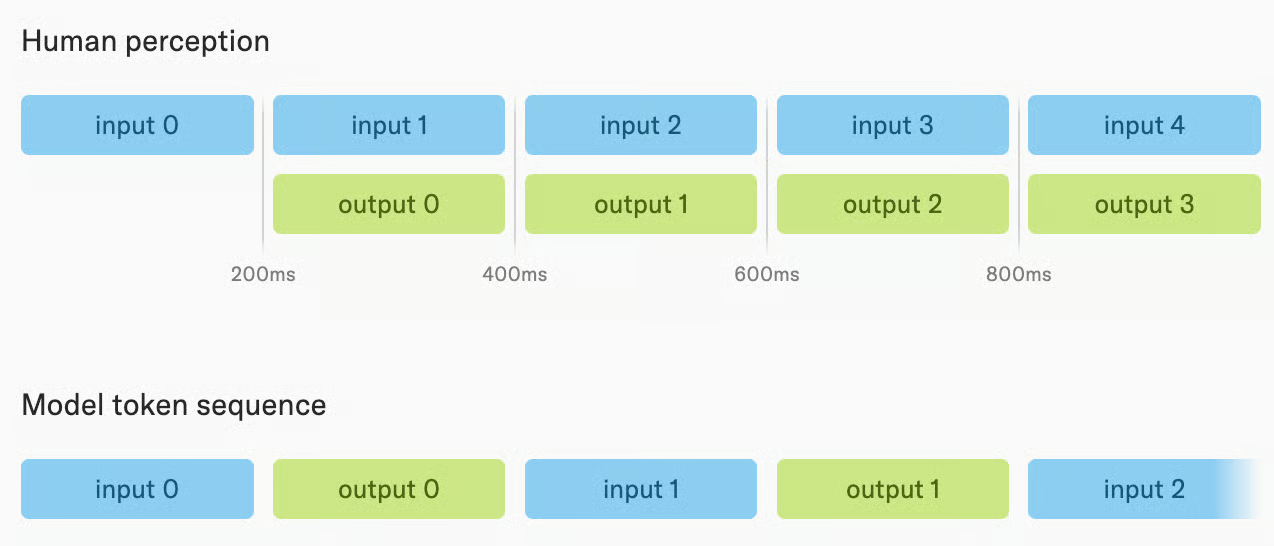

Zamiast sekwencyjnie konsumować dane wejściowe użytkownika, a następnie generować pełną odpowiedź, modele interakcji laboratorium są zaprojektowane bliżej ludzkiej percepcji. Traktują zarówno tokeny wejściowe, jak i wyjściowe jako strumienie, a oba są przeplatane w każdej 200-milisekundowej mikro-turze.

W efekcie model interakcji postrzega i odpowiada jednocześnie, przetwarzając wejście i wyjście równolegle, zamiast czekać, aż mówca skończy. To umożliwia kilka ciekawych zdolności:

W efekcie model interakcji postrzega i odpowiada jednocześnie, przetwarzając wejście i wyjście równolegle, zamiast czekać, aż mówca skończy. To umożliwia kilka ciekawych zdolności:

- Mówienie podczas słuchania

- Reagowanie na wskazówki wizualne bez podpowiedzi

- Bezpośrednie śledzenie upływu czasu

To wszystko są rzeczy, których modele turowe z zewnętrzną otoczką nie są w stanie odtworzyć, niezależnie od ich zdolności do rozumowania.

Czym jest TML-Interaction-Small?

TML-Interaction-Small to pierwszy publiczny model Thinking Machines Lab i pierwsza implementacja ich architektury modelu interakcji.

To model Mixture-of-Experts z 276 mld parametrów i 12 mld aktywnych parametrów, wytrenowany od podstaw na ciągłych strumieniach audio i wideo z wykorzystaniem opisanego wcześniej projektu wielostrumieniowych mikro-tur, w którym wejście i wyjście są przetwarzane w porcjach po 200 ms.

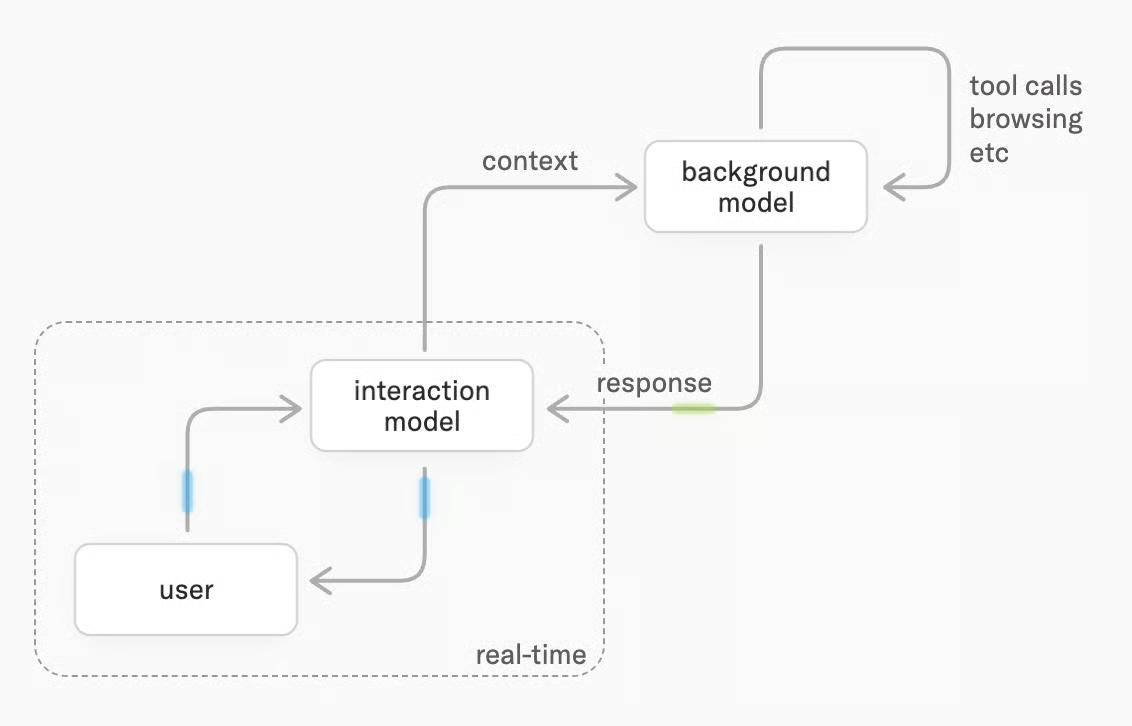

Połączenie dwóch modeli ze współdzielonym kontekstem zapewnia zarówno responsywność, jak i inteligencję. Użytkownik otrzymuje odpowiedzi od modelu interakcji w czasie rzeczywistym, podczas gdy planowanie, korzystanie z narzędzi i głębsze rozumowanie są delegowane do modelu działającego w tle, który pracuje asynchronicznie.

Następnie model interakcji wplata wyniki pracy w tle w rozmowę, gdy tylko się pojawiają, nie wypadając z toku konwersacji.

Funkcje TML-Interaction-Small

Podczas gdy istniejące modele głosowe działają turami (Państwo mówią, one odpowiadają), TML-Interaction-Small działa bardziej jak ludzki rozmówca. Oto cztery możliwości, które go wyróżniają.

Mów i słuchaj jednocześnie

TML-Interaction-Small potrafi generować mowę, gdy użytkownik wciąż mówi. Umożliwia to tłumaczenie symultaniczne: mówią Państwo w jednym języku, a model zaczyna tłumaczyć, zanim skończy się zdanie. Oznacza to także, że model może wtrącić się w połowie zdania, gdy wychwyci błąd, lub dawać sygnały werbalne („rozumiem”, „proszę kontynuować”) w trakcie Państwa wyjaśnień.

Jest to również przydatne do niestandardowych odpowiedzi w czasie rzeczywistym zawsze, gdy wystąpi określone zdarzenie z promptu. Jeden z klipów w informacjach o wydaniu pokazuje na przykład, jak model przelicza kwoty w EUR i podaje odpowiadające im kwoty w USD za każdym razem, gdy użytkownik wspomina o płatności.

Widzenie i reagowanie na wideo bez proszenia

TML-Interaction-Small przetwarza wideo równolegle z dźwiękiem i może inicjować wypowiedź na podstawie tego, co widzi, bez werbalnej podpowiedzi.

Jeśli wykonują Państwo pompki przed kamerą, może na bieżąco liczyć powtórzenia na głos. Jeśli w strumieniu wideo pojawi się istotny obiekt, może go wskazać w chwili pojawienia. To jednak funkcja, którą można jeszcze poprawić, co widać po wewnętrznym wyniku RepCount-A, gdzie tylko jedna trzecia (33,4%) przypadków mieściła się w jednym powtórzeniu od wartości referencyjnej.

Jeden z klipów z wydania (który moim zdaniem wygląda nieco osobliwie) demonstruje to w praktyce: po poproszeniu o zwrócenie uwagi na postawę użytkowniczki, model natychmiast wykrył garbienie się przy laptopie i przypomniał, by je skorygować.

Istniejące komercyjne API czasu rzeczywistego obsługują wyłącznie dźwięk. Reagują na wypowiedzi, ale nie potrafią proaktywnie odpowiadać na zmiany wizualne. To zdolność, której obecnie nie ma GPT-Realtime-2 ani Gemini Live.

Naturalna obsługa przerwań i autokorekt

Jeśli zaczną Państwo zdanie, zmienią zdanie i poprawią się w trakcie wypowiedzi, TML-Interaction-Small śledzi korektę i odpowiada na to, co naprawdę mieli Państwo na myśli. Radzi sobie z backchannelingiem (Państwa „mhmm” lub „tak” w trakcie jego mówienia) i rozróżnia, czy ktoś zwraca się do niego, czy do innej osoby w pomieszczeniu.

To scenariusze, w których modele turowe często zawodzą. Albo przestają mówić, gdy nie powinny, albo odpowiadają na niewłaściwy fragment wypowiedzi. Ciekawe, czy TML-Interaction-Small poradzi sobie z tym równie dobrze w codziennych sytuacjach, jak w przygotowanych materiałach demonstracyjnych.

Uruchamianie złożonych zadań w tle przy zachowaniu ciągłej obecności

Model w tle sprawia, że model interakcji jest nie tylko szybki, ale i inteligentny. Można zadawać kolejne pytania lub zmieniać temat, gdy zadanie w tle jest w toku. Gdy wyniki są gotowe, model wplata je w rozmowę w naturalnym momencie, zamiast przerywać nagłą zmianą kontekstu.

Oznacza to, że otrzymują Państwo zarówno szybkie odpowiedzi konwersacyjne, jak i możliwość obsługi zadań wieloetapowych, które zwykle wymagałyby, by model na kilka sekund zamilkł. W klipie z quizem działa to całkiem dobrze: trzech użytkowników zadaje pytania z dziedziny trivia w szybkim tempie, a model w większości nadąża za ich szybkością.

Benchmarki TML-Interaction-Small

Thinking Machines prezentuje wyniki w dwóch kategoriach: benchmarki strumieniowe mierzące interaktywność oraz benchmarki turowe mierzące inteligencję. Najmocniejsze wyniki model osiąga po stronie strumieniowej, gdzie jego wybory architektoniczne są testowane najbardziej bezpośrednio.

Interaktywność

FD-bench v1.5 podaje modelowi nagrany dźwięk i mierzy jego zachowanie w czterech scenariuszach:

- Przerwanie przez użytkownika

- Backchannel użytkownika

- Rozmowa z innymi

- Mowa w tle

TML-Interaction-Small uzyskuje wynik 77,8, w porównaniu do 54,3 dla Gemini-3.1-flash-live-preview przy ustawieniach minimalnych i 46,8 dla GPT-Realtime-2.0 przy ustawieniach minimalnych. Nawet GPT-Realtime-2.0 przy najwyższym poziomie rozumowania (xhigh) osiąga tylko 47,8.

To benchmark, który najpełniej mierzy to, do czego dąży Thinking Machines. Przewaga o 30 punktów nad najbliższym konkurentem to nie marginalna różnica. Pytanie, czy FD-bench v1.5 obejmuje pełne spektrum interaktywności istotnej w praktyce, co samo Thinking Machines uznaje za otwarte zagadnienie badawcze.

Opóźnienie w przejmowaniu tury

TML-Interaction-Small osiąga opóźnienie przejęcia tury 0,40 sekundy w FD-bench v1, najszybciej spośród porównywanych modeli. Najbliżej jest Gemini-3.1-flash-live-preview z wynikiem 0,57 sekundy. Nawet przy ustawieniach minimalnych GPT-Realtime-2.0 potrzebuje około trzykrotnie więcej (1,18 sekundy); przy rozumowaniu xhigh GPT-Realtime-2.0 osiąga 1,63 sekundy.

Opóźnienie ma w interakcji głosowej znacznie większe znaczenie niż w tekście. Różnica 1,2 sekundy między zakończeniem mówienia przez użytkownika a rozpoczęciem odpowiedzi przez model jest nie tylko zauważalna, ale i rozpraszająca. Wynik 0,40 sekundy zbliża TML-Interaction-Small do ludzkich czasów reakcji w rozmowie.

Inteligencja i podążanie za instrukcjami

Audio MultiChallenge mierzy inteligencję i podążanie za instrukcjami w audio. TML-Interaction-Small uzyskuje 43,4%, powyżej GPT-Realtime-1.5 (34,7%) i Gemini-3.1-flash-live-preview (26,8%), ale poniżej GPT-Realtime-2.0 w trybie xhigh (48,5%). Tu widać kompromis między inteligencją a interaktywnością.

Różnica między TML-Interaction-Small a GPT-Realtime-2.0 w xhigh to 5,1 punktu procentowego. To istotna, lecz nie ogromna różnica, okupiona przy tym znacznym kosztem opóźnienia po stronie GPT-Realtime-2.0 (1,63 sekundy wobec 0,40 sekundy). Czy taki kompromis jest sensowny, zależy od zastosowania.

Jakość odpowiedzi i korzystanie z narzędzi

FD-bench v3 mierzy jakość odpowiedzi i dokładność wywołań narzędzi w scenariuszach audio plus narzędzia. TML-Interaction-Small uzyskuje 82,8% jakości odpowiedzi i 68,0% pass@1 z włączonym agentem w tle, w porównaniu do 80,0% / 52,0% dla GPT-Realtime-2.0 przy ustawieniach minimalnych i 81,0% / 58,0% przy xhigh.

Luka w pass@1 (68,0% wobec 58,0%) to tu najważniejsza liczba, ponieważ mierzy, czy model faktycznie poprawnie wykonuje zadania zależne od narzędzi. Wygląda na to, że podwójna architektura, która oddziela wywołania narzędzi od interakcji z użytkownikiem, się opłaca.

Nowe benchmarki interaktywności: TimeSpeak, CueSpeak i proaktywność wizualna

Thinking Machines stworzyło dwa wewnętrzne benchmarki i zaadaptowało trzy mniej powszechnie używane, aby bezpośrednio mierzyć zdolności interaktywne. Warto im się uważnie przyjrzeć, ponieważ żaden model konkurencyjny nie osiąga na nich istotnych wyników.

- TimeSpeak (czasowe inicjowanie mowy): TML-Interaction-Small uzyskuje 64,7% makro-dokładności.

- CueSpeak (mowa wyzwalana sygnałem werbalnym): TML-Interaction-Small uzyskuje 81,7% makro-dokładności.

- RepCount-A (zliczanie akcji wizualnych): TML-Interaction-Small uzyskuje 33,4% dokładności off-by-one.

- ProactiveVideoQA (mowa wyzwalana sygnałem wizualnym): TML-Interaction-Small uzyskuje 31,5 PAUC (bazowy brak odpowiedzi = 25,0%).

- Lokalizacja czasowa Charades (czasowanie akcji wizualnych): TML-Interaction-Small uzyskuje 30,4 mIoU.

Na większości z tych nowych benchmarków GPT realtime-2.0 całkowicie zawodzi, osiągając wynik bliski zeru, a nawet zero (na benchmarku Charades, który wymaga, by model mówił „start” i „stop” w odpowiednich momentach podczas wideo).

Trudno mi ocenić, jak znaczące są te wyniki, ponieważ benchmarki są nowe i nie zostały jeszcze niezależnie zweryfikowane, ale wpisują się w ogólny obraz różnic architektonicznych i zbliżonych wyników testów.

Cennik i dostępność TML-Interaction-Small

TML-Interaction-Small znajduje się obecnie w ograniczonej wersji badawczej i nie ogłoszono szczegółów cenowych. Thinking Machines planuje szerszy dostęp później w 2026 roku. Zainteresowani badacze i deweloperzy mogą skontaktować się z zespołem pod adresem interaction@thinkingmachines.ai, aby poprosić o dostęp.

Dla porównania, GPT-Realtime-2 kosztuje 32 USD za milion tokenów wejściowych audio i 64 USD za milion tokenów wyjściowych audio, co opisaliśmy w naszym przeglądzie GPT-Realtime-2. Cennik TML-Interaction-Small prawdopodobnie zostanie ogłoszony wraz z szerszym wydaniem.

Jak zapewne Państwo zauważyli, model ma przyrostek „-Small”, i słusznie można oczekiwać, że Thinking Machines wprowadzi większe modele. Na razie są zbyt wolne do wdrożeń, ale wydanie planowane jest na koniec 2026 roku.

TML-Interaction-Small vs. GPT-Realtime-2

Bardziej interesująca różnica między tymi modelami dotyczy benchmarków interaktywności. W FD-bench v1.5, który mierzy zachowanie w sytuacjach przerwania przez użytkownika, backchannelingu, rozmowy z innymi i mowy w tle, TML-Interaction-Small uzyskuje 77,8. GPT-Realtime-2.0 przy ustawieniach minimalnych uzyskuje 46,8, a przy najwyższym poziomie rozumowania (xhigh) 47,8. To różnica 30 punktów w benchmarku najbliżej mierzącym to, co Thinking Machines optymalizuje.

Istnieje kompromis w zakresie inteligencji, ale różnica jest tu znacznie mniejsza niż w interaktywności. GPT-Realtime-2.0 w xhigh osiąga 48,5% w Audio MultiChallenge wobec 43,4% dla TML-Interaction-Small. W BigBench Audio GPT-Realtime-2.0 w high uzyskuje 96,6% wobec 75,7% dla TML-Interaction-Small (choć TML-Interaction-Small osiąga 96,5% z włączonym agentem w tle).

Ogólny obraz jest taki, że TML-Interaction-Small prowadzi pod względem responsywności i interaktywności, podczas gdy GPT-Realtime-2.0 przy wysokich ustawieniach rozumowania prowadzi w benchmarkach czystej inteligencji.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 opóźnienie przejęcia tury (s) | 0,40 | 1,18 | 1,63 | 0,57 |

| FD-bench v1.5 średnio | 77,8 | 46,8 | 47,8 | 54,3 |

| FD-bench v3 jakość odpowiedzi (%) | 82,8* | 80,0 | 81,0 | 68,5 |

| Audio MultiChallenge APR (%) | 43,4 | 37,6 | 48,5 | 26,8 |

| BigBench Audio dokładność (%) | 75,7 / 96,5* | 71,8 | 96,6 | 71,3 |

| IFEval (VoiceBench) dokładność (%) | 82,1 | 81,7 | 83,2 | 67,6 |

| IFEval dokładność tekstu (%) | 89,7 | 89,6 | 95,2 | 85,8 |

* Z włączonym agentem w tle.

Aby zobaczyć rodzinę modeli audio OpenAI w akcji, proszę zajrzeć do naszego samouczka API GPT-Realtime-2.

Wnioski końcowe

TML-Interaction-Small zapowiada się obiecująco. Jeśli spełni deklaracje z informacji o wydaniu, nowy model zapewni znacząco lepszą interaktywność przy krótkim opóźnieniu, bez poświęcania jakości odpowiedzi czy zdolności rozumowania. Zdolność do jednoczesnego mówienia, słuchania i reagowania na wskazówki wizualne jest jak dotąd unikalna i daje wiele możliwości. Jestem ciekaw, jak będzie wyglądał cennik przy publicznym wydaniu modelu.

Luka w inteligencji względem GPT-Realtime-2 jest realna, ale węższa niż luka w interaktywności. W zastosowaniach, gdzie rozmowa ma brzmieć naturalnie, różnica w opóźnieniu ma większe znaczenie niż różnica w inteligencji. W zastosowaniach, gdzie priorytetem jest dokładność w trudnych zadaniach wymagających rozumowania, GPT-Realtime-2.0 przy wysokich ustawieniach rozumowania wciąż prowadzi.

Jeśli chcą Państwo szybko odnaleźć się w szerszym krajobrazie modeli AI i efektywnie z nich korzystać, polecam zacząć od naszego programu AI Fundamentals.