Programa

Na semana passada, o GPT-Realtime-2 da OpenAI elevou o patamar da IA de voz ao chegar com raciocínio no nível do GPT-5 e janela de contexto de 128K. Agora, o Thinking Machines Lab, de Mira Murati, traz um argumento diferente: que responsividade e inteligência devem ser treinadas no mesmo modelo desde o início, e não acopladas depois com camadas de detecção de atividade de voz e componentes de gerenciamento de diálogo.

O laboratório chama esse novo tipo de modelo de "Interaction Model".

O preview da pesquisa, TML-Interaction-Small, é o primeiro resultado dessa abordagem. É um modelo Mixture-of-Experts com 276 bilhões de parâmetros e 12 bilhões ativos. Ele processa áudio, vídeo e texto em microturnos contínuos de 200 ms, o que significa que percebe e responde ao mesmo tempo, em vez de esperar o interlocutor terminar.

Neste artigo, explico o que é o TML-Interaction-Small, apresento seus principais recursos de arquitetura, comparo diretamente com o GPT-Realtime-2 e analiso em detalhes os resultados de benchmark.

O que são Interaction Models?

O Thinking Machines Lab descreve um interaction model como um sistema em que a interatividade faz parte do próprio modelo, e não é implementada em camadas externas. O princípio central é que responsividade e inteligência devem ser treinadas juntas desde o início, em fluxos contínuos de áudio e vídeo, em vez de acopladas depois a um modelo baseado em texto.

A maioria dos sistemas atuais de IA de voz em tempo real costura componentes de detecção de atividade de voz, codificadores separados e camadas de gerenciamento de diálogo para simular responsividade. O Thinking Machines Lab argumenta que essa abordagem sempre ficará atrás de modelos que lidam com a interação de forma nativa, por causa de limites artificiais de turnos que restringem o que o modelo não interativo consegue fazer.

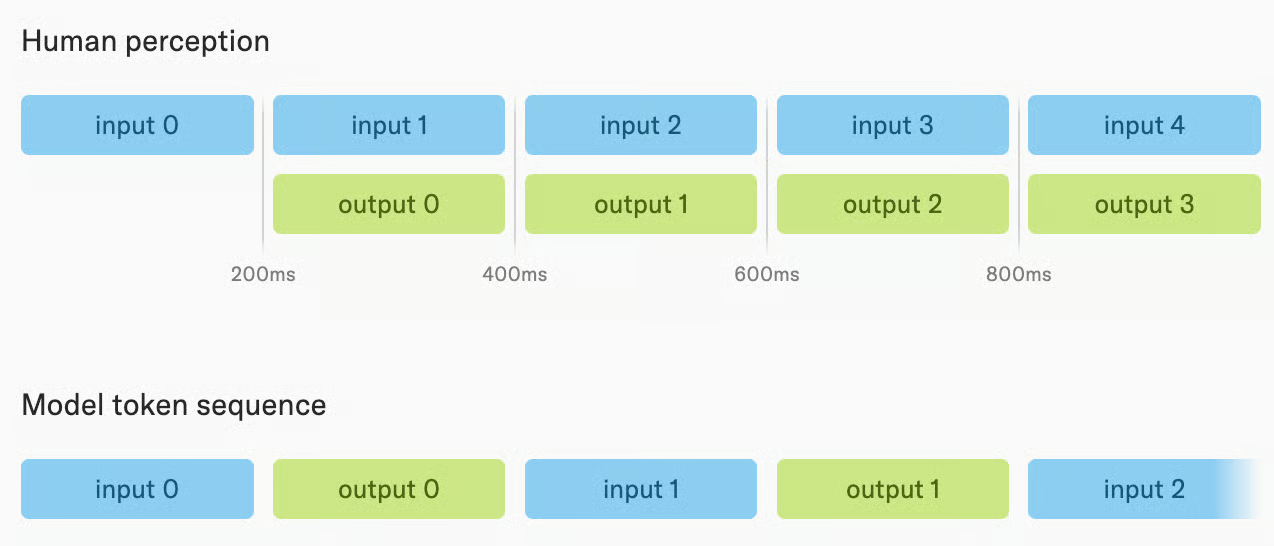

Em vez de consumir a entrada do usuário de forma sequencial e só então gerar uma resposta completa, os interaction models do laboratório foram projetados para se aproximar mais da percepção humana. Eles tratam tokens de entrada e de saída como fluxos, intercalados dentro de cada microturno de 200 milissegundos.

Assim, um interaction model percebe e responde ao mesmo tempo, processando entrada e saída em paralelo, em vez de esperar o interlocutor terminar. Isso permite algumas habilidades interessantes:

Assim, um interaction model percebe e responde ao mesmo tempo, processando entrada e saída em paralelo, em vez de esperar o interlocutor terminar. Isso permite algumas habilidades interessantes:

- Falar enquanto ouve

- Reagir a pistas visuais sem ser provocado

- Acompanhar o tempo decorrido diretamente

Tudo isso são coisas que modelos por turnos com camadas externas não conseguem replicar, independentemente do nível de raciocínio que tenham.

O que é o TML-Interaction-Small?

O TML-Interaction-Small é o primeiro modelo público do Thinking Machines Lab e a primeira implementação da arquitetura de interaction model.

É um modelo Mixture-of-Experts com 276 bilhões de parâmetros e 12 bilhões ativos, treinado do zero em fluxos contínuos de áudio e vídeo usando o design de microturnos multistream que descrevi acima, no qual entrada e saída são processadas em blocos de 200 ms.

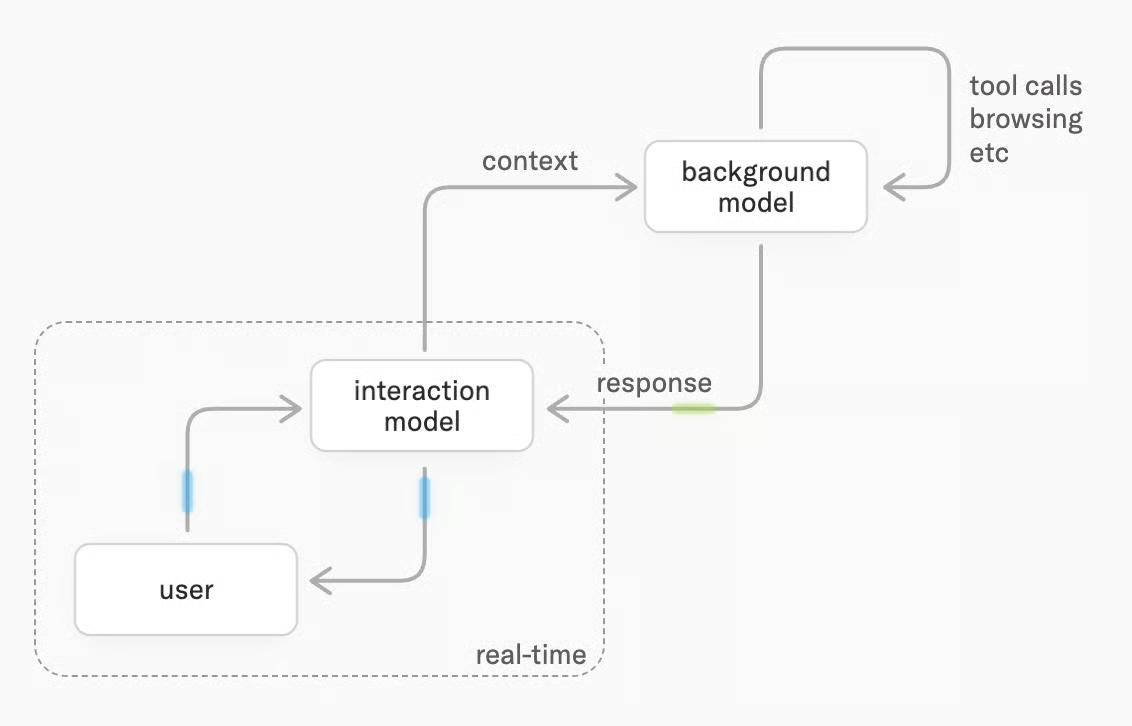

A combinação de dois modelos com um contexto compartilhado oferece tanto responsividade quanto inteligência. Os usuários recebem respostas do interaction model em tempo real, enquanto planejamento, uso de ferramentas e raciocínio mais profundo são delegados ao modelo de segundo plano, que roda de forma assíncrona.

O interaction model então integra os resultados de segundo plano à conversa conforme chegam, sem sair do fluxo da interação.

Recursos do TML-Interaction-Small

Enquanto os modelos de voz existentes funcionam por turnos (você fala, eles respondem), o TML-Interaction-Small se comporta mais como um parceiro de conversa humano. Estes são os quatro diferenciais que o destacam.

Fale e ouça ao mesmo tempo

O TML-Interaction-Small consegue produzir fala enquanto você ainda está falando. Isso viabiliza tradução simultânea: você fala em um idioma, e o modelo começa a traduzir antes de você terminar a frase. Também significa que o modelo pode intervir no meio da sentença quando detectar um erro, ou dar sinais verbais ("entendi", "pode continuar") enquanto você ainda está explicando algo.

Isso também é útil para respostas personalizadas em tempo real sempre que ocorrer um evento específico no prompt. Um clipe nas notas de lançamento, por exemplo, mostra o modelo convertendo valores em EUR e informando os valores correspondentes em USD sempre que o usuário menciona um pagamento.

Veja e reaja a vídeo sem ser solicitado

O TML-Interaction-Small processa vídeo junto com áudio e pode iniciar a fala com base no que vê, sem nenhum comando verbal.

Se você estiver fazendo flexões em frente à câmera, ele pode contar as repetições em voz alta conforme acontecem. Se um objeto relevante aparecer no stream de vídeo, ele pode destacá-lo no momento em que fica visível. No entanto, esse recurso ainda pode melhorar, como mostra a métrica interna RepCount-A, na qual apenas um terço (33,4%) das instâncias ficou a uma repetição do valor real.

Um clipe do lançamento (que parece um pouco curioso, na minha opinião) demonstra isso na prática: quando solicitado a prestar atenção à postura da usuária, o modelo detectou a curvatura no notebook instantaneamente e a lembrou de corrigir.

APIs comerciais de tempo real existentes são apenas de áudio. Elas respondem a turnos falados, mas não conseguem reagir proativamente a mudanças visuais. Essa é uma capacidade que simplesmente não existe hoje no GPT-Realtime-2 ou no Gemini Live.

Lide com interrupções e autocorreções de forma natural

Se você começa uma frase, muda de ideia e se corrige no meio do pensamento, o TML-Interaction-Small acompanha a correção e responde ao que você realmente quis dizer. Ele lida com backchanneling (você dizendo "uh-huh" ou "certo" enquanto ele fala) e diferencia alguém falando com ele de alguém falando com outra pessoa no ambiente.

Esses são cenários em que modelos por turnos costumam falhar. Ou eles param de falar quando não deveriam, ou respondem à parte errada do que foi dito. Vai ser interessante ver se o TML-Interaction-Small consegue lidar com isso no dia a dia tão bem quanto nos vídeos de demonstração.

Execute tarefas complexas em segundo plano sem sair da conversa

O modelo de segundo plano é o que torna o interaction model não apenas rápido, mas também inteligente. Você pode continuar fazendo perguntas de acompanhamento ou mudar de assunto enquanto a tarefa de fundo roda. Quando os resultados ficam prontos, o modelo os reintegra na conversa no momento mais natural, em vez de interromper com uma troca brusca de contexto.

Isso significa que você tem respostas rápidas na conversa e, ao mesmo tempo, a capacidade de lidar com tarefas de múltiplas etapas que normalmente fariam o modelo ficar em silêncio por vários segundos. Em um clipe de quiz, isso funciona muito bem: três usuários fazem perguntas de trivia em ritmo acelerado, e o modelo consegue, na maioria das vezes, acompanhar a velocidade.

Benchmarks do TML-Interaction-Small

O Thinking Machines reporta resultados em duas categorias: benchmarks de streaming, que medem interatividade, e benchmarks por turnos, que medem inteligência. Os resultados mais fortes do modelo estão no lado de streaming, onde suas escolhas de arquitetura são testadas de forma mais direta.

Interatividade

O FD-bench v1.5 fornece ao modelo áudios pré-gravados e mede seu comportamento em quatro cenários:

- Interrupção do usuário

- Backchannel do usuário

- Falando com outras pessoas

- Fala de fundo

O TML-Interaction-Small marca 77,8, contra 54,3 do Gemini-3.1-flash-live-preview nas configurações mínimas e 46,8 do GPT-Realtime-2.0 nas configurações mínimas. Mesmo no nível mais alto de raciocínio (xhigh), o GPT-Realtime-2.0 alcança apenas 47,8.

Esse é o benchmark que mede de forma mais direta o objetivo do Thinking Machines. Uma diferença de 30 pontos sobre o concorrente mais próximo não é marginal. A questão é se o FD-bench v1.5 captura toda a gama de interatividade que importa na prática, algo que o próprio Thinking Machines reconhece ser uma questão em aberto na pesquisa.

Latência de tomada de turno

O TML-Interaction-Small atinge uma latência de tomada de turno de 0,40 segundo no FD-bench v1, a mais rápida entre os modelos comparados. O Gemini-3.1-flash-live-preview chega mais perto, com 0,57 segundo. Mesmo nas configurações mínimas, o GPT-Realtime-2.0 leva cerca de três vezes mais (1,18 segundo); no modo xhigh, chega a 1,63 segundo.

Latência importa muito mais na interação por voz do que em texto. Um intervalo de 1,2 segundo entre o fim da fala do usuário e o início da resposta do modelo não só é perceptível como também quebra o ritmo. O resultado de 0,40 segundo coloca o TML-Interaction-Small mais próximo dos tempos de resposta de uma conversa humana.

Inteligência e seguimento de instruções

O Audio MultiChallenge mede inteligência e capacidade de seguir instruções em áudio. O TML-Interaction-Small marca 43,4%, acima do GPT-Realtime-1.5 (34,7%) e do Gemini-3.1-flash-live-preview (26,8%), mas abaixo do GPT-Realtime-2.0 em xhigh (48,5%). É aqui que aparece o trade-off entre inteligência e interatividade.

A diferença entre o TML-Interaction-Small e o GPT-Realtime-2.0 em xhigh é de 5,1 pontos percentuais. É uma diferença relevante, mas não enorme, e vem acompanhada de um custo significativo de latência no GPT-Realtime-2.0 (1,63 s versus 0,40 s). Se vale a pena, depende da aplicação.

Qualidade de resposta e uso de ferramentas

O FD-bench v3 mede qualidade de resposta e precisão em chamadas de ferramentas em cenários de áudio + ferramentas. O TML-Interaction-Small marca 82,8% em qualidade de resposta e 68,0% de pass@1 com o agente de segundo plano ativado, contra 80,0% / 52,0% do GPT-Realtime-2.0 nas configurações mínimas e 81,0% / 58,0% em xhigh.

A diferença em pass@1 (68,0% versus 58,0%) é o número mais importante aqui, pois mede se o modelo conclui corretamente tarefas que dependem de ferramentas. Parece que a arquitetura dupla, que separa as chamadas de ferramenta da interação com o usuário, compensa.

Novos benchmarks de interatividade: TimeSpeak, CueSpeak e proatividade visual

O Thinking Machines criou dois benchmarks internos e adaptou três benchmarks menos difundidos para medir capacidades de interatividade diretamente. Vale analisar com atenção, porque nenhum modelo concorrente tem desempenho significativo em qualquer um deles.

- TimeSpeak (início de fala cronometrado): o TML-Interaction-Small marca 64,7% de macro-accuracy.

- CueSpeak (fala acionada por pistas verbais): o TML-Interaction-Small marca 81,7% de macro-accuracy.

- RepCount-A (contagem de ações visuais): o TML-Interaction-Small marca 33,4% de acerto off-by-one.

- ProactiveVideoQA (fala acionada por pistas visuais): o TML-Interaction-Small marca 31,5 PAUC (baseline sem resposta = 25,0%).

- Charades temporal localization (temporalização de ações visuais): o TML-Interaction-Small marca 30,4 mIoU.

Na maioria desses novos benchmarks, o GPT-Realtime-2.0 falha completamente, com resultado próximo de zero, ou até zero (no Charades, que exige dizer "start" e "stop" nos momentos certos durante um vídeo).

É difícil afirmar o quão significativos são esses resultados, já que os benchmarks são novos e ainda não foram validados de forma independente, mas eles reforçam o quadro geral das diferenças de arquitetura e os resultados comparáveis de benchmark.

Preço e disponibilidade do TML-Interaction-Small

O TML-Interaction-Small está em um preview de pesquisa limitado, sem detalhes de preço anunciados. O Thinking Machines planeja abrir o acesso mais amplamente ao longo de 2026. Pesquisadores e desenvolvedores interessados podem contatar a equipe em interaction@thinkingmachines.ai para solicitar acesso.

Para comparação, o GPT-Realtime-2 custa US$ 32 por milhão de tokens de entrada de áudio e US$ 64 por milhão de tokens de saída de áudio, como explicamos na nossa visão geral do GPT-Realtime-2. Os preços do TML-Interaction-Small provavelmente serão anunciados junto com o lançamento mais amplo.

Como você deve ter notado, o modelo tem o sufixo "-Small", e faz sentido esperar que o Thinking Machines lance versões maiores na sequência. Elas ainda estão lentas demais para servir, mas um lançamento está previsto para o fim de 2026.

TML-Interaction-Small vs. GPT-Realtime-2

A diferença mais interessante entre os dois modelos está nos benchmarks de interatividade. No FD-bench v1.5, que mede comportamento em interrupção do usuário, backchannel, conversa com terceiros e fala de fundo, o TML-Interaction-Small marca 77,8. O GPT-Realtime-2.0 nas configurações mínimas marca 46,8, e no nível mais alto de raciocínio (xhigh), 47,8. É uma diferença de 30 pontos no benchmark que mais diretamente mede o foco de otimização do Thinking Machines.

Existe um trade-off de inteligência, mas a diferença aqui é bem menor que na interatividade. O GPT-Realtime-2.0 em xhigh marca 48,5% no Audio MultiChallenge, contra 43,4% do TML-Interaction-Small. No BigBench Audio, o GPT-Realtime-2.0 em high fica com 96,6% contra 75,7% do TML-Interaction-Small (embora o TML-Interaction-Small chegue a 96,5% com o agente de segundo plano ativado).

O panorama geral é: o TML-Interaction-Small lidera em responsividade e interatividade, enquanto o GPT-Realtime-2.0, em configurações altas de raciocínio, lidera nos benchmarks de inteligência bruta.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (mínimo) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (mínimo) |

|---|---|---|---|---|

| FD-bench v1 latência de tomada de turno (s) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 média | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 qualidade da resposta (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio acurácia (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) acurácia (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval texto acurácia (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* Com agente de segundo plano ativado.

Para ver a família de modelos de áudio da OpenAI em ação, confira nosso tutorial da API do GPT-Realtime-2.

Considerações finais

O TML-Interaction-Small parece promissor. Se cumprir o que promete nas notas de lançamento, o novo modelo traz interatividade bem melhor com baixa latência, sem sacrificar qualidade de resposta ou poder de raciocínio. A capacidade de falar, ouvir e reagir a pistas visuais ao mesmo tempo é única até agora e abre muitas possibilidades. Estou curioso para ver a política de preços quando o modelo for lançado publicamente.

A diferença de inteligência para o GPT-Realtime-2 é real, mas menor do que a diferença de interatividade. Para aplicações em que a conversa precisa soar natural, essa diferença de latência pesa mais do que a diferença de inteligência. Para aplicações em que a precisão em tarefas de raciocínio difícil é prioridade, o GPT-Realtime-2.0 em configurações altas de raciocínio ainda leva vantagem.

Se você quer se atualizar sobre o panorama mais amplo de modelos de IA e como trabalhar com eles de forma eficaz, recomendo começar pela nossa trilha de habilidades AI Fundamentals.

Editor de Ciência de Dados @ DataCamp | Fazer previsões e construir com APIs é a minha paixão.