track

Chiar săptămâna trecută, GPT-Realtime-2 de la OpenAI a ridicat ștacheta pentru AI vocal odată cu lansarea sa, oferind raționare de clasă GPT-5 și o fereastră de context de 128K. Acum, Thinking Machines Lab, condus de Mira Murati, propune altceva: că receptivitatea și inteligența ar trebui antrenate împreună, de la zero, în același model, nu lipite ulterior prin harnașamente de detecție a activității vocale și componente de gestionare a dialogului.

Laboratorul numește acest tip de model nou „Model de interacțiune”.

Previzualizarea lor de cercetare, TML-Interaction-Small, este primul rezultat al acestei abordări. Este un model Mixture-of-Experts cu 276 de miliarde de parametri și 12 miliarde de parametri activi. Procesează audio, video și text în micro-ture continue de 200 ms, ceea ce înseamnă că percepe și răspunde simultan, în loc să aștepte ca vorbitorul să termine.

În acest articol, voi prezenta ce este TML-Interaction-Small, voi parcurge principalele sale caracteristici arhitecturale, voi compara direct cu GPT-Realtime-2 și voi analiza în detaliu rezultatele benchmark-urilor.

Ce sunt modelele de interacțiune?

Thinking Machines Lab descrie un model de interacțiune ca pe un sistem în care interactivitatea face parte din modelul însuși, nu este implementată într-un harnașament periferic. Principiul de bază este că receptivitatea și inteligența ar trebui antrenate împreună, de la zero, pe fluxuri continue de audio și video, nu adăugate ulterior peste un model bazat pe text.

Majoritatea sistemelor AI vocale în timp real existente îmbină componente de detecție a activității vocale, encodere separate și straturi de gestionare a dialogului pentru a simula receptivitatea. Thinking Machines Lab susține că această abordare va rămâne mereu în urma modelelor care gestionează nativ interacțiunea, din cauza limitelor impuse de granițele artificiale ale turelor, care constrâng ceea ce poate face modelul non-interactiv.

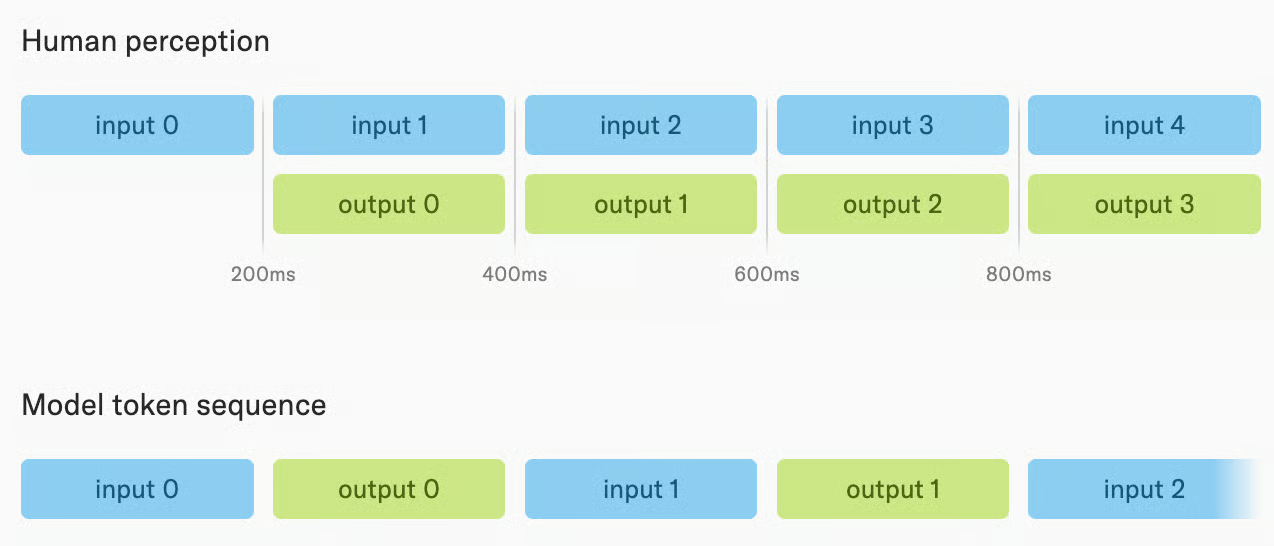

În loc să consume secvențial intrarea utilizatorului și apoi să genereze un răspuns complet, modelele de interacțiune ale laboratorului sunt proiectate să fie mai apropiate de percepția umană. Ele tratează atât tokenii de intrare, cât și pe cei de ieșire ca fluxuri, intercalate în fiecare micro-tură de 200 de milisecunde.

La rândul său, un model de interacțiune percepe și răspunde simultan, procesând intrarea și ieșirea în paralel, în loc să aștepte ca vorbitorul să termine. Acest lucru permite câteva abilități interesante:

La rândul său, un model de interacțiune percepe și răspunde simultan, procesând intrarea și ieșirea în paralel, în loc să aștepte ca vorbitorul să termine. Acest lucru permite câteva abilități interesante:

- Să vorbească în timp ce ascultă

- Să reacționeze la indicii vizuale fără a fi întrebat

- Să urmărească direct timpul scurs

Toate acestea sunt lucruri pe care modelele pe ture, cu harnașamente externe, nu le pot replica, indiferent câtă capacitate de raționare au.

Ce este TML-Interaction-Small?

TML-Interaction-Small este primul model publicat de Thinking Machines Lab și prima implementare a arhitecturii lor de model de interacțiune.

Este un model Mixture-of-Experts cu 276 de miliarde de parametri și 12 miliarde de parametri activi, antrenat de la zero pe fluxuri continue de audio și video folosind designul cu micro-ture multi-flux descris mai devreme, în care intrarea și ieșirea sunt procesate în bucăți de 200 ms.

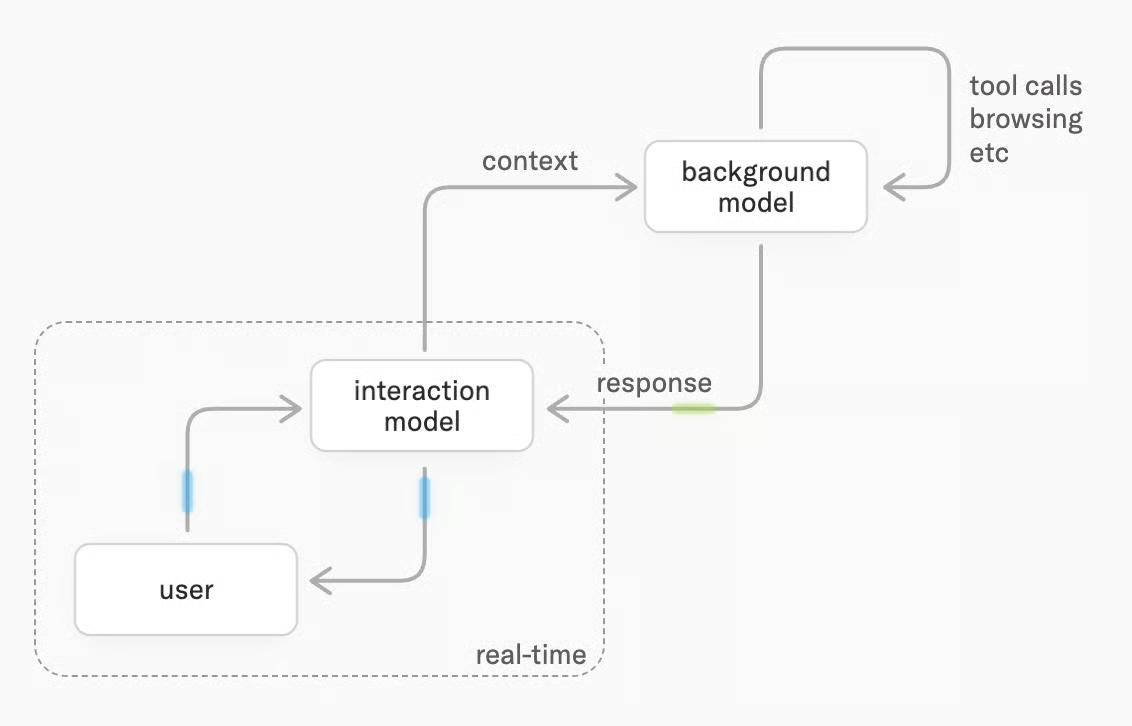

Combinarea a două modele cu un context partajat oferă atât receptivitate, cât și inteligență. Utilizatorii primesc răspunsuri de la modelul de interacțiune în timp real, în timp ce planificarea, folosirea uneltelor și raționarea mai profundă sunt delegate modelului de fundal, care rulează asincron.

Modelul de interacțiune integrează apoi rezultatele de fundal în conversație pe măsură ce sosesc, fără a ieși din dialog.

Funcțiile TML-Interaction-Small

În timp ce modelele vocale existente funcționează pe rând (dumneavoastră vorbiți, ele răspund), TML-Interaction-Small se apropie mai mult de un partener uman de conversație. Iată cele patru capabilități care îl diferențiază.

Să vorbească și să asculte în același timp

TML-Interaction-Small poate produce vorbire în timp ce utilizatorul încă vorbește. Acest lucru face posibilă traducerea simultană: vorbiți într-o limbă, iar modelul începe traducerea înainte să terminați propoziția. De asemenea, modelul poate interveni la mijlocul unei propoziții când detectează o eroare sau poate oferi indicii verbale („înțeles”, „continuați”) cât timp încă explicați ceva.

Acest lucru este util și pentru răspunsuri personalizate în timp real ori de câte ori are loc un anumit eveniment menționat. Un clip din notele de lansare, de pildă, arată cum modelul convertește sume în EUR și anunță sumele corespunzătoare în USD ori de câte ori utilizatorul menționează o plată.

Să „vadă” și să reacționeze la video fără a fi întrebat

TML-Interaction-Small procesează video alături de audio și poate iniția vorbirea pe baza a ceea ce vede, fără nicio solicitare verbală.

Dacă faceți flotări în fața camerei, poate număra repetările cu voce tare pe măsură ce se întâmplă. Dacă un obiect relevant apare într-un flux video, îl poate semnala în momentul în care devine vizibil. Totuși, aceasta este o funcție care poate fi îmbunătățită, așa cum reiese din scorul intern RepCount-A, unde doar o treime (33,4%) dintre instanțe au fost la o repetare distanță de adevărul de teren.

Un clip din lansare (care pare puțin năstrușnic, după părerea mea) demonstrează acest lucru în acțiune: Când i s-a cerut să urmărească postura utilizatoarei, modelul a detectat imediat cocoșarea la laptop și i-a amintit să o corecteze.

API-urile comerciale în timp real existente sunt doar audio. Ele răspund la ture vorbite, dar nu pot reacționa proactiv la schimbări vizuale. Aceasta este o capabilitate care pur și simplu nu există astăzi în GPT-Realtime-2 sau Gemini Live.

Să gestioneze întreruperile și autocorectările natural

Dacă începeți o propoziție, vă răzgândiți și vă corectați pe parcurs, TML-Interaction-Small urmărește corecția și răspunde la ceea ce ați intenționat de fapt. Gestionează backchanneling-ul (dumneavoastră spuneți „mhm” sau „da” în timp ce el vorbește) și distinge între cineva care i se adresează lui și cineva care vorbește cu altcineva din încăpere.

Acestea sunt scenarii în care modelele pe ture cedează frecvent. Fie se opresc din vorbit când nu ar trebui, fie răspund la partea greșită din ceea ce s-a spus. Va fi interesant de văzut dacă TML-Interaction-Small se descurcă la fel de bine în situații cotidiene ca în clipurile demo curate.

Să ruleze sarcini complexe în fundal, rămânând prezent

Modelul de fundal este cel care face ca modelul de interacțiune să fie nu doar rapid, ci și inteligent. Puteți continua cu întrebări suplimentare sau puteți schimba subiectul în timp ce sarcina de fundal rulează. Când rezultatele sunt gata, modelul le reintroduce în conversație într-un moment natural, în loc să vă întrerupă cu o schimbare bruscă de context.

Asta înseamnă că obțineți atât răspunsuri conversaționale rapide, cât și capacitatea de a gestiona sarcini în mai mulți pași care, în mod normal, ar necesita ca modelul să tacă câteva secunde. Într-un clip cu un quiz, acest lucru funcționează destul de bine: Trei utilizatori pun întrebări de cultură generală într-un ritm alert, iar modelul reușește în mare parte să țină pasul.

Benchmark-uri pentru TML-Interaction-Small

Thinking Machines raportează rezultate în două categorii: benchmark-uri de streaming care măsoară interactivitatea și benchmark-uri pe ture care măsoară inteligența. Cele mai puternice rezultate ale modelului sunt pe partea de streaming, acolo unde alegerile sale arhitecturale sunt testate cel mai direct.

Interactivitate

FD-bench v1.5 oferă modelului audio preînregistrat și îi măsoară comportamentul în patru scenarii:

- Întreruperea utilizatorului

- Backchannel al utilizatorului

- Vorbirea către alții

- Vorbire de fundal

TML-Interaction-Small obține 77,8, comparativ cu 54,3 pentru Gemini-3.1-flash-live-preview la setări minimale și 46,8 pentru GPT-Realtime-2.0 la setări minimale. Chiar și GPT-Realtime-2.0 la cel mai înalt nivel de raționare (xhigh) obține doar 47,8.

Acesta este benchmark-ul care măsoară cel mai direct ceea ce urmărește să construiască Thinking Machines. Un ecart de 30 de puncte față de cel mai apropiat competitor nu este o diferență marginală. Întrebarea este dacă FD-bench v1.5 surprinde întreaga gamă de interactivitate care contează în practică, lucru pe care chiar Thinking Machines îl recunoaște ca fiind o chestiune deschisă de cercetare.

Întârzierea la preluarea turei

TML-Interaction-Small atinge o întârziere de 0,40 secunde în FD-bench v1, cea mai rapidă dintre toate modelele comparate. Gemini-3.1-flash-live-preview se apropie cu 0,57 secunde. Chiar și la setări minimale, GPT-Realtime-2.0 are nevoie de aproximativ de trei ori mai mult (1,18 secunde); la raționare xhigh, GPT-Realtime-2.0 ajunge la 1,63 secunde.

Întârzierea contează mult mai mult pentru interacțiunea vocală decât pentru text. Un decalaj de 1,2 secunde între momentul în care utilizatorul termină de vorbit și momentul în care modelul începe să răspundă nu este doar perceptibil, ci și perturbator. Rezultatul de 0,40 secunde apropie TML-Interaction-Small de timpii de răspuns conversațional umani.

Inteligență și urmarea instrucțiunilor

Audio MultiChallenge măsoară inteligența și urmarea instrucțiunilor în audio. TML-Interaction-Small obține 43,4%, peste GPT-Realtime-1.5 (34,7%) și Gemini-3.1-flash-live-preview (26,8%), dar sub GPT-Realtime-2.0 la xhigh (48,5%). Aici este vizibil compromis-ul între inteligență și interactivitate.

Diferența dintre TML-Interaction-Small și GPT-Realtime-2.0 la xhigh este de 5,1 puncte procentuale. Este o diferență semnificativă, dar nu mare, și vine cu un cost important de latență pe partea GPT-Realtime-2.0 (1,63 secunde versus 0,40 secunde). Dacă merită acest compromis depinde de aplicație.

Calitatea răspunsului și folosirea uneltelor

FD-bench v3 măsoară calitatea răspunsului și acuratețea apelurilor de unelte în scenarii audio-plus-unelte. TML-Interaction-Small obține 82,8% calitatea răspunsului și 68,0% pass@1 cu agentul de fundal activat, comparativ cu 80,0% / 52,0% pentru GPT-Realtime-2.0 la setări minimale și 81,0% / 58,0% la xhigh.

Diferența la pass@1 (68,0% față de 58,0%) este cifra cea mai semnificativă aici, deoarece măsoară dacă modelul finalizează corect sarcinile dependente de unelte. Se pare că arhitectura duală, care separă apelurile de unelte de interacțiunile cu utilizatorul, dă roade.

Benchmark-uri noi de interactivitate: TimeSpeak, CueSpeak și proactivitate vizuală

Thinking Machines a creat două benchmark-uri interne și a adaptat trei benchmark-uri mai puțin utilizate pentru a măsura direct capabilitățile de interactivitate. Merită analizate atent, deoarece niciun model concurent nu performează semnificativ la vreunul dintre ele.

- TimeSpeak (inițiere temporizată a vorbirii): TML-Interaction-Small obține 64,7% macro-acuratețe.

- CueSpeak (vorbire declanșată de indicii verbale): TML-Interaction-Small obține 81,7% macro-acuratețe.

- RepCount-A (numărarea acțiunilor vizuale): TML-Interaction-Small obține 33,4% acuratețe off-by-one.

- ProactiveVideoQA (vorbire declanșată de indicii vizuale): TML-Interaction-Small obține 31,5 PAUC (bază fără răspuns = 25,0%).

- Charades localizare temporală (temporizarea acțiunilor vizuale): TML-Interaction-Small obține 30,4 mIoU.

La majoritatea acestor benchmark-uri noi, GPT realtime-2.0 eșuează complet, cu un rezultat aproape de zero sau chiar zero (la benchmark-ul Charades, care cere modelului să spună „start” și „stop” la momentele potrivite dintr-un video).

Îmi este greu să spun cât de semnificative sunt aceste rezultate, întrucât benchmark-urile sunt noi și încă nevalidate independent, dar ele se aliniază cu imaginea generală a diferențelor arhitecturale și a rezultatelor comparabile din benchmark-uri.

Prețuri și disponibilitate pentru TML-Interaction-Small

TML-Interaction-Small se află în prezent într-o previzualizare limitată pentru cercetare, iar detalii de preț nu au fost anunțate. Thinking Machines plănuiește să deschidă accesul mai larg mai târziu în 2026. Cercetătorii și dezvoltatorii interesați pot contacta echipa la interaction@thinkingmachines.ai pentru a solicita acces.

Pentru comparație, GPT-Realtime-2 are un preț de 32 USD per milion de tokene audio de intrare și 64 USD per milion de tokene audio de ieșire, așa cum am acoperit în prezentarea noastră GPT-Realtime-2. Prețurile pentru TML-Interaction-Small vor fi probabil anunțate odată cu lansarea mai largă.

După cum probabil ați observat, modelul are sufixul „-Small”, și aveți dreptate să vă așteptați ca Thinking Machines să vină cu modele mai mari. Acestea sunt încă prea lente pentru producție, dar o lansare este planificată pentru sfârșitul lui 2026.

TML-Interaction-Small vs. GPT-Realtime-2

Diferența mai interesantă între cele două modele este în benchmark-urile de interactivitate. La FD-bench v1.5, care măsoară comportamentul în caz de întrerupere a utilizatorului, backchanneling, vorbirea către alții și vorbirea de fundal, TML-Interaction-Small obține 77,8. GPT-Realtime-2.0 la setări minimale obține 46,8, iar la cel mai înalt nivel de raționare (xhigh) obține 47,8. Este un ecart de 30 de puncte la benchmark-ul care măsoară cel mai direct ceea ce optimizează Thinking Machines.

Există un compromis pe partea de inteligență, dar diferența aici este mult mai mică decât la interactivitate. GPT-Realtime-2.0 la xhigh obține 48,5% la Audio MultiChallenge, față de 43,4% pentru TML-Interaction-Small. La BigBench Audio, GPT-Realtime-2.0 la high obține 96,6% față de 75,7% pentru TML-Interaction-Small (deși TML-Interaction-Small ajunge la 96,5% cu agentul de fundal activat).

Imaginea generală care reiese este că TML-Interaction-Small conduce la capitolele receptivitate și interactivitate, în timp ce GPT-Realtime-2.0 la setări înalte de raționare conduce la benchmark-urile de inteligență brută.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 întârziere preluare tură (s) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 medie | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 calitatea răspunsului (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio acuratețe (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) acuratețe (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval text acuratețe (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* Cu agentul de fundal activat.

Pentru a vedea familia de modele audio a OpenAI în acțiune, consultați tutorialul nostru despre API-ul GPT-Realtime-2.

Gânduri finale

TML-Interaction-Small arată promițător. Dacă își confirmă afirmațiile din notele de lansare, noul model aduce o interactivitate semnificativ îmbunătățită, cu latență redusă, fără a sacrifica calitatea răspunsului sau capacitatea de raționare. Abilitatea de a vorbi, asculta și răspunde simultan la indicii vizuale este, deocamdată, unică și deschide multe posibilități. Sunt curios să văd cum vor arăta prețurile la lansarea publică.

Diferența de inteligență față de GPT-Realtime-2 este reală, dar mai îngustă decât diferența de interactivitate. Pentru aplicațiile în care conversația trebuie să se simtă naturală, acea diferență de latență contează mai mult decât diferența de inteligență. Pentru aplicațiile în care prioritatea este acuratețea pe sarcini de raționare dificile, GPT-Realtime-2.0 la setări înalte de raționare este încă înainte.

Dacă doriți să vă puneți rapid la curent cu peisajul mai larg al modelelor AI și cum să lucrați eficient cu ele, vă recomand să începeți cu traseul de competențe AI Fundamentals.