Program

Baru minggu lalu, GPT-Realtime-2 dari OpenAI menaikkan standar AI suara saat diluncurkan dengan penalaran setara GPT-5 dan jendela konteks 128K. Kini, Thinking Machines Lab milik Mira Murati menyampaikan argumen berbeda: bahwa daya tanggap dan kecerdasan sebaiknya dilatih dalam model yang sama sejak awal, bukan ditambal dengan rangkaian voice-activity-detection dan komponen manajemen dialog.

Lab menyebut tipe model baru ini sebagai "Model Interaksi."

Pratinjau riset mereka, TML-Interaction-Small, adalah hasil pertama dari pendekatan ini. Model ini adalah Mixture-of-Experts 276B parameter dengan 12B parameter aktif. Ia memproses audio, video, dan teks dalam micro-turn berkelanjutan 200 ms, artinya ia menangkap dan merespons secara bersamaan alih-alih menunggu penutur selesai.

Dalam artikel ini, saya akan membahas apa itu TML-Interaction-Small, menelusuri fitur arsitektur utamanya, membandingkannya langsung dengan GPT-Realtime-2, dan melihat hasil benchmark secara rinci.

Apa Itu Model Interaksi?

Thinking Machines Lab mendeskripsikan model interaksi sebagai sistem di mana interaktivitas merupakan bagian dari model itu sendiri, bukan diimplementasikan melalui rangka luar. Prinsip intinya adalah bahwa daya tanggap dan kecerdasan harus dilatih bersama sejak awal pada aliran audio dan video kontinu, bukan ditambahkan kemudian ke model berbasis teks.

Kebanyakan sistem AI suara real-time saat ini merangkai komponen voice-activity-detection, encoder terpisah, dan lapisan manajemen dialog untuk meniru daya tanggap. Thinking Machines Lab berargumen pendekatan ini akan selalu tertinggal dari model yang menangani interaksi secara native karena adanya batas giliran buatan yang membatasi kemampuan model non-interaktif.

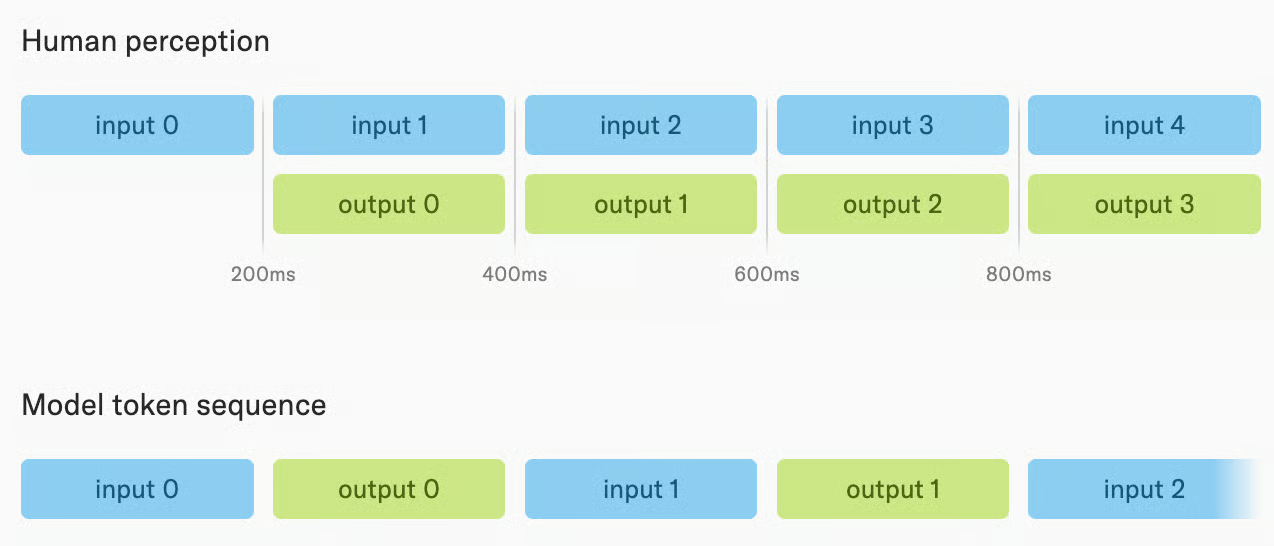

Alih-alih mengonsumsi masukan pengguna secara berurutan lalu menghasilkan respons lengkap, model interaksi lab dirancang lebih mendekati persepsi manusia. Mereka memperlakukan token masukan dan keluaran sebagai aliran, dan keduanya diselingkan pada setiap micro-turn berdurasi 200 milidetik.

Sebaliknya, model interaksi menangkap dan merespons secara bersamaan, memproses input dan output secara paralel alih-alih menunggu penutur selesai. Ini memungkinkan beberapa kemampuan menarik:

Sebaliknya, model interaksi menangkap dan merespons secara bersamaan, memproses input dan output secara paralel alih-alih menunggu penutur selesai. Ini memungkinkan beberapa kemampuan menarik:

- Berbicara sambil mendengarkan

- Bereaksi terhadap isyarat visual tanpa diminta

- Melacak waktu yang berlalu secara langsung

Semua ini adalah hal-hal yang tidak dapat direplikasi oleh model berbasis giliran dengan rangka eksternal, terlepas dari seberapa besar kemampuan penalarannya.

Apa itu TML-Interaction-Small?

TML-Interaction-Small adalah rilis model publik pertama Thinking Machines Lab dan implementasi perdana arsitektur model interaksi mereka.

Ini adalah model Mixture-of-Experts dengan 276B parameter dan 12B parameter aktif, dilatih dari nol pada aliran audio dan video berkelanjutan menggunakan desain micro-turn multi-stream seperti yang saya jelaskan sebelumnya, di mana masukan dan keluaran diproses dalam potongan 200 ms.

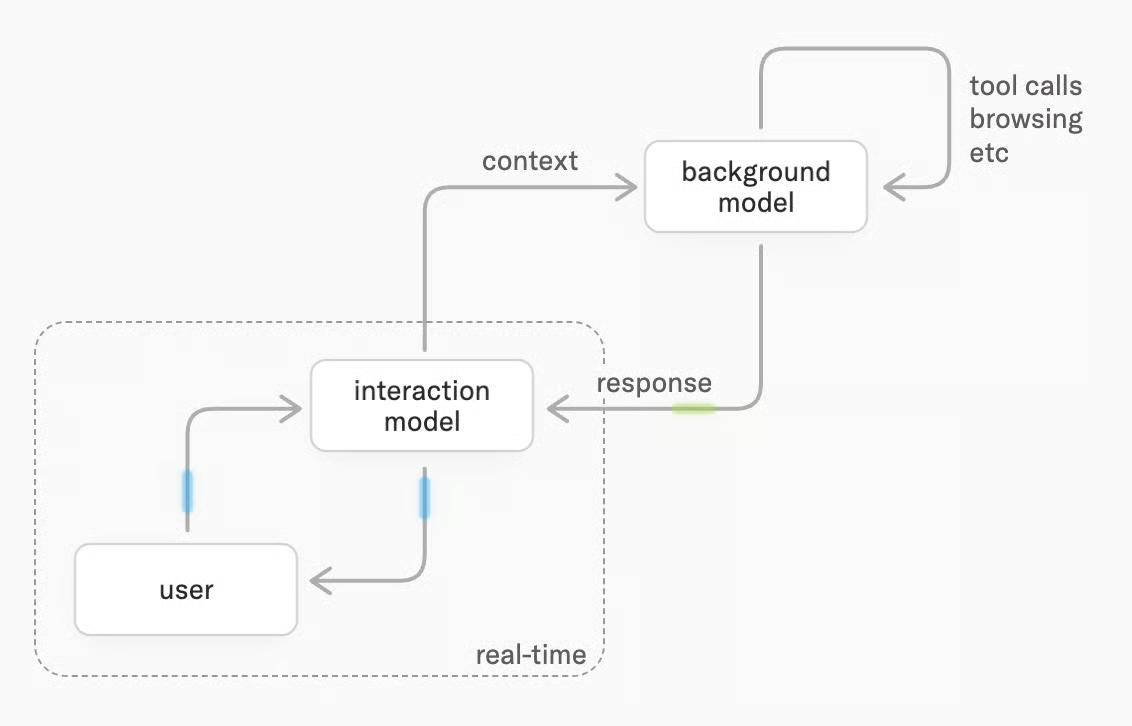

Kombinasi dua model dengan konteks bersama menawarkan baik daya tanggap maupun kecerdasan. Pengguna menerima jawaban dari model interaksi secara real-time, sementara perencanaan, penggunaan alat, dan penalaran lebih dalam didelegasikan ke model latar yang berjalan secara asinkron.

Model interaksi kemudian mengintegrasikan hasil latar ke dalam percakapan saat hasil tersebut tiba, tanpa keluar dari percakapan.

Fitur TML-Interaction-Small

Jika model AI suara yang ada bergiliran (Anda berbicara, mereka merespons), TML-Interaction-Small bekerja lebih seperti rekan percakapan manusia. Berikut empat kemampuan yang membedakannya.

Berbicara dan mendengarkan secara bersamaan

TML-Interaction-Small dapat menghasilkan ucapan saat pengguna masih berbicara. Ini memungkinkan terjemahan simultan: Anda berbicara dalam satu bahasa, dan model mulai menerjemahkan sebelum kalimat Anda selesai. Ini juga berarti model dapat menyela di tengah kalimat ketika mendeteksi kesalahan, atau memberi isyarat verbal ("baik," "lanjutkan") saat Anda masih menjelaskan sesuatu.

Ini juga berguna untuk respons real-time kustom ketika suatu peristiwa tertentu yang dipicu terjadi. Salah satu klip dalam catatan rilis, misalnya, menunjukkan bagaimana model mengonversi jumlah EUR dan menyebutkan jumlah USD yang sesuai setiap kali pengguna menyebutkan pembayaran.

Melihat dan bereaksi terhadap video tanpa diminta

TML-Interaction-Small memproses video bersamaan dengan audio dan dapat memulai ucapan berdasarkan apa yang dilihatnya, tanpa prompt verbal apa pun.

Jika Anda melakukan push-up di kamera, model dapat menghitung repetisi dengan suara saat itu terjadi. Jika objek relevan muncul dalam aliran video, model dapat menyebutkannya saat objek tersebut terlihat. Namun, fitur ini masih bisa ditingkatkan, terlihat dari skor internal RepCount-A, di mana hanya sepertiga (33,4%) kejadian yang berada dalam selisih satu repetisi dari nilai kebenaran.

Salah satu klip rilis (yang menurut saya agak unik) menunjukkan hal ini: Saat diminta memperhatikan postur pengguna, model mendeteksi posisi membungkuk di depan laptop seketika dan mengingatkannya untuk memperbaikinya.

API real-time komersial yang ada saat ini hanya audio. Mereka merespons giliran bicara tetapi tidak punya cara untuk bereaksi secara proaktif terhadap perubahan visual. Ini adalah kemampuan yang saat ini belum ada di GPT-Realtime-2 atau Gemini Live.

Menangani interupsi dan koreksi diri secara natural

Jika Anda mulai berbicara, berubah pikiran, dan mengoreksi diri di tengah kalimat, TML-Interaction-Small melacak koreksi tersebut dan merespons apa yang sebenarnya Anda maksud. Model ini menangani backchanneling (Anda berkata "uh-huh" atau "ya" saat model berbicara) dan membedakan antara seseorang yang berbicara dengannya versus berbicara dengan orang lain di ruangan.

Ini adalah skenario di mana model berbasis giliran sering kali gagal. Mereka berhenti berbicara saat tidak seharusnya, atau merespons bagian yang salah dari ucapan. Akan menarik untuk melihat apakah TML-Interaction-Small dapat menanganinya dalam situasi sehari-hari sebaik di video demo yang dikurasi.

Menjalankan tugas kompleks di latar sambil tetap hadir

Model latar membuat model interaksi tidak hanya cepat, tetapi juga cerdas. Anda dapat terus mengajukan pertanyaan lanjutan atau mengganti topik saat tugas latar berjalan. Ketika hasil siap, model menyelipkannya kembali ke percakapan pada momen yang alami alih-alih menginterupsi Anda dengan pergantian konteks mendadak.

Ini berarti Anda mendapatkan respons percakapan yang cepat sekaligus kemampuan menangani tugas bertahap yang biasanya membuat model harus hening selama beberapa detik. Dalam klip demo kuis, ini bekerja cukup baik: Tiga pengguna mengajukan pertanyaan trivia dengan tempo tinggi, dan model sebagian besar dapat mengikuti kecepatannya.

Benchmark TML-Interaction-Small

Thinking Machines melaporkan hasil pada dua kategori: benchmark streaming yang mengukur interaktivitas, dan benchmark berbasis giliran yang mengukur kecerdasan. Hasil terkuat model ada pada sisi streaming, tempat pilihan arsitekturnya paling langsung diuji.

Interaktivitas

FD-bench v1.5 memberikan model audio prarekam dan mengukur perilakunya dalam empat skenario:

- Interupsi pengguna

- Backchannel pengguna

- Berbicara dengan orang lain

- Ucapan latar

TML-Interaction-Small meraih skor 77,8, dibandingkan 54,3 untuk Gemini-3.1-flash-live-preview pada pengaturan minimal dan 46,8 untuk GPT-Realtime-2.0 pada pengaturan minimal. Bahkan GPT-Realtime-2.0 pada pengaturan penalaran tertinggi (xhigh) hanya meraih 47,8.

Ini adalah benchmark yang paling langsung mengukur tujuan pembangunan Thinking Machines. Kesenjangan 30 poin dibanding pesaing terdekat bukanlah perbedaan kecil. Pertanyaannya apakah FD-bench v1.5 menangkap seluruh rentang interaktivitas yang relevan dalam praktik, yang juga diakui Thinking Machines sebagai pertanyaan riset terbuka.

Latensi pergantian giliran

TML-Interaction-Small mencapai latensi pergantian giliran 0,40 detik di FD-bench v1, yang tercepat di antara model yang dibandingkan. Gemini-3.1-flash-live-preview mendekati dengan 0,57 detik. Bahkan pada pengaturan minimal, GPT-Realtime-2.0 memerlukan waktu sekitar tiga kali lebih lama (1,18 detik); pada penalaran xhigh, GPT-Realtime-2.0 mencapai 1,63 detik.

Latensi sangat penting untuk interaksi suara dengan cara yang tidak terjadi pada teks. Kesenjangan 1,2 detik antara saat pengguna selesai berbicara dan saat model mulai merespons tidak hanya terasa, tetapi juga mengganggu. Hasil 0,40 detik menempatkan TML-Interaction-Small lebih mendekati waktu respons percakapan manusia.

Kecerdasan dan kepatuhan instruksi

Audio MultiChallenge mengukur kecerdasan dan kepatuhan instruksi dalam audio. TML-Interaction-Small meraih 43,4%, di atas GPT-Realtime-1.5 (34,7%) dan Gemini-3.1-flash-live-preview (26,8%), namun di bawah GPT-Realtime-2.0 pada xhigh (48,5%). Di sinilah trade-off kecerdasan–interaktivitas terlihat.

Selisih antara TML-Interaction-Small dan GPT-Realtime-2.0 pada xhigh adalah 5,1 poin persentase. Itu signifikan, namun tidak besar, dan disertai biaya latensi yang signifikan di sisi GPT-Realtime-2.0 (1,63 detik versus 0,40 detik). Apakah trade-off itu layak tergantung aplikasinya.

Kualitas respons dan penggunaan alat

FD-bench v3 mengukur kualitas respons dan akurasi pemanggilan alat pada skenario audio-plus-tools. TML-Interaction-Small meraih 82,8% kualitas respons dan 68,0% pass@1 dengan agen latar diaktifkan, dibandingkan 80,0% / 52,0% untuk GPT-Realtime-2.0 pada pengaturan minimal dan 81,0% / 58,0% pada xhigh.

Kesenjangan pass@1 (68,0% versus 58,0%) adalah angka paling bermakna di sini, karena mengukur apakah model benar-benar menyelesaikan tugas yang bergantung pada alat dengan benar. Tampaknya arsitektur ganda yang memisahkan pemanggilan alat dari interaksi pengguna membuahkan hasil.

Benchmark interaktivitas baru: TimeSpeak, CueSpeak, dan proaktivitas visual

Thinking Machines membuat dua benchmark internal dan mengadaptasi tiga benchmark yang kurang umum untuk mengukur kemampuan interaktivitas secara langsung. Ini layak ditelaah cermat karena tidak ada model pesaing yang berkinerja berarti pada salah satunya.

- TimeSpeak (inisiasi ucapan terjadwal): TML-Interaction-Small meraih 64,7% akurasi makro.

- CueSpeak (ucapan dipicu isyarat verbal): TML-Interaction-Small meraih 81,7% akurasi makro.

- RepCount-A (penghitungan aksi visual): TML-Interaction-Small meraih 33,4% akurasi off-by-one.

- ProactiveVideoQA (ucapan dipicu isyarat visual): TML-Interaction-Small meraih 31,5 PAUC (baseline tanpa respons = 25,0%).

- Charades temporal localization (penentuan waktu aksi visual): TML-Interaction-Small meraih 30,4 mIoU.

Pada sebagian besar benchmark baru ini, GPT realtime-2.0 benar-benar gagal, dengan hasil mendekati nol, atau bahkan nol (pada benchmark Charades, yang mengharuskan model mengatakan "mulai" dan "berhenti" pada momen yang tepat selama video).

Sulit bagi saya untuk mengatakan seberapa bermakna hasil ini, karena benchmark tersebut baru dan belum divalidasi secara independen, tetapi hasilnya konsisten dengan gambaran umum perbedaan arsitektur dan hasil benchmark yang sebanding.

Harga dan ketersediaan TML-Interaction-Small

Saat ini TML-Interaction-Small berada dalam pratinjau riset terbatas, dan belum ada rincian harga yang diumumkan. Thinking Machines berencana membuka akses yang lebih luas pada akhir 2026. Peneliti dan pengembang yang berminat dapat menghubungi tim di interaction@thinkingmachines.ai untuk meminta akses.

Sebagai perbandingan, GPT-Realtime-2 dihargai $32 per satu juta token input audio dan $64 per satu juta token output audio, seperti yang kami bahas dalam ulasan GPT-Realtime-2. Harga TML-Interaction-Small kemungkinan akan diumumkan bersamaan dengan rilis yang lebih luas.

Seperti yang mungkin Anda perhatikan, model ini memiliki akhiran "-Small", dan benar jika Anda mengharapkan Thinking Machines akan menyusul dengan model yang lebih besar. Model tersebut masih terlalu lambat untuk disajikan, tetapi rilis direncanakan pada akhir 2026.

TML-Interaction-Small vs. GPT-Realtime-2

Kesenjangan yang lebih menarik antara kedua model ada pada benchmark interaktivitas. Pada FD-bench v1.5, yang mengukur perilaku terkait interupsi pengguna, backchanneling, berbicara dengan orang lain, dan ucapan latar, TML-Interaction-Small meraih 77,8. GPT-Realtime-2.0 pada pengaturan minimal meraih 46,8, dan pada pengaturan penalaran tertinggi (xhigh) meraih 47,8. Itu adalah selisih 30 poin pada benchmark yang paling langsung mengukur fokus optimasi Thinking Machines.

Ada trade-off kecerdasan, tetapi kesenjangannya jauh lebih kecil dibanding interaktivitas. GPT-Realtime-2.0 pada xhigh meraih 48,5% pada Audio MultiChallenge versus 43,4% untuk TML-Interaction-Small. Pada BigBench Audio, GPT-Realtime-2.0 pada high meraih 96,6% versus 75,7% untuk TML-Interaction-Small (meskipun TML-Interaction-Small mencapai 96,5% dengan agen latar diaktifkan).

Gambaran umum yang muncul adalah TML-Interaction-Small memimpin dalam daya tanggap dan interaktivitas, sementara GPT-Realtime-2.0 pada pengaturan penalaran tinggi memimpin pada benchmark kecerdasan murni.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 turn-taking latency (d) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 rata-rata | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 kualitas respons (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| Akurasi BigBench Audio (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| Akurasi IFEval (VoiceBench) (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| Akurasi teks IFEval (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* Dengan agen latar diaktifkan.

Untuk melihat keluarga model audio OpenAI beraksi, lihat tutorial API GPT-Realtime-2 kami.

Pikiran penutup

TML-Interaction-Small terlihat menjanjikan. Jika sesuai dengan klaim dalam catatan rilis, model baru ini menghadirkan interaktivitas yang meningkat signifikan dengan latensi singkat, tanpa mengorbankan kualitas respons atau kemampuan bernalar. Kemampuan untuk berbicara, mendengarkan, dan merespons isyarat visual secara simultan sejauh ini unik dan menawarkan banyak kemungkinan. Saya penasaran melihat seperti apa harga saat model dirilis untuk publik.

Kesenjangan kecerdasan dengan GPT-Realtime-2 memang ada namun lebih sempit daripada kesenjangan interaktivitas. Untuk aplikasi di mana percakapan harus terasa natural, perbedaan latensi itu lebih penting ketimbang kesenjangan kecerdasan. Untuk aplikasi di mana akurasi pada tugas penalaran sulit menjadi prioritas, GPT-Realtime-2.0 pada pengaturan penalaran tinggi masih unggul.

Jika Anda ingin memahami lanskap model AI yang lebih luas dan cara bekerja dengannya secara efektif, saya sarankan mulai dengan AI Fundamentals skill track kami.

Tom adalah seorang ilmuwan data dan pendidik teknis. Ia menulis dan mengelola tutorial serta artikel blog ilmu data DataCamp. Sebelumnya, Tom bekerja di bidang ilmu data di Deutsche Telekom.