Cursus

La semaine dernière, GPT-Realtime-2 d’OpenAI a relevé la barre de la voix IA avec un raisonnement de niveau GPT-5 et une fenêtre de contexte de 128K. Désormais, le Thinking Machines Lab de Mira Murati avance une thèse différente : la réactivité et l’intelligence doivent être entraînées ensemble dans un même modèle dès le départ, plutôt que greffées a posteriori via des systèmes de détection d’activité vocale et des couches de gestion de dialogue.

Le laboratoire appelle ce nouveau type de modèle un « modèle d’interaction ».

Leur aperçu de recherche, TML-Interaction-Small, est le premier résultat de cette approche. Il s’agit d’un modèle Mixture-of-Experts de 276 milliards de paramètres, avec 12 milliards de paramètres actifs. Il traite l’audio, la vidéo et le texte en micro-tours continus de 200 ms, ce qui signifie qu’il perçoit et répond simultanément au lieu d’attendre la fin de l’interlocuteur.

Dans cet article, je présente ce qu’est TML-Interaction-Small, j’examine ses principales caractéristiques d’architecture, je le compare directement à GPT-Realtime-2, et j’analyse en détail les résultats des benchmarks.

Qu’est-ce qu’un modèle d’interaction ?

Thinking Machines Lab décrit un modèle d’interaction comme un système où l’interactivité fait partie intégrante du modèle, et non un ajout via une surcouche. Le principe clé : réactivité et intelligence doivent être entraînées ensemble, dès le départ, sur des flux audio et vidéo continus, plutôt que d’être ajoutées après coup à un modèle textuel.

La plupart des systèmes voix IA en temps réel actuels assemblent des composants de détection d’activité vocale, des encodeurs distincts et des couches de gestion de dialogue pour simuler la réactivité. Thinking Machines Lab soutient que cette approche restera toujours en retrait par rapport aux modèles qui gèrent l’interaction nativement, à cause de frontières artificielles de tours qui limitent les capacités d’un modèle non interactif.

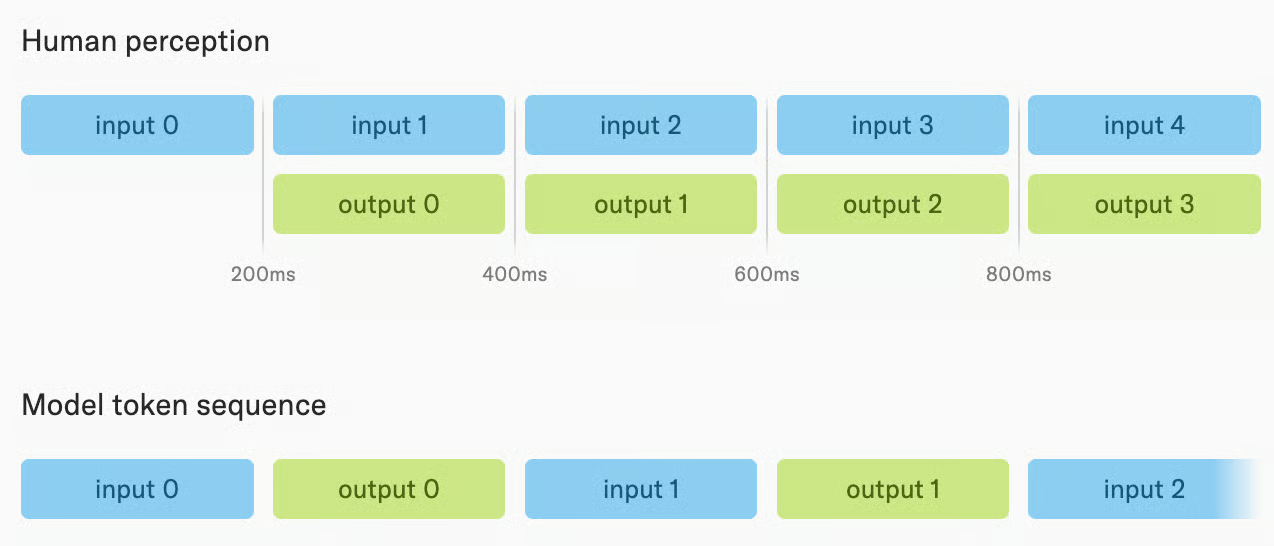

Au lieu d’ingérer séquentiellement l’entrée utilisateur avant de générer une réponse complète, les modèles d’interaction du labo se rapprochent de la perception humaine. Ils traitent les jetons d’entrée et de sortie comme des flux, entrelacés à chaque micro-tour de 200 millisecondes.

Ainsi, un modèle d’interaction perçoit et répond simultanément, en traitant l’entrée et la sortie en parallèle plutôt que d’attendre la fin du locuteur. Cela permet plusieurs aptitudes intéressantes :

Ainsi, un modèle d’interaction perçoit et répond simultanément, en traitant l’entrée et la sortie en parallèle plutôt que d’attendre la fin du locuteur. Cela permet plusieurs aptitudes intéressantes :

- Parler tout en écoutant

- Réagir aux signaux visuels sans sollicitation

- Suivre le temps écoulé directement

Autant de choses qu’un modèle à tours avec surcouches externes ne peut pas reproduire, quel que soit son niveau de raisonnement.

Qu’est-ce que TML-Interaction-Small ?

TML-Interaction-Small est la première version publique du Thinking Machines Lab et la première implémentation de leur architecture de modèle d’interaction.

C’est un modèle Mixture-of-Experts de 276 milliards de paramètres, avec 12 milliards de paramètres actifs, entraîné from scratch sur des flux audio et vidéo continus via le design multi-flux en micro-tours décrit plus haut, où entrées et sorties sont traitées par tranches de 200 ms.

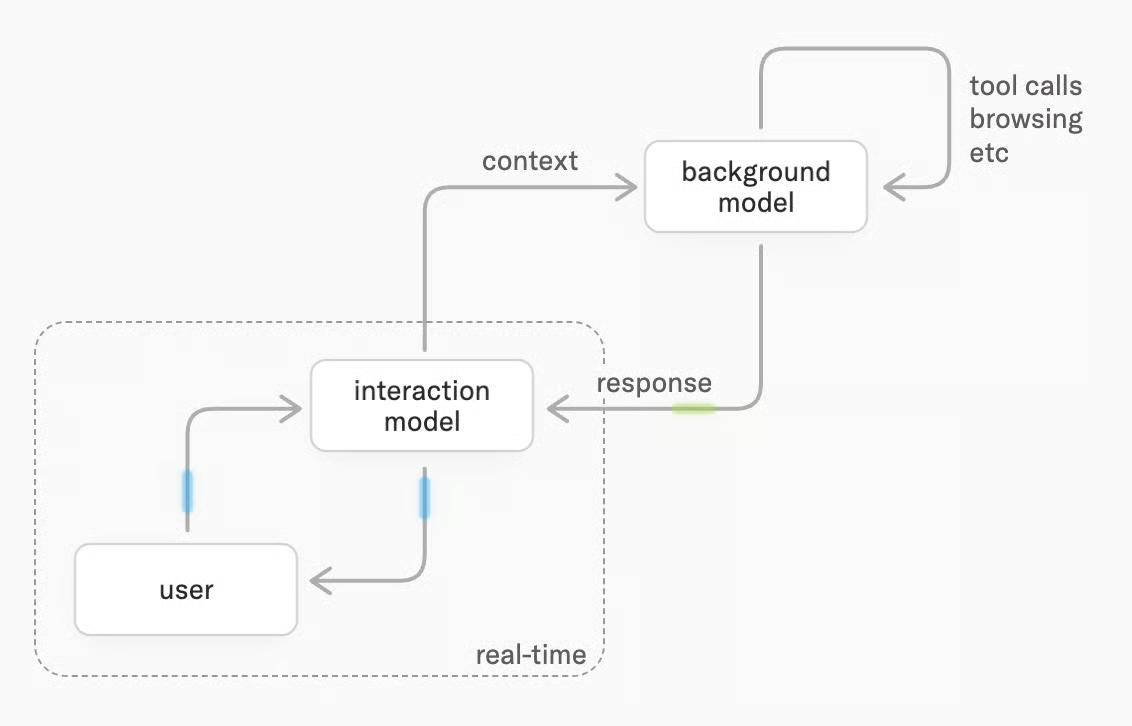

La combinaison de deux modèles partageant le même contexte offre à la fois réactivité et intelligence. Les utilisateurs reçoivent des réponses en temps réel du modèle d’interaction, tandis que la planification, l’usage d’outils et le raisonnement approfondi sont délégués au modèle d’arrière-plan, exécuté de façon asynchrone.

Le modèle d’interaction intègre ensuite les résultats d’arrière-plan dans l’échange au fil de l’eau, sans quitter la conversation.

Fonctionnalités de TML-Interaction-Small

Là où les modèles voix existants fonctionnent par tours (vous parlez, ils répondent), TML-Interaction-Small se comporte davantage comme un interlocuteur humain. Voici les quatre capacités qui le distinguent.

Parler et écouter en même temps

TML-Interaction-Small peut produire de la parole alors que vous êtes encore en train de parler. Cela rend possible la traduction simultanée : vous parlez dans une langue, et le modèle commence à traduire avant la fin de votre phrase. Il peut aussi intervenir en plein milieu d’une phrase lorsqu’il détecte une erreur, ou donner des signaux verbaux (« compris », « allez-y ») pendant que vous expliquez.

C’est également utile pour des réponses personnalisées en temps réel lorsqu’un événement donné survient. Une des vidéos de la note de version montre par exemple comment le modèle convertit des montants en EUR et annonce les montants correspondants en USD à chaque fois qu’un paiement est mentionné.

Voir et réagir à la vidéo sans sollicitation

TML-Interaction-Small traite la vidéo en parallèle de l’audio et peut initier la parole en fonction de ce qu’il voit, sans aucune requête verbale.

Si vous faites des pompes à la caméra, il peut compter les répétitions à voix haute en direct. Si un objet pertinent apparaît dans un flux vidéo, il peut le signaler au moment où il devient visible. Cette capacité reste toutefois perfectible, comme le montre le score interne RepCount-A, où seulement un tiers (33,4 %) des cas sont à une répétition près de la vérité terrain.

Une vidéo de démonstration (un peu décalée à mon goût) l’illustre : lorsqu’on lui demande de surveiller la posture de l’utilisatrice, le modèle détecte instantanément l’affaissement devant l’ordinateur portable et lui rappelle de se redresser.

Les API commerciales temps réel existantes sont limitées à l’audio. Elles répondent aux tours parlés mais ne peuvent pas réagir proactivement aux changements visuels. C’est une capacité tout simplement absente de GPT-Realtime-2 et de Gemini Live aujourd’hui.

Gérer naturellement interruptions et autocorrections

Si vous commencez une phrase, changez d’avis et vous corrigez en cours de route, TML-Interaction-Small suit la correction et répond à votre intention réelle. Il gère le backchannel (quand vous dites « hm-hm » ou « d’accord » pendant qu’il parle) et distingue quelqu’un qui s’adresse à lui de quelqu’un qui parle à une autre personne dans la pièce.

Ce sont des situations où les modèles à tours échouent souvent : ils s’arrêtent quand il ne faut pas, ou répondent à la mauvaise partie de l’énoncé. Il sera intéressant de voir si TML-Interaction-Small tient la route en conditions réelles autant que dans des démos soignées.

Exécuter des tâches complexes en arrière-plan sans quitter l’échange

Le modèle d’arrière-plan rend le modèle d’interaction non seulement rapide, mais aussi intelligent. Vous pouvez enchaîner les questions de relance ou changer de sujet pendant que la tâche d’arrière-plan s’exécute. Lorsque les résultats sont prêts, le modèle les réinsère dans la conversation au bon moment, sans vous interrompre brutalement.

Vous obtenez ainsi à la fois des réponses rapides en conversation et la capacité à gérer des tâches multi-étapes qui, normalement, imposeraient quelques secondes de silence. Dans une démo de quiz, cela fonctionne plutôt bien : trois utilisateurs posent des questions de culture générale à cadence soutenue, et le modèle suit globalement le rythme.

Benchmarks de TML-Interaction-Small

Thinking Machines publie des résultats dans deux catégories : des benchmarks de streaming qui mesurent l’interactivité, et des benchmarks à tours qui mesurent l’intelligence. Les meilleurs scores du modèle se situent côté streaming, là où ses choix d’architecture sont mis à l’épreuve de la manière la plus directe.

Interactivité

FD-bench v1.5 fournit au modèle de l’audio préenregistré et évalue son comportement sur quatre scénarios :

- Interruption par l’utilisateur

- Backchannel de l’utilisateur

- Conversation avec d’autres personnes

- Parole en arrière-plan

TML-Interaction-Small obtient 77,8, contre 54,3 pour Gemini-3.1-flash-live-preview aux réglages minimaux et 46,8 pour GPT-Realtime-2.0 aux réglages minimaux. Même au niveau de raisonnement maximal (xhigh), GPT-Realtime-2.0 n’atteint que 47,8.

C’est le benchmark qui mesure le plus directement l’objectif de Thinking Machines. Un écart de 30 points sur le concurrent le plus proche n’a rien d’anecdotique. La question reste de savoir si FD-bench v1.5 couvre tout le spectre d’interactivité pertinent en pratique – un point que Thinking Machines reconnaît comme une question de recherche ouverte.

Latence de prise de tour

TML-Interaction-Small atteint une latence de prise de tour de 0,40 seconde sur FD-bench v1, le meilleur score des modèles comparés. Gemini-3.1-flash-live-preview s’en approche avec 0,57 seconde. Même aux réglages minimaux, GPT-Realtime-2.0 met environ trois fois plus de temps (1,18 seconde) ; en xhigh, GPT-Realtime-2.0 monte à 1,63 seconde.

La latence compte beaucoup plus en interaction vocale qu’en texte. Un décalage de 1,2 seconde entre la fin de la prise de parole et le début de la réponse est non seulement perceptible, mais aussi perturbant. Avec 0,40 seconde, TML-Interaction-Small se rapproche des temps de réponse d’une conversation humaine.

Intelligence et suivi d’instructions

Audio MultiChallenge mesure l’intelligence et le suivi d’instructions en audio. TML-Interaction-Small atteint 43,4 %, au-dessus de GPT-Realtime-1.5 (34,7 %) et de Gemini-3.1-flash-live-preview (26,8 %), mais en dessous de GPT-Realtime-2.0 en xhigh (48,5 %). C’est ici que le compromis intelligence–interactivité apparaît.

L’écart entre TML-Interaction-Small et GPT-Realtime-2.0 en xhigh est de 5,1 points. C’est notable, sans être massif, et il s’accompagne d’un coût de latence important côté GPT-Realtime-2.0 (1,63 seconde contre 0,40 seconde). La pertinence de ce compromis dépendra de l’usage.

Qualité des réponses et usage d’outils

FD-bench v3 mesure la qualité des réponses et la précision des appels d’outils dans des scénarios audio+outils. TML-Interaction-Small enregistre 82,8 % de qualité de réponse et 68,0 % en pass@1 avec l’agent d’arrière-plan activé, contre 80,0 % / 52,0 % pour GPT-Realtime-2.0 aux réglages minimaux et 81,0 % / 58,0 % en xhigh.

L’écart sur le pass@1 (68,0 % contre 58,0 %) est le plus parlant ici, car il mesure la bonne exécution des tâches dépendantes d’outils. L’architecture double qui sépare les appels d’outils des interactions utilisateur semble payer.

Nouveaux benchmarks d’interactivité : TimeSpeak, CueSpeak et proactivité visuelle

Thinking Machines a créé deux benchmarks internes et adapté trois benchmarks moins répandus pour mesurer directement les capacités d’interactivité. Ils méritent attention, car aucun modèle concurrent n’y performe de manière significative.

- TimeSpeak (déclenchement temporel de la parole) : TML-Interaction-Small obtient 64,7 % de macro-précision.

- CueSpeak (déclenchement par signal verbal) : TML-Interaction-Small obtient 81,7 % de macro-précision.

- RepCount-A (comptage d’actions visuelles) : TML-Interaction-Small obtient 33,4 % d’accuracy à une unité près.

- ProactiveVideoQA (déclenchement par indice visuel) : TML-Interaction-Small obtient 31,5 PAUC (base « pas de réponse » = 25,0 %).

- Charades temporal localization (timing d’actions visuelles) : TML-Interaction-Small obtient 30,4 mIoU.

Sur la plupart de ces nouveaux benchmarks, GPT-Realtime-2.0 échoue complètement, avec un score proche de zéro, voire nul (sur Charades, où il faut dire « start » et « stop » aux bons moments d’une vidéo).

Difficile de juger pleinement la portée de ces résultats, ces benchmarks étant nouveaux et pas encore validés indépendamment, mais ils confirment l’image générale : des différences d’architecture qui se traduisent par des performances contrastées.

Tarification et disponibilité de TML-Interaction-Small

TML-Interaction-Small est actuellement en aperçu de recherche limité, sans détails de tarification annoncés. Thinking Machines prévoit un accès élargi plus tard en 2026. Chercheurs et développeurs intéressés peuvent contacter l’équipe à interaction@thinkingmachines.ai pour demander un accès.

À titre de comparaison, GPT-Realtime-2 est facturé 32 $ par million de jetons audio en entrée et 64 $ par million de jetons audio en sortie, comme expliqué dans notre présentation de GPT-Realtime-2. Les prix de TML-Interaction-Small seront probablement annoncés lors de la mise à disposition plus large.

Comme vous l’avez sans doute remarqué, le modèle porte le suffixe « -Small », et vous avez raison d’anticiper que Thinking Machines proposera des modèles plus grands. Ils restent pour l’instant trop lents à servir, mais une sortie est prévue fin 2026.

TML-Interaction-Small vs GPT-Realtime-2

L’écart le plus intéressant entre les deux modèles concerne les benchmarks d’interactivité. Sur FD-bench v1.5, qui mesure le comportement face à l’interruption, au backchannel, aux conversations avec d’autres personnes et à la parole en arrière-plan, TML-Interaction-Small obtient 77,8. GPT-Realtime-2.0 aux réglages minimaux obtient 46,8, et en raisonnement maximal (xhigh) 47,8. Soit 30 points d’écart sur le benchmark le plus proche de l’objectif de Thinking Machines.

Il existe un compromis côté intelligence, mais l’écart est nettement plus réduit que pour l’interactivité. GPT-Realtime-2.0 en xhigh atteint 48,5 % sur Audio MultiChallenge contre 43,4 % pour TML-Interaction-Small. Sur BigBench Audio, GPT-Realtime-2.0 en high atteint 96,6 % contre 75,7 % pour TML-Interaction-Small (qui monte toutefois à 96,5 % avec l’agent d’arrière-plan activé).

L’image générale qui se dégage : TML-Interaction-Small domine en réactivité et interactivité, tandis que GPT-Realtime-2.0, aux réglages de raisonnement élevés, conserve l’avantage sur les benchmarks d’intelligence pure.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 – latence de prise de tour (s) | 0,40 | 1,18 | 1,63 | 0,57 |

| FD-bench v1.5 moyenne | 77,8 | 46,8 | 47,8 | 54,3 |

| FD-bench v3 – qualité de réponse (%) | 82,8* | 80,0 | 81,0 | 68,5 |

| Audio MultiChallenge APR (%) | 43,4 | 37,6 | 48,5 | 26,8 |

| BigBench Audio – exactitude (%) | 75,7 / 96,5* | 71,8 | 96,6 | 71,3 |

| IFEval (VoiceBench) – exactitude (%) | 82,1 | 81,7 | 83,2 | 67,6 |

| IFEval texte – exactitude (%) | 89,7 | 89,6 | 95,2 | 85,8 |

* Avec agent d’arrière-plan activé.

Pour voir la famille de modèles audio d’OpenAI en action, consultez notre tutoriel API GPT-Realtime-2.

Dernières réflexions

TML-Interaction-Small est prometteur. S’il tient les promesses de la note de version, ce nouveau modèle apporte une interactivité nettement améliorée avec une faible latence, sans sacrifier la qualité des réponses ni la capacité de raisonnement. La faculté de parler, d’écouter et de réagir aux signaux visuels simultanément est unique à ce jour et ouvre de nombreuses possibilités. J’ai hâte de découvrir la tarification lors de la sortie publique.

L’écart d’intelligence face à GPT-Realtime-2 est réel, mais plus étroit que l’écart d’interactivité. Pour les applications où la conversation doit paraître naturelle, la latence prime sur l’écart d’intelligence. Pour les cas où la précision sur des tâches de raisonnement difficiles est prioritaire, GPT-Realtime-2.0 aux réglages de raisonnement élevés garde l’avantage.

Pour vous repérer rapidement dans le paysage des modèles d’IA et apprendre à travailler efficacement avec eux, commencez par notre parcours de compétences AI Fundamentals.

FAQ sur TML-Interaction-Small

Qu’est-ce qu’un modèle d’interaction ?

Un modèle d’interaction est un système de voix IA où l’interactivité est intégrée au modèle lui-même, plutôt qu’ajoutée via des composants externes comme la détection d’activité vocale et la gestion de dialogue. Il traite simultanément l’entrée et la sortie, ce qui lui permet d’écouter et de parler en même temps, au lieu d’attendre son tour.

Qui est derrière Thinking Machines Lab ?

Thinking Machines Lab est dirigé par Mira Murati, ex-CTO d’OpenAI. TML-Interaction-Small est la première version publique du labo, présentée comme un aperçu de recherche de leur architecture de modèle d’interaction.

Comment TML-Interaction-Small se compare-t-il à GPT-Realtime-2 d’OpenAI ?

TML-Interaction-Small mène sur l’interactivité, avec un score de 77,8 sur FD-bench v1.5 contre 47,8 pour GPT-Realtime-2 à son réglage le plus élevé, et une latence de prise de tour plus faible (0,40 s contre 1,63 s). GPT-Realtime-2 garde l’avantage sur des benchmarks d’intelligence pure comme Audio MultiChallenge (48,5 % vs 43,4 %).

TML-Interaction-Small peut-il traiter la vidéo ?

Oui. Il traite la vidéo en parallèle de l’audio et peut réagir à des événements visuels sans sollicitation verbale de l’utilisateur, par exemple compter des répétitions d’exercices à la caméra ou signaler des objets à leur apparition. Cette proactivité visuelle n’existe pas dans GPT-Realtime-2 ni dans Gemini Live.

Rédacteur en chef Data Science chez DataCamp | Je suis passionné par la prévision et le développement à l'aide d'API.