Programma

Solo la scorsa settimana, GPT-Realtime-2 di OpenAI ha alzato l’asticella per la voice AI al lancio con capacità di ragionamento di classe GPT-5 e una finestra di contesto da 128K. Ora, il Thinking Machines Lab di Mira Murati propone un’idea diversa: reattività e intelligenza dovrebbero essere addestrate nello stesso modello fin dall’inizio, non assemblate dopo con imbracature di voice-activity-detection e componenti di gestione del dialogo.

Il laboratorio chiama questo nuovo tipo di modello “Interaction Model”.

La loro anteprima di ricerca, TML-Interaction-Small, è il primo risultato di questo approccio. È un modello Mixture-of-Experts da 276B parametri con 12B parametri attivi. Elabora audio, video e testo in micro-turni continui da 200 ms, il che significa che percepisce e risponde nello stesso momento invece di aspettare che l’oratore finisca.

In questo articolo, spiegherò cos’è TML-Interaction-Small, illustrerò le sue principali caratteristiche architetturali, comparerò direttamente con GPT-Realtime-2 e esaminerò nel dettaglio i risultati dei benchmark.

Cosa sono i modelli di interazione?

Il Thinking Machines Lab descrive un interaction model come un sistema in cui l’interattività è parte del modello stesso, non implementata in un’imbracatura esterna. Il principio cardine è che reattività e intelligenza vanno addestrate insieme da zero, su flussi continui di audio e video, invece di essere agganciate a posteriori a un modello basato su testo.

La maggior parte dei sistemi voice AI in tempo reale esistenti mette insieme componenti di rilevamento dell’attività vocale, encoder separati e livelli di gestione del dialogo per simulare la reattività. Il Thinking Machines Lab sostiene che questo approccio sarà sempre in ritardo rispetto ai modelli che gestiscono l’interazione in modo nativo, a causa di confini di turno artificiali che limitano ciò che un modello non interattivo può fare.

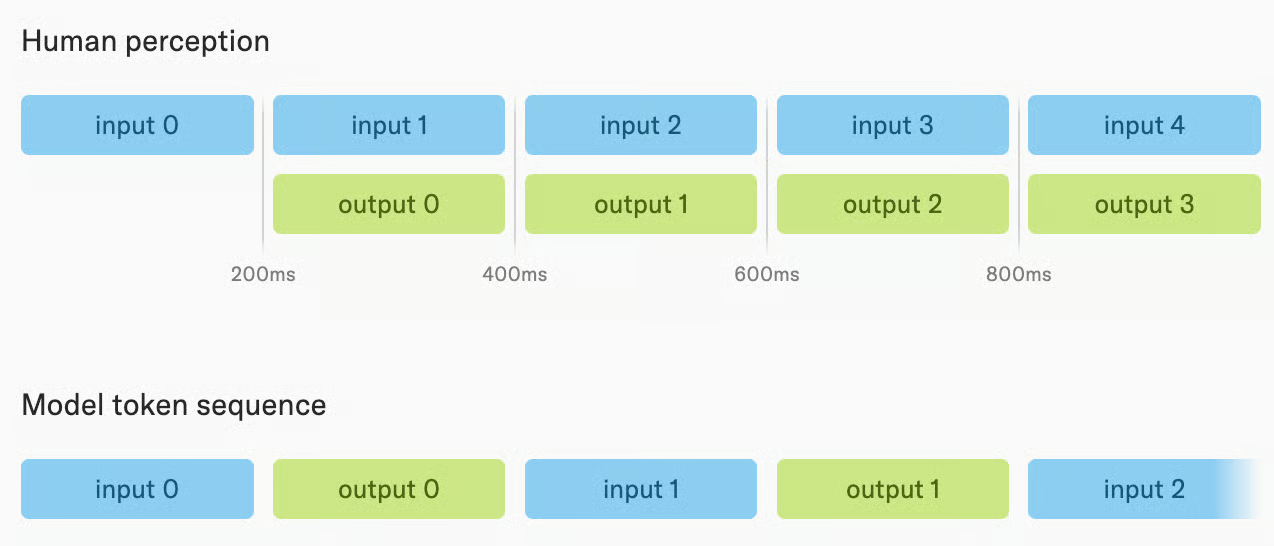

Invece di consumare sequenzialmente l’input dell’utente e poi generare una risposta completa, i modelli di interazione del laboratorio sono progettati per avvicinarsi di più alla percezione umana. Trattano sia i token di input sia quelli di output come flussi, intrecciandoli in ciascuno dei micro-turni di 200 millisecondi.

A sua volta, un interaction model percepisce e risponde nello stesso momento, elaborando input e output in parallelo invece di aspettare che l’oratore finisca. Questo abilita un paio di capacità interessanti:

A sua volta, un interaction model percepisce e risponde nello stesso momento, elaborando input e output in parallelo invece di aspettare che l’oratore finisca. Questo abilita un paio di capacità interessanti:

- Parlare mentre ascolta

- Reagire a segnali visivi senza essere sollecitato

- Tenere traccia del tempo trascorso direttamente

Queste sono tutte cose che i modelli a turni con imbracature esterne non possono replicare, a prescindere da quanta capacità di ragionamento abbiano.

Che cos’è TML-Interaction-Small?

TML-Interaction-Small è la prima release pubblica del Thinking Machines Lab e la prima implementazione della loro architettura di interaction model.

È un modello Mixture-of-Experts da 276B parametri con 12B parametri attivi, addestrato da zero su flussi continui di audio e video usando il design multi-stream a micro-turni descritto prima, in cui input e output sono elaborati in blocchi da 200 ms.

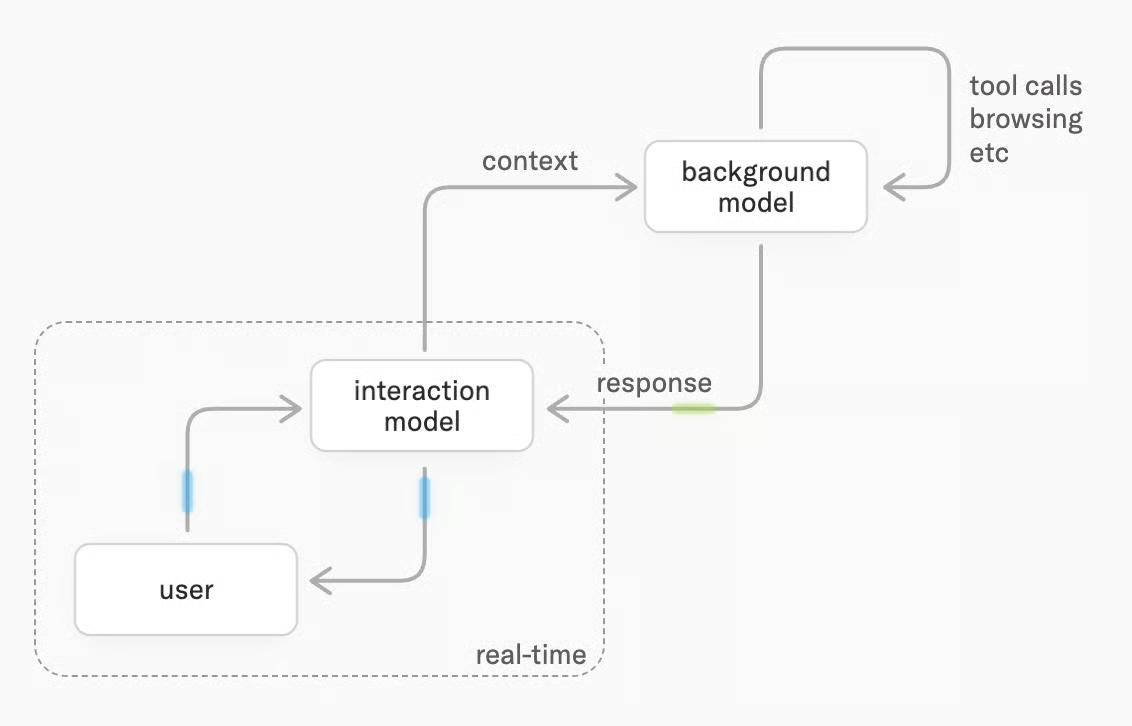

La combinazione di due modelli con un contesto condiviso offre sia reattività sia intelligenza. Gli utenti ricevono risposte dal modello di interazione in tempo reale, mentre pianificazione, uso di tool e ragionamento più profondo sono delegati al modello di background, che gira in modo asincrono.

Il modello di interazione integra poi i risultati di background nella conversazione man mano che arrivano, senza uscire dal flusso.

Funzionalità di TML-Interaction-Small

Mentre i modelli voice AI esistenti procedono a turni (tu parli, loro rispondono), TML-Interaction-Small funziona più come un partner di conversazione umano. Ecco le quattro capacità che lo distinguono.

Parlare e ascoltare allo stesso tempo

TML-Interaction-Small può produrre parlato mentre l’utente sta ancora parlando. Questo rende possibile la traduzione simultanea: parli in una lingua e il modello inizia a tradurre prima che tu finisca la frase. Significa anche che può intervenire a metà frase quando intercetta un errore, o dare segnali vocali ("ok", "vai pure") mentre stai ancora spiegando qualcosa.

È utile anche per risposte personalizzate in tempo reale quando si verifica un evento specifico. Una clip nelle note di rilascio, per esempio, mostra come il modello converta importi in EUR e dica i corrispondenti importi in USD ogni volta che l’utente menziona un pagamento.

Vedere e reagire al video senza essere richiesto

TML-Interaction-Small elabora video insieme all’audio e può avviare il parlato in base a ciò che vede, senza alcun prompt verbale.

Se stai facendo flessioni davanti alla camera, può contare le ripetizioni ad alta voce mentre accadono. Se un oggetto rilevante appare in un flusso video, può segnalarlo nel momento in cui diventa visibile. Tuttavia, questa funzione è ancora migliorabile, come si vede dallo score interno RepCount-A, in cui solo un terzo (33,4%) dei casi rientrava a una ripetizione dalla verità a terra.

Una clip del rilascio (che a mio avviso risulta un po’ buffa) lo mostra in azione: quando gli viene chiesto di prestare attenzione alla postura dell’utente, il modello ha rilevato all’istante che era curva sul laptop e le ha ricordato di correggerla.

Le API commerciali in tempo reale esistenti sono solo audio. Rispondono ai turni parlati ma non hanno modo di reagire proattivamente ai cambiamenti visivi. Questa è una capacità che oggi semplicemente non esiste in GPT-Realtime-2 o Gemini Live.

Gestire interruzioni e autocorrezioni in modo naturale

Se inizi una frase, cambi idea e ti correggi a metà pensiero, TML-Interaction-Small tiene traccia della correzione e risponde a ciò che intendevi davvero. Gestisce il backchanneling (tu che dici "uh-huh" o "giusto" mentre parla) e distingue tra qualcuno che parla con lui e qualcuno che parla con un’altra persona nella stanza.

Questi sono scenari in cui i modelli a turni spesso si rompono. O smettono di parlare quando non dovrebbero, o rispondono alla parte sbagliata di ciò che è stato detto. Sarà interessante vedere se TML-Interaction-Small saprà gestirlo nelle situazioni di tutti i giorni così come nei video demo curati.

Eseguire attività complesse in background restando presente

Il modello di background è ciò che rende il modello di interazione non solo veloce, ma anche intelligente. Puoi continuare a fare domande di follow-up o cambiare argomento mentre l’attività di background gira. Quando i risultati sono pronti, il modello li reintegra nella conversazione in un momento naturale invece di interromperti con un cambio di contesto brusco.

Questo significa avere sia risposte conversazionali rapide sia la possibilità di gestire attività multi-step che normalmente richiederebbero al modello di restare in silenzio per diversi secondi. In una clip demo del quiz, funziona piuttosto bene: tre utenti fanno domande di trivia a ritmo sostenuto e il modello riesce per lo più a stare al passo.

Benchmark di TML-Interaction-Small

Thinking Machines riporta risultati in due categorie: benchmark in streaming che misurano l’interattività, e benchmark a turni che misurano l’intelligenza. I risultati più forti del modello sono sul lato streaming, dove le scelte architetturali sono testate più direttamente.

Interattività

FD-bench v1.5 fornisce al modello audio preregistrato e misura il suo comportamento in quattro scenari:

- Interruzione dell’utente

- Backchannel dell’utente

- Parlare con altri

- Parlato di sottofondo

TML-Interaction-Small ottiene 77,8, contro 54,3 per Gemini-3.1-flash-live-preview alle impostazioni minime e 46,8 per GPT-Realtime-2.0 alle impostazioni minime. Anche GPT-Realtime-2.0 alla massima impostazione di ragionamento (xhigh) arriva solo a 47,8.

Questo è il benchmark che misura più direttamente ciò verso cui sta costruendo Thinking Machines. Un divario di 30 punti rispetto al concorrente più vicino non è una differenza marginale. La domanda è se FD-bench v1.5 catturi l’intera gamma di interattività che conta nella pratica, cosa che gli stessi Thinking Machines riconoscono essere una questione di ricerca aperta.

Latency del turn-taking

TML-Interaction-Small raggiunge una turn-taking latency di 0,40 secondi in FD-bench v1, la più veloce tra i modelli confrontati. Gemini-3.1-flash-live-preview si avvicina con 0,57 secondi. Anche alle impostazioni minime, GPT-Realtime-2.0 impiega circa tre volte tanto (1,18 secondi); a ragionamento xhigh, GPT-Realtime-2.0 arriva a 1,63 secondi.

La latenza conta per l’interazione vocale in modo diverso rispetto al testo. Un gap di 1,2 secondi tra quando l’utente finisce di parlare e quando il modello inizia a rispondere non è solo percepibile, ma anche di disturbo. Il risultato di 0,40 secondi avvicina TML-Interaction-Small ai tempi di risposta conversazionale umani.

Intelligenza e rispetto delle istruzioni

Audio MultiChallenge misura intelligenza e rispetto delle istruzioni in audio. TML-Interaction-Small ottiene il 43,4%, sopra GPT-Realtime-1.5 (34,7%) e Gemini-3.1-flash-live-preview (26,8%), ma sotto GPT-Realtime-2.0 a xhigh (48,5%). Qui è visibile il trade-off tra intelligenza e interattività.

Il divario tra TML-Interaction-Small e GPT-Realtime-2.0 a xhigh è di 5,1 punti percentuali. È un gap significativo, ma non enorme, e comporta un costo di latenza rilevante sul lato GPT-Realtime-2.0 (1,63 secondi contro 0,40 secondi). Se valga la pena di questo compromesso dipende dall’applicazione.

Qualità della risposta e uso degli strumenti

FD-bench v3 misura la qualità delle risposte e l’accuratezza delle chiamate agli strumenti in scenari audio+tools. TML-Interaction-Small ottiene l’82,8% di qualità della risposta e il 68,0% di pass@1 con l’agente di background abilitato, contro l’80,0% / 52,0% per GPT-Realtime-2.0 alle impostazioni minime e 81,0% / 58,0% a xhigh.

Il gap su pass@1 (68,0% contro 58,0%) è il numero più significativo qui, perché misura se il modello porta effettivamente a termine correttamente i compiti che dipendono dagli strumenti. Sembra che l’architettura duale che separa le chiamate ai tool dalle interazioni con l’utente ripaghi.

Nuovi benchmark di interattività: TimeSpeak, CueSpeak e proattività visiva

Thinking Machines ha creato due benchmark interni e adattato tre benchmark meno diffusi per misurare direttamente le capacità di interattività. Vale la pena esaminarli con attenzione perché nessun modello concorrente ottiene risultati significativi in nessuno di essi.

- TimeSpeak (avvio del parlato a tempo): TML-Interaction-Small ottiene il 64,7% di macro-accuracy.

- CueSpeak (parlato innescato da segnali verbali): TML-Interaction-Small ottiene l’81,7% di macro-accuracy.

- RepCount-A (conteggio di azioni visive): TML-Interaction-Small ottiene il 33,4% di accuratezza off-by-one.

- ProactiveVideoQA (parlato innescato da segnali visivi): TML-Interaction-Small ottiene 31,5 PAUC (baseline nessuna risposta = 25,0%).

- Charades temporal localization (timing di azioni visive): TML-Interaction-Small ottiene 30,4 mIoU.

Su molti di questi nuovi benchmark, GPT realtime-2.0 fallisce completamente, con un risultato vicino allo zero, o addirittura zero (sul benchmark Charades, che richiede al modello di dire "start" e "stop" nei momenti giusti durante un video).

Mi è difficile dire quanto siano significativi questi risultati, dato che i benchmark sono nuovi e non ancora convalidati in modo indipendente, ma seguono il quadro generale delle differenze architetturali e dei risultati comparabili dei benchmark.

Prezzi e disponibilità di TML-Interaction-Small

TML-Interaction-Small è attualmente in un’anteprima di ricerca limitata e non sono stati annunciati dettagli sui prezzi. Thinking Machines prevede di aprire l’accesso più ampio nel corso del 2026. Ricercatori e sviluppatori interessati possono contattare il team all’indirizzo interaction@thinkingmachines.ai per richiedere l’accesso.

Per confronto, GPT-Realtime-2 ha un prezzo di $32 per milione di token audio in input e $64 per milione di token audio in output, come abbiamo spiegato nella nostra panoramica di GPT-Realtime-2. I prezzi di TML-Interaction-Small saranno probabilmente annunciati insieme al rilascio più ampio.

Come avrai notato, il modello ha il suffisso “-Small”, e hai ragione ad aspettarti che Thinking Machines seguirà con modelli più grandi. Al momento sono ancora troppo lenti da servire, ma un rilascio è previsto per la fine del 2026.

TML-Interaction-Small vs. GPT-Realtime-2

Il divario più interessante tra i due modelli è nei benchmark di interattività. Su FD-bench v1.5, che misura il comportamento tra interruzione dell’utente, backchanneling, parlare con altri e parlato di sottofondo, TML-Interaction-Small ottiene 77,8. GPT-Realtime-2.0 alle impostazioni minime ottiene 46,8 e alla massima impostazione di ragionamento (xhigh) ottiene 47,8. È un divario di 30 punti sul benchmark che misura più direttamente ciò per cui Thinking Machines sta ottimizzando.

C’è un trade-off sull’intelligenza, ma qui il gap è molto più piccolo rispetto all’interattività. GPT-Realtime-2.0 a xhigh ottiene il 48,5% su Audio MultiChallenge contro il 43,4% di TML-Interaction-Small. Su BigBench Audio, GPT-Realtime-2.0 a high ottiene il 96,6% contro il 75,7% di TML-Interaction-Small (anche se TML-Interaction-Small arriva al 96,5% con l’agente di background abilitato).

Il quadro generale che emerge è che TML-Interaction-Small è in testa per reattività e interattività, mentre GPT-Realtime-2.0 alle impostazioni di ragionamento elevate guida sui benchmark di pura intelligenza.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (minimo) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimo) |

|---|---|---|---|---|

| FD-bench v1 turn-taking latency (s) | 0,40 | 1,18 | 1,63 | 0,57 |

| FD-bench v1.5 media | 77,8 | 46,8 | 47,8 | 54,3 |

| FD-bench v3 qualità della risposta (%) | 82,8* | 80,0 | 81,0 | 68,5 |

| Audio MultiChallenge APR (%) | 43,4 | 37,6 | 48,5 | 26,8 |

| BigBench Audio accuratezza (%) | 75,7 / 96,5* | 71,8 | 96,6 | 71,3 |

| IFEval (VoiceBench) accuratezza (%) | 82,1 | 81,7 | 83,2 | 67,6 |

| IFEval testo accuratezza (%) | 89,7 | 89,6 | 95,2 | 85,8 |

* Con agente di background abilitato.

Per vedere la famiglia di modelli audio di OpenAI in azione, dai un’occhiata al nostro tutorial sull’API GPT-Realtime-2.

Considerazioni finali

TML-Interaction-Small sembra promettente. Se manterrà quanto dichiarato nelle note di rilascio, il nuovo modello porta un’interattività significativamente migliorata con una latenza ridotta, senza sacrificare la qualità delle risposte o la capacità di ragionamento. La capacità di parlare, ascoltare e rispondere ai segnali visivi simultaneamente è finora unica e offre molte possibilità. Sono curioso di vedere come saranno i prezzi quando il modello verrà reso pubblico.

Il divario di intelligenza rispetto a GPT-Realtime-2 è reale ma più stretto di quello sull’interattività. Per le applicazioni in cui la conversazione deve sembrare naturale, quella differenza di latenza conta più del gap di intelligenza. Per le applicazioni in cui la priorità è l’accuratezza su compiti di ragionamento complessi, GPT-Realtime-2.0 alle impostazioni di ragionamento elevate è ancora in vantaggio.

Se vuoi aggiornarti sul panorama più ampio dei modelli di AI e su come lavorarci in modo efficace, ti consiglio di iniziare con la nostra skill track AI Fundamentals.

FAQ su TML-Interaction-Small

Che cos’è un interaction model?

Un interaction model è un sistema di voice AI in cui l’interattività è integrata nel modello stesso, invece di essere aggiunta tramite componenti esterni come il rilevamento dell’attività vocale e la gestione del dialogo. Elabora input e output simultaneamente, così può ascoltare e parlare allo stesso tempo invece di aspettare i turni.

Chi c’è dietro il Thinking Machines Lab?

Il Thinking Machines Lab è guidato da Mira Murati, precedentemente CTO di OpenAI. TML-Interaction-Small è la prima release pubblica del laboratorio, descritta come un’anteprima di ricerca della loro architettura di interaction model.

Come si confronta TML-Interaction-Small con GPT-Realtime-2 di OpenAI?

TML-Interaction-Small è leader sull’interattività, con 77,8 su FD-bench v1.5 contro 47,8 per GPT-Realtime-2 alla massima impostazione, e una turn-taking latency più rapida di 0,40 secondi contro 1,63 secondi. GPT-Realtime-2 guida sui benchmark di pura intelligenza come Audio MultiChallenge (48,5% vs 43,4%).

TML-Interaction-Small può elaborare video?

Sì. Elabora il video insieme all’audio e può reagire a eventi visivi senza alcun prompt verbale da parte dell’utente, per esempio contando le ripetizioni degli esercizi in camera o segnalando oggetti quando compaiono. Questa proattività visiva non esiste in GPT-Realtime-2 o Gemini Live.

Tom è un data scientist e formatore tecnico. Scrive e gestisce i tutorial e i post del blog di DataCamp su data science. In precedenza, Tom ha lavorato nella data science presso Deutsche Telekom.