Tracks

先週、OpenAIのGPT-Realtime-2がGPT-5級の推論力と128Kのコンテキストウィンドウを携えて登場し、音声AIの水準を引き上げました。これに対し、Mira MuratiのThinking Machines Labは別の主張をしています。応答性と知性は、音声活動検知や対話管理のコンポーネントを後付けで継ぎはぎするのではなく、最初から同じモデルの中に学習として組み込むべきだというのです。

同ラボはこの新しいタイプのモデルを「インタラクション・モデル」と呼んでいます。

研究プレビュー版であるTML-Interaction-Smallは、そのアプローチの最初の成果です。2760億パラメータのMixture-of-Expertsモデルで、うち有効パラメータは120億。音声・動画・テキストを200msの連続したマイクロターンで処理し、話者が話し終えるのを待つのではなく、知覚と応答を同時に行います。

本記事では、TML-Interaction-Smallの概要、主要なアーキテクチャ上の特徴を解説し、直接GPT-Realtime-2と比較し、ベンチマーク結果を詳しく見ていきます。

インタラクション・モデルとは?

Thinking Machines Labは、インタラクション・モデルを「相互作用性がモデルそのものの一部として組み込まれており、外部のハーネスで実装されているわけではないシステム」と定義しています。中核となる原則は、応答性と知性を、離散的なテキストモデルに後から付け足すのではなく、連続する音声・動画ストリームで最初から一体的に学習させるべきだという点です。

既存の多くのリアルタイム音声AIシステムは、音声活動検知コンポーネントや個別エンコーダ、対話管理レイヤーを寄せ集めて応答性を擬似的に実現しています。Thinking Machines Labは、このやり方では常にネイティブに相互作用を扱うモデルに遅れを取ると主張します。人工的なターン境界が、非インタラクティブなモデルの能力を制限するためです。

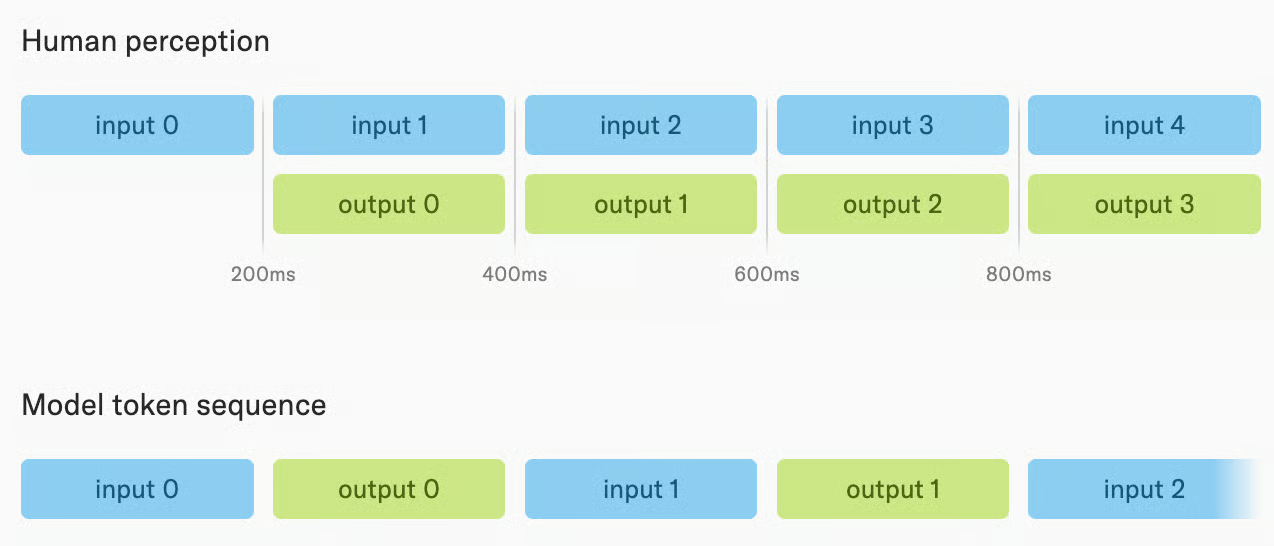

ユーザー入力を逐次的に取り込んでから完全な応答を生成するのではなく、同ラボのインタラクション・モデルは人間の知覚に近づくよう設計されています。入力と出力の両トークンをストリームとして扱い、両者を200ミリ秒のマイクロターンごとにインタリーブします。

この結果、インタラクション・モデルは話者の発話が終わるのを待たずに、入力と出力を並行して処理しながら、同時に知覚し応答できます。これにより、以下のような能力が可能になります。

この結果、インタラクション・モデルは話者の発話が終わるのを待たずに、入力と出力を並行して処理しながら、同時に知覚し応答できます。これにより、以下のような能力が可能になります。

- 聞きながら話す

- 促しなしで視覚的合図に反応する

- 経過時間を直接トラッキングする

これらはいずれも、どれだけ推論能力が高くても、外部ハーネスを使うターン制モデルでは再現できません。

TML-Interaction-Smallとは?

TML-Interaction-Smallは、Thinking Machines Labによる初の公開モデルであり、インタラクション・モデルのアーキテクチャを初めて実装したものです。

これは、Mixture-of-Expertsの2760億パラメータ(有効パラメータ120億)のモデルで、先述のマルチストリーム・マイクロターン設計に基づき、連続する音声・動画ストリームでゼロから学習されています。入力と出力は200ms単位で処理されます。

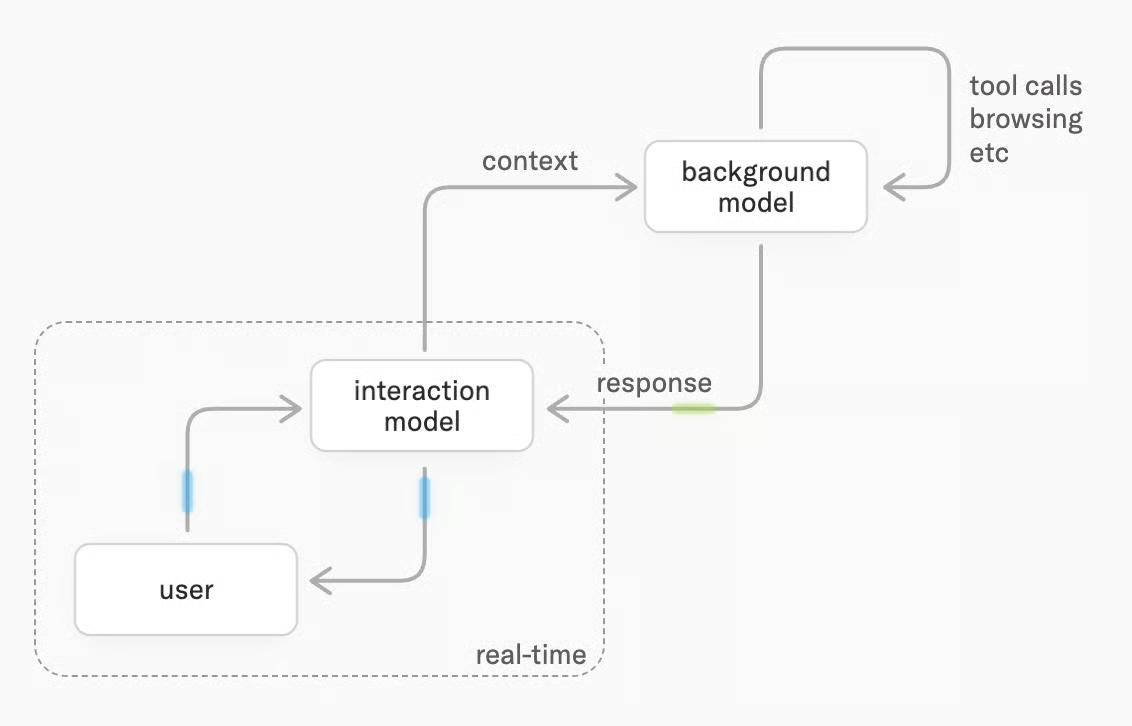

コンテキストを共有する2つのモデルを組み合わせることで、応答性と知性の両立を図っています。ユーザーはインタラクション・モデルからリアルタイムに回答を受け取りつつ、計画立案、ツール利用、より深い推論はバックグラウンドモデルに非同期で委ねられます。

インタラクション・モデルは会話から離脱することなく、バックグラウンドの結果を到着次第、自然に会話へ統合します。

TML-Interaction-Smallの機能

既存の音声AIモデルがターン制(あなたが話し、次にモデルが応答)であるのに対し、TML-Interaction-Smallは人間の会話相手に近い働きをします。特徴的な4つの能力を紹介します。

同時に話し、同時に聞く

TML-Interaction-Smallは、ユーザーがまだ話している最中に音声を生成できます。これにより同時通訳が可能になります。つまり、ある言語で話し始めると、文を言い終える前に翻訳が始まります。また、誤りを検知した時点で文の途中でも割り込んだり、(「了解」「続けてください」などの)合図を、説明の最中でも口頭で返したりできます。

特定のトリガーとなる事象が発生した際に、カスタムのリアルタイム応答を返す用途にも有用です。例えばリリースノートのクリップでは、ユーザーが支払いに言及するたびに、モデルがEURの金額をUSDに換算して伝える様子が示されています。

頼まれなくても動画を見て反応する

TML-Interaction-Smallは音声と並行して動画も処理し、口頭での指示がなくても、見た内容に基づいて発話を開始できます。

カメラの前で腕立て伏せをしていれば、リアルタイムで回数をカウントして声に出します。動画ストリームに関連する物体が現れれば、見えた瞬間に指摘できます。ただし、この機能はまだ改良の余地があり、内部のRepCount-Aスコアでは、正解から±1回以内に収まった事例は3分の1(33.4%)にとどまっています。

リリースのクリップの一つ(筆者の印象ではやや風変わり)では、ユーザーの姿勢に注意を向けるよう促すと、モデルがノートPCに向かって猫背になった瞬間に検知し、すぐに正すよう促した様子が示されています。

既存の商用リアルタイムAPIは音声のみで、発話ターンには応答できますが、視覚的な変化に能動的に反応する手段がありません。これは、現時点のGPT-Realtime-2やGemini Liveには存在しない能力です。

割り込みや自己修正に自然に対応

文を話し始めてから考え直し、途中で言い換えた場合でも、TML-Interaction-Smallは修正を追跡し、意図した内容に応じて応答します。バックチャネル(モデルが話している最中の「うん」「そうだね」など)を適切に扱い、モデルに話しかけているのか、それとも同室の別の相手に話しているのかを区別します。

この種の状況は、ターン制モデルがよく破綻する場面です。本来は話し続けるべきところで止まってしまったり、言われた内容の不適切な部分に応答したりします。TML-Interaction-Smallが、デモ動画だけでなく日常の場面でも同様に対応できるか注目されます。

会話を続けながらバックグラウンドで複雑な処理を実行

バックグラウンドモデルは、インタラクション・モデルを高速にするだけでなく、知的にもします。バックグラウンド処理の実行中でも、フォローアップの質問を続けたり、話題を変えたりできます。結果が整い次第、唐突な文脈切り替えで会話を遮ることなく、自然なタイミングで会話に織り込みます。

これにより、素早い会話応答と、本来なら数秒間モデルが黙る必要のあるマルチステップタスクの両方が実現します。クイズのデモクリップでは、3人のユーザーが高速で雑学クイズを投げかけても、モデルは概ねそのスピードに追随できていました。

TML-Interaction-Smallのベンチマーク

Thinking Machinesは、相互作用性を測るストリーミング系ベンチマークと、知性を測るターン制ベンチマークの2カテゴリで結果を報告しています。アーキテクチャの特性が最も直接的に試されるストリーミング系で、同モデルは特に強い結果を示しています。

インタラクティビティ

FD-bench v1.5は、あらかじめ録音された音声をモデルに与え、次の4つのシナリオでの挙動を測定します。

- ユーザーによる割り込み

- ユーザーのバックチャネル

- 他者との会話

- 背景音声

TML-Interaction-Smallのスコアは77.8で、最小設定のGemini-3.1-flash-live-previewは54.3、最小設定のGPT-Realtime-2.0は46.8です。GPT-Realtime-2.0を最高の推論設定(xhigh)にしても47.8にとどまります。

これは、Thinking Machinesが目指す方向性を最も直接測るベンチマークです。最も近い競合に30ポイント差を付けるのは、些細な差ではありません。もっとも、FD-bench v1.5が実運用上重要な相互作用性をどの程度網羅しているかは、Thinking Machines自身も未解決の研究課題だと認めています。

ターンテイキングの遅延

TML-Interaction-SmallはFD-bench v1で0.40秒のターンテイキング遅延を達成し、比較対象中で最速です。次点のGemini-3.1-flash-live-previewは0.57秒。GPT-Realtime-2.0は最小設定でも約3倍(1.18秒)、xhigh設定では1.63秒を要します。

遅延はテキストよりも音声対話で大きな意味を持ちます。ユーザーが話し終えてからモデルが応答し始めるまでに1.2秒の差があると、知覚できるだけでなく、体験を損ないます。0.40秒という結果は、人間の会話に近い応答時間に寄せています。

知性と指示追従

Audio MultiChallengeは、音声における知性と指示追従を測定します。TML-Interaction-Smallは43.4%で、GPT-Realtime-1.5(34.7%)やGemini-3.1-flash-live-preview(26.8%)を上回るものの、GPT-Realtime-2.0のxhigh(48.5%)には及びません。ここでは、知性と相互作用性のトレードオフが可視化されています。

TML-Interaction-SmallとGPT-Realtime-2.0(xhigh)の差は5.1ポイントです。意味のある差ではあるものの極端ではなく、しかもGPT-Realtime-2.0側には大きな遅延コスト(1.63秒対0.40秒)が伴います。どちらを選ぶべきかは、用途に依存します。

応答品質とツール利用

FD-bench v3は、音声+ツールのシナリオでの応答品質とツール呼び出しの正確性を測ります。バックグラウンドエージェント有効時、TML-Interaction-Smallは応答品質82.8%、pass@1が68.0%で、GPT-Realtime-2.0の最小設定(80.0%/52.0%)やxhigh(81.0%/58.0%)を上回ります。

ここで最も意味のある数値はpass@1(68.0%対58.0%)で、ツール依存のタスクを実際に正しく完了できたかを測ります。ユーザーとのやり取りとツール呼び出しを分離する二重アーキテクチャが奏功しているようです。

新しいインタラクティビティ・ベンチマーク:TimeSpeak、CueSpeak、視覚プロアクティビティ

Thinking Machinesは、相互作用性を直接測るために2つの内部ベンチマークを作成し、さらに知名度の低い3つのベンチマークを適応しました。いずれも、競合モデルが意味のあるスコアを出せていない点で注目に値します。

- TimeSpeak(タイミング制御された発話開始):TML-Interaction-Smallはマクロ精度64.7%。

- CueSpeak(言語的合図での発話トリガー):マクロ精度81.7%。

- RepCount-A(視覚的動作のカウント):±1以内の精度33.4%。

- ProactiveVideoQA(視覚的合図での発話トリガー):PAUC 31.5(無応答のベースライン=25.0%)。

- Charadesの時間的ローカライゼーション(視覚的動作のタイミング):mIoU 30.4。

これらの新ベンチマークの多くで、GPT Realtime-2.0はほぼゼロ、あるいはゼロ(動画中の適切なタイミングで「開始」「停止」と言う必要があるCharadesベンチマークなど)に近い結果に終わっています。

これらのベンチマークは新しく、まだ独立検証が進んでいないため、どの程度の意味を持つか断言は難しいものの、アーキテクチャの差異と他のベンチマーク結果の全体像とは整合しています。

TML-Interaction-Smallの価格と提供状況

TML-Interaction-Smallは現在、限定的な研究プレビュー段階で、価格は未発表です。Thinking Machinesは2026年後半により広範なアクセスを開放する計画です。関心のある研究者・開発者は、interaction@thinkingmachines.aiまで連絡してアクセスを申請できます。

参考として、GPT-Realtime-2の価格は、音声入力トークン100万あたり32ドル、音声出力トークン100万あたり64ドルで、詳細はGPT-Realtime-2の概要で取り上げました。TML-Interaction-Smallの価格は、広範提供のタイミングで発表される見込みです。

ご覧のとおり、モデル名には「-Small」が付きます。Thinking Machinesが今後、より大きなモデルを投入するであろうことも示唆しています。現時点では提供には遅すぎますが、2026年後半にリリースが予定されています。

TML-Interaction-SmallとGPT-Realtime-2の比較

両モデルの差で特に興味深いのは、インタラクティビティ系ベンチマークです。ユーザーの割り込み、バックチャネル、他者との会話、背景音声への挙動を測るFD-bench v1.5で、TML-Interaction-Smallは77.8。GPT-Realtime-2.0は最小設定で46.8、最高の推論設定(xhigh)でも47.8。Thinking Machinesが最適化の主眼とする指標で30ポイント差が付いています。

知性面にはトレードオフがあるものの、その差はインタラクティビティほど大きくはありません。Audio MultiChallengeではGPT-Realtime-2.0(xhigh)が48.5%、TML-Interaction-Smallは43.4%。BigBench AudioではGPT-Realtime-2.0(high)が96.6%に対し、TML-Interaction-Smallは75.7%(ただしバックグラウンドエージェント有効時は96.5%)。

総じて、応答性とインタラクティビティではTML-Interaction-Smallがリードし、高い推論設定での純粋な知性ベンチマークではGPT-Realtime-2.0が優位、という構図が浮かび上がります。

| ベンチマーク | TML-Interaction-Small | GPT-Realtime-2.0(最小) | GPT-Realtime-2.0(xhigh) | Gemini-3.1-flash-live(最小) |

|---|---|---|---|---|

| FD-bench v1 ターンテイキング遅延(秒) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 平均 | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 応答品質(%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR(%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio 正解率(%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval(VoiceBench)正解率(%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval テキスト正解率(%) | 89.7 | 89.6 | 95.2 | 85.8 |

* バックグラウンドエージェント有効時。

OpenAIの音声モデル群の動作は、GPT-Realtime-2 APIチュートリアルで確認できます。

まとめ

TML-Interaction-Smallは将来性を感じさせます。リリースノートの主張どおりであれば、短い遅延でインタラクティビティが大きく向上しつつ、応答品質や推論力も犠牲にしていません。音声・聴取・視覚合図への応答を同時にこなす能力は現時点でユニークで、応用の幅が広がります。一般提供時の価格設定も注目点です。

知性面でのGPT-Realtime-2との差は確かにありますが、インタラクティビティの差ほどではありません。会話の自然さが重視される用途では、この遅延差の方が知性差よりも重要です。反対に、難度の高い推論課題での正確性が最優先なら、GPT-Realtime-2.0の高推論設定が依然として先行しています。

AIモデルの全体像と実務での効果的な活用法を素早く把握したい方は、AI Fundamentals スキルトラックから始めるのがおすすめです。