Leerpad

Nog maar vorige week zette OpenAI's GPT-Realtime-2 de toon voor stem-AI met GPT-5-klasse redeneren en een contextvenster van 128K. Nu komt Thinking Machines Lab van Mira Murati met een andere invalshoek: dat responsiviteit en intelligentie vanaf nul in hetzelfde model getraind moeten worden, in plaats van achteraf aan elkaar te schroeven met voice-activity-detection-harnassen en dialoogmanagementcomponenten.

Het lab noemt dit type nieuw model een "Interaction Model".

Hun research preview, TML-Interaction-Small, is het eerste resultaat van deze aanpak. Het is een Mixture-of-Experts-model met 276B parameters en 12B actieve parameters. Het verwerkt audio, video en tekst in continue micro-beurten van 200 ms, wat betekent dat het tegelijk waarneemt en reageert in plaats van te wachten tot een spreker klaar is.

In dit artikel leg ik uit wat TML-Interaction-Small is, loop ik door de belangrijkste architectuurkenmerken heen, vergelijk het direct met GPT-Realtime-2, en bekijk ik de benchmarkresultaten in detail.

Wat zijn interactiemodellen?

Thinking Machines Lab beschrijft een interactiemodel als een systeem waarbij interactiviteit onderdeel is van het model zelf, niet geïmplementeerd in een omliggend harnas. Het kernprincipe is dat responsiviteit en intelligentie samen vanaf nul getraind moeten worden, op continue audio- en videostreams, in plaats van achteraf op een tekstgebaseerd model te worden geplakt.

De meeste bestaande real-time stem-AI-systemen naaien voice-activity-detectioncomponenten, aparte encoders en lagen voor dialoogbeheer aan elkaar om responsiviteit te simuleren. Thinking Machines Lab stelt dat deze aanpak altijd achterblijft bij modellen die interactie native afhandelen, vanwege kunstmatige beurtgrenzen die beperken wat het niet-interactieve model kan doen.

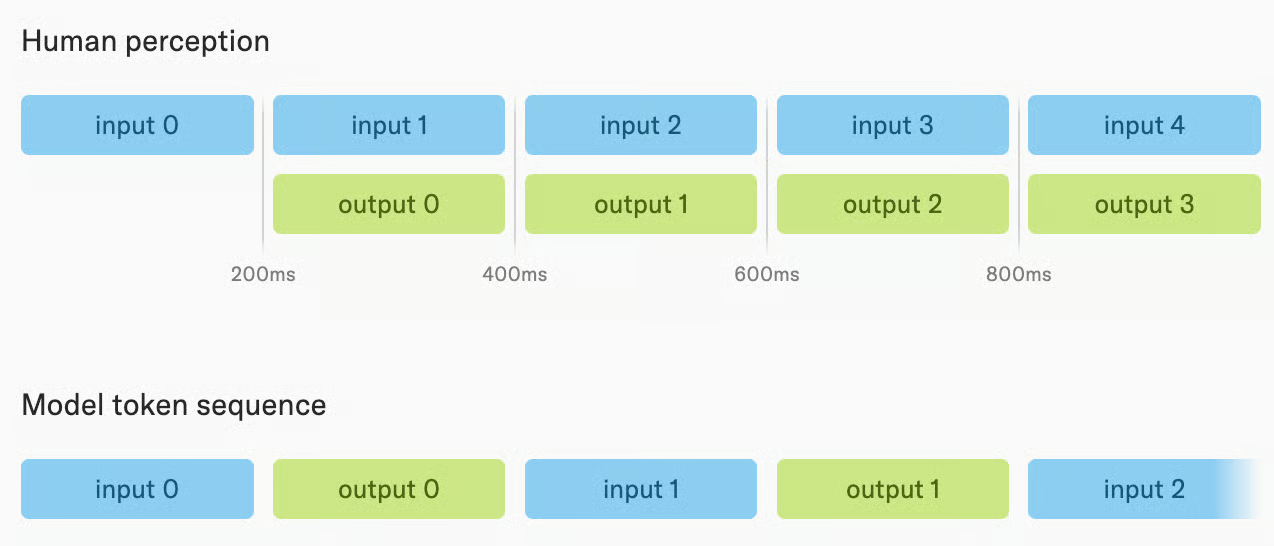

In plaats van gebruikersinvoer sequentieel te consumeren en daarna een volledig antwoord te genereren, zijn de interactiemodellen van het lab ontworpen om dichter bij menselijke perceptie te liggen. Ze behandelen zowel invoer- als uitvoertokens als streams, en beide zijn verweven in elk van de 200 milliseconden durende micro-beurten.

Een interactiemodel neemt dus waar en reageert tegelijk, waarbij invoer en uitvoer parallel worden verwerkt in plaats van te wachten tot een spreker klaar is. Dit maakt een paar handige dingen mogelijk:

Een interactiemodel neemt dus waar en reageert tegelijk, waarbij invoer en uitvoer parallel worden verwerkt in plaats van te wachten tot een spreker klaar is. Dit maakt een paar handige dingen mogelijk:

- Praten terwijl je luistert

- Reageren op visuele cues zonder te worden gevraagd

- Verstreken tijd direct bijhouden

Dit zijn allemaal dingen die beurtgebaseerde modellen met externe harnassen niet kunnen repliceren, ongeacht hoeveel redeneervermogen ze hebben.

Wat is TML-Interaction-Small?

TML-Interaction-Small is de eerste publieke modelrelease van Thinking Machines Lab en de eerste implementatie van hun interactiemodelarchitectuur.

Het is een Mixture-of-Experts-model met 276B parameters en 12B actieve parameters, vanaf nul getraind op continue audio- en videostreams met het multi-stream micro-beurtontwerp dat ik hierboven beschreef, waarbij invoer en uitvoer in stukken van 200 ms worden verwerkt.

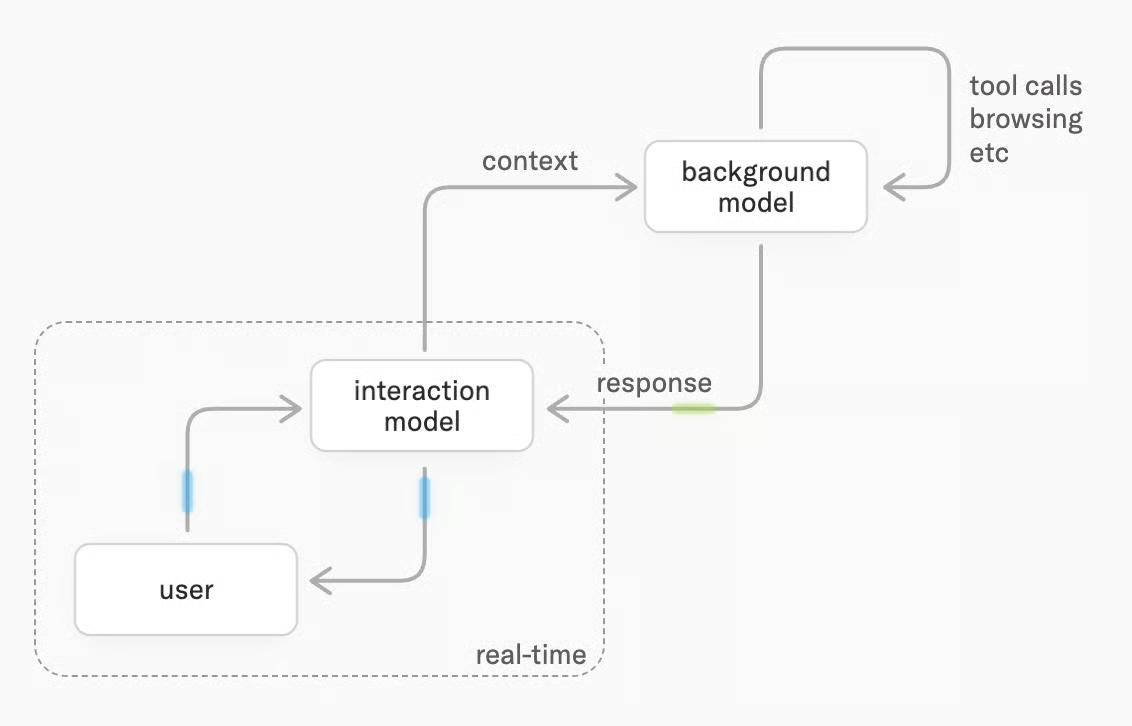

De combinatie van twee modellen met gedeelde context biedt zowel responsiviteit als intelligentie. Gebruikers krijgen in real-time antwoorden van het interactiemodel, terwijl planning, toolgebruik en diepere redenering worden gedelegeerd aan het achtergrondmodel, dat asynchroon draait.

Het interactiemodel verweeft vervolgens de achtergrondresultaten in het gesprek zodra ze binnenkomen, zonder uit het gesprek te vallen.

Functies van TML-Interaction-Small

Waar bestaande stem-AI-modellen om de beurt gaan (jij spreekt, zij reageren), werkt TML-Interaction-Small meer als een menselijke gesprekspartner. Dit zijn de vier mogelijkheden die het onderscheiden.

Tegelijk spreken en luisteren

TML-Interaction-Small kan spraak genereren terwijl de gebruiker nog praat. Dit maakt simultaanvertaling mogelijk: je spreekt in de ene taal, en het model begint te vertalen vóórdat je je zin af hebt. Het betekent ook dat het model halverwege kan interrumperen als het een fout oppikt, of verbale hints kan geven ("begrepen", "ga door") terwijl je nog iets uitlegt.

Dit is ook handig voor aangepaste real-time reacties wanneer een specifieke gevraagde gebeurtenis zich voordoet. Een clip in de releasenotes laat bijvoorbeeld zien hoe het model EUR-bedragen omzet en de bijbehorende USD-bedragen noemt zodra de gebruiker een betaling noemt.

Video zien en erop reageren zonder te worden gevraagd

TML-Interaction-Small verwerkt video naast audio en kan spraak initiëren op basis van wat het ziet, zonder verbale prompt.

Als je op camera push-ups doet, kan het hardop herhalingen tellen terwijl ze gebeuren. Als er een relevant object in een videostream verschijnt, kan het dat benoemen op het moment dat het zichtbaar wordt. Dit is echter een functie die nog beter kan, zoals te zien is aan de interne RepCount-A-score, waarin slechts een derde (33,4%) van de gevallen binnen één herhaling van de ground truth lag.

Een releaseclip (die er naar mijn mening een beetje quirky uitziet) laat dit in actie zien: wanneer gevraagd om op de houding van de gebruiker te letten, detecteerde het model meteen hangen boven de laptop en herinnerde haar eraan die te corrigeren.

Bestaande commerciële real-time API's zijn alleen audio. Ze reageren op gesproken beurten maar hebben geen manier om proactief op visuele veranderingen te reageren. Dit is een mogelijkheid die simpelweg niet bestaat in GPT-Realtime-2 of Gemini Live vandaag.

Onderbrekingen en zelfcorrecties natuurlijk afhandelen

Als je een zin begint, van gedachten verandert en jezelf halverwege corrigeert, volgt TML-Interaction-Small de correctie en reageert op wat je daadwerkelijk bedoelde. Het kan backchanneling aan (jij zegt "uh-huh" of "right" terwijl het praat) en maakt onderscheid tussen iemand die tegen het model praat versus tegen iemand anders in de kamer.

Dit zijn scenario's waarin beurtgebaseerde modellen vaak stuklopen. Ze stoppen dan met praten wanneer dat niet moet, of reageren op het verkeerde deel van wat gezegd is. Het wordt interessant om te zien of TML-Interaction-Small dit in alledaagse situaties net zo goed aankan als in gecureerde demovideo's.

Complexe taken op de achtergrond draaien terwijl het aanwezig blijft

Het achtergrondmodel zorgt ervoor dat het interactiemodel niet alleen snel is, maar ook intelligent. Je kunt vervolgvragen blijven stellen of van onderwerp veranderen terwijl de achtergrondtaak loopt. Wanneer resultaten klaar zijn, vlecht het model die op een natuurlijk moment terug in het gesprek, in plaats van je te onderbreken met een abrupte contextswitch.

Dit betekent dat je zowel snelle conversatiereacties krijgt als de mogelijkheid om meerstapstaken af te handelen die normaal gesproken zouden vereisen dat het model enkele seconden stilvalt. In een quizdemoclip werkt dit behoorlijk goed: drie gebruikers stellen in hoog tempo triviavragen, en het model kan hun snelheid grotendeels bijbenen.

TML-Interaction-Small-benchmarks

Thinking Machines rapporteert resultaten in twee categorieën: streamingbenchmarks die interactiviteit meten, en beurtgebaseerde benchmarks die intelligentie meten. De sterkste resultaten van het model liggen aan de streamingkant, waar de architecturale keuzes het meest direct getest worden.

Interactiviteit

FD-bench v1.5 voert het model vooraf opgenomen audio en meet zijn gedrag in vier scenario's:

- Onderbreking door gebruiker

- Backchanneling door gebruiker

- Praten tegen anderen

- Achtergrondspraak

TML-Interaction-Small scoort 77,8, vergeleken met 54,3 voor Gemini-3.1-flash-live-preview op minimale instellingen en 46,8 voor GPT-Realtime-2.0 op minimale instellingen. Zelfs GPT-Realtime-2.0 op de hoogste redeneerinstelling (xhigh) scoort slechts 47,8.

Dit is de benchmark die het meest direct meet waar Thinking Machines naartoe werkt. Een voorsprong van 30 punten op de dichtstbijzijnde concurrent is geen marginale afwijking. De vraag is of FD-bench v1.5 het volledige spectrum aan interactiviteit vangt dat in de praktijk telt, wat Thinking Machines zelf erkent als een open onderzoeksvraag.

Beurtlatentie

TML-Interaction-Small behaalt een beurtlatentie van 0,40 seconden in FD-bench v1, de snelste van alle vergeleken modellen. Gemini-3.1-flash-live-preview komt het dichtst in de buurt met 0,57 seconden. Zelfs op minimale instellingen doet GPT-Realtime-2.0 er ongeveer drie keer zo lang over (1,18 seconden); bij xhigh redeneren komt GPT-Realtime-2.0 op 1,63 seconden.

Latentie is voor spraakinteractie belangrijk op een manier die voor tekst minder speelt. Een kloof van 1,2 seconde tussen het moment dat een gebruiker klaar is met praten en het moment dat het model begint te reageren is niet alleen merkbaar, maar ook storend. De 0,40-secondenresultaat brengt TML-Interaction-Small dichter bij menselijke gesprekstijden.

Intelligentie en instructieopvolging

Audio MultiChallenge meet intelligentie en het volgen van instructies in audio. TML-Interaction-Small scoort 43,4%, boven GPT-Realtime-1.5 (34,7%) en Gemini-3.1-flash-live-preview (26,8%), maar onder GPT-Realtime-2.0 op xhigh (48,5%). Hier is de trade-off tussen intelligentie en interactiviteit zichtbaar.

De kloof tussen TML-Interaction-Small en GPT-Realtime-2.0 op xhigh is 5,1 procentpunt. Dat is significant, maar niet enorm, en het gaat gepaard met een flinke latentiekost aan de kant van GPT-Realtime-2.0 (1,63 seconden versus 0,40 seconden). Of die trade-off het waard is, hangt af van de toepassing.

Antwoordkwaliteit en toolgebruik

FD-bench v3 meet antwoordkwaliteit en nauwkeurigheid van tool-calls in audio-plus-tools-scenario's. TML-Interaction-Small scoort 82,8% antwoordkwaliteit en 68,0% pass@1 met achtergrondagent ingeschakeld, vergeleken met 80,0% / 52,0% voor GPT-Realtime-2.0 op minimale instellingen en 81,0% / 58,0% op xhigh.

Het pass@1-verschil (68,0% versus 58,0%) is hier het meest betekenisvolle getal, omdat het meet of het model toolafhankelijke taken daadwerkelijk correct afrondt. Het lijkt erop dat de dubbele architectuur die tool-calls scheidt van gebruikersinteracties loont.

Nieuwe interactiviteitsbenchmarks: TimeSpeak, CueSpeak en visuele proactiviteit

Thinking Machines creëerde twee interne benchmarks en paste drie minder breed gebruikte benchmarks aan om interactiviteitsmogelijkheden direct te meten. Deze zijn het bekijken waard, omdat geen concurrerend model hierop betekenisvol presteert.

- TimeSpeak (getimede spraakinitiatie): TML-Interaction-Small scoort 64,7% macro-nauwkeurigheid.

- CueSpeak (spraak getriggerd door verbale cue): TML-Interaction-Small scoort 81,7% macro-nauwkeurigheid.

- RepCount-A (visueel actietellen): TML-Interaction-Small scoort 33,4% off-by-one-nauwkeurigheid.

- ProactiveVideoQA (spraak getriggerd door visuele cue): TML-Interaction-Small scoort 31,5 PAUC (geen respons-baseline = 25,0%).

- Charades temporal localization (timing van visuele acties): TML-Interaction-Small scoort 30,4 mIoU.

Op de meeste van deze nieuwe benchmarks faalt GPT realtime-2.0 volledig, met een resultaat dicht bij nul, of zelfs nul (op de Charades-benchmark, die vereist dat het model "start" en "stop" op de juiste momenten in een video zegt).

Het is lastig voor mij om te zeggen hoe betekenisvol deze resultaten zijn, aangezien die benchmarks nieuw zijn en nog niet onafhankelijk zijn gevalideerd, maar ze sluiten aan bij het algemene beeld van de architecturale verschillen en vergelijkbare benchmarkresultaten.

TML-Interaction-Small: prijs en beschikbaarheid

TML-Interaction-Small bevindt zich momenteel in een beperkte research preview, en er zijn geen prijsdetails aangekondigd. Thinking Machines is van plan om later in 2026 bredere toegang te openen. Geïnteresseerde onderzoekers en ontwikkelaars kunnen contact opnemen met het team via interaction@thinkingmachines.ai om toegang aan te vragen.

Ter vergelijking: GPT-Realtime-2 kost $32 per miljoen audio-invoertokens en $64 per miljoen audio-uitvoertokens, zoals we bespraken in onze GPT-Realtime-2-overzicht. De prijzen voor TML-Interaction-Small worden waarschijnlijk aangekondigd bij de bredere release.

Zoals je waarschijnlijk hebt gezien, heeft het model het achtervoegsel "-Small", en je hebt gelijk als je verwacht dat Thinking Machines met grotere modellen komt. Die zijn nog te traag om te serven, maar een release staat gepland voor eind 2026.

TML-Interaction-Small vs. GPT-Realtime-2

Het interessantere verschil tussen de twee modellen zit in interactiviteitsbenchmarks. Op FD-bench v1.5, die gedrag meet rond onderbreking door de gebruiker, backchanneling, praten tegen anderen en achtergrondspraak, scoort TML-Interaction-Small 77,8. GPT-Realtime-2.0 op minimale instellingen scoort 46,8, en op de hoogste redeneerinstelling (xhigh) 47,8. Dat is een kloof van 30 punten op de benchmark die het meest direct meet waar Thinking Machines op optimaliseert.

Er is een trade-off in intelligentie, maar die kloof is veel kleiner dan bij interactiviteit. GPT-Realtime-2.0 op xhigh scoort 48,5% op Audio MultiChallenge tegenover 43,4% voor TML-Interaction-Small. Op BigBench Audio scoort GPT-Realtime-2.0 op high 96,6% tegenover 75,7% voor TML-Interaction-Small (al haalt TML-Interaction-Small 96,5% met achtergrondagent ingeschakeld).

Het algemene beeld dat ontstaat, is dat TML-Interaction-Small voorloopt op responsiviteit en interactiviteit, terwijl GPT-Realtime-2.0 op hoge redeneerinstellingen voorloopt op ruwe intelligentiebenchmarks.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 beurtlatentie (s) | 0,40 | 1,18 | 1,63 | 0,57 |

| FD-bench v1.5 gemiddeld | 77,8 | 46,8 | 47,8 | 54,3 |

| FD-bench v3 antwoordkwaliteit (%) | 82,8* | 80,0 | 81,0 | 68,5 |

| Audio MultiChallenge APR (%) | 43,4 | 37,6 | 48,5 | 26,8 |

| BigBench Audio nauwkeurigheid (%) | 75,7 / 96,5* | 71,8 | 96,6 | 71,3 |

| IFEval (VoiceBench) nauwkeurigheid (%) | 82,1 | 81,7 | 83,2 | 67,6 |

| IFEval tekstnauwkeurigheid (%) | 89,7 | 89,6 | 95,2 | 85,8 |

* Met achtergrondagent ingeschakeld.

Wil je de audiomodelfamilie van OpenAI in actie zien? Bekijk dan onze GPT-Realtime-2 API-tutorial.

Tot slot

TML-Interaction-Small oogt veelbelovend. Als het de claims in de releasenotes waarmaakt, brengt het nieuwe model aanzienlijk verbeterde interactiviteit met korte latentie, zonder in te leveren op antwoordkwaliteit of redeneervermogen. De mogelijkheid om tegelijk te spreken, te luisteren en op visuele cues te reageren is tot nu toe uniek en biedt veel mogelijkheden. Ik ben benieuwd hoe de prijs eruitziet wanneer het model openbaar wordt uitgebracht.

De intelligentiekloof met GPT-Realtime-2 is reëel maar smaller dan de interactiviteitskloof. Voor toepassingen waarbij het gesprek natuurlijk moet aanvoelen, weegt dat latentieverschil zwaarder dan de intelligentiekloof. Voor toepassingen waar nauwkeurigheid op moeilijke redeneertaken prioriteit heeft, ligt GPT-Realtime-2.0 op hoge redeneerinstellingen nog voor.

Wil je snel bij zijn met het bredere landschap van AI-modellen en hoe je er effectief mee werkt, begin dan met onze AI Fundamentals skill track.

Tom is data scientist en technisch docent. Hij schrijft en beheert de data science-tutorials en blogposts van DataCamp. Eerder werkte Tom in data science bij Deutsche Telekom.