Track

पिछले ही हफ्ते, OpenAI के GPT-Realtime-2 ने GPT-5-स्तरीय रीजनिंग और 128K कॉन्टेक्स्ट विंडो के साथ लॉन्च होकर वॉयस AI के मानक ऊंचे कर दिए। अब, मीरा मुराती की थिंकिंग मशीनज़ लैब एक अलग तर्क दे रही है: कि तत्परता (responsiveness) और बुद्धिमत्ता को शुरुआत से ही एक ही मॉडल में साथ प्रशिक्षित किया जाना चाहिए—न कि वॉयस-एक्टिविटी-डिटेक्शन हार्नेस और डायलॉग मैनेजमेंट कॉम्पोनेंट्स को जोड़कर।

लैब इस नए तरह के मॉडल को "इंटरैक्शन मॉडल" कहती है।

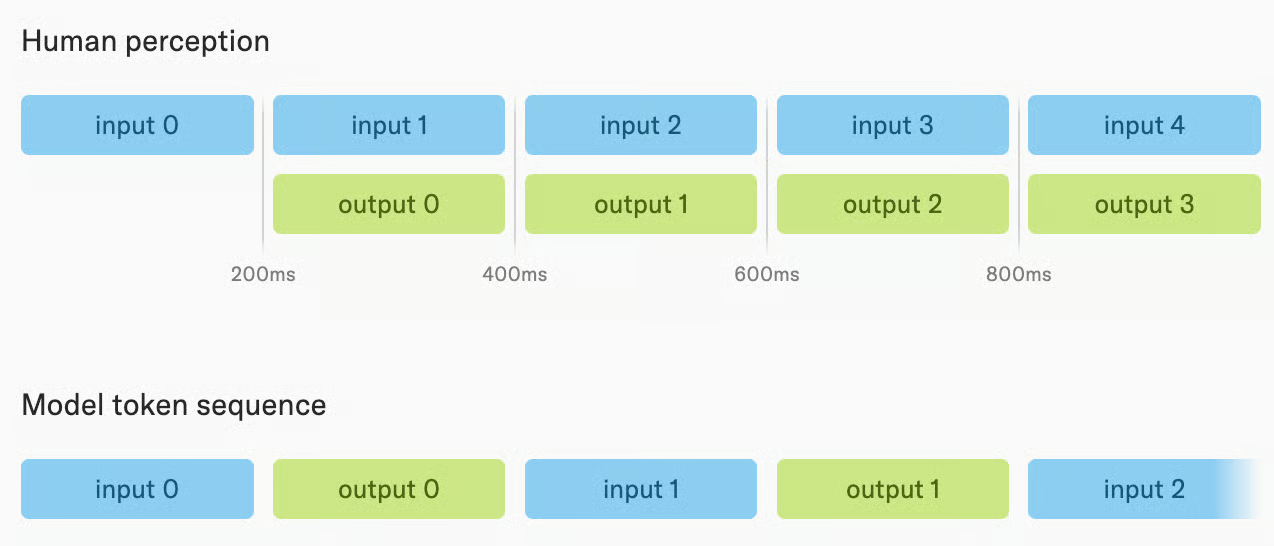

उनका रिसर्च प्रीव्यू, TML-Interaction-Small, इस दृष्टिकोण का पहला परिणाम है। यह 276B पैरामीटर वाला मिक्सचर-ऑफ-एक्सपर्ट्स मॉडल है जिसमें 12B सक्रिय पैरामीटर हैं। यह ऑडियो, वीडियो और टेक्स्ट को लगातार 200ms के माइक्रो-टर्न्स में प्रोसेस करता है—अर्थात यह वक्ता के बोलना खत्म करने का इंतजार करने के बजाय एक साथ ग्रहण करता और जवाब देता है।

इस लेख में, मैं बताऊंगा कि TML-Interaction-Small क्या है, इसकी प्रमुख आर्किटेक्चरल विशेषताओं से गुजरूंगा, compare इसे सीधे GPT-Realtime-2 से करूंगा, और बेंचमार्क परिणामों को विस्तार से देखूंगा।

इंटरैक्शन मॉडल्स क्या हैं?

थिंकिंग मशीनज़ लैब इंटरैक्शन मॉडल को ऐसे सिस्टम के रूप में वर्णित करती है जिसमें इंटरेक्टिविटी मॉडल का ही हिस्सा होती है, न कि किसी बाहरी हार्नेस में लागू। मूल सिद्धांत यह है कि तत्परता और बुद्धिमत्ता को शुरुआत से ही लगातार ऑडियो और वीडियो स्ट्रीम्स पर साथ में प्रशिक्षित किया जाना चाहिए, न कि बाद में किसी टेक्स्ट-आधारित मॉडल पर चिपकाया जाए।

अधिकांश मौजूदा रियल-टाइम वॉयस AI सिस्टम्स तत्परता का आभास देने के लिए वॉयस-एक्टिविटी-डिटेक्शन कॉम्पोनेंट्स, अलग एन्कोडर्स और डायलॉग मैनेजमेंट लेयर्स को जोड़ते हैं। थिंकिंग मशीनज़ लैब का तर्क है कि यह तरीका उन मॉडलों से हमेशा पीछे रहेगा जो नैटिव रूप से इंटरैक्शन संभालते हैं—क्योंकि कृत्रिम टर्न सीमाएं गैर-इंटरैक्टिव मॉडल की क्षमता घटाती हैं।

यूज़र इनपुट को क्रमवार खपत करने और फिर पूरा उत्तर जनरेट करने के बजाय, लैब के इंटरैक्शन मॉडल मानवीय बोध के अधिक करीब डिजाइन किए गए हैं। वे इनपुट और आउटपुट दोनों टोकनों को स्ट्रीम्स मानते हैं, और दोनों ही 200 मिलीसेकंड लंबे हर माइक्रो-टर्न में इंटरलीव्ड होते हैं।

इस तरह, एक इंटरैक्शन मॉडल एक ही समय में ग्रहण करता और जवाब देता है—वक्ता के खत्म होने का इंतजार किए बिना इनपुट और आउटपुट को समानांतर में प्रोसेस करता है। इससे कुछ उपयोगी क्षमताएं सक्षम होती हैं:

इस तरह, एक इंटरैक्शन मॉडल एक ही समय में ग्रहण करता और जवाब देता है—वक्ता के खत्म होने का इंतजार किए बिना इनपुट और आउटपुट को समानांतर में प्रोसेस करता है। इससे कुछ उपयोगी क्षमताएं सक्षम होती हैं:

- सुनते हुए बोलना

- प्रॉम्प्ट किए बिना विज़ुअल संकेतों पर प्रतिक्रिया देना

- बीता हुआ समय सीधे ट्रैक करना

ये सभी वे चीज़ें हैं जिन्हें बाहरी हार्नेस वाले टर्न-आधारित मॉडल, उनकी रीजनिंग क्षमता चाहे जितनी हो, दोहरा नहीं सकते।

TML-Interaction-Small क्या है?

TML-Interaction-Small थिंकिंग मशीनज़ लैब का पहला सार्वजनिक मॉडल रिलीज़ है और उनके इंटरैक्शन मॉडल आर्किटेक्चर का पहला इम्प्लीमेंटेशन।

यह 276B पैरामीटर वाला मिक्सचर-ऑफ-एक्सपर्ट्स मॉडल है जिसमें 12B सक्रिय पैरामीटर हैं, जिसे शुरुआत से ही लगातार ऑडियो और वीडियो स्ट्रीम्स पर उस मल्टी-स्ट्रीम माइक्रो-टर्न डिजाइन के साथ प्रशिक्षित किया गया है जिसका मैंने पहले वर्णन किया—जहां इनपुट और आउटपुट 200ms के हिस्सों में प्रोसेस होते हैं।

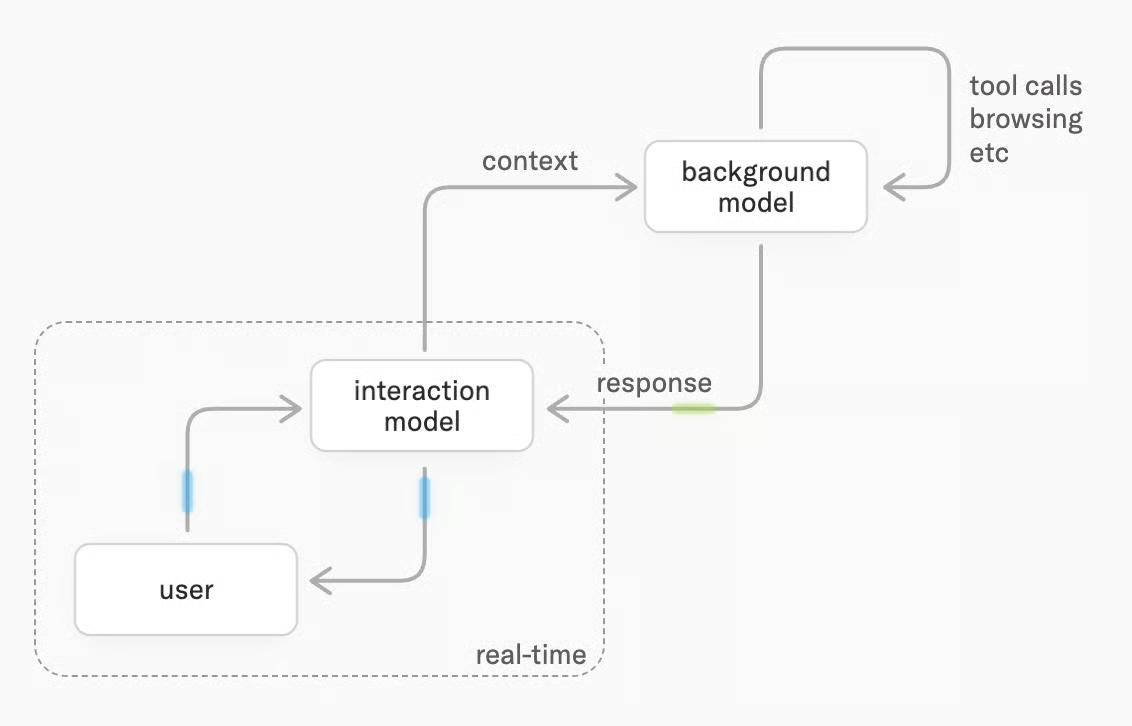

साझा कॉन्टेक्स्ट वाले दो मॉडलों का संयोजन तत्परता और बुद्धिमत्ता—दोनों प्रदान करता है। यूज़र को इंटरैक्शन मॉडल से रियल-टाइम में जवाब मिलते हैं, जबकि प्लानिंग, टूल-यूज़ और गहन रीजनिंग बैकग्राउंड मॉडल को सौंप दी जाती है, जो एसिंक्रोनस रूप से चलता है।

इसके बाद इंटरैक्शन मॉडल बिना बातचीत से बाहर हुए, बैकग्राउंड परिणामों को आते ही संवाद में पिरो देता है।

TML-Interaction-Small की विशेषताएं

जहां मौजूदा वॉयस AI मॉडल बारी-बारी से काम करते हैं (आप बोलते हैं, वे जवाब देते हैं), TML-Interaction-Small इंसानी बातचीत के साथी की तरह ज्यादा काम करता है। यहां चार क्षमताएं हैं जो इसे अलग बनाती हैं।

एक साथ बोलें और सुनें

TML-Interaction-Small यूज़र के बोलते समय ही स्पीच जनरेट कर सकता है। यह एक साथ अनुवाद (simultaneous translation) को संभव बनाता है: आप एक भाषा में बोलते हैं, और मॉडल आपके वाक्य पूरा होने से पहले ही अनुवाद शुरू कर देता है। इसका मतलब यह भी है कि मॉडल गलती पकड़ते ही वाक्य के बीच में टोक सकता है, या आप कुछ समझा रहे हों तो बीच-बीच में मौखिक संकेत ("समझ गया", "जारी रखें") दे सकता है।

यह तब भी उपयोगी है जब किसी विशिष्ट प्रॉम्प्टेड घटना पर रियल-टाइम कस्टम प्रतिक्रिया देनी हो। उदाहरण के लिए, रिलीज़ नोट्स की एक क्लिप में दिखाया गया है कि मॉडल जब भी यूज़र भुगतान का ज़िक्र करता है तो EUR राशियों को USD में बदलकर तुरंत बता देता है।

पूछे बिना वीडियो देखें और प्रतिक्रिया दें

TML-Interaction-Small ऑडियो के साथ-साथ वीडियो को भी प्रोसेस करता है और जो वो देखता है उसके आधार पर बिना किसी मौखिक प्रॉम्प्ट के स्पीच शुरू कर सकता है।

अगर आप कैमरे पर पुश-अप्स कर रहे हैं, तो यह होते ही गिनती ज़ोर से कर सकता है। अगर किसी वीडियो स्ट्रीम में कोई प्रासंगिक ऑब्जेक्ट दिखता है, तो यह उसी क्षण उसका उल्लेख कर सकता है जब वह दिखाई देता है। हालांकि, यह फीचर अभी और सुधर सकता है—जैसा कि आंतरिक RepCount-A स्कोर से दिखता है, जिसमें केवल एक-तिहाई (33.4%) उदाहरण ग्राउंड ट्रुथ से एक रेप के भीतर थे।

रिलीज़ की एक क्लिप (जो मेरी राय में थोड़ी अजीब लगती है) इसे क्रिया में दिखाती है: जब यूज़र की पोस्चर पर ध्यान देने को कहा गया, तो मॉडल ने लैपटॉप पर झुकाव तुरंत पकड़ लिया और उसे ठीक करने की याद दिलाई।

मौजूदा कमर्शियल रियल-टाइम APIs केवल ऑडियो-आधारित हैं। वे बोले गए टर्न्स पर जवाब देते हैं लेकिन विज़ुअल बदलावों पर सक्रिय रूप से प्रतिक्रिया देने का कोई तरीका नहीं है। यह क्षमता आज GPT-Realtime-2 या Gemini Live में मौजूद नहीं है।

बाधाएं और स्व-सुधार स्वाभाविक रूप से संभालें

अगर आप वाक्य शुरू करें, फिर अपना मन बदलें और बीच में खुद को सुधारें, तो TML-Interaction-Small उस सुधार को ट्रैक करता है और वही जवाब देता है जो आपका वास्तविक आशय था। यह बैकचैनलिंग (जब यह बोल रहा हो तो आपका "हूँ-हूँ" या "ठीक है" कहना) को संभालता है और यह भी भेद कर सकता है कि कोई उससे बात कर रहा है या कमरे में किसी और से।

ये वे स्थितियां हैं जहां टर्न-आधारित मॉडल अक्सर टूट जाते हैं। वे या तो जब नहीं रुकना चाहिए तब रुक जाते हैं, या कही गई बात के गलत हिस्से पर प्रतिक्रिया देते हैं। देखना होगा कि TML-Interaction-Small रोजमर्रा की स्थितियों में भी क्यूरेटेड डेमो वीडियोज़ जितना अच्छा संभाल पाता है या नहीं।

मौजूद रहते हुए बैकग्राउंड में जटिल टास्क चलाएं

बैकग्राउंड मॉडल वही है जो इंटरैक्शन मॉडल को सिर्फ तेज़ ही नहीं, बल्कि बुद्धिमान भी बनाता है। आप बैकग्राउंड टास्क चलते हुए फॉलो-अप सवाल पूछते रह सकते हैं या विषय बदल सकते हैं। जब परिणाम तैयार हो जाते हैं, तो मॉडल उन्हें किसी स्वाभाविक क्षण पर बातचीत में फिर से पिरो देता है—आपको अचानक संदर्भ बदलाव से टोकता नहीं है।

इसका मतलब है कि आपको तेज़ संवादात्मक प्रतिक्रियाएं भी मिलती हैं और बहु-चरणीय टास्क संभालने की क्षमता भी—जिनके लिए आमतौर पर मॉडल को कुछ सेकंड के लिए चुप होना पड़ता। एक क्विज़ डेमो क्लिप में, यह काफी अच्छा काम करता दिखता है: तीन यूज़र तेज़ रफ़्तार से ट्रिविया सवाल पूछते हैं, और मॉडल ज़्यादातर उनकी गति के साथ बना रहता है।

TML-Interaction-Small बेंचमार्क्स

थिंकिंग मशीनज़ ने दो श्रेणियों में परिणाम रिपोर्ट किए हैं: स्ट्रीमिंग बेंचमार्क्स जो इंटरैक्टिविटी को मापते हैं, और टर्न-आधारित बेंचमार्क्स जो बुद्धिमत्ता को मापते हैं। मॉडल के सबसे मज़बूत परिणाम स्ट्रीमिंग पक्ष पर हैं, जहां इसकी आर्किटेक्चरल पसंद का सबसे प्रत्यक्ष परीक्षण होता है।

इंटरैक्टिविटी

FD-bench v1.5 मॉडल को प्री-रिकॉर्डेड ऑडियो देता है और चार परिदृश्यों में इसके व्यवहार को मापता है:

- यूज़र द्वारा बाधा डालना

- यूज़र बैकचैनल

- दूसरों से बात करना

- बैkg्राउंड स्पीच

TML-Interaction-Small का स्कोर 77.8 है, जबकि न्यूनतम सेटिंग्स पर Gemini-3.1-flash-live-preview का 54.3 और GPT-Realtime-2.0 का 46.8 है। यहां तक कि अपनी सबसे ऊंची रीजनिंग सेटिंग (xhigh) पर भी GPT-Realtime-2.0 केवल 47.8 स्कोर करता है।

यह वह बेंचमार्क है जो सबसे सीधे तौर पर मापता है कि थिंकिंग मशीनज़ किस दिशा में निर्माण कर रही है। निकटतम प्रतियोगी पर 30-पॉइंट का अंतर मामूली नहीं है। सवाल यह है कि क्या FD-bench v1.5 व्यवहार में मायने रखने वाली इंटरैक्टिविटी की पूरी रेंज को कैप्चर करता है—जिसे थिंकिंग मशीनज़ खुद एक ओपन रिसर्च प्रश्न मानती है।

टर्न-टेकिंग लेटेंसी

TML-Interaction-Small FD-bench v1 में 0.40 सेकंड की टर्न-टेकिंग लेटेंसी हासिल करता है, जो तुलना किए गए मॉडलों में सबसे तेज़ है। Gemini-3.1-flash-live-preview 0.57 सेकंड के साथ सबसे करीब आता है। न्यूनतम सेटिंग्स पर भी GPT-Realtime-2.0 लगभग तीन गुना समय लेता है (1.18 सेकंड); xhigh रीजनिंग पर यह 1.63 सेकंड तक पहुंचता है।

टेक्स्ट की तुलना में वॉयस इंटरैक्शन में लेटेंसी अधिक मायने रखती है। यूज़र के बोलना खत्म करने और मॉडल के जवाब शुरू करने के बीच 1.2 सेकंड का अंतर न सिर्फ महसूस होने लायक होता है, बल्कि बाधक भी होता है। 0.40 सेकंड का परिणाम TML-Interaction-Small को मानवीय बातचीत के जवाब समयों के करीब लाता है।

बुद्धिमत्ता और निर्देशों का पालन

Audio MultiChallenge ऑडियो में बुद्धिमत्ता और निर्देश-पालन को मापता है। TML-Interaction-Small 43.4% स्कोर करता है, जो GPT-Realtime-1.5 (34.7%) और Gemini-3.1-flash-live-preview (26.8%) से ऊपर है, पर GPT-Realtime-2.0 के xhigh (48.5%) से नीचे है। यहीं पर बुद्धिमत्ता–इंटरैक्टिविटी ट्रेड-ऑफ दिखता है।

TML-Interaction-Small और GPT-Realtime-2.0 (xhigh) के बीच 5.1 प्रतिशत अंक का अंतर है। यह महत्वपूर्ण है, पर बहुत बड़ा नहीं—और GPT-Realtime-2.0 की ओर लेटेंसी लागत भी उल्लेखनीय है (1.63 सेकंड बनाम 0.40 सेकंड)। यह ट्रेड-ऑफ उपयोग के मामले पर निर्भर करेगा।

रिस्पॉन्स गुणवत्ता और टूल-यूज़

FD-bench v3 ऑडियो-प्लस-टूल्स परिदृश्यों में रिस्पॉन्स गुणवत्ता और टूल-कॉल शुद्धता को मापता है। बैकग्राउंड एजेंट सक्षम होने पर TML-Interaction-Small 82.8% रिस्पॉन्स गुणवत्ता और 68.0% pass@1 स्कोर करता है, जबकि GPT-Realtime-2.0 न्यूनतम सेटिंग्स पर 80.0% / 52.0% और xhigh पर 81.0% / 58.0% स्कोर करता है।

यहां pass@1 का अंतर (68.0% बनाम 58.0%) सबसे अर्थपूर्ण संख्या है, क्योंकि यह मापता है कि मॉडल टूल-निर्भर कार्यों को वास्तव में सही ढंग से पूरा करता है या नहीं। लगता है कि यूज़र इंटरेक्शन से टूल कॉल्स को अलग करने वाली दोहरी आर्किटेक्चर का लाभ मिल रहा है।

नई इंटरैक्टिविटी बेंचमार्क्स: TimeSpeak, CueSpeak, और विज़ुअल प्रॉएक्टिविटी

थिंकिंग मशीनज़ ने दो आंतरिक बेंचमार्क बनाए और तीन कम व्यापक रूप से उपयोग किए जाने वाले बेंचमार्क्स को अनुकूलित किया ताकि इंटरैक्टिविटी क्षमताओं को सीधे मापा जा सके। इन्हें ध्यान से देखना चाहिए क्योंकि कोई भी प्रतिस्पर्धी मॉडल इन पर अर्थपूर्ण प्रदर्शन नहीं करता।

- TimeSpeak (समयबद्ध स्पीच शुरुआत): TML-Interaction-Small 64.7% मैक्रो-एक्युरेसी स्कोर करता है।

- CueSpeak (मौखिक संकेत-ट्रिगर स्पीच): TML-Interaction-Small 81.7% मैक्रो-एक्युरेसी स्कोर करता है।

- RepCount-A (विज़ुअल क्रिया गिनती): TML-Interaction-Small 33.4% ऑफ-बाय-वन एक्युरेसी स्कोर करता है।

- ProactiveVideoQA (विज़ुअल संकेत-ट्रिगर स्पीच): TML-Interaction-Small 31.5 PAUC स्कोर करता है (नो-रिस्पॉन्स बेसलाइन = 25.0%)।

- Charades टेम्पोरल लोकलाइज़ेशन (विज़ुअल क्रिया समय-निर्धारण): TML-Interaction-Small 30.4 mIoU स्कोर करता है।

इन नए बेंचमार्क्स में से अधिकांश पर GPT realtime-2.0 पूरी तरह विफल रहता है—नतीजा शून्य के क़रीब, या यहां तक कि शून्य (Charades बेंचमार्क पर, जिसमें मॉडल को वीडियो के दौरान सही क्षणों पर "start" और "stop" कहना होता है)।

यह कहना कठिन है कि ये परिणाम कितने अर्थपूर्ण हैं, क्योंकि ये बेंचमार्क नए हैं और अभी स्वतंत्र रूप से मान्य नहीं हुए, पर ये आर्किटेक्चरल अंतर और तुलनीय बेंचमार्क परिणामों की समग्र तस्वीर का अनुसरण करते दिखते हैं।

TML-Interaction-Small की कीमत और उपलब्धता

TML-Interaction-Small फिलहाल सीमित रिसर्च प्रीव्यू में है, और कीमत के विवरण की घोषणा नहीं हुई है। थिंकिंग मशीनज़ 2026 के बाद के समय में व्यापक एक्सेस खोलने की योजना बना रही है। इच्छुक शोधकर्ता और डेवलपर interaction@thinkingmachines.ai पर टीम से संपर्क कर एक्सेस का अनुरोध कर सकते हैं।

तुलना के लिए, GPT-Realtime-2 की कीमत प्रति मिलियन ऑडियो इनपुट टोकन $32 और प्रति मिलियन ऑडियो आउटपुट टोकन $64 है, जैसा कि हमने अपने GPT-Realtime-2 ओवरव्यू में कवर किया है। TML-Interaction-Small की कीमत संभवतः व्यापक रिलीज़ के साथ ही घोषित होगी।

जैसा कि आपने शायद नोट किया होगा, मॉडल के नाम में "-Small" उपसर्ग है—और आप सही हैं यह अपेक्षा करने में कि थिंकिंग मशीनज़ बड़े मॉडल्स के साथ आगे आएगी। वे अभी सर्व करने के लिए बहुत धीमे हैं, पर 2026 के उत्तरार्ध में रिलीज़ की योजना है।

TML-Interaction-Small बनाम GPT-Realtime-2

दोनों मॉडलों के बीच अधिक रोचक अंतर इंटरैक्टिविटी बेंचमार्क्स में है। FD-bench v1.5 पर—जो यूज़र बाधा, बैकचैनलिंग, दूसरों से बात करना, और बैकग्राउंड स्पीच में व्यवहार मापता है—TML-Interaction-Small 77.8 स्कोर करता है। GPT-Realtime-2.0 न्यूनतम सेटिंग्स पर 46.8 और अपनी सबसे ऊंची रीजनिंग सेटिंग (xhigh) पर 47.8 स्कोर करता है। यह उस बेंचमार्क पर 30-पॉइंट का अंतर है जो सीधे तौर पर मापता है कि थिंकिंग मशीनज़ किसके लिए ऑप्टिमाइज़ कर रही है।

बुद्धिमत्ता में एक ट्रेड-ऑफ है, लेकिन यहां अंतर इंटरैक्टिविटी की तुलना में बहुत छोटा है। Audio MultiChallenge पर GPT-Realtime-2.0 (xhigh) 48.5% स्कोर करता है, जबकि TML-Interaction-Small 43.4% पर है। BigBench Audio पर, GPT-Realtime-2.0 (high) 96.6% बनाम TML-Interaction-Small के 75.7% (हालांकि बैकग्राउंड एजेंट सक्षम होने पर TML-Interaction-Small 96.5% तक पहुंचता है)।

उभरती समग्र तस्वीर यह है कि TML-Interaction-Small तत्परता और इंटरैक्टिविटी में आगे है, जबकि GPT-Realtime-2.0 उच्च रीजनिंग सेटिंग्स पर रॉ इंटेलिजेंस बेंचमार्क्स में बढ़त बनाए हुए है।

| बेंचमार्क | TML-Interaction-Small | GPT-Realtime-2.0 (न्यूनतम) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (न्यूनतम) |

|---|---|---|---|---|

| FD-bench v1 टर्न-टेकिंग लेटेंसी (सेकंड) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 औसत | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 रिस्पॉन्स गुणवत्ता (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio शुद्धता (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) शुद्धता (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval टेक्स्ट शुद्धता (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* बैकग्राउंड एजेंट सक्षम होने पर।

OpenAI के ऑडियो मॉडल परिवार को कार्रवाई में देखने के लिए हमारा GPT-Realtime-2 API ट्यूटोरियल देखें।

अंतिम विचार

TML-Interaction-Small उम्मीद जगाता है। अगर यह रिलीज़ नोट्स में किए गए दावों पर खरा उतरता है, तो नया मॉडल कम लेटेंसी के साथ इंटरैक्टिविटी में उल्लेखनीय सुधार लाता है—बिना रिस्पॉन्स गुणवत्ता या रीजनिंग पावर की कुर्बानी दिए। एक साथ बोलने, सुनने और विज़ुअल संकेतों पर प्रतिक्रिया देने की क्षमता फिलहाल अनोखी है और कई संभावनाएं खोलती है। मैं उत्सुक हूं कि सार्वजनिक रिलीज़ पर इसकी कीमत कैसी दिखेगी।

GPT-Realtime-2 के मुकाबले बुद्धिमत्ता का अंतर वास्तविक है, पर इंटरैक्टिविटी के अंतर से संकरा है। जिन अनुप्रयोगों में बातचीत प्राकृतिक महसूस होनी चाहिए, वहां लेटेंसी का फर्क बुद्धिमत्ता के अंतर से ज्यादा मायने रखता है। जिन अनुप्रयोगों में कठिन रीजनिंग टास्क पर सटीकता प्राथमिकता है, वहां उच्च रीजनिंग सेटिंग्स पर GPT-Realtime-2.0 अभी भी आगे है।

अगर आप AI मॉडलों के व्यापक परिदृश्य और उनके साथ प्रभावी ढंग से काम करना सीखना चाहते हैं, तो हमारी AI Fundamentals स्किल ट्रैक से शुरुआत करने की सलाह देता हूं।