programa

La semana pasada, GPT-Realtime-2 de OpenAI subió el listón de la voz con IA al presentarse con razonamiento de clase GPT-5 y una ventana de contexto de 128K. Ahora, el Thinking Machines Lab de Mira Murati plantea otra idea: que la capacidad de respuesta y la inteligencia deben entrenarse juntas desde cero en el mismo modelo, no acoplarse después con detectores de actividad de voz y capas de gestión del diálogo.

El laboratorio denomina a este tipo de modelo nuevo un "modelo de interacción".

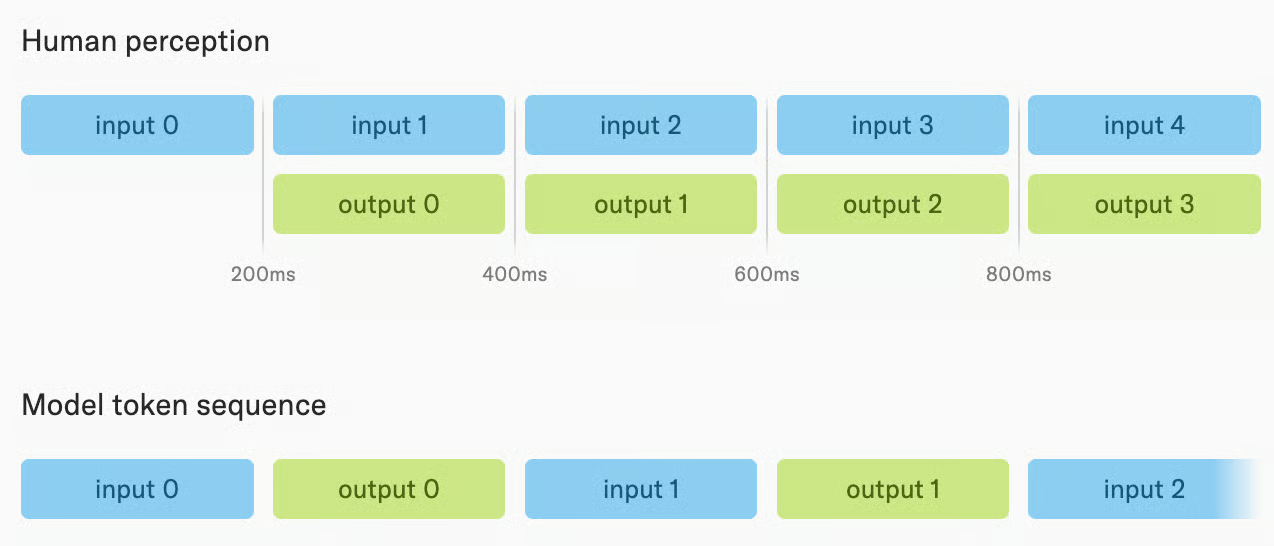

Su vista previa de investigación, TML-Interaction-Small, es el primer resultado de este enfoque. Es un modelo Mixture-of-Experts de 276B parámetros con 12B activos. Procesa audio, vídeo y texto en microturnos continuos de 200 ms, lo que significa que percibe y responde a la vez en lugar de esperar a que el interlocutor termine.

En este artículo, te cuento qué es TML-Interaction-Small, repaso sus características clave de arquitectura, comparo directamente con GPT-Realtime-2 y analizo en detalle los resultados de los benchmarks.

¿Qué son los modelos de interacción?

Thinking Machines Lab describe un modelo de interacción como un sistema donde la interactividad forma parte del propio modelo, no se implementa en un arnés externo. El principio clave es que la capacidad de respuesta y la inteligencia deben entrenarse juntas desde cero, con flujos continuos de audio y vídeo, en lugar de acoplarse a posteriori sobre un modelo basado en texto.

La mayoría de los sistemas de voz en tiempo real actuales encadenan componentes de detección de actividad de voz, codificadores independientes y capas de gestión del diálogo para simular la interactividad. Thinking Machines Lab sostiene que este enfoque siempre irá por detrás de los modelos que gestionan la interacción de forma nativa debido a límites de turno artificiales que restringen lo que puede hacer un modelo no interactivo.

En lugar de consumir la entrada del usuario de forma secuencial y luego generar una respuesta completa, los modelos de interacción del laboratorio están diseñados para acercarse más a la percepción humana. Tratan tanto las entradas como las salidas como flujos, e intercalan ambos en microturnos de 200 milisegundos.

Así, un modelo de interacción percibe y responde a la vez, procesando entrada y salida en paralelo en lugar de esperar a que termine quien habla. Esto habilita varias capacidades interesantes:

Así, un modelo de interacción percibe y responde a la vez, procesando entrada y salida en paralelo en lugar de esperar a que termine quien habla. Esto habilita varias capacidades interesantes:

- Hablar mientras escucha

- Reaccionar a señales visuales sin que se le pida

- Controlar el tiempo transcurrido de forma directa

Todo ello resulta inalcanzable para los modelos por turnos con arneses externos, por mucha capacidad de razonamiento que tengan.

¿Qué es TML-Interaction-Small?

TML-Interaction-Small es la primera versión pública del laboratorio y la primera implementación de su arquitectura de modelos de interacción.

Es un modelo Mixture-of-Experts de 276B parámetros con 12B activos, entrenado desde cero sobre flujos continuos de audio y vídeo usando el diseño de microturnos multistream que describí antes, donde las entradas y salidas se procesan en bloques de 200 ms.

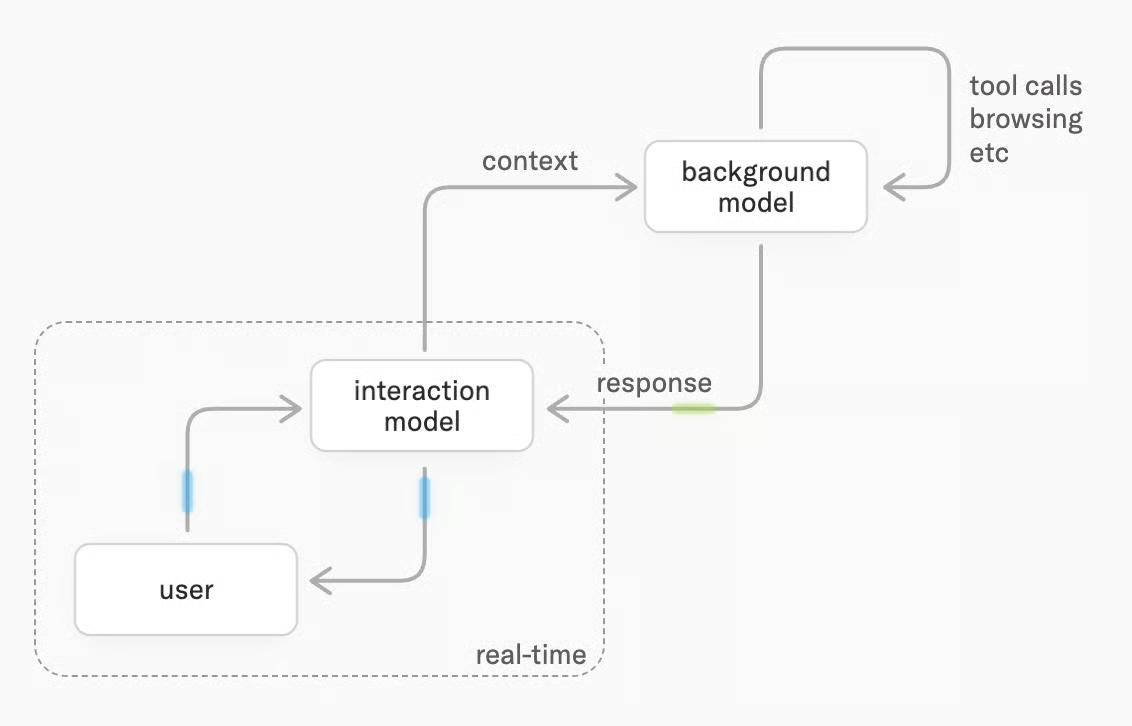

La combinación de dos modelos con un contexto compartido ofrece tanto rapidez de respuesta como inteligencia. El modelo de interacción contesta en tiempo real, mientras que la planificación, el uso de herramientas y el razonamiento más profundo se delegan al modelo en segundo plano, que se ejecuta de forma asíncrona.

El modelo de interacción integra después los resultados del segundo plano en la conversación a medida que llegan, sin desconectarse del diálogo.

Funciones de TML-Interaction-Small

Mientras que los modelos de voz existentes funcionan por turnos (tú hablas, ellos responden), TML-Interaction-Small se comporta más como un interlocutor humano. Estas son las cuatro capacidades que lo diferencian.

Habla y escucha a la vez

TML-Interaction-Small puede generar voz mientras tú sigues hablando. Esto hace posible la traducción simultánea: hablas en un idioma y el modelo empieza a traducir antes de que termines la frase. También puede interrumpir a mitad de frase cuando detecta un error o dar señales verbales ("entendido", "sigue") mientras estás explicando algo.

También es útil para respuestas personalizadas en tiempo real cuando ocurre un evento concreto indicado en el prompt. En una de las demos, por ejemplo, el modelo convierte importes en EUR y dice el equivalente en USD siempre que el usuario menciona un pago.

Ve y reacciona al vídeo sin que se lo pidas

TML-Interaction-Small procesa vídeo junto con audio y puede iniciar el habla en función de lo que ve, sin necesidad de una instrucción verbal.

Si haces flexiones ante la cámara, puede contar repeticiones en voz alta según ocurren. Si aparece un objeto relevante en el flujo de vídeo, puede señalarlo en el momento en que se hace visible. No obstante, esta función aún tiene margen de mejora, como se aprecia en la puntuación interna RepCount-A, donde solo un tercio (33,4%) de las instancias quedaron a una repetición de la referencia.

Un clip de la presentación (algo pintoresco, en mi opinión) lo demuestra: al pedirle que vigile la postura de la usuaria, el modelo detectó al instante que se encorvaba ante el portátil y le recordó que la corrigiera.

Las APIs comerciales de tiempo real actuales son solo de audio. Responden a turnos hablados, pero no pueden reaccionar de forma proactiva a cambios visuales. Hoy por hoy, esta capacidad no existe en GPT-Realtime-2 ni en Gemini Live.

Gestiona interrupciones y autocorrecciones con naturalidad

Si empiezas una frase, cambias de idea y te corriges a mitad, TML-Interaction-Small sigue la corrección y responde a lo que realmente quieres decir. Gestiona el backchannel (cuando dices "ajá" o "vale" mientras habla) y distingue si te diriges a él o a otra persona en la sala.

Estos son casos en los que los modelos por turnos suelen fallar. O bien dejan de hablar cuando no deben, o contestan a la parte equivocada. Veremos si TML-Interaction-Small lo maneja igual de bien en situaciones cotidianas que en demos cuidadas.

Ejecuta tareas complejas en segundo plano sin desconectarse

El modelo en segundo plano es lo que hace que el modelo de interacción no solo sea rápido, sino también inteligente. Puedes seguir haciendo preguntas o cambiar de tema mientras la tarea en segundo plano se ejecuta. Cuando los resultados están listos, el modelo los incorpora a la conversación en un momento natural en lugar de interrumpirte con un cambio de contexto brusco.

Así obtienes respuestas conversacionales rápidas y, a la vez, la capacidad de abordar tareas de varios pasos que normalmente harían que el modelo guardara silencio durante segundos. En una demo de trivial, funciona bastante bien: tres usuarios lanzan preguntas a gran velocidad y el modelo, en general, mantiene el ritmo.

Benchmarks de TML-Interaction-Small

Thinking Machines publica resultados en dos categorías: benchmarks en streaming que miden interactividad y benchmarks por turnos que miden inteligencia. Los mejores resultados del modelo están en la parte de streaming, donde sus decisiones arquitectónicas se ponen a prueba de forma más directa.

Interactividad

FD-bench v1.5 alimenta al modelo con audio pregrabado y evalúa su comportamiento en cuatro escenarios:

- Interrupción del usuario

- Backchannel del usuario

- Hablar con otras personas

- Habla de fondo

TML-Interaction-Small obtiene 77,8, frente a 54,3 de Gemini-3.1-flash-live-preview en ajustes mínimos y 46,8 de GPT-Realtime-2.0 también en mínimos. Incluso GPT-Realtime-2.0 en su ajuste de razonamiento más alto (xhigh) solo alcanza 47,8.

Este es el benchmark que más directamente mide el objetivo de Thinking Machines. Una diferencia de 30 puntos sobre el competidor más cercano no es marginal. La cuestión es si FD-bench v1.5 recoge todo el espectro de interactividad relevante en la práctica, algo que el propio laboratorio reconoce como una pregunta abierta de investigación.

Latencia en la toma de turnos

TML-Interaction-Small alcanza una latencia de toma de turno de 0,40 segundos en FD-bench v1, la más rápida de los modelos comparados. Gemini-3.1-flash-live-preview se acerca con 0,57 segundos. Incluso en ajustes mínimos, GPT-Realtime-2.0 tarda unas tres veces más (1,18 s); en xhigh llega a 1,63 s.

La latencia importa mucho más en interacción por voz que en texto. Un desfase de 1,2 segundos entre el final de la intervención del usuario y el inicio de la respuesta del modelo no solo se percibe: resulta molesto. El resultado de 0,40 s acerca a TML-Interaction-Small a los tiempos de respuesta de una conversación humana.

Inteligencia y seguimiento de instrucciones

Audio MultiChallenge mide inteligencia y seguimiento de instrucciones en audio. TML-Interaction-Small obtiene un 43,4%, por encima de GPT-Realtime-1.5 (34,7%) y Gemini-3.1-flash-live-preview (26,8%), pero por debajo de GPT-Realtime-2.0 en xhigh (48,5%). Aquí se aprecia la compensación entre inteligencia e interactividad.

La diferencia entre TML-Interaction-Small y GPT-Realtime-2.0 en xhigh es de 5,1 puntos porcentuales. Es significativa, pero no enorme, y conlleva un coste de latencia notable en GPT-Realtime-2.0 (1,63 s frente a 0,40 s). Que compense o no depende de la aplicación.

Calidad de respuesta y uso de herramientas

FD-bench v3 mide la calidad de las respuestas y la precisión en llamadas a herramientas en escenarios de audio más herramientas. TML-Interaction-Small logra un 82,8% en calidad de respuesta y un 68,0% en pass@1 con el agente en segundo plano activado, frente a 80,0% / 52,0% de GPT-Realtime-2.0 en mínimos y 81,0% / 58,0% en xhigh.

La brecha en pass@1 (68,0% frente a 58,0%) es el dato más relevante aquí, porque mide si el modelo completa correctamente tareas que dependen de herramientas. Parece que la arquitectura dual que separa las llamadas a herramientas de la interacción con el usuario da sus frutos.

Nuevos benchmarks de interactividad: TimeSpeak, CueSpeak y proactividad visual

Thinking Machines creó dos benchmarks internos y adaptó otros tres menos extendidos para medir la interactividad de forma directa. Merece la pena examinarlos con atención porque ningún modelo competidor rinde de forma significativa en ellos.

- TimeSpeak (inicio de habla cronometrado): TML-Interaction-Small obtiene 64,7% de macro-accuracy.

- CueSpeak (habla activada por señales verbales): TML-Interaction-Small obtiene 81,7% de macro-accuracy.

- RepCount-A (conteo de acciones visuales): TML-Interaction-Small obtiene 33,4% en precisión off-by-one.

- ProactiveVideoQA (habla activada por señales visuales): TML-Interaction-Small obtiene 31,5 PAUC (línea base sin respuesta = 25,0%).

- Charades temporal localization (temporización de acciones visuales): TML-Interaction-Small obtiene 30,4 mIoU.

En la mayoría de estos nuevos benchmarks, GPT-Realtime-2.0 falla por completo, con resultados cercanos a cero o incluso cero (en Charades, donde el modelo debe decir "inicio" y "fin" en los momentos correctos de un vídeo).

Es difícil valorar cuán significativos son estos resultados, ya que los benchmarks son nuevos y aún no están validados de forma independiente, pero encajan con la foto general: diferencias arquitectónicas y resultados comparables en el resto de pruebas.

Precio y disponibilidad de TML-Interaction-Small

TML-Interaction-Small está actualmente en una vista previa de investigación limitada y no se han anunciado precios. Thinking Machines planea abrir el acceso de forma más amplia más adelante en 2026. Investigadores y desarrolladores interesados pueden contactar con el equipo en interaction@thinkingmachines.ai para solicitar acceso.

Como referencia, GPT-Realtime-2 cuesta 32 $ por millón de tokens de audio de entrada y 64 $ por millón de tokens de audio de salida, como contamos en nuestro resumen de GPT-Realtime-2. Es probable que el precio de TML-Interaction-Small se anuncie junto con el lanzamiento más amplio.

Como habrás visto, el modelo lleva el sufijo "-Small", y es razonable esperar que Thinking Machines lance modelos más grandes. De momento son demasiado lentos para servir, pero hay una publicación prevista para finales de 2026.

TML-Interaction-Small vs. GPT-Realtime-2

La diferencia más interesante entre ambos modelos está en los benchmarks de interactividad. En FD-bench v1.5, que mide el comportamiento ante interrupciones del usuario, backchanneling, hablar con otros y habla de fondo, TML-Interaction-Small obtiene 77,8. GPT-Realtime-2.0 en ajustes mínimos obtiene 46,8 y en su ajuste de razonamiento más alto (xhigh) 47,8. Es una brecha de 30 puntos en el benchmark que mejor refleja el objetivo de Thinking Machines.

Hay una cesión en inteligencia, pero la diferencia es mucho menor que en interactividad. GPT-Realtime-2.0 en xhigh logra 48,5% en Audio MultiChallenge frente al 43,4% de TML-Interaction-Small. En BigBench Audio, GPT-Realtime-2.0 en high alcanza 96,6% frente al 75,7% de TML-Interaction-Small (aunque TML-Interaction-Small llega al 96,5% con el agente en segundo plano activado).

La conclusión general es que TML-Interaction-Small lidera en capacidad de respuesta e interactividad, mientras que GPT-Realtime-2.0 en ajustes altos de razonamiento lidera en pruebas de inteligencia pura.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (mínimo) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (mínimo) |

|---|---|---|---|---|

| FD-bench v1 latencia de toma de turno (s) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 media | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 calidad de respuesta (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio precisión (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) precisión (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval texto precisión (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* Con el agente en segundo plano activado.

Si quieres ver en acción la familia de modelos de audio de OpenAI, echa un vistazo a nuestro tutorial del API de GPT-Realtime-2.

Reflexiones finales

TML-Interaction-Small pinta muy bien. Si cumple lo que promete la nota de lanzamiento, aporta una interactividad muy superior con baja latencia, sin sacrificar calidad de respuesta ni capacidad de razonamiento. La posibilidad de hablar, escuchar y responder a señales visuales a la vez es única por ahora y abre muchas posibilidades. Tengo curiosidad por ver qué precio tendrá cuando se lance al público.

La brecha de inteligencia respecto a GPT-Realtime-2 existe, pero es menor que la distancia en interactividad. Para aplicaciones donde la conversación debe sonar natural, esa diferencia de latencia pesa más que la de inteligencia. Para aplicaciones donde prima la precisión en tareas de razonamiento complejo, GPT-Realtime-2.0 en ajustes altos sigue por delante.

Si quieres ponerte al día sobre el panorama general de modelos de IA y cómo trabajar con ellos con eficacia, te recomiendo empezar por nuestro itinerario de aprendizaje AI Fundamentals.

Preguntas frecuentes sobre TML-Interaction-Small

¿Qué es un modelo de interacción?

Un modelo de interacción es un sistema de voz con IA en el que la interactividad está integrada en el propio modelo, en lugar de añadirse mediante componentes externos como la detección de actividad de voz o la gestión del diálogo. Procesa entrada y salida a la vez, por lo que puede escuchar y hablar simultáneamente en lugar de esperar por turnos.

¿Quién está detrás de Thinking Machines Lab?

Thinking Machines Lab está dirigido por Mira Murati, ex CTO de OpenAI. TML-Interaction-Small es la primera versión pública del laboratorio, presentada como una vista previa de investigación de su arquitectura de modelos de interacción.

¿Cómo se compara TML-Interaction-Small con GPT-Realtime-2 de OpenAI?

TML-Interaction-Small lidera en interactividad, con 77,8 en FD-bench v1.5 frente a 47,8 de GPT-Realtime-2 en su ajuste más alto, y una latencia de toma de turno más baja (0,40 s frente a 1,63 s). GPT-Realtime-2 lidera en pruebas de inteligencia pura como Audio MultiChallenge (48,5% vs. 43,4%).

¿Puede TML-Interaction-Small procesar vídeo?

Sí. Procesa vídeo junto con audio y puede reaccionar a eventos visuales sin una instrucción verbal del usuario; por ejemplo, contar repeticiones de ejercicio ante la cámara o señalar objetos cuando aparecen. Esta proactividad visual no existe en GPT-Realtime-2 ni en Gemini Live.

Editor de ciencia de datos en DataCamp | Me encanta hacer previsiones y crear con API.