Tracks

就在上周,OpenAI 推出的 GPT-Realtime-2 以 GPT-5 级推理能力和 128K 上下文窗口再次提升了语音 AI 的水位线。如今,Mira Murati 的 Thinking Machines Lab 提出了不同的主张:响应性与智能性应当从零开始在同一个模型中联合训练,而不是通过语音活动检测(VAD)与对话管理等外部组件“拼接”出来。

该实验室将这种新型模型称为“交互模型”(Interaction Model)。

其研究预览版本 TML-Interaction-Small 是这种方法的首个成果。它是一个具有 2760 亿参数的专家混合(Mixture-of-Experts)模型,活跃参数为 120 亿。它以连续的 200ms 微轮次处理音频、视频和文本,也就是说,它一边感知一边响应,而不是等待说话者结束。

本文将介绍 TML-Interaction-Small 是什么,梳理其关键架构特性,并与 GPT-Realtime-2 进行直接对比,并详细解读基准测试结果。

什么是交互模型?

Thinking Machines Lab 将交互模型描述为一种将“交互性”内嵌到模型本身的系统,而不是通过外围框架实现。其核心理念是:应当在连续音视频流上,从零开始将“响应性”和“智能性”联合训练,而不是事后附加到一个文本模型之上。

多数现有的实时语音 AI 系统会把语音活动检测组件、独立编码器和对话管理层拼接起来,以模拟响应性。Thinking Machines Lab 认为,这种方法必然落后于原生处理交互的模型,因为人为的轮次边界限制了非交互式模型的能力。

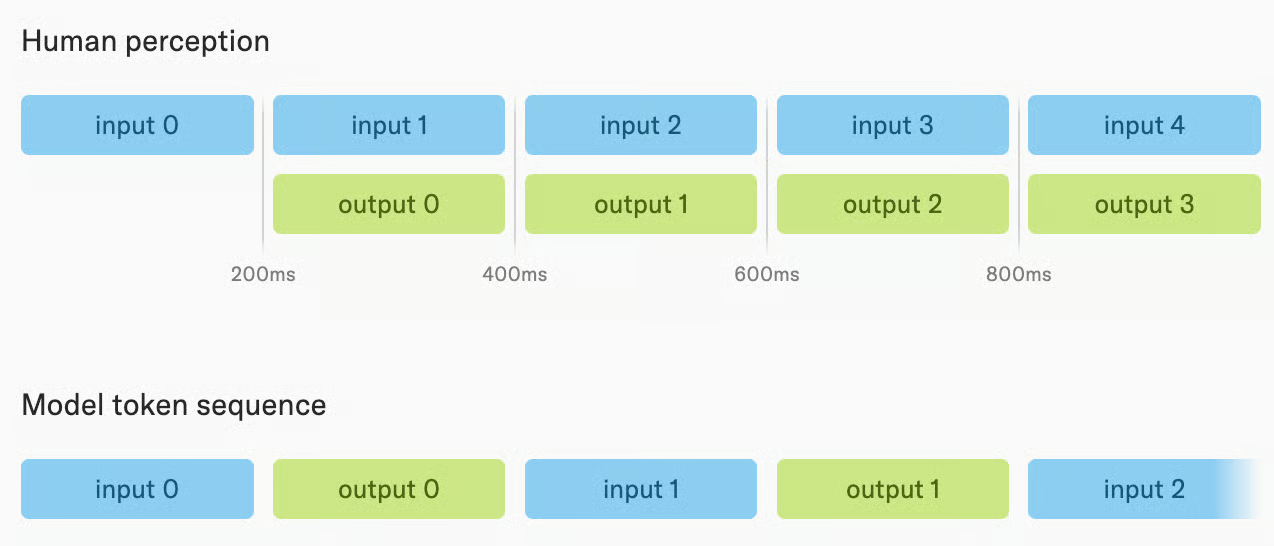

该实验室的交互模型不再是先顺序消费用户输入,再生成完整响应;它们更接近人类的感知方式。输入与输出的 token 都被视为流,并在每个 200 毫秒的微轮次中交错进行。

因此,交互模型能够同步感知与响应,以并行方式处理输入与输出,而无需等说话者结束。这带来了几项实用能力:

因此,交互模型能够同步感知与响应,以并行方式处理输入与输出,而无需等说话者结束。这带来了几项实用能力:

- 边听边说

- 无需提示即可对视觉线索作出反应

- 直接追踪已用时间

这些都是带外部框架的轮次式模型无论具备多强推理能力都无法复制的。

什么是 TML-Interaction-Small?

TML-Interaction-Small 是 Thinking Machines Lab 的首次公开模型发布,也是其交互模型架构的首个实现。

它是一个 2760 亿参数的 专家混合(Mixture-of-Experts) 模型,活跃参数为 120 亿,采用前述多流微轮次设计,在连续音视频流上从零开始训练,输入与输出以 200ms 为颗粒度处理。

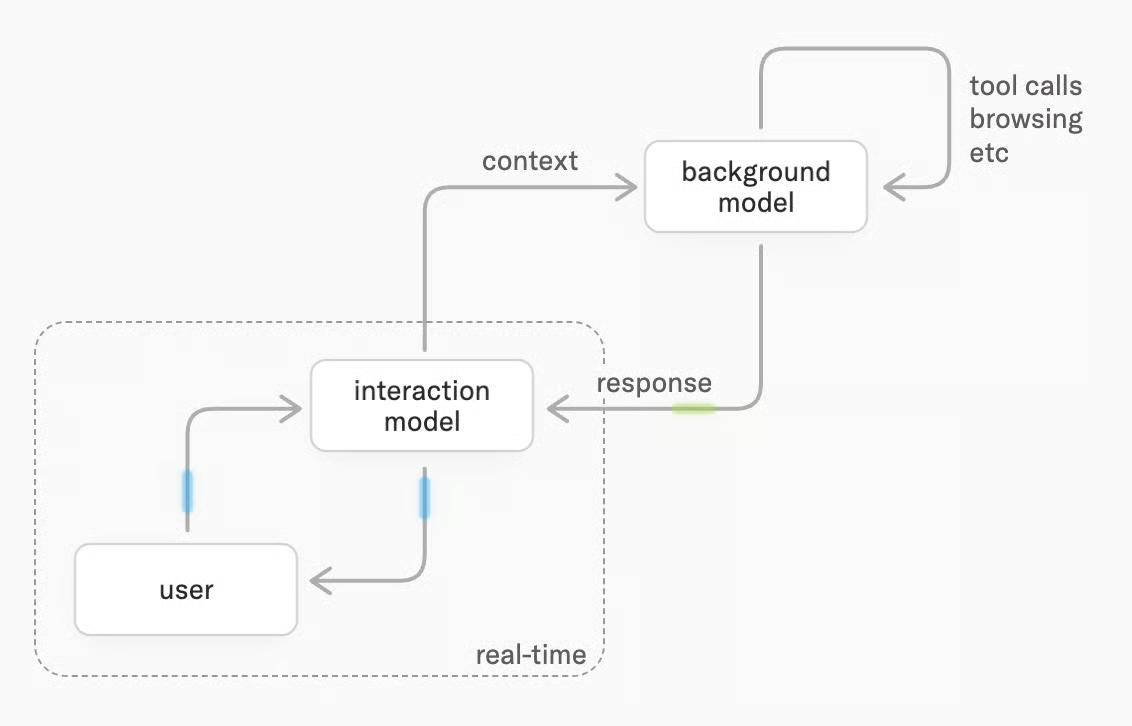

两个共享上下文的模型相结合,既带来响应性,也带来智能性。交互模型实时向用户给出答案,而规划、工具使用和更深层的推理由后台模型异步承担。

随后,交互模型会在不“脱离对话”的情况下,将后台结果随到随融入对话。

TML-Interaction-Small 的特性

不同于现有语音 AI 的轮流说话(您说完它再回应),TML-Interaction-Small 更像一位人类对话伙伴。以下四项能力使其与众不同。

同时说与听

TML-Interaction-Small 能在用户尚在说话时就开始输出语音。这使同声传译成为可能:您用一种语言讲话,模型在您未说完前就开始翻译。这也意味着模型能在捕捉到错误时“打断”纠正,或在您解释过程中给出口头提示(“明白了”“继续说”)。

对于特定触发事件下的自定义实时响应,这也很实用。发布说明中的一段演示片段显示:每当用户提及付款时,模型会将欧元金额换算并报出对应的美元金额。

无需提示即可“看见”并响应视频

TML-Interaction-Small 在处理音频的同时也处理视频,并且可以仅凭所见就主动发声,无需任何口头提示。

如果您在镜头前做俯卧撑,它能边看边出声计数。如果视频流中出现相关物体,它能在其刚一可见时就指出来。不过,这项能力仍有改进空间,从内部的 RepCount-A 得分可见,只有三分之一(33.4%)的实例在“偏差一个”范围内接近真实值。

发布的另一段演示(在我看来略显别致)展示了这一点:当被提示关注用户坐姿时,模型立即检测到她在笔记本电脑前含胸驼背,并提醒其纠正。

现有的商用实时 API 仅支持音频。它们只能对口语轮次做出回应,无法主动对视觉变化做反应。这一点在当前的 GPT-Realtime-2 或 Gemini Live 中都尚不存在。

自然处理打断与自我纠正

如果您开口后改变想法并在半句中纠正,TML-Interaction-Small 会跟踪该纠正并回应您的真实意图。它能处理“回馈信号”(在它说话时您说“嗯”“对”等),并区分是有人在对它说话,还是在对房间里其他人说话。

这类场景往往会让轮次式模型“翻车”。它们要么不该停时停了,要么回应了不该回应的部分。也很值得观察 TML-Interaction-Small 在日常场景中能否像精心剪辑的演示视频里那样稳健。

在保持“在场感”的同时后台运行复杂任务

后台模型让交互模型不仅快,而且聪明。 当后台任务运行时,您可以继续追问或换话题。当结果就绪,模型会在自然的时机把它们编织回对话中,而不是突然打断进行生硬的上下文切换。

这意味着您既能获得快速的对话式响应,也能处理通常需要模型“静默几秒”的多步骤任务。在一个问答小测的演示片段中,这一点表现不错:三位用户高频率抛出冷知识问题,模型大体能跟上节奏。

TML-Interaction-Small 的基准表现

Thinking Machines 从两类任务报告了结果:衡量交互性的流式基准,以及衡量智能性的轮次式基准。该模型在流式基准上的表现最强,这恰是其架构取舍最直接受检之处。

交互性

FD-bench v1.5 向模型提供预录音频,并在四种情境下评估其行为:

- 用户打断

- 用户回馈

- 与他人交谈

- 背景语音

TML-Interaction-Small 的得分为 77.8;作为对比,Gemini-3.1-flash-live-preview 在最低设置下为 54.3,GPT-Realtime-2.0 在最低设置下为 46.8。即便在最高推理设置(xhigh)下,GPT-Realtime-2.0 也仅为 47.8。

这是最直接衡量 Thinking Machines 目标的基准。在该项上领先最近对手 30 分,并非边际差异。问题在于 FD-bench v1.5 是否覆盖了实践中重要的交互性全谱——Thinking Machines 自身也承认,这是一个尚待研究的问题。

轮次切换时延

在 FD-bench v1 中,TML-Interaction-Small 的轮次切换时延为 0.40 秒,为对比模型中最快。Gemini-3.1-flash-live-preview 最接近,为 0.57 秒。即便在最低设置下,GPT-Realtime-2.0 也需要近三倍时长(1.18 秒);在 xhigh 推理下为 1.63 秒。

对语音交互而言,时延的重要性远高于文本。用户说完到模型开始回应之间若有 1.2 秒差距,不仅可感知,而且会打断交流节奏。0.40 秒的结果让 TML-Interaction-Small 更接近人类对话反应时间。

智能性与指令遵循

Audio MultiChallenge 衡量音频中的智能性与指令遵循。TML-Interaction-Small 得分 43.4%,高于 GPT-Realtime-1.5(34.7%)与 Gemini-3.1-flash-live-preview(26.8%),但低于 GPT-Realtime-2.0 在 xhigh 设置下的 48.5%。这是能看到“智能性—交互性”权衡的基准。

TML-Interaction-Small 与 GPT-Realtime-2.0(xhigh)之间的差距为 5.1 个百分点。这一差距不小,但也不大,并且在 GPT-Realtime-2.0 一侧伴随着显著的时延成本(1.63 秒对 0.40 秒)。是否值得,取决于应用场景。

响应质量与工具使用

FD-bench v3 在“音频+工具”的情境下衡量响应质量和工具调用准确率。启用后台代理时,TML-Interaction-Small 的响应质量为 82.8%,pass@1 为 68.0%;作为对比,GPT-Realtime-2.0 在最低设置下为 80.0% / 52.0%,在 xhigh 下为 81.0% / 58.0%。

这里最有意义的是 pass@1 的差距(68.0% 对 58.0%),因为它衡量模型是否真正正确完成依赖工具的任务。看起来,将工具调用与用户交互分离的双架构设计确有收益。

新的交互性基准:TimeSpeak、CueSpeak 与视觉前摄

Thinking Machines 自建了两个内部基准,并改编了三个较少使用的基准,以直接衡量交互能力。这些值得认真审视,因为目前没有竞争对手在这些任务上取得有意义的成绩。

- TimeSpeak(定时发声启动):TML-Interaction-Small 的宏准确率为 64.7%。

- CueSpeak(口头线索触发发声):宏准确率为 81.7%。

- RepCount-A(视觉动作计数):“偏差一内”准确率为 33.4%。

- ProactiveVideoQA(视觉线索触发发声):PAUC 为 31.5(不响应基线 = 25.0%)。

- Charades 时间定位(视觉动作时序):mIoU 为 30.4。

在上述大多数新基准上,GPT realtime-2.0 几乎完全失利,结果接近于零,或干脆为零(如 Charades 基准,需要模型在视频中的正确时刻说出“start”和“stop”)。

这些结果究竟有多大意义,目前很难断言,因为这些基准尚新,未获独立验证。但它们与架构差异及其他可比基准结果所呈现的整体图景是一致的。

TML-Interaction-Small 的定价与可用性

TML-Interaction-Small 目前处于有限的研究预览阶段,尚未公布定价细节。Thinking Machines 计划在 2026 年晚些时候开放更广泛的访问。有兴趣的研究者与开发者可通过 interaction@thinkingmachines.ai 联系团队申请访问。

作为对比,GPT-Realtime-2 的定价为每百万音频输入 token 32 美元、每百万音频输出 token 64 美元,详情可参阅我们的 GPT-Realtime-2 概览。TML-Interaction-Small 的定价预计会在更广泛发布时同步公布。

您也许已经注意到,模型带有 “-Small” 后缀,确实可以期待 Thinking Machines 推出更大模型。它们目前仍然过慢,无法服务化,计划在 2026 年底发布。

TML-Interaction-Small 与 GPT-Realtime-2 对比

两者之间更有意思的差距体现在交互性基准上。在衡量用户打断、回馈、与他人交谈、背景语音等行为的 FD-bench v1.5 上,TML-Interaction-Small 得分 77.8。GPT-Realtime-2.0 在最低设置下为 46.8,在最高推理(xhigh)下为 47.8。也就是说,在最能直接衡量 Thinking Machines 优化目标的这一基准上,相差 30 分。

在智能性上存在取舍,但差距远小于交互性。GPT-Realtime-2.0(xhigh)在 Audio MultiChallenge 上为 48.5%,TML-Interaction-Small 为 43.4%。在 BigBench Audio 上,GPT-Realtime-2.0(high)为 96.6%,TML-Interaction-Small 为 75.7%(不过启用后台代理后,TML-Interaction-Small 可达 96.5%)。

总体来看,TML-Interaction-Small 在响应性与交互性上领先,而在高推理设置下,GPT-Realtime-2.0 在原始智能性基准上占优。

| 基准 | TML-Interaction-Small | GPT-Realtime-2.0(最低) | GPT-Realtime-2.0(xhigh) | Gemini-3.1-flash-live(最低) |

|---|---|---|---|---|

| FD-bench v1 轮次切换时延(秒) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 平均分 | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 响应质量(%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR(%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio 准确率(%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval(VoiceBench)准确率(%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval 文本准确率(%) | 89.7 | 89.6 | 95.2 | 85.8 |

* 启用后台代理。

想了解 OpenAI 音频模型家族的实际表现,可查看我们的 GPT-Realtime-2 API 教程。

结语

TML-Interaction-Small 前景可期。如果能兑现发布说明中的说法,这一新模型在保持较短时延的同时,显著提升了交互性,又不牺牲响应质量或推理能力。其同时“说”“听”并对视觉线索作出反应的能力目前独树一帜,蕴含诸多可能。我也很好奇其正式公开时的定价。

与 GPT-Realtime-2 的智能差距确实存在,但明显小于交互性差距。对需要自然对话体验的应用而言,时延差异比智能差异更重要;而对以高难度推理准确性为优先的应用,开启高推理设置的 GPT-Realtime-2.0 仍然领先。

若您想更系统地了解 AI 模型的整体版图以及如何高效使用它们,推荐从我们的 AI Fundamentals 技能路径 开始。