Lernpfad

Erst letzte Woche hat OpenAIs GPT-Realtime-2 die Messlatte für Sprach-KI mit GPT-5-ähnlichem Denken und einem 128K-Kontextfenster angehoben. Jetzt setzt Mira Muratis Thinking Machines Lab einen anderen Akzent: Reaktionsfähigkeit und Intelligenz sollten von Anfang an im selben Modell gemeinsam trainiert werden – statt sie mit Voice-Activity-Detection-Gerüsten und Dialogmanagement drumherum zusammenzustückeln.

Das Labor nennt diesen neuen Typ ein „Interaktionsmodell“.

Die Forschungs-Vorschau TML-Interaction-Small ist das erste Ergebnis dieses Ansatzes. Es ist ein Mixture-of-Experts-Modell mit 276 Milliarden Parametern und 12 Milliarden aktiven Parametern. Es verarbeitet Audio, Video und Text in kontinuierlichen 200-ms-Mikro-Turns – es nimmt also wahr und antwortet gleichzeitig, statt zu warten, bis eine Person fertig gesprochen hat.

In diesem Artikel erkläre ich, was TML-Interaction-Small ist, führe durch die zentralen Architekturmerkmale, vergleiche es direkt mit GPT-Realtime-2 und schaue mir die Benchmark-Ergebnisse im Detail an.

Was sind Interaktionsmodelle?

Thinking Machines Lab beschreibt ein Interaktionsmodell als ein System, bei dem Interaktivität Teil des Modells selbst ist – nicht etwas, das außen herum implementiert wird. Das Kernprinzip lautet: Reaktionsfähigkeit und Intelligenz werden von Grund auf gemeinsam auf kontinuierlichen Audio- und Videoströmen trainiert, statt sie nachträglich auf ein textbasiertes Modell zu setzen.

Die meisten Echtzeit-Sprach-KI-Systeme kombinieren Voice-Activity-Detection-Komponenten, separate Encoder und Dialogschichten, um Reaktionsfähigkeit zu simulieren. Thinking Machines Lab argumentiert, dass dieser Ansatz nativ interaktive Modelle immer hinterherhinken lässt – wegen künstlicher Turn-Grenzen, die das nicht-interaktive Modell einschränken.

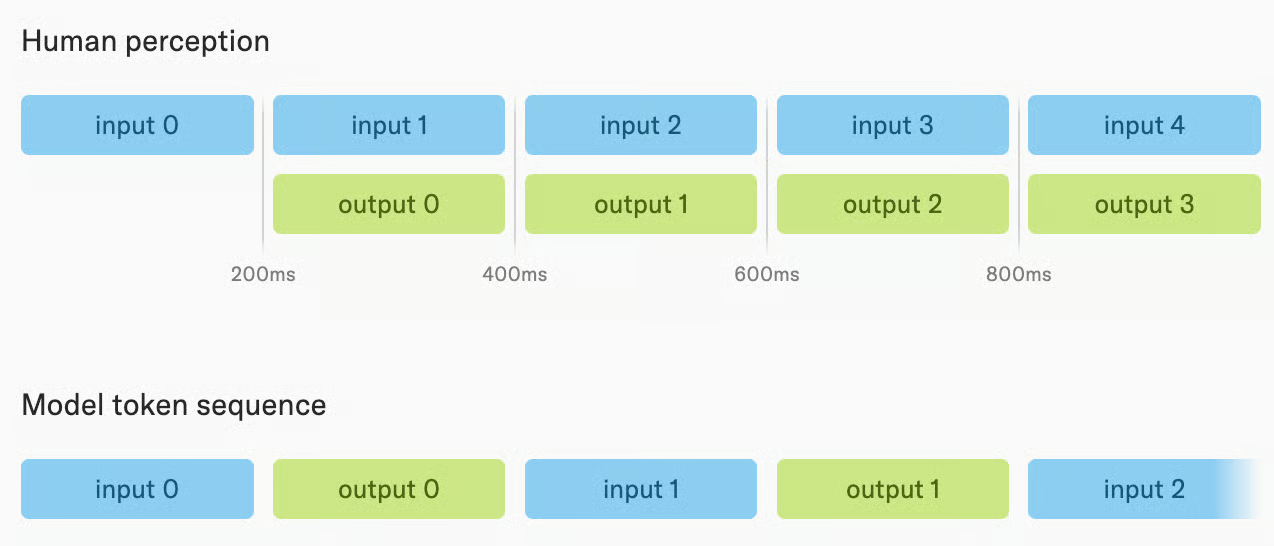

Statt Nutzereingaben sequentiell zu konsumieren und dann eine vollständige Antwort zu generieren, sind die Interaktionsmodelle des Labors näher an menschlicher Wahrnehmung. Eingabe- und Ausgabetoken werden als Ströme verstanden und in jedem 200-Millisekunden-Mikro-Turn ineinander verschachtelt.

Ein Interaktionsmodell nimmt also wahr und antwortet zugleich, verarbeitet Ein- und Ausgabe parallel und wartet nicht, bis das Gegenüber fertig ist. Das ermöglicht unter anderem:

Ein Interaktionsmodell nimmt also wahr und antwortet zugleich, verarbeitet Ein- und Ausgabe parallel und wartet nicht, bis das Gegenüber fertig ist. Das ermöglicht unter anderem:

- Sprechen und Zuhören gleichzeitig

- Auf visuelle Signale reagieren, ohne Aufforderung

- Vergangene Zeit direkt mitverfolgen

All das können turnbasierte Modelle mit externer Steuerung nicht nachbilden – unabhängig davon, wie gut sie „denken“ können.

Was ist TML-Interaction-Small?

TML-Interaction-Small ist die erste öffentliche Modellveröffentlichung von Thinking Machines Lab und die erste Umsetzung ihrer Interaktionsmodell-Architektur.

Es ist ein Mixture-of-Experts-Modell mit 276 Milliarden Parametern und 12 Milliarden aktiven Parametern, von Grund auf auf kontinuierlichen Audio- und Videoströmen trainiert – mit dem zuvor beschriebenen Multi-Stream-Mikro-Turn-Design, bei dem Ein- und Ausgabe in 200-ms-Blöcken verarbeitet werden.

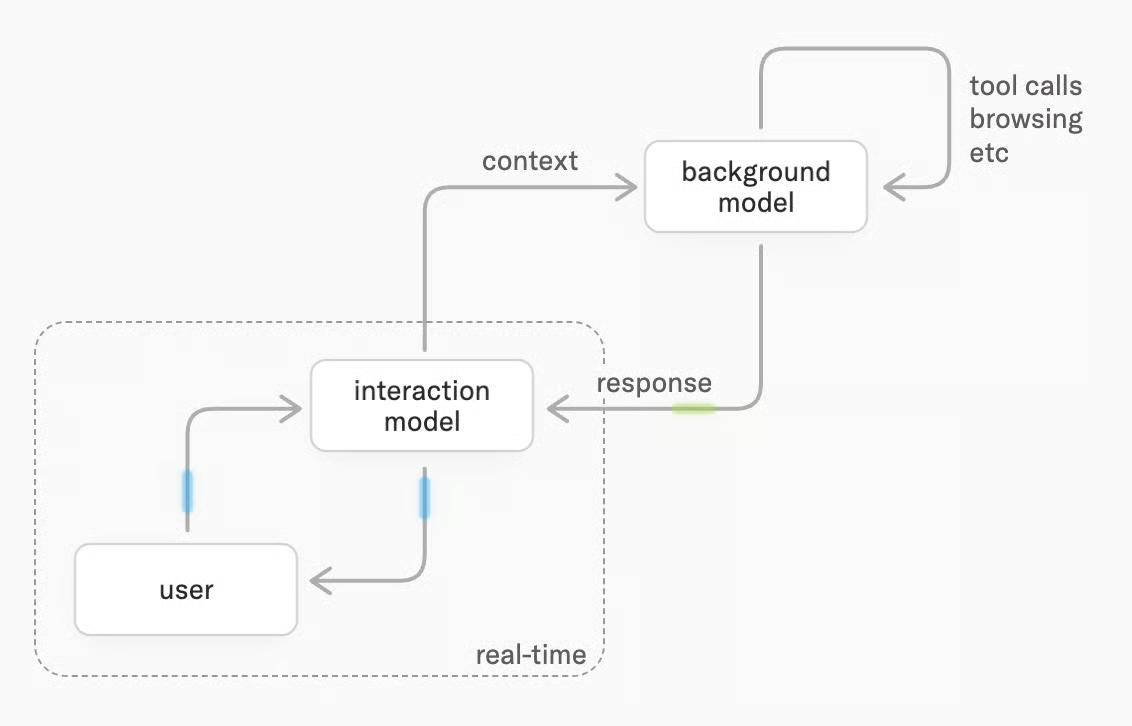

Die Kombination zweier Modelle mit gemeinsamem Kontext liefert sowohl Reaktionsfähigkeit als auch Intelligenz. Nutzende bekommen Antworten des Interaktionsmodells in Echtzeit, während Planung, Tool-Einsatz und tieferes Denken asynchron an das Hintergrundmodell ausgelagert werden.

Das Interaktionsmodell integriert die Ergebnisse aus dem Hintergrund dann nahtlos, sobald sie eintreffen – ohne aus dem Gespräch auszusteigen.

Funktionen von TML-Interaction-Small

Während bestehende Sprach-KI-Modelle abwechselnd sprechen (du sprichst, sie antworten), funktioniert TML-Interaction-Small eher wie ein menschliches Gegenüber. Diese vier Fähigkeiten stechen hervor.

Gleichzeitig sprechen und zuhören

TML-Interaction-Small kann Sprache erzeugen, während du noch redest. Das ermöglicht Simultanübersetzung: Du sprichst in einer Sprache, und das Modell beginnt mit der Übersetzung, bevor du den Satz beendet hast. Außerdem kann es mitten im Satz einhaken, wenn es einen Fehler bemerkt, oder verbale Signale geben ("verstanden", "erzähl weiter"), während du noch erklärst.

Das ist auch nützlich für maßgeschneiderte Echtzeitreaktionen, sobald bestimmte Ereignisse auftreten. Ein Clip in den Release Notes zeigt etwa, wie das Modell EUR-Beträge umrechnet und die entsprechenden USD-Werte nennt, sobald die Nutzerin eine Zahlung erwähnt.

Video sehen und ohne Aufforderung reagieren

TML-Interaction-Small verarbeitet Video parallel zu Audio und kann allein auf Basis des Sichtbaren sprechen – ganz ohne verbale Eingabe.

Wenn du Liegestütze vor der Kamera machst, zählt es die Wiederholungen laut mit. Taucht ein relevantes Objekt im Videostream auf, kann es den Moment benennen, in dem es sichtbar wird. Diese Funktion hat aber noch Luft nach oben: Im internen RepCount-A-Score lag nur gut ein Drittel (33,4%) der Fälle höchstens eine Wiederholung vom Ground Truth entfernt.

Ein Release-Clip (wirkt auf mich etwas skurril) demonstriert das: Mit der Aufforderung, auf die Körperhaltung zu achten, erkannte das Modell sofort das krumme Sitzen am Laptop und erinnerte daran, sich aufzurichten.

Bestehende kommerzielle Echtzeit-APIs sind audio-only. Sie reagieren auf gesprochene Turns, können aber visuelle Veränderungen nicht proaktiv aufgreifen. Diese Fähigkeit gibt es in GPT-Realtime-2 oder Gemini Live derzeit schlicht nicht.

Unterbrechungen und Selbstkorrekturen natürlich handhaben

Wenn du einen Satz beginnst, dich umentscheidest und dich mittendrin korrigierst, verfolgt TML-Interaction-Small die Änderung und reagiert auf das, was du wirklich meintest. Es meistert Backchanneling (du sagst „mhm“ oder „genau“, während es spricht) und unterscheidet, ob jemand mit ihm spricht oder mit einer anderen Person im Raum.

Hier scheitern turnbasierte Modelle häufig: Sie stoppen, obwohl sie weitersprechen sollten, oder reagieren auf den falschen Teil. Spannend wird sein, ob TML-Interaction-Small das im Alltag ebenso gut kann wie in kuratierten Demos.

Komplexe Aufgaben im Hintergrund ausführen und trotzdem präsent bleiben

Das Hintergrundmodell macht das Interaktionsmodell nicht nur schnell, sondern auch intelligent. Du kannst weiter nachfragen oder das Thema wechseln, während die Hintergrundaufgabe läuft. Wenn Ergebnisse vorliegen, flicht das Modell sie zum passenden Moment ins Gespräch ein – statt dich mit einem harten Kontextwechsel zu unterbrechen.

So bekommst du sowohl schnelle Gesprächsantworten als auch die Fähigkeit, mehrstufige Aufgaben zu bewältigen, für die das Modell sonst mehrere Sekunden lang schweigen müsste. In einem Quiz-Demo-Clip klappt das gut: Drei Personen stellen im hohen Tempo Quizfragen, und das Modell hält weitgehend mit.

TML-Interaction-Small Benchmarks

Thinking Machines berichtet Ergebnisse in zwei Kategorien: Streaming-Benchmarks, die Interaktivität messen, und turnbasierte Benchmarks, die Intelligenz messen. Die stärksten Resultate erzielt das Modell im Streaming – dort, wo die Architekturentscheidungen am direktesten geprüft werden.

Interaktivität

FD-bench v1.5 füttert das Modell mit voraufgezeichnetem Audio und misst sein Verhalten in vier Szenarien:

- Unterbrechung durch die Nutzerin

- Backchanneling durch die Nutzerin

- Gespräche mit anderen

- Hintergrundsprache

TML-Interaction-Small erreicht 77,8 – gegenüber 54,3 für Gemini-3.1-flash-live-preview mit Minimal-Einstellungen und 46,8 für GPT-Realtime-2.0 mit Minimal-Einstellungen. Selbst bei höchster Reasoning-Stufe (xhigh) kommt GPT-Realtime-2.0 nur auf 47,8.

Das ist der Benchmark, der am direktesten misst, worauf Thinking Machines hinarbeitet. Ein Vorsprung von 30 Punkten auf den nächsten Wettbewerber ist kein kleiner Unterschied. Offen bleibt, ob FD-bench v1.5 die gesamte Bandbreite praxisrelevanter Interaktivität abbildet – was Thinking Machines selbst als offene Forschungsfrage nennt.

Turn-Taking-Latenz

TML-Interaction-Small erreicht eine Turn-Taking-Latenz von 0,40 Sekunden in FD-bench v1 – schneller als jedes verglichene Modell. Am nächsten kommt Gemini-3.1-flash-live-preview mit 0,57 Sekunden. Selbst mit Minimal-Einstellungen braucht GPT-Realtime-2.0 etwa dreimal so lang (1,18 Sekunden); bei xhigh-Reasoning liegt GPT-Realtime-2.0 bei 1,63 Sekunden.

Latenz ist bei Sprachinteraktion kritischer als bei Text. Eine Lücke von 1,2 Sekunden zwischen Redeende und Antwortbeginn ist deutlich spürbar – und störend. Das Ergebnis von 0,40 Sekunden bringt TML-Interaction-Small näher an menschliche Reaktionszeiten im Gespräch.

Intelligenz und Befolgen von Anweisungen

Audio MultiChallenge misst Intelligenz und Anweisungsbefolgung in Audio. TML-Interaction-Small erreicht 43,4% – über GPT-Realtime-1.5 (34,7%) und Gemini-3.1-flash-live-preview (26,8%), aber unter GPT-Realtime-2.0 bei xhigh (48,5%). Hier zeigt sich der Trade-off zwischen Intelligenz und Interaktivität.

Die Lücke zwischen TML-Interaction-Small und GPT-Realtime-2.0 bei xhigh beträgt 5,1 Prozentpunkte. Das ist spürbar, aber nicht riesig – und auf Seiten von GPT-Realtime-2.0 mit deutlichen Latenzkosten verbunden (1,63 Sekunden vs. 0,40 Sekunden). Ob sich das lohnt, hängt vom Use Case ab.

Antwortqualität und Tool-Nutzung

FD-bench v3 misst Antwortqualität und Genauigkeit von Tool-Aufrufen in Audio-plus-Tools-Szenarien. TML-Interaction-Small erreicht 82,8% Antwortqualität und 68,0% pass@1 mit aktiviertem Background Agent – gegenüber 80,0% / 52,0% für GPT-Realtime-2.0 bei Minimal-Einstellungen und 81,0% / 58,0% bei xhigh.

Die pass@1-Differenz (68,0% vs. 58,0%) ist hier am aussagekräftigsten, weil sie misst, ob toolabhängige Aufgaben tatsächlich korrekt abgeschlossen werden. Offenbar zahlt sich die Doppelarchitektur aus, die Tool-Aufrufe von der Nutzerinteraktion trennt.

Neue Interaktivitätsbenchmarks: TimeSpeak, CueSpeak und visuelle Proaktivität

Thinking Machines hat zwei interne Benchmarks erstellt und drei weniger verbreitete Benchmarks adaptiert, um Interaktivität direkt zu messen. Diese lohnen einen genaueren Blick, denn kein Konkurrenzmodell liefert darauf sinnvolle Ergebnisse.

- TimeSpeak (zeitgesteuerter Sprechbeginn): TML-Interaction-Small erreicht 64,7% Macro-Accuracy.

- CueSpeak (sprachsignalgetriggerter Sprechbeginn): TML-Interaction-Small erreicht 81,7% Macro-Accuracy.

- RepCount-A (visuelles Zählen von Aktionen): TML-Interaction-Small erreicht 33,4% Off-by-one-Accuracy.

- ProactiveVideoQA (visuell getriggerter Sprechbeginn): TML-Interaction-Small erreicht 31,5 PAUC (Baseline ohne Antwort = 25,0%).

- Charades Temporal Localization (Timing visueller Aktionen): TML-Interaction-Small erreicht 30,4 mIoU.

Auf den meisten dieser neuen Benchmarks scheitert GPT-Realtime-2.0 komplett – Ergebnisse nahe null oder sogar null (auf dem Charades-Benchmark, bei dem das Modell „Start“ und „Stopp“ zum richtigen Zeitpunkt im Video sagen muss).

Wie aussagekräftig diese Resultate sind, ist schwer zu beurteilen, da die Benchmarks neu und noch nicht unabhängig validiert sind. Sie fügen sich aber ins Gesamtbild der architektonischen Unterschiede und der übrigen Benchmarks ein.

Preis und Verfügbarkeit von TML-Interaction-Small

TML-Interaction-Small befindet sich derzeit in einer limitierten Forschungsvorschau, Preise wurden noch nicht genannt. Thinking Machines plant, den Zugang später in 2026 breiter zu öffnen. Interessierte Forschende und Entwicklerinnen können das Team unter interaction@thinkingmachines.ai kontaktieren, um Zugang anzufragen.

Zum Vergleich: GPT-Realtime-2 kostet 32 US-Dollar pro einer Million Audio-Eingabetokens und 64 US-Dollar pro einer Million Audio-Ausgabetokens, wie in unserer GPT-Realtime-2-Übersicht beschrieben. Die Preise für TML-Interaction-Small dürften zur breiteren Veröffentlichung bekanntgegeben werden.

Wie dir sicher aufgefallen ist, trägt das Modell den Zusatz „-Small“. Du darfst also mit größeren Modellen rechnen. Sie sind aktuell noch zu langsam für den Betrieb, eine Veröffentlichung ist für Ende 2026 geplant.

TML-Interaction-Small vs. GPT-Realtime-2

Der spannendere Abstand zwischen den beiden Modellen liegt bei der Interaktivität. Auf FD-bench v1.5, der Verhalten bei Unterbrechungen, Backchanneling, Gesprächen mit anderen und Hintergrundsprache misst, erreicht TML-Interaction-Small 77,8. GPT-Realtime-2.0 kommt mit Minimal-Einstellungen auf 46,8 und mit höchster Reasoning-Stufe (xhigh) auf 47,8. Das sind 30 Punkte Vorsprung in dem Benchmark, der am direktesten das misst, worauf Thinking Machines optimiert.

Es gibt einen Intelligenz-Trade-off, aber die Lücke ist deutlich kleiner als bei der Interaktivität. GPT-Realtime-2.0 bei xhigh erreicht 48,5% in Audio MultiChallenge, TML-Interaction-Small 43,4%. In BigBench Audio erzielt GPT-Realtime-2.0 bei high 96,6% gegenüber 75,7% für TML-Interaction-Small (wobei TML-Interaction-Small mit aktiviertem Background Agent 96,5% erreicht).

Unterm Strich führt TML-Interaction-Small bei Reaktionsfähigkeit und Interaktivität, während GPT-Realtime-2.0 bei hohen Reasoning-Einstellungen bei reinen Intelligenzbenchmarks vorn liegt.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 Turn-Taking-Latenz (s) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 Durchschnitt | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 Antwortqualität (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio Genauigkeit (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) Genauigkeit (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval Textgenauigkeit (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* Mit aktiviertem Background Agent.

Um OpenAIs Audio-Modellfamilie in Aktion zu sehen, schau dir unser GPT-Realtime-2 API-Tutorial an.

Fazit

TML-Interaction-Small macht einen starken Eindruck. Wenn es die Aussagen in den Release Notes hält, bringt das neue Modell deutlich verbesserte Interaktivität bei kurzer Latenz – ohne Einbußen bei Antwortqualität oder Denkvermögen. Die Fähigkeit, gleichzeitig zu sprechen, zuzuhören und auf visuelle Signale zu reagieren, ist bisher einzigartig und eröffnet viele Möglichkeiten. Ich bin gespannt, wie die Preisgestaltung bei der breiten Veröffentlichung aussieht.

Die Intelligenzlücke zu GPT-Realtime-2 ist real, aber kleiner als die Interaktivitätslücke. Für Anwendungsfälle, in denen sich das Gespräch natürlich anfühlen muss, zählt der Latenzunterschied mehr als die Intelligenzlücke. Wo höchste Genauigkeit bei schwierigen Denkaufgaben Priorität hat, liegt GPT-Realtime-2.0 bei hohen Reasoning-Einstellungen weiterhin vorn.

Wenn du dir schnell einen Überblick über die KI-Modelllandschaft verschaffen und effektiv damit arbeiten willst, empfehle ich unseren AI Fundamentals Skill Track.

Datenwissenschaftsredakteur bei DataCamp | Prognosen erstellen und mit APIs arbeiten ist genau mein Ding.