Tracks

สัปดาห์ที่แล้ว GPT-Realtime-2 ของ OpenAI ยกระดับมาตรฐานด้านเสียงของ AI ด้วยเหตุผลเชิงตรรกะระดับ GPT-5 และหน้าต่างบริบท 128K ขณะนี้ Thinking Machines Lab ของ Mira Murati กำลังเสนอแนวทางที่ต่างออกไป: ความตอบสนองฉับไวและความฉลาดควรถูกฝึกในโมเดลเดียวตั้งแต่ต้น แทนที่จะนำมาประกบกันภายหลังด้วยตัวตรวจจับกิจกรรมเสียงและคอมโพเนนต์จัดการบทสนทนา

ห้องแล็บเรียกโมเดลประเภทใหม่นี้ว่า “โมเดลปฏิสัมพันธ์”

งานพรีวิวงานวิจัย TML-Interaction-Small คือผลลัพธ์แรกของแนวทางนี้ เป็นโมเดล Mixture-of-Experts ที่มีพารามิเตอร์ 276B โดยมีพารามิเตอร์ที่ทำงานจริง 12B ประมวลผลเสียง วิดีโอ และข้อความเป็นไมโครเทิร์นต่อเนื่องความยาว 200 มิลลิวินาที ซึ่งหมายความว่าสามารถรับรู้และตอบสนองไปพร้อมกัน ไม่ต้องรอให้ผู้พูดพูดจบก่อน

ในบทความนี้ ฉันจะอธิบายว่า TML-Interaction-Small คืออะไร ไล่ดูคุณลักษณะทางสถาปัตยกรรมที่สำคัญ เปรียบเทียบโดยตรงกับ GPT-Realtime-2 และ เจาะรายละเอียดผลการทดสอบมาตรฐาน

โมเดลปฏิสัมพันธ์คืออะไร?

Thinking Machines Lab อธิบายโมเดลปฏิสัมพันธ์ว่าเป็นระบบที่ทำให้ความเป็นปฏิสัมพันธ์เป็นส่วนหนึ่งของตัวโมเดลเอง ไม่ใช่สิ่งที่นำไปครอบด้วยฮาร์เนสภายนอก หลักการสำคัญคือความตอบสนองฉับไวและความฉลาดต้องถูกฝึกให้ไปด้วยกันตั้งแต่ต้น บนสตรีมเสียงและวิดีโอต่อเนื่อง แทนที่จะไปติดตั้งเพิ่มบนโมเดลที่อิงข้อความภายหลัง

ระบบเสียง AI แบบเรียลไทม์ส่วนใหญ่ในปัจจุบันจะเย็บต่อชิ้นส่วนอย่างตัวตรวจจับกิจกรรมเสียง เอนโค้ดเดอร์แยกกัน และเลเยอร์จัดการบทสนทนาเพื่อเลียนแบบความตอบสนอง Thinking Machines Lab ให้เหตุผลว่าแนวทางนี้จะล่าช้ากว่าโมเดลที่รองรับปฏิสัมพันธ์โดยกำเนิดเสมอ เพราะมีขอบเขตเทิร์นที่เป็นเทียมซึ่งจำกัดความสามารถของโมเดลที่ไม่โต้ตอบ

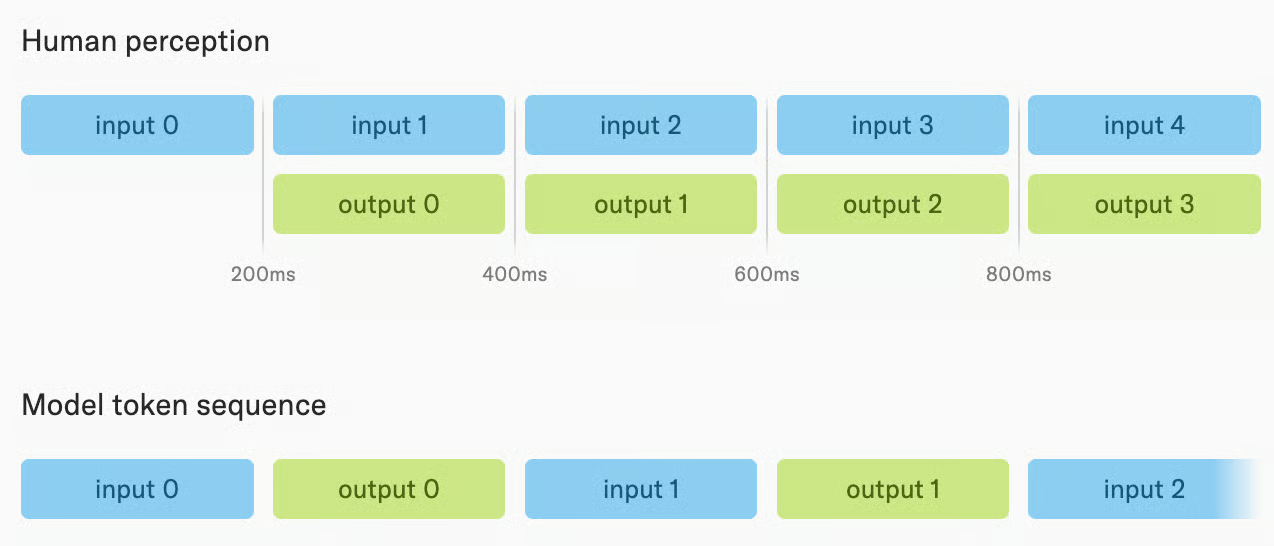

แทนที่จะรับอินพุตแบบเรียงลำดับแล้วจึงสร้างคำตอบจนจบ โมเดลปฏิสัมพันธ์ของห้องแล็บถูกออกแบบให้ใกล้เคียงการรับรู้ของมนุษย์มากขึ้น โดยมองทั้งโทเค็นอินพุตและเอาต์พุตเป็นสตรีม และทั้งสองถูกสลับกันในแต่ละไมโครเทิร์นความยาว 200 มิลลิวินาที

ด้วยเหตุนี้ โมเดลปฏิสัมพันธ์จึงรับรู้และตอบสนองพร้อมกัน ประมวลผลอินพุตและเอาต์พุตแบบขนาน โดยไม่ต้องรอให้ผู้พูดจบ ช่วยให้ทำสิ่งเจ๋ง ๆ ได้หลายอย่าง เช่น:

ด้วยเหตุนี้ โมเดลปฏิสัมพันธ์จึงรับรู้และตอบสนองพร้อมกัน ประมวลผลอินพุตและเอาต์พุตแบบขนาน โดยไม่ต้องรอให้ผู้พูดจบ ช่วยให้ทำสิ่งเจ๋ง ๆ ได้หลายอย่าง เช่น:

- พูดพร้อมกับฟัง

- ตอบสนองต่อสัญญาณจากภาพโดยไม่ต้องมีพรอมต์

- ติดตามเวลาที่ผ่านไปได้โดยตรง

ทั้งหมดนี้คือสิ่งที่โมเดลแบบผลัดกันพูดที่พึ่งพาฮาร์เนสภายนอกไม่สามารถทำซ้ำได้ ไม่ว่าจะมีความสามารถด้านเหตุผลมากเพียงใด

TML-Interaction-Small คืออะไร?

TML-Interaction-Small คือโมเดลที่เปิดตัวสู่สาธารณะรุ่นแรกของ Thinking Machines Lab และเป็นการนำสถาปัตยกรรมโมเดลปฏิสัมพันธ์มาประยุกต์ใช้เป็นครั้งแรก

เป็นโมเดล Mixture-of-Experts ที่มีพารามิเตอร์ 276B และพารามิเตอร์ที่ทำงานจริง 12B ฝึกจากศูนย์บนสตรีมเสียงและวิดีโอต่อเนื่อง โดยใช้ดีไซน์ไมโครเทิร์นหลายสตรีมตามที่อธิบายไว้ก่อนหน้า ซึ่งอินพุตและเอาต์พุตถูกประมวลผลเป็นช่วง ๆ ละ 200 มิลลิวินาที

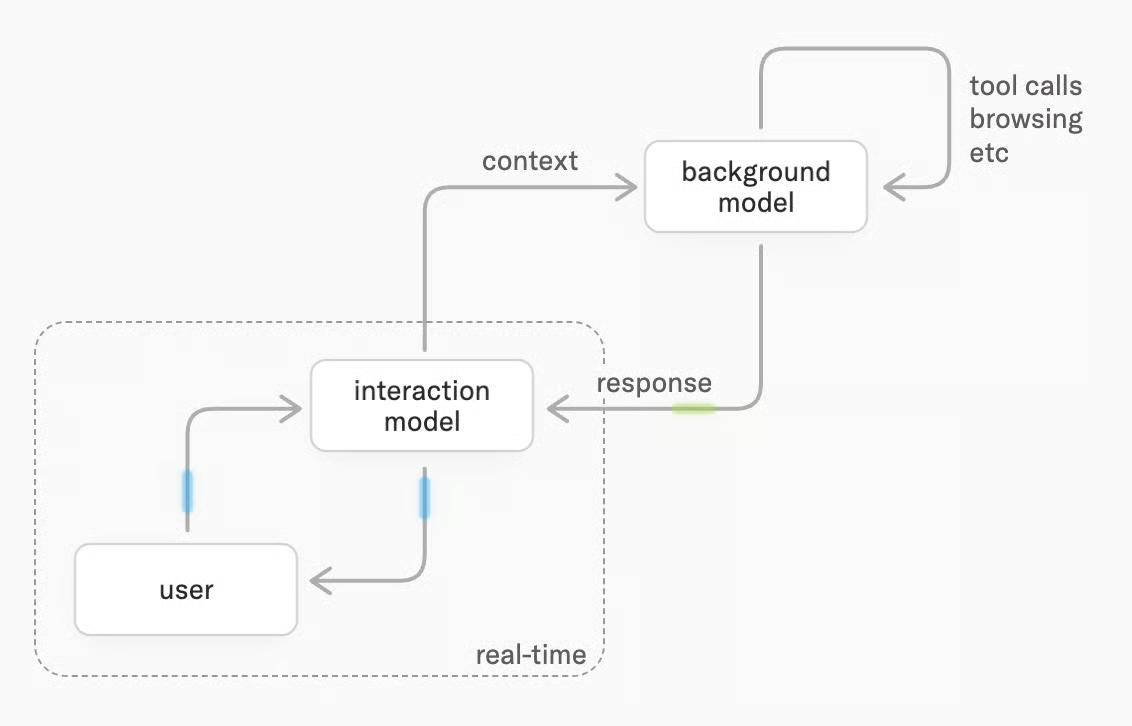

การผสานโมเดลสองตัวที่ใช้บริบทเดียวกันทำให้ได้ทั้งความตอบสนองฉับไวและความฉลาด ผู้ใช้ได้รับคำตอบจากโมเดลปฏิสัมพันธ์แบบเรียลไทม์ ขณะที่การวางแผน การใช้เครื่องมือ และการให้เหตุผลลึกจะถูกมอบหมายให้โมเดลเบื้องหลังที่ทำงานแบบอะซิงโครนัส

จากนั้นโมเดลปฏิสัมพันธ์จะผสานผลลัพธ์จากเบื้องหลังเข้ามาในบทสนทนาเมื่อมาถึง โดยไม่หลุดจากบทสนทนา

คุณสมบัติของ TML-Interaction-Small

ขณะที่โมเดลเสียง AI ที่มีอยู่ส่วนใหญ่ผลัดกันพูด (คุณพูด แล้วมันตอบ) TML-Interaction-Small ทำงานคล้ายคู่สนทนามนุษย์มากกว่า ต่อไปนี้คือสี่ความสามารถที่ทำให้โดดเด่น

พูดและฟังพร้อมกัน

TML-Interaction-Small สามารถสร้างคำพูดได้ขณะที่ผู้ใช้ยังพูดอยู่ ทำให้การแปลพร้อมกันเป็นไปได้: คุณพูดอีกภาษา โมเดลก็เริ่มแปลก่อนที่คุณจะพูดจบ นอกจากนี้ โมเดลยังสามารถขัดจังหวะกลางประโยคเมื่อจับ错误ได้ หรือส่งสัญญาณด้วยคำพูด (“รับทราบ”, “พูดต่อได้”) ระหว่างที่คุณอธิบายอยู่

ยังมีประโยชน์สำหรับการตอบสนองแบบเรียลไทม์ตามอีเวนต์ที่กำหนดเองด้วย ตัวอย่างในบันทึกการเปิดตัวแสดงให้เห็นว่าโมเดลจะแปลงจำนวนเงินเป็น EUR และบอกจำนวนเงิน USD ที่สอดคล้องกันทุกครั้งเมื่อผู้ใช้พูดถึงการชำระเงิน

ดูและตอบสนองต่อวิดีโอโดยไม่ต้องถูกขอ

TML-Interaction-Small ประมวลผลวิดีโอควบคู่กับเสียงและสามารถเริ่มพูดได้จากสิ่งที่เห็น โดยไม่ต้องมีพรอมต์ด้วยคำพูด

หากคุณกำลังวิดีโอวิดพื้นอยู่ มันสามารถนับจำนวนครั้งให้แบบเปล่งเสียงตามเวลาจริง หากมีวัตถุที่เกี่ยวข้องโผล่มาในสตรีมวิดีโอ ก็สามารถระบุทันทีที่มองเห็น อย่างไรก็ตาม คุณสมบัตินี้ยังพัฒนาได้อีก ดังเห็นจากคะแนนภายใน RepCount-A ที่มีเพียงหนึ่งในสาม (33.4%) ของกรณีที่คลาดเคลื่อนจากความจริงไม่เกินหนึ่งครั้ง

คลิปหนึ่งในบันทึกการเปิดตัว (ที่ดูแปลกตาเล็กน้อยในมุมมองของฉัน) สาธิตสิ่งนี้: เมื่อตั้งให้สนใจท่าทางของผู้ใช้ โมเดลตรวจพบการนั่งหลังค่อมที่หน้าคอมพิวเตอร์ได้ทันทีและเตือนให้ปรับ

API เชิงพาณิชย์แบบเรียลไทม์ที่มีอยู่ในปัจจุบันรองรับเฉพาะเสียง ตอบสนองต่อรอบคำพูดเท่านั้น และไม่สามารถตอบโต้การเปลี่ยนแปลงทางภาพแบบเชิงรุกได้ ความสามารถนี้ยังไม่มีใน GPT-Realtime-2 หรือ Gemini Live ในตอนนี้

รับมือการแทรกและการแก้คำพูดตนเองอย่างเป็นธรรมชาติ

หากคุณเริ่มพูด ประมาณใจใหม่ แล้วแก้คำพูดกลางคัน TML-Interaction-Small จะติดตามการแก้ไขและตอบสนองต่อสิ่งที่ตั้งใจจริง ๆ จัดการ backchanneling (เช่นคุณพูด “อืม” หรือ “ใช่” ระหว่างที่มันพูด) และแยกแยะได้ว่ามีคนกำลังคุยกับมันหรือคุยกับคนอื่นในห้อง

สถานการณ์เหล่านี้มักทำให้โมเดลแบบผลัดกันพูดล้มเหลว พวกมันหยุดพูดเมื่อไม่ควรหยุด หรือไปตอบส่วนที่ผิดของสิ่งที่ถูกกล่าวไป น่าสนใจว่าจะเห็นว่า TML-Interaction-Small จะรับมือได้ดีในสถานการณ์จริงเหมือนในวิดีโอโชว์หรือไม่

รันงานซับซ้อนเบื้องหลังโดยยังคงอยู่กับบทสนทนา

โมเดลเบื้องหลังคือสิ่งที่ทำให้โมเดลปฏิสัมพันธ์ไม่เพียงเร็ว แต่ยังฉลาดด้วย คุณสามารถถามต่อหรือเปลี่ยนหัวข้อได้ขณะงานเบื้องหลังยังทำอยู่ เมื่อผลลัพธ์พร้อม โมเดลจะสอดแทรกกลับเข้าบทสนทนาในจังหวะที่เป็นธรรมชาติ แทนที่จะขัดจังหวะคุณด้วยการตัดบริบทกะทันหัน

นั่นหมายความว่าคุณจะได้ทั้งการสนทนาที่ตอบไว และความสามารถในการจัดการงานหลายขั้นตอนที่ปกติจะทำให้โมเดลต้องเงียบไปหลายวินาที ในคลิปเดโมแบบตอบคำถามความรู้รอบตัว สิ่งนี้ทำงานได้ดีทีเดียว: ผู้ใช้สามคนยิงคำถามอย่างรวดเร็ว และโมเดลก็ตามทันได้เกือบทั้งหมด

การทดสอบมาตรฐานของ TML-Interaction-Small

Thinking Machines รายงานผลลัพธ์ในสองหมวด: การทดสอบสตรีมมิงที่วัดความเป็นปฏิสัมพันธ์ และการทดสอบแบบผลัดกันพูดที่วัดความฉลาด ผลลัพธ์ที่แข็งแกร่งที่สุดของโมเดลอยู่ฝั่งสตรีมมิง ซึ่งเป็นจุดที่ทางเลือกด้านสถาปัตยกรรมถูกทดสอบโดยตรงที่สุด

ความเป็นปฏิสัมพันธ์

FD-bench v1.5 ให้โมเดลฟังเสียงที่บันทึกไว้ล่วงหน้าและวัดพฤติกรรมในสี่สถานการณ์:

- ผู้ใช้ขัดจังหวะ

- ผู้ใช้ส่งสัญญาณยืนยันระหว่างฟัง (backchannel)

- คุยกับผู้อื่น

- มีเสียงพูดพื้นหลัง

TML-Interaction-Small ได้คะแนน 77.8 เทียบกับ Gemini-3.1-flash-live-preview ที่ตั้งค่าน้อยสุด 54.3 และ GPT-Realtime-2.0 ที่ตั้งค่าน้อยสุด 46.8 แม้ตั้งค่าสูงสุดด้านเหตุผล (xhigh) GPT-Realtime-2.0 ก็ได้เพียง 47.8

นี่เป็นการทดสอบที่วัดสิ่งที่ Thinking Machines มุ่งสร้างได้ตรงที่สุด ช่องว่าง 30 คะแนนเหนือคู่แข่งที่ใกล้สุดไม่ใช่ความต่างเล็กน้อย คำถามคือ FD-bench v1.5 ครอบคลุมช่วงความเป็นปฏิสัมพันธ์ที่สำคัญในทางปฏิบัติครบถ้วนหรือไม่ ซึ่งทาง Thinking Machines เองก็ยอมรับว่ายังเป็นคำถามวิจัยเปิดอยู่

เวลาแฝงในการผลัดกันพูด

TML-Interaction-Small ทำเวลาแฝงผลัดกันพูดได้ 0.40 วินาทีใน FD-bench v1 เร็วที่สุดในทุกโมเดลที่เปรียบเทียบ Gemini-3.1-flash-live-preview ใกล้สุดที่ 0.57 วินาที แม้ตั้งค่าต่ำสุด GPT-Realtime-2.0 ใช้เวลาประมาณสามเท่า (1.18 วินาที); ที่เหตุผล xhigh GPT-Realtime-2.0 อยู่ที่ 1.63 วินาที

เวลาแฝงมีความสำคัญมากกว่าสำหรับปฏิสัมพันธ์ด้วยเสียงเมื่อเทียบกับข้อความ ช่องว่าง 1.2 วินาทีระหว่างที่ผู้ใช้พูดจบกับที่โมเดลเริ่มตอบ นอกจากสังเกตได้ชัดแล้วยังรบกวนจังหวะด้วย ผลลัพธ์ 0.40 วินาทีทำให้ TML-Interaction-Small เข้าใกล้เวลาตอบสนองของการสนทนามนุษย์

ความฉลาดและการทำตามคำสั่ง

Audio MultiChallenge วัดความฉลาดและการทำตามคำสั่งจากเสียง TML-Interaction-Small ได้ 43.4% สูงกว่า GPT-Realtime-1.5 (34.7%) และ Gemini-3.1-flash-live-preview (26.8%) แต่ต่ำกว่า GPT-Realtime-2.0 ที่ xhigh (48.5%) นี่คือการทดสอบที่เห็นสมดุลระหว่างความฉลาดกับความเป็นปฏิสัมพันธ์

ช่องว่างระหว่าง TML-Interaction-Small กับ GPT-Realtime-2.0 ที่ xhigh อยู่ที่ 5.1 จุด ถือว่าเด่นชัดแต่ไม่มาก และมาพร้อมต้นทุนเวลาแฝงที่สูงบนฝั่ง GPT-Realtime-2.0 (1.63 วินาทีเทียบกับ 0.40 วินาที) ความคุ้มค่าของการแลกเปลี่ยนนั้นขึ้นอยู่กับแอปพลิเคชัน

คุณภาพคำตอบและการใช้เครื่องมือ

FD-bench v3 วัดคุณภาพคำตอบและความแม่นยำการเรียกเครื่องมือในสถานการณ์เสียงบวกเครื่องมือ TML-Interaction-Small ได้คุณภาพคำตอบ 82.8% และ pass@1 ที่ 68.0% เมื่อเปิดใช้งานตัวแทนเบื้องหลัง เทียบกับ GPT-Realtime-2.0 ตั้งค่าต่ำสุดที่ 80.0% / 52.0% และที่ xhigh 81.0% / 58.0%

ช่องว่าง pass@1 (68.0% เทียบกับ 58.0%) เป็นตัวเลขที่สำคัญที่สุด เพราะวัดว่าโมเดลทำงานที่พึ่งพาเครื่องมือได้ถูกต้องจริงหรือไม่ ดูเหมือนสถาปัตยกรรมคู่ที่แยกการเรียกเครื่องมือออกจากการโต้ตอบกับผู้ใช้จะให้ผลดี

การทดสอบใหม่ด้านปฏิสัมพันธ์: TimeSpeak, CueSpeak และเชิงรุกด้านภาพ

Thinking Machines สร้างการทดสอบภายในสองชุดและดัดแปลงอีกสามชุดที่ไม่ค่อยถูกใช้เพื่อวัดความสามารถด้านปฏิสัมพันธ์โดยตรง ควรพิจารณาอย่างใกล้ชิด เพราะไม่มีโมเดลคู่แข่งใดทำผลงานได้อย่างมีนัยสำคัญในชุดเหล่านี้

- TimeSpeak (เริ่มพูดตามเวลา): TML-Interaction-Small ได้ 64.7% macro-accuracy

- CueSpeak (เริ่มพูดเมื่อมีสัญญาณคำพูด): TML-Interaction-Small ได้ 81.7% macro-accuracy

- RepCount-A (นับการกระทำจากภาพ): TML-Interaction-Small ได้ 33.4% off-by-one accuracy

- ProactiveVideoQA (เริ่มพูดเมื่อมีสัญญาณจากภาพ): TML-Interaction-Small ได้ 31.5 PAUC (ฐานที่ไม่ตอบ = 25.0%)

- Charades temporal localization (ระบุเวลาการกระทำจากภาพ): TML-Interaction-Small ได้ 30.4 mIoU

ในหลายการทดสอบใหม่เหล่านี้ GPT realtime-2.0 ล้มเหลวอย่างสิ้นเชิง ได้ผลลัพธ์ใกล้ศูนย์ หรือเป็นศูนย์เลย (เช่นบน Charades ที่ต้องให้โมเดลพูด “เริ่ม” และ “หยุด” ให้ตรงจังหวะในวิดีโอ)

ยากที่จะบอกว่าผลลัพธ์เหล่านี้มีนัยสำคัญเพียงใด เพราะบรรดาการทดสอบยังใหม่และยังไม่ถูกยืนยันโดยอิสระ แต่ก็สอดคล้องกับภาพรวมของความต่างด้านสถาปัตยกรรมและผลการทดสอบที่เปรียบเทียบกัน

ราคาและการเปิดให้ใช้ TML-Interaction-Small

TML-Interaction-Small อยู่ในช่วงพรีวิวงานวิจัยแบบจำกัด และยังไม่ประกาศรายละเอียดราคา Thinking Machines มีแผนเปิดให้เข้าถึงกว้างขึ้นในช่วงปลายปี 2026 นักวิจัยและนักพัฒนาที่สนใจสามารถติดต่อทีมได้ที่ interaction@thinkingmachines.ai เพื่อขอเข้าถึง

เพื่อเปรียบเทียบ GPT-Realtime-2 มีราคา $32 ต่อโทเค็นอินพุตเสียงหนึ่งล้าน และ $64 ต่อโทเค็นเอาต์พุตเสียงหนึ่งล้าน ตามที่เราครอบคลุมไว้ใน ภาพรวม GPT-Realtime-2 ราคาของ TML-Interaction-Small น่าจะประกาศพร้อมการเปิดให้ใช้ในวงกว้าง

อย่างที่สังเกตได้ โมเดลลงท้ายด้วย “-Small” และคาดได้ว่า Thinking Machines จะตามมาด้วยโมเดลที่ใหญ่กว่า ปัจจุบันยังช้าเกินกว่าจะให้บริการ แต่มีแผนเปิดตัวปลายปี 2026

TML-Interaction-Small เทียบกับ GPT-Realtime-2

ช่องว่างที่น่าสนใจกว่าระหว่างสองโมเดลอยู่ที่การทดสอบด้านปฏิสัมพันธ์ บน FD-bench v1.5 ซึ่งวัดพฤติกรรมในสถานการณ์ผู้ใช้ขัดจังหวะ การ backchannel การคุยกับผู้อื่น และเสียงพื้นหลัง TML-Interaction-Small ได้ 77.8 ส่วน GPT-Realtime-2.0 ตั้งค่าต่ำสุดได้ 46.8 และที่เหตุผลสูงสุด (xhigh) ได้ 47.8 นั่นคือช่องว่าง 30 คะแนนบนการทดสอบที่วัดสิ่งที่ Thinking Machines ปรับแต่งโดยตรงที่สุด

มีการแลกกับความฉลาด แต่ช่องว่างนี้เล็กกว่าของด้านปฏิสัมพันธ์มาก GPT-Realtime-2.0 ที่ xhigh ได้ 48.5% บน Audio MultiChallenge เทียบกับ 43.4% ของ TML-Interaction-Small บน BigBench Audio GPT-Realtime-2.0 ที่ high ได้ 96.6% เทียบกับ 75.7% ของ TML-Interaction-Small (แม้ TML-Interaction-Small จะทำได้ 96.5% เมื่อเปิดตัวแทนเบื้องหลัง)

ภาพรวมที่ได้คือ TML-Interaction-Small นำหน้าในด้านความตอบสนองและความเป็นปฏิสัมพันธ์ ขณะที่ GPT-Realtime-2.0 ที่การให้เหตุผลสูงนำหน้าบนการทดสอบมาตรฐานด้านความฉลาดดิบ

| การทดสอบมาตรฐาน | TML-Interaction-Small | GPT-Realtime-2.0 (ต่ำสุด) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (ต่ำสุด) |

|---|---|---|---|---|

| FD-bench v1 เวลาแฝงผลัดกันพูด (วินาที) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 ค่าเฉลี่ย | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 คุณภาพคำตอบ (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio ความแม่นยำ (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) ความแม่นยำ (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval ข้อความ ความแม่นยำ (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* เปิดใช้งานตัวแทนเบื้องหลัง

เพื่อชมตระกูลโมเดลเสียงของ OpenAI ในการใช้งาน ลองดู บทเรียน API ของ GPT-Realtime-2

ข้อคิดส่งท้าย

TML-Interaction-Small ดูมีอนาคต หากทำได้ตามที่อ้างในบันทึกการเปิดตัว โมเดลใหม่นี้จะยกระดับปฏิสัมพันธ์อย่างมีนัยสำคัญด้วยเวลาแฝงสั้น โดยไม่ต้องแลกกับคุณภาพคำตอบหรือพลังการให้เหตุผล ความสามารถในการพูด ฟัง และตอบสนองต่อสัญญาณจากภาพไปพร้อมกันยังคงเป็นเอกลักษณ์ และเปิดโอกาสอีกมาก อยากเห็นโครงสร้างราคาตอนที่เปิดให้ใช้สาธารณะ

ช่องว่างด้านความฉลาดเมื่อเทียบกับ GPT-Realtime-2 มีอยู่จริง แต่แคบกว่าช่องว่างด้านปฏิสัมพันธ์ สำหรับงานที่ต้องการให้การสนทนาดูเป็นธรรมชาติ ความต่างของเวลาแฝงสำคัญกว่าช่องว่างด้านความฉลาด สำหรับงานที่ความแม่นยำบนโจทย์ให้เหตุผลยากเป็นเป้าหมาย GPT-Realtime-2.0 ที่การให้เหตุผลสูงยังนำอยู่

หากต้องการติดตามภาพรวมโลกของโมเดล AI และวิธีใช้งานอย่างมีประสิทธิภาพ แนะนำให้เริ่มจาก เส้นทางทักษะ AI Fundamentals ของเรา