Track

Всего на прошлой неделе GPT-Realtime-2 от OpenAI поднял планку для голосового ИИ, представив рассуждения уровня GPT-5 и контекстное окно 128K. Теперь лаборатория Mira Murati — Thinking Machines Lab — предлагает иной подход: отзывчивость и интеллект должны изначально обучаться в одной модели, а не скрепляться внешними компонентами вроде VAD и систем управления диалогом.

В лаборатории такой тип новой модели называют «моделью взаимодействия».

Их исследовательский превью-релиз, TML-Interaction-Small, — первый результат этого подхода. Это модель Mixture-of-Experts с 276 млрд параметров и 12 млрд активных. Она обрабатывает аудио, видео и текст непрерывными 200‑мс микро-ходами, то есть воспринимает и отвечает одновременно, не дожидаясь, пока собеседник договорит.

В этой статье я расскажу, что такое TML-Interaction-Small, разберу её ключевые архитектурные особенности, сравню её напрямую с GPT-Realtime-2 и подробно рассмотрю результаты бенчмарков.

Что такое модели взаимодействия?

Thinking Machines Lab описывает модель взаимодействия как систему, в которой интерактивность заложена в саму модель, а не реализована во внешней «обвязке». Базовый принцип — отзывчивость и интеллект нужно обучать вместе с нуля на непрерывных аудио- и видеопотоках, а не прикручивать их к текстовой модели постфактум.

Большинство текущих систем голосового ИИ в реальном времени «сшивают» компоненты детекции голосовой активности, отдельные энкодеры и слои управления диалогом, чтобы имитировать отзывчивость. В Thinking Machines Lab утверждают, что такой подход всегда будет уступать моделям, которые изначально умеют обрабатывать взаимодействие, из-за искусственных границ ходов, ограничивающих возможности неинтерактивной модели.

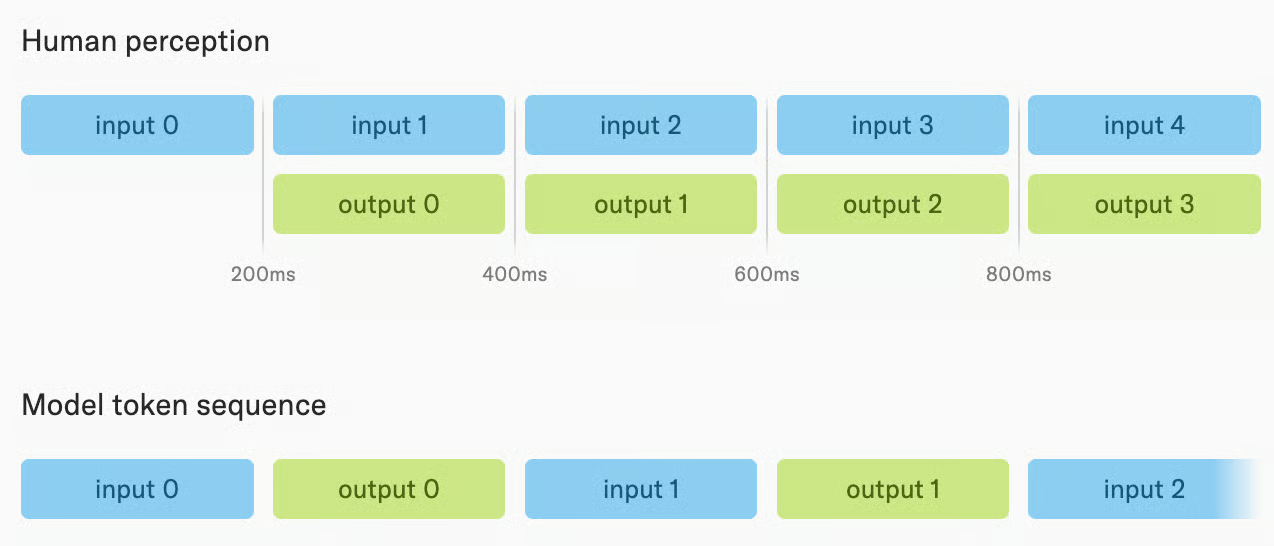

Вместо последовательного приёма пользовательского ввода с последующей генерацией полного ответа модели взаимодействия лаборатории ближе к человеческому восприятию. Они трактуют и входные, и выходные токены как потоки и чередуют их в каждом 200‑миллисекундном микро-ходе.

Таким образом, модель взаимодействия одновременно воспринимает и отвечает, обрабатывая вход и выход параллельно, а не дожидаясь, пока говорящий закончит. Это даёт несколько полезных возможностей:

Таким образом, модель взаимодействия одновременно воспринимает и отвечает, обрабатывая вход и выход параллельно, а не дожидаясь, пока говорящий закончит. Это даёт несколько полезных возможностей:

- Говорить и слушать одновременно

- Реагировать на визуальные сигналы без явного запроса

- Непосредственно отслеживать прошедшее время

Всего этого не могут достичь пошаговые модели с внешней обвязкой, как бы ни развиты были их способности к рассуждению.

Что такое TML-Interaction-Small?

TML-Interaction-Small — первый публичный релиз Thinking Machines Lab и первая реализация их архитектуры модели взаимодействия.

Это модель Mixture-of-Experts с 276 млрд параметров и 12 млрд активных, обученная с нуля на непрерывных аудио- и видеопотоках по описанному выше дизайну много-поточных микро-ходов, где вход и выход обрабатываются 200‑мс блоками.

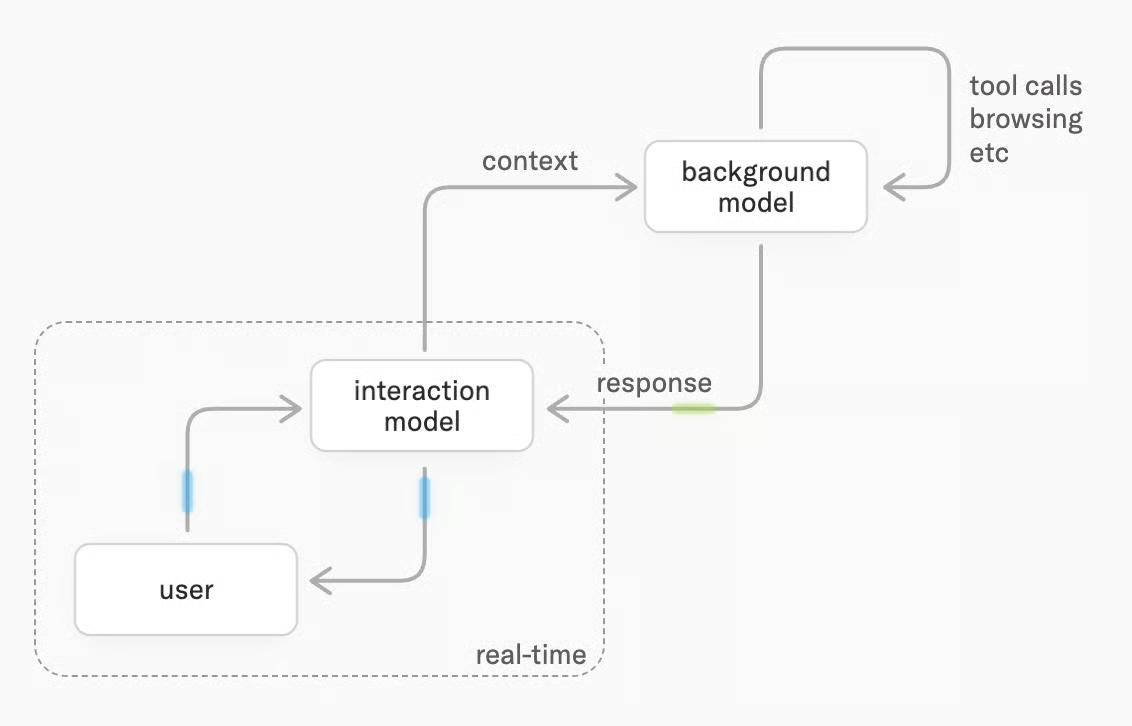

Сочетание двух моделей с общим контекстом обеспечивает и отзывчивость, и интеллект. Пользователи получают ответы от модели взаимодействия в реальном времени, а планирование, вызов инструментов и более глубокие рассуждения делегируются фоновой модели, работающей асинхронно.

Модель взаимодействия затем интегрирует фоновые результаты в беседу по мере их готовности, не выпадая из диалога.

Возможности TML-Interaction-Small

Там, где существующие голосовые ИИ модели разговаривают по очереди (вы говорите — они отвечают), TML-Interaction-Small ведёт себя ближе к собеседнику-человеку. Вот четыре способности, которые её выделяют.

Говорить и слушать одновременно

TML-Interaction-Small может синтезировать речь, пока пользователь ещё говорит. Это делает возможным синхронный перевод: вы говорите на одном языке, а модель начинает переводить, не дожидаясь конца фразы. Это также позволяет модели перебивать на полуслове, если она замечает ошибку, или подавать вербальные сигналы («поняла», «продолжайте»), пока вы ещё объясняете.

Это полезно и для настраиваемых ответов в реальном времени при наступлении заданного события. В одном клипе из релиз-нот, например, показывается, как модель конвертирует суммы в евро и озвучивает соответствующие суммы в долларах США при каждом упоминании платежа пользователем.

Видеть и реагировать на видео без запроса

TML-Interaction-Small обрабатывает видео вместе с аудио и может инициировать речь на основе увиденного, без словесного запроса.

Если вы делаете отжимания на камеру, она может вслух считать повторы по мере их выполнения. Если в видеопотоке появляется релевантный объект, она может тут же отметить его появление. Однако эту функцию ещё есть куда улучшать, что видно по внутренней метрике RepCount-A: лишь треть (33,4%) случаев укладывалась в точность «±1 повтор» относительно эталона.

Один из клипов (выглядит слегка необычно, на мой взгляд) демонстрирует это на практике: когда модель попросили следить за осанкой пользователя, она мгновенно заметила сутулость у ноутбука и напомнила её исправить.

Существующие коммерческие API реального времени работают только с аудио. Они отвечают на речевые ходы, но не могут проактивно реагировать на визуальные изменения. Такой возможности сегодня нет ни у GPT-Realtime-2, ни у Gemini Live.

Естественно обрабатывать перебивания и самокоррекции

Если вы начали фразу, передумали и поправили себя на ходу, TML-Interaction-Small отслеживает поправку и отвечает на то, что вы имели в виду. Она справляется с бэкчэннелингом (когда вы говорите «угу» или «да» во время её речи) и различает, обращаются ли к ней или к кому-то ещё в комнате.

В таких сценариях пошаговые модели часто ломаются: они либо замолкают, когда не нужно, либо отвечают на несущественную часть сказанного. Интересно будет увидеть, как TML-Interaction-Small справится с этим в повседневной среде, а не только в выверенных демо.

Выполнять сложные задачи в фоне, оставаясь «в разговоре»

Именно фоновая модель делает модель взаимодействия не только быстрой, но и умной. Вы можете продолжать задавать уточняющие вопросы или менять тему, пока фоновая задача выполняется. Когда результаты готовы, модель вплетает их в беседу в подходящий момент, а не прерывает вас резкой сменой контекста.

Это значит, что вы получаете и быстрые разговорные ответы, и возможность решать многошаговые задачи, для которых обычно модели приходится замолкать на несколько секунд. В демо-викторине это выглядит весьма убедительно: трое пользователей задают вопросы в быстром темпе, и модель в целом успевает за ними.

Бенчмарки TML-Interaction-Small

Thinking Machines приводит результаты по двум категориям: стриминговые бенчмарки, измеряющие интерактивность, и пошаговые бенчмарки, измеряющие интеллект. Наиболее сильные результаты — в стриминге, что напрямую отражает архитектурные решения.

Интерактивность

FD-bench v1.5 подаёт модели заранее записанное аудио и измеряет её поведение в четырёх сценариях:

- Перебивание пользователем

- Бэкчэннелинг пользователя

- Разговор с другими

- Фоновая речь

TML-Interaction-Small набирает 77,8 против 54,3 у Gemini-3.1-flash-live-preview на минимальных настройках и 46,8 у GPT-Realtime-2.0 на минимальных. Даже GPT-Realtime-2.0 на максимальных рассуждениях (xhigh) набирает лишь 47,8.

Это бенчмарк, который наиболее прямо измеряет цель Thinking Machines. Разрыв в 30 пунктов от ближайшего конкурента — это не «на грани погрешности». Вопрос лишь в том, охватывает ли FD-bench v1.5 весь спектр значимых на практике аспектов интерактивности — сами Thinking Machines признают, что это открытый исследовательский вопрос.

Задержка в смене хода

TML-Interaction-Small достигает задержки 0,40 секунды в FD-bench v1 — это самый быстрый результат среди сравниваемых моделей. Ближе всего Gemini-3.1-flash-live-preview с 0,57 секунды. Даже на минимальных настройках GPT-Realtime-2.0 требуется примерно втрое больше (1,18 секунды); на xhigh — 1,63 секунды.

Задержка критична для голосового взаимодействия так, как не критична для текста. Разница в 1,2 секунды между окончанием речи пользователя и началом ответа модели не только заметна, но и сбивает с ритма. Результат 0,40 секунды приближает TML-Interaction-Small к человеческим временам реакции в разговоре.

Интеллект и следование инструкциям

Audio MultiChallenge измеряет интеллект и следование инструкциям в аудио. TML-Interaction-Small набирает 43,4% — выше GPT-Realtime-1.5 (34,7%) и Gemini-3.1-flash-live-preview (26,8%), но ниже GPT-Realtime-2.0 на xhigh (48,5%). Здесь виден компромисс «интеллект ↔ интерактивность».

Разрыв между TML-Interaction-Small и GPT-Realtime-2.0 на xhigh — 5,1 п.п. Это заметно, но не критично, и при этом у GPT-Realtime-2.0 ощутимо выше задержка (1,63 секунды против 0,40). Ценность компромисса зависит от сценария.

Качество ответов и использование инструментов

FD-bench v3 измеряет качество ответов и точность вызовов инструментов в сценариях «аудио + инструменты». TML-Interaction-Small набирает 82,8% по качеству и 68,0% pass@1 с включённым фоновым агентом против 80,0% / 52,0% у GPT-Realtime-2.0 на минимуме и 81,0% / 58,0% на xhigh.

Разрыв в pass@1 (68,0% против 58,0%) — самый значимый показатель здесь, так как он отражает фактическое успешное завершение задач, зависящих от инструментов. Похоже, что двойная архитектура, отделяющая вызовы инструментов от пользовательского взаимодействия, себя оправдывает.

Новые бенчмарки интерактивности: TimeSpeak, CueSpeak и визуальная проактивность

Thinking Machines создали два внутренних бенчмарка и адаптировали ещё три менее распространённых, чтобы напрямую измерять интерактивность. Их стоит внимательно рассмотреть, потому что ни одна конкурирующая модель не показывает на них существенных результатов.

- TimeSpeak (запуск речи по времени): TML-Interaction-Small — 64,7% macro-accuracy.

- CueSpeak (запуск речи по вербальной подсказке): TML-Interaction-Small — 81,7% macro-accuracy.

- RepCount-A (подсчёт визуальных действий): TML-Interaction-Small — 33,4% точность «±1».

- ProactiveVideoQA (запуск речи по визуальной подсказке): TML-Interaction-Small — 31,5 PAUC (база «нет ответа» = 25,0%).

- Charades temporal localization (временная локализация действий в видео): TML-Interaction-Small — 30,4 mIoU.

На большинстве этих новых бенчмарков GPT realtime-2.0 фактически проваливается, показывая результат, близкий к нулю, или даже нулевой (на Charades, где нужно произносить «start» и «stop» в нужные моменты видео).

Сложно сказать, насколько эти результаты показательны, так как бенчмарки новые и пока не прошли независимую валидацию, но они укладываются в общую картину различий архитектур и сопоставимых метрик.

Цены и доступность TML-Interaction-Small

TML-Interaction-Small сейчас доступна в ограниченном исследовательском превью, цен пока не объявляли. Thinking Machines планирует расширить доступ позже в 2026 году. Заинтересованные исследователи и разработчики могут написать команде на interaction@thinkingmachines.ai, чтобы запросить доступ.

Для сравнения: GPT-Realtime-2 стоит $32 за миллион входных аудиотокенов и $64 за миллион выходных, как мы писали в нашем обзоре GPT-Realtime-2. Цены на TML-Interaction-Small, вероятно, объявят к моменту более широкого релиза.

Как вы, вероятно, заметили, у модели суффикс «-Small», и вы правы, ожидая, что Thinking Machines выпустит и более крупные модели. Пока они слишком медленные для продакшена, но релиз запланирован на конец 2026 года.

TML-Interaction-Small vs. GPT-Realtime-2

Наиболее интересный разрыв между моделями — в бенчмарках интерактивности. В FD-bench v1.5, который измеряет поведение при перебивании, бэкчэннелинге, разговоре с другими и фоновой речи, TML-Interaction-Small набирает 77,8. GPT-Realtime-2.0 на минимальных настройках — 46,8, а на максимальных рассуждениях (xhigh) — 47,8. Это разница в 30 пунктов по метрике, которая наиболее прямо отражает приоритеты Thinking Machines.

Есть компромисс по интеллекту, но здесь разрыв куда меньше, чем по интерактивности. GPT-Realtime-2.0 на xhigh набирает 48,5% в Audio MultiChallenge против 43,4% у TML-Interaction-Small. В BigBench Audio GPT-Realtime-2.0 на high — 96,6% против 75,7% у TML-Interaction-Small (хотя TML-Interaction-Small достигает 96,5% с включённым фоновым агентом).

Общая картина такова: TML-Interaction-Small лидирует по отзывчивости и интерактивности, тогда как GPT-Realtime-2.0 на высоких настройках рассуждений лидирует в «чисто интеллектуальных» тестах.

| Бенчмарк | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 задержка смены хода (с) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 среднее | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 качество ответа (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio точность (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) точность (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval текстовая точность (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* С включённым фоновым агентом.

Чтобы увидеть в действии семейство аудиомоделей OpenAI, загляните в наш туториал по API GPT-Realtime-2.

Заключение

TML-Interaction-Small выглядит многообещающе. Если она подтвердит заявленные в релиз-нотах характеристики, новая модель серьёзно улучшает интерактивность при малой задержке, не жертвуя качеством ответов или способностями к рассуждению. Умение одновременно говорить, слушать и реагировать на визуальные сигналы пока уникально и открывает множество возможностей. Интересно будет увидеть, каков окажется прайс-лист при публичном релизе.

Разрыв в интеллекте по сравнению с GPT-Realtime-2 реален, но уже, чем разрыв по интерактивности. В задачах, где важна естественность беседы, разница в задержке важнее разницы в интеллекте. В задачах, где приоритет — точность сложных рассуждений, GPT-Realtime-2.0 на высоких настройках рассуждений по-прежнему впереди.

Если вы хотите быстро разобраться в мире ИИ-моделей и научиться эффективно с ними работать, начните с нашего трекa навыков «AI Fundamentals».