track

Bara förra veckan höjde OpenAI:s GPT-Realtime-2 ribban för röst-AI när den lanserades med GPT-5-klassad slutledningsförmåga och ett kontextfönster på 128K. Nu för Mira Muratis Thinking Machines Lab fram en annan tes: att responsivitet och intelligens bör tränas in i samma modell från grunden, inte skruvas på i efterhand med röstaktivitetsdetektering och dialoghanteringskomponenter.

Labbet kallar den här typen av ny modell för en ”interaktionsmodell”.

Deras forskningsförhandsvisning, TML-Interaction-Small, är det första resultatet av detta angreppssätt. Det är en Mixture-of-Experts-modell med 276 miljarder parametrar och 12 miljarder aktiva parametrar. Den bearbetar ljud, video och text i kontinuerliga mikro-omgångar om 200 ms, vilket betyder att den uppfattar och svarar samtidigt i stället för att vänta tills talaren pratat färdigt.

I den här artikeln går jag igenom vad TML-Interaction-Small är, tar upp dess viktigaste arkitektoniska egenskaper, jämför den direkt med GPT-Realtime-2 och tittar närmare på benchmarkresultaten.

Vad är interaktionsmodeller?

Thinking Machines Lab beskriver en interaktionsmodell som ett system där interaktiviteten är en del av själva modellen, inte något som implementeras i ett omgivande hölje. Grundprincipen är att responsivitet och intelligens bör tränas tillsammans från grunden, på kontinuerliga ljud- och videoströmmar, i stället för att bultas på en textbaserad modell i efterhand.

De flesta befintliga röst-AI-system i realtid syr ihop komponenter för röstaktivitetsdetektering, separata kodare och lager för dialoghantering för att simulera responsivitet. Thinking Machines Lab menar att detta arbetssätt alltid kommer att släpa efter modeller som hanterar interaktion inbyggt, på grund av konstgjorda turgränser som begränsar vad den icke-interaktiva modellen kan göra.

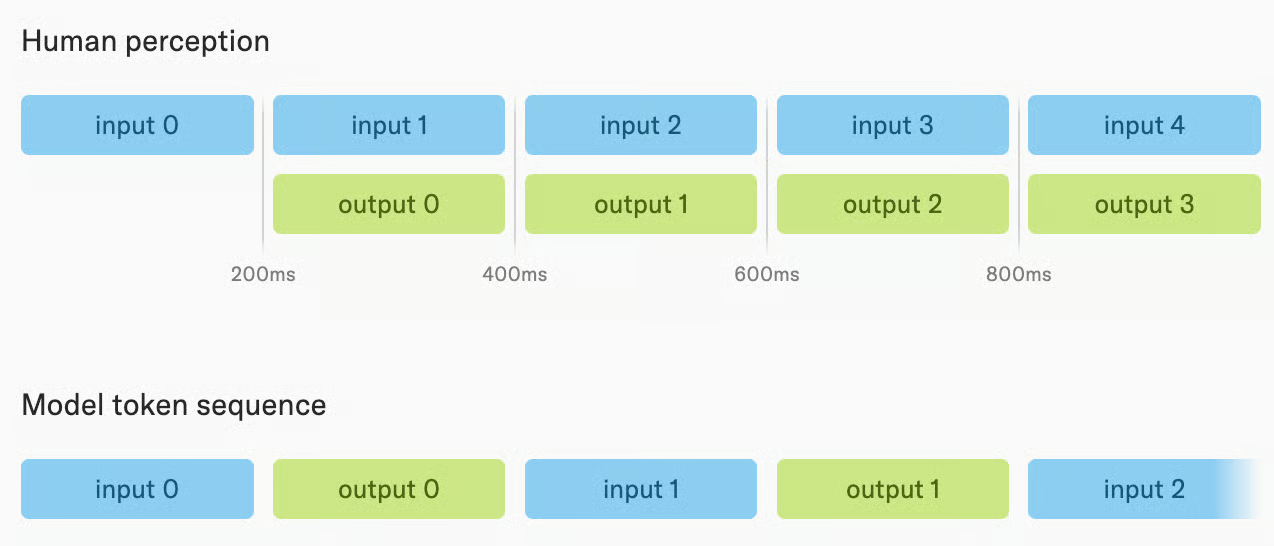

I stället för att sekventiellt konsumera användarinmatning och sedan generera ett fullständigt svar är labbets interaktionsmodeller utformade för att ligga närmare mänsklig perception. De behandlar både in- och utdata-token som strömmar, och båda flätas samman i var och en av de 200 millisekunder långa mikro-omgångarna.

I sin tur uppfattar och svarar en interaktionsmodell samtidigt, och bearbetar in- och utdata parallellt i stället för att vänta tills talaren är färdig. Detta möjliggör ett par smarta förmågor:

I sin tur uppfattar och svarar en interaktionsmodell samtidigt, och bearbetar in- och utdata parallellt i stället för att vänta tills talaren är färdig. Detta möjliggör ett par smarta förmågor:

- Tala samtidigt som den lyssnar

- Reagera på visuella signaler utan att bli tillfrågad

- Hålla direkt koll på förfluten tid

Allt detta är sådant som turbaserade modeller med externa höljen inte kan replikera, oavsett hur mycket slutledningsförmåga de har.

Vad är TML-Interaction-Small?

TML-Interaction-Small är Thinking Machines Labs första publika modellsläpp och den första implementeringen av deras arkitektur för interaktionsmodeller.

Det är en Mixture-of-Experts-modell med 276 miljarder parametrar och 12 miljarder aktiva parametrar, tränad från grunden på kontinuerliga ljud- och videoströmmar enligt den flerströms mikro-omgångsdesign jag beskrev tidigare, där in- och utdata bearbetas i 200 ms-block.

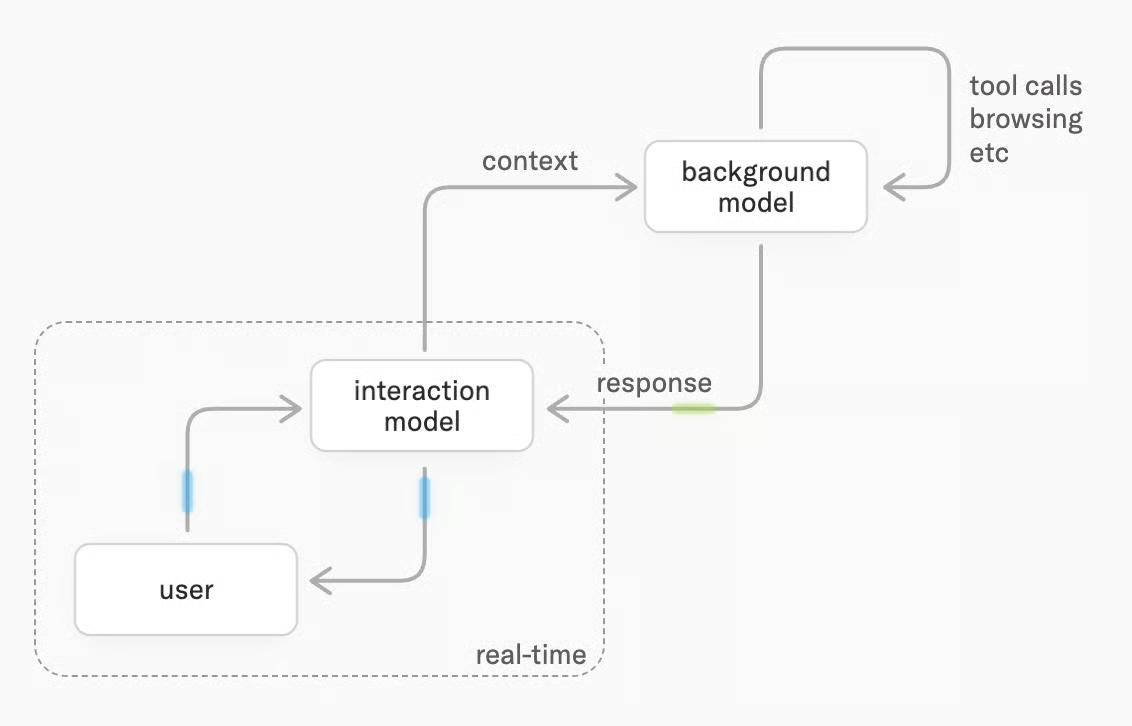

Kombinationen av två modeller med delat sammanhang ger både responsivitet och intelligens. Användare får svar från interaktionsmodellen i realtid, medan planering, verktygsanvändning och djupare resonemang delegeras till bakgrundsmodellen, som körs asynkront.

Interaktionsmodellen väver sedan in bakgrundsresultaten i samtalet när de kommer, utan att tappa tråden.

Funktioner i TML-Interaction-Small

Där befintliga röst-AI-modeller turas om (du pratar, de svarar) fungerar TML-Interaction-Small mer som en mänsklig samtalspartner. Här är de fyra förmågor som särskiljer den.

Tala och lyssna samtidigt

TML-Interaction-Small kan generera tal medan användaren fortfarande pratar. Det gör simultantolkning möjlig: du talar på ett språk och modellen börjar översätta innan du avslutat meningen. Det betyder också att modellen kan avbryta mitt i en mening när den upptäcker ett fel, eller ge verbala signaler ("uppfattat", "fortsätt") medan du fortfarande förklarar något.

Detta är också användbart för anpassade svar i realtid när en specifik promptad händelse inträffar. Ett klipp i versionsanteckningarna visar till exempel hur modellen omvandlar EUR-belopp och säger de motsvarande USD-beloppen närhelst en betalning nämns av användaren.

Se och reagera på video utan att bli tillfrågad

TML-Interaction-Small bearbetar video parallellt med ljud och kan initiera tal baserat på vad den ser, utan någon verbal prompt.

Om du gör armhävningar framför kameran kan den räkna repetitioner högt i takt med att de sker. Om ett relevant objekt dyker upp i en videoström kan den uppmärksamma det i samma ögonblick som det blir synligt. Detta är dock en funktion som fortfarande kan förbättras, vilket syns i det interna RepCount-A-resultatet, där bara en tredjedel (33,4 %) av fallen låg inom en repetition från facit.

Ett släppklipp (som ser lite quirky ut, enligt min mening) demonstrerar detta i praktiken: När modellen ombads hålla koll på användarens hållning upptäckte den genast framåtlutad hållning vid laptopen och påminde henne om att rätta till den.

Befintliga kommersiella realtids-API:er är endast för ljud. De svarar på talade turer men har inget sätt att proaktivt reagera på visuella förändringar. Detta är en kapacitet som helt enkelt inte finns i GPT-Realtime-2 eller Gemini Live i dag.

Hantera avbrott och självkorrigeringar naturligt

Om du börjar en mening, ångrar dig och rättar dig själv mitt i tanken, håller TML-Interaction-Small reda på korrigeringen och svarar på vad du faktiskt menade. Den hanterar backchanneling (att du säger "mm" eller "just det" medan den pratar) och skiljer på när någon pratar med den jämfört med när någon pratar med någon annan i rummet.

Detta är scenarier där turbaserade modeller ofta fallerar. De slutar antingen prata när de inte borde, eller svarar på fel del av det som sades. Det blir intressant att se om TML-Interaction-Small klarar detta i vardagliga situationer lika bra som i kuraterade demovideor.

Köra komplexa uppgifter i bakgrunden och samtidigt vara närvarande

Bakgrundsmodellen är det som gör interaktionsmodellen inte bara snabb, utan också intelligent. Du kan fortsätta ställa följdfrågor eller byta ämne medan bakgrundsuppgiften körs. När resultaten är klara väver modellen in dem i samtalet vid ett naturligt tillfälle i stället för att avbryta dig med ett tvärt kontextskifte.

Det betyder att du får både snabba, samtalsmässiga svar och förmågan att hantera flerstegsuppgifter som normalt skulle kräva att modellen blir tyst i flera sekunder. I ett quiz-demoklipp fungerar detta ganska bra: Tre användare ställer snabba triviafrågor, och modellen hänger för det mesta med i deras tempo.

TML-Interaction-Small benchmarkresultat

Thinking Machines rapporterar resultat i två kategorier: strömmande benchmark som mäter interaktivitet, och turbaserade benchmark som mäter intelligens. Modellens starkaste resultat finns på den strömmande sidan, där dess arkitektoniska val testas mest direkt.

Interaktivitet

FD-bench v1.5 ger modellen förinspelat ljud och mäter dess beteende i fyra scenarier:

- Användaravbrott

- Användarens backchannel

- Att prata med andra

- Bakgrundstal

TML-Interaction-Small får 77,8, jämfört med 54,3 för Gemini-3.1-flash-live-preview på minimala inställningar och 46,8 för GPT-Realtime-2.0 på minimala inställningar. Även GPT-Realtime-2.0 på sin högsta slutledningsnivå (xhigh) får bara 47,8.

Detta är benchmarken som mest direkt mäter det Thinking Machines siktar på att bygga. Ett försprång på 30 poäng över närmaste konkurrent är inte en marginell skillnad. Frågan är om FD-bench v1.5 fångar hela det spektrum av interaktivitet som spelar roll i praktiken, vilket Thinking Machines själva medger är en öppen forskningsfråga.

Turbyteslatens

TML-Interaction-Small uppnår en turbyteslatens på 0,40 sekunder i FD-bench v1, snabbast av alla jämförda modeller. Gemini-3.1-flash-live-preview kommer närmast med 0,57 sekunder. Även på minimala inställningar tar GPT-Realtime-2.0 ungefär tre gånger så lång tid (1,18 sekunder); på xhigh-sutledning når GPT-Realtime-2.0 1,63 sekunder.

Latens spelar roll för röstinteraktion på ett sätt som den inte gör för text. En lucka på 1,2 sekunder mellan att en användare slutar tala och att modellen börjar svara är inte bara märkbar utan också störande. Resultatet 0,40 sekunder placerar TML-Interaction-Small närmare mänskliga samtalsresponstider.

Intelligens och instruktionsefterlevnad

Audio MultiChallenge mäter intelligens och instruktionsefterlevnad i ljud. TML-Interaction-Small får 43,4 %, över GPT-Realtime-1.5 (34,7 %) och Gemini-3.1-flash-live-preview (26,8 %), men under GPT-Realtime-2.0 på xhigh (48,5 %). Detta är benchmarken där trade-offen mellan intelligens och interaktivitet syns.

Gapet mellan TML-Interaction-Small och GPT-Realtime-2.0 på xhigh är 5,1 procentenheter. Det är en märkbar, men inte enorm skillnad, och den kommer med en avsevärd latenskostnad på GPT-Realtime-2.0-sidan (1,63 sekunder jämfört med 0,40 sekunder). Om den trade-offen är värd det beror på applikationen.

Svarskvalitet och verktygsanvändning

FD-bench v3 mäter svarskvalitet och träffsäkerhet i verktygsanrop i scenarier med ljud plus verktyg. TML-Interaction-Small får 82,8 % svarskvalitet och 68,0 % pass@1 med bakgrundsagent aktiverad, jämfört med 80,0 % / 52,0 % för GPT-Realtime-2.0 på minimala inställningar och 81,0 % / 58,0 % på xhigh.

Pass@1-gapet (68,0 % mot 58,0 %) är den mest meningsfulla siffran här, eftersom den mäter om modellen faktiskt slutför verktygsberoende uppgifter korrekt. Det verkar som att den dubbla arkitekturen som separerar verktygsanrop från användarinteraktioner lönar sig.

Nya interaktivitetsbenchmarks: TimeSpeak, CueSpeak och visuell proaktivitet

Thinking Machines skapade två interna benchmark och anpassade tre mindre spridda benchmark för att mäta interaktivitetsförmågor direkt. Dessa är värda att granska noggrant eftersom inga konkurrerande modeller presterar meningsfullt på någon av dem.

- TimeSpeak (tidsstyrd talinitiering): TML-Interaction-Small får 64,7 % makro-precision.

- CueSpeak (verbala signaler som triggar tal): TML-Interaction-Small får 81,7 % makro-precision.

- RepCount-A (visuell räkning av handlingar): TML-Interaction-Small får 33,4 % off-by-one-precision.

- ProactiveVideoQA (visuella signaler som triggar tal): TML-Interaction-Small får 31,5 PAUC (ingen-svar-baslinje = 25,0 %).

- Charades temporal localization (tidsmässig lokalisering av visuella handlingar): TML-Interaction-Small får 30,4 mIoU.

På de flesta av dessa nya benchmark misslyckas GPT realtime-2.0 helt, med ett resultat nära noll, eller till och med noll (på Charades-benchmarken, som kräver att modellen säger ”start” och ”stopp” vid rätt ögonblick under en video).

Det är svårt för mig att säga hur meningsfulla dessa resultat är, eftersom dessa benchmark är nya och ännu inte oberoende validerade, men de följer den allmänna bilden av de arkitektoniska skillnaderna och jämförbara benchmarkresultat.

Prissättning och tillgänglighet för TML-Interaction-Small

TML-Interaction-Small är för närvarande i en begränsad forskningsförhandsvisning, och inga prisuppgifter har meddelats. Thinking Machines planerar att öppna för bredare åtkomst senare under 2026. Intresserade forskare och utvecklare kan kontakta teamet på interaction@thinkingmachines.ai för att begära åtkomst.

Som jämförelse kostar GPT-Realtime-2 32 dollar per miljon ljudinmatningstoken och 64 dollar per miljon ljudutmatningstoken, vilket vi tog upp i vår översikt av GPT-Realtime-2. Priset för TML-Interaction-Small kommer sannolikt att meddelas i samband med den bredare lanseringen.

Som du säkert lade märke till har modellen suffixet ”-Small”, och du har rätt i att förvänta dig att Thinking Machines följer upp med större modeller. De är fortfarande för långsamma för att kunna servas, men en lansering planeras till slutet av 2026.

TML-Interaction-Small vs. GPT-Realtime-2

Den mer intressanta skillnaden mellan de två modellerna finns i interaktivitetsbenchmarks. På FD-bench v1.5, som mäter beteende vid användaravbrott, backchanneling, att prata med andra och bakgrundstal, får TML-Interaction-Small 77,8. GPT-Realtime-2.0 på minimala inställningar får 46,8, och på sin högsta slutledningsnivå (xhigh) 47,8. Det är ett gap på 30 poäng på den benchmark som mest direkt mäter det Thinking Machines optimerar för.

Det finns en intelligens-trade-off, men gapet här är mycket mindre än för interaktivitet. GPT-Realtime-2.0 på xhigh får 48,5 % på Audio MultiChallenge jämfört med TML-Interaction-Smalls 43,4 %. På BigBench Audio får GPT-Realtime-2.0 på high 96,6 % jämfört med 75,7 % för TML-Interaction-Small (även om TML-Interaction-Small når 96,5 % med bakgrundsagent aktiverad).

Den allmänna bilden som framträder är att TML-Interaction-Small leder i responsivitet och interaktivitet, medan GPT-Realtime-2.0 på höga slutledningsinställningar leder på rena intelligensbenchmark.

| Benchmark | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 turbyteslatens (s) | 0,40 | 1,18 | 1,63 | 0,57 |

| FD-bench v1.5 genomsnitt | 77,8 | 46,8 | 47,8 | 54,3 |

| FD-bench v3 svarskvalitet (%) | 82,8* | 80,0 | 81,0 | 68,5 |

| Audio MultiChallenge APR (%) | 43,4 | 37,6 | 48,5 | 26,8 |

| BigBench Audio noggrannhet (%) | 75,7 / 96,5* | 71,8 | 96,6 | 71,3 |

| IFEval (VoiceBench) noggrannhet (%) | 82,1 | 81,7 | 83,2 | 67,6 |

| IFEval textnoggrannhet (%) | 89,7 | 89,6 | 95,2 | 85,8 |

* Med bakgrundsagent aktiverad.

För att se OpenAI:s ljudmodellsfamilj i praktiken, kolla in vår GPT-Realtime-2 API-handledning.

Avslutande tankar

TML-Interaction-Small ser lovande ut. Om den lever upp till påståendena i versionsanteckningarna innebär den nya modellen avsevärt förbättrad interaktivitet med kort latens, utan att offra svarskvalitet eller slutledningsförmåga. Förmågan att samtidigt tala, lyssna och reagera på visuella signaler är hittills unik och öppnar för många möjligheter. Jag är nyfiken på hur prissättningen kommer att se ut när modellen släpps publikt.

Intelligensgapet till GPT-Realtime-2 är verkligt men smalare än interaktivitetsgapet. För applikationer där samtalet behöver kännas naturligt är skillnaden i latens viktigare än intelligensgapet. För applikationer där noggrannhet på svåra resonemangsuppgifter är prioritet ligger GPT-Realtime-2.0 på höga slutledningsinställningar fortfarande före.

Om du vill få en snabb överblick över det bredare landskapet av AI-modeller och hur du arbetar effektivt med dem rekommenderar jag att du börjar med vår kompetensväg AI Fundamentals.