Program

Geçen hafta OpenAI’nin GPT-Realtime-2’si, GPT-5 sınıfı akıl yürütme ve 128K bağlam penceresiyle birlikte piyasaya çıkarak sesli yapay zekâda çıtayı yükseltti. Şimdi ise Mira Murati’nin Thinking Machines Lab’i farklı bir iddia ortaya koyuyor: tepki verebilirlik ve zekânın, ses etkinliği tespiti (VAD) ve diyalog yönetimi bileşenleriyle sonradan yamalanmak yerine, en baştan aynı modelin içine birlikte eğitilmesi gerektiği.

Laboratuvar bu yeni model türünü “Etkileşim Modeli” olarak adlandırıyor.

Araştırma ön izlemesi olan TML-Interaction-Small, bu yaklaşımın ilk sonucu. 12B aktif parametreli, 276B parametreli bir Uzman Karışımı (Mixture-of-Experts) model. Sesi, videoyu ve metni 200 ms’lik sürekli mikro turlarda işliyor; yani bir konuşmacının sözünü bitirmesini beklemek yerine eşzamanlı olarak algılıyor ve yanıtlıyor.

Bu yazıda TML-Interaction-Small’ın ne olduğunu, temel mimari özelliklerini ele alacak, doğrudan GPT-Realtime-2 ile karşılaştıracak ve kıyaslama sonuçlarına ayrıntılı olarak bakacağım.

Etkileşim Modelleri Nedir?

Thinking Machines Lab, etkileşim modelini, etkileşimin modelin bizzat parçası olduğu, çevresel bir düzende (harness) uygulanmadığı bir sistem olarak tanımlıyor. Temel ilke; tepki verebilirlik ve zekânın, sonradan metin tabanlı bir modele eklemlenmek yerine, sürekli ses ve video akışları üzerinde en baştan birlikte eğitilmesi gerektiği.

Mevcut gerçek zamanlı sesli yapay zekâların çoğu, tepki verebilirliği taklit etmek için ses etkinliği tespiti bileşenlerini, ayrı kodlayıcıları ve diyalog yönetimi katmanlarını bir araya diker. Thinking Machines Lab, etkileşimi yerel olarak ele alan modellere kıyasla bu yaklaşımın daima geride kalacağını; çünkü yapay tur sınırlarının, etkileşimsiz modelin yapabileceklerini sınırladığını savunuyor.

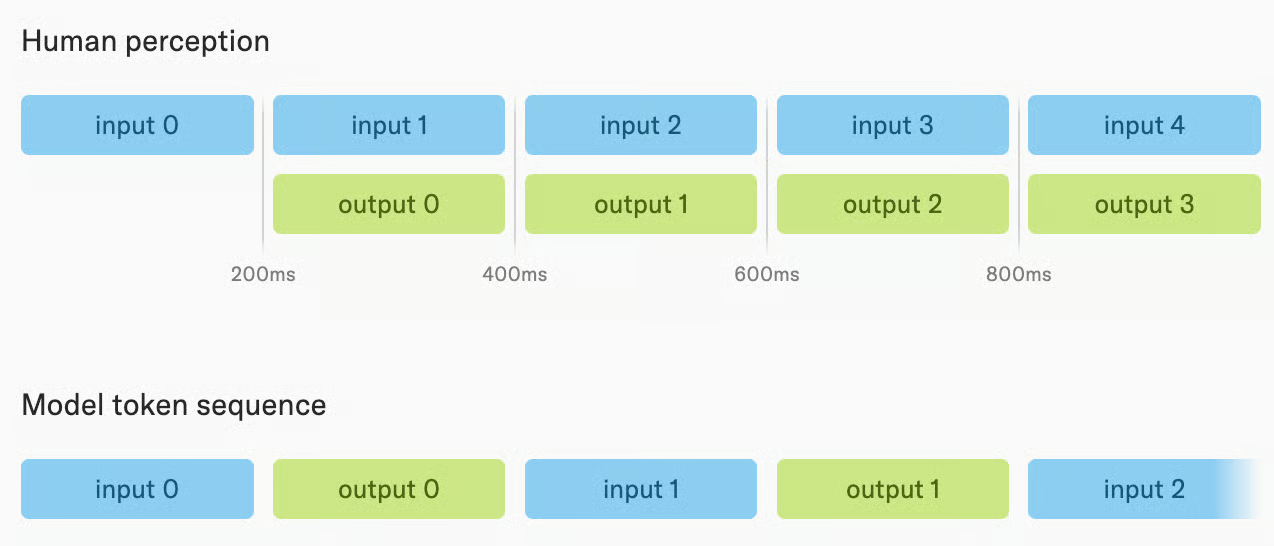

Kullanıcı girdisini sırasıyla tüketip ardından tam bir yanıt üretmek yerine, laboratuvarın etkileşim modelleri insan algısına daha yakın davranacak şekilde tasarlandı. Hem girdi hem de çıktı belirteçlerini akışlar olarak ele alıyorlar ve her ikisi de 200 milisaniyelik mikro turların her birinde iç içe geçiyor.

Böylece bir etkileşim modeli, bir konuşmacının sözünü bitirmesini beklemek yerine girdiyi ve çıktıyı paralel olarak işleyip aynı anda algılar ve yanıtlar. Bu da birkaç güzel yeteneği mümkün kılar:

Böylece bir etkileşim modeli, bir konuşmacının sözünü bitirmesini beklemek yerine girdiyi ve çıktıyı paralel olarak işleyip aynı anda algılar ve yanıtlar. Bu da birkaç güzel yeteneği mümkün kılar:

- Dinlerken konuşabilme

- İsteme olmaksızın görsel ipuçlarına tepki verme

- Geçen süreyi doğrudan takip etme

Bunların tümü, ne kadar güçlü akıl yürütme yeteneğine sahip olursa olsun, harici düzenekli tur bazlı modellerin kopyalayamadığı özelliklerdir.

TML-Interaction-Small nedir?

TML-Interaction-Small, Thinking Machines Lab’in ilk kamuya açık model sürümü ve etkileşim modeli mimarilerinin ilk uygulamasıdır.

12B aktif parametreli, 276B parametreli bir Uzman Karışımı modeldir; daha önce açıkladığım çok akışlı mikro tur tasarımıyla, girdi ve çıktının 200 ms’lik parçalar halinde işlendiği sürekli ses ve video akışları üzerinde sıfırdan eğitilmiştir.

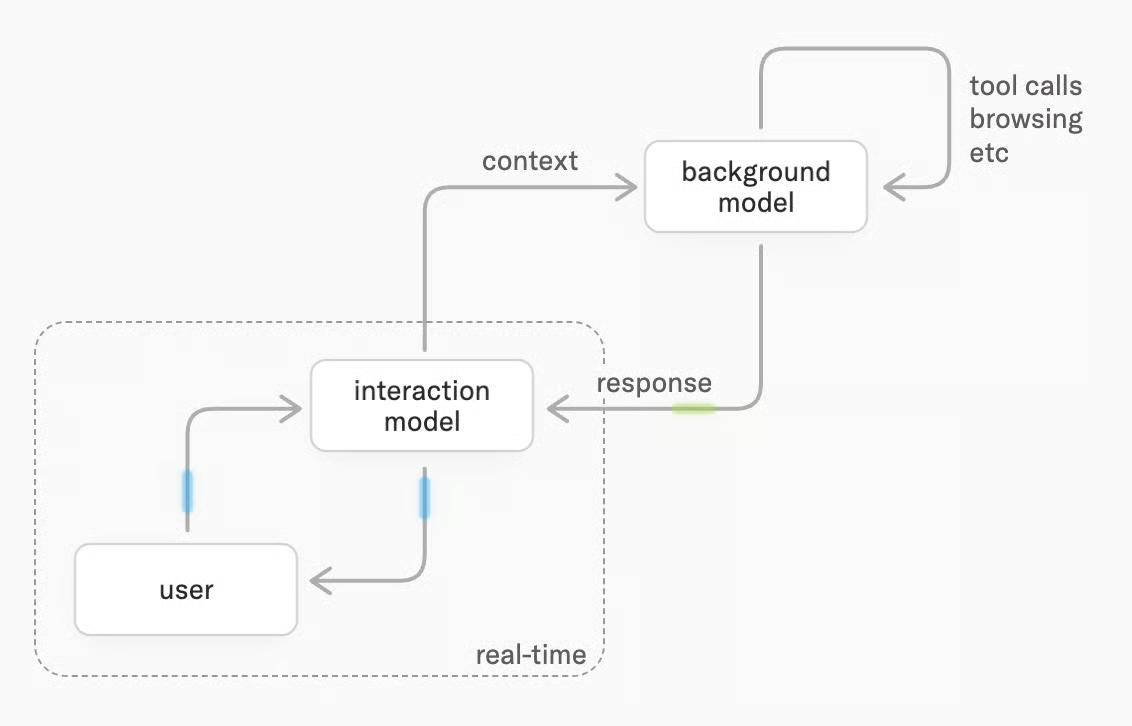

Paylaşılan bağlama sahip iki modelin birleşimi hem tepki verebilirlik hem de zekâ sunar. Kullanıcılar etkileşim modelinden gerçek zamanlı yanıt alırken, planlama, araç kullanımı ve daha derin akıl yürütme, eşzamanlı olmayan şekilde çalışan arka plan modeline devredilir.

Ardından etkileşim modeli, arka plan sonuçlarını sohbete, konuşmadan kopmadan, geldikleri anda entegre eder.

TML-Interaction-Small özellikleri

Mevcut sesli yapay zekâ modelleri sıra ile konuşur (siz konuşursunuz, onlar yanıtlar); TML-Interaction-Small ise daha çok insanla yapılan bir sohbet ortağı gibi çalışır. Onu öne çıkaran dört yetenek şunlardır.

Aynı anda konuşun ve dinleyin

TML-Interaction-Small, kullanıcı hâlâ konuşurken konuşma üretebilir. Bu, eşzamanlı çeviriyi mümkün kılar: siz bir dilde konuşurken model, cümlenizi bitirmeden çevirmeye başlar. Ayrıca model, bir hatayı yakaladığında cümle ortasında araya girebilir veya siz bir şey açıklarken ("anladım", "devam edin") gibi sözlü işaretler verebilir.

Bu, belirli bir tetikleyici olay gerçekleştiğinde özel gerçek zamanlı yanıtlar için de faydalıdır. Örneğin sürüm notlarındaki bir klipte, modelin kullanıcı bir ödemeden bahsettiğinde EUR tutarlarını USD’ye çevirip karşılıklarını sesli olarak ilettiği gösteriliyor.

İstenmeden videoyu görüp tepki verin

TML-Interaction-Small, videoyu sesle birlikte işler ve herhangi bir sözlü istem olmaksızın, gördüklerine dayanarak konuşma başlatabilir.

Kamerada şınav çekiyorsanız, tekrarları olurken yüksek sesle sayabilir. Bir video akışında ilgili bir nesne belirirse, görünür olduğu anda onu söyleyebilir. Ancak bu özellik hâlâ geliştirilebilir; içsel RepCount-A skorundan da görülebileceği gibi örneklerin yalnızca üçte birinde (%33,4) gerçek değerden bir tekrar sapmayla sonuç alınabilmiştir.

Bir sürüm klibi (bana göre biraz tuhaf görünüyor) bunu şöyle gösteriyor: Kullanıcının duruşuna dikkat etmesi istendiğinde, model dizüstü bilgisayar başında kambur duruşu anında tespit etti ve düzeltmesini hatırlattı.

Mevcut ticari gerçek zamanlı API’ler yalnızca seslidir. Konuşma turlarına yanıt verirler ancak görsel değişimlere proaktif şekilde tepki veremezler. Bu, bugün GPT-Realtime-2 veya Gemini Live’da bulunmayan bir yetenek.

Kesintileri ve kendini düzeltmeleri doğal biçimde yönetin

Bir cümleye başlayıp fikrinizi değiştirir ve düşüncenin ortasında kendinizi düzeltirseniz, TML-Interaction-Small düzeltmeyi takip eder ve aslında ne demek istediğinize yanıt verir. Araya girme işaretlerini (onun konuştuğu sırada sizin “hı hı” ya da “doğru” demeniz) idare eder ve kendisiyle konuşan biriyle odadaki başka birine konuşan kişiyi ayırt eder.

Bunlar, tur bazlı modellerin sık sık tökezlediği senaryolardır. Ya konuşmamaları gerekirken konuşmayı keserler ya da söylenenin yanlış kısmına yanıt verirler. TML-Interaction-Small’ın bunu gündelik durumlarda da, seçilmiş demo videolarındaki kadar iyi idare edip edemeyeceğini görmek ilginç olacak.

Varlığını korurken arka planda karmaşık görevler çalıştırın

Arka plan modeli, etkileşim modelini yalnızca hızlı değil, aynı zamanda zeki kılan unsurdur. Arka plan görevi çalışırken takip soruları sormaya devam edebilir veya konuyu değiştirebilirsiniz. Sonuçlar hazır olduğunda, model bunları sizi ani bir bağlam geçişiyle bölmek yerine, doğal bir anda sohbete geri işler.

Bu, birkaç saniye boyunca modelin susmasını gerektirecek çok adımlı görevleri de yönetebilme ile hızlı sohbet yanıtlarını birlikte almanız anlamına gelir. Bir bilgi yarışması demo klibinde bu oldukça iyi çalışıyor: Üç kullanıcı hızlı tempoda bilgi soruları soruyor ve model büyük ölçüde hızlarına yetişebiliyor.

TML-Interaction-Small kıyaslamaları

Thinking Machines sonuçları iki kategoride raporluyor: etkileşimi ölçen akış (streaming) kıyaslamaları ve zekâyı ölçen tur bazlı kıyaslamalar. Modelin en güçlü sonuçları, mimari tercihlerin en doğrudan test edildiği akış tarafında.

Etkileşim

FD-bench v1.5, modele önceden kaydedilmiş ses verip dört senaryoda davranışını ölçüyor:

- Kullanıcı kesintisi

- Kullanıcı araya girme işaretleri

- Başkalarıyla konuşma

- Arka plan konuşması

TML-Interaction-Small 77,8 puan alıyor; minimum ayarlarda Gemini-3.1-flash-live-preview 54,3 ve GPT-Realtime-2.0 46,8 puan alıyor. GPT-Realtime-2.0, en yüksek akıl yürütme ayarında (xhigh) bile yalnızca 47,8 puan alıyor.

Bu, Thinking Machines’in hedeflediğini en doğrudan ölçen kıyaslama. En yakın rakibe karşı 30 puanlık fark, marjinal bir fark değil. Soru şu: FD-bench v1.5 pratikte önemli olan etkileşimin tüm yelpazesini yakalıyor mu? Thinking Machines de bunun açık bir araştırma sorusu olduğunu kabul ediyor.

Tur alma gecikmesi

TML-Interaction-Small, FD-bench v1’de 0,40 saniyelik tur alma gecikmesine ulaşıyor ve karşılaştırılan modeller içinde en hızlısı. En çok yaklaşan Gemini-3.1-flash-live-preview 0,57 saniye. GPT-Realtime-2.0 ise minimum ayarlarda bile yaklaşık üç kat daha uzun sürüyor (1,18 saniye); xhigh akıl yürütmede 1,63 saniyeye ulaşıyor.

Gecikme, metinde olduğundan farklı bir biçimde sesli etkileşim için önemlidir. Kullanıcı konuşmasını bitirdikten modelin yanıt vermeye başlamasına kadar geçen 1,2 saniyelik boşluk yalnızca fark edilir olmakla kalmaz, aynı zamanda rahatsız edicidir. 0,40 saniyelik sonuç, TML-Interaction-Small’ı insan sohbeti yanıt sürelerine daha çok yaklaştırıyor.

Zekâ ve talimat izleme

Audio MultiChallenge, seste zekâyı ve talimat izleme yeteneğini ölçer. TML-Interaction-Small %43,4 puan alarak GPT-Realtime-1.5’i (%34,7) ve Gemini-3.1-flash-live-preview’i (%26,8) geride bırakıyor; ancak xhigh ayarında GPT-Realtime-2.0’ın (%48,5) altında kalıyor. Bu, zekâ–etkileşim ödünleşiminin görüldüğü kıyaslamadır.

TML-Interaction-Small ile xhigh ayarındaki GPT-Realtime-2.0 arasındaki fark 5,1 yüzde puanı. Bu anlamlı fakat büyük olmayan bir fark ve GPT-Realtime-2.0 tarafında kayda değer bir gecikme maliyetiyle geliyor (1,63 saniye karşısında 0,40 saniye). Bu ödünleşimin değip değmeyeceği uygulamaya bağlı.

Yanıt kalitesi ve araç kullanımı

FD-bench v3, ses+araç senaryolarında yanıt kalitesi ve araç çağrısı doğruluğunu ölçer. Arka plan ajanı etkinleştirildiğinde TML-Interaction-Small %82,8 yanıt kalitesi ve %68,0 pass@1 alıyor; bu değerler GPT-Realtime-2.0 için minimum ayarlarda %80,0 / %52,0 ve xhigh’da %81,0 / %58,0.

Burada en anlamlı sayı pass@1 farkıdır (%68,0’a karşı %58,0); çünkü modelin araçlara bağlı görevleri gerçekten doğru tamamlayıp tamamlamadığını ölçer. Kullanıcı etkileşimlerinden araç çağrılarını ayıran çiftli mimarinin karşılığını verdiği görülüyor.

Yeni etkileşim kıyasları: TimeSpeak, CueSpeak ve görsel proaktivite

Thinking Machines, etkileşim yeteneklerini doğrudan ölçmek için iki dahili kıyaslama oluşturdu ve daha az yaygın kullanılan üç kıyaslamayı uyarladı. Rakip hiçbir modelin bunların hiçbirinde anlamlı performans göstermediği göz önüne alındığında, bunlara dikkatle bakmaya değer.

- TimeSpeak (zamanlı konuşma başlatma): TML-Interaction-Small %64,7 makro-doğruluk.

- CueSpeak (sözlü ipucu tetiklemeli konuşma): TML-Interaction-Small %81,7 makro-doğruluk.

- RepCount-A (görsel eylem sayma): TML-Interaction-Small %33,4 bir farkla (off-by-one) doğruluk.

- ProactiveVideoQA (görsel ipucu tetiklemeli konuşma): TML-Interaction-Small 31,5 PAUC (yanıt yok taban çizgisi = %25,0).

- Charades zamansal yerelleştirme (görsel eylem zamanlama): TML-Interaction-Small 30,4 mIoU.

Bu yeni kıyasların çoğunda GPT realtime-2.0 tamamen başarısız oluyor; sonuç sıfıra yakın ya da hatta sıfır (modelin bir video sırasında doğru anlarda “başla” ve “dur” demesini gerektiren Charades kıyasında).

Bu sonuçların ne kadar anlamlı olduğunu söylemek benim için zor; çünkü bu kıyaslar yeni ve henüz bağımsız olarak doğrulanmadı. Yine de mimari farklılıkların genel tablosunu ve karşılaştırılabilir kıyas sonuçlarını takip ediyorlar.

TML-Interaction-Small fiyatlandırma ve erişilebilirlik

TML-Interaction-Small şu anda sınırlı bir araştırma ön izlemesinde ve herhangi bir fiyatlandırma detayı duyurulmadı. Thinking Machines, 2026’nın ilerleyen dönemlerinde daha geniş erişim açmayı planlıyor. İlgilenen araştırmacı ve geliştiriciler erişim talebi için interaction@thinkingmachines.ai adresinden ekiple iletişime geçebilir.

Karşılaştırma için, GPT-Realtime-2, milyon başına ses girdi belirteçlerinde 32 ABD doları ve ses çıktı belirteçlerinde 64 ABD doları olarak fiyatlandırılıyor; bunu GPT-Realtime-2 genel bakışımızda ele almıştık. TML-Interaction-Small’ın fiyatlandırması muhtemelen daha geniş sürümle birlikte duyurulacaktır.

Muhtemelen fark ettiğiniz gibi modelin soneki “-Small” ve Thinking Machines’in daha büyük modellerle devam edeceğini beklemekte haklısınız. Şimdilik sunum için çok yavaşlar, ancak 2026’nın sonlarında bir sürüm planlanıyor.

TML-Interaction-Small vs. GPT-Realtime-2

İki model arasındaki daha ilginç fark etkileşim kıyaslarında. Kullanıcı kesintisi, araya girme, başkalarıyla konuşma ve arka plan konuşmasını ölçen FD-bench v1.5’te TML-Interaction-Small 77,8 puan alıyor. GPT-Realtime-2.0 minimum ayarlarda 46,8; en yüksek akıl yürütme ayarında (xhigh) 47,8 puan alıyor. Bu, Thinking Machines’in doğrudan optimize ettiği alanı ölçen kıyaslamada 30 puanlık bir fark.

Bir zekâ ödünleşimi var, ancak buradaki fark etkileşimdeki kadar büyük değil. Xhigh ayarında GPT-Realtime-2.0, Audio MultiChallenge’da %48,5 alırken TML-Interaction-Small %43,4 alıyor. BigBench Audio’da GPT-Realtime-2.0 yüksek ayarda %96,6’ya karşı TML-Interaction-Small %75,7 (ancak TML-Interaction-Small, arka plan ajanı etkinleştirildiğinde %96,5’e ulaşıyor).

Ortaya çıkan genel tablo, TML-Interaction-Small’ın tepki verebilirlik ve etkileşimde önde olduğu; buna karşılık yüksek akıl yürütme ayarlarında GPT-Realtime-2.0’ın ham zekâ kıyaslarında önde olduğudur.

| Kıyas | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 tur alma gecikmesi (sn) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 ortalama | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 yanıt kalitesi (%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR (%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio doğruluk (%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) doğruluk (%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval metin doğruluğu (%) | 89.7 | 89.6 | 95.2 | 85.8 |

* Arka plan ajanı etkinleştirildiğinde.

OpenAI’nin sesli model ailesini iş başında görmek için GPT-Realtime-2 API eğitimimize göz atın.

Son düşünceler

TML-Interaction-Small umut verici görünüyor. Sürüm notlarındaki iddiaları karşılıyorsa, yeni model kısa gecikmeyle belirgin biçimde geliştirilmiş etkileşim sunuyor ve bunu yanıt kalitesi ya da akıl yürütme gücünden ödün vermeden yapıyor. Aynı anda konuşma, dinleme ve görsel ipuçlarına tepki verme becerisi şu ana dek benzersiz ve birçok olanağın önünü açıyor. Model genel kullanıma açıldığında fiyatlandırmanın nasıl olacağını merak ediyorum.

GPT-Realtime-2 ile arasındaki zekâ farkı gerçek; ancak etkileşim farkından daha dar. Sohbetin doğal hissettirmesinin gerektiği uygulamalarda, bu gecikme farkı zekâ farkından daha fazla önem taşır. Zor akıl yürütme görevlerinde doğruluğun öncelikli olduğu uygulamalarda ise, yüksek akıl yürütme ayarlarında GPT-Realtime-2.0 hâlâ önde.

Daha geniş yapay zekâ model yelpazesi ve onlarla etkili biçimde çalışma konusunda hız kazanmak istiyorsanız, AI Fundamentals beceri rotamızla başlamanızı öneririm.

Tom bir veri bilimci ve teknik eğitmendir. DataCamp'in veri bilimi eğitim içerikleri ve blog yazılarını yazar ve yönetir. Daha önce Tom, Deutsche Telekom'da veri bilimi alanında çalıştı.