tracks

바로 지난주, OpenAI의 GPT-Realtime-2가 GPT-5급 추론과 128K 컨텍스트 윈도우를 내세우며 음성 AI의 수준을 끌어올렸습니다. 이제 Mira Murati의 Thinking Machines Lab은 다른 주장을 합니다. 반응성(responsiveness)과 지능을 음성 활동 감지(VAD) 하니스와 대화 관리 컴포넌트로 덧대는 것이 아니라, 처음부터 하나의 모델로 함께 학습시켜야 한다는 것입니다.

랩은 이러한 새로운 유형의 모델을 “인터랙션 모델(Interaction Model)”이라고 부릅니다.

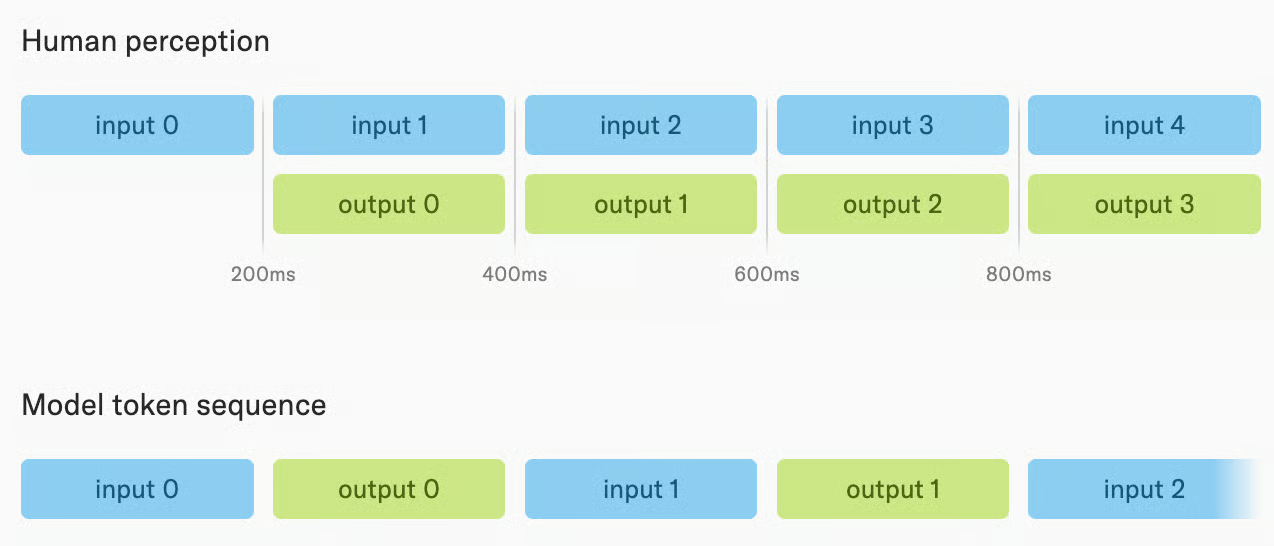

연구 프리뷰인 TML-Interaction-Small은 이 접근법의 첫 결과물입니다. 276B 파라미터의 Mixture-of-Experts 모델이며, 활성 파라미터는 12B입니다. 오디오, 비디오, 텍스트를 연속적인 200ms 마이크로 턴으로 처리하여, 화자가 말을 마칠 때까지 기다리지 않고 동시에 인지하고 응답합니다.

이 글에서는 TML-Interaction-Small이 무엇인지, 핵심 아키텍처 특징을 살펴보고, 직접 GPT-Realtime-2와 비교하며 벤치마크 결과를 자세히 살펴보겠습니다.

인터랙션 모델이란?

Thinking Machines Lab은 인터랙션 모델을, 상위 하니스가 아니라 모델 자체에 상호작용성이 내장된 시스템으로 설명합니다. 핵심 원칙은 반응성과 지능을 텍스트 기반 모델에 사후로 덧붙이는 대신, 연속적인 오디오·비디오 스트림으로 처음부터 함께 학습해야 한다는 것입니다.

대부분의 기존 실시간 음성 AI 시스템은 반응성을 흉내 내기 위해 음성 활동 감지 컴포넌트, 별도의 인코더, 대화 관리 레이어를 이어 붙입니다. Thinking Machines Lab은 이러한 접근은 비대화형 모델이 할 수 있는 일을 인위적인 턴 경계가 제한하기 때문에, 상호작용을 네이티브로 처리하는 모델에 항상 뒤처질 것이라고 주장합니다.

사용자 입력을 순차적으로 소비한 뒤 완전한 응답을 생성하는 대신, 이 랩의 인터랙션 모델은 인간 지각에 더 가깝게 설계되었습니다. 입력과 출력 토큰을 모두 스트림으로 취급하고, 둘 다 200밀리초 길이의 각 마이크로 턴에서 상호교차됩니다.

그 결과, 인터랙션 모델은 화자가 말을 마칠 때까지 기다리지 않고 입력과 출력을 병렬로 처리하며 동시에 인지하고 응답합니다. 이는 몇 가지 유용한 능력을 가능하게 합니다.

그 결과, 인터랙션 모델은 화자가 말을 마칠 때까지 기다리지 않고 입력과 출력을 병렬로 처리하며 동시에 인지하고 응답합니다. 이는 몇 가지 유용한 능력을 가능하게 합니다.

- 들으면서 말하기

- 프롬프트 없이도 시각적 신호에 반응하기

- 경과 시간을 직접 추적하기

이런 것들은 외부 하니스를 붙인 턴 기반 모델로는, 추론 능력이 아무리 좋아도 복제할 수 없습니다.

TML-Interaction-Small이란?

TML-Interaction-Small은 Thinking Machines Lab의 첫 공개 모델 릴리스이자, 인터랙션 모델 아키텍처의 첫 구현입니다.

276B 파라미터의 Mixture-of-Experts 모델로 활성 파라미터는 12B이며, 앞서 설명한 멀티 스트림 마이크로 턴 설계를 사용해 연속 오디오·비디오 스트림으로 처음부터 학습되었습니다. 입력과 출력은 200ms 청크로 처리됩니다.

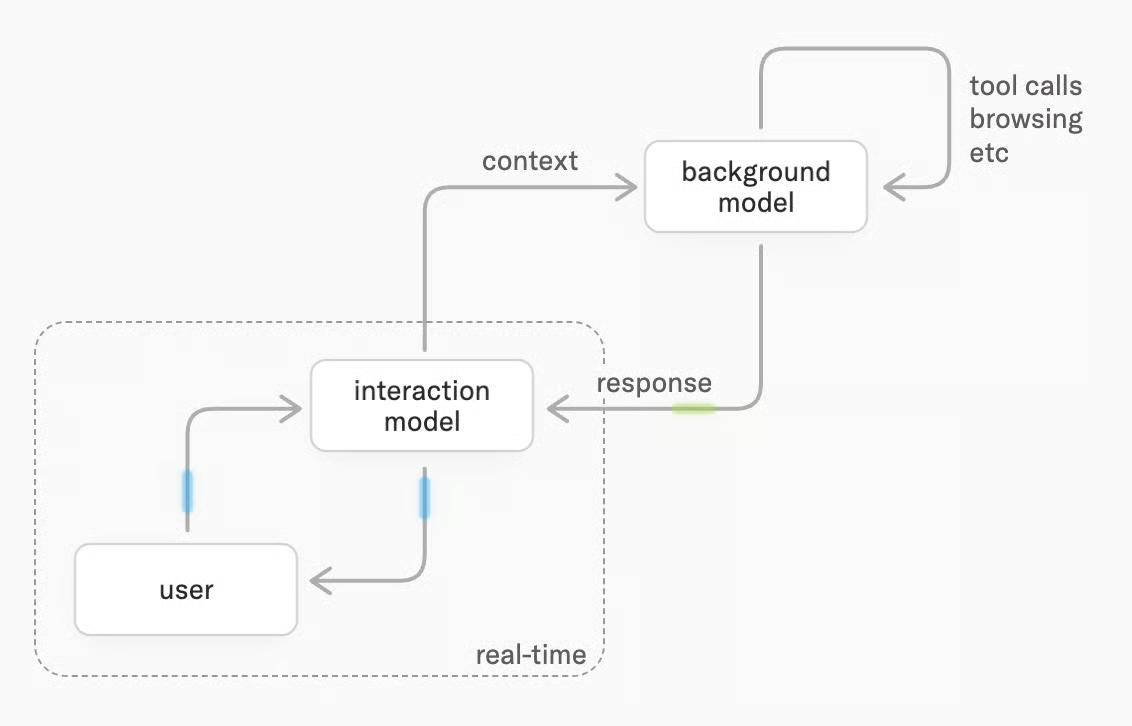

공유 컨텍스트를 가진 두 모델의 조합은 반응성과 지능을 모두 제공합니다. 사용자는 인터랙션 모델로부터 실시간으로 답변을 받는 한편, 계획 수립, 도구 사용, 더 깊은 추론은 비동기적으로 실행되는 백그라운드 모델에 위임됩니다.

그다음 인터랙션 모델은 대화에서 이탈하지 않고 도착하는 대로 백그라운드 결과를 대화에 자연스럽게 통합합니다.

TML-Interaction-Small 기능

기존 음성 AI 모델이 턴을 주고받는 방식(당신이 말하면, 그들이 응답)이라면, TML-Interaction-Small은 사람과의 대화에 더 가깝게 동작합니다. 다음은 이 모델을 돋보이게 하는 네 가지 역량입니다.

동시에 말하고 듣기

TML-Interaction-Small은 사용자가 말하는 도중에도 음성을 생성할 수 있습니다. 이를 통해 동시 통역이 가능합니다. 한 언어로 말하면, 문장을 마치기 전에 모델이 번역을 시작합니다. 또한 오류를 포착하면 문장 중간에 끼어들어 바로잡거나, 설명 중일 때도 “알겠습니다”, “계속하세요” 같은 언어적 신호를 줄 수 있습니다.

이는 특정 이벤트가 발생할 때마다 맞춤형 실시간 응답을 제공하는 데에도 유용합니다. 예를 들어 릴리스 노트의 한 클립에서는 사용자가 결제를 언급할 때마다 모델이 EUR 금액을 환산해 해당 USD 금액을 알려줍니다.

요청 없이도 비디오를 보고 반응하기

TML-Interaction-Small은 오디오와 함께 비디오를 처리하며, 언어적 프롬프트 없이 시각 정보를 보고 자발적으로 발화를 시작할 수 있습니다.

카메라 앞에서 팔굽혀펴기를 하고 있다면, 동작이 일어나는 즉시 횟수를 소리 내어 셀 수 있습니다. 비디오 스트림에 관련 객체가 나타나면 보이는 순간 바로 지적할 수 있습니다. 다만 내부 RepCount-A 점수에서 보이듯, 이 기능은 아직 개선의 여지가 있습니다. 실제 값과 한 번 차이 이내로 맞춘 비율이 3분의 1(33.4%)에 그칩니다.

한 릴리스 클립(개인적으로는 다소 엉뚱해 보입니다)은 이를 시연합니다. 사용자의 자세에 주의를 기울이라고 지시하자, 모델이 노트북 앞에서 구부정한 자세를 즉시 감지하고 교정하라고 상기시켰습니다.

기존 상용 실시간 API는 오디오 전용입니다. 발화 턴에는 반응하지만, 시각적 변화에 선제적으로 반응할 방법이 없습니다. 이 역량은 현재 GPT-Realtime-2나 Gemini Live에는 존재하지 않습니다.

자연스러운 끼어들기와 자기 교정 처리

문장을 시작했다가 생각을 바꿔 중간에 고쳐 말하더라도, TML-Interaction-Small은 교정을 추적해 실제 의도에 응답합니다. 백채널링(모델이 말하는 동안 사용자가 “음-흠”, “맞아요”라고 하는 것)을 처리하고, 모델에게 말하는 것과 방 안의 다른 사람에게 말하는 것을 구분합니다.

이런 상황은 턴 기반 모델이 자주 깨지는 지점입니다. 멈추지 말아야 할 때 멈추거나, 잘못된 부분에 응답하곤 합니다. 큐레이션된 데모 영상뿐 아니라 일상 상황에서도 TML-Interaction-Small이 이를 얼마나 잘 처리하는지 지켜볼 일입니다.

대화에 머무른 채 복잡한 작업을 백그라운드로 실행

백그라운드 모델 덕분에 인터랙션 모델은 빠를 뿐 아니라 지능적이기도 합니다. 백그라운드 작업이 진행되는 동안에도 후속 질문을 계속하거나 주제를 바꿀 수 있습니다. 결과가 준비되면, 모델은 갑작스러운 컨텍스트 전환으로 사용자를 방해하지 않고 자연스러운 순간에 대화에 녹여 넣습니다.

즉, 빠른 대화형 응답과 함께, 보통은 모델이 몇 초간 침묵해야 하는 다단계 작업도 처리할 수 있습니다. 퀴즈 데모 클립에서는 이 점이 꽤 잘 드러납니다. 세 명의 사용자가 빠른 속도로 퀴즈를 내도, 모델은 대부분 그 속도를 따라갑니다.

TML-Interaction-Small 벤치마크

Thinking Machines는 두 가지 범주에서 결과를 보고합니다. 상호작용성을 측정하는 스트리밍 벤치마크와 지능을 측정하는 턴 기반 벤치마크입니다. 이 모델이 가장 강한 성과를 보이는 곳은 스트리밍 측면으로, 아키텍처 선택이 가장 직접적으로 시험되는 영역입니다.

상호작용성

FD-bench v1.5는 사전 녹음된 오디오를 모델에 제공하고 다음 네 가지 시나리오에서의 동작을 측정합니다.

- 사용자 끼어들기

- 사용자 백채널

- 다른 사람과 대화

- 배경 발화

TML-Interaction-Small은 77.8점을 기록했으며, 최소 설정의 Gemini-3.1-flash-live-preview는 54.3점, 최소 설정의 GPT-Realtime-2.0은 46.8점입니다. GPT-Realtime-2.0은 최고 추론 설정(xhigh)에서도 47.8점에 그칩니다.

이는 Thinking Machines가 지향하는 바를 가장 직접적으로 측정하는 벤치마크입니다. 가장 가까운 경쟁자 대비 30점 차이는 미미한 차이가 아닙니다. 관건은 FD-bench v1.5가 실제로 중요한 상호작용성의 전 범위를 포착하는지 여부인데, 이는 Thinking Machines 스스로도 열린 연구 문제라고 인정합니다.

턴 전환 지연(latency)

TML-Interaction-Small은 FD-bench v1에서 턴 전환 지연 0.40초를 기록해, 비교된 모델 중 가장 빠릅니다. Gemini-3.1-flash-live-preview가 0.57초로 가장 근접합니다. 최소 설정의 GPT-Realtime-2.0은 약 세 배 느린 1.18초이며, xhigh 추론에서는 1.63초에 달합니다.

지연은 텍스트보다 음성 상호작용에서 훨씬 중요합니다. 사용자가 발화를 마친 시점과 모델이 응답을 시작하는 시점 사이 1.2초 차이는 뚜렷하게 느껴질 뿐 아니라 방해 요소가 됩니다. 0.40초 결과는 TML-Interaction-Small을 인간 대화 응답 시간에 더 가깝게 위치시킵니다.

지능과 지시 따르기

Audio MultiChallenge는 오디오에서의 지능과 지시 준수를 측정합니다. TML-Interaction-Small은 43.4%로, GPT-Realtime-1.5(34.7%)와 Gemini-3.1-flash-live-preview(26.8%)를 앞서지만, GPT-Realtime-2.0 xhigh(48.5%)보다는 낮습니다. 여기서 지능-상호작용성의 트레이드오프가 드러납니다.

TML-Interaction-Small과 GPT-Realtime-2.0 xhigh 간의 격차는 5.1%포인트입니다. 의미 있는 차이지만 아주 큰 차이는 아니며, GPT-Realtime-2.0 쪽에는 상당한 지연 비용(1.63초 대 0.40초)이 따릅니다. 그 트레이드오프가 가치 있는지는 애플리케이션에 달려 있습니다.

응답 품질과 도구 사용

FD-bench v3는 오디오+도구 시나리오에서의 응답 품질과 도구 호출 정확도를 측정합니다. 백그라운드 에이전트를 활성화한 TML-Interaction-Small은 응답 품질 82.8%, pass@1 68.0%를 기록했으며, 이는 GPT-Realtime-2.0 최소 설정의 80.0% / 52.0%, xhigh 설정의 81.0% / 58.0%와 비교됩니다.

여기서 가장 의미 있는 수치가 pass@1 격차(68.0% 대 58.0%)입니다. 모델이 실제로 도구 의존적 작업을 제대로 완료하는지를 측정하기 때문입니다. 사용자 상호작용과 도구 호출을 분리한 이중 아키텍처의 효과가 입증된 듯합니다.

새로운 상호작용성 벤치마크: TimeSpeak, CueSpeak, 시각적 선제성

Thinking Machines는 상호작용 능력을 직접 측정하기 위해 두 가지 내부 벤치마크를 만들고, 덜 널리 쓰이던 세 가지 벤치마크를 개adapt했습니다. 경쟁 모델들이 어느 것도 의미 있게 성과를 내지 못하는 영역이므로 주의 깊게 볼 가치가 있습니다.

- TimeSpeak(타이밍 기반 발화 시작): TML-Interaction-Small 매크로 정확도 64.7%.

- CueSpeak(언어적 신호 트리거 발화): TML-Interaction-Small 매크로 정확도 81.7%.

- RepCount-A(시각적 동작 카운팅): TML-Interaction-Small off-by-one 정확도 33.4%.

- ProactiveVideoQA(시각적 신호 트리거 발화): TML-Interaction-Small 31.5 PAUC(무응답 기준선 = 25.0%).

- Charades 시간적 로컬라이제이션(시각적 동작 타이밍): TML-Interaction-Small 30.4 mIoU.

이들 신규 벤치마크 대부분에서 GPT realtime-2.0은 완전히 실패해, 거의 0에 가깝거나(또는 비디오 중 적절한 순간에 “시작”, “정지”를 말해야 하는 Charades 벤치마크에서는) 아예 0을 기록합니다.

이 결과들이 얼마나 의미 있는지 단언하긴 어렵습니다. 벤치마크가 새롭고 독립 검증이 아직이기 때문입니다. 다만 아키텍처 차이와 다른 벤치마크 결과에서 보이는 일반적 그림과 일치합니다.

TML-Interaction-Small 가격과 이용 가능성

TML-Interaction-Small은 현재 제한된 연구 프리뷰 단계이며, 가격 정보는 아직 발표되지 않았습니다. Thinking Machines는 2026년 후반에 더 넓은 접근을 열 계획입니다. 관심 있는 연구자와 개발자는 interaction@thinkingmachines.ai로 연락해 접근을 요청할 수 있습니다.

비교를 위해, GPT-Realtime-2는 백만 개 오디오 입력 토큰당 32달러, 백만 개 오디오 출력 토큰당 64달러로 가격이 책정되어 있습니다. 자세한 내용은 GPT-Realtime-2 개요에서 다뤘습니다. TML-Interaction-Small의 가격은 더 넓은 공개와 함께 발표될 가능성이 큽니다.

눈치채셨겠지만 모델 이름에 “-Small” 접미사가 붙어 있으며, Thinking Machines가 더 큰 모델을 이어서 내놓을 것으로 예상하셔도 됩니다. 아직 서빙하기엔 너무 느리지만, 2026년 말에 릴리스를 계획 중입니다.

TML-Interaction-Small vs. GPT-Realtime-2

두 모델 간 더 흥미로운 간극은 상호작용성 벤치마크에서 나타납니다. 사용자 끼어들기, 백채널링, 타인에게 말하기, 배경 발화를 측정하는 FD-bench v1.5에서 TML-Interaction-Small은 77.8점을 기록했습니다. GPT-Realtime-2.0은 최소 설정에서 46.8점, 최고 추론 설정(xhigh)에서 47.8점입니다. 이는 Thinking Machines가 최적화하는 지점을 가장 직접적으로 측정하는 벤치마크에서 30점 차이입니다.

지능에서는 트레이드오프가 있지만, 간극은 상호작용성만큼 크지 않습니다. Audio MultiChallenge에서 GPT-Realtime-2.0 xhigh는 48.5%, TML-Interaction-Small은 43.4%입니다. BigBench Audio에서는 GPT-Realtime-2.0 high가 96.6%, TML-Interaction-Small은 75.7%입니다(다만 TML-Interaction-Small도 백그라운드 에이전트를 활성화하면 96.5%에 도달).

종합하면, TML-Interaction-Small은 반응성과 상호작용성에서 앞서고, GPT-Realtime-2.0은 높은 추론 설정에서 순수 지능 벤치마크에서 앞선다는 그림이 나옵니다.

| 벤치마크 | TML-Interaction-Small | GPT-Realtime-2.0 (minimal) | GPT-Realtime-2.0 (xhigh) | Gemini-3.1-flash-live (minimal) |

|---|---|---|---|---|

| FD-bench v1 턴 전환 지연(초) | 0.40 | 1.18 | 1.63 | 0.57 |

| FD-bench v1.5 평균 | 77.8 | 46.8 | 47.8 | 54.3 |

| FD-bench v3 응답 품질(%) | 82.8* | 80.0 | 81.0 | 68.5 |

| Audio MultiChallenge APR(%) | 43.4 | 37.6 | 48.5 | 26.8 |

| BigBench Audio 정확도(%) | 75.7 / 96.5* | 71.8 | 96.6 | 71.3 |

| IFEval (VoiceBench) 정확도(%) | 82.1 | 81.7 | 83.2 | 67.6 |

| IFEval 텍스트 정확도(%) | 89.7 | 89.6 | 95.2 | 85.8 |

* 백그라운드 에이전트 활성화 시.

OpenAI의 오디오 모델 제품군을 실제로 보려면 GPT-Realtime-2 API 튜토리얼을 확인하세요.

마무리 생각

TML-Interaction-Small은 유망해 보입니다. 릴리스 노트의 주장대로라면, 새로운 모델은 짧은 지연과 함께 상호작용성을 크게 개선하면서도 응답 품질이나 추론 능력을 희생하지 않습니다. 동시에 말하고 듣고 시각적 신호에 반응하는 능력은 현재로서는 독보적이며 많은 가능성을 엽니다. 공개 릴리스 시 가격이 어떻게 나올지 궁금합니다.

GPT-Realtime-2와의 지능 격차는 분명하지만, 상호작용성 격차보다는 좁습니다. 대화가 자연스러워야 하는 애플리케이션에서는 지연 차이가 지능 격차보다 더 중요합니다. 반대로, 어려운 추론 과제의 정확도가 우선이라면, 높은 추론 설정의 GPT-Realtime-2.0이 여전히 앞서 있습니다.

더 넓은 AI 모델 지형과 효과적인 활용법을 빠르게 익히고 싶다면, AI Fundamentals 스킬 트랙부터 시작해 보시기 바랍니다.

TML-Interaction-Small 자주 묻는 질문(FAQ)

인터랙션 모델이란 무엇인가요?

인터랙션 모델은 음성 활동 감지나 대화 관리 같은 외부 컴포넌트를 덧붙이는 대신, 상호작용성이 모델 자체에 내장된 음성 AI 시스템입니다. 입력과 출력을 동시에 처리하므로, 턴을 기다리는 대신 듣고 말하기를 동시에 할 수 있습니다.

Thinking Machines Lab의 배경은 무엇인가요?

Thinking Machines Lab은 OpenAI 전 CTO인 Mira Murati가 이끌고 있습니다. TML-Interaction-Small은 이 랩의 첫 공개 모델 릴리스로, 인터랙션 모델 아키텍처의 연구 프리뷰로 소개됩니다.

TML-Interaction-Small은 OpenAI의 GPT-Realtime-2와 어떻게 비교되나요?

TML-Interaction-Small은 상호작용성에서 앞서며, FD-bench v1.5에서 77.8점을 기록해 GPT-Realtime-2의 최고 설정 47.8점 대비 우위에 있고, 턴 전환 지연도 0.40초로 1.63초보다 빠릅니다. 반면 GPT-Realtime-2는 Audio MultiChallenge 같은 순수 지능 벤치마크에서 앞섭니다(48.5% vs. 43.4%).

TML-Interaction-Small은 비디오를 처리할 수 있나요?

예. 오디오와 함께 비디오를 처리하며, 사용자의 언어적 프롬프트 없이도 시각적 이벤트에 반응할 수 있습니다. 예를 들어 카메라에서 운동 횟수를 세거나, 객체가 나타나면 즉시 알려줄 수 있습니다. 이러한 시각적 선제성은 GPT-Realtime-2나 Gemini Live에는 없습니다.