Track

Wizja komputerowa od zawsze opierała się na wyraźnym rozdziale między modelami, które tworzą obrazy, a modelami, które je rozumieją. Ramy generatywne były głównym źródłem syntezy, podczas gdy architektury dyskryminacyjne koncentrowały się na klasyfikacji, segmentacji lub regresji głębi. Standardowym podejściem do każdego nowego zadania wizyjnego było wybranie architektury, dołączenie głowicy specyficznej dla zadania i dostrajanie na oznaczonych danych.

Założenie to podważa Vision Banana z Google DeepMind. Artykuł dowodzi, że generatory obrazów nauczyły się już wszystkiego, czego potrzebuje uogólniony model wizyjny, w tym segmentacji, głębi, normalnych powierzchni i nie tylko. Zdaniem autorów brakuje jedynie cienkiej warstwy dostrajania instrukcjami, aby te ukryte możliwości stały się mierzalne w benchmarkach.

W tym wpisie zacznę od wyjaśnienia, czym właściwie jest Vision Banana i dlaczego artykuł przykuł uwagę branży, a następnie omówię działanie modelu. Na koniec wskażę, co działa, co nie działa i jakie wnioski powinni wyciągnąć praktycy. Po drodze poruszę pytania, które miałem podczas lektury pracy — inni czytelnicy zapewne mają podobne.

Uwaga: samo Vision Banana nie jest publicznie dostępne. Opublikowano artykuł oraz stronę projektu. Model bazowy powstał na Nano Banana Pro i jest dostępny przez API Gemini oraz Google AI Studio.

Czym jest Vision Banana?

Vision Banana to model badawczy Google DeepMind, zbudowany przez wzięcie Nano Banana Pro (generatora tekst–obraz) i zastosowanie lekkiego dostrajania instrukcjami na mieszance jego oryginalnych danych treningowych z niewielką ilością danych do zadań wizji komputerowej.

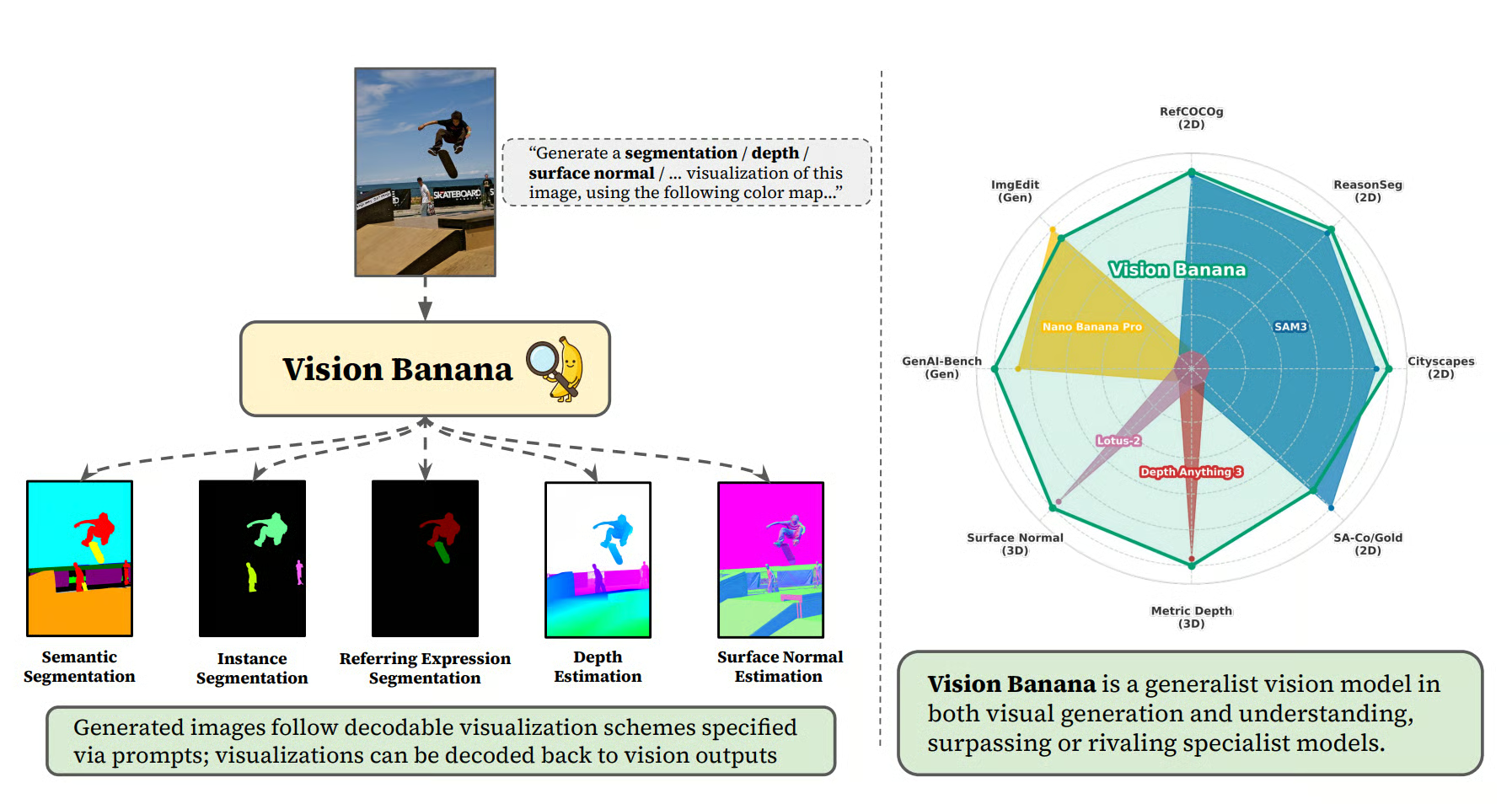

Rysunek 1: Ukryte zdolności rozumienia wizualnego u generatorów obrazów dzięki dostrajaniu instrukcjami Nano Banana Pro (Źródło)

Przepis jest następujący:

- Pozostawić bez zmian architekturę modelu bazowego

- Domieszać dane segmentacji, głębi i normalnych powierzchni do rozkładu treningowego w niskiej proporcji

- Dostroić instrukcjami

Cała metodyka treningowa nie wymaga nowej architektury, niestandardowych głowic, strat pomocniczych ani wyspecjalizowanych dekoderów.

Powstały model:

- Pokonuje SAM 3 w trzech benchmarkach segmentacji

- Pokonuje Depth Anything V3 w estymacji głębi metrycznej

- Pokonuje Lotus-2 w estymacji normalnych powierzchni

- Zachowuje jakość generowania obrazów modelu bazowego (statystyczny remis w GenAI-Bench i ImgEdit)

Wszystko to osiągnięto w rygorystycznym protokole transferu zero-shot, gwarantującym, że model nigdy nie widział zbiorów treningowych benchmarków, na których jest oceniany.

Dlaczego to ma znaczenie?

Uczenie reprezentacji w wizji testowało przez lata wiele celów wstępnego treningu. Do najczęstszych należą:

- Nadzorowana klasyfikacja (ImageNet, JFT)

- Uczenie kontrastowe (CLIP, SigLIP)

- Samodystylacja (DINO, DINOv2)

- Maskowane autoenkodowanie (MAE, BEiT)

Co istotne, żaden z nich nie jest generatywny. Generowanie obrazów historycznie traktowano jako zdolność „zstępującą”, a nie fundament rozumienia. Wczesne próby generatywnego pretreningu (iGPT, LVM) konsekwentnie odstawały od metod kontrastowych w benchmarkach jakości reprezentacji.

Skalowanie generatywnych celów autoregresyjnych poprzez przewidywanie kolejnego tokena katalizowało pojawienie się zdolności uogólnionych w trybie zero-shot w modelach takich jak GPT-3. Złożone zachowania „zstępujące” okazały się ukryte w wysokowymiarowej przestrzeni wag, a następnie wydobywane poprzez lekkie nadzorowane dostrajanie i dopasowanie instrukcyjne. Przykłady obejmują:

- Neuronalne tłumaczenie maszynowe

- Wielojęzyczną syntezę kodu

- Abstrakcyjne streszczanie

- Rozumowanie arytmetyczne

Vision Banana przekonuje, że w wizji jesteśmy w tym samym momencie. Artykuł wprost rysuje analogię między pretreningiem generowania obrazów a pretreningiem modeli językowych oraz między dostrajaniem instrukcjami a etapem dopasowania.

Jeśli analogia się utrzyma, przestaniemy budować potoki specyficzne dla zadań i potraktujemy jeden duży generator obrazów jako warstwę bazową, określając zadania za pomocą promptów.

Jak działa Vision Banana?

Mechanizm jest prosty: każde zadanie wizyjne zostaje przedefiniowane jako „wygeneruj obraz RGB o tych właściwościach”, a w czasie dekodowania deterministycznie przekształca się ten obraz RGB z powrotem w predykcje zadania.

Mapowanie dla poszczególnych zadań wygląda tak:

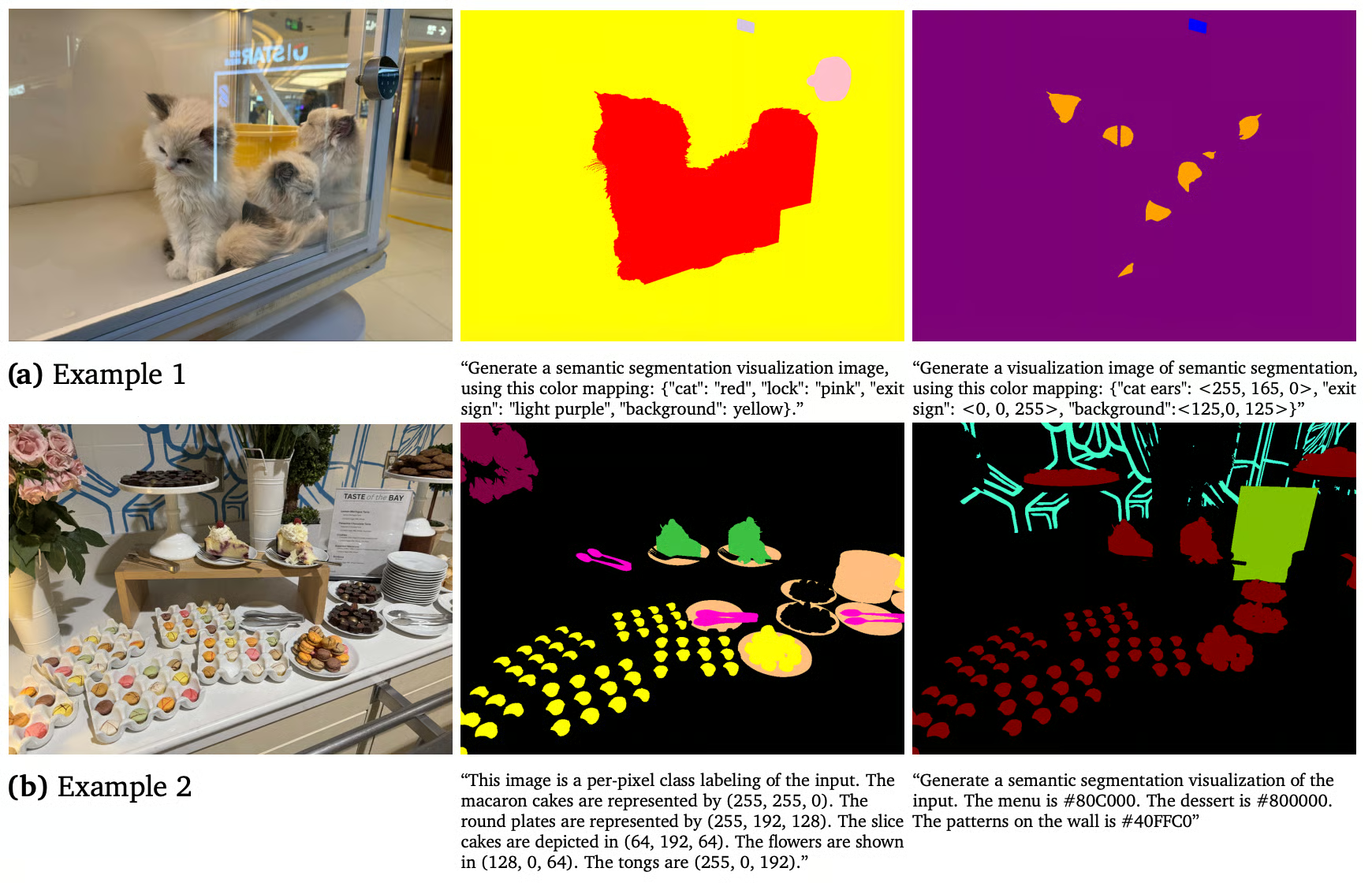

Segmentacja semantyczna

Podaj modelowi przypisania kolorów dla klas w promptcie, a przy dekodowaniu zgrupuj piksele do najbliższego określonego koloru. Słownictwo jest takie, jakie wskaże prompt; z założenia jest to słownik otwarty.

Łatwiej to zrozumieć na przykładzie. Oto prompt z artykułu:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Rysunek 2: Segmentacja semantyczna (Źródło)

Segmentacja instancji

Segmentacja instancji jest trudniejsza niż semantyczna, ponieważ liczba instancji nie jest znana z góry. Nie można więc z góry przypisać kolorów.

Rozwiązaniem Vision Banana jest wykonywanie wnioskowania po jednej klasie, pozwolenie modelowi na dynamiczne przypisywanie odrębnych kolorów różnym instancjom, a następnie klastrowanie pikseli do modów kolorów podczas dekodowania.

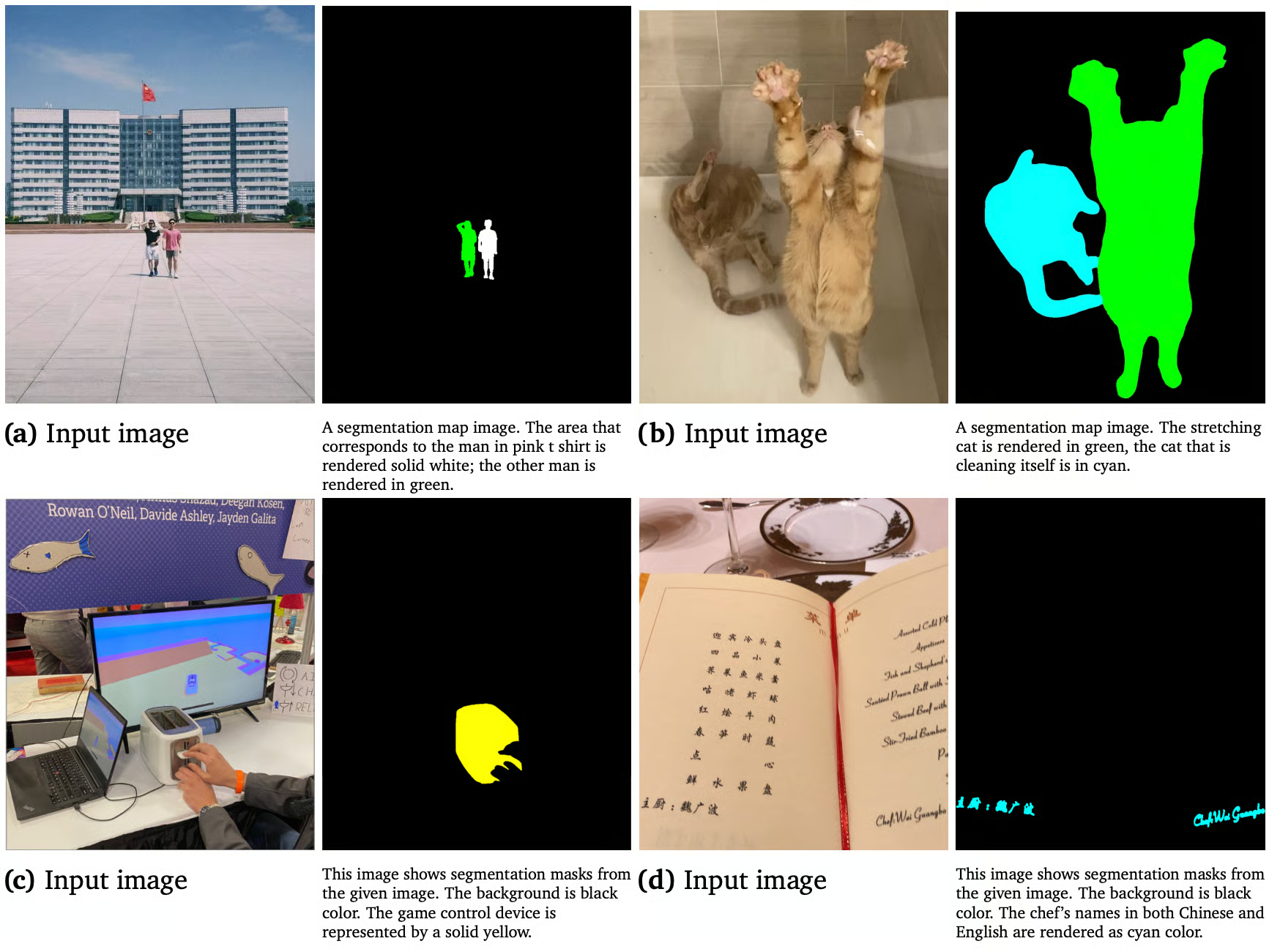

Segmentacja na podstawie wyrażeń

Vision Banana może przyjąć prompt z opisem w języku naturalnym tego, co segmentować, i zwrócić maskę. Oto przykładowy prompt z artykułu:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Tu błyszczy multimodalne rozumowanie wbudowane w generatywny pretrening. Modele dyskryminacyjne mają trudności z wyrażeniami referencyjnymi, bo zadanie wymaga łącznego rozumowania językowego i wizualnego. Modele generatywne uczone na miliardach par podpis–obraz radzą sobie z tym naturalnie.

Rysunek 3: Vision Banana rozumie prompt w języku naturalnym i potrafi o nim rozumować (Źródło)

Głębia i normalne powierzchni

Zarówno głębia, jak i normalne powierzchni są rzutowane do przestrzeni RGB poprzez bijektywne odwzorowania, co zapewnia zachowanie ukrytych własności geometrycznych bez utraty informacji podczas transformacji. W kolejnej sekcji rozbierzemy na czynniki pierwsze specyfikę kodowania głębi na RGB.

Ten ujednolicony paradygmat wnioskowania traktuje każde zadanie wizji komputerowej jako deterministyczny problem generowania obrazu. Utrzymując spójny interfejs RGB w całym potoku, model unika gałęzi architektonicznych specyficznych dla zadań, w pełni polegając na warunkowaniu przez prompt do zdefiniowania semantyki wyjścia.

Przyjrzyjmy się teraz dokładniej głębi. To miejsce, gdzie całe podejście może najłatwiej się posypać.

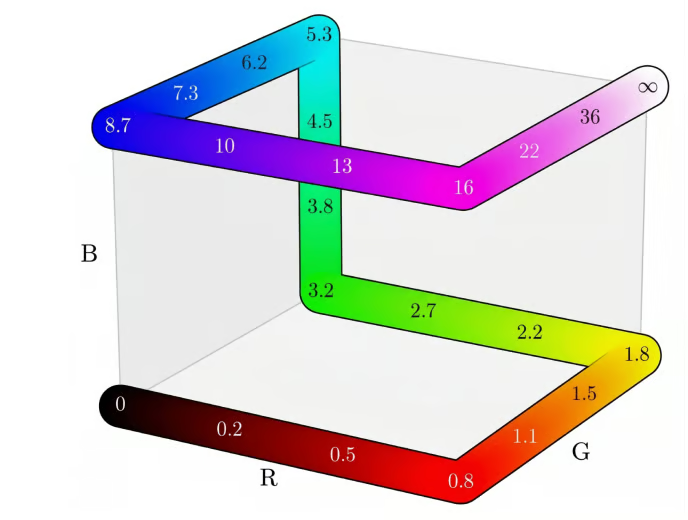

Kodowanie nieograniczonej głębi do RGB

Jeśli kodowanie nie jest bijektywne, nie da się odzyskać odległości metrycznych podczas dekodowania, a wraz z tym upada cała teza „generowania obrazu jako uniwersalnego interfejsu”. Warto to zrozumieć, bo mówi, czy podejście jest zasadnicze, czy „na skróty”.

Problem polega na tym, że wartości głębi to nieograniczone liczby rzeczywiste w [0, ∞), podczas gdy RGB jest ograniczone do [0, 1]. Aby więc użyć „wygeneruj mapę głębi” jako sygnału treningowego, potrzebne jest odwzorowanie bijektywne, w którym każdej metrycznej głębi odpowiada dokładnie jedna wartość RGB, a przy dekodowaniu można ją odwrócić z powrotem do metrów.

Podejście Vision Banana ma dwa etapy:

Etap 1: Ściśnij nieograniczoną głębię do [0, 1)

Autorzy używają transformacji potęgowej Barrona (2025) z parametrem kształtu λ = -3, co daje większą rozdzielczość dla obszarów bliskiego pola niż dalekiego. Obiekt w odległości 2 metrów otrzymuje większą precyzję niż ten w odległości 200 metrów. To odpowiada większości zastosowań, które skupiają się na obiektach „uchwytnych”, a nie odległych.

Etap 2: Odwzoruj [0, 1) na krawędzie sześcianu RGB

Następnie interpolują wzdłuż odcinkowej ścieżki liniowej, która śledzi krawędzie sześcianu RGB — zasadniczo pierwszą iterację 3D krzywej Hilberta. Daje to płynne, perceptualnie sensowne przejścia kolorów bez niejednoznaczności co do tego, jaki kolor odpowiada jakiej głębokości.

Ponieważ oba etapy są ściśle odwracalne, ich złożenie jest bijekcją. Trenują więc na zakodowanej w RGB prawdzie etykiet, a podczas wnioskowania rzutują przewidziane RGB na najbliższą krawędź sześcianu i odwracają z powrotem do metrów.

Rysunek 4: Wizualizacja naszej bijekcji między skalarnymi odległościami metrycznymi 𝑑 ≥ 0 a wartościami kolorów RGB (Źródło)

Dla odporności trening uzupełniono alternatywnymi mapami kolorów, jak Plasma, Inferno, Viridis i skala szarości, aby model radził sobie z dowolnym stylem wizualizacji, o jaki poprosisz w promptcie.

Normalne powierzchni są łatwiejsze, ponieważ już są wektorami jednostkowymi o składowych w [-1, 1], które bezpośrednio mapują się na RGB w standardowej konwencji przestrzeni kamery (+x w prawo, +y w górę, +z na zewnątrz płaszczyzny obrazu). Jasna zieleń oznacza zwrócone ku górze, czerwonawy róż — w lewo, a jasny niebiesko–fioletowy — w kierunku kamery. Bez potrzeby zniekształceń.

Uwaga: Vision Banana nie używa parametrów wewnętrznych kamery nigdzie — ani w treningu, ani we wnioskowaniu. Większość metod SOTA głębi (Depth Anything V3, MoGe-2, UniK3D, DepthLM) używa intrinsics w pewnym momencie, bo pomagają usuwać niejednoznaczność skali monokularnej.

To, że Vision Banana wnioskuje skalę absolutną wyłącznie z priorytetów wizualnych, a mimo to wygrywa, jest najsilniejszym dowodem w artykule, że generatywny pretrening wykonuje pracę geometryczną, a nie tylko dopasowuje wzorce wizualizacji widziane podczas treningu.

Modele specjalistyczne vs Vision Banana: porównanie

Najczyściej widać różnice, porównując oba paradygmaty na jednym zadaniu. Porównajmy estymację głębi podejściem specjalistycznym (Marigold, Lotus, Depth Anything V3) i Vision Banana.

Oba paradygmaty wytwarzają różne artefakty. Marigold to narzędzie wyspecjalizowane, podczas gdy Vision Banana to uogólniony model, którego szerokość kompetencji wynika z jednego kroku treningowego.

Różnice przekładają się na to, jak model jest używany w praktyce:

|

Aspekt |

Specjalista (w stylu Marigold) |

Vision Banana |

|

Format wyjścia |

Tensor specyficzny dla zadania |

Obraz RGB |

|

Słownictwo |

Ustalane w treningu |

Definiowane w promptcie |

|

Wielozadaniowość |

Jeden model na zadanie |

Jeden model, wiele zadań |

|

Parametry kamery (intrinsics) |

Często wymagane |

Nie używane |

|

Zdolność generowania |

Tracona w dostrajaniu |

Zachowana |

|

Koszt wnioskowania |

Niski |

Wysoki (pełny generator obrazów) |

Benchmarki to mieszanka wyraźnych zwycięstw i jednej uczciwej porażki. Wszystko w trybie zero-shot transfer, tzn. model nigdy nie widział zbiorów treningowych benchmarków ewaluacyjnych.

Obszary przewagi:

- Segmentacja semantyczna (Cityscapes): Osiągnięto 0,699 średniego Intersection over Union (mIoU), przewyższając wyspecjalizowany Segment Anything Model (SAM 3) z wynikiem 0,652.

- Segmentacja referencyjna (RefCOCOg): Uzyskano 0,738 cIoU (skumulowane IoU), przekraczając bazę SAM 3 Agent na poziomie 0,734.

- Złożone rozumowanie wizualne (ReasonSeg): Przy łącznym wykorzystaniu z Gemini 2.5 Pro osiągnięto 0,793 gIoU, przewyższając SAM 3 Agent (0,770) i ustanawiając nowe zero-shot SOTA, nawet względem metod w pełni nadzorowanych, nie-zero-shot.

- Estymacja głębi metrycznej: Zanotowano średnie

δ(dokładność progowa) 0,929 na czterech zróżnicowanych zbiorach, poprawiając wynik Depth Anything V3 (0,918). - Estymacja normalnych powierzchni: Zarejestrowano niższy średni błąd kątowy 15,549° na trzech zestawach wewnętrznych, wykazując wyższą wierność geometryczną niż Lotus-2 (16,558°).

Niedobór wydajności:

- Segmentacja instancji (SA-Co/Gold): Wynik 0,540 pmF1 (ocena na próbce 500 zapytań z SA-Co/Gold, nie na pełnym benchmarku), poniżej nie-zero-shot SAM 3 (0,661) i na poziomie zero-shot DINO-X (0,552). Wynik ten prawdopodobnie wynika z ograniczenia dyskretnego przypisywania kolorów do liczby instancji, co redukuje rozdzielczość w bardzo gęstych scenach.

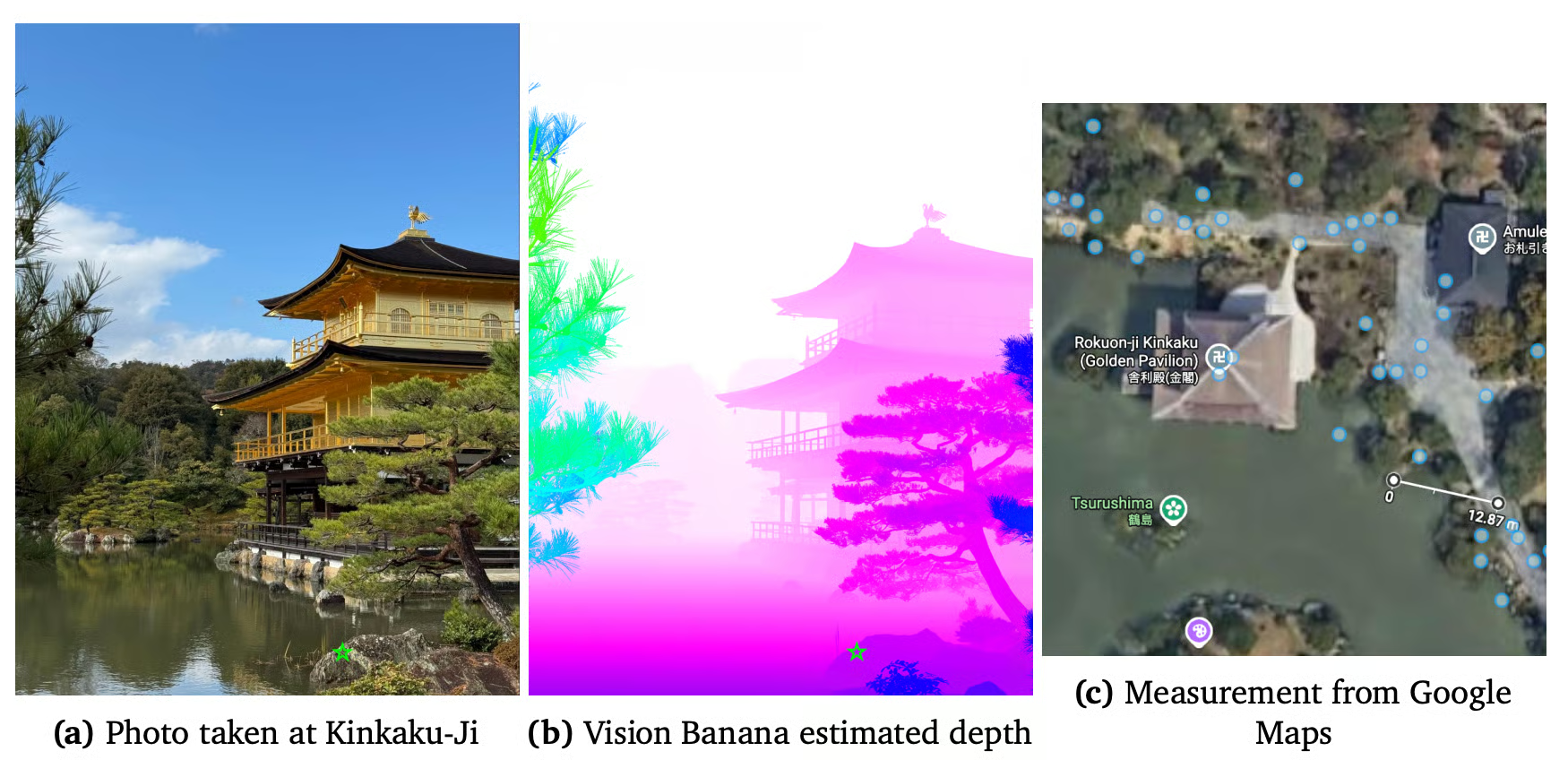

W GenAI-Bench Vision Banana wygrywa 53,5% porównań ludzkich z bazowym Nano Banana Pro. Oto przykład testu ugruntowania w warunkach rzeczywistych z artykułu:

Rysunek 5: Estymacja głębi przez Vision Banana (Źródło)

Autor zrobił zdjęcie smartfonem w pobliżu Kinkaku-ji. Vision Banana przewidziała konkretny punkt w odległości 13,71 m. Google Maps wskazuje 12,87 m, co daje 6,5% bezwzględnego błędu względnego na zdjęciu z telefonu bez kalibracji, parametrów wewnętrznych czy przygotowania. To rodzaj testu, który lepiej przewiduje zachowanie w wdrożeniu niż same liczby z benchmarków.

Ograniczenia Vision Banana

Vision Banana ma cztery ograniczenia warte odnotowania. Obejmują one:

- Koszt: Uruchamianie modelu o skali Nano Banana Pro przy każdym wnioskowaniu jest zdecydowanie droższe niż uruchamianie zdystylowanego specjalisty od głębi. Artykuł wprost to przyznaje w sekcji Future Work. Dla 10 tys. klatek wideo podejście to dziś nie jest ekonomicznie konkurencyjne. Oczywistym kolejnym krokiem jest dystylacja do mniejszych specjalistów.

- Sceny z wieloma instancjami: SA-Co/Gold to wyraźna porażka. Przypisywanie kolorów per klasa wyczerpuje możliwości, gdy trzeba precyzyjnie policzyć wiele małych obiektów. SAM 3 nadal tu wygrywa.

- Obraz pojedynczy: Obecna implementacja modelu jest zasadniczo ograniczona do statycznych, jednowidokowych wejść obrazowych, bez zdolności do przetwarzania wielowidokowego lub czasoprzestrzennego. Rozumowanie temporalne autorzy odłożyli na przyszłość.

- Wdrożenie w formie czarnej skrzynki: Nie można sondować, modyfikować ani uruchamiać modelu prywatnie. Ma to znaczenie w kontekstach regulowanych lub wrażliwych na własność intelektualną, gdzie korzystanie z czołowego API nie wchodzi w grę.

Wnioski końcowe

Vision Banana to konkretny dowód, że generatory obrazów wykonują już ciężką pracę związaną ze zrozumieniem wizualnym, a wydobycie tych możliwości wymaga dopasowania, a nie nowych architektur.

Szczegółowe wkłady artykułu to

- Bijektywne kodowanie RGB, które czyni głębię i segmentację odwracalnymi problemami generowania obrazów

- Lekka recepta na dostrajanie instrukcjami, która dodaje umiejętności wizyjne bez „spalenia” priory generacyjnej

- Estymacja głębi metrycznej bez parametrów wewnętrznych kamery, przewyższająca specjalistów, którzy ich wymagają

- Rygorystyczny protokół transferu zero-shot, który pozwala mierzyć tezę o uogólnieniu na standardowych benchmarkach.

Artykuł promuje też mentalny model „najpierw generowanie”, gdzie zadania specyfikuje się promptem, a wyjścia dekoduje z powrotem z obrazów RGB, i gdzie te same wagi obsługują zarówno tworzenie, jak i parsowanie treści wizualnych.

Można przetestować prompty ze strony projektu na bazowym Nano Banana Pro lub Nano Banana 2, aby zobaczyć, co jest już dostępne bez dostrajania instrukcjami, oraz budować funkcje segmentation-by-reasoning z modelami klasy NBP i multimodalnym routerem LLM zamiast od razu trenować niestandardowe potoki.

Vision Banana — najczęstsze pytania

Jak mogę korzystać z Vision Banana już dziś?

Nie. Artykuł i strona projektu są dostępne, ale wagi modelu znajdują się w Google DeepMind. Model bazowy, Nano Banana Pro, jest dostępny w Gemini API i AI Studio, a sama teza artykułu sugeruje, że bezpośrednie promptowanie NBP przy użyciu promptów ze strony projektu powinno już dawać sensowne wyniki.

Czy Vision Banana może zastąpić SAM 3 lub Depth Anything?

Nie dziś, głównie z powodu kosztów. W zastosowaniach, gdzie trzeba tanio uruchamiać wnioskowanie wizji na skalę (wideo, czas rzeczywisty, mobile), specjaliści nadal wygrywają ekonomią.

Jak to się ma do MLLM-ów, takich jak GPT-5V czy Gemini 2.5?

Multimodalne LLM-y przyjmują obraz i generują tekst. Vision Banana przyjmuje obraz i prompt, aby wygenerować obraz. Rozwiązują różne problemy.

Dlaczego Vision Banana nie używa parametrów wewnętrznych kamery do głębi?

Większość specjalistów używa parametrów wewnętrznych kamery, aby usuwać niejednoznaczność skali monokularnej (mały obiekt z bliska i duży z daleka mogą dawać identyczne piksele). Natomiast Vision Banana wnioskuje skalę z priorytetów wizualnych wyuczonych podczas generatywnego pretreningu na rozmiarach obiektów, kontekście scen i wiedzy o świecie.